Membangun platform operasi pembelajaran mesin (MLOps) dalam lanskap kecerdasan buatan (AI) dan pembelajaran mesin (ML) yang berkembang pesat bagi organisasi sangat penting untuk menjembatani kesenjangan antara eksperimen dan penerapan ilmu data sekaligus memenuhi persyaratan seputar kinerja model. keamanan, dan kepatuhan.

Untuk memenuhi persyaratan peraturan dan kepatuhan, persyaratan utama saat merancang platform tersebut adalah:

- Mengatasi penyimpangan data

- Pantau kinerja model

- Memfasilitasi pelatihan ulang model otomatis

- Menyediakan proses untuk persetujuan model

- Simpan model di lingkungan yang aman

Dalam postingan ini, kami menunjukkan cara membuat kerangka kerja MLOps untuk memenuhi kebutuhan ini saat menggunakan kombinasi layanan AWS dan perangkat pihak ketiga. Solusi ini memerlukan pengaturan multi-lingkungan dengan pelatihan ulang model otomatis, inferensi batch, dan pemantauan Monitor Model Amazon SageMaker, membuat versi model dengan Registri Model SageMaker, dan pipeline CI/CD untuk memfasilitasi promosi kode ML dan pipeline di seluruh lingkungan dengan menggunakan Amazon SageMaker, Jembatan Acara Amazon, Layanan Pemberitahuan Sederhana Amazon (Amazon S3), Terraform HashiCorp, GitHub, dan Jenkins CI/CD. Kami membangun model untuk memprediksi tingkat keparahan (jinak atau ganas) dari lesi massa mamografi yang dilatih dengan Algoritma XGBoost menggunakan yang tersedia untuk umum Massa Mamografi UCI kumpulan data dan menyebarkannya menggunakan kerangka kerja MLOps. Instruksi lengkap dengan kode tersedia di Repositori GitHub.

Ikhtisar solusi

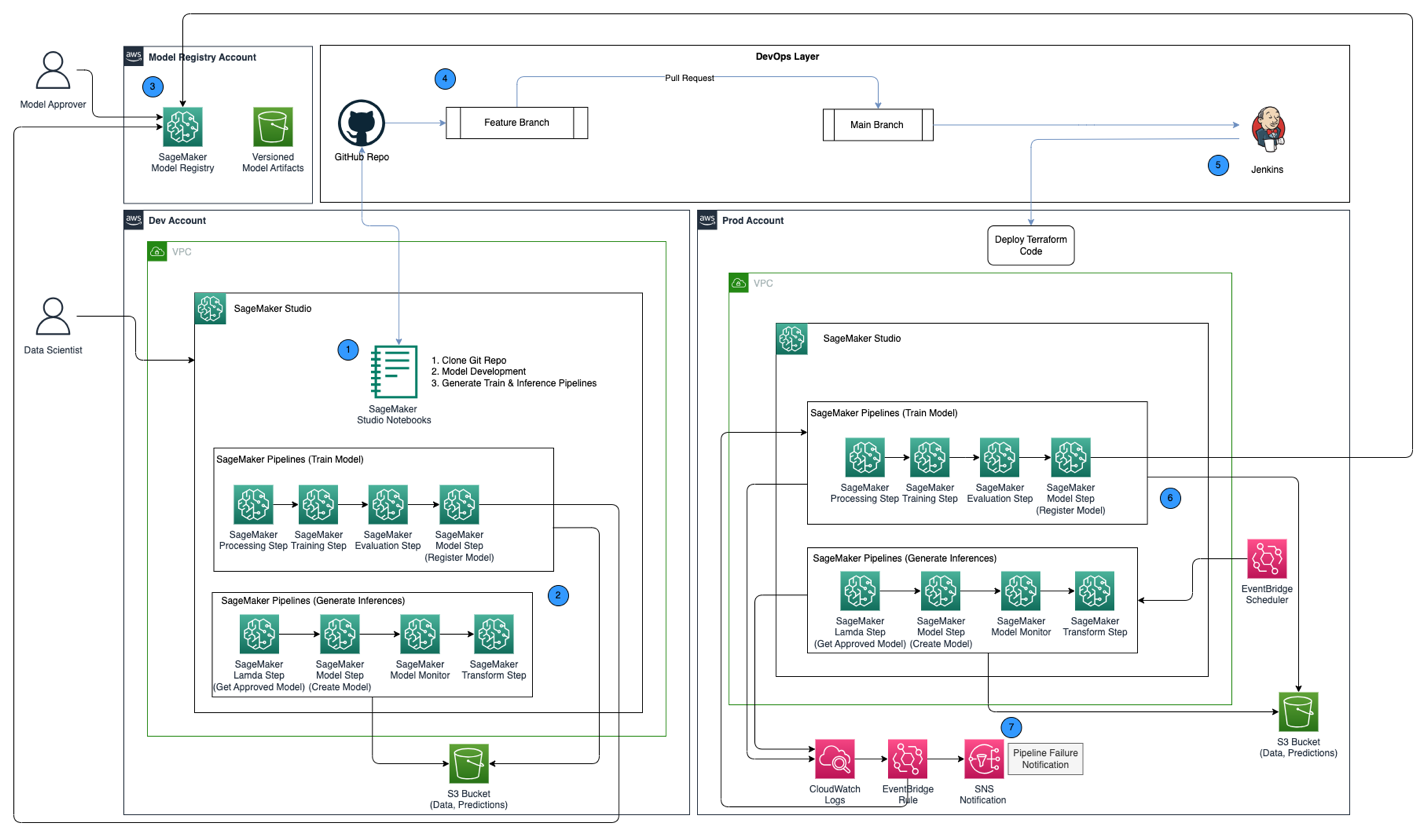

Diagram arsitektur berikut menunjukkan gambaran umum kerangka MLOps dengan komponen utama berikut:

- Strategi multi akun – Dua lingkungan berbeda (dev dan prod) disiapkan di dua akun AWS berbeda dengan mengikuti praktik terbaik AWS Well-Architected, dan akun ketiga disiapkan di registri model pusat:

- lingkungan pengembang – Dimana sebuah Domain Amazon SageMaker Studio disiapkan untuk memungkinkan pengembangan model, pelatihan model, dan pengujian pipeline ML (pelatihan dan inferensi), sebelum model siap untuk dipromosikan ke lingkungan yang lebih tinggi.

- Lingkungan produksi – Dimana pipeline ML dari dev dipromosikan sebagai langkah pertama, dan dijadwalkan serta dipantau dari waktu ke waktu.

- Registri model pusat - Registri Model Amazon SageMaker diatur dalam akun AWS terpisah untuk melacak versi model yang dihasilkan di seluruh lingkungan pengembangan dan produksi.

- CI/CD dan kontrol sumber – Penerapan pipeline ML di seluruh lingkungan ditangani melalui penyiapan CI/CD dengan Jenkins, bersama dengan kontrol versi yang ditangani melalui GitHub. Perubahan kode yang digabungkan ke lingkungan terkait cabang git memicu alur kerja CI/CD untuk membuat perubahan yang sesuai pada lingkungan target tertentu.

- Prediksi batch dengan pemantauan model – Saluran inferensi dibuat dengan Pipa Amazon SageMaker berjalan secara terjadwal untuk menghasilkan prediksi beserta pemantauan model menggunakan SageMaker Model Monitor untuk mendeteksi penyimpangan data.

- Mekanisme pelatihan ulang otomatis – Pipeline pelatihan yang dibangun dengan SageMaker Pipelines dipicu setiap kali penyimpangan data terdeteksi di pipeline inferensi. Setelah dilatih, model didaftarkan ke dalam registri model pusat untuk disetujui oleh pemberi persetujuan model. Jika disetujui, versi model yang diperbarui digunakan untuk menghasilkan prediksi melalui jalur inferensi.

- Infrastruktur sebagai kode – Infrastruktur sebagai kode (IaC), dibuat menggunakan Terraform HashiCorp, mendukung penjadwalan alur inferensi dengan EventBridge, yang memicu alur kereta berdasarkan Aturan EventBridge dan mengirim notifikasi menggunakan Layanan Pemberitahuan Sederhana Amazon (Amazon SNS) topik.

Alur kerja MLOps mencakup langkah-langkah berikut:

- Akses domain SageMaker Studio di akun pengembangan, kloning repositori GitHub, lakukan proses pengembangan model menggunakan model sampel yang disediakan, dan buat alur pelatihan dan inferensi.

- Jalankan alur kereta di akun pengembangan, yang menghasilkan artefak model untuk versi model terlatih dan mendaftarkan model ke SageMaker Model Registry di akun registri model pusat.

- Setujui model di SageMaker Model Registry di akun registri model pusat.

- Dorong kode (jalur pelatihan dan inferensi, serta kode IaC Terraform untuk membuat jadwal EventBridge, aturan EventBridge, dan topik SNS) ke dalam cabang fitur repositori GitHub. Buat permintaan tarik untuk menggabungkan kode ke dalam cabang utama repositori GitHub.

- Memicu alur Jenkins CI/CD, yang disiapkan dengan repositori GitHub. Pipeline CI/CD menyebarkan kode ke akun prod untuk membuat pipeline train dan inferensi bersama dengan kode Terraform untuk menyediakan jadwal EventBridge, aturan EventBridge, dan topik SNS.

- Pipeline inferensi dijadwalkan untuk dijalankan setiap hari, sedangkan pipeline train disiapkan untuk dijalankan setiap kali penyimpangan data terdeteksi dari pipeline inferensi.

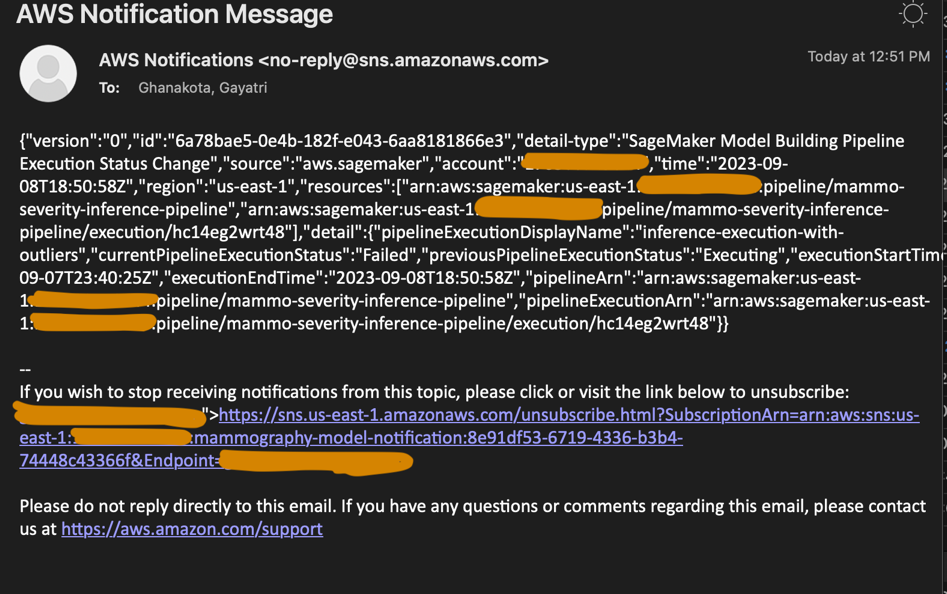

- Notifikasi dikirim melalui topik SNS setiap kali terjadi kegagalan pada train atau pipeline inferensi.

Prasyarat

Untuk solusi ini, Anda harus memiliki prasyarat berikut:

- Tiga akun AWS (akun registri model dev, prod, dan pusat)

- Domain SageMaker Studio disiapkan di masing-masing dari tiga akun AWS (lihat Masuk ke Amazon SageMaker Studio atau tonton videonya Onboard dengan Cepat ke Amazon SageMaker Studio untuk petunjuk pengaturan)

- Jenkins (kami menggunakan Jenkins 2.401.1) dengan hak administratif yang diinstal di AWS

- Terraform versi 1.5.5 atau lebih baru diinstal di server Jenkins

Untuk posting ini, kami bekerja di us-east-1 Wilayah untuk menyebarkan solusi.

Menyediakan kunci KMS di akun dev dan prod

Langkah pertama kami adalah menciptakan Layanan Manajemen Kunci AWS (AWS KMS) kunci di akun dev dan prod.

Buat kunci KMS di akun dev dan berikan akses ke akun prod

Selesaikan langkah-langkah berikut untuk membuat kunci KMS di akun dev:

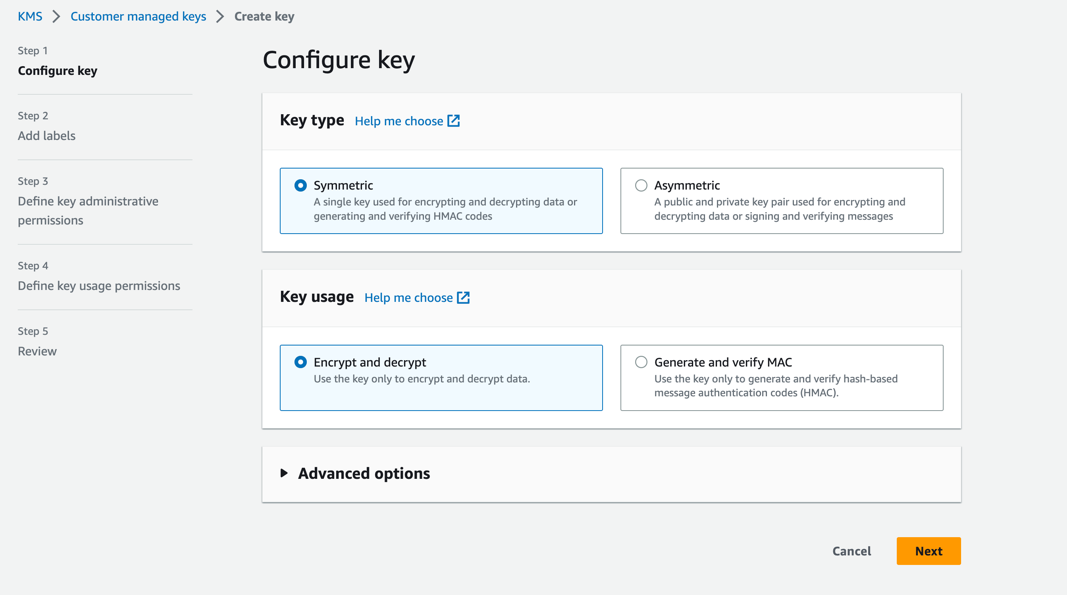

- Di konsol AWS KMS, pilih Kunci yang dikelola pelanggan di panel navigasi.

- Pilih Buat kunci.

- Untuk Jenis kunci, pilih Simetris.

- Untuk Penggunaan kunci, pilih Enkripsi dan dekripsi.

- Pilih Selanjutnya.

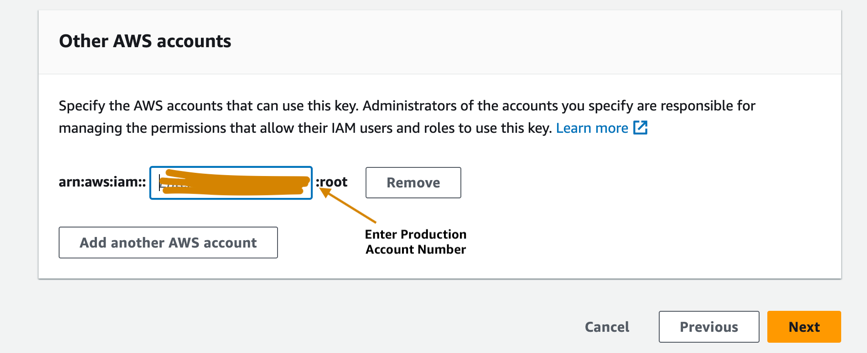

- Masukkan nomor akun produksi untuk memberikan akses akun produksi ke kunci KMS yang disediakan di akun dev. Ini adalah langkah yang diperlukan karena pertama kali model dilatih di akun dev, artefak model dienkripsi dengan kunci KMS sebelum ditulis ke bucket S3 di akun registri model pusat. Akun produksi memerlukan akses ke kunci KMS untuk mendekripsi artefak model dan menjalankan pipa inferensi.

- Pilih Selanjutnya dan selesaikan pembuatan kunci Anda.

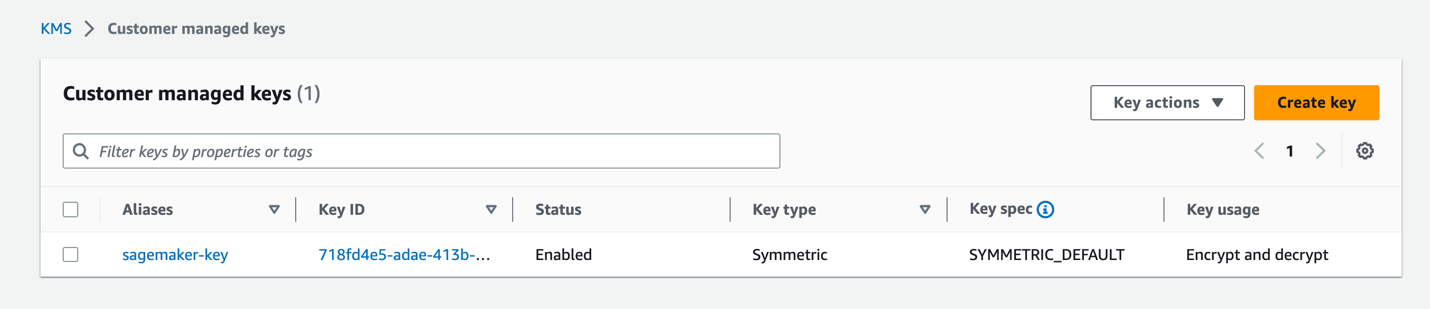

Setelah kunci disediakan, kunci tersebut akan terlihat di konsol AWS KMS.

Buat kunci KMS di akun prod

Lakukan langkah yang sama di bagian sebelumnya untuk membuat kunci KMS yang dikelola pelanggan di akun prod. Anda dapat melewati langkah untuk membagikan kunci KMS ke akun lain.

Siapkan bucket S3 artefak model di akun registri model pusat

Buat bucket S3 pilihan Anda dengan string sagemaker dalam konvensi penamaan sebagai bagian dari nama bucket di akun registri model pusat, dan perbarui kebijakan bucket di bucket S3 untuk memberikan izin dari akun dev dan prod untuk membaca dan menulis artefak model ke dalam bucket S3.

Kode berikut adalah kebijakan bucket yang akan diperbarui pada bucket S3:

Siapkan IAM role di akun AWS Anda

Langkah selanjutnya adalah mengatur Identitas AWS dan Manajemen Akses (IAM) peran di akun AWS Anda dengan izin untuk AWS Lambda, SageMaker, dan Jenkins.

Peran eksekusi Lambda

Mendirikan Peran eksekusi Lambda di akun dev dan prod, yang akan digunakan oleh fungsi Lambda yang dijalankan sebagai bagian dari Langkah Lambda Jalur Pipa SageMaker. Langkah ini akan dijalankan dari pipeline inferensi untuk mengambil model terbaru yang disetujui, yang akan digunakan untuk menghasilkan inferensi. Buat peran IAM di akun dev dan prod dengan konvensi penamaan arn:aws:iam::<account-id>:role/lambda-sagemaker-role dan lampirkan kebijakan IAM berikut:

- Kebijakan 1 – Buat kebijakan inline bernama

cross-account-model-registry-access, yang memberikan akses ke paket model yang diatur dalam registri model di akun pusat: - Kebijakan 2 - Menempel AmazonSageMakerAkses Penuh, yang merupakan kebijakan yang dikelola AWS yang memberikan akses penuh ke SageMaker. Ini juga menyediakan akses tertentu ke layanan terkait, seperti Penskalaan Otomatis Aplikasi AWS, Amazon S3, Registry Kontainer Elastis Amazon (Amazon ECR), dan Log Amazon CloudWatch.

- Kebijakan 3 - Menempel AWSLambda_Akses Penuh, yang merupakan kebijakan terkelola AWS yang memberikan akses penuh ke Lambda, fitur konsol Lambda, dan layanan AWS terkait lainnya.

- Kebijakan 4 – Gunakan kebijakan kepercayaan IAM berikut untuk peran IAM:

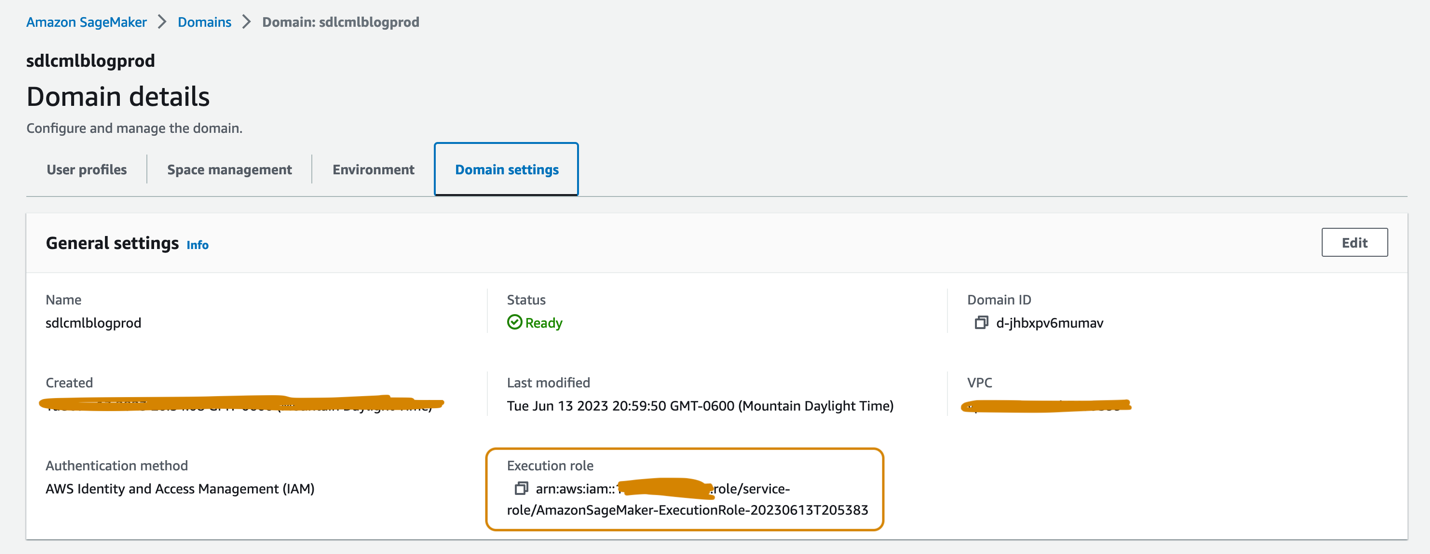

Peran eksekusi SageMaker

Domain SageMaker Studio yang disiapkan di akun dev dan prod masing-masing harus memiliki peran eksekusi yang terkait, yang dapat ditemukan di setting domain tab di halaman detail domain, seperti yang ditunjukkan pada tangkapan layar berikut. Peran ini digunakan untuk menjalankan tugas pelatihan, tugas pemrosesan, dan lainnya dalam domain SageMaker Studio.

Tambahkan kebijakan berikut ke peran eksekusi SageMaker di kedua akun:

- Kebijakan 1 – Buat kebijakan inline bernama

cross-account-model-artifacts-s3-bucket-access, yang memberikan akses ke bucket S3 di akun registri model pusat, yang menyimpan artefak model: - Kebijakan 2 – Buat kebijakan inline bernama

cross-account-model-registry-access, yang memberikan akses ke paket model di registri model di akun registri model pusat: - Kebijakan 3 – Buat kebijakan inline bernama

kms-key-access-policy, yang memberikan akses ke kunci KMS yang dibuat pada langkah sebelumnya. Berikan ID akun tempat kebijakan dibuat dan ID kunci KMS yang dibuat di akun tersebut. - Kebijakan 4 - Menempel AmazonSageMakerAkses Penuh, yang merupakan kebijakan yang dikelola AWS yang memberikan akses penuh ke SageMaker dan memilih akses ke layanan terkait.

- Kebijakan 5 - Menempel AWSLambda_Akses Penuh, yang merupakan kebijakan terkelola AWS yang memberikan akses penuh ke Lambda, fitur konsol Lambda, dan layanan AWS terkait lainnya.

- Kebijakan 6 - Menempel CloudWatchEventsAkses Penuh, yang merupakan kebijakan terkelola AWS yang memberikan akses penuh ke CloudWatch Events.

- Kebijakan 7 – Tambahkan kebijakan kepercayaan IAM berikut untuk IAM role eksekusi SageMaker:

- Kebijakan 8 (khusus untuk peran eksekusi SageMaker di akun prod) – Buat kebijakan inline bernama

cross-account-kms-key-access-policy, yang memberikan akses ke kunci KMS yang dibuat di akun dev. Hal ini diperlukan agar alur inferensi membaca artefak model yang disimpan di akun registri model pusat tempat artefak model dienkripsi menggunakan kunci KMS dari akun dev ketika versi pertama model dibuat dari akun dev.

Peran Jenkins lintas akun

Siapkan peran IAM yang disebut cross-account-jenkins-role di akun prod, yang akan diasumsikan oleh Jenkins untuk menerapkan pipeline ML dan infrastruktur terkait ke dalam akun prod.

Tambahkan kebijakan IAM terkelola berikut ke peran tersebut:

CloudWatchFullAccessAmazonS3FullAccessAmazonSNSFullAccessAmazonSageMakerFullAccessAmazonEventBridgeFullAccessAWSLambda_FullAccess

Perbarui hubungan kepercayaan pada peran untuk memberikan izin ke akun AWS yang menghosting server Jenkins:

Perbarui izin pada IAM role yang terkait dengan server Jenkins

Dengan asumsi bahwa Jenkins telah diatur di AWS, perbarui peran IAM yang terkait dengan Jenkins untuk menambahkan kebijakan berikut, yang akan memberi Jenkins akses untuk menerapkan sumber daya ke akun prod:

- Kebijakan 1 – Buat kebijakan inline berikut bernama

assume-production-role-policy: - Kebijakan 2 – Lampirkan

CloudWatchFullAccesskebijakan IAM yang dikelola.

Siapkan grup paket model di akun registri model pusat

Dari domain SageMaker Studio di akun registri model pusat, buat grup paket model yang disebut mammo-severity-model-package menggunakan cuplikan kode berikut (yang dapat Anda jalankan menggunakan notebook Jupyter):

Siapkan akses ke paket model untuk peran IAM di akun dev dan prod

Menyediakan akses ke peran eksekusi SageMaker yang dibuat di akun dev dan prod sehingga Anda dapat mendaftarkan versi model dalam paket model mammo-severity-model-package di registri model pusat dari kedua akun. Dari domain SageMaker Studio di akun registri model pusat, jalankan kode berikut di notebook Jupyter:

Siapkan Jenkins

Di bagian ini, kami mengonfigurasi Jenkins untuk membuat pipeline ML dan infrastruktur Terraform yang sesuai di akun prod melalui pipeline Jenkins CI/CD.

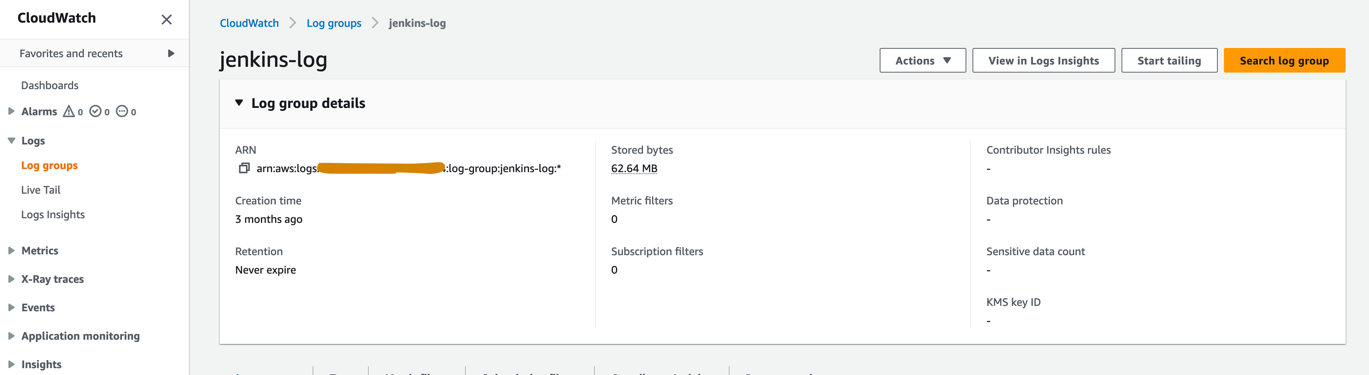

- Di konsol CloudWatch, buat grup log bernama

jenkins-logdalam akun prod tempat Jenkins akan mengirim log dari pipeline CI/CD. Grup log harus dibuat di Wilayah yang sama dengan tempat server Jenkins disiapkan.

- Instal plugin berikut di server Jenkins Anda:

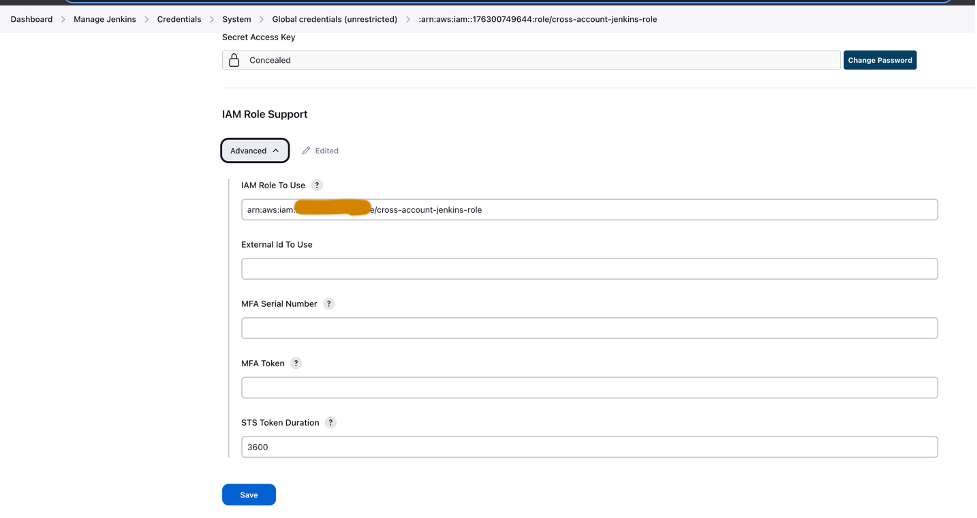

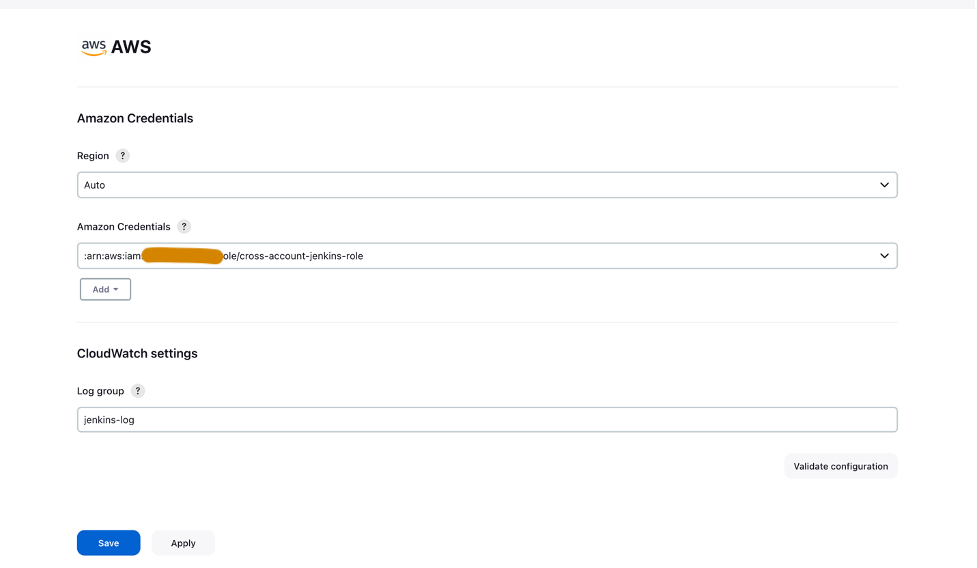

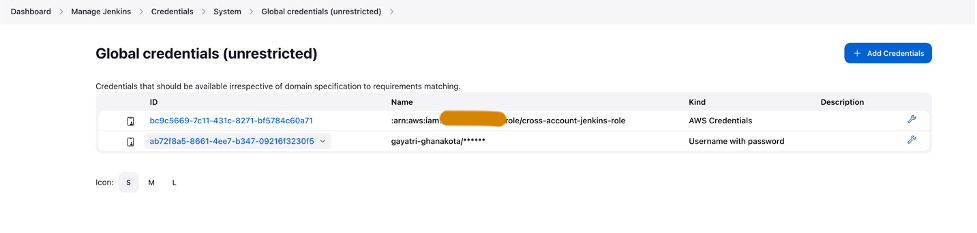

- Siapkan kredensial AWS di Jenkins menggunakan IAM role lintas akun (

cross-account-jenkins-role) disediakan di akun prod.

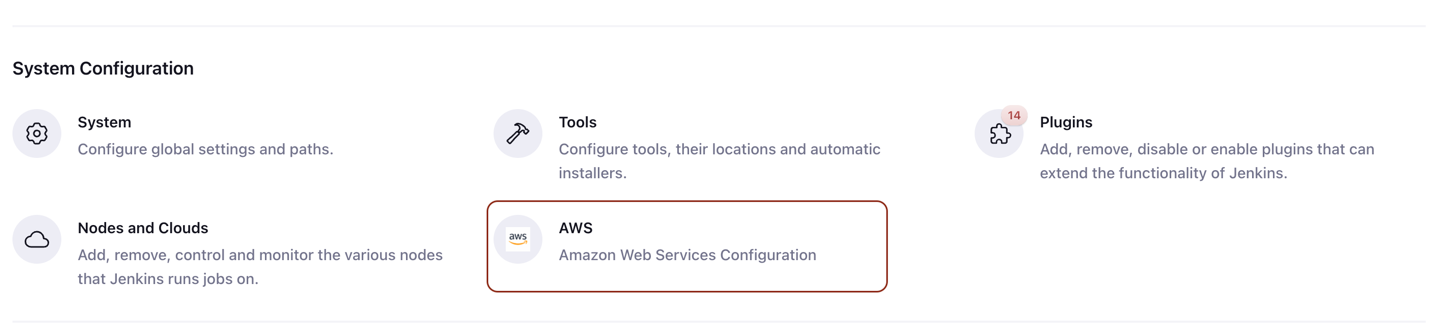

- Untuk system Configuration, pilih AWS.

- Berikan kredensial dan grup log CloudWatch yang Anda buat sebelumnya.

- Siapkan kredensial GitHub dalam Jenkins.

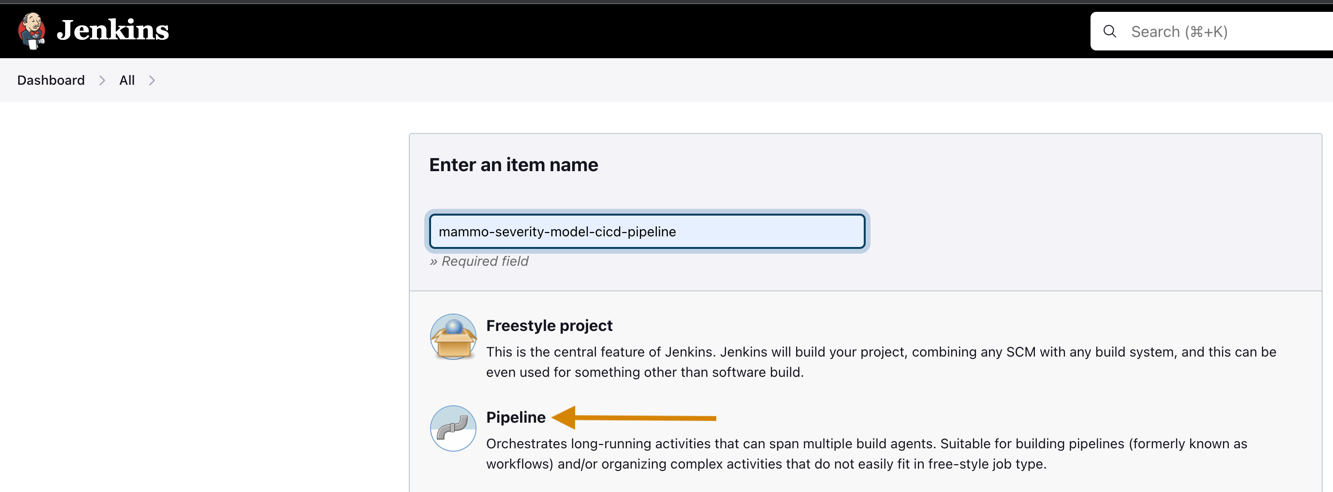

- Buat proyek baru di Jenkins.

- Masukkan nama proyek dan pilih Pipa saluran.

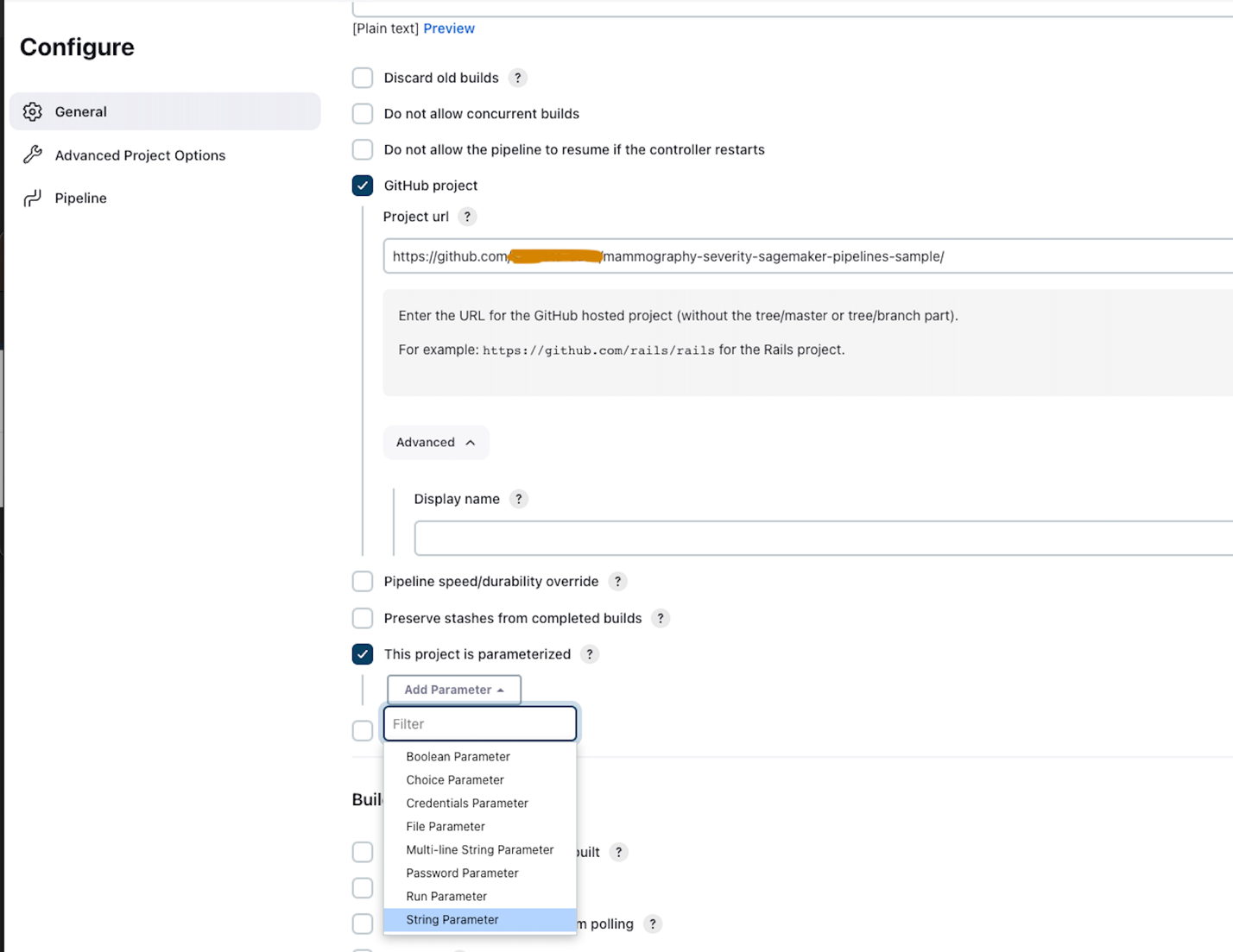

- pada Umum tab, pilih Proyek GitHub dan masukkan bercabang Repositori GitHub URL.

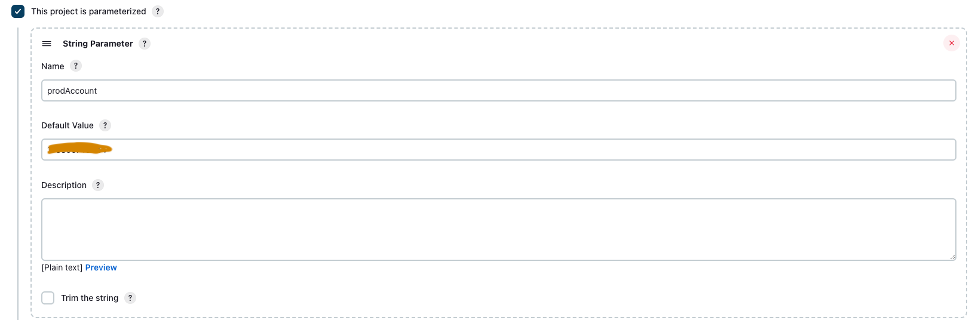

- Pilih Proyek ini diparameterisasi.

- pada Tambahkan Parameter menu, pilih Parameter Tali.

- Untuk Nama, Masuk

prodAccount. - Untuk Nilai default, masukkan ID akun prod.

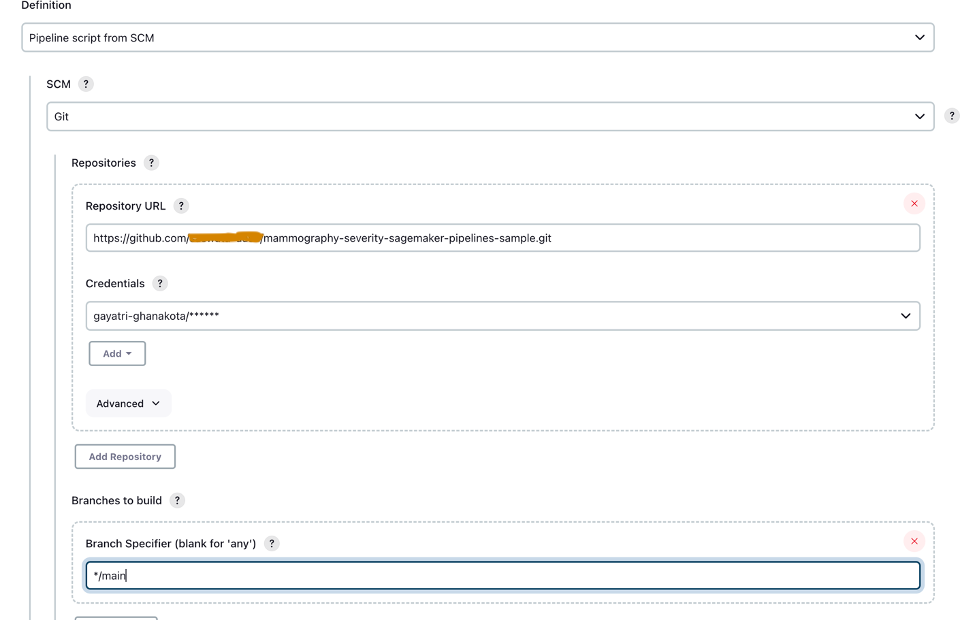

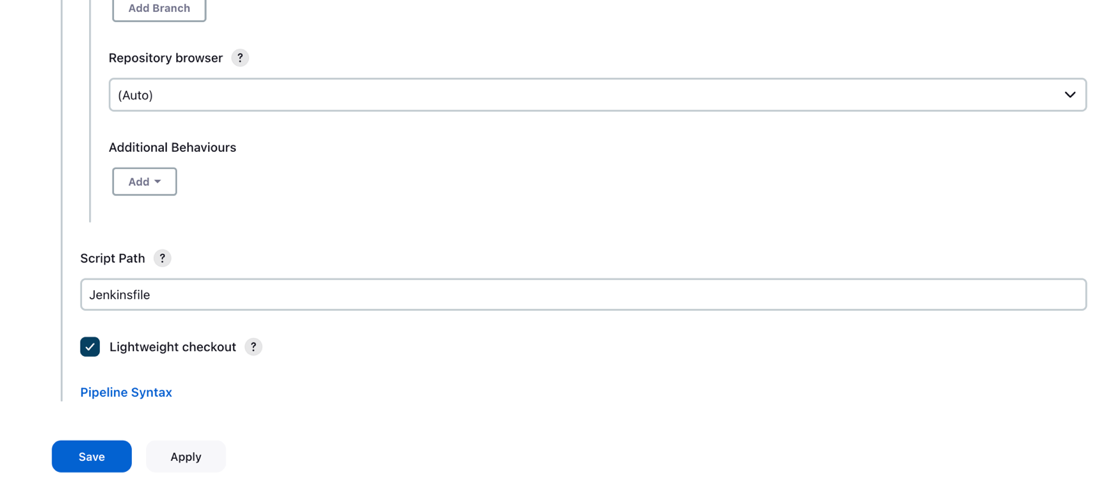

- Bawah Opsi Proyek Tingkat Lanjut, Untuk Definisi, pilih Skrip saluran pipa dari SCM.

- Untuk SCM, pilih pergi.

- Untuk URL repositori, masukkan bercabang Repositori GitHub URL.

- Untuk Surat kepercayaan, masukkan kredensial GitHub yang disimpan di Jenkins.

- Enter

maindalam Cabang untuk dibangun bagian, berdasarkan saluran CI/CD mana yang akan dipicu.

- Untuk Jalur Skrip, Masuk

Jenkinsfile. - Pilih Save.

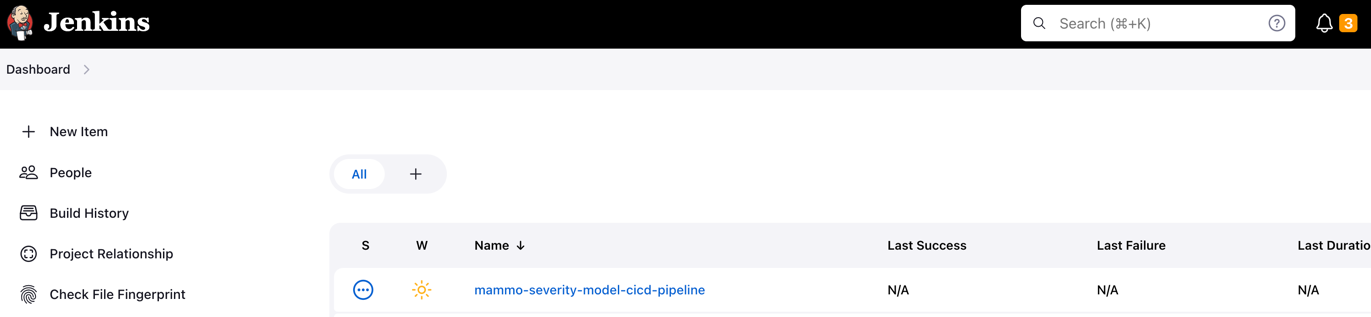

Pipeline Jenkins harus dibuat dan terlihat di dasbor Anda.

Sediakan bucket S3, kumpulkan dan siapkan data

Selesaikan langkah-langkah berikut untuk menyiapkan bucket dan data S3 Anda:

- Buat bucket S3 pilihan Anda dengan string

sagemakerdalam konvensi penamaan sebagai bagian dari nama keranjang di akun dev dan prod untuk menyimpan kumpulan data dan artefak model. - Siapkan bucket S3 untuk mempertahankan status Terraform di akun prod.

- Unduh dan simpan tersedia untuk umum Massa Mamografi UCI dataset ke bucket S3 yang Anda buat sebelumnya di akun dev.

- Garpu dan kloning Repositori GitHub dalam domain SageMaker Studio di akun dev. Repo memiliki struktur folder berikut:

- /environments – Skrip konfigurasi untuk lingkungan prod

- /mlops-infra – Kode untuk menerapkan layanan AWS menggunakan kode Terraform

- /pipa – Kode untuk komponen saluran SageMaker

- Jenkinsfile – Skrip untuk diterapkan melalui pipeline Jenkins CI/CD

- setup.py – Diperlukan untuk menginstal modul Python yang diperlukan dan membuat perintah run-pipeline

- mammografi-keparahan-modeling.ipynb – Memungkinkan Anda membuat dan menjalankan alur kerja ML

- Buat folder bernama data di dalam folder repositori GitHub yang dikloning dan simpan salinannya ke publik Massa Mamografi UCI Himpunan data.

- Ikuti buku catatan Jupyter

mammography-severity-modeling.ipynb. - Jalankan kode berikut di notebook untuk melakukan praproses himpunan data dan mengunggahnya ke bucket S3 di akun dev:

Kode ini akan menghasilkan kumpulan data berikut:

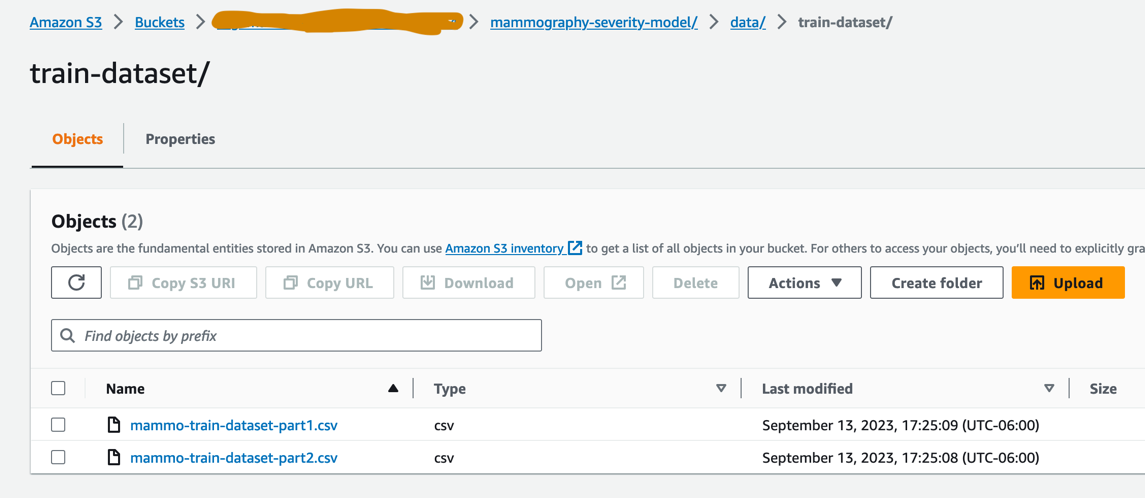

-

- data/ mammo-train-dataset-part1.csv – Akan digunakan untuk melatih model versi pertama.

- data/ mammo-train-dataset-part2.csv – Akan digunakan untuk melatih model versi kedua bersama dengan dataset mammo-train-dataset-part1.csv.

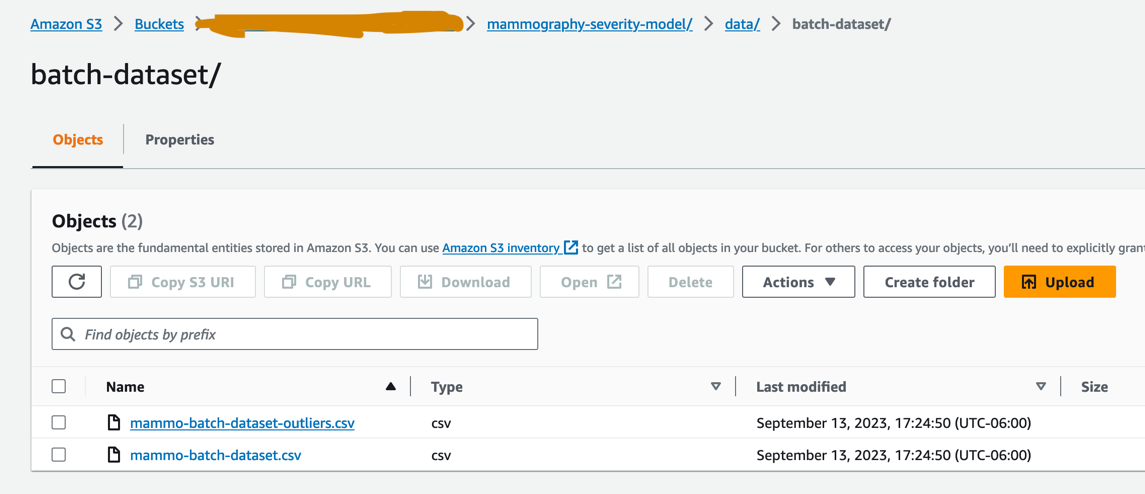

- data/mammo-batch-dataset.csv – Akan digunakan untuk menghasilkan kesimpulan.

- data/mammo-batch-dataset-outliers.csv – Akan memasukkan outlier ke dalam kumpulan data yang akan menggagalkan jalur inferensi. Ini akan memungkinkan kami menguji pola untuk memicu pelatihan ulang model secara otomatis.

- Unggah kumpulan data

mammo-train-dataset-part1.csvdi bawah awalanmammography-severity-model/train-dataset, dan unggah kumpulan datamammo-batch-dataset.csvdanmammo-batch-dataset-outliers.csvke awalanmammography-severity-model/batch-datasetdari bucket S3 yang dibuat di akun dev: - Unggah kumpulan data

mammo-train-dataset-part1.csvdanmammo-train-dataset-part2.csvdi bawah awalanmammography-severity-model/train-datasetke dalam bucket S3 yang dibuat di akun prod melalui konsol Amazon S3.

- Unggah kumpulan data

mammo-batch-dataset.csvdanmammo-batch-dataset-outliers.csvke awalanmammography-severity-model/batch-datasetdari bucket S3 di akun prod.

Jalankan jalur pipa kereta

Bawah <project-name>/pipelines/train, Anda dapat melihat skrip Python berikut:

- skrip/raw_preprocess.py – Terintegrasi dengan Pemrosesan SageMaker untuk rekayasa fitur

- skrip/evaluate_model.py – Memungkinkan penghitungan metrik model, dalam hal ini

auc_score - train_pipeline.py – Berisi kode untuk alur pelatihan model

Selesaikan langkah-langkah berikut:

- Unggah skrip ke Amazon S3:

- Dapatkan contoh jalur pipa kereta:

- Kirimkan jalur kereta api dan jalankan:

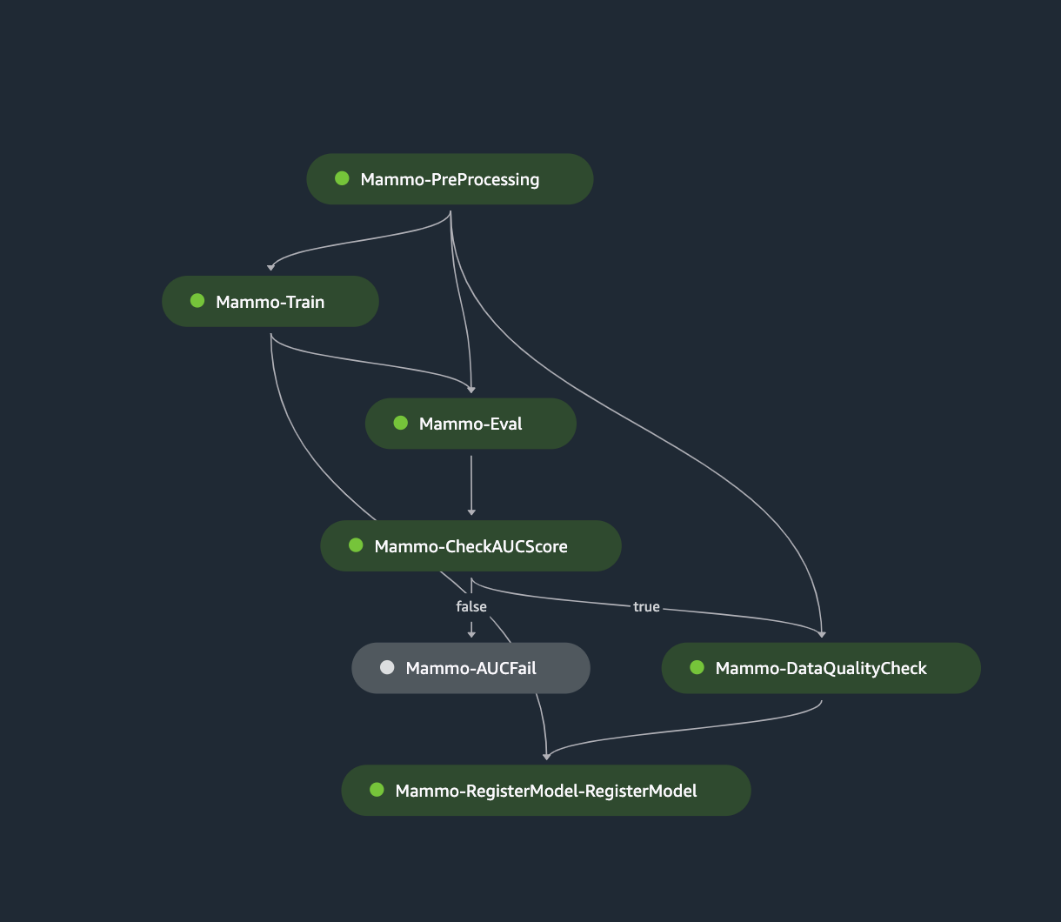

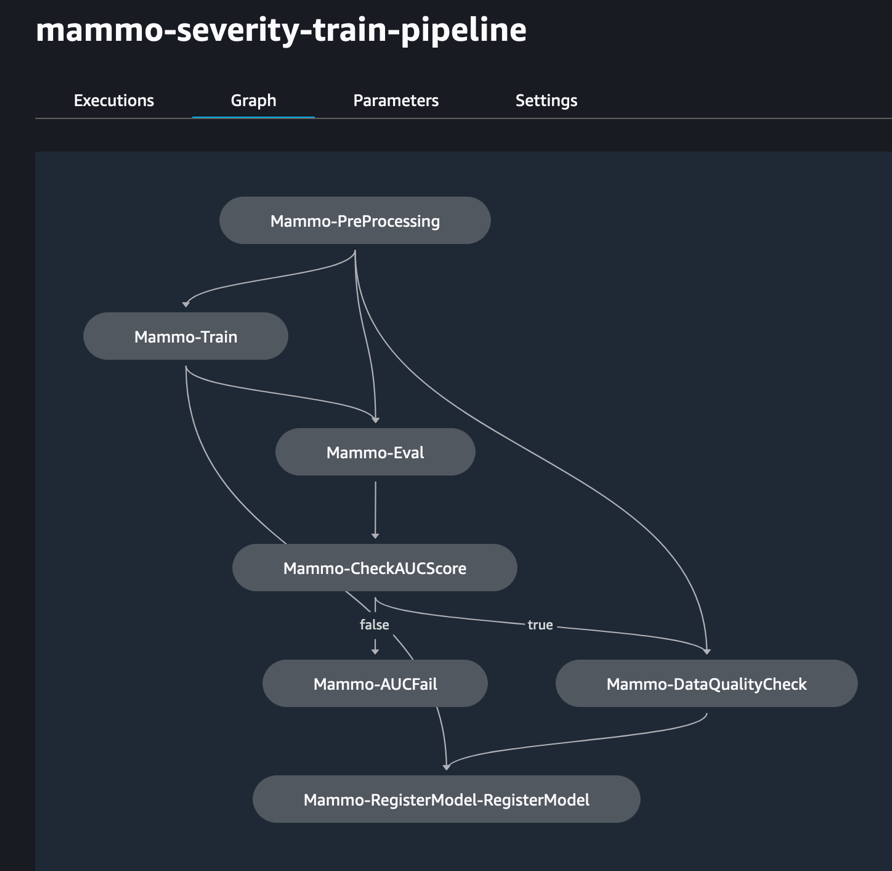

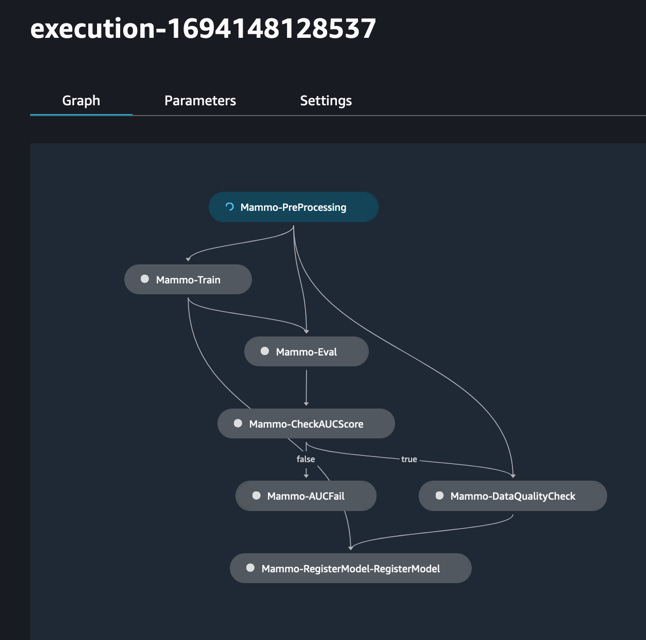

Gambar berikut menunjukkan keberhasilan menjalankan alur pelatihan. Langkah terakhir dalam alur mendaftarkan model di akun registri model pusat.

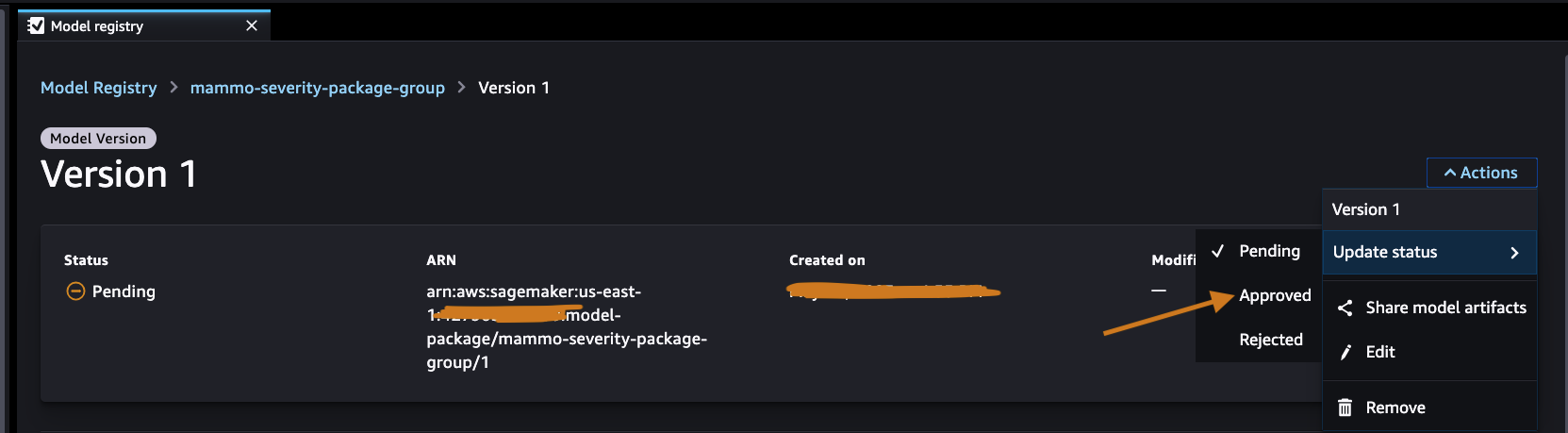

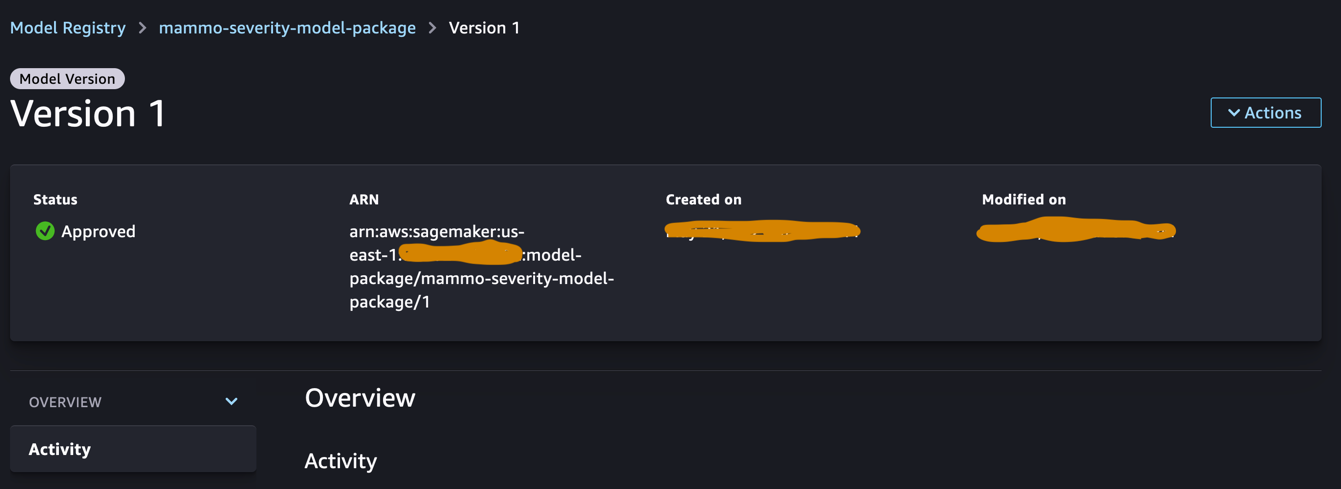

Setujui model di registri model pusat

Masuk ke akun registri model pusat dan akses registri model SageMaker dalam domain SageMaker Studio. Ubah status versi model menjadi Disetujui.

Setelah disetujui, statusnya harus diubah pada versi model.

Jalankan pipa inferensi (Opsional)

Langkah ini tidak diperlukan tetapi Anda masih dapat menjalankan alur inferensi untuk menghasilkan prediksi di akun pengembang.

Bawah <project-name>/pipelines/inference, Anda dapat melihat skrip Python berikut:

- skrip/lambda_helper.py – Menarik versi model terbaru yang disetujui dari akun registri model pusat menggunakan langkah SageMaker Pipelines Lambda

- inference_pipeline.py – Berisi kode untuk pipa inferensi model

Selesaikan langkah-langkah berikut:

- Unggah skrip ke bucket S3:

- Dapatkan instance pipeline inferensi menggunakan kumpulan data batch normal:

- Kirimkan pipa inferensi dan jalankan:

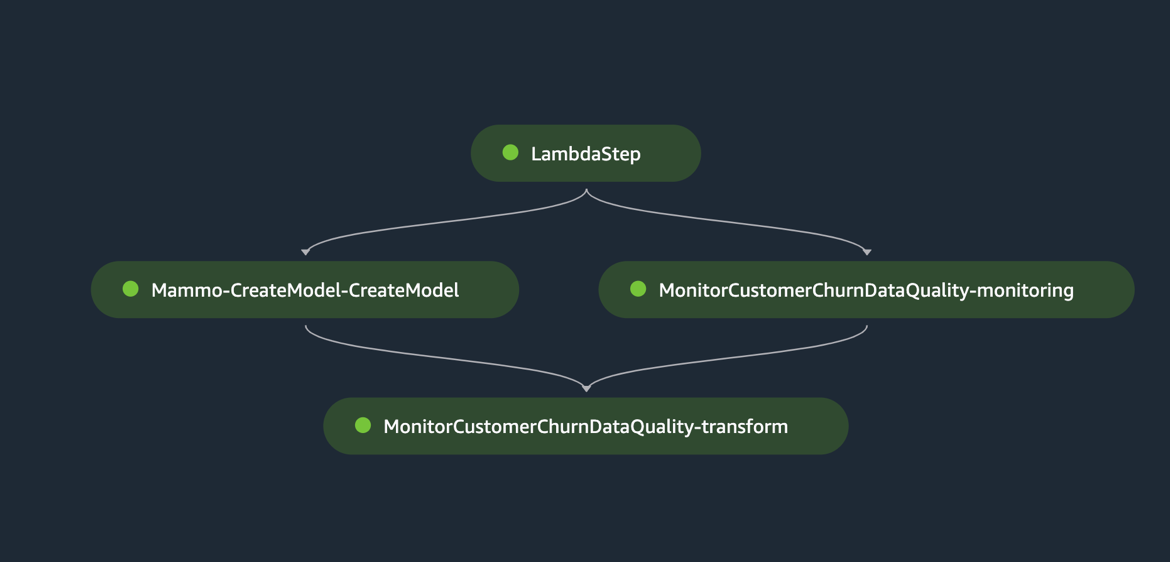

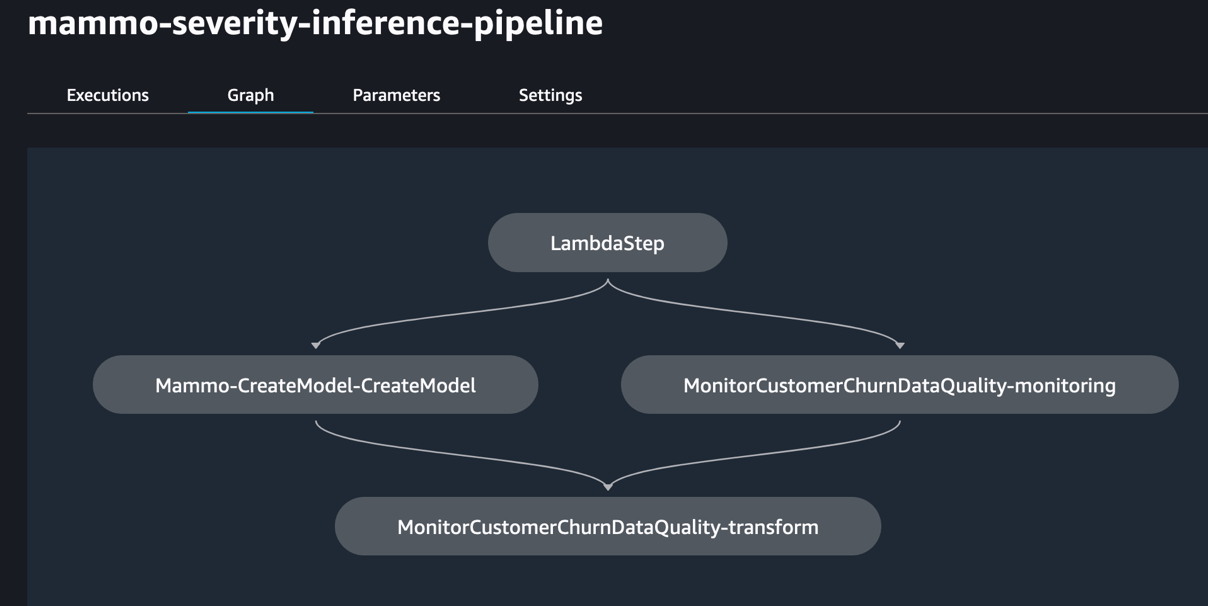

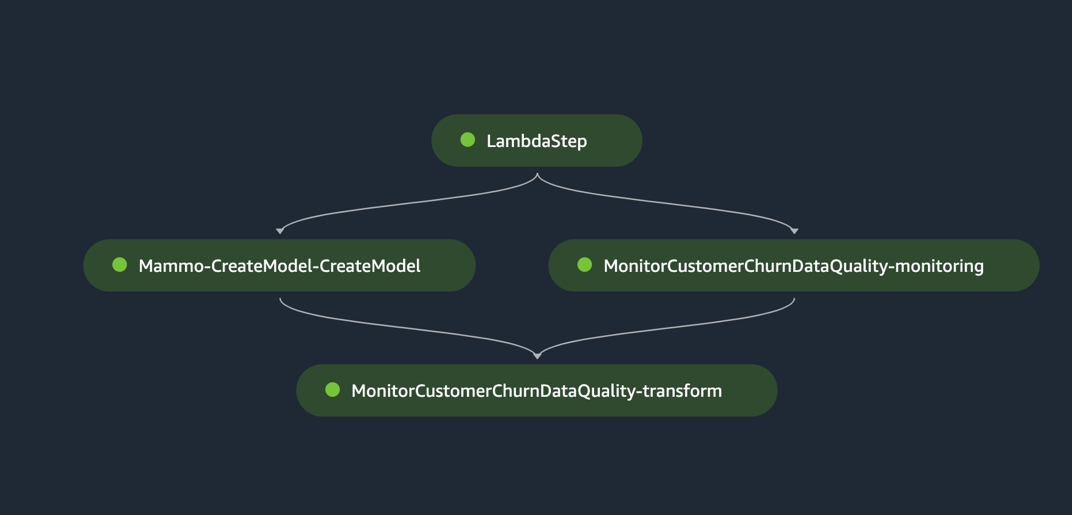

Gambar berikut menunjukkan keberhasilan menjalankan pipa inferensi. Langkah terakhir dalam pipeline menghasilkan prediksi dan menyimpannya di bucket S3. Kita gunakan MonitorBatchTransformStep untuk memantau masukan ke dalam pekerjaan transformasi batch. Jika terdapat outlier, pipeline inferensi akan mengalami status gagal.

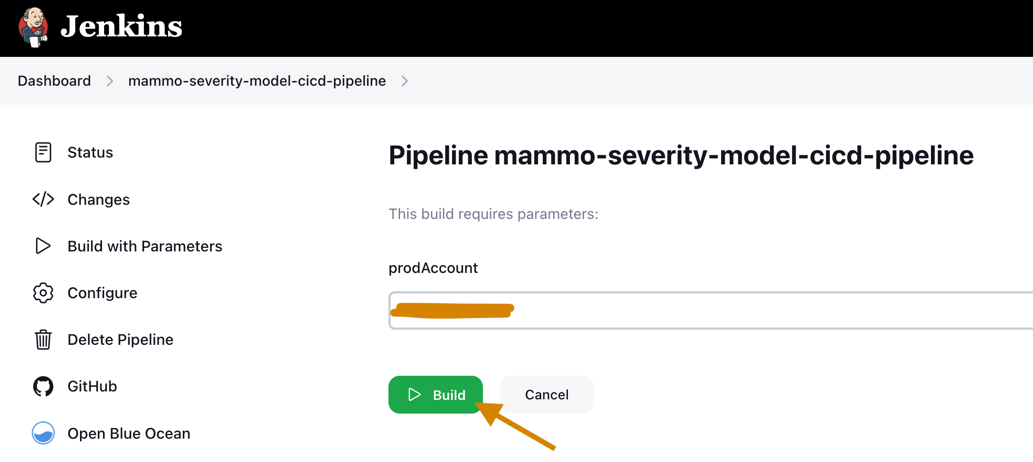

Jalankan alur Jenkins

Grafik environment/ folder dalam repositori GitHub berisi skrip konfigurasi untuk akun prod. Selesaikan langkah-langkah berikut untuk memicu alur Jenkins:

- Perbarui skrip konfigurasi

prod.tfvars.jsonberdasarkan sumber daya yang dibuat pada langkah sebelumnya: - Setelah diperbarui, masukkan kode ke dalam repositori GitHub bercabang dan gabungkan kode ke dalam cabang utama.

- Buka Jenkins UI, pilih Bangun dengan Parameter, dan memicu alur CI/CD yang dibuat pada langkah sebelumnya.

Ketika pembangunan selesai dan berhasil, Anda dapat masuk ke akun prod dan melihat alur pelatihan dan inferensi dalam domain SageMaker Studio.

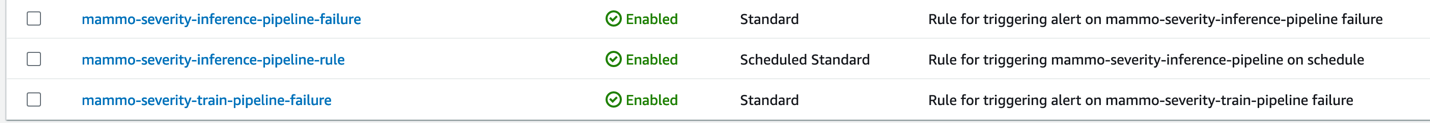

Selain itu, Anda akan melihat tiga aturan EventBridge di konsol EventBridge di akun prod:

- Jadwalkan alur inferensi

- Kirim pemberitahuan kegagalan pada jalur kereta

- Jika alur inferensi gagal memicu alur kereta, kirimkan pemberitahuan

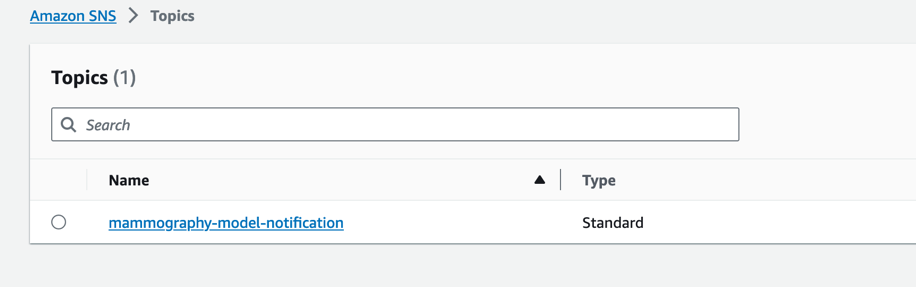

Terakhir, Anda akan melihat topik notifikasi SNS di konsol Amazon SNS yang mengirimkan notifikasi melalui email. Anda akan mendapatkan email yang meminta Anda untuk mengonfirmasi penerimaan email pemberitahuan ini.

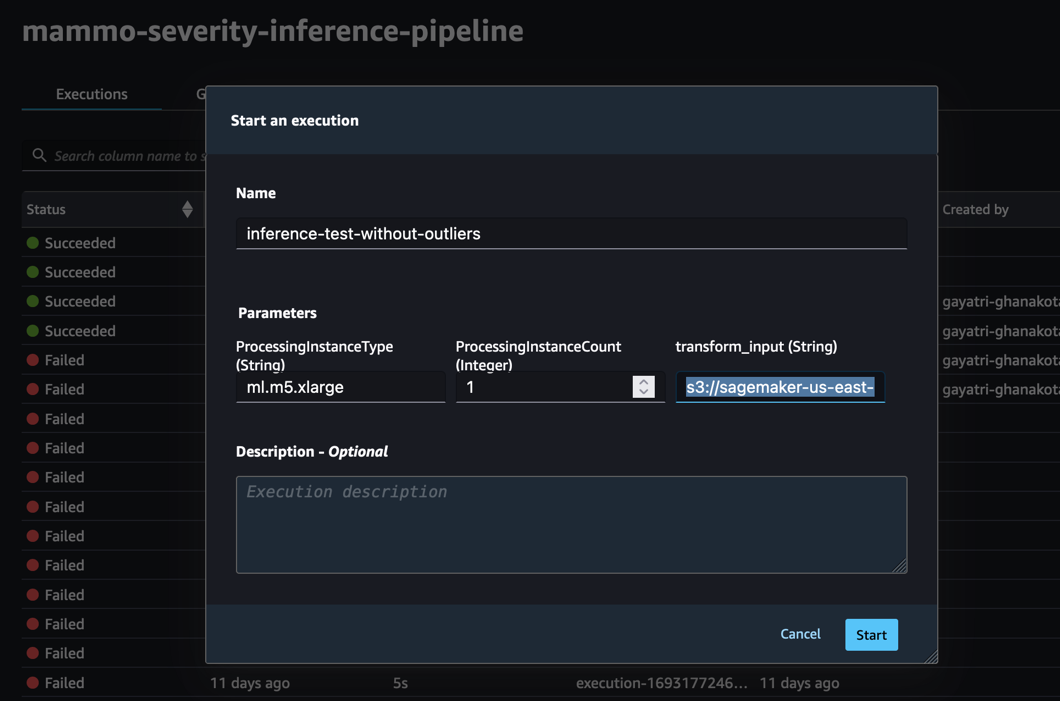

Uji alur inferensi menggunakan kumpulan data batch tanpa outlier

Untuk menguji apakah pipa inferensi berfungsi seperti yang diharapkan di akun prod, kita dapat masuk ke akun prod dan memicu pipa inferensi menggunakan kumpulan data batch tanpa outlier.

Jalankan alur melalui konsol SageMaker Pipelines di domain SageMaker Studio dari akun prod, di mana transform_input akan menjadi URI S3 dari kumpulan data tanpa outlier (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset.csv).

Alur inferensi berhasil dan menulis prediksi kembali ke bucket S3.

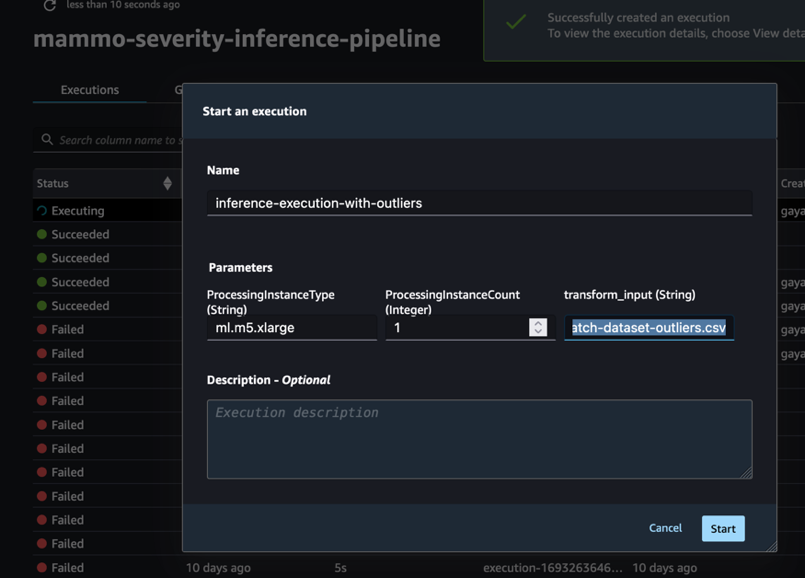

Uji alur inferensi menggunakan kumpulan data batch dengan outlier

Anda dapat menjalankan alur inferensi menggunakan kumpulan data batch dengan outlier untuk memeriksa apakah mekanisme pelatihan ulang otomatis berfungsi seperti yang diharapkan.

Jalankan alur melalui konsol SageMaker Pipelines di domain SageMaker Studio dari akun prod, di mana transform_input akan menjadi URI S3 dari kumpulan data dengan outlier (s3://<s3-bucket-in-prod-account>/mammography-severity-model/data/mammo-batch-dataset-outliers.csv).

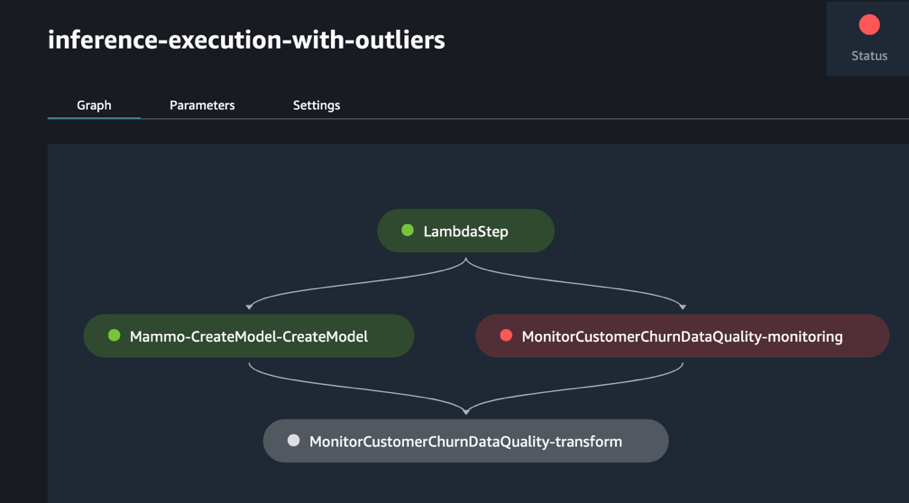

Pipa inferensi gagal seperti yang diharapkan, yang memicu aturan EventBridge, yang pada gilirannya memicu pipa kereta.

Setelah beberapa saat, Anda akan melihat proses baru dari alur kereta di konsol SageMaker Pipelines, yang mengambil dua himpunan data kereta yang berbeda (mammo-train-dataset-part1.csv dan mammo-train-dataset-part2.csv) diunggah ke bucket S3 untuk melatih ulang model.

Anda juga akan melihat pemberitahuan dikirim ke email yang berlangganan topik SNS.

Untuk menggunakan versi model yang diperbarui, masuk ke akun registri model pusat dan setujui versi model, yang akan diambil selama pengoperasian pipa inferensi berikutnya yang dipicu melalui aturan EventBridge terjadwal.

Meskipun alur pelatihan dan inferensi menggunakan URL himpunan data statis, Anda dapat meneruskan URL himpunan data ke alur pelatihan dan inferensi sebagai variabel dinamis untuk menggunakan himpunan data yang diperbarui guna melatih ulang model dan menghasilkan prediksi dalam skenario dunia nyata.

Membersihkan

Untuk menghindari timbulnya biaya di masa mendatang, selesaikan langkah-langkah berikut:

- Hapus domain SageMaker Studio di semua akun AWS.

- Hapus semua sumber daya yang dibuat di luar SageMaker, termasuk bucket S3, peran IAM, aturan EventBridge, dan topik SNS yang disiapkan melalui Terraform di akun prod.

- Hapus alur SageMaker yang dibuat di seluruh akun menggunakan Antarmuka Baris Perintah AWS (AWS CLI).

Kesimpulan

Organisasi sering kali perlu menyelaraskan perangkat di seluruh perusahaan untuk memungkinkan kolaborasi di berbagai area fungsional dan tim. Kolaborasi ini memastikan platform MLOps Anda dapat beradaptasi dengan kebutuhan bisnis yang terus berkembang dan mempercepat penerapan ML di seluruh tim. Posting ini menjelaskan cara membuat kerangka kerja MLOps dalam pengaturan multi-lingkungan untuk mengaktifkan pelatihan ulang model otomatis, inferensi batch, dan pemantauan dengan Amazon SageMaker Model Monitor, pembuatan versi model dengan SageMaker Model Registry, dan promosi kode dan pipeline ML di seluruh lingkungan dengan a Pipa CI/CD. Kami memamerkan solusi ini menggunakan kombinasi layanan AWS dan perangkat pihak ketiga. Untuk petunjuk penerapan solusi ini, lihat Repositori GitHub. Anda juga dapat memperluas solusi ini dengan menggunakan sumber data dan kerangka pemodelan Anda sendiri.

Tentang Penulis

Gayatri Ghanakota adalah Insinyur Pembelajaran Mesin Senior dengan Layanan Profesional AWS. Dia bersemangat mengembangkan, menerapkan, dan menjelaskan solusi AI/ML di berbagai domain. Sebelum peran ini, ia memimpin berbagai inisiatif sebagai ilmuwan data dan insinyur ML dengan perusahaan global terkemuka di bidang keuangan dan ritel. Dia meraih gelar master di bidang Ilmu Komputer dengan spesialisasi Ilmu Data dari University of Colorado, Boulder.

Gayatri Ghanakota adalah Insinyur Pembelajaran Mesin Senior dengan Layanan Profesional AWS. Dia bersemangat mengembangkan, menerapkan, dan menjelaskan solusi AI/ML di berbagai domain. Sebelum peran ini, ia memimpin berbagai inisiatif sebagai ilmuwan data dan insinyur ML dengan perusahaan global terkemuka di bidang keuangan dan ritel. Dia meraih gelar master di bidang Ilmu Komputer dengan spesialisasi Ilmu Data dari University of Colorado, Boulder.

Sunita Koppar adalah Sr. Arsitek Data Lake dengan Layanan Profesional AWS. Dia bersemangat memecahkan masalah pelanggan dengan memproses data besar dan menyediakan solusi skalabel jangka panjang. Sebelum menjalankan peran ini, ia mengembangkan produk di domain internet, telekomunikasi, dan otomotif, dan telah menjadi pelanggan AWS. Dia meraih gelar master di bidang Ilmu Data dari University of California, Riverside.

Sunita Koppar adalah Sr. Arsitek Data Lake dengan Layanan Profesional AWS. Dia bersemangat memecahkan masalah pelanggan dengan memproses data besar dan menyediakan solusi skalabel jangka panjang. Sebelum menjalankan peran ini, ia mengembangkan produk di domain internet, telekomunikasi, dan otomotif, dan telah menjadi pelanggan AWS. Dia meraih gelar master di bidang Ilmu Data dari University of California, Riverside.

Saswata Dash adalah Konsultan DevOps dengan Layanan Profesional AWS. Dia telah bekerja dengan pelanggan di bidang perawatan kesehatan dan ilmu hayati, penerbangan, dan manufaktur. Dia sangat tertarik dengan segala hal mengenai otomatisasi dan memiliki pengalaman komprehensif dalam merancang dan membangun solusi pelanggan skala perusahaan di AWS. Di luar pekerjaan, ia menekuni minatnya pada fotografi dan menyaksikan matahari terbit.

Saswata Dash adalah Konsultan DevOps dengan Layanan Profesional AWS. Dia telah bekerja dengan pelanggan di bidang perawatan kesehatan dan ilmu hayati, penerbangan, dan manufaktur. Dia sangat tertarik dengan segala hal mengenai otomatisasi dan memiliki pengalaman komprehensif dalam merancang dan membangun solusi pelanggan skala perusahaan di AWS. Di luar pekerjaan, ia menekuni minatnya pada fotografi dan menyaksikan matahari terbit.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/promote-pipelines-in-a-multi-environment-setup-using-amazon-sagemaker-model-registry-hashicorp-terraform-github-and-jenkins-ci-cd/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 12

- 13

- 14

- 16

- 17

- 19

- 23

- 27

- 31

- 320

- 7

- 8

- 9

- a

- Tentang Kami

- mempercepat

- penerimaan

- mengakses

- Akun

- Akun

- di seluruh

- Tindakan

- menyesuaikan

- menambahkan

- alamat

- administratif

- Adopsi

- Setelah

- usia

- AI

- meluruskan

- Semua

- mengizinkan

- memungkinkan

- sepanjang

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- dan

- Lain

- Apa pun

- Aplikasi

- sesuai

- menyetujui

- disetujui

- arsitektur

- ADALAH

- daerah

- sekitar

- buatan

- kecerdasan buatan

- Kecerdasan buatan (AI)

- AS

- meminta

- terkait

- menganggap

- melampirkan

- mobil

- Otomatis

- secara otomatis

- Otomatisasi

- otomotif

- tersedia

- penerbangan

- menghindari

- AWS

- Pelanggan AWS

- Layanan Profesional AWS

- kembali

- berdasarkan

- dasar

- BE

- karena

- menjadi

- sebelum

- makhluk

- TERBAIK

- Praktik Terbaik

- antara

- Besar

- Big data

- kedua

- Cabang

- menjembatani

- Membawa

- membangun

- Bangunan

- dibangun di

- bisnis

- tapi

- by

- perhitungan

- california

- bernama

- CAN

- kasus

- pusat

- perubahan

- berubah

- Perubahan

- beban

- memeriksa

- pilihan

- Pilih

- kode

- kolaborasi

- mengumpulkan

- Colorado

- Kolom

- Kolom

- COM

- kombinasi

- lengkap

- pemenuhan

- komponen

- luas

- komputer

- Komputer Ilmu

- kondisi

- konfigurasi

- Memastikan

- konsul

- konsultan

- Wadah

- mengandung

- kontrol

- Konvensi

- mengubah

- Sesuai

- membuat

- dibuat

- membuat

- Surat kepercayaan

- Cross

- pelanggan

- Solusi Pelanggan

- pelanggan

- harian

- dasbor

- data

- Danau Data

- ilmu data

- ilmuwan data

- kumpulan data

- Dekripsi

- Default

- Derajat

- menyebarkan

- penggelaran

- penyebaran

- menyebarkan

- merancang

- rincian

- menemukan

- terdeteksi

- dev

- dikembangkan

- berkembang

- Pengembangan

- DICT

- berbeda

- domain

- domain

- selama

- dinamis

- setiap

- Terdahulu

- efek

- antara

- aktif

- terenkripsi

- insinyur

- Memastikan

- Enter

- Lingkungan Hidup

- lingkungan

- penting

- peristiwa

- berkembang

- eksekusi

- diharapkan

- pengalaman

- menjelaskan

- menjelaskan

- memperpanjang

- memudahkan

- GAGAL

- Gagal

- gagal

- Kegagalan

- Fitur

- Fitur

- beberapa

- Angka

- File

- terakhir

- keuangan

- menyelesaikan

- perusahaan

- Pertama

- pertama kali

- berikut

- Untuk

- ditemukan

- Kerangka

- kerangka

- dari

- Memenuhi

- penuh

- fungsi

- fungsionil

- masa depan

- celah

- menghasilkan

- dihasilkan

- menghasilkan

- mendapatkan

- pergi

- GitHub

- Memberikan

- diberikan

- memberikan

- Aksi

- Go

- Pergi

- beasiswa

- Kelompok

- Memiliki

- kesehatan

- dia

- lebih tinggi

- memegang

- tuan

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- http

- HTTPS

- ID

- identitas

- if

- mengimplementasikan

- mengimpor

- in

- termasuk

- Termasuk

- indeks

- Infrastruktur

- mulanya

- inisiatif

- input

- install

- diinstal

- contoh

- instruksi

- Terintegrasi

- Intelijen

- Internet

- ke

- memperkenalkan

- IT

- Pekerjaan

- Jobs

- jpg

- json

- kunci

- kunci-kunci

- label

- danau

- pemandangan

- kemudian

- Terbaru

- pengetahuan

- Dipimpin

- leveraged

- Hidup

- Biologi

- baris

- mencatat

- jangka panjang

- mesin

- Mesin belajar

- Utama

- memelihara

- membuat

- berhasil

- pengelolaan

- pabrik

- Margin

- Massa

- tuan

- mekanisme

- pertemuan

- menu

- Bergabung

- Metrik

- hilang

- ML

- MLOps

- model

- pemodelan

- model

- memodifikasi

- Modul

- Waktu

- Memantau

- dipantau

- pemantauan

- lebih

- beberapa

- nama

- Bernama

- penamaan

- Navigasi

- Perlu

- dibutuhkan

- kebutuhan

- New

- berikutnya

- normal

- buku catatan

- pemberitahuan

- pemberitahuan

- jumlah

- mati rasa

- of

- sering

- on

- ONE

- Operasi

- or

- urutan

- organisasi

- Lainnya

- di luar

- di luar

- lebih

- ikhtisar

- sendiri

- paket

- halaman

- Sakit

- panda

- pane

- bagian

- bagian

- Lulus

- gairah

- bergairah

- pola

- prestasi

- Izin

- fotografi

- terpilih

- Pilihan

- pipa saluran

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- poin

- Kebijakan

- kebijaksanaan

- Pos

- praktek

- meramalkan

- Prediksi

- Mempersiapkan

- prasyarat

- sebelumnya

- Utama

- Sebelumnya

- hak

- proses

- pengolahan

- Produksi

- Produk

- profesional

- proyek

- mendorong

- dipromosikan

- promosi

- memberikan

- disediakan

- menyediakan

- menyediakan

- ketentuan

- di depan umum

- Menarik

- Mengejar

- Dorong

- Ular sanca

- segera

- cepat

- Mentah

- Baca

- siap

- dunia nyata

- wilayah

- daftar

- terdaftar

- register

- pendaftaran

- regulator

- terkait

- hubungan

- menghapus

- gudang

- permintaan

- wajib

- Persyaratan

- sumber

- Sumber

- tanggapan

- eceran

- kembali

- Tepi sungai

- Peran

- peran

- akar

- Aturan

- aturan

- Run

- berjalan

- pembuat bijak

- Pipa SageMaker

- sama

- Save

- disimpan

- terukur

- skenario

- menjadwalkan

- dijadwalkan

- penjadwalan

- Ilmu

- ILMU PENGETAHUAN

- ilmuwan

- naskah

- script

- mulus

- Kedua

- Bagian

- aman

- keamanan

- melihat

- mengirim

- mengirim

- mengirimkan

- mengirim

- terpisah

- Server

- layanan

- Layanan

- set

- pengaturan

- penyiapan

- Bentuknya

- Share

- dia

- harus

- Menunjukkan

- dipamerkan

- ditunjukkan

- Pertunjukkan

- Sederhana

- potongan

- So

- larutan

- Solusi

- Memecahkan

- sumber

- sumber

- Space

- khusus

- tertentu

- membagi

- Negara

- Pernyataan

- statis

- Status

- Langkah

- Tangga

- Masih

- menyimpan

- tersimpan

- toko

- Tali

- struktur

- studio

- sukses

- seperti itu

- Mendukung

- target

- tim

- telekomunikasi

- Terraform

- uji

- pengujian

- bahwa

- Grafik

- Mereka

- kemudian

- Sana.

- Ini

- hal

- Ketiga

- pihak ketiga

- ini

- tiga

- Melalui

- waktu

- untuk

- perkakas

- puncak

- tema

- jalur

- Pelatihan VE

- terlatih

- Pelatihan

- Mengubah

- memicu

- dipicu

- memicu

- benar

- Kepercayaan

- MENGHIDUPKAN

- dua

- ui

- bawah

- universitas

- University of California

- Memperbarui

- diperbarui

- upload

- URL

- us

- menggunakan

- bekas

- menggunakan

- kegunaan

- Nilai - Nilai

- berbagai

- versi

- Versi

- melalui

- Video

- terlihat

- Menonton

- we

- jaringan

- layanan web

- ketika

- kapan saja

- sedangkan

- yang

- sementara

- akan

- dengan

- dalam

- tanpa

- Kerja

- bekerja

- alur kerja

- kerja

- bekerja

- menulis

- tertulis

- Kamu

- Anda

- Youtube

- zephyrnet.dll