La stima della posa è una tecnica di visione artificiale che rileva una serie di punti su oggetti (come persone o veicoli) all'interno di immagini o video. La stima della posa ha applicazioni nel mondo reale in sport, robotica, sicurezza, realtà aumentata, media e intrattenimento, applicazioni mediche e altro ancora. I modelli di stima della posa vengono addestrati su immagini o video annotati con un insieme coerente di punti (coordinate) definiti da un rig. Per addestrare modelli accurati di stima della posa, è necessario innanzitutto acquisire un ampio set di dati di immagini annotate; molti set di dati contengono decine o centinaia di migliaia di immagini annotate e richiedono risorse significative per essere creati. Gli errori di etichettatura sono importanti da identificare e prevenire perché le prestazioni del modello per i modelli di stima della posa sono fortemente influenzate dalla qualità dei dati etichettati e dal volume dei dati.

In questo post mostriamo come utilizzare un flusso di lavoro di etichettatura personalizzato Amazon SageMaker verità fondamentale appositamente progettato per l'etichettatura dei punti chiave. Questo flusso di lavoro personalizzato aiuta a semplificare il processo di etichettatura e a ridurre al minimo gli errori di etichettatura, riducendo così il costo per ottenere etichette di posa di alta qualità.

Importanza di dati di alta qualità e riduzione degli errori di etichettatura

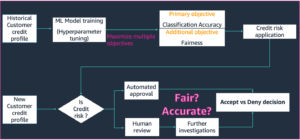

Dati di alta qualità sono fondamentali per formare modelli di stima delle pose robusti e affidabili. L'accuratezza di questi modelli è direttamente legata alla correttezza e alla precisione delle etichette assegnate a ciascun punto chiave della posa, che, a sua volta, dipende dall'efficacia del processo di annotazione. Inoltre, disporre di un volume considerevole di dati diversificati e ben annotati garantisce che il modello possa apprendere un'ampia gamma di pose, variazioni e scenari, portando a una migliore generalizzazione e prestazioni in diverse applicazioni del mondo reale. L'acquisizione di questi grandi set di dati annotati coinvolge annotatori umani che etichettano attentamente le immagini con informazioni sulla posa. Mentre si etichettano i punti di interesse all'interno dell'immagine, è utile vedere la struttura scheletrica dell'oggetto durante l'etichettatura per fornire una guida visiva all'annotatore. Ciò è utile per identificare gli errori di etichettatura prima che vengano incorporati nel set di dati come scambi di sinistra-destra o etichette errate (come contrassegnare un piede come una spalla). Ad esempio, un errore di etichettatura come lo scambio sinistra-destra effettuato nell'esempio seguente può essere facilmente identificato dall'incrocio delle linee del rig scheletro e dalla mancata corrispondenza dei colori. Questi segnali visivi aiutano gli etichettatori a riconoscere gli errori e si tradurranno in un set di etichette più pulito.

A causa della natura manuale dell’etichettatura, ottenere set di dati etichettati grandi e accurati può essere proibitivo in termini di costi e lo è ancora di più con un sistema di etichettatura inefficiente. Pertanto, l'efficienza e la precisione dell'etichettatura sono fondamentali quando si progetta il flusso di lavoro di etichettatura. In questo post, mostriamo come utilizzare un flusso di lavoro di etichettatura personalizzato SageMaker Ground Truth per annotare le immagini in modo rapido e accurato, riducendo l'onere di sviluppare set di dati di grandi dimensioni per flussi di lavoro di stima della posa.

Panoramica della soluzione

Questa soluzione fornisce un portale Web online in cui il personale addetto all'etichettatura può utilizzare un browser Web per effettuare il login, accedere ai lavori di etichettatura e annotare le immagini utilizzando l'interfaccia utente (UI) crowd-2d-skeleton, un'interfaccia utente personalizzata progettata per l'etichettatura di punti chiave e pose utilizzando La verità fondamentale di SageMaker. Le annotazioni o le etichette create dal personale addetto all'etichettatura vengono quindi esportate in un file Servizio di archiviazione semplice Amazon (Amazon S3), dove possono essere utilizzati per processi downstream come l'addestramento di modelli di visione artificiale con deep learning. Questa soluzione illustra come configurare e distribuire i componenti necessari per creare un portale Web e come creare processi di etichettatura per questo flusso di lavoro di etichettatura.

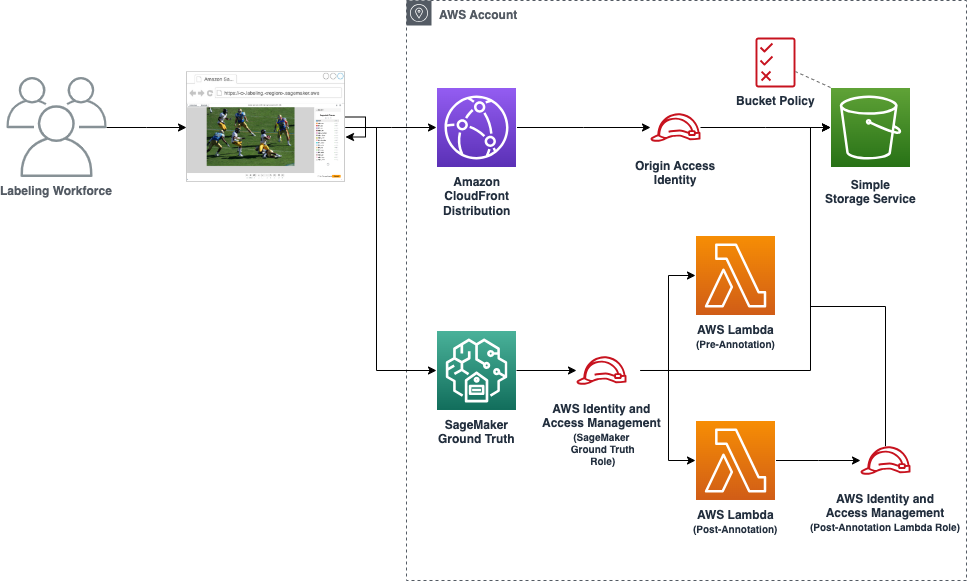

Di seguito è riportato uno schema dell'architettura complessiva.

Questa architettura è composta da diversi componenti chiave, ciascuno dei quali verrà spiegato in modo più dettagliato nelle sezioni seguenti. Questa architettura fornisce al personale di etichettatura un portale Web online ospitato da SageMaker Ground Truth. Questo portale consente a ciascun etichettatore di accedere e vedere i propri lavori di etichettatura. Dopo aver effettuato l'accesso, l'etichettatore può selezionare un lavoro di etichettatura e iniziare ad annotare le immagini utilizzando l'interfaccia utente personalizzata ospitata da Amazon CloudFront. Noi usiamo AWS Lambda funzioni per l'elaborazione dei dati pre-annotazione e post-annotazione.

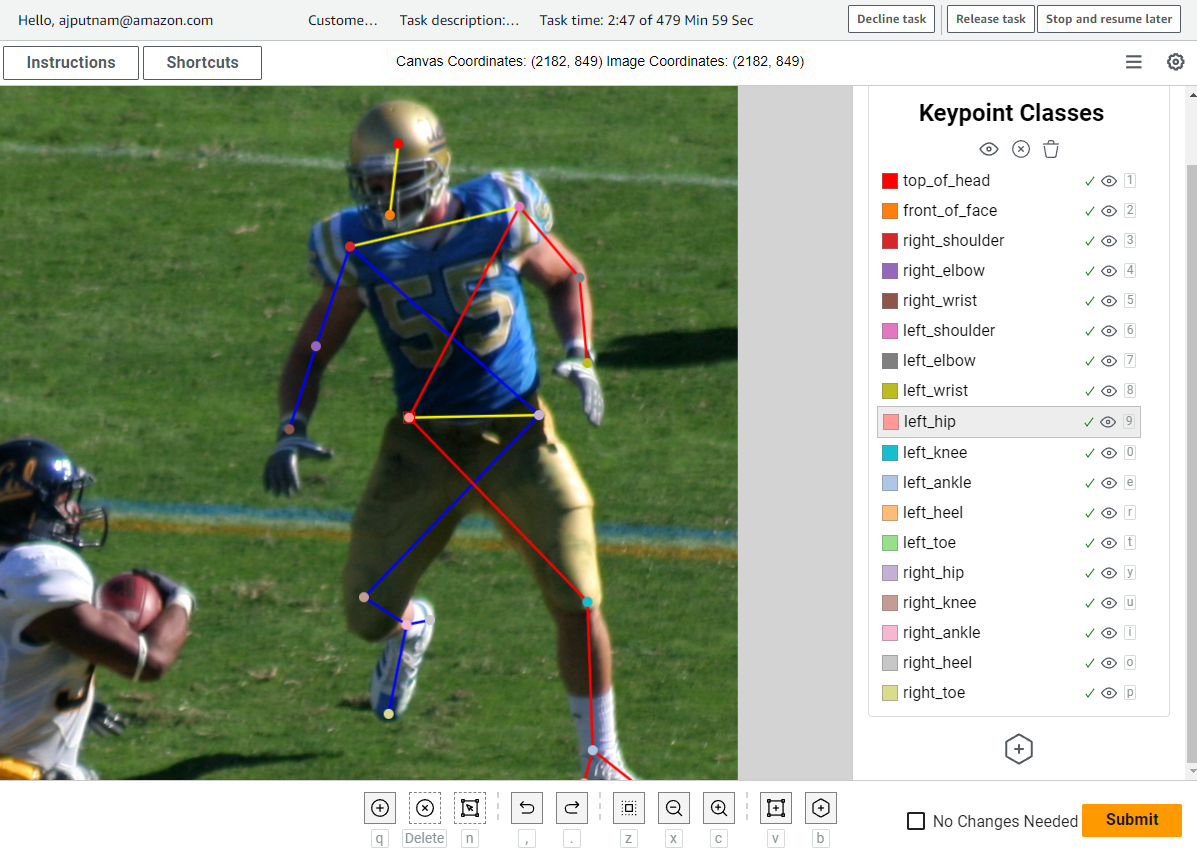

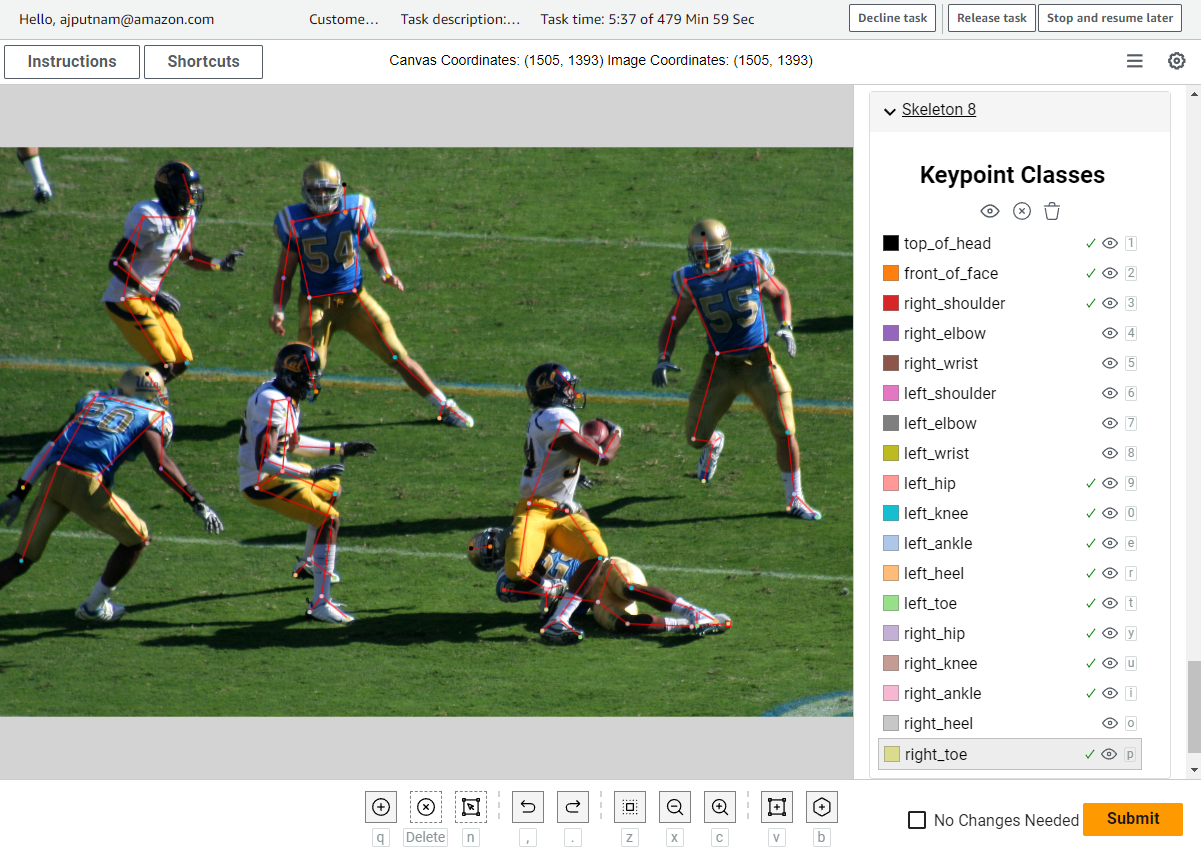

Lo screenshot seguente è un esempio dell'interfaccia utente.

L'etichettatore può contrassegnare punti chiave specifici sull'immagine utilizzando l'interfaccia utente. Le linee tra i punti chiave verranno disegnate automaticamente per l'utente in base alla definizione di scheletro dell'attrezzatura utilizzata dall'interfaccia utente. L'interfaccia utente consente molte personalizzazioni, come le seguenti:

- Nomi dei punti chiave personalizzati

- Colori dei punti chiave configurabili

- Colori della linea di rig configurabili

- Scheletro e strutture di rig configurabili

Ognuna di queste è una funzionalità mirata per migliorare la facilità e la flessibilità dell'etichettatura. I dettagli specifici sulla personalizzazione dell'interfaccia utente sono disponibili nel file Repository GitHub e sono riassunti più avanti in questo post. Tieni presente che in questo post utilizziamo la stima della posa umana come attività di base, ma puoi espanderla per etichettare la posa dell'oggetto con un rig predefinito anche per altri oggetti, come animali o veicoli. Nell'esempio seguente mostriamo come questo può essere applicato per etichettare i punti di un camion con cassone.

SageMaker verità fondamentale

In questa soluzione, utilizziamo SageMaker Ground Truth per fornire alla forza lavoro dell'etichettatura un portale online e un modo per gestire i lavori di etichettatura. Questo post presuppone che tu abbia familiarità con SageMaker Ground Truth. Per ulteriori informazioni, fare riferimento a Amazon SageMaker verità fondamentale.

Distribuzione CloudFront

Per questa soluzione, l'interfaccia utente di etichettatura richiede un componente JavaScript personalizzato denominato componente crowd-2d-skeleton. Questo componente può essere trovato su GitHub come parte delle iniziative open source di Amazon. La distribuzione CloudFront verrà utilizzata per ospitare il crowd-2d-skeleton.js, necessario per l'interfaccia utente di SageMaker Ground Truth. Alla distribuzione CloudFront verrà assegnata un'identità di accesso origine, che consentirà alla distribuzione CloudFront di accedere a crowd-2d-skeleton.js residente nel bucket S3. Il bucket S3 rimarrà privato e nessun altro oggetto in questo bucket sarà disponibile tramite la distribuzione CloudFront a causa delle restrizioni che imponiamo all'identità di accesso di origine tramite una policy del bucket. Questa è una pratica consigliata per seguire il principio del privilegio minimo.

Bucket Amazon S3

Utilizziamo il bucket S3 per archiviare i file manifest di input e output di SageMaker Ground Truth, il modello di interfaccia utente personalizzata, le immagini per i lavori di etichettatura e il codice JavaScript necessario per l'interfaccia utente personalizzata. Questo bucket sarà privato e non accessibile al pubblico. Il bucket avrà inoltre una policy di bucket che limita la distribuzione CloudFront solo alla possibilità di accedere al codice JavaScript necessario per l'interfaccia utente. Ciò impedisce alla distribuzione CloudFront di ospitare qualsiasi altro oggetto nel bucket S3.

Funzione Lambda di pre-annotazione

I lavori di etichettatura di SageMaker Ground Truth utilizzano in genere un file manifest di input, che è in formato JSON Lines. Questo file manifest di input contiene metadati per un processo di etichettatura, funge da riferimento ai dati che devono essere etichettati e aiuta a configurare il modo in cui i dati devono essere presentati agli annotatori. La funzione Lambda di pre-annotazione elabora gli elementi dal file manifest di input prima che i dati manifest vengano immessi nel modello dell'interfaccia utente personalizzato. È qui che è possibile apportare eventuali formattazioni o modifiche speciali agli elementi prima di presentare i dati agli annotatori nell'interfaccia utente. Per ulteriori informazioni sulle funzioni Lambda di pre-annotazione, consulta Lambda di pre-annotazione.

Funzione Lambda post-annotazione

Similmente alla funzione Lambda pre-annotazione, la funzione post-annotazione gestisce l'ulteriore elaborazione dei dati che potresti voler eseguire dopo che tutti gli etichettatori hanno terminato l'etichettatura ma prima di scrivere i risultati di output dell'annotazione finale. Questa elaborazione viene eseguita da una funzione Lambda, responsabile della formattazione dei dati per i risultati di output del lavoro di etichettatura. In questa soluzione, la utilizziamo semplicemente per restituire i dati nel formato di output desiderato. Per ulteriori informazioni sulle funzioni Lambda post-annotazione, consulta Lambda post-annotazione.

Ruolo della funzione Lambda post-annotazione

Usiamo un file Gestione dell'identità e dell'accesso di AWS (IAM) per fornire alla funzione Lambda post-annotazione l'accesso al bucket S3. Ciò è necessario per leggere i risultati dell'annotazione e apportare eventuali modifiche prima di scrivere i risultati finali nel file manifest di output.

Ruolo di SageMaker Ground Truth

Utilizziamo questo ruolo IAM per fornire al lavoro di etichettatura SageMaker Ground Truth la possibilità di richiamare le funzioni Lambda e leggere le immagini, i file manifest e il modello di interfaccia utente personalizzato nel bucket S3.

Prerequisiti

Per questa procedura dettagliata, è necessario disporre dei seguenti prerequisiti:

Per questa soluzione, utilizziamo AWS CDK per distribuire l'architettura. Quindi creiamo un lavoro di etichettatura di esempio, utilizziamo il portale di annotazione per etichettare le immagini nel lavoro di etichettatura ed esaminiamo i risultati dell'etichettatura.

Crea lo stack AWS CDK

Dopo aver completato tutti i prerequisiti, sei pronto per distribuire la soluzione.

Imposta le tue risorse

Completa i seguenti passaggi per impostare le tue risorse:

- Scarica lo stack di esempio da Repository GitHub.

- Utilizzare il comando cd per passare al repository.

- Crea il tuo ambiente Python e installa i pacchetti richiesti (vedi il repository README.md per maggiori dettagli).

- Con l'ambiente Python attivato, esegui il comando seguente:

- Esegui il comando seguente per distribuire AWS CDK:

- Eseguire il comando seguente per eseguire lo script post-distribuzione:

Crea un lavoro di etichettatura

Dopo aver impostato le risorse, sei pronto per creare un processo di etichettatura. Ai fini di questo post, creiamo un lavoro di etichettatura utilizzando gli script e le immagini di esempio forniti nel repository.

- CD nel

scriptsdirectory nel repository. - Scarica le immagini di esempio da Internet eseguendo il seguente codice:

Questo script scarica un set di 10 immagini, che utilizziamo nel nostro lavoro di etichettatura di esempio. Esamineremo come utilizzare i tuoi dati di input personalizzati più avanti in questo post.

- Crea un processo di etichettatura eseguendo il seguente codice:

Questo script accetta come argomento un ARN per la forza lavoro privata SageMaker Ground Truth, che dovrebbe essere l'ARN per una forza lavoro presente nello stesso account in cui hai distribuito questa architettura. Lo script creerà il file manifest di input per il nostro lavoro di etichettatura, lo caricherà su Amazon S3 e creerà un lavoro di etichettatura personalizzato SageMaker Ground Truth. Approfondiremo più approfonditamente i dettagli di questo script più avanti in questo post.

Etichetta il set di dati

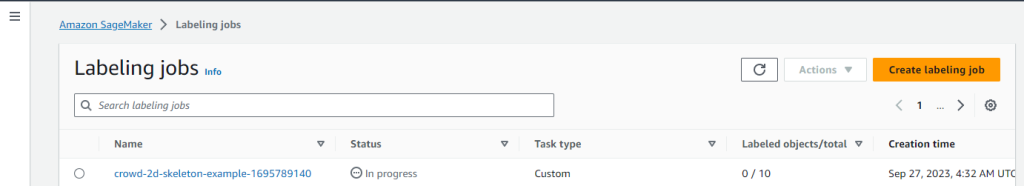

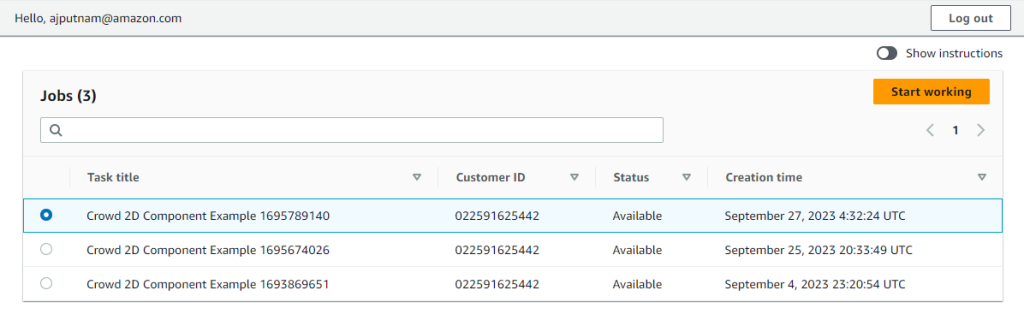

Dopo aver avviato il lavoro di etichettatura di esempio, verrà visualizzato sulla console SageMaker e sul portale della forza lavoro.

Nel portale della forza lavoro, seleziona il lavoro di etichettatura e scegli Iniziare a lavorare.

Ti verrà presentata un'immagine dal set di dati di esempio. A questo punto, puoi utilizzare l'interfaccia utente personalizzata di crowd-2d-skeleton per annotare le immagini. Puoi familiarizzare con l'interfaccia utente di crowd-2d-skeleton facendo riferimento a Panoramica dell'interfaccia utente. Usiamo la definizione di rig da Sfida del set di dati di rilevamento dei punti chiave COCO come l'attrezzatura per la posa umana. Per ribadire, puoi personalizzarlo senza il nostro componente dell'interfaccia utente personalizzato per rimuovere o aggiungere punti in base alle tue esigenze.

Una volta terminata l'annotazione di un'immagine, scegli Invio. Questo ti porterà all'immagine successiva nel set di dati finché tutte le immagini non saranno etichettate.

Accedi ai risultati dell'etichettatura

Una volta terminata l'etichettatura di tutte le immagini nel processo di etichettatura, SageMaker Ground Truth invocherà la funzione Lambda post-annotazione e produrrà un file output.manifest contenente tutte le annotazioni. Questo output.manifest verrà archiviato nel bucket S3. Nel nostro caso, la posizione del manifest di output dovrebbe seguire il percorso dell'URI S3 s3://<bucket name> /labeling_jobs/output/<labeling job name>/manifests/output/output.manifest. Il file output.manifest è un file JSON Lines, in cui ogni riga corrisponde a una singola immagine e alle relative annotazioni da parte del personale di etichettatura. Ogni elemento delle righe JSON è un oggetto JSON con molti campi. Il campo che ci interessa si chiama label-results. Il valore di questo campo è un oggetto contenente i seguenti campi:

- dataset_object_id – L'ID o l'indice dell'elemento manifest di input

- data_object_s3_uri – L'URI Amazon S3 dell'immagine

- nome_file_immagine – Il nome del file dell'immagine

- immagine_s3_posizione – L'URL Amazon S3 dell'immagine

- annotazioni_originali – Le annotazioni originali (impostate e utilizzate solo se si utilizza un flusso di lavoro di pre-annotazione)

- annotazioni_aggiornate – Le annotazioni per l'immagine

- lavoratore_id – L'operaio che ha effettuato le annotazioni

- nessuna_modifica_necessaria – Se è stata selezionata la casella di controllo Nessuna modifica necessaria

- è stato_modificato – Se i dati dell'annotazione differiscono dai dati di input originali

- tempo_totale_in_secondi – Il tempo impiegato dal lavoratore per annotare l'immagine

Con questi campi puoi accedere ai risultati delle annotazioni per ciascuna immagine ed eseguire calcoli come il tempo medio per etichettare un'immagine.

Crea i tuoi lavori di etichettatura

Ora che abbiamo creato un esempio di lavoro di etichettatura e hai compreso il processo complessivo, ti guideremo attraverso il codice responsabile della creazione del file manifest e dell'avvio del lavoro di etichettatura. Ci concentreremo sulle parti chiave dello script che potresti voler modificare per avviare i tuoi lavori di etichettatura.

Copriamo frammenti di codice dal file create_example_labeling_job.py script situato in Repository GitHub. Lo script inizia impostando le variabili che verranno utilizzate successivamente nello script. Alcune variabili sono codificate per semplicità, mentre altre, che dipendono dallo stack, verranno importate dinamicamente in fase di runtime recuperando i valori creati dal nostro stack AWS CDK.

La prima sezione chiave in questo script è la creazione del file manifest. Ricorda che il file manifest è un file di linee JSON che contiene i dettagli per un lavoro di etichettatura SageMaker Ground Truth. Ogni oggetto JSON Lines rappresenta un elemento (ad esempio, un'immagine) che deve essere etichettato. Per questo flusso di lavoro, l'oggetto deve contenere i seguenti campi:

- rif.fonte – L'URI Amazon S3 dell'immagine che desideri etichettare.

- annotazioni – Un elenco di oggetti di annotazione, utilizzato per pre-annotare i flussi di lavoro. Vedi il documentazione crowd-2d-skeleton per maggiori dettagli sui valori attesi.

Lo script crea una riga manifest per ogni immagine nella directory delle immagini utilizzando la seguente sezione di codice:

Se desideri utilizzare immagini diverse o puntare a una directory di immagini diversa, puoi modificare quella sezione del codice. Inoltre, se utilizzi un flusso di lavoro di pre-annotazione, puoi aggiornare l'array di annotazioni con una stringa JSON composta dall'array e da tutti i relativi oggetti di annotazione. I dettagli del formato di questo array sono documentati nel file documentazione crowd-2d-skeleton.

Una volta creati gli elementi pubblicitari manifest, puoi creare e caricare il file manifest nel bucket S3 creato in precedenza:

Ora che hai creato un file manifest contenente le immagini che desideri etichettare, puoi creare un processo di etichettatura. È possibile creare il processo di etichettatura a livello di codice utilizzando il file SDK AWS per Python (Boto3). Il codice per creare un lavoro di etichettatura è il seguente:

Gli aspetti di questo codice che potresti voler modificare sono LabelingJobName, TaskTitlee TaskDescription. LabelingJobName è il nome univoco del lavoro di etichettatura che SageMaker utilizzerà per fare riferimento al tuo lavoro. Questo è anche il nome che apparirà sulla console SageMaker. TaskTitle ha uno scopo simile, ma non è necessario che sia univoco e sarà il nome del lavoro visualizzato nel portale della forza lavoro. Potresti voler renderli più specifici per ciò che stai etichettando o per lo scopo del lavoro di etichettatura. Infine, abbiamo il TaskDescription campo. Questo campo viene visualizzato nel portale della forza lavoro per fornire ulteriore contesto agli etichettatori su quale sia l'attività, come istruzioni e indicazioni per l'attività. Per ulteriori informazioni su questi campi e sugli altri, fare riferimento al create_labeling_job documentazione.

Apporta modifiche all'interfaccia utente

In questa sezione esamineremo alcuni modi in cui è possibile personalizzare l'interfaccia utente. Di seguito è riportato un elenco delle potenziali personalizzazioni più comuni dell'interfaccia utente per adattarla all'attività di modellazione:

- È possibile definire quali punti chiave possono essere etichettati. Ciò include il nome del punto chiave e il suo colore.

- Puoi cambiare la struttura dello scheletro (quali punti chiave sono collegati).

- È possibile modificare i colori delle linee per linee specifiche tra punti chiave specifici.

Tutte queste personalizzazioni dell'interfaccia utente sono configurabili tramite argomenti passati al componente crowd-2d-skeleton, che è il componente JavaScript utilizzato in questo modello di flusso di lavoro personalizzato. In questo modello troverai l'utilizzo del componente crowd-2d-skeleton. Una versione semplificata è mostrata nel seguente codice:

Nell'esempio di codice precedente, puoi vedere i seguenti attributi sul componente: imgSrc, keypointClasses, skeletonRig, skeletonBoundingBoxe intialValues. Descriviamo lo scopo di ciascun attributo nelle sezioni seguenti, ma personalizzare l'interfaccia utente è semplice come modificare i valori di questi attributi, salvare il modello ed eseguire nuovamente il programma. post_deployment_script.py abbiamo usato in precedenza.

Attributo imgSrc

Il imgSrc L'attributo controlla quale immagine mostrare nell'interfaccia utente durante l'etichettatura. Di solito, viene utilizzata un'immagine diversa per ogni elemento pubblicitario manifest, quindi questo attributo viene spesso popolato dinamicamente utilizzando l'attributo integrato Liquido linguaggio dei modelli. Nell'esempio di codice precedente puoi vedere che il valore dell'attributo è impostato su {{ task.input.image_s3_uri | grant_read_access }}, che è la variabile del modello Liquid che verrà sostituita con la variabile effettiva image_s3_uri valore quando viene eseguito il rendering del modello. Il processo di rendering inizia quando l'utente apre un'immagine per l'annotazione. Questo processo preleva un elemento pubblicitario dal file manifest di input e lo invia alla funzione Lambda di pre-annotazione come file event.dataObject. La funzione di pre-annotazione prende le informazioni necessarie dall'elemento pubblicitario e restituisce a taskInput dizionario, che viene poi passato al motore di rendering Liquid, che sostituirà qualsiasi variabile Liquid nel modello. Ad esempio, supponiamo che tu abbia un file manifest con la seguente riga:

Questi dati verrebbero passati alla funzione di pre-annotazione. Il codice seguente mostra come la funzione estrae i valori dall'oggetto evento:

L'oggetto restituito dalla funzione in questo caso sarebbe simile al seguente codice:

I dati restituiti dalla funzione sono quindi disponibili per il motore del modello Liquid, che sostituisce i valori del modello nel modello con i valori dei dati restituiti dalla funzione. Il risultato sarebbe qualcosa di simile al seguente codice:

Attributo keypointClasses

Il keypointClasses L'attributo definisce quali punti chiave appariranno nell'interfaccia utente e verranno utilizzati dagli annotatori. Questo attributo accetta una stringa JSON contenente un elenco di oggetti. Ogni oggetto rappresenta un punto chiave. Ogni oggetto keypoint deve contenere i seguenti campi:

- id – Un valore univoco per identificare quel punto chiave.

- colore – Il colore del punto chiave rappresentato come colore esadecimale HTML.

- etichetta – Il nome o la classe del punto chiave.

- x – Questo attributo facoltativo è necessario solo se desideri utilizzare la funzionalità di disegno dello scheletro nell'interfaccia utente. Il valore di questo attributo è la posizione x del punto chiave rispetto al riquadro di delimitazione dello scheletro. Questo valore è solitamente ottenuto da Strumento Skeleton Rig Creator. Se stai eseguendo annotazioni di punti chiave e non hai bisogno di disegnare un intero scheletro in una sola volta, puoi impostare questo valore su 0.

- y – Questo attributo opzionale è simile a x, ma per la dimensione verticale.

Per ulteriori informazioni sulla keypointClasses attributo, vedere il documentazione keypointClasses.

Attributo skeletonRig

Il skeletonRig l'attributo controlla quali punti chiave dovrebbero avere linee tracciate tra di loro. Questo attributo accetta una stringa JSON contenente un elenco di coppie di etichette di punti chiave. Ogni coppia informa l'interfaccia utente su quali punti chiave tracciare le linee. Per esempio, '[["left_ankle","left_knee"],["left_knee","left_hip"]]' informa l'interfaccia utente di tracciare le linee tra "left_ankle" ed "left_knee" e tracciare linee tra "left_knee" ed "left_hip". Questo può essere generato da Strumento Skeleton Rig Creator.

Attributo skeletonBoundingBox

Il skeletonBoundingBox L'attributo è facoltativo ed è necessario solo se desideri utilizzare la funzionalità di disegno dello scheletro nell'interfaccia utente. La funzionalità di disegno dello scheletro consente di annotare interi scheletri con una singola azione di annotazione. Non trattiamo questa funzionalità in questo post. Il valore di questo attributo corrisponde alle dimensioni del riquadro di delimitazione dello scheletro. Questo valore è solitamente ottenuto da Strumento Skeleton Rig Creator. Se stai eseguendo annotazioni di punti chiave e non hai bisogno di disegnare un intero scheletro in una sola volta, puoi impostare questo valore su null. Si consiglia di utilizzare lo strumento Skeleton Rig Creator per ottenere questo valore.

attributo intialValues

Il initialValues L'attributo viene utilizzato per precompilare l'interfaccia utente con annotazioni ottenute da un altro processo (ad esempio un altro processo di etichettatura o un modello di machine learning). Ciò è utile quando si eseguono lavori di regolazione o revisione. I dati per questo campo vengono solitamente popolati dinamicamente nella stessa descrizione per il file imgSrc attributo. Maggiori dettagli possono essere trovati in documentazione crowd-2d-skeleton.

ripulire

Per evitare di incorrere in addebiti futuri, dovresti eliminare gli oggetti nel bucket S3 ed eliminare lo stack AWS CDK. Puoi eliminare i tuoi oggetti S3 tramite la console Amazon SageMaker o il file Interfaccia della riga di comando di AWS (AWS CLI). Dopo aver eliminato tutti gli oggetti S3 nel bucket, puoi distruggere AWS CDK eseguendo il codice seguente:

Ciò rimuoverà le risorse create in precedenza.

Considerazioni

Potrebbero essere necessari passaggi aggiuntivi per rendere produttivo il flusso di lavoro. Ecco alcune considerazioni a seconda del profilo di rischio della tua organizzazione:

- Aggiunta della registrazione degli accessi e delle applicazioni

- Aggiunta di un firewall per applicazioni Web (WAF)

- Modifica delle autorizzazioni IAM per seguire il privilegio minimo

Conclusione

In questo post, abbiamo condiviso l'importanza dell'efficienza e dell'accuratezza dell'etichettatura nella creazione di set di dati per la stima delle pose. Per aiutare con entrambi gli elementi, abbiamo mostrato come utilizzare SageMaker Ground Truth per creare flussi di lavoro di etichettatura personalizzati per supportare attività di etichettatura di pose basate sullo scheletro, con l'obiettivo di migliorare l'efficienza e la precisione durante il processo di etichettatura. Abbiamo mostrato come estendere ulteriormente il codice e gli esempi a vari requisiti di etichettatura per la stima della posa personalizzata.

Ti invitiamo a utilizzare questa soluzione per le tue attività di etichettatura e a collaborare con AWS per assistenza o domande relative ai flussi di lavoro di etichettatura personalizzati.

Informazioni sugli autori

Arthur Putnam è un data scientist full-stack nei servizi professionali AWS. L'esperienza di Arthur è incentrata sullo sviluppo e sull'integrazione di tecnologie front-end e back-end nei sistemi di intelligenza artificiale. Al di fuori del lavoro, ad Arthur piace esplorare gli ultimi progressi tecnologici, trascorrere del tempo con la sua famiglia e godersi la vita all'aria aperta.

Arthur Putnam è un data scientist full-stack nei servizi professionali AWS. L'esperienza di Arthur è incentrata sullo sviluppo e sull'integrazione di tecnologie front-end e back-end nei sistemi di intelligenza artificiale. Al di fuori del lavoro, ad Arthur piace esplorare gli ultimi progressi tecnologici, trascorrere del tempo con la sua famiglia e godersi la vita all'aria aperta.

Ben Fenker è Senior Data Scientist in AWS Professional Services e ha aiutato i clienti a creare e distribuire soluzioni ML in settori che vanno dallo sport all'assistenza sanitaria alla produzione. Ha un dottorato di ricerca. in fisica presso la Texas A&M University e 6 anni di esperienza nel settore. A Ben piace giocare a baseball, leggere e crescere i suoi figli.

Ben Fenker è Senior Data Scientist in AWS Professional Services e ha aiutato i clienti a creare e distribuire soluzioni ML in settori che vanno dallo sport all'assistenza sanitaria alla produzione. Ha un dottorato di ricerca. in fisica presso la Texas A&M University e 6 anni di esperienza nel settore. A Ben piace giocare a baseball, leggere e crescere i suoi figli.

Jarvis Lee è un Senior Data Scientist presso AWS Professional Services. Lavora con AWS da oltre sei anni, lavorando con i clienti su problemi di machine learning e visione artificiale. Fuori dal lavoro gli piace andare in bicicletta.

Jarvis Lee è un Senior Data Scientist presso AWS Professional Services. Lavora con AWS da oltre sei anni, lavorando con i clienti su problemi di machine learning e visione artificiale. Fuori dal lavoro gli piace andare in bicicletta.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/skeleton-based-pose-annotation-labeling-using-amazon-sagemaker-ground-truth/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 13

- 15%

- 17

- 2D

- 31

- 320

- 7

- 8

- 9

- a

- capacità

- capace

- accesso

- accessibile

- Il mio account

- precisione

- preciso

- con precisione

- acquisire

- acquisizione

- operanti in

- Action

- atti

- presenti

- aggiungere

- aggiuntivo

- Inoltre

- Adattamento

- regolazioni

- avanzamenti

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Sistemi di intelligenza artificiale

- Mirare

- Tutti

- consentire

- consente

- anche

- Amazon

- Amazon Sage Maker

- Amazon SageMaker verità fondamentale

- Amazon Web Services

- an

- ed

- animali

- Un altro

- in qualsiasi

- apparire

- appare

- Applicazioni

- applicazioni

- applicato

- architettura

- SONO

- argomento

- argomenti

- in giro

- Italia

- Artù

- AS

- aspetti

- addetto

- Assistenza

- assume

- At

- gli attributi

- aumentata

- Realtà aumentata (RA)

- automaticamente

- disponibile

- media

- evitare

- AWS

- Servizi professionali AWS

- Back-end

- Baseball

- basato

- Linea di base

- BE

- perché

- stato

- prima

- iniziare

- essendo

- Ben

- fra

- entrambi

- Scatola

- ampio

- del browser

- costruire

- Costruzione

- incassato

- onere

- ma

- by

- calcoli

- detto

- Materiale

- attentamente

- Custodie

- CD

- centrato

- il cambiamento

- Modifiche

- cambiando

- oneri

- dai un'occhiata

- Scegli

- classe

- depuratore

- cli

- cliente

- codice

- colore

- viene

- Uncommon

- completamento di una

- componente

- componenti

- Compreso

- computer

- Visione computerizzata

- collegato

- Considerazioni

- coerente

- Consistente

- consolle

- contenere

- contiene

- contesto

- controlli

- corrisponde

- Costo

- coprire

- creare

- creato

- crea

- Creazione

- creazione

- Creatore

- critico

- incrocio

- folla

- costume

- Custom-built

- Clienti

- personalizzazione

- personalizzare

- dati

- elaborazione dati

- scienziato di dati

- dataset

- datetime

- deep

- apprendimento profondo

- più profondo

- definire

- definito

- definisce

- definizione

- dimostrare

- dipendente

- Dipendente

- dipende

- schierare

- schierato

- descrivere

- descrizione

- progettato

- progettazione

- desiderato

- distruggere

- dettaglio

- dettagli

- rivelazione

- in via di sviluppo

- diagramma

- diverso

- Dimensioni

- dimensioni

- direttamente

- elenco

- distribuzione

- immersione

- paesaggio differenziato

- do

- non

- fare

- fatto

- Dont

- download

- disegnare

- disegnato

- dovuto

- durante

- dinamicamente

- ogni

- In precedenza

- alleviare

- facilmente

- efficacia

- efficienza

- incoraggiare

- impegnarsi

- motore

- accrescere

- godendo

- assicura

- Intrattenimento

- Intero

- Ambiente

- errore

- errori

- Anche

- Evento

- esaminare

- esempio

- Esempi

- Espandere

- previsto

- esperienza

- competenza

- Spiegare

- Esplorare

- estendere

- extra

- estratti

- familiare

- familiarizzare

- famiglia

- caratteristica

- Caratteristiche

- campo

- campi

- Compila il

- File

- finale

- Trovate

- firewall

- Nome

- Flessibilità

- Focus

- seguire

- i seguenti

- segue

- Calcio

- Nel

- formato

- essere trovato

- da

- function

- funzionalità

- funzioni

- fondamentale

- ulteriormente

- futuro

- generato

- ottenere

- gif

- GitHub

- Dare

- Go

- Terra

- guida

- Maniglie

- Avere

- avendo

- he

- assistenza sanitaria

- pesantemente

- Aiuto

- aiutato

- utile

- aiuta

- qui

- HEX

- alta qualità

- il suo

- host

- ospitato

- di hosting

- Come

- Tutorial

- HTML

- http

- HTTPS

- umano

- centinaia

- ID

- identificato

- identificare

- identificazione

- Identità

- if

- Immagine

- immagini

- importanza

- importante

- competenze

- migliorata

- in

- inclusi

- Incorporated

- Index

- industrie

- industria

- inefficiente

- influenzato

- informazioni

- Informa

- iniziative

- ingresso

- Richieste

- install

- istruzioni

- Integrazione

- interesse

- interessato

- Interfaccia

- Internet

- ai miglioramenti

- comporta

- IT

- elementi

- SUO

- JavaScript

- Lavoro

- Offerte di lavoro

- jpg

- json

- Le

- Rilevamento di punti chiave

- bambini

- Discografica

- etichettatura

- per il tuo brand

- Lingua

- grandi

- infine

- dopo

- con i più recenti

- lanciare

- lanciato

- lancio

- principale

- IMPARARE

- apprendimento

- meno

- Consente di

- piace

- linea

- Linee

- Liquido

- Lista

- collocato

- località

- ceppo

- registrati

- Guarda

- una

- macchina

- machine learning

- fatto

- make

- gestire

- Manuale

- consigliato per la

- molti

- marchio

- marcatura

- Maggio..

- può essere

- Media

- medicale

- Applicazioni mediche

- Metadati

- ridurre al minimo

- errori

- ML

- modello

- modellismo

- modelli

- modifiche

- modificare

- Scopri di più

- maggior parte

- Nome

- Natura

- necessaria

- Bisogno

- di applicazione

- esigenze

- GENERAZIONE

- no

- Nota

- adesso

- oggetto

- oggetti

- ottenuto

- ottenendo

- of

- di frequente

- on

- una volta

- ONE

- online

- esclusivamente

- aprire

- open source

- apre

- or

- minimo

- organizzazioni

- origine

- i

- OS

- Altro

- Altri

- nostro

- su

- all'aperto

- produzione

- al di fuori

- ancora

- complessivo

- proprio

- Packages

- coppia

- coppie

- parte

- Ricambi

- Passato

- sentiero

- Persone

- performance

- permessi

- Fisica

- posto

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- punti

- politica

- popolata

- Portale

- posa

- Stima della posa

- pone

- posizione

- Post

- potenziale

- pratica

- precedente

- Precisione

- prerequisiti

- presentata

- presentazione

- prevenire

- impedisce

- precedente

- in precedenza

- principio

- un bagno

- problemi

- processi

- i processi

- lavorazione

- produrre

- professionale

- Profilo

- fornire

- purché

- fornisce

- la percezione

- scopo

- fini

- Python

- qualità

- rapidamente

- raccolta

- gamma

- che vanno

- Leggi

- Lettura

- pronto

- mondo reale

- Realtà

- riconoscere

- raccomandato

- riducendo

- riferimento

- riferimento

- relazionato

- parente

- affidabile

- rimanere

- rimuovere

- reso

- interpretazione

- sostituire

- sostituito

- deposito

- rappresentato

- rappresenta

- necessario

- Requisiti

- richiede

- Risorse

- risposta

- responsabile

- restrizioni

- colpevole

- Risultati

- ritorno

- problemi

- recensioni

- equitazione

- impianto

- Rischio

- robotica

- robusto

- Ruolo

- Correre

- running

- runtime

- sagemaker

- stesso

- campione

- risparmio

- dire

- Scenari

- Scienziato

- copione

- script

- sdk

- Sezione

- sezioni

- problemi di

- vedere

- select

- invia

- anziano

- serve

- Servizi

- set

- regolazione

- alcuni

- condiviso

- dovrebbero

- mostrare attraverso le sue creazioni

- ha mostrato

- mostrato

- Spettacoli

- significativa

- simile

- Un'espansione

- semplicità

- semplificata

- semplicemente

- singolo

- SIX

- So

- soluzione

- Soluzioni

- alcuni

- qualcosa

- Fonte

- la nostra speciale

- specifico

- in particolare

- Spendere

- Sports

- pila

- inizio

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- lineare

- snellire

- Corda

- La struttura

- sostanziale

- tale

- supporto

- swap

- swap

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- mirata

- Task

- task

- per l'esame

- Tecnologie

- Tecnologia

- modello

- decine

- Texas

- che

- Il

- le informazioni

- La linea

- loro

- Li

- poi

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- migliaia

- Attraverso

- Legato

- tempo

- a

- ha preso

- Treni

- allenato

- Training

- innescato

- camion

- vero

- Verità

- TURNO

- tipicamente

- ui

- capire

- unico

- Università

- fino a quando

- Aggiornanento

- Impiego

- uso

- utilizzato

- utile

- Utente

- Interfaccia utente

- usa

- utilizzando

- generalmente

- APPREZZIAMO

- Valori

- variabile

- variazioni

- vario

- Veicoli

- versione

- verticale

- via

- Video

- visione

- visivo

- volume

- W

- camminare

- passeggiate

- walkthrough

- volere

- Prima

- Modo..

- modi

- we

- sito web

- applicazione web

- browser web

- servizi web

- WELL

- Che

- quando

- mentre

- se

- quale

- while

- OMS

- volere

- desiderio

- con

- entro

- senza

- Lavora

- lavoratore

- flusso di lavoro

- flussi di lavoro

- Forza lavoro

- lavoro

- sarebbe

- scrittura

- X

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- te stesso

- zefiro