Questo è un post sul blog degli ospiti scritto insieme a Vik Pant e Kyle Bassett di PwC.

Con le organizzazioni che investono sempre più nel machine learning (ML), l'adozione del ML è diventata parte integrante delle strategie di trasformazione aziendale. Un recente CEO di PwC sondaggio ha rivelato che l'84% dei CEO canadesi concorda sul fatto che l'intelligenza artificiale (AI) cambierà in modo significativo il loro business entro i prossimi 5 anni, rendendo questa tecnologia più critica che mai. Tuttavia, l'implementazione del machine learning in produzione comporta varie considerazioni, in particolare la possibilità di navigare nel mondo dell'IA in modo sicuro, strategico e responsabile. Uno dei primi passi e in particolare una grande sfida per diventare alimentati dall'intelligenza artificiale è lo sviluppo efficace di pipeline ML in grado di scalare in modo sostenibile nel cloud. Pensare al machine learning in termini di pipeline che generano e mantengono modelli piuttosto che modelli da soli aiuta a costruire sistemi di previsione versatili e resilienti che sono maggiormente in grado di resistere a modifiche significative dei dati rilevanti nel tempo.

Molte organizzazioni iniziano il loro viaggio nel mondo del machine learning con un punto di vista incentrato sul modello. Nelle prime fasi della costruzione di una pratica ML, l'attenzione è rivolta all'addestramento di modelli ML supervisionati, che sono rappresentazioni matematiche delle relazioni tra input (variabili indipendenti) e output (variabili dipendenti) che vengono apprese dai dati (tipicamente storici). I modelli sono artefatti matematici che accettano dati di input, eseguono calcoli e calcoli su di essi e generano previsioni o inferenze.

Sebbene questo approccio sia un punto di partenza ragionevole e relativamente semplice, non è intrinsecamente scalabile o intrinsecamente sostenibile a causa della natura manuale e ad hoc delle attività di addestramento, messa a punto, test e prova del modello. Le organizzazioni con maggiore maturità nel dominio ML adottano un paradigma di operazioni ML (MLOps) che incorpora integrazione continua, distribuzione continua, implementazione continua e formazione continua. Al centro di questo paradigma c'è un punto di vista incentrato sulla pipeline per lo sviluppo e il funzionamento di sistemi ML di livello industriale.

In questo post, iniziamo con una panoramica di MLOps e dei suoi vantaggi, descriviamo una soluzione per semplificarne le implementazioni e forniamo dettagli sull'architettura. Concludiamo con un case study che evidenzia i vantaggi realizzati da un grande cliente AWS e PwC che ha implementato questa soluzione.

sfondo

Una pipeline MLOps è un insieme di sequenze di passaggi correlati utilizzati per creare, distribuire, utilizzare e gestire uno o più modelli ML in produzione. Tale pipeline comprende le fasi coinvolte nella creazione, test, messa a punto e distribuzione di modelli ML, inclusi, a titolo esemplificativo ma non esaustivo, preparazione dei dati, ingegneria delle funzionalità, addestramento del modello, valutazione, distribuzione e monitoraggio. Pertanto, un modello ML è il prodotto di una pipeline MLOps e una pipeline è un flusso di lavoro per la creazione di uno o più modelli ML. Tali pipeline supportano processi strutturati e sistematici per la costruzione, la calibrazione, la valutazione e l'implementazione di modelli ML e i modelli stessi generano previsioni e inferenze. Automatizzando lo sviluppo e l'operatività delle fasi delle pipeline, le organizzazioni possono ridurre i tempi di consegna dei modelli, aumentare la stabilità dei modelli in produzione e migliorare la collaborazione tra team di data scientist, ingegneri del software e amministratori IT.

Panoramica della soluzione

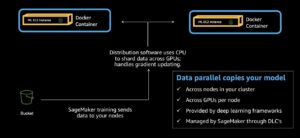

AWS offre un portafoglio completo di servizi cloud-native per lo sviluppo e l'esecuzione di pipeline MLOps in modo scalabile e sostenibile. Amazon Sage Maker comprende un portafoglio completo di funzionalità come servizio MLOps completamente gestito per consentire agli sviluppatori di creare, addestrare, distribuire, utilizzare e gestire modelli ML nel cloud. SageMaker copre l'intero flusso di lavoro MLOps, dalla raccolta alla preparazione e all'addestramento dei dati con algoritmi integrati ad alte prestazioni e sofisticati esperimenti di ML automatizzato (AutoML) in modo che le aziende possano scegliere modelli specifici che si adattano alle loro priorità e preferenze aziendali. SageMaker consente alle organizzazioni di automatizzare in modo collaborativo la maggior parte del loro ciclo di vita MLOps in modo che possano concentrarsi sui risultati aziendali senza rischiare ritardi nei progetti o aumentare i costi. In questo modo, SageMaker consente alle aziende di concentrarsi sui risultati senza preoccuparsi dell'infrastruttura, dello sviluppo e della manutenzione associati al potenziamento dei servizi di previsione di livello industriale.

SageMaker include JumpStart di Amazon SageMaker, che offre modelli di soluzioni pronte all'uso per le organizzazioni che cercano di accelerare il loro percorso MLOps. Le organizzazioni possono iniziare con modelli preformati e open source che possono essere perfezionati per soddisfare le loro esigenze specifiche attraverso la riqualificazione e il trasferimento dell'apprendimento. Inoltre, JumpStart fornisce modelli di soluzione progettati per affrontare casi d'uso comuni, oltre a notebook Jupyter di esempio con codice iniziale prescritto. È possibile accedere a queste risorse semplicemente visitando la pagina di destinazione JumpStart all'interno Amazon Sage Maker Studio.

PwC ha creato un acceleratore MLOps preconfezionato che accelera ulteriormente il time-to-value e aumenta il ritorno sull'investimento per le organizzazioni che utilizzano SageMaker. Questo acceleratore MLOps migliora le funzionalità native di JumpStart integrando servizi AWS complementari. Con una suite completa di artefatti tecnici, tra cui script IaC (Infrastructure as Code), flussi di lavoro di elaborazione dei dati, codice di integrazione dei servizi e modelli di configurazione della pipeline, l'acceleratore MLOps di PwC semplifica il processo di sviluppo e gestione dei sistemi di previsione della classe di produzione.

Panoramica sull'architettura

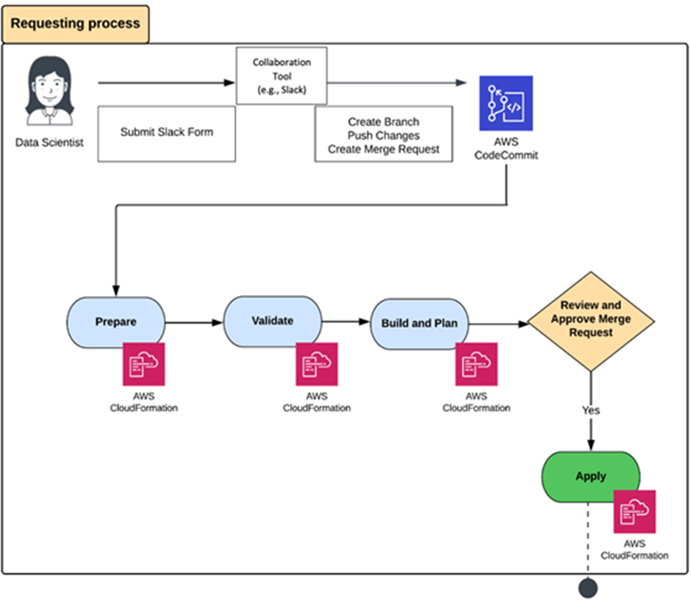

L'inclusione di servizi serverless nativi per il cloud di AWS ha la priorità nell'architettura dell'acceleratore PwC MLOps. Il punto di ingresso in questo acceleratore è qualsiasi strumento di collaborazione, come Slack, che un data scientist o un data engineer può utilizzare per richiedere un ambiente AWS per MLOps. Tale richiesta viene analizzata e quindi approvata in modo completo o semiautomatico utilizzando le funzionalità del flusso di lavoro in quello strumento di collaborazione. Dopo che una richiesta è stata approvata, i suoi dettagli vengono utilizzati per la parametrizzazione dei modelli IaC. Il codice sorgente per questi modelli IaC è gestito in AWS CodeCommit. Questi modelli IaC parametrizzati sono inviati a AWS CloudFormazione per la modellazione, il provisioning e la gestione di stack di risorse AWS e di terze parti.

Il diagramma seguente illustra il flusso di lavoro.

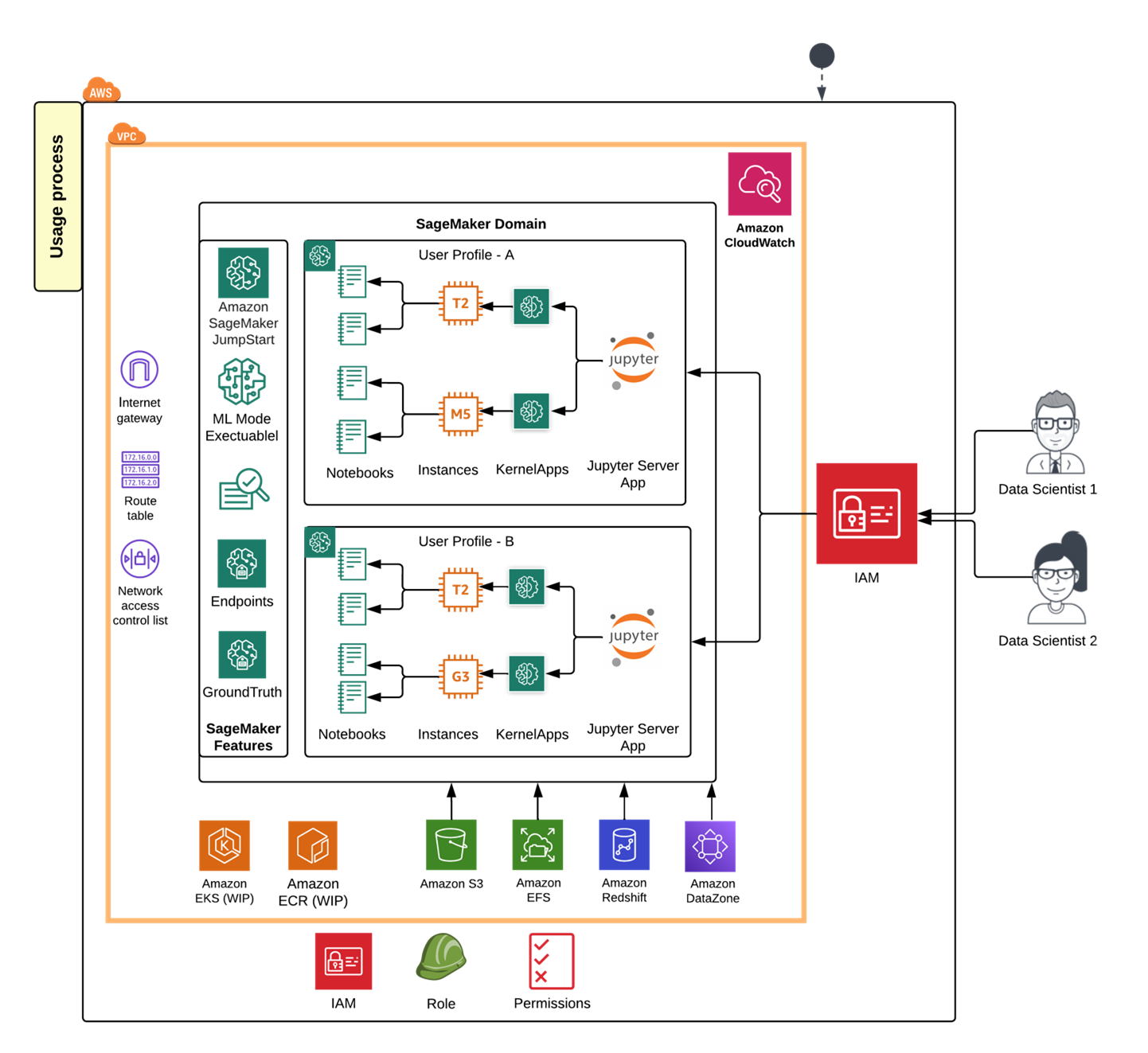

Dopo che AWS CloudFormation esegue il provisioning di un ambiente per MLOps su AWS, l'ambiente è pronto per l'uso da parte di data scientist, data engineer e dei loro collaboratori. L'acceleratore PWC include ruoli predefiniti su Gestione dell'identità e dell'accesso di AWS (IAM) che sono correlati alle attività e ai compiti MLOps. Questi ruoli specificano i servizi e le risorse nell'ambiente MLOps a cui possono accedere diversi utenti in base ai loro profili professionali. Dopo aver effettuato l'accesso all'ambiente MLOps, gli utenti possono accedere a qualsiasi modalità su SageMaker per svolgere i propri compiti. Questi includono istanze notebook SageMaker, Pilota automatico Amazon SageMaker esperimenti e Studio. Puoi trarre vantaggio da tutte le caratteristiche e le funzioni di SageMaker, inclusi addestramento, messa a punto, valutazione, implementazione e monitoraggio del modello.

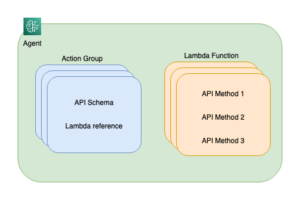

L'acceleratore include anche connessioni con Amazon DataZone per la condivisione, la ricerca e la scoperta di dati su larga scala oltre i confini organizzativi per generare e arricchire i modelli. Allo stesso modo, i dati per l'addestramento, il test, la convalida e il rilevamento della deriva del modello possono fornire una varietà di servizi, tra cui Amazon RedShift, Servizio di database relazionale Amazon (AmazonRDS), File system elastico Amazon (Amazon EFS) e Servizio di archiviazione semplice Amazon (Amazon S3). I sistemi di previsione possono essere implementati in molti modi, incluso come endpoint SageMaker direttamente, endpoint SageMaker racchiusi in AWS Lambda funzioni e endpoint SageMaker richiamati tramite codice personalizzato su Servizio Amazon Elastic Kubernetes (Amazon EKS) o Cloud di calcolo elastico di Amazon (Amazon EC2). Amazon Cloud Watch viene utilizzato per monitorare l'ambiente per MLOps su AWS in modo completo per osservare i dati di allarmi, log ed eventi dall'intero stack (applicazioni, infrastruttura, rete e servizi).

Il diagramma seguente illustra questa architettura.

Caso di studio

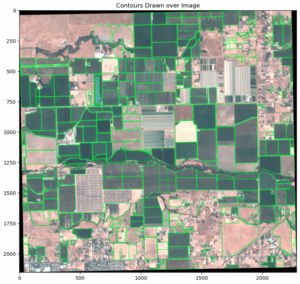

In questa sezione, condividiamo un caso di studio illustrativo di una grande compagnia di assicurazioni in Canada. Si concentra sull'impatto trasformativo dell'implementazione dell'acceleratore MLOps di PwC Canada e dei modelli JumpStart.

Questo cliente ha collaborato con PwC Canada e AWS per affrontare le sfide con lo sviluppo di modelli inefficienti e processi di distribuzione inefficaci, mancanza di coerenza e collaborazione e difficoltà nel ridimensionare i modelli ML. L'implementazione di questo MLOps Accelerator insieme ai modelli JumpStart ha ottenuto quanto segue:

- Automazione end-to-end – L'automazione ha quasi dimezzato la quantità di tempo per la preelaborazione dei dati, l'addestramento del modello, l'ottimizzazione degli iperparametri e la distribuzione e il monitoraggio del modello

- Collaborazione e standardizzazione – Strumenti e framework standardizzati per promuovere la coerenza all'interno dell'organizzazione hanno quasi raddoppiato il tasso di innovazione del modello

- Governance e compliance del modello – Hanno implementato un framework di governance del modello per garantire che tutti i modelli ML soddisfacessero i requisiti normativi e aderissero alle linee guida etiche dell'azienda, riducendo i costi di gestione del rischio del 40%

- Infrastruttura cloud scalabile – Hanno investito in un'infrastruttura scalabile per gestire efficacemente enormi volumi di dati e implementare più modelli ML contemporaneamente, riducendo i costi di infrastruttura e piattaforma del 50%

- Distribuzione rapida – La soluzione preconfezionata ha ridotto i tempi di produzione del 70%

Fornendo best practice MLOps attraverso pacchetti di implementazione rapida, il nostro cliente è stato in grado di ridurre i rischi della propria implementazione MLOps e sbloccare il pieno potenziale di ML per una gamma di funzioni aziendali, come la previsione del rischio e la determinazione del prezzo degli asset. Nel complesso, la sinergia tra l'acceleratore PwC MLOps e JumpStart ha consentito al nostro cliente di semplificare, ridimensionare, proteggere e sostenere le proprie attività di data science e data engineering.

Va notato che la soluzione PwC e AWS non è specifica del settore ed è rilevante per tutti i settori e settori.

Conclusione

SageMaker e i suoi acceleratori consentono alle organizzazioni di migliorare la produttività del loro programma ML. Ci sono molti vantaggi, inclusi ma non limitati a quanto segue:

- Crea in modo collaborativo casi d'uso IaC, MLOps e AutoML per ottenere vantaggi aziendali dalla standardizzazione

- Consenti una prototipazione sperimentale efficiente, con e senza codice, per potenziare l'AI dallo sviluppo all'implementazione con IaC, MLOps e AutoML

- Automatizza attività noiose e dispendiose in termini di tempo, come l'ingegnerizzazione delle funzionalità e l'ottimizzazione degli iperparametri con AutoML

- Impiega un paradigma di monitoraggio continuo del modello per allineare il rischio dell'utilizzo del modello ML con la propensione al rischio aziendale

Si prega di contattare gli autori di questo post, Consulenza AWS Canada, o PwC Canada per saperne di più su Jumpstart e sull'acceleratore MLOps di PwC.

Informazioni sugli autori

Vik è un partner nella pratica Cloud & Data presso PwC Canada Ha conseguito un dottorato di ricerca in Scienze dell'informazione presso l'Università di Toronto. È convinto che esista una connessione telepatica tra la sua rete neurale biologica e le reti neurali artificiali che addestra su SageMaker. Connettiti con lui su LinkedIn.

Vik è un partner nella pratica Cloud & Data presso PwC Canada Ha conseguito un dottorato di ricerca in Scienze dell'informazione presso l'Università di Toronto. È convinto che esista una connessione telepatica tra la sua rete neurale biologica e le reti neurali artificiali che addestra su SageMaker. Connettiti con lui su LinkedIn.

Kyle è un partner nella pratica Cloud & Data presso PwC Canada, insieme al suo fantastico team di alchimisti tecnologici, tessono incantevoli soluzioni MLOP che ipnotizzano i clienti con un valore aziendale accelerato. Armato del potere dell'intelligenza artificiale e di un pizzico di magia, Kyle trasforma sfide complesse in fiabe digitali, rendendo possibile l'impossibile. Connettiti con lui su LinkedIn.

Kyle è un partner nella pratica Cloud & Data presso PwC Canada, insieme al suo fantastico team di alchimisti tecnologici, tessono incantevoli soluzioni MLOP che ipnotizzano i clienti con un valore aziendale accelerato. Armato del potere dell'intelligenza artificiale e di un pizzico di magia, Kyle trasforma sfide complesse in fiabe digitali, rendendo possibile l'impossibile. Connettiti con lui su LinkedIn.

Francois è Principal Advisory Consultant presso AWS Professional Services Canada e responsabile della pratica canadese per Data and Innovation Advisory. Guida i clienti a stabilire e implementare il loro viaggio globale nel cloud e i loro programmi di dati, concentrandosi su visione, strategia, driver di business, governance, modelli operativi target e roadmap. Connettiti con lui su LinkedIn.

Francois è Principal Advisory Consultant presso AWS Professional Services Canada e responsabile della pratica canadese per Data and Innovation Advisory. Guida i clienti a stabilire e implementare il loro viaggio globale nel cloud e i loro programmi di dati, concentrandosi su visione, strategia, driver di business, governance, modelli operativi target e roadmap. Connettiti con lui su LinkedIn.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerate-machine-learning-time-to-value-with-amazon-sagemaker-jumpstart-and-pwcs-mlops-accelerator/

- :ha

- :È

- :non

- $ SU

- 100

- 7

- a

- capace

- WRI

- accelerare

- accelerata

- acceleratore

- acceleratori

- accesso

- accessibile

- Accedendo

- raggiunto

- operanti in

- attività

- Ad

- Inoltre

- indirizzo

- amministratori

- adottare

- Adozione

- consultivo

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Algoritmi

- allineare

- Tutti

- consentire

- consente

- lungo

- anche

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- quantità

- an

- ed

- in qualsiasi

- applicazioni

- approccio

- approvato

- architettura

- SONO

- armato

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- AS

- valutare

- attività

- associato

- At

- gli autori

- automatizzare

- Automatizzata

- Automatizzare

- Automazione

- AutoML

- AWS

- AWS CloudFormazione

- Servizi professionali AWS

- basato

- BE

- diventare

- diventando

- essendo

- beneficio

- vantaggi

- MIGLIORE

- best practice

- Meglio

- fra

- Blog

- confini

- costruire

- Costruzione

- costruito

- incassato

- affari

- funzioni aziendali

- Trasformazione aziendale

- aziende

- ma

- by

- calcoli

- Materiale

- Canada

- canadese

- funzionalità

- Custodie

- caso di studio

- casi

- centrale

- ceo

- CEO

- Challenge

- sfide

- il cambiamento

- Modifiche

- Scegli

- cliente

- clienti

- Cloud

- infrastruttura cloud

- codice

- collaborazione

- Raccolta

- COM

- viene

- Uncommon

- Aziende

- azienda

- Società

- complementare

- completamento di una

- complesso

- globale

- incluso

- calcoli

- Calcolare

- concerto

- Configurazione

- Connettiti

- veloce

- Connessioni

- Considerazioni

- consulente

- contatti

- continuo

- Costi

- Copertine

- crepa

- creare

- Creazione

- critico

- costume

- cliente

- Clienti

- dati

- Preparazione dei dati

- elaborazione dati

- scienza dei dati

- scienziato di dati

- Banca Dati

- ritardi

- consegna

- consegna

- dipendente

- schierare

- schierato

- distribuzione

- deployment

- descrivere

- progettato

- dettagli

- sviluppatori

- in via di sviluppo

- Mercato

- Livello di difficoltà

- digitale

- direttamente

- scoprire

- dominio

- raddoppiato

- driver

- dovuto

- Presto

- guadagnato

- in maniera efficace

- efficiente

- enable

- abilitato

- Abilita

- comprende

- ingegnere

- Ingegneria

- Ingegneri

- accrescere

- Migliora

- arricchire

- garantire

- Impresa

- Intero

- iscrizione

- Ambiente

- stabilire

- etico

- valutazione

- eventi

- EVER

- esempio

- esperimenti

- caratteristica

- Caratteristiche

- Compila il

- finire

- Nome

- primi passi

- in forma

- Focus

- si concentra

- messa a fuoco

- i seguenti

- Nel

- Contesto

- quadri

- da

- pieno

- completamente

- funzioni

- ulteriormente

- generare

- la governance

- grande

- maggiore

- GUEST

- linee guida

- Guide

- dimezzato

- he

- aiuta

- Alte prestazioni

- mettendo in evidenza

- lui

- il suo

- storico

- Tuttavia

- HTML

- http

- HTTPS

- Sintonia iperparametro

- Identità

- illustra

- Impact

- realizzare

- implementazione

- implementato

- Implementazione

- impossibile

- competenze

- in

- includere

- inclusi

- Compreso

- inclusione

- Aumento

- Aumenta

- sempre più

- studente indipendente

- industrie

- industria

- inefficiente

- info

- informazioni

- Infrastruttura

- Innovazione

- ingresso

- Ingressi

- assicurazione

- integrale

- Integrazione

- integrazione

- Intelligence

- ai miglioramenti

- intrinsecamente

- investito

- investire

- investimento

- invocato

- coinvolto

- IT

- SUO

- Lavoro

- viaggio

- jpg

- Dipingere

- atterraggio

- grandi

- portare

- IMPARARE

- imparato

- apprendimento

- ciclo di vita

- Limitato

- macchina

- machine learning

- mantenere

- manutenzione

- Maggioranza

- Fare

- gestire

- gestito

- gestione

- gestione

- modo

- Manuale

- molti

- massiccio

- matematico

- maturità

- significativo

- Soddisfare

- ML

- MLOp

- modello

- modelli

- Monitorare

- monitoraggio

- Scopri di più

- multiplo

- nativo

- Natura

- Navigare

- quasi

- esigenze

- Rete

- reti

- rete neurale

- reti neurali

- GENERAZIONE

- segnatamente

- taccuino

- noto

- osservare

- of

- Offerte

- on

- ONE

- open source

- operare

- operativo

- Operazioni

- or

- organizzazione

- organizzativa

- organizzazioni

- nostro

- ancora

- complessivo

- panoramica

- Packages

- pagina

- paradigma

- parte

- partner

- collaborato

- modelli

- Eseguire

- conduttura

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- lavori

- possibile

- Post

- potenziale

- energia

- alimentato

- Accensione

- pratica

- pratiche

- predizione

- Previsioni

- preferenze

- preparazione

- prezzi

- Direttore

- priorità

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- della produttività

- professionale

- Profili

- Programma

- Programmi

- progetto

- promuoverlo

- prototipazione

- fornire

- fornisce

- PWC

- gamma

- veloce

- tasso

- piuttosto

- pronto

- rendersi conto

- ragionevole

- recente

- ridurre

- Ridotto

- riducendo

- normativo

- relazionato

- Relazioni

- relativamente

- pertinente

- richiesta

- Requisiti

- elastico

- Risorse

- Risultati

- ritorno

- Rischio

- gestione del rischio

- rischiando

- roadmap

- ruoli

- running

- tranquillamente

- sagemaker

- scalabile

- Scala

- scala

- Scienze

- Scienziato

- scienziati

- script

- ricerca

- Sezione

- Settori

- sicuro

- cerca

- serverless

- servizio

- Servizi

- set

- Condividi

- compartecipazione

- dovrebbero

- significativamente

- Allo stesso modo

- Un'espansione

- semplificare

- semplicemente

- contemporaneamente

- allentato

- So

- Software

- soluzione

- Soluzioni

- sofisticato

- Fonte

- codice sorgente

- specifico

- velocità

- Stabilità

- pila

- Stacks

- tappe

- inizia a

- Di partenza

- Passi

- conservazione

- strategicamente

- strategie

- Strategia

- snellire

- strutturato

- studio

- Studio

- presentata

- tale

- suite

- supporto

- sostenibile

- sinergia

- SISTEMI DI TRATTAMENTO

- attrezzatura

- Fai

- Target

- task

- team

- le squadre

- Tech

- Consulenza

- Tecnologia

- modelli

- condizioni

- Testing

- di

- che

- Il

- L’ORIGINE

- il mondo

- loro

- Li

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Pensiero

- di parti terze standard

- questo

- Attraverso

- tempo

- richiede tempo

- a

- strumenti

- toronto

- Treni

- Training

- forma

- trasferimento

- Trasformazione

- trasformativa

- si

- tipicamente

- Università

- sbloccare

- svelato

- Impiego

- uso

- utilizzato

- utenti

- utilizzando

- APPREZZIAMO

- varietà

- vario

- versatile

- visione

- volumi

- Prima

- Modo..

- modi

- we

- Tessere

- sito web

- servizi web

- WELL

- quale

- OMS

- volere

- con

- entro

- senza

- flussi di lavoro

- mondo

- Avvolto

- anni

- Tu

- zefiro