Negli ultimi anni, i progressi nella visione artificiale hanno consentito a ricercatori, soccorritori e governi di affrontare l'impegnativo problema dell'elaborazione di immagini satellitari globali per comprendere il nostro pianeta e il nostro impatto su di esso. AWS recentemente rilasciato Funzionalità geospaziali di Amazon SageMaker per fornirti immagini satellitari e modelli geospaziali di machine learning (ML) all'avanguardia, riducendo le barriere per questi tipi di casi d'uso. Per ulteriori informazioni, fare riferimento a Anteprima: utilizzo di Amazon SageMaker per creare, addestrare e distribuire modelli ML utilizzando dati geospaziali.

Molte agenzie, inclusi i primi soccorritori, stanno utilizzando queste offerte per acquisire consapevolezza situazionale su larga scala e dare priorità agli sforzi di soccorso nelle aree geografiche che sono state colpite da disastri naturali. Spesso queste agenzie hanno a che fare con immagini di disastri provenienti da fonti satellitari ea bassa quota, e questi dati sono spesso non etichettati e difficili da usare. I modelli di visione artificiale all'avanguardia spesso hanno prestazioni inferiori quando si guardano le immagini satellitari di una città colpita da un uragano o da un incendio. Data la mancanza di questi set di dati, anche i modelli ML all'avanguardia spesso non sono in grado di fornire l'accuratezza e la precisione necessarie per prevedere le classificazioni standard dei disastri FEMA.

I set di dati geospaziali contengono metadati utili come coordinate di latitudine e longitudine e timestamp, che possono fornire un contesto per queste immagini. Ciò è particolarmente utile per migliorare la precisione del ML geospaziale per le scene di disastro, perché queste immagini sono intrinsecamente disordinate e caotiche. Gli edifici sono meno rettangolari, la vegetazione ha subito danni e le strade lineari sono state interrotte da allagamenti o smottamenti. Poiché l'etichettatura di questi enormi set di dati è costosa, manuale e richiede molto tempo, lo sviluppo di modelli ML in grado di automatizzare l'etichettatura e l'annotazione delle immagini è fondamentale.

Per addestrare questo modello, abbiamo bisogno di un sottoinsieme di verità di base etichettato di Set di dati LADI (Low Altitude Disaster Imagery). Questo set di dati è costituito da immagini aeree con annotazioni umane e automatiche raccolte dalla Civil Air Patrol a supporto di varie risposte ai disastri dal 2015 al 2019. Questi set di dati LADI si concentrano sulle stagioni degli uragani atlantici e sugli stati costieri lungo l'Oceano Atlantico e il Golfo del Messico. Due distinzioni chiave sono la bassa quota, la prospettiva obliqua delle immagini e le caratteristiche relative ai disastri, che sono raramente presenti nei benchmark e nei set di dati di visione artificiale. I team hanno utilizzato le categorie FEMA esistenti per danni come inondazioni, detriti, fuoco e fumo o frane, che hanno standardizzato le categorie di etichette. La soluzione è quindi in grado di fare previsioni sul resto dei dati di addestramento e indirizzare i risultati con minore affidabilità per la revisione umana.

In questo post, descriviamo la nostra progettazione e implementazione della soluzione, le best practice e i componenti chiave dell'architettura di sistema.

Panoramica della soluzione

In breve, la soluzione prevedeva la costruzione di tre pipeline:

- Pipeline di dati – Estrae i metadati delle immagini

- Pipeline di apprendimento automatico – Classifica ed etichetta le immagini

- Pipeline di revisione Human-in-the-loop – Utilizza un team umano per esaminare i risultati

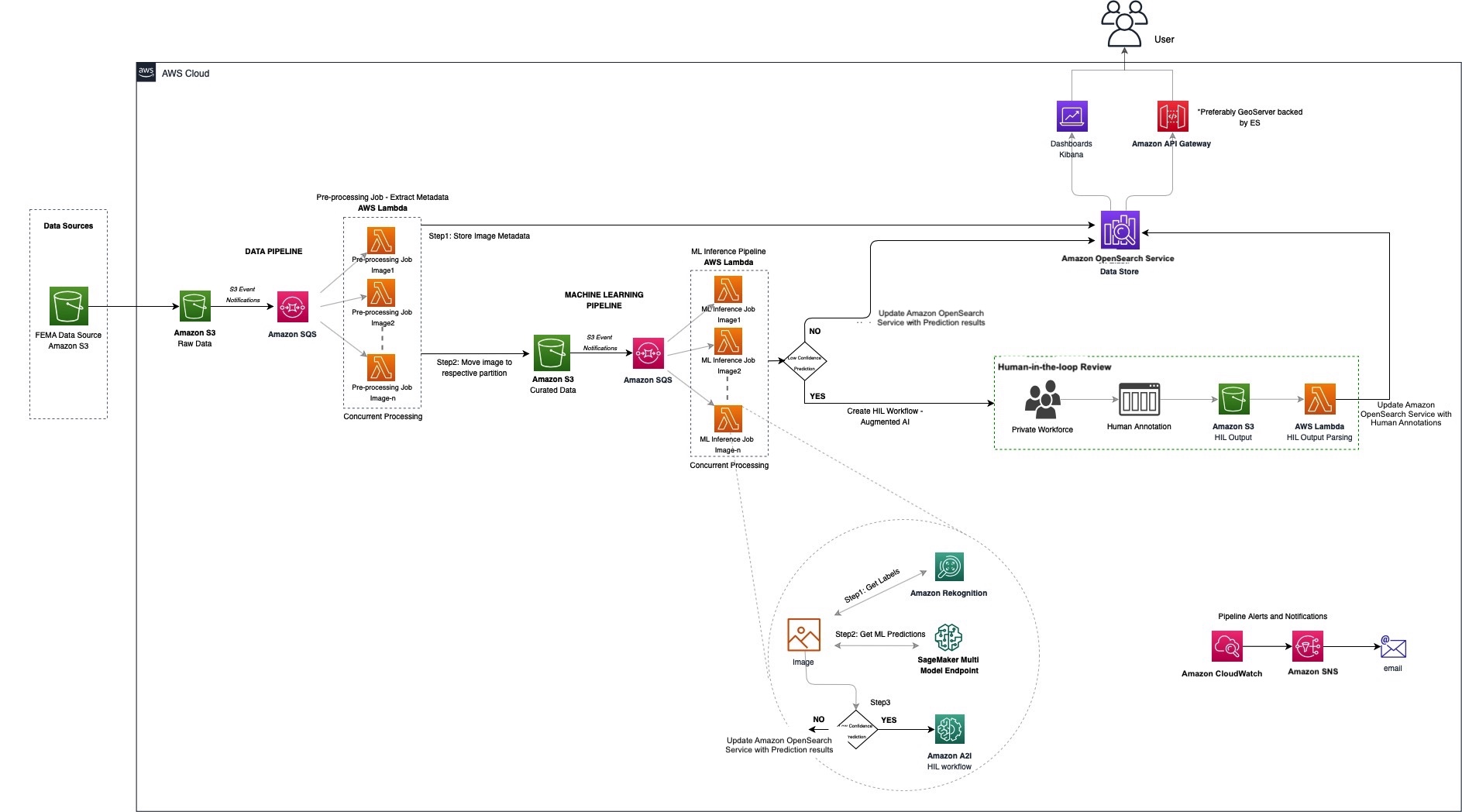

Il diagramma seguente illustra l'architettura della soluzione.

Data la natura di un sistema di etichettatura come questo, abbiamo progettato un'architettura scalabile orizzontalmente in grado di gestire i picchi di ingestione senza overprovisioning utilizzando un'architettura senza server. Usiamo un modello uno-a-molti from Servizio Amazon Simple Queue (Amazon SQS) a AWS Lambda in più punti per supportare questi picchi di ingestione, offrendo resilienza.

Utilizzo di una coda SQS per l'elaborazione Servizio di archiviazione semplice Amazon (Amazon S3) ci aiuta a controllare la concorrenza dell'elaborazione a valle (funzioni Lambda, in questo caso) e a gestire i picchi di dati in entrata. L'accodamento dei messaggi in arrivo funge anche da memoria buffer in caso di errori a valle.

Date le esigenze altamente parallele, abbiamo scelto Lambda per elaborare le nostre immagini. Lambda è un servizio di calcolo senza server che ci consente di eseguire il codice senza eseguire il provisioning o la gestione dei server, creando una logica di ridimensionamento del cluster in grado di riconoscere il carico di lavoro, mantenendo le integrazioni degli eventi e gestendo i tempi di esecuzione.

Usiamo Servizio Amazon OpenSearch come nostro archivio dati centrale per sfruttare le sue ricerche rapide e altamente scalabili e lo strumento di visualizzazione integrato, OpenSearch Dashboards. Ci consente di aggiungere in modo iterativo il contesto all'immagine, senza dover ricompilare o ridimensionare, e di gestire l'evoluzione dello schema.

Rekognition di Amazon semplifica l'aggiunta di analisi di immagini e video nelle nostre applicazioni, utilizzando una tecnologia comprovata, altamente scalabile e di deep learning. Con Amazon Rekognition, otteniamo una buona linea di base degli oggetti rilevati.

Nelle sezioni seguenti, ci immergiamo in ogni pipeline in modo più dettagliato.

Pipeline di dati

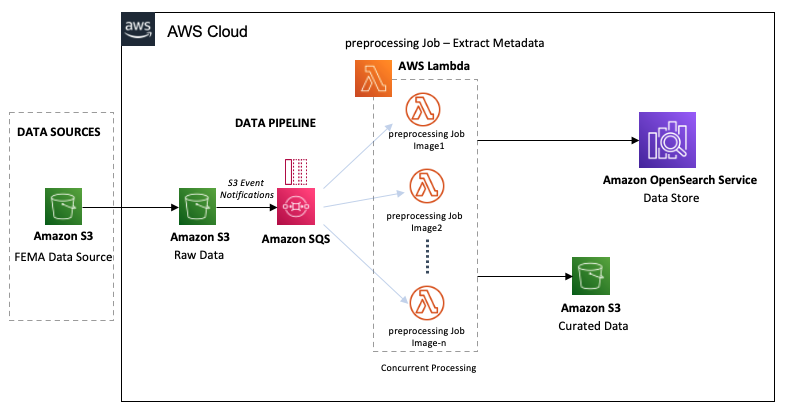

Il diagramma seguente mostra il flusso di lavoro della pipeline di dati.

La pipeline di dati LADI inizia con l'acquisizione di immagini di dati grezzi dal file Protocollo di allerta comune (CAP) della FEMA in un secchio S3. Man mano che inseriamo le immagini nel bucket dei dati grezzi, queste vengono elaborate quasi in tempo reale in due passaggi:

- Il bucket S3 attiva le notifiche degli eventi per tutte le creazioni di oggetti, creando messaggi nella coda SQS per ogni immagine acquisita.

- La coda SQS richiama contemporaneamente le funzioni Lambda di pre-elaborazione sull'immagine.

Le funzioni Lambda eseguono le seguenti fasi di pre-elaborazione:

- Calcola l'UUID per ogni immagine, fornendo un identificatore univoco per ogni immagine. Questo ID identificherà l'immagine per l'intero ciclo di vita.

- Estrai metadati come coordinate GPS, dimensioni dell'immagine, informazioni GIS e posizione S3 dall'immagine e mantienili in OpenSearch.

- Sulla base di una ricerca sui codici FIPS, la funzione sposta l'immagine nel bucket S3 dei dati curati. Partizioniamo i dati in base al codice di stato FIPS/codice di contea FIPS/anno/mese dell'immagine.

Pipeline di apprendimento automatico

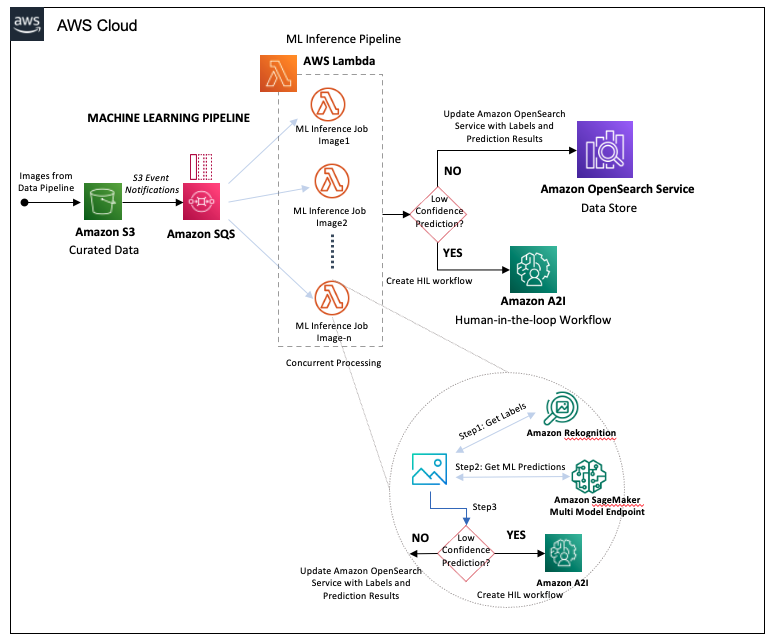

La pipeline ML inizia dalle immagini che arrivano nel bucket S3 di dati curati nella fase della pipeline di dati, che attiva i seguenti passaggi:

- Amazon S3 genera un messaggio in un'altra coda SQS per ogni oggetto creato nel bucket di dati S3 curato.

- La coda SQS attiva simultaneamente le funzioni Lambda per eseguire il processo di inferenza ML sull'immagine.

Le funzioni Lambda eseguono le seguenti azioni:

- Invia ogni immagine ad Amazon Rekognition per il rilevamento degli oggetti, archiviando le etichette restituite e i rispettivi punteggi di attendibilità.

- Componi l'output di Amazon Rekognition nei parametri di input per our Amazon Sage Maker endpoint multi-modello. Questo endpoint ospita il nostro insieme di classificatori, addestrati per serie specifiche di etichette di danno.

- Passa i risultati dell'endpoint SageMaker a AI aumentata di Amazon (Amazon A2I).

Il diagramma seguente illustra il flusso di lavoro della pipeline.

Pipeline di revisione Human-in-the-loop

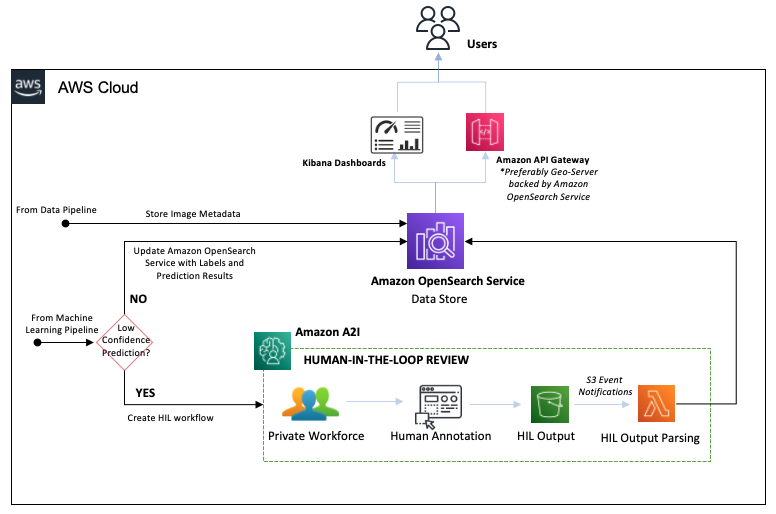

Il diagramma seguente illustra la pipeline HIL (human-in-the-loop).

Con Amazon A2I, possiamo configurare soglie che attiveranno una revisione umana da parte di un team privato quando un modello produce una previsione con bassa confidenza. Possiamo anche utilizzare Amazon A2I per fornire un controllo continuo delle previsioni del nostro modello. I passaggi del flusso di lavoro sono i seguenti:

- Amazon A2I instrada le previsioni ad alta affidabilità in OpenSearch Service, aggiornando i dati dell'etichetta dell'immagine.

- Amazon A2I indirizza le previsioni a bassa confidenza al team privato per annotare manualmente le immagini.

- Il revisore umano completa l'annotazione, generando un file di output dell'annotazione umana che viene archiviato nel bucket HIL Output S3.

- Il bucket HIL Output S3 attiva una funzione Lambda che analizza l'output delle annotazioni umane e aggiorna i dati dell'immagine in OpenSearch Service.

Indirizzando i risultati dell'annotazione umana all'archivio dati, possiamo riaddestrare i modelli di insieme e migliorare in modo iterativo l'accuratezza del modello.

Con i nostri risultati di alta qualità ora archiviati in OpenSearch Service, siamo in grado di eseguire ricerche geospaziali e temporali tramite un'API REST, utilizzando Gateway API Amazon e Geoserver. OpenSearch Dashboard consente inoltre agli utenti di cercare ed eseguire analisi con questo set di dati.

Risultati

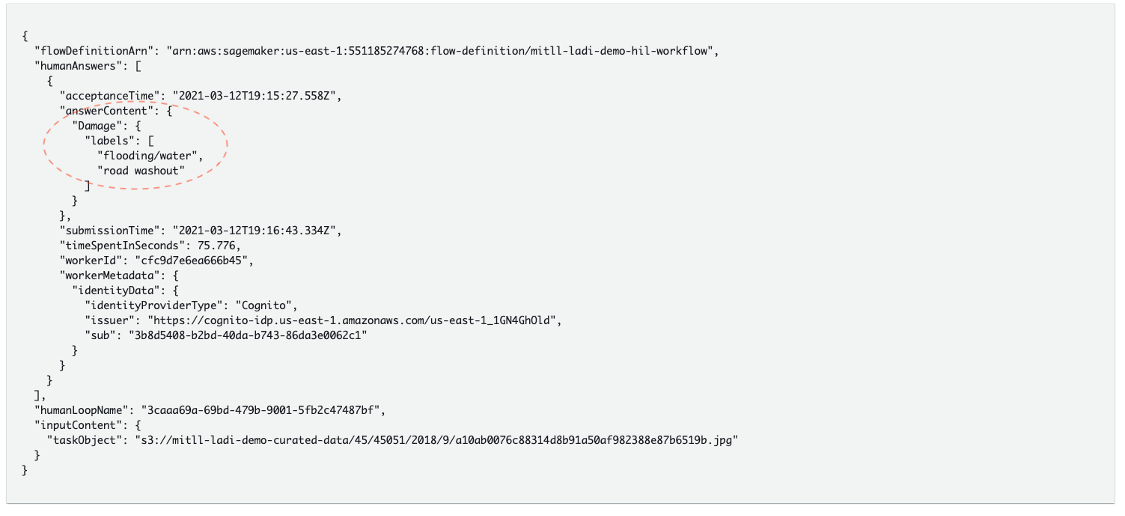

Il codice seguente mostra un esempio dei nostri risultati.

Con questa nuova pipeline, creiamo un backstop umano per i modelli che non sono ancora completamente performanti. Questa nuova pipeline ML è stata messa in produzione per l'uso con a Microservizio di filtro delle immagini della pattuglia aerea civile che consente di filtrare le immagini della Civil Air Patrol a Porto Rico. Ciò consente ai primi soccorritori di visualizzare l'entità del danno e visualizzare le immagini associate a tale danno dopo gli uragani. Il team AWS Data Lab, AWS Open Data Program, Amazon Disaster Response e AWS human-in-the-loop hanno collaborato con i clienti per sviluppare una pipeline open source che può essere utilizzata per analizzare i dati della Civil Air Patrol archiviati in Open Data Registro programmi su richiesta a seguito di eventuali calamità naturali. Per ulteriori informazioni sull'architettura della pipeline e una panoramica della collaborazione e dell'impatto, guarda il video Concentrandosi sulla risposta ai disastri con Amazon Augmented AI, il programma AWS Open Data e AWS Snowball.

Conclusione

Poiché il cambiamento climatico continua ad aumentare la frequenza e l'intensità di tempeste e incendi, continuiamo a vedere l'importanza di utilizzare il machine learning per comprendere l'impatto di questi eventi sulle comunità locali. Questi nuovi strumenti possono accelerare gli sforzi di risposta ai disastri e consentirci di utilizzare i dati di queste analisi post-evento per migliorare l'accuratezza delle previsioni di questi modelli con l'apprendimento attivo. Questi nuovi modelli ML possono automatizzare l'annotazione dei dati, che ci consente di dedurre l'entità del danno da ciascuno di questi eventi sovrapponendo le etichette dei danni ai dati della mappa. Questi dati cumulativi possono anche aiutare a migliorare la nostra capacità di prevedere i danni per futuri eventi disastri, che possono informare le strategie di mitigazione. Questo a sua volta può migliorare la resilienza delle comunità, delle economie e degli ecosistemi fornendo ai decisori le informazioni di cui hanno bisogno per sviluppare politiche basate sui dati per affrontare queste minacce ambientali emergenti.

In questo post del blog abbiamo discusso dell'uso della visione artificiale sulle immagini satellitari. Questa soluzione è pensata per essere un'architettura di riferimento o una guida rapida che è possibile personalizzare in base alle proprie esigenze.

Fai un giro e facci sapere come questo ha risolto il tuo caso d'uso lasciando un feedback nella sezione dei commenti. Per ulteriori informazioni, vedere Funzionalità geospaziali di Amazon SageMaker.

Informazioni sugli autori

Vamshi Krishna Enabothala è Sr. Applied AI Specialist Architect presso AWS. Lavora con clienti di diversi settori per accelerare iniziative di dati, analisi e apprendimento automatico ad alto impatto. È appassionato di sistemi di raccomandazione, PNL e aree di visione artificiale in AI e ML. Al di fuori del lavoro, Vamshi è un appassionato di RC, costruisce attrezzature RC (aerei, automobili e droni) e ama anche il giardinaggio.

Vamshi Krishna Enabothala è Sr. Applied AI Specialist Architect presso AWS. Lavora con clienti di diversi settori per accelerare iniziative di dati, analisi e apprendimento automatico ad alto impatto. È appassionato di sistemi di raccomandazione, PNL e aree di visione artificiale in AI e ML. Al di fuori del lavoro, Vamshi è un appassionato di RC, costruisce attrezzature RC (aerei, automobili e droni) e ama anche il giardinaggio.

Morgan Dutton è Senior Technical Program Manager del team Amazon Augmented AI e Amazon SageMaker Ground Truth. Lavora con clienti aziendali, accademici e del settore pubblico per accelerare l'adozione di servizi di machine learning e ML human-in-the-loop.

Morgan Dutton è Senior Technical Program Manager del team Amazon Augmented AI e Amazon SageMaker Ground Truth. Lavora con clienti aziendali, accademici e del settore pubblico per accelerare l'adozione di servizi di machine learning e ML human-in-the-loop.

Sandep Verma è un Senior Prototyping Architect con AWS. Gli piace approfondire le sfide dei clienti e costruire prototipi per i clienti per accelerare l'innovazione. Ha un background in AI/ML, fondatore di New Knowledge e generalmente appassionato di tecnologia. Nel tempo libero ama viaggiare e sciare con la sua famiglia.

Sandep Verma è un Senior Prototyping Architect con AWS. Gli piace approfondire le sfide dei clienti e costruire prototipi per i clienti per accelerare l'innovazione. Ha un background in AI/ML, fondatore di New Knowledge e generalmente appassionato di tecnologia. Nel tempo libero ama viaggiare e sciare con la sua famiglia.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerate-disaster-response-with-computer-vision-for-satellite-imagery-using-amazon-sagemaker-and-amazon-augmented-ai/

- 100

- 7

- 98

- a

- capacità

- capace

- Chi siamo

- accademico

- accelerare

- precisione

- azioni

- attivo

- atti

- indirizzo

- Adozione

- avanzamenti

- Vantaggio

- contro

- agenzie

- AI

- AI / ML

- ARIA

- Tutti

- consente

- Amazon

- AI aumentata di Amazon

- Rekognition di Amazon

- Amazon Sage Maker

- Amazon SageMaker verità fondamentale

- Analisi

- .

- analitica

- analizzare

- ed

- Un altro

- api

- applicazioni

- applicato

- AI applicata

- architettura

- aree

- associato

- revisione

- aumentata

- automatizzare

- consapevolezza

- AWS

- precedente

- sfondo

- arresto

- barriere

- Linea di base

- perché

- parametri di riferimento

- MIGLIORE

- best practice

- Blog

- bufferizzare

- costruire

- Costruzione

- berretto

- auto

- Custodie

- casi

- categoria

- centrale

- sfide

- impegnativo

- il cambiamento

- dai un'occhiata

- ha scelto

- Città

- Clima

- Cambiamento climatico

- Cluster

- codice

- collaborazione

- Commenti

- Uncommon

- Comunità

- Completa

- componenti

- Calcolare

- computer

- Visione computerizzata

- fiducia

- contenere

- contesto

- continua

- continua

- di controllo

- creare

- creato

- Creazione

- creazioni

- critico

- a cura

- cliente

- Clienti

- personalizzare

- cruscotto

- dati

- data-driven

- dataset

- trattare

- decisori

- deep

- apprendimento profondo

- consegnare

- Richiesta

- schierare

- descrivere

- Design

- progettato

- dettaglio

- rilevato

- rivelazione

- sviluppare

- Mercato

- diverso

- difficile

- disastro

- disastri

- discusso

- Droni

- ogni

- economie

- ecosistemi

- sforzi

- emergenti del mondo

- abilitato

- Abilita

- endpoint

- Impresa

- appassionato

- Intero

- ambientale

- usate

- particolarmente

- Anche

- Evento

- eventi

- evoluzione

- esempio

- esistente

- costoso

- estratti

- famiglia

- FAST

- In primo piano

- Caratteristiche

- feedback

- Compila il

- filtro

- filtraggio

- Antincendio

- Nome

- Focus

- i seguenti

- segue

- fondatore

- Gratis

- Frequenza

- da

- completamente

- function

- funzioni

- futuro

- Guadagno

- generalmente

- genera

- la generazione di

- geografico

- ML geospaziale

- ottenere

- dato

- Dare

- globali

- buono

- I governi

- GPS

- Terra

- guida

- maniglia

- avendo

- Aiuto

- utile

- aiuta

- Alta

- alta qualità

- vivamente

- Colpire

- padroni di casa

- Come

- HTML

- HTTPS

- umano

- uragano

- ID

- identificatore

- identificare

- Immagine

- immagini

- Impact

- implementazione

- importanza

- competenze

- miglioramento

- in

- Compreso

- In arrivo

- Aumento

- informazioni

- iniziative

- Innovazione

- ingresso

- integrato

- integrazioni

- sospeso

- invoca

- coinvolto

- IT

- Lavoro

- Le

- Sapere

- conoscenze

- laboratorio

- Discografica

- etichettatura

- per il tuo brand

- Dipingere

- atterraggio

- larga scala

- apprendimento

- partenza

- Consente di

- ciclo di vita

- locale

- località

- cerca

- ricerca

- Basso

- macchina

- machine learning

- Mantenere

- make

- FA

- direttore

- gestione

- Manuale

- manualmente

- carta geografica

- Maps

- massiccio

- messaggio

- messaggi

- Metadati

- Messico

- attenuazione

- ML

- modello

- modelli

- Scopri di più

- si muove

- Endpoint multimodello

- multiplo

- Naturale

- Natura

- Bisogno

- esigenze

- New

- nlp

- notifiche

- oggetto

- Rilevazione dell'oggetto

- oggetti

- oceano

- offerte

- in corso

- aprire

- dati aperti

- open source

- al di fuori

- panoramica

- proprio

- Parallel

- parametri

- appassionato

- Cartamodello

- Eseguire

- prospettiva

- conduttura

- pianeta

- Platone

- Platone Data Intelligence

- PlatoneDati

- Post

- pratiche

- Precisione

- predire

- predizione

- Previsioni

- Dare priorità

- un bagno

- Problema

- processi

- Elaborato

- lavorazione

- Produzione

- Programma

- protocollo

- prototipi

- prototipazione

- comprovata

- fornire

- fornitura

- la percezione

- Puerto

- Puerto Rico

- metti

- Presto

- Crudo

- recente

- recentemente

- Consigli

- riducendo

- registro

- rilasciato

- sollievo

- necessario

- ricercatori

- elasticità

- quelli

- risposta

- REST

- Risultati

- recensioni

- RICO

- strada

- percorsi

- Correre

- sagemaker

- satellitare

- scalabile

- scala

- Scene

- Cerca

- stagioni

- Sezione

- sezioni

- settore

- Settori

- anziano

- serverless

- Server

- servizio

- Servizi

- Set

- Spettacoli

- Un'espansione

- Taglia

- Fumo

- Istantanea

- soluzione

- fonti

- specialista

- specifico

- picchi

- Standard

- inizia a

- inizio

- state-of-the-art

- stati

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- tempeste

- strategie

- tale

- supporto

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- team

- le squadre

- Tech

- Consulenza

- Tecnologia

- I

- le informazioni

- minacce

- tre

- tempo

- richiede tempo

- a

- strumenti

- Treni

- allenato

- Training

- Di viaggio

- innescare

- TURNO

- Tipi di

- capire

- unico

- Aggiornamenti

- aggiornamento

- us

- uso

- caso d'uso

- utenti

- vario

- via

- Video

- Visualizza

- visione

- visualizzazione

- quale

- volere

- senza

- Lavora

- lavorato

- lavori

- sarebbe

- anni

- i rendimenti

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro