I semi di un cambio di paradigma di machine learning (ML) esistono da decenni, ma con la pronta disponibilità di capacità di elaborazione scalabile, un'enorme proliferazione di dati e il rapido progresso delle tecnologie ML, i clienti di tutti i settori stanno trasformando le loro attività. Proprio di recente, le applicazioni di intelligenza artificiale generativa come ChatGPT hanno catturato l'attenzione e l'immaginazione diffuse. Siamo davvero a un punto di svolta entusiasmante nell'adozione diffusa del ML e crediamo che la maggior parte delle esperienze e delle applicazioni dei clienti verrà reinventata con l'IA generativa.

AI e ML sono al centro dell'attenzione di Amazon da oltre 20 anni e molte delle funzionalità che i clienti utilizzano con Amazon sono guidate dal ML. Il nostro motore di suggerimenti per l'e-commerce è guidato da ML; i percorsi che ottimizzano i percorsi di prelievo robotizzati nei nostri centri logistici sono guidati dal machine learning; e la nostra catena di approvvigionamento, le previsioni e la pianificazione della capacità sono informate da ML. Prime Air (i nostri droni) e la tecnologia di visione artificiale in Amazon Go (la nostra esperienza di vendita al dettaglio fisica che consente ai consumatori di selezionare gli articoli da uno scaffale e lasciare il negozio senza dover formalmente effettuare il check-out) utilizzano il deep learning. Alexa, alimentata da oltre 30 diversi sistemi ML, aiuta i clienti miliardi di volte ogni settimana a gestire case intelligenti, fare acquisti, ottenere informazioni e intrattenimento e altro ancora. Abbiamo migliaia di ingegneri in Amazon impegnati nel machine learning, ed è una parte importante del nostro patrimonio, dell'etica attuale e del futuro.

In AWS, abbiamo svolto un ruolo chiave nella democratizzazione del machine learning e nel renderlo accessibile a chiunque desideri utilizzarlo, inclusi oltre 100,000 clienti di tutte le dimensioni e settori. AWS ha il portafoglio più ampio e completo di servizi AI e ML a tutti e tre i livelli dello stack. Abbiamo investito e innovato per offrire l'infrastruttura più performante e scalabile per l'addestramento e l'inferenza sul machine learning a costi contenuti; ha sviluppato Amazon SageMaker, che è il modo più semplice per tutti gli sviluppatori di creare, addestrare e distribuire modelli; e ha lanciato un'ampia gamma di servizi che consentono ai clienti di aggiungere funzionalità AI come il riconoscimento delle immagini, la previsione e la ricerca intelligente alle applicazioni con una semplice chiamata API. Questo è il motivo per cui clienti come Intuit, Thomson Reuters, AstraZeneca, Ferrari, Bundesliga, 3M e BMW, così come migliaia di startup e agenzie governative in tutto il mondo, stanno trasformando se stessi, i loro settori e le loro missioni con il machine learning. Adottiamo lo stesso approccio democratizzante all'IA generativa: lavoriamo per portare queste tecnologie fuori dal regno della ricerca e degli esperimenti ed estendere la loro disponibilità ben oltre una manciata di startup e grandi aziende tecnologiche ben finanziate. Ecco perché oggi sono lieto di annunciare diverse nuove innovazioni che renderanno facile e pratico per i nostri clienti utilizzare l'IA generativa nelle loro attività.

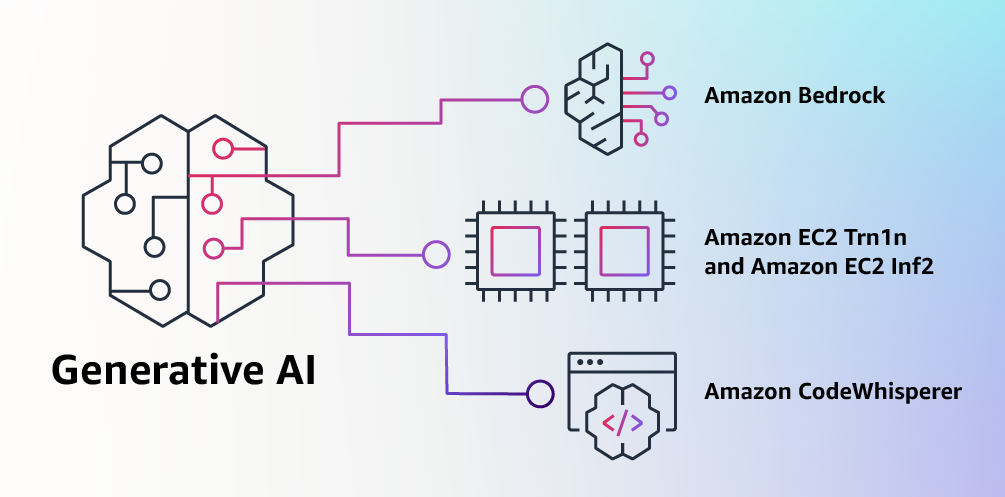

Creazione con l'IA generativa su AWS

IA generativa e modelli di base

L'IA generativa è un tipo di intelligenza artificiale in grado di creare nuovi contenuti e idee, tra cui conversazioni, storie, immagini, video e musica. Come tutte le IA, l'IA generativa è alimentata da modelli ML, modelli molto grandi che vengono preaddestrati su grandi quantità di dati e comunemente indicati come Foundation Models (FM). I recenti progressi nel machine learning (in particolare l'invenzione dell'architettura di rete neurale basata su trasformatore) hanno portato alla nascita di modelli che contengono miliardi di parametri o variabili. Per dare un senso al cambiamento di scala, il più grande modello pre-addestrato nel 2019 era di 330 milioni di parametri. Ora, i modelli più grandi hanno più di 500 miliardi di parametri, un aumento delle dimensioni di 1,600 volte in pochi anni. Gli odierni FM, come i grandi modelli linguistici (LLM) GPT3.5 o BLOOM, e il modello di testo-immagine Stable Diffusion di Stability AI, possono eseguire un'ampia gamma di attività che abbracciano più domini, come scrivere post di blog, generare immagini, risolvere problemi di matematica, impegnarsi in dialoghi e rispondere a domande basate su un documento. Le dimensioni e la natura generica dei FM li rendono diversi dai modelli ML tradizionali, che in genere eseguono attività specifiche, come analizzare il testo per il sentiment, classificare le immagini e prevedere le tendenze.

Gli FM possono eseguire molte più attività perché contengono un numero così elevato di parametri che li rendono capaci di apprendere concetti complessi. E attraverso la loro esposizione pre-formazione ai dati su scala Internet in tutte le sue varie forme e una miriade di modelli, i FM imparano ad applicare le loro conoscenze in un'ampia gamma di contesti. Sebbene le capacità e le possibilità risultanti di un FM pre-addestrato siano sorprendenti, i clienti sono davvero entusiasti perché questi modelli generalmente capaci possono anche essere personalizzati per eseguire funzioni specifiche del dominio che si differenziano per le loro attività, utilizzando solo una piccola parte dei dati e calcolo necessario per addestrare un modello da zero. I FM personalizzati possono creare un'esperienza cliente unica, incarnando la voce, lo stile ei servizi dell'azienda in un'ampia varietà di settori di consumo, come banche, viaggi e assistenza sanitaria. Ad esempio, una società finanziaria che ha bisogno di generare automaticamente un rapporto di attività giornaliero per la circolazione interna utilizzando tutte le transazioni rilevanti può personalizzare il modello con dati proprietari, che includeranno i rapporti precedenti, in modo che il FM apprenda come dovrebbero leggere questi rapporti e cosa i dati sono stati utilizzati per generarli.

Il potenziale degli FM è incredibilmente eccitante. Ma siamo ancora agli inizi. Sebbene ChatGPT sia stata la prima vasta esperienza di intelligenza artificiale generativa a catturare l'attenzione dei clienti, la maggior parte delle persone che studiano l'IA generativa si è presto resa conto che diverse aziende hanno lavorato su FM per anni e che sono disponibili diversi FM, ognuno con punti di forza unici e caratteristiche. Come abbiamo visto negli anni con le tecnologie in rapida evoluzione e nell'evoluzione del machine learning, le cose cambiano rapidamente. Ci aspettiamo che nuove architetture sorgano in futuro e questa diversità di FM scatenerà un'ondata di innovazione. Stiamo già assistendo a nuove esperienze applicative mai viste prima. I clienti AWS ci hanno chiesto come possono sfruttare rapidamente ciò che è disponibile oggi (e ciò che probabilmente arriverà domani) e iniziare rapidamente a utilizzare FM e IA generativa all'interno delle loro aziende e organizzazioni per raggiungere nuovi livelli di produttività e trasformare le loro offerte.

Annuncio dei modelli Amazon Bedrock e Amazon Titan, il modo più semplice per creare e scalare applicazioni di IA generative con FM

I clienti ci hanno detto che oggi ci sono alcune grandi cose che li ostacolano. Innanzitutto, hanno bisogno di un modo semplice per trovare e accedere a FM ad alte prestazioni che diano risultati eccezionali e siano più adatti ai loro scopi. In secondo luogo, i clienti desiderano che l'integrazione nelle applicazioni avvenga senza soluzione di continuità, senza dover gestire enormi cluster di infrastruttura o sostenere costi elevati. Infine, i clienti vogliono che sia facile prendere l'FM di base e creare app differenziate utilizzando i propri dati (pochi dati o molti). Poiché i dati che i clienti desiderano utilizzare per la personalizzazione sono IP incredibilmente preziosi, ne hanno bisogno per rimanere completamente protetti, protetti e privati durante tale processo e desiderano il controllo su come i loro dati vengono condivisi e utilizzati.

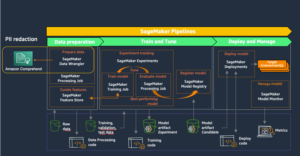

Abbiamo raccolto tutti i feedback dei clienti e oggi siamo entusiasti di annunciare Roccia Amazzonica, un nuovo servizio che rende i FM di AI21 Labs, Anthropic, Stability AI e Amazon accessibili tramite un'API. Bedrock è il modo più semplice per i clienti di creare e scalare applicazioni generative basate su IA utilizzando FM, democratizzando l'accesso per tutti i builder. Bedrock offrirà la possibilità di accedere a una gamma di potenti FM per testo e immagini, incluso Titan FM di Amazon, che consistono in due nuovi LLM che annunciamo anch'essi oggi—attraverso un servizio gestito da AWS scalabile, affidabile e sicuro. Con l'esperienza serverless di Bedrock, i clienti possono facilmente trovare il modello giusto per quello che stanno cercando di fare, iniziare rapidamente, personalizzare privatamente FM con i propri dati e integrarli e distribuirli facilmente nelle loro applicazioni utilizzando gli strumenti e le funzionalità AWS che hanno familiarità (comprese le integrazioni con le funzionalità di Amazon SageMaker ML come gli esperimenti per testare diversi modelli e le pipeline per gestire i loro FM su larga scala) senza dover gestire alcuna infrastruttura.

I clienti Bedrock possono scegliere tra alcuni degli FM più all'avanguardia oggi disponibili. Ciò include la famiglia Jurassic-2 di LLM multilingue di AI21 Labs, che seguono istruzioni in linguaggio naturale per generare testo in spagnolo, francese, tedesco, portoghese, italiano e olandese. Claude, LLM di Anthropic, può eseguire un'ampia varietà di attività di conversazione e di elaborazione del testo e si basa sull'ampia ricerca di Anthropic sulla formazione di sistemi di intelligenza artificiale onesti e responsabili. Bedrock semplifica inoltre l'accesso alla suite di modelli di base text-to-image di Stability AI, tra cui Stable Diffusion (il più popolare nel suo genere), che è in grado di generare immagini, grafica, loghi e immagini uniche, realistiche e di alta qualità disegni.

Una delle funzionalità più importanti di Bedrock è quanto sia facile personalizzare un modello. I clienti indicano semplicemente a Bedrock alcuni esempi etichettati in Amazon S3 e il servizio può mettere a punto il modello per una particolare attività senza dover annotare grandi volumi di dati (sono sufficienti solo 20 esempi). Immagina un responsabile del marketing dei contenuti che lavora presso un importante rivenditore di moda e ha bisogno di sviluppare annunci e testi per campagne freschi e mirati per una nuova linea di borse in arrivo. Per fare ciò, forniscono a Bedrock alcuni esempi etichettati dei loro slogan più performanti delle campagne passate, insieme alle descrizioni dei prodotti associati, e Bedrock inizierà automaticamente a generare social media efficaci, annunci display e copia web per le nuove borse. Nessuno dei dati del cliente viene utilizzato per addestrare i modelli sottostanti e poiché tutti i dati sono crittografati e non lasciano il Virtual Private Cloud (VPC) del cliente, i clienti possono essere certi che i loro dati rimarranno privati e riservati.

Bedrock è ora in anteprima limitata e piace ai clienti Coda sono entusiasti della rapidità con cui i loro team di sviluppo sono entrati in funzione. Shishir Mehrotra, co-fondatore e CEO di Coda, afferma: “Come cliente AWS soddisfatto da molto tempo, siamo entusiasti di come Amazon Bedrock possa portare qualità, scalabilità e prestazioni a Coda AI. Poiché tutti i nostri dati sono già su AWS, siamo in grado di incorporare rapidamente l'IA generativa utilizzando Bedrock, con tutta la sicurezza e la privacy di cui abbiamo bisogno per proteggere i nostri dati integrati. Con oltre decine di migliaia di team che utilizzano Coda, inclusi grandi team come Uber, il New York Times e Square, l'affidabilità e la scalabilità sono davvero importanti".

Abbiamo mostrato in anteprima i nuovi Titan FM di Amazon con alcuni clienti prima di renderli disponibili in modo più ampio nei prossimi mesi. Inizialmente avremo due modelli Titan. Il primo è un LLM generativo per attività come riepilogo, generazione di testo (ad esempio, creazione di un post sul blog), classificazione, domande e risposte aperte ed estrazione di informazioni. Il secondo è un LLM di incorporamenti che traduce input di testo (parole, frasi o eventualmente grandi unità di testo) in rappresentazioni numeriche (note come incorporamenti) che contengono il significato semantico del testo. Sebbene questo LLM non genererà testo, è utile per applicazioni come la personalizzazione e la ricerca perché confrontando gli incorporamenti il modello produrrà risposte più pertinenti e contestuali rispetto alla corrispondenza delle parole. In effetti, la funzionalità di ricerca dei prodotti di Amazon.com utilizza un modello di incorporamento simile tra gli altri per aiutare i clienti a trovare i prodotti che stanno cercando. Per continuare a supportare le migliori pratiche nell'uso responsabile dell'IA, i Titan FM sono progettati per rilevare e rimuovere contenuti dannosi nei dati, rifiutare contenuti inappropriati nell'input dell'utente e filtrare gli output dei modelli che contengono contenuti inappropriati (come incitamento all'odio, oscenità e violenza).

Bedrock rende la potenza degli FM accessibile alle aziende di tutte le dimensioni in modo che possano accelerare l'uso del ML nelle loro organizzazioni e creare le proprie applicazioni di intelligenza artificiale generativa perché sarà facile per tutti gli sviluppatori. Pensiamo che Bedrock rappresenterà un enorme passo avanti nella democratizzazione dei FM e i nostri partner come Accenture, Deloitte, Infosys e Slalom stanno costruendo pratiche per aiutare le imprese ad andare più veloci con l'IA generativa. I fornitori di software indipendenti (ISV) come C3AI e Pega sono entusiasti di sfruttare Bedrock per un facile accesso alla sua vasta selezione di FM con tutta la sicurezza, la privacy e l'affidabilità che si aspettano da AWS.

Annuncio della disponibilità generale delle istanze Trn2n di Amazon EC1 alimentate da AWS Trainium e delle istanze Inf2 di Amazon EC2 alimentate da AWS Inferentia2, l'infrastruttura cloud più conveniente per l'IA generativa

Qualunque cosa i clienti stiano cercando di fare con FM (eseguirli, crearli, personalizzarli), hanno bisogno dell'infrastruttura più performante e conveniente creata appositamente per ML. Negli ultimi cinque anni, AWS ha investito nel nostro silicio per spingere la busta in termini di prestazioni e rapporto prezzo per carichi di lavoro impegnativi come addestramento ML e inferenza, e i nostri chip AWS Trainium e AWS Inferentia offrono il costo più basso per i modelli di addestramento e l'esecuzione dell'inferenza nella nuvola. Questa capacità di massimizzare le prestazioni e controllare i costi scegliendo l'infrastruttura ML ottimale è il motivo per cui le principali startup AI, come AI21 Labs, Anthropic, Cohere, Grammarly, Hugging Face, Runway e Stability AI vengono eseguite su AWS.

Le istanze Trn1, alimentate da Trainium, possono offrire fino al 50% di risparmio sui costi di formazione rispetto a qualsiasi altra istanza EC2 e sono ottimizzate per distribuire la formazione su più server connessi con 800 Gbps di rete Elastic Fabric Adapter (EFA) di seconda generazione. I clienti possono distribuire istanze Trn1 in UltraClusters in grado di scalare fino a 30,000 chip Trainium (più di 6 exaflop di calcolo) situati nella stessa zona di disponibilità AWS con rete su scala petabit. Molti clienti AWS, tra cui Helixon, Money Forward e il team di Amazon Search, utilizzano le istanze Trn1 per ridurre il tempo necessario per addestrare i modelli di deep learning su larga scala da mesi a settimane o addirittura giorni, riducendo al contempo i costi. 800 Gbps è un'ampia larghezza di banda, ma abbiamo continuato a innovare per offrire di più e oggi annunciamo la disponibilità generale di nuovi, ottimizzati per la rete Trn1n istanze, che offrono 1600 Gbps di larghezza di banda di rete e sono progettati per offrire prestazioni superiori del 20% rispetto a Trn1 per i modelli di grandi dimensioni a uso intensivo di rete.

Oggi, la maggior parte del tempo e del denaro spesi per i FM va nella loro formazione. Questo perché molti clienti stanno appena iniziando a implementare FM in produzione. Tuttavia, in futuro, quando i FM verranno implementati su larga scala, la maggior parte dei costi sarà associata all'esecuzione dei modelli e all'inferenza. Mentre in genere si addestra periodicamente un modello, un'applicazione di produzione può generare costantemente previsioni, note come inferenze, generando potenzialmente milioni all'ora. E queste previsioni devono avvenire in tempo reale, il che richiede una rete a bassissima latenza e ad alto throughput. Alexa è un ottimo esempio con milioni di richieste in arrivo ogni minuto, che rappresentano il 40% di tutti i costi di calcolo.

Poiché sapevamo che la maggior parte dei futuri costi di ML sarebbe derivata dall'esecuzione di inferenze, abbiamo dato la priorità al silicio ottimizzato per l'inferenza quando abbiamo iniziato a investire in nuovi chip alcuni anni fa. Nel 2018 abbiamo annunciato Inferentia, il primo chip appositamente realizzato per l'inferenza. Ogni anno, Inferentia aiuta Amazon a eseguire trilioni di inferenze e ha già risparmiato ad aziende come Amazon oltre cento milioni di dollari di spese in conto capitale. I risultati sono impressionanti e vediamo molte opportunità per continuare a innovare poiché i carichi di lavoro aumenteranno solo in dimensioni e complessità man mano che più clienti integreranno l'IA generativa nelle loro applicazioni.

Ecco perché oggi annunciamo il disponibilità generale di INF2 istanze alimentate da AWS Inferentia2, che sono ottimizzati specificamente per applicazioni di intelligenza artificiale generativa su larga scala con modelli contenenti centinaia di miliardi di parametri. Le istanze Inf2 offrono un throughput fino a 4 volte superiore e una latenza fino a 10 volte inferiore rispetto alle istanze basate su Inferentia della generazione precedente. Dispongono inoltre di connettività ad altissima velocità tra gli acceleratori per supportare l'inferenza distribuita su larga scala. Queste funzionalità consentono prestazioni di prezzo di inferenza migliori fino al 40% rispetto ad altre istanze Amazon EC2 comparabili e il costo più basso per l'inferenza nel cloud. Clienti come Runway registrano un throughput fino a 2 volte superiore con Inf2 rispetto alle istanze Amazon EC2 comparabili per alcuni dei loro modelli. Questa inferenza ad alte prestazioni ea basso costo consentirà a Runway di introdurre più funzionalità, implementare modelli più complessi e, in definitiva, offrire un'esperienza migliore per i milioni di creatori che utilizzano Runway.

Annuncio della disponibilità generale di Amazon CodeWhisperer, gratuito per i singoli sviluppatori

Sappiamo che costruire con gli FM giusti ed eseguire applicazioni di intelligenza artificiale generativa su larga scala nell'infrastruttura cloud più performante sarà una trasformazione per i clienti. La nuova ondata di esperienze sarà anche trasformativa per gli utenti. Con l'IA generativa integrata, gli utenti saranno in grado di avere interazioni più naturali e fluide con applicazioni e sistemi. Pensa a come possiamo sbloccare i nostri telefoni cellulari semplicemente guardandoli, senza bisogno di sapere nulla sui potenti modelli ML che rendono possibile questa funzionalità.

Un'area in cui prevediamo che l'uso dell'IA generativa crescerà rapidamente è la codifica. Gli sviluppatori di software oggi trascorrono una notevole quantità del loro tempo a scrivere codice piuttosto semplice e indifferenziato. Trascorrono anche molto tempo cercando di stare al passo con un panorama tecnologico e di strumenti complesso e in continua evoluzione. Tutto ciò lascia agli sviluppatori meno tempo per sviluppare funzionalità e servizi nuovi e innovativi. Gli sviluppatori tentano di superare questo problema copiando e modificando frammenti di codice dal Web, il che può comportare la copia involontaria di codice che non funziona, contiene vulnerabilità di sicurezza o non tiene traccia dell'utilizzo del software open source. E, in definitiva, la ricerca e la copia tolgono ancora tempo alle cose buone.

L'intelligenza artificiale generativa può eliminare questo pesante sollevamento dall'equazione "scrivendo" gran parte del codice indifferenziato, consentendo agli sviluppatori di creare più velocemente e liberandoli per concentrarsi sugli aspetti più creativi della codifica. Per questo, lo scorso anno, abbiamo annunciato l'anteprima di Amazon Code Whisperer, un compagno di codifica AI che utilizza un FM sotto il cofano per migliorare radicalmente la produttività degli sviluppatori generando suggerimenti di codice in tempo reale sulla base dei commenti degli sviluppatori in linguaggio naturale e del codice precedente nel loro ambiente di sviluppo integrato (IDE). Gli sviluppatori possono semplicemente dire a CodeWhisperer di eseguire un'attività, ad esempio "analizzare una stringa di brani CSV" e chiedergli di restituire un elenco strutturato basato su valori come artista, titolo e posizione più alta in classifica. CodeWhisperer fornisce un aumento della produttività generando un'intera funzione che analizza la stringa e restituisce l'elenco come specificato. La risposta degli sviluppatori all'anteprima è stata estremamente positiva e continuiamo a credere che aiutare gli sviluppatori a programmare potrebbe finire per essere uno degli usi più potenti dell'IA generativa che vedremo nei prossimi anni. Durante l'anteprima, abbiamo lanciato una sfida sulla produttività e i partecipanti che hanno utilizzato CodeWhisperer hanno completato le attività in media il 57% più velocemente e avevano il 27% di probabilità in più di completarle con successo rispetto a coloro che non hanno utilizzato CodeWhisperer. Questo è un enorme balzo in avanti nella produttività degli sviluppatori e crediamo che questo sia solo l'inizio.

Oggi siamo lieti di annunciare il disponibilità generale di Amazon CodeWhisperer per Python, Java, JavaScript, TypeScript e C#, oltre a dieci nuovi linguaggi, tra cui Go, Kotlin, Rust, PHP e SQL. È possibile accedere a CodeWhisperer da IDE come VS Code, IntelliJ IDEA, AWS Cloud9 e molti altri tramite le estensioni IDE di AWS Toolkit. CodeWhisperer è disponibile anche nella console AWS Lambda. Oltre a imparare dai miliardi di righe di codice pubblicamente disponibili, CodeWhisperer è stato addestrato sul codice Amazon. Crediamo che CodeWhisperer sia ora il modo più preciso, veloce e sicuro per generare codice per i servizi AWS, tra cui Amazon EC2, AWS Lambda e Amazon S3.

Gli sviluppatori non saranno veramente più produttivi se il codice suggerito dal loro strumento di intelligenza artificiale generativa contiene vulnerabilità di sicurezza nascoste o non riesce a gestire l'open source in modo responsabile. CodeWhisperer è l'unico compagno di codifica AI con scansione di sicurezza integrata (basata sul ragionamento automatico) per trovare e suggerire rimedi per vulnerabilità difficili da rilevare, come quelle nella top ten Open Worldwide Application Security Project (OWASP), quelle che non soddisfano le migliori pratiche della libreria crittografica e altri. Per aiutare gli sviluppatori a codificare in modo responsabile, CodeWhisperer filtra i suggerimenti di codice che potrebbero essere considerati di parte o ingiusti e CodeWhisperer è l'unico compagno di codifica in grado di filtrare e contrassegnare i suggerimenti di codice che assomigliano a codice open source a cui i clienti potrebbero voler fare riferimento o concedere in licenza per l'uso.

Sappiamo che l'IA generativa cambierà il gioco per gli sviluppatori e vogliamo che sia utile al maggior numero possibile di persone. Questo è il motivo per cui CodeWhisperer è gratuito per tutti i singoli utenti senza qualifiche o limiti di tempo per la generazione del codice! Chiunque può registrarsi a CodeWhisperer con un semplice account e-mail e diventare più produttivo in pochi minuti. Non devi nemmeno avere un account AWS. Per gli utenti aziendali, offriamo un livello professionale di CodeWhisperer che include funzionalità di amministrazione come Single Sign-On (SSO) con l'integrazione di AWS Identity and Access Management (IAM), oltre a limiti più elevati per la scansione di sicurezza.

La creazione di potenti applicazioni come CodeWhisperer è trasformativa per gli sviluppatori e per tutti i nostri clienti. Abbiamo molto altro in arrivo e siamo entusiasti di ciò che costruirai con l'IA generativa su AWS. La nostra missione è consentire agli sviluppatori di tutti i livelli di abilità e alle organizzazioni di tutte le dimensioni di innovare utilizzando l'IA generativa. Questo è solo l'inizio di quella che crediamo sarà la prossima ondata di ML che darà vita a nuove possibilità per te.

Risorse

Consulta le seguenti risorse per saperne di più sull'IA generativa su AWS e questi annunci:

Circa l'autore

Swami Shivasubramanian è vicepresidente dei dati e dell'apprendimento automatico presso AWS. In questo ruolo, Swami supervisiona tutti i servizi AWS Database, Analytics e AI e Machine Learning. La missione del suo team è aiutare le organizzazioni a far funzionare i propri dati con una soluzione di dati end-to-end completa per archiviare, accedere, analizzare, visualizzare e prevedere.

Swami Shivasubramanian è vicepresidente dei dati e dell'apprendimento automatico presso AWS. In questo ruolo, Swami supervisiona tutti i servizi AWS Database, Analytics e AI e Machine Learning. La missione del suo team è aiutare le organizzazioni a far funzionare i propri dati con una soluzione di dati end-to-end completa per archiviare, accedere, analizzare, visualizzare e prevedere.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-for-building-with-generative-ai-on-aws/

- :È

- $ SU

- 000

- 000 clienti

- 1

- 100

- 20 anni

- 2018

- 2019

- 7

- a

- capacità

- capace

- WRI

- accelerare

- acceleratori

- Accenture

- accesso

- accessibile

- accessibile

- Il mio account

- conti

- preciso

- operanti in

- attività

- Ad

- aggiunta

- amministrazione

- Adozione

- avanzamento

- avanzamenti

- Vantaggio

- agenzie

- AI

- AI e apprendimento automatico

- ARIA

- Alexa

- Tutti

- Consentire

- già

- stupefacente

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon Sage Maker

- tra

- quantità

- importi

- analitica

- analizzare

- l'analisi

- ed

- Annunciare

- ha annunciato

- Annunci

- annunciando

- chiunque

- api

- Applicazioni

- sicurezza delle applicazioni

- applicazioni

- APPLICA

- approccio

- applicazioni

- architettura

- SONO

- RISERVATA

- in giro

- Arte

- artista

- AS

- aspetti

- associato

- At

- attenzione

- Automatizzata

- automaticamente

- disponibilità

- disponibile

- media

- AWS

- AWS Cloud9

- Cliente AWS

- AWS Identity and Access Management (IAM)

- AWS Inferenza

- AWS Lambda

- Larghezza di banda

- Settore bancario

- base

- basato

- BE

- perché

- diventare

- prima

- iniziare

- Inizio

- essendo

- CREDIAMO

- MIGLIORE

- best practice

- Meglio

- fra

- Al di là di

- Big

- miliardi

- Blog

- Post di Blog

- Fioritura

- BMW

- Incremento

- portare

- ampio

- in linea di massima

- costruire

- costruttori

- Costruzione

- costruito

- incassato

- affari

- aziende

- by

- chiamata

- Campagna

- Responsabile Campagne

- Materiale

- funzionalità

- capace

- Ultra-Grande

- capitale

- lotta

- centri

- ceo

- catena

- Challenge

- il cambiamento

- caratteristiche

- Grafico

- ChatGPT

- dai un'occhiata

- patata fritta

- Chips

- Scegli

- la scelta

- Circolazione

- classificazione

- Cloud

- infrastruttura cloud

- Cloud9

- Co-fondatore

- codice

- codifica

- Venire

- arrivo

- Commenti

- impegnata

- comunemente

- Aziende

- Società

- paragonabile

- rispetto

- confronto

- completamento di una

- Completato

- completamente

- complesso

- complessità

- Calcolare

- computer

- Visione computerizzata

- concetti

- collegato

- Connettività

- considerato

- consolle

- costantemente

- Consumer

- Consumatori

- contenere

- contiene

- contenuto

- Marketing Content

- contesti

- contestuale

- continua

- continua

- di controllo

- discorsivo

- Conversazioni

- copiatura

- Costo

- costo effettivo

- Costi

- potuto

- creare

- Creazione

- Creative

- creatori

- crypto

- Corrente

- cliente

- esperienza del cliente

- Clienti

- personalizzazione

- personalizzare

- personalizzate

- bordo tagliente

- alle lezioni

- dati

- Banca Dati

- Giorni

- decenni

- deep

- apprendimento profondo

- più profondo

- consegnare

- Deloitte

- esigente

- democratizzare

- schierare

- schierato

- progettato

- disegni

- sviluppare

- sviluppato

- Costruttori

- sviluppatori

- Mercato

- dialogo

- diverso

- diversificato

- Emittente

- Dsiplay

- distribuire

- distribuito

- Diversità

- documento

- non

- fare

- dollari

- domini

- Dont

- guidare

- spinto

- Droni

- durante

- Olandese

- e-commerce

- ogni

- Presto

- più semplice

- facilmente

- Efficace

- enable

- crittografato

- da un capo all'altro

- impegnandosi

- motore

- Ingegneri

- abbastanza

- aziende

- Intrattenimento

- Intero

- Ambiente

- ethos

- Anche

- in continua evoluzione

- Ogni

- evoluzione

- esempio

- Esempi

- eccitato

- coinvolgenti

- attenderti

- esperienza

- Esperienze

- Esposizione

- estendere

- estensioni

- estensivo

- tessuto

- Faccia

- fallisce

- familiare

- famiglia

- Moda

- FAST

- che si muove velocemente

- più veloce

- più veloce

- caratteristica

- Caratteristiche

- feedback

- Ferrari

- pochi

- filtro

- filtri

- Infine

- finanziario

- Trovate

- ricerca

- Impresa

- Nome

- Focus

- seguire

- i seguenti

- Nel

- formalmente

- forme

- Avanti

- Fondazione

- frazione

- Gratis

- Francese

- fresco

- da

- function

- funzioni

- futuro

- gioco

- Generale

- scopo generale

- generalmente

- generare

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- Tedesco

- ottenere

- gigante

- Dare

- Go

- va

- andando

- buono

- Enti Pubblici

- grande

- Crescita

- manciata

- maniglia

- accadere

- contento

- dannoso

- Avere

- avendo

- assistenza sanitaria

- pesante

- sollevamento pesante

- Aiuto

- aiutare

- aiuta

- eredità

- nascosto

- Alte prestazioni

- ad alte prestazioni

- alta qualità

- superiore

- massimo

- Case

- cappuccio

- Come

- Tuttavia

- HTTPS

- Enorme

- centinaia

- idea

- idee

- Identità

- Immagine

- Riconoscimento dell'immagine

- immagini

- immaginazione

- importante

- impressionante

- competenze

- in

- includere

- inclusi

- Compreso

- incorporare

- Aumento

- incredibilmente

- studente indipendente

- individuale

- industrie

- Punto di flessione

- informazioni

- estrazione di informazioni

- informati

- Infosys

- Infrastruttura

- inizialmente

- innovare

- innovare

- Innovazione

- innovazioni

- creativi e originali

- ingresso

- esempio

- istruzioni

- integrare

- integrato

- integrazione

- integrazioni

- Intelligente

- interazioni

- interno

- introdurre

- Intuit

- Invenzione

- investito

- investire

- IP

- IT

- elementi

- SUO

- Java

- JavaScript

- mantenere

- Le

- Genere

- Sapere

- conoscenze

- conosciuto

- Labs

- paesaggio

- Lingua

- Le Lingue

- grandi

- larga scala

- maggiore

- Cognome

- L'anno scorso

- Latenza

- lanciato

- galline ovaiole

- principale

- Salto

- IMPARARE

- apprendimento

- Lasciare

- Guidato

- Consente di

- livelli

- Leva

- Biblioteca

- Licenza

- di sollevamento

- piace

- probabile

- Limitato

- limiti

- linea

- Linee

- Lista

- piccolo

- LLM

- collocato

- cerca

- lotto

- a basso costo

- Abbattimento dei Costi

- macchina

- machine learning

- make

- FA

- Fare

- gestire

- gestito

- gestione

- direttore

- molti

- Marketing

- massiccio

- corrispondenza

- matematica

- Massimizzare

- Maggio..

- significato

- Media

- Soddisfare

- forza

- milione

- milioni di dollari

- milioni

- minuto

- Minuti

- Missione

- missioni

- ML

- Mobile

- cellulari

- modello

- modelli

- soldi

- mese

- Scopri di più

- maggior parte

- Più popolare

- multiplo

- Musica

- Naturale

- Natura

- Bisogno

- che necessitano di

- esigenze

- Rete

- internazionale

- rete neurale

- New

- New York

- New York Times

- GENERAZIONE

- numero

- of

- offrire

- offerta

- offerte

- on

- ONE

- aprire

- open source

- Opportunità

- ottimale

- OTTIMIZZA

- ottimizzati

- organizzazioni

- Altro

- Altri

- eccezionale

- Superare

- proprio

- paradigma

- parametri

- parte

- partecipanti

- particolare

- partner

- passato

- modelli

- Eseguire

- performance

- esecuzione

- personalizzazione

- telefoni

- PHP

- Frasi

- Fisico

- pianificazione

- Platone

- Platone Data Intelligence

- PlatoneDati

- giocato

- punto

- Popolare

- lavori

- Portoghese

- positivo

- possibilità

- possibile

- Post

- Post

- potenziale

- potenzialmente

- energia

- alimentato

- potente

- Accensione

- Pratico

- pratiche

- predire

- Previsioni

- Presidente

- piuttosto

- Anteprima

- prezzo

- premio

- Precedente

- priorità

- Privacy

- un bagno

- problemi

- processi

- lavorazione

- produrre

- Prodotto

- Produzione

- produttivo

- della produttività

- Prodotti

- PROFANITÀ

- professionale

- progetto

- proprio

- protegge

- protetta

- fornire

- fornisce

- pubblicamente

- fini

- Spingi

- metti

- Python

- Domande e risposte

- titoli di studio

- qualità

- Domande

- rapidamente

- radicalmente

- gamma

- veloce

- rapidamente

- Leggi

- pronto

- tempo reale

- realistico

- rendersi conto

- regno

- recente

- recentemente

- riconoscimento

- raccomandazioni

- ridurre

- di cui

- pertinente

- problemi di

- affidabile

- rimanere

- rimuovere

- rapporto

- Report

- richieste

- necessario

- richiede

- riparazioni

- Risorse

- risposta

- responsabile

- colpevole

- risultante

- Risultati

- nello specifico retail

- rivenditore

- ritorno

- problemi

- Reuters

- Aumento

- Ruolo

- percorsi

- Correre

- running

- pista

- Ruggine

- sagemaker

- stesso

- Risparmio

- dice

- Scalabilità

- scalabile

- Scala

- scansione

- senza soluzione di continuità

- Cerca

- ricerca

- Secondo

- sicuro

- problemi di

- semi

- vedendo

- prodotti

- senso

- sentimento

- serverless

- Server

- servizio

- Servizi

- set

- alcuni

- condiviso

- Lo scaffale

- spostamento

- Shop

- dovrebbero

- segno

- significativa

- Silicio

- simile

- Un'espansione

- semplicemente

- da

- singolo

- Taglia

- Dimensioni

- abilità

- piccole

- smart

- So

- Social

- Social Media

- Software

- Sviluppatori di software

- soluzione

- Soluzione

- alcuni

- Fonte

- codice sorgente

- campata

- Spagnolo

- specifico

- in particolare

- specificato

- discorso

- spendere

- esaurito

- quadrato

- Stabilità

- stabile

- pila

- inizia a

- iniziato

- Di partenza

- Startup

- soggiorno

- step

- Ancora

- Tornare al suo account

- Storie

- lineare

- punti di forza

- Corda

- strutturato

- Studiando

- style

- Con successo

- tale

- suite

- fornire

- supply chain

- supporto

- Supporto

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- mirata

- Task

- task

- team

- le squadre

- Tech

- tech

- Tecnologie

- Tecnologia

- carnagione

- test

- che

- Il

- Il futuro

- Il New York Times

- il mondo

- loro

- Li

- si

- Strumenti Bowman per analizzare le seguenti finiture:

- cose

- Thomson Reuters

- migliaia

- tre

- Attraverso

- portata

- fila

- tempo

- volte

- titano

- Titolo

- a

- oggi

- di oggi

- domani

- toolkit

- strumenti

- top

- Top ten

- pista

- tradizionale

- Treni

- allenato

- Training

- Le transazioni

- Trasformare

- trasformativa

- trasformazione

- viaggiare

- tendenze

- triliardi

- Affidati ad

- Dattiloscritto

- tipicamente

- Uber

- in definitiva

- per

- sottostante

- unico

- unità

- sbloccare

- imminenti

- us

- Impiego

- uso

- Utente

- utenti

- Prezioso

- Valori

- varietà

- vario

- Fisso

- fornitori

- via

- Vicepresidente

- Video

- Violenza

- virtuale

- visione

- Voce

- volumi

- vs

- vs codice

- vulnerabilità

- Wave

- Modo..

- sito web

- settimana

- Settimane

- WELL

- Che

- Che cosa è l'

- quale

- while

- OMS

- largo

- Vasta gamma

- molto diffuso

- volere

- con

- entro

- senza

- Word

- parole

- Lavora

- lavoro

- lavori

- mondo

- In tutto il mondo

- sarebbe

- scrittura

- anno

- anni

- Tu

- zefiro