Dopo aver creato, addestrato e valutato il tuo modello di machine learning (ML) per assicurarti che risolva il problema aziendale previsto proposto, devi distribuire tale modello per consentire il processo decisionale nelle operazioni aziendali. I modelli che supportano le funzioni business-critical vengono distribuiti in un ambiente di produzione in cui viene messa in atto una strategia di rilascio del modello. Data la natura dei modelli ML, in cui i dati cambiano continuamente, vuoi anche assicurarti che un modello distribuito sia ancora rilevante per i nuovi dati e che il modello venga aggiornato quando non è così. Ciò include la scelta di una strategia di implementazione che riduca al minimo i rischi e i tempi di inattività. Questa strategia di distribuzione ottimale dovrebbe mantenere un'elevata disponibilità del modello, considerare il costo aziendale della distribuzione di un modello inferiore a quello già in produzione e contenere funzionalità per eseguire facilmente il rollback a una versione precedente del modello. Molte di queste considerazioni e modelli di distribuzione consigliati sono trattati anche all'interno di Framework AWS ben progettato: obiettivo di apprendimento automatico.

Oltre a scegliere la giusta strategia di distribuzione, tale strategia dovrebbe essere implementata utilizzando un meccanismo affidabile che includa pratiche MLOps. MLOps include pratiche che integrano i carichi di lavoro ML nella gestione dei rilasci, CI/CD e operazioni, tenendo conto degli aspetti unici dei progetti ML, comprese le considerazioni per la distribuzione e il monitoraggio dei modelli. Amazon SageMaker per MLOps fornisce strumenti appositamente creati per automatizzare e standardizzare le fasi del ciclo di vita ML, comprese le funzionalità per distribuire e gestire nuovi modelli utilizzando modelli di distribuzione avanzati.

In questo post, discutiamo su come distribuire i modelli ML con Amazon Sage Maker in modo ripetibile e automatizzato, integrando il varianti di produzione ed parapetti di dispiegamento funzionalità di SageMaker con soluzioni MLOps. Ti forniamo un'introduzione su come integrare gli strumenti MLOps di SageMaker con i modelli di distribuzione del modello SageMaker, concentrandoti sugli endpoint a modello singolo in tempo reale.

Panoramica della soluzione

Esploriamo i seguenti test di modelli e modelli di guardrail e la loro integrazione con gli strumenti SageMaker MLOps:

- Test del modello – Confrontiamo diverse versioni del modello in produzione prima di sostituire la versione attuale del modello. Questo post confronta le seguenti capacità di test del modello:

- A / B testing – Con il test A/B, confronti diverse versioni del tuo modello in produzione distribuendo il traffico dell'endpoint tra le varianti del tuo modello. Il test A/B viene utilizzato in scenari in cui il feedback a circuito chiuso può collegare direttamente gli output del modello alle metriche aziendali a valle. Questo feedback viene quindi utilizzato per determinare l'importanza statistica del passaggio da un modello all'altro, aiutandoti a selezionare il modello migliore attraverso test di produzione dal vivo.

- Prove d'ombra – Con gli shadow test, si testa una nuova versione del modello in produzione inviando richieste al modello di produzione e al nuovo modello in parallelo. I dati di risposta della previsione dal modello di produzione vengono forniti all'applicazione, mentre le previsioni della nuova versione del modello vengono archiviate per il test ma non fornite all'applicazione di produzione. Il test delle ombre viene utilizzato in situazioni in cui non esiste un feedback a circuito chiuso che mappa una metrica aziendale sulle previsioni di un modello. In questo scenario, utilizzi la qualità del modello e le metriche operative per confrontare più modelli invece di qualsiasi impatto sulle metriche aziendali a valle.

- Traffico in movimento – Dopo aver testato la nuova versione del modello e essere soddisfatti delle sue prestazioni, il passaggio successivo consiste nel trasferire il traffico dal modello corrente a quello nuovo. IL parapetti di spiegamento blu/verdi in SageMaker consentono di passare facilmente dall'attuale modello in produzione (flotta blu) a uno nuovo (flotta verde) in modo controllato. Le distribuzioni blu/verdi evitano i tempi di inattività durante gli aggiornamenti del modello, come in uno scenario di distribuzione sul posto. Per massimizzare la disponibilità del modello, al momento della stesura di questo documento, le distribuzioni blu/verde sono l'opzione predefinita per gli aggiornamenti del modello in SageMaker. Discutiamo i seguenti metodi di spostamento del traffico in questo post:

- Tutto in una volta il traffico si sposta – Il 100% del traffico dell'endpoint viene spostato dalla flotta blu alla flotta verde dopo che la flotta verde diventa disponibile. Noi usiamo allarmi in Amazon Cloud Watch che monitorano la tua flotta verde per un determinato periodo di tempo (il periodo di cottura) e se non viene attivato alcun allarme, la flotta blu viene quindi eliminata da SageMaker dopo il periodo di cottura.

- Spostamento del traffico delle Canarie – La tua flotta verde è prima esposta a una percentuale minore del tuo traffico (a canarino) e convalidato per eventuali problemi utilizzando gli allarmi CloudWatch per un periodo di attesa mentre la flotta blu continua a ricevere la maggior parte del traffico dell'endpoint. Dopo che la flotta verde è stata convalidata, tutto il traffico viene trasferito alla nuova flotta e la flotta blu viene quindi eliminata da SageMaker.

- Spostamento del traffico lineare blu/verde guardrail – Sposta gradualmente il traffico dalla tua flotta blu a quella verde con un approccio graduale. Il tuo modello viene quindi monitorato con allarmi CloudWatch per un periodo di cottura in ogni passaggio prima che la flotta Blue venga completamente sostituita.

Questo post si concentra sulla descrizione delle architetture che utilizzano le funzionalità MLOps di SageMaker per eseguire distribuzioni controllate di modelli tramite le barriere di protezione della distribuzione e le strategie di test di modellazione che abbiamo elencato. Per informazioni generali su questi modelli, fare riferimento a Sfrutta le strategie di distribuzione avanzate utilizzando i guardrail di distribuzione di Amazon SageMaker ed Guardrail di schieramento.

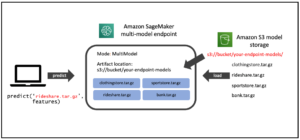

Distribuisci un modello con SageMaker

SageMaker offre una vasta gamma di opzioni di distribuzione che variano da bassa latenza e throughput elevato a processi di inferenza di lunga durata. Queste opzioni includono considerazioni per batch, in tempo reale o inferenza quasi in tempo reale. Ogni opzione offre diverse funzionalità avanzate, come la possibilità di eseguire più modelli su un singolo endpoint. Tuttavia, come accennato in precedenza, per questo post trattiamo solo i modelli di distribuzione MLOps che utilizzano endpoint a modello singolo. Per approfondire ulteriormente le funzionalità di distribuzione SageMaker più avanzate per l'inferenza in tempo reale, fare riferimento a Modelli di hosting dei modelli in Amazon SageMaker, Parte 2: Introduzione alla distribuzione di modelli in tempo reale su SageMaker.

Per comprendere l'implementazione di modelli di distribuzione avanzati utilizzando pipeline di distribuzione continua (CD), discutiamo innanzitutto un concetto chiave all'interno di SageMaker chiamato varianti di modello.

Varianti del modello SageMaker

Le varianti del modello ti consentono di distribuire più versioni del tuo modello allo stesso endpoint per testare il tuo modello. Le varianti del modello vengono distribuite in istanze separate, quindi non vi è alcun impatto sulle altre varianti quando una viene aggiornata. In SageMaker, le varianti del modello vengono implementate come varianti di produzione e shadow.

Varianti di produzione ti consentono di testare A/B più versioni del tuo modello per confrontarne le prestazioni. In questo scenario, tutte le versioni del modello restituiscono risposte alle richieste del modello. Il traffico dell'endpoint viene distribuito tra le varianti esistenti in base alla distribuzione del traffico, in cui assegni un peso a ciascuna variante, o in base alla variante di destinazione, in cui un determinato parametro (ad esempio regione o mercato) decide quale modello deve essere richiamato.

Varianti ombra ti permettono di eseguire lo shadow test di una nuova versione del tuo modello. In questo scenario, il tuo modello ha una variante di produzione e una variante shadow distribuite in parallelo allo stesso endpoint. La variante shadow riceve il traffico dati completo (o campionato) dal tuo endpoint. Tuttavia, solo le previsioni delle varianti di produzione vengono inviate agli utenti dell'applicazione e le previsioni delle varianti shadow vengono registrate per l'analisi. Poiché le varianti shadow vengono avviate su istanze separate dalla variante di produzione, in questo test non vi è alcun impatto sulle prestazioni della variante di produzione. Con questa opzione, stai testando il nuovo modello e riducendo al minimo i rischi di un modello a basso rendimento e puoi confrontare le prestazioni di entrambi i modelli con gli stessi dati.

Barriere di distribuzione SageMaker

I guardrail sono una parte essenziale dello sviluppo del software. Proteggono la tua applicazione e riducono al minimo il rischio di distribuzione di una nuova versione della tua applicazione. Allo stesso modo, i guardrail di distribuzione SageMaker consentono di passare da una versione del modello all'altra in modo controllato. A partire da dicembre 2022, i guardrail SageMaker forniscono l'implementazione per le opzioni di implementazione di spostamento del traffico blu/verde, canary e lineare. In combinazione con le varianti del modello, i guardrail di distribuzione possono essere applicati sia alle varianti di produzione che a quelle shadow del modello, garantendo l'assenza di tempi di inattività durante l'aggiornamento di una nuova variante, con lo spostamento del traffico controllato in base all'opzione selezionata.

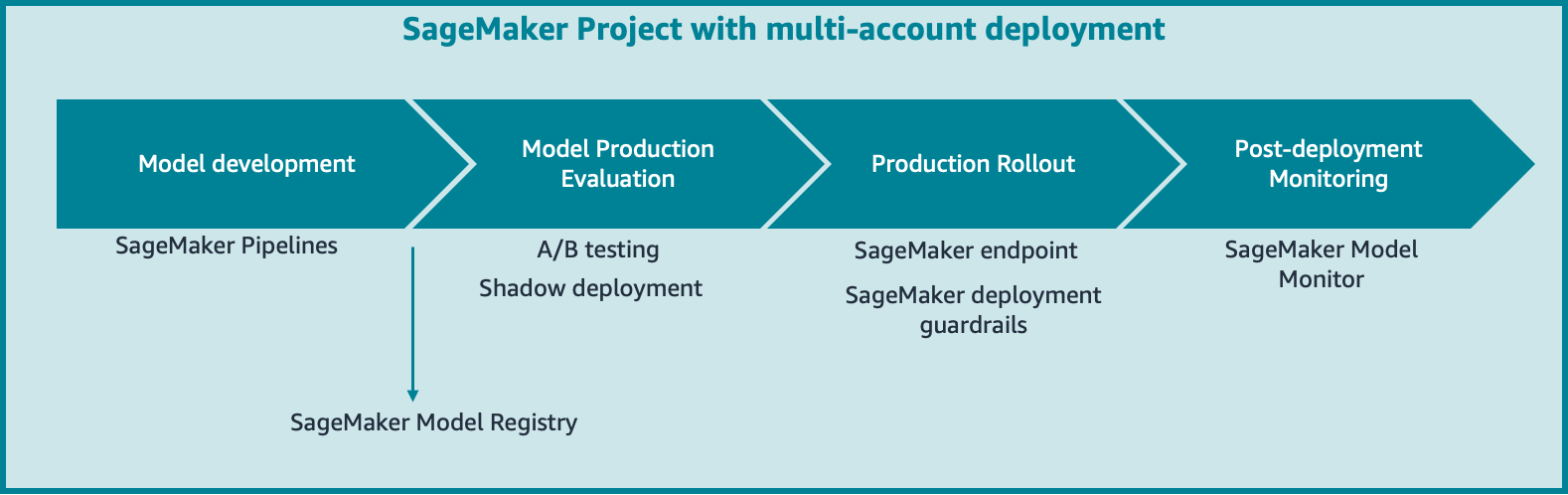

Fondamenti MLOps per la distribuzione del modello

Nel contesto più ampio di un flusso di lavoro di creazione e distribuzione di un modello ML, vogliamo utilizzare pratiche CI/CD create appositamente per il flusso di lavoro ML. Analogamente ai tradizionali sistemi CI/CD, vogliamo automatizzare i test del software, i test di integrazione e le distribuzioni di produzione. Tuttavia, dobbiamo anche includere operazioni specifiche nel ciclo di vita ML che non sono presenti nel tradizionale ciclo di vita dello sviluppo del software, come l'addestramento del modello, la sperimentazione del modello, il test del modello e il monitoraggio del modello.

Per ottenere queste funzionalità specifiche di ML, al processo di distribuzione del modello vengono aggiunte le basi MLOps come il test del modello automatizzato, i guardrail della distribuzione, le distribuzioni multi-account e il rollback del modello automatizzato. Ciò garantisce che le funzionalità già descritte consentano il test del modello ed evitino tempi di inattività durante il processo di aggiornamento del modello. Fornisce inoltre l'affidabilità e la tracciabilità necessarie per il miglioramento continuo di un modello pronto per la produzione. Inoltre, funzionalità come la capacità di impacchettare soluzioni esistenti in modelli riutilizzabili e distribuire modelli in una configurazione multi-account garantiscono la scalabilità dei modelli di distribuzione del modello discussi nel post a diversi modelli all'interno di un'organizzazione.

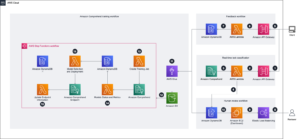

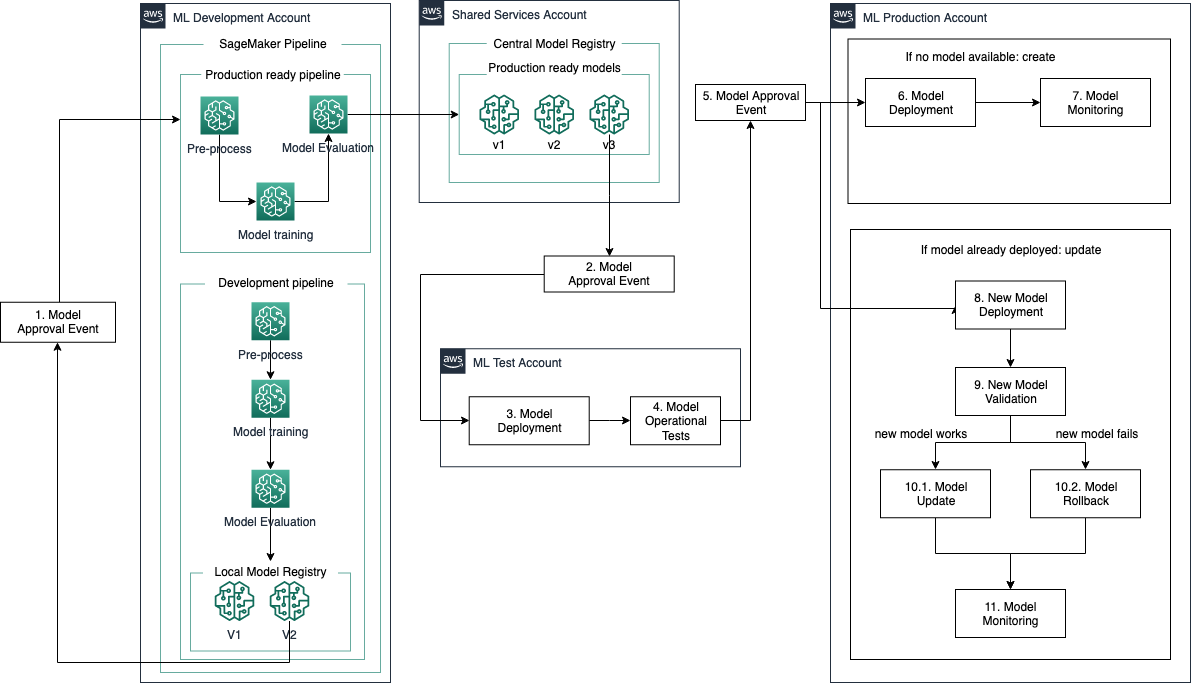

La figura seguente mostra un modello comune per la connessione delle funzionalità di SageMaker per creare una pipeline end-to-end per la creazione e la distribuzione di modelli. In questo esempio, un modello viene sviluppato in SageMaker utilizzando SageMaker Lavori di elaborazione per eseguire il codice di elaborazione dati utilizzato per preparare i dati per un algoritmo ML. Lavori di formazione SageMaker vengono quindi utilizzati per addestrare un modello ML sui dati prodotti dal processo di elaborazione. Gli artefatti del modello e i metadati associati vengono archiviati nel file Registro dei modelli SageMaker come ultima fase del processo formativo. Questo è orchestrato da Pipeline SageMaker, che è un servizio CI/CD appositamente creato per ML che consente di automatizzare e gestire i flussi di lavoro ML su larga scala.

Dopo che il modello è stato approvato, viene testato in produzione con un test A/B o una distribuzione shadow. Dopo che il modello è stato convalidato in produzione, utilizziamo il registro del modello per approvare il modello per l'implementazione in produzione su un endpoint SageMaker utilizzando una delle opzioni di protezione della distribuzione.

Al termine del processo di aggiornamento del modello, Monitor modello SageMaker monitora continuamente le prestazioni del modello per le derive nel modello e la qualità dei dati. Questo processo è automatizzato per più casi d'uso utilizzando Progetto SageMaker modelli che associano l'implementazione dell'infrastruttura a una configurazione multi-account per garantire il completo isolamento delle risorse e un controllo dei costi più semplice.

Modelli di distribuzione dell'endpoint a modello singolo

Quando si distribuiscono i modelli in un ambiente di produzione per la prima volta, non si dispone di un modello in esecuzione con cui confrontarsi e il modello distribuito sarà quello utilizzato dall'applicazione aziendale. Dopo che il modello è stato distribuito e monitorato in un ambiente di produzione, potresti voler aggiornare il modello, su base regolare o su richiesta, quando sono disponibili nuovi dati o quando il tuo modello ha rilevato un gap di prestazioni. Quando aggiorni un modello esistente, vuoi assicurarti che il nuovo modello funzioni meglio di quello attuale e possa gestire il traffico delle richieste di previsione dalle tue applicazioni aziendali. Durante questo periodo di convalida, si desidera che il modello corrente sia ancora disponibile per un possibile rollback per ridurre al minimo il rischio di tempi di inattività delle applicazioni.

In un quadro di sviluppo del modello più ampio, i modelli vengono in genere addestrati in un account di sviluppo della scienza dei dati. Ciò include i flussi di lavoro di sperimentazione spesso utilizzati nello sviluppo di modelli, nonché i flussi di lavoro di riaddestramento utilizzati nelle pipeline pronte per la produzione. Tutti i metadati per questi esperimenti possono essere monitorati utilizzando Esperimenti Amazon SageMaker durante lo sviluppo. Dopo che il flusso di lavoro è stato incorporato in una pipeline per l'utilizzo in produzione, i metadati vengono tracciati automaticamente tramite SageMaker Pipelines. Per tenere traccia dei modelli di produzione praticabili in un unico posto, dopo che la sperimentazione ha portato le metriche delle prestazioni di un modello (precisione, richiamo e così via) a un livello accettabile per la produzione, un fase condizionale nella pipeline SageMaker consente la registrazione del modello nel registro dei modelli.

Il registro del modello consente di attivare la distribuzione di questo modello con un processo di approvazione manuale o automatizzato. Questa distribuzione avviene in un account di test ML in cui è possibile eseguire test operativi come test di integrazione, unit test, latenza del modello ed eventuali convalide aggiuntive del modello rispetto alla nuova versione del modello. Tieni presente che il test A/B e lo shadow test non vengono eseguiti nell'account di test ML, ma piuttosto nell'account di produzione ML.

Dopo che il modello ha superato tutte le convalide nell'account di test, è pronto per essere distribuito in un ambiente di produzione. Un nuovo processo di approvazione avvia questa distribuzione e le barriere di protezione della distribuzione di SageMaker consentono un rilascio controllato e un processo di aggiornamento del modello trasparente in base alla modalità di spostamento del traffico selezionata.

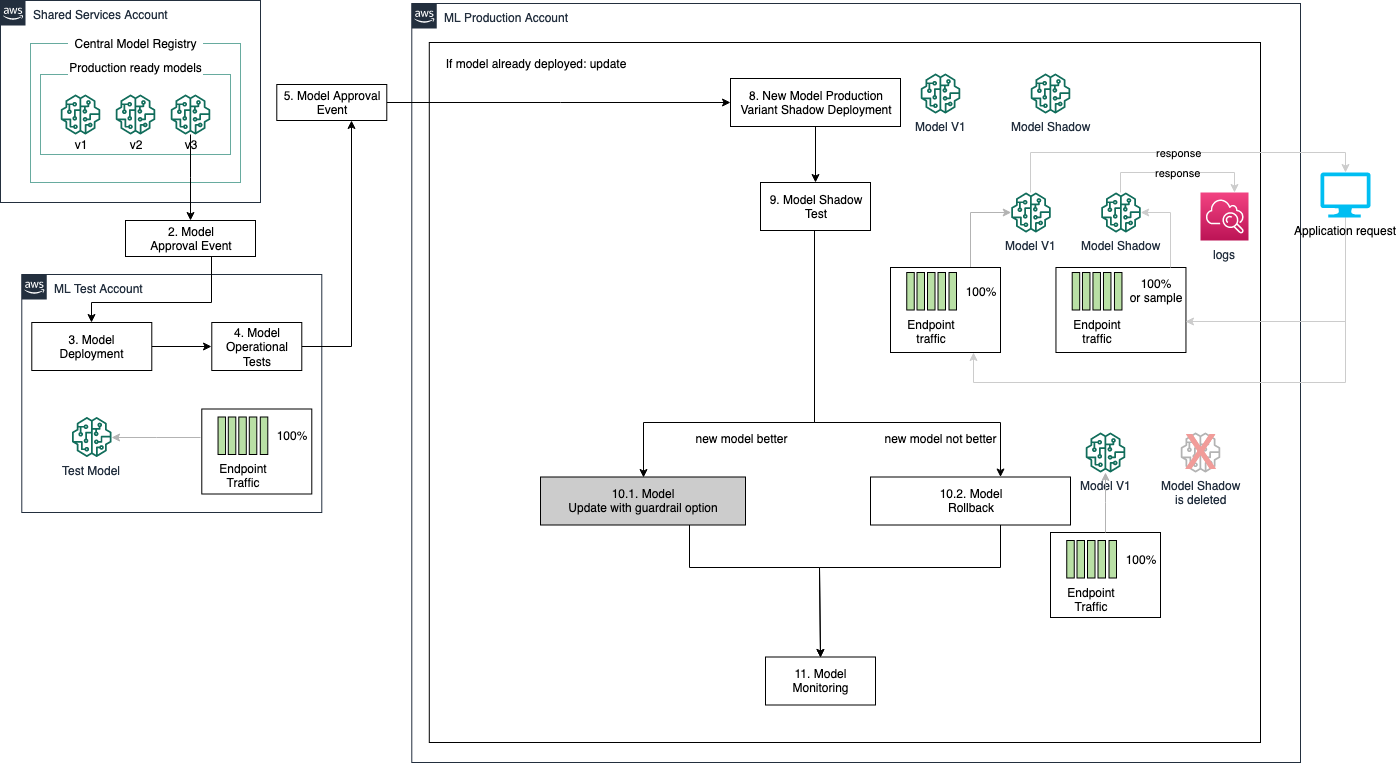

Il diagramma seguente illustra questa architettura della soluzione.

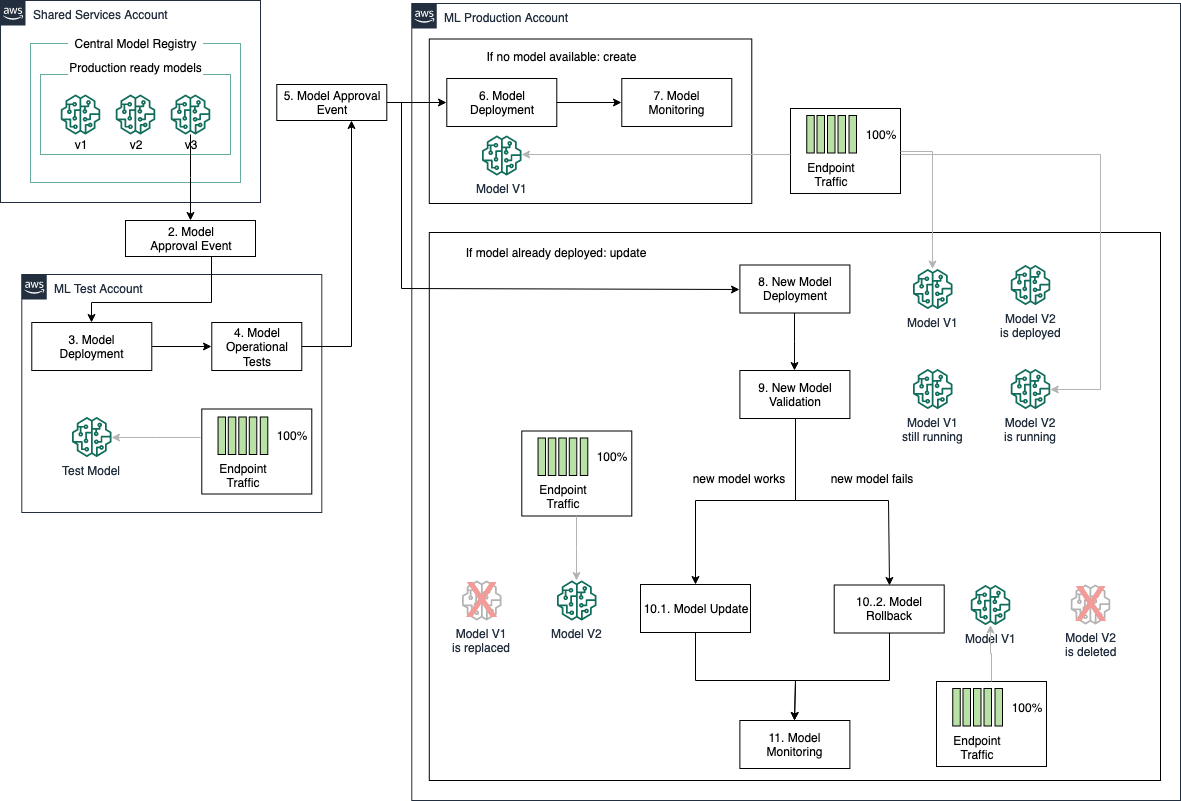

Tutto in una volta il traffico si sposta

Il tutto in una volta la modalità di spostamento del traffico consente di aggiornare una nuova versione del modello (flotta verde) spostando completamente il 100% del traffico dal modello attuale (flotta blu) al nuovo modello. Con questa opzione, puoi configurare un periodo di cottura durante il quale entrambe le versioni del tuo modello sono ancora in esecuzione e puoi eseguire rapidamente e automaticamente il rollback alla versione corrente se il tuo nuovo modello non funziona come previsto. Lo svantaggio di questa opzione è che tutto il traffico dati viene interessato contemporaneamente, quindi se si verifica un problema con la distribuzione del modello, tutti gli utenti che utilizzano l'applicazione durante il processo di distribuzione ne risentono. L'architettura seguente mostra come l'opzione di spostamento del traffico tutto in una volta gestisce gli aggiornamenti del modello.

Tutto in una volta lo spostamento del traffico può essere incorporato negli strumenti MLOps definendo una configurazione di distribuzione dell'endpoint con Politica di aggiornamento BlueGreen impostato ALL_AT_ONCE. Nella pipeline MLOps, dopo che un nuovo modello è stato approvato per la distribuzione nell'account di produzione ML, SageMaker controlla se l'endpoint del modello esiste già. Se è così, il ALL_AT_ONCE la configurazione attiva un aggiornamento dell'endpoint che segue l'architettura. Il rollback dell'endpoint è controllato in base a Allarmi CloudWatch definito dall'endpoint AutoRollbackConfiguration, che quando attivato avvia automaticamente il rollback del modello alla versione corrente del modello.

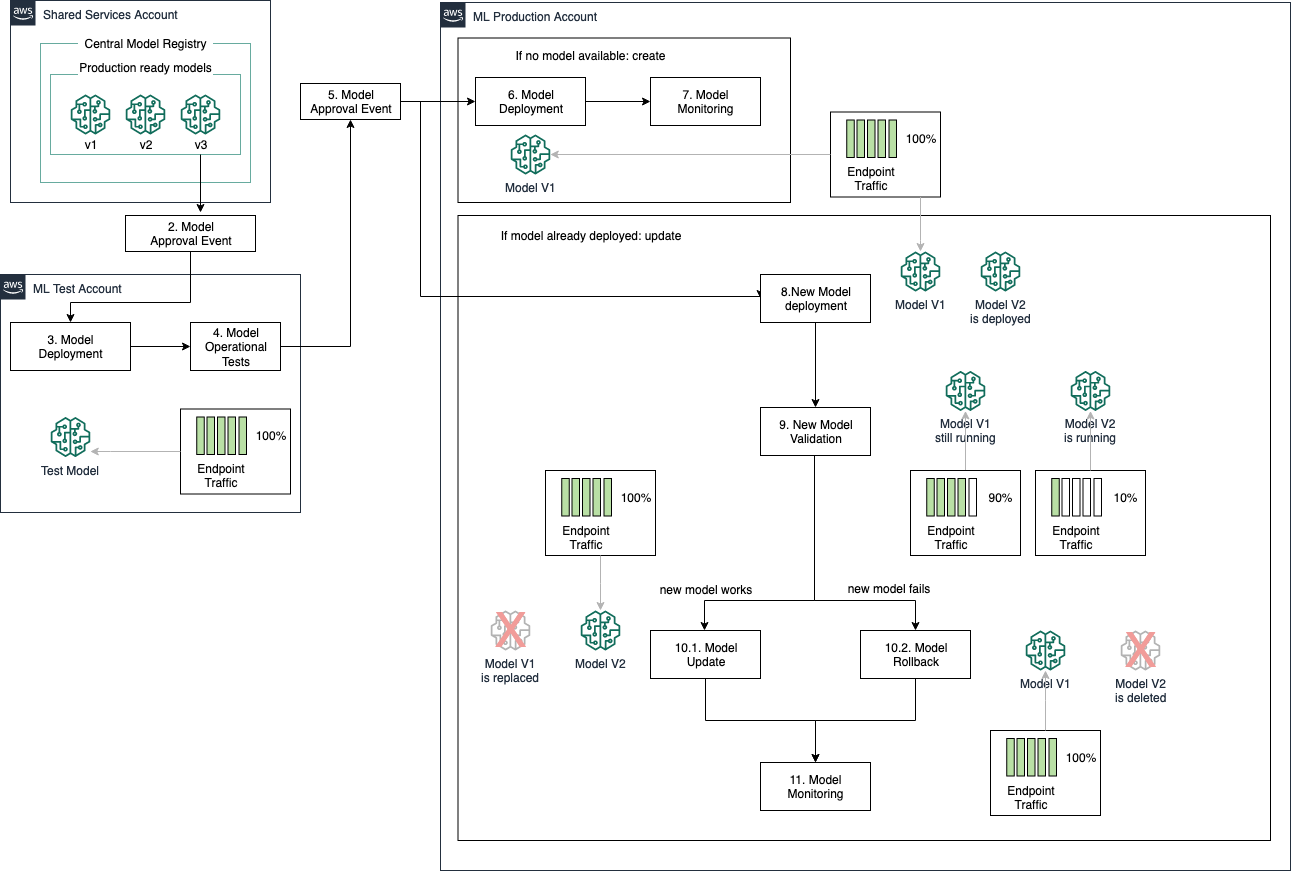

Spostamento del traffico delle Canarie

Il spostamento del traffico delle Canarie La modalità ti consente di testare il tuo nuovo modello (flotta verde) con una piccola parte del traffico dati prima di aggiornare il modello in esecuzione (flotta blu) alla nuova versione o eseguire il rollback della nuova versione, a seconda dell'esito del test canary. La parte del traffico utilizzata per testare il nuovo modello è chiamata canary e in questa opzione il rischio di un nuovo modello problematico è ridotto al minimo al traffico canary mentre il tempo di aggiornamento è ancora ridotto al minimo.

Le distribuzioni Canary consentono di ridurre al minimo il rischio di implementare una nuova versione del modello esponendo la nuova versione del modello a un gruppo più piccolo di utenti per monitorare l'efficacia per un periodo di tempo. Lo svantaggio è la gestione di più versioni per un periodo di tempo che consente di raccogliere metriche sulle prestazioni sufficientemente significative da determinare l'impatto sulle prestazioni. Il vantaggio è la capacità di isolare il rischio per un gruppo più piccolo di utenti.

Lo spostamento del traffico Canary può essere incorporato negli strumenti MLOps definendo una configurazione di distribuzione dell'endpoint con a Politica di aggiornamento BlueGreen impostato CANARY e definendo il CanarySize per determinare la quantità di traffico dell'endpoint da reindirizzare a una nuova versione del modello. Analogamente all'opzione tutto in una volta, nella pipeline MLOps, dopo che un nuovo modello è stato approvato per la distribuzione nell'account di produzione ML, SageMaker verifica se l'endpoint del modello esiste già. Se è così, il CANARY La configurazione attiva un aggiornamento dell'endpoint che segue l'architettura delineata nel diagramma seguente. Il rollback dell'endpoint è controllato in base agli allarmi CloudWatch definiti dall'endpoint AutoRollbackConfiguration che, quando attivato, avvia automaticamente il rollback del modello alla versione corrente del modello. I tipi di allarme utili da implementare qui sono 500 codici di stato e latenza del modello; tuttavia, queste impostazioni di allarme devono essere personalizzate in base al caso d'uso aziendale specifico e alla tecnologia ML.

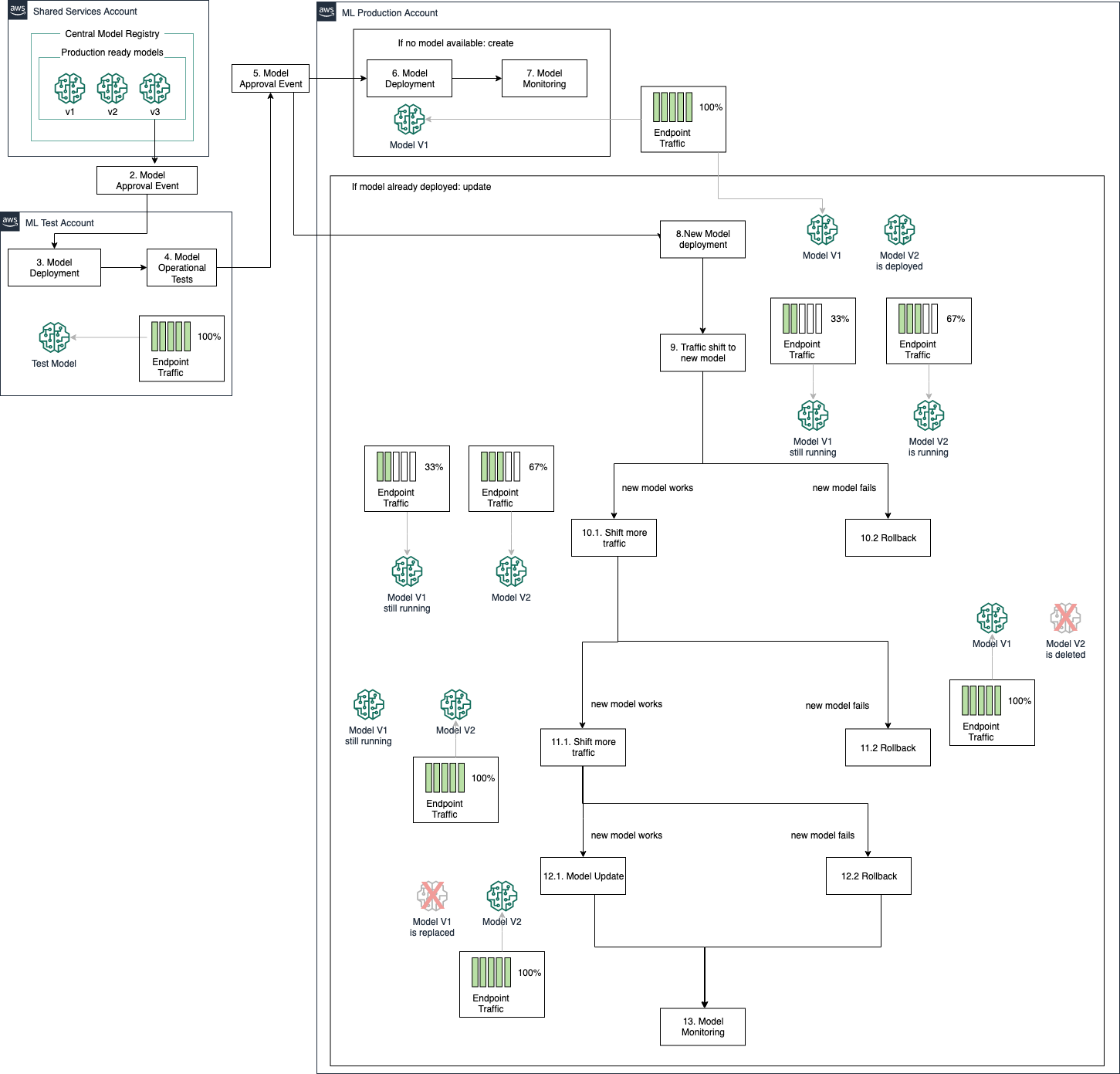

Spostamento lineare del traffico

Nel spostamento lineare del traffico modello, modifichi gradualmente il traffico dal tuo modello attuale (flotta blu) alla nuova versione del modello (flotta verde) aumentando gradualmente il traffico dati inviato al nuovo modello. In questo modo, la percentuale di traffico utilizzata per testare la nuova versione del modello aumenta gradualmente a ogni passaggio e un tempo di cottura per ogni passaggio garantisce che il modello sia ancora operativo con il nuovo traffico. Con questa opzione, riduci al minimo il rischio di distribuire un modello a basse prestazioni ed esponi gradualmente il nuovo modello a un maggiore traffico di dati. Lo svantaggio di questo approccio è che il tempo di aggiornamento è più lungo ei costi di esecuzione di entrambi i modelli in parallelo aumentano.

Lo spostamento lineare del traffico può essere incorporato negli strumenti MLOps definendo una configurazione di distribuzione dell'endpoint con BlueGreenUpdatePolicy impostato su LINEAR e definendo il LinearStepSize per determinare la quantità di traffico che deve essere reindirizzata a un nuovo modello in ogni passaggio. Analogamente all'opzione tutto in una volta, nella pipeline MLOps, dopo che un nuovo modello è stato approvato per la distribuzione nell'account di produzione ML, SageMaker verifica se l'endpoint del modello esiste già. Se è così, il LINEAR La configurazione attiva un aggiornamento dell'endpoint che segue l'architettura indicata nel diagramma seguente. Il rollback dell'endpoint è controllato in base agli allarmi CloudWatch definiti dall'endpoint AutoRollbackConfiguration che, quando attivato, avvia automaticamente il rollback del modello alla versione corrente del modello.

Modelli di distribuzione con varianti di produzione del modello

Indipendentemente dal modello di distribuzione che hai scelto per la tua applicazione, puoi anche utilizzare varianti di produzione per convalidare le prestazioni del tuo modello prima di aggiornare l'endpoint o implementare modelli di distribuzione aggiuntivi come le distribuzioni shadow. In questo caso, si desidera aggiungere un processo manuale o automatizzato per selezionare il modello migliore da distribuire prima di aggiornare l'endpoint. L'architettura seguente mostra come si comportano il traffico e la risposta dell'endpoint in uno scenario di distribuzione shadow. In questo scenario, ogni richiesta di previsione viene inviata sia al modello nuovo che a quello distribuito; tuttavia, solo il modello attualmente distribuito fornisce la risposta di previsione all'applicazione aziendale, mentre la previsione fornita dal nuovo modello viene mantenuta solo per l'analisi delle prestazioni rispetto al modello attualmente distribuito. Dopo aver valutato le prestazioni del modello, la nuova versione del modello può essere distribuita al traffico di risposta di previsione del servizio alle applicazioni aziendali.

Rollback

Indipendentemente dalla strategia di distribuzione scelta per la distribuzione del modello, si desidera poter eseguire il rollback alla versione del modello precedente se le prestazioni del nuovo modello sono inferiori alle prestazioni del modello corrente. Per fare ciò riducendo al minimo i tempi di inattività dell'applicazione, è necessario mantenere il modello corrente in esecuzione in parallelo a quello nuovo fino a quando non si è sicuri che il nuovo modello funzioni meglio di quello attuale.

I guardrail di distribuzione di SageMaker consentono di impostare allarmi e ripristinare automaticamente le versioni precedenti del modello durante il periodo di convalida del modello. Al termine del periodo di convalida, potrebbe essere comunque necessario eseguire il rollback a una versione precedente del modello per risolvere un nuovo problema rilevato dopo il completamento dell'aggiornamento del modello. Per fare ciò, puoi sfruttare il registro dei modelli SageMaker per modelli respinti e approvati e attiva un file processo di rollback.

Conclusione

In questo post, hai imparato a combinare le varianti del modello di endpoint SageMaker e le barriere di protezione della distribuzione con le funzionalità MLOps per creare modelli end-to-end per lo sviluppo del modello. Abbiamo fornito un'implementazione di esempio per i guardrail di distribuzione canary e linear shifting collegati alle pipeline SageMaker e al registro dei modelli tramite un progetto personalizzato SageMaker. Come passaggio successivo, prova ad adattare quanto segue modello per implementare la strategia di implementazione della tua organizzazione.

Riferimenti

Circa gli autori

Maira Ladeira Tanke è un ML Specialist Solutions Architect presso AWS. Con un background in data science, ha 9 anni di esperienza nell'architettura e nella creazione di applicazioni ML con clienti di tutti i settori. In qualità di responsabile tecnico, aiuta i clienti ad accelerare il raggiungimento del valore aziendale attraverso tecnologie emergenti e soluzioni innovative. Nel suo tempo libero, Maira ama viaggiare e passare il tempo con la sua famiglia in un posto caldo.

Maira Ladeira Tanke è un ML Specialist Solutions Architect presso AWS. Con un background in data science, ha 9 anni di esperienza nell'architettura e nella creazione di applicazioni ML con clienti di tutti i settori. In qualità di responsabile tecnico, aiuta i clienti ad accelerare il raggiungimento del valore aziendale attraverso tecnologie emergenti e soluzioni innovative. Nel suo tempo libero, Maira ama viaggiare e passare il tempo con la sua famiglia in un posto caldo.

Clay Elmore è AI/ML Specialist Solutions Architect presso AWS. Dopo aver trascorso molte ore in un laboratorio di ricerca sui materiali, il suo background in ingegneria chimica è stato rapidamente abbandonato per perseguire il suo interesse per l'apprendimento automatico. Ha lavorato su applicazioni ML in molti settori diversi, dal commercio di energia al marketing dell'ospitalità. Clay ha un interesse speciale nel portare le pratiche di sviluppo software al ML e nel guidare i clienti verso soluzioni ripetibili e scalabili utilizzando questi principi. Nel tempo libero, Clay ama sciare, risolvere i cubi di Rubik, leggere e cucinare.

Clay Elmore è AI/ML Specialist Solutions Architect presso AWS. Dopo aver trascorso molte ore in un laboratorio di ricerca sui materiali, il suo background in ingegneria chimica è stato rapidamente abbandonato per perseguire il suo interesse per l'apprendimento automatico. Ha lavorato su applicazioni ML in molti settori diversi, dal commercio di energia al marketing dell'ospitalità. Clay ha un interesse speciale nel portare le pratiche di sviluppo software al ML e nel guidare i clienti verso soluzioni ripetibili e scalabili utilizzando questi principi. Nel tempo libero, Clay ama sciare, risolvere i cubi di Rubik, leggere e cucinare.

Shelbee Eigenbrode è Principal AI e Machine Learning Specialist Solutions Architect presso AWS. Si occupa di tecnologia da 24 anni coprendo diversi settori, tecnologie e ruoli. Attualmente si sta concentrando sulla combinazione del suo background DevOps e ML nel dominio di MLOps per aiutare i clienti a fornire e gestire i carichi di lavoro ML su larga scala. Con oltre 35 brevetti concessi in vari settori tecnologici, ha una passione per l'innovazione continua e l'utilizzo dei dati per ottenere risultati aziendali. Shelbee è un co-creatore e istruttore della specializzazione in Scienze dei dati pratici su Coursera. È anche co-direttrice di Women In Big Data (WiBD), capitolo di Denver. Nel tempo libero le piace trascorrere del tempo con la sua famiglia, gli amici e i cani iperattivi.

Shelbee Eigenbrode è Principal AI e Machine Learning Specialist Solutions Architect presso AWS. Si occupa di tecnologia da 24 anni coprendo diversi settori, tecnologie e ruoli. Attualmente si sta concentrando sulla combinazione del suo background DevOps e ML nel dominio di MLOps per aiutare i clienti a fornire e gestire i carichi di lavoro ML su larga scala. Con oltre 35 brevetti concessi in vari settori tecnologici, ha una passione per l'innovazione continua e l'utilizzo dei dati per ottenere risultati aziendali. Shelbee è un co-creatore e istruttore della specializzazione in Scienze dei dati pratici su Coursera. È anche co-direttrice di Women In Big Data (WiBD), capitolo di Denver. Nel tempo libero le piace trascorrere del tempo con la sua famiglia, gli amici e i cani iperattivi.

Qiyun Zhao è un ingegnere di sviluppo software senior con il team della piattaforma di inferenza di Amazon SageMaker. È lo sviluppatore principale dei guardrail di distribuzione e delle distribuzioni shadow e si concentra sull'aiutare i clienti a gestire i carichi di lavoro e le distribuzioni ML su larga scala con disponibilità elevata. Lavora anche sulle evoluzioni dell'architettura della piattaforma per l'implementazione rapida e sicura dei lavori di ML e l'esecuzione di esperimenti online di ML a proprio agio. Nel tempo libero ama leggere, giocare e viaggiare.

Qiyun Zhao è un ingegnere di sviluppo software senior con il team della piattaforma di inferenza di Amazon SageMaker. È lo sviluppatore principale dei guardrail di distribuzione e delle distribuzioni shadow e si concentra sull'aiutare i clienti a gestire i carichi di lavoro e le distribuzioni ML su larga scala con disponibilità elevata. Lavora anche sulle evoluzioni dell'architettura della piattaforma per l'implementazione rapida e sicura dei lavori di ML e l'esecuzione di esperimenti online di ML a proprio agio. Nel tempo libero ama leggere, giocare e viaggiare.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- capacità

- capace

- accelerare

- accettabile

- Secondo

- Il mio account

- Contabilità

- Raggiungere

- realizzazione

- operanti in

- aggiunto

- aggiunta

- aggiuntivo

- Inoltre

- Avanzate

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AI

- AI / ML

- allarme

- algoritmo

- Tutti

- consente

- già

- Amazon

- Amazon Sage Maker

- quantità

- .

- ed

- Un altro

- Applicazioni

- applicazioni

- applicato

- approccio

- approvazione

- approvare

- approvato

- architettura

- in giro

- aspetti

- associato

- automatizzare

- Automatizzata

- automaticamente

- disponibilità

- disponibile

- AWS

- precedente

- sfondo

- basato

- base

- perché

- diventa

- prima

- dietro

- essendo

- beneficio

- MIGLIORE

- best practice

- Meglio

- fra

- Big

- Big Data

- Blu

- Portare

- ampio

- più ampia

- portato

- costruire

- Costruzione

- costruito

- affari

- Applicazioni aziendali

- detto

- funzionalità

- Custodie

- casi

- CD

- certo

- il cambiamento

- cambiando

- Capitolo

- Controlli

- chimico

- la scelta

- ha scelto

- chiuso

- codice

- combinare

- combinato

- combinando

- Uncommon

- confrontare

- completamento di una

- completamente

- concetto

- fiducioso

- Configurazione

- collegato

- veloce

- Prendere in considerazione

- Considerazioni

- contenere

- contesto

- continuamente

- continuo

- continuamente

- di controllo

- controllata

- Costo

- Costi

- coprire

- coperto

- creare

- Corrente

- Attualmente

- costume

- Clienti

- personalizzate

- dati

- elaborazione dati

- scienza dei dati

- Dicembre

- Decision Making

- Predefinito

- definito

- definizione

- consegnare

- consegna

- Richiesta

- dimostra

- Denver

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- descritta

- rilevato

- Determinare

- sviluppato

- Costruttori

- Mercato

- diverso

- direttamente

- scoperto

- discutere

- discusso

- distribuito

- distribuzione

- distribuzione

- non

- dominio

- domini

- Dont

- svantaggio

- i tempi di inattività

- guidare

- durante

- ogni

- più facile

- facilmente

- efficacia

- o

- emergenti del mondo

- enable

- da un capo all'altro

- endpoint

- energia

- ingegnere

- Ingegneria

- abbastanza

- garantire

- assicura

- assicurando

- Ambiente

- essential

- valutare

- valutato

- evoluzioni

- esempio

- esistente

- esiste

- previsto

- esperienza

- esplora

- esposto

- famiglia

- FAST

- Caratteristiche

- feedback

- figura

- Nome

- prima volta

- FLOTTA

- si concentra

- messa a fuoco

- i seguenti

- segue

- Fondazioni

- Contesto

- Gratis

- amici

- da

- pieno

- funzionalità

- funzioni

- ulteriormente

- gaming

- divario

- raccolta

- Generale

- ottenere

- Dare

- dato

- gradualmente

- concesso

- Green

- Gruppo

- maniglia

- Maniglie

- Aiuto

- aiutare

- aiuta

- qui

- Alta

- ospitalità

- di hosting

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- Impact

- realizzare

- implementazione

- implementato

- Implementazione

- miglioramento

- in

- includere

- inclusi

- Compreso

- Incorporated

- è aumentato

- Aumenta

- crescente

- industrie

- informazioni

- Infrastruttura

- Innovazione

- creativi e originali

- esempio

- invece

- integrare

- Integrazione

- integrazione

- interesse

- Introduzione

- da solo

- problema

- sicurezza

- IT

- Lavoro

- Offerte di lavoro

- mantenere

- Le

- laboratorio

- Cognome

- Latenza

- lanciato

- portare

- imparato

- apprendimento

- Livello

- ciclo di vita

- elencati

- vivere

- più a lungo

- Basso

- macchina

- machine learning

- mantenere

- gestire

- gestione

- gestione

- Manuale

- molti

- mappatura

- Rappresentanza

- Marketing

- Materiale

- Massimizzare

- significativo

- meccanismo

- menzionato

- Metadati

- metodi

- metrico

- Metrica

- forza

- minimizzando

- ML

- MLOp

- Moda

- modello

- Test del modello

- modelli

- Monitorare

- monitorati

- monitoraggio

- monitor

- Scopri di più

- maggior parte

- multiplo

- Natura

- necessaria

- Bisogno

- New

- GENERAZIONE

- Offerte

- ONE

- online

- operativa

- Operazioni

- ottimale

- Opzione

- Opzioni

- minimo

- organizzazione

- Altro

- Risultato

- delineato

- pacchetto

- Parallel

- parametro

- parte

- Passi

- passione

- Brevetti

- Cartamodello

- modelli

- Eseguire

- performance

- esegue

- periodo

- immagine

- conduttura

- posto

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- possibile

- Post

- Pratico

- pratiche

- Precisione

- predizione

- Previsioni

- Preparare

- presenti

- precedente

- in precedenza

- Direttore

- principi

- Problema

- processi

- lavorazione

- Prodotto

- Produzione

- progetto

- progetti

- proposto

- protegge

- fornire

- purché

- fornisce

- scopo

- metti

- qualità

- rapidamente

- gamma

- che vanno

- Lettura

- pronto

- di rose

- tempo reale

- riceve

- ricevente

- raccomandato

- regione

- registrato

- registro

- Basic

- rilasciare

- pertinente

- problemi di

- affidabile

- ripetibile

- sostituito

- richiesta

- richieste

- riparazioni

- risorsa

- risposta

- ritorno

- riutilizzabile

- Rischio

- rischi

- ruoli

- Rotolo

- rotolamento

- Correre

- running

- sagemaker

- Inferenza di SageMaker

- Pipeline SageMaker

- stesso

- soddisfatte

- soddisfatto

- Scalabilità

- scalabile

- Scala

- scenario

- Scenari

- Scienze

- sicuro

- selezionato

- invio

- anziano

- separato

- serve

- servizio

- servizio

- set

- impostazioni

- flessibile.

- alcuni

- Shadow

- Test dell'ombra

- spostamento

- MUTEVOLE

- dovrebbero

- Spettacoli

- significato

- simile

- Allo stesso modo

- singolo

- situazioni

- piccole

- inferiore

- So

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- RISOLVERE

- Soluzione

- la nostra speciale

- specialista

- specifico

- spendere

- Spendere

- iniziato

- inizio

- statistiche

- Stato dei servizi

- step

- Passi

- Ancora

- memorizzati

- strategie

- Strategia

- presentata

- tale

- supporto

- Interruttore

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- Target

- team

- Consulenza

- Tecnologie

- Tecnologia

- modelli

- test

- Testing

- test

- Il

- loro

- Attraverso

- portata

- TIE

- tempo

- a

- strumenti

- verso

- Tracciabilità

- pista

- Trading

- tradizionale

- traffico

- Treni

- allenato

- Training

- trasparente

- Di viaggio

- innescare

- innescato

- Tipi di

- tipicamente

- capire

- unico

- unità

- Aggiornanento

- aggiornato

- Aggiornamenti

- aggiornamento

- uso

- caso d'uso

- utenti

- utilizzare

- CONVALIDARE

- convalidato

- convalida

- APPREZZIAMO

- Variante

- vario

- versione

- via

- vitale

- caldo

- peso

- Che

- Che cosa è l'

- quale

- while

- volere

- entro

- Donna

- lavorato

- flussi di lavoro

- lavori

- sarebbe

- scrittura

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro