Questo post è stato co-scritto da Ramdev Wudali e Kiran Mantripragada di Thomson Reuters.

Nel 1992, Thomson Reuters (TR) ha rilasciato il suo primo servizio di ricerca legale AI, WIN (Westlaw Is Natural), un'innovazione all'epoca, poiché la maggior parte dei motori di ricerca supportava solo termini e connettori booleani. Da allora, TR ha raggiunto molti altri traguardi poiché i suoi prodotti e servizi di intelligenza artificiale sono in continua crescita in numero e varietà, supportando i professionisti legali, fiscali, contabili, di conformità e dei servizi di notizie in tutto il mondo, con miliardi di approfondimenti di machine learning (ML) generati ogni anno .

Con questo enorme aumento dei servizi di intelligenza artificiale, il prossimo traguardo per TR è stato quello di semplificare l'innovazione e facilitare la collaborazione. Standardizzare la creazione e il riutilizzo delle soluzioni di intelligenza artificiale tra le funzioni aziendali e le persone dei professionisti dell'IA, garantendo al tempo stesso il rispetto delle migliori pratiche aziendali:

- Automatizza e standardizza lo sforzo ingegneristico ripetitivo e indifferenziato

- Garantire l'isolamento e il controllo richiesti dei dati sensibili in base a standard di governance comuni

- Fornire un facile accesso a risorse di elaborazione scalabili

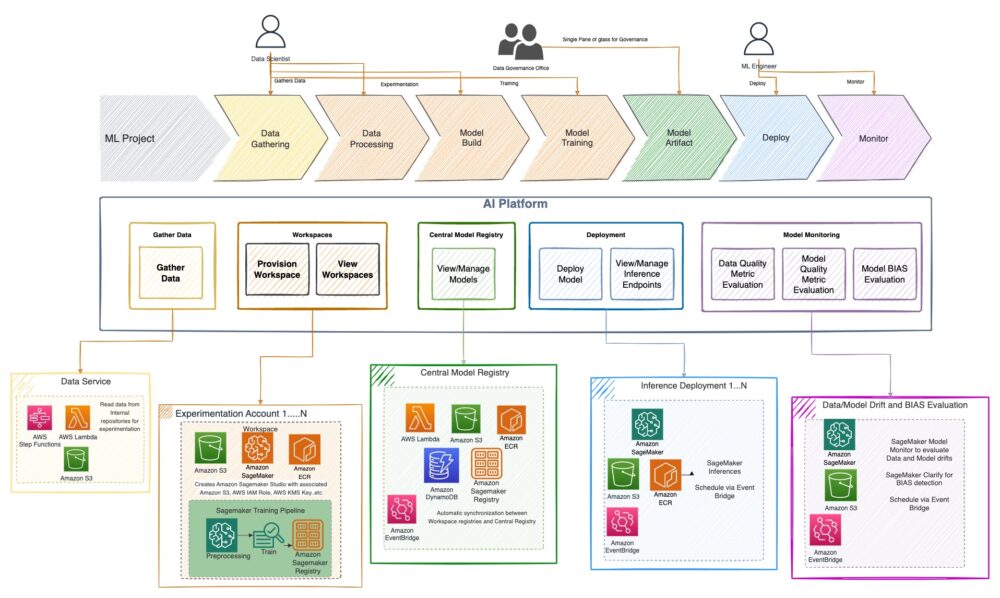

Per soddisfare questi requisiti, TR ha costruito la piattaforma Enterprise AI attorno ai seguenti cinque pilastri: un servizio dati, un'area di lavoro di sperimentazione, un registro centrale dei modelli, un servizio di distribuzione dei modelli e un monitoraggio dei modelli.

In questo post, discutiamo di come TR e AWS hanno collaborato per sviluppare la prima Enterprise AI Platform di TR, uno strumento basato sul Web che avrebbe fornito funzionalità che vanno dalla sperimentazione ML, formazione, un registro centrale dei modelli, distribuzione dei modelli e monitoraggio dei modelli. Tutte queste funzionalità sono progettate per soddisfare gli standard di sicurezza in continua evoluzione di TR e fornire servizi semplici, sicuri e conformi agli utenti finali. Condivideremo anche il modo in cui TR ha abilitato il monitoraggio e la governance per i modelli ML creati in diverse unità aziendali con un unico pannello di controllo.

Le sfide

Storicamente in TR, il machine learning è stato una capacità per i team con data scientist e ingegneri avanzati. I team con risorse altamente qualificate sono stati in grado di implementare processi ML complessi secondo le loro esigenze, ma sono diventati rapidamente molto isolati. Gli approcci in silos non hanno fornito alcuna visibilità per fornire la governance in previsioni decisionali estremamente critiche.

I team aziendali di TR hanno una vasta conoscenza del dominio; tuttavia, le competenze tecniche e il pesante impegno ingegneristico richiesti nel machine learning rendono difficile utilizzare la loro profonda esperienza per risolvere i problemi aziendali con la potenza del machine learning. TR vuole democratizzare le competenze, rendendole accessibili a più persone all'interno dell'organizzazione.

Diversi team in TR seguono le proprie pratiche e metodologie. TR vuole creare le funzionalità che si estendono attraverso il ciclo di vita ML ai propri utenti per accelerare la consegna di progetti ML consentendo ai team di concentrarsi sugli obiettivi aziendali e non sullo sforzo ingegneristico ripetitivo e indifferenziato.

Inoltre, le normative sui dati e l'IA etica continuano a evolversi, imponendo standard di governance comuni per tutte le soluzioni AI di TR.

Panoramica della soluzione

La piattaforma Enterprise AI di TR è stata concepita per fornire servizi semplici e standardizzati a persone diverse, offrendo funzionalità per ogni fase del ciclo di vita del machine learning. TR ha identificato cinque categorie principali che modularizzano tutti i requisiti di TR:

- Servizio dati – Per consentire un accesso facile e sicuro alle risorse di dati aziendali

- Area di lavoro sperimentale – Fornire capacità per sperimentare e addestrare modelli ML

- Registro centrale dei modelli – Un catalogo aziendale per i modelli realizzati in diverse business unit

- Servizio di distribuzione del modello – Fornire varie opzioni di implementazione dell'inferenza seguendo le pratiche CI/CD aziendali di TR

- Servizi di monitoraggio dei modelli – Fornire funzionalità per monitorare i dati e modellare bias e derive

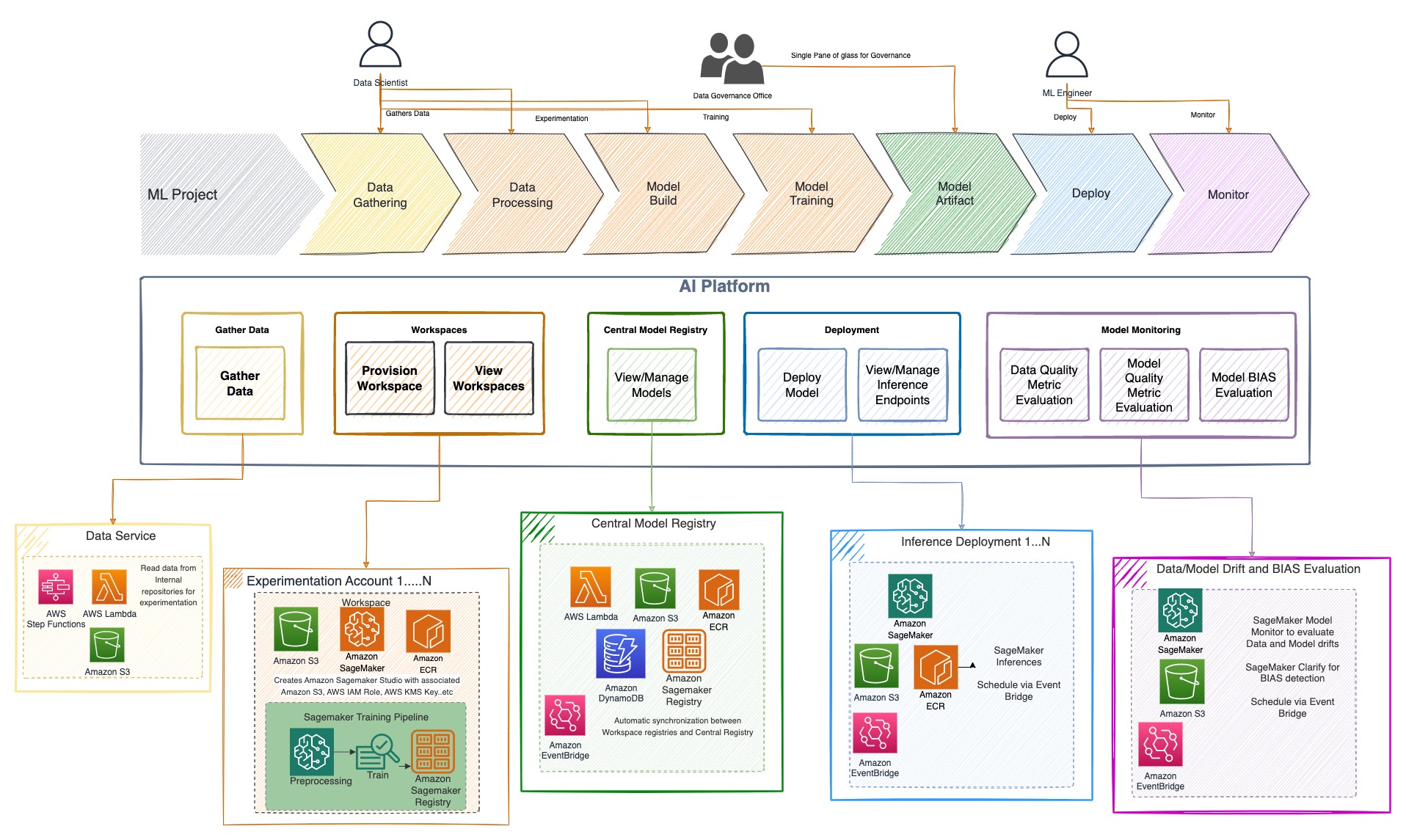

Come mostrato nel diagramma seguente, questi microservizi sono costruiti tenendo presenti alcuni principi chiave:

- Rimuovi lo sforzo ingegneristico indifferenziato da parte degli utenti

- Fornisci le funzionalità richieste con un semplice clic

- Proteggi e governa tutte le funzionalità secondo gli standard aziendali di TR

- Porta un unico pannello di vetro per le attività di ML

I microservizi AI Platform di TR sono realizzati con Amazon Sage Maker come motore principale, componenti AWS serverless per flussi di lavoro e servizi AWS DevOps per pratiche CI/CD. Sage Maker Studio viene utilizzato per la sperimentazione e la formazione e il registro dei modelli SageMaker viene utilizzato per registrare i modelli. Il registro centrale dei modelli comprende sia il registro dei modelli SageMaker sia un file Amazon DynamoDB tabella. Servizi di hosting SageMaker vengono utilizzati per distribuire i modelli, mentre Monitor modello SageMaker ed SageMaker Chiarire vengono utilizzati per monitorare i modelli per deriva, bias, calcolatori di metriche personalizzati e spiegabilità.

Le sezioni seguenti descrivono questi servizi in dettaglio.

Servizio dati

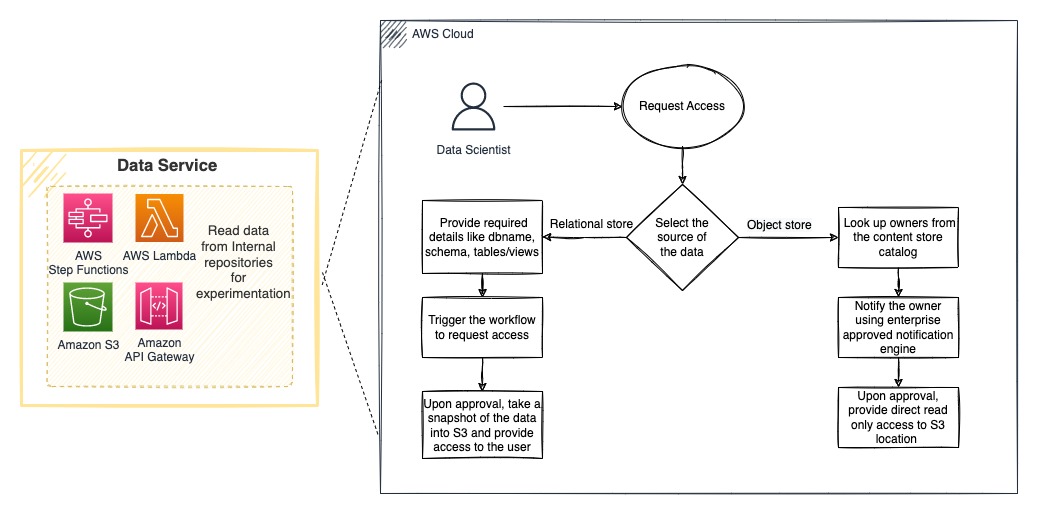

Il ciclo di vita di un progetto ML tradizionale inizia con la ricerca dei dati. In generale, i data scientist dedicano il 60% o più del loro tempo a trovare i dati giusti quando ne hanno bisogno. Proprio come ogni organizzazione, TR dispone di più archivi di dati che fungono da singolo punto di verità per diversi domini di dati. TR ha identificato due archivi dati aziendali chiave che forniscono dati per la maggior parte dei loro casi d'uso ML: un archivio oggetti e un archivio dati relazionale. TR ha creato un servizio dati AI Platform per fornire l'accesso senza problemi a entrambi gli archivi di dati dagli spazi di lavoro di sperimentazione degli utenti e rimuovere l'onere per gli utenti di navigare in processi complessi per acquisire i dati da soli. La piattaforma AI di TR segue tutte le conformità e le best practice definite dal team Data and Model Governance. Ciò include una valutazione obbligatoria dell'impatto dei dati che aiuta i professionisti del riciclaggio a comprendere e seguire l'uso etico e appropriato dei dati, con processi di approvazione formale per garantire un accesso appropriato ai dati. Il fulcro di questo servizio, così come di tutti i servizi della piattaforma, è la sicurezza e la conformità secondo le migliori pratiche determinate da TR e dal settore.

Servizio di archiviazione semplice Amazon (Amazon S3) l'object storage funge da data lake di contenuti. TR ha creato processi per accedere in modo sicuro ai dati dal data lake dei contenuti agli spazi di lavoro di sperimentazione degli utenti, mantenendo l'autorizzazione e la verificabilità richieste. Snowflake viene utilizzato come archivio dati primario relazionale aziendale. Su richiesta dell'utente e in base all'approvazione del proprietario dei dati, il servizio dati di AI Platform fornisce all'utente un'istantanea dei dati prontamente disponibile nell'area di lavoro di sperimentazione.

L'accesso ai dati da varie fonti è un problema tecnico che può essere facilmente risolto. Ma la complessità che TR ha risolto è creare flussi di lavoro di approvazione che automatizzino l'identificazione del proprietario dei dati, l'invio di una richiesta di accesso, assicurandosi che il proprietario dei dati riceva una notifica che ha una richiesta di accesso in sospeso e, in base allo stato di approvazione, agire per fornire i dati a il richiedente. Tutti gli eventi durante questo processo vengono monitorati e registrati per verificabilità e conformità.

Come mostrato nel diagramma seguente, TR utilizza Funzioni AWS Step per orchestrare il flusso di lavoro e AWS Lambda per eseguire la funzionalità. Gateway API Amazon viene utilizzato per esporre la funzionalità con un endpoint API da utilizzare dal proprio portale web.

Sperimentazione e sviluppo del modello

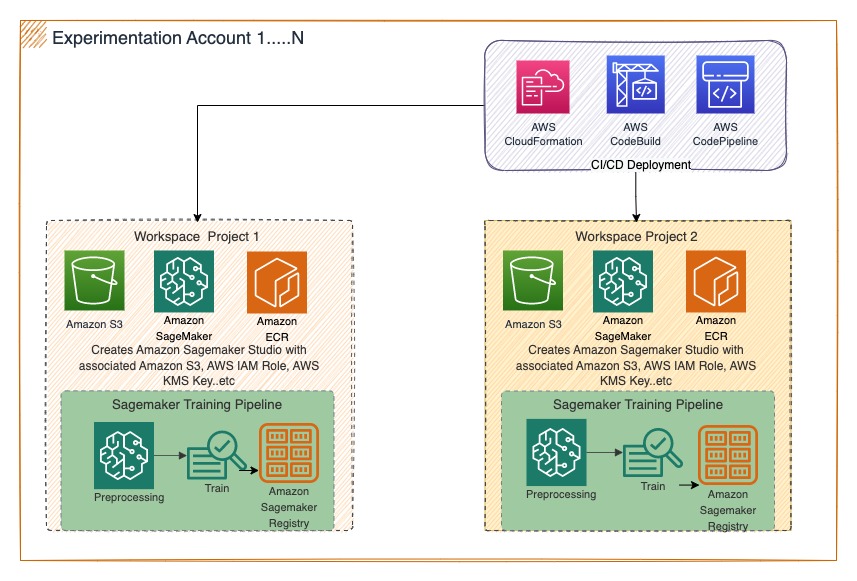

Una capacità essenziale per la standardizzazione del ciclo di vita ML è un ambiente che consenta ai data scientist di sperimentare diversi framework ML e dimensioni dei dati. L'abilitazione di un ambiente così sicuro e conforme nel cloud in pochi minuti solleva i data scientist dall'onere di gestire l'infrastruttura cloud, i requisiti di rete e le misure degli standard di sicurezza, per concentrarsi invece sul problema della scienza dei dati.

TR costruisce uno spazio di lavoro di sperimentazione che offre accesso a servizi come Colla AWS, Amazon EMRe SageMaker Studio per abilitare l'elaborazione dei dati e le funzionalità di ML conformi agli standard di sicurezza del cloud aziendale e all'isolamento degli account richiesto per ogni unità aziendale. TR ha incontrato le seguenti sfide durante l'implementazione della soluzione:

- L'orchestrazione all'inizio non era completamente automatizzata e comportava diversi passaggi manuali. Rintracciare dove si verificavano i problemi non è stato facile. TR ha superato questo errore orchestrando i flussi di lavoro utilizzando Step Functions. Con l'uso di Step Functions, la creazione di flussi di lavoro complessi, la gestione degli stati e la gestione degli errori è diventata molto più semplice.

- Corretto Gestione dell'identità e dell'accesso di AWS La definizione del ruolo (IAM) per l'area di lavoro di sperimentazione era difficile da definire. Per conformarsi agli standard di sicurezza interni di TR e al modello di privilegio minimo, in origine il ruolo dell'area di lavoro era definito con policy inline. Di conseguenza, la policy inline è cresciuta nel tempo ed è diventata dettagliata, superando il limite di dimensione della policy consentito per il ruolo IAM. Per mitigare questo problema, TR è passato all'utilizzo di più criteri gestiti dal cliente e al riferimento ad essi nella definizione del ruolo dell'area di lavoro.

- TR occasionalmente ha raggiunto i limiti di risorse predefiniti applicati a livello di account AWS. Ciò ha causato errori occasionali nell'avvio dei processi SageMaker (ad esempio, processi di formazione) a causa del raggiungimento del limite del tipo di risorsa desiderato. TR ha lavorato a stretto contatto con il team di assistenza SageMaker su questo problema. Questo problema è stato risolto dopo che il team AWS ha lanciato SageMaker come servizio supportato in Quote di servizio nel giugno 2022.

Oggi, i data scientist di TR possono lanciare un progetto ML creando uno spazio di lavoro indipendente e aggiungendo i membri del team necessari per collaborare. La scala illimitata offerta da SageMaker è a portata di mano fornendo loro immagini del kernel personalizzate con varie dimensioni. SageMaker Studio è diventato rapidamente un componente cruciale nella piattaforma AI di TR e ha cambiato il comportamento degli utenti passando dall'utilizzo di applicazioni desktop vincolate a motori appositamente costruiti scalabili ed effimeri. Il diagramma seguente illustra questa architettura.

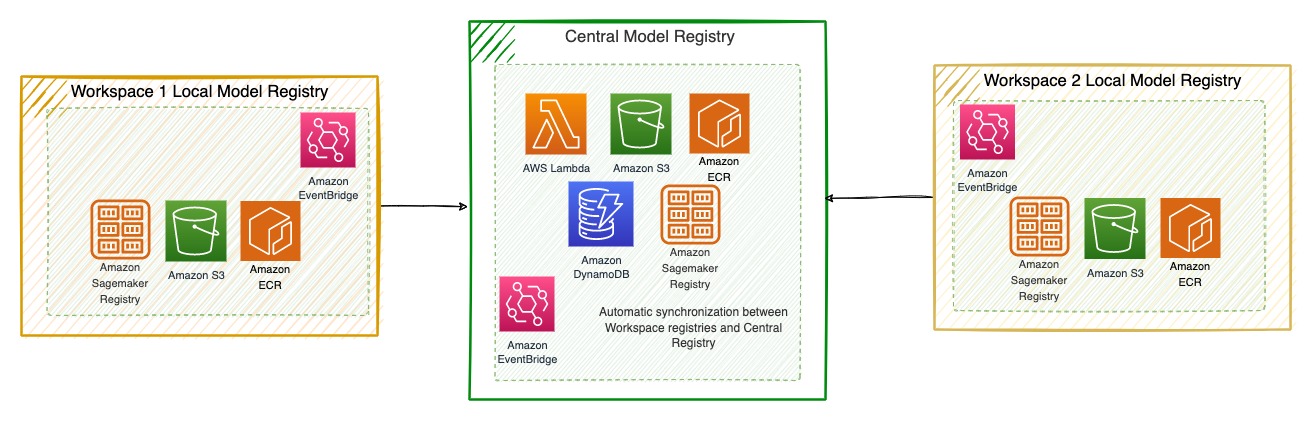

Registro centrale dei modelli

Il registro dei modelli fornisce un archivio centrale per tutti i modelli di apprendimento automatico di TR, consente la gestione del rischio e dell'integrità di tali modelli in modo standardizzato tra le funzioni aziendali e semplifica il potenziale riutilizzo dei modelli. Pertanto, il servizio necessario per eseguire le seguenti operazioni:

- Fornire la possibilità di registrare sia modelli nuovi che legacy, sviluppati all'interno o all'esterno di SageMaker

- Implementa flussi di lavoro di governance, consentendo a data scientist, sviluppatori e parti interessate di visualizzare e gestire collettivamente il ciclo di vita dei modelli

- Aumenta la trasparenza e la collaborazione creando una vista centralizzata di tutti i modelli in TR insieme a metadati e metriche di integrità

TR ha iniziato la progettazione solo con il registro dei modelli SageMaker, ma uno dei requisiti chiave di TR è fornire la possibilità di registrare i modelli creati al di fuori di SageMaker. TR ha valutato diversi database relazionali ma ha finito per scegliere DynamoDB perché lo schema dei metadati per i modelli provenienti da origini legacy sarà molto diverso. TR inoltre non voleva imporre alcun lavoro aggiuntivo agli utenti, quindi ha implementato una sincronizzazione automatica senza soluzione di continuità tra i registri SageMaker dell'area di lavoro di AI Platform e il registro SageMaker centrale utilizzando Amazon EventBridge regole e ruoli IAM richiesti. TR ha migliorato il registro centrale con DynamoDB per estendere le funzionalità di registrazione dei modelli legacy creati sui desktop degli utenti.

Il registro centrale dei modelli di AI Platform di TR è integrato nel portale di AI Platform e fornisce un'interfaccia visiva per cercare modelli, aggiornare i metadati del modello e comprendere le metriche di base del modello e le metriche di monitoraggio periodiche personalizzate. Il diagramma seguente illustra questa architettura.

Distribuzione del modello

TR ha identificato due modelli principali per automatizzare la distribuzione:

- I modelli sviluppati utilizzando SageMaker tramite i processi di trasformazione batch di SageMaker per ottenere inferenze su una pianificazione preferita

- Modelli sviluppati all'esterno di SageMaker su desktop locali utilizzando librerie open source, attraverso l'approccio del contenitore personalizzato utilizzando i processi di elaborazione di SageMaker per eseguire codice di inferenza personalizzato, come modo efficiente per migrare tali modelli senza refactoring del codice

Con il servizio di distribuzione di AI Platform, gli utenti TR (data scientist e ingegneri ML) possono identificare un modello dal catalogo e distribuire un lavoro di inferenza nell'account AWS scelto fornendo i parametri richiesti attraverso un flusso di lavoro basato sull'interfaccia utente.

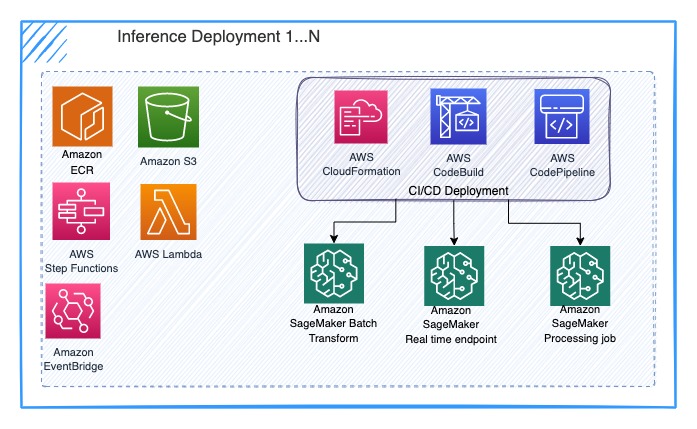

TR ha automatizzato questa distribuzione utilizzando servizi AWS DevOps come AWS Code Pipeline ed AWSCodeBuild. TR utilizza Step Functions per orchestrare il flusso di lavoro di lettura e pre-elaborazione dei dati per creare lavori di inferenza SageMaker. TR distribuisce i componenti richiesti come codice utilizzando AWS CloudFormazione modelli. Il diagramma seguente illustra questa architettura.

Monitoraggio del modello

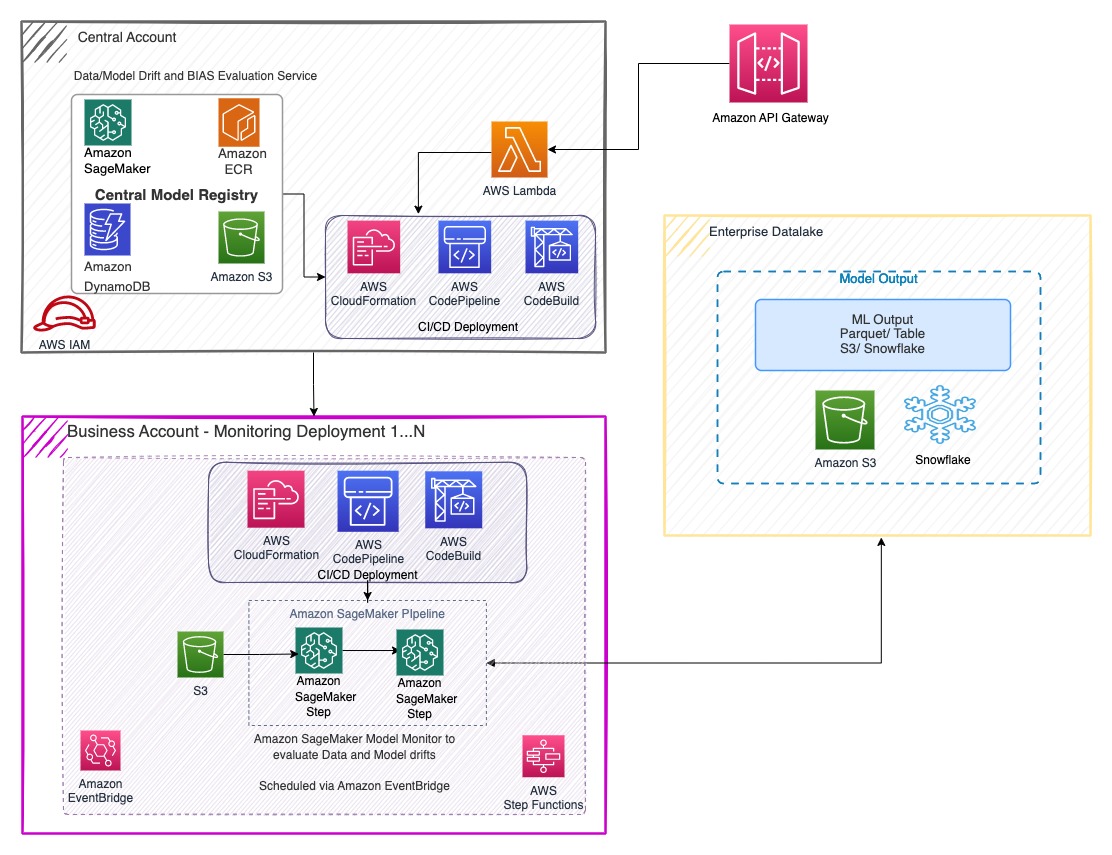

Il ciclo di vita ML non è completo senza la possibilità di monitorare i modelli. Il team di governance aziendale di TR inoltre impone e incoraggia i team aziendali a monitorare le prestazioni del proprio modello nel tempo per affrontare eventuali problemi normativi. TR ha iniziato con il monitoraggio di modelli e dati per la deriva. TR ha utilizzato SageMaker Model Monitor per fornire una base di dati e una verità di base dell'inferenza per monitorare periodicamente la deriva dei dati e delle inferenze di TR. Insieme alle metriche di monitoraggio del modello SageMaker, TR ha migliorato la capacità di monitoraggio sviluppando metriche personalizzate specifiche per i propri modelli. Ciò aiuterà i data scientist di TR a capire quando riaddestrare il loro modello.

Insieme al monitoraggio della deriva, TR vuole anche comprendere i bias nei modelli. Le funzionalità pronte all'uso di SageMaker Clarify vengono utilizzate per creare il servizio di bias di TR. TR monitora sia i dati che la distorsione del modello e rende tali metriche disponibili per i propri utenti attraverso il portale AI Platform.

Per aiutare tutti i team ad adottare questi standard aziendali, TR ha reso questi servizi indipendenti e prontamente disponibili tramite il portale AI Platform. I team aziendali di TR possono entrare nel portale e distribuire un lavoro di monitoraggio del modello o un lavoro di monitoraggio del bias per conto proprio ed eseguirli secondo la pianificazione preferita. Vengono informati sullo stato del lavoro e sulle metriche per ogni esecuzione.

TR ha utilizzato i servizi AWS per la distribuzione CI/CD, l'orchestrazione del flusso di lavoro, i framework serverless e gli endpoint API per creare microservizi che possono essere attivati in modo indipendente, come mostrato nella seguente architettura.

Risultati e miglioramenti futuri

La piattaforma AI di TR è entrata in funzione nel terzo trimestre del 3 con tutti e cinque i componenti principali: un servizio dati, un'area di lavoro di sperimentazione, un registro centrale dei modelli, la distribuzione dei modelli e il monitoraggio dei modelli. TR ha condotto sessioni di formazione interna per le sue unità aziendali per l'onboarding della piattaforma e ha offerto loro video di formazione autoguidati.

La piattaforma AI ha fornito ai team di TR capacità mai esistite prima; ha aperto un'ampia gamma di possibilità per il team di governance aziendale di TR per migliorare gli standard di conformità e centralizzare il registro, fornendo un unico punto di vista su tutti i modelli ML all'interno di TR.

TR riconosce che nessun prodotto è al suo meglio al rilascio iniziale. Tutti i componenti di TR sono a diversi livelli di maturità e il team Enterprise AI Platform di TR è in una fase di miglioramento continuo per migliorare in modo iterativo le funzionalità del prodotto. L'attuale pipeline di avanzamento di TR include l'aggiunta di ulteriori opzioni di inferenza SageMaker come endpoint in tempo reale, asincroni e multi-modello. TR sta inoltre pianificando di aggiungere la spiegabilità del modello come funzionalità al suo servizio di monitoraggio del modello. TR prevede di utilizzare le funzionalità di spiegabilità di SageMaker Clarify per sviluppare il proprio servizio di spiegabilità interno.

Conclusione

TR può ora elaborare grandi quantità di dati in modo sicuro e utilizzare le funzionalità AWS avanzate per portare un progetto ML dall'ideazione alla produzione nell'arco di settimane, rispetto ai mesi necessari prima. Con le funzionalità pronte all'uso dei servizi AWS, i team all'interno di TR possono registrare e monitorare i modelli ML per la prima volta in assoluto, ottenendo la conformità con i loro standard di governance dei modelli in continua evoluzione. TR ha consentito ai data scientist e ai team di prodotto di liberare efficacemente la loro creatività per risolvere i problemi più complessi.

Per saperne di più su Enterprise AI Platform di TR su AWS, consulta il Sessione AWS re:Invent 2022. Se desideri sapere come TR ha accelerato l'uso dell'apprendimento automatico utilizzando il Laboratorio di dati AWS programma, fare riferimento al caso di studio.

Informazioni sugli autori

Ramdev Wudali è un Data Architect, che aiuta a progettare e costruire la piattaforma AI/ML per consentire a data scientist e ricercatori di sviluppare soluzioni di machine learning concentrandosi sulla scienza dei dati e non sulle esigenze infrastrutturali. Nel tempo libero ama piegare la carta per creare tassellature di origami e indossare irriverenti magliette.

Ramdev Wudali è un Data Architect, che aiuta a progettare e costruire la piattaforma AI/ML per consentire a data scientist e ricercatori di sviluppare soluzioni di machine learning concentrandosi sulla scienza dei dati e non sulle esigenze infrastrutturali. Nel tempo libero ama piegare la carta per creare tassellature di origami e indossare irriverenti magliette.

Kiran Mantripragada è Senior Director di AI Platform presso Thomson Reuters. Il team di AI Platform è responsabile dell'abilitazione delle applicazioni software AI di livello di produzione e dell'abilitazione del lavoro di data scientist e ricercatori di machine learning. Con la passione per la scienza, l'intelligenza artificiale e l'ingegneria, a Kiran piace colmare il divario tra ricerca e produzione per portare la vera innovazione dell'IA ai consumatori finali.

Kiran Mantripragada è Senior Director di AI Platform presso Thomson Reuters. Il team di AI Platform è responsabile dell'abilitazione delle applicazioni software AI di livello di produzione e dell'abilitazione del lavoro di data scientist e ricercatori di machine learning. Con la passione per la scienza, l'intelligenza artificiale e l'ingegneria, a Kiran piace colmare il divario tra ricerca e produzione per portare la vera innovazione dell'IA ai consumatori finali.

Bhavana Chirumamilla è Senior Resident Architect presso AWS. È appassionata di dati e operazioni di ML e porta molto entusiasmo nell'aiutare le aziende a costruire dati e strategie di ML. Nel tempo libero si diverte con la sua famiglia viaggiando, facendo escursioni, facendo giardinaggio e guardando documentari.

Bhavana Chirumamilla è Senior Resident Architect presso AWS. È appassionata di dati e operazioni di ML e porta molto entusiasmo nell'aiutare le aziende a costruire dati e strategie di ML. Nel tempo libero si diverte con la sua famiglia viaggiando, facendo escursioni, facendo giardinaggio e guardando documentari.

Srivasa Shaik è un Solutions Architect presso AWS con sede a Boston. Aiuta i clienti aziendali ad accelerare il loro viaggio verso il cloud. È appassionato di container e tecnologie di machine learning. Nel tempo libero ama passare il tempo con la sua famiglia, cucinare e viaggiare.

Srivasa Shaik è un Solutions Architect presso AWS con sede a Boston. Aiuta i clienti aziendali ad accelerare il loro viaggio verso il cloud. È appassionato di container e tecnologie di machine learning. Nel tempo libero ama passare il tempo con la sua famiglia, cucinare e viaggiare.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato in ricerca operativa dopo aver rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente, aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato in ricerca operativa dopo aver rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente, aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-built-an-ai-platform-using-amazon-sagemaker-to-accelerate-delivery-of-ml-projects/

- 100

- 2022

- 7

- a

- capace

- WRI

- accelerare

- accelerata

- accesso

- accessibile

- Secondo

- Il mio account

- Contabilità

- raggiunto

- il raggiungimento

- acquisire

- operanti in

- Action

- atti

- aggiuntivo

- indirizzo

- adottare

- Avanzate

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Piattaforma AI

- Servizi di intelligenza artificiale

- AI / ML

- Tutti

- consente

- a fianco di

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- importi

- ed

- api

- applicazioni

- applicato

- approccio

- approcci

- approvazione

- architettura

- in giro

- autorizzazione

- automatizzare

- Automatizzata

- Automatico

- disponibile

- AWS

- basato

- Linea di base

- perché

- prima

- essendo

- MIGLIORE

- best practice

- fra

- pregiudizio

- miliardi

- Boston

- BRIDGE

- portare

- Porta

- Rotto

- costruire

- Costruzione

- costruisce

- costruito

- onere

- affari

- funzioni aziendali

- funzionalità

- casi

- catalogo

- categoria

- ha causato

- centrale

- centralizzata

- sfide

- dai un'occhiata

- la scelta

- scelto

- strettamente

- Cloud

- infrastruttura cloud

- Cloud Security

- codice

- collaboreranno

- collaborato

- collaborazione

- collettivamente

- arrivo

- Uncommon

- rispetto

- completamento di una

- complesso

- complessità

- conformità

- compiacente

- componente

- componenti

- Compreso

- informatica

- consumato

- Consumatori

- Contenitore

- Tecnologie Container

- contenuto

- continua

- continuo

- di controllo

- Nucleo

- creare

- creato

- Creazione

- la creatività

- critico

- cruciale

- Corrente

- Attualmente

- costume

- Clienti

- dati

- Lago di dati

- elaborazione dati

- scienza dei dati

- banche dati

- Decision Making

- deep

- profonda competenza

- Predefinito

- consegnare

- consegna

- democratizzare

- schierare

- deployment

- Distribuisce

- descrivere

- Design

- tavolo

- dettaglio

- determinato

- sviluppare

- sviluppato

- sviluppatori

- in via di sviluppo

- Mercato

- diverso

- difficile

- Direttore

- discutere

- documentari

- dominio

- domini

- giù

- Presto

- più facile

- facilmente

- in maniera efficace

- efficiente

- sforzo

- il potere

- enable

- abilitato

- Abilita

- consentendo

- incoraggia

- endpoint

- motore

- Ingegneria

- Ingegneri

- Motori

- migliorata

- garantire

- assicurando

- Impresa

- aziende

- entusiasmo

- Ambiente

- errore

- essential

- etico

- valutato

- eventi

- EVER

- evolvere

- evoluzione

- esempio

- esperimento

- competenza

- estendere

- estremamente

- facilitare

- fallito

- famiglia

- caratteristica

- Caratteristiche

- pochi

- finale

- finanziario

- servizio finanziario

- Trovate

- ricerca

- Nome

- prima volta

- Focus

- messa a fuoco

- seguire

- i seguenti

- segue

- formale

- quadri

- da

- Adempiere

- completamente

- funzionalità

- funzioni

- futuro

- divario

- Generale

- generato

- ottenere

- vetro.

- Go

- Obiettivi

- la governance

- concedere

- Terra

- Crescita

- Manovrabilità

- Hard

- Salute e benessere

- Aiuto

- aiutare

- aiuta

- vivamente

- di hosting

- Come

- Tuttavia

- HTML

- HTTPS

- identificato

- identificare

- identificazione

- Identità

- immagini

- Impact

- realizzare

- implementato

- Implementazione

- imporre

- competenze

- in

- inclusi

- Aumento

- studente indipendente

- indipendentemente

- industria

- Infrastruttura

- inizialmente

- Innovazione

- intuizioni

- invece

- assicurazione

- integrato

- Interfaccia

- interno

- coinvolto

- da solo

- problema

- IT

- Lavoro

- Offerte di lavoro

- viaggio

- Le

- Sapere

- conoscenze

- lago

- lanciare

- lanciato

- lancio

- IMPARARE

- apprendimento

- Eredità

- Legale

- Livello

- livelli

- biblioteche

- LIMITE

- limiti

- vivere

- locale

- macchina

- machine learning

- fatto

- maggiore

- FA

- Fare

- gestire

- gestione

- gestione

- mandati

- modo

- Manuale

- molti

- maturità

- analisi

- Utenti

- Metadati

- metodologie

- metrico

- Metrica

- microservices

- migrare

- pietra miliare

- Milestone

- mente

- Minuti

- Ridurre la perdita dienergia con una

- ML

- modello

- modelli

- Monitorare

- monitoraggio

- monitor

- mese

- Scopri di più

- maggior parte

- multiplo

- Naturale

- Navigare

- Bisogno

- esigenze

- internazionale

- New

- notizie

- GENERAZIONE

- premio Nobel

- numero

- oggetto

- occasionale

- offerto

- offerta

- Offerte

- Onboard

- ONE

- open source

- ha aperto

- Operazioni

- Opzioni

- orchestrazione

- organizzazione

- originariamente

- al di fuori

- proprio

- proprietario

- vetro

- Carta

- parametri

- passione

- appassionato

- modelli

- Persone

- performance

- periodico

- fase

- conduttura

- pianificazione

- piani

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- Termini e Condizioni

- politica

- Portale

- possibilità

- Post

- potenziale

- energia

- pratiche

- Previsioni

- preferito

- primario

- principi

- premio

- Problema

- problemi

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- Prodotti

- Scelto dai professionisti

- Programma

- progetto

- progetti

- promesso

- fornire

- purché

- fornisce

- fornitura

- Q3

- q3 2022

- rapidamente

- gamma

- che vanno

- RE

- a raggiunto

- Lettura

- di rose

- tempo reale

- ricevuto

- registro

- registro

- normativa

- normativo

- rilasciare

- rilasciato

- rimuovere

- deposito

- richiesta

- necessario

- Requisiti

- riparazioni

- ricercatori

- risorsa

- Risorse

- responsabile

- Reuters

- Rischio

- Ruolo

- ruoli

- norme

- Correre

- sagemaker

- Inferenza di SageMaker

- scalabile

- Scala

- programma

- Scienze

- scienziati

- senza soluzione di continuità

- senza soluzione di continuità

- Cerca

- Motori di ricerca

- sezioni

- sicuro

- assicurato

- in modo sicuro

- problemi di

- invio

- anziano

- delicata

- servire

- serverless

- servizio

- Servizi

- sessioni

- alcuni

- Condividi

- mostrato

- Un'espansione

- da

- singolo

- Taglia

- Dimensioni

- qualificato

- abilità

- Istantanea

- So

- Software

- soluzione

- Soluzioni

- RISOLVERE

- fonti

- specialista

- specifico

- spendere

- Spendere

- Stage

- stakeholder

- standardizzazione

- standard

- iniziato

- inizio

- stati

- Stato dei servizi

- step

- Passi

- conservazione

- Tornare al suo account

- negozi

- strategie

- snellire

- studio

- tale

- supportato

- Supporto

- commutata

- dati

- tavolo

- Fai

- imposta

- Insegnamento

- team

- le squadre

- Consulenza

- abilità tecniche

- Tecnologie

- modelli

- condizioni

- Il

- loro

- perciò

- Thomson Reuters

- Attraverso

- per tutto

- tempo

- a

- Tracking

- tradizionale

- Treni

- Training

- Trasformare

- Trasparenza

- Di viaggio

- enorme

- innescato

- capire

- unità

- unità

- sguinzagliare

- illimitato

- Aggiornanento

- uso

- Utente

- utenti

- varietà

- vario

- Fisso

- via

- Video

- Visualizza

- visibilità

- guardare

- sito web

- servizi web

- Web-basata

- Settimane

- se

- while

- largo

- Vasta gamma

- volere

- vincere

- entro

- senza

- Lavora

- lavorato

- flussi di lavoro

- In tutto il mondo

- sarebbe

- anno

- Trasferimento da aeroporto a Sharm

- zefiro