Questo post è stato scritto in collaborazione da Brian Curry (fondatore e responsabile dei prodotti presso OCX Cognition) e Sandhya MN (data science lead presso InfoGain)

Cognizione OCX è una startup con sede nella San Francisco Bay Area, che offre un software B2B commerciale come prodotto di servizio (SaaS) chiamato Spectrum AI. Spectrum AI è una piattaforma di analisi CX predittiva (generativa) per le aziende. Le soluzioni OCX sono sviluppate in collaborazione con Infoguadagno, un partner di livello AWS Advanced. Infogain collabora con OCX Cognition come team di prodotto integrato, fornendo servizi di ingegneria del software incentrati sull'uomo e competenze nello sviluppo di software, microservizi, automazione, Internet of Things (IoT) e intelligenza artificiale.

La piattaforma Spectrum AI combina le attitudini dei clienti con i dati operativi dei clienti e utilizza il machine learning (ML) per generare insight continui sulla CX. OCX ha creato Spectrum AI su AWS perché AWS offriva un'ampia gamma di strumenti, elaborazione elastica e un ambiente ML in grado di tenere il passo con le esigenze in evoluzione.

In questo post, discutiamo di come OCX Cognition con il supporto di Infogain e del team dell'account AWS di OCX abbia migliorato l'esperienza del cliente finale e ridotto il time-to-value automatizzando e orchestrando le funzioni ML che supportavano l'analisi CX di Spectrum AI. Usando Funzioni AWS Step, le SDK di data science per AWS Step Functions per Pythone Esperimenti Amazon SageMaker, OCX Cognition ha ridotto il tempo di sviluppo del modello ML da 6 settimane a 2 settimane e ha ridotto il tempo di aggiornamento del modello ML da 4 giorni a quasi tempo reale.

sfondo

La piattaforma Spectrum AI deve produrre modelli ottimizzati per centinaia di punteggi CX generativi diversi per ciascun cliente e questi punteggi devono essere calcolati in modo univoco per decine di migliaia di account attivi. Con il passare del tempo e l'accumulo di nuove esperienze, la piattaforma deve aggiornare questi punteggi in base a nuovi input di dati. Dopo che sono stati prodotti nuovi punteggi, OCX e Infogain calcolano l'impatto relativo di ciascuna metrica operativa sottostante nella previsione. Amazon Sage Maker è un ambiente di sviluppo integrato (IDE) basato sul Web che consente di creare, addestrare e distribuire modelli ML per qualsiasi caso d'uso con infrastruttura, strumenti e flussi di lavoro completamente gestiti. Con SageMaker, il team di OCX-Infogain ha sviluppato la propria soluzione utilizzando librerie di codice condivise su notebook Jupyter gestiti individualmente in Amazon Sage Maker Studio.

Il problema: scalare la soluzione per più clienti

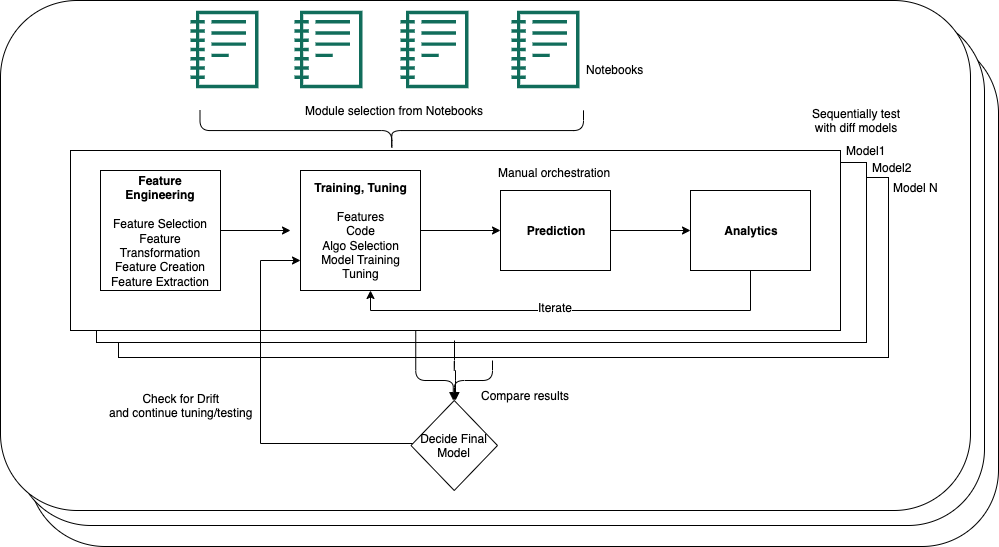

Mentre la R&S iniziale si è rivelata vincente, il ridimensionamento ha rappresentato una sfida. Lo sviluppo ML di OCX e Infogain ha comportato più fasi: ingegneria delle funzionalità, addestramento del modello, previsione e generazione di analisi. Il codice per i moduli risiedeva in più notebook e l'esecuzione di questi notebook era manuale, senza alcuno strumento di orchestrazione. Per ogni nuovo cliente, il team di OCX-Infogain ha dedicato 6 settimane per cliente al tempo di sviluppo del modello perché le librerie non potevano essere riutilizzate. A causa della quantità di tempo dedicata allo sviluppo del modello, il team di OCX-Infogain aveva bisogno di una soluzione automatizzata e scalabile che funzionasse come una singola piattaforma utilizzando configurazioni uniche per ciascuno dei suoi clienti.

Il seguente diagramma dell'architettura illustra i processi iniziali di sviluppo e aggiornamento del modello ML di OCX.

Panoramica della soluzione

Per semplificare il processo ML, il team di OCX-Infogain ha collaborato con il team dell'account AWS per sviluppare un framework ML dichiarativo personalizzato per sostituire tutto il codice ripetitivo. Ciò ha ridotto la necessità di sviluppare un nuovo codice ML di basso livello. Le nuove librerie potrebbero essere riutilizzate per più clienti configurando i dati in modo appropriato per ciascun cliente tramite file YAML.

Sebbene questo codice di alto livello continui a essere sviluppato inizialmente in Studio utilizzando i notebook Jupyter, viene poi convertito in Python (file .py) e la piattaforma SageMaker viene utilizzata per creare un'immagine Docker con contenitori BYO (porta i tuoi). Le immagini Docker vengono quindi inviate a Registro dei contenitori Amazon Elastic (Amazon ECR) come fase preparatoria. Infine, il codice viene eseguito utilizzando Step Functions.

Il team dell'account AWS ha consigliato Step Functions Data Science SDK e SageMaker Experiments per automatizzare l'ingegnerizzazione delle funzionalità, l'addestramento del modello e la distribuzione del modello. L'SDK di Data Science di Step Functions è stato utilizzato per generare le funzioni di passaggio a livello di codice. Il team di OCX-Infogain ha imparato a utilizzare funzionalità come Parallel e MAP all'interno di Step Functions per orchestrare un gran numero di processi di addestramento ed elaborazione in parallelo, riducendo il tempo di esecuzione. Questo è stato combinato con Experiments, che funziona come uno strumento di analisi, monitorando più candidati ML e variazioni di ottimizzazione degli iperparametri. Queste analisi integrate hanno consentito al team di OCX-Infogain di confrontare più metriche in fase di esecuzione e identificare al volo i modelli con le migliori prestazioni.

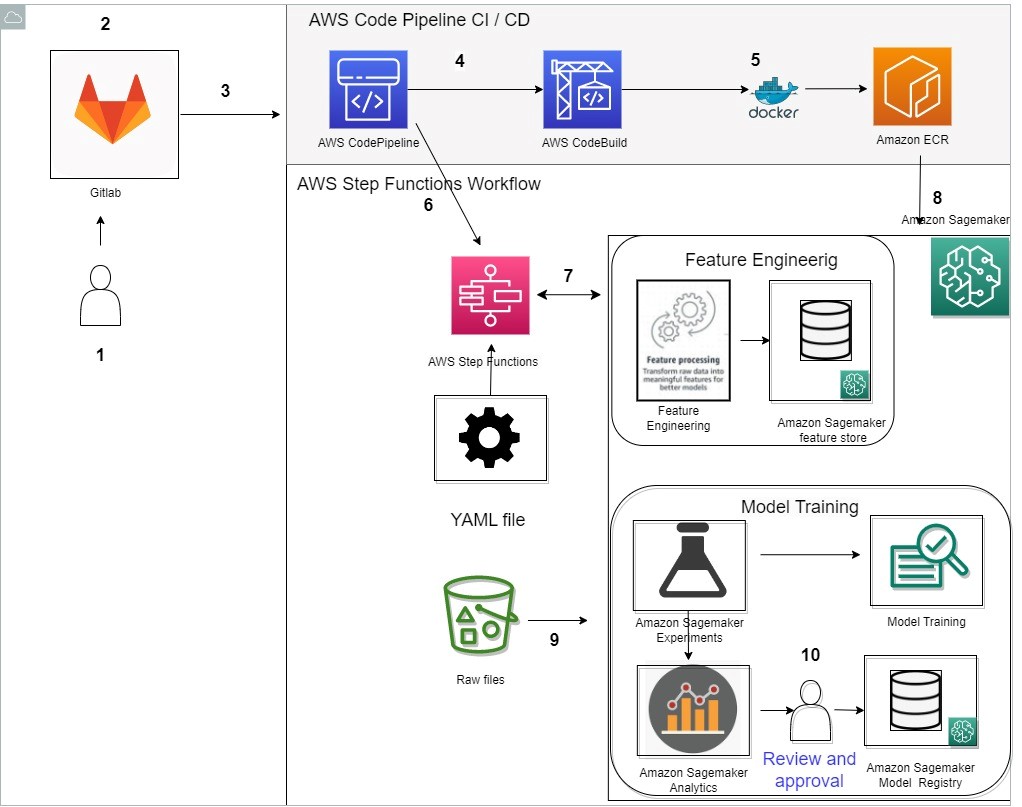

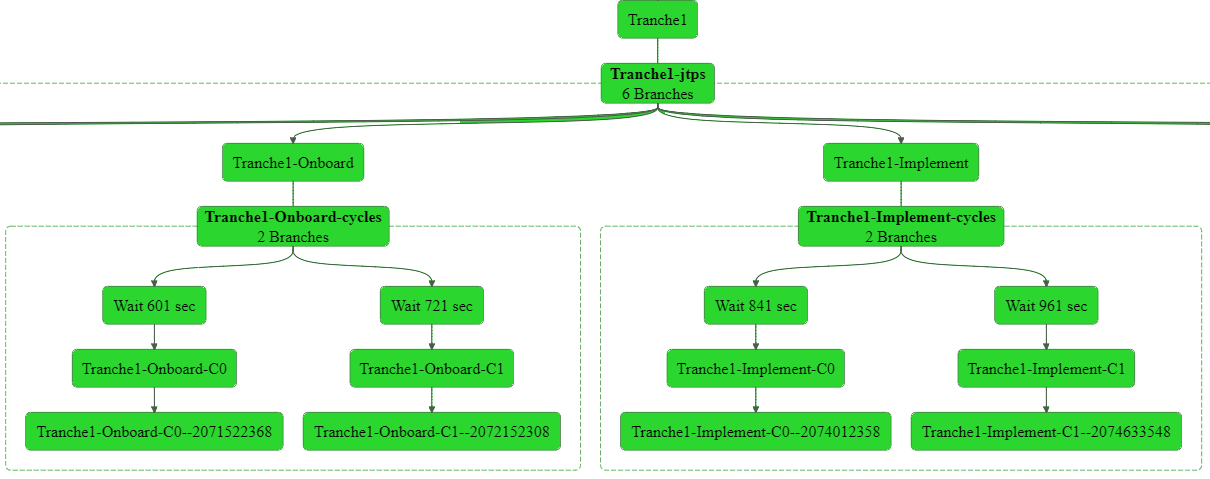

Il seguente diagramma dell'architettura mostra la pipeline MLOps sviluppata per il ciclo di creazione del modello.

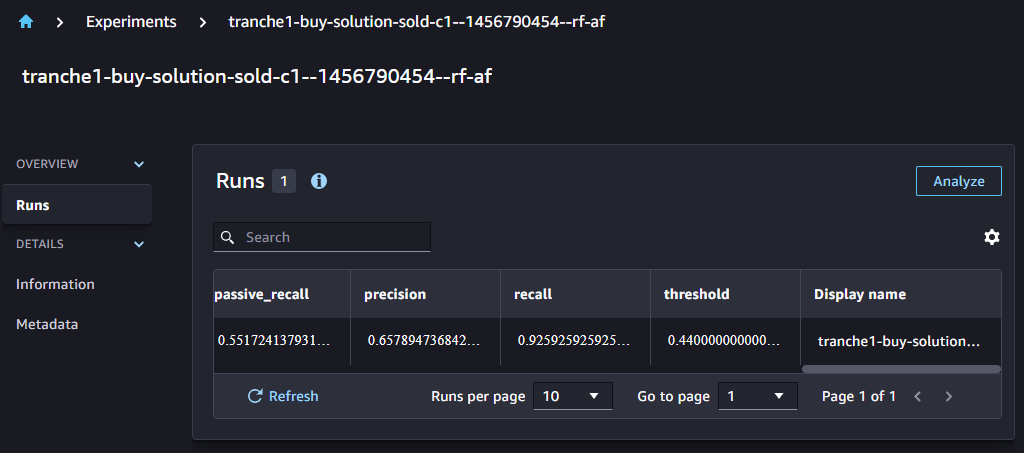

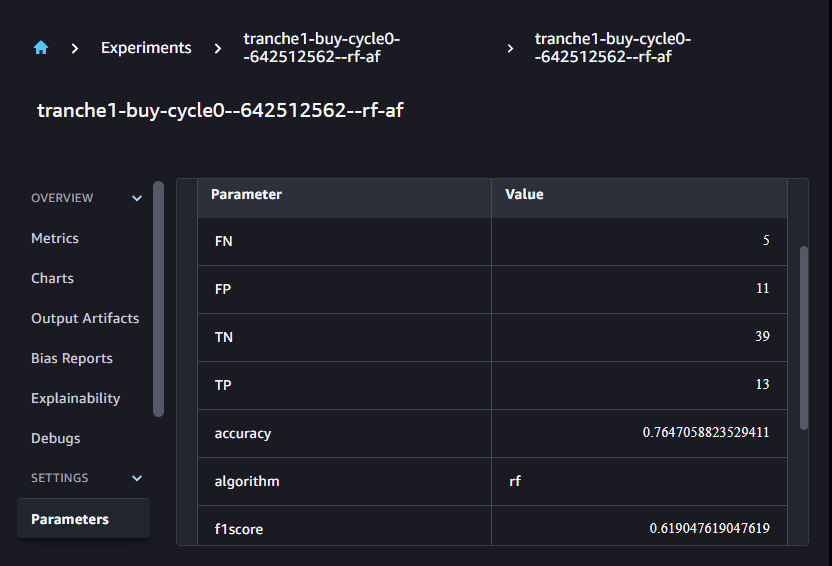

L'SDK Data Science di Step Functions viene utilizzato per analizzare e confrontare più algoritmi di addestramento del modello. La macchina a stati esegue più modelli in parallelo e ogni output del modello viene registrato in Experiments. Quando l'addestramento del modello è completo, i risultati di più esperimenti vengono recuperati e confrontati utilizzando l'SDK. Gli screenshot seguenti mostrano come viene selezionato il modello con le migliori prestazioni per ogni fase.

Di seguito sono riportati i passaggi di alto livello del ciclo di vita ML:

- Gli sviluppatori ML inseriscono il loro codice nelle librerie nel repository Gitlab quando lo sviluppo in Studio è completo.

- AWS Code Pipeline viene utilizzato per estrarre il codice appropriato dal repository Gitlab.

- Un'immagine Docker viene preparata utilizzando questo codice e inviata ad Amazon ECR per l'elaborazione senza server.

- Step Functions viene utilizzato per eseguire i passaggi utilizzando Elaborazione di Amazon SageMaker lavori. Qui, più attività indipendenti vengono eseguite in parallelo:

- Viene eseguita la progettazione delle funzionalità e le funzionalità vengono memorizzate nell'archivio delle funzionalità.

- Viene eseguito l'addestramento del modello, con più algoritmi e diverse combinazioni di iperparametri che utilizzano il file di configurazione YAML.

- La funzione del passo di addestramento è progettata per avere un parallelismo pesante. I modelli per ogni tappa del viaggio vengono eseguiti in parallelo. Ciò è rappresentato nel diagramma seguente.

- I risultati del modello vengono quindi registrati in Esperimenti. Il modello con le migliori prestazioni viene selezionato e inserito nel registro dei modelli.

- Le previsioni vengono effettuate utilizzando i modelli con le migliori prestazioni per ogni analitica CX che generiamo.

- Centinaia di analisi vengono generate e poi distribuite per la pubblicazione in un data warehouse ospitato su AWS.

Risultati

Con questo approccio, OCX Cognition ha automatizzato e accelerato l'elaborazione ML. Sostituendo i processi manuali ad alta intensità di manodopera e gli oneri di sviluppo altamente ripetitivi, il costo per cliente si riduce di oltre il 60%. Ciò consente inoltre a OCX di scalare la propria attività di software triplicando la capacità complessiva e raddoppiando la capacità per l'onboarding simultaneo dei clienti. L'automazione dell'elaborazione ML da parte di OCX sblocca un nuovo potenziale di crescita attraverso l'acquisizione di clienti. L'utilizzo di SageMaker Experiments per tenere traccia dell'addestramento dei modelli è fondamentale per identificare il miglior set di modelli da utilizzare e portare in produzione. Per i loro clienti, questa nuova soluzione fornisce non solo un miglioramento dell'8% nelle prestazioni ML, ma anche un miglioramento del 63% nel time-to-value. L'onboarding di nuovi clienti e la generazione iniziale del modello sono migliorati da 6 a 2 settimane. Una volta costruito e installato, OCX inizia a rigenerare continuamente l'analisi CX man mano che arrivano nuovi dati di input dal cliente. Questi cicli di aggiornamento sono migliorati da 4 giorni a quasi in tempo reale

Conclusione

In questo post, abbiamo mostrato come OCX Cognition e Infogain hanno utilizzato Step Functions, Step Functions Data Science SDK per Python e Sagemaker Experiments insieme a Sagemaker Studio per ridurre il time-to-value del team di OCX-InfoGain nello sviluppo e nell'aggiornamento dei modelli di analisi CX per i loro clienti.

Per iniziare con questi servizi, fare riferimento a Amazon Sage Maker, SDK Python per data science di AWS Step Functions, Funzioni AWS Stepe Gestisci l'apprendimento automatico con Amazon SageMaker Experiments.

Informazioni sugli autori

Brian Curri è attualmente fondatore e Head of Products di OCX Cognition, dove stiamo costruendo una piattaforma di machine learning per l'analisi dei clienti. Brian ha più di un decennio di esperienza nella guida di soluzioni cloud e organizzazioni di prodotti incentrate sul design.

Brian Curri è attualmente fondatore e Head of Products di OCX Cognition, dove stiamo costruendo una piattaforma di machine learning per l'analisi dei clienti. Brian ha più di un decennio di esperienza nella guida di soluzioni cloud e organizzazioni di prodotti incentrate sul design.

Sandya MN fa parte di Infogain e guida il team di Data Science per OCX. È una leader esperta nello sviluppo di software con una vasta esperienza in più tecnologie e domini di settore. È appassionata di rimanere aggiornata con la tecnologia e utilizzarla per fornire valore aziendale ai clienti.

Sandya MN fa parte di Infogain e guida il team di Data Science per OCX. È una leader esperta nello sviluppo di software con una vasta esperienza in più tecnologie e domini di settore. È appassionata di rimanere aggiornata con la tecnologia e utilizzarla per fornire valore aziendale ai clienti.

Prashanth Ganapatia è Senior Solutions Architect nel segmento Small Medium Business (SMB) presso AWS. Gli piace conoscere i servizi AI/ML di AWS e aiutare i clienti a raggiungere i loro risultati aziendali creando soluzioni per loro. Al di fuori del lavoro, Prashanth ama la fotografia, viaggiare e provare diverse cucine.

Prashanth Ganapatia è Senior Solutions Architect nel segmento Small Medium Business (SMB) presso AWS. Gli piace conoscere i servizi AI/ML di AWS e aiutare i clienti a raggiungere i loro risultati aziendali creando soluzioni per loro. Al di fuori del lavoro, Prashanth ama la fotografia, viaggiare e provare diverse cucine.

Sabha Parameshwaran è un Senior Solutions Architect presso AWS con oltre 20 anni di profonda esperienza nell'integrazione di applicazioni aziendali, microservizi, container e ottimizzazione delle prestazioni dei sistemi distribuiti, prototipazione e altro ancora. Ha sede nella San Francisco Bay Area. In AWS, si concentra sull'aiutare i clienti nel loro viaggio nel cloud ed è anche attivamente coinvolto in microservizi e architetture e framework basati su serverless.

Sabha Parameshwaran è un Senior Solutions Architect presso AWS con oltre 20 anni di profonda esperienza nell'integrazione di applicazioni aziendali, microservizi, container e ottimizzazione delle prestazioni dei sistemi distribuiti, prototipazione e altro ancora. Ha sede nella San Francisco Bay Area. In AWS, si concentra sull'aiutare i clienti nel loro viaggio nel cloud ed è anche attivamente coinvolto in microservizi e architetture e framework basati su serverless.

Vaisnavi Ganesan è un Solutions Architect presso AWS con sede nella San Francisco Bay Area. Si concentra sull'aiutare i clienti del segmento commerciale nel loro viaggio nel cloud ed è appassionata di sicurezza nel cloud. Al di fuori del lavoro, Vaishnavi ama viaggiare, fare escursioni e provare vari torrefattori.

Vaisnavi Ganesan è un Solutions Architect presso AWS con sede nella San Francisco Bay Area. Si concentra sull'aiutare i clienti del segmento commerciale nel loro viaggio nel cloud ed è appassionata di sicurezza nel cloud. Al di fuori del lavoro, Vaishnavi ama viaggiare, fare escursioni e provare vari torrefattori.

Ajay Swaminathan è un Account Manager II presso AWS. È un sostenitore dei clienti del segmento commerciale, fornendo le giuste risorse finanziarie, di innovazione aziendale e tecniche in conformità con gli obiettivi dei suoi clienti. Al di fuori del lavoro, Ajay è appassionato di sci, dubstep, musica drum and bass e basket.

Ajay Swaminathan è un Account Manager II presso AWS. È un sostenitore dei clienti del segmento commerciale, fornendo le giuste risorse finanziarie, di innovazione aziendale e tecniche in conformità con gli obiettivi dei suoi clienti. Al di fuori del lavoro, Ajay è appassionato di sci, dubstep, musica drum and bass e basket.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-ocx-cognition-reduced-ml-model-development-time-from-weeks-to-days-and-model-update-time-from-days-to-real-time-using-aws-step-functions-and-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 100

- 20

- 20 anni

- 7

- a

- WRI

- accelerata

- accordo

- Il mio account

- conti

- Accumulare

- acquisizione

- operanti in

- attivo

- attivamente

- Avanzate

- avvocato

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Piattaforma AI

- AI / ML

- Algoritmi

- Tutti

- consente

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantità

- an

- Analitico

- analitica

- analizzare

- ed

- in qualsiasi

- Applicazioni

- approccio

- opportuno

- appropriatamente

- architettura

- SONO

- RISERVATA

- Arriva

- artificiale

- intelligenza artificiale

- AS

- At

- automatizzare

- Automatizzata

- Automatizzare

- Automazione

- AWS

- Funzioni AWS Step

- B2B

- basato

- Pallacanestro

- basso

- Baia

- BE

- perché

- MIGLIORE

- Brian

- portare

- costruire

- Costruzione

- costruito

- incassato

- affari

- ma

- by

- detto

- i candidati

- Ultra-Grande

- Custodie

- Challenge

- dai un'occhiata

- Cloud

- codice

- Caffè

- collaborazione

- combinazioni

- combinato

- combina

- confrontare

- rispetto

- completamento di una

- Calcolare

- informatica

- Configurazione

- Contenitore

- Tecnologie Container

- continua

- continuo

- continuamente

- convertito

- Costo

- potuto

- creazione

- critico

- Attualmente

- costume

- cliente

- esperienza del cliente

- Clienti

- CX

- ciclo

- cicli

- dati

- scienza dei dati

- Data

- Giorni

- decennio

- deep

- consegnare

- schierare

- deployment

- progettato

- sviluppare

- sviluppato

- sviluppatori

- in via di sviluppo

- Mercato

- diverso

- discutere

- distribuito

- sistemi distribuiti

- docker

- domini

- raddoppio

- dovuto

- ogni

- fine

- Ingegneria

- Impresa

- aziende

- Ambiente

- Ogni

- evoluzione

- esperienza

- Esperienze

- esperimenti

- competenza

- estensivo

- Conclamata Esperienza

- caratteristica

- Caratteristiche

- Compila il

- File

- Infine

- finanziario

- concentrato

- i seguenti

- Nel

- fondatore

- Contesto

- quadri

- Francisco

- da

- completamente

- function

- funzioni

- generare

- generato

- ELETTRICA

- generativo

- ottenere

- Obiettivi

- Crescere

- Avere

- he

- capo

- pesante

- aiutare

- qui

- alto livello

- vivamente

- il suo

- ospitato

- Come

- Tutorial

- HTML

- http

- HTTPS

- centinaia

- Sintonia iperparametro

- identificare

- identificazione

- ii

- Immagine

- immagini

- Impact

- migliorata

- miglioramento

- in

- studente indipendente

- Individualmente

- industria

- Infrastruttura

- inizialmente

- inizialmente

- Innovazione

- ingresso

- Ingressi

- intuizione

- integrato

- integrazione

- Intelligence

- Internet

- Internet delle cose

- ai miglioramenti

- coinvolto

- IoT

- IT

- Offerte di lavoro

- viaggio

- jpg

- mantenere

- grandi

- portare

- leader

- principale

- Leads

- imparato

- apprendimento

- biblioteche

- ciclo di vita

- piace

- registrati

- macchina

- machine learning

- fatto

- gestito

- direttore

- Manuale

- carta geografica

- medie

- Soddisfare

- metrico

- Metrica

- microservices

- ML

- MLOp

- modello

- modelli

- moduli

- Scopri di più

- multiplo

- Musica

- Bisogno

- di applicazione

- esigenze

- New

- nuova soluzione

- no

- numero

- of

- MENO

- offerto

- offerta

- on

- Procedura di Onboarding

- una volta

- esclusivamente

- operato

- operativa

- orchestrazione

- organizzazioni

- su

- risultati

- produzione

- al di fuori

- ancora

- complessivo

- proprio

- Pace

- Parallel

- parte

- partner

- Passi

- appassionato

- performance

- esecuzione

- fotografia

- conduttura

- posto

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- Post

- potenziale

- predizione

- preparato

- Problema

- processi

- i processi

- lavorazione

- produrre

- Prodotto

- Prodotto

- Produzione

- Prodotti

- prototipazione

- dimostrato

- fornisce

- fornitura

- Pubblicazione

- Spingi

- spinto

- Python

- R&D

- gamma

- di rose

- tempo reale

- raccomandato

- ridurre

- Ridotto

- riduce

- registro

- ripetitivo

- sostituire

- deposito

- Risorse

- Risultati

- destra

- Correre

- running

- SaaS

- sagemaker

- San

- San Francisco

- scalabile

- Scala

- scala

- Scienze

- screenshot

- sdk

- condito

- problemi di

- segmento

- selezionato

- anziano

- serverless

- servizio

- Servizi

- set

- alcuni

- condiviso

- lei

- mostrare attraverso le sue creazioni

- ha mostrato

- Spettacoli

- semplificare

- singolare

- piccole

- SMB

- Software

- software come un servizio

- lo sviluppo del software

- Ingegneria del software

- soluzione

- Soluzioni

- Spettro

- esaurito

- Stage

- iniziato

- startup

- Regione / Stato

- step

- Passi

- Tornare al suo account

- memorizzati

- studio

- di successo

- supporto

- supportato

- SISTEMI DI TRATTAMENTO

- Fai

- task

- team

- Consulenza

- Tecnologie

- Tecnologia

- decine

- di

- che

- Il

- Lo Stato

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- cose

- questo

- migliaia

- Attraverso

- fila

- tempo

- a

- strumenti

- pista

- Tracking

- Treni

- Training

- viaggiare

- Di viaggio

- triplicando

- sottostante

- unico

- univocamente

- sblocca

- Aggiornanento

- aggiornamento

- uso

- caso d'uso

- utilizzato

- utilizzando

- utilizzati

- Utilizzando

- APPREZZIAMO

- vario

- Prima

- we

- sito web

- servizi web

- Web-basata

- Settimane

- quando

- quale

- largo

- Vasta gamma

- con

- entro

- Lavora

- lavorato

- flussi di lavoro

- lavori

- sarebbe

- YAML

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro