La scorsa settimana il Parlamento europeo ha approvato la tanto attesa legge sull’intelligenza artificiale, rendendola la prima grande giurisdizione al mondo a introdurre norme complete per il settore, ma la conformità potrebbe rivelarsi difficile per le startup nuove alla regolamentazione.

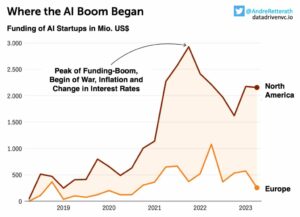

Sebbene alcuni aspetti dell’AI Act siano aperti all’interpretazione e debbano ancora essere implementati, alcuni fondatori temono che le misure potrebbero farlo danneggiare le aziende più piccole e ostacolare gli investimenti e l’innovazione, lasciando l’Europa ulteriormente indietro rispetto agli Stati Uniti e alla Cina nella corsa all’intelligenza artificiale.

Il nuove regole, che mirano a limitare l’uso dell’intelligenza artificiale considerata ad alto rischio, come i deepfake e i software di riconoscimento facciale nelle aree pubbliche, si applicheranno a tutte le aziende che utilizzano l’intelligenza artificiale nei 27 Stati membri dell’UE. Complessivamente, il blocco rappresenta circa il 20% dell’economia globale.

Leggi anche: Il Parlamento europeo adotta finalmente la legge sull’IA

AI Act: gli effetti a catena

“Sebbene la legge sia piuttosto progressista e probabilmente avrà un effetto a catena in altre regioni, ci sono preoccupazioni su come potrebbe avere un impatto sull’innovazione nell’UE”, ha detto a MetaNews Nitish Mittal, partner del gruppo tecnologico statunitense Everest.

Mittal, che guida la trasformazione digitale e i servizi IT dell’Everest in Europa, Regno Unito e Irlanda, ha affermato che negli ultimi decenni l’Europa sembra “essere rimasta indietro rispetto a Stati Uniti e Cina in termini di innovazione tecnologica”.

Ma ha anche sottolineato come l’Unione europea abbia previsto tali debolezze e abbia iniziato a prepararsi prima che la legge, che dovrebbe essere pienamente attuata nei prossimi due anni, entri in vigore entro la fine dell’anno.

“L’UE riconosce alcune di queste sfide e sta cercando di implementare alcune strade per aiutare le startup e l’innovazione nel campo dell’intelligenza artificiale”, ha affermato Mittal.

Alla fine di gennaio, il bloc ha annunciato una serie di misure volte a promuovere l’innovazione per le startup europee che sviluppano quella che definisce un’intelligenza artificiale “affidabile” che “rispetta i valori e le regole dell’UE”.

Ha affermato che le aziende avranno “accesso privilegiato ai supercomputer” e che la stessa UE costruirà “fabbriche di intelligenza artificiale” per garantire che l’infrastruttura AI sia disponibile per l’acquisto e l’aggiornamento delle startup.

Affare rischioso

Ancor prima che il Parlamento Europeo, il principale organo legislativo dell’UE, votasse a favore della legge sull’AI, la legge ha dovuto affrontare critiche da parte dei fondatori di startup che lavorano con modelli generativi.

A ottobre, Cedric O, fondatore della startup francese AI Maestrale, ha affermato che la legge “ucciderà” la sua azienda. L'imprenditore temeva che la legge ponesse un controllo eccessivo sui modelli linguistici di grandi dimensioni, anche se non venivano utilizzati per questioni delicate come le assunzioni, Sifted segnalati.

Jonas Andrulis, amministratore delegato di Aleph Alpha, la rivale tedesca del creatore statunitense ChatGPT, OpenAI, ha affermato che classificare l'"intelligenza artificiale per scopi generali" come gli LLM come ad alto rischio potrebbe avere conseguenze indesiderate. Ai suoi commenti ha fatto eco Peter Sarlin, amministratore delegato della finlandese Silo AI.

"Se generalizziamo la tecnologia dell'intelligenza artificiale generativa e diciamo che tutti i casi d'uso che utilizzano trasformatori generativi pre-addestrati (GPT) sono ad alto rischio, allora penso che regoleremo anche molti casi d'uso che non lo sono" In realtà non è ad alto rischio", disse Sarlin all'epoca.

Non sono stati solo gli imprenditori a sollevare preoccupazioni riguardo alla legge sull’AI. Un’analisi del Dipartimento di Stato americano di ottobre ha avvertito che alcune norme della legge erano basate su termini “vaghi o indefiniti”, secondo Bloomberg.

L’analisi afferma che l’AI Act europeo andrebbe a vantaggio delle più grandi aziende tecnologiche che hanno il peso finanziario per addestrare modelli di intelligenza artificiale e sistemi di apprendimento automatico. È probabile che le imprese più piccole subiscano perdite, ha aggiunto.

La legge sull’intelligenza artificiale delinea diverse categorie di rischio legate all’uso dell’intelligenza artificiale, che vanno da “basso rischio” a “alto” e “rischio inaccettabile”. Le app di intelligenza artificiale considerate una minaccia ai diritti individuali, come il punteggio sociale o i software di riconoscimento facciale nei luoghi pubblici, saranno completamente vietate.

I casi d’uso sensibili “ad alto rischio” che saranno consentiti includono aspetti come la gestione delle frontiere, l’istruzione e il reclutamento. Le aziende che utilizzano tali tecnologie saranno tenute a divulgare maggiori informazioni sui dati utilizzati per addestrare i propri sistemi.

Adeguamento alla legge sull'AI

"Sebbene la legge incoraggi lo sviluppo etico dell'intelligenza artificiale, introduce anche requisiti e obblighi specifici, in particolare per i sistemi di intelligenza artificiale ad alto rischio", Michele Borrelli, CEO di AI & Partners con sede a Londra, ha detto a MetaNews.

Borrelli, la cui azienda aiuta le aziende a rispettare la conformità normativa in Europa, ha aggiunto che le nuove regole potrebbero richiedere aggiustamenti nel modo in cui le startup operano e innovano.

“La necessità di rispettare queste normative può inizialmente rappresentare una sfida, ma alla fine mira a promuovere un ecosistema di intelligenza artificiale più sicuro e affidabile, migliorando potenzialmente la crescita e la competitività globale delle start-up europee”, ha spiegato.

Uno di problemi maggiori sollevato dai fondatori di startup riguarda il modo in cui la nuova legislazione classifica tutti i modelli di intelligenza artificiale generativa come ad alto rischio, anche quando le aziende dietro di essi affrontano sfide diverse.

Nitish Mittal, partner dell’Everest Group, ha voluto sottolineare che alcuni settori classificati come ad alto rischio “avranno probabilmente bisogno di maggiori tutele e comprensione” su come ciò si applicherà alle loro aziende e sulle “misure che dovranno adottare”.

“Ogni organizzazione dovrà dare uno sguardo più approfondito e attento ai dati e a tutti gli aspetti che li circondano”, ci dice Mittal.

"Ad esempio, chi possiede i dati che utilizzano, li usa per addestrare i propri modelli, come lavora con i partner e con i clienti, ecc.", ha aggiunto.

Competere con gli Stati Uniti

L’Europa è in ritardo rispetto agli Stati Uniti nel numero di grandi aziende di intelligenza artificiale generativa, ma continua a promuovere un ecosistema attivo di attori più piccoli. Alcuni di quelli più importanti includono Mistral AI, Iris AI con sede a Oslo, Zeta Alpha con sede ad Amsterdam e altri.

L’AI Act riconosce questa differenza e si rivolge direttamente alla comunità europea delle startup. Come ha sottolineato Michael Borrelli, la legge impone l’accesso prioritario ai sandbox normativi sull’IA per le piccole e medie imprese, comprese le startup.

Offre inoltre misure a sostegno dell’innovazione, come l’organizzazione di sensibilizzazione e “attività di formazione su misura per le PMI e la riduzione delle tariffe per le valutazioni di conformità proporzionalmente alle loro dimensioni”, ha affermato.

Ma è improbabile che i fondi di rischio investano in startup classificate dalla legge sull’AI come ad alto rischio, secondo a un sondaggio del 2023 condotto su 14 VC europei dall’Initiative for Applied AI. Undici fondi hanno affermato di essere meno propensi a investire in società con un rating ad alto rischio e otto hanno affermato che ciò avrebbe un impatto negativo sulla valutazione della startup.

Per Borrelli, il fatto che gli Stati Uniti stiano ancora cercando di individuare il giusto quadro giuridico per l’IA – attualmente è meno centralizzato e varia da stato a stato – significa che l’AI Act dell’UE, che fornisce un insieme di regole armonizzate per l’intero mercato europeo , ha il sopravvento.

“Questa armonizzazione può offrire un ambiente normativo chiaro e coerente per le startup, rendendo potenzialmente più semplice la loro espansione in tutta l’UE senza dover navigare tra normative disparate”, ha affermato.

Ma ha avvertito che l’approccio normativo collettivo potrebbe anche “rallentare [il] rapido ridimensionamento” dei prodotti di intelligenza artificiale.

“I requisiti rigorosi per i sistemi di IA ad alto rischio e l’attenzione allo sviluppo etico dell’IA richiedono che le startup europee investano di più nella conformità e nelle considerazioni etiche rispetto alle loro controparti statunitensi”, ha spiegato Borrelli.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://metanews.com/what-does-the-eus-ai-act-mean-for-startups/

- :ha

- :È

- :non

- 14

- 2023

- 27

- 475

- 7

- 8

- a

- WRI

- accesso

- Secondo

- operanti in

- Legge

- attivo

- attività

- effettivamente

- aggiunto

- regolazioni

- AI

- Legge sull'IA

- Modelli AI

- Sistemi di intelligenza artificiale

- AI-alimentato

- puntare

- Mirato

- mira

- Tutti

- permesso

- Alpha

- anche

- del tutto

- an

- .

- ed

- Anticipato

- appare

- applicato

- AI applicata

- APPLICA

- approccio

- applicazioni

- SONO

- aree

- in giro

- artificiale

- intelligenza artificiale

- AS

- aspetti

- valutazioni

- At

- disponibile

- viali

- consapevolezza

- male

- vietato

- basato

- BE

- prima

- dietro

- essendo

- beneficio

- stile di vita

- potenziamento

- sistema

- costruire

- aziende

- ma

- Acquistare

- by

- Bandi

- Materiale

- casi

- categoria

- classificato

- centralizzata

- ceo

- certo

- sfide

- Cina

- classificato

- pulire campo

- cliente

- Chiudi

- Collective

- viene

- Commenti

- comunità

- Aziende

- competitività

- conformità

- ottemperare

- globale

- preoccupazioni

- Conseguenze

- Considerazioni

- considerato

- coerente

- continua

- potuto

- omologhi

- Creatore

- Crediti

- Attualmente

- dati

- decenni

- deepfakes

- Shirts Department

- schierare

- in via di sviluppo

- Mercato

- differenza

- diverso

- digitale

- DIGITAL TRANSFORMATION

- direttamente

- Rilevare

- disparato

- do

- effettua

- giù

- più facile

- eco

- economia

- ecosistema

- Istruzione

- effetto

- otto

- undici

- enfatizzare

- incoraggia

- ingegnere

- migliorando

- Intero

- Imprenditore

- imprenditori

- Ambiente

- particolarmente

- eccetera

- etico

- EU

- Europa

- Europa

- europeo

- Parlamento europeo

- Unione europea

- Europe

- Anche

- Everest

- eccessivo

- previsto

- ha spiegato

- Faccia

- di fronte

- Facciale

- riconoscimento facciale

- fatto

- favorire

- Costi

- pochi

- figura

- Infine

- finanziario

- Impresa

- Aziende

- Nome

- Focus

- Nel

- Per le startup

- forza

- Favorire

- fondatore

- fondatori

- Contesto

- Francese

- da

- completamente

- fondi

- ulteriormente

- generativo

- AI generativa

- Tedesco

- globali

- Economia globale

- Gruppo

- Crescita

- ha avuto

- cura

- Più forte

- Avere

- he

- aiutare

- aiuta

- Alta

- alto rischio

- Evidenziato

- Affitto

- il suo

- Come

- HTTPS

- i

- if

- Immagine

- Impact

- realizzare

- implementato

- in

- In altre

- includere

- Compreso

- individuale

- informazioni

- Infrastruttura

- inizialmente

- iniziativa

- innovare

- Innovazione

- esempio

- Intelligence

- interpretazione

- ai miglioramenti

- introdurre

- Introduce

- Investire

- investimento

- Irlanda

- sicurezza

- IT

- stessa

- Gennaio

- jpeg

- jpg

- Giurisdizione

- Acuto

- Regno

- Lingua

- grandi

- maggiore

- Cognome

- In ritardo

- dopo

- Legge

- Leads

- apprendimento

- Legale

- quadro giuridico

- Legislazione

- Legislativo

- meno

- piace

- probabile

- Guarda

- perdite

- lotto

- macchina

- machine learning

- Principale

- maggiore

- make

- Fare

- gestione

- mandati

- Rappresentanza

- max-width

- Maggio..

- significare

- si intende

- analisi

- medie

- MetaNotizie

- Michael

- forza

- modelli

- Scopri di più

- navigazione

- Bisogno

- New

- Nuova legislazione

- GENERAZIONE

- notevole

- numero

- obblighi

- ottobre

- of

- offrire

- Offerte

- on

- quelli

- esclusivamente

- aprire

- OpenAI

- operare

- operato

- or

- organizzazione

- organizzazione

- Altro

- Altri

- su

- lineamenti

- a titolo definitivo

- ancora

- possiede

- parlamento

- partner

- partner

- Passato

- Peter

- Partner

- Platone

- Platone Data Intelligence

- PlatoneDati

- giocatori

- posa

- potenzialmente

- Preparare

- priorità

- Prodotti

- progressivo

- proporzionalmente

- Dimostra

- fornisce

- la percezione

- scopo

- Mettendo

- abbastanza

- Gara

- raccolta

- gamma

- che vanno

- veloce

- valutazione

- Leggi

- riconoscere

- riconoscimento

- riconosce

- reclutamento

- riducendo

- regioni

- regolazione

- Regolamento

- normativa

- normativo

- Conformità normativa

- riferisce

- affidabile

- rappresenta

- richiedere

- necessario

- Requisiti

- limitare

- destra

- diritti

- Rischio

- Rivale

- robot

- norme

- s

- garanzie

- più sicuro

- Suddetto

- sandbox

- detto

- Scala

- punteggio

- scrutinio

- settore

- Settori

- delicata

- Servizi

- set

- Taglia

- piccole

- inferiore

- PMI

- Social

- Software

- alcuni

- Parla

- specifico

- start-up

- iniziato

- startup

- aziende startup

- Startup

- Regione / Stato

- Dipartimento di Stato

- stati

- Ancora

- rigoroso

- tale

- supporto

- sicuro

- Indagine

- SISTEMI DI TRATTAMENTO

- su misura

- Fai

- Tech

- Tecnologie

- Tecnologia

- Innovazione tecnologica

- dice

- condizioni

- di

- che

- Il

- L'iniziativa

- la legge

- il Regno Unito

- il mondo

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- think

- questo

- quest'anno

- minaccia

- tempo

- a

- detto

- difficile

- Treni

- Trasformazione

- trasformatori

- cerca

- seconda

- noi

- in definitiva

- unione

- Unito

- UK

- improbabile

- upgrade

- us

- uso

- utilizzato

- utilizzando

- utilizzare

- Valorizzazione

- Valori

- VC

- impresa

- votato

- avvertito

- Prima

- we

- debolezza

- settimana

- WELL

- sono stati

- Che

- quando

- quale

- OMS

- di chi

- volere

- con

- senza

- Lavora

- lavoro

- mondo

- preoccupato

- preoccuparsi

- sarebbe

- anno

- anni

- ancora

- zefiro

- Zeta