La moderazione dei contenuti svolge un ruolo fondamentale nel mantenimento della sicurezza online e nel sostegno dei valori e degli standard dei siti Web e delle piattaforme di social media. La sua importanza è sottolineata dalla protezione che offre agli utenti dall’esposizione a contenuti inappropriati, salvaguardando il loro benessere negli spazi digitali. Ad esempio, nel settore pubblicitario, la moderazione dei contenuti serve a proteggere i marchi da associazioni sfavorevoli, contribuendo così all’elevazione del marchio e alla crescita dei ricavi. Gli inserzionisti danno priorità all'allineamento del proprio marchio con contenuti appropriati per sostenere la propria reputazione ed evitare pubblicità negativa. La moderazione dei contenuti assume un’importanza fondamentale anche nei settori finanziario e sanitario, dove svolge molteplici funzioni. Svolge un ruolo importante nell'identificazione e nella salvaguardia delle informazioni personali sensibili e sanitarie (PII, PHI). Aderendo a standard e pratiche interni e rispettando le normative esterne, la moderazione dei contenuti migliora la sicurezza digitale degli utenti. In questo modo, impedisce la condivisione involontaria di dati riservati su piattaforme pubbliche, garantendo la preservazione della privacy degli utenti e la sicurezza dei dati.

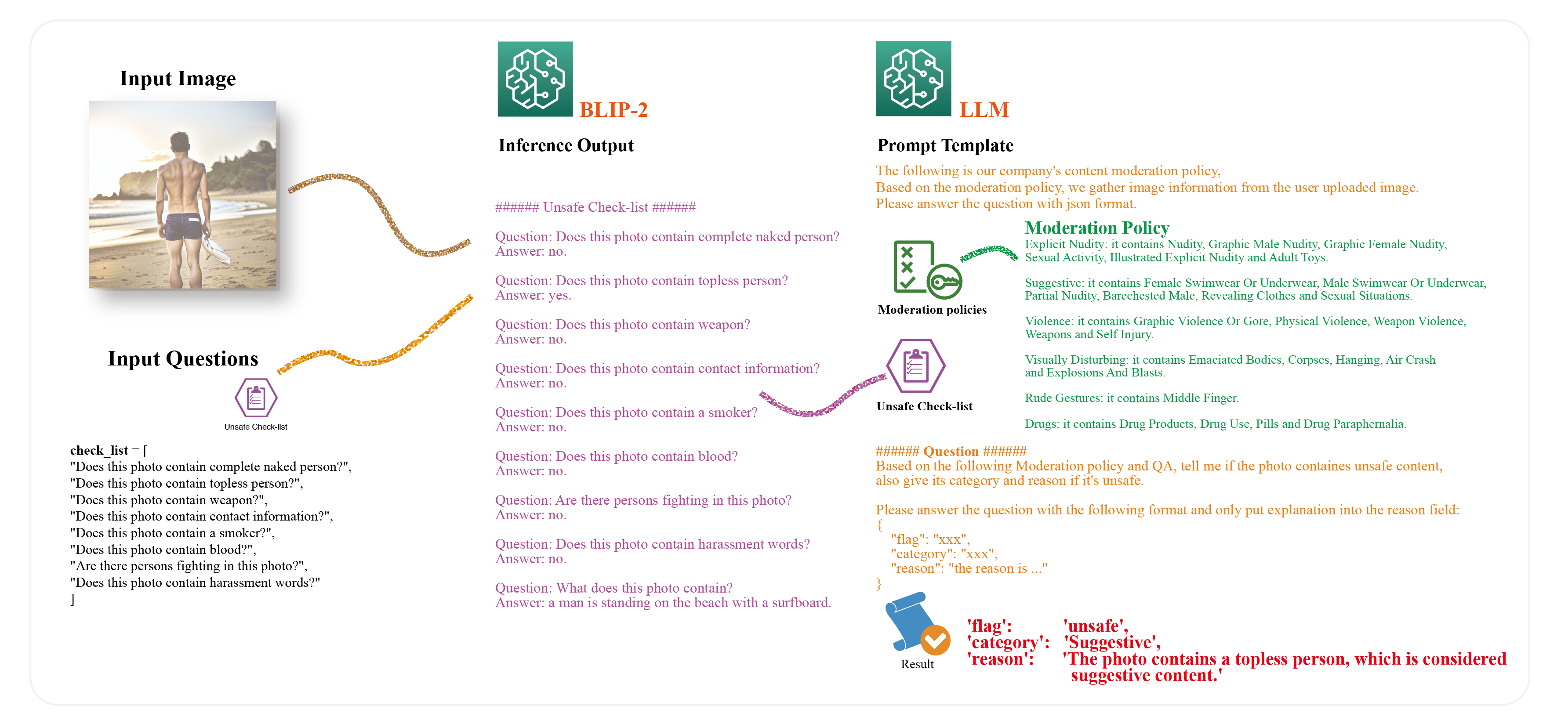

In questo post, introduciamo un nuovo metodo per eseguire la moderazione dei contenuti sui dati di immagine con pre-addestramento multimodale e un modello linguistico di grandi dimensioni (LLM). Con il pre-addestramento multimodale, possiamo interrogare direttamente il contenuto dell'immagine sulla base di una serie di domande di interesse e il modello sarà in grado di rispondere a queste domande. Ciò consente agli utenti di chattare con l'immagine per verificare se contiene contenuti inappropriati che violano le politiche dell'organizzazione. Utilizziamo la potente capacità di generazione dei LLM per generare la decisione finale, comprese le etichette sicure/non sicure e il tipo di categoria. Inoltre, progettando un prompt, possiamo fare in modo che un LLM generi il formato di output definito, come il formato JSON. Il modello di richiesta progettato consente a LLM di determinare se l'immagine viola la politica di moderazione, identificare la categoria di violazione, spiegare il motivo e fornire l'output in un formato JSON strutturato.

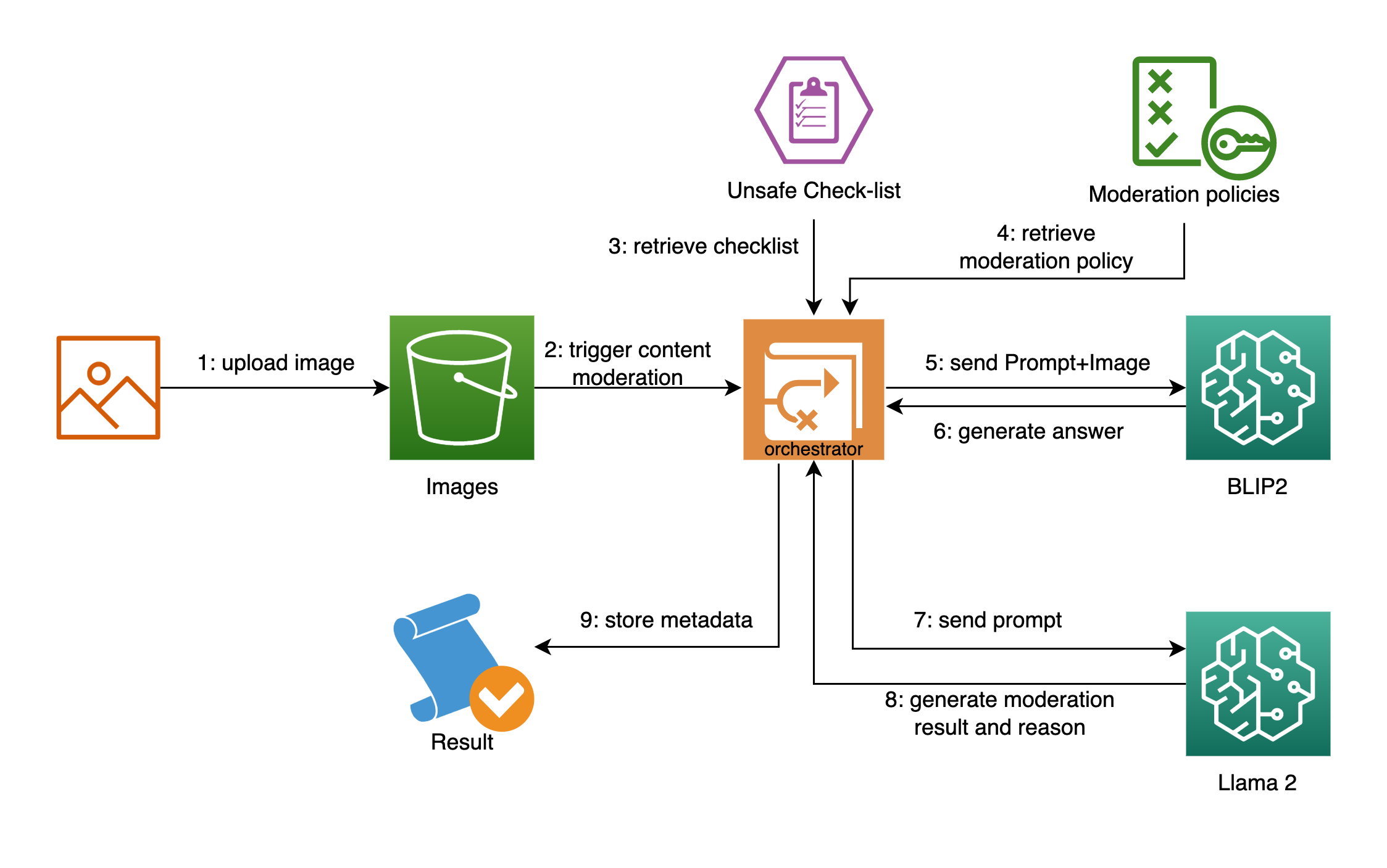

Usiamo BLIP-2 come metodo di pre-formazione multimodale. BLIP-2 è uno dei modelli all'avanguardia nel pre-addestramento multimodale e supera la maggior parte dei metodi esistenti nella risposta visiva alle domande, nella didascalia delle immagini e nel recupero del testo delle immagini. Per il nostro LLM, utilizziamo lama 2, il LLM open source di nuova generazione, che supera i modelli linguistici open source esistenti su molti parametri di riferimento, inclusi test di ragionamento, codifica, competenza e conoscenza. Il diagramma seguente illustra i componenti della soluzione.

Sfide nella moderazione dei contenuti

I metodi tradizionali di moderazione dei contenuti, come la moderazione basata sull'uomo, non riescono a tenere il passo con il volume crescente di contenuti generati dagli utenti (UGC). Con l’aumento del volume degli UGC, i moderatori umani possono sentirsi sopraffatti e avere difficoltà a moderare i contenuti in modo efficace. Ciò si traduce in un'esperienza utente scadente, costi di moderazione elevati e rischio per il marchio. La moderazione basata sull’uomo è anche soggetta a errori, che possono portare a una moderazione incoerente e a decisioni distorte. Per affrontare queste sfide, la soluzione è emersa come moderazione dei contenuti basata sull’apprendimento automatico (ML). Gli algoritmi ML possono analizzare grandi volumi di UGC e identificare i contenuti che violano le policy dell'organizzazione. I modelli ML possono essere addestrati a riconoscere modelli e identificare contenuti problematici, come incitamento all'odio, spam e materiale inappropriato. Secondo lo studio Proteggi i tuoi utenti, il tuo brand e il tuo budget con la moderazione dei contenuti basata sull'intelligenza artificiale, la moderazione dei contenuti basata sul machine learning può aiutare le organizzazioni a recuperare fino al 95% del tempo che i team dedicano alla moderazione manuale dei contenuti. Ciò consente alle organizzazioni di concentrare le proprie risorse su compiti più strategici, come la costruzione di comunità e la creazione di contenuti. La moderazione dei contenuti basata sul machine learning può anche ridurre i costi di moderazione perché è più efficiente della moderazione basata sull'uomo.

Nonostante i vantaggi della moderazione dei contenuti basata sul machine learning, c’è ancora spazio per ulteriori miglioramenti. L'efficacia degli algoritmi ML dipende in larga misura dalla qualità dei dati su cui vengono addestrati. Quando i modelli vengono addestrati utilizzando dati distorti o incompleti, possono prendere decisioni di moderazione errate, esponendo le organizzazioni a rischi per il marchio e potenziali responsabilità legali. L’adozione di approcci basati sul machine learning per la moderazione dei contenuti comporta diverse sfide che richiedono un’attenta considerazione. Queste sfide includono:

- Acquisizione di dati etichettati – Questo può essere un processo costoso, soprattutto per attività complesse di moderazione dei contenuti che richiedono la formazione degli etichettatori. Questo costo può rendere difficile la raccolta di set di dati sufficientemente grandi per addestrare facilmente un modello ML supervisionato. Inoltre, l’accuratezza del modello dipende in larga misura dalla qualità dei dati di addestramento e dati distorti o incompleti possono portare a decisioni di moderazione imprecise, con conseguenti rischi per il marchio e responsabilità legali.

- Generalizzazione del modello – Questo è fondamentale per l’adozione di approcci basati sul ML. Un modello addestrato su un set di dati potrebbe non generalizzarsi bene a un altro set di dati, in particolare se i set di dati hanno distribuzioni diverse. Pertanto, è essenziale garantire che il modello sia addestrato su un set di dati diversificato e rappresentativo per garantire che si generalizzi bene ai nuovi dati.

- Efficienza operativa – Questa è un’altra sfida quando si utilizzano approcci convenzionali basati sul ML per la moderazione dei contenuti. Aggiungere costantemente nuove etichette e riqualificare il modello quando vengono aggiunte nuove classi può richiedere molto tempo e denaro. Inoltre, è essenziale garantire che il modello venga aggiornato regolarmente per tenere il passo con i cambiamenti nei contenuti moderati.

- Spiegabilità – Gli utenti finali potrebbero percepire la piattaforma come parziale o ingiusta se i contenuti vengono contrassegnati o rimossi senza giustificazione, con conseguente esperienza utente scadente. Allo stesso modo, l’assenza di spiegazioni chiare può rendere il processo di moderazione dei contenuti inefficiente, dispendioso in termini di tempo e costoso per i moderatori.

- Natura contraddittoria – La natura contraddittoria della moderazione dei contenuti basata su immagini rappresenta una sfida unica per gli approcci convenzionali basati sul ML. I malintenzionati possono tentare di eludere i meccanismi di moderazione dei contenuti alterando il contenuto in vari modi, ad esempio utilizzando sinonimi di immagini o incorporando il contenuto effettivo all'interno di un corpo più ampio di contenuti non offensivi. Ciò richiede un monitoraggio e un aggiornamento costanti del modello per rilevare e rispondere a tali tattiche contraddittorie.

Ragionamento multimodale con BLIP-2

I modelli ML multimodalità si riferiscono a modelli in grado di gestire e integrare dati provenienti da più fonti o modalità, come immagini, testo, audio, video e altre forme di dati strutturati o non strutturati. Uno dei modelli multimodali più popolari sono i modelli del linguaggio visivo come BLIP-2, che combina la visione artificiale e l’elaborazione del linguaggio naturale (PNL) per comprendere e generare informazioni sia visive che testuali. Questi modelli consentono ai computer di interpretare il significato di immagini e testo in un modo che imita la comprensione umana. I modelli del linguaggio visivo possono affrontare una varietà di compiti, tra cui la didascalia delle immagini, il recupero del testo delle immagini, la risposta visiva alle domande e altro ancora. Ad esempio, un modello di didascalia delle immagini può generare una descrizione in linguaggio naturale di un'immagine e un modello di recupero del testo dell'immagine può cercare immagini in base a una query di testo. I modelli di risposta visiva alle domande possono rispondere a domande in linguaggio naturale sulle immagini e i chatbot multimodali possono utilizzare input visivi e testuali per generare risposte. In termini di moderazione dei contenuti, puoi utilizzare questa funzionalità per eseguire query su un elenco di domande.

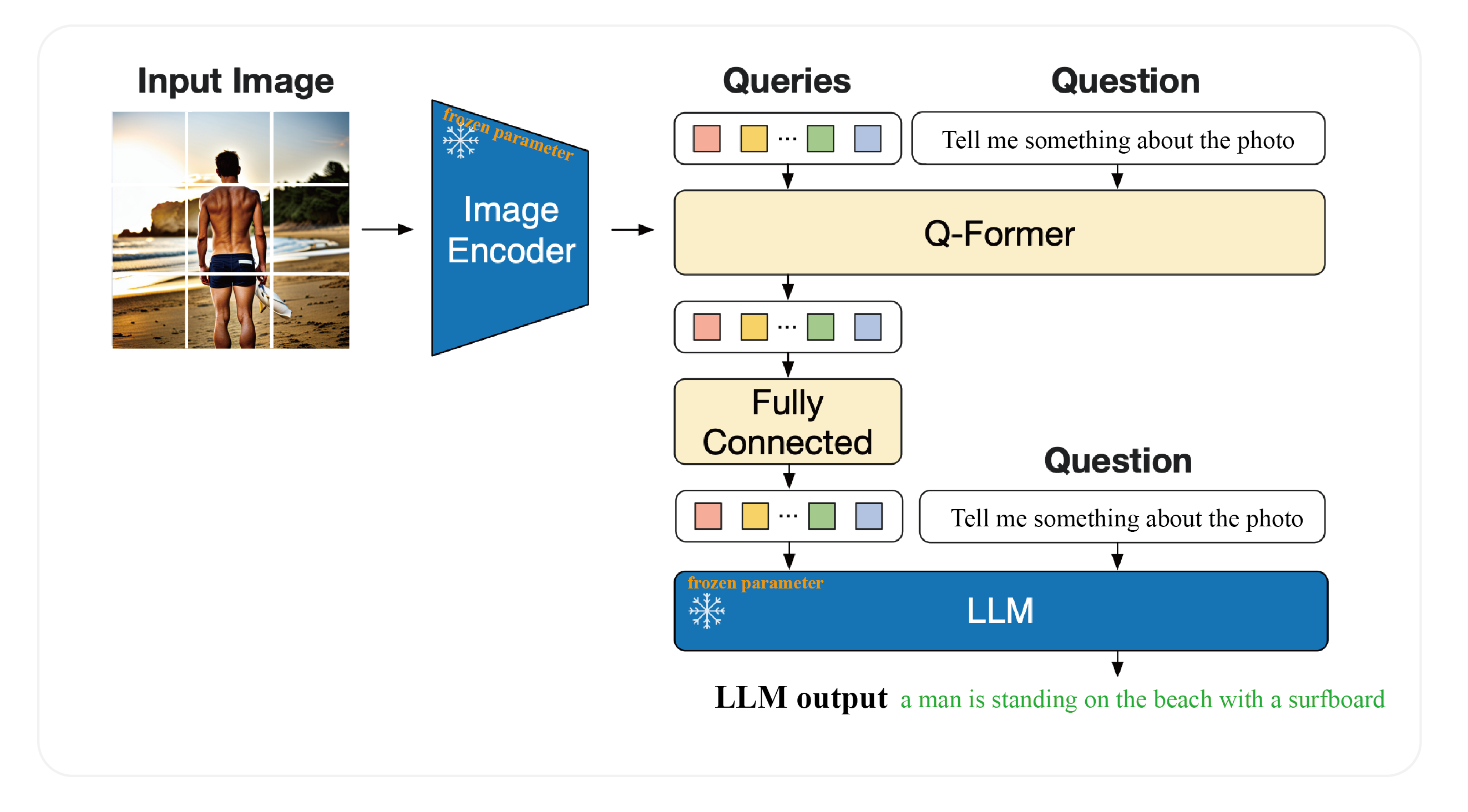

BLIP-2 contiene tre parti. Il primo componente è un codificatore di immagini congelate, ViT-L/14 di CLIP, che prende i dati dell'immagine come input. Il secondo componente è un LLM congelato, FlanT5, che emette testo. Il terzo componente è un modulo addestrabile chiamato Q-Former, un trasformatore leggero che collega il codificatore di immagini congelate con l'LLM congelato. Q-Former utilizza vettori di query apprendibili per estrarre funzionalità visive dal codificatore di immagini congelate e fornisce la funzionalità visiva più utile a LLM per produrre il testo desiderato.

Il processo di pre-formazione prevede due fasi. Nella prima fase, viene eseguito l'apprendimento della rappresentazione visiva-linguaggio per insegnare a Q-Former ad apprendere la rappresentazione visiva più rilevante per il testo. Nella seconda fase, l'apprendimento generativo visione-linguaggio viene eseguito collegando l'output di Q-Former a un LLM congelato e addestrando Q-Former a produrre rappresentazioni visive che possono essere interpretate dal LLM.

BLIP-2 raggiunge prestazioni all'avanguardia su vari compiti di linguaggio visivo nonostante abbia un numero significativamente inferiore di parametri addestrabili rispetto ai metodi esistenti. Il modello dimostra anche le capacità emergenti di generazione zero-shot di immagini in testo in grado di seguire le istruzioni del linguaggio naturale. La seguente illustrazione è modificata rispetto a documento di ricerca originale.

Panoramica della soluzione

Il diagramma seguente illustra l'architettura della soluzione.

Nelle sezioni seguenti, dimostriamo come distribuire BLIP-2 su un file Amazon Sage Maker endpoint e utilizzare BLIP-2 e un LLM per la moderazione dei contenuti.

Prerequisiti

Hai bisogno di un account AWS con un Gestione dell'identità e dell'accesso di AWS (IAM) ruolo con autorizzazioni per gestire le risorse create come parte della soluzione. Per i dettagli, fare riferimento a Crea un account AWS autonomo.

Se è la prima volta che lavori con Amazon Sage Maker Studio, devi prima creare un file dominio SageMaker. Inoltre, potrebbe essere necessario richiedere un aumento della quota del servizio per le istanze di hosting SageMaker corrispondenti. Per il modello BLIP-2, utilizziamo un ml.g5.2xlarge Istanza di hosting SageMaker. Per il modello Llama 2 13B utilizziamo un ml.g5.12xlarge Istanza di hosting SageMaker.

Distribuisci BLIP-2 su un endpoint SageMaker

Puoi ospitare un LLM su SageMaker utilizzando il file Inferenza di modelli di grandi dimensioni (LMI) contenitore ottimizzato per ospitare modelli di grandi dimensioni utilizzando DJLServing. DJLServing è una soluzione di modelserving universale ad alte prestazioni basata sulla Deep Java Library (DJL) indipendente dal linguaggio di programmazione. Per ulteriori informazioni su DJL e DJLServing, fare riferimento a Distribuisci modelli di grandi dimensioni su Amazon SageMaker utilizzando DJLServing e l'inferenza parallela del modello DeepSpeed. Con l'aiuto del contenitore LMI SageMaker, il modello BLIP-2 può essere facilmente implementato con la libreria Hugging Face e ospitato su SageMaker. Puoi correre blip2-sagemaker.ipynb per questo passaggio.

Per preparare l'immagine Docker e il file del modello, è necessario recuperare l'immagine Docker di DJLServing, impacchettare lo script di inferenza e i file di configurazione come file model.tar.gz file e caricarlo su un file Servizio di archiviazione semplice Amazon (Amazon S3) secchio. Puoi fare riferimento a script di inferenza e file di configurazione per ulteriori dettagli.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Quando l'immagine Docker e i file correlati all'inferenza sono pronti, crei il modello, la configurazione per l'endpoint e l'endpoint:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Quando lo stato dell'endpoint diventa in servizio, è possibile richiamare l'endpoint per i sottotitoli delle immagini e l'attività di generazione visione-linguaggio zero-shot istruita. Per l'attività di didascalia delle immagini, devi solo passare un'immagine all'endpoint:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)Per l'attività di generazione visione-linguaggio zero-shot istruita, oltre all'immagine di input, è necessario definire la domanda come prompt:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Utilizza BLIP-2 e LLM per la moderazione dei contenuti

In questa fase, puoi effettuare query sull'immagine specificata e recuperare informazioni nascoste. Con LLM, organizzi le query e recuperi le informazioni per generare il risultato in formato JSON. Puoi suddividere approssimativamente questa attività nelle seguenti due attività secondarie:

- Estrai informazioni dall'immagine con il modello BLIP-2.

- Genera il risultato finale e la spiegazione con il LLM.

Estrai informazioni dall'immagine con il modello BLIP-2

Per recuperare informazioni nascoste abbastanza utili dall'immagine specificata, è necessario definire le query. Poiché ogni query richiamerà l'endpoint una volta, molte query comporteranno tempi di elaborazione più lunghi. Pertanto, suggeriamo di effettuare query di alta qualità e coprire tutte le politiche ma anche senza duplicazioni. Nel nostro codice di esempio, definiamo le query come segue:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]Con le query precedenti, invoca l'endpoint di BLIP-2 per recuperare le informazioni con il seguente codice:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """Oltre alle informazioni recuperate dalle query, è possibile ottenere informazioni con l'attività di didascalia delle immagini richiamando l'endpoint senza prompt campo nel payload:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')È possibile combinare il contenuto delle domande e delle risposte con la didascalia dell'immagine e utilizzare queste informazioni recuperate per l'attività downstream, descritta nella sezione successiva di seguito.

Genera il risultato finale e la spiegazione con il LLM

I modelli linguistici di grandi dimensioni (LLM) come Llama 2 possono generare risultati di alta qualità con il modello di prompt giusto. Utilizzando JumpStart di Amazon SageMaker, i professionisti del machine learning possono scegliere tra un'ampia selezione di modelli di base disponibili al pubblico. Con pochi clic in SageMaker Studio, ora puoi scopri e distribuisci Llama 2.

I risultati finali si basano su un LLM con un modello di prompt specifico. Tale suggerimento consiste: nella politica di moderazione basata su categorie di inappropriato o offensivo categorie di moderazione; informazioni sull'immagine estratte da BLIP-2; il modello di domanda al LLM che chiede se la foto contiene contenuti non sicuri e ne richiede la categoria e il motivo se non sicuri; e istruzioni per produrre i risultati in formato JSON. Il modello di richiesta progettato consente a LLM di determinare se l'immagine viola la politica di moderazione, identificare la categoria di violazione, spiegare il motivo e fornire l'output in un formato JSON strutturato.

Il codice sorgente principale è il seguente:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]È possibile personalizzare il prompt in base al proprio caso d'uso. Fare riferimento al taccuino per ulteriori dettagli. Quando il prompt è pronto, puoi richiamare l'endpoint LLM per generare risultati:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]Parte dell'output generato è il seguente:

Occasionalmente, Llama 2 allega ulteriori spiegazioni oltre alla risposta dell'assistente. Potresti utilizzare il codice di analisi per estrarre i dati JSON dai risultati generati originali:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Vantaggi degli approcci generativi

Le sezioni precedenti hanno mostrato come implementare la parte centrale dell'inferenza del modello. In questa sezione trattiamo vari aspetti degli approcci generativi, compresi i confronti con approcci e prospettive convenzionali.

La tabella seguente mette a confronto ciascun approccio.

| . | Approccio generativo | Approccio di classificazione |

| Acquisizione di dati etichettati | Modello pre-addestrato su un gran numero di immagini, inferenza zero-shot | Richiede dati da tutti i tipi di categorie |

| Generalizzazione del modello | Modello pre-addestrato con vari tipi di immagini | Richiede un grande volume di dati relativi alla moderazione dei contenuti per migliorare la generalizzazione del modello |

| Efficienza operativa | Capacità di tiro zero | Richiede l'addestramento del modello per il riconoscimento di modelli diversi e la riqualificazione quando vengono aggiunte le etichette |

| Spiegabilità | Ragionamento come output del testo, ottima esperienza utente | Difficile raggiungere un ragionamento, difficile da spiegare e interpretare |

| Natura contraddittoria | Robusto | Riqualificazione ad alta frequenza |

Potenziali casi d'uso del ragionamento multimodale oltre la moderazione dei contenuti

I modelli BLIP-2 possono essere applicati per adattarsi a molteplici scopi con o senza messa a punto, che include quanto segue:

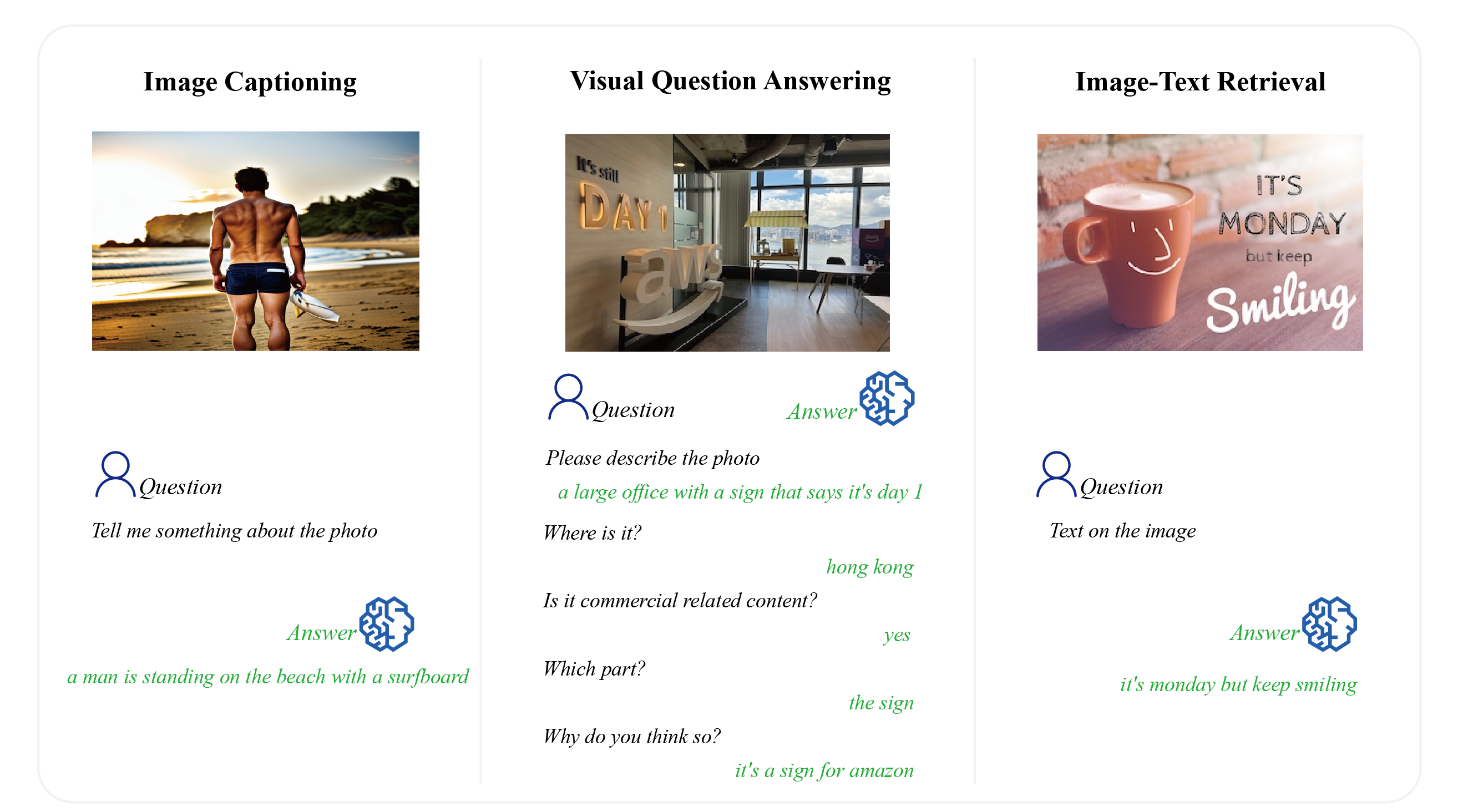

- Didascalie delle immagini – Ciò richiede al modello di generare una descrizione testuale per il contenuto visivo dell'immagine. Come illustrato nella seguente immagine di esempio (a sinistra), possiamo avere “un uomo è in piedi sulla spiaggia con una tavola da surf” come descrizione dell'immagine.

- Risposta visiva alla domanda – Come mostra l’immagine di esempio al centro, possiamo chiedere "Si tratta di contenuti commerciali" e noi abbiamo "sì" come risposta. Inoltre, BLIP-2 supporta la conversazione a più round e restituisce la seguente domanda: "Perchè la pensi così?" Sulla base del segnale visivo e delle funzionalità LLM, gli output BLIP-2 "è un segno per Amazon."

- Recupero del testo dell'immagine – Data la domanda come “Testo sull'immagine”, possiamo estrarre il testo dell'immagine “è lunedì ma continua a sorridere” come dimostrato nell'immagine a destra.

Le immagini seguenti mostrano esempi per dimostrare la capacità zero-shot da immagine a testo del ragionamento basato sulla conoscenza visiva.

Come possiamo vedere dai vari esempi sopra riportati, i modelli multimodali aprono nuove opportunità per risolvere problemi complessi che i tradizionali modelli monomodali faticherebbero ad affrontare.

ripulire

Per evitare di incorrere in addebiti futuri, elimina le risorse create come parte di questo post. Puoi farlo seguendo le istruzioni nella sezione di pulizia del notebook o eliminando gli endpoint creati tramite la console SageMaker e le risorse archiviate nel bucket S3.

Conclusione

In questo post abbiamo discusso dell'importanza della moderazione dei contenuti nel mondo digitale e ne abbiamo evidenziato le sfide. Abbiamo proposto un nuovo metodo per migliorare la moderazione dei contenuti con i dati delle immagini ed eseguire risposte alle domande sulle immagini per estrarre automaticamente informazioni utili. Abbiamo inoltre fornito un'ulteriore discussione sui vantaggi derivanti dall'utilizzo di un approccio generativo basato sull'intelligenza artificiale rispetto al tradizionale approccio basato sulla classificazione. Infine, abbiamo illustrato i potenziali casi d’uso dei modelli di linguaggio visivo oltre la moderazione dei contenuti.

Ti invitiamo a saperne di più esplorando SageMaker e creando una soluzione utilizzando la soluzione multimodale fornita in questo post e un set di dati pertinente alla tua attività.

Informazioni sugli autori

Gordon Wang è un TAM specialista AI/ML senior presso AWS. Supporta i clienti strategici con le migliori pratiche AI/ML in molti settori. È appassionato di visione artificiale, PNL, intelligenza artificiale generativa e MLOps. Nel tempo libero ama correre e fare escursioni.

Gordon Wang è un TAM specialista AI/ML senior presso AWS. Supporta i clienti strategici con le migliori pratiche AI/ML in molti settori. È appassionato di visione artificiale, PNL, intelligenza artificiale generativa e MLOps. Nel tempo libero ama correre e fare escursioni.

Yanwei Cui, PhD, è un Senior Machine Learning Specialist Solutions Architect presso AWS. Ha iniziato la ricerca sull'apprendimento automatico presso l'IRISA (Istituto di ricerca di informatica e sistemi casuali) e ha diversi anni di esperienza nella creazione di applicazioni industriali basate sull'intelligenza artificiale nella visione artificiale, nell'elaborazione del linguaggio naturale e nella previsione del comportamento degli utenti online. In AWS, condivide la sua esperienza nel settore e aiuta i clienti a sbloccare potenziali aziendali e ottenere risultati attuabili con l'apprendimento automatico su larga scala. Al di fuori del lavoro, gli piace leggere e viaggiare.

Yanwei Cui, PhD, è un Senior Machine Learning Specialist Solutions Architect presso AWS. Ha iniziato la ricerca sull'apprendimento automatico presso l'IRISA (Istituto di ricerca di informatica e sistemi casuali) e ha diversi anni di esperienza nella creazione di applicazioni industriali basate sull'intelligenza artificiale nella visione artificiale, nell'elaborazione del linguaggio naturale e nella previsione del comportamento degli utenti online. In AWS, condivide la sua esperienza nel settore e aiuta i clienti a sbloccare potenziali aziendali e ottenere risultati attuabili con l'apprendimento automatico su larga scala. Al di fuori del lavoro, gli piace leggere e viaggiare.

Melania Li, PhD, è Senior AI/ML Specialist TAM presso AWS con sede a Sydney, in Australia. Aiuta i clienti aziendali a creare soluzioni utilizzando strumenti AI/ML all'avanguardia su AWS e fornisce indicazioni sull'architettura e l'implementazione di soluzioni ML con le best practice. Nel tempo libero ama esplorare la natura e trascorrere del tempo con la famiglia e gli amici.

Melania Li, PhD, è Senior AI/ML Specialist TAM presso AWS con sede a Sydney, in Australia. Aiuta i clienti aziendali a creare soluzioni utilizzando strumenti AI/ML all'avanguardia su AWS e fornisce indicazioni sull'architettura e l'implementazione di soluzioni ML con le best practice. Nel tempo libero ama esplorare la natura e trascorrere del tempo con la famiglia e gli amici.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- capace

- WRI

- sopra

- accesso

- Secondo

- Il mio account

- precisione

- Raggiungere

- Realizza

- attori

- presenti

- aggiunto

- l'aggiunta di

- aggiunta

- aggiuntivo

- Inoltre

- indirizzo

- aderendo

- Adottando

- Adozione

- vantaggi

- contraddittorio

- gli inserzionisti

- Pubblicità

- contro

- AI

- AI-alimentato

- AI / ML

- Algoritmi

- allineamento

- Tutti

- consente

- anche

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- an

- analizzare

- ed

- Un altro

- rispondere

- risposte

- in qualsiasi

- applicazioni

- applicato

- approccio

- approcci

- opportuno

- architettura

- SONO

- AS

- chiedere

- aspetti

- Assistant

- associazioni

- assume

- At

- Audio

- Australia

- automaticamente

- disponibile

- evitare

- AWS

- Vasca

- basato

- BE

- Beach

- perché

- diventare

- diventa

- comportamento

- essendo

- sotto

- parametri di riferimento

- oltre a

- MIGLIORE

- best practice

- Al di là di

- parziale

- sangue

- stile di vita

- entrambi

- marca

- marche

- Porta

- ampio

- budget limitato.

- costruire

- Costruzione

- affari

- ma

- by

- detto

- Materiale

- Può ottenere

- funzionalità

- capacità

- attento

- Custodie

- casi

- categoria

- Categoria

- Challenge

- sfide

- impegnativo

- Modifiche

- oneri

- chatbots

- Scegli

- classi

- pulire campo

- cliente

- vestiti

- codice

- codifica

- combinare

- combina

- comunità

- costruzione della comunità

- azienda

- rispetto

- completamento di una

- complesso

- componente

- componenti

- computer

- Informatica

- Visione computerizzata

- computer

- Configurazione

- Confermare

- Collegamento

- collega

- considerazione

- considerato

- consiste

- consolle

- costante

- costantemente

- contatti

- contenere

- Contenitore

- contiene

- contenuto

- creazione di contenuti

- testuali

- contribuendo

- convenzionale

- Conversazione

- Conversazioni

- Nucleo

- Corrispondente

- Costo

- costoso

- Costi

- potuto

- coprire

- creare

- creato

- creazione

- critico

- Cross

- Clienti

- personalizzare

- dati

- la sicurezza dei dati

- dataset

- decisione

- decisioni

- deep

- definire

- definito

- dimostrare

- dimostrato

- dimostra

- schierare

- descritta

- descrizione

- progettato

- progettazione

- desiderato

- Nonostante

- dettagli

- individuare

- Determinare

- dialogo

- diverso

- digitale

- mondo digitale

- direttamente

- discusso

- discussione

- distribuzioni

- paesaggio differenziato

- do

- docker

- effettua

- dominio

- guidare

- ogni

- alleviare

- facilmente

- in maniera efficace

- efficacia

- efficiente

- incorporamento

- emerse

- emergenti del mondo

- impiega

- enable

- Abilita

- incoraggiare

- fine

- endpoint

- Migliora

- abbastanza

- garantire

- assicurando

- Impresa

- errori

- particolarmente

- essential

- esempio

- Esempi

- esistente

- esperienza

- competenza

- Spiegare

- spiegazione

- esplora

- Esplorare

- Esposizione

- esterno

- estratto

- Faccia

- cadute

- famiglia

- caratteristica

- Caratteristiche

- la donna

- pochi

- meno

- campo

- lotta

- Compila il

- File

- finale

- finanziare

- Nome

- prima volta

- in forma

- contrassegnato

- Focus

- seguire

- i seguenti

- segue

- Nel

- formato

- forme

- Fondazione

- Frequenza

- amici

- da

- congelati

- funzioni

- ulteriormente

- futuro

- raccogliere

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- Dare

- dato

- grande

- Crescita

- Crescita

- guida

- maniglia

- successo

- Hard

- Avere

- avendo

- he

- Salute e benessere

- informazioni sulla salute

- assistenza sanitaria

- pesantemente

- Aiuto

- aiuta

- suo

- nascosto

- Alta

- Alte prestazioni

- alta qualità

- Evidenziato

- il suo

- host

- ospitato

- di hosting

- Come

- Tutorial

- HTML

- http

- HTTPS

- umano

- identificare

- identificazione

- Identità

- if

- illustra

- Immagine

- immagini

- realizzare

- implementato

- Implementazione

- importare

- importanza

- importante

- competenze

- miglioramento

- in

- impreciso

- includere

- inclusi

- Compreso

- Aumento

- Aumenta

- industriale

- industrie

- industria

- inefficiente

- informazioni

- ingresso

- Ingressi

- esempio

- Istituto

- istruzioni

- integrare

- interesse

- interno

- ai miglioramenti

- introdurre

- IT

- SUO

- Java

- jpg

- json

- ad appena

- mantenere

- conoscenze

- per il tuo brand

- Lingua

- grandi

- superiore, se assunto singolarmente.

- portare

- principale

- IMPARARE

- apprendimento

- a sinistra

- Legale

- passivo

- Biblioteca

- leggero

- Lista

- Lama

- LLM

- più a lungo

- ama

- macchina

- machine learning

- Mantenere

- make

- Fare

- uomo

- gestire

- manualmente

- molti

- materiale

- Maggio..

- me

- significato

- meccanismi di

- Media

- Meta

- metodo

- metodi

- In mezzo

- ML

- MLOp

- modello

- modelli

- moderazione

- modificato

- Moduli

- Lunedì

- monitoraggio

- Scopri di più

- più efficiente

- maggior parte

- multiplo

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Bisogno

- negativo.

- New

- GENERAZIONE

- nlp

- taccuino

- romanzo

- adesso

- numero

- of

- offensivo

- on

- una volta

- ONE

- online

- esclusivamente

- aprire

- open source

- Opportunità

- ottimizzati

- or

- organizzazioni

- i

- Altro

- nostro

- Azienda

- risultati

- Sorpassa

- produzione

- al di fuori

- sopraffatti

- proprio

- pacchetto

- Parallel

- parametri

- parte

- particolarmente

- Ricambi

- passare

- appassionato

- modelli

- Eseguire

- performance

- eseguita

- permessi

- persona

- cronologia

- persone

- prospettive

- phd

- foto

- centrale

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- per favore

- Termini e Condizioni

- politica

- povero

- Popolare

- Post

- potenziale

- potenziali

- alimentato

- potente

- pratiche

- predizione

- Preparare

- presents

- conservazione

- impedisce

- Dare priorità

- Privacy

- problemi

- processi

- lavorazione

- Programmazione

- proposto

- protezione

- fornire

- purché

- fornisce

- la percezione

- pubblicità

- pubblicamente

- fini

- metti

- Domande e risposte

- qualità

- query

- domanda

- Domande

- casuale

- Lettura

- pronto

- ragione

- riconoscere

- riconoscendo

- ridurre

- regolarmente

- normativa

- relazionato

- pertinente

- fare affidamento

- rimosso

- rappresentazione

- rappresentante

- reputazione

- richiesta

- richiedere

- richiede

- riparazioni

- Risorse

- Rispondere

- risposta

- risposte

- colpevole

- risultante

- Risultati

- ritorno

- rivelando

- Le vendite

- la crescita dei ricavi

- RGB

- destra

- Rischio

- rischi

- Ruolo

- approssimativamente

- Regola

- Correre

- running

- s

- salvaguardare

- Sicurezza

- sagemaker

- Scala

- Scienze

- Cerca

- Secondo

- Sezione

- sezioni

- Settori

- problemi di

- vedere

- prodotti

- anziano

- delicata

- serve

- servizio

- Servizi

- servizio

- set

- alcuni

- Sessuale

- azioni

- compartecipazione

- lei

- Scudo

- mostrare attraverso le sue creazioni

- ha mostrato

- Spettacoli

- segno

- significato

- significativamente

- Allo stesso modo

- Un'espansione

- situazioni

- So

- Social

- Social Media

- piattaforme di social media

- soluzione

- Soluzioni

- Soluzione

- Fonte

- codice sorgente

- fonti

- lo spazio

- spazi

- carne in scatola

- specialista

- specifico

- discorso

- spendere

- dividere

- Stage

- tappe

- standalone

- standard

- iniziato

- state-of-the-art

- stati

- Stato dei servizi

- step

- Ancora

- conservazione

- memorizzati

- Strategico

- strutturato

- Lotta

- studio

- Studio

- tale

- suggerire

- supporti

- sydney

- SISTEMI DI TRATTAMENTO

- tavolo

- attrezzatura

- tattica

- prende

- Task

- task

- le squadre

- dire

- modello

- condizioni

- testo

- testuale

- di

- che

- Il

- le informazioni

- loro

- Là.

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- think

- Terza

- questo

- tre

- tempo

- richiede tempo

- a

- strumenti

- tradizionale

- Treni

- allenato

- Training

- trasformatore

- Di viaggio

- seconda

- Digitare

- Tipi di

- per

- capire

- e una comprensione reciproca

- unico

- universale

- sbloccare

- aggiornato

- aggiornamento

- sostenere

- caricato

- uso

- caso d'uso

- Utente

- Esperienza da Utente

- privacy dell'utente

- utenti

- utilizzando

- Valori

- varietà

- vario

- via

- Video

- VIOLAZIONE

- visione

- volume

- volumi

- Modo..

- modi

- we

- sito web

- servizi web

- siti web

- WELL

- Che

- quando

- quale

- perché

- volere

- con

- entro

- senza

- parole

- Lavora

- lavoro

- mondo

- sarebbe

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro