I moderni chatbot possono fungere da agenti digitali, fornendo una nuova strada per fornire assistenza e supporto clienti 24 ore su 7, XNUMX giorni su XNUMX, in molti settori. La loro popolarità deriva dalla capacità di rispondere alle richieste dei clienti in tempo reale e di gestire più richieste contemporaneamente in diverse lingue. I chatbot offrono inoltre preziose informazioni basate sui dati sul comportamento dei clienti e si adattano facilmente man mano che la base utenti cresce; pertanto, presentano una soluzione economicamente vantaggiosa per coinvolgere i clienti. I chatbot utilizzano le funzionalità avanzate del linguaggio naturale dei modelli linguistici di grandi dimensioni (LLM) per rispondere alle domande dei clienti. Possono comprendere il linguaggio colloquiale e rispondere in modo naturale. Tuttavia, i chatbot che si limitano a rispondere a domande di base hanno un’utilità limitata. Per diventare consulenti fidati, i chatbot devono fornire risposte ponderate e personalizzate.

Un modo per consentire conversazioni più contestuali è collegare il chatbot a basi di conoscenza e sistemi informativi interni. L'integrazione di dati aziendali proprietari provenienti da basi di conoscenza interne consente ai chatbot di contestualizzare le proprie risposte alle esigenze e agli interessi individuali di ciascun utente. Ad esempio, un chatbot potrebbe suggerire prodotti che corrispondono alle preferenze di un acquirente e agli acquisti passati, spiegare i dettagli in un linguaggio adattato al livello di competenza dell'utente o fornire supporto all'account accedendo ai record specifici del cliente. La capacità di incorporare in modo intelligente informazioni, comprendere il linguaggio naturale e fornire risposte personalizzate in un flusso di conversazione consente ai chatbot di offrire un reale valore aziendale in diversi casi d'uso.

Il modello di architettura popolare di Recupero generazione aumentata (RAG) viene spesso utilizzato per aumentare il contesto e le risposte delle query dell'utente. RAG combina le capacità dei LLM con la conoscenza dei fatti e del mondo reale che deriva dal recupero di testi e passaggi rilevanti dal corpus di dati. Questi testi recuperati vengono quindi utilizzati per informare e radicare l'output, riducendo le allucinazioni e migliorando la pertinenza.

In questo post, illustriamo contestualmente il miglioramento di un chatbot utilizzando Basi di conoscenza per Amazon Bedrock, un servizio serverless completamente gestito. L'integrazione delle Knowledge Base per Amazon Bedrock consente al nostro chatbot di fornire risposte più pertinenti e personalizzate collegando le query degli utenti ai punti dati delle informazioni correlate. Internamente, Roccia Amazzonica utilizza incorporamenti archiviati in un database vettoriale per aumentare il contesto delle query dell'utente in fase di esecuzione e abilitare una soluzione di architettura RAG gestita. Noi usiamo il Lettere di Amazon agli azionisti set di dati per sviluppare questa soluzione.

Recupero generazione aumentata

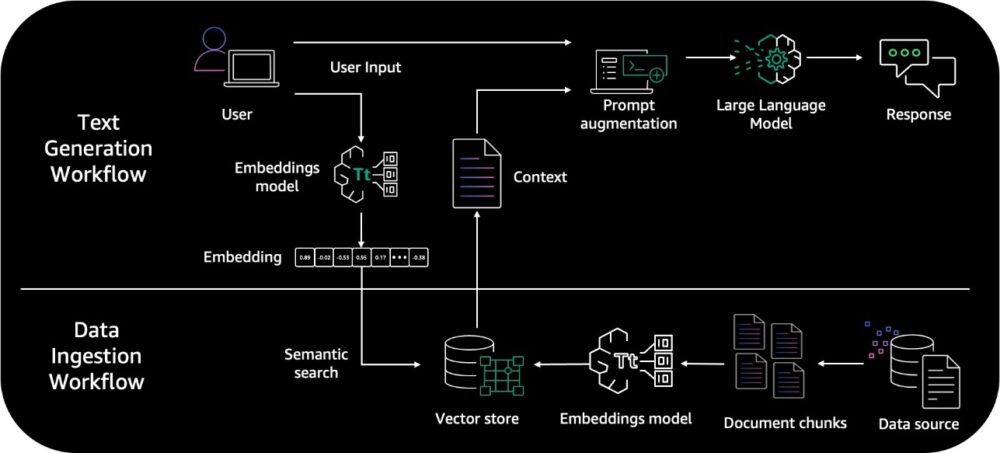

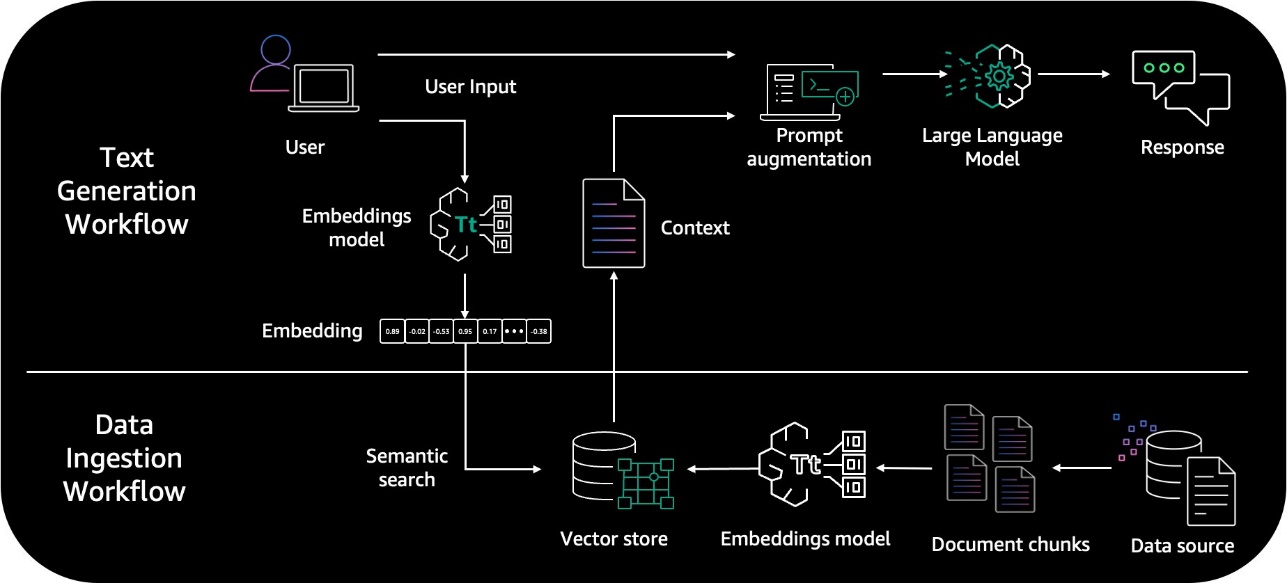

RAG è un approccio alla generazione del linguaggio naturale che incorpora il recupero delle informazioni nel processo di generazione. L'architettura RAG prevede due flussi di lavoro chiave: preelaborazione dei dati tramite l'acquisizione e generazione di testo utilizzando un contesto avanzato.

Il flusso di lavoro di inserimento dati utilizza LLM per creare vettori di incorporamento che rappresentano il significato semantico dei testi. Vengono creati incorporamenti per documenti e domande degli utenti. Gli incorporamenti del documento vengono suddivisi in blocchi e archiviati come indici in un database vettoriale. Il flusso di lavoro di generazione del testo prende quindi il vettore di incorporamento di una domanda e lo utilizza per recuperare i blocchi di documento più simili in base alla somiglianza del vettore. Aumenta le richieste con questi blocchi rilevanti per generare una risposta utilizzando LLM. Per maggiori dettagli fare riferimento al Primer sul recupero di generazione aumentata, incorporamenti e database vettoriali sezione in Anteprima: collega i Foundation Model alle origini dati della tua azienda con gli agenti per Amazon Bedrock.

Il diagramma seguente illustra l'architettura RAG di alto livello.

Sebbene l'architettura RAG presenti molti vantaggi, coinvolge più componenti, tra cui un database, un meccanismo di recupero, un prompt e un modello generativo. La gestione di queste parti interdipendenti può introdurre complessità nello sviluppo e nell'implementazione del sistema. L'integrazione del recupero e della generazione richiede inoltre ulteriori sforzi ingegneristici e risorse computazionali. Alcune librerie open source forniscono wrapper per ridurre questo sovraccarico; tuttavia, le modifiche alle librerie possono introdurre errori e aggiungere ulteriore sovraccarico al controllo delle versioni. Anche con le librerie open source, è necessario uno sforzo significativo per scrivere codice, determinare la dimensione ottimale dei blocchi, generare incorporamenti e altro ancora. Solo questo lavoro di configurazione può richiedere settimane a seconda del volume di dati.

Pertanto, una soluzione gestita in grado di gestire queste attività indifferenziate potrebbe semplificare e accelerare il processo di implementazione e gestione delle applicazioni RAG.

Basi di conoscenza per Amazon Bedrock

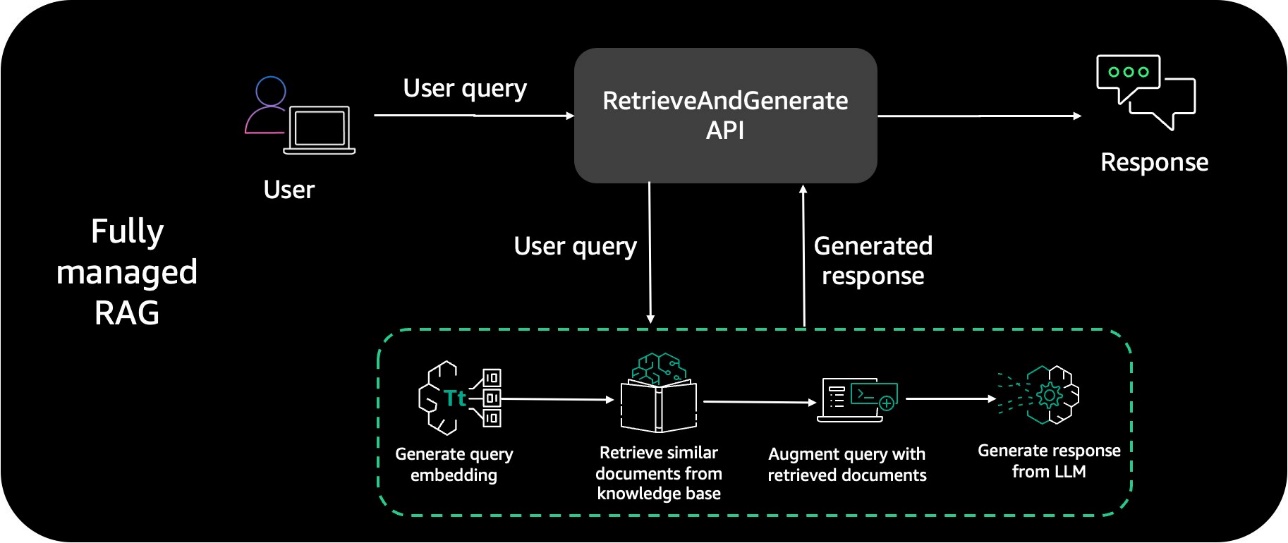

Knowledge Base per Amazon Bedrock è un'opzione serverless per creare potenti sistemi di intelligenza artificiale conversazionale utilizzando RAG. Offre flussi di lavoro di acquisizione dati e generazione di testo completamente gestiti.

Per l'inserimento dei dati, gestisce automaticamente la creazione, l'archiviazione, la gestione e l'aggiornamento degli incorporamenti di testo dei dati del documento nel database vettoriale. Suddivide i documenti in blocchi gestibili per un recupero efficiente. I blocchi vengono quindi convertiti in incorporamenti e scritti in un indice vettoriale, consentendo al tempo stesso di vedere i documenti di origine quando si risponde a una domanda.

Per la generazione di testo, Amazon Bedrock fornisce il file Recupera e genera API per creare incorporamenti di query utente e recuperare blocchi rilevanti dal database vettoriale per generare risposte accurate. Supporta inoltre l'attribuzione della fonte e la memoria a breve termine necessaria per le applicazioni RAG.

Ciò ti consente di concentrarti sulle applicazioni aziendali principali ed eliminare il lavoro pesante indifferenziato.

Panoramica della soluzione

La soluzione presentata in questo post utilizza un chatbot creato utilizzando a Snello applicazione e include i seguenti servizi AWS:

Il seguente diagramma è un modello di architettura di soluzione comune che puoi utilizzare per integrare qualsiasi applicazione chatbot nelle Knowledge Base per Amazon Bedrock.

Questa architettura prevede i seguenti passaggi:

- Un utente interagisce con l'interfaccia del chatbot Streamlit e invia una query in linguaggio naturale

- Ciò attiva una funzione Lambda, che richiama le Knowledge Base

RetrieveAndGenerateAPI. Internamente, le basi di conoscenza utilizzano un file Titano Amazzonico modello di incorporamento e converte la query dell'utente in un vettore e trova blocchi semanticamente simili alla query dell'utente. Il prompt dell'utente viene quindi ampliato con i blocchi recuperati dalla knowledge base. La richiesta insieme al contesto aggiuntivo viene quindi inviata a un LLM per la generazione della risposta. In questa soluzione, utilizziamo Claude Instant antropico come nostro LLM per generare risposte utente utilizzando contesto aggiuntivo. Tieni presente che questa soluzione è supportata nelle regioni in cui si trova Anthropic Claude su Amazon Bedrock disponibile. - Una risposta contestualmente rilevante viene inviata all'applicazione chatbot e all'utente.

Prerequisiti

Gli utenti di Amazon Bedrock devono richiedere l'accesso ai modelli di fondazione prima che siano disponibili per l'uso. Questa è un'azione una tantum e richiede meno di un minuto. Per questa soluzione, dovrai abilitare l'accesso al modello Titan Embeddings G1 – Text and Claude Instant – v1.2 in Amazon Bedrock. Per ulteriori informazioni, fare riferimento a Accesso al modello.

Clona il repository GitHub

La soluzione presentata in questo post è disponibile di seguito Repository GitHub. Devi clonare il repository GitHub sul tuo computer locale. Apri una finestra di terminale ed esegui il comando seguente. Nota che questo è un singolo comando git clone.

Carica il tuo set di dati della conoscenza su Amazon S3

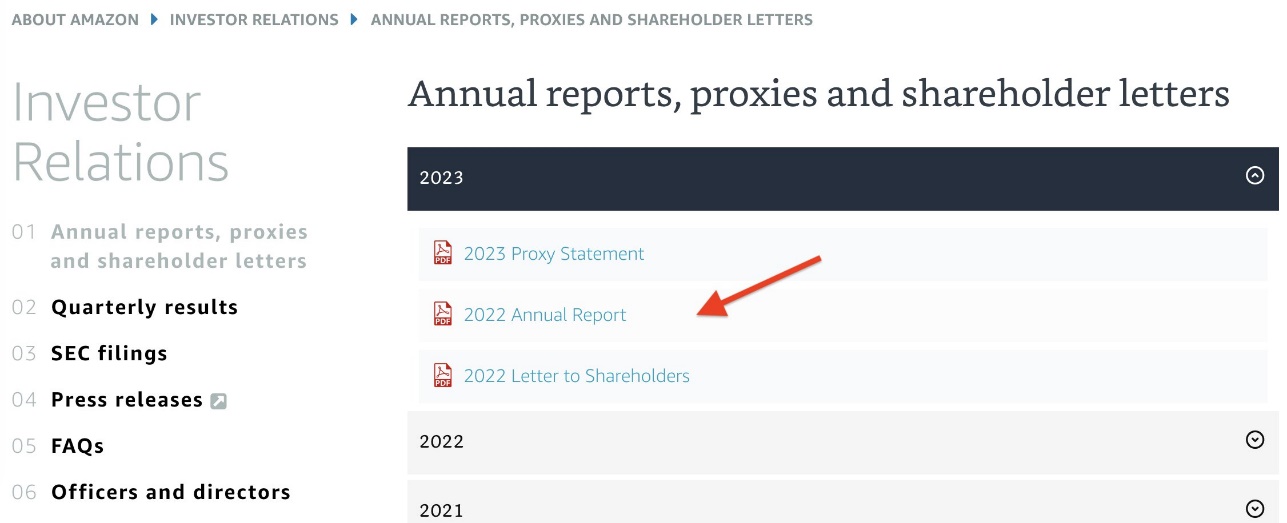

Scarichiamo il set di dati per la nostra knowledge base e lo carichiamo in un bucket S3. Questo set di dati alimenterà e alimenterà la base di conoscenza. Completa i seguenti passaggi:

- Passare alla Relazioni annuali, deleghe e lettere agli azionisti repository di dati e scaricare le lettere degli azionisti di Amazon degli ultimi anni.

- Sulla console Amazon S3, scegli Secchi nel pannello di navigazione.

- Scegli Crea un secchio.

- Dai un nome al secchio

knowledgebase-<your-awsaccount-number>. - Lascia tutte le altre impostazioni del bucket come predefinite e scegli Creare.

- Passare alla

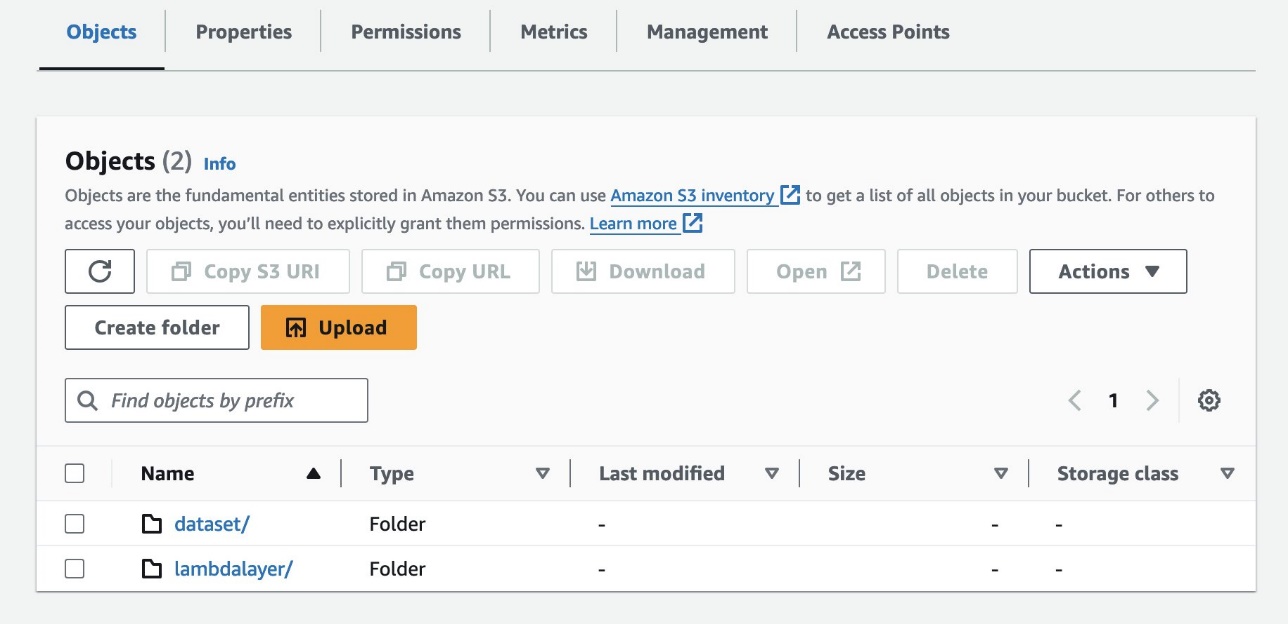

knowledgebase-<your-awsaccount-number>secchio. - Scegli Crea cartella e chiamarlo set di dati.

- Lascia tutte le altre impostazioni della cartella come predefinite e scegli Creare.

- Torna alla home del secchio e scegli Crea cartella per creare una nuova cartella e darle un nome

lambdalayer. - Lascia tutte le altre impostazioni come predefinite e scegli Creare.

- Passare alla

datasetcartella. - Carica i file dei set di dati delle relazioni annuali, delle deleghe e delle lettere degli azionisti scaricati in precedenza in questo bucket e scegli Caricare.

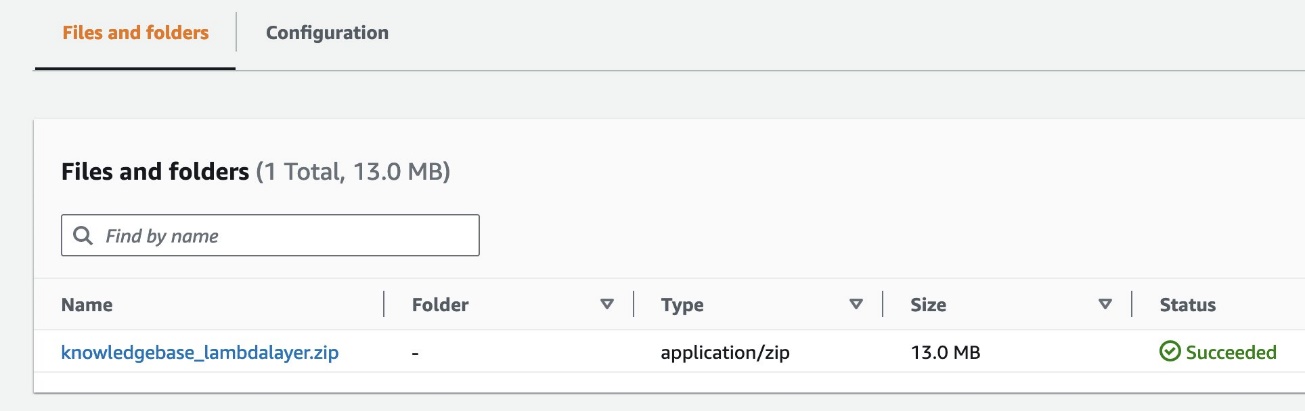

- Passare alla

lambdalayercartella. - Carica il

knowledgebase-lambdalayer.zipfile disponibile sotto il/lambda/layercartella nel repository GitHub clonato in precedenza e scegli Caricare. Utilizzerai questo codice del livello Lambda in seguito per creare la funzione Lambda.

Crea una base di conoscenza

In questa fase, creiamo una knowledge base utilizzando il set di dati delle lettere degli azionisti di Amazon che abbiamo caricato nel nostro bucket S3 nella fase precedente.

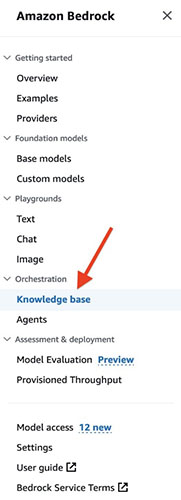

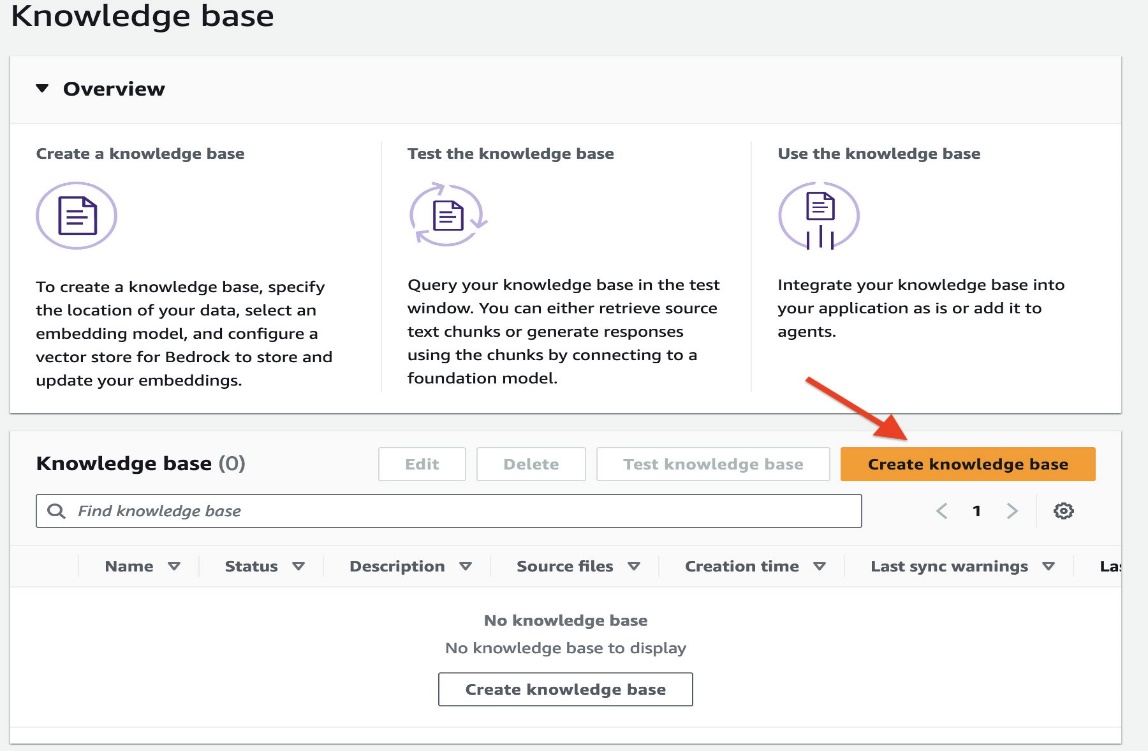

- Sulla console Amazon Bedrock, sotto Orchestrazione nel pannello di navigazione, scegli Knowledge Base.

- Scegli Crea una base di conoscenza.

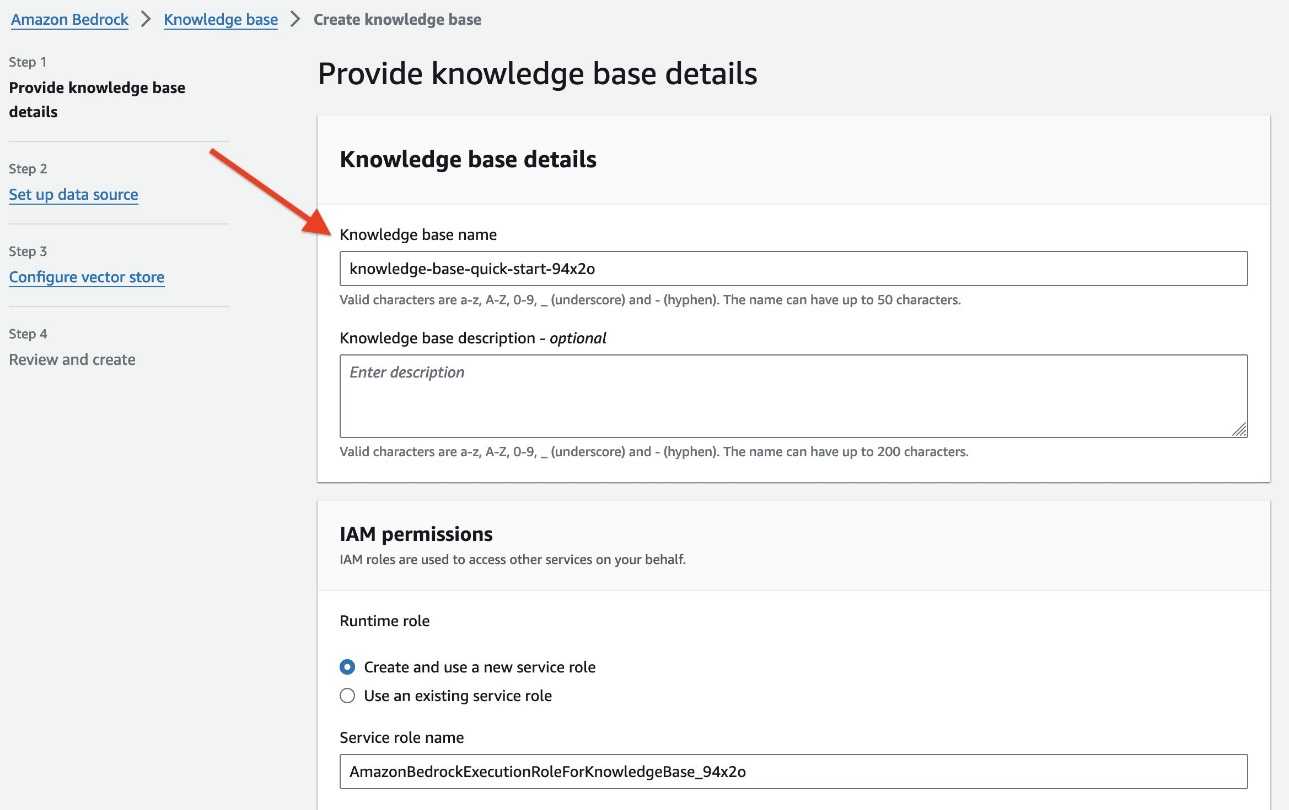

- Nel Dettagli della base di conoscenza sezione, immettere un nome e una descrizione facoltativa.

- Nel Autorizzazioni IAM sezione, selezionare Crea e utilizza un nuovo ruolo del servizio e inserisci un nome per il ruolo.

- Aggiungi tag secondo necessità.

- Scegli Avanti.

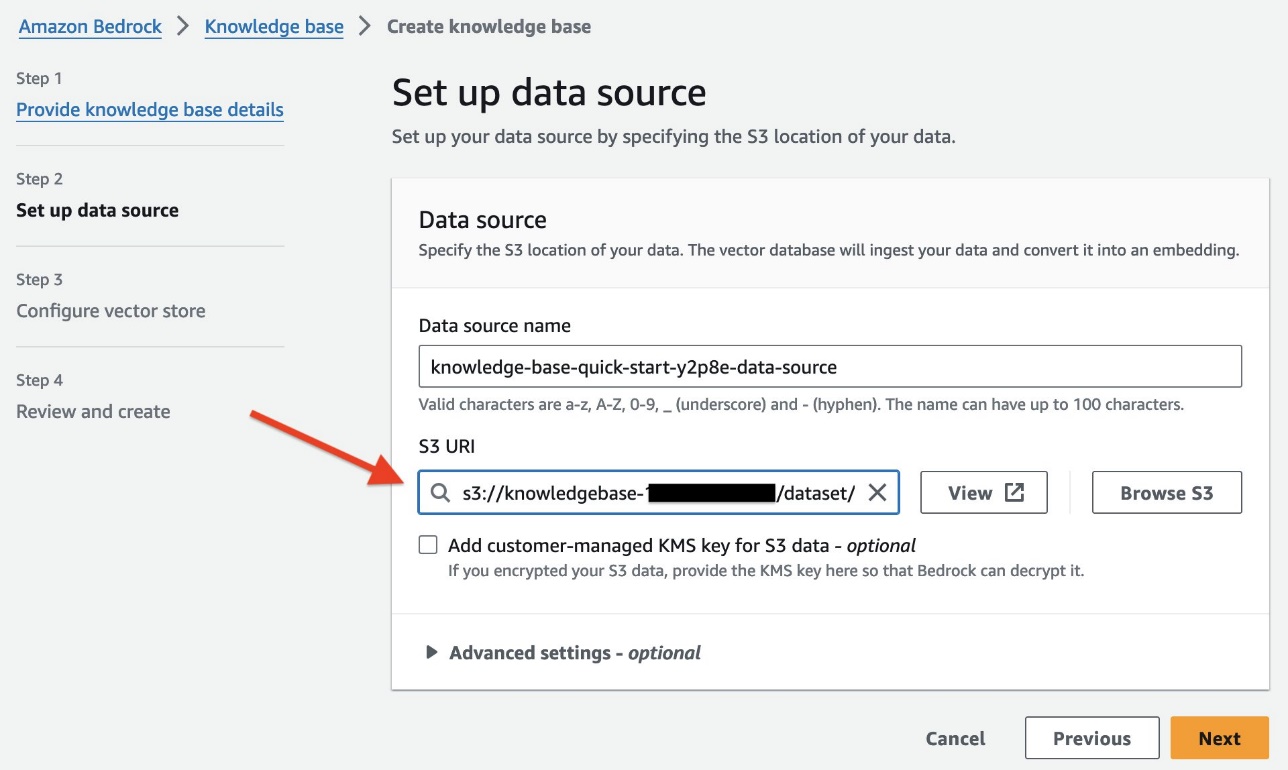

- Lasciare Nome dell'origine dati come nome predefinito.

- Nel URI S3scegli Sfoglia S3 per scegliere il secchiello S3

knowledgebase-<your-account-number>/dataset/.Devi puntare al bucket e alla cartella del set di dati creati nei passaggi precedenti. - Nel impostazioni avanzate sezione, lascia i valori predefiniti (se lo desideri, puoi modificare la strategia di suddivisione in blocchi predefinita e specificare la dimensione del blocco e la sovrapposizione in percentuale).

- Scegli Avanti.

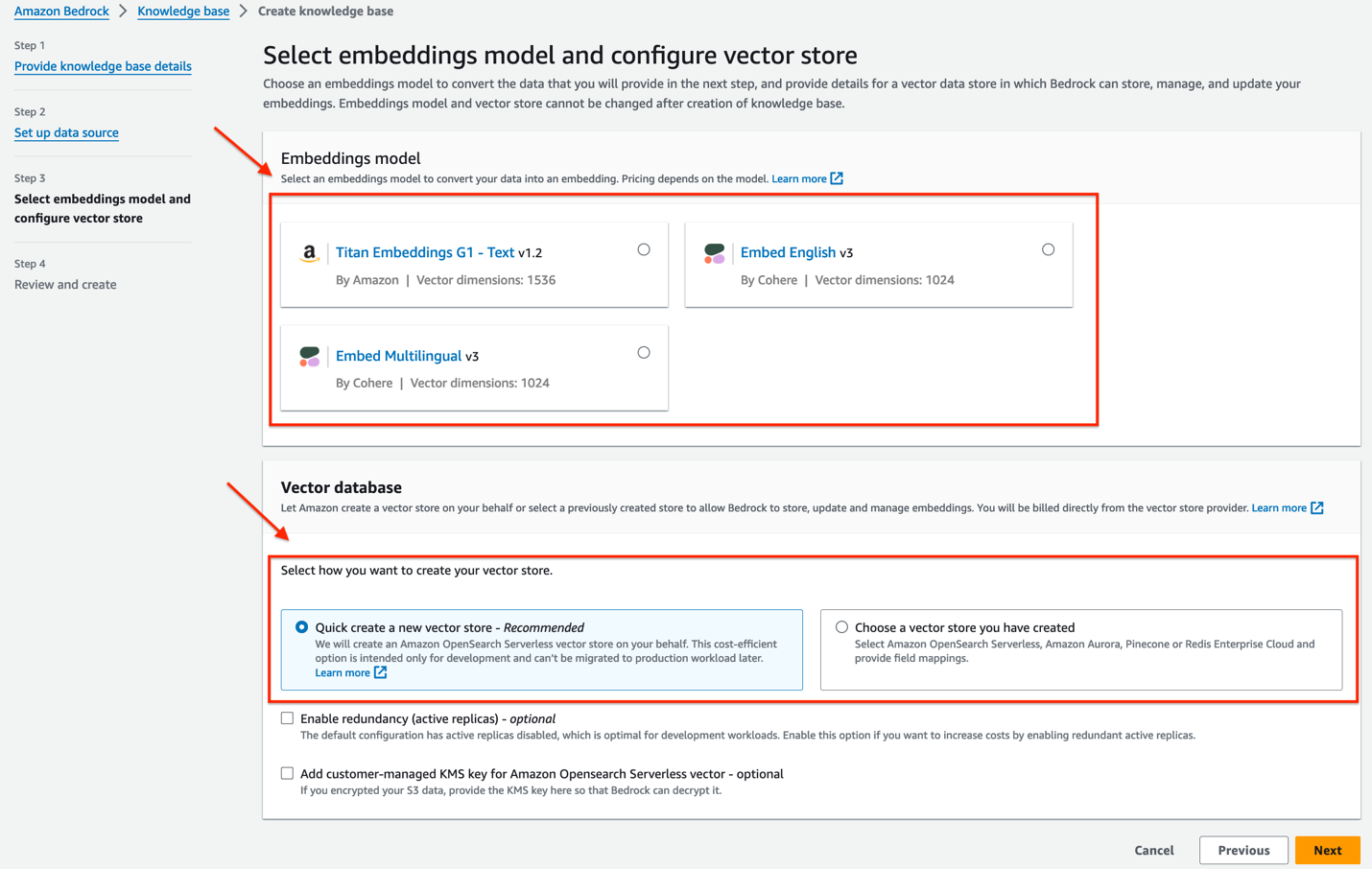

- Nel Modello degli incastri, selezionare Titan Incorporamento G1 – Testo.

- Nel Banca dati vettoriale, puoi selezionare Crea rapidamente un nuovo archivio vettoriale or Scegli un negozio di vettori che hai creato. Tieni presente che, per utilizzare l'archivio vettoriale di tua scelta, è necessario disporre di un archivio vettoriale preconfigurato per l'utilizzo. Attualmente supportiamo quattro tipi di motori vettoriali: il motore vettoriale per Amazon OpenSearch Serverless, Amazon Aurora, Pinecone e Redis Enterprise Cloud. Per questo post selezioniamo Crea rapidamente un nuovo archivio vettoriale, che per impostazione predefinita crea un nuovo archivio vettoriale OpenSearch Serverless nel tuo account.

- Scegli Avanti.

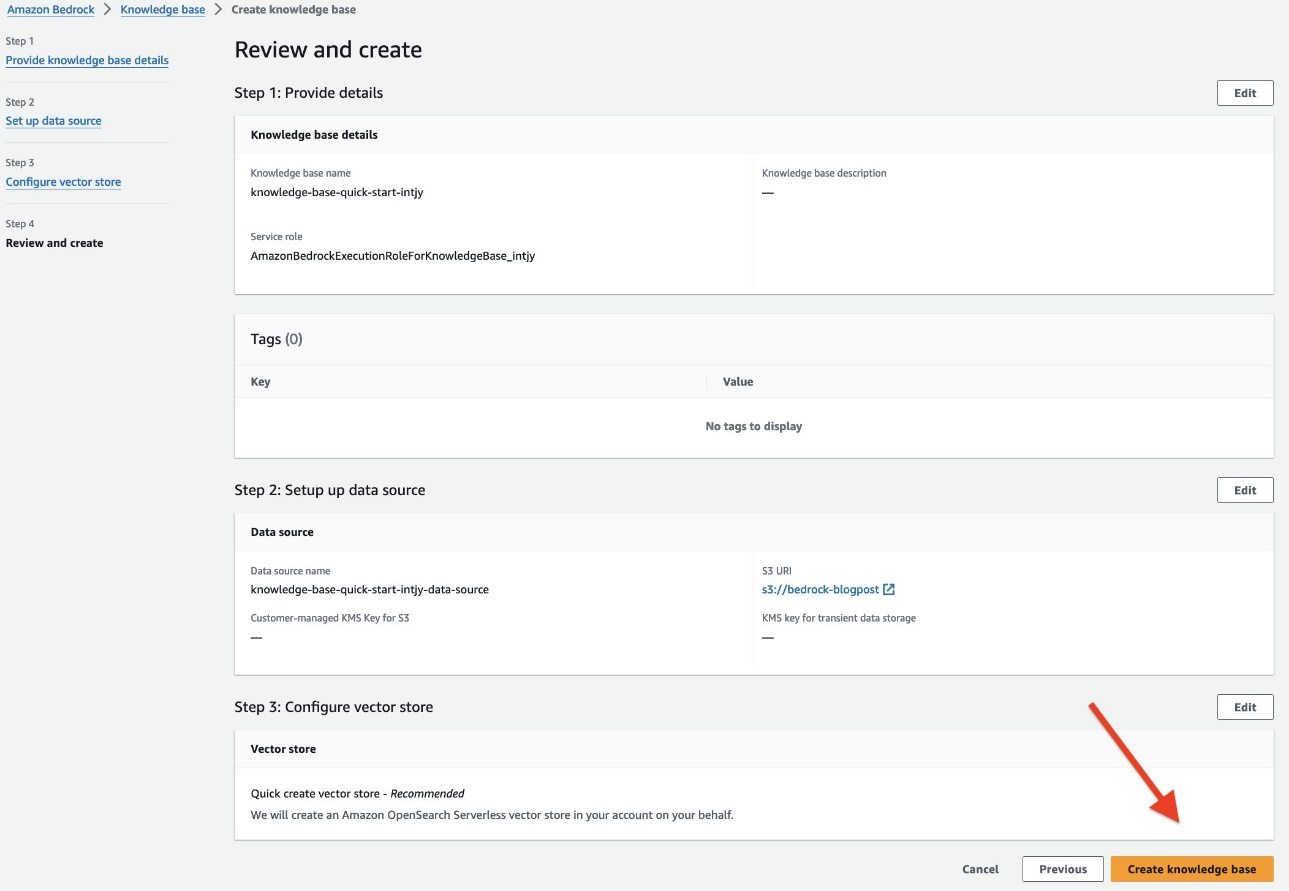

- Sulla Rivedi e crea pagina, rivedere tutte le informazioni o scegliere Precedente per modificare eventuali opzioni.

- Scegli Crea una base di conoscenza.

Tieni presente che il processo di creazione della knowledge base inizia e lo stato è In corso. Saranno necessari alcuni minuti per creare l'archivio vettoriale e la knowledge base. Non uscire dalla pagina, altrimenti la creazione fallirà.

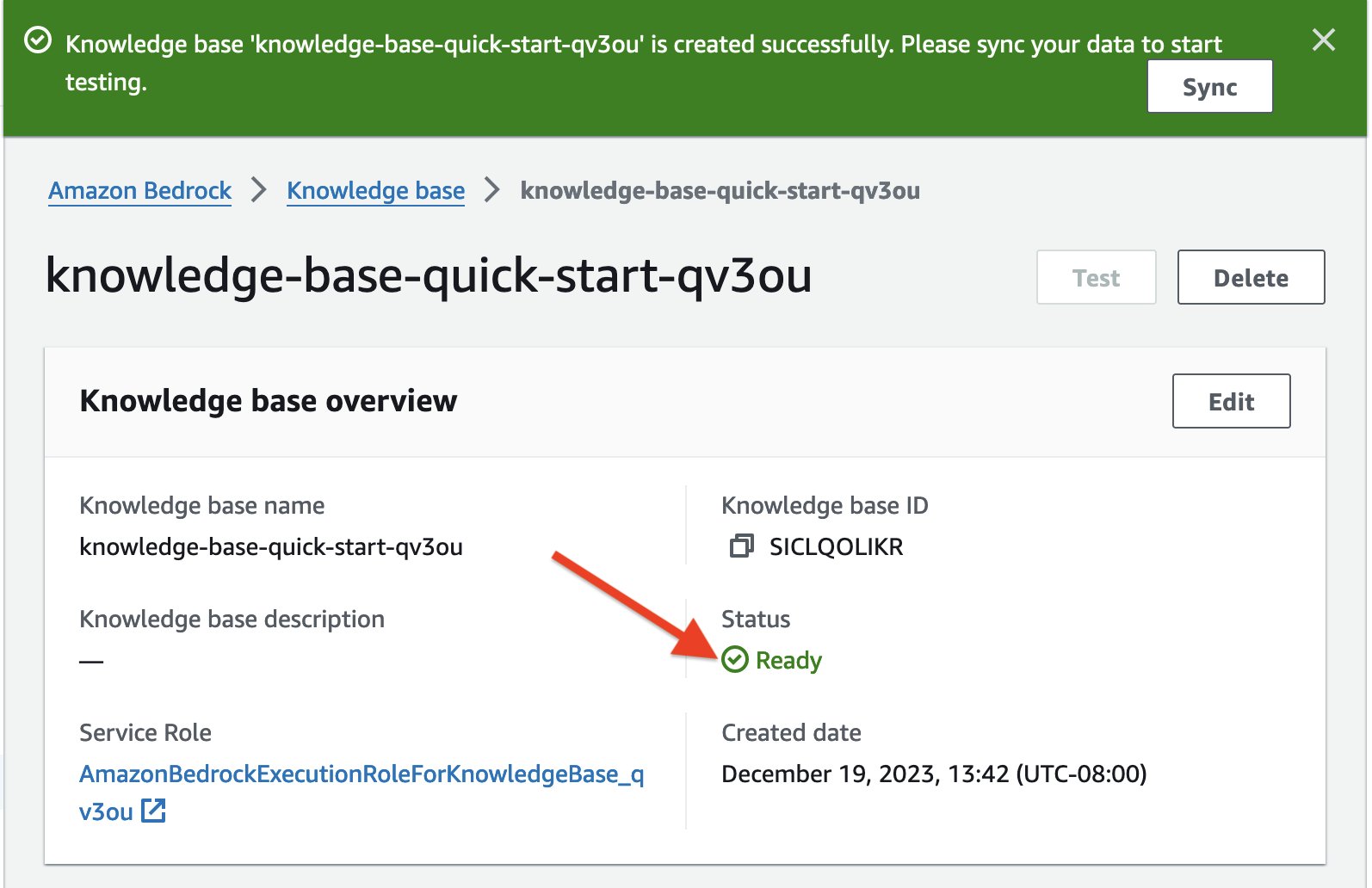

Tieni presente che il processo di creazione della knowledge base inizia e lo stato è In corso. Saranno necessari alcuni minuti per creare l'archivio vettoriale e la knowledge base. Non uscire dalla pagina, altrimenti la creazione fallirà. - Quando lo stato della knowledge base è in

Readystato, annotare l'ID della knowledge base. Lo utilizzerai nei passaggi successivi per configurare la funzione Lambda.

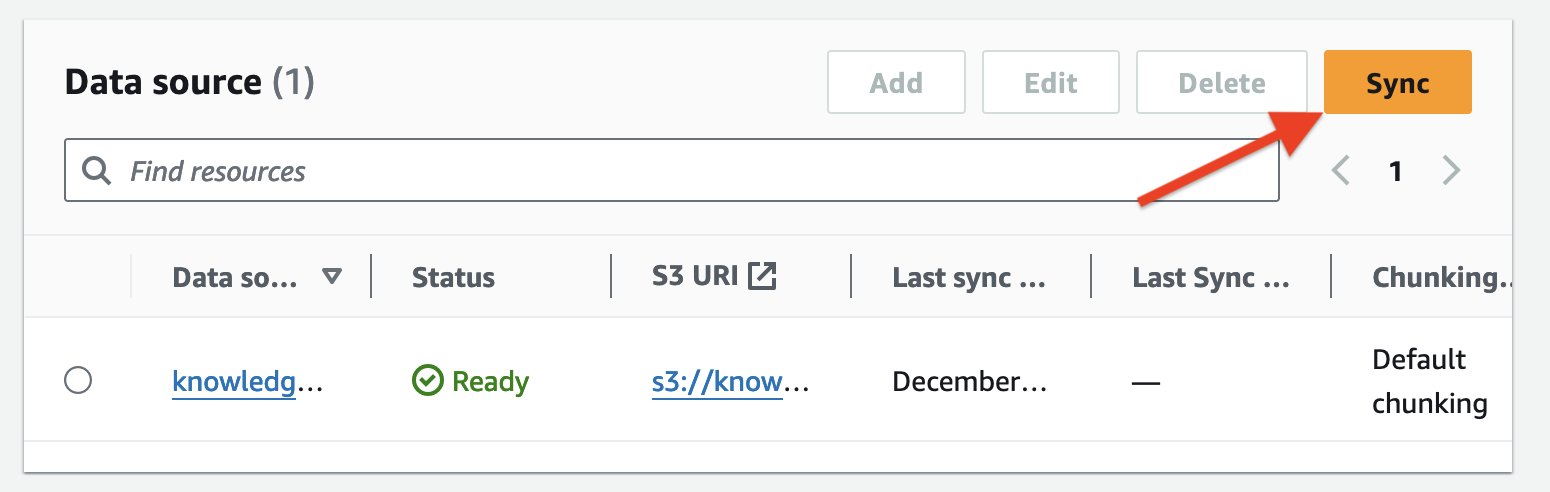

- Ora che la knowledge base è pronta, dobbiamo sincronizzare i dati delle lettere degli azionisti di Amazon. Nel Fonte di dati sezione della pagina dei dettagli della knowledge base, scegliere Sincronizza per attivare il processo di inserimento dei dati dal bucket S3 alla knowledge base.

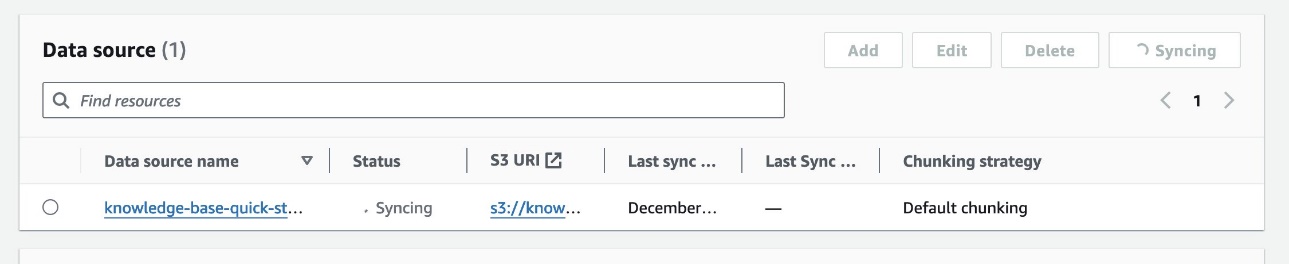

Questo processo di sincronizzazione suddivide i file del documento in blocchi più piccoli della dimensione specificata in precedenza, genera incorporamenti di vettori utilizzando il modello di incorporamento del testo selezionato e li archivia nell'archivio di vettori gestito da Knowledge Base per Amazon Bedrock.

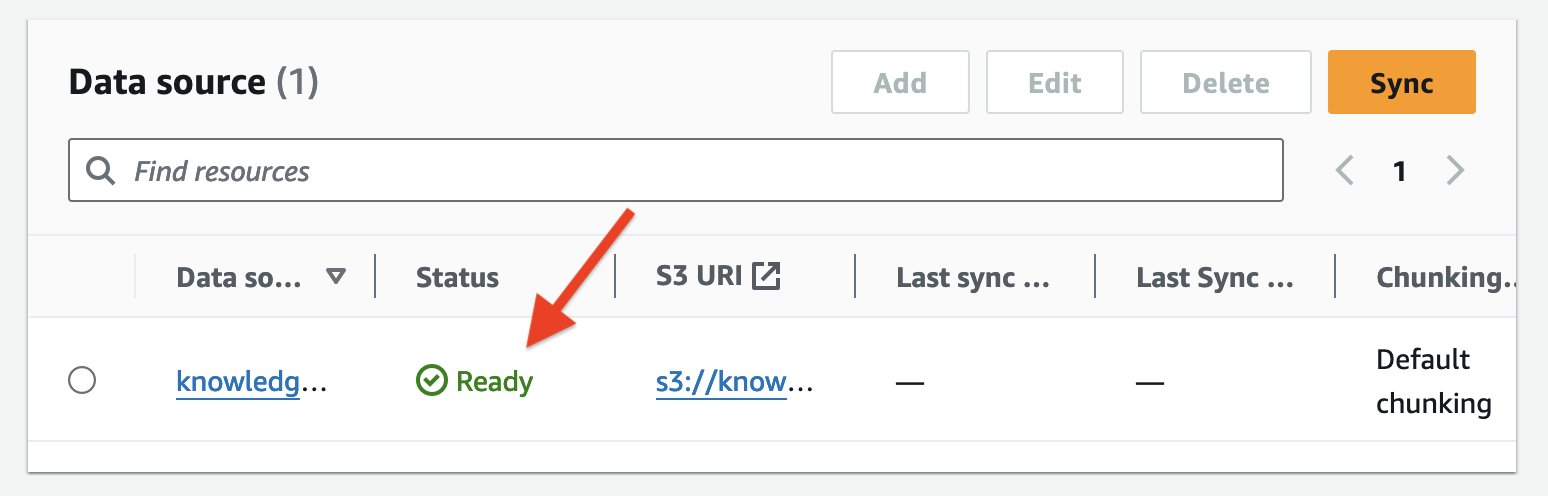

Una volta completata la sincronizzazione del set di dati, lo stato dell'origine dati cambierà in Ready stato. Tieni presente che, se aggiungi ulteriori documenti nella cartella dati S3, dovrai sincronizzare nuovamente la knowledge base.

Congratulazioni, la tua base di conoscenza è pronta.

Tieni presente che puoi anche utilizzare le Knowledge Base per le API del servizio Amazon Bedrock e il file Interfaccia della riga di comando di AWS (AWS CLI) per creare a livello di codice una knowledge base. Sarà necessario eseguire varie sezioni del notebook Jupyter fornito nel file /notebook cartella nel repository GitHub.

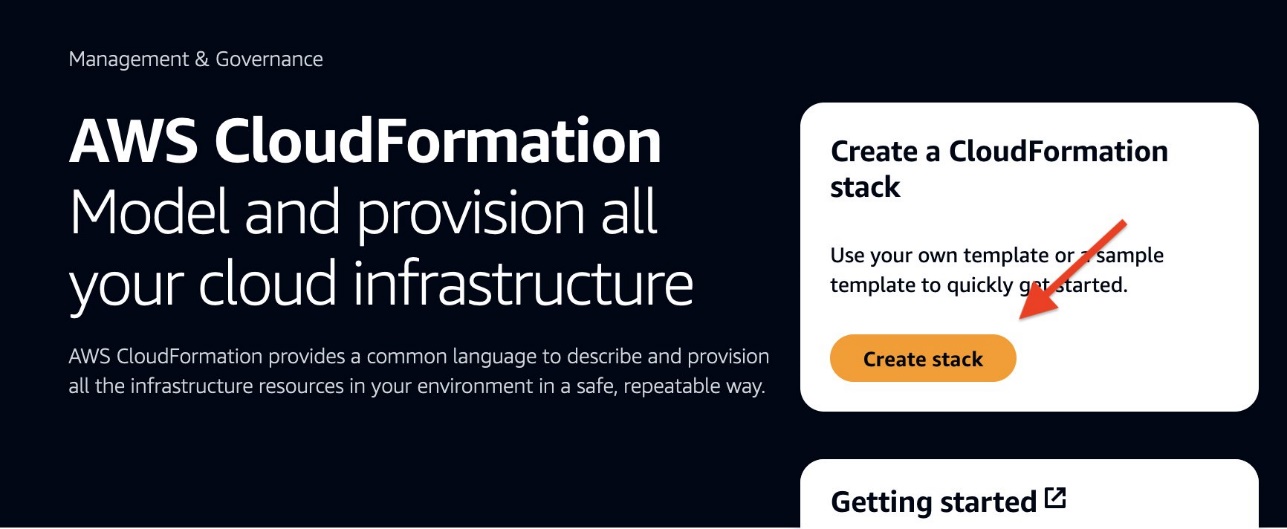

Crea una funzione Lambda

Questa funzione Lambda viene distribuita utilizzando un file AWS CloudFormazione modello disponibile nel repository GitHub sotto il file /cfn cartella. Il modello richiede due parametri: il nome del bucket S3 e l'ID della knowledge base.

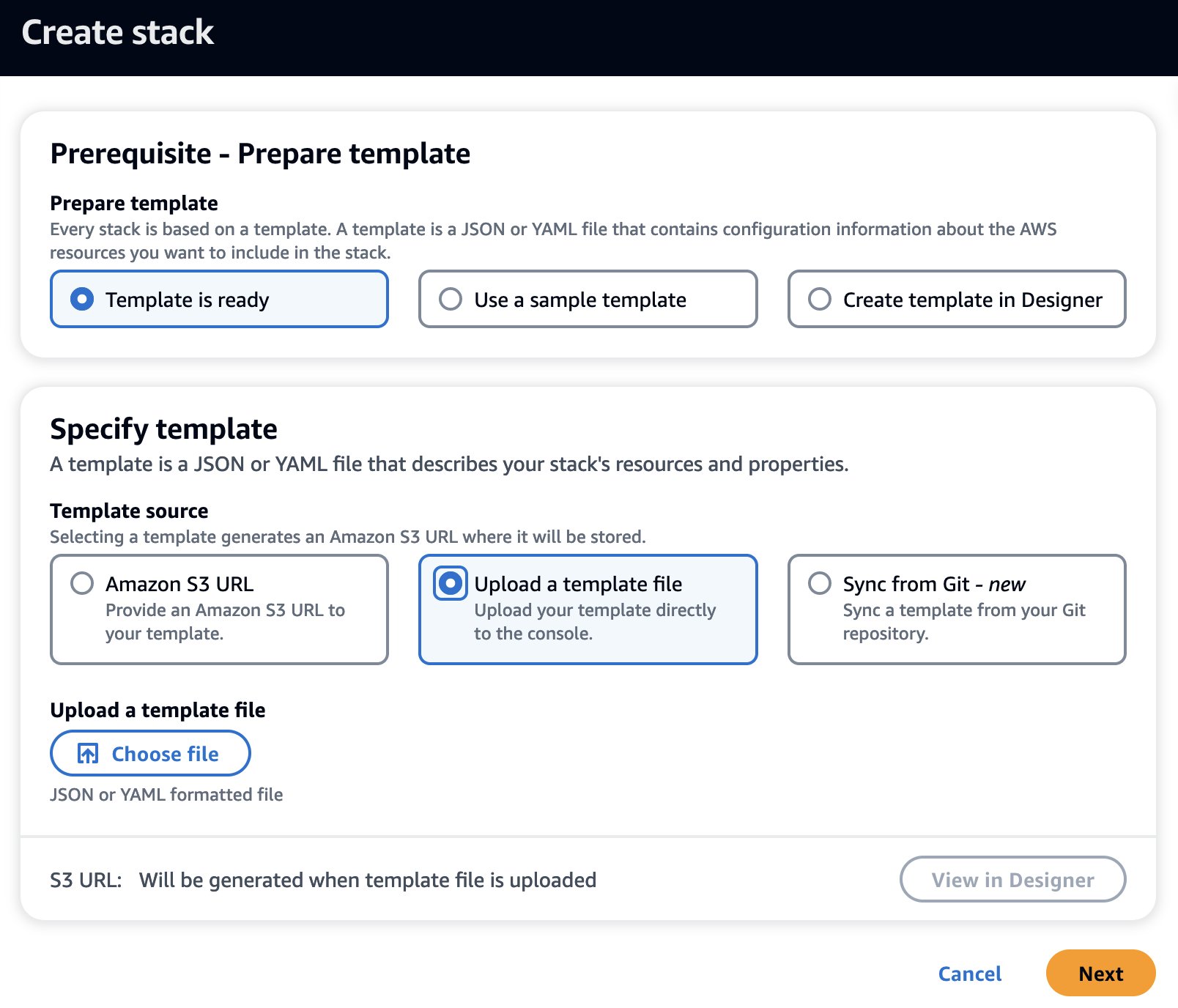

- Nella home page del servizio AWS CloudFormation, scegli Crea stack per creare una nuova pila.

- Seleziona Il modello è pronto per Preparare il modello.

- Seleziona Carica il file modello per Fonte del modello.

- Scegli Scegli il file, vai al repository GitHub che hai clonato in precedenza e scegli il file .yaml sotto il file

/cfncartella. - Scegli Avanti.

- Nel Nome dello stack, inserisci un nome.

- Nel parametri sezione, inserisci l'ID della knowledge base e il nome del bucket S3 annotato in precedenza.

- Scegli Avanti.

- Lascia tutte le opzioni predefinite così come sono, scegli Avantie scegli Invio.

- Verifica che il modello CloudFormation sia stato eseguito correttamente e che non siano presenti errori.

Congratulazioni, hai creato correttamente una funzione Lambda, i ruoli correlati e le policy.

Testare l'applicazione chatbot contestuale

Per testare la tua applicazione chatbot, completa i seguenti passaggi:

- Apri un nuovo terminale o una finestra della riga di comando sul tuo computer.

- Eseguire il comando seguente per installare SDK AWS per Python (Boto3). Boto3 semplifica l'integrazione di un'applicazione, libreria o script Python con i servizi AWS.

- Esegui il comando seguente per installare e configurare un ambiente di sviluppo Python locale per eseguire l'applicazione Streamlit:

- Passare alla

/streamlitnella cartella del repository GitHub clonata in precedenza. - Esegui il comando seguente per creare un'istanza dell'applicazione chatbot:

Questo dovrebbe aprire un'applicazione di chat basata sul web fornita da Streamlit nel tuo browser web predefinito.

- Utilizza questa applicazione chatbot Streamlit per pubblicare domande in linguaggio naturale per avviare conversazioni basate sulle basi di conoscenza per Amazon Bedrock.

Quando invii una richiesta, l'app Streamlit attiva la funzione Lambda, che richiama le Knowledge Base RetrieveAndGenerate API per cercare e generare risposte.

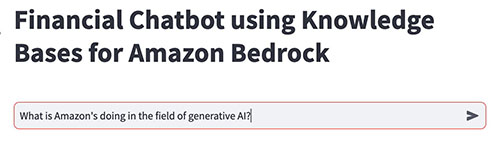

La tabella seguente include alcune domande di esempio e le relative risposte della Knowledge Base. Prova alcune di queste domande utilizzando le istruzioni.

| Domande | Risposte |

| Cosa sta facendo Amazon nel campo dell’intelligenza artificiale generativa? | Amazon ha lavorato sui propri modelli linguistici di grandi dimensioni (LLM) per l’intelligenza artificiale generativa e ritiene che trasformerà e migliorerà ogni esperienza del cliente. Hanno intenzione di continuare a investire sostanzialmente in questi modelli in tutte le loro esperienze di consumo, venditore, marchio e creatore. |

| Qual è il fatturato annuale di AWS nel 2022? | I ricavi di AWS sono cresciuti del 29% su base annua nel 2022 su una base di ricavi di 62 miliardi di dollari. |

| Per quanti giorni Amazon ha chiesto ai dipendenti di venire a lavorare in ufficio? | Amazon ha chiesto ai dipendenti aziendali di tornare in ufficio almeno tre giorni alla settimana a partire da maggio 2022. |

| In quale percentuale i ricavi di AWS sono cresciuti anno su anno nel 2022? | AWS ha registrato un fatturato anno su anno ("YoY") del 29% nel 2022. |

| Rispetto ai processori Graviton2, quale miglioramento prestazionale hanno apportato i chip Graviton3 secondo il passaggio? | Nel 2022, AWS ha consegnato i propri chip Graviton3, fornendo prestazioni migliori del 25% rispetto ai processori Graviton2. |

| Qual è stato il primo chip di inferenza lanciato da AWS secondo il passaggio? | AWS ha lanciato i suoi primi chip di inferenza (“Inferentia”) nel 2019 e ha fatto risparmiare ad aziende come Amazon oltre cento milioni di dollari in spese di capitale. |

| A seconda del contesto, in quale anno le entrate annuali di Amazon sono aumentate da 245 miliardi di dollari a 434 miliardi di dollari? | Le entrate annuali di Amazon sono aumentate da 245 miliardi di dollari nel 2019 a 434 miliardi di dollari nel 2022. |

| Raccontatemi ancora quali sono state le entrate nel 2019? | Il fatturato di Amazon nel 2019 è stato di 245 miliardi di dollari. |

| e il 2021? | Le entrate di Amazon nel 2021 sono state di 469.8 miliardi di dollari, con un aumento del 22% rispetto al 2020. |

| E ricordamelo ancora quando è stato lanciato il primo chip di inferenza? | Il primo chip di inferenza di Amazon è stato Inferentia, lanciato nel 2019. |

Durante la prima chiamata alla funzione Lambda, il file RetrieveAndGenerate L'API restituisce a sessionId, che viene quindi passato dall'app Streamlit insieme alla successiva richiesta dell'utente come input all'API RetrieveAndGenerate per continuare la conversazione nella stessa sessione. IL RetrieveAndGenerate L'API gestisce la memoria a breve termine e utilizza la cronologia della chat a patto che lo stesso sessionId venga passato come input nelle chiamate successive.

Congratulazioni, hai creato e testato con successo un'applicazione chatbot utilizzando le basi di conoscenza per Amazon Bedrock.

ripulire

La mancata eliminazione di risorse come il bucket S3, la raccolta OpenSearch Serverless e la knowledge base comporterà dei costi. Per ripulire queste risorse, elimina lo stack CloudFormation, elimina il bucket S3 (inclusi eventuali cartelle di documenti e file archiviati in quel bucket), elimina la raccolta OpenSearch Serverless, elimina la knowledge base ed elimina tutti i ruoli, policy e autorizzazioni che hai creato in precedenza.

Conclusione

In questo post abbiamo fornito una panoramica dei chatbot contestuali e spiegato perché sono importanti. Abbiamo descritto le complessità coinvolte nell'inserimento dei dati e nei flussi di lavoro di generazione del testo per un'architettura RAG. Abbiamo quindi introdotto il modo in cui Knowledge Base per Amazon Bedrock crea un sistema RAG serverless completamente gestito, incluso un archivio vettoriale. Infine, abbiamo fornito un'architettura della soluzione e un codice di esempio in a Repository GitHub per recuperare e generare risposte contestuali per un'applicazione chatbot utilizzando una base di conoscenza.

Spiegando il valore dei chatbot contestuali, le sfide dei sistemi RAG e il modo in cui Knowledge Base per Amazon Bedrock affronta tali sfide, questo post mirava a mostrare come Amazon Bedrock consente di creare sofisticate applicazioni di intelligenza artificiale conversazionale con il minimo sforzo.

Per ulteriori informazioni, vedere la Guida per gli sviluppatori di Amazon Bedrock ed API della base di conoscenza.

Informazioni sugli autori

Manish Chugh è Principal Solutions Architect presso AWS con sede a San Francisco, California. È specializzato in machine learning e intelligenza artificiale generativa. Lavora con organizzazioni che vanno dalle grandi imprese alle startup in fase iniziale su problemi legati all'apprendimento automatico. Il suo ruolo consiste nell'aiutare queste organizzazioni a progettare carichi di lavoro scalabili, sicuri ed economici su AWS. Presenta regolarmente alle conferenze AWS e ad altri eventi dei partner. Al di fuori del lavoro, gli piace fare escursioni sui sentieri dell'East Bay, andare in bicicletta su strada e guardare (e giocare) il cricket.

Manish Chugh è Principal Solutions Architect presso AWS con sede a San Francisco, California. È specializzato in machine learning e intelligenza artificiale generativa. Lavora con organizzazioni che vanno dalle grandi imprese alle startup in fase iniziale su problemi legati all'apprendimento automatico. Il suo ruolo consiste nell'aiutare queste organizzazioni a progettare carichi di lavoro scalabili, sicuri ed economici su AWS. Presenta regolarmente alle conferenze AWS e ad altri eventi dei partner. Al di fuori del lavoro, gli piace fare escursioni sui sentieri dell'East Bay, andare in bicicletta su strada e guardare (e giocare) il cricket.

Mani Khanuja è Tech Lead – Generative AI Specialists, autrice del libro Applied Machine Learning and High Performance Computing su AWS e membro del Consiglio di amministrazione della Women in Manufacturing Education Foundation. Conduce progetti di machine learning in vari settori come la visione artificiale, l'elaborazione del linguaggio naturale e l'intelligenza artificiale generativa. Parla a conferenze interne ed esterne come AWS re:Invent, Women in Manufacturing West, webinar su YouTube e GHC 23. Nel tempo libero le piace fare lunghe corse lungo la spiaggia.

Mani Khanuja è Tech Lead – Generative AI Specialists, autrice del libro Applied Machine Learning and High Performance Computing su AWS e membro del Consiglio di amministrazione della Women in Manufacturing Education Foundation. Conduce progetti di machine learning in vari settori come la visione artificiale, l'elaborazione del linguaggio naturale e l'intelligenza artificiale generativa. Parla a conferenze interne ed esterne come AWS re:Invent, Women in Manufacturing West, webinar su YouTube e GHC 23. Nel tempo libero le piace fare lunghe corse lungo la spiaggia.

Pallavi Nargund è Principal Solutions Architect presso AWS. Nel suo ruolo di abilitatore della tecnologia cloud, collabora con i clienti per comprenderne obiettivi e sfide e fornire indicazioni prescrittive per raggiungere i loro obiettivi con le offerte AWS. È appassionata di donne nella tecnologia ed è un membro fondamentale di Women in AI/ML su Amazon. Parla a conferenze interne ed esterne come AWS re:Invent, AWS Summits e webinar. Al di fuori del lavoro le piace il volontariato, il giardinaggio, il ciclismo e l'escursionismo.

Pallavi Nargund è Principal Solutions Architect presso AWS. Nel suo ruolo di abilitatore della tecnologia cloud, collabora con i clienti per comprenderne obiettivi e sfide e fornire indicazioni prescrittive per raggiungere i loro obiettivi con le offerte AWS. È appassionata di donne nella tecnologia ed è un membro fondamentale di Women in AI/ML su Amazon. Parla a conferenze interne ed esterne come AWS re:Invent, AWS Summits e webinar. Al di fuori del lavoro le piace il volontariato, il giardinaggio, il ciclismo e l'escursionismo.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :ha

- :È

- :Dove

- $ SU

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- capacità

- WRI

- accelerare

- accesso

- Accedendo

- Secondo

- Il mio account

- preciso

- Raggiungere

- operanti in

- Action

- aggiungere

- aggiuntivo

- indirizzi

- Avanzate

- vantaggi

- consulenti

- ancora

- agenti

- AI

- Sistemi di intelligenza artificiale

- AI / ML

- Mirato

- Tutti

- Consentire

- consente

- da solo

- lungo

- a fianco di

- anche

- Amazon

- Amazon Web Services

- an

- ed

- annuale

- ENTRATE ANNUALI

- rispondere

- rispondere

- Antropico

- in qualsiasi

- api

- API

- App

- Applicazioni

- applicazioni

- applicato

- approccio

- architettura

- SONO

- AS

- At

- aumentare

- aumentata

- aumenti

- Aurora

- autore

- automaticamente

- disponibile

- Avenue

- lontano

- AWS

- AWS CloudFormazione

- AWS re: Invent

- precedente

- base

- basato

- basic

- Baia

- Beach

- diventare

- stato

- prima

- Inizio

- inizia

- comportamento

- crede

- Meglio

- Miliardo

- tavola

- Consiglio di Amministrazione

- libro

- marca

- del browser

- costruire

- affari

- Applicazioni aziendali

- by

- CA

- chiamata

- Bandi

- Materiale

- funzionalità

- capitale

- casi

- CD

- sfide

- il cambiamento

- Modifiche

- oneri

- chiacchierare

- chatbot

- chatbots

- Procedi all'acquisto

- patata fritta

- Chips

- scegliere

- Scegli

- cavedano

- cli

- Cloud

- TECNOLOGIA NUVOLA

- codice

- collezione

- combina

- Venire

- viene

- Uncommon

- Aziende

- azienda

- completamento di una

- complessità

- componenti

- computazionale

- computer

- Visione computerizzata

- informatica

- conferenze

- Connettiti

- consolle

- Consumer

- contesto

- contestuale

- contestualizzare

- continua

- Conversazione

- discorsivo

- AI conversazionale

- Conversazioni

- convertito

- Nucleo

- Aziende

- costo effettivo

- potuto

- creare

- creato

- crea

- Creazione

- creazione

- Creatore

- cricket

- Attualmente

- cliente

- comportamento del cliente

- esperienza del cliente

- Servizio clienti

- Clienti

- personalizzate

- dati

- punti dati

- data-driven

- Banca Dati

- Giorni

- Predefinito

- consegnare

- consegnato

- consegna

- Dipendente

- schierato

- deployment

- descritta

- descrizione

- dettagli

- Determinare

- sviluppare

- Costruttori

- Mercato

- diagramma

- DID

- diverso

- digitale

- Amministrazione

- paesaggio differenziato

- documento

- documenti

- fare

- dollari

- domini

- Dont

- giù

- scaricare

- ogni

- In precedenza

- fase iniziale

- est

- Istruzione

- efficiente

- sforzo

- senza sforzo

- o

- incorporamento

- dipendenti

- enable

- enabler

- Abilita

- impegnandosi

- motore

- Ingegneria

- migliorata

- migliorando

- entrare

- Impresa

- aziende

- Ambiente

- errori

- Anche

- eventi

- Ogni

- esempio

- esperienza

- Esperienze

- competenza

- Spiegare

- ha spiegato

- spiegando

- esterno

- fatti

- FAIL

- pochi

- campo

- Compila il

- File

- Infine

- trova

- Nome

- flusso

- Focus

- i seguenti

- Nel

- Fondazione

- quattro

- Francisco

- Gratis

- da

- completamente

- function

- g1

- generare

- genera

- ELETTRICA

- generativo

- AI generativa

- Idiota

- GitHub

- Dare

- Go

- Obiettivi

- è cresciuto

- Terra

- Crescere

- cresce

- guida

- ha avuto

- maniglia

- Maniglie

- Avere

- he

- pesante

- sollevamento pesante

- aiutare

- suo

- Alta

- alto livello

- il suo

- storia

- Casa

- Come

- Tuttavia

- HTML

- http

- HTTPS

- misura di peso di 5.8 chili

- ID

- if

- illustrare

- illustra

- Implementazione

- importante

- competenze

- miglioramento

- miglioramento

- in

- inclusi

- Compreso

- incorporare

- incorpora

- Aumento

- è aumentato

- Index

- indici

- individuale

- industrie

- far sapere

- informazioni

- Sistemi di informazione

- ingresso

- Richieste

- intuizioni

- install

- immediato

- integrare

- Integrazione

- integrazione

- interagisce

- interessi

- Interfaccia

- interno

- internamente

- ai miglioramenti

- introdurre

- introdotto

- investire

- invoca

- coinvolto

- comporta

- IT

- jpg

- Le

- conoscenze

- Lingua

- Le Lingue

- grandi

- Grandi imprese

- Cognome

- dopo

- lanciato

- strato

- portare

- Leads

- apprendimento

- meno

- Lasciare

- meno

- lettera

- Livello

- biblioteche

- Biblioteca

- di sollevamento

- piace

- piace

- Limitato

- linea

- collegamento

- LLM

- locale

- Lunghi

- macchina

- machine learning

- Principale

- FA

- maneggevole

- gestito

- gestisce

- gestione

- consigliato per la

- molti

- partita

- Maggio..

- me

- significato

- meccanismo

- membro

- Memorie

- semplicemente

- milione

- milioni di dollari

- minimo

- minuto

- Minuti

- modello

- modelli

- modificare

- Scopri di più

- maggior parte

- multiplo

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Navigare

- Navigazione

- Bisogno

- di applicazione

- esigenze

- New

- GENERAZIONE

- no

- Nessuna

- Nota

- taccuino

- noto

- obiettivo

- of

- offrire

- offerte

- Offerte

- Office

- di frequente

- on

- ONE

- aprire

- open source

- ottimale

- Opzione

- Opzioni

- or

- organizzazioni

- Altro

- altrimenti

- nostro

- su

- produzione

- al di fuori

- ancora

- alto

- panoramica

- proprio

- pagina

- vetro

- parametri

- partner

- Ricambi

- passaggio

- passaggi

- Passato

- appassionato

- passato

- Cartamodello

- percentuale

- performance

- permessi

- Personalizzata

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- punto

- punti

- Termini e Condizioni

- Popolare

- popolarità

- Post

- energia

- alimentato

- potente

- preferenze

- presenti

- presentata

- presents

- precedente

- Direttore

- problemi

- processi

- lavorazione

- processori

- Prodotti

- Progressi

- progetti

- istruzioni

- proprio

- fornire

- purché

- fornisce

- fornitura

- acquisti

- Python

- query

- domanda

- domanda

- Domande

- Presto

- straccio

- che vanno

- RE

- pronto

- di rose

- mondo reale

- tempo reale

- record

- ridurre

- riducendo

- riferimento

- regioni

- regolarmente

- relazionato

- rilevanza

- pertinente

- rimuove

- Report

- deposito

- rappresentare

- richiesta

- necessario

- richiede

- Risorse

- Rispondere

- risposta

- risposte

- richiamo

- problemi

- Le vendite

- recensioni

- strada

- Ruolo

- ruoli

- Correre

- corre

- runtime

- stesso

- campione

- San

- San Francisco

- salvato

- scalabile

- scala

- copione

- sdk

- Cerca

- Sezione

- sezioni

- sicuro

- vedere

- select

- selezionato

- semantico

- inviato

- servire

- serverless

- servizio

- Servizi

- Sessione

- set

- impostazioni

- flessibile.

- azionista

- Azionisti

- lei

- a breve scadenza

- dovrebbero

- vetrina

- significativa

- simile

- contemporaneamente

- singolo

- Taglia

- inferiore

- soluzione

- Soluzioni

- alcuni

- sofisticato

- Fonte

- fonti

- Parla

- specialisti

- specializzata

- specifico

- specificato

- dividere

- Si divide

- pila

- inizia a

- Startup

- Regione / Stato

- Stato dei servizi

- deriva

- step

- Passi

- Tornare al suo account

- memorizzati

- negozi

- memorizzare

- lineare

- Strategia

- snellire

- inviare

- successivo

- sostanzialmente

- Con successo

- tale

- suggerire

- Vertici

- supporto

- supportato

- supporti

- sync.

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- su misura

- Fai

- prende

- task

- Tech

- Tecnologia

- modello

- terminal

- test

- testato

- testo

- di

- che

- Il

- le informazioni

- L’ORIGINE

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- Attraverso

- tempo

- titano

- a

- Trasformare

- innescare

- di fiducia

- prova

- seconda

- Tipi di

- per

- capire

- aggiornamento

- caricato

- uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilità

- v1

- Prezioso

- APPREZZIAMO

- Valori

- vario

- visione

- volume

- volere

- Prima

- guardare

- Modo..

- we

- sito web

- browser web

- servizi web

- Web-basata

- Webinars

- settimana

- Settimane

- ovest

- Che

- quando

- quale

- while

- perché

- volere

- finestra

- con

- Donna

- donne nella tecnologia

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- scrivere

- scrivere codice

- scritto

- YAML

- anno

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro