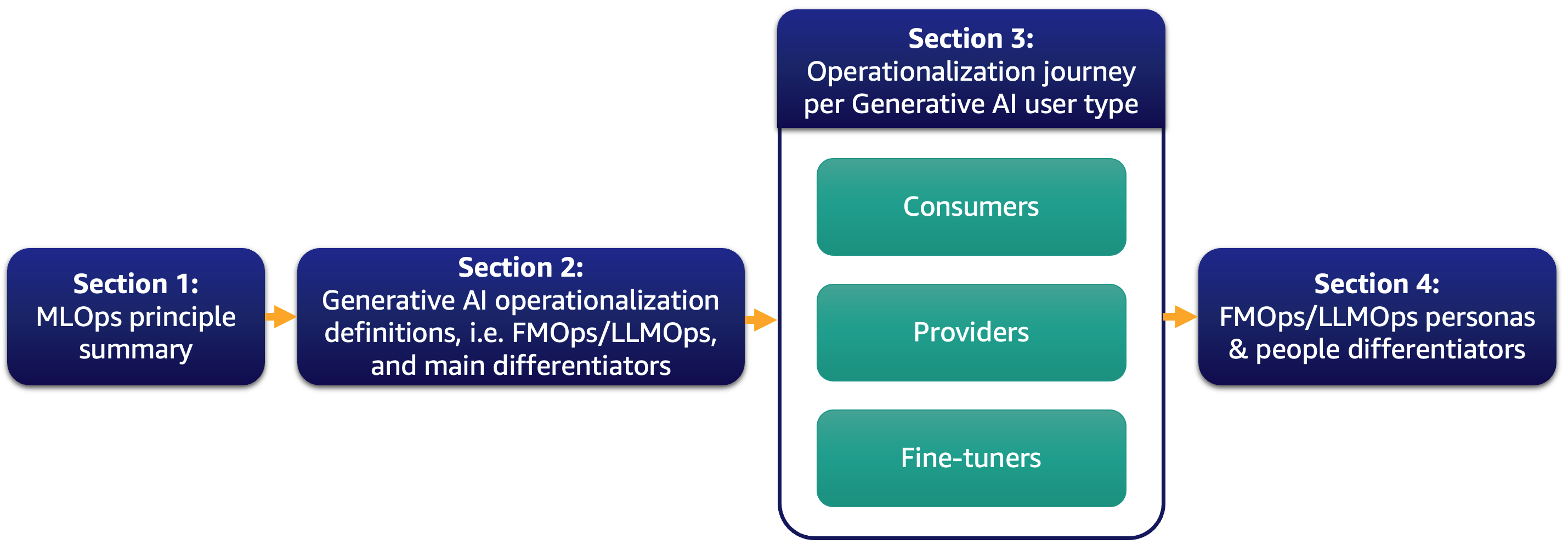

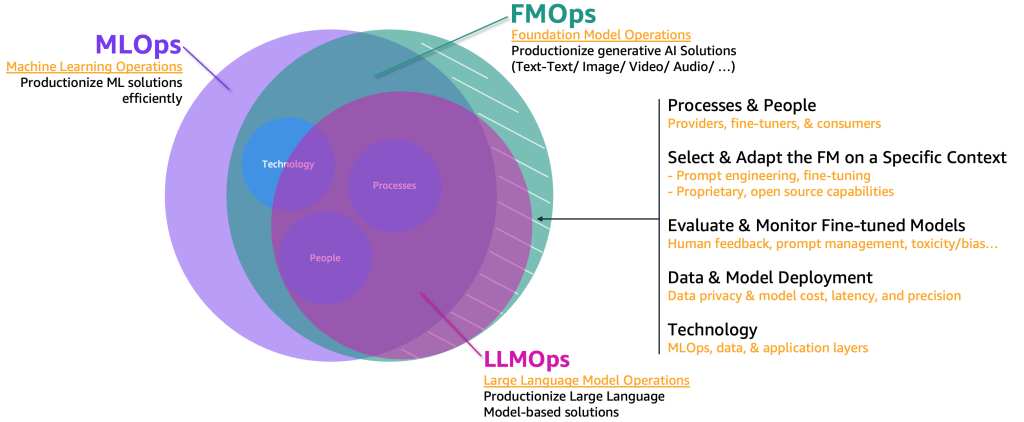

Al giorno d'oggi, la maggior parte dei nostri clienti è entusiasta dei modelli linguistici di grandi dimensioni (LLM) e pensa a come l'intelligenza artificiale generativa potrebbe trasformare il loro business. Tuttavia, portare tali soluzioni e modelli nelle operazioni di business as usual non è un compito facile. In questo post, discutiamo di come rendere operative le applicazioni di intelligenza artificiale generativa utilizzando i principi MLOps che portano alle operazioni del modello di fondazione (FMOps). Inoltre, approfondiamo il caso d'uso più comune dell'intelligenza artificiale generativa delle applicazioni text-to-text e delle operazioni LLM (LLMOps), un sottoinsieme di FMOps. La figura seguente illustra gli argomenti di cui discutiamo.

Nello specifico, introduciamo brevemente i principi MLOps e ci concentriamo sui principali differenziatori rispetto a FMOps e LLMOps riguardanti processi, persone, selezione e valutazione del modello, privacy dei dati e implementazione del modello. Questo vale per i clienti che li utilizzano fuori dagli schemi, creano modelli di base da zero o li perfezionano. Il nostro approccio si applica allo stesso modo sia ai modelli open source che a quelli proprietari.

Riepilogo dell'operazionalizzazione del machine learning

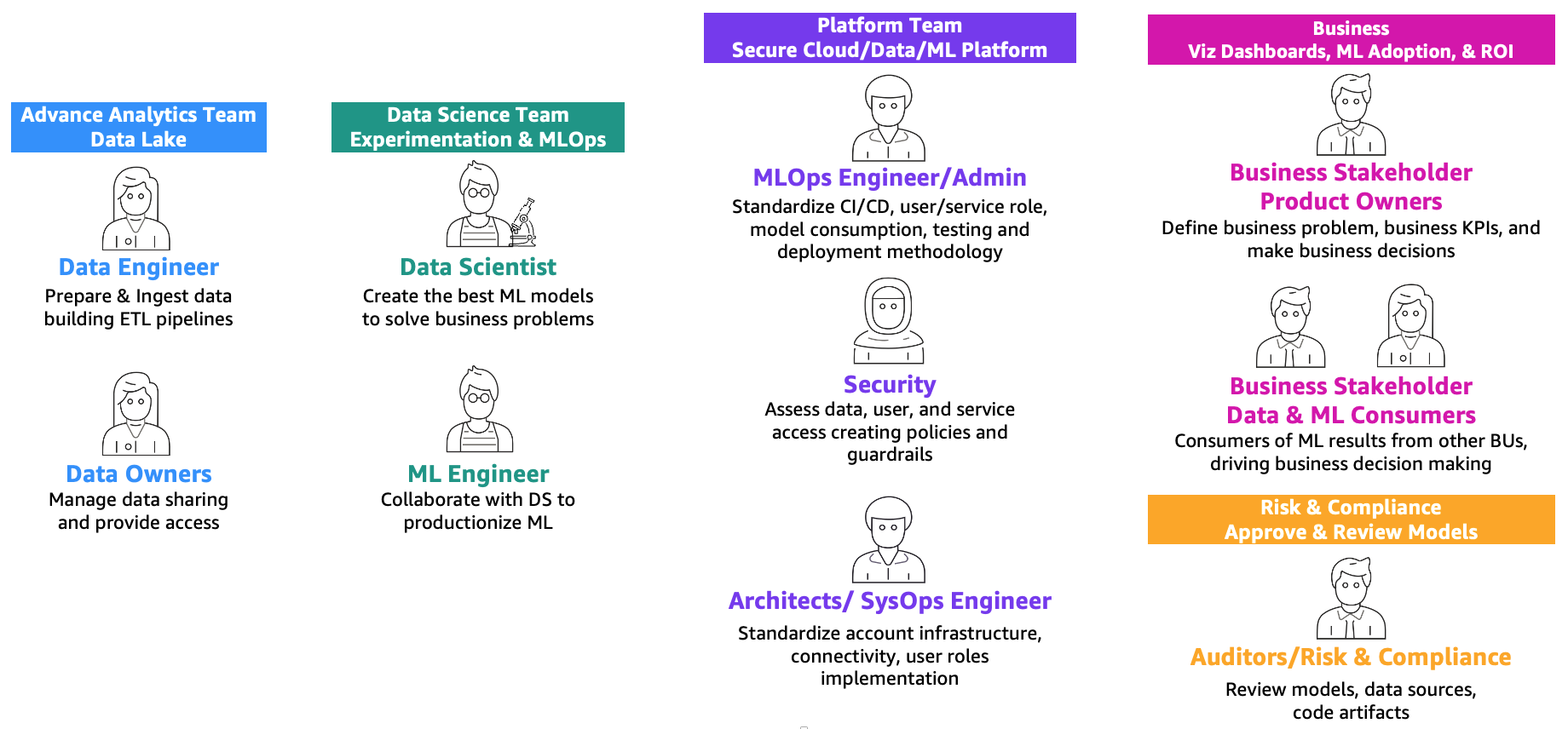

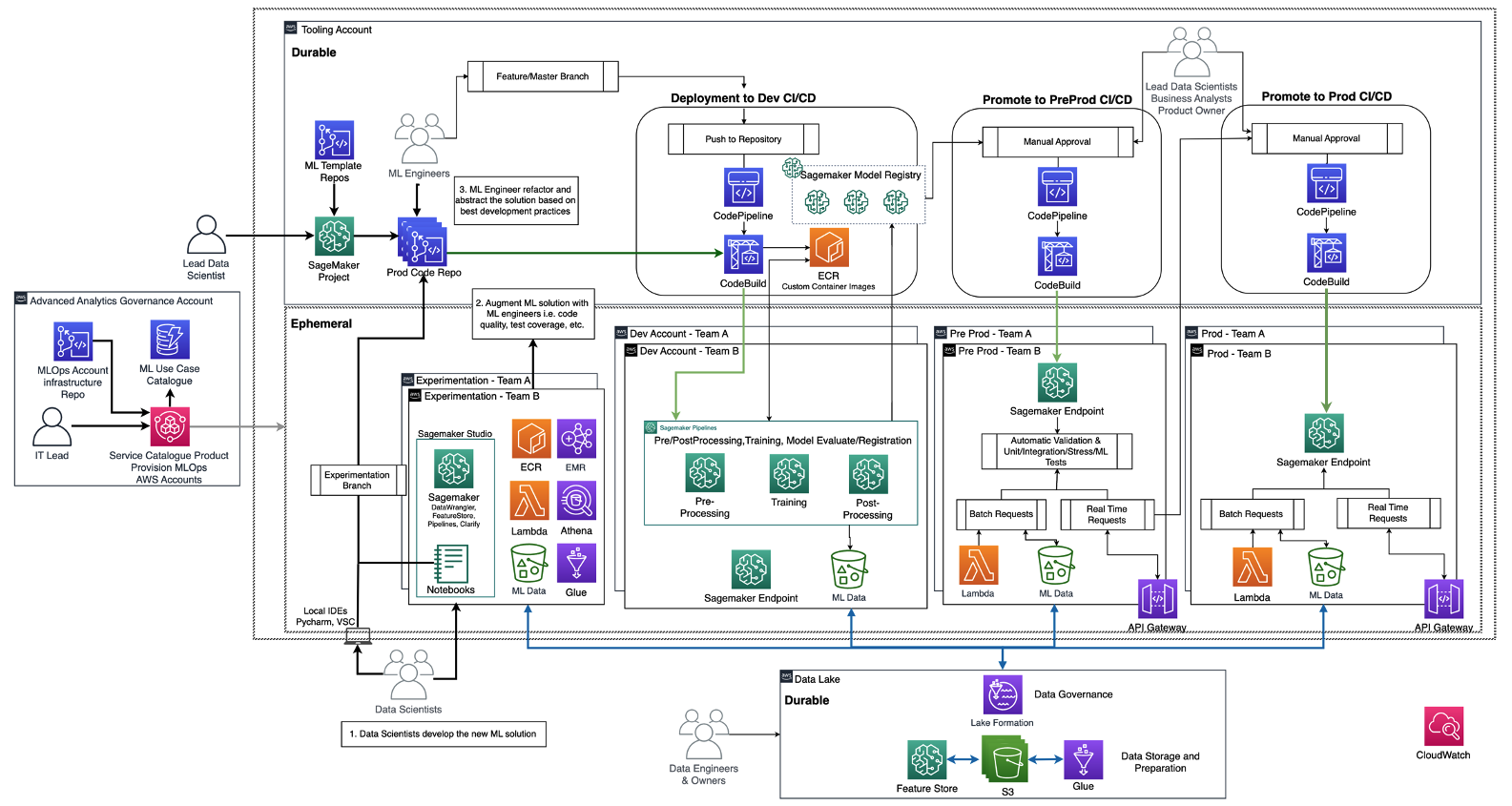

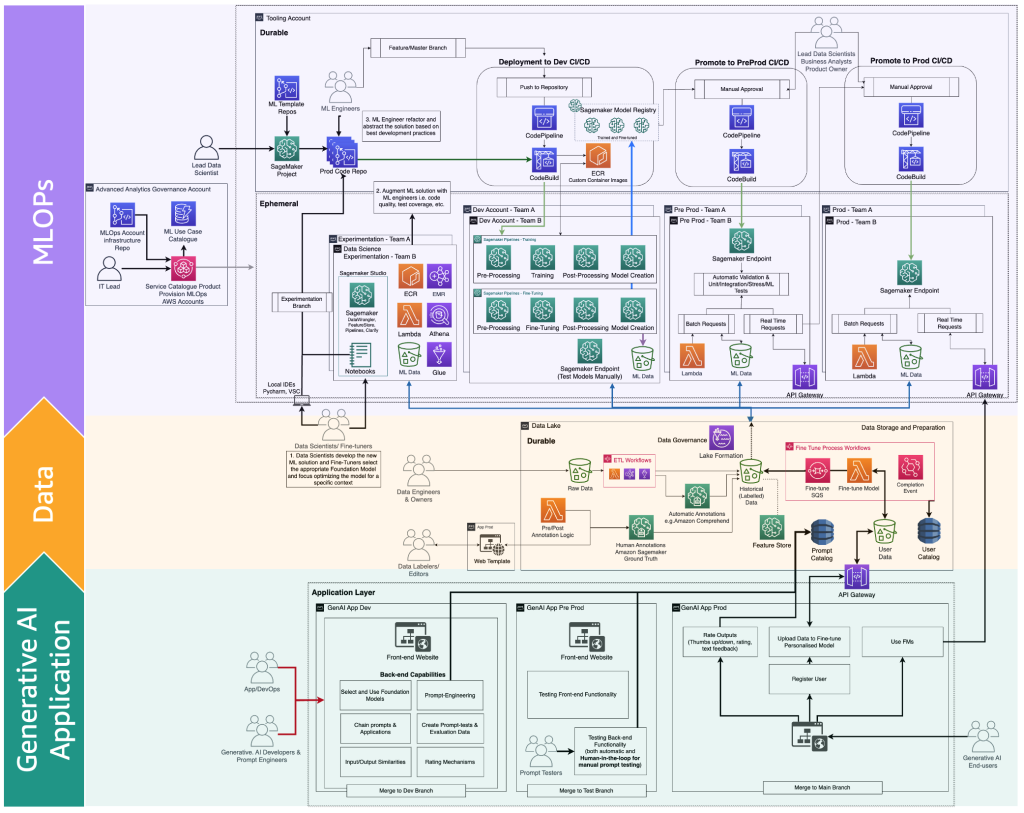

Come definito nel post Roadmap della fondazione MLOps per le aziende con Amazon SageMaker, ML e operazioni (MLOps) è la combinazione di persone, processi e tecnologia per produrre in modo efficiente soluzioni di machine learning (ML). Per raggiungere questo obiettivo, è necessario che una combinazione di team e personaggi collaborino, come illustrato nella figura seguente.

Queste squadre sono le seguenti:

- Team di analisi avanzate (data Lake e data mesh) – I data engineer sono responsabili della preparazione e dell'acquisizione di dati da più fonti, della creazione di pipeline ETL (estrazione, trasformazione e caricamento) per curare e catalogare i dati e preparare i dati storici necessari per i casi d'uso ML. Questi proprietari di dati si concentrano nel fornire l'accesso ai propri dati a più unità aziendali o team.

- Squadra di scienza dei dati – I data scientist devono concentrarsi sulla creazione del modello migliore basato su indicatori chiave di prestazione (KPI) predefiniti che funzionano sui notebook. Dopo il completamento della fase di ricerca, i data scientist devono collaborare con gli ingegneri ML per creare automazioni per la creazione (pipeline ML) e la distribuzione di modelli in produzione utilizzando pipeline CI/CD.

- Squadra di affari – Il proprietario del prodotto è responsabile della definizione del business case, dei requisiti e dei KPI da utilizzare per valutare le prestazioni del modello. I consumatori ML sono altri stakeholder aziendali che utilizzano i risultati dell'inferenza (previsioni) per guidare le decisioni.

- Squadra della piattaforma – Gli architetti sono responsabili dell’architettura cloud complessiva dell’azienda e del modo in cui tutti i diversi servizi sono collegati tra loro. Le PMI legate alla sicurezza rivedono l'architettura in base alle politiche e alle esigenze di sicurezza aziendale. Gli ingegneri MLOps sono responsabili di fornire un ambiente sicuro ai data scientist e agli ingegneri ML per produrre i casi d'uso ML. Nello specifico, sono responsabili della standardizzazione delle pipeline CI/CD, dei ruoli degli utenti e dei servizi e della creazione di contenitori, del consumo dei modelli, dei test e della metodologia di distribuzione in base ai requisiti aziendali e di sicurezza.

- Team rischio e conformità – Per ambienti più restrittivi, i revisori sono responsabili della valutazione dei dati, del codice e degli artefatti del modello e di assicurarsi che l’azienda sia conforme alle normative, come la privacy dei dati.

Tieni presente che più personas possono essere coperti dalla stessa persona a seconda del ridimensionamento e della maturità MLOps dell'azienda.

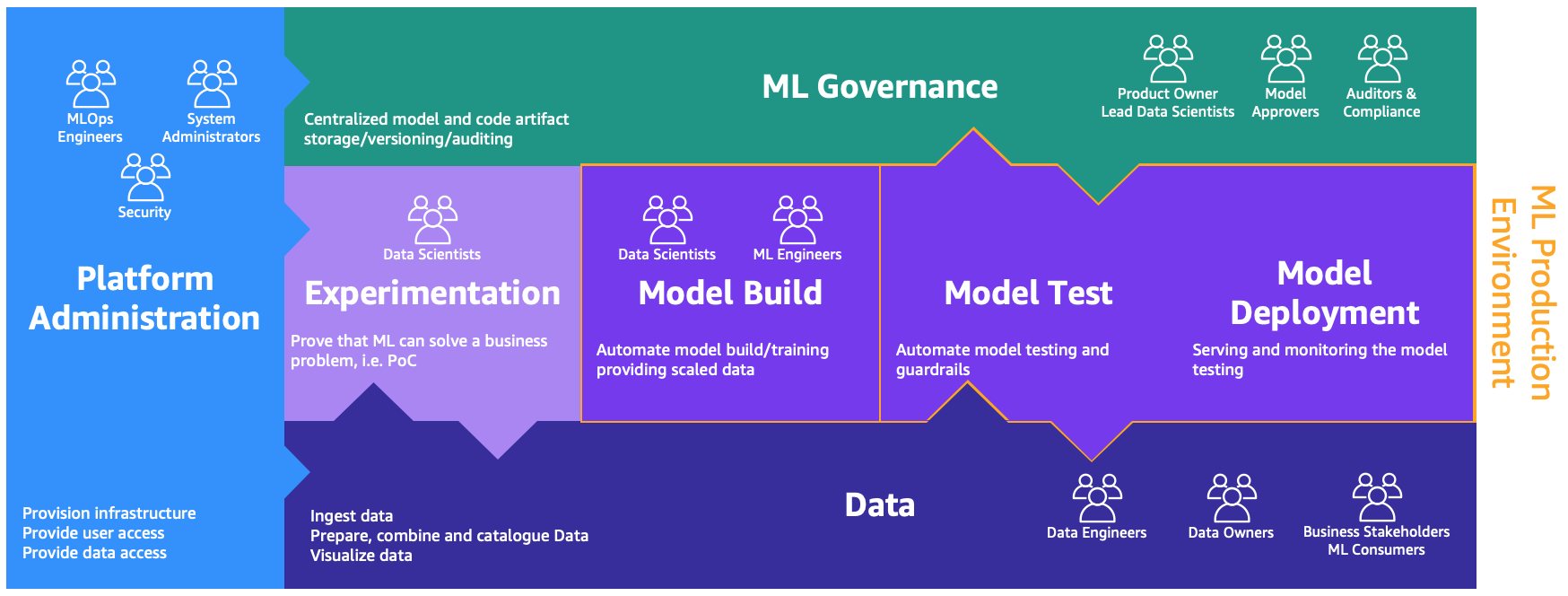

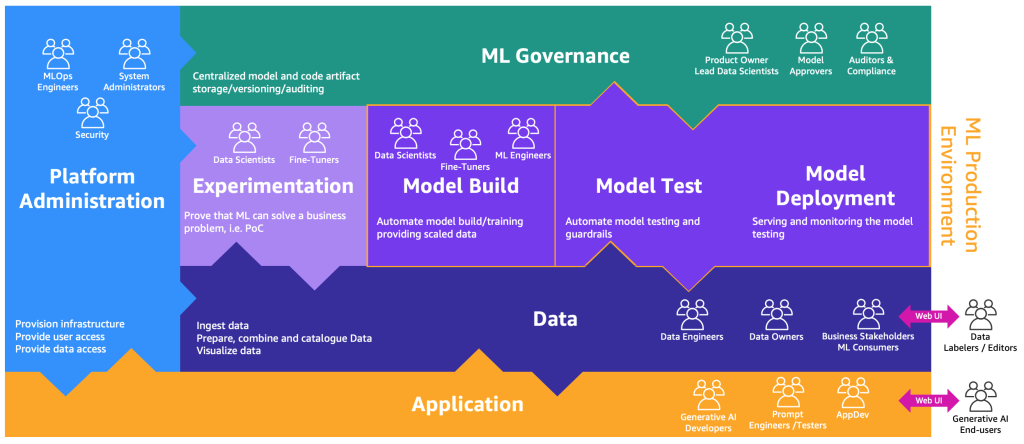

Queste personas necessitano di ambienti dedicati per eseguire i diversi processi, come illustrato nella figura seguente.

Gli ambienti sono i seguenti:

- Amministrazione della piattaforma – L'ambiente di amministrazione della piattaforma è il luogo in cui il team della piattaforma ha accesso per creare account AWS e collegare gli utenti e i dati corretti

- Dati – Il livello dati, spesso noto come data lake o data mesh, è l'ambiente utilizzato dagli ingegneri o proprietari dei dati e dalle parti interessate aziendali per preparare, interagire e visualizzare i dati

- Sperimentazione – I data scientist utilizzano un sandbox o un ambiente di sperimentazione per testare nuove librerie e tecniche ML per dimostrare che la loro prova di concetto può risolvere problemi aziendali

- Creazione del modello, test del modello, distribuzione del modello – L'ambiente di creazione, test e distribuzione del modello è il livello di MLOps, in cui data scientist e ingegneri ML collaborano per automatizzare e spostare la ricerca in produzione

- Governance del machine learning – L’ultimo pezzo del puzzle è l’ambiente di governance ML, in cui tutti gli artefatti del modello e del codice vengono archiviati, rivisti e controllati dai personaggi corrispondenti

Il diagramma seguente illustra l'architettura di riferimento, di cui si è già parlato in Roadmap della fondazione MLOps per le aziende con Amazon SageMaker.

Ciascuna unità aziendale dispone di un proprio set di account di sviluppo (formazione e creazione automatizzata di modelli), preproduzione (test automatico) e produzione (distribuzione e fornitura di modelli) per produrre casi d'uso di ML, che recuperano dati da un data lake centralizzato o decentralizzato o da maglia, rispettivamente. Tutti i modelli prodotti e l'automazione del codice vengono archiviati in un account di strumenti centralizzato utilizzando la funzionalità di un registro dei modelli. Il codice dell'infrastruttura per tutti questi account ha una versione in un account di servizio condiviso (account di governance di analisi avanzata) che il team della piattaforma può astrarre, modellare, mantenere e riutilizzare per l'onboarding sulla piattaforma MLOps di ogni nuovo team.

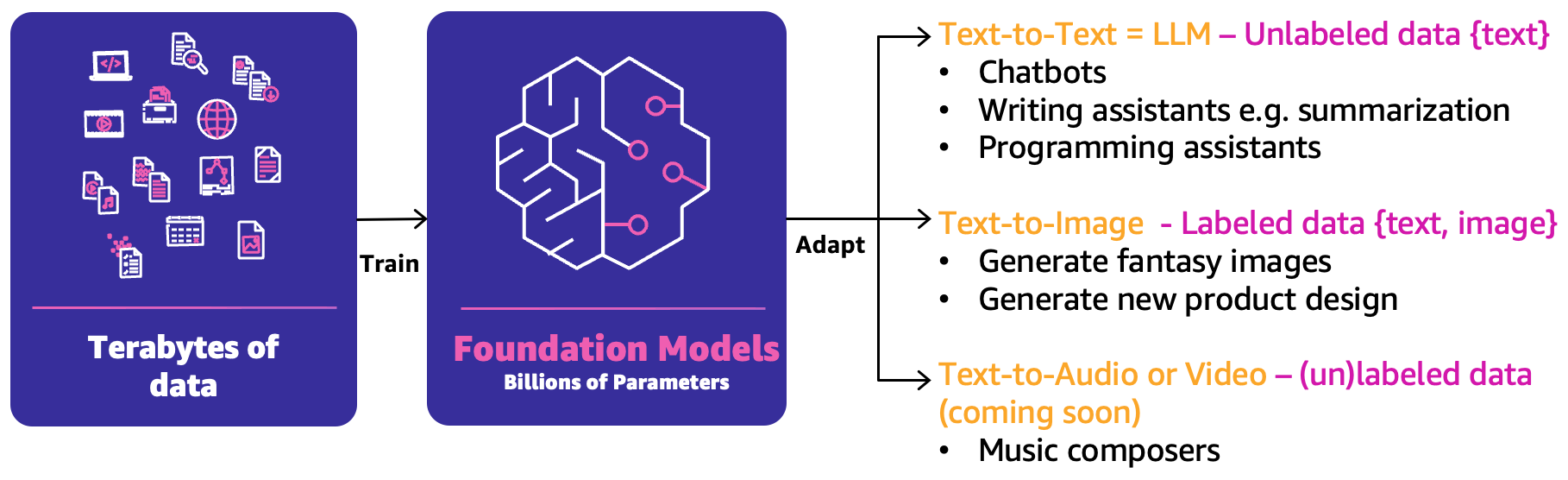

Definizioni di intelligenza artificiale generativa e differenze con MLOps

Nel machine learning classico, la precedente combinazione di persone, processi e tecnologia può aiutarti a realizzare i tuoi casi d'uso di machine learning. Tuttavia, nell’intelligenza artificiale generativa, la natura dei casi d’uso richiede un’estensione di tali capacità o nuove funzionalità. Una di queste nuove nozioni è il modello della fondazione (FM). Sono chiamati così perché possono essere utilizzati per creare un’ampia gamma di altri modelli di IA, come illustrato nella figura seguente.

FM è stato addestrato sulla base di terabyte di dati e dispone di centinaia di miliardi di parametri per essere in grado di prevedere la migliore risposta successiva sulla base di tre categorie principali di casi d'uso dell'intelligenza artificiale generativa:

- Da testo a testo – I FM (LLM) sono stati formati sulla base di dati senza etichetta (come testo libero) e sono in grado di prevedere la parola o sequenza di parole migliore successiva (paragrafi o saggi lunghi). I principali casi d'uso riguardano chatbot di tipo umano, riepilogo o altra creazione di contenuti come codice di programmazione.

- Da testo a immagine – Dati etichettati, come coppie di , è stato utilizzato per addestrare gli FM, che sono in grado di prevedere la migliore combinazione di pixel. Casi d'uso di esempio sono la generazione di design di abbigliamento o immagini personalizzate immaginarie.

- Testo in audio o video – Sia i dati etichettati che quelli senza etichetta possono essere utilizzati per l'allenamento FM. Un esempio principale di caso d’uso dell’intelligenza artificiale generativa è la composizione musicale.

Per produrre questi casi d'uso dell'intelligenza artificiale generativa, dobbiamo prendere in prestito ed estendere il dominio MLOps per includere quanto segue:

- Operazioni FM (FMOps) – Ciò può produrre soluzioni di intelligenza artificiale generativa, incluso qualsiasi tipo di caso d’uso

- Operazioni LLM (LLMOps) – Questo è un sottoinsieme di FOps incentrato sulla produzione di soluzioni basate su LLM, come text-to-text

La figura seguente illustra la sovrapposizione di questi casi d'uso.

Rispetto ai classici ML e MLOps, FMOps e LLMOps differiscono in base a quattro categorie principali che tratteremo nelle sezioni seguenti: persone e processi, selezione e adattamento di FM, valutazione e monitoraggio di FM, privacy dei dati e implementazione del modello ed esigenze tecnologiche. Tratteremo il monitoraggio in un post separato.

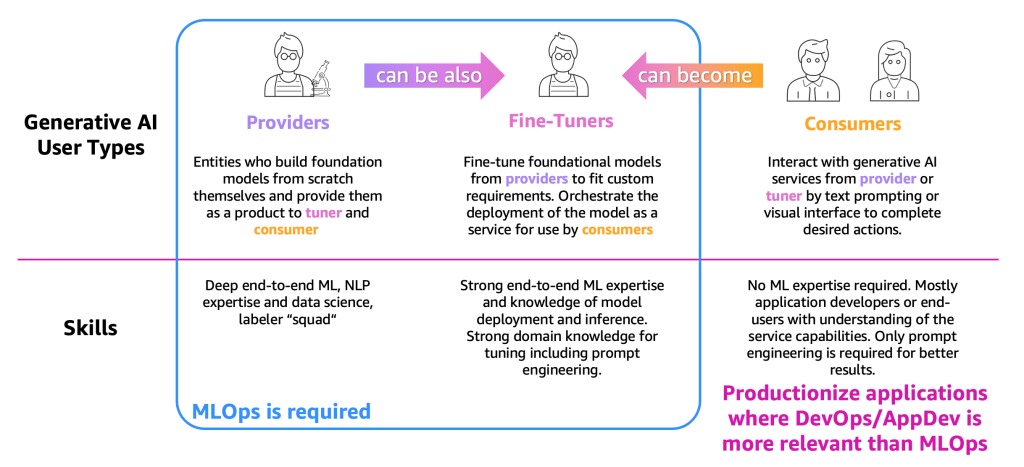

Percorso di operatività per tipo di utente di intelligenza artificiale generativa

Per semplificare la descrizione dei processi, dobbiamo categorizzare le principali tipologie di utenti dell’IA generativa, come mostrato nella figura seguente.

I tipi di utente sono i seguenti:

- provider – Utenti che creano FM da zero e li forniscono come prodotto ad altri utenti (sintonizzatori e consumatori). Hanno una profonda esperienza end-to-end nel machine learning e nell'elaborazione del linguaggio naturale (NLP), nonché competenze in materia di scienza dei dati, nonché enormi team di etichettatori e redattori di dati.

- Sintonizzatori – Utenti che riqualificano (perfezionano) i FM dai fornitori per soddisfare i requisiti personalizzati. Orchestrano l'implementazione del modello come servizio per l'utilizzo da parte dei consumatori. Questi utenti necessitano di una forte esperienza di ML e di scienza dei dati end-to-end e di conoscenza della distribuzione e dell'inferenza dei modelli. È richiesta anche una conoscenza approfondita del dominio per l'ottimizzazione, inclusa la progettazione tempestiva.

- Consumatori – Utenti che interagiscono con servizi di intelligenza artificiale generativa di fornitori o ottimizzatori tramite suggerimenti di testo o un'interfaccia visiva per completare le azioni desiderate. Non è richiesta alcuna competenza in ML ma, soprattutto, sviluppatori di applicazioni o utenti finali che comprendano le funzionalità del servizio. Per ottenere risultati migliori è necessaria solo una tempestiva progettazione.

Secondo la definizione e le competenze ML richieste, MLOps è richiesto principalmente per fornitori e ottimizzatori, mentre i consumatori possono utilizzare i principi di produzione delle applicazioni, come DevOps e AppDev per creare applicazioni di intelligenza artificiale generativa. Inoltre, abbiamo osservato un movimento tra le tipologie di utenti, in cui i fornitori potrebbero diventare perfezionatori per supportare casi d’uso basati su un verticale specifico (come il settore finanziario) o i consumatori potrebbero diventare perfezionatori per ottenere risultati più accurati. Ma osserviamo i principali processi per tipologia di utente.

Il viaggio dei consumatori

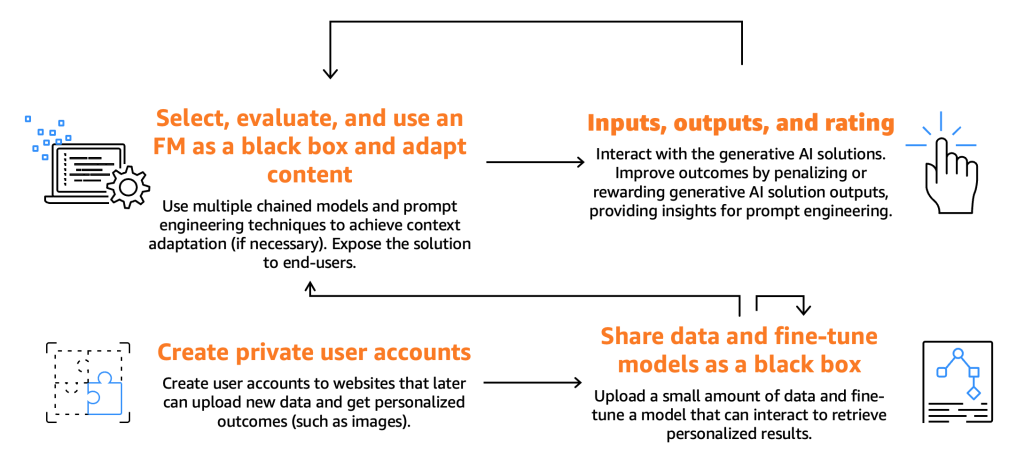

La figura seguente illustra il percorso del consumatore.

Come accennato in precedenza, i consumatori sono tenuti a selezionare, testare e utilizzare un FM, interagendo con esso fornendo input specifici, altrimenti noti come istruzioni. I suggerimenti, nel contesto della programmazione informatica e dell'intelligenza artificiale, si riferiscono all'input fornito a un modello o sistema per generare una risposta. Questo può assumere la forma di un testo, un comando o una domanda, che il sistema utilizza per elaborare e generare un output. L'output generato dal FM può quindi essere utilizzato dagli utenti finali, che dovrebbero anche essere in grado di valutare questi output per migliorare le risposte future del modello.

Al di là di questi processi fondamentali, abbiamo notato che i consumatori esprimono il desiderio di mettere a punto un modello sfruttando le funzionalità offerte dai perfezionatori. Prendi, ad esempio, un sito Web che genera immagini. Qui, gli utenti finali possono impostare account privati, caricare foto personali e successivamente generare contenuti relativi a tali immagini (ad esempio, generare un'immagine raffigurante l'utente finale su una moto che brandisce una spada o si trova in un luogo esotico). In questo scenario, l’applicazione di intelligenza artificiale generativa, progettata dal consumatore, deve interagire con il backend di ottimizzazione tramite API per fornire questa funzionalità agli utenti finali.

Tuttavia, prima di approfondire questo argomento, concentriamoci sul percorso di selezione, test, utilizzo, interazione di input e output e valutazione del modello, come mostrato nella figura seguente.

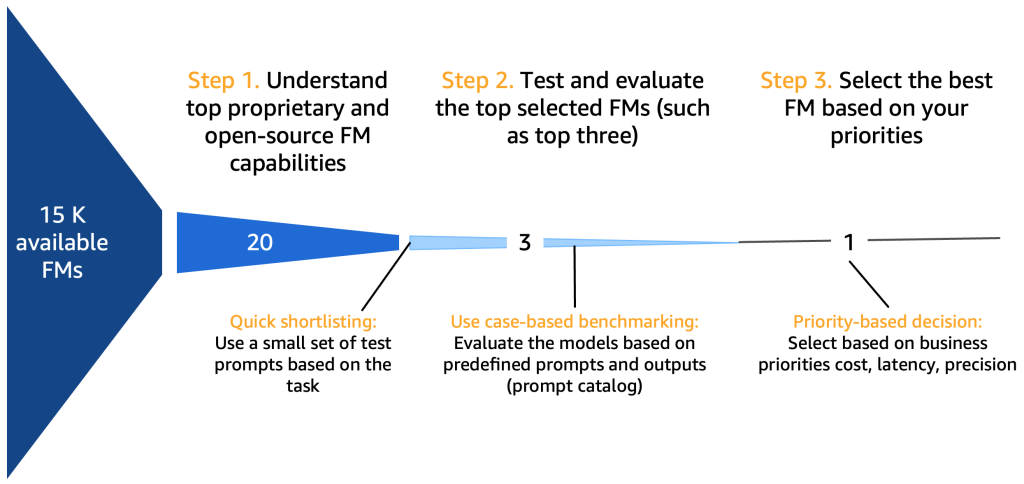

*Riferimento FM disponibile 15K

Passaggio 1. Comprendere le principali funzionalità FM

Ci sono molte dimensioni che devono essere prese in considerazione quando si selezionano i modelli di fondazione, a seconda del caso d'uso, dei dati disponibili, delle normative e così via. Una buona checklist, anche se non esaustiva, potrebbe essere la seguente:

- FM proprietario o open source – I modelli proprietari spesso hanno un costo finanziario, ma in genere offrono prestazioni migliori (in termini di qualità del testo o dell’immagine generata), spesso sviluppati e gestiti da team dedicati di fornitori di modelli che garantiscono prestazioni e affidabilità ottimali. D'altra parte, vediamo anche l'adozione di modelli open source che, oltre ad essere gratuiti, offrono ulteriori vantaggi di essere accessibili e flessibili (ad esempio, ogni modello open source è personalizzabile). Un esempio di modello proprietario è il modello Claude di Anthropic, mentre un esempio di modello open source ad alte prestazioni è Falcon-40B, a partire da luglio 2023.

- Licenza commerciale – Le considerazioni sulla licenza sono cruciali quando si decide su un FM. È importante notare che alcuni modelli sono open source ma non possono essere utilizzati per scopi commerciali, a causa di restrizioni o condizioni di licenza. Le differenze possono essere sottili: il nuovo rilascio xgen-7b-8k-base modello, ad esempio, è open source e utilizzabile commercialmente (licenza Apache-2.0), mentre la versione ottimizzata delle istruzioni del modello xgen-7b-8k-ist viene rilasciato solo a scopo di ricerca. Quando si seleziona un FM per un'applicazione commerciale, è essenziale verificare il contratto di licenza, comprenderne i limiti e assicurarsi che sia in linea con l'uso previsto del progetto.

- parametri – Un altro fattore chiave è il numero di parametri che consistono in pesi e bias nella rete neurale. Un numero maggiore di parametri generalmente significa un modello più complesso e potenzialmente potente, perché può catturare modelli e correlazioni più complessi nei dati. Tuttavia, il compromesso è che richiede più risorse computazionali e, quindi, costa di più da gestire. Inoltre, osserviamo una tendenza verso modelli più piccoli, soprattutto nello spazio open source (modelli che vanno da 7 a 40 miliardi) che funzionano bene, soprattutto se ottimizzati.

- Velocità – La velocità di un modello è influenzata dalle sue dimensioni. I modelli più grandi tendono a elaborare i dati più lentamente (maggiore latenza) a causa della maggiore complessità computazionale. Pertanto, è fondamentale bilanciare la necessità di un modello con elevato potere predittivo (spesso modelli più grandi) con i requisiti pratici di velocità, soprattutto in applicazioni, come i chat bot, che richiedono risposte in tempo reale o quasi.

- Dimensioni della finestra di contesto (numero di token) – La finestra di contesto, definita dal numero massimo di token che possono essere immessi o restituiti per prompt, è fondamentale per determinare la quantità di contesto che il modello può considerare alla volta (un token si traduce approssimativamente in 0.75 parole per l'inglese). I modelli con finestre di contesto più grandi possono comprendere e generare sequenze di testo più lunghe, che possono essere utili per attività che comportano conversazioni o documenti più lunghi.

- Set di dati di formazione – È anche importante capire su che tipo di dati è stato addestrato il FM. Alcuni modelli possono essere addestrati su diversi set di dati di testo come dati Internet, script di codifica, istruzioni o feedback umano. Altri possono anche essere addestrati su set di dati multimodali, come combinazioni di dati di testo e immagini. Ciò può influenzare l'idoneità del modello per compiti diversi. Inoltre, un'organizzazione potrebbe avere problemi di copyright a seconda delle fonti esatte su cui è stato addestrato un modello, pertanto è obbligatorio ispezionare attentamente il set di dati di addestramento.

- Qualità – La qualità di un FM può variare in base al tipo (proprietario o open source), alle dimensioni e a ciò su cui è stato addestrato. La qualità dipende dal contesto, il che significa che ciò che è considerato di alta qualità per un'applicazione potrebbe non esserlo per un'altra. Ad esempio, un modello addestrato sui dati Internet potrebbe essere considerato di alta qualità per la generazione di testo conversazionale, ma meno per compiti tecnici o specializzati.

- Personalizzazione – La capacità di mettere a punto un FM regolando i pesi o gli strati del modello può essere un fattore cruciale. La messa a punto consente al modello di adattarsi meglio al contesto specifico dell'applicazione, migliorando le prestazioni sull'attività specifica da svolgere. Tuttavia, la messa a punto richiede risorse computazionali e competenze tecniche aggiuntive e non tutti i modelli supportano questa funzionalità. I modelli open source sono (in generale) sempre ottimizzabili perché gli artefatti del modello sono disponibili per il download e gli utenti sono in grado di estenderli e utilizzarli a piacimento. I modelli proprietari potrebbero talvolta offrire la possibilità di una messa a punto.

- Competenze esistenti del cliente – La scelta di un FM può essere influenzata anche dalle competenze e dalla familiarità del cliente o del team di sviluppo. Se un'organizzazione non ha esperti di IA/ML nel proprio team, un servizio API potrebbe essere più adatto a loro. Inoltre, se un team ha una vasta esperienza con uno specifico FM, potrebbe essere più efficiente continuare a utilizzarlo piuttosto che investire tempo e risorse per apprendere e adattarsi a uno nuovo.

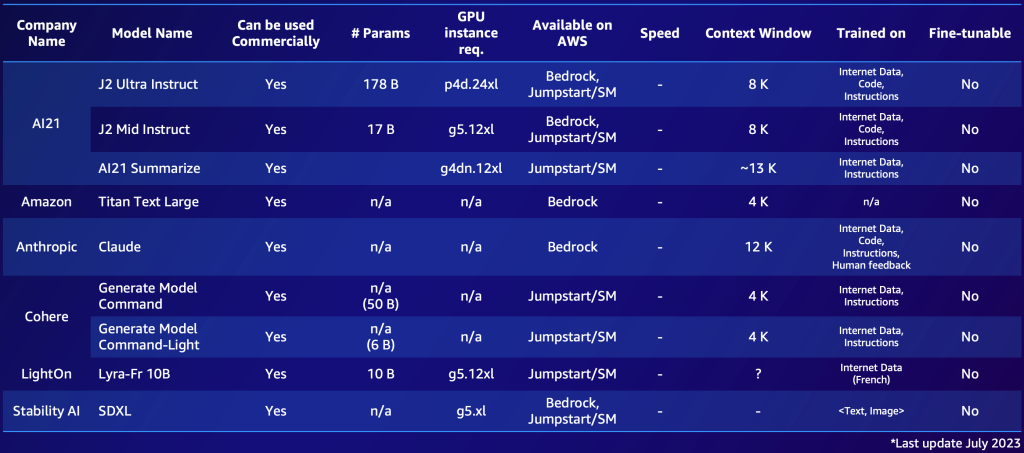

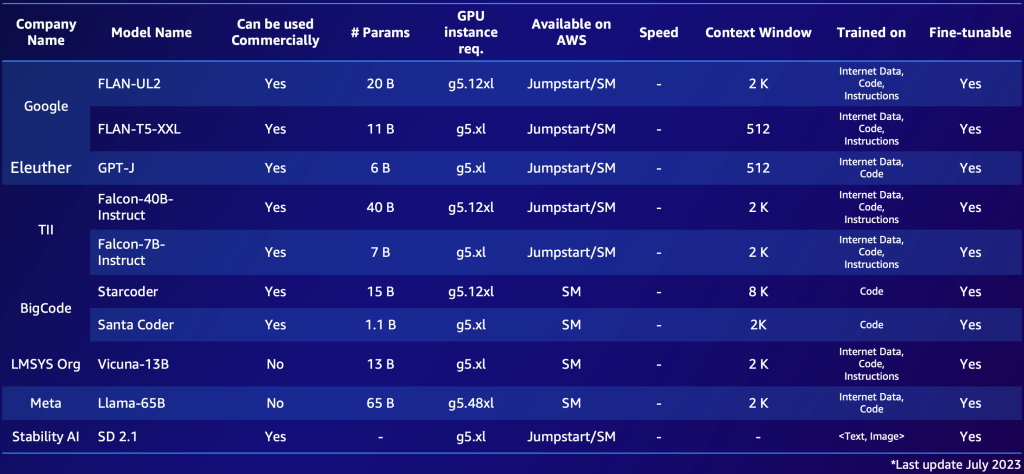

Di seguito è riportato un esempio di due elenchi ristretti, uno per i modelli proprietari e uno per i modelli open source. Potresti compilare tabelle simili in base alle tue esigenze specifiche per ottenere una rapida panoramica delle opzioni disponibili. Tieni presente che le prestazioni e i parametri di questi modelli cambiano rapidamente e potrebbero essere obsoleti al momento della lettura, mentre altre funzionalità potrebbero essere importanti per clienti specifici, come la lingua supportata.

Di seguito è riportato un esempio di FM proprietari degni di nota disponibili in AWS (luglio 2023).

Di seguito è riportato un esempio di notevole FM open source disponibile in AWS (luglio 2023).

Dopo aver compilato una panoramica di 10-20 potenziali modelli candidati, diventa necessario perfezionare ulteriormente questa lista. In questa sezione proponiamo un meccanismo rapido che produrrà due o tre modelli finali praticabili come candidati per il prossimo round.

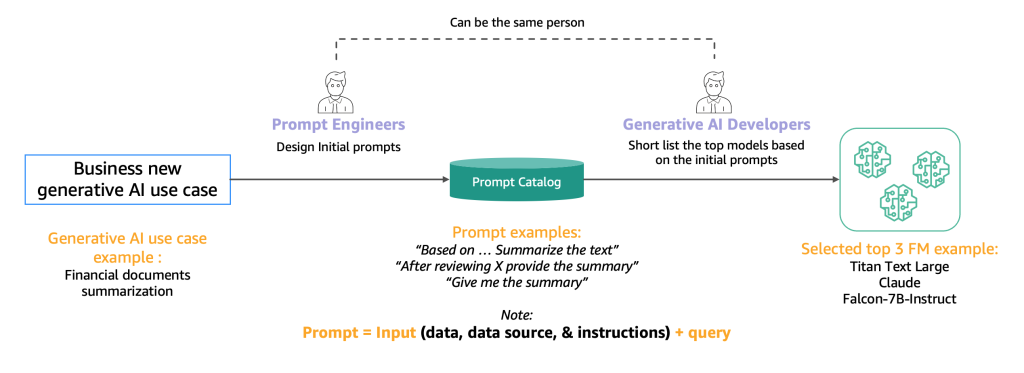

Il diagramma seguente illustra il processo di selezione iniziale.

In genere, i prompt engineer, esperti nella creazione di prompt di alta qualità che consentono ai modelli di intelligenza artificiale di comprendere ed elaborare gli input degli utenti, sperimentano vari metodi per eseguire la stessa attività (come il riepilogo) su un modello. Suggeriamo che questi prompt non vengano creati al volo, ma vengano sistematicamente estratti da un catalogo di prompt. Questo catalogo di prompt è una posizione centrale in cui archiviare i prompt per evitare repliche, abilitare il controllo della versione e condividere i prompt all'interno del team per garantire la coerenza tra i diversi tester dei prompt nelle diverse fasi di sviluppo, che presenteremo nella sezione successiva. Questo catalogo di prompt è analogo a un repository Git di un archivio di funzionalità. Lo sviluppatore di intelligenza artificiale generativa, che potrebbe potenzialmente essere la stessa persona dell’ingegnere tempestivo, deve quindi valutare l’output per determinare se sarebbe adatto all’applicazione di intelligenza artificiale generativa che sta cercando di sviluppare.

Passaggio 2. Testare e valutare la migliore FM

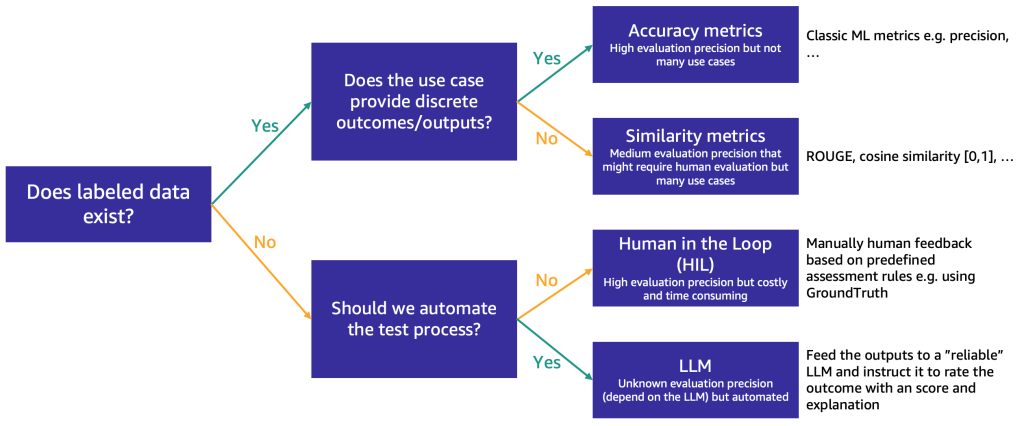

Una volta ridotta la rosa dei candidati a circa tre FM, consigliamo una fase di valutazione per testare ulteriormente le capacità e l'idoneità dei FM per il caso d'uso. A seconda della disponibilità e della natura dei dati di valutazione, suggeriamo metodi diversi, come illustrato nella figura seguente.

Il metodo da utilizzare per primo dipende dal fatto che siano stati etichettati o meno i dati del test.

Se hai etichettato i dati, puoi utilizzarli per condurre una valutazione del modello, come facciamo con i modelli ML tradizionali (inserisci alcuni campioni e confronta l'output con le etichette). A seconda che i dati del test abbiano etichette distinte (come l'analisi del sentiment positivo, negativo o neutro) o siano testo non strutturato (come il riepilogo), proponiamo diversi metodi di valutazione:

- Metriche di precisione – In caso di output discreti (come l’analisi del sentiment), possiamo utilizzare metriche di accuratezza standard come precisione, ricordo e punteggio F1

- Metriche di somiglianza – Se l’output non è strutturato (come un riepilogo), suggeriamo metriche di somiglianza come ROUGE e somiglianza del coseno

Alcuni casi d'uso non si prestano ad avere una risposta vera (ad esempio, "Crea una breve storia per bambini per mia figlia di 5 anni"). In questi casi, diventa più difficile valutare i modelli perché non si hanno dati di test etichettati. Proponiamo due approcci, a seconda dell'importanza della revisione umana del modello rispetto alla valutazione automatizzata:

- Human-in-the-Loop (HIL) – In questo caso, un team di tester tempestivi esaminerà le risposte di un modello. A seconda della criticità dell'applicazione, i tester tempestivi potrebbero esaminare il 100% degli output del modello o solo un campione.

- Valutazione basata su LLM – In questo scenario, i tester tempestivi vengono sostituiti da un LLM, idealmente uno che è più potente (anche se forse più lento e costoso) di quelli in fase di test. Il LLM esaminerà tutte le risposte generate dal modello e le assegnerà un punteggio. Questo metodo può comportare una qualità inferiore, ma è un'opzione di valutazione più economica e rapida che potrebbe fornire un buon indicatore iniziale delle prestazioni dei modelli.

Ad esempio, possiamo utilizzare il seguente prompt di esempio per un LLM, che include la query di input, la risposta LLM e le istruzioni: "Vorremmo richiedere il tuo feedback sulle prestazioni di un assistente AI in risposta alla domanda dell'utente visualizzata sopra . Si prega di valutare l'utilità, la pertinenza, l'accuratezza, il livello di dettaglio della risposta dell'assistente. L'assistente riceverà un punteggio complessivo su una scala da 1 a 10, dove un punteggio più alto indica una prestazione complessiva migliore."

Questo messaggio verrà inviato a un altro LLM (EvalLLM) per la valutazione. Quello che segue è un esempio in cui la risposta del modello Falcon-40B è stata valutata da un EvalLLM (in questo caso Claude). Usiamo la domanda “E se il Canale di Suez non fosse mai stato costruito?” La risposta è la seguente:

Domanda: E se il Canale di Suez non fosse mai stato costruito?

falcon-40b-istruire

Se il Canale di Suez non fosse mai stato costruito, le navi avrebbero dovuto viaggiare intorno all’Africa per navigare tra il Mediterraneo e il Mar Rosso. Ciò aggiungerebbe tempo e distanza significativi al viaggio, rendendolo meno efficiente e più costoso. Inoltre, senza il Canale di Suez, molti paesi del Medio Oriente e del Nord Africa sarebbero stati molto meno collegati al resto del mondo, ostacolando lo sviluppo economico e culturale.

Recensione (punteggio: 9/10)

La risposta dell'assistente è altamente pertinente, accurata e dettagliata. Fornisce un'ottima risposta all'ipotetica domanda dell'utente sull'inesistenza del Canale di Suez. L'assistente sottolinea correttamente le implicazioni sui viaggi marittimi e l'impatto economico e culturale sul Medio Oriente e sul Nord Africa. Tuttavia, per una risposta più completa, avrebbe potuto elaborare ulteriormente le implicazioni geopolitiche o l’impatto sui modelli commerciali globali.

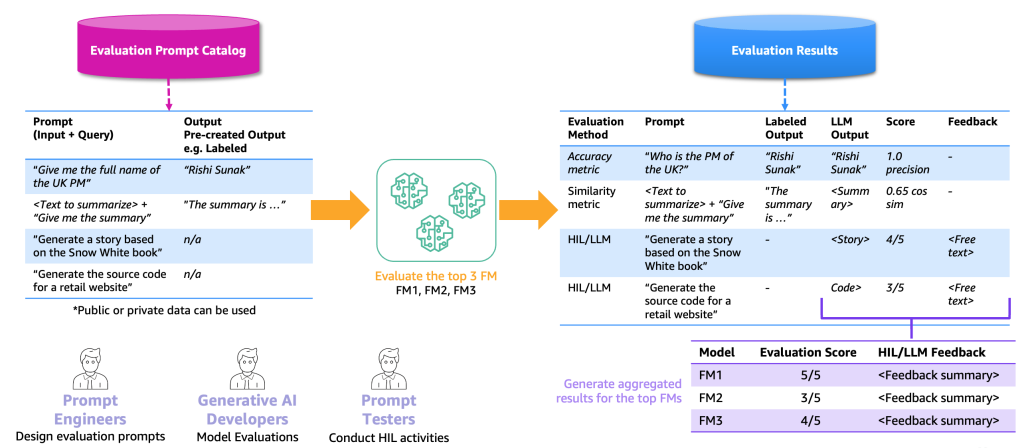

La figura seguente illustra l'esempio del processo di valutazione end-to-end.

Sulla base di questo esempio, per eseguire la valutazione, dobbiamo fornire i prompt di esempio, che memorizziamo nel catalogo dei prompt, e un set di dati di valutazione etichettato o senza etichetta in base alle nostre applicazioni specifiche. Ad esempio, con un set di dati di valutazione etichettato, possiamo fornire suggerimenti (input e query) come “Dammi il nome completo del Primo Ministro del Regno Unito nel 2023” e output e risposte, come “Rishi Sunak”. Con un set di dati senza etichetta, forniamo solo la domanda o l'istruzione, ad esempio "Genera il codice sorgente per un sito web di vendita al dettaglio". Chiameremo la combinazione di catalogo rapido e set di dati di valutazione the catalogo dei suggerimenti di valutazione. Il motivo per cui differenziamo il catalogo dei prompt e il catalogo dei prompt di valutazione è perché quest'ultimo è dedicato a un caso d'uso specifico invece dei prompt e delle istruzioni generiche (come la risposta alle domande) contenuti nel catalogo dei prompt.

Con questo catalogo di suggerimenti di valutazione, il passo successivo è fornire i suggerimenti di valutazione ai migliori FM. Il risultato è un set di dati dei risultati della valutazione che contiene i prompt, gli output di ogni FM e l'output etichettato insieme a un punteggio (se esistente). Nel caso di un catalogo di prompt di valutazione senza etichetta, è previsto un passaggio aggiuntivo per un HIL o LLM per esaminare i risultati e fornire un punteggio e un feedback (come descritto in precedenza). Il risultato finale saranno risultati aggregati che combinano i punteggi di tutti gli output (calcolano la precisione media o la valutazione umana) e consentono agli utenti di valutare la qualità dei modelli.

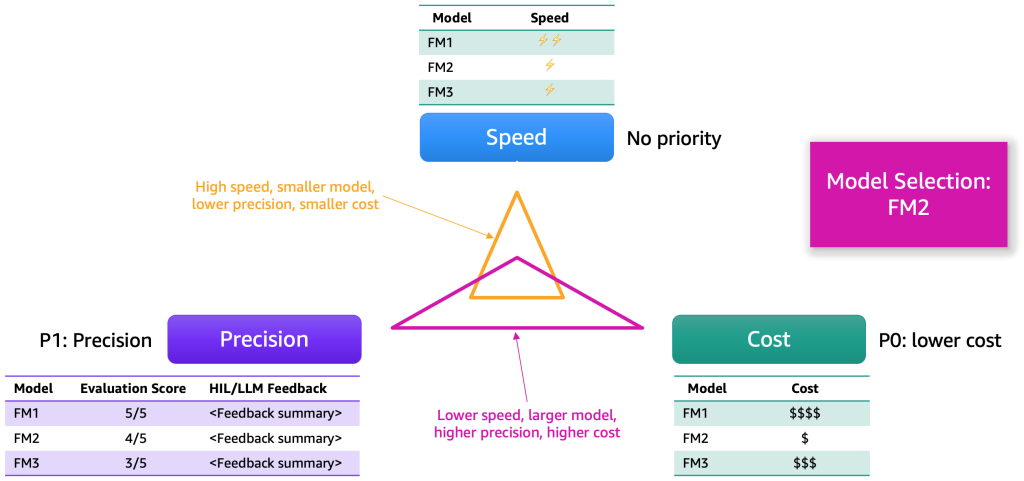

Dopo aver raccolto i risultati della valutazione, proponiamo di scegliere un modello basato su diverse dimensioni. Questi in genere si riducono a fattori quali precisione, velocità e costi. La figura seguente mostra un esempio.

Ciascun modello possiederà punti di forza e alcuni compromessi lungo queste dimensioni. A seconda del caso d’uso, dovremmo assegnare priorità diverse a queste dimensioni. Nell'esempio precedente, abbiamo scelto di dare priorità al costo come fattore più importante, seguito dalla precisione e quindi dalla velocità. Anche se è più lento e non efficiente come FM1, rimane sufficientemente efficace e molto più economico da ospitare. Di conseguenza, potremmo selezionare FM2 come la scelta migliore.

Passaggio 3. Sviluppare il backend e il frontend dell'applicazione IA generativa

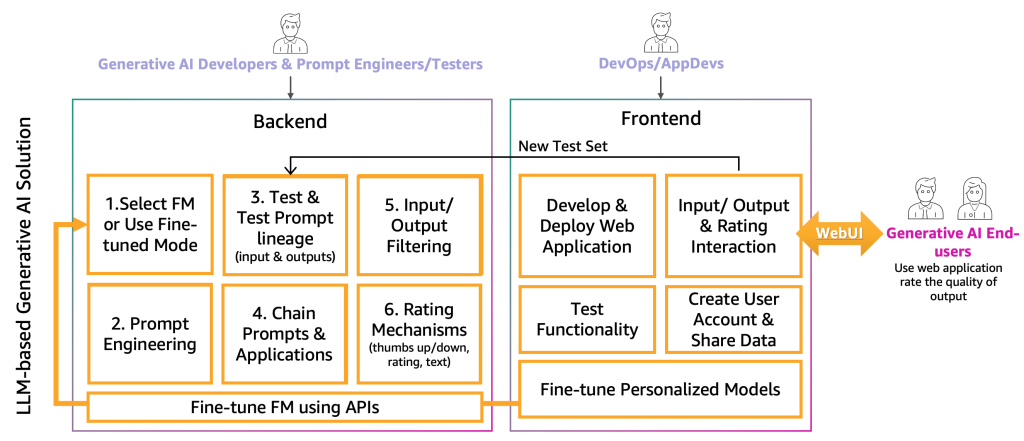

A questo punto, gli sviluppatori di intelligenza artificiale generativa hanno selezionato la FM giusta per l'applicazione specifica insieme all'aiuto di ingegneri e tester tempestivi. Il prossimo passo è iniziare a sviluppare l’applicazione di intelligenza artificiale generativa. Abbiamo separato lo sviluppo dell'applicazione di intelligenza artificiale generativa in due livelli, backend e frontend, come mostrato nella figura seguente.

Sul back-end, gli sviluppatori di intelligenza artificiale generativa incorporano l'FM selezionato nelle soluzioni e collaborano con gli ingegneri dei prompt per creare l'automazione per trasformare l'input dell'utente finale in prompt FM appropriati. I tester dei prompt creano le voci necessarie nel catalogo dei prompt per i test automatici o manuali (HIL o LLM). Quindi, gli sviluppatori di intelligenza artificiale generativa creano il concatenamento rapido e il meccanismo di applicazione per fornire l'output finale. Il concatenamento rapido, in questo contesto, è una tecnica per creare applicazioni LLM più dinamiche e consapevoli del contesto. Funziona suddividendo un'attività complessa in una serie di attività secondarie più piccole e più gestibili. Ad esempio, se poniamo a un LLM la domanda "Dove è nato il primo ministro del Regno Unito e quanto dista quel luogo da Londra", l'attività può essere suddivisa in singoli suggerimenti, dove un suggerimento potrebbe essere creato in base alla risposta di una precedente valutazione tempestiva, come “Chi è il primo ministro del Regno Unito”, “Qual è il loro luogo di nascita” e “Quanto dista quel posto da Londra?” Per garantire una certa qualità di input e output, gli sviluppatori di IA generativa devono anche creare il meccanismo per monitorare e filtrare gli input degli utenti finali e gli output delle applicazioni. Se, ad esempio, si suppone che l'applicazione LLM eviti richieste e risposte tossiche, potrebbe applicare un rilevatore di tossicità per input e output e filtrarli. Infine, devono fornire un meccanismo di valutazione, che supporterà l’ampliamento del catalogo dei suggerimenti di valutazione con esempi buoni e cattivi. Una rappresentazione più dettagliata di tali meccanismi sarà presentata nei post futuri.

Per fornire la funzionalità all'utente finale dell'intelligenza artificiale generativa, è necessario lo sviluppo di un sito Web frontend che interagisca con il backend. Pertanto, i personaggi DevOps e AppDevs (sviluppatori di applicazioni sul cloud) devono seguire le migliori pratiche di sviluppo per implementare la funzionalità di input/output e valutazione.

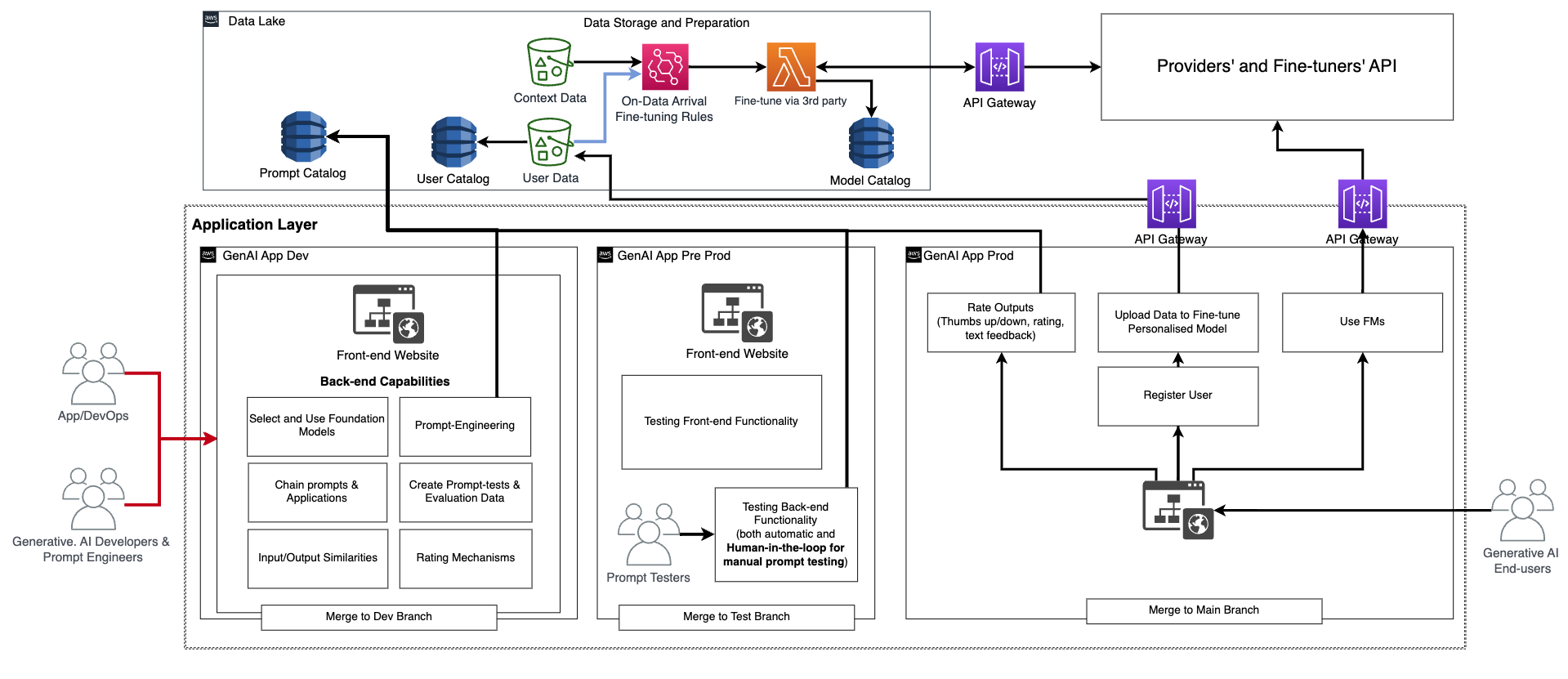

Oltre a questa funzionalità di base, il frontend e il backend devono incorporare la funzionalità di creazione di account utente personali, caricamento di dati, avvio della messa a punto come una scatola nera e utilizzo del modello personalizzato invece del FM di base. La produzione di un'applicazione di intelligenza artificiale generativa è simile a quella di un'applicazione normale. La figura seguente illustra un'architettura di esempio.

In questa architettura, gli sviluppatori di intelligenza artificiale generativa, i prompt engineer e DevOps o AppDev creano e testano manualmente l'applicazione distribuendola tramite CI/CD in un ambiente di sviluppo (AI generativa App Dev nella figura precedente) utilizzando repository di codice dedicati e unendosi con il ramo di sviluppo. In questa fase, gli sviluppatori di intelligenza artificiale generativa utilizzeranno l'FM corrispondente chiamando l'API come fornito dai fornitori FM di fine-tuner. Quindi, per testare l'applicazione in modo approfondito, è necessario promuovere il codice al ramo di test, che attiverà la distribuzione tramite CI/CD nell'ambiente di preproduzione (pre-produzione dell'app AI generativa). In questo ambiente, i tester dei prompt devono provare un gran numero di combinazioni di prompt e rivedere i risultati. La combinazione di prompt, output e revisione deve essere spostata nel catalogo dei prompt di valutazione per automatizzare il processo di test in futuro. Dopo questo test approfondito, l'ultimo passaggio è promuovere l'applicazione di intelligenza artificiale generativa in produzione tramite CI/CD fondendosi con il ramo principale (generative AI App Prod). Tieni presente che tutti i dati, inclusi il catalogo dei prompt, i dati e i risultati della valutazione, i dati e i metadati dell'utente finale e i metadati del modello ottimizzati, devono essere archiviati nel data Lake o nel livello data mesh. Le pipeline e i repository CI/CD devono essere archiviati in un account di strumenti separato (simile a quello descritto per MLOps).

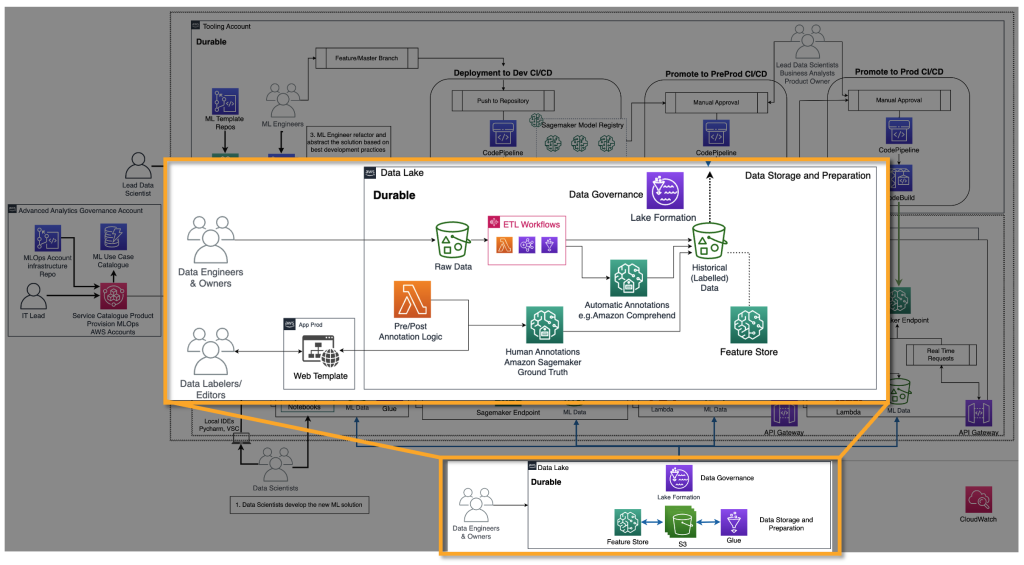

Il viaggio dei fornitori

I fornitori di FM devono formare i FM, come i modelli di deep learning. Per loro, il ciclo di vita e l’infrastruttura MLOps end-to-end sono necessari. Sono necessarie aggiunte nella preparazione dei dati storici, nella valutazione del modello e nel monitoraggio. La figura seguente illustra il loro viaggio.

Nel machine learning classico, i dati storici vengono spesso creati alimentando la verità fondamentale tramite pipeline ETL. Ad esempio, in un caso d'uso di previsione dell'abbandono, un'automazione aggiorna una tabella di database in base al nuovo stato di un cliente per abbandonare/non abbandonare automaticamente. Nel caso dei FM, hanno bisogno di miliardi di punti dati etichettati o non etichettati. Nei casi d'uso da testo a immagine, è necessario che un team di etichettatori di dati esegua l'etichettatura accoppia manualmente. Si tratta di un esercizio costoso che richiede un gran numero di risorse umane. Amazon SageMaker Ground Truth Plus può fornire un team di etichettatori per svolgere questa attività per te. Per alcuni casi d'uso, questo processo può essere anche parzialmente automatizzato, ad esempio utilizzando modelli simili a CLIP. Nel caso di un LLM, come da testo a testo, i dati non sono etichettati. Tuttavia, devono essere preparati e seguire il formato dei dati storici esistenti senza etichetta. Pertanto, sono necessari editor di dati per eseguire la necessaria preparazione dei dati e garantirne la coerenza.

Con i dati storici preparati, il passo successivo è l'addestramento e la produzione del modello. Si noti che è possibile utilizzare le stesse tecniche di valutazione descritte per i consumatori.

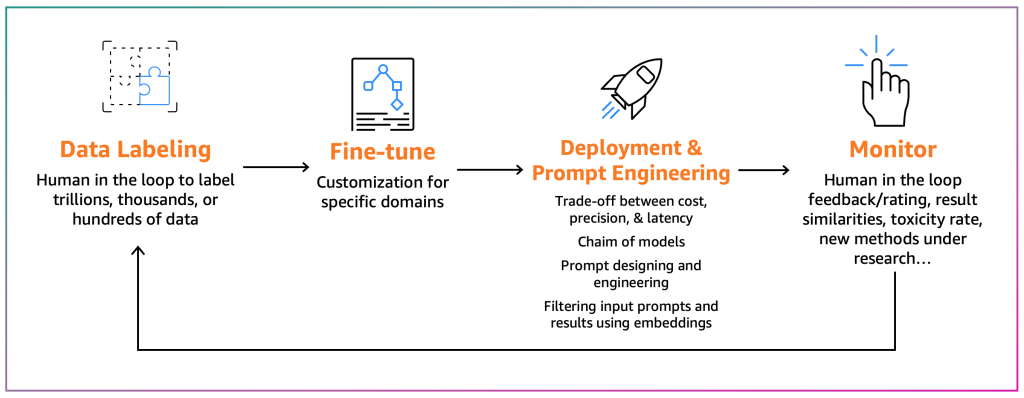

Il viaggio dei perfezionatori

I fine-tuner mirano ad adattare un FM esistente al loro contesto specifico. Ad esempio, un modello FM può riassumere in modo accurato un testo di uso generale ma non un rapporto finanziario o non può generare codice sorgente per un linguaggio di programmazione non comune. In questi casi, i ottimizzatori devono etichettare i dati, mettere a punto un modello eseguendo un processo di formazione, implementare il modello, testarlo in base ai processi del consumatore e monitorare il modello. Il diagramma seguente illustra questo processo.

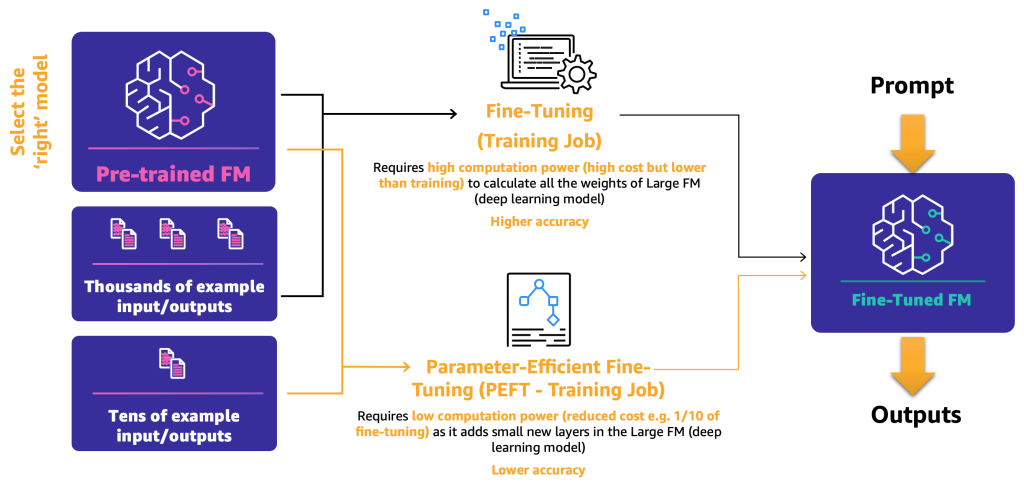

Per il momento esistono due meccanismi di messa a punto:

- Ritocchi – Utilizzando un FM e dati etichettati, un processo di training ricalcola i pesi e i pregiudizi dei livelli del modello di deep learning. Questo processo può essere intensivo dal punto di vista computazionale e richiede una quantità rappresentativa di dati, ma può generare risultati accurati.

- Regolazione fine efficiente dei parametri (PEFT) – Invece di ricalcolare tutti i pesi e i bias, i ricercatori hanno dimostrato che aggiungendo ulteriori piccoli strati ai modelli di deep learning, si possono ottenere risultati soddisfacenti (ad esempio, LORA). PEFT richiede una potenza di calcolo inferiore rispetto alla messa a punto approfondita e un lavoro di formazione con meno dati di input. Lo svantaggio è una potenziale minore precisione.

Il diagramma seguente illustra questi meccanismi.

Ora che abbiamo definito i due principali metodi di messa a punto, il passo successivo è determinare come possiamo implementare e utilizzare il FM proprietario e open source.

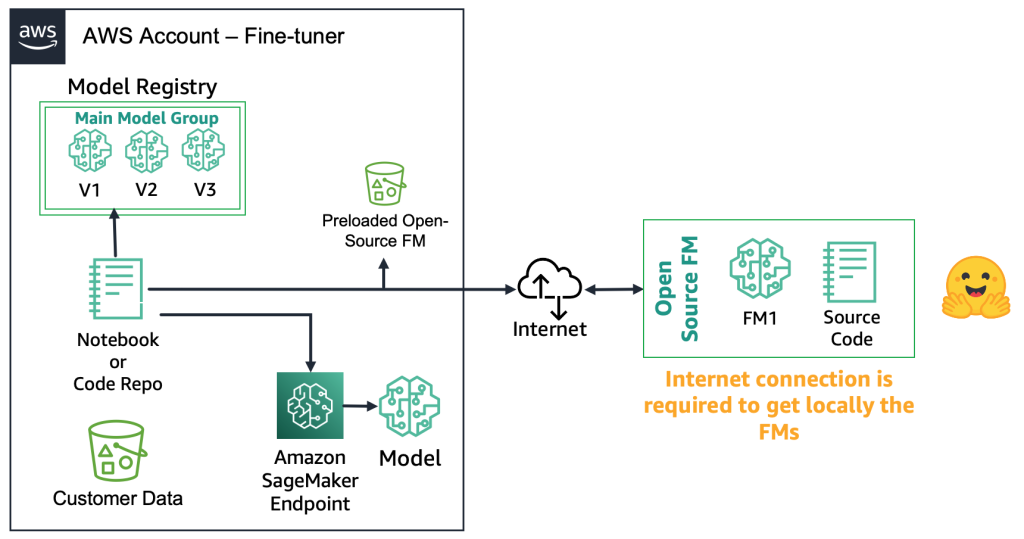

Con gli FM open source, i perfezionatori possono scaricare l'artefatto del modello e il codice sorgente dal web, ad esempio, utilizzando il Hub del modello del viso che abbraccia. Ciò ti offre la flessibilità di ottimizzare in modo approfondito il modello, archiviarlo in un registro del modello locale e distribuirlo in un file Amazon Sage Maker punto finale. Questo processo richiede una connessione Internet. Per supportare ambienti più sicuri (ad esempio per i clienti del settore finanziario), puoi scaricare il modello in locale, eseguire tutti i controlli di sicurezza necessari e caricarli in un bucket locale su un account AWS. Quindi, i sintonizzatori utilizzano la FM dal bucket locale senza una connessione Internet. Ciò garantisce la privacy dei dati e i dati non viaggiano su Internet. Il diagramma seguente illustra questo metodo.

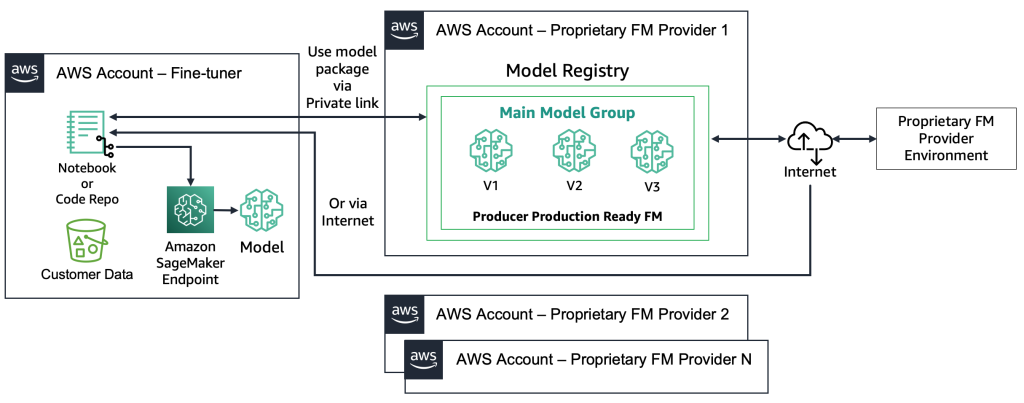

Con i FM proprietari, il processo di distribuzione è diverso perché i regolatori non hanno accesso all'artefatto del modello o al codice sorgente. I modelli sono archiviati negli account AWS e nei registri dei modelli del provider FM proprietario. Per distribuire un modello di questo tipo su un endpoint SageMaker, i ottimizzatori possono richiedere solo il pacchetto del modello che verrà distribuito direttamente su un endpoint. Questo processo richiede l'utilizzo dei dati dei clienti negli account dei fornitori FM proprietari, il che solleva dubbi riguardanti i dati sensibili del cliente utilizzati in un account remoto per eseguire la messa a punto e i modelli ospitati in un registro dei modelli condiviso tra più clienti . Ciò porta a un problema multi-tenancy che diventa più impegnativo se i fornitori FM proprietari devono servire questi modelli. Se i perfezionatori utilizzano Roccia Amazzonica, queste sfide sono state risolte: i dati non viaggiano su Internet e i fornitori FM non hanno accesso ai dati dei sintonizzatori. Le stesse sfide valgono per i modelli open source se i perfezionatori vogliono servire modelli di più clienti, come l'esempio che abbiamo fornito in precedenza con il sito Web su cui migliaia di clienti caricheranno immagini personalizzate. Tuttavia, questi scenari possono essere considerati controllabili perché è coinvolto solo il fine-tuner. Il diagramma seguente illustra questo metodo.

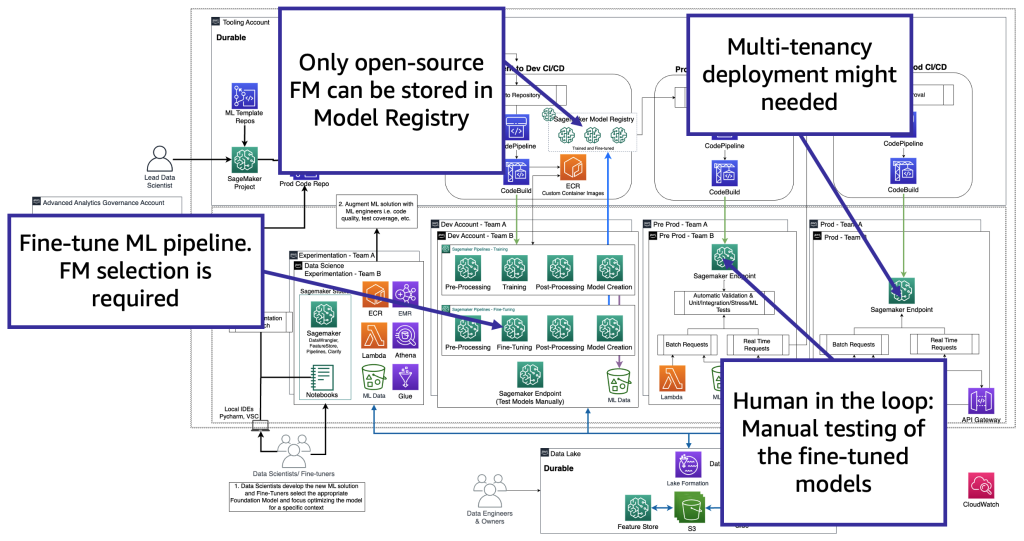

Dal punto di vista tecnologico, l'architettura che un fine-tuner deve supportare è simile a quella di MLOps (vedere la figura seguente). La messa a punto deve essere condotta in fase di sviluppo creando pipeline ML, come using Pipeline di Amazon SageMaker; eseguire la preelaborazione, la messa a punto (lavoro di formazione) e la postelaborazione; e invio dei modelli ottimizzati a un registro di modelli locale nel caso di un FM open source (altrimenti, il nuovo modello verrà archiviato nell'ambiente di fornitura FM proprietario). Quindi, in pre-produzione, dobbiamo testare il modello descritto per lo scenario dei consumatori. Infine il modello verrà servito e monitorato in prod. Tieni presente che l'attuale FM (ottimizzato) richiede endpoint di istanze GPU. Se dobbiamo distribuire ciascun modello ottimizzato su un endpoint separato, ciò potrebbe aumentare il costo nel caso di centinaia di modelli. Pertanto, dobbiamo utilizzare endpoint multi-modello e risolvere la sfida multi-tenancy.

I fine-tuner adattano un modello FM basato su un contesto specifico per utilizzarlo per i loro scopi aziendali. Ciò significa che, nella maggior parte dei casi, i perfezionatori sono anche consumatori tenuti a supportare tutti i livelli, come descritto nelle sezioni precedenti, incluso lo sviluppo di applicazioni di intelligenza artificiale generativa, data Lake, data mesh e MLOps.

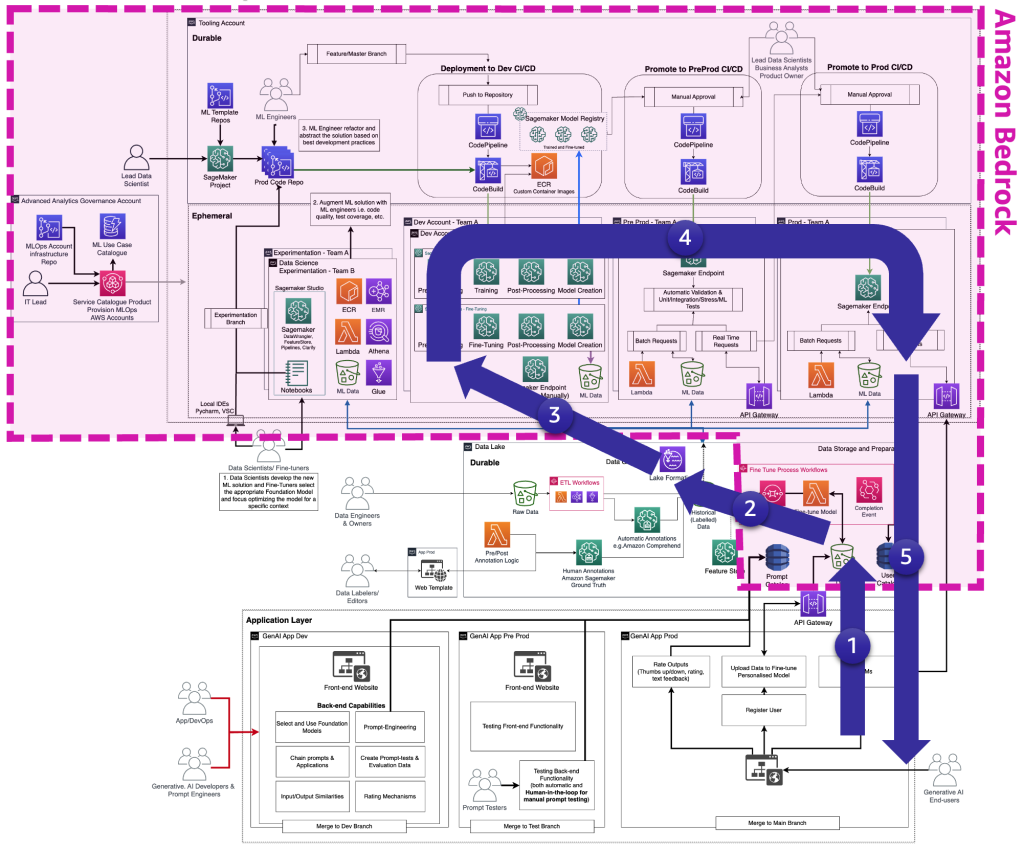

La figura seguente illustra il ciclo di vita completo della messa a punto FM di cui i regolatori hanno bisogno per fornire all'utente finale dell'IA generativa.

La figura seguente illustra i passaggi chiave.

I passaggi chiave sono i seguenti:

- L'utente finale crea un account personale e carica dati privati.

- I dati vengono archiviati nel data Lake e preelaborati per seguire il formato previsto da FM.

- Ciò attiva una pipeline ML di perfezionamento che aggiunge il modello al registro del modello,

- Da lì, il modello viene distribuito in produzione con test minimi oppure il modello spinge test approfonditi con HIL e cancelli di approvazione manuale.

- Il modello ottimizzato viene reso disponibile agli utenti finali.

Poiché questa infrastruttura è complessa per i clienti non aziendali, AWS ha rilasciato Amazon Bedrock per scaricare lo sforzo di creare tali architetture e avvicinare i FM ottimizzati alla produzione.

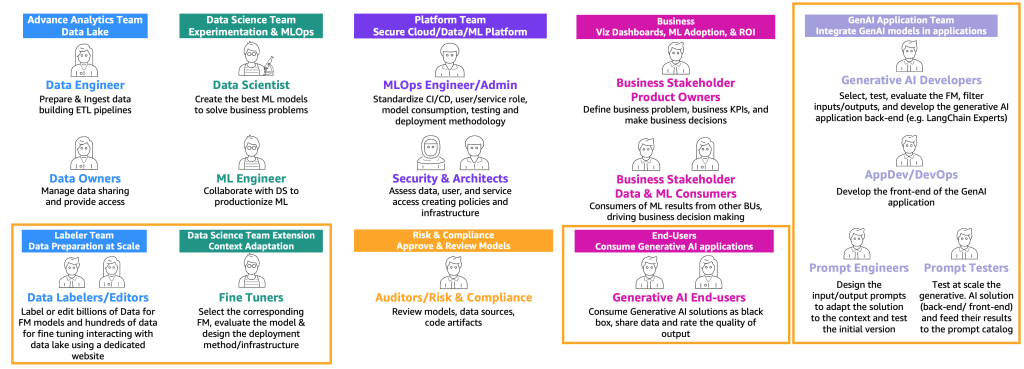

Personas FMops e LLMOps e differenziatori dei processi

Sulla base dei precedenti percorsi di tipo utente (consumatore, produttore e perfezionatore), sono richieste nuove personas con competenze specifiche, come illustrato nella figura seguente.

I nuovi personaggi sono i seguenti:

- Etichettatori ed editori di dati – Questi utenti etichettano i dati, come accoppia o prepara dati senza etichetta, come testo libero, ed estende il team di analisi avanzata e gli ambienti data lake.

- Sintonizzatori – Questi utenti hanno una conoscenza approfondita dei FM e sanno come ottimizzarli, ampliando il team di data science che si concentrerà sul machine learning classico.

- Sviluppatori di intelligenza artificiale generativa – Hanno una conoscenza approfondita della selezione di FM, del concatenamento di prompt e applicazioni e del filtraggio di input e output. Appartengono a un nuovo team: il team delle applicazioni di intelligenza artificiale generativa.

- Ingegneri pronti – Questi utenti progettano i prompt di input e output per adattare la soluzione al contesto e testare e creare la versione iniziale del catalogo dei prompt. Il loro team è il team dell’applicazione dell’intelligenza artificiale generativa.

- Tester rapidi – Testano su larga scala la soluzione di intelligenza artificiale generativa (backend e frontend) e alimentano i loro risultati per aumentare il catalogo tempestivo e il set di dati di valutazione. Il loro team è il team dell’applicazione dell’intelligenza artificiale generativa.

- AppDev e DevOps – Sviluppano il front-end (come un sito Web) dell’applicazione di intelligenza artificiale generativa. Il loro team è il team dell’applicazione dell’intelligenza artificiale generativa.

- Utenti finali dell'intelligenza artificiale generativa – Questi utenti utilizzano applicazioni di intelligenza artificiale generativa come scatole nere, condividono dati e valutano la qualità dell’output.

La versione estesa della mappa dei processi MLOps per incorporare l'intelligenza artificiale generativa può essere illustrata con la figura seguente.

Un nuovo livello applicativo è l’ambiente in cui gli sviluppatori di intelligenza artificiale generativa, i prompt engineer, i tester e gli AppDev hanno creato il backend e il front-end delle applicazioni di intelligenza artificiale generativa. Gli utenti finali dell'intelligenza artificiale generativa interagiscono con il front-end delle applicazioni di intelligenza artificiale generativa tramite Internet (come un'interfaccia utente web). D’altro canto, gli etichettatori e gli editor dei dati devono preelaborare i dati senza accedere al backend del data Lake o del data mesh. Pertanto, per interagire in modo sicuro con i dati è necessaria un'interfaccia utente Web (sito Web) con un editor. SageMaker Ground Truth fornisce questa funzionalità immediatamente.

Conclusione

MLOps può aiutarci a produrre modelli ML in modo efficiente. Tuttavia, per rendere operative le applicazioni di intelligenza artificiale generativa, sono necessari competenze, processi e tecnologie aggiuntivi, che portino a FMOps e LLMOps. In questo post, abbiamo definito i concetti principali di FMOps e LLMOps e descritto i principali differenziatori rispetto alle capacità di MLOps in termini di persone, processi, tecnologia, selezione del modello FM e valutazione. Inoltre, abbiamo illustrato il processo di pensiero di uno sviluppatore di IA generativa e il ciclo di vita di sviluppo di un'applicazione di IA generativa.

In futuro, ci concentreremo sulla fornitura di soluzioni per il dominio di cui abbiamo discusso e forniremo maggiori dettagli su come integrare il monitoraggio FM (come tossicità, bias e allucinazioni) e modelli architettonici di fonti dati private o di terze parti, come Recupero Augmented Generation (RAG), in FMOps/LLMOps.

Per saperne di più, fare riferimento a Roadmap della fondazione MLOps per le aziende con Amazon SageMaker e provare la soluzione end-to-end in Implementazione di pratiche MLOps con modelli preaddestrati di Amazon SageMaker JumpStart.

Se hai commenti o domande, ti preghiamo di lasciarli nella sezione commenti.

Informazioni sugli autori

Dott. Sokratis Kartakis è un Senior Machine Learning and Operations Specialist Solutions Architect per Amazon Web Services. Sokratis si concentra nel consentire ai clienti aziendali di industrializzare le proprie soluzioni di Machine Learning (ML) sfruttando i servizi AWS e modellando il proprio modello operativo, ovvero la base MLOps, e la roadmap di trasformazione sfruttando le migliori pratiche di sviluppo. Ha trascorso più di 15 anni a inventare, progettare, guidare e implementare soluzioni innovative di ML e Internet of Things (IoT) a livello di produzione end-to-end nei settori dell'energia, vendita al dettaglio, salute, finanza/banche, sport motoristici, ecc. A Sokratis piace trascorrere il tempo libero con la famiglia e gli amici o andare in moto.

Dott. Sokratis Kartakis è un Senior Machine Learning and Operations Specialist Solutions Architect per Amazon Web Services. Sokratis si concentra nel consentire ai clienti aziendali di industrializzare le proprie soluzioni di Machine Learning (ML) sfruttando i servizi AWS e modellando il proprio modello operativo, ovvero la base MLOps, e la roadmap di trasformazione sfruttando le migliori pratiche di sviluppo. Ha trascorso più di 15 anni a inventare, progettare, guidare e implementare soluzioni innovative di ML e Internet of Things (IoT) a livello di produzione end-to-end nei settori dell'energia, vendita al dettaglio, salute, finanza/banche, sport motoristici, ecc. A Sokratis piace trascorrere il tempo libero con la famiglia e gli amici o andare in moto.

Heiko Hotz è un Senior Solutions Architect per l'intelligenza artificiale e l'apprendimento automatico con particolare attenzione all'elaborazione del linguaggio naturale, ai modelli linguistici di grandi dimensioni e all'intelligenza artificiale generativa. Prima di ricoprire questo ruolo, è stato responsabile della scienza dei dati per il servizio clienti UE di Amazon. Heiko aiuta i nostri clienti ad avere successo nel loro percorso AI/ML su AWS e ha collaborato con organizzazioni in molti settori, tra cui assicurazioni, servizi finanziari, media e intrattenimento, sanità, servizi pubblici e produzione. Nel tempo libero Heiko viaggia il più possibile.

Heiko Hotz è un Senior Solutions Architect per l'intelligenza artificiale e l'apprendimento automatico con particolare attenzione all'elaborazione del linguaggio naturale, ai modelli linguistici di grandi dimensioni e all'intelligenza artificiale generativa. Prima di ricoprire questo ruolo, è stato responsabile della scienza dei dati per il servizio clienti UE di Amazon. Heiko aiuta i nostri clienti ad avere successo nel loro percorso AI/ML su AWS e ha collaborato con organizzazioni in molti settori, tra cui assicurazioni, servizi finanziari, media e intrattenimento, sanità, servizi pubblici e produzione. Nel tempo libero Heiko viaggia il più possibile.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/fmops-llmops-operationalize-generative-ai-and-differences-with-mlops/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 2023

- 23

- 7

- 75

- a

- capacità

- capace

- WRI

- sopra

- ABSTRACT

- accesso

- accessibile

- Accedendo

- Il mio account

- conti

- precisione

- preciso

- con precisione

- Raggiungere

- azioni

- attività

- adattare

- adattamento

- aggiungere

- l'aggiunta di

- aggiunta

- aggiuntivo

- Inoltre

- integrazioni

- Aggiunge

- amministrazione

- Adozione

- Avanzate

- Africa

- Dopo shavasana, sedersi in silenzio; saluti;

- Accordo

- AI

- AI e apprendimento automatico

- Assistente AI

- Modelli AI

- Servizi di intelligenza artificiale

- casi d'uso ai

- AI / ML

- puntare

- Allinea

- Tutti

- consentire

- consente

- lungo

- già

- anche

- Sebbene il

- sempre

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- tra

- quantità

- an

- .

- analitica

- ed

- e infrastruttura

- Un altro

- rispondere

- risposte

- in qualsiasi

- api

- API

- App

- Applicazioni

- Sviluppo di applicazioni

- applicazioni

- APPLICA

- approccio

- approcci

- opportuno

- approvazione

- circa

- architetti

- architettonico

- architettura

- SONO

- in giro

- AS

- valutare

- Assistant

- At

- sottoposto a revisione contabile

- revisori dei conti

- aumentata

- automatizzare

- Automatizzata

- Automatico

- automaticamente

- Automazione

- disponibilità

- disponibile

- media

- evitare

- AWS

- BACKEND

- Vasca

- Equilibrio

- basato

- basic

- BE

- perché

- diventare

- diventa

- stato

- prima

- essendo

- Segno di riferimento

- vantaggi

- MIGLIORE

- Meglio

- fra

- pregiudizio

- pregiudizi

- Miliardo

- miliardi

- Nero

- Dezen Dezen

- prendere in prestito

- entrambi

- bots

- Scatola

- scatole

- Branch di società

- Rottura

- brevemente

- Portare

- Rotto

- costruire

- Costruzione

- costruito

- affari

- ma

- by

- calcolare

- chiamata

- detto

- chiamata

- Materiale

- candidato

- i candidati

- funzionalità

- capacità

- catturare

- Custodie

- casi

- catalogo

- categoria

- centrale

- centralizzata

- certo

- Challenge

- sfide

- impegnativo

- il cambiamento

- chatbots

- più economico

- Controlli

- scegliere

- la scelta

- classico

- strettamente

- più vicino

- Abbigliamento

- Cloud

- codice

- codifica

- collaboreranno

- combinazione

- combinazioni

- combinare

- Venire

- Commenti

- commercialmente

- Uncommon

- confrontare

- rispetto

- completamento di una

- completamento

- complesso

- complessità

- conformità

- compiacente

- composizione

- globale

- potenza computazionale

- computer

- concentrarsi

- concetto

- concetti

- preoccupazioni

- condizioni

- Segui il codice di Condotta

- condotto

- collegato

- veloce

- conseguentemente

- Prendere in considerazione

- Considerazioni

- considerato

- consumare

- Consumer

- Consumatori

- consumo

- Contenitore

- contiene

- contenuto

- creazione di contenuti

- contesto

- continua

- di controllo

- discorsivo

- Conversazioni

- copyright

- Corrispondente

- Costo

- costoso

- Costi

- potuto

- paesi

- coprire

- coperto

- creare

- creato

- crea

- Creazione

- creazione

- critico

- cruciale

- la cultura della

- Corrente

- costume

- cliente

- dati dei clienti

- Servizio clienti

- Clienti

- dati

- Lago di dati

- punti dati

- Preparazione dei dati

- privacy dei dati

- scienza dei dati

- Banca Dati

- dataset

- decentrata

- Decidere

- decisioni

- dedicato

- deep

- profonda immersione

- apprendimento profondo

- definito

- definizione

- definizione

- definizioni

- consegnare

- scavare

- Richiesta

- Dipendente

- dipende

- raffigurante

- schierare

- schierato

- distribuzione

- deployment

- descrivere

- descritta

- descrizione

- Design

- progettato

- progettazione

- desiderio

- desiderato

- dettagliati

- dettagli

- Determinare

- determinazione

- Dev

- sviluppare

- sviluppato

- Costruttori

- sviluppatori

- in via di sviluppo

- Mercato

- team di sviluppo

- differenze

- diverso

- differenziare

- dimensioni

- direttamente

- discutere

- discusso

- visualizzati

- distanza

- immersione

- paesaggio differenziato

- do

- documenti

- non

- dominio

- domini

- Dont

- giù

- scaricare

- guidare

- dovuto

- dinamico

- e

- ogni

- In precedenza

- est

- facile

- Economico

- editore

- Efficace

- efficiente

- in modo efficiente

- sforzo

- o

- elaborato

- eletto

- enable

- consentendo

- fine

- da un capo all'altro

- endpoint

- energia

- ingegnere

- Ingegneria

- Ingegneri

- Inglese

- accrescere

- garantire

- assicura

- Impresa

- aziende

- Intrattenimento

- Ambiente

- ambienti

- Allo stesso modo

- particolarmente

- essential

- eccetera

- EU

- valutare

- valutato

- valutazione

- Anche

- Ogni

- esempio

- Esempi

- eccellente

- eccitato

- Esercitare

- esistente

- esiste

- Esotico

- aspetta

- costoso

- esperienza

- esperimento

- competenza

- esperti

- sfruttando

- estendere

- estendendo

- estensione

- estensivo

- Conclamata Esperienza

- descrive

- estratto

- f1

- Faccia

- fattore

- Fattori

- Familiarità

- famiglia

- lontano

- più veloce

- caratteristica

- feedback

- alimentazione

- figura

- filtro

- filtraggio

- finale

- Infine

- finanziario

- Relazione finanziaria

- Settore finanziario

- servizi finanziari

- Nome

- in forma

- Flessibilità

- flessibile

- Focus

- concentrato

- si concentra

- messa a fuoco

- seguire

- seguito

- i seguenti

- segue

- Nel

- Per i consumatori

- modulo

- formato

- Fondazione

- quattro

- Gratis

- amici

- da

- anteriore

- Fine frontale

- Frontend

- pieno

- funzionalità

- fondamentale

- ulteriormente

- Inoltre

- futuro

- Gates

- valutare

- Generale

- scopo generale

- generalmente

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- geopolitica

- ottenere

- Idiota

- dato

- dà

- globali

- commercio globale

- buono

- la governance

- GPU

- Terra

- ha avuto

- cura

- Sfruttamento

- Avere

- avendo

- he

- capo

- Salute e benessere

- assistenza sanitaria

- Aiuto

- aiuta

- qui

- Alta

- alta qualità

- superiore

- vivamente

- il suo

- storico

- tenere

- host

- ospitato

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- umano

- centinaia

- i

- idealmente

- if

- illustra

- Immagine

- immagini

- immaginario

- Impact

- realizzare

- Implementazione

- implicazioni

- importanza

- importante

- miglioramento

- in

- includere

- inclusi

- Compreso

- incorporare

- Aumento

- è aumentato

- indica

- individuale

- industrie

- influenza

- influenzato

- Infrastruttura

- inizialmente

- creativi e originali

- ingresso

- Ingressi

- esempio

- invece

- istruzioni

- assicurazione

- integrare

- destinato

- interagire

- si interagisce

- interazione

- interagisce

- Interfaccia

- Internet

- connessione internet

- Internet delle cose

- ai miglioramenti

- introdurre

- investire

- coinvolto

- coinvolgendo

- IoT

- IT

- SUO

- Lavoro

- viaggio

- Journeys

- Luglio

- ad appena

- Le

- fattore chiave

- Genere

- Sapere

- conoscenze

- conosciuto

- Discografica

- per il tuo brand

- lago

- Lingua

- grandi

- superiore, se assunto singolarmente.

- Cognome

- Latenza

- strato

- galline ovaiole

- principale

- Leads

- IMPARARE

- apprendimento

- Lasciare

- prestare

- meno

- Livello

- leveraging

- biblioteche

- Licenza

- Licenze

- ciclo di vita

- piace

- piace

- limiti

- LINK

- LLM

- caricare

- locale

- collocato

- località

- Londra

- Lunghi

- più a lungo

- inferiore

- macchina

- machine learning

- fatto

- Principale

- mantenere

- Maggioranza

- Fare

- maneggevole

- obbligatorio

- Manuale

- manualmente

- consigliato per la

- molti

- carta geografica

- massiccio

- maturità

- massimo

- Maggio..

- me

- significato

- si intende

- meccanismo

- meccanismi di

- Media

- mediterraneo

- menzionato

- fusione

- maglia

- Metadati

- metodo

- Metodologia

- metodi

- Metrica

- In mezzo

- Medio Oriente

- forza

- ordine

- ML

- MLOp

- modello

- modelli

- Monitorare

- monitorati

- monitoraggio

- Scopri di più

- più efficiente

- maggior parte

- soprattutto

- Motorsports

- cambiano

- mosso

- movimento

- molti

- multiplo

- Musica

- devono obbligatoriamente:

- my

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Navigare

- necessaria

- Bisogno

- di applicazione

- esigenze

- negativo.

- Rete

- rete neurale

- Neutres

- mai

- New

- recentemente

- GENERAZIONE

- nlp

- no

- normale

- Nord

- notevole

- numero

- osservare

- of

- offrire

- offerto

- di frequente

- on

- Procedura di Onboarding

- ONE

- quelli

- esclusivamente

- aprire

- open source

- operativo

- Operazioni

- ottimale

- Opzione

- Opzioni

- or

- organizzazione

- organizzazioni

- Altro

- Altri

- altrimenti

- nostro

- su

- Risultato

- produzione

- ancora

- complessivo

- panoramica

- proprio

- proprietario

- proprietari

- pacchetto

- coppie

- parametri

- modelli

- Persone

- per

- Eseguire

- performance

- esecuzione

- Forse

- persona

- cronologia

- Personalizzata

- prospettiva

- fase

- Foto

- pezzo

- conduttura

- posto

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- punto

- punti

- Termini e Condizioni

- positivo

- possedere

- possibile

- Post

- Post

- potenziale

- potenzialmente

- energia

- potente

- Pratico

- pratiche

- Precisione

- predire

- predizione

- Previsioni

- preparazione

- Preparare

- preparato

- preparazione

- presentata

- precedente

- in precedenza

- premio

- primo ministro

- principi

- Precedente

- Dare priorità

- Privacy

- un bagno

- Problema

- processi

- i processi

- lavorazione

- Prodotto

- produttore

- Prodotto

- Produzione

- Programmazione

- progetto

- promuoverlo

- prova

- prova del concetto

- offre

- proprio

- Dimostra

- fornire

- purché

- fornitore

- fornitori

- fornisce

- fornitura

- scopo

- fini

- spinge

- puzzle

- qualità

- domanda

- Domande

- Presto

- solleva

- gamma

- che vanno

- rapidamente

- tasso

- piuttosto

- valutazione

- Lettura

- tempo reale

- ragione

- ricevere

- raccomandare

- Rosso

- Ridotto

- raffinare

- per quanto riguarda

- registri

- registro

- normativa

- relazionato

- rilasciato

- rilevanza

- pertinente

- problemi di

- resti

- a distanza

- sostituito

- rapporto

- deposito

- rappresentazione

- rappresentante

- richiesta

- richieste

- necessario

- Requisiti

- richiede

- riparazioni

- ricercatori

- Risorse

- rispettivamente

- risposta

- risposte

- responsabile

- REST

- restrizioni

- restrittivo

- colpevole

- Risultati

- nello specifico retail

- riutilizzare

- recensioni

- rivisto

- equitazione

- destra

- tabella di marcia

- Ruolo

- ruoli

- approssimativamente

- tondo

- Correre

- running

- sagemaker

- stesso

- sandbox

- Scala

- scala

- scenario

- Scenari

- Scienze

- scienziati

- Punto

- graffiare

- script

- MARE

- Sezione

- sezioni

- settore

- sicuro

- in modo sicuro

- problemi di

- politiche di sicurezza

- vedere

- cerca

- selezionato

- Selezione

- prodotti

- invio

- anziano

- inviato

- sentimento

- separato

- Sequenza

- Serie

- servire

- servizio

- Servizi

- servizio

- set

- alcuni

- sagomatura

- Condividi

- condiviso

- navi

- Corti

- dovrebbero

- mostrato

- Spettacoli

- lato

- significativa

- significativamente

- simile

- semplificare

- Taglia

- abilità

- piccole

- inferiore

- PMI

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- codice sorgente

- fonti

- lo spazio

- la nostra speciale

- specialista

- specializzata

- specifico

- in particolare

- velocità

- spendere

- esaurito

- Stage

- tappe

- stakeholder

- Standard

- standardizzazione

- inizia a

- Stato dei servizi

- step

- Passi

- Tornare al suo account

- memorizzati

- memorizzare

- Storia

- punti di forza

- forte

- Successivamente

- di successo

- tale

- suggerire

- convenienza

- adatto

- riassumere

- SOMMARIO

- supporto

- supportato

- suppone

- sicuro

- SWIFT

- sistema

- tavolo

- Fai

- Task

- task

- team

- le squadre

- Consulenza

- tecniche

- Tecnologie

- Tecnologia

- condizioni

- test

- testato

- tester

- Testing

- di

- che

- Il

- Il futuro

- L’ORIGINE

- Regno Unito

- il mondo

- loro

- Li

- si

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- Pensiero

- di parti terze standard

- questo

- quelli

- anche se?

- pensiero

- migliaia

- tre

- tempo

- a

- insieme

- token

- Tokens

- top

- Argomenti

- verso

- commercio

- tradizionale

- Treni

- allenato

- Training

- Trasformare

- Trasformazione

- viaggiare

- viaggia

- Trend

- innescare

- vero

- Verità

- prova

- seconda

- Digitare

- Tipi di

- tipicamente

- ui

- Uk

- capire

- e una comprensione reciproca

- unità

- unità

- Aggiornamenti

- Caricamento

- us

- utilizzabile

- Impiego

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilità

- utilizzati

- vario

- verificare

- versione

- contro

- verticale

- via

- vitale

- visualizzare

- vs

- volere

- Prima

- we

- sito web

- servizi web

- Sito web

- WELL

- Che

- Che cosa è l'

- quando

- mentre

- se

- quale

- while

- OMS

- largo

- Vasta gamma

- volere

- finestra

- finestre

- con

- entro

- senza

- Word

- parole

- Lavora

- lavorare insieme

- lavorato

- lavoro

- lavori

- mondo

- sarebbe

- anni

- dare la precedenza

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro