Clienti di ogni dimensione e settore stanno innovando su AWS integrando il machine learning (ML) nei loro prodotti e servizi. I recenti sviluppi nei modelli di intelligenza artificiale generativa hanno ulteriormente accelerato la necessità di adozione del machine learning in tutti i settori. Tuttavia, l’implementazione della sicurezza, della privacy dei dati e dei controlli di governance rappresentano ancora le sfide principali affrontate dai clienti quando implementano carichi di lavoro ML su larga scala. Affrontare queste sfide crea il quadro e le basi per mitigare i rischi e l’uso responsabile dei prodotti basati sul machine learning. Sebbene l’intelligenza artificiale generativa possa richiedere ulteriori controlli, come la rimozione della tossicità e la prevenzione del jailbreak e delle allucinazioni, condivide gli stessi componenti fondamentali per la sicurezza e la governance del machine learning tradizionale.

Abbiamo sentito dai clienti che richiedono conoscenze specialistiche e investimenti fino a 12 mesi per costruire il loro progetto personalizzato Amazon Sage Maker Implementazione della piattaforma ML per garantire ambienti ML scalabili, affidabili, sicuri e governati per le loro linee di business (LOB) o team ML. Se non disponi di un framework per governare il ciclo di vita ML su larga scala, potresti incorrere in sfide come l'isolamento delle risorse a livello di team, il ridimensionamento delle risorse di sperimentazione, l'operazionalizzazione dei flussi di lavoro ML, il ridimensionamento della governance dei modelli e la gestione della sicurezza e della conformità dei carichi di lavoro ML.

Governare il ciclo di vita del machine learning su larga scala è un framework che ti aiuta a creare una piattaforma di machine learning con controlli di governance e sicurezza integrati basati sulle best practice del settore e sugli standard aziendali. Questo quadro affronta le sfide fornendo una guida prescrittiva attraverso un approccio quadro modulare che estende un Torre di controllo AWS ambiente AWS multi-account e l'approccio discusso nel post Configurazione di ambienti di machine learning sicuri e ben gestiti su AWS.

Fornisce indicazioni prescrittive per le seguenti funzioni della piattaforma ML:

- Fondamenti di multi-account, sicurezza e networking – Questa funzione utilizza AWS Control Tower e principi ben architettati per l'impostazione e il funzionamento di servizi di ambiente, sicurezza e rete multi-account.

- Fondamenti di dati e governance – Questa funzione utilizza a architettura della rete dati per la configurazione e il funzionamento del data Lake, dell'archivio di funzionalità centrale e delle basi di governance dei dati per consentire un accesso granulare ai dati.

- Servizi condivisi e di governance della piattaforma ML – Questa funzione consente di impostare e utilizzare servizi comuni come CI/CD, Catalogo dei servizi AWS per gli ambienti di provisioning e un registro centrale dei modelli per la promozione e la derivazione dei modelli.

- Ambienti del team ML – Questa funzione consente la configurazione e l'utilizzo di ambienti operativi per i team ML per lo sviluppo, il test e la distribuzione dei modelli di casi d'uso per incorporare controlli di sicurezza e governance.

- Osservabilità della piattaforma ML – Questa funzione aiuta nella risoluzione dei problemi e nell'identificazione della causa principale dei problemi nei modelli ML attraverso la centralizzazione dei log e fornendo strumenti per la visualizzazione dell'analisi dei log. Fornisce inoltre indicazioni per la generazione di report sui costi e sull'utilizzo per i casi d'uso di ML.

Sebbene questo framework possa offrire vantaggi a tutti i clienti, è particolarmente vantaggioso per i clienti di aziende grandi, mature, regolamentate o globali che desiderano adattare le proprie strategie di ML con un approccio controllato, conforme e coordinato in tutta l'organizzazione. Aiuta a consentire l'adozione del machine learning mitigando i rischi. Questo framework è utile per i seguenti clienti:

- Clienti aziendali di grandi dimensioni con molte linee di business o dipartimenti interessati all'utilizzo del machine learning. Questo framework consente a diversi team di creare e distribuire modelli ML in modo indipendente fornendo al contempo una governance centrale.

- Clienti aziendali con una maturità da moderata ad alta in ML. Hanno già implementato alcuni modelli ML iniziali e stanno cercando di ampliare i propri sforzi ML. Questo framework può aiutare ad accelerare l’adozione del machine learning in tutta l’organizzazione. Queste aziende riconoscono anche la necessità di una governance per gestire aspetti come il controllo degli accessi, l’utilizzo dei dati, le prestazioni dei modelli e i pregiudizi sleali.

- Aziende di settori regolamentati come servizi finanziari, sanità, chimica e settore privato. Queste aziende necessitano di una forte governance e udibilità per qualsiasi modello ML utilizzato nei loro processi aziendali. L’adozione di questo quadro può contribuire a facilitare la conformità pur consentendo lo sviluppo di modelli locali.

- Organizzazioni globali che devono bilanciare il controllo centralizzato e locale. L'approccio federato di questo framework consente al team tecnico della piattaforma centrale di definire alcune politiche e standard di alto livello, ma offre anche ai team LOB la flessibilità di adattarsi in base alle esigenze locali.

Nella prima parte di questa serie esamineremo l'architettura di riferimento per la configurazione della piattaforma ML. In un post successivo forniremo indicazioni prescrittive su come implementare i vari moduli nell'architettura di riferimento nella tua organizzazione.

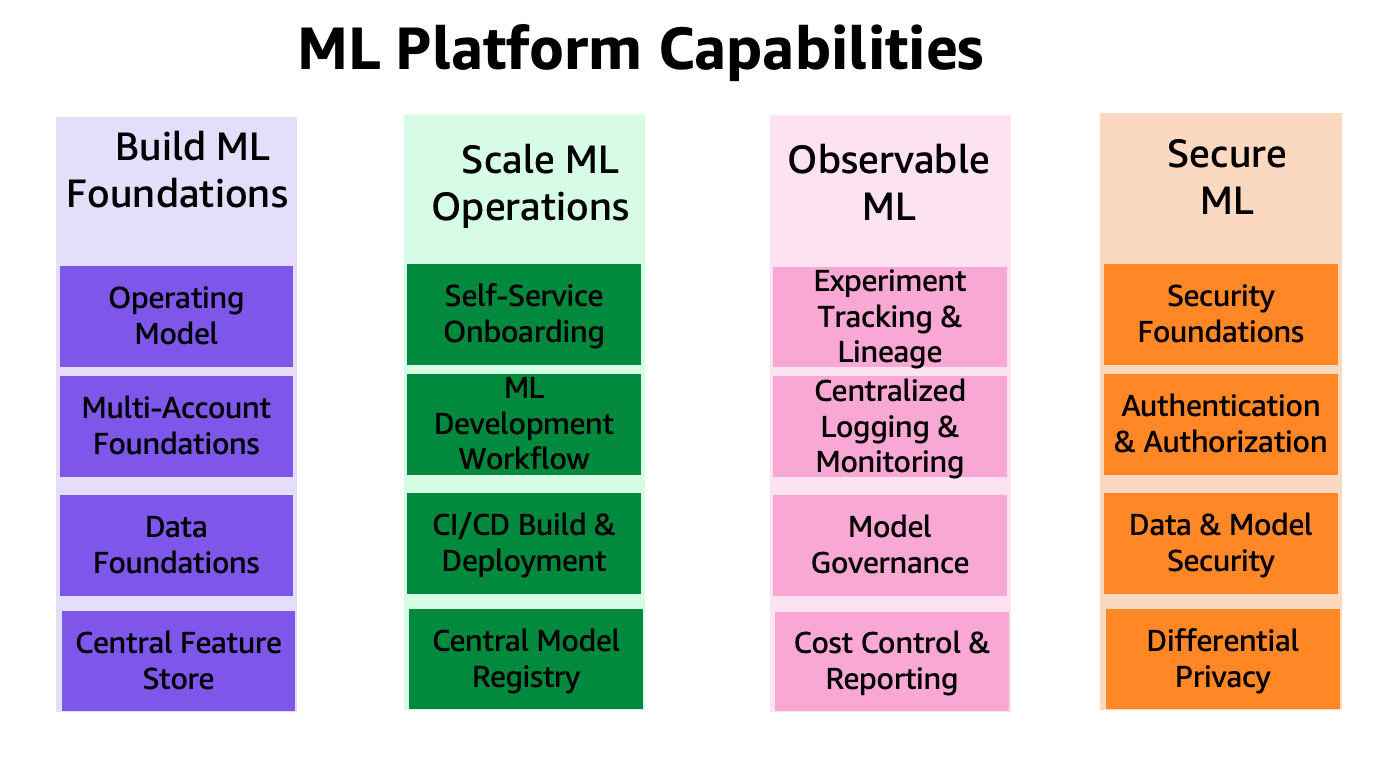

Le funzionalità della piattaforma ML sono raggruppate in quattro categorie, come mostrato nella figura seguente. Queste funzionalità costituiscono la base dell'architettura di riferimento discussa più avanti in questo post:

- Costruisci le basi del machine learning

- Operazioni di machine learning su scala

- ML osservabile

- ML sicuro

Panoramica della soluzione

Il framework per governare il ciclo di vita del machine learning su larga scala consente alle organizzazioni di incorporare controlli di sicurezza e governance durante tutto il ciclo di vita del machine learning che a loro volta aiutano le organizzazioni a ridurre i rischi e ad accelerare l'integrazione del machine learning nei propri prodotti e servizi. Il framework aiuta a ottimizzare la configurazione e la governance di ambienti ML sicuri, scalabili e affidabili in grado di adattarsi per supportare un numero crescente di modelli e progetti. Il framework abilita le seguenti funzionalità:

- Provisioning di account e infrastruttura con risorse infrastrutturali conformi ai criteri dell'organizzazione

- Distribuzione self-service di ambienti di data science e modelli di operazioni ML end-to-end (MLOps) per casi d'uso ML

- Isolamento delle risorse a livello di LOB o di team per garantire la conformità alla sicurezza e alla privacy

- Accesso regolamentato ai dati di produzione per la sperimentazione e flussi di lavoro pronti per la produzione

- Gestione e governance per repository di codice, pipeline di codice, modelli distribuiti e funzionalità di dati

- Un registro dei modelli e un archivio di funzionalità (componenti locali e centrali) per migliorare la governance

- Controlli di sicurezza e governance per il processo di sviluppo e distribuzione del modello end-to-end

In questa sezione forniamo una panoramica delle linee guida prescrittive per aiutarti a creare questa piattaforma ML su AWS con controlli di sicurezza e governance integrati.

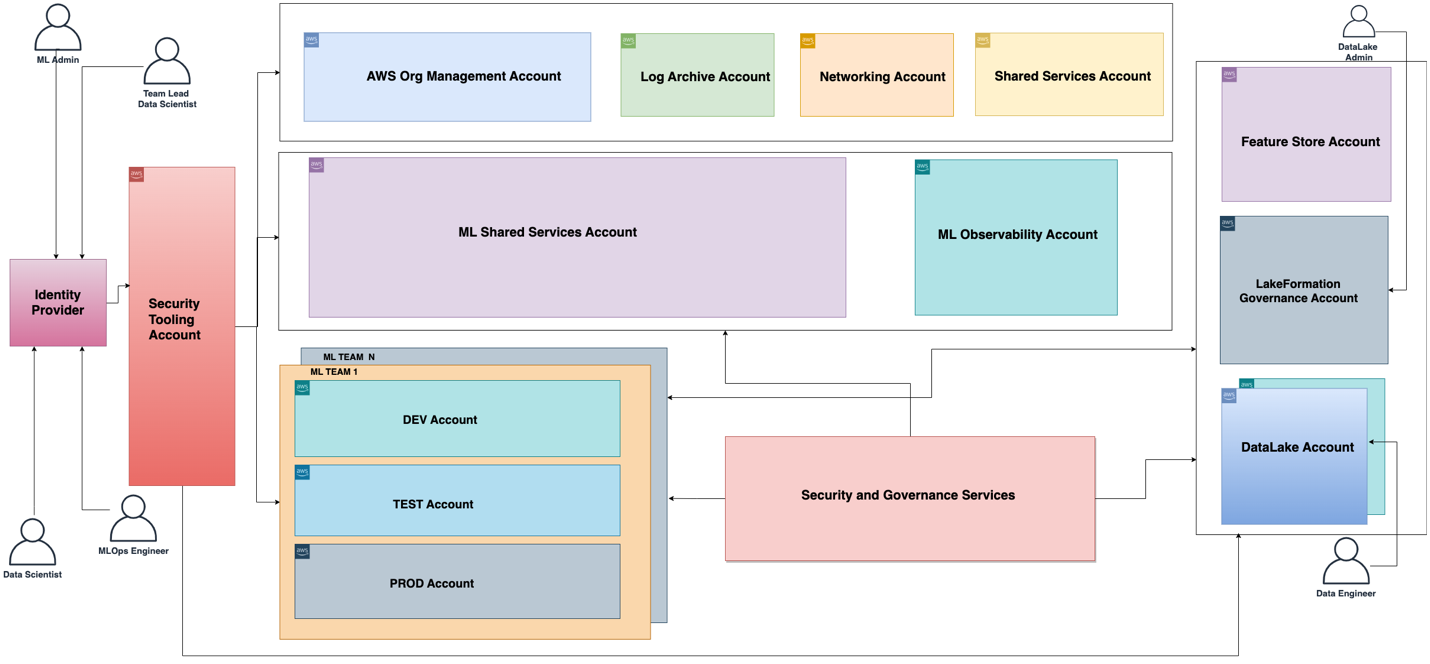

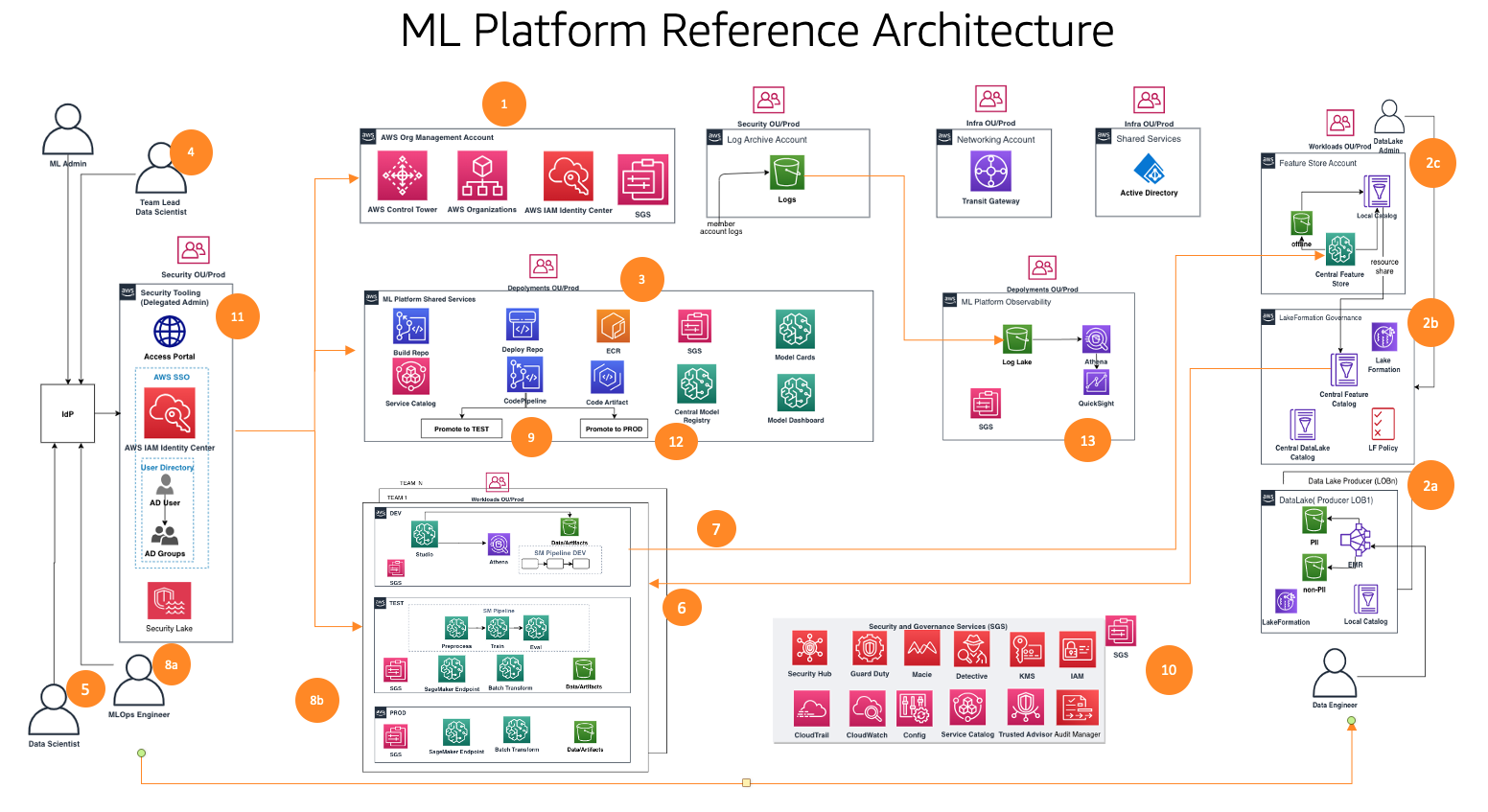

L'architettura funzionale associata alla piattaforma ML è mostrata nel diagramma seguente. L'architettura mappa le diverse funzionalità della piattaforma ML sugli account AWS.

L'architettura funzionale con diverse capacità viene implementata utilizzando una serie di servizi AWS, tra cui Organizzazioni AWS, SageMaker, servizi AWS DevOps e un data Lake. L'architettura di riferimento per la piattaforma ML con vari servizi AWS è mostrata nel diagramma seguente.

Questo framework considera più persone e servizi per governare il ciclo di vita del machine learning su larga scala. Ti consigliamo i seguenti passaggi per organizzare i tuoi team e servizi:

- Utilizzando AWS Control Tower e gli strumenti di automazione, l'amministratore del cloud configura le basi multi-account come Organizzazioni e Centro di identità AWS IAM (successore di AWS Single Sign-On) e servizi di sicurezza e governance come Servizio di gestione delle chiavi AWS (AWS KMS) e Catalogo dei servizi. Inoltre, l'amministratore configura una serie di unità organizzative (OU) e account iniziali per supportare i flussi di lavoro di ML e di analisi.

- Gli amministratori di data Lake configurano il data Lake e il catalogo dati e configurano l'archivio di funzionalità centrale collaborando con l'amministratore della piattaforma ML.

- L'amministratore della piattaforma ML fornisce servizi condivisi ML come AWS CodeCommit, AWS Code Pipeline, Registro dei contenitori Amazon Elastic (Amazon ECR), un registro centrale dei modelli, Schede modello SageMaker, Pannello di controllo del modello SageMakere prodotti del catalogo dei servizi per i team ML.

- Il responsabile del team ML si unisce tramite IAM Identity Center, utilizza i prodotti del catalogo dei servizi ed effettua il provisioning delle risorse nell'ambiente di sviluppo del team ML.

- I data scientist dei team ML di diverse business unit si uniscono nell'ambiente di sviluppo del proprio team per creare la pipeline del modello.

- I data scientist cercano ed estraggono funzionalità dal catalogo del negozio di funzionalità centrale, creano modelli attraverso esperimenti e selezionano il modello migliore per la promozione.

- I data scientist creano e condividono nuove funzionalità nel catalogo dell'archivio funzionalità centrale per il riutilizzo.

- Un ingegnere di machine learning distribuisce la pipeline del modello nell'ambiente di test del team di machine learning utilizzando un processo CI/CD di servizi condivisi.

- Dopo la convalida delle parti interessate, il modello ML viene distribuito nell'ambiente di produzione del team.

- I controlli di sicurezza e governance sono incorporati in ogni livello di questa architettura utilizzando servizi come Hub di sicurezza AWS, Amazon Guard Duty, Amazon MacieE altro ancora.

- I controlli di sicurezza vengono gestiti centralmente dall'account degli strumenti di sicurezza utilizzando Security Hub.

- Le funzionalità di governance della piattaforma ML come SageMaker Model Cards e SageMaker Model Dashboard sono gestite centralmente dall'account dei servizi di governance.

- Amazon Cloud Watch ed AWS CloudTrail i log di ciascun account membro sono resi accessibili centralmente da un account di osservabilità utilizzando i servizi nativi AWS.

Successivamente, approfondiremo i moduli dell'architettura di riferimento per questo framework.

Moduli dell'architettura di riferimento

L'architettura di riferimento comprende otto moduli, ciascuno progettato per risolvere uno specifico insieme di problemi. Collettivamente, questi moduli affrontano la governance in varie dimensioni, come infrastruttura, dati, modello e costi. Ogni modulo offre un insieme distinto di funzioni e interagisce con altri moduli per fornire una piattaforma ML end-to-end integrata con controlli di governance e sicurezza integrati. In questa sezione presentiamo un breve riepilogo delle funzionalità di ciascun modulo.

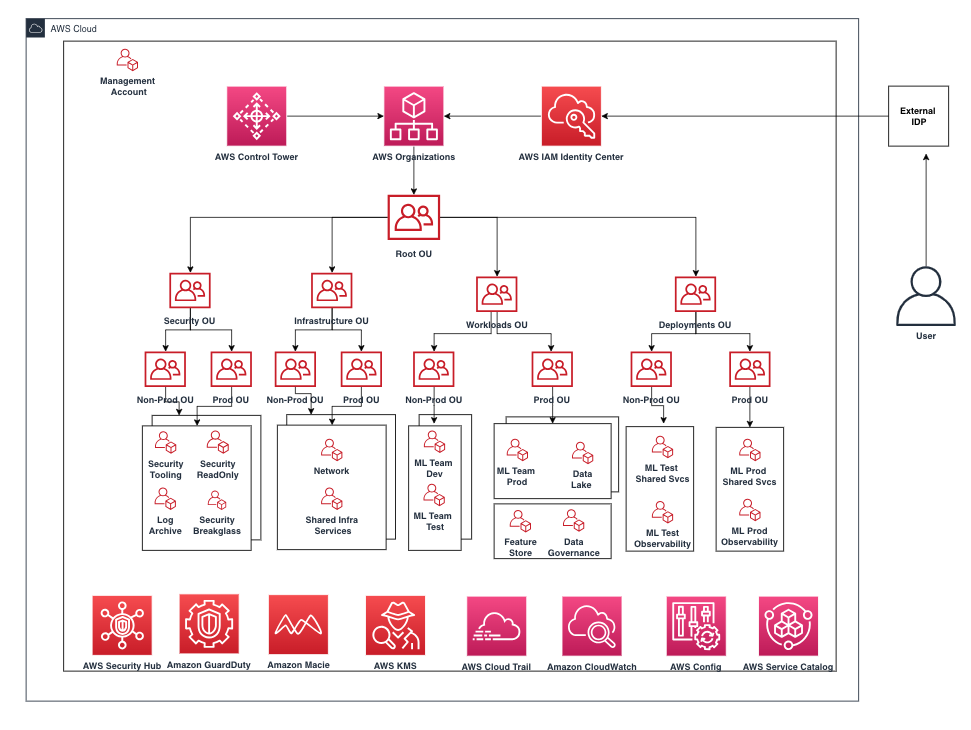

Fondazioni multiconto

Questo modulo aiuta gli amministratori del cloud a creare un Zona di atterraggio della torre di controllo AWS come quadro fondativo. Ciò include la creazione di una struttura multi-account, autenticazione e autorizzazione tramite IAM Identity Center, un design di rete hub-and-spoke, servizi di registrazione centralizzati e nuovi account membri AWS con linee di base di sicurezza e governance standardizzate.

Inoltre, questo modulo fornisce indicazioni sulle best practice sulle unità organizzative e sulle strutture degli account appropriate per supportare i flussi di lavoro di ML e analisi. Gli amministratori del cloud comprenderanno lo scopo degli account e delle unità organizzative richiesti, come distribuirli e i principali servizi di sicurezza e conformità che dovrebbero utilizzare per governare a livello centrale i carichi di lavoro di ML e analisi.

Viene inoltre trattato un framework per la vendita di nuovi account, che utilizza l'automazione per definire le basi per i nuovi account quando vengono forniti. Avendo impostato un processo automatizzato di provisioning degli account, gli amministratori cloud possono fornire ai team di ML e di analisi gli account di cui hanno bisogno per svolgere il proprio lavoro più rapidamente, senza sacrificare una solida base per la governance.

Fondazioni del data lago

Questo modulo aiuta gli amministratori di data Lake a configurare un data Lake per importare dati, curare set di dati e utilizzare i file Formazione AWS Lake modello di governance per la gestione dell'accesso granulare ai dati tra account e utenti utilizzando un catalogo dati centralizzato, policy di accesso ai dati e controlli di accesso basati su tag. Puoi iniziare in piccolo con un account per le basi della tua piattaforma dati per una prova di concetto o alcuni piccoli carichi di lavoro. Per l'implementazione del carico di lavoro di produzione su scala medio-grande, consigliamo di adottare una strategia multi-account. In tale contesto, i LOB possono assumere il ruolo di produttori e consumatori di dati utilizzando diversi account AWS e la governance del data Lake è gestita da un account AWS centrale condiviso. Il produttore di dati raccoglie, elabora e archivia i dati dal proprio dominio di dati, oltre a monitorare e garantire la qualità delle proprie risorse di dati. I consumatori di dati consumano i dati dal produttore di dati dopo che il catalogo centralizzato li ha condivisi utilizzando Lake Formation. Il catalogo centralizzato archivia e gestisce il catalogo dati condiviso per gli account produttori di dati.

Servizi della piattaforma ML

Questo modulo aiuta il team tecnico della piattaforma ML a configurare i servizi condivisi utilizzati dai team di data science nei propri account del team. I servizi includono un portafoglio del Catalogo dei servizi con prodotti per dominio SageMaker distribuzione, Profilo utente del dominio SageMaker distribuzione, modelli di modelli di data science per la creazione e la distribuzione di modelli. Questo modulo dispone di funzionalità per un registro dei modelli centralizzato, schede dei modelli, dashboard dei modelli e pipeline CI/CD utilizzate per orchestrare e automatizzare i flussi di lavoro di sviluppo e distribuzione dei modelli.

Inoltre, questo modulo descrive in dettaglio come implementare i controlli e la governance necessari per abilitare funzionalità self-service basate sulle persone, consentendo ai team di data science di distribuire in modo indipendente l'infrastruttura cloud e i modelli ML richiesti.

Sviluppo di casi d'uso ML

Questo modulo aiuta le linee di business e i data scientist ad accedere al dominio SageMaker del proprio team in un ambiente di sviluppo e a creare un'istanza di un modello di creazione di modelli per sviluppare i propri modelli. In questo modulo, i data scientist lavorano su un'istanza dell'account di sviluppo del modello per interagire con i dati disponibili sul data Lake centralizzato, riutilizzare e condividere funzionalità da un archivio di funzionalità centrale, creare ed eseguire esperimenti ML, creare e testare i propri flussi di lavoro ML, e registrare i propri modelli in un registro dei modelli di account di sviluppo nei propri ambienti di sviluppo.

Nei modelli sono implementate anche funzionalità come il monitoraggio degli esperimenti, i report sulla spiegabilità dei modelli, il monitoraggio dei dati e delle distorsioni del modello e il registro dei modelli, consentendo un rapido adattamento delle soluzioni ai modelli sviluppati dai data scientist.

Operazioni di machine learning

Questo modulo aiuta i LOB e gli ingegneri ML a lavorare sulle loro istanze di sviluppo del modello di distribuzione del modello. Dopo che il modello candidato è stato registrato e approvato, configurano pipeline CI/CD ed eseguono flussi di lavoro ML nell'ambiente di test del team, che registra il modello nel registro centrale dei modelli in esecuzione in un account di servizi condivisi della piattaforma. Quando un modello viene approvato nel registro centrale dei modelli, viene attivata una pipeline CI/CD per distribuire il modello nell'ambiente di produzione del team.

Archivio funzionalità centralizzato

Dopo che i primi modelli vengono distribuiti in produzione e più casi d'uso iniziano a condividere funzionalità create dagli stessi dati, un archivio di funzionalità diventa essenziale per garantire la collaborazione tra casi d'uso e ridurre il lavoro duplicato. Questo modulo aiuta il team tecnico della piattaforma ML a configurare un archivio di funzionalità centralizzato per fornire archiviazione e governance per le funzionalità ML create dai casi d'uso ML, consentendo il riutilizzo delle funzionalità tra progetti.

Registrazione e osservabilità

Questo modulo aiuta le LOB e i professionisti ML a ottenere visibilità sullo stato dei carichi di lavoro ML negli ambienti ML attraverso la centralizzazione dell'attività di log come CloudTrail, CloudWatch, log di flusso VPC e log dei carichi di lavoro ML. I team possono filtrare, interrogare e visualizzare i log per l'analisi, il che può aiutare anche a migliorare il livello di sicurezza.

Costo e rendicontazione

Questo modulo aiuta varie parti interessate (amministratore del cloud, amministratore della piattaforma, ufficio aziendale del cloud) a generare report e dashboard per suddividere i costi a livello di utente ML, team ML e prodotto ML e tenere traccia dell'utilizzo come numero di utenti, tipi di istanza e endpoint.

I clienti ci hanno chiesto di fornire indicazioni su quanti account creare e come strutturarli. Nella sezione successiva, forniamo indicazioni sulla struttura dei conti come riferimento che puoi modificare in base alle tue esigenze in base ai requisiti di governance aziendale.

In questa sezione, discutiamo i nostri consigli per organizzare la struttura del tuo account. Condividiamo una struttura contabile di riferimento di base; tuttavia, consigliamo agli amministratori di dati e ML di lavorare a stretto contatto con l'amministratore del cloud per personalizzare la struttura dell'account in base ai controlli dell'organizzazione.

Ti consigliamo di organizzare gli account per unità organizzativa per sicurezza, infrastruttura, carichi di lavoro e distribuzioni. Inoltre, all'interno di ciascuna UO, organizzare per UO non di produzione e di produzione perché gli account e i carichi di lavoro distribuiti al loro interno hanno controlli diversi. Successivamente, discuteremo brevemente di tali unità organizzative.

UO Sicurezza

Gli account in questa unità organizzativa sono gestiti dall'amministratore cloud dell'organizzazione o dal team di sicurezza per monitorare, identificare, proteggere, rilevare e rispondere agli eventi di sicurezza.

UO Infrastrutture

Gli account in questa unità organizzativa sono gestiti dall'amministratore cloud dell'organizzazione o dal team di rete per la gestione delle risorse e delle reti condivise dell'infrastruttura a livello aziendale.

Ti consigliamo di avere i seguenti account nell'unità organizzativa dell'infrastruttura:

- Network NetPoulSafe – Configurare un'infrastruttura di rete centralizzata come Gateway di transito AWS

- Servizi condivisi – Configura servizi AD centralizzati ed endpoint VPC

Unità organizzativa carichi di lavoro

Gli account in questa unità organizzativa sono gestiti dagli amministratori del team della piattaforma dell'organizzazione. Se sono necessari controlli diversi implementati per ciascun team della piattaforma, è possibile nidificare altri livelli di unità organizzative a tale scopo, ad esempio un'unità organizzativa per carichi di lavoro ML, un'unità organizzativa per carichi di lavoro dati e così via.

Consigliamo i seguenti account nell'unità organizzativa dei carichi di lavoro:

- Account di sviluppo, test e produzione di machine learning a livello di team – Configuralo in base ai requisiti di isolamento del carico di lavoro

- Conti di data Lake – Partizionare gli account in base al dominio dati

- Conto centrale di governance dei dati – Centralizza le tue policy di accesso ai dati

- Account del negozio di funzionalità centrale – Centralizzare le funzionalità per la condivisione tra team

UO Distribuzioni

Gli account in questa unità organizzativa sono gestiti dagli amministratori del team della piattaforma dell'organizzazione per la distribuzione dei carichi di lavoro e l'osservabilità.

Consigliamo i seguenti account nell'unità organizzativa delle distribuzioni perché il team della piattaforma ML può impostare diversi set di controlli a questo livello di unità organizzativa per gestire e governare le distribuzioni:

- Account dei servizi condivisi ML per test e produzione – Servizi condivisi della piattaforma host CI/CD e registro dei modelli

- L'osservabilità ML tiene conto di test e produzione – Ospita log CloudWatch, log CloudTrail e altri log secondo necessità

Successivamente, discuteremo brevemente i controlli organizzativi che devono essere considerati per l'integrazione negli account dei membri per il monitoraggio delle risorse dell'infrastruttura.

Controlli dell'ambiente AWS

Un controllo è una regola di alto livello che fornisce una governance continua per l'ambiente AWS complessivo. È espresso in un linguaggio semplice. In questo framework, utilizziamo AWS Control Tower per implementare i seguenti controlli che ti aiutano a governare le tue risorse e monitorare la conformità tra gruppi di account AWS:

- Controlli preventivi – Un controllo preventivo garantisce che i tuoi account mantengano la conformità perché impedisce azioni che portano a violazioni delle policy e vengono implementate utilizzando una Policy di controllo dei servizi (SCP). Ad esempio, puoi impostare un controllo preventivo che garantisca che CloudTrail non venga eliminato o interrotto negli account o nelle regioni AWS.

- Controlli investigativi – Un controllo investigativo rileva la non conformità delle risorse all'interno dei tuoi account, come le violazioni delle policy, fornisce avvisi tramite la dashboard e viene implementato utilizzando Configurazione AWS regole. Ad esempio, puoi creare un controllo detective per rilevare se l'accesso in lettura pubblico è abilitato al file Servizio di archiviazione semplice Amazon (Amazon S3) nell'account condiviso dell'archivio log.

- Controlli proattivi – Un controllo proattivo esegue la scansione delle risorse prima che vengano fornite e garantisce che le risorse siano conformi a tale controllo e siano implementate utilizzando AWS CloudFormazione ganci. Non verrà effettuato il provisioning delle risorse non conformi. Ad esempio, puoi impostare un controllo proattivo che verifichi che l'accesso diretto a Internet non sia consentito per un'istanza di notebook SageMaker.

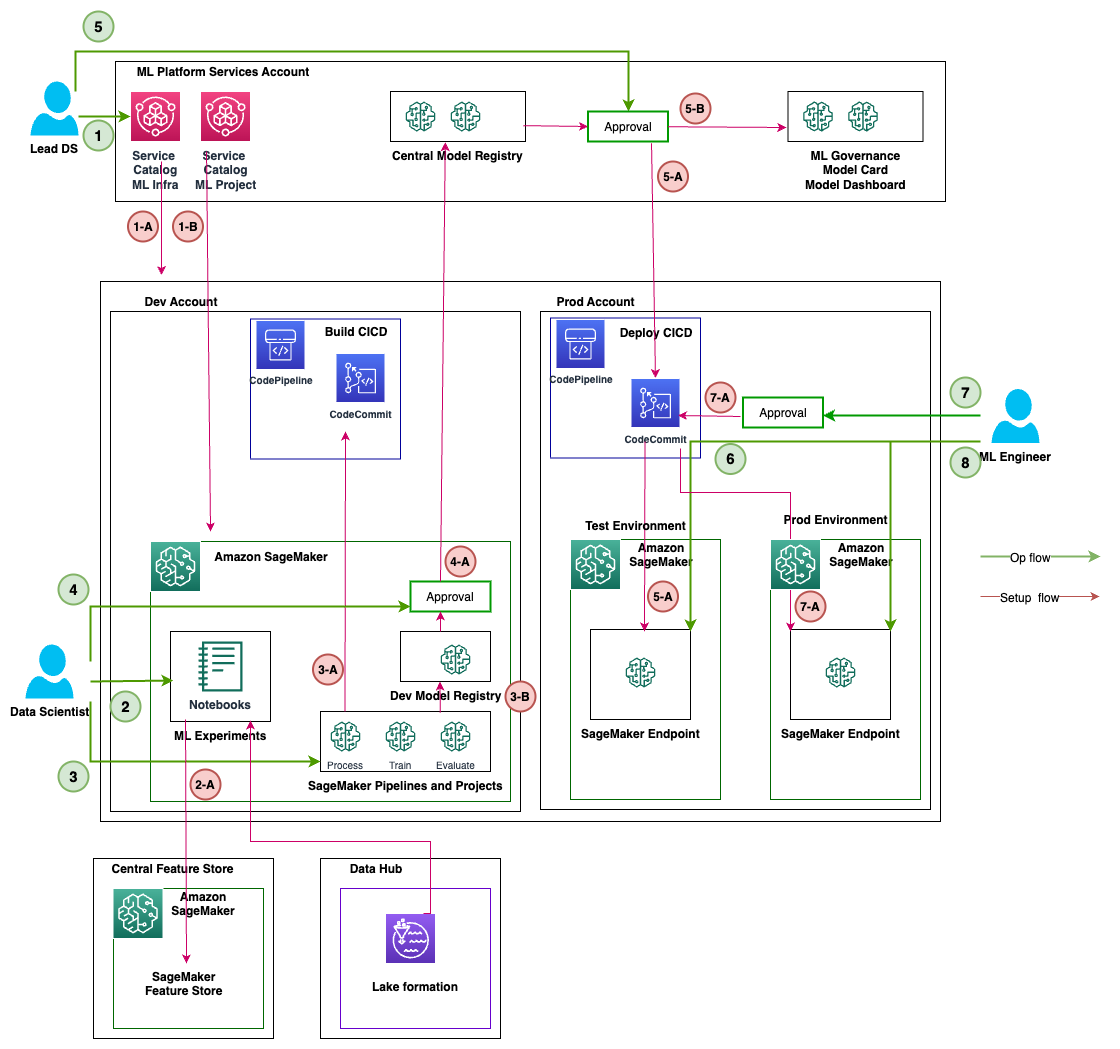

Interazioni tra servizi della piattaforma ML, casi d'uso ML e operazioni ML

Diversi personaggi, come il responsabile della scienza dei dati (lead data scientist), il data scientist e l'ingegnere ML, gestiscono i moduli 2-6 come mostrato nel diagramma seguente per le diverse fasi dei servizi della piattaforma ML, dello sviluppo di casi d'uso ML e delle operazioni ML insieme alle fondazioni del data Lake e all'archivio di funzionalità centrale.

La tabella seguente riepiloga l'attività del flusso operativo e i passaggi del flusso di configurazione per i diversi utenti tipo. Una volta che una persona avvia un'attività ML come parte del flusso operativo, i servizi vengono eseguiti come indicato nei passaggi del flusso di configurazione.

| Persona | Attività del flusso operativo: numero | Attività del flusso operativo – Descrizione | Fase del flusso di configurazione: numero | Passaggio del flusso di configurazione: descrizione |

| Responsabile della scienza dei dati o del team ML |

1 |

Utilizza il catalogo dei servizi nell'account dei servizi della piattaforma ML e distribuisce quanto segue:

|

1-A |

|

|

1-B |

|

|||

| Dati Scientist |

2 |

Conduce e tiene traccia degli esperimenti di ML nei notebook SageMaker |

2-A |

|

|

3 |

Automatizza esperimenti di ML di successo con progetti e pipeline SageMaker |

3-A |

|

|

|

3-B |

Dopo l'esecuzione delle pipeline SageMaker, salva il modello nel registro del modello locale (sviluppo). | |||

| Capo scienziato dei dati o capo del team ML |

4 |

Approva il modello nel registro del modello locale (sviluppo). |

4-A |

I metadati del modello e il pacchetto del modello scrivono dal registro del modello locale (sviluppo) al registro del modello centrale |

|

5 |

Approva il modello nel registro centrale dei modelli |

5-A |

Avvia il processo CI/CD di distribuzione per creare endpoint SageMaker nell'ambiente di test | |

|

5-B |

Scrive le informazioni e i metadati del modello nel modulo di governance ML (scheda del modello, dashboard del modello) nell'account dei servizi della piattaforma ML dall'account locale (sviluppo) | |||

| Ingegnere ML |

6 |

Testa e monitora l'endpoint SageMaker nell'ambiente di test dopo CI/CD | . | |

|

7 |

Approva la distribuzione per gli endpoint SageMaker nell'ambiente di produzione |

7-A |

Avvia il processo CI/CD di distribuzione per creare endpoint SageMaker nell'ambiente di produzione | |

|

8 |

Testa e monitora l'endpoint SageMaker nell'ambiente di test dopo CI/CD | . | ||

Personas e interazioni con diversi moduli della piattaforma ML

Ogni modulo si rivolge a particolari target personas all'interno di divisioni specifiche che utilizzano il modulo più spesso, garantendo loro l'accesso primario. L'accesso secondario è poi consentito ad altre divisioni che richiedono l'utilizzo occasionale dei moduli. I moduli sono adattati alle esigenze di particolari ruoli lavorativi o personaggi per ottimizzare la funzionalità.

Parliamo delle seguenti squadre:

- Ingegneria cloud centrale – Questo team opera a livello di cloud aziendale su tutti i carichi di lavoro per la configurazione di servizi di infrastruttura cloud comuni, come la configurazione di reti, identità, autorizzazioni e gestione degli account a livello aziendale

- Ingegneria della piattaforma dati – Questo team gestisce i data Lake aziendali, la raccolta dei dati, la cura dei dati e la governance dei dati

- Ingegneria della piattaforma ML – Questo team opera a livello di piattaforma ML tra LOB per fornire servizi di infrastruttura ML condivisi come provisioning dell'infrastruttura ML, monitoraggio degli esperimenti, governance dei modelli, distribuzione e osservabilità

La tabella seguente descrive in dettaglio quali divisioni hanno accesso primario e secondario per ciascun modulo in base ai personaggi target del modulo.

| Numero modulo | moduli | Accesso primario | Accesso secondario | Personas target | Numero di account |

|

1 |

Fondazioni multiconto | Ingegneria cloud centrale | LOB individuali |

|

Pochi |

|

2 |

Fondazioni del data lago | Ingegneria centrale del cloud o della piattaforma dati | LOB individuali |

|

multiplo |

|

3 |

Servizi della piattaforma ML | Ingegneria centralizzata della piattaforma cloud o ML | LOB individuali |

|

Uno |

|

4 |

Sviluppo di casi d'uso ML | LOB individuali | Ingegneria centralizzata della piattaforma cloud o ML |

|

multiplo |

|

5 |

Operazioni di machine learning | Ingegneria cloud o ML centralizzata | LOB individuali |

|

multiplo |

|

6 |

Archivio funzionalità centralizzato | Cloud centrale o ingegneria dei dati | LOB individuali |

|

Uno |

|

7 |

Registrazione e osservabilità | Ingegneria cloud centrale | LOB individuali |

|

Uno |

|

8 |

Costo e rendicontazione | LOB individuali | Ingegneria della piattaforma centrale |

|

Uno |

Conclusione

In questo post abbiamo introdotto un framework per governare il ciclo di vita del machine learning su larga scala che ti aiuta a implementare carichi di lavoro di machine learning ben architettati incorporando controlli di sicurezza e governance. Abbiamo discusso di come questo framework adotti un approccio olistico per la creazione di una piattaforma ML considerando la governance dei dati, la governance dei modelli e i controlli a livello aziendale. Ti invitiamo a sperimentare la struttura e i concetti introdotti in questo post e a condividere il tuo feedback.

Circa gli autori

Ram Vital è Principal ML Solutions Architect presso AWS. Ha oltre 3 decenni di esperienza nell'architettura e nella creazione di applicazioni distribuite, ibride e cloud. La sua passione è creare soluzioni AI/ML e big data sicure, scalabili e affidabili per aiutare i clienti aziendali nel loro percorso di adozione e ottimizzazione del cloud per migliorare i risultati aziendali. Nel tempo libero va in moto e cammina con la sua pecora di tre anni!

Ram Vital è Principal ML Solutions Architect presso AWS. Ha oltre 3 decenni di esperienza nell'architettura e nella creazione di applicazioni distribuite, ibride e cloud. La sua passione è creare soluzioni AI/ML e big data sicure, scalabili e affidabili per aiutare i clienti aziendali nel loro percorso di adozione e ottimizzazione del cloud per migliorare i risultati aziendali. Nel tempo libero va in moto e cammina con la sua pecora di tre anni!

Sovik Kumar Nath è un architetto di soluzioni AI/ML con AWS. Ha una vasta esperienza nella progettazione di soluzioni di machine learning e analisi aziendale end-to-end in finanza, operazioni, marketing, sanità, gestione della supply chain e IoT. Sovik ha pubblicato articoli e detiene un brevetto nel monitoraggio del modello ML. Ha conseguito un doppio master presso la University of South Florida, l'Università di Friburgo, in Svizzera, e una laurea presso l'Indian Institute of Technology, Kharagpur. Al di fuori del lavoro, a Sovik piace viaggiare, prendere il traghetto e guardare film.

Sovik Kumar Nath è un architetto di soluzioni AI/ML con AWS. Ha una vasta esperienza nella progettazione di soluzioni di machine learning e analisi aziendale end-to-end in finanza, operazioni, marketing, sanità, gestione della supply chain e IoT. Sovik ha pubblicato articoli e detiene un brevetto nel monitoraggio del modello ML. Ha conseguito un doppio master presso la University of South Florida, l'Università di Friburgo, in Svizzera, e una laurea presso l'Indian Institute of Technology, Kharagpur. Al di fuori del lavoro, a Sovik piace viaggiare, prendere il traghetto e guardare film.

Maira Ladeira Tanke è uno specialista di dati senior presso AWS. In qualità di responsabile tecnico, aiuta i clienti ad accelerare il raggiungimento del valore aziendale attraverso tecnologie emergenti e soluzioni innovative. Maira lavora in AWS da gennaio 2020. In precedenza, ha lavorato come data scientist in diversi settori concentrandosi sull'ottenimento di valore aziendale dai dati. Nel tempo libero, Maira ama viaggiare e trascorrere del tempo con la sua famiglia in un posto caldo.

Maira Ladeira Tanke è uno specialista di dati senior presso AWS. In qualità di responsabile tecnico, aiuta i clienti ad accelerare il raggiungimento del valore aziendale attraverso tecnologie emergenti e soluzioni innovative. Maira lavora in AWS da gennaio 2020. In precedenza, ha lavorato come data scientist in diversi settori concentrandosi sull'ottenimento di valore aziendale dai dati. Nel tempo libero, Maira ama viaggiare e trascorrere del tempo con la sua famiglia in un posto caldo.

Ryan Lempka è Senior Solutions Architect presso Amazon Web Services, dove aiuta i suoi clienti a lavorare a ritroso rispetto agli obiettivi aziendali per sviluppare soluzioni su AWS. Ha una profonda esperienza nella strategia aziendale, nella gestione dei sistemi IT e nella scienza dei dati. Ryan si impegna a imparare per tutta la vita e si diverte a sfidare se stesso ogni giorno per imparare qualcosa di nuovo.

Ryan Lempka è Senior Solutions Architect presso Amazon Web Services, dove aiuta i suoi clienti a lavorare a ritroso rispetto agli obiettivi aziendali per sviluppare soluzioni su AWS. Ha una profonda esperienza nella strategia aziendale, nella gestione dei sistemi IT e nella scienza dei dati. Ryan si impegna a imparare per tutta la vita e si diverte a sfidare se stesso ogni giorno per imparare qualcosa di nuovo.

Sriharsh Adari è Senior Solutions Architect presso Amazon Web Services (AWS), dove aiuta i clienti a lavorare a ritroso dai risultati aziendali per sviluppare soluzioni innovative su AWS. Nel corso degli anni, ha aiutato più clienti nelle trasformazioni della piattaforma dati in tutti i settori verticali. Le sue principali aree di competenza includono la strategia tecnologica, l'analisi dei dati e la scienza dei dati. Nel tempo libero, gli piace fare sport, guardare programmi TV e giocare a Tabla.

Sriharsh Adari è Senior Solutions Architect presso Amazon Web Services (AWS), dove aiuta i clienti a lavorare a ritroso dai risultati aziendali per sviluppare soluzioni innovative su AWS. Nel corso degli anni, ha aiutato più clienti nelle trasformazioni della piattaforma dati in tutti i settori verticali. Le sue principali aree di competenza includono la strategia tecnologica, l'analisi dei dati e la scienza dei dati. Nel tempo libero, gli piace fare sport, guardare programmi TV e giocare a Tabla.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 12

- 12 mesi

- 2020

- 28

- 7

- 8

- 971

- a

- WRI

- accelerare

- accesso

- accessibile

- Secondo

- Il mio account

- conti

- realizzazione

- il raggiungimento

- operanti in

- azioni

- attività

- Ad

- adattare

- adattamento

- aggiunta

- aggiuntivo

- indirizzo

- indirizzi

- indirizzamento

- Admin

- amministratori

- Adottando

- Adozione

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Modelli AI

- AI / ML

- Avvisi

- Tutti

- permesso

- Consentire

- consente

- lungo

- già

- anche

- Sebbene il

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- .

- analitica

- ed

- e infrastruttura

- in qualsiasi

- applicazioni

- approccio

- opportuno

- approvato

- architettura

- Archivio

- SONO

- RISERVATA

- news

- AS

- Attività

- associato

- assumere

- At

- Autenticazione

- autorizzazione

- automatizzare

- Automatizzata

- Automazione

- disponibile

- AWS

- Equilibrio

- basato

- Linea di base

- BE

- perché

- diventa

- stato

- prima

- essendo

- benefico

- vantaggi

- MIGLIORE

- best practice

- fra

- pregiudizio

- Big

- Big Data

- Rompere

- brevemente

- costruire

- Costruzione

- costruisce

- affari

- strategia d'affari

- ma

- by

- Materiale

- candidato

- funzionalità

- carta

- Carte

- Custodie

- casi

- catalogo

- categoria

- Dedicato

- Causare

- centro

- centrale

- Centralizzazione

- centralizzata

- catena

- sfide

- impegnativo

- Controlli

- chimica

- strettamente

- Cloud

- adozione del cloud

- infrastruttura cloud

- codice

- collaborazione

- collezione

- collettivamente

- Uncommon

- Aziende

- conformità

- compiacente

- componenti

- incluso

- concetto

- concetti

- considerato

- considerando

- ritiene

- consumare

- Consumatori

- Contenitore

- di controllo

- Torre di controllo

- controllata

- controlli

- coordinato

- Nucleo

- Costo

- Costi

- coperto

- creare

- creato

- curation

- Clienti

- personalizzare

- personalizzate

- cruscotto

- cruscotti

- dati

- l'accesso ai dati

- Dati Analytics

- Lago di dati

- Piattaforma dati

- privacy dei dati

- scienza dei dati

- scienziato di dati

- dataset

- giorno

- decenni

- dedicato

- deep

- Laurea

- dipartimenti

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- Distribuisce

- Design

- progettato

- progettazione

- dettagli

- Dev

- sviluppare

- sviluppato

- Mercato

- sviluppi

- diverso

- dimensioni

- dirette

- discutere

- discusso

- distinto

- distribuito

- immersione

- dominio

- doppio

- giù

- ogni

- sforzi

- incastrare

- incorporato

- incorporamento

- emergenti del mondo

- Tecnologia emergente

- enable

- abilitato

- Abilita

- consentendo

- incoraggiare

- da un capo all'altro

- endpoint

- ingegnere

- Ingegneria

- Ingegneri

- accrescere

- garantire

- assicura

- assicurando

- Impresa

- di livello enterprise

- aziende

- Ambiente

- ambienti

- essential

- valutare

- eventi

- Ogni

- ogni giorno

- esempio

- esperienza

- esperimento

- esperimenti

- competenza

- espresso

- estendendo

- estensivo

- Conclamata Esperienza

- di fronte

- facilitare

- famiglia

- caratteristica

- Caratteristiche

- feedback

- pochi

- figura

- filtro

- finanziare

- finanziario

- servizi finanziari

- Nome

- Flessibilità

- Florida

- flusso

- messa a fuoco

- i seguenti

- Nel

- modulo

- formazione

- Fondazione

- Fondazioni

- quattro

- Contesto

- Gratis

- da

- function

- funzionale

- funzionalità

- funzionalità

- funzioni

- ulteriormente

- Inoltre

- Guadagno

- generare

- la generazione di

- generativo

- AI generativa

- dà

- globali

- la governance

- modello di governance

- modulo di governo

- governati

- governo

- rilascio

- Gruppo

- guida

- Avere

- avendo

- he

- capo

- assistenza sanitaria

- sentire

- Aiuto

- aiutato

- aiuta

- suo

- Alta

- alto livello

- il suo

- detiene

- olistica

- ganci

- padroni di casa

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Hub

- IBRIDO

- identificazione

- Identità

- if

- realizzare

- implementazione

- implementato

- Implementazione

- competenze

- miglioramento

- in

- includere

- inclusi

- Compreso

- crescente

- indipendentemente

- indiano

- industrie

- industria

- informazioni

- Infrastruttura

- inizialmente

- iniziati

- innovare

- creativi e originali

- esempio

- Istituto

- integrato

- interagire

- interazioni

- interessato

- Internet

- accesso ad Internet

- ai miglioramenti

- introdotto

- investimento

- IoT

- da solo

- IT

- Gennaio

- Lavoro

- viaggio

- jpg

- Le

- conoscenze

- Kumar

- Dipingere

- lago

- laghi

- atterraggio

- Lingua

- grandi

- dopo

- strato

- portare

- IMPARARE

- apprendimento

- Livello

- livelli

- ciclo di vita

- piace

- lignaggio

- Linee

- locale

- ceppo

- registrazione

- cerca

- macchina

- machine learning

- fatto

- mantenere

- FA

- gestire

- gestito

- gestione

- gestisce

- gestione

- molti

- Maps

- Marketing

- alunni

- maturità

- Maggio..

- membro

- menzionato

- maglia

- Metadati

- attenuante

- mitigazione dei rischi

- ML

- MLOp

- modello

- modelli

- modificare

- componibile

- Moduli

- moduli

- Monitorare

- monitoraggio

- monitor

- mese

- Scopri di più

- maggior parte

- MOTO

- Film

- multiplo

- nativo

- Bisogno

- esigenze

- Nest

- Rete

- internazionale

- reti

- New

- Nuove funzionalità

- GENERAZIONE

- taccuino

- numero

- Obiettivi d'Esame

- occasionale

- of

- Offerte

- Office

- di frequente

- Vecchio

- on

- una volta

- ONE

- in corso

- operare

- operato

- opera

- operativo

- Operazioni

- ottimizzazione

- OTTIMIZZA

- or

- organizzazione

- organizzazioni

- organizzazione

- Altro

- nostro

- su

- risultati

- al di fuori

- ancora

- complessivo

- panoramica

- pacchetto

- parte

- particolare

- appassionato

- brevetto

- Eseguire

- performance

- permessi

- conduttura

- posto

- pianura

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- Termini e Condizioni

- politica

- lavori

- Post

- pratica

- pratiche

- presenti

- prevenzione

- primario

- Direttore

- Precedente

- Privacy

- un bagno

- settore privato

- Proactive

- problemi

- processi

- i processi

- produttore

- Produttori

- Prodotto

- Produzione

- Prodotti

- progetti

- promozione

- prova

- prova del concetto

- proteggere

- fornire

- fornisce

- fornitura

- la percezione

- pubblicato

- scopo

- qualità

- rapidamente

- veloce

- Leggi

- recente

- riconoscere

- raccomandare

- Consigli

- ridurre

- riferimento

- regioni

- registro

- registrato

- registri

- registro

- regolamentati

- industrie regolamentate

- affidabile

- rimozione

- Report

- richiedere

- necessario

- Requisiti

- risorsa

- Risorse

- risponde

- responsabile

- riutilizzare

- corse

- Rischio

- rischi

- Ruolo

- ruoli

- radice

- Regola

- norme

- Correre

- running

- Ryan

- sacrificando

- sagemaker

- Pipeline SageMaker

- stesso

- scalabile

- Scala

- scala

- Scienze

- Scienziato

- scienziati

- Cerca

- secondario

- Sezione

- settore

- sicuro

- problemi di

- eventi di sicurezza

- Fai da te

- anziano

- Serie

- servizio

- Servizi

- set

- Set

- regolazione

- flessibile.

- Condividi

- condiviso

- azioni

- compartecipazione

- lei

- Corti

- dovrebbero

- mostrato

- Spettacoli

- Un'espansione

- da

- singolo

- Taglia

- piccole

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- qualcosa

- Sud

- South Florida

- specialista

- specializzata

- specifico

- Spendere

- Sports

- tappe

- delle parti interessate

- stakeholder

- standard

- inizia a

- Regione / Stato

- step

- Passi

- Ancora

- fermato

- conservazione

- Tornare al suo account

- negozi

- strategie

- Strategia

- forte

- La struttura

- strutture

- studio

- di successo

- tale

- Completo

- SOMMARIO

- fornire

- supply chain

- gestione della catena di approvvigionamento

- supporto

- Supporto

- sicuro

- Svizzera

- SISTEMI DI TRATTAMENTO

- tavolo

- su misura

- prende

- presa

- Target

- team

- le squadre

- Consulenza

- Tecnologia

- Strategia tecnologica

- modello

- modelli

- test

- Testing

- che

- Il

- Lo Stato

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- questo

- quelli

- Attraverso

- per tutto

- tempo

- a

- strumenti

- verso

- Torre

- pista

- Tracking

- tradizionale

- Treni

- trasformazioni

- transito

- Di viaggio

- TURNO

- tv

- Tipi di

- per

- capire

- sleale

- unità

- Università

- us

- Impiego

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilizzare

- convalida

- APPREZZIAMO

- varietà

- vario

- verticali

- via

- Violazioni

- visibilità

- visualizzazione

- visualizzare

- camminare

- volere

- caldo

- guardare

- we

- sito web

- servizi web

- WELL

- quando

- se

- quale

- while

- volere

- con

- entro

- senza

- Lavora

- lavorato

- flussi di lavoro

- lavoro

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro