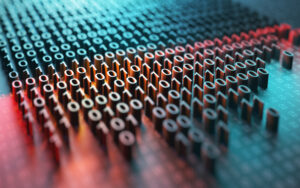

Quando una grave vulnerabilità scuote il mondo della sicurezza informatica, come la recente backdoor XZ o le falle Log4j2 del 2021, la prima domanda che la maggior parte delle aziende si pone è: “Siamo colpiti?” In assenza di playbook ben scritti, la risposta a una domanda semplice può richiedere un grande sforzo.

Microsoft e Google stanno investendo molto in sistemi di intelligenza artificiale generativa (GenAI) che possono trasformare grandi domande di sicurezza in azioni concrete, assistere le operazioni di sicurezza e, sempre più spesso, intraprendere azioni automatizzate. Microsoft offre centri operativi di sicurezza oberati di lavoro con Copilota di sicurezza, un servizio basato su GenAI che può identificare le violazioni, collegare i segnali di minaccia e analizzare i dati. E quello di Google Gemelli in Sicurezza è una raccolta di funzionalità di sicurezza alimentate da Gemini GenAI dell'azienda.

Startup Simbian si unisce alla gara con la sua nuova piattaforma basata su GenAI per aiutare le aziende ad affrontare le loro operazioni di sicurezza. Il sistema di Simbian combina modelli linguistici di grandi dimensioni (LLM) per riassumere i dati e comprendere le lingue native, altri modelli di apprendimento automatico per connettere punti dati disparati e un sistema esperto basato su software basato su informazioni di sicurezza raccolte da Internet.

Laddove la configurazione di un sistema di gestione delle informazioni e degli eventi di sicurezza (SIEM) o di un sistema di orchestrazione, automazione e risposta della sicurezza (SOAR) potrebbe richiedere settimane o mesi, l’utilizzo dell’intelligenza artificiale riduce i tempi, in alcuni casi, a secondi, afferma Ambuj Kumar, co- fondatore e amministratore delegato di Simbian.

"Con Simbian, queste cose vengono fatte letteralmente in pochi secondi", afferma. “Fai una domanda, esprimi il tuo obiettivo in linguaggio naturale, noi suddividiamo in passaggi l'esecuzione del codice e tutto questo avviene automaticamente. È autosufficiente."

Aiutare gli analisti della sicurezza e gli addetti alla risposta agli incidenti, oberati di lavoro, a semplificare il loro lavoro è un'applicazione perfetta per le funzionalità più potenti di GenAI, afferma Eric Doerr, vicepresidente della progettazione presso Google Cloud.

“Le opportunità nel campo della sicurezza sono particolarmente acute considerato l’elevato panorama delle minacce, il divario di talenti ben pubblicizzato tra i professionisti della sicurezza informatica e la fatica che rappresenta lo status quo nella maggior parte dei team di sicurezza”, afferma Doerr. “Accelerare la produttività e ridurre i tempi medi necessari per rilevare, rispondere e contenere [o] mitigare le minacce attraverso l’uso di GenAI consentirà ai team di sicurezza di recuperare e difendere le proprie organizzazioni con maggiore successo”.

Diversi punti di partenza, diversi “vantaggi”

I vantaggi di Google sul mercato sono evidenti. Il gigante dell’IT e di Internet ha il budget per mantenere la rotta, le competenze tecniche nell’apprendimento automatico e nell’intelligenza artificiale derivanti dai suoi progetti DeepMind per innovare e l’accesso a molti dati di formazione: una considerazione fondamentale per la creazione di LLM.

"Disponiamo di un'enorme quantità di dati proprietari che abbiamo utilizzato per addestrare un LLM di sicurezza personalizzato, SecLM, che fa parte di Gemini for Security", afferma Doerr. "Questo è il superset di 20 anni di intelligenza Mandiant, VirusTotal e altro ancora, e siamo l'unica piattaforma che dispone di un'API aperta - parte di Gemini for Security - che consente ai partner e ai clienti aziendali di estendere le nostre soluzioni di sicurezza e avere un un’unica intelligenza artificiale in grado di operare con tutto il contesto dell’impresa”.

Come la guida di Simbian, Gemini nelle operazioni di sicurezza: una capacità sotto l'egida di Gemini in Security — assisterà nelle indagini a partire dalla fine di aprile, guidando l'analista della sicurezza e consigliando azioni dall'interno di Chronicle Enterprise.

Simbian utilizza query in linguaggio naturale per generare risultati, quindi chiedendo: "Siamo interessati dalla vulnerabilità XZ?" produrrà una tabella di indirizzi IP delle applicazioni vulnerabili. Il sistema utilizza inoltre conoscenze selezionate sulla sicurezza raccolte da Internet per creare guide per gli analisti della sicurezza che mostrano loro uno script di istruzioni da fornire al sistema per eseguire un'attività specifica.

"La guida è un modo per personalizzare o creare contenuti affidabili", afferma Kumar di Simbian. "In questo momento stiamo creando le guide, ma una volta... le persone inizieranno a usarle, allora potranno crearne di proprie."

Forti richieste di ROI per i LLM

I ritorni sugli investimenti aumenteranno man mano che le aziende passeranno da un processo manuale a un processo assistito verso un’attività autonoma. La maggior parte dei sistemi basati su GenAI sono avanzati solo fino allo stadio di assistente o copilota, quando suggerisce azioni o esegue solo una serie limitata di azioni, dopo aver ottenuto le autorizzazioni degli utenti.

Il vero ritorno sull’investimento arriverà più tardi, afferma Kumar.

"Ciò che siamo entusiasti di costruire è autonomo: autonomo significa prendere decisioni per tuo conto che rientrano nell'ambito della guida che gli hai fornito", afferma.

Gemini di Google sembra anche colmare il divario tra un assistente AI e un motore automatizzato. La società di servizi finanziari Fiserv utilizza Gemini nelle operazioni di sicurezza per creare rilevamenti e playbook più velocemente e con meno sforzo e per aiutare gli analisti della sicurezza a trovare rapidamente risposte utilizzando la ricerca in linguaggio naturale, aumentando la produttività dei team di sicurezza, afferma Doerr.

Tuttavia, afferma, la fiducia è ancora un problema e un ostacolo per una maggiore automazione. Per rafforzare la fiducia nel sistema e nelle soluzioni, Google rimane concentrato sulla creazione di sistemi di intelligenza artificiale spiegabili che siano trasparenti nel modo in cui giungono a una decisione.

"Quando utilizzi un input in linguaggio naturale per creare un nuovo rilevamento, ti mostriamo la sintassi del linguaggio di rilevamento e tu scegli di eseguirlo", afferma. “Questo fa parte del processo di creazione di fiducia e contesto con Gemini for Security”.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://www.darkreading.com/cybersecurity-operations/race-ai-powered-platforms-security-platforms

- :ha

- :È

- $ SU

- 20

- 20 anni

- 2021

- 7

- a

- Chi siamo

- assenza

- accelerando

- accesso

- realizzare

- azioni

- attività

- indirizzi

- Avanzate

- vantaggi

- influenzato

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Assistente AI

- Sistemi di intelligenza artificiale

- AI-alimentato

- Tutti

- consente

- anche

- quantità

- an

- analista

- Gli analisti

- analizzare

- ed

- rispondere

- risposte

- api

- Applicazioni

- applicazioni

- Aprile

- SONO

- artificiale

- intelligenza artificiale

- AS

- chiedere

- chiedendo

- assistere

- Assistant

- assistito

- At

- Automatizzata

- automaticamente

- Automazione

- autonomo

- porta posteriore

- basato

- per conto

- fra

- sostenere

- potenziamento

- violazioni

- Rompere

- budget limitato.

- Costruzione

- ma

- by

- Materiale

- funzionalità

- capacità

- casi

- lotta

- centri

- ceo

- Scegli

- cronaca

- Cloud

- Co-fondatore

- codice

- collezione

- combina

- Venire

- Aziende

- azienda

- calcestruzzo

- fiducia

- configurazione

- Connettiti

- considerazione

- contenere

- contenuto

- contesto

- potuto

- Portata

- creare

- Creazione

- critico

- a cura

- costume

- Clienti

- tagli

- Cybersecurity

- dati

- punti dati

- affare

- decisione

- decisioni

- DeepMind

- individuare

- rivelazione

- diverso

- disparato

- fatto

- giù

- guida

- sforzo

- elevata

- enable

- fine

- motore

- Ingegneria

- Impresa

- eric

- Evento

- evidente

- eccitato

- esecuzione

- esperto

- competenza

- esprimere

- estendere

- più veloce

- finanziario

- servizi finanziari

- Trovare

- Impresa

- Nome

- Fiserv

- difetti

- concentrato

- Nel

- da

- guadagnando

- divario

- raccolto

- Gemini

- genio

- generare

- generativo

- gigante

- Dare

- dato

- scopo

- Google cloud

- grande

- Crescere

- guida

- guidare

- Avere

- he

- pesantemente

- aiutare

- Come

- HTTPS

- ostacolo

- in

- incidente

- è aumentato

- sempre più

- informazioni

- innovare

- ingresso

- Intelligence

- Internet

- ai miglioramenti

- Indagini

- investire

- investimento

- IP

- Gli indirizzi IP

- problema

- IT

- SUO

- Offerte di lavoro

- accoppiamento

- jpg

- ad appena

- conoscenze

- Kumar

- paesaggio

- Lingua

- Le Lingue

- grandi

- dopo

- apprendimento

- meno

- Limitato

- LLM

- lotto

- macchina

- machine learning

- maggiore

- Fare

- gestione

- Manuale

- Rappresentanza

- significare

- Microsoft

- Ridurre la perdita dienergia con una

- modelli

- mese

- Scopri di più

- maggior parte

- cambiano

- nativo

- Naturale

- New

- adesso

- of

- Offerte

- on

- una volta

- ONE

- esclusivamente

- aprire

- operare

- Operazioni

- Opportunità

- or

- orchestrazione

- organizzazioni

- Altro

- nostro

- proprio

- parte

- particolarmente

- partner

- Persone

- perfetta

- permessi

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- punti

- alimentato

- potente

- Presidente

- processi

- produrre

- della produttività

- Scelto dai professionisti

- progetti

- istruzioni

- proprio

- query

- domanda

- Domande

- rapidamente

- Gara

- RE

- di rose

- recente

- raccomandando

- resti

- richiedere

- Rispondere

- risposta

- Risultati

- ritorno

- problemi

- Ritorno sull'investimento

- destra

- ROI

- Correre

- s

- dice

- portata

- copione

- Cerca

- secondo

- problemi di

- sembra

- AUTO

- Serie

- servizio

- Servizi

- mostrare attraverso le sue creazioni

- Segnali

- Un'espansione

- singolo

- So

- volare

- Software

- Soluzioni

- alcuni

- specifico

- Stage

- inizia a

- Di partenza

- Stato dei servizi

- soggiorno

- Passi

- Ancora

- snellire

- forte

- Con successo

- tale

- sufficiente

- suggerisce

- sintassi

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- attrezzatura

- Fai

- prende

- Talento

- Task

- le squadre

- Consulenza

- che

- I

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- questo

- minaccia

- minacce

- Attraverso

- tempo

- a

- Treni

- Training

- trasparente

- enorme

- Affidati ad

- di fiducia

- TURNO

- e una comprensione reciproca

- uso

- utilizzato

- utenti

- usa

- utilizzando

- Ve

- vice

- Vicepresidente

- vulnerabilità

- Vulnerabile

- Modo..

- we

- Settimane

- WELL

- Che

- quando

- quale

- volere

- con

- entro

- mondo

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro