Il machine learning (ML) sta rivoluzionando le soluzioni in tutti i settori e generando nuove forme di insight e intelligenza dai dati. Molti algoritmi ML si addestrano su set di dati di grandi dimensioni, generalizzando i modelli trovati nei dati e deducendo risultati da tali modelli man mano che vengono elaborati nuovi record invisibili. Di solito, se il set di dati o il modello è troppo grande per essere addestrato su una singola istanza, formazione distribuita consente l'utilizzo di più istanze all'interno di un cluster e la distribuzione di dati o partizioni di modello tra tali istanze durante il processo di training. Il supporto nativo per la formazione distribuita viene offerto tramite Amazon Sage Maker SDK, insieme a quaderni di esempio nei quadri popolari.

Tuttavia, a volte a causa delle normative sulla sicurezza e sulla privacy all'interno o tra le organizzazioni, i dati sono decentralizzati su più account o in diverse regioni e non possono essere centralizzati in un unico account o tra regioni. In questo caso, l'apprendimento federato (FL) dovrebbe essere considerato per ottenere un modello generalizzato sull'insieme dei dati.

In questo post, discutiamo di come implementare l'apprendimento federato su Amazon SageMaker per eseguire il machine learning con dati di addestramento decentralizzati.

Cos’è l’apprendimento federato?

L'apprendimento federato è un approccio ML che consente a più sessioni di formazione separate eseguite in parallelo di oltrepassare ampi confini, ad esempio geograficamente, e di aggregare i risultati per costruire un modello generalizzato (modello globale) nel processo. Più specificamente, ogni sessione di formazione utilizza il proprio set di dati e ottiene il proprio modello locale. I modelli locali presenti in diverse sessioni di formazione verranno aggregati (ad esempio, aggregazione del peso del modello) in un modello globale durante il processo di formazione. Questo approccio è in contrasto con le tecniche di ML centralizzate in cui i set di dati vengono uniti per una sessione di formazione.

Apprendimento federato e formazione distribuita sul cloud

Quando questi due approcci vengono eseguiti sul cloud, la formazione distribuita avviene in una regione su un account e i dati di formazione iniziano con una sessione di formazione o un lavoro centralizzato. Durante il processo di addestramento distribuito, il set di dati viene suddiviso in sottoinsiemi più piccoli e, a seconda della strategia (parallelismo dei dati o parallelismo del modello), i sottoinsiemi vengono inviati a diversi nodi di addestramento o passano attraverso i nodi in un cluster di addestramento, il che significa che i singoli dati non necessariamente rimanere in un nodo del cluster.

Al contrario, con l’apprendimento federato, la formazione di solito avviene in più account separati o in più regioni. Ogni account o regione ha le proprie istanze di formazione. I dati di formazione sono decentralizzati tra account o regioni dall'inizio alla fine e i dati individuali vengono letti solo dalla rispettiva sessione di formazione o lavoro tra diversi account o regioni durante il processo di apprendimento federato.

Quadro di apprendimento federato dei fiori

Sono disponibili diversi framework open source per l'apprendimento federato, come ad esempio DESTINO, Fiore, PySyft, ApriFL, FedML, NVFlaree Tensorflow federato. Quando si sceglie un framework FL, in genere ne consideriamo il supporto per la categoria del modello, il framework ML e il dispositivo o il sistema operativo. Dobbiamo anche considerare l'estensibilità del framework FL e le dimensioni del pacchetto in modo da eseguirlo in modo efficiente sul cloud. In questo post scegliamo un framework facilmente estensibile, personalizzabile e leggero, Flower, per eseguire l'implementazione FL utilizzando SageMaker.

Flower è un framework FL completo che si distingue dai framework esistenti offrendo nuove strutture per eseguire esperimenti FL su larga scala e consente scenari di dispositivi FL estremamente eterogenei. FL risolve le sfide legate alla privacy dei dati e alla scalabilità in scenari in cui la condivisione dei dati non è possibile.

Principi di progettazione e implementazione di Flower FL

Flower FL è indipendente dal linguaggio e dal framework ML in base alla progettazione, è completamente estensibile e può incorporare algoritmi emergenti, strategie di formazione e protocolli di comunicazione. Flower è open source con licenza Apache 2.0.

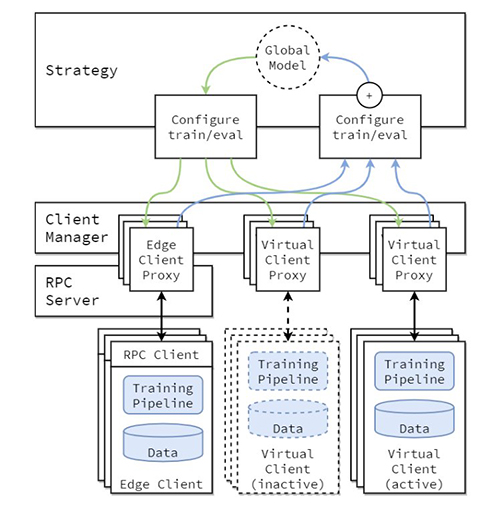

L'architettura concettuale dell'implementazione FL è descritta nel documento Fiore: un quadro di apprendimento federato amichevole ed è evidenziato nella figura seguente.

In questa architettura, i client edge risiedono su dispositivi edge reali e comunicano con il server tramite RPC. I client virtuali, d'altro canto, consumano quasi zero risorse quando sono inattivi e caricano il modello e i dati in memoria solo quando il client viene selezionato per la formazione o la valutazione.

Il server Flower costruisce la strategia e le configurazioni da inviare ai client Flower. Serializza questi dizionari di configurazione (o dict in breve) nella loro rappresentazione ProtoBuf, li trasporta al client utilizzando gRPC e quindi li deserializza nuovamente nei dizionari Python.

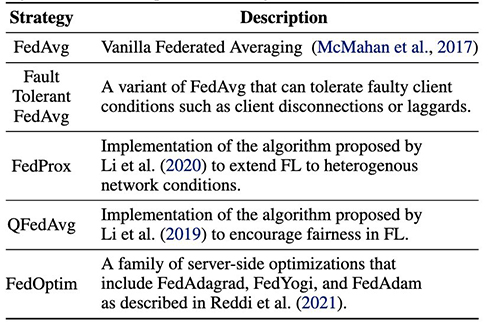

Strategie FL dei fiori

Flower consente la personalizzazione del processo di apprendimento attraverso il astrazione della strategia. La strategia definisce l'intero processo di federazione specificando l'inizializzazione dei parametri (se si tratta di server o client inizializzato), il numero minimo di client disponibili richiesti per inizializzare un'esecuzione, il peso dei contributi del client e i dettagli di formazione e valutazione.

Flower dispone di un'ampia implementazione di algoritmi di media FL e di un robusto stack di comunicazione. Per un elenco degli algoritmi di calcolo della media implementati e dei documenti di ricerca associati, fare riferimento alla tabella seguente, da Fiore: un quadro di apprendimento federato amichevole.

Apprendimento federato con SageMaker: architettura della soluzione

Un'architettura di apprendimento federata che utilizza SageMaker con il framework Flower è implementata su flussi gRPC (foundation) bidirezionali. gRPC definisce i tipi di messaggi scambiati e utilizza compilatori per generare quindi un'implementazione efficiente per Python, ma può anche generare l'implementazione per altri linguaggi, come Java o C++.

I client Flower ricevono istruzioni (messaggi) come array di byte grezzi attraverso la rete. Quindi i client deserializzano ed eseguono l'istruzione (addestramento sui dati locali). I risultati (parametri e pesi del modello) vengono quindi serializzati e comunicati al server.

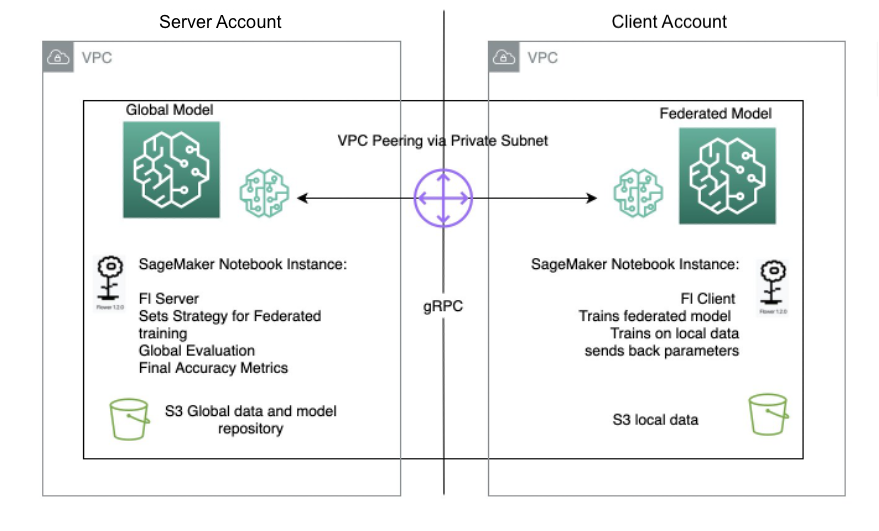

L'architettura server/client per Flower FL è definita in SageMaker utilizzando istanze notebook in account diversi nella stessa regione del server Flower e del client Flower. Sul server vengono definite le strategie di addestramento e valutazione così come i parametri globali, quindi la configurazione viene serializzata e inviata al client tramite peering VPC.

Il client dell'istanza notebook avvia un processo di formazione SageMaker che esegue uno script personalizzato per attivare l'istanziazione del client Flower, che deserializza e legge la configurazione del server, attiva il processo di formazione e invia la risposta dei parametri.

L'ultimo passaggio avviene sul server quando la valutazione dei nuovi parametri aggregati viene avviata al completamento del numero di esecuzioni e client stabiliti nella strategia del server. La valutazione avviene su un set di dati di test esistente solo sul server e vengono prodotte le nuove metriche di precisione migliorate.

Il diagramma seguente illustra l'architettura della configurazione FL su SageMaker con il pacchetto Flower.

Implementa l'apprendimento federato utilizzando SageMaker

SageMaker è un servizio ML completamente gestito. Con SageMaker, data scientist e sviluppatori possono creare e addestrare rapidamente modelli ML e quindi distribuirli in un ambiente ospitato pronto per la produzione.

In questo post, dimostriamo come utilizzare la piattaforma ML gestita per fornire un ambiente di esperienza notebook ed eseguire l'apprendimento federato tra gli account AWS, utilizzando i processi di formazione SageMaker. I dati di addestramento grezzi non lasciano mai l'account proprietario dei dati e solo i pesi derivati vengono inviati attraverso la connessione in peering.

Evidenziamo i seguenti componenti principali in questo post:

- Networking – SageMaker consente l'impostazione rapida della configurazione di rete predefinita, consentendo inoltre di personalizzare completamente la rete in base ai requisiti della propria organizzazione. Usiamo a Configurazione del peering VPC all'interno della Regione in questo esempio.

- Impostazioni di accesso tra più account – Per consentire a un utente nell'account del server di avviare un lavoro di formazione del modello nell'account del cliente, noi delegare l'accesso tra gli account utilizzando Gestione dell'identità e dell'accesso di AWS (IAM) ruoli. In questo modo, un utente nell'account server non deve uscire dall'account e accedere all'account client per eseguire azioni su SageMaker. Questa impostazione serve solo allo scopo di avviare processi di formazione SageMaker e non prevede alcuna autorizzazione o condivisione di accesso ai dati tra account.

- Implementazione del codice client di apprendimento federato nell'account client e del codice server nell'account server – Implementiamo il codice client di apprendimento federato nell'account cliente utilizzando il pacchetto Flower e la formazione gestita SageMaker. Nel frattempo, implementiamo il codice server nell'account del server utilizzando il pacchetto Flower.

Configura il peering VPC

Una connessione peering VPC è una connessione di rete tra due VPC che consente di instradare il traffico tra di essi utilizzando indirizzi IPv4 privati o indirizzi IPv6. Le istanze in entrambi i VPC possono comunicare tra loro come se si trovassero all'interno della stessa rete.

Per configurare una connessione peering VPC, crea innanzitutto una richiesta di peering con un altro VPC. Puoi richiedere una connessione peering VPC con un altro VPC nello stesso account o, nel nostro caso d'uso, connetterti con un VPC in un account AWS diverso. Per attivare la richiesta, il proprietario del VPC deve accettare la richiesta. Per ulteriori dettagli sul peering VPC, fare riferimento a Crea una connessione peering VPC.

Avvia le istanze notebook SageMaker nei VPC

Un'istanza notebook SageMaker fornisce un'app notebook Jupyter tramite un ML completamente gestito Cloud di calcolo elastico di Amazon (Amazon EC2). I notebook SageMaker Jupyter vengono utilizzati per eseguire l'esplorazione avanzata dei dati, creare processi di formazione, distribuire modelli sull'hosting SageMaker e testare o convalidare i modelli.

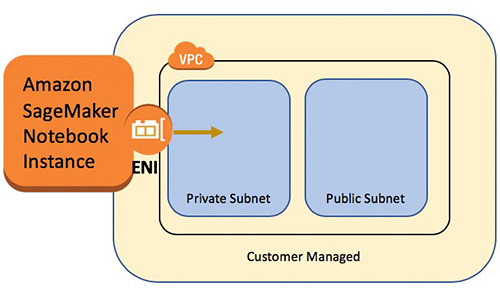

L'istanza notebook ha a disposizione diverse configurazioni di rete. In questa configurazione, l'istanza notebook viene eseguita all'interno di una sottorete privata del VPC e non abbiamo accesso diretto a Internet.

Configura le impostazioni di accesso tra più account

Le impostazioni di accesso tra account includono due passaggi per delegare l'accesso dall'account server all'account client utilizzando i ruoli IAM:

- Crea un ruolo IAM nell'account cliente.

- Concedere l'accesso al ruolo nell'account del server.

Per i passaggi dettagliati per impostare uno scenario simile, fare riferimento a Delega l'accesso agli account AWS utilizzando i ruoli IAM.

Nell'account cliente creiamo un ruolo IAM chiamato FL-kickoff-client-job con la politica FL-sagemaker-actions legato al ruolo. IL FL-sagemaker-actions la policy ha il contenuto JSON come segue:

Modifichiamo quindi la politica di fiducia nelle relazioni di fiducia del FL-kickoff-client-job ruolo:

Nell'account del server, le autorizzazioni vengono aggiunte a un utente esistente (ad esempio, developer) per consentire il passaggio a FL-kickoff-client-job ruolo nell'account cliente. Per fare ciò, creiamo una policy in linea chiamata FL-allow-kickoff-client-job e allegarlo all'utente. Di seguito è riportato il contenuto JSON della policy:

Set di dati campione e preparazione dei dati

In questo post, utilizziamo a set di dati curato per l'individuazione delle frodi nei dati dei fornitori di Medicare rilasciati dal Centri per i servizi Medicare e Medicaid (CMS). I dati sono suddivisi in un set di dati di training e un set di dati di test. Poiché la maggior parte dei dati non è fraudolenta, applichiamo percossero per bilanciare il set di dati di addestramento e suddividere ulteriormente il set di dati di addestramento in parti di addestramento e convalida. Sia i dati di training che quelli di validazione vengono caricati su un file Servizio di archiviazione semplice Amazon (Amazon S3) per l'addestramento del modello nell'account client e il set di dati di test viene utilizzato nell'account server solo a scopo di test. I dettagli del codice di preparazione dei dati sono riportati di seguito taccuino.

Con SageMaker immagini Docker precostruite per il framework scikit-learn e il processo di formazione gestito da SageMaker, addestriamo un modello di regressione logistica su questo set di dati utilizzando l'apprendimento federato.

Implementare un client di apprendimento federato nell'account cliente

Nell'istanza notebook SageMaker dell'account cliente, prepariamo a cliente.py sceneggiatura e a utils.py sceneggiatura. Il client.py il file contiene il codice per il client e il file utils.py Il file contiene il codice per alcune delle funzioni di utilità che saranno necessarie per la nostra formazione. Usiamo il pacchetto scikit-learn per costruire il modello di regressione logistica.

In client.py, definiamo un cliente Flower. Il client è derivato dalla classe fl.client.NumPyClient. È necessario definire i tre metodi seguenti:

- get_parametri – Restituisce i parametri del modello locale corrente. La funzione di utilità

get_model_parametersfarà questo. - in forma – Definisce i passaggi per addestrare il modello sui dati di addestramento nell'account del cliente. Riceve inoltre i parametri del modello globale e altre informazioni di configurazione dal server. Aggiorniamo i parametri del modello locale utilizzando i parametri globali ricevuti e continuiamo ad addestrarlo sul set di dati nell'account cliente. Questo metodo invia inoltre i parametri del modello locale dopo l'addestramento, la dimensione del set di addestramento e un dizionario che comunica valori arbitrari al server.

- valutare – Valuta i parametri forniti utilizzando i dati di convalida nell'account cliente. Restituisce al server la perdita insieme ad altri dettagli come la dimensione del set di convalida e l'accuratezza.

Quello che segue è uno snippet di codice per la definizione del client Flower:

Utilizziamo quindi SageMaker modalità script per preparare il resto client.py file. Ciò include la definizione dei parametri che verranno passati all'addestramento di SageMaker, il caricamento dei dati di addestramento e convalida, l'inizializzazione e l'addestramento del modello sul client, la configurazione del client Flower per comunicare con il server e infine il salvataggio del modello addestrato.

utils.py include alcune funzioni di utilità che vengono richiamate client.py:

- get_model_parameters – Restituisce il file scikit-learn Regressione logistica parametri del modello.

- set_model_params – Imposta i parametri del modello.

- set_initial_params – Inizializza i parametri del modello come zero. Ciò è necessario perché il server richiede i parametri del modello iniziale dal client all'avvio. Tuttavia, nel framework scikit-learn,

LogisticRegressioni parametri del modello non vengono inizializzati fino a quandomodel.fit()è chiamato. - Caricamento dati – Carica i dati di training e testing.

- salva_modello – Salva il modello come file

.joblibfile.

Poiché Flower non è un pacchetto installato nel file Contenitore Docker scikit-learn precostruito di SageMaker, elenchiamo flwr==1.3.0 in un requirements.txt file.

Inseriamo tutti e tre i file (client.py, utils.pye requirements.txt) sotto una cartella e comprimerlo con tar. Il file .tar.gz (denominato source.tar.gz in questo post) viene quindi caricato in un bucket S3 nell'account cliente.

Implementare un server di apprendimento federato nell'account del server

Nell'account del server, prepariamo il codice su un notebook Jupyter. Ciò include due parti: il server innanzitutto assume un ruolo per avviare un lavoro di formazione nell'account cliente, quindi il server federa il modello utilizzando Flower.

Assumi un ruolo per eseguire il processo di formazione nell'account cliente

Usiamo il SDK Boto3 Python per configurare un file Servizio token di sicurezza AWS (AWS STS) ad assumere il file FL-kickoff-client-job ruolo e configurare un client SageMaker in modo da eseguire un processo di formazione nell'account cliente utilizzando il processo di formazione gestito da SageMaker:

Utilizzando il ruolo assunto, creiamo un lavoro di formazione SageMaker nell'account cliente. Il lavoro di formazione utilizza il framework scikit-learn integrato di SageMaker. Tieni presente che tutti i bucket S3 e il ruolo IAM SageMaker nel seguente snippet di codice sono correlati all'account cliente:

Aggrega modelli locali in un modello globale utilizzando Flower

Prepariamo il codice per federare il modello sul server. Ciò include la definizione della strategia per la federazione e i suoi parametri di inizializzazione. Utilizziamo le funzioni di utilità nel file utils.py script descritto in precedenza per inizializzare e impostare i parametri del modello. Flower ti consente di definire le tue funzioni di callback per personalizzare una strategia esistente. Noi usiamo il FedMedia strategia con callback personalizzati per la valutazione e la configurazione dell'adattamento. Vedere il seguente codice:

Le due funzioni seguenti sono menzionate nel frammento di codice precedente:

- fit_round – Viene utilizzato per inviare il numero tondo al cliente. Passiamo questa richiamata come file

on_fit_config_fnparametro della strategia. Lo facciamo semplicemente per dimostrare l'uso dion_fit_config_fnparametro. - get_valuta_fn – Viene utilizzato per la valutazione del modello sul server.

A scopo dimostrativo, utilizziamo il set di dati di test che mettiamo da parte nella preparazione dei dati per valutare il modello federato dall'account del cliente e comunicare il risultato al cliente. Tuttavia, vale la pena notare che in quasi tutti i casi d'uso reali, i dati utilizzati nell'account server non vengono separati dal set di dati utilizzato nell'account client.

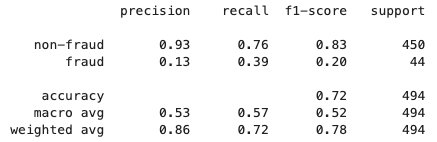

Una volta terminato il processo di apprendimento federato, a model.tar.gz il file viene salvato da SageMaker come artefatto del modello in un bucket S3 nell'account cliente. Nel frattempo, a model.joblib il file viene salvato sull'istanza del notebook SageMaker nell'account del server. Infine, utilizziamo il set di dati di test per testare il modello finale (model.joblib) sul server. L'output del test del modello finale è il seguente:

ripulire

Al termine, pulisci le risorse sia nell'account server che nell'account client per evitare costi aggiuntivi:

- Arresta le istanze del notebook SageMaker.

- Elimina le connessioni peering VPC e i VPC corrispondenti.

- Svuota ed elimina il bucket S3 creato per l'archiviazione dei dati.

Conclusione

In questo post abbiamo illustrato come implementare l'apprendimento federato su SageMaker utilizzando il pacchetto Flower. Abbiamo mostrato come configurare il peering VPC, impostare l'accesso tra account e implementare il client e il server FL. Questo post è utile per coloro che hanno bisogno di addestrare modelli ML su SageMaker utilizzando dati decentralizzati su account con condivisione dati limitata. Poiché il FL in questo post è implementato utilizzando SageMaker, vale la pena notare che molte più funzionalità di SageMaker possono essere introdotte nel processo.

L'implementazione dell'apprendimento federato su SageMaker può sfruttare tutte le funzionalità avanzate fornite da SageMaker durante il ciclo di vita ML. Esistono altri modi per ottenere o applicare l'apprendimento federato sul cloud AWS, ad esempio utilizzando istanze EC2 o all'edge. Per dettagli su questi approcci alternativi, fare riferimento a Apprendimento federato su AWS con FedML ed Applicazione dell'apprendimento federato per il machine learning all'edge.

Circa gli autori

Sherry Ding è un architetto senior di soluzioni specializzate in AI/ML presso Amazon Web Services (AWS). Ha una vasta esperienza nell'apprendimento automatico con un dottorato di ricerca in informatica. Lavora principalmente con clienti del settore pubblico su varie sfide aziendali legate all'intelligenza artificiale/ML, aiutandoli ad accelerare il loro percorso di apprendimento automatico sul cloud AWS. Quando non aiuta i clienti, le piacciono le attività all'aria aperta.

Sherry Ding è un architetto senior di soluzioni specializzate in AI/ML presso Amazon Web Services (AWS). Ha una vasta esperienza nell'apprendimento automatico con un dottorato di ricerca in informatica. Lavora principalmente con clienti del settore pubblico su varie sfide aziendali legate all'intelligenza artificiale/ML, aiutandoli ad accelerare il loro percorso di apprendimento automatico sul cloud AWS. Quando non aiuta i clienti, le piacciono le attività all'aria aperta.

Lorea Arrizabalaga è un Solutions Architect allineato al settore pubblico del Regno Unito, dove aiuta i clienti a progettare soluzioni ML con Amazon SageMaker. Fa anche parte della Technical Field Community dedicata all'accelerazione hardware e aiuta con i test e il benchmarking dei carichi di lavoro AWS Inferentia e AWS Trainium.

Lorea Arrizabalaga è un Solutions Architect allineato al settore pubblico del Regno Unito, dove aiuta i clienti a progettare soluzioni ML con Amazon SageMaker. Fa anche parte della Technical Field Community dedicata all'accelerazione hardware e aiuta con i test e il benchmarking dei carichi di lavoro AWS Inferentia e AWS Trainium.

Ben Snively è un Senior Principal Specialist Solutions Architect di AWS nel settore pubblico. Lavora con clienti governativi, no-profit e del settore educativo su progetti di big data, analitici e AI/ML, aiutandoli a creare soluzioni utilizzando AWS.

Ben Snively è un Senior Principal Specialist Solutions Architect di AWS nel settore pubblico. Lavora con clienti governativi, no-profit e del settore educativo su progetti di big data, analitici e AI/ML, aiutandoli a creare soluzioni utilizzando AWS.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/machine-learning-with-decentralized-training-data-using-federated-learning-on-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 11

- 12

- 15%

- 24

- 25

- 500

- 7

- a

- WRI

- accelerare

- Accetta

- accesso

- Il mio account

- conti

- precisione

- Raggiungere

- operanti in

- Action

- azioni

- attività

- aggiunto

- aggiuntivo

- indirizzi

- Avanzate

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- aggregato

- aggregazione

- AI / ML

- Algoritmi

- Allineati

- Tutti

- consentire

- Consentire

- consente

- lungo

- anche

- alternativa

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- Analitico

- ed

- Un altro

- in qualsiasi

- Apache

- App

- APPLICA

- approccio

- approcci

- architettura

- SONO

- AS

- associato

- assumere

- assunto

- assume

- At

- allegare

- disponibile

- media

- evitare

- AWS

- AWS Inferenza

- precedente

- Equilibrio

- BE

- perché

- prima

- Inizio

- essendo

- analisi comparativa

- fra

- Big

- Big Data

- entrambi

- confini

- portato

- costruire

- costruisce

- incassato

- affari

- ma

- by

- C++

- detto

- Materiale

- Custodie

- casi

- Categoria

- centralizzata

- sfide

- oneri

- Scegli

- la scelta

- classe

- cliente

- clienti

- Chiudi

- Cloud

- Cluster

- cms

- codice

- comunicare

- comunicare

- Comunicazione

- comunità

- completamento

- componenti

- globale

- Calcolare

- computer

- Informatica

- concettuale

- condizione

- Configurazione

- Connettiti

- collegato

- veloce

- Connessioni

- Prendere in considerazione

- considerato

- consumare

- contiene

- contenuto

- continua

- contrasto

- contributi

- Nucleo

- Corrispondente

- creare

- creato

- Credenziali

- Corrente

- costume

- Clienti

- personalizzabile

- personalizzazione

- personalizzare

- dati

- l'accesso ai dati

- Preparazione dei dati

- privacy dei dati

- condivisione dei dati

- memorizzazione dei dati

- dataset

- decentrata

- dedicato

- Predefinito

- definire

- definito

- definisce

- definizione

- definizione

- Laurea

- dimostrazione

- dimostrare

- Dipendente

- schierare

- derivato

- descritta

- Design

- dettagliati

- dettagli

- rivelazione

- sviluppatori

- dispositivo

- dispositivi

- diverso

- dirette

- discutere

- distribuire

- distribuito

- formazione distribuita

- do

- docker

- non

- fatto

- Dont

- guida

- dovuto

- durante

- ogni

- In precedenza

- facilmente

- bordo

- Istruzione

- effetto

- efficiente

- in modo efficiente

- o

- emergenti del mondo

- Abilita

- fine

- Intero

- Ambiente

- valutare

- valutazione

- esempio

- scambiati

- esistente

- esperienza

- esperimenti

- esplorazione

- estensivo

- Conclamata Esperienza

- strutture

- Caratteristiche

- Federazione

- pochi

- campo

- figura

- Compila il

- File

- finale

- Infine

- trova

- Nome

- in forma

- i seguenti

- segue

- Nel

- forme

- Fondazione

- Contesto

- quadri

- frode

- rilevazione di frodi

- amichevole

- da

- completamente

- function

- funzioni

- ulteriormente

- generare

- ottenere

- globali

- Go

- Enti Pubblici

- cura

- accade

- Hardware

- Avere

- he

- aiutare

- aiuta

- Highlight

- Evidenziato

- ospitato

- di hosting

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Identità

- if

- illustra

- immagini

- realizzare

- implementazione

- implementato

- migliorata

- in

- inattivo

- includere

- inclusi

- incorporare

- individuale

- industrie

- informazioni

- inizialmente

- intuizioni

- installato

- esempio

- istruzioni

- Intelligence

- Interfaccia

- Internet

- accesso ad Internet

- ai miglioramenti

- IT

- SUO

- stessa

- Java

- Lavoro

- Offerte di lavoro

- viaggio

- jpg

- json

- l2

- Le Lingue

- grandi

- larga scala

- Cognome

- lanciare

- apprendimento

- Licenza

- ciclo di vita

- leggero

- Lista

- vivere

- caricare

- Caricamento in corso

- carichi

- locale

- spento

- lotto

- macchina

- machine learning

- principalmente

- Maggioranza

- gestito

- molti

- si intende

- Nel frattempo

- Medicare

- Memorie

- menzionato

- messaggi

- metodo

- metodi

- Metrica

- ordine

- ML

- modello

- modelli

- modificare

- Scopri di più

- multiplo

- devono obbligatoriamente:

- Detto

- nativo

- necessariamente

- Bisogno

- di applicazione

- esigenze

- Rete

- internazionale

- mai

- New

- recentemente

- GENERAZIONE

- nodo

- nodi

- senza scopo di lucro

- taccuino

- notando

- numero

- of

- offerto

- offerta

- on

- ONE

- esclusivamente

- open source

- operazione

- or

- minimo

- organizzazioni

- Altro

- nostro

- su

- produzione

- ancora

- proprio

- proprietario

- possiede

- pacchetto

- Carta

- documenti

- Parallel

- parametro

- parametri

- parte

- Ricambi

- passare

- Passato

- modelli

- pera

- Eseguire

- autorizzazione

- permessi

- phd

- posto

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- politica

- Popolare

- possibile

- Post

- preparazione

- Preparare

- Direttore

- principi

- Privacy

- un bagno

- processi

- Elaborato

- Prodotto

- progetti

- protocolli

- fornire

- purché

- fornisce

- la percezione

- fini

- metti

- Python

- Presto

- rapidamente

- Crudo

- Leggi

- di rose

- ricevere

- ricevuto

- riceve

- record

- regione

- regioni

- normativa

- relazionato

- Relazioni

- rilasciato

- rappresentazione

- richiesta

- necessario

- Requisiti

- riparazioni

- risorsa

- Risorse

- quelli

- risposta

- REST

- limitato

- colpevole

- Risultati

- ritorno

- problemi

- rivoluzionando

- robusto

- Ruolo

- ruoli

- radice

- tondo

- round

- strada

- Correre

- running

- corre

- sagemaker

- stesso

- risparmio

- Scalabilità

- scenario

- Scenari

- Scienze

- scienziati

- scikit-impara

- sdk

- settore

- problemi di

- token di sicurezza

- vedere

- selezionato

- AUTO

- inviare

- invia

- anziano

- inviato

- separato

- servizio

- Servizi

- Sessione

- sessioni

- set

- Set

- regolazione

- impostazioni

- flessibile.

- compartecipazione

- lei

- Corti

- dovrebbero

- ha mostrato

- segno

- simile

- Un'espansione

- semplicemente

- singolo

- Taglia

- inferiore

- frammento

- So

- soluzione

- Soluzioni

- risolve

- alcuni

- specialista

- in particolare

- dividere

- pila

- si

- inizia a

- Di partenza

- inizio

- dichiarazione

- soggiorno

- step

- Passi

- conservazione

- strategie

- Strategia

- flussi

- sottorete

- sottoreti

- tale

- supporto

- sistema

- tavolo

- Fai

- prende

- Consulenza

- tecniche

- tensorflow

- test

- Testing

- che

- Il

- Regno Unito

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- Attraverso

- a

- insieme

- token

- pure

- top

- traffico

- Treni

- allenato

- Training

- innescare

- innescato

- Affidati ad

- seconda

- Tipi di

- Uk

- per

- fino a quando

- Aggiornanento

- caricato

- su

- uso

- caso d'uso

- utilizzato

- Utente

- usa

- utilizzando

- generalmente

- utilità

- CONVALIDARE

- convalida

- Valori

- varietà

- vario

- versione

- via

- virtuale

- vs

- camminava

- Modo..

- modi

- we

- sito web

- servizi web

- peso

- WELL

- quando

- se

- quale

- while

- OMS

- tutto

- volere

- con

- entro

- lavori

- valore

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- zero

- Codice postale