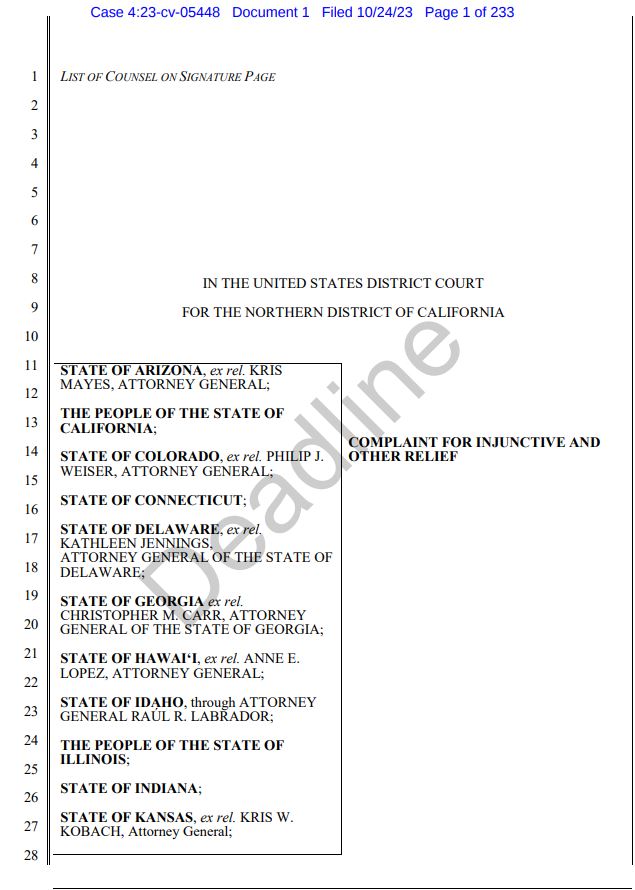

Un gruppo di 34 stati degli Stati Uniti sta intentando una causa contro Meta, proprietario di Facebook e Instagram, accusando la società di essere coinvolta in una manipolazione impropria dei minori che utilizzano le piattaforme. Questo sviluppo avviene in modo rapido intelligenza artificiale (AI) progressi che coinvolgono sia il testo che l’intelligenza artificiale generativa.

Rappresentanti legali di vari stati, tra cui California, New York, Ohio, South Dakota, Virginia e Louisiana, asserire che Meta utilizza i suoi algoritmi per favorire comportamenti di dipendenza e avere un impatto negativo sul benessere mentale dei bambini attraverso le sue funzionalità in-app, come il pulsante "Mi piace".

I litiganti del governo lo sono procedere con azioni legali nonostante il capo AI scienziato di Meta ha recentemente parlato, affermando che le preoccupazioni sui rischi esistenziali della tecnologia sono ancora “premature”, e Meta lo ha già fatto hanno sfruttato l’intelligenza artificiale per affrontare i problemi di fiducia e sicurezza sulle sue piattaforme.

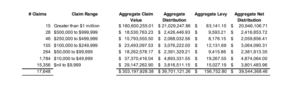

Gli avvocati degli stati chiedono diversi danni, risarcimenti e risarcimenti per ciascuno stato menzionato nel documento, con cifre che vanno dai 5,000 ai 25,000 dollari per presunto evento. Cointelegraph ha contattato Meta per ulteriori informazioni, ma non ha ancora ricevuto risposta.

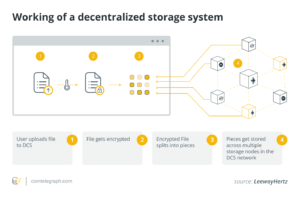

Nel frattempo, la Internet Watch Foundation (IWF) con sede nel Regno Unito ha espresso preoccupazione per l’allarmante proliferazione di materiale pedopornografico generato dall’intelligenza artificiale (CSAM). In un recente rapporto, l'IWF ha rivelato la scoperta di oltre 20,254 immagini CSAM generate dall'intelligenza artificiale in un unico forum del dark web in appena un mese, avvertendo che questa ondata di contenuti inquietanti ha il potenziale di inondare Internet.

L’organizzazione ha sollecitato la cooperazione globale per combattere il problema dei materiali pedopornografici, suggerendo una strategia articolata, che includa adeguamenti alle leggi esistenti, miglioramenti nella formazione delle forze dell’ordine e l’implementazione della supervisione normativa per i modelli di intelligenza artificiale.

Per quanto riguarda gli sviluppatori di intelligenza artificiale, l’IWF consiglia di vietare all’IA di generare contenuti pedopornografici, escludendo i modelli associati e concentrandosi sulla rimozione di tale materiale dai loro modelli.

Il progresso dei generatori di immagini AI ha migliorato significativamente la creazione di repliche umane realistiche. Piattaforme come Midjourney, Runway, Stable Diffusion e Dall-E di OpenAI sono esempi popolari di strumenti in grado di generare immagini realistiche.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://cointelegraph.com/news/meta-faces-legal-scrutiny-ai-advancements-raise-concerns-child-safety

- :ha

- :È

- 000

- 10

- 20

- a

- WRI

- abuso

- Action

- indirizzo

- regolazioni

- avanzamento

- avanzamenti

- contro

- AI

- Modelli AI

- Algoritmi

- presunta

- già

- Tra

- ed

- SONO

- AS

- associato

- At

- comportamento

- CAPO

- entrambi

- ma

- pulsante

- California

- capace

- capo

- bambino

- Bambini

- Cina

- Cointelegraph

- combattere

- viene

- azienda

- compensazione

- preoccupazioni

- contenuto

- cooperazione

- creazione

- Dakota

- dall's

- Scuro

- Web Scuro

- dc

- Nonostante

- sviluppato

- sviluppatori

- Mercato

- diverso

- Emittente

- scoperta

- documento

- ogni

- Istruzione

- applicazione

- impegnandosi

- motore

- miglioramenti

- Esempi

- esclusa

- esistenziale

- esistente

- facce

- Caratteristiche

- Cifre

- Limatura

- messa a fuoco

- Nel

- Forum

- Favorire

- Fondazione

- da

- la generazione di

- generativo

- AI generativa

- Generatori

- globali

- Enti Pubblici

- Gruppo

- HTTPS

- umano

- Immagine

- immagini

- Impact

- Implementazione

- migliorata

- in

- Compreso

- informazioni

- Intelligence

- Internet

- coinvolgendo

- problema

- SUO

- jpg

- ad appena

- Legge

- applicazione della legge

- Legislazione

- querela

- Legale

- Azione legale

- Louisiana

- Manipolazione

- materiale

- mentale

- menzionato

- Meta

- Mezzo viaggio

- modelli

- Mese

- Scopri di più

- poliedrico

- negativamente

- New

- New York

- evento

- of

- Ohio

- on

- organizzazione

- su

- ancora

- proprietario

- per

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- Popolare

- potenziale

- aumentare

- sollevato

- che vanno

- veloce

- a raggiunto

- realistico

- ricevere

- recente

- recentemente

- normativo

- rimozione

- Rappresentanti

- risposta

- Rivelato

- rischi

- pista

- Sicurezza

- detto

- scrutinio

- cerca

- Sessuale

- significativamente

- singolo

- Fonte

- Sud

- parlando

- stabile

- Regione / Stato

- stati

- Ancora

- Strategia

- tale

- supervisione

- ondata

- Tecnologia

- testo

- di

- che

- Il

- loro

- questo

- Attraverso

- a

- strumenti

- Affidati ad

- Unito

- Stati Uniti

- uso

- utilizza

- vario

- Virginia

- identificazione dei warning

- Orologio

- sito web

- OMS

- con

- ancora

- York

- zefiro