La preparazione dei dati è un passaggio fondamentale in qualsiasi progetto basato sui dati e disporre degli strumenti giusti può migliorare notevolmente l'efficienza operativa. Gestore di dati di Amazon SageMaker riduce da settimane a minuti il tempo necessario per aggregare e preparare dati tabulari e immagine per il machine learning (ML). Con SageMaker Data Wrangler, puoi semplificare il processo di preparazione dei dati e progettazione delle funzionalità e completare ogni fase del flusso di lavoro di preparazione dei dati, inclusa la selezione, la pulizia, l'esplorazione e la visualizzazione dei dati da un'unica interfaccia visiva.

In questo post, esploriamo le ultime funzionalità di SageMaker Data Wrangler che sono specificamente progettate per migliorare l'esperienza operativa. Approfondiamo il supporto di Servizio di archiviazione semplice (Amazon S3) manifesto file, artefatti di inferenza in un flusso di dati interattivo e la perfetta integrazione con JSON (notazione oggetto JavaScript) formato per l'inferenza, evidenziando come questi miglioramenti rendano la preparazione dei dati più semplice ed efficiente.

Presentazione di nuove funzionalità

In questa sezione, discutiamo delle nuove funzionalità di SageMaker Data Wrangler per una preparazione ottimale dei dati.

Supporto file manifest S3 con SageMaker Autopilot per inferenza ML

SageMaker Data Wrangler abilita a preparazione unificata dei dati e training del modello esperienza con Pilota automatico Amazon SageMaker in pochi clic. Puoi utilizzare SageMaker Autopilot per addestrare, ottimizzare e distribuire automaticamente i modelli sui dati che hai trasformato nel tuo flusso di dati.

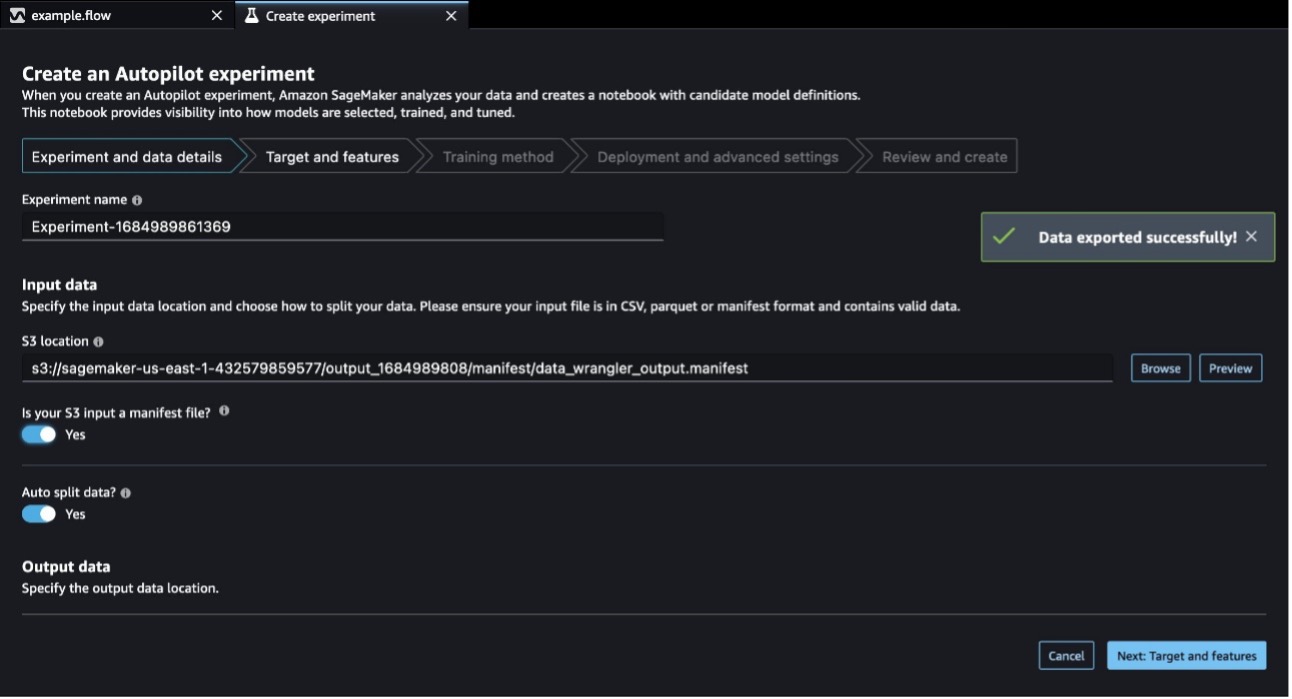

Questa esperienza è ora ulteriormente semplificata con il supporto del file manifest S3. Un file manifest S3 è un file di testo che elenca gli oggetti (file) archiviati in un bucket S3. Se il set di dati esportato in SageMaker Data Wrangler è piuttosto grande e suddiviso in file di dati in più parti in Amazon S3, ora SageMaker Data Wrangler creerà automaticamente un file manifest in S3 che rappresenta tutti questi file di dati. Questo file manifest generato può ora essere utilizzato con l'interfaccia utente di SageMaker Autopilot in SageMaker Data Wrangler per raccogliere tutti i dati partizionati per l'addestramento.

Prima del lancio di questa funzione, quando si utilizzavano i modelli SageMaker Autopilot addestrati sui dati preparati da SageMaker Data Wrangler, era possibile scegliere solo un file di dati, che potrebbe non rappresentare l'intero set di dati, soprattutto se il set di dati è molto grande. Con questa nuova esperienza di file manifest, non sei limitato a un sottoinsieme del tuo set di dati. Puoi creare un modello ML con SageMaker Autopilot che rappresenta tutti i tuoi dati utilizzando il file manifest e utilizzarlo per l'inferenza ML e la distribuzione di produzione. Questa funzionalità migliora l'efficienza operativa semplificando l'addestramento dei modelli ML con SageMaker Autopilot e semplificando i flussi di lavoro di elaborazione dei dati.

Aggiunto il supporto per il flusso di inferenza negli artefatti generati

I clienti desiderano prendere le trasformazioni dei dati che hanno applicato ai dati di addestramento del modello, come la codifica one-hot, PCA e imputare i valori mancanti, e applicare tali trasformazioni dei dati all'inferenza in tempo reale o all'inferenza batch nella produzione. Per fare ciò, devi disporre di un artefatto di inferenza SageMaker Data Wrangler, che viene utilizzato da un modello SageMaker.

In precedenza, gli artefatti di inferenza potevano essere generati solo dall'interfaccia utente durante l'esportazione nell'addestramento di SageMaker Autopilot o l'esportazione di un notebook della pipeline di inferenza. Ciò non forniva flessibilità se volevi portare i tuoi flussi SageMaker Data Wrangler al di fuori del Amazon Sage Maker Studio ambiente. Ora puoi generare un artefatto di inferenza per qualsiasi file di flusso compatibile tramite un processo di elaborazione SageMaker Data Wrangler. Ciò consente MLOps end-to-end programmatici con flussi SageMaker Data Wrangler per utenti MLOps code-first, nonché un percorso intuitivo senza codice per ottenere un artefatto di inferenza creando un lavoro dall'interfaccia utente.

Semplificazione della preparazione dei dati

JSON è diventato un formato ampiamente adottato per lo scambio di dati nei moderni ecosistemi di dati. L'integrazione di SageMaker Data Wrangler con il formato JSON consente di gestire senza problemi i dati JSON per la trasformazione e la pulizia. Fornendo il supporto nativo per JSON, SageMaker Data Wrangler semplifica il processo di lavoro con dati strutturati e semi-strutturati, consentendoti di estrarre preziose informazioni e preparare i dati in modo efficiente. SageMaker Data Wrangler ora supporta il formato JSON per la distribuzione di endpoint di inferenza sia in batch che in tempo reale.

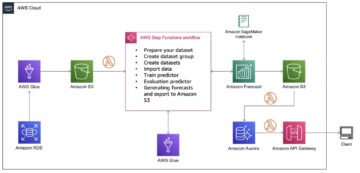

Panoramica della soluzione

Per il nostro caso d'uso, utilizziamo il campione Set di dati delle recensioni dei clienti Amazon per mostrare come SageMaker Data Wrangler può semplificare lo sforzo operativo per creare un nuovo modello ML utilizzando SageMaker Autopilot. Il set di dati delle recensioni dei clienti di Amazon contiene recensioni di prodotti e metadati di Amazon, tra cui 142.8 milioni di recensioni dal maggio 1996 al luglio 2014.

Ad alto livello, utilizziamo SageMaker Data Wrangler per gestire questo set di dati di grandi dimensioni ed eseguire le seguenti azioni:

- Sviluppa un modello ML in SageMaker Autopilot utilizzando tutto il set di dati, non solo un campione.

- Crea una pipeline di inferenza in tempo reale con l'artefatto di inferenza generato da SageMaker Data Wrangler e utilizza la formattazione JSON per l'input e l'output.

Supporto file manifest S3 con SageMaker Autopilot

Durante la creazione di un esperimento SageMaker Autopilot utilizzando SageMaker Data Wrangler, in precedenza era possibile specificare solo un singolo file CSV o Parquet. Ora puoi anche utilizzare un file manifest S3, che ti consente di utilizzare grandi quantità di dati per gli esperimenti di SageMaker Autopilot. SageMaker Data Wrangler suddividerà automaticamente i file di dati di input in diversi file più piccoli e genererà un manifest che può essere utilizzato in un esperimento SageMaker Autopilot per estrarre tutti i dati dalla sessione interattiva, non solo un piccolo campione.

Completa i seguenti passi:

- Importa i dati delle recensioni dei clienti Amazon da un file CSV in SageMaker Data Wrangler. Assicurati di disabilitare il campionamento durante l'importazione dei dati.

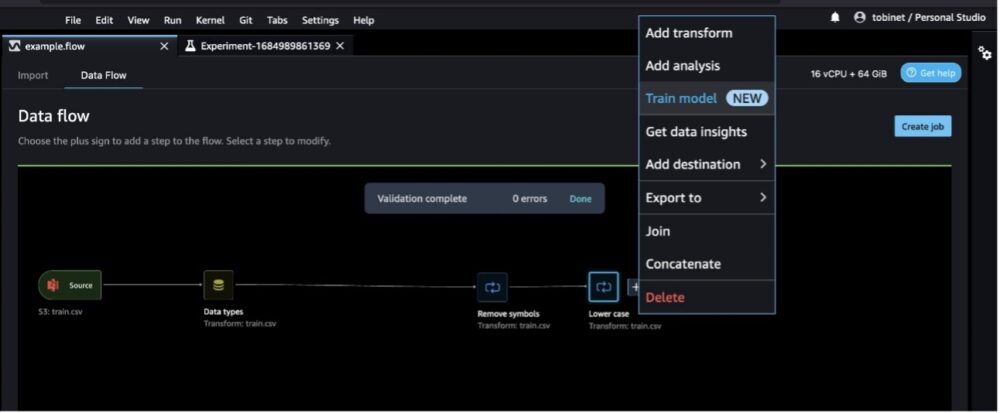

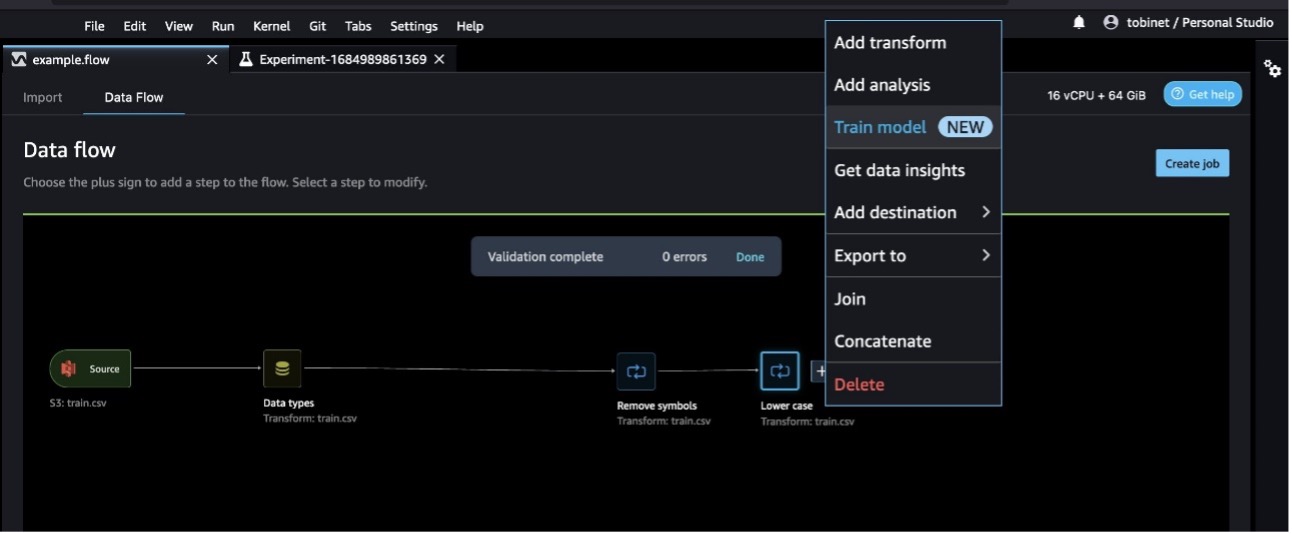

- Specificare le trasformazioni che normalizzano i dati. Per questo esempio, rimuovi i simboli e trasforma tutto in minuscolo utilizzando le trasformazioni integrate di SageMaker Data Wrangler.

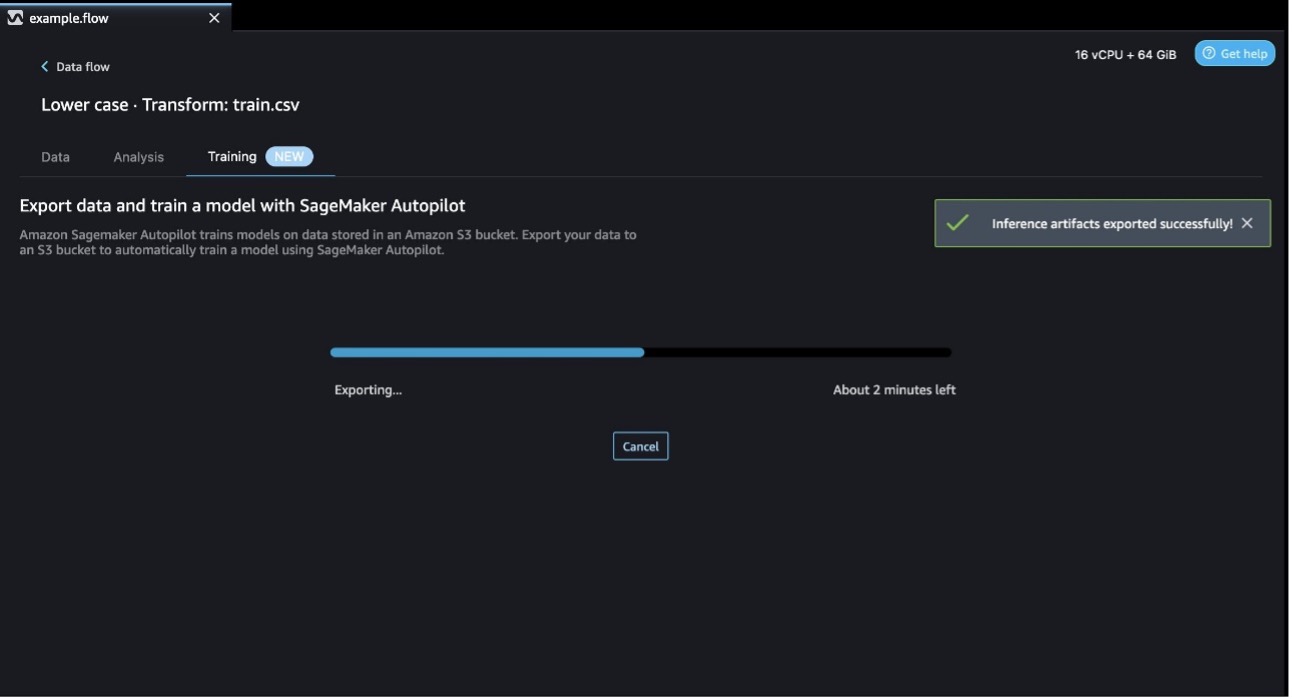

- Scegli Modello di treno per iniziare la formazione.

Per addestrare un modello con SageMaker Autopilot, SageMaker esporta automaticamente i dati in un bucket S3. Per set di dati di grandi dimensioni come questo, suddividerà automaticamente il file in file più piccoli e genererà un manifest che include la posizione dei file più piccoli.

- Innanzitutto, seleziona i dati di input.

In precedenza, SageMaker Data Wrangler non disponeva di un'opzione per generare un file manifest da utilizzare con SageMaker Autopilot. Oggi, con il rilascio del supporto per i file manifest, SageMaker Data Wrangler esporterà automaticamente un file manifest in Amazon S3, precompilerà la posizione S3 della formazione SageMaker Autopilot con la posizione S3 del file manifest e attiverà l'opzione del file manifest su Sì. Non è necessario alcun lavoro per generare o utilizzare il file manifest.

- Configura il tuo esperimento selezionando l'obiettivo da prevedere per il modello.

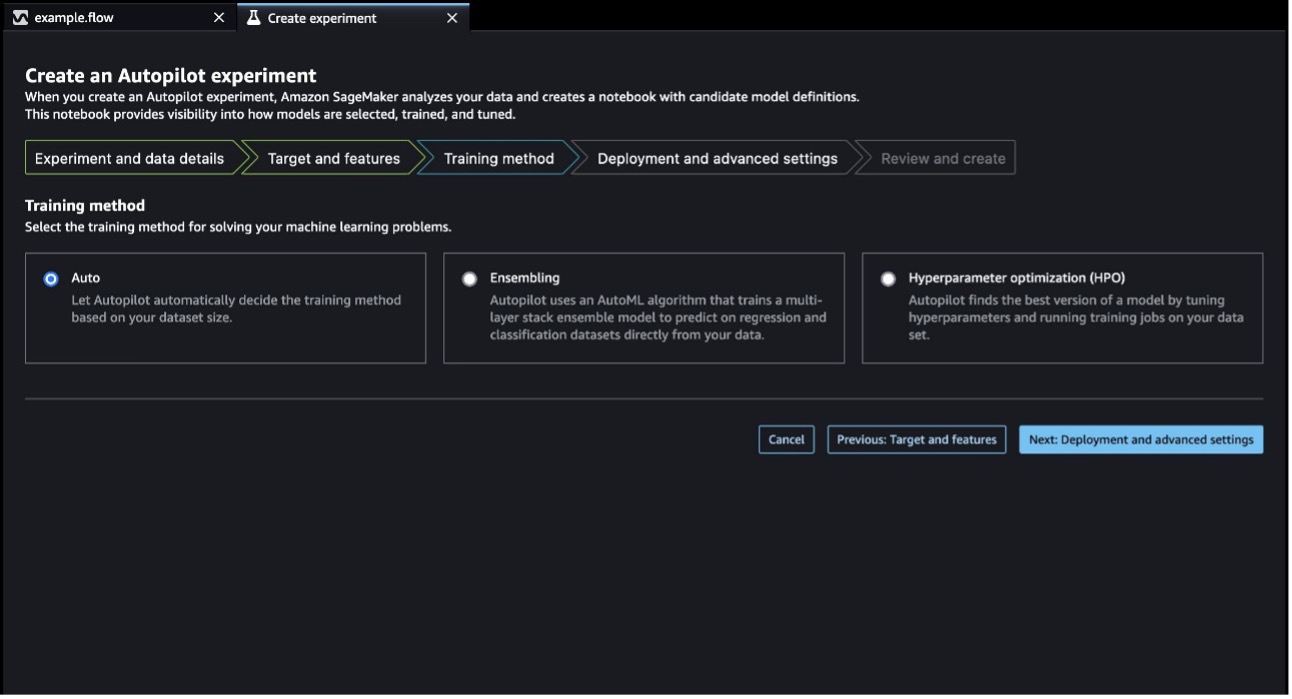

- Successivamente, seleziona un metodo di allenamento. In questo caso, selezioniamo Automatico e lascia che SageMaker Autopilot decida il metodo di addestramento migliore in base alle dimensioni del set di dati.

- Specificare le impostazioni di distribuzione.

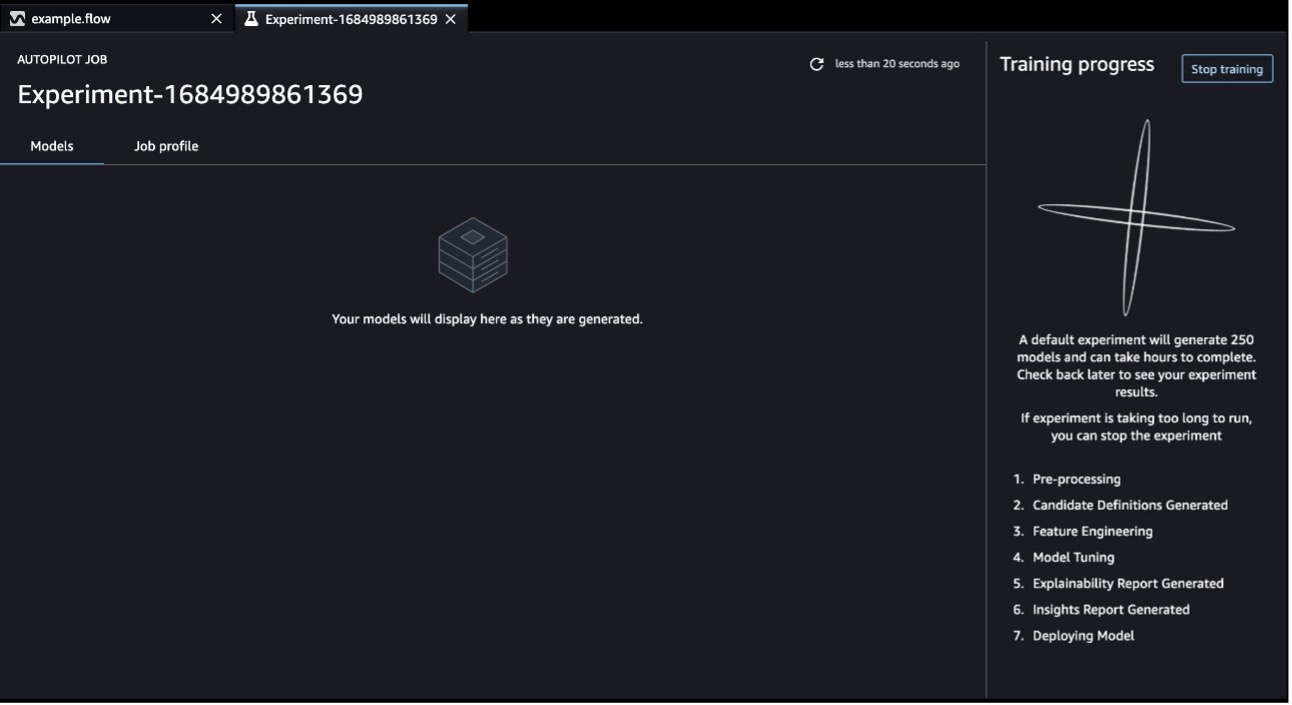

- Infine, rivedi la configurazione del lavoro e invia l'esperimento SageMaker Autopilot per l'addestramento. Quando SageMaker Autopilot completa l'esperimento, puoi visualizzare i risultati dell'addestramento ed esplorare il modello migliore.

Grazie al supporto per i file manifest, puoi utilizzare l'intero set di dati per l'esperimento SageMaker Autopilot, non solo un sottoinsieme dei tuoi dati.

Per ulteriori informazioni sull'utilizzo di SageMaker Autopilot con SageMaker Data Wrangler, vedere Preparazione dei dati unificata e addestramento dei modelli con Amazon SageMaker Data Wrangler e Amazon SageMaker Autopilot.

Genera artefatti di inferenza dai lavori di SageMaker Processing

Ora, diamo un'occhiata a come possiamo generare artefatti di inferenza tramite l'interfaccia utente di SageMaker Data Wrangler e i notebook SageMaker Data Wrangler.

Interfaccia utente di SageMaker Data Wrangler

Per il nostro caso d'uso, vogliamo elaborare i nostri dati tramite l'interfaccia utente e quindi utilizzare i dati risultanti per addestrare e distribuire un modello tramite la console SageMaker. Completa i seguenti passaggi:

- Apri il flusso di dati creato nella sezione precedente.

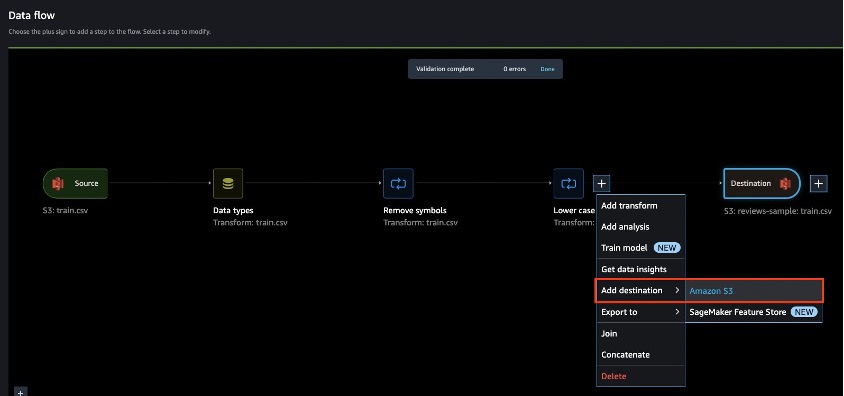

- Scegli il segno più accanto all'ultima trasformazione, scegli Aggiungi destinazionee scegli Amazon S3. Questo sarà il luogo in cui verranno archiviati i dati elaborati.

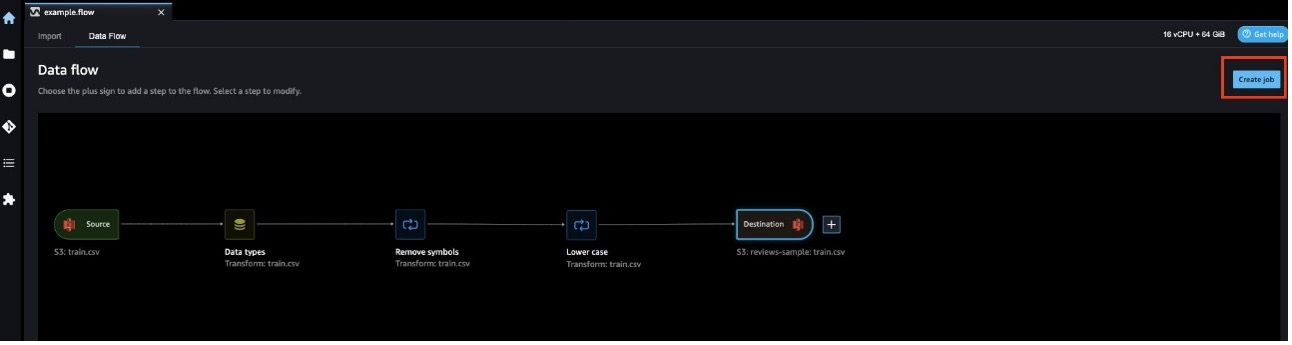

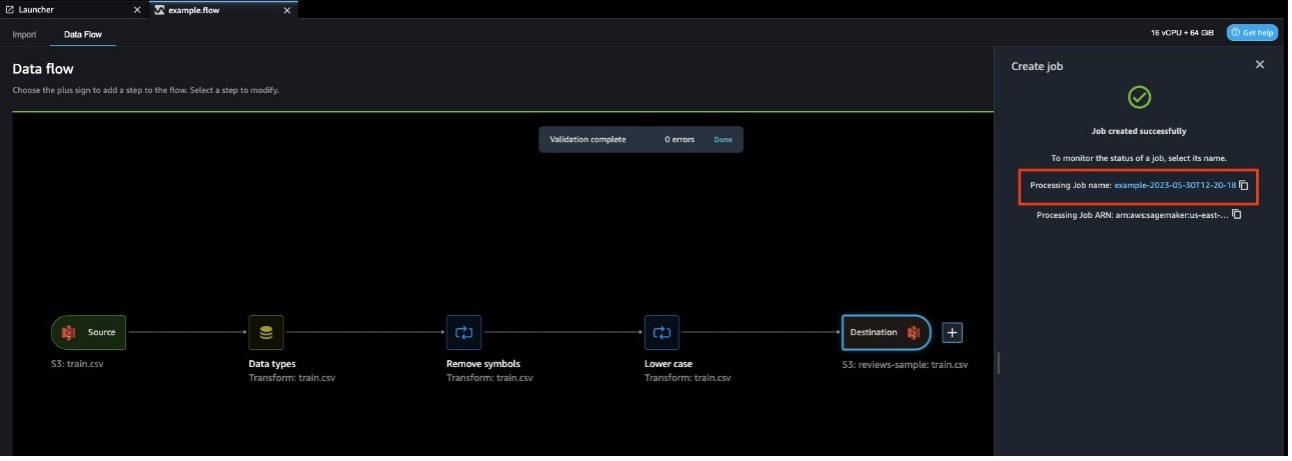

- Scegli Crea lavoro.

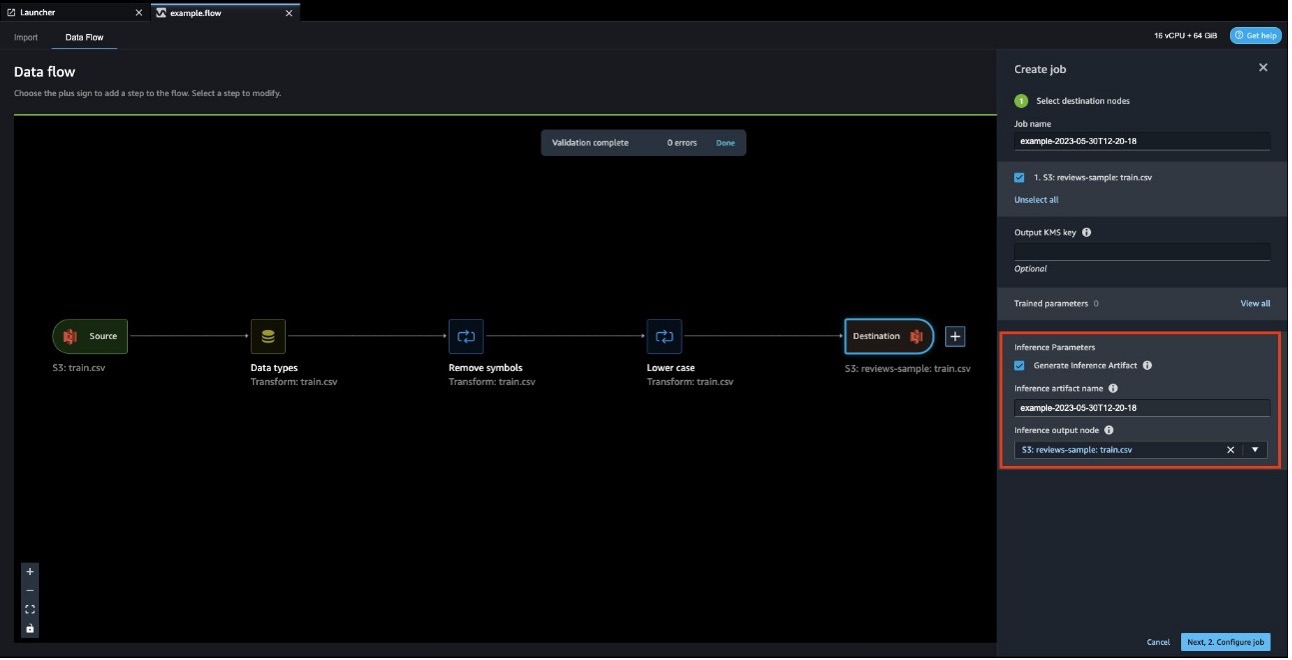

- Seleziona Genera artefatti di inferenza nella sezione Parametri di inferenza per generare un artefatto di inferenza.

- Per Nome artefatto di inferenza, inserisci il nome dell'artefatto di inferenza (con .tar.gz come estensione del file).

- Per Nodo di output di inferenza, immetti il nodo di destinazione corrispondente alle trasformazioni applicate ai dati di addestramento.

- Scegli Configura lavoro.

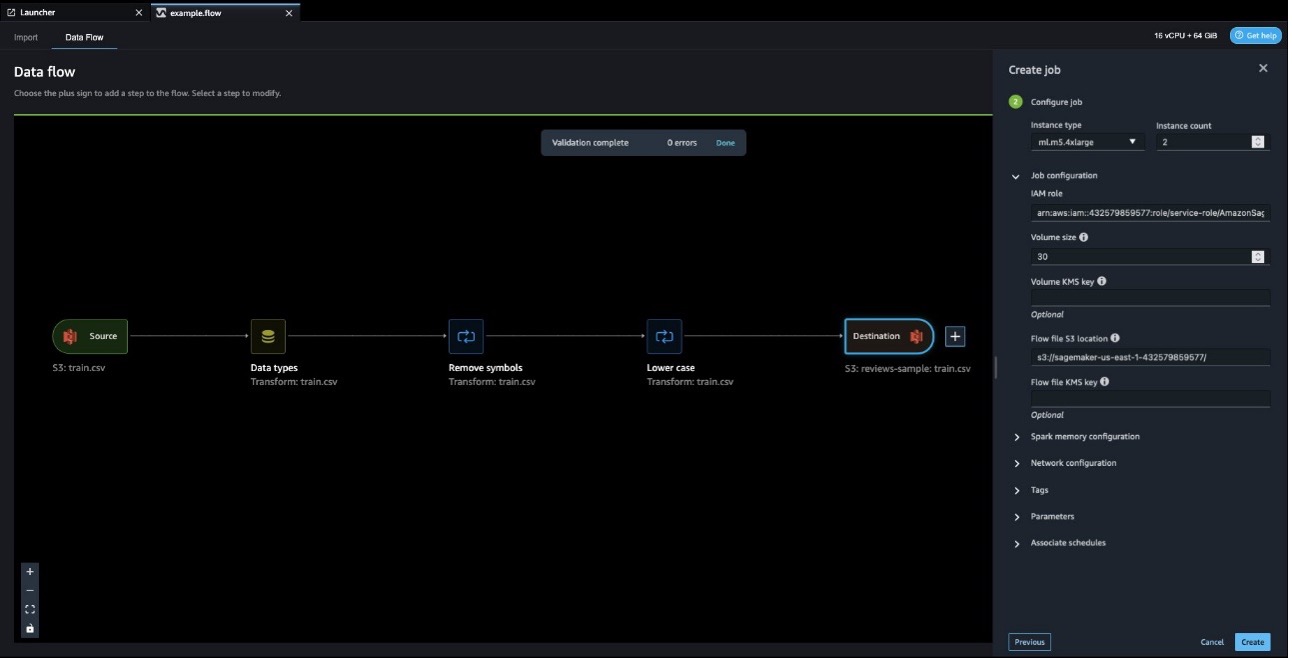

- Sotto Configurazione del lavoro, inserisci un percorso per Posizione del file di flusso S3. Una cartella chiamata

data_wrangler_flowsverrà creato in questa posizione e l'artefatto di inferenza verrà caricato in questa cartella. Per modificare la posizione di caricamento, imposta una posizione S3 diversa. - Lascia i valori predefiniti per tutte le altre opzioni e scegli Creare per creare il lavoro di elaborazione.

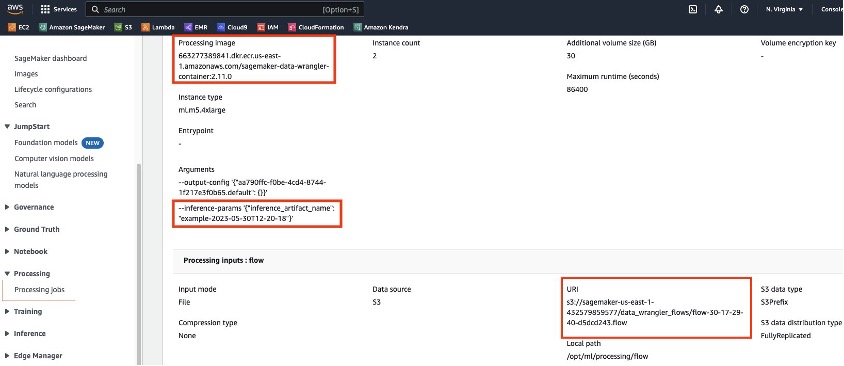

Il processo di elaborazione creerà un filetarball (.tar.gz)contenente un file del flusso di dati modificato con una sezione di inferenza appena aggiunta che consente di utilizzarlo per l'inferenza. È necessario l'URI (Uniform Resource Identifier) S3 dell'artefatto di inferenza per fornire l'artefatto a un modello SageMaker durante la distribuzione della soluzione di inferenza. L'URI sarà nel formato{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Se non hai preso nota di questi valori in precedenza, puoi scegliere il collegamento al processo di elaborazione per trovare i dettagli pertinenti. Nel nostro esempio, l'URI è

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Copia il valore di Elaborazione dell'immagine; abbiamo bisogno di questo URI anche durante la creazione del nostro modello.

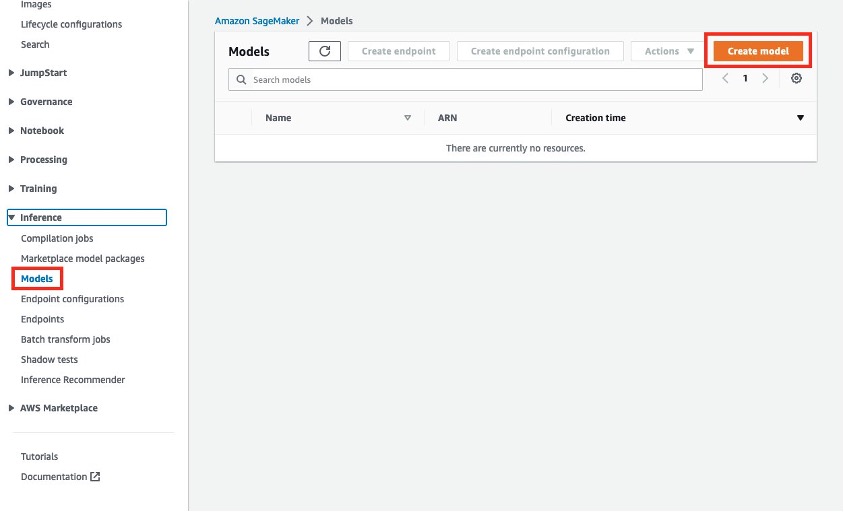

- Ora possiamo utilizzare questo URI per creare un modello SageMaker sulla console SageMaker, che possiamo successivamente distribuire a un endpoint o a un processo di trasformazione batch.

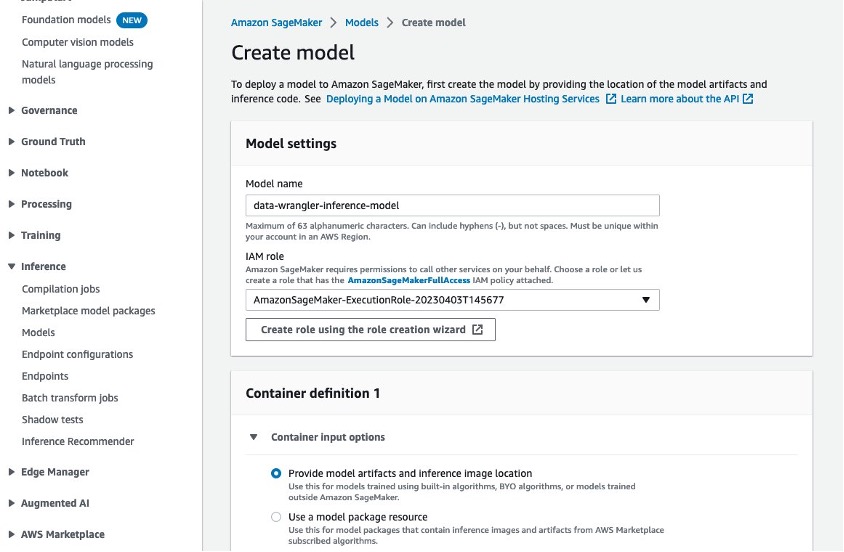

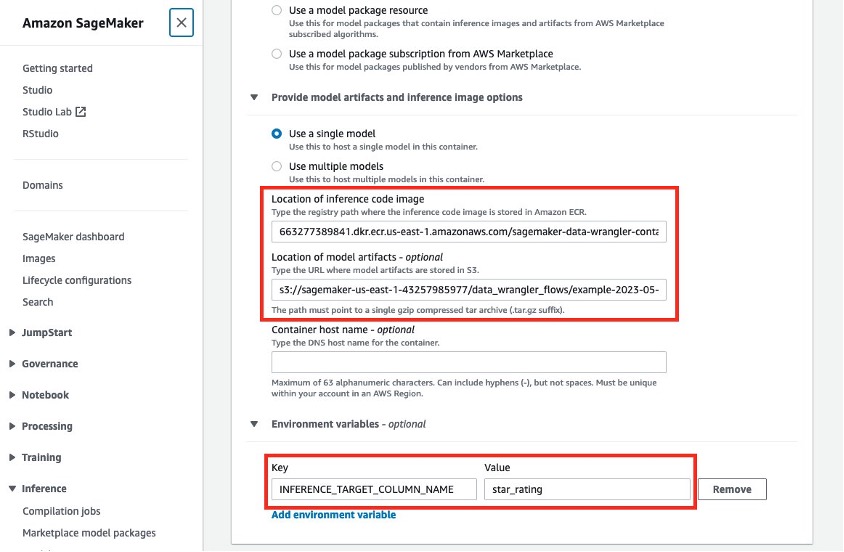

- Sotto Impostazioni del modello¸ inserire un nome modello e specificare il proprio ruolo IAM.

- Nel Opzioni di input del contenitore, selezionare Fornire artefatti del modello e posizione dell'immagine di inferenza.

- Nel Posizione dell'immagine del codice di inferenza, inserisci l'URI dell'immagine di elaborazione.

- Nel Posizione degli artefatti del modello, immetti l'URI dell'artefatto di inferenza.

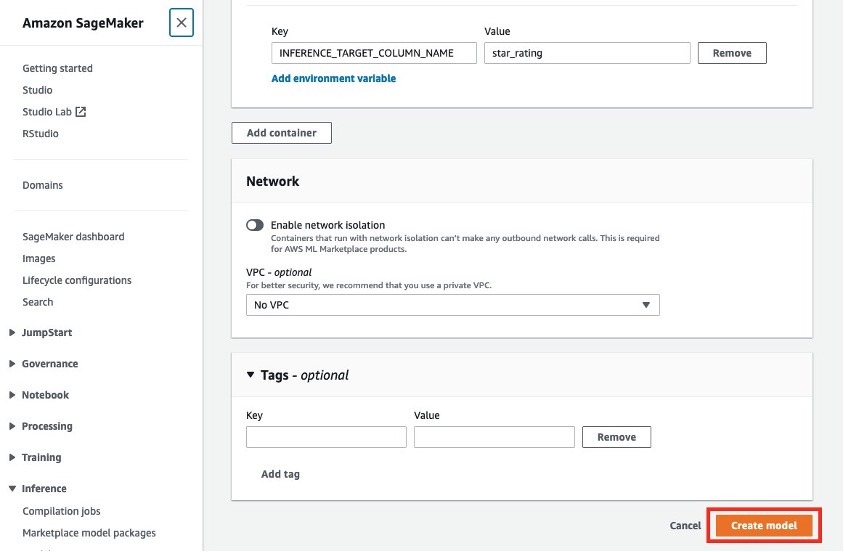

- Inoltre, se i tuoi dati hanno una colonna di destinazione che verrà prevista da un modello ML addestrato, specifica il nome di tale colonna in Variabili ambientali, con

INFERENCE_TARGET_COLUMN_NAMEas Le e il nome della colonna come Valore.

- Finisci di creare il tuo modello scegliendo Crea modello.

Ora disponiamo di un modello che possiamo distribuire a un endpoint o a un processo di trasformazione batch.

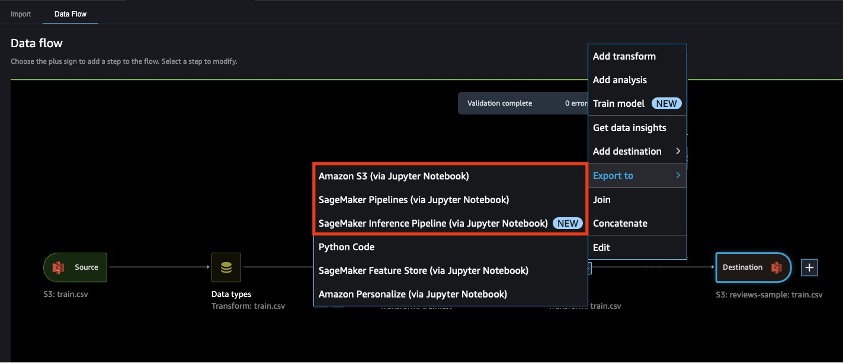

Notebook SageMaker Data Wrangler

Per un approccio code-first per generare l'artefatto di inferenza da un processo di elaborazione, possiamo trovare il codice di esempio scegliendo Esporta a nel menu del nodo e scegliendo uno dei due Amazon S3, Pipeline SageMaker, o Pipeline di inferenza SageMaker. Noi scegliamo Pipeline di inferenza SageMaker in questo esempio.

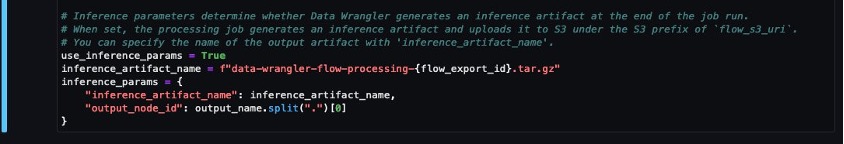

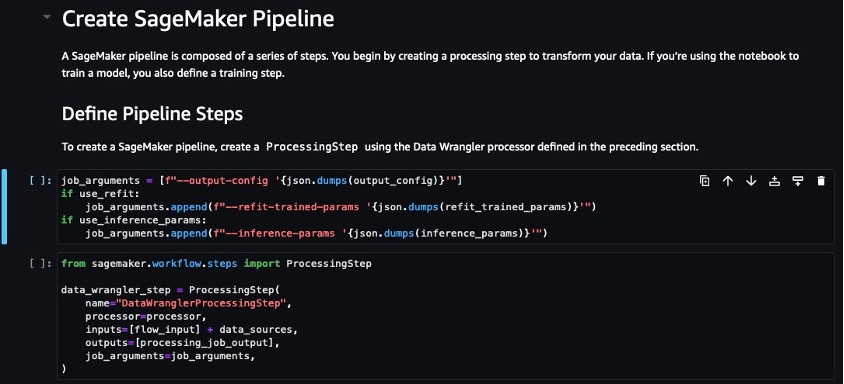

In questo quaderno c'è una sezione intitolata Crea Processore (questo è identico nel notebook SageMaker Pipelines, ma nel notebook Amazon S3, il codice equivalente sarà sotto il Configurazioni di lavoro sezione). In fondo a questa sezione c'è una configurazione per il nostro artefatto di inferenza chiamato inference_params. Contiene le stesse informazioni che abbiamo visto nell'interfaccia utente, vale a dire il nome dell'artefatto di inferenza e il nodo di output dell'inferenza. Questi valori verranno precompilati ma possono essere modificati. C'è inoltre un parametro chiamato use_inference_params, che deve essere impostato su True per utilizzare questa configurazione nel processo di elaborazione.

Più in basso c'è una sezione intitolata Definire i passaggi della pipeline, Dove l' inference_params La configurazione viene aggiunta a un elenco di argomenti del lavoro e passata alla definizione per una fase di elaborazione di SageMaker Data Wrangler. Nel taccuino Amazon S3, job_arguments è definito immediatamente dopo il Configurazioni di lavoro .

Con queste semplici configurazioni, il processo di elaborazione creato da questo notebook genererà un artefatto di inferenza nella stessa posizione S3 del nostro file di flusso (definito in precedenza nel nostro notebook). Possiamo determinare a livello di codice questa posizione S3 e utilizzare questo artefatto per creare un modello SageMaker utilizzando il file SDK Python di SageMaker, illustrato nel notebook SageMaker Inference Pipeline.

Lo stesso approccio può essere applicato a qualsiasi codice Python che crea un processo di elaborazione SageMaker Data Wrangler.

Supporto del formato di file JSON per l'input e l'output durante l'inferenza

È abbastanza comune per i siti Web e le applicazioni utilizzare JSON come richiesta/risposta per le API in modo che le informazioni siano facilmente analizzabili da diversi linguaggi di programmazione.

In precedenza, dopo aver ottenuto un modello addestrato, era possibile interagire con esso solo tramite CSV come formato di input in una pipeline di inferenza di SageMaker Data Wrangler. Oggi puoi utilizzare JSON come formato di input e output, fornendo maggiore flessibilità durante l'interazione con i contenitori di inferenza di SageMaker Data Wrangler.

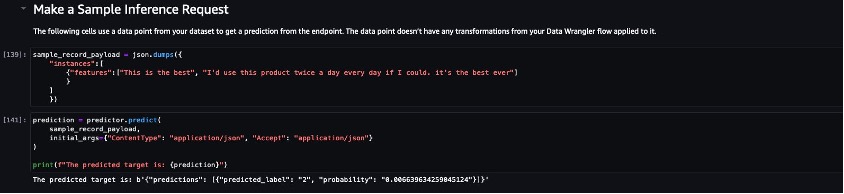

Per iniziare a utilizzare JSON per l'input e l'output nel notebook della pipeline di inferenza, completare i seguenti passaggi:

- Definire un carico utile.

Per ogni payload, il modello prevede una chiave denominata istanze. Il valore è un elenco di oggetti, ognuno dei quali è il proprio punto dati. Gli oggetti richiedono una chiave chiamata funzionalità e i valori devono essere le funzionalità di un singolo punto dati che devono essere inviate al modello. È possibile inviare più punti dati in un'unica richiesta, fino a una dimensione totale di 6 MB per richiesta.

Vedi il seguente codice:

- specificare la

ContentTypeasapplication/json. - Fornisci i dati al modello e ricevi l'inferenza in formato JSON.

See Formati di dati comuni per l'inferenza per esempi JSON di input e output.

ripulire

Quando hai finito di utilizzare SageMaker Data Wrangler, ti consigliamo di chiudere l'istanza su cui è in esecuzione per evitare di incorrere in costi aggiuntivi. Per istruzioni su come chiudere l'app SageMaker Data Wrangler e l'istanza associata, vedere Chiudi Data Wrangler.

Conclusione

Le nuove funzionalità di SageMaker Data Wrangler, incluso il supporto per i file manifest S3, le capacità di inferenza e l'integrazione del formato JSON, trasformano l'esperienza operativa della preparazione dei dati. Questi miglioramenti semplificano l'importazione dei dati, automatizzano le trasformazioni dei dati e semplificano l'utilizzo dei dati JSON. Con queste funzionalità, puoi migliorare la tua efficienza operativa, ridurre il lavoro manuale ed estrarre facilmente informazioni preziose dai tuoi dati. Abbraccia la potenza delle nuove funzionalità di SageMaker Data Wrangler e sblocca tutto il potenziale dei tuoi flussi di lavoro di preparazione dei dati.

Per iniziare con SageMaker Data Wrangler, consulta le informazioni più recenti su Pagina del prodotto SageMaker Data Wrangler.

Circa gli autori

Munish Dabra è Principal Solutions Architect presso Amazon Web Services (AWS). Le sue attuali aree di interesse sono AI/ML e Osservabilità. Ha una solida esperienza nella progettazione e realizzazione di sistemi distribuiti scalabili. Gli piace aiutare i clienti a innovare e trasformare la loro attività in AWS. Linkedin: /mdabra

Munish Dabra è Principal Solutions Architect presso Amazon Web Services (AWS). Le sue attuali aree di interesse sono AI/ML e Osservabilità. Ha una solida esperienza nella progettazione e realizzazione di sistemi distribuiti scalabili. Gli piace aiutare i clienti a innovare e trasformare la loro attività in AWS. Linkedin: /mdabra

Patrizio Lin è un ingegnere di sviluppo software con Amazon SageMaker Data Wrangler. Si impegna a rendere Amazon SageMaker Data Wrangler lo strumento di preparazione dei dati numero uno per i flussi di lavoro ML prodotti. Al di fuori del lavoro, puoi trovarlo a leggere, ascoltare musica, conversare con gli amici e servire nella sua chiesa.

Patrizio Lin è un ingegnere di sviluppo software con Amazon SageMaker Data Wrangler. Si impegna a rendere Amazon SageMaker Data Wrangler lo strumento di preparazione dei dati numero uno per i flussi di lavoro ML prodotti. Al di fuori del lavoro, puoi trovarlo a leggere, ascoltare musica, conversare con gli amici e servire nella sua chiesa.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :ha

- :È

- :non

- :Dove

- $ SU

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- azioni

- aggiunto

- aggiuntivo

- Inoltre

- adottato

- Dopo shavasana, sedersi in silenzio; saluti;

- AI / ML

- Tutti

- Consentire

- consente

- anche

- Amazon

- Amazon Sage Maker

- Pilota automatico Amazon SageMaker

- Gestore di dati di Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- importi

- an

- ed

- in qualsiasi

- API

- App

- applicazioni

- applicato

- APPLICA

- approccio

- SONO

- aree

- argomenti

- AS

- associato

- At

- automatizzare

- automaticamente

- evitare

- AWS

- sfondo

- basato

- BE

- diventare

- essendo

- MIGLIORE

- Big

- entrambi

- Parte inferiore

- Rompere

- costruire

- Costruzione

- incassato

- affari

- ma

- by

- detto

- Materiale

- funzionalità

- Custodie

- il cambiamento

- oneri

- dai un'occhiata

- Scegli

- la scelta

- chiesa

- Pulizia

- codice

- Colonna

- impegnata

- Uncommon

- compatibile

- completamento di una

- Completa

- Configurazione

- consolle

- consumato

- Tecnologie Container

- contiene

- Conversazioni

- Corrispondente

- potuto

- creare

- creato

- crea

- Creazione

- critico

- Corrente

- cliente

- Clienti

- dati

- Scambio di dati

- punti dati

- Preparazione dei dati

- elaborazione dati

- data-driven

- dataset

- giorno

- decide

- defaults

- definito

- definizione

- scavare

- dimostrato

- schierare

- distribuzione

- deployment

- progettato

- progettazione

- destinazione

- dettagli

- Determinare

- Mercato

- diverso

- discutere

- distribuito

- sistemi distribuiti

- do

- giù

- durante

- ogni

- In precedenza

- alleviare

- più facile

- facile

- ecosistemi

- efficienza

- efficiente

- in modo efficiente

- sforzo

- o

- abbraccio

- Abilita

- consentendo

- da un capo all'altro

- endpoint

- ingegnere

- Ingegneria

- accrescere

- miglioramenti

- Migliora

- entrare

- Intero

- Ambiente

- Equivalente

- particolarmente

- EVER

- Ogni

- ogni giorno

- qualunque cosa

- esempio

- Esempi

- exchange

- aspetta

- esperienza

- esperimento

- esperimenti

- esplorazione

- esplora

- export

- le esportazioni

- estensione

- estratto

- caratteristica

- Caratteristiche

- pochi

- Compila il

- File

- Trovate

- Flessibilità

- flusso

- flussi

- Focus

- seguire

- i seguenti

- Nel

- modulo

- formato

- amici

- da

- pieno

- ulteriormente

- generare

- generato

- ottenere

- molto

- ha avuto

- maniglia

- Avere

- avendo

- he

- aiutare

- Alta

- mettendo in evidenza

- lui

- il suo

- Come

- Tutorial

- HTML

- HTTPS

- i

- identico

- identificatore

- if

- Immagine

- subito

- importare

- importazione

- competenze

- in

- inclusi

- Compreso

- informazioni

- innovare

- ingresso

- intuizioni

- esempio

- istruzioni

- integrazione

- destinato

- interagire

- si interagisce

- interattivo

- Interfaccia

- ai miglioramenti

- intuitivo

- IT

- SUO

- JavaScript

- Lavoro

- jpg

- json

- Luglio

- ad appena

- Le

- Le Lingue

- grandi

- Cognome

- dopo

- con i più recenti

- lanciare

- apprendimento

- lasciare

- Livello

- piace

- Limitato

- LINK

- Lista

- Ascolto

- elenchi

- località

- Guarda

- macchina

- machine learning

- make

- Fare

- gestire

- Manuale

- Maggio..

- Menu

- Metadati

- metodo

- forza

- milione

- Minuti

- mancante

- ML

- MLOp

- modello

- modelli

- moderno

- modificato

- Scopri di più

- più efficiente

- multiplo

- Musica

- devono obbligatoriamente:

- Nome

- Detto

- cioè

- nativo

- necessaria

- Bisogno

- esigenze

- New

- Nuove funzionalità

- recentemente

- GENERAZIONE

- no

- nodo

- taccuino

- adesso

- numero

- oggetto

- oggetti

- of

- on

- ONE

- esclusivamente

- operativa

- ottimale

- OTTIMIZZA

- Opzione

- Opzioni

- or

- Altro

- nostro

- su

- produzione

- al di fuori

- proprio

- parametro

- parametri

- Passato

- sentiero

- per

- Eseguire

- scegliere

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- più

- punto

- punti

- Post

- potenziale

- energia

- predire

- previsto

- preparazione

- Preparare

- preparato

- piuttosto

- in precedenza

- Direttore

- processi

- Elaborato

- lavorazione

- Prodotto

- Recensioni prodotto

- Produzione

- programmatica

- Programmazione

- linguaggi di programmazione

- progetto

- fornire

- fornitura

- Python

- Lettura

- tempo reale

- ricevere

- raccomandare

- ridurre

- riduce

- rilasciare

- pertinente

- rimuovere

- rappresentare

- che rappresenta

- richiesta

- richiedere

- risorsa

- risultante

- Risultati

- recensioni

- Recensioni

- destra

- Ruolo

- corre

- s

- sagemaker

- Inferenza di SageMaker

- Pipeline SageMaker

- stesso

- sega

- scalabile

- senza soluzione di continuità

- senza soluzione di continuità

- Sezione

- vedere

- Selezione

- prodotti

- Servizi

- servizio

- Sessione

- set

- impostazioni

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- fermare

- segno

- Un'espansione

- semplificata

- semplificare

- semplificando

- singolo

- Taglia

- piccole

- inferiore

- So

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- tensione

- in particolare

- dividere

- inizia a

- iniziato

- step

- Passi

- conservazione

- memorizzati

- snellire

- razionalizzazione

- forte

- strutturato

- inviare

- presentata

- tale

- supporto

- supporti

- sicuro

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- Target

- che

- Il

- le informazioni

- loro

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- quelli

- Attraverso

- tempo

- titolato

- a

- oggi

- pure

- strumenti

- Totale

- Treni

- allenato

- Training

- Trasformare

- Trasformazione

- trasformazioni

- trasformato

- trasforma

- Due volte

- ui

- per

- sbloccare

- caricato

- uso

- caso d'uso

- utilizzato

- utilizzando

- Prezioso

- APPREZZIAMO

- Valori

- molto

- via

- Visualizza

- visualizzazione

- volere

- ricercato

- we

- sito web

- servizi web

- siti web

- Settimane

- WELL

- quando

- quale

- ampiamente

- volere

- con

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro