Ogni organizzazione ha il proprio set di standard e pratiche che forniscono sicurezza e governance per il proprio ambiente AWS. Amazon Sage Maker è un servizio completamente gestito per preparare i dati e creare, addestrare e distribuire modelli di machine learning (ML) per qualsiasi caso d'uso con infrastruttura, strumenti e flussi di lavoro completamente gestiti. SageMaker fornisce una serie di modelli per le organizzazioni che desiderano iniziare rapidamente con i flussi di lavoro ML e le pipeline di integrazione continua e consegna continua (CI/CD) DevOps.

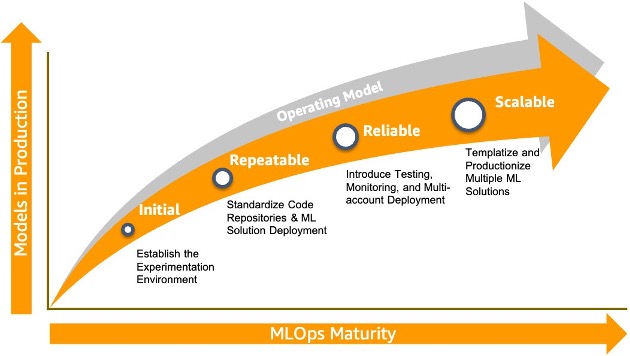

La maggior parte dei clienti aziendali dispone già di una pratica MLOps consolidata con un ambiente standardizzato, ad esempio un repository standardizzato, un'infrastruttura e protezioni di sicurezza, e desidera estendere il proprio processo MLOps a strumenti AutoML senza codice e a basso contenuto di codice anche. Hanno anche molti processi che devono essere rispettati prima di promuovere un modello alla produzione. Stanno cercando un modo rapido e semplice per passare dalla fase iniziale a una fase operativa ripetibile, affidabile e infine scalabile, come illustrato nel diagramma seguente. Per ulteriori informazioni, fare riferimento a Roadmap della fondazione MLOps per le aziende con Amazon SageMaker.

Sebbene queste aziende dispongano di solidi team di data science e MLOps che le aiutino a creare pipeline affidabili e scalabili, vogliono che i loro utenti dello strumento AutoML a basso codice producano artefatti di codice e modello in un modo che possa essere integrato con le loro pratiche standardizzate, aderendo alle loro struttura del repository del codice e con convalide, test, passaggi e approvazioni appropriati.

Stanno cercando un meccanismo per gli strumenti low-code per generare tutto il codice sorgente per ogni fase delle attività AutoML (pre-elaborazione, addestramento e post-elaborazione) in una struttura di repository standardizzata che possa fornire ai loro data scientist esperti la capacità di visualizzare , convalidare e modificare il flusso di lavoro in base alle proprie esigenze e quindi generare un modello di pipeline personalizzato che può essere integrato in un ambiente standardizzato (dove hanno definito il repository di codice, gli strumenti di creazione del codice e i processi).

Questo post mostra come avere un processo ripetibile con strumenti a basso codice come Pilota automatico Amazon SageMaker in modo tale che possa essere perfettamente integrato nel tuo ambiente, quindi non devi orchestrare questo flusso di lavoro end-to-end da solo. Dimostriamo come utilizzare CI/CD il codice degli strumenti low-code/no-code per integrarlo nel tuo ambiente MLOps, rispettando le best practice MLOps.

Panoramica della soluzione

Per dimostrare il flusso di lavoro orchestrato, utilizziamo il file pubblicamente disponibile Set di dati sul reddito del censimento degli adulti UCI 1994 per prevedere se una persona ha un reddito annuo superiore a $ 50,000 all'anno. Questo è un problema di classificazione binaria; le opzioni per la variabile obiettivo di reddito sono superiori a $ 50,000 o inferiori a $ 50,000.

La tabella seguente riassume i componenti principali del set di dati.

| Caratteristiche del set di dati | Multivariata | Numero di istanze | 48842 | Zona | Social |

| Caratteristiche degli attributi: | Categorico, Intero | Numero di attributi: | 14 | Data Donazione | 1996-05-01 |

| Compiti associati: | Classificazione | Valori mancanti? | Sì | Numero di accessi Web | 2749715 |

La tabella seguente riepiloga le informazioni sugli attributi.

| Nome colonna | Descrizione |

| Età | Educazione |

| classe lavoro | Privato, Self-emp-not-inc, Self-emp-inc, Federal-gov, Local-gov, State-gov, Senza retribuzione, Mai lavorato |

| fnlwgt | continuo |

| continua | Laurea triennale, Some-college, 11, HS-grad, Prof-school, Assoc-acdm, Assoc-voc, 9, 7-8, 12, Master, 1-4, 10, Dottorato, 5-6, Scuola dell'infanzia. |

| numero di istruzione | continuo |

| stato civile | Sposato-coniuge-civ, Divorziato, Mai-sposato, Separato, Vedovo, Sposato-coniuge-assente, Sposato-AF-coniuge. |

| occupazione | ech-support, Craft-repair, Other-service, Sales, Exec-managerial, Prof-specialty, Handlers-cleaners, Machine-op-inspct, Adm-clerical, Farming-fishing, Transport-moving, Priv-house-serv, Servizio protettivo, Forze armate |

| rapporto | Moglie, figlio proprio, marito, non familiare, altro parente, celibe. |

| gara | Bianco, Asiatico-Pac-Islander, Amer-Indian-Eskimo, Altro, Nero |

| sesso | Femmina maschio |

| plusvalenza | Educazione |

| perdita di capitale | Educazione |

| ore per settimana | Educazione |

| Paese d'origine | Stati Uniti, Cambogia, Inghilterra, Portorico, Canada, Germania, Outlying-US (Guam-USVI-etc), India, Giappone, Grecia, Sud, Cina, Cuba, Iran, Honduras, Filippine, Italia, Polonia, Giamaica , Vietnam, Messico, Portogallo, Irlanda, Francia, Repubblica Dominicana, Laos, Ecuador, Taiwan, Haiti, Colombia, Ungheria, Guatemala, Nicaragua, Scozia, Tailandia, Jugoslavia, El-Salvador, Trinadad&Tobago, Perù, Hong, Olanda-Paesi Bassi . |

| classe | Classe di reddito, <=50K o >=50K |

In questo post, mostriamo come utilizzare Amazon SageMaker Projects, uno strumento che aiuta le organizzazioni a configurare e standardizzare gli ambienti per MLOps con strumenti AutoML low-code come Autopilot e Gestore di dati di Amazon SageMaker.

Il pilota automatico elimina il lavoro pesante della creazione di modelli ML. Fornisci semplicemente un set di dati tabulare e seleziona la colonna di destinazione da prevedere e Autopilot esplorerà automaticamente diverse soluzioni per trovare il modello migliore. È quindi possibile distribuire direttamente il modello in produzione con un solo clic o ripetere le soluzioni consigliate per migliorare ulteriormente la qualità del modello.

Data Wrangler fornisce una soluzione end-to-end per importare, preparare, trasformare, caratterizzare e analizzare i dati. Puoi integrare un flusso di preparazione dei dati di Data Wrangler nei tuoi flussi di lavoro ML per semplificare e ottimizzare la pre-elaborazione dei dati e l'ingegnerizzazione delle funzionalità utilizzando poca o nessuna codifica. Puoi anche aggiungere i tuoi script e trasformazioni Python per personalizzare i flussi di lavoro. Utilizziamo Data Wrangler per eseguire la pre-elaborazione sul set di dati prima di inviare i dati ad Autopilot.

SageMaker Projects aiuta le organizzazioni a configurare e standardizzare gli ambienti per automatizzare le diverse fasi coinvolte in un ciclo di vita ML. Sebbene i notebook siano utili per la creazione di modelli e la sperimentazione, un team di data scientist e ingegneri ML che condividono il codice ha bisogno di un modo più scalabile per mantenere la coerenza del codice e un rigoroso controllo della versione.

Per aiutarti a iniziare con la creazione di modelli comuni e i paradigmi di distribuzione, SageMaker Projects offre una serie di modelli proprietari (Modelli 1P). I modelli 1P generalmente si concentrano sulla creazione di risorse per la creazione di modelli e l'addestramento di modelli. I modelli includono progetti che utilizzano servizi nativi di AWS per CI/CD, ad esempio AWSCodeBuild ed AWS Code Pipeline. SageMaker Projects può supportare offerte di modelli personalizzati, in cui le organizzazioni utilizzano un AWS CloudFormazione modello per eseguire uno stack Terraform e creare le risorse necessarie per un flusso di lavoro ML.

Le organizzazioni potrebbero voler estendere i modelli 1P per supportare i casi d'uso oltre la semplice formazione e distribuzione dei modelli. Modelli di progetto personalizzati sono un modo per creare un flusso di lavoro standard per i progetti ML. È possibile creare diversi modelli e utilizzare Gestione dell'identità e dell'accesso di AWS (IAM) per gestire l'accesso a tali modelli Amazon Sage Maker Studio, assicurando che ciascuno dei tuoi utenti acceda a progetti dedicati ai propri casi d'uso.

Per ulteriori informazioni sui progetti SageMaker e sulla creazione di modelli di progetto personalizzati in linea con le best practice, fare riferimento a Crea modelli di progetto SageMaker personalizzati: best practice.

Questi modelli personalizzati vengono creati come Catalogo dei servizi AWS prodotti e forniti come modelli di organizzazione nell'interfaccia utente di Studio. È qui che i data scientist possono scegliere un modello e avviare e preconfigurare il proprio flusso di lavoro ML. Il provisioning dei progetti viene effettuato utilizzando i prodotti AWS Service Catalog. I modelli di progetto vengono utilizzati dalle organizzazioni per eseguire il provisioning dei progetti per ciascuno dei propri team.

In questo post, mostriamo come creare un modello di progetto personalizzato per avere un flusso di lavoro MLOps end-to-end utilizzando progetti SageMaker, AWS Service Catalog e Pipeline di Amazon SageMaker l'integrazione di Data Wrangler e Autopilot con gli esseri umani nel ciclo per facilitare le fasi di addestramento e distribuzione del modello. Gli esseri umani nel ciclo sono le diverse persone coinvolte in una pratica MLOps che lavorano in modo collaborativo per un flusso di lavoro di creazione e distribuzione ML di successo.

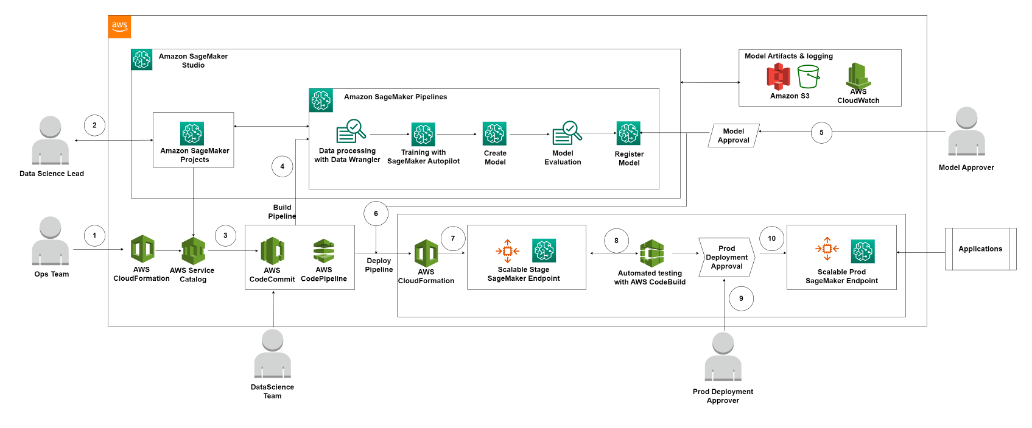

Il diagramma seguente illustra il flusso di lavoro di automazione end-to-end low-code/no-code.

Il flusso di lavoro include i seguenti passaggi:

- Il team operativo o il team della piattaforma avvia il modello CloudFormation per configurare i prerequisiti richiesti per il provisioning del modello SageMaker personalizzato.

- Quando il modello è disponibile in SageMaker, il Data Science Lead lo utilizza per creare un progetto SageMaker.

- La creazione del progetto SageMaker avvierà un prodotto AWS Service Catalog che aggiunge due codici seed al file AWS CodeCommit repository:

- Il codice di inizializzazione per la pipeline di creazione del modello include una pipeline che pre-elabora il file Set di dati UCI Machine Learning per adulti utilizzando Data Wrangler, crea automaticamente un modello ML con visibilità completa utilizzando Autopilot, valuta le prestazioni di un modello utilizzando una fase di elaborazione e registra il modello in un registro dei modelli in base alle prestazioni del modello.

- Il codice di inizializzazione per la distribuzione del modello include una fase di CodeBuild per trovare il modello più recente che è stato approvato nel registro del modello e creare file di configurazione per distribuire i modelli CloudFormation come parte delle pipeline CI/CD utilizzando CodePipeline. Il modello CloudFormation distribuisce il modello negli ambienti di gestione temporanea e di produzione.

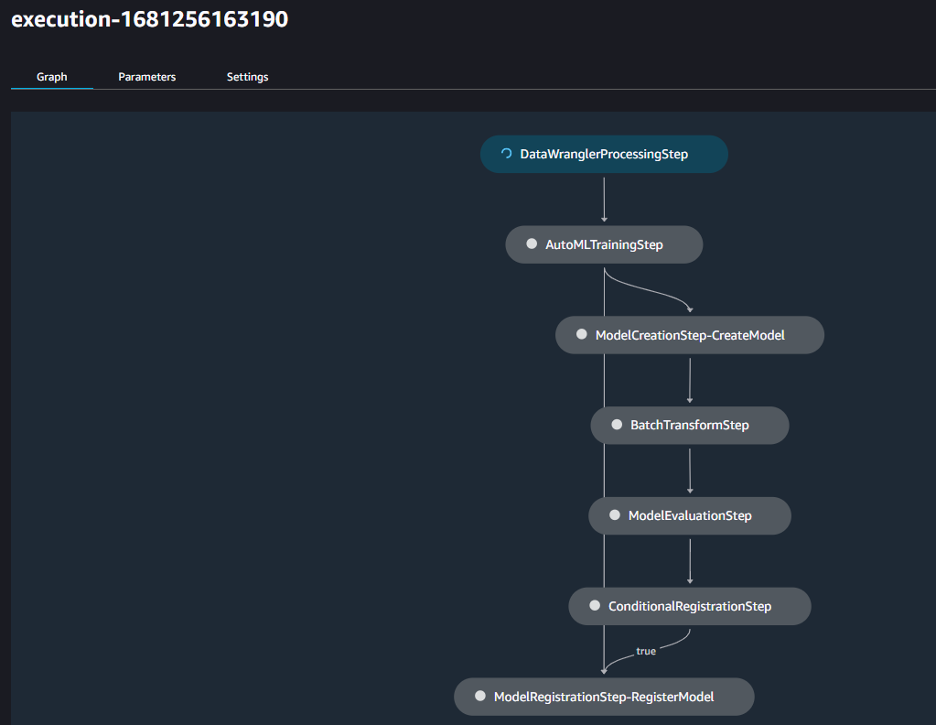

- Il primo commit del codice seed avvia una pipeline CI/CD utilizzando CodePipeline che attiva una pipeline SageMaker, ovvero una serie di passaggi interconnessi codificati utilizzando un grafo aciclico diretto (DAG). In questo caso, i passaggi coinvolti sono elaborazione dati utilizzando un flusso Data Wrangler, addestrare il modello utilizzando il pilota automatico, creazione del modello, valutando il modello e, se la valutazione viene superata, registrazione del modello.

Per maggiori dettagli sulla creazione di pipeline SageMaker utilizzando Autopilot, fare riferimento a Avvia gli esperimenti di Amazon SageMaker Autopilot direttamente da Amazon SageMaker Pipelines per automatizzare facilmente i flussi di lavoro MLOps.

- Dopo che il modello è stato registrato, l'approvatore del modello può approvare o rifiutare il modello in Studio.

- Quando il modello viene approvato, viene attivata una pipeline di distribuzione CodePipeline integrata con il secondo codice seed.

- Questa pipeline crea un endpoint scalabile senza server SageMaker per l'ambiente di staging.

- È presente un passaggio di test automatizzato nella pipeline di distribuzione che verrà testato sull'endpoint di gestione temporanea.

- I risultati del test sono memorizzati in Servizio di archiviazione semplice Amazon (Amazon S3). La pipeline si fermerà per un approvatore della distribuzione di produzione, che può esaminare tutti gli artefatti prima dell'approvazione.

- Una volta approvato, il modello viene distribuito alla produzione sotto forma di endpoint serverless scalabile. Le applicazioni di produzione possono ora utilizzare l'endpoint per l'inferenza.

Le fasi di distribuzione sono le seguenti:

- Crea il modello di progetto SageMaker personalizzato per Autopilot e altre risorse utilizzando AWS CloudFormation. Questa è un'attività di configurazione una tantum.

- Crea il progetto SageMaker utilizzando il modello personalizzato.

Nelle sezioni seguenti, procediamo con ciascuno di questi passaggi in modo più dettagliato ed esploriamo la pagina dei dettagli del progetto.

Prerequisiti

Questa procedura dettagliata include i seguenti prerequisiti:

Crea risorse di soluzione con AWS CloudFormation

È possibile scaricare e avviare il file Modello CloudFormation tramite la console AWS CloudFormation, il Interfaccia della riga di comando di AWS (AWS CLI), l'SDK o semplicemente scegliendo Avvia Stack:

Il modello CloudFormation è disponibile anche nel formato Repository di codice GitHub di esempi AWS. Il repository contiene quanto segue:

- A Modello CloudFormation per configurare il modello di progetto SageMaker personalizzato per Autopilot

- Codice seme con il codice ML per configurare le pipeline SageMaker per automatizzare l'elaborazione dei dati e le fasi di addestramento

- A cartella del progetto per il modello CloudFormation utilizzato da AWS Service Catalog mappato al modello di progetto SageMaker personalizzato che verrà creato

Il modello CloudFormation accetta diversi parametri come input.

Di seguito sono riportati i parametri delle informazioni sul prodotto AWS Service Catalog:

- nome del prodotto – Il nome del prodotto AWS Service Catalog a cui sarà associato il modello MLOps personalizzato del progetto SageMaker

- Descrizione del prodotto – La descrizione del prodotto AWS Service Catalog

- Product Owner – Il proprietario del prodotto Service Catalog

- Distributore di prodotti – Il distributore del prodotto Service Catalog

Di seguito sono riportati i parametri delle informazioni di supporto del prodotto AWS Service Catalog:

- Descrizione del supporto del prodotto – Una descrizione del supporto per questo prodotto

- E-mail di supporto del prodotto – Un indirizzo e-mail del team che supporta il prodotto AWS Service Catalog

- URL del supporto del prodotto – Un URL di supporto per il prodotto AWS Service Catalog

Di seguito sono riportati i parametri di configurazione del repository del codice sorgente:

- URL alla versione compressa del tuo repository GitHub – Utilizza i valori predefiniti se non esegui il fork del repository AWS Samples.

- Nome e ramo del tuo repository GitHub – Questi dovrebbero corrispondere alla cartella principale dello zip. Utilizza i valori predefiniti se non esegui il fork del repository AWS Samples.

- StudioUserExecutionRole – Fornisci l'ARN del ruolo IAM di esecuzione dell'utente di Studio.

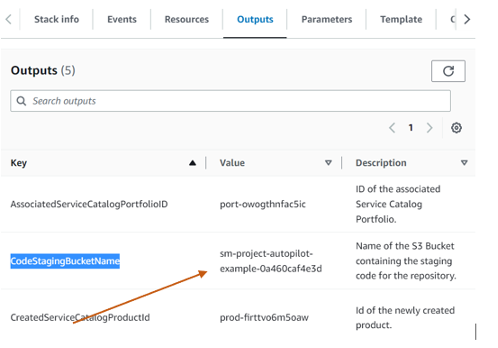

Dopo aver avviato lo stack CloudFormation da questo modello, puoi monitorarne lo stato nella console AWS CloudFormation.

Quando lo stack è completo, copia il valore di CodeStagingBucketName chiave sul Uscite scheda dello stack CloudFormation e salvalo in un editor di testo per utilizzarlo in seguito.

Crea il progetto SageMaker utilizzando il nuovo modello personalizzato

Per creare il tuo progetto SageMaker, completa i seguenti passaggi:

- Accedi a Studio. Per ulteriori informazioni, vedere Integrazione nel dominio Amazon SageMaker.

- Nella barra laterale di Studio, scegli l'icona Home.

- Scegli Distribuzioni dal menu, quindi scegli Progetti.

- Scegli Crea progetto.

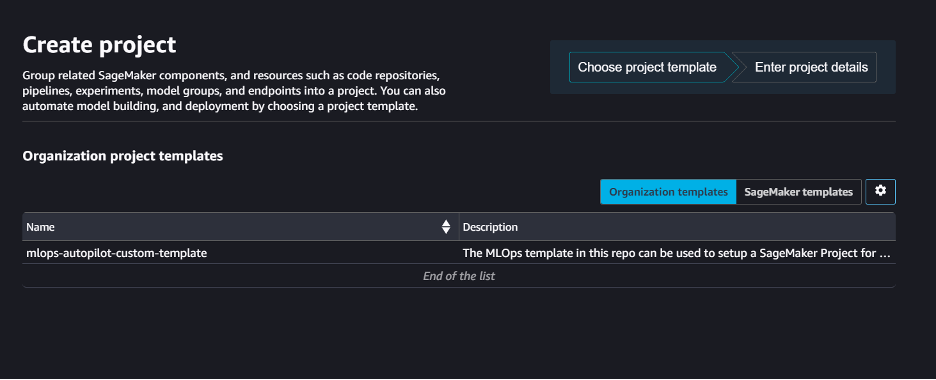

- Scegli Modelli di organizzazione per visualizzare il nuovo modello MLOps personalizzato.

- Scegli Seleziona modello di progetto.

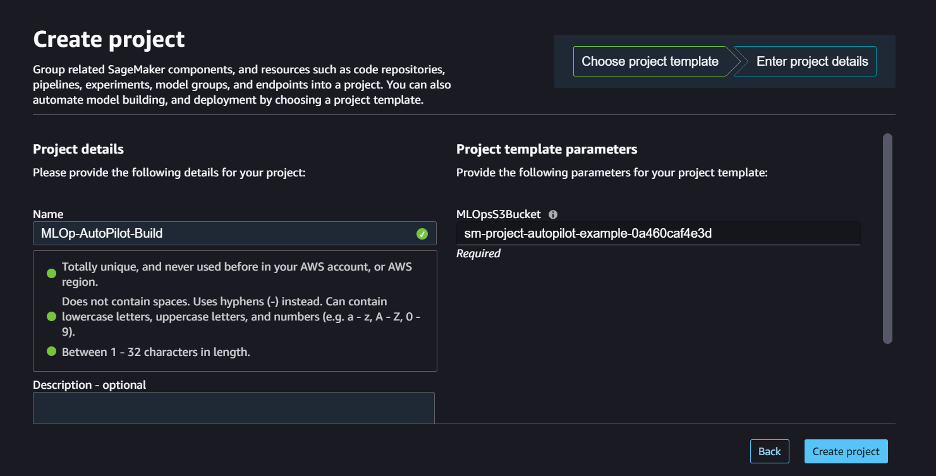

- Nel Dettagli del progetto, inserisci un nome e una descrizione per il tuo progetto.

- Nel MLOpsS3Bucket, inserisci il nome del bucket S3 che hai salvato in precedenza.

- Scegli Crea progetto.

Viene visualizzato un messaggio che indica che SageMaker sta fornendo e configurando le risorse.

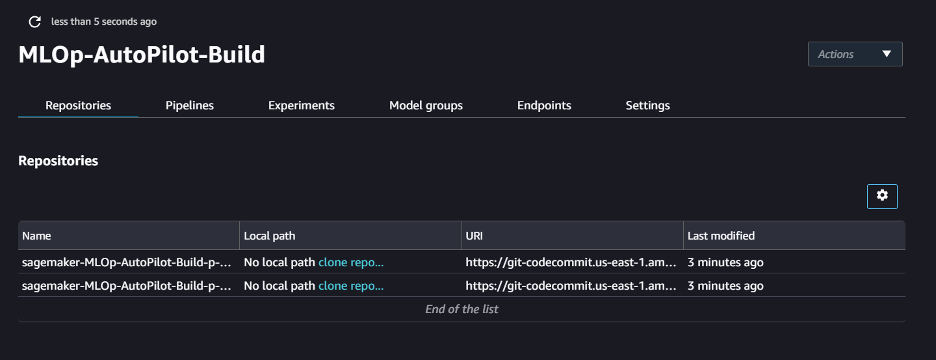

Quando il progetto è completo, ricevi un messaggio di successo e il tuo progetto è ora elencato nella Progetti elenco.

Esplora i dettagli del progetto

Nella pagina dei dettagli del progetto, puoi visualizzare varie schede associate al progetto. Analizziamo in dettaglio ciascuna di queste schede.

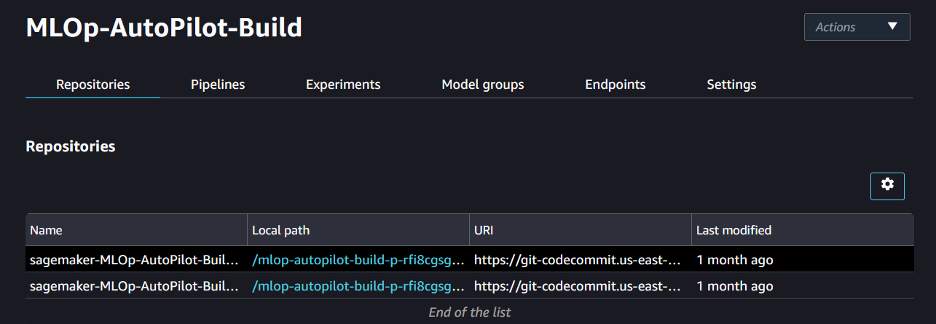

repository

Questa scheda elenca i repository di codice associati a questo progetto. Puoi scegliere clone repository per Percorso locale per clonare i due repository di codice seed creati in CodeCommit dal progetto SageMaker. Questa opzione fornisce l'accesso Git ai repository di codice dal progetto SageMaker stesso.

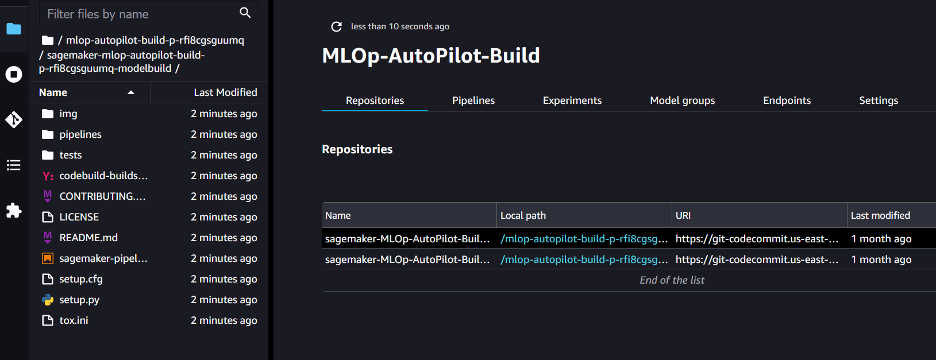

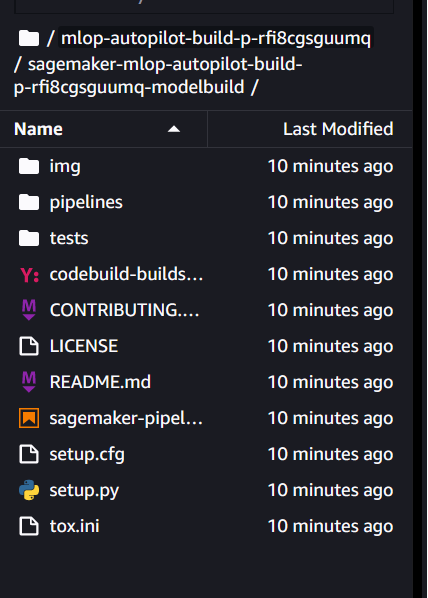

Quando il clone del repository è completo, il percorso locale viene visualizzato nel file Percorso locale colonna. Puoi scegliere il percorso per aprire la cartella locale che contiene il codice del repository in Studio.

La cartella sarà accessibile nel riquadro di navigazione. È possibile utilizzare l'icona del browser di file per nascondere o visualizzare l'elenco delle cartelle. Puoi apportare le modifiche al codice qui o scegliere l'icona Git per mettere in scena, eseguire il commit e inviare la modifica.

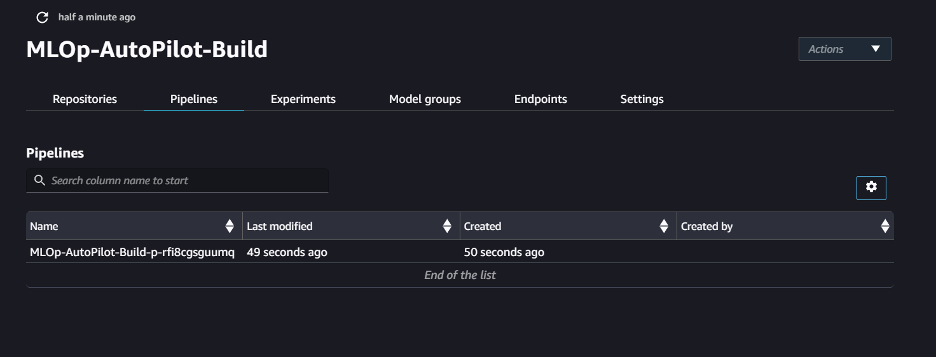

Condotte

Questa scheda elenca le pipeline SageMaker ML che definiscono i passaggi per preparare i dati, addestrare i modelli e distribuire i modelli. Per informazioni sulle pipeline SageMaker ML, vedere Crea e gestisci pipeline SageMaker.

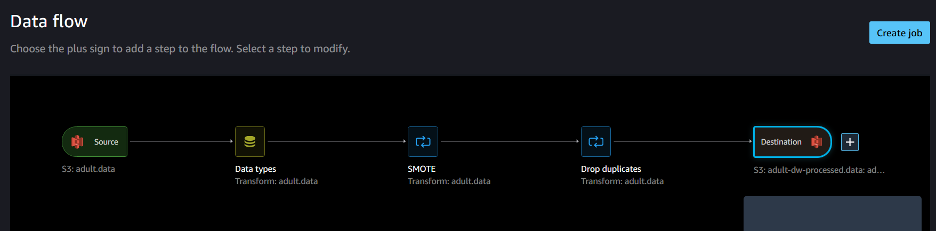

Puoi scegliere la pipeline attualmente in esecuzione per visualizzarne lo stato più recente. Nell'esempio seguente, il passaggio DataProcessing viene eseguito utilizzando un flusso di dati Data Wrangler.

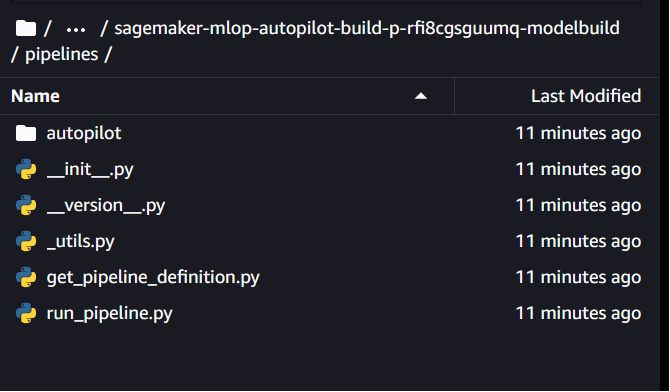

Puoi accedere al flusso di dati dal percorso locale del repository di codice che abbiamo clonato in precedenza. Scegli l'icona del browser di file per mostrare il percorso, che è elencato nel file pipelines cartella del repository di costruzione del modello.

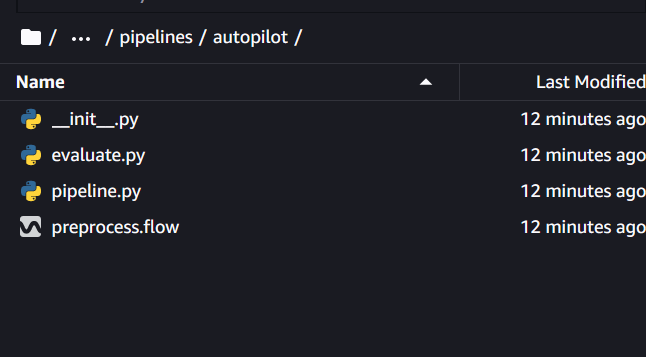

Nel pipelines cartella, aprire la cartella del pilota automatico.

Nel autopilot cartella, apri il file preprocess.flow file.

Ci vorrà un momento per aprire il flusso di Data Wrangler.

In questo esempio, vengono eseguite tre trasformazioni di dati tra l'origine e la destinazione. Puoi scegliere ogni trasformazione per visualizzare maggiori dettagli.

Per istruzioni su come includere o rimuovere le trasformazioni in Data Wrangler, fare riferimento a Trasforma i dati.

Per ulteriori informazioni, fare riferimento a Preparazione unificata dei dati e addestramento dei modelli con Amazon SageMaker Data Wrangler e Amazon SageMaker Autopilot – Parte 1.

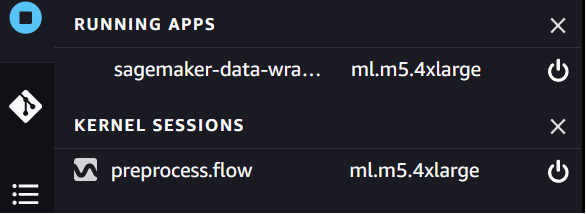

Al termine della revisione, scegli l'icona di accensione e interrompi le risorse di Data Wrangler in basso App in esecuzione ed Sessioni del kernel.

Esperimenti

Questa scheda elenca gli esperimenti Autopilot associati al progetto. Per ulteriori informazioni su Autopilot, vedere Automatizza lo sviluppo del modello con Amazon SageMaker Autopilot.

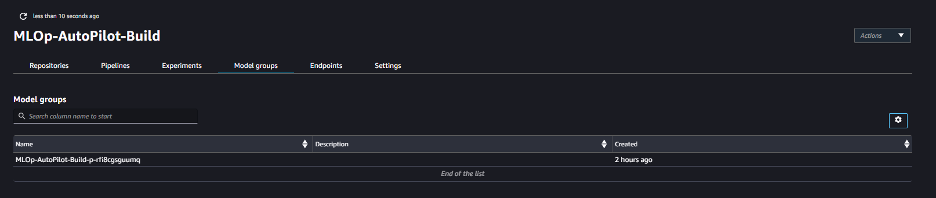

Gruppi di modelli

Questa scheda elenca i gruppi di versioni del modello create dalle esecuzioni della pipeline nel progetto. Al termine dell'esecuzione della pipeline, il modello creato dall'ultimo passaggio della pipeline sarà accessibile qui.

È possibile scegliere il gruppo di modelli per accedere all'ultima versione del modello.

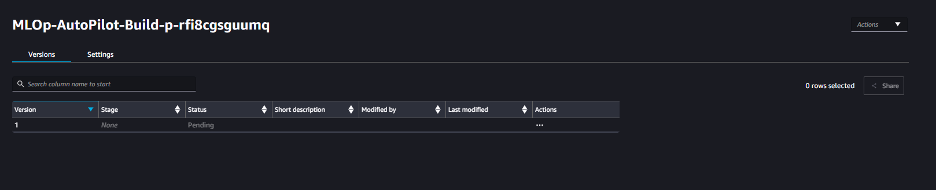

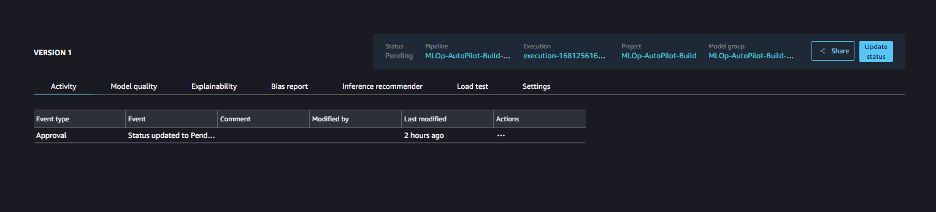

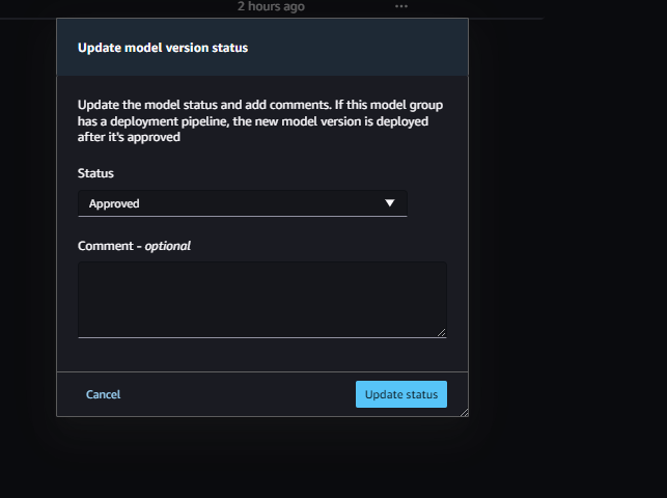

Lo stato della versione del modello nell'esempio seguente è Attesa Pagamento. Puoi scegliere la versione del modello e scegliere Aggiorna stato per aggiornare lo stato.

Scegli Approvato e scegli Aggiorna stato per approvare il modello.

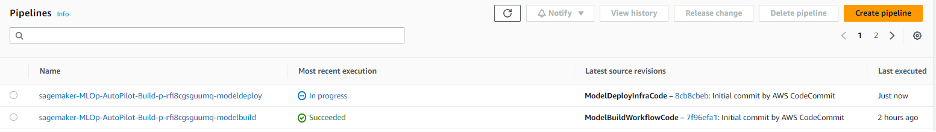

Dopo che lo stato del modello è stato approvato, verrà avviata la pipeline CI/CD di distribuzione del modello all'interno di CodePipeline.

Puoi aprire la pipeline distribuita per visualizzare le diverse fasi nel repository.

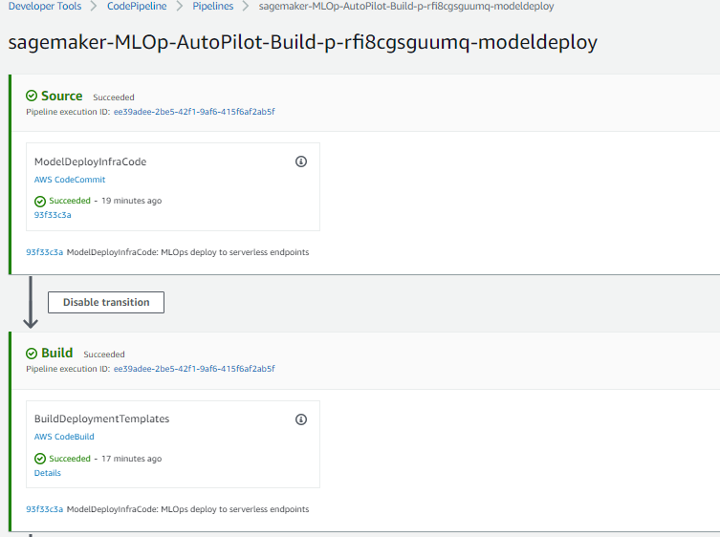

Come mostrato nello screenshot precedente, questa pipeline ha quattro fasi:

- Fonte – In questa fase, CodePipeline verifica il codice del repository CodeCommit nel bucket S3.

- Costruire – In questa fase, i modelli di CloudFormation vengono preparati per la distribuzione del codice del modello.

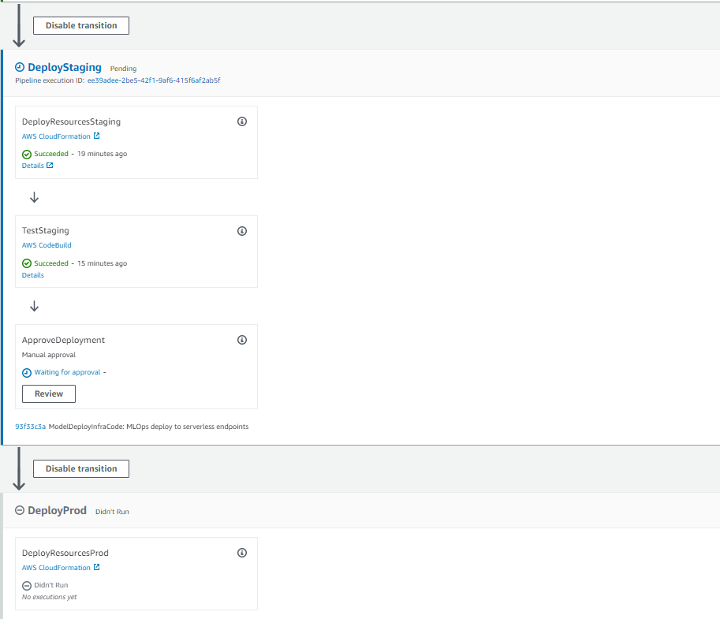

- DistribuisciStaging – Questa fase si compone di tre sottofasi:

- DeployResourcesStaging – Nella prima fase secondaria, lo stack CloudFormation viene distribuito per creare un file endpoint SageMaker senza server nell'ambiente scenico.

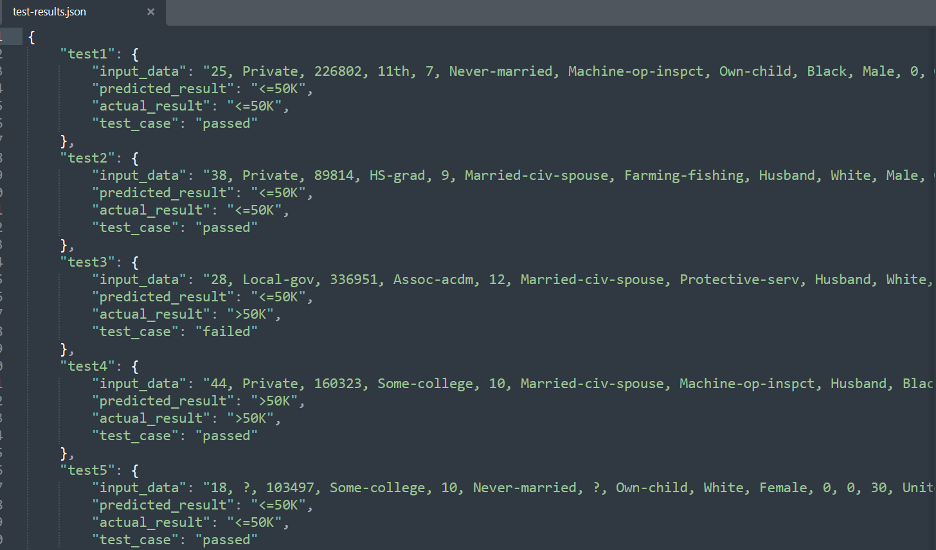

- ProvaStaging – Nella seconda fase secondaria, il test automatizzato viene eseguito utilizzando CodeBuild sull'endpoint per verificare se l'inferenza si sta verificando come previsto. I risultati del test saranno disponibili nel bucket S3 con il nome

sagemaker-project-<project ID of the SageMaker project>.

Puoi ottenere l'ID del progetto SageMaker sul file Impostazioni profilo scheda del progetto SageMaker. All'interno del bucket S3, scegli la cartella del nome del progetto (ad esempio, sagemaker-MLOp-AutoP) e al suo interno, apri la cartella TestArtifa/. Scegli il file oggetto in questa cartella per vedere i risultati del test.

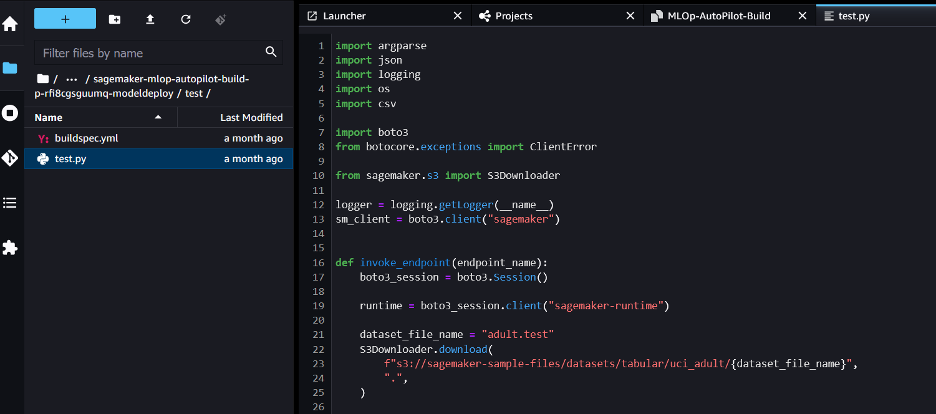

Puoi accedere allo script di test dal percorso locale del repository di codice che abbiamo clonato in precedenza. Scegli l'icona del browser di file per visualizzare il percorso. Nota che questo sarà il repository di distribuzione. In quel repository, apri la cartella di test e scegli il file test.py File di codice Python.

Puoi apportare modifiche a questo codice di test in base al tuo caso d'uso.

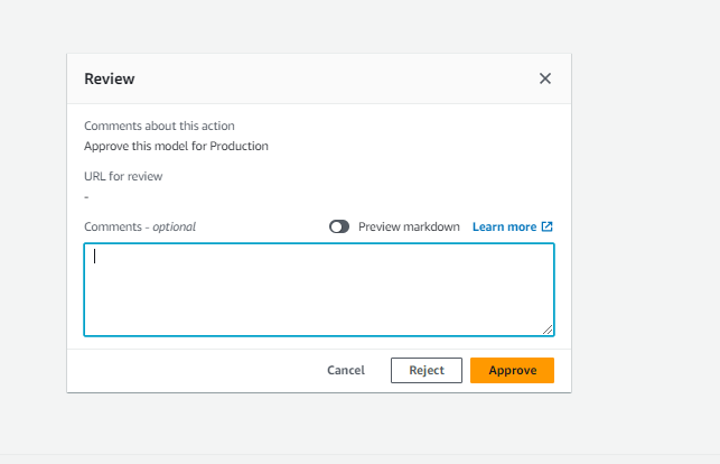

- Approva distribuzione – Nella terza sottofase, c'è un ulteriore processo di approvazione prima dell'ultima fase di distribuzione alla produzione. Puoi scegliere Review e approvarlo per procedere.

- DistribuisciProd – In questa fase, lo stack CloudFormation viene distribuito per creare un endpoint SageMaker senza server per l'ambiente di produzione.

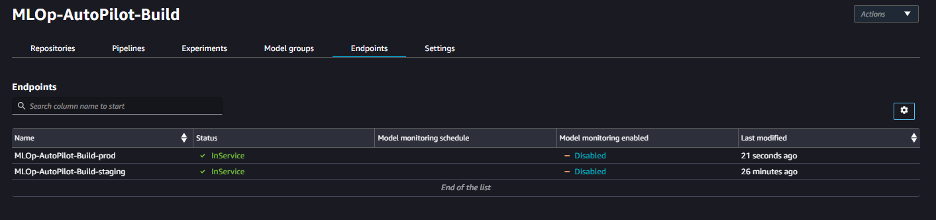

endpoint

Questa scheda elenca gli endpoint SageMaker che ospitano i modelli distribuiti per l'inferenza. Una volta completate tutte le fasi della pipeline di distribuzione del modello, i modelli vengono distribuiti agli endpoint SageMaker e sono accessibili all'interno del progetto SageMaker.

Impostazioni profilo

Questa è l'ultima scheda nella pagina del progetto ed elenca le impostazioni per il progetto. Ciò include il nome e la descrizione del progetto, informazioni sul modello di progetto e SourceModelPackageGroupNamee metadati sul progetto.

ripulire

Per evitare costi di infrastruttura aggiuntivi associati all'esempio in questo post, assicurati di eliminare gli stack CloudFormation. Inoltre, assicurati di eliminare gli endpoint SageMaker, tutti i notebook in esecuzione e i bucket S3 creati durante la configurazione.

Conclusione

Questo post descrive un approccio alla pipeline ML di facile utilizzo per automatizzare e standardizzare l'addestramento e la distribuzione dei modelli ML utilizzando SageMaker Projects, Data Wrangler, Autopilot, Pipelines e Studio. Questa soluzione può aiutarti a eseguire attività AutoML (pre-elaborazione, addestramento e post-elaborazione) in una struttura di repository standardizzata che può fornire ai tuoi data scientist esperti la capacità di visualizzare, convalidare e modificare il flusso di lavoro secondo le loro esigenze e quindi generare una pipeline personalizzata modello che può essere integrato in un progetto SageMaker.

Puoi modificare le pipeline con i passaggi di pre-elaborazione e pipeline per il tuo caso d'uso e distribuire il nostro flusso di lavoro end-to-end. Facci sapere nei commenti come ha funzionato il modello personalizzato per il tuo rispettivo caso d'uso.

Circa gli autori

Vish Naik è Sr. Solutions Architect presso Amazon Web Services (AWS). È un costruttore a cui piace aiutare i clienti a soddisfare le loro esigenze aziendali e risolvere sfide complesse con le soluzioni e le best practice di AWS. La sua area di interesse principale include Machine Learning, DevOps e Container. Nel tempo libero, Vishal ama realizzare cortometraggi sui viaggi nel tempo e sui temi dell'universo alternativo.

Vish Naik è Sr. Solutions Architect presso Amazon Web Services (AWS). È un costruttore a cui piace aiutare i clienti a soddisfare le loro esigenze aziendali e risolvere sfide complesse con le soluzioni e le best practice di AWS. La sua area di interesse principale include Machine Learning, DevOps e Container. Nel tempo libero, Vishal ama realizzare cortometraggi sui viaggi nel tempo e sui temi dell'universo alternativo.

Shikhar Kwatra è un architetto di soluzioni specializzato in AI/ML presso Amazon Web Services, che lavora con uno dei principali integratori di sistemi globali. Si è guadagnato il titolo di uno dei più giovani maestri inventori indiani con oltre 500 brevetti nei domini AI/ML e IoT. Shikhar aiuta a progettare, costruire e mantenere ambienti cloud scalabili ed economici per l'organizzazione e supporta il partner GSI nella creazione di soluzioni di settore strategiche su AWS. A Shikhar piace suonare la chitarra, comporre musica e praticare la consapevolezza nel tempo libero.

Shikhar Kwatra è un architetto di soluzioni specializzato in AI/ML presso Amazon Web Services, che lavora con uno dei principali integratori di sistemi globali. Si è guadagnato il titolo di uno dei più giovani maestri inventori indiani con oltre 500 brevetti nei domini AI/ML e IoT. Shikhar aiuta a progettare, costruire e mantenere ambienti cloud scalabili ed economici per l'organizzazione e supporta il partner GSI nella creazione di soluzioni di settore strategiche su AWS. A Shikhar piace suonare la chitarra, comporre musica e praticare la consapevolezza nel tempo libero.

Janisha Anand è Senior Product Manager nel team SageMaker Low/No Code ML, che include SageMaker Canvas e SageMaker Autopilot. Le piace il caffè, rimanere attiva e passare il tempo con la sua famiglia.

Janisha Anand è Senior Product Manager nel team SageMaker Low/No Code ML, che include SageMaker Canvas e SageMaker Autopilot. Le piace il caffè, rimanere attiva e passare il tempo con la sua famiglia.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- EVM Finance. Interfaccia unificata per la finanza decentralizzata. Accedi qui.

- Quantum Media Group. IR/PR amplificato. Accedi qui.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/bring-sagemaker-autopilot-into-your-mlops-processes-using-a-custom-sagemaker-project/

- :ha

- :È

- :non

- :Dove

- $ SU

- 000

- 1

- 10

- 100

- 10°

- 12

- 17

- 1994

- 214

- 220

- 30

- 500

- 7

- 9

- 9°

- a

- WRI

- accesso

- accessibile

- Accedendo

- realizzare

- attivo

- aciclico

- aggiungere

- aggiuntivo

- indirizzo

- Aggiunge

- Adulto

- AI / ML

- AIDS

- Allineati

- Tutti

- già

- anche

- Sebbene il

- Amazon

- Amazon Sage Maker

- Pilota automatico Amazon SageMaker

- Gestore di dati di Amazon SageMaker

- Pipeline di Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analizzare

- ed

- annuale

- in qualsiasi

- appare

- applicazioni

- approccio

- opportuno

- approvazione

- approvazioni

- approvare

- approvato

- SONO

- RISERVATA

- AS

- associato

- At

- gli attributi

- automatizzare

- Automatizzata

- automaticamente

- Automatizzare

- Automazione

- AutoML

- disponibile

- evitare

- AWS

- AWS CloudFormazione

- basato

- BE

- stato

- prima

- MIGLIORE

- best practice

- fra

- Al di là di

- Branch di società

- portare

- del browser

- costruire

- costruttore

- Costruzione

- affari

- by

- Cambogia

- Materiale

- Può ottenere

- Canada

- tela

- Custodie

- casi

- catalogo

- Censimento

- sfide

- il cambiamento

- Modifiche

- caratteristiche

- dai un'occhiata

- Controlli

- Cina

- Scegli

- la scelta

- classe

- classificazione

- clicca

- Cloud

- codice

- codici

- codifica

- Caffè

- COLUMBIA

- Colonna

- Commenti

- commettere

- Uncommon

- Aziende

- completamento di una

- complesso

- componenti

- Configurazione

- consiste

- consolle

- consumare

- Tecnologie Container

- contiene

- continuo

- di controllo

- Nucleo

- Costi

- creare

- creato

- crea

- Creazione

- creazione

- Cuba

- Attualmente

- costume

- Clienti

- personalizzare

- GIORNO

- dati

- Preparazione dei dati

- elaborazione dati

- scienza dei dati

- dedicato

- deep

- defaults

- definito

- consegna

- dimostrare

- schierare

- schierato

- distribuzione

- deployment

- Distribuisce

- descritta

- descrizione

- destinazione

- dettaglio

- dettagli

- Mercato

- diverso

- direttamente

- domini

- fatto

- Dont

- scaricare

- durante

- ogni

- In precedenza

- guadagnato

- facilmente

- facile

- facile da usare

- Ecuador

- editore

- o

- elimina

- da un capo all'altro

- endpoint

- Ingegneria

- Ingegneri

- Inghilterra

- garantire

- assicurando

- entrare

- Impresa

- aziende

- Ambiente

- ambienti

- la valutazione

- valutazione

- alla fine

- esempio

- esecuzione

- previsto

- esperimenti

- esperto

- esplora

- estendere

- facilitare

- famiglia

- caratteristica

- Compila il

- File

- attraverso

- Trovate

- Nome

- flusso

- Focus

- i seguenti

- Nel

- modulo

- Fondazione

- quattro

- Francia

- da

- pieno

- completamente

- ulteriormente

- generalmente

- generare

- Germania

- ottenere

- Idiota

- GitHub

- globali

- la governance

- laurea

- grafico

- maggiore

- Grecia

- Gruppo

- Gruppo

- Guatemala

- Happening

- Avere

- he

- pesante

- sollevamento pesante

- Aiuto

- utile

- aiutare

- aiuta

- suo

- qui

- nascondere

- il suo

- Casa

- HONDURAS

- Hong

- host

- Come

- Tutorial

- HTML

- http

- HTTPS

- Gli esseri umani

- Ungheria

- ICON

- ID

- Identità

- if

- illustra

- importare

- competenze

- in

- includere

- inclusi

- Reddito

- India

- indiano

- industria

- informazioni

- Infrastruttura

- inizialmente

- ingresso

- istruzioni

- integrare

- integrato

- Integrazione

- integrazione

- interconnesso

- ai miglioramenti

- Inventori

- coinvolto

- IoT

- Iran

- Irlanda

- IT

- Italia

- SUO

- stessa

- Giamaica

- Giappone

- jpg

- ad appena

- solo uno

- Le

- Sapere

- Cognome

- dopo

- con i più recenti

- lanciare

- lancia

- portare

- principale

- IMPARARE

- apprendimento

- lasciare

- ciclo di vita

- di sollevamento

- piace

- linea

- Lista

- elencati

- elenchi

- piccolo

- locale

- cerca

- lotto

- ama

- macchina

- machine learning

- mantenere

- Mantenere

- Maggioranza

- make

- Fare

- gestire

- gestito

- direttore

- modo

- Mastercard

- partita

- Maggio..

- meccanismo

- Menu

- messaggio

- Metadati

- Messico

- Mindfulness

- ML

- MLOp

- modello

- modelli

- modificare

- momento

- Monitorare

- Scopri di più

- Musica

- Nome

- Navigazione

- Bisogno

- di applicazione

- esigenze

- New

- no

- adesso

- oggetto

- of

- offerte

- Offerte

- on

- ONE

- aprire

- operativo

- Opzione

- Opzioni

- or

- orchestrato

- minimo

- organizzazione

- organizzazioni

- Altro

- nostro

- delineato

- ancora

- proprio

- proprietario

- pagina

- vetro

- parametri

- parte

- partner

- Passato

- Brevetti

- sentiero

- Eseguire

- performance

- eseguita

- persona

- tacchino

- fase

- Philippines

- conduttura

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- Polonia

- Termini e Condizioni

- Portogallo

- Post

- energia

- pratica

- pratiche

- predire

- preparazione

- Preparare

- preparato

- prerequisiti

- Problema

- processi

- i processi

- lavorazione

- produrre

- Prodotto

- Informazioni sul prodotto

- product manager

- Produzione

- Prodotti

- progetto

- Dettagli del progetto

- progetti

- promuovere

- fornire

- fornisce

- fornitura

- pubblicamente

- Spingi

- Python

- qualità

- Presto

- rapidamente

- ricevere

- raccomandato

- registrato

- registri

- registro

- affidabile

- rimuovere

- ripetibile

- deposito

- necessario

- Risorse

- quelli

- Risultati

- recensioni

- revisione

- tabella di marcia

- robusto

- Ruolo

- radice

- Correre

- running

- sagemaker

- Pipeline SageMaker

- vendite

- Risparmi

- scalabile

- Scienze

- scienziati

- script

- sdk

- senza soluzione di continuità

- Secondo

- sezioni

- problemi di

- vedere

- seme

- anziano

- Serie

- serverless

- servizio

- Servizi

- set

- impostazioni

- flessibile.

- alcuni

- compartecipazione

- lei

- Corti

- dovrebbero

- mostrare attraverso le sue creazioni

- vetrina

- mostrato

- Un'espansione

- semplificare

- semplicemente

- So

- soluzione

- Soluzioni

- RISOLVERE

- Fonte

- codice sorgente

- Sud

- specialista

- Spendere

- pila

- Stacks

- Stage

- tappe

- messa in scena

- Standard

- standard

- inizia a

- iniziato

- inizio

- Stato dei servizi

- step

- Passi

- Fermare

- conservazione

- memorizzati

- Strategico

- snellire

- Strict

- La struttura

- studio

- il successo

- di successo

- tale

- supporto

- Supporto

- supporti

- sistema

- tavolo

- Taiwan

- Fai

- prende

- Target

- Task

- task

- team

- le squadre

- modello

- modelli

- Terraform

- test

- testato

- Testing

- test

- Tailandia

- di

- che

- Il

- L’ORIGINE

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Terza

- questo

- quelli

- tre

- tempo

- tempo di percorrenza

- Titolo

- a

- Tobago

- strumenti

- Treni

- Training

- Trasformare

- Trasformazione

- trasformazioni

- viaggiare

- innescato

- seconda

- ui

- per

- Universo

- Aggiornanento

- URL

- us

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- CONVALIDARE

- APPREZZIAMO

- Valori

- vario

- versione

- via

- Vietnam

- Visualizza

- Vishal

- visibilità

- walkthrough

- volere

- Modo..

- we

- sito web

- servizi web

- WELL

- sono stati

- quando

- quale

- while

- OMS

- volere

- con

- entro

- lavorato

- flusso di lavoro

- flussi di lavoro

- lavoro

- YAML

- anno

- Tu

- Minore

- Trasferimento da aeroporto a Sharm

- zefiro

- Codice postale