JumpStart di Amazon SageMaker è l'hub di Machine Learning (ML) di SageMaker che fornisce modelli preaddestrati e pubblicamente disponibili per un'ampia gamma di tipi di problemi per aiutarti a iniziare con il machine learning.

Capire il comportamento dei clienti è al centro dell'attenzione di ogni azienda oggi. Ottenere informazioni dettagliate sul perché e sul modo in cui i clienti acquistano può contribuire a far crescere le entrate. Il tasso di abbandono dei clienti è un problema affrontato da un'ampia gamma di aziende, dalle telecomunicazioni alle banche, in cui i clienti vengono generalmente persi a causa della concorrenza. È nell'interesse di un'azienda mantenere i clienti esistenti invece di acquisirne di nuovi, perché di solito costa molto di più attirare nuovi clienti. Quando cercano di fidelizzare i clienti, le aziende spesso concentrano i loro sforzi sui clienti che hanno maggiori probabilità di andarsene. Il comportamento degli utenti e i registri delle chat dell'assistenza clienti possono contenere indicatori preziosi sulla probabilità che un cliente termini il servizio. In questa soluzione, addestriamo e distribuiamo un modello di previsione del tasso di abbandono che utilizza un modello di elaborazione del linguaggio naturale (NLP) all'avanguardia per trovare segnali utili nel testo. Oltre agli input testuali, questo modello utilizza input di dati strutturati tradizionali come campi numerici e categorici.

La multimodalità è un campo di ricerca multidisciplinare che affronta alcuni degli obiettivi originali dell'intelligenza artificiale integrando e modellando modalità multiple. Questo post mira a costruire un modello in grado di elaborare e mettere in relazione le informazioni da più modalità come le caratteristiche tabulari e testuali.

Ti mostriamo come addestrare, distribuire e utilizzare un modello di previsione del tasso di abbandono che ha elaborato caratteristiche numeriche, categoriche e testuali per fare la sua previsione. Sebbene in questo post approfondiamo un caso d'uso di previsione del tasso di abbandono, puoi utilizzare questa soluzione come modello per generalizzare l'ottimizzazione dei modelli pre-addestrati con il tuo set di dati e successivamente eseguire l'ottimizzazione dell'iperparametro (HPO) per migliorare la precisione. Puoi persino sostituire il set di dati di esempio con il tuo ed eseguirlo end-to-end per risolvere i tuoi casi d'uso. La soluzione delineata nel post è disponibile su GitHub.

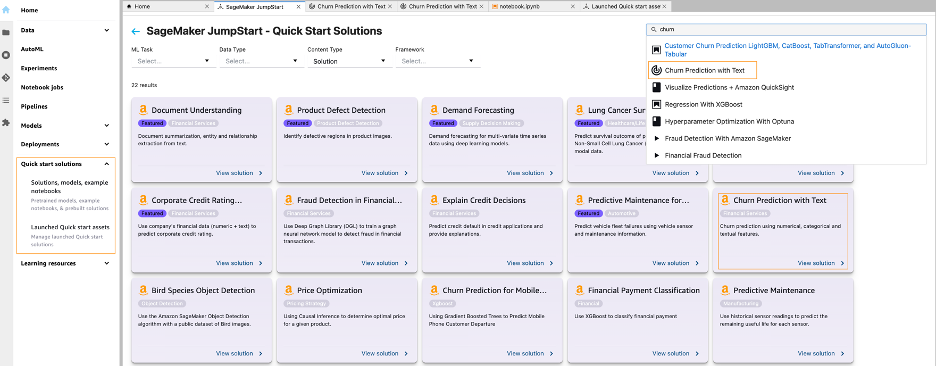

Modelli di soluzione JumpStart

JumpStart di Amazon SageMaker fornisce soluzioni end-to-end con un clic per molti casi d'uso comuni di ML. Esplora i seguenti casi d'uso per ulteriori informazioni sui modelli di soluzione disponibili:

I modelli di soluzione JumpStart coprono una varietà di casi d'uso, in ciascuno dei quali vengono offerti diversi modelli di soluzione (questa soluzione Document Understanding rientra nel caso d'uso "Estrai e analizza i dati dai documenti").

Scegli il modello di soluzione che meglio si adatta al tuo caso d'uso dalla pagina di destinazione di JumpStart. Per ulteriori informazioni su soluzioni specifiche in ogni caso d'uso e su come avviare una soluzione JumpStart, vedere Modelli di soluzione.

Panoramica della soluzione

La figura seguente mostra come utilizzare questa soluzione con Amazon Sage Maker componenti. I processi di formazione SageMaker vengono utilizzati per addestrare i vari modelli NLP e gli endpoint SageMaker vengono utilizzati per distribuire i modelli in ogni fase. Noi usiamo Servizio di archiviazione semplice Amazon (Amazon S3) insieme a SageMaker per archiviare i dati di addestramento e gli artefatti del modello e Amazon Cloud Watch per registrare l'addestramento e gli output dell'endpoint.

Ci avviciniamo alla risoluzione del problema di previsione del tasso di abbandono con i seguenti passaggi:

- Esplorazione dei dati per preparare i dati affinché siano pronti per il machine learning.

- Addestra un modello multimodale con a Trasformatore di frasi Hugging Face ed Classificatore di foresta casuale Scikit-learn.

- Migliorare ulteriormente le prestazioni del modello con l'utilizzo di HPO Ottimizzazione automatica del modello di SageMaker.

- Treno due Modelli multimodali AutoGluon: un modello di insieme pesato/impilato multimodale AutoGluon e un modello di fusione multimodale AutoGluon.

- Valutare e confrontare le prestazioni del modello sui dati del test di controllo.

Prerequisiti

Per provare il soluzione nel tuo account, assicurati di disporre di quanto segue:

- Un account AWS. Se non hai un account, puoi farlo iscriviti per uno.

- La soluzione delineata nel post fa parte di SageMaker JumpStart. Per eseguire questa soluzione JumpStart e fare in modo che l'infrastruttura venga distribuita al tuo account AWS, devi creare un file active Amazon Sage Maker Studio esempio (vedi Effettua l'onboarding in Amazon SageMaker Studio). Quando l'istanza di Studio è pronta, utilizza le istruzioni in JumpStart per avviare la soluzione.

- Quando si esegue questo taccuino su Studio, dovresti assicurarti che il file Python 3 (PyTorch 1.10 Python 3.8 ottimizzato per CPU) viene utilizzato image/kernel.

È possibile installare i pacchetti richiesti come indicato nella soluzione per eseguire questo notebook:

Apri il caso d'uso della previsione del tasso di abbandono

Nella console di Studio, scegli Soluzioni, modelli, notebook di esempio per Soluzioni di avvio rapido nel riquadro di navigazione. Naviga verso il Previsione del tasso di abbandono con testo soluzione in JumpStart.

Ora possiamo dare un'occhiata più da vicino ad alcune delle risorse incluse in questa soluzione.

Esplorazione dei dati

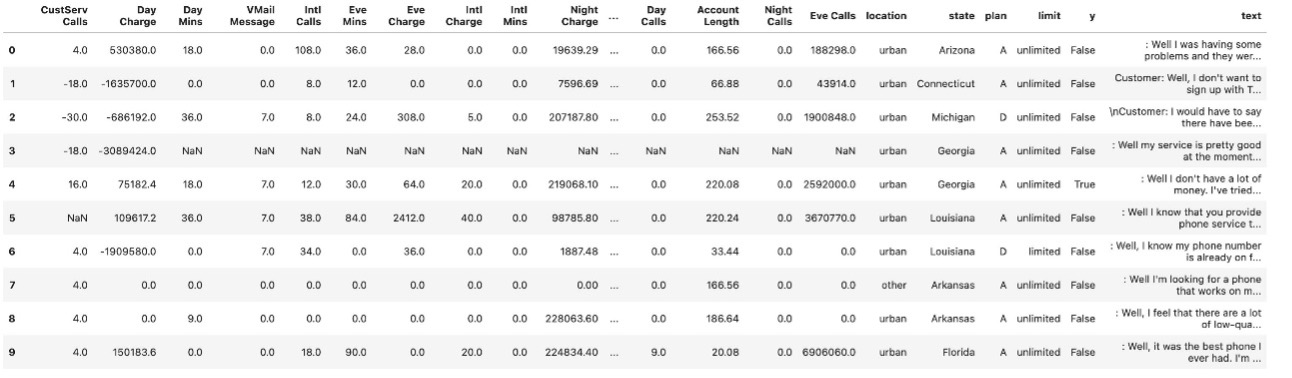

Per prima cosa scarichiamo il set di dati di test, convalida ed addestramento dal bucket S3 di origine e lo carichiamo nel nostro bucket S3. Lo screenshot seguente ci mostra 10 osservazioni dei dati di addestramento.

Iniziamo ad esplorare il set di dati di addestramento e convalida.

Come puoi vedere, abbiamo diverse funzionalità come CustServ Calls, Day Chargee Day Calls che usiamo per prevedere la colonna di destinazione y (se il cliente ha lasciato il servizio).

y è noto come il attributo di destinazione: l'attributo che vogliamo che il modello ML preveda. Poiché l'attributo di destinazione è binario, il nostro modello esegue la previsione binaria, nota anche come classificazione binaria.

Sono disponibili 21 funzioni, inclusa la variabile target. Il numero di esempi per i dati di addestramento e convalida è rispettivamente di 43,000 e 5,000.

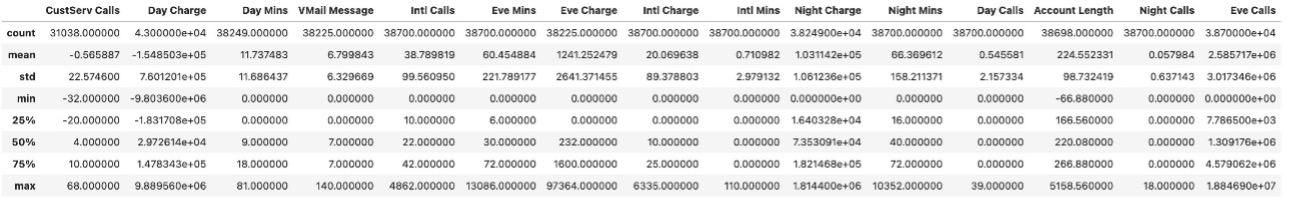

Lo screenshot seguente mostra le statistiche di riepilogo del set di dati di addestramento.

Abbiamo esplorato il set di dati e lo abbiamo suddiviso in set di addestramento, convalida e test. Il set di addestramento e convalida viene utilizzato per l'addestramento e l'HPO. Il set di test viene utilizzato come set di controllo per la valutazione delle prestazioni del modello. Ora eseguiamo le fasi di progettazione delle caratteristiche e quindi adattiamo il modello.

Adatta un modello multimodale con un trasformatore di frasi Hugging Face e un classificatore foresta casuale Scikit-learn

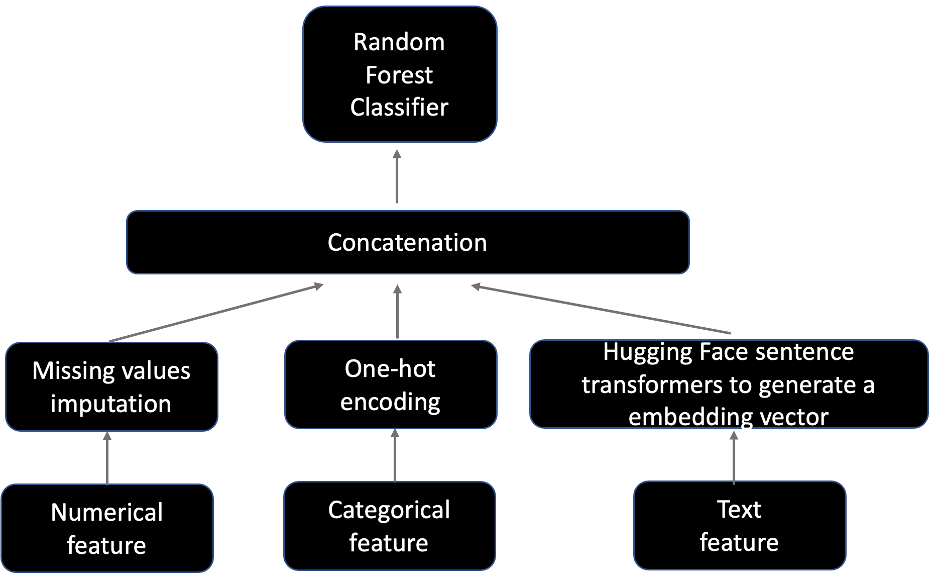

L'addestramento del modello è costituito da due componenti: una fase di progettazione delle funzionalità che elabora le funzionalità numeriche, categoriche e di testo e una fase di adattamento del modello che adatta le funzionalità trasformate in un Classificatore di foresta casuale Scikit-learn.

Per la progettazione delle funzionalità, completiamo i seguenti passaggi:

- Inserisci i valori mancanti per le caratteristiche numeriche.

- Codifica le funzionalità categoriche in valori one-hot, in cui i valori mancanti vengono conteggiati come una delle categorie per ciascuna funzionalità.

- Utilizzare Trasformatore di frasi Hugging Face per codificare la caratteristica del testo per generare un vettore denso X-dimensionale, dove il valore di X dipende da un particolare trasformatore di frase.

Scegliamo i primi tre modelli di trasformatori di frasi più scaricati e li usiamo nel seguente modello di adattamento e HPO. In particolare, usiamo tutto-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1e parafrasi-MiniLM-L6-v2. Per gli iperparametri del classificatore foresta casuale, fare riferimento a Repository GitHub.

La figura seguente illustra il diagramma dell'architettura del modello.

Esistono molti iperparametri che è possibile ottimizzare, ad esempio n-estimatori, profondità massima e bootstrap. Per maggiori dettagli, consultare il Repository GitHub.

A scopo dimostrativo, utilizziamo solo caratteristiche numeriche CustServ Calls ed Account Length, caratteristiche categoriche plane limite funzione di testo text per adattarsi al modello. Più funzioni devono essere separate da ,.

Distribuiamo il modello al termine dell'addestramento:

Quando chiamiamo il nostro nuovo endpoint dal notebook, utilizziamo un SDK SageMaker Predictor. UN Predictor viene utilizzato per inviare dati a un endpoint (come parte di una richiesta) e interpretare la risposta. JSON viene utilizzato come formato sia per i dati di input che per la risposta di output perché è un formato di endpoint standard e la risposta dell'endpoint può contenere strutture di dati nidificate.

Con il nostro modello distribuito correttamente e il nostro predittore configurato, possiamo provare il modello di previsione del tasso di abbandono su un input di esempio:

Il codice seguente mostra la risposta (probabilità di abbandono) dall'interrogazione dell'endpoint:

Si noti che la probabilità restituita da questo modello non è stata calibrata. Quando il modello fornisce una probabilità di abbandono del 20%, ad esempio, ciò non significa necessariamente che il 20% dei clienti con una probabilità del 20% abbia generato un abbandono. La calibrazione è una proprietà utile in determinate circostanze, ma non è richiesta nei casi in cui la discriminazione tra casi di abbandono e non abbandono è sufficiente. CalibratoClassificatoreCV da Scikit-learn può essere utilizzato per calibrare un modello.

Ora interroghiamo l'endpoint utilizzando i dati del test di controllo, che consiste in 1,939 esempi. La tabella seguente riassume i risultati della valutazione per il nostro modello multimodale con un trasformatore di frasi Hugging Face e un classificatore di foreste casuali Scikit-learn.

| Metrico | BERT + Foresta casuale |

| Precisione | 0.77463 |

| ROC UAC | 0.75905 |

Le prestazioni del modello dipendono dalle configurazioni degli iperparametri. Il training di un modello con un set di configurazioni di iperparametri non garantisce un modello ottimale. Di conseguenza, eseguiamo il processo HPO nella sezione seguente per migliorare ulteriormente le prestazioni del modello.

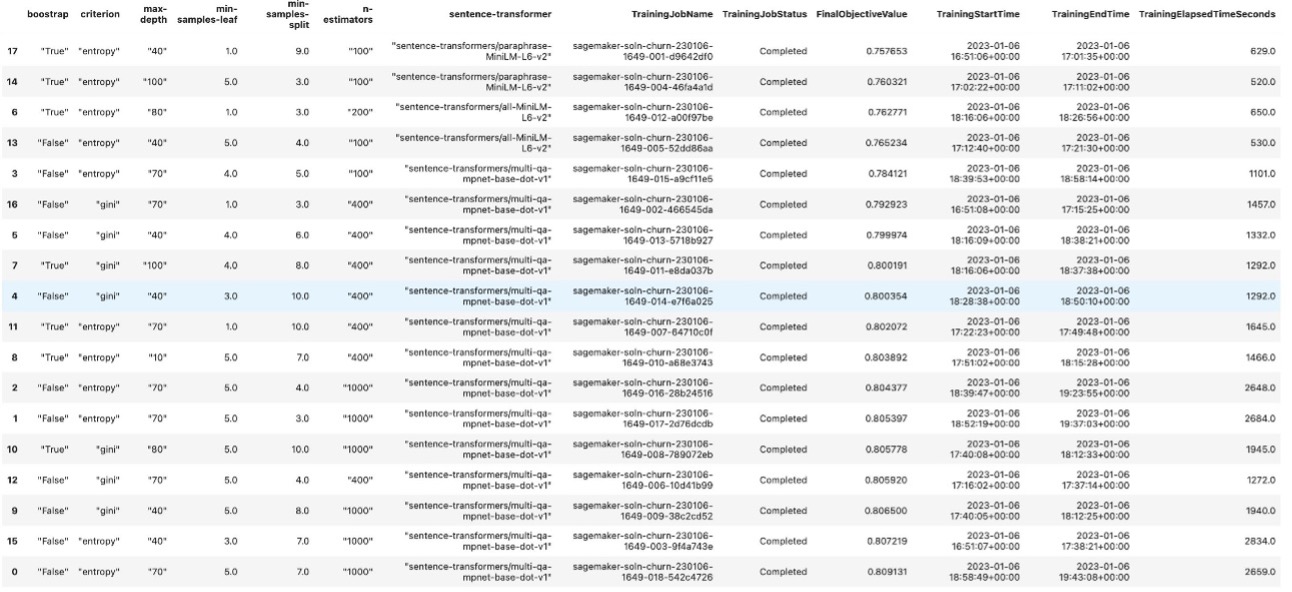

Montare un modello multimodale con HPO

In questa sezione, miglioriamo ulteriormente le prestazioni del modello aggiungendo l'ottimizzazione HPO con Ottimizzazione automatica del modello di SageMaker. L'ottimizzazione automatica del modello di SageMaker, nota anche come ottimizzazione dell'iperparametro, trova la versione migliore di un modello eseguendo molti processi di addestramento sul set di dati utilizzando l'algoritmo e gli intervalli di iperparametri specificati. Quindi sceglie i valori dell'iperparametro che risultano in un modello con le prestazioni migliori, misurate da una metrica scelta. Il modello migliore ei relativi iperparametri corrispondenti vengono selezionati sui dati di convalida. Successivamente, il modello migliore viene valutato sui dati del test di controllo, che sono gli stessi dati del test che abbiamo creato nella sezione precedente. Infine, mostriamo che le prestazioni del modello addestrato con HPO sono significativamente migliori di quelle addestrate senza HPO.

I seguenti sono iperparametri statici che non ottimizziamo e iperparametri dinamici che vogliamo ottimizzare e i relativi intervalli di ricerca:

Definiamo il nome della metrica dell'obiettivo, la definizione della metrica (con pattern regex) e il tipo di obiettivo per il lavoro di ottimizzazione.

Innanzitutto, impostiamo l'obiettivo come punteggio di accuratezza sui dati di convalida (roc auc score on validation data) e le metriche definite per il processo di ottimizzazione specificando il nome della metrica obiettivo e un'espressione regolare (regex). L'espressione regolare viene utilizzata per abbinare l'output del log dell'algoritmo e acquisire i valori numerici delle metriche.

Successivamente, specifichiamo gli intervalli di iperparametri da cui selezionare i migliori valori di iperparametri. Impostiamo il numero totale di lavori di ottimizzazione su 10 e distribuiamo questi lavori su cinque diversi Cloud di calcolo elastico di Amazon (Amazon EC2) per l'esecuzione di processi di ottimizzazione paralleli.

Infine, passiamo quei valori per creare un'istanza di un oggetto SageMaker Estimator, in modo simile a quanto fatto nella fase di addestramento precedente. Invece di chiamare la funzione di adattamento dell'oggetto Estimator, passiamo l'oggetto Estimator come parametro a Sintonizzatore iperparametri costruttore e chiamarne la funzione fit per avviare i lavori di ottimizzazione:

Quando il lavoro di ottimizzazione è completo, possiamo generare la tabella riassuntiva di tutti i lavori di ottimizzazione.

Dopo che i lavori di ottimizzazione sono stati completati, distribuiamo il modello che fornisce il miglior punteggio della metrica di valutazione sul set di dati di convalida, eseguiamo l'inferenza sullo stesso set di dati di test di hold-out che abbiamo fatto nella sezione precedente e calcoliamo le metriche di valutazione.

| Metrico | BERT + Foresta casuale | BERT + Foresta casuale con HPO |

| Precisione | 0.77463 | 0.9278 |

| ROC UAC | 0.75905 | 0.79861 |

Possiamo vedere che l'esecuzione di HPO con l'ottimizzazione automatica del modello SageMaker migliora significativamente le prestazioni del modello.

Oltre all'HPO, anche le prestazioni del modello dipendono dall'algoritmo. È importante addestrare più algoritmi all'avanguardia, confrontare le loro prestazioni sugli stessi dati di test di controllo e scegliere quello ottimale. Pertanto, addestriamo altri due modelli multimodali AutoGluon nelle sezioni seguenti.

Adatta un modello di insieme pesato/impilato multimodale AutoGluon

Esistono due tipi di multimodalità AutoGluon:

- Addestra più modelli tabulari e il

TextPredictormodello (utilizzando ilTextPredictormodello all'interno diTabularPredictor), e quindi combinarli tramite un insieme ponderato o un insieme sovrapposto, come spiegato in AutoGluon-Tabular: AutoML robusto e accurato per dati strutturati - Fondere più modelli di rete neurale direttamente e gestire il testo non elaborato (che è anche in grado di gestire ulteriori colonne numeriche e categoriche)

In questa sezione viene prima addestrato un modello di ensemble pesato o in pila multimodale e nella sezione successiva viene addestrato un modello di rete neurale di fusione.

Innanzitutto, recuperiamo l'immagine di addestramento di AutoGluon:

Successivamente, passiamo gli iperparametri. A differenza dei framework AutoML esistenti che si concentrano principalmente sulla selezione del modello o dell'iperparametro, AutoGluonTabular ha successo assemblando più modelli e impilandoli in più livelli. Pertanto, HPO di solito non è richiesto per i modelli di ensemble AutoGluon.

Infine, creiamo un Estimatore di SageMaker e chiama estimator.fit() per iniziare un lavoro di formazione:

Al termine dell'addestramento, recuperiamo l'immagine di inferenza AutoGluon e distribuiamo il modello:

Dopo aver distribuito gli endpoint, interroghiamo l'endpoint utilizzando lo stesso set di test e calcoliamo le metriche di valutazione. Nella tabella seguente, possiamo vedere che l'ensemble multimodale AutoGluon migliora di circa il 3% in ROC AUC rispetto al trasformatore di frasi BERT e alla foresta casuale con HPO.

| Metrico | BERT + Foresta casuale | BERT + Foresta casuale con HPO | Complesso multimodale AutoGluon |

| Precisione | 0.77463 | 0.9278 | 0.92625 |

| ROC UAC | 0.75905 | 0.79861 | 0.82918 |

Montare un modello di fusione multimodale AutoGluon

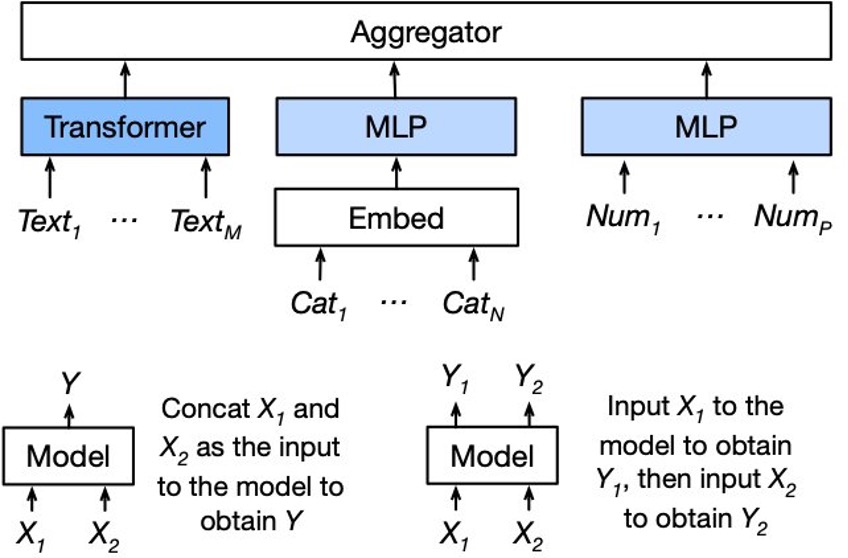

Il diagramma seguente illustra l'architettura del modello. Per i dettagli, vedere AutoMM per testo + tabulare: avvio rapido.

Internamente, utilizziamo reti diverse per codificare le colonne di testo, le colonne categoriche e le colonne numeriche. Le caratteristiche generate dalle singole reti sono aggregate da un aggregatore di fusione tardiva. L'aggregatore può emettere sia i logit che le previsioni del punteggio.

Qui, utilizziamo la spina dorsale della PNL preaddestrata per estrarre le caratteristiche del testo e quindi utilizziamo altre due torri per estrarre la caratteristica dalla colonna categorica e dalla colonna numerica.

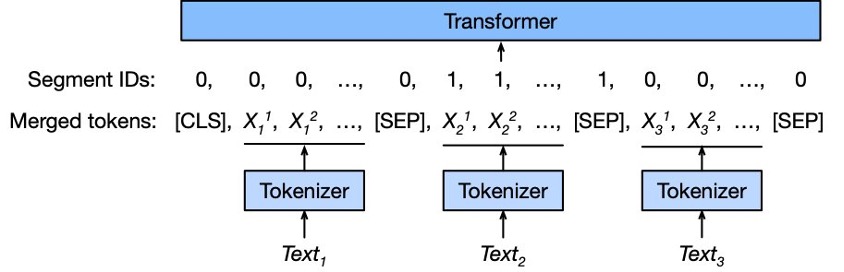

Inoltre, per gestire più campi di testo, separiamo questi campi con il token [SEP] e alterniamo 0 e 1 come ID segmento, come mostrato nel diagramma seguente.

Allo stesso modo, seguiamo le istruzioni nella sezione precedente per addestrare e distribuire il modello di fusione multimodale AutoGluon:

La tabella seguente riassume i risultati della valutazione per il modello di fusione multimodale AutoGluon, insieme a quelli di tre modelli che abbiamo valutato nelle sezioni precedenti. Possiamo vedere l'ensemble multimodale AutoGluon e i modelli di fusione multimodale ottenere le migliori prestazioni.

| Metrica | BERT + Foresta casuale | BERT + Foresta casuale con HPO | Complesso multimodale AutoGluon | Fusione multimodale AutoGluon |

| Precisione | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC UAC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Si noti che i risultati e le prestazioni relative tra questi modelli dipendono dal set di dati utilizzato per l'addestramento. Questi risultati sono rappresentativi e anche se la tendenza di alcuni algoritmi a funzionare meglio è basata su fattori rilevanti, l'equilibrio delle prestazioni potrebbe cambiare data una diversa distribuzione dei dati. Puoi sostituire il set di dati di esempio con i tuoi dati per determinare quale modello funziona meglio per te.

Quaderno dimostrativo

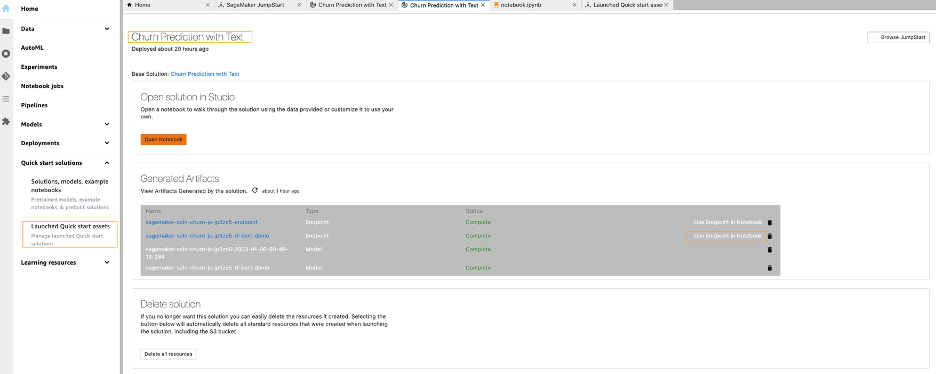

Puoi utilizzare il notebook demo per inviare dati di esempio agli endpoint del modello già distribuiti. Il taccuino dimostrativo ti consente di acquisire rapidamente esperienza pratica eseguendo query sui dati di esempio. Dopo aver avviato la soluzione Churn Prediction with Text, apri il taccuino dimostrativo scegliendo Usa l'endpoint nel blocco appunti.

ripulire

Quando hai finito con questa soluzione, assicurati di eliminare tutte le risorse AWS indesiderate scegliendo Elimina tutte le risorse.

Tieni presente che devi eliminare manualmente eventuali risorse aggiuntive che potresti aver creato in questo notebook.

Conclusione

In questo post, abbiamo mostrato come utilizzare Sagemaker JumpStart per prevedere il tasso di abbandono utilizzando la multimodalità del testo e le funzioni tabulari.

Se sei interessato a saperne di più sui modelli di abbandono dei clienti, dai un'occhiata ai seguenti post:

Informazioni sugli autori

Dott. Xin Huang è uno scienziato applicato per gli algoritmi integrati Amazon SageMaker JumpStart e Amazon SageMaker. Si concentra sullo sviluppo di algoritmi di apprendimento automatico scalabili. I suoi interessi di ricerca sono nell'area dell'elaborazione del linguaggio naturale, del deep learning spiegabile su dati tabulari e dell'analisi robusta del clustering spazio-temporale non parametrico. Ha pubblicato molti articoli su ACL, ICDM, conferenze KDD e Royal Statistical Society: rivista di serie A.

Dott. Xin Huang è uno scienziato applicato per gli algoritmi integrati Amazon SageMaker JumpStart e Amazon SageMaker. Si concentra sullo sviluppo di algoritmi di apprendimento automatico scalabili. I suoi interessi di ricerca sono nell'area dell'elaborazione del linguaggio naturale, del deep learning spiegabile su dati tabulari e dell'analisi robusta del clustering spazio-temporale non parametrico. Ha pubblicato molti articoli su ACL, ICDM, conferenze KDD e Royal Statistical Society: rivista di serie A.

Rajakumar Sampathkumar è un Principal Technical Account Manager presso AWS, che fornisce ai clienti una guida sull'allineamento della tecnologia aziendale e supporta la reinvenzione dei loro modelli e processi operativi cloud. È appassionato di cloud e machine learning. Raj è anche uno specialista dell'apprendimento automatico e collabora con i clienti AWS per progettare, distribuire e gestire i carichi di lavoro e le architetture AWS.

Rajakumar Sampathkumar è un Principal Technical Account Manager presso AWS, che fornisce ai clienti una guida sull'allineamento della tecnologia aziendale e supporta la reinvenzione dei loro modelli e processi operativi cloud. È appassionato di cloud e machine learning. Raj è anche uno specialista dell'apprendimento automatico e collabora con i clienti AWS per progettare, distribuire e gestire i carichi di lavoro e le architetture AWS.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- WRI

- Il mio account

- precisione

- preciso

- Raggiungere

- l'acquisizione di

- attivo

- aggiunta

- aggiuntivo

- indirizzi

- Dopo shavasana, sedersi in silenzio; saluti;

- Agente

- Aggregator

- mira

- algoritmo

- Algoritmi

- Tutti

- consente

- a fianco di

- Sebbene il

- Amazon

- Amazon EC2

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- .

- analizzare

- ed

- applicato

- approccio

- architettura

- RISERVATA

- artificiale

- intelligenza artificiale

- Attività

- Automatico

- AutoML

- disponibile

- AWS

- Spina dorsale

- Equilibrio

- Settore bancario

- basato

- perché

- MIGLIORE

- Meglio

- fra

- bootstrap

- costruire

- incassato

- affari

- Acquistare

- chiamata

- chiamata

- Bandi

- capace

- catturare

- trasportare

- Custodie

- casi

- categoria

- certo

- possibilità

- il cambiamento

- dai un'occhiata

- Scegli

- la scelta

- condizioni

- classificazione

- più vicino

- Cloud

- il clustering

- codice

- Colonna

- colonne

- combinare

- Uncommon

- Aziende

- Società

- confrontare

- rispetto

- concorrenti

- completamento di una

- componenti

- Calcolare

- conferenze

- consolle

- Contenitore

- contratto

- contratti

- Corrispondente

- Costi

- coprire

- creare

- creato

- cliente

- comportamento del cliente

- Servizio clienti

- Assistenza clienti

- Clienti

- dati

- affare

- trattare

- deciso

- deep

- apprendimento profondo

- dipendente

- dipende

- schierare

- schierato

- Design

- dettagli

- Determinare

- in via di sviluppo

- DID

- diverso

- direttamente

- distribuire

- distribuzione

- docker

- documento

- non

- Dont

- scaricare

- dinamico

- ogni

- sforzi

- o

- da un capo all'altro

- endpoint

- Ingegneria

- valutato

- valutazione

- Anche

- esempio

- Esempi

- esistente

- esperienza

- ha spiegato

- esplorazione

- esplora

- Esplorazione

- Esplorare

- estratto

- estremamente

- Faccia

- di fronte

- Fattori

- caratteristica

- Caratteristiche

- campo

- campi

- figura

- Infine

- Trovate

- trova

- Nome

- in forma

- adatto

- Focus

- si concentra

- seguire

- i seguenti

- foresta

- formato

- quadri

- da

- function

- ulteriormente

- fusione

- guadagnando

- generare

- generato

- ottenere

- dato

- dà

- gluone

- Obiettivi

- buono

- Crescere

- di garanzia

- maniglia

- Manovrabilità

- mani su

- Aiuto

- utile

- Come

- Tutorial

- HTML

- HTTPS

- Hub

- Ottimizzazione dell'iperparametro

- Sintonia iperparametro

- identificare

- Immagine

- importare

- importante

- competenze

- in

- incluso

- Compreso

- Aumento

- individuale

- informazioni

- Infrastruttura

- ingresso

- intuizioni

- install

- esempio

- invece

- istruzioni

- Integrazione

- Intelligence

- interesse

- interessato

- interessi

- coinvolto

- sicurezza

- IT

- Lavoro

- Offerte di lavoro

- rivista

- json

- Le

- Genere

- conosciuto

- atterraggio

- Lingua

- lanciare

- galline ovaiole

- apprendimento

- Lasciare

- Lunghezza

- probabile

- LIMITE

- linea

- Lunghi

- Guarda

- macchina

- machine learning

- make

- gestire

- direttore

- manualmente

- molti

- partita

- Massimizzare

- massimo

- metrico

- Metrica

- forza

- mente

- mancante

- ML

- modello

- modelli

- Mese

- mese

- Scopri di più

- maggior parte

- multidisciplinare

- multiplo

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Navigare

- Navigazione

- necessariamente

- Bisogno

- Rete

- reti

- rete neurale

- New

- GENERAZIONE

- nlp

- taccuino

- numero

- oggetto

- obiettivo

- offerto

- ONE

- aprire

- operazione

- ottimale

- ottimizzazione

- ottimizzati

- i

- Altro

- delineato

- proprio

- Packages

- vetro

- documenti

- Parallel

- parametro

- parte

- particolare

- appassionato

- Cartamodello

- Eseguire

- performance

- prestazioni

- esegue

- telefono

- scegliere

- posto

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- Post

- Post

- predire

- predizione

- Previsioni

- Predictor

- Preparare

- precedente

- principalmente

- Direttore

- Problema

- processi

- Elaborato

- i processi

- lavorazione

- proprietà

- fornisce

- fornitura

- pubblicamente

- pubblicato

- fini

- Python

- pytorch

- Presto

- rapidamente

- casuale

- gamma

- Crudo

- RE

- pronto

- regex

- Basic

- pertinente

- sostituire

- rappresentante

- richiesta

- necessario

- riparazioni

- Risorse

- risposta

- di risposta

- colpevole

- Risultati

- Le vendite

- robusto

- reale

- Correre

- running

- sagemaker

- Sintonizzazione automatica del modello SageMaker

- stesso

- scalabile

- Scienziato

- scikit-impara

- sdk

- Cerca

- ricerca

- Sezione

- sezioni

- segmento

- selezionato

- prodotti

- condanna

- Serie

- Serie A

- servizio

- set

- Set

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- Segnali

- significativamente

- simile

- Un'espansione

- So

- Società

- soluzione

- Soluzioni

- RISOLVERE

- Soluzione

- alcuni

- Fonte

- specialista

- specifico

- in particolare

- dividere

- Sprint

- impilato

- impilamento

- Stage

- Standard

- inizia a

- iniziato

- state-of-the-art

- statistiche

- statistica

- step

- Passi

- conservazione

- Tornare al suo account

- strutturato

- studio

- Successivamente

- Con successo

- tale

- sufficiente

- SOMMARIO

- supporto

- Supporto

- tavolo

- Fai

- Target

- Tech

- Consulenza

- telecomunicazioni

- modello

- modelli

- condizioni

- test

- Il

- L'area

- L’ORIGINE

- loro

- perciò

- tre

- a

- oggi

- token

- top

- Totale

- tradizionale

- Treni

- allenato

- Training

- trasformato

- vero

- Tipi di

- tipicamente

- per

- e una comprensione reciproca

- illimitato

- non desiderato

- upgrade

- us

- uso

- caso d'uso

- Utente

- generalmente

- Utilizzando

- CONVALIDARE

- convalida

- Prezioso

- APPREZZIAMO

- Valori

- varietà

- vario

- Ve

- Verizon

- versione

- via

- Che

- se

- quale

- OMS

- largo

- Vasta gamma

- volere

- senza

- Lavora

- lavori

- sarebbe

- Wrong

- X

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro