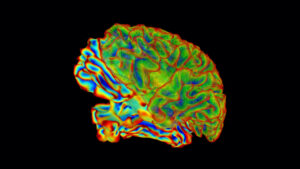

Il linguaggio e la parola sono il modo in cui esprimiamo i nostri pensieri interiori. Ma i neuroscienziati hanno appena aggirato la necessità di un discorso udibile, almeno in laboratorio. Invece, hanno attinto direttamente alla macchina biologica che genera linguaggio e idee: il cervello.

Utilizzando scansioni cerebrali e una forte dose di apprendimento automatico, un team dell'Università del Texas ad Austin ha sviluppato un "decodificatore del linguaggio" che cattura l'essenza di ciò che una persona sente basandosi solo sui modelli di attivazione cerebrale. Lungi dall'essere un pony one-trick, il decodificatore può anche tradurre discorsi immaginari e persino generare sottotitoli descrittivi per film muti utilizzando l'attività neurale.

Ecco il kicker: il metodo non richiede un intervento chirurgico. Piuttosto che fare affidamento su elettrodi impiantati, che ascoltano scoppi elettrici direttamente dai neuroni, la neurotecnologia utilizza la risonanza magnetica funzionale (fMRI), una procedura completamente non invasiva, per generare mappe cerebrali che corrispondono al linguaggio.

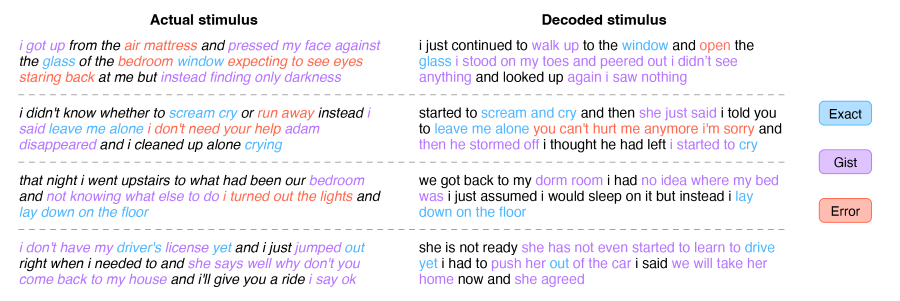

Per essere chiari, la tecnologia non legge la mente. In ogni caso, il decodificatore produce parafrasi che catturano l'idea generale di una frase o di un paragrafo. Non riproduce ogni singola parola. Eppure questo è anche il potere del decoder.

"Pensiamo che il decodificatore rappresenti qualcosa di più profondo delle lingue", ha affermato l'autore principale dello studio, il dott. Alexander Huth, in una conferenza stampa. "Possiamo recuperare l'idea generale... e vedere come si evolve l'idea, anche se le parole esatte si perdono."

Lo studio, pubblicato questa settimana in Nature Neuroscience, rappresenta una potente prima spinta verso la non invasività interfacce cervello-macchina per decodificare il linguaggio, un problema notoriamente difficile. Con un ulteriore sviluppo, la tecnologia potrebbe aiutare coloro che hanno perso la capacità di parlare a ritrovare la capacità di comunicare con il mondo esterno.

Il lavoro apre anche nuove strade per apprendere come il linguaggio è codificato nel cervello e per gli scienziati di intelligenza artificiale per scavare nella "scatola nera" dei modelli di apprendimento automatico che elaborano la parola e il linguaggio.

"Ci è voluto molto tempo... siamo rimasti piuttosto scioccati dal fatto che abbia funzionato così bene", ha detto Huth.

Lingua decodifica

La traduzione dell'attività cerebrale in parole non è una novità. Uno studio precedente elettrodi usati posizionati direttamente nel cervello di pazienti con paralisi. Ascoltando le vibrazioni elettriche dei neuroni, il team è stato in grado di ricostruire le parole complete del paziente.

Huth ha deciso di prendere una strada alternativa, anche se audace. Invece di affidarsi alla neurochirurgia, ha optato per un approccio non invasivo: fMRI.

"L'aspettativa tra i neuroscienziati in generale che tu possa fare questo genere di cose con la fMRI è piuttosto bassa", ha detto Huth.

Ci sono molte ragioni. A differenza degli impianti che attingono direttamente all'attività neurale, la fMRI misura come cambiano i livelli di ossigeno nel sangue. Questo è chiamato il segnale BOLD. Poiché regioni cerebrali più attive richiedono più ossigeno, le risposte BOLD fungono da proxy affidabile per l'attività neurale. Ma viene fornito con problemi. I segnali sono lenti rispetto alla misurazione di burst elettrici e i segnali possono essere rumorosi.

Eppure la fMRI ha un enorme vantaggio rispetto agli impianti cerebrali: può monitorare l'intero cervello ad alta risoluzione. Rispetto alla raccolta di dati da una pepita in una regione, fornisce una visione a volo d'uccello delle funzioni cognitive di livello superiore, incluso il linguaggio.

Con la decodifica del linguaggio, la maggior parte degli studi precedenti ha attinto alla corteccia motoria, un'area che controlla il modo in cui la bocca e la laringe si muovono per generare il parlato, o più "livello superficiale" nell'elaborazione del linguaggio per l'articolazione. Il team di Huth ha deciso di salire di un'astrazione: nel regno dei pensieri e delle idee.

Nello sconosciuto

Il team ha capito di aver bisogno di due cose fin dall'inizio. Uno, un set di dati di scansioni cerebrali di alta qualità per addestrare il decodificatore. Due, un framework di apprendimento automatico per elaborare i dati.

Per generare il database della mappa del cervello, sette volontari hanno scansionato ripetutamente il loro cervello mentre ascoltavano le storie dei podcast mentre la loro attività neurale veniva misurata all'interno di una macchina per la risonanza magnetica. Sdraiarsi all'interno di un magnete gigante e rumoroso non è divertente per nessuno, e il team si è preso cura di mantenere i volontari interessati e vigili, dal momento che i fattori di attenzione nella decodifica.

Per ogni persona, l'enorme set di dati risultante è stato inserito in un framework basato sull'apprendimento automatico. Grazie alla recente esplosione dei modelli di apprendimento automatico che aiutano a elaborare il linguaggio naturale, il team è stato in grado di sfruttare tali risorse e costruire prontamente il decodificatore.

Ha più componenti. Il primo è un modello di codifica che utilizza il GPT originale, il predecessore del popolarissimo ChatGPT. Il modello prende ogni parola e prevede come risponderà il cervello. Qui, il team ha messo a punto GPT utilizzando oltre 200 milioni di parole totali dai commenti e dai podcast di Reddit.

Questa seconda parte utilizza una tecnica popolare nell'apprendimento automatico chiamata decodifica bayesiana. L'algoritmo indovina la parola successiva sulla base di una sequenza precedente e utilizza la parola indovinata per verificare l'effettiva risposta del cervello.

Ad esempio, un episodio di un podcast aveva come trama "mio padre non ne ha bisogno...". Quando è stato immesso nel decodificatore come prompt, è arrivato con potenziali risposte: "molto", "giusto", "da allora" e così via. Il confronto dell'attività cerebrale prevista con ogni parola con quella generata dalla parola effettiva ha aiutato il decodificatore a perfezionare i modelli di attività cerebrale di ogni persona e correggere gli errori.

Dopo aver ripetuto il processo con le parole meglio previste, l'aspetto di decodifica del programma ha infine appreso l'"impronta digitale neurale" unica di ogni persona per il modo in cui elabora il linguaggio.

Un neuro traduttore

Come prova del concetto, il team ha confrontato le risposte decodificate con il testo della storia reale.

È arrivato sorprendentemente vicino, ma solo per l'essenza generale. Ad esempio, una trama, "iniziamo a scambiarci storie sulle nostre vite, veniamo entrambi dal nord", è stata decodificata come "abbiamo iniziato a parlare delle nostre esperienze nell'area in cui è nato, io ero del nord".

Questa parafrasi è prevista, ha spiegato Huth. Poiché la fMRI è piuttosto rumorosa e lenta, è quasi impossibile catturare e decodificare ogni parola. Il decodificatore è alimentato da un miscuglio di parole e ha bisogno di districare i loro significati usando caratteristiche come i giri di parole.

Al contrario, le idee sono più permanenti e cambiano relativamente lentamente. Poiché la fMRI ha un ritardo nella misurazione dell'attività neurale, cattura concetti e pensieri astratti meglio di parole specifiche.

Questo approccio di alto livello ha dei vantaggi. Pur mancando di fedeltà, il decodificatore acquisisce un livello più elevato di rappresentazione linguistica rispetto ai tentativi precedenti, anche per attività non limitate al solo discorso. In un test, i volontari hanno guardato una clip animata di una ragazza attaccata dai draghi senza alcun suono. Usando solo l'attività cerebrale, il decodificatore ha descritto la scena dal punto di vista del protagonista come una storia basata su testo. In altre parole, il decodificatore è stato in grado di tradurre le informazioni visive direttamente in una narrazione basata su una rappresentazione del linguaggio codificata nell'attività cerebrale.

Allo stesso modo, il decoder ha anche ricostruito storie immaginate di un minuto dai volontari.

Dopo oltre un decennio di lavoro sulla tecnologia, "è stato scioccante ed emozionante quando finalmente ha funzionato", ha affermato Huth.

Anche se il decodificatore non legge esattamente le menti, il team è stato attento a valutare la privacy mentale. In una serie di test, hanno scoperto che il decoder funzionava solo con la partecipazione mentale attiva dei volontari. Chiedere ai partecipanti di contare fino a sette, nominare diversi animali o costruire mentalmente le proprie storie ha rapidamente degradato il decodificatore, ha affermato il primo autore Jerry Tang. In altre parole, al decodificatore si può "consapevolmente resistere".

Per ora, la tecnologia funziona solo dopo mesi di attente scansioni cerebrali in una macchina che ronza rumorosamente mentre giace completamente immobile, difficilmente fattibile per l'uso clinico. Il team sta lavorando per tradurre la tecnologia in fNIRS (spettroscopia funzionale nel vicino infrarosso), che misura i livelli di ossigeno nel sangue nel cervello. Sebbene abbia una risoluzione inferiore rispetto a fMRI, fNIRS è molto più portatile in quanto l'hardware principale è un dispositivo simile a una cuffia da nuoto che si adatta facilmente sotto una felpa con cappuccio.

"Con le modifiche, dovremmo essere in grado di tradurre l'attuale configurazione in fNIRS all'ingrosso", ha affermato Huth.

Il team sta inoltre pianificando di utilizzare modelli linguistici più recenti per aumentare la precisione del decodificatore e potenzialmente collegare lingue diverse. Poiché le lingue hanno una rappresentazione neurale condivisa nel cervello, il decodificatore potrebbe in teoria codificare una lingua e utilizzare i segnali neurali per decodificarla in un'altra.

È una "eccitante direzione futura", ha detto Huth.

Immagine di credito: Jerry Tang/Martha Morales/Università del Texas ad Austin

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Fonte: https://singularityhub.com/2023/05/02/this-brain-activity-decoder-translates-ideas-into-text-using-only-scans/

- :ha

- :È

- :non

- $ SU

- 200

- a

- capacità

- capace

- WRI

- ABSTRACT

- astrazione

- precisione

- Legge

- Attivazione

- attivo

- attività

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AI

- Mettere in guardia

- Alexander

- algoritmo

- da solo

- anche

- alternativa

- Sebbene il

- tra

- an

- ed

- animali

- Un altro

- in qualsiasi

- chiunque

- approccio

- SONO

- RISERVATA

- AS

- aspetto

- At

- Tentativi

- attenzione

- austin

- autore

- basato

- bayesiano

- BE

- perché

- essendo

- MIGLIORE

- Meglio

- sangue

- perno

- Incremento

- Dezen Dezen

- entrambi

- Cervello

- Attività cerebrale

- BRIDGE

- briefing

- costruire

- ma

- by

- detto

- è venuto

- Materiale

- catturare

- cattura

- che

- attento

- Custodie

- il cambiamento

- ChatGPT

- dai un'occhiata

- pulire campo

- Info su

- Chiudi

- conoscitivo

- viene

- Commenti

- comunicare

- rispetto

- confronto

- completamente

- componenti

- concetto

- concetti

- costruire

- contrasto

- controlli

- correggere

- potuto

- credito

- Corrente

- Papà

- dati

- Banca Dati

- decennio

- deciso

- Decodifica

- più profondo

- descritta

- sviluppato

- Mercato

- dispositivo

- DID

- diverso

- difficile

- DIG

- direzione

- direttamente

- do

- effettua

- non

- ogni

- facilmente

- Intero

- episodio

- Anche

- alla fine

- Ogni

- si evolve

- di preciso

- esempio

- coinvolgenti

- aspettativa

- previsto

- Esperienze

- ha spiegato

- esplosione

- esprimere

- Fattori

- lontano

- fattibile

- Caratteristiche

- Federale

- fedeltà

- Infine

- Nome

- Nel

- essere trovato

- Contesto

- da

- pieno

- ti divertirai

- funzionale

- ulteriormente

- ulteriori sviluppi

- futuro

- raccolta

- Generale

- generare

- generato

- genera

- ottenere

- gigante

- Bambina

- Go

- indovinato

- ha avuto

- Hardware

- cintura da arrampicata

- Avere

- avendo

- he

- Aiuto

- aiutato

- qui

- Alta

- alto livello

- alta qualità

- superiore

- Come

- HTTPS

- i

- idea

- idee

- if

- Imaging

- impossibile

- in

- In altre

- Compreso

- informazioni

- invece

- interessato

- ai miglioramenti

- IT

- ad appena

- mantenere

- Genere

- laboratorio

- Lingua

- Le Lingue

- portare

- imparato

- apprendimento

- meno

- Livello

- livelli

- piace

- Limitato

- linea

- Ascolto

- Lives

- Lunghi

- a lungo

- perso

- Basso

- inferiore

- macchina

- machine learning

- Principale

- carta geografica

- Maps

- massiccio

- massicciamente

- max-width

- significati

- analisi

- di misura

- mentale

- metodo

- milione

- mente

- menti

- errori

- modello

- modelli

- Monitorare

- mese

- Scopri di più

- maggior parte

- Il motore

- bocca

- cambiano

- Film

- MRI

- multiplo

- Nome

- NARRATIVA

- Naturale

- Natura

- quasi

- Bisogno

- di applicazione

- esigenze

- neuroni

- chirurgia neuro

- New

- GENERAZIONE

- Nord

- adesso

- of

- on

- ONE

- esclusivamente

- inizio

- apre

- or

- minimo

- i

- Altro

- nostro

- al di fuori

- ancora

- complessivo

- proprio

- Oxygen

- parte

- partecipanti

- partecipazione

- paziente

- pazienti

- modelli

- vantaggi

- permanente

- persona

- prospettiva

- snocciolate

- pianificazione

- Platone

- Platone Data Intelligence

- PlatoneDati

- Abbondanza

- Podcast

- Podcast

- Popolare

- potenziale

- potenzialmente

- energia

- alimentato

- potente

- predecessore

- previsto

- predice

- stampa

- piuttosto

- precedente

- Privacy

- Problema

- problemi

- processi

- lavorazione

- Programma

- prova

- prova del concetto

- fornisce

- delega

- pubblicato

- Spingi

- rapidamente

- piuttosto

- Leggi

- Lettura

- realizzato

- regno

- motivi

- recente

- Recuperare

- riguadagnare

- regione

- regioni

- relativamente

- affidabile

- RIPETUTAMENTE

- rappresentazione

- rappresenta

- richiedere

- Risoluzione

- risonanza

- Risorse

- Rispondere

- risposta

- risposte

- strada

- Suddetto

- scena

- scienziati

- Secondo

- vedere

- condanna

- Sequenza

- Serie

- flessibile.

- Sette

- condiviso

- scioccato

- dovrebbero

- Signal

- Segnali

- da

- singolo

- Lentamente

- lento

- So

- qualcosa

- Suono

- parlare

- specifico

- Spettroscopia

- discorso

- inizia a

- iniziato

- stimolo

- Storie

- Storia

- studi

- Studio

- sottotitoli

- Chirurgia

- Fai

- prende

- parlando

- Rubinetto

- Filettato

- task

- team

- Tecnologia

- test

- test

- Texas

- di

- Grazie

- che

- Il

- L'area

- loro

- di

- cosa

- cose

- think

- questo

- questa settimana

- quelli

- tempo

- a

- ha preso

- Totale

- commercio

- Treni

- tradurre

- seconda

- per

- unico

- Università

- a differenza di

- uso

- utilizzato

- utilizzando

- Visualizza

- volontari

- vs

- Prima

- Seguiti

- we

- settimana

- WELL

- sono stati

- Che

- quando

- quale

- while

- OMS

- vendita all'ingrosso

- volere

- con

- senza

- Word

- parole

- Lavora

- lavorato

- lavoro

- lavori

- mondo

- ancora

- Tu

- zefiro