- 30 Giugno 2014

- Vasilis Vryniotis

- . Non ci sono commenti

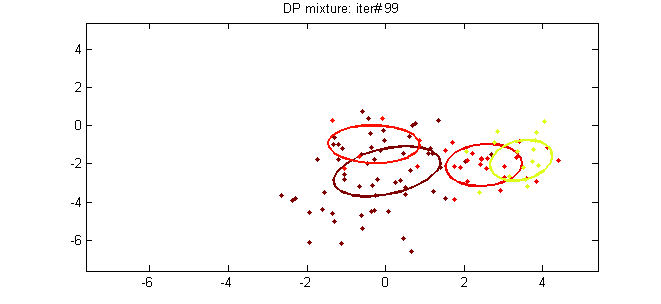

Questo articolo è la quinta parte del tutorial su Clustering con DPMM. Nei post precedenti abbiamo trattato in dettaglio lo sfondo teorico del metodo e abbiamo descritto il suo modulo di rappresentazione matematica e i modi per costruirlo. In questo post cercheremo di collegare la teoria con la pratica introducendo due modelli DPMM: il modello di miscela normale multivariata di Dirichlet che può essere utilizzato per raggruppare i dati gaussiani e il modello di miscela multichomiale di Dirichlet che viene utilizzato per raggruppare i documenti.

Aggiornamento: Datumbox Machine Learning Framework è ora open-source e gratuito scaricare. Dai un'occhiata al pacchetto com.datumbox.framework.machinelearning.clustering per vedere l'implementazione dei modelli di miscela di processo di Dirichlet in Java.

1. Il modello di miscela normale multivariata di Dirichlet

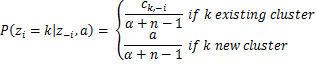

Il primo modello di miscela del processo Dirichlet che esamineremo è il modello di miscela normale multivariata di Dirichlet che può essere utilizzato per eseguire il clustering su set di dati continui. Il modello di miscela è definito come segue:

![]()

![]()

![]()

Equazione 1: Modello di miscela normale multivariata di Dirichlet

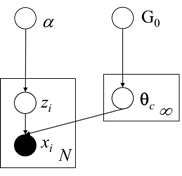

Come possiamo vedere sopra, il modello particolare presuppone che la distribuzione generativa sia la distribuzione gaussiana multinomiale e utilizza il processo di ristorante cinese come precedente per le assegnazioni di cluster. Inoltre per la distribuzione Base G0 utilizza il normale Wishart normale-inverso che è coniugato precedente di distribuzione normale multivariata con matrice di covarianza e media sconosciuta. Di seguito presentiamo il modello grafico del modello di miscela:

Figura 1: Modello grafico del modello a miscela normale multivariata di Dirichlet

Come discusso in precedenza, per poter stimare le assegnazioni dei cluster, utilizzeremo il file Campionamento Gibbs compresso che richiede la selezione di priori coniugati appropriati. Inoltre avremo bisogno di aggiornare i parametri posteriori indicati il priore e l'evidenza. Di seguito vediamo il Stime MAP dei parametri per uno dei cluster:

![]()

![]()

![]()

![]()

![]()

Equazione 2: stime MAP sui parametri del cluster

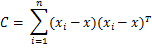

Dove d è la dimensionalità dei nostri dati e ![]() è la media del campione. Inoltre abbiamo diversi iperparametri del Wishart normale-inverso come il μ0 che è la media iniziale, κ0 è la frazione media che funziona come parametro di livellamento, ν0 è il grado di libertà impostato sul numero di dimensioni e Ψ0 è il prodotto di deviazione a coppie impostato sulla matrice identità dxd moltiplicata per una costante. Da ora in poi tutti i precedenti iperparametri di G0 sarà indicato da λ per semplificare la notazione. Infine, avendo tutto quanto sopra, possiamo stimare le probabilità richieste dal campionatore Gibbs compresso. La probabilità dell'osservazione i di appartenere al cluster k dati i compiti del cluster, il set di dati e tutti gli iperparametri α e λ di DP e G0 è riportato di seguito:

è la media del campione. Inoltre abbiamo diversi iperparametri del Wishart normale-inverso come il μ0 che è la media iniziale, κ0 è la frazione media che funziona come parametro di livellamento, ν0 è il grado di libertà impostato sul numero di dimensioni e Ψ0 è il prodotto di deviazione a coppie impostato sulla matrice identità dxd moltiplicata per una costante. Da ora in poi tutti i precedenti iperparametri di G0 sarà indicato da λ per semplificare la notazione. Infine, avendo tutto quanto sopra, possiamo stimare le probabilità richieste dal campionatore Gibbs compresso. La probabilità dell'osservazione i di appartenere al cluster k dati i compiti del cluster, il set di dati e tutti gli iperparametri α e λ di DP e G0 è riportato di seguito:

![]()

![]()

Equazione 3: Probabilità utilizzate da Gibbs Sampler per MNMM

Dove zi è l'assegnazione cluster dell'osservazione xi, X1: n è il set di dati completo, z-i è l'insieme delle assegnazioni di cluster senza quello dell'ith osservazione, x-i è il set di dati completo escluso l'ith osservazione, ck,-io è il numero totale di osservazioni assegnate al cluster k escluso l'ith osservazione mentre ![]() ed

ed ![]() sono la matrice media e di covarianza del cluster k che esclude l'ith osservazione.

sono la matrice media e di covarianza del cluster k che esclude l'ith osservazione.

2. Il modello di miscela multichomiale di Dirichlet

Il modello di miscela di Dirichlet-Multinomial viene utilizzato per eseguire analisi cluster di documenti. Il modello particolare ha una gerarchia leggermente più complicata poiché modella gli argomenti / le categorie dei documenti, le probabilità di parola all'interno di ciascun argomento, le assegnazioni dei cluster e la distribuzione generativa dei documenti. Il suo obiettivo è quello di eseguire l'apprendimento senza supervisione e raggruppare un elenco di documenti assegnandoli ai gruppi. Il modello di miscela è definito come segue:

![]()

![]()

![]()

![]()

Equazione 4: Modello di miscela multichomiale di Dirichlet

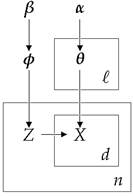

Dove φ modella le probabilità dell'argomento, zi è un selettore di argomenti, θk sono le probabilità di parola in ciascun cluster e xi, j rappresenta le parole del documento. Dobbiamo notare che questa tecnica utilizza il quadro bag-of-words che rappresenta i documenti come una raccolta non ordinata di parole, ignorando la grammatica e l'ordine delle parole. Questa rappresentazione semplificata viene comunemente utilizzata nell'elaborazione del linguaggio naturale e nel recupero delle informazioni. Di seguito presentiamo il modello grafico del modello di miscela:

Figura 2: Modello grafico del modello di miscela multichomiale di Dirichlet

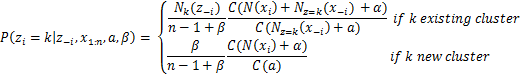

Il modello particolare utilizza Distribuzione discreta multinomiale per la distribuzione generativa e le distribuzioni di Dirichlet per i priori. ℓ è la dimensione dei nostri cluster attivi, n il numero totale di documenti, β controlla il numero previsto a priori di cluster mentre α controlla il numero di parole assegnate a ciascun cluster. Per stimare le probabilità richieste dal Campionatore Gibbs compresso noi usiamo il seguente equazione:

![]()

Equazione 5: Probabilità utilizzate da Gibbs Sampler per DMMM

Dove Γ è la funzione gamma, zi è l'assegnazione del cluster del documento xi, X1: n è il set di dati completo, z-i è l'insieme delle assegnazioni di cluster senza quello dell'ith documento, x-i è il set di dati completo escluso l'ith documento, Nk(z-i) è il numero di osservazioni assegnate al cluster k escluso ith documento, Nz=k(x-i) è un vettore con le somme dei conteggi per ogni parola per tutti i documenti assegnati al cluster k esclusi ith documento e N (xi) è il vettore rado con i conteggi di ogni parola nel documento xi. Infine, come possiamo vedere sopra, usando il campionatore Gibbs compresso con il processo del ristorante cinese θjk la variabile che memorizza la probabilità della parola j nell'argomento k può essere integrata.

- AI

- oh arte

- generatore d'arte

- un robot

- intelligenza artificiale

- certificazione di intelligenza artificiale

- robot di intelligenza artificiale

- robot di intelligenza artificiale

- software di intelligenza artificiale

- blockchain

- conferenza blockchain ai

- geniale

- intelligenza artificiale conversazionale

- criptoconferenza ai

- dall's

- Databox

- apprendimento profondo

- google ai

- machine learning

- Apprendimento automatico e statistiche

- Platone

- platone ai

- Platone Data Intelligence

- Gioco di Platone

- PlatoneDati

- gioco di plato

- scala ai

- sintassi

- zefiro