Ora puoi registrare i modelli di machine learning (ML) integrati Tela di Amazon SageMaker con un solo clic al Registro dei modelli di Amazon SageMaker, consentendoti di rendere operativi i modelli ML in produzione. Canvas è un'interfaccia visiva che consente agli analisti aziendali di generare autonomamente previsioni ML accurate, senza richiedere alcuna esperienza di ML o dover scrivere una sola riga di codice. Sebbene sia un luogo ideale per lo sviluppo e la sperimentazione, per trarre valore da questi modelli, è necessario renderli operativi, vale a dire implementarli in un ambiente di produzione in cui possono essere utilizzati per fare previsioni o prendere decisioni. Ora, con l'integrazione con il registro dei modelli, puoi archiviare tutti gli artefatti del modello, inclusi i metadati e le baseline delle metriche delle prestazioni, in un repository centrale e collegarli ai processi CI/CD di distribuzione del modello esistenti.

Il registro dei modelli è un repository che cataloga i modelli ML, gestisce varie versioni del modello, associa i metadati (come le metriche di addestramento) a un modello, gestisce lo stato di approvazione di un modello e li distribuisce alla produzione. Dopo aver creato una versione del modello, in genere si desidera valutarne le prestazioni prima di distribuirla a un endpoint di produzione. Se soddisfa i tuoi requisiti, puoi aggiornare lo stato di approvazione della versione del modello in approvato. L'impostazione dello stato su approvato può avviare la distribuzione CI/CD per il modello. Se la versione del modello non soddisfa i tuoi requisiti, puoi aggiornare lo stato di approvazione a rifiutato nel registro, che impedisce la distribuzione del modello in un ambiente sottoposto a escalation.

Un registro del modello svolge un ruolo chiave nel processo di distribuzione del modello perché raggruppa tutte le informazioni sul modello e consente l'automazione della promozione del modello negli ambienti di produzione. Di seguito sono riportati alcuni modi in cui un registro dei modelli può aiutare a rendere operativi i modelli ML:

- Controllo della versione – Un registro dei modelli consente di tenere traccia delle diverse versioni dei modelli ML, che è essenziale quando si distribuiscono i modelli in produzione. Tenendo traccia delle versioni del modello, puoi facilmente ripristinare una versione precedente se una nuova versione causa problemi.

- Collaborazione – Un registro dei modelli consente la collaborazione tra data scientist, ingegneri e altre parti interessate fornendo una posizione centralizzata per l'archiviazione, la condivisione e l'accesso ai modelli. Questo può aiutare a semplificare il processo di distribuzione e garantire che tutti lavorino con lo stesso modello.

- Governance LPI – Un registro dei modelli può aiutare con la conformità e la governance fornendo una cronologia verificabile delle modifiche e delle distribuzioni del modello.

Nel complesso, un registro dei modelli può aiutare a semplificare il processo di distribuzione dei modelli ML in produzione fornendo controllo della versione, collaborazione, monitoraggio e governance.

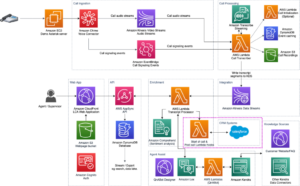

Panoramica della soluzione

Per il nostro caso d'uso, stiamo assumendo il ruolo di un utente aziendale nel reparto marketing di un operatore di telefonia mobile e abbiamo creato con successo un modello ML in Canvas per identificare i clienti con il potenziale rischio di abbandono. Grazie alle previsioni generate dal nostro modello, ora vogliamo spostarlo dal nostro ambiente di sviluppo alla produzione. Tuttavia, prima che il nostro modello venga distribuito a un endpoint di produzione, deve essere esaminato e approvato da un team MLOps centrale. Questo team è responsabile della gestione delle versioni del modello, della revisione di tutti i metadati associati (come le metriche di addestramento) con un modello, della gestione dello stato di approvazione di ogni modello ML, della distribuzione dei modelli approvati alla produzione e dell'automazione della distribuzione del modello con CI/CD. Per semplificare il processo di distribuzione del nostro modello in produzione, sfruttiamo l'integrazione di Canvas con il registro dei modelli e registriamo il nostro modello per la revisione da parte del nostro team MLOps.

I passaggi del flusso di lavoro sono i seguenti:

- Carica un nuovo set di dati con l'attuale popolazione di clienti in Canvas. Per l'elenco completo delle origini dati supportate, fare riferimento a Importa i dati in Canvas.

- Crea modelli ML e analizza le metriche delle loro prestazioni. Fare riferimento alle istruzioni per creare un modello ML personalizzato in Canvas ed valutare le prestazioni del modello.

- Registra le versioni più performanti al registro dei modelli per la revisione e l'approvazione.

- Distribuire la versione del modello approvato a un endpoint di produzione per l'inferenza in tempo reale.

Puoi eseguire i passaggi 1-3 in Canvas senza scrivere una singola riga di codice.

Prerequisiti

Per questa procedura dettagliata, assicurati che siano soddisfatti i seguenti prerequisiti:

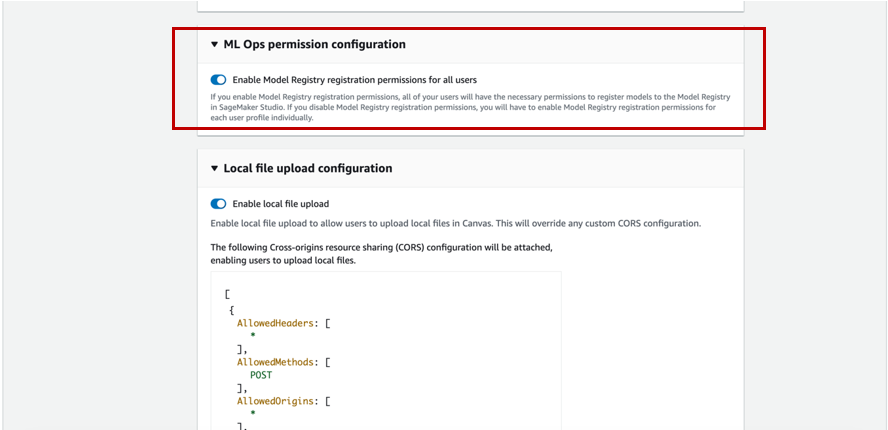

- Per registrare le versioni del modello nel registro del modello, l'amministratore di Canvas deve concedere le autorizzazioni necessarie all'utente Canvas, che puoi gestire nel dominio SageMaker che ospita la tua applicazione Canvas. Per ulteriori informazioni, consultare il Guida per sviluppatori Amazon SageMaker. Quando concedi le autorizzazioni utente Canvas, devi scegliere se consentire all'utente di registrare le versioni del modello nello stesso account AWS.

- Attuare i prerequisiti menzionati in Prevedi l'abbandono dei clienti con il machine learning senza codice utilizzando Amazon SageMaker Canvas.

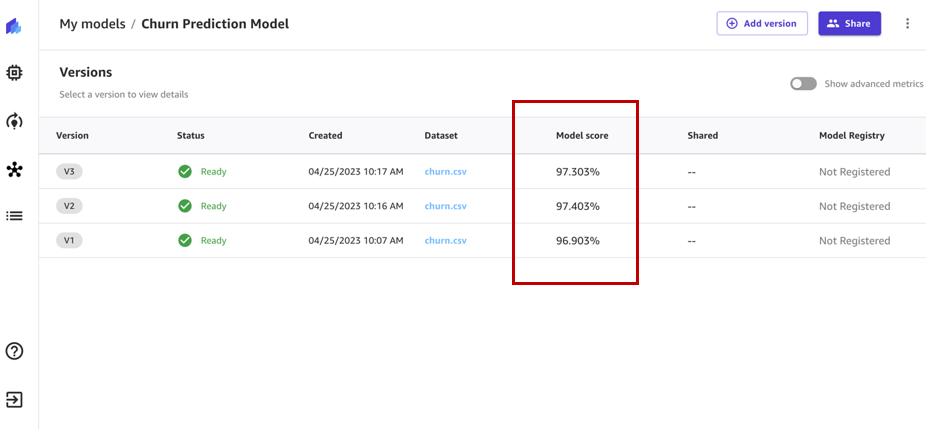

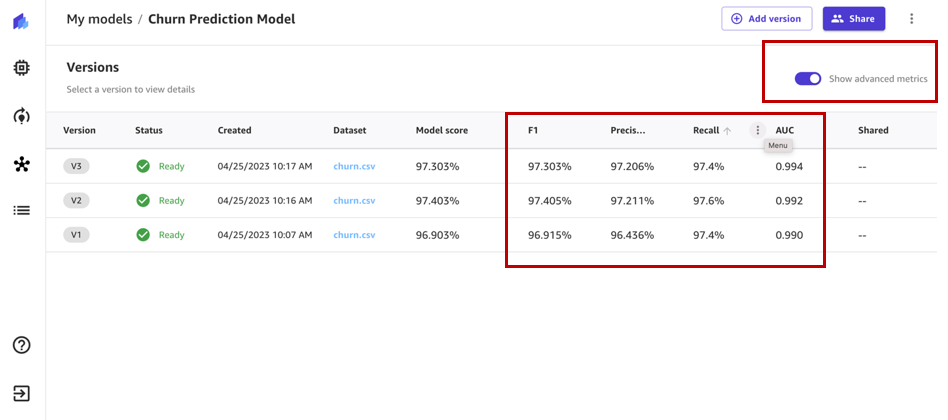

Ora dovresti avere tre versioni del modello addestrate sui dati storici di previsione del tasso di abbandono in Canvas:

- V1 addestrato con tutte le 21 funzionalità e configurazione rapida con un punteggio del modello del 96.903%

- V2 addestrato con tutte le 19 funzionalità (telefono rimosso e funzionalità di stato) e configurazione rapida della build e precisione migliorata del 97.403%

- V3 addestrato con configurazione di build standard con punteggio del modello del 97.03%.

Utilizza il modello di previsione del tasso di abbandono dei clienti

permettere Mostra metriche avanzate ed esaminare le metriche oggettive associate a ciascuna versione del modello in modo da poter selezionare il modello con le migliori prestazioni per la registrazione nel registro dei modelli.

In base alle metriche delle prestazioni, selezioniamo la versione 2 da registrare.

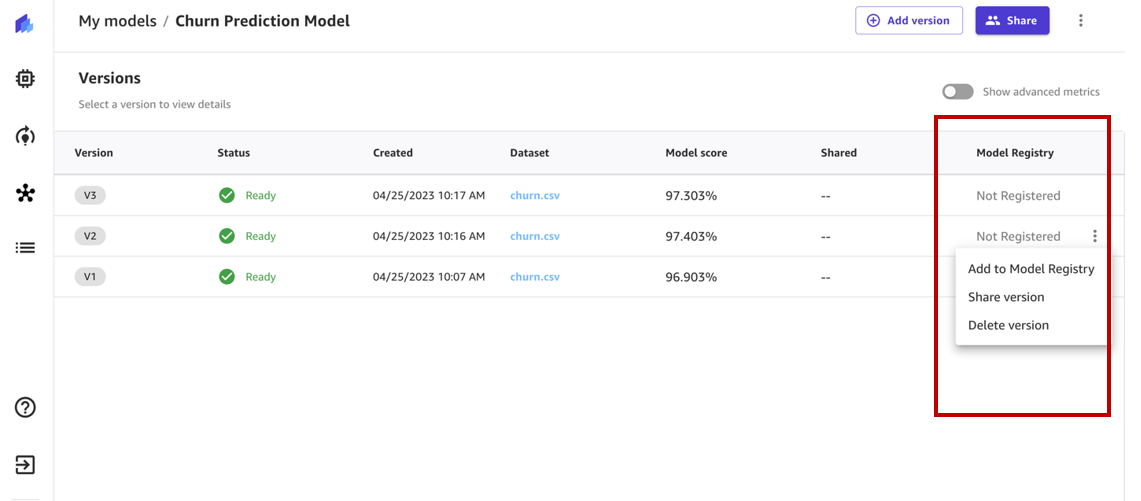

Il registro del modello tiene traccia di tutte le versioni del modello addestrate per risolvere un particolare problema in un gruppo di modelli. Quando si addestra un modello Canvas e lo si registra nel registro dei modelli, viene aggiunto a un gruppo di modelli come nuova versione del modello.

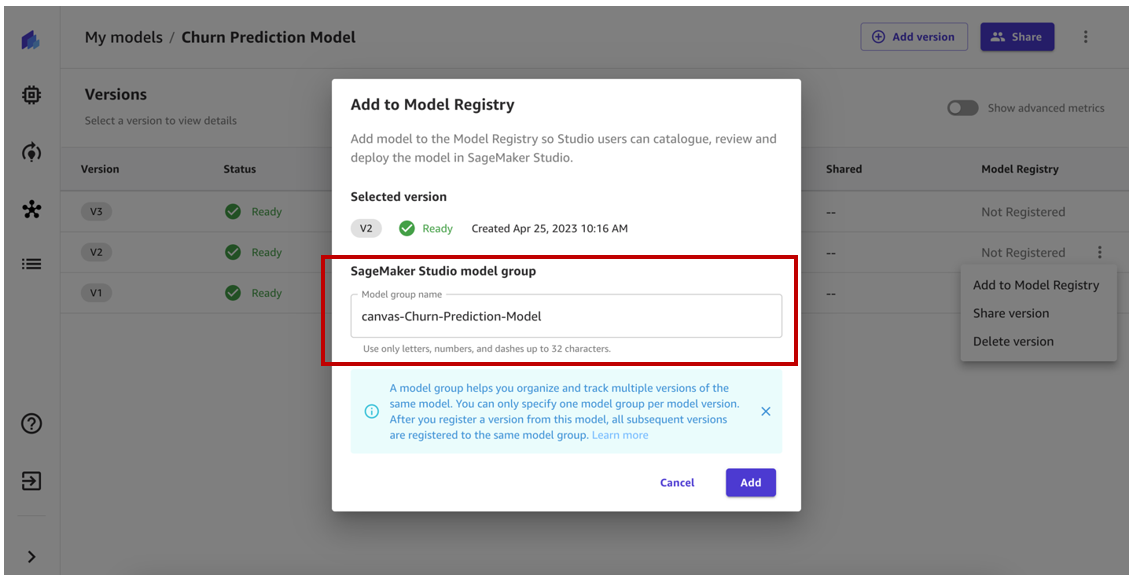

Al momento della registrazione, viene creato automaticamente un gruppo di modelli all'interno del registro dei modelli. Facoltativamente, è possibile rinominarlo con un nome di propria scelta o utilizzare un gruppo di modelli esistente nel registro dei modelli.

Per questo esempio, utilizziamo il nome del gruppo di modelli generato automaticamente e scegliamo Aggiungi.

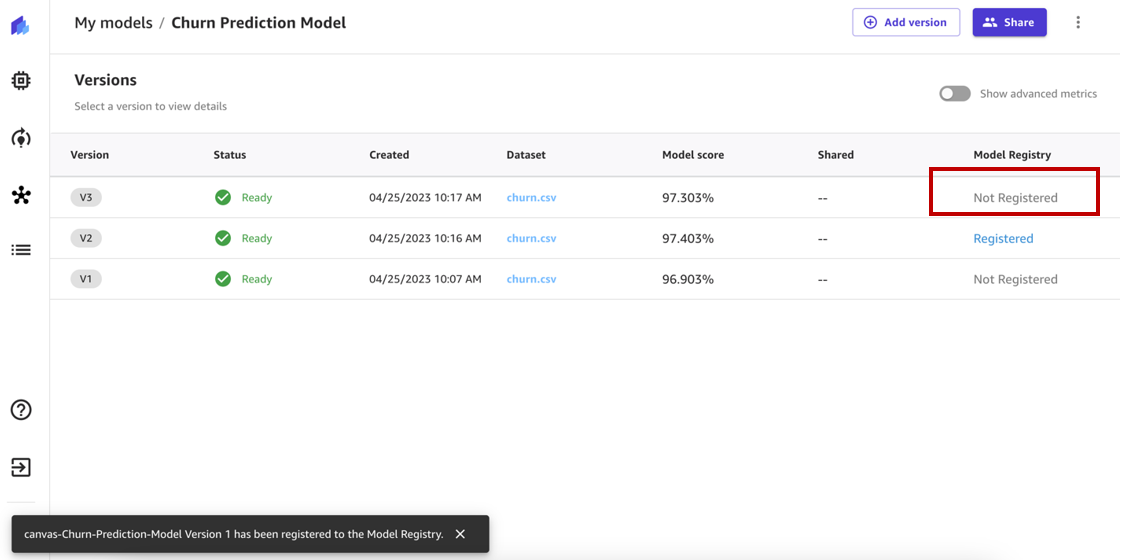

La nostra versione del modello dovrebbe ora essere registrata nel gruppo di modelli nel registro dei modelli. Se dovessimo registrare un'altra versione del modello, verrebbe registrata allo stesso gruppo di modelli.

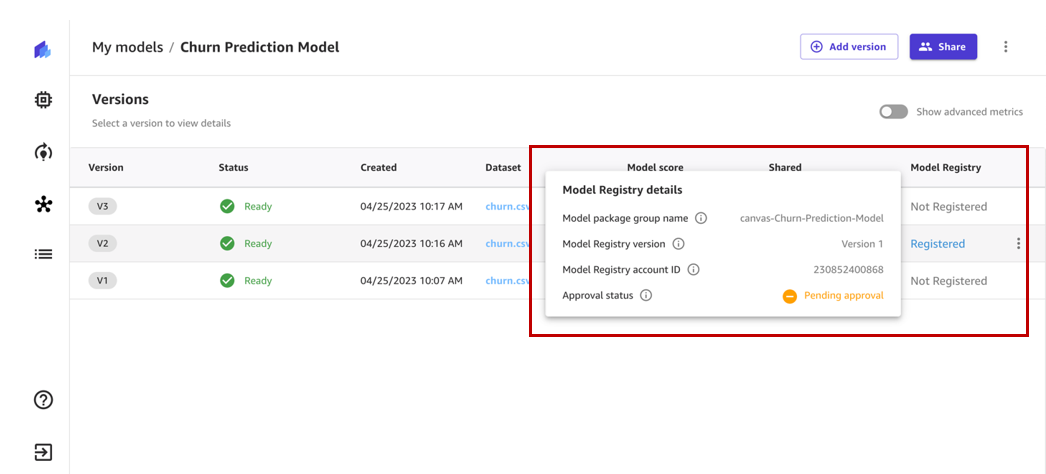

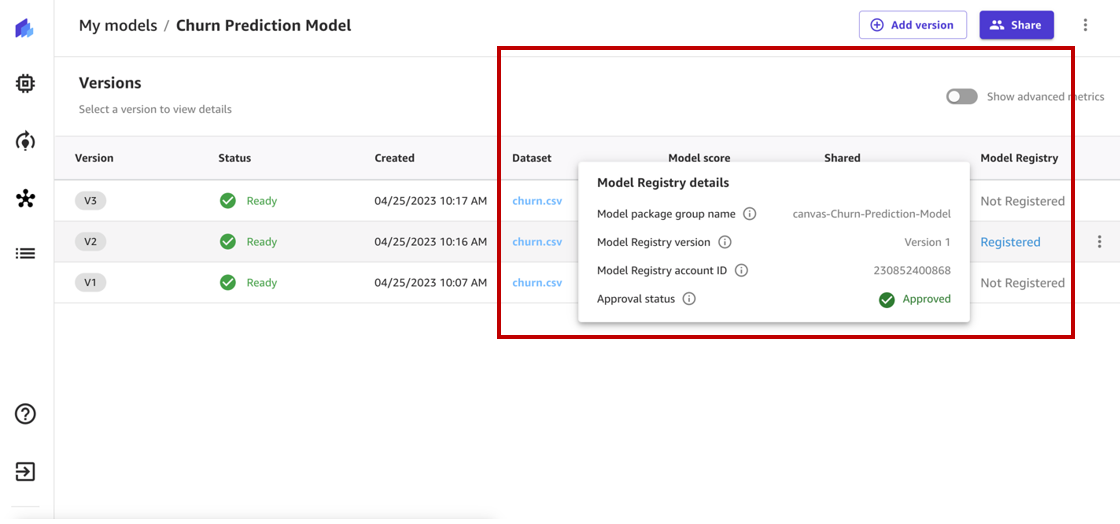

Lo stato della versione del modello dovrebbe essere cambiato da Non registrato a Registrato.

Quando passiamo il mouse sopra lo stato, possiamo esaminare i dettagli del registro del modello, che includono il nome del gruppo di modelli, l'ID dell'account del registro del modello e lo stato di approvazione. Subito dopo la registrazione, lo stato cambia in In attesa di approvazione, il che significa che questo modello è registrato nel registro dei modelli ma è in attesa di revisione e approvazione da parte di un data scientist o di un membro del team MLOps e può essere distribuito a un endpoint solo se approvato.

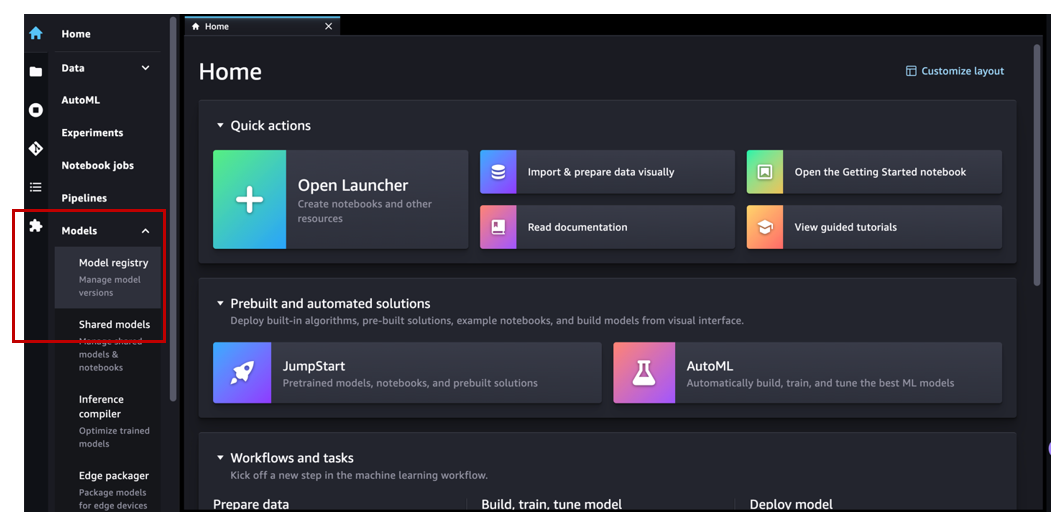

Ora passiamo a Amazon Sage Maker Studio e assumere il ruolo di un membro del team MLOps. Sotto Modelli nel pannello di navigazione, scegli Registro dei modelli per aprire la home page del registro dei modelli.

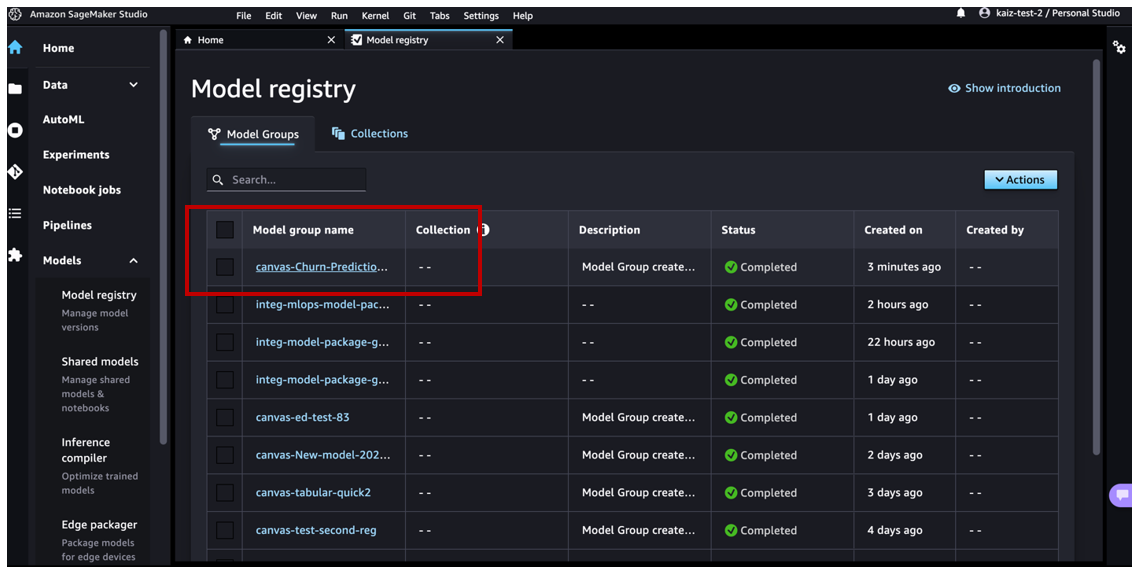

Possiamo vedere il modello group canvas-Churn-Prediction-Model che Canvas ha creato automaticamente per noi.

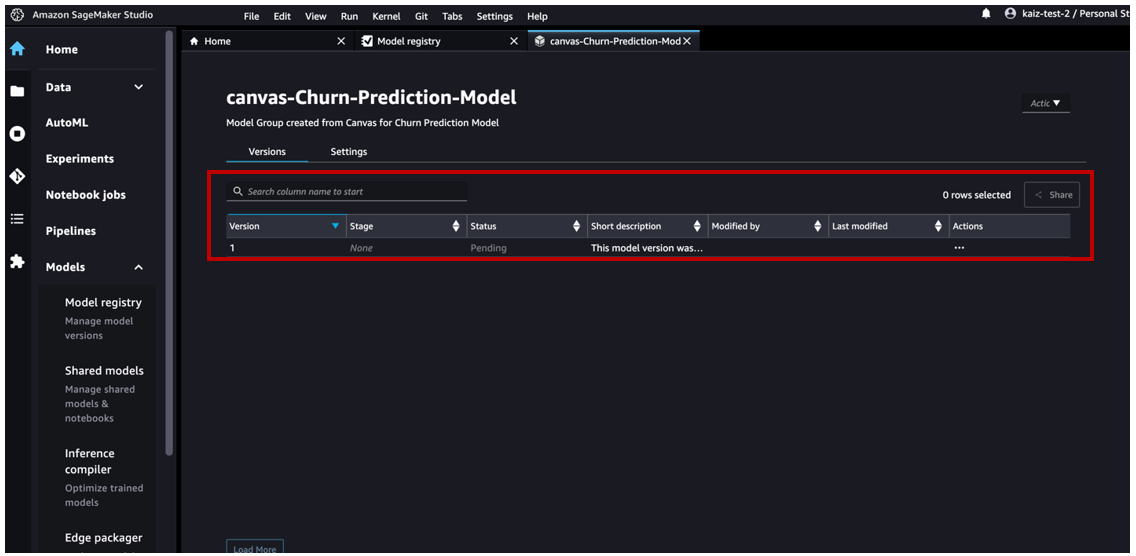

Scegli il modello per esaminare tutte le versioni registrate in questo gruppo di modelli e quindi rivedere i dettagli del modello corrispondente.

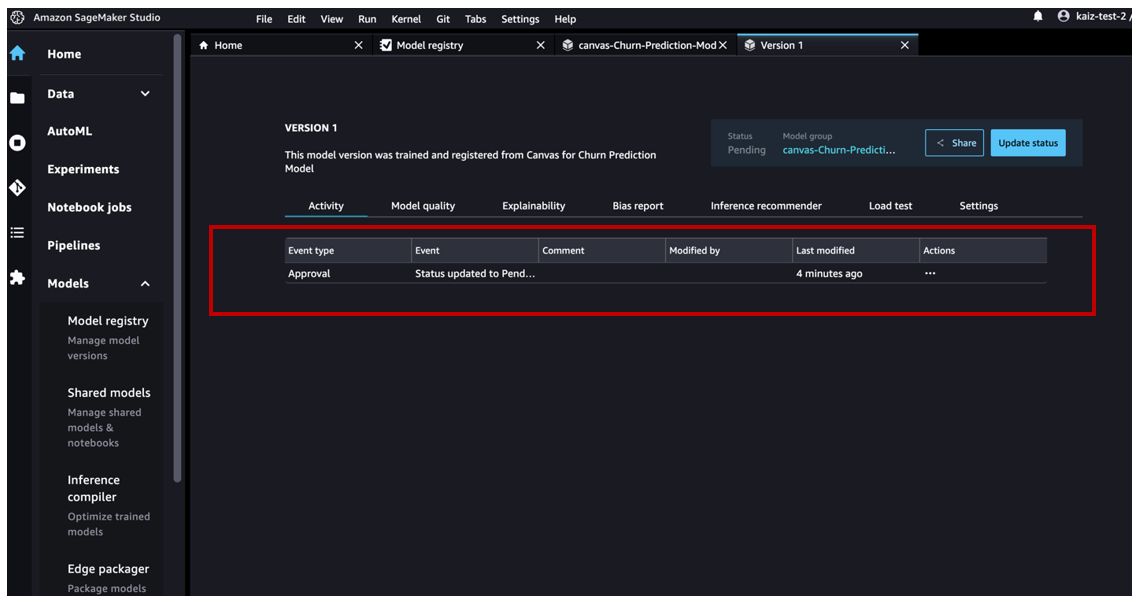

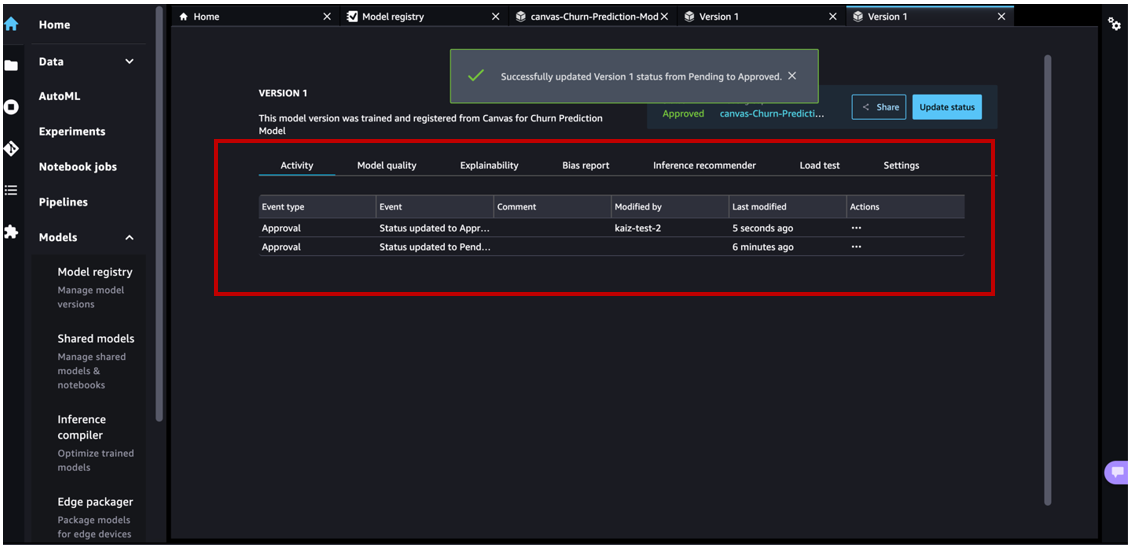

Se apri i dettagli per la versione 1, possiamo vedere che il file Attività tab tiene traccia di tutti gli eventi che si verificano sul modello.

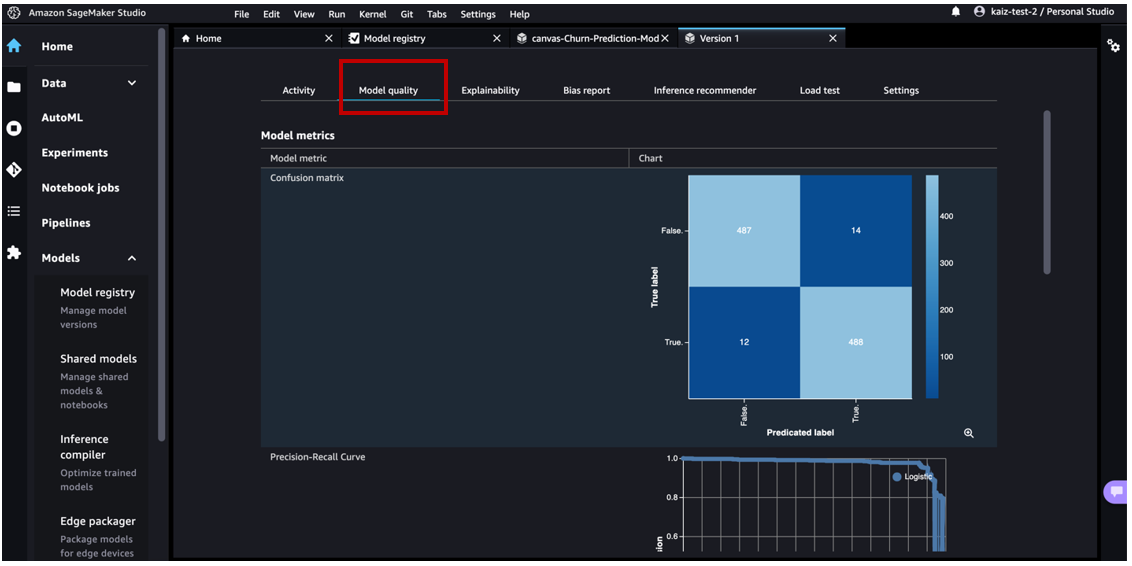

Sulla Qualità del modello scheda, possiamo esaminare le metriche del modello, le curve di precisione/richiamo e i grafici della matrice di confusione per comprendere le prestazioni del modello.

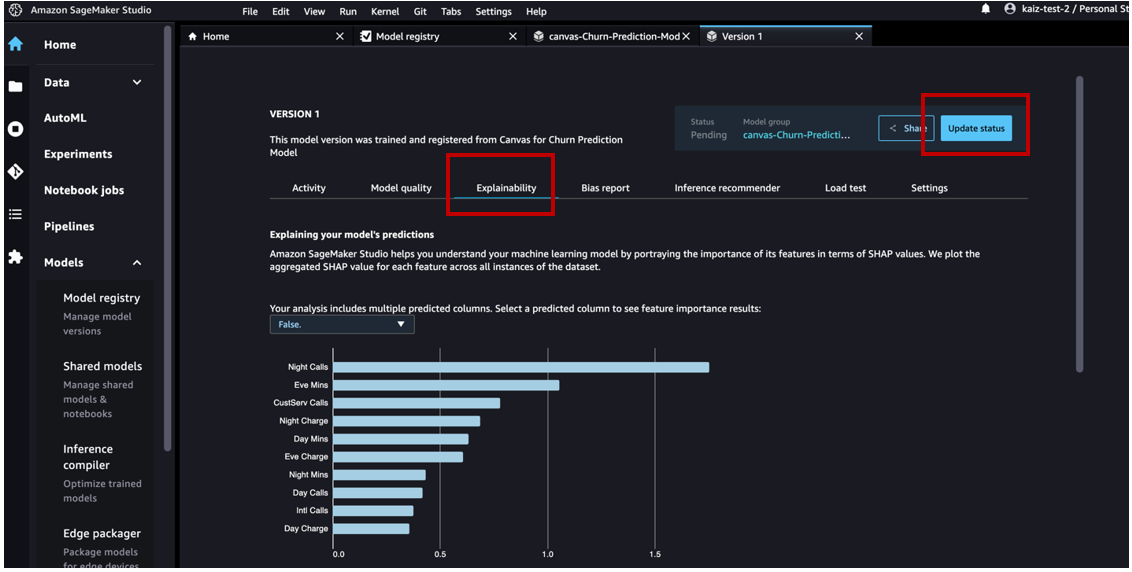

Sulla Spiegabilità scheda, possiamo rivedere le caratteristiche che hanno maggiormente influenzato le prestazioni del modello.

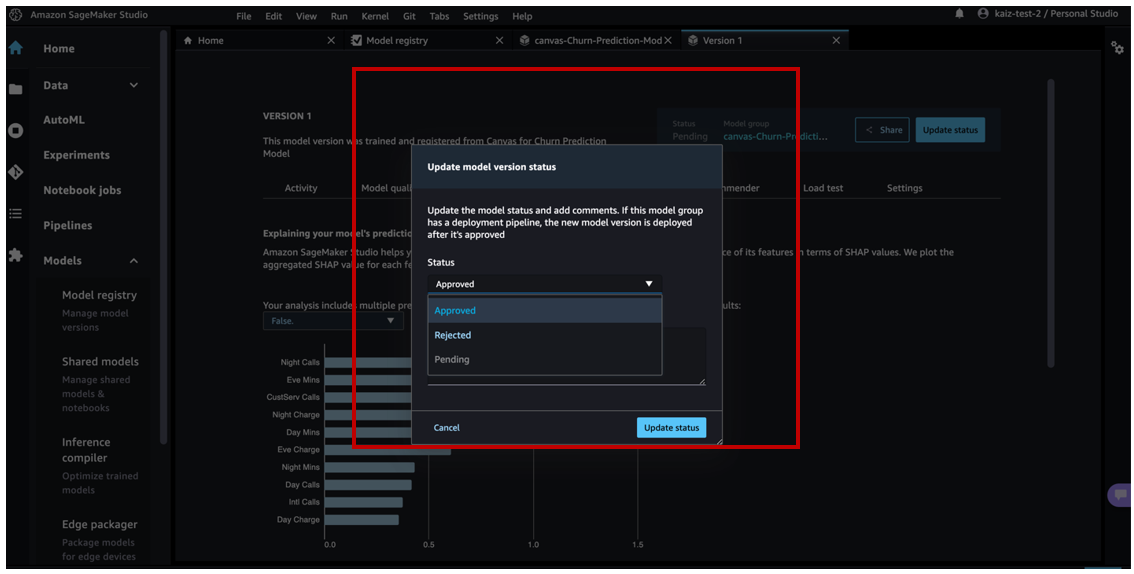

Dopo aver esaminato gli artefatti del modello, è possibile modificare lo stato di approvazione da Attesa Pagamento a Approvato.

Ora possiamo vedere l'attività aggiornata.

L'utente aziendale Canvas sarà ora in grado di vedere che lo stato del modello registrato è cambiato da In attesa di approvazione a Approvato.

Come membro del team MLOps, poiché abbiamo approvato questo modello ML, distribuiamolo a un endpoint.

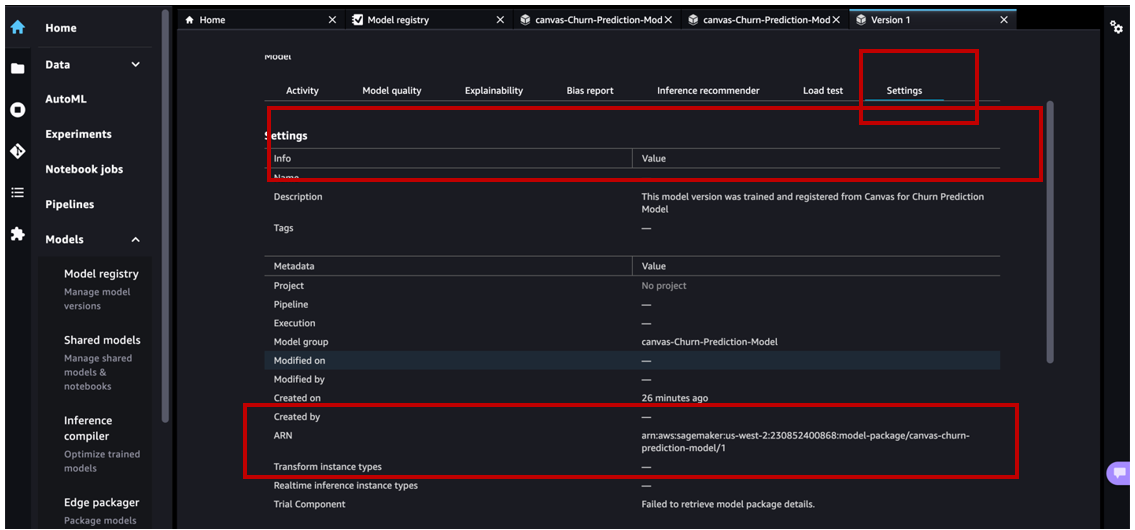

In Studio, vai alla home page del registro dei modelli e scegli il file canvas-Churn-Prediction-Model gruppo modello. Scegli la versione da distribuire e vai al file Impostazioni profilo scheda.

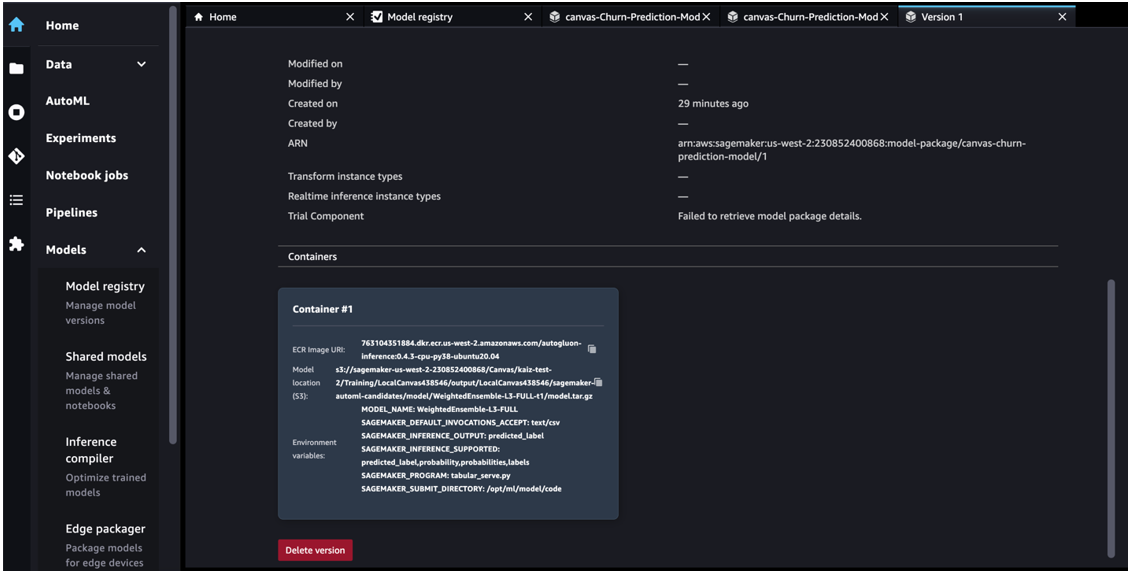

Sfoglia per ottenere i dettagli ARN del pacchetto del modello dalla versione del modello selezionata nel registro del modello.

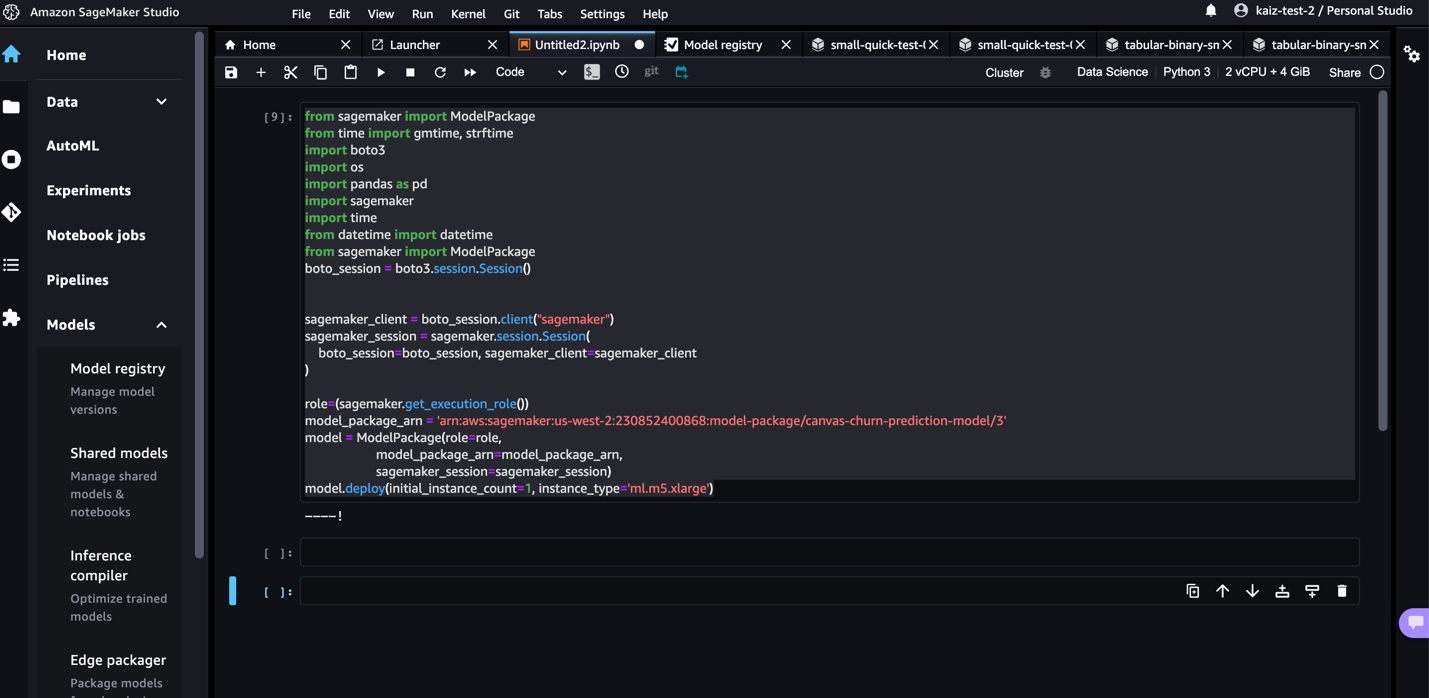

Apri un notebook in Studio ed esegui il codice seguente per distribuire il modello a un endpoint. Sostituisci l'ARN del pacchetto modello con il tuo ARN del pacchetto modello.

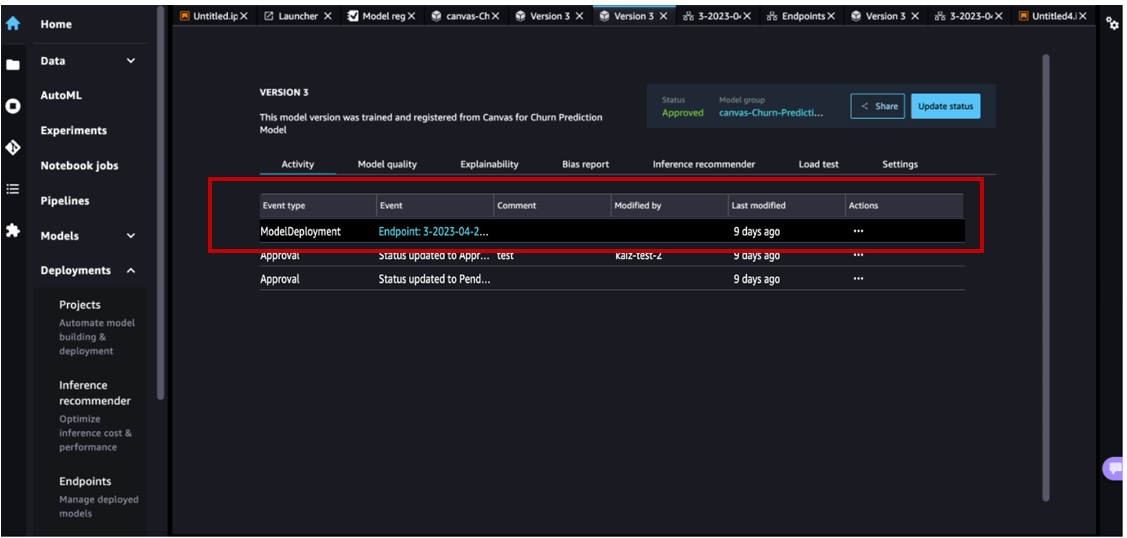

Dopo che l'endpoint è stato creato, puoi vederlo registrato come un evento sul file Attività scheda del registro dei modelli.

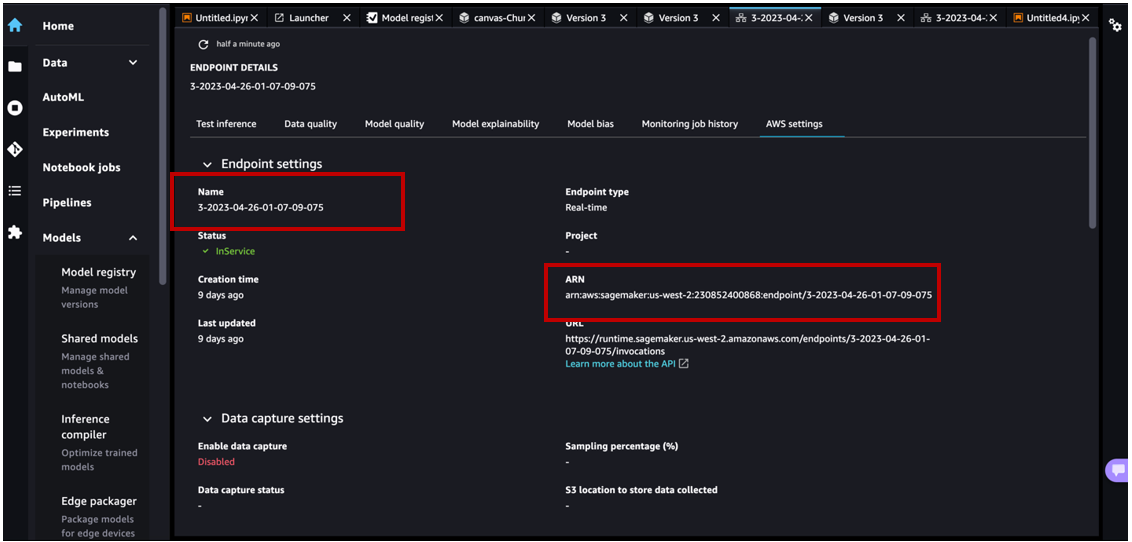

È possibile fare doppio clic sul nome dell'endpoint per ottenerne i dettagli.

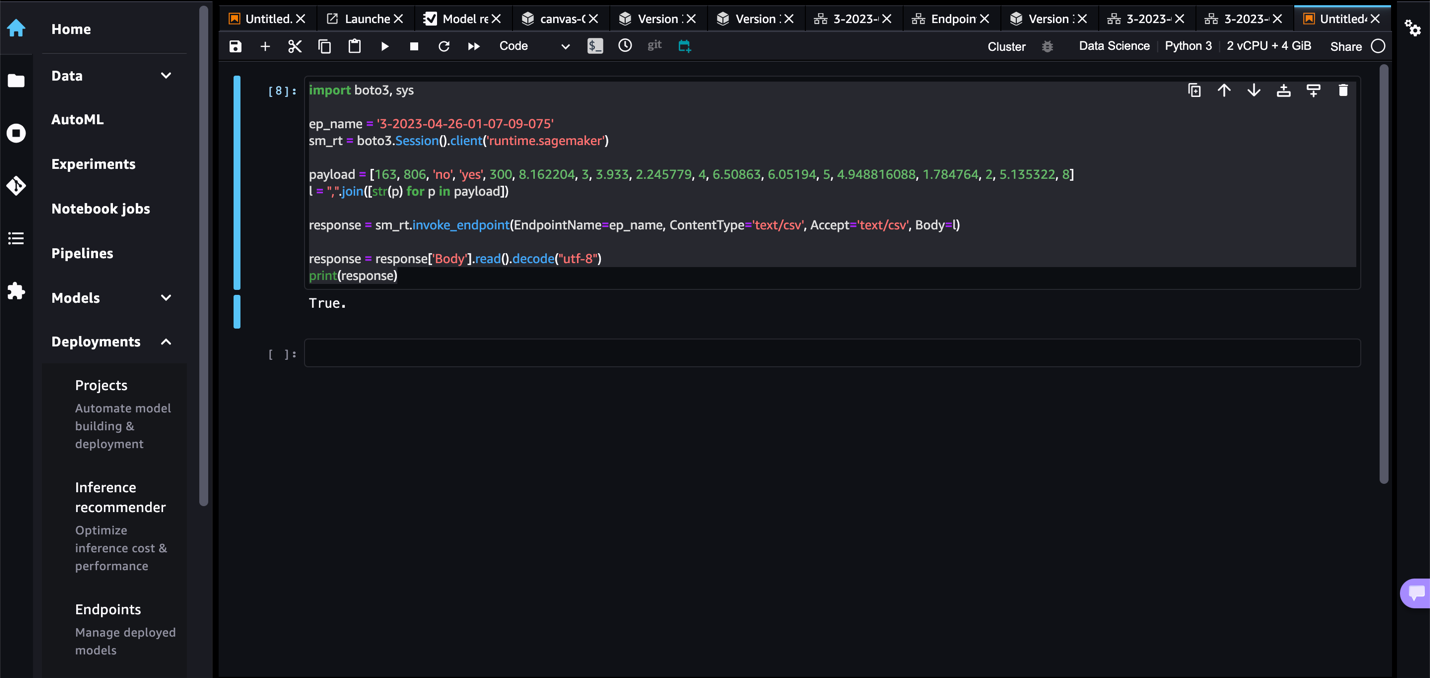

Ora che abbiamo un endpoint, invochiamolo per ottenere un'inferenza in tempo reale. Sostituisci il nome dell'endpoint nel seguente frammento di codice:

ripulire

Per evitare di incorrere in addebiti futuri, elimina le risorse che hai creato seguendo questo post. Ciò include la disconnessione da Canvas e eliminando l'endpoint SageMaker distribuito. Canvas ti addebita la durata della sessione e ti consigliamo di disconnetterti da Canvas quando non lo utilizzi. Fare riferimento a Disconnessione da Amazon SageMaker Canvas per ulteriori dettagli.

Conclusione

In questo post, abbiamo discusso di come Canvas può aiutare a rendere operativi i modelli ML negli ambienti di produzione senza richiedere competenze ML. Nel nostro esempio, abbiamo mostrato come un analista può creare rapidamente un modello ML predittivo estremamente accurato senza scrivere alcun codice e registrarlo nel registro del modello. Il team MLOps può quindi esaminarlo e rifiutare il modello o approvarlo e avviare il processo di distribuzione CI/CD a valle.

Per iniziare il tuo viaggio ML low-code/no-code, fai riferimento a Tela di Amazon SageMaker.

Un ringraziamento speciale a tutti coloro che hanno contribuito al lancio:

backend:

- Huayuan (Alice) Wu

- Krittaphat Pugdeethosapol

- Yanda Hu

- Giovanni Lui

- Esha Dutta

- Prashanth

Fine frontale:

- Kaiz Mercante

- Ed Cheung

Informazioni sugli autori

Janisha Anand è un Senior Product Manager nel team SageMaker Low/No Code ML, che include SageMaker Autopilot. Le piace il caffè, resta attiva e trascorre del tempo con la sua famiglia.

Janisha Anand è un Senior Product Manager nel team SageMaker Low/No Code ML, che include SageMaker Autopilot. Le piace il caffè, resta attiva e trascorre del tempo con la sua famiglia.

Krittaphat Pugdeethosapol è un Software Development Engineer presso Amazon SageMaker e lavora principalmente con i prodotti SageMaker low-code e no-code.

Krittaphat Pugdeethosapol è un Software Development Engineer presso Amazon SageMaker e lavora principalmente con i prodotti SageMaker low-code e no-code.

Huayuan (Alice) Wu è un ingegnere di sviluppo software presso Amazon SageMaker. Si concentra sulla creazione di strumenti e prodotti ML per i clienti. Al di fuori del lavoro, le piace la vita all'aria aperta, lo yoga e le escursioni.

Huayuan (Alice) Wu è un ingegnere di sviluppo software presso Amazon SageMaker. Si concentra sulla creazione di strumenti e prodotti ML per i clienti. Al di fuori del lavoro, le piace la vita all'aria aperta, lo yoga e le escursioni.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/operationalize-ml-models-built-in-amazon-sagemaker-canvas-to-production-using-the-amazon-sagemaker-model-registry/

- :È

- :non

- :Dove

- ][P

- 1

- 100

- 15%

- 420

- 7

- 8

- a

- capace

- Accedendo

- Il mio account

- precisione

- preciso

- attivo

- attività

- aggiunto

- Admin

- Avanzate

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- Tutti

- consentire

- consente

- Sebbene il

- Amazon

- Amazon Sage Maker

- Tela di Amazon SageMaker

- tra

- an

- analista

- Gli analisti

- analizzare

- ed

- Un altro

- in qualsiasi

- Applicazioni

- approvazione

- approvare

- approvato

- SONO

- AS

- associato

- At

- verificabile

- automaticamente

- Automatizzare

- Automazione

- evitare

- AWS

- BE

- perché

- prima

- essendo

- MIGLIORE

- Bills

- stile di vita

- costruire

- Costruzione

- costruito

- affari

- ma

- by

- Materiale

- tela

- Custodie

- cataloghi

- cause

- centrale

- centralizzata

- il cambiamento

- cambiato

- Modifiche

- oneri

- scegliere

- Scegli

- clicca

- codice

- Caffè

- collaborazione

- conformità

- Configurazione

- confusione

- contribuito

- di controllo

- Corrispondente

- creare

- creato

- Corrente

- costume

- cliente

- Clienti

- dati

- scienziato di dati

- datetime

- decisioni

- Shirts Department

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- Distribuisce

- dettagli

- Costruttori

- Mercato

- diverso

- discusso

- non

- dominio

- durata

- ogni

- facilmente

- o

- Abilita

- consentendo

- fine

- endpoint

- ingegnere

- Ingegneri

- garantire

- Ambiente

- ambienti

- essential

- valutare

- Evento

- eventi

- Ogni

- tutti

- esempio

- esistente

- esperienza

- competenza

- famiglia

- Caratteristiche

- si concentra

- i seguenti

- segue

- Nel

- da

- pieno

- futuro

- generare

- generato

- ottenere

- Dare

- Go

- la governance

- rilascio

- grande

- Gruppo

- Happening

- Avere

- avendo

- Aiuto

- suo

- vivamente

- storico

- storia

- Casa

- padroni di casa

- librarsi

- Come

- Tuttavia

- HTML

- HTTPS

- ID

- identificare

- if

- importare

- migliorata

- in

- includere

- inclusi

- Compreso

- influenzato

- informazioni

- avviare

- istruzioni

- integrazione

- Interfaccia

- ai miglioramenti

- sicurezza

- IT

- SUO

- viaggio

- jpg

- conservazione

- Le

- lanciare

- apprendimento

- linea

- Lista

- località

- registrazione

- macchina

- machine learning

- principalmente

- make

- gestire

- direttore

- gestisce

- gestione

- Marketing

- Matrice

- si intende

- membro

- menzionato

- Metadati

- Metrica

- ML

- MLOp

- Mobile

- cellulare

- modello

- modelli

- monitoraggio

- Scopri di più

- maggior parte

- cambiano

- devono obbligatoriamente:

- Nome

- Navigare

- Navigazione

- necessaria

- Bisogno

- esigenze

- New

- no

- taccuino

- adesso

- obiettivo

- of

- on

- esclusivamente

- aprire

- operatore

- or

- OS

- Altro

- nostro

- su

- all'aperto

- al di fuori

- ancora

- proprio

- pacchetto

- Packages

- pagina

- panda

- vetro

- particolare

- in attesa di

- Eseguire

- performance

- esecuzione

- esegue

- permessi

- telefono

- posto

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- spina

- popolazione

- Post

- potenziale

- predizione

- Previsioni

- prerequisiti

- impedisce

- precedente

- Problema

- processi

- i processi

- Prodotto

- product manager

- Produzione

- Prodotti

- promozione

- fornitura

- Presto

- rapidamente

- tempo reale

- raccomandare

- registro

- registrato

- Iscrizione

- registro

- rimosso

- sostituire

- deposito

- Requisiti

- Risorse

- risposta

- responsabile

- ritornare

- recensioni

- rivisto

- revisione

- destra

- Rischio

- Ruolo

- Correre

- sagemaker

- stesso

- Scienziato

- scienziati

- Punto

- vedere

- selezionato

- anziano

- Sessione

- regolazione

- compartecipazione

- lei

- dovrebbero

- ha mostrato

- singolo

- So

- Software

- lo sviluppo del software

- RISOLVERE

- alcuni

- fonti

- Spendere

- stakeholder

- Standard

- inizia a

- Regione / Stato

- Stato dei servizi

- Passi

- Tornare al suo account

- memorizzare

- snellire

- studio

- Con successo

- tale

- supportato

- SYS

- Fai

- team

- Grazie

- che

- Il

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- tre

- tempo

- a

- strumenti

- pista

- Treni

- allenato

- Training

- tipicamente

- per

- capire

- Aggiornanento

- aggiornato

- us

- uso

- caso d'uso

- utilizzato

- Utente

- utilizzando

- APPREZZIAMO

- vario

- versione

- walkthrough

- volere

- modi

- we

- sono stati

- quando

- se

- quale

- while

- OMS

- volere

- con

- entro

- senza

- Lavora

- lavoro

- lavori

- sarebbe

- scrivere

- scrittura

- sì

- Yoga

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro