Fonte: rawpixel.com

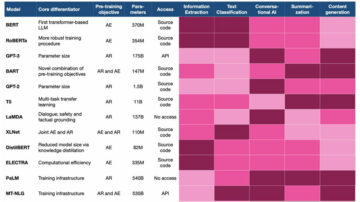

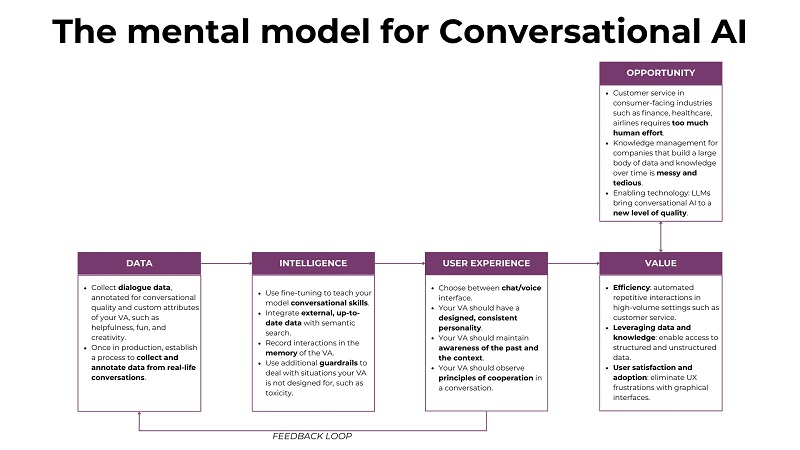

L'intelligenza artificiale conversazionale è un'applicazione di LLM che ha suscitato molto interesse e attenzione grazie alla sua scalabilità in molti settori e casi d'uso. Sebbene i sistemi conversazionali esistano da decenni, gli LLM hanno apportato la spinta qualitativa necessaria per la loro adozione su larga scala. In questo articolo, utilizzeremo il modello mentale mostrato nella Figura 1 per analizzare le applicazioni di intelligenza artificiale conversazionale (cfr. Costruire prodotti di intelligenza artificiale con un modello mentale olistico per un'introduzione al modello mentale). Dopo aver considerato le opportunità di mercato e il valore aziendale dei sistemi di intelligenza artificiale conversazionale, spiegheremo i "macchinari" aggiuntivi in termini di dati, messa a punto LLM e progettazione conversazionale che devono essere impostati per rendere le conversazioni non solo possibili ma anche utili e divertente.

1. Opportunità, valore e limitazioni

Il design UX tradizionale è costruito attorno a una moltitudine di elementi UX artificiali, scorrimenti, tocchi e clic, che richiedono una curva di apprendimento per ogni nuova app. Utilizzando l’intelligenza artificiale conversazionale, possiamo eliminare questa frenesia, sostituendola con l’esperienza elegante di una conversazione che scorre naturalmente in cui possiamo dimenticare le transizioni tra diverse app, finestre e dispositivi. Usiamo il linguaggio, il nostro protocollo universale e familiare per la comunicazione, per interagire con diversi assistenti virtuali (VA) e svolgere i nostri compiti.

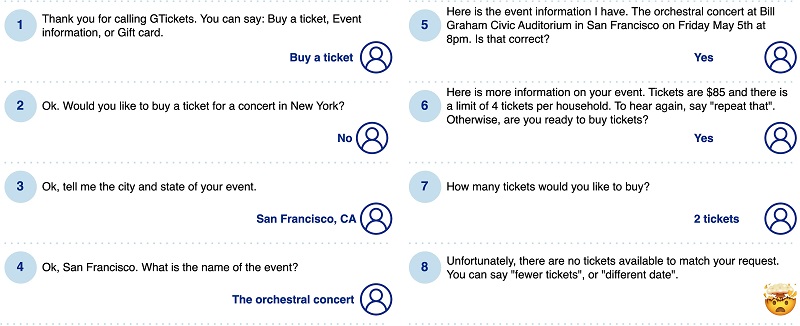

Le interfacce utente conversazionali non sono esattamente la novità. I sistemi interattivi di risposta vocale (IVR) e i chatbot esistono dagli anni ’1990 e i principali progressi nella PNL sono stati seguiti da vicino da ondate di speranza e sviluppo per le interfacce vocali e di chat. Tuttavia, prima dell’avvento dei LLM, la maggior parte dei sistemi erano implementati nel paradigma simbolico, basandosi su regole, parole chiave e modelli di conversazione. Erano inoltre limitati a un ambito di “competenza” specifico e predefinito e gli utenti che si avventuravano al di fuori di questi si sarebbero presto ritrovati in un vicolo cieco. Nel complesso, questi sistemi presentavano potenziali punti di errore e, dopo un paio di tentativi frustranti, molti utenti non sono più tornati ad utilizzarli. La figura seguente illustra un esempio di dialogo. Un utente che vuole ordinare i biglietti per un concerto specifico segue pazientemente un flusso di interrogazioni dettagliate, solo per scoprire alla fine che il concerto è esaurito.

Essendo una tecnologia abilitante, gli LLM possono portare le interfacce conversazionali a nuovi livelli di qualità e soddisfazione degli utenti. I sistemi conversazionali possono ora mostrare una conoscenza del mondo, una competenza linguistica e una capacità di conversazione molto più ampie. Sfruttando modelli pre-addestrati, possono anche essere sviluppati in tempi molto più brevi poiché il noioso lavoro di compilazione di regole, parole chiave e flussi di dialogo è ora sostituito dalla conoscenza statistica del LLM. Diamo un'occhiata a due importanti applicazioni in cui l'intelligenza artificiale conversazionale può fornire valore su larga scala:

- Supporto clienti e, più in generale, applicazioni utilizzate da un gran numero di utenti che spesso avanzano richieste simili. In questo caso, l’azienda che fornisce l’assistenza clienti ha un chiaro vantaggio informativo rispetto all’utente e può sfruttarlo per creare un’esperienza utente più intuitiva e piacevole. Consideriamo il caso della riprenotazione di un volo. Per quanto mi riguarda, un viaggiatore piuttosto frequente, questo è qualcosa che accade 1–2 volte all'anno. Nel frattempo tendo a dimenticare i dettagli del processo, per non parlare dell'interfaccia utente di una specifica compagnia aerea. Al contrario, l’assistenza clienti della compagnia aerea ha le richieste di riprenotazione al centro delle loro operazioni. Invece di esporre il processo di riprenotazione tramite un'interfaccia grafica complessa, la sua logica può essere "nascosta" ai clienti che contattano il supporto e possono utilizzare il linguaggio come canale naturale per effettuare la riprenotazione. Naturalmente, rimarrà ancora una “lunga coda” di richieste meno familiari. Immaginate ad esempio uno sbalzo d'umore spontaneo che spinga un cliente aziendale ad aggiungere il suo amato cane come bagaglio in eccesso a un volo prenotato. Queste richieste più individuali possono essere trasmesse ad agenti umani o coperte tramite un sistema interno di gestione della conoscenza collegato all'assistente virtuale.

- La gestione della conoscenza che si fonda su una grande quantità di dati. Per molte aziende moderne, la conoscenza interna accumulata in anni di attività, iterazione e apprendimento è una risorsa fondamentale e un elemento di differenziazione, se archiviata, gestita e consultata in modo efficiente. Basandosi su una ricchezza di dati nascosta in strumenti di collaborazione, wiki interni, basi di conoscenza, ecc., spesso non riescono a trasformarli in conoscenza utilizzabile. Quando i dipendenti se ne vanno, nuovi dipendenti vengono inseriti e non arrivi mai a finalizzare la pagina di documentazione che hai iniziato tre mesi fa, la conoscenza preziosa cade vittima dell'entropia. Diventa sempre più difficile trovare una via d'uscita nel labirinto interno dei dati e mettere le mani sulle informazioni necessarie in una specifica situazione aziendale. Ciò porta a enormi perdite di efficienza per i lavoratori della conoscenza. Per risolvere questo problema, possiamo aumentare gli LLM con la ricerca semantica su origini dati interne. I LLM consentono di utilizzare domande in linguaggio naturale invece di query formali complesse per porre domande su questo database. Gli utenti possono così concentrarsi sulle proprie esigenze informative piuttosto che sulla struttura della base di conoscenza o sulla sintassi di un linguaggio di interrogazione come SQL. Essendo basati su testo, questi sistemi lavorano con i dati in un ricco spazio semantico, creando connessioni significative “dietro le quinte”.

Oltre a queste principali aree di applicazione, esistono numerose altre applicazioni, come la telemedicina, gli assistenti per la salute mentale e i chatbot educativi, che possono semplificare la UX e apportare valore ai propri utenti in modo più rapido ed efficiente.

Se questo contenuto educativo approfondito è utile per te, puoi farlo iscriviti alla nostra mailing list di ricerca sull'IA per essere avvisato quando rilasciamo nuovo materiale.

2. Dati

Gli LLM originariamente non sono formati per impegnarsi in chiacchiere fluenti o conversazioni più sostanziali. Piuttosto, imparano a generare il seguente token ad ogni passo dell'inferenza, risultando infine in un testo coerente. Questo obiettivo di basso livello è diverso dalla sfida della conversazione umana. La conversazione è incredibilmente intuitiva per gli esseri umani, ma diventa incredibilmente complessa e ricca di sfumature quando vuoi insegnare a una macchina a farlo. Ad esempio, diamo un'occhiata alla nozione fondamentale di intenti. Quando usiamo il linguaggio, lo facciamo per uno scopo specifico, che è il nostro intento comunicativo: potrebbe essere trasmettere informazioni, socializzare o chiedere a qualcuno di fare qualcosa. Mentre i primi due sono piuttosto semplici per un LLM (a patto che abbia visto le informazioni richieste nei dati), il secondo è già più impegnativo. Il LLM non solo deve combinare e strutturare le informazioni correlate in modo coerente, ma deve anche impostare il giusto tono emotivo in termini di criteri morbidi come formalità, creatività, umorismo, ecc. Questa è una sfida per il design conversazionale. (cfr. paragrafo 5), che è strettamente intrecciato con il compito di creare dati di fine tuning.

Effettuare la transizione dalla generazione del linguaggio classico al riconoscimento e alla risposta a specifici intenti comunicativi è un passo importante verso una migliore usabilità e accettazione dei sistemi conversazionali. Come per tutti gli sforzi di messa a punto, anche questo inizia con la compilazione di un set di dati appropriato.

I dati di precisione dovrebbero avvicinarsi il più possibile alla (futura) distribuzione dei dati nel mondo reale. Innanzitutto, dovrebbero essere dati di conversazione (dialogo). In secondo luogo, se il tuo assistente virtuale sarà specializzato in un dominio specifico, dovresti provare a raccogliere dati di messa a punto che riflettano la conoscenza del dominio necessaria. In terzo luogo, se sono presenti flussi e richieste tipici che ricorreranno frequentemente nella tua applicazione, come nel caso dell'assistenza clienti, prova a incorporarne vari esempi nei dati di addestramento. La tabella seguente mostra un esempio di dati di ottimizzazione della conversazione provenienti da Set di dati delle conversazioni 3K per ChatBot, che è disponibile gratuitamente su Kaggle:

La creazione manuale di dati di conversazione può diventare un'impresa costosa: il crowdsourcing e l'utilizzo di LLM per generare dati sono due modi per crescere. Una volta raccolti i dati del dialogo, le conversazioni devono essere valutate e annotate. Ciò ti consente di mostrare esempi sia positivi che negativi al tuo modello e spingerlo a cogliere le caratteristiche delle conversazioni “giuste”. La valutazione può avvenire sia con punteggi assoluti che con una graduatoria di opzioni diverse tra loro. Quest’ultimo approccio porta a dati di messa a punto più accurati perché gli esseri umani sono normalmente più bravi a classificare più opzioni che a valutarle isolatamente.

Con i tuoi dati a posto, sei pronto per mettere a punto il tuo modello e arricchirlo con funzionalità aggiuntive. Nella sezione successiva, esamineremo la messa a punto, l'integrazione di informazioni aggiuntive dalla memoria e la ricerca semantica e la connessione degli agenti al sistema conversazionale per consentirgli di eseguire compiti specifici.

3. Assemblaggio del sistema conversazionale

Un tipico sistema conversazionale è costruito con un agente conversazionale che orchestra e coordina i componenti e le funzionalità del sistema, come LLM, la memoria e le origini dati esterne. Lo sviluppo di sistemi di intelligenza artificiale conversazionale è un compito altamente sperimentale ed empirico e i tuoi sviluppatori saranno costantemente avanti e indietro tra l'ottimizzazione dei dati, il miglioramento della strategia di messa a punto, il gioco con componenti aggiuntivi e miglioramenti e il test dei risultati . Anche i membri del team non tecnici, inclusi product manager e progettisti UX, testeranno continuamente il prodotto. Sulla base delle loro attività di scoperta dei clienti, sono in un'ottima posizione per anticipare lo stile e il contenuto delle conversazioni dei futuri utenti e dovrebbero contribuire attivamente a questa conoscenza.

3.1 Insegnare abilità di conversazione al tuo LLM

Per l'ottimizzazione sono necessari i dati di ottimizzazione (cfr. sezione 2) e un LLM pre-formato. Gli LLM sanno già molto sulla lingua e sul mondo e la nostra sfida è insegnare loro i principi della conversazione. Nella messa a punto, gli output target sono testi e il modello sarà ottimizzato per generare testi il più simili possibile agli obiettivi. Per la messa a punto supervisionata, è necessario innanzitutto definire chiaramente l'attività di intelligenza artificiale conversazionale che si desidera che il modello esegua, raccogliere i dati ed eseguire e ripetere il processo di messa a punto.

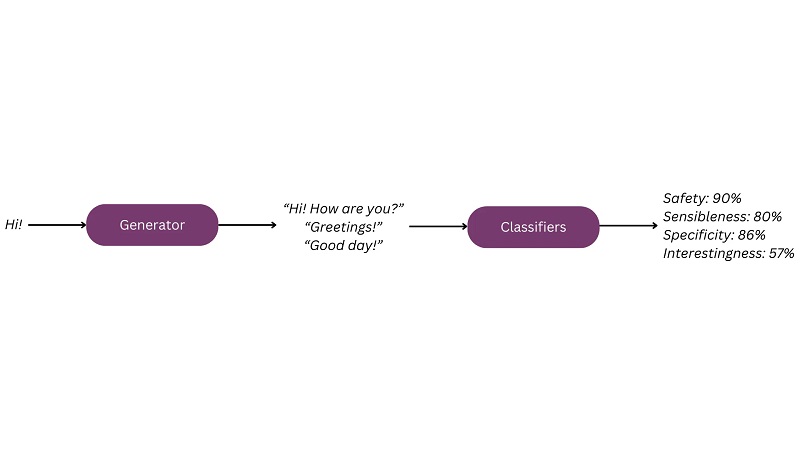

Con il clamore attorno ai LLM, sono emersi una varietà di metodi di messa a punto. Per un esempio piuttosto tradizionale di messa a punto per la conversazione, si può fare riferimento alla descrizione del modello LaMDA.[1] LaMDA è stata messa a punto in due fasi. Innanzitutto, i dati del dialogo vengono utilizzati per insegnare al modello le abilità conversazionali (personalizzazione “generativa”). Quindi, le etichette prodotte dagli annotatori durante la valutazione dei dati vengono utilizzate per addestrare i classificatori in grado di valutare gli output del modello lungo gli attributi desiderati, che includono sensibilità, specificità, interesse e sicurezza (personalizzazione “discriminativa”). Questi classificatori vengono quindi utilizzati per orientare il comportamento del modello verso questi attributi.

Inoltre, la fondatezza fattuale – la capacità di fondare i propri risultati su informazioni esterne credibili – è un attributo importante degli LLM. Per garantire la fondatezza dei fatti e ridurre al minimo le allucinazioni, LaMDA è stato messo a punto con un set di dati che prevede chiamate a un sistema esterno di recupero delle informazioni ogni volta che è richiesta conoscenza esterna. Pertanto, il modello ha imparato a recuperare prima informazioni fattuali ogni volta che l'utente effettuava una query che richiedeva nuove conoscenze.

Un'altra tecnica di perfezionamento popolare è l'apprendimento per rinforzo dal feedback umano (RLHF)[2]. RLHF “reindirizza” il processo di apprendimento del LLM dal semplice ma artificiale compito di previsione del token successivo verso l'apprendimento delle preferenze umane in una data situazione comunicativa. Queste preferenze umane sono codificate direttamente nei dati di addestramento. Durante il processo di annotazione, agli esseri umani vengono presentati dei suggerimenti e scrivono la risposta desiderata o classificano una serie di risposte esistenti. Il comportamento del LLM viene quindi ottimizzato per riflettere la preferenza umana.

3.2 Aggiunta di dati esterni e ricerca semantica

Oltre a compilare conversazioni per mettere a punto il modello, potresti voler migliorare il tuo sistema con dati specializzati che possono essere sfruttati durante la conversazione. Ad esempio, il tuo sistema potrebbe aver bisogno di accedere a dati esterni, come brevetti o articoli scientifici, o dati interni, come i profili dei clienti o la documentazione tecnica. Ciò avviene normalmente tramite la ricerca semantica (nota anche come generazione aumentata con recupero o RAG)[3]. I dati aggiuntivi vengono salvati in un database sotto forma di incorporamenti semantici (cfr. Questo articolo per una spiegazione degli incastri e ulteriori riferimenti). Quando arriva la richiesta dell'utente, viene preelaborata e trasformata in un incorporamento semantico. La ricerca semantica identifica quindi i documenti più rilevanti per la richiesta e li utilizza come contesto per il prompt. Integrando dati aggiuntivi con la ricerca semantica, è possibile ridurre le allucinazioni e fornire risposte più utili e basate sui fatti. Aggiornando continuamente il database di incorporamento, puoi anche mantenere aggiornate le conoscenze e le risposte del tuo sistema senza dover ripetere costantemente il processo di messa a punto.

3.3 Memoria e consapevolezza del contesto

Immagina di andare a una festa e incontrare Peter, un avvocato. Ti entusiasmi e inizi a presentare il chatbot legale che stai attualmente pianificando di costruire. Peter sembra interessato, si sporge verso di te, uhm e annuisce. Ad un certo punto, vuoi la sua opinione sull'opportunità di utilizzare la tua app. Invece di una dichiarazione informativa che compenserebbe la tua eloquenza, senti: "Uhm... cosa stava facendo di nuovo questa app?"

Il contratto non scritto di comunicazione tra gli esseri umani presuppone che ascoltiamo i nostri interlocutori e costruiamo i nostri atti linguistici sul contesto che stiamo co-creando durante l'interazione. Nei contesti sociali, l’emergere di questa comprensione congiunta caratterizza una conversazione fruttuosa e arricchente. In contesti più banali, come prenotare un tavolo al ristorante o acquistare un biglietto del treno, è una necessità assoluta per portare a termine il compito e fornire il valore atteso all'utente. Ciò richiede che il tuo assistente conosca la cronologia della conversazione corrente, ma anche delle conversazioni passate: ad esempio, non dovrebbe chiedere il nome e altri dettagli personali di un utente più e più volte ogni volta che avvia una conversazione.

Una delle sfide nel mantenere la consapevolezza del contesto è la risoluzione della coreferenza, cioè capire a quali oggetti si riferiscono i pronomi. Gli esseri umani utilizzano intuitivamente molti segnali contestuali quando interpretano il linguaggio: ad esempio, puoi chiedere a un bambino piccolo: "Per favore, prendi la palla verde dalla scatola rossa e portamela", e il bambino saprà che intendi la palla. , non la scatola. Per gli assistenti virtuali, questo compito può essere piuttosto impegnativo, come illustrato dalla seguente finestra di dialogo:

Assistente: Grazie, ora prenoto il tuo volo. Desideri ordinare un pasto anche per il tuo volo?

Utente: Uhm... posso decidere più tardi se lo voglio?

Assistente: Siamo spiacenti, questo volo non può essere modificato o cancellato in seguito.

Qui, l'assistente non riesce a riconoscere il pronome it da parte dell'utente non si riferisce al volo, ma al pasto, richiedendo quindi un'altra iterazione per risolvere questo malinteso.

3.4 Guardrail aggiuntivi

Di tanto in tanto, anche il miglior LLM si comporta male e ha allucinazioni. In molti casi, le allucinazioni sono semplici problemi di precisione e, beh, devi accettare che nessuna intelligenza artificiale è accurata al 100%. Rispetto ad altri sistemi di intelligenza artificiale, la “distanza” tra l’utente e l’IA è piuttosto ridotta. Un semplice problema di accuratezza può trasformarsi rapidamente in qualcosa che viene percepito come tossico, discriminatorio o generalmente dannoso. Inoltre, poiché gli LLM non hanno una comprensione intrinseca della privacy, possono anche rivelare dati sensibili come informazioni di identificazione personale (PII). Puoi contrastare questi comportamenti utilizzando guardrail aggiuntivi. Strumenti come Guardrails AI, Rebuff, NeMo Guardrails e Microsoft Guidance ti consentono di ridurre i rischi del tuo sistema formulando requisiti aggiuntivi sugli output LLM e bloccando gli output indesiderati.

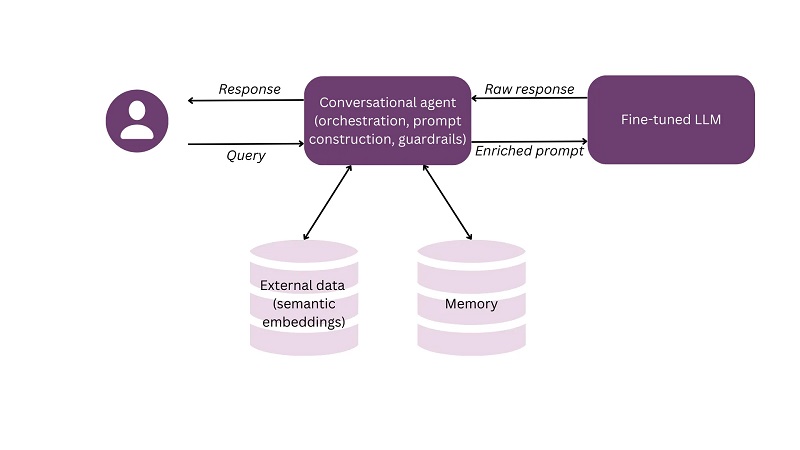

Sono possibili più architetture nell’intelligenza artificiale conversazionale. Lo schema seguente mostra un semplice esempio di come l'LLM ottimizzato, i dati esterni e la memoria possono essere integrati da un agente conversazionale, che è anche responsabile della rapida costruzione e dei guardrail.

4. Esperienza utente e design conversazionale

Il fascino delle interfacce conversazionali risiede nella loro semplicità e uniformità tra le diverse applicazioni. Se il futuro delle interfacce utente è che tutte le app sembrino più o meno uguali, il lavoro del progettista UX è condannato? Sicuramente no: la conversazione è un'arte da insegnare al tuo LLM in modo che possa condurre conversazioni che siano utili, naturali e confortevoli per i tuoi utenti. Un buon design conversazionale emerge quando combiniamo la nostra conoscenza della psicologia umana, della linguistica e del design UX. Di seguito, considereremo innanzitutto due scelte fondamentali quando si costruisce un sistema conversazionale, vale a dire se si utilizzerà la voce e/o la chat, nonché il contesto più ampio del proprio sistema. Quindi, esamineremo le conversazioni stesse e vedremo come puoi progettare la personalità del tuo assistente insegnandogli a impegnarsi in conversazioni utili e cooperative.

4.1 Voce contro chat

Le interfacce conversazionali possono essere implementate utilizzando la chat o la voce. In poche parole, la voce è più veloce mentre la chat consente agli utenti di rimanere privati e di beneficiare di funzionalità dell'interfaccia utente arricchite. Immergiamoci un po' più a fondo nelle due opzioni poiché questa è una delle prime e più importanti decisioni che dovrai affrontare quando crei un'app conversazionale.

Per scegliere tra le due alternative, inizia considerando l'ambiente fisico in cui verrà utilizzata la tua app. Ad esempio, perché quasi tutti i sistemi di conversazione nelle automobili, come quelli offerti da Nuance Communications, sono basati sulla voce? Perché le mani del conducente sono già occupate e non possono passare costantemente dal volante alla tastiera. Questo vale anche per altre attività come la cucina, in cui gli utenti desiderano rimanere nel flusso della loro attività mentre utilizzano la tua app. Le automobili e le cucine sono per lo più ambienti privati, quindi gli utenti possono provare la gioia dell'interazione vocale senza preoccuparsi della privacy o di disturbare gli altri. Al contrario, se la tua app deve essere utilizzata in un ambiente pubblico come un ufficio, una biblioteca o una stazione ferroviaria, la voce potrebbe non essere la tua prima scelta.

Dopo aver compreso l'ambiente fisico, considera il lato emotivo. La voce può essere utilizzata intenzionalmente per trasmettere tono, umore e personalità: questo aggiunge valore nel tuo contesto? Se stai creando la tua app per il tempo libero, la voce potrebbe aumentare il fattore divertimento, mentre un assistente per la salute mentale potrebbe favorire una maggiore empatia e consentire a un utente potenzialmente problematico un diapason espressivo più ampio. Al contrario, se la tua app assisterà gli utenti in un contesto professionale come il trading o il servizio clienti, un’interazione più anonima e basata su testo potrebbe contribuire a decisioni più obiettive e risparmiarti il fastidio di progettare un’esperienza eccessivamente emotiva.

Come passo successivo, pensa alla funzionalità. L'interfaccia basata su testo ti consente di arricchire le conversazioni con altri media come immagini ed elementi grafici dell'interfaccia utente come i pulsanti. Ad esempio, in un assistente di e-commerce, un'app che suggerisce prodotti pubblicando immagini e descrizioni strutturate sarà molto più user-friendly di un'app che descrive i prodotti tramite voce e potenzialmente fornisce i loro identificatori.

Infine, parliamo delle ulteriori sfide di progettazione e sviluppo legate alla creazione di un'interfaccia utente vocale:

- Esiste un ulteriore passaggio di riconoscimento vocale che avviene prima che gli input dell'utente possano essere elaborati con LLM e Natural Language Processing (NLP).

- La voce è un mezzo di comunicazione più personale ed emotivo: pertanto, i requisiti per progettare una persona coerente, appropriata e divertente dietro il tuo assistente virtuale sono più elevati e dovrai prendere in considerazione ulteriori fattori di "progettazione vocale" come il timbro , stress, tono e velocità di parola.

- Gli utenti si aspettano che la tua conversazione vocale proceda alla stessa velocità di una conversazione umana. Per offrire un'interazione naturale tramite voce è necessaria una latenza molto più breve rispetto alla chat. Nelle conversazioni umane, l'intervallo tipico tra i turni è di 200 millisecondi: questa risposta rapida è possibile perché iniziamo a costruire i nostri turni mentre ascoltiamo il discorso del nostro partner. Il tuo assistente vocale dovrà corrispondere a questo grado di fluidità nell'interazione. Al contrario, per i chatbot, si compete con intervalli di tempo di pochi secondi e alcuni sviluppatori introducono addirittura un ulteriore ritardo per far sembrare la conversazione una chat digitata tra umani.

- La comunicazione tramite voce è un'impresa lineare e una tantum: se l'utente non ha capito ciò che hai detto, ti trovi in un ciclo di chiarimenti noioso e soggetto a errori. Pertanto, i tuoi turni devono essere il più concisi, chiari e informativi possibile.

Se scegli la soluzione vocale, assicurati non solo di comprendere chiaramente i vantaggi rispetto alla chat, ma di avere anche le competenze e le risorse per affrontare queste sfide aggiuntive.

4.2 Dove vivrà la tua IA conversazionale?

Consideriamo ora il contesto più ampio in cui è possibile integrare l'intelligenza artificiale conversazionale. Tutti noi abbiamo familiarità con i chatbot sui siti Web aziendali: quei widget sulla destra dello schermo che compaiono quando apriamo il sito Web di un'azienda. Personalmente, il più delle volte, la mia reazione intuitiva è cercare il pulsante Chiudi. Perché? Dai primi tentativi di “conversare” con questi bot, ho imparato che non possono soddisfare esigenze informative più specifiche e, alla fine, devo ancora spulciare il sito. La morale della storia? Non costruire un chatbot perché è bello e trendy, piuttosto, costruiscilo perché sei sicuro che possa creare valore aggiuntivo per i tuoi utenti.

Al di là del controverso widget sul sito web di un'azienda, ci sono diversi contesti interessanti per integrare quei chatbot più generali che sono diventati possibili con i LLM:

- Copiloti: questi assistenti ti guidano e ti consigliano attraverso processi e attività specifici, come GitHub CoPilot per la programmazione. Normalmente, i copiloti sono “legati” a un’applicazione specifica (o a una piccola suite di applicazioni correlate).

- Umani sintetici (anche umani digitali): queste creature “emulano” gli esseri umani reali nel mondo digitale. Sembrano, agiscono e parlano come gli esseri umani e quindi necessitano anche di ricche capacità di conversazione. Gli esseri umani sintetici sono spesso utilizzati in applicazioni immersive come i giochi e la realtà aumentata e virtuale.

- Gemelli digitali: I gemelli digitali sono “copie” digitali di processi e oggetti del mondo reale, come fabbriche, automobili o motori. Vengono utilizzati per simulare, analizzare e ottimizzare il design e il comportamento dell'oggetto reale. Le interazioni del linguaggio naturale con i gemelli digitali consentono un accesso più fluido e versatile ai dati e ai modelli.

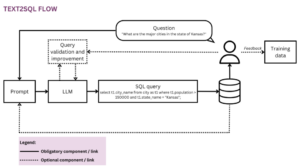

- Database: Al giorno d'oggi, i dati sono disponibili su qualsiasi argomento, che si tratti di consigli di investimento, frammenti di codice o materiale didattico. Ciò che spesso è difficile è trovare i dati molto specifici di cui gli utenti hanno bisogno in una situazione specifica. Le interfacce grafiche ai database sono troppo grossolane o coperte da infiniti widget di ricerca e filtro. Linguaggi di query versatili come SQL e GraphQL sono accessibili solo agli utenti con le competenze corrispondenti. Le soluzioni conversazionali consentono agli utenti di interrogare i dati in linguaggio naturale, mentre il LLM che elabora le richieste le converte automaticamente nel corrispondente linguaggio di interrogazione (cfr. Questo articolo per una spiegazione di Text2SQL).

4.3 Imprimere una personalità al tuo assistente

Come esseri umani, siamo programmati per antropomorfizzare, cioè per infliggere tratti umani aggiuntivi quando vediamo qualcosa che somiglia vagamente a un essere umano. Il linguaggio è una delle abilità più uniche e affascinanti del genere umano e i prodotti conversazionali verranno automaticamente associati agli esseri umani. Le persone immagineranno una persona dietro il proprio schermo o dispositivo ed è buona norma non lasciare questa persona specifica al libero arbitrio dell'immaginazione dei tuoi utenti, ma piuttosto darle una personalità coerente che sia in linea con il tuo prodotto e marchio. Questo processo è chiamato “progettazione della persona”.

Il primo passo del design della persona è comprendere i tratti caratteriali che vorresti che la tua persona mostrasse. Idealmente, questo è già fatto a livello dei dati di addestramento: ad esempio, quando usi RLHF, puoi chiedere ai tuoi annotatori di classificare i dati in base a tratti come disponibilità, gentilezza, divertimento, ecc., al fine di orientare il modello verso le caratteristiche desiderate. Queste caratteristiche possono essere abbinate agli attributi del tuo marchio per creare un'immagine coerente che promuova continuamente il tuo marchio attraverso l'esperienza del prodotto.

Al di là delle caratteristiche generali, dovresti anche pensare a come il tuo assistente virtuale affronterà situazioni specifiche oltre il “percorso felice”. Ad esempio, come risponderà alle richieste degli utenti che esulano dal suo ambito, risponderà alle domande su se stesso e gestirà il linguaggio offensivo o volgare?

È importante sviluppare linee guida interne esplicite sulla tua persona che possano essere utilizzate dagli annotatori di dati e dai progettisti di conversazioni. Ciò ti consentirà di progettare la tua persona in modo mirato e mantenerla coerente all'interno del tuo team e nel tempo, poiché la tua applicazione subisce molteplici iterazioni e perfezionamenti.

4.4 Rendere utili le conversazioni secondo il “principio di cooperazione”

Hai mai avuto l'impressione di parlare con un muro di mattoni mentre in realtà stavi parlando con un essere umano? A volte, scopriamo che i nostri interlocutori semplicemente non sono interessati a portare la conversazione al successo. Fortunatamente, nella maggior parte dei casi, le cose vanno più agevolmente e gli esseri umani seguiranno intuitivamente il “principio di cooperazione” introdotto dal filosofo del linguaggio Paul Grice. Secondo questo principio, gli esseri umani che comunicano con successo tra loro seguono quattro massime: quantità, qualità, pertinenza e modo.

Massima di quantità

La massima della quantità richiede a chi parla di essere informativo e di fornire il proprio contributo tanto informativo quanto richiesto. Da parte dell’assistente virtuale, ciò significa anche portare avanti attivamente la conversazione. Ad esempio, considera questo snippet di un'app di moda e-commerce:

Assistente: Che tipo di capi di abbigliamento stai cercando?

Utente: Cerco un vestito arancione.

Assistente: Non: Siamo spiacenti, non abbiamo vestiti arancioni al momento.

Fare: Mi dispiace, non abbiamo vestiti in arancione, ma abbiamo questo vestito fantastico e molto comodo in giallo:...

L'utente spera di lasciare la tua app con un elemento adatto. Interrompere la conversazione perché non hai elementi che corrispondano alla descrizione esatta elimina ogni possibilità di successo. Tuttavia, se la tua app fornisce suggerimenti su elementi alternativi, apparirà più utile e lascerà aperta la possibilità di un'interazione riuscita.

Soprattutto nelle interazioni vocali, è importante trovare il giusto equilibrio tra fornire tutte le informazioni di cui l'utente potrebbe aver bisogno per avere successo senza sovraccaricarlo con informazioni non necessarie che potrebbero offuscare l'interazione.

Massima della qualità

La massima della qualità chiede agli oratori di essere sinceri e di non dire cose che credono false o per le quali non hanno prove adeguate. C'è molta soggettività e convinzioni personali coinvolte qui, quindi questa massima non può essere proiettata direttamente sui LLM. Come abbiamo visto, gli LLM tendono ad avere allucinazioni, e questo rischio è particolarmente elevato quando la conversazione si sposta verso territori meno familiari. È possibile utilizzare ulteriori guardrail per evitare dichiarazioni fuorvianti e riportare la conversazione sulla buona strada.

Massima di pertinenza

La massima della pertinenza ci chiede di essere... beh, rilevanti. Come precondizione, l'assistente virtuale deve comprendere il vero intento dell'utente. Ecco un esempio di un assistente di compagnia aerea che viola questa regola:

Utente: Domani mattina mi serve un volo da Berlino a Zurigo.

Assistente: OK, ho trovato i seguenti voli da Berlino a Zurigo per domani mattina. Il volo BZ36294 parte da Berlino alle 6.30:8 e arriva a Zurigo alle 96294:8. Il volo BZ9.30 parte da Berlino alle 96294:8 e arriva alle 9.30:95614. Il volo BZ11 parte da Berlino alle 12.30:11.45 e arriva a Zurigo alle 3:XNUMX. Il volo BZXNUMX parte da Berlino alle XNUMX:XNUMX e arriva a Zurigo alle XNUMX:XNUMX. Esiste anche la possibilità di un volo in coincidenza, in questo caso lasceresti Berlino alle XNUMX:XNUMX e arriveresti a Zurigo alle XNUMX:XNUMX.

Utente: Scusa... potresti ripeterlo di nuovo?

L'assistente travolge l'utente con informazioni dettagliate che potrebbero non essere rilevanti. Suddividendo questo e guidando l'utente a limitare il proprio spazio di ricerca, il dialogo diventa molto più facile da digerire:

Utente: Domani mattina mi serve un volo da Berlino a Zurigo.

Assistente: Ok, ho trovato voli in partenza alle 6.30, 8 e 11. A che ora vorresti partire?

Utente: Devo essere a Zurigo prima delle 9.

Assistente: OK, allora puoi prendere il volo BZ36294. Parte alle 6.30 e arriva alle 8. Devo comprarti il biglietto?

Utente: Sì grazie.

Massima di maniera

Infine, la massima di maniera afferma che i nostri atti linguistici dovrebbero essere chiari, concisi e ordinati, evitando ambiguità e oscurità di espressione. Il tuo assistente virtuale dovrebbe evitare il gergo tecnico o interno e favorire formulazioni semplici e universalmente comprensibili.

Sebbene i principi di Grice siano validi per tutte le conversazioni indipendentemente da un dominio specifico, gli LLM non formati specificamente per la conversazione spesso non riescono a soddisfarli. Pertanto, quando si compilano i dati di addestramento, è importante disporre di un numero sufficiente di esempi di dialogo che consentano al modello di apprendere questi principi.

Il dominio del design conversazionale si sta sviluppando piuttosto rapidamente. Che tu stia già costruendo prodotti di intelligenza artificiale o pensando al tuo percorso professionale nell'intelligenza artificiale, ti incoraggio ad approfondire questo argomento (cfr. le eccellenti introduzioni in [5] e [6]). Poiché l’intelligenza artificiale si sta trasformando in una merce, una buona progettazione insieme a una strategia di dati difendibile diventeranno due importanti elementi di differenziazione per i prodotti di intelligenza artificiale.

Sommario

Riassumiamo i punti salienti dell'articolo. Inoltre, la figura 5 offre un "cheat sheet" con i punti principali che è possibile scaricare come riferimento.

- Gli LLM migliorano l'intelligenza artificiale conversazionale: i Large Language Models (LLM) hanno migliorato significativamente la qualità e la scalabilità delle applicazioni di intelligenza artificiale conversazionale in vari settori e casi d'uso.

- L'intelligenza artificiale conversazionale può aggiungere molto valore alle applicazioni con molte richieste utente simili (ad esempio, il servizio clienti) o che necessitano di accedere a una grande quantità di dati non strutturati (ad esempio, gestione della conoscenza).

- Dati: la messa a punto degli LLM per le attività di conversazione richiede dati di conversazione di alta qualità che rispecchino fedelmente le interazioni del mondo reale. I dati generati dal crowdsourcing e dal LLM possono essere risorse preziose per ridimensionare la raccolta dei dati.

- Mettere insieme il sistema: lo sviluppo di sistemi di intelligenza artificiale conversazionale è un processo iterativo e sperimentale che coinvolge l'ottimizzazione costante dei dati, la messa a punto delle strategie e l'integrazione dei componenti.

- Insegnare abilità di conversazione ai LLM: perfezionare i LLM implica addestrarli a riconoscere e rispondere a specifici intenti e situazioni comunicativi.

- Aggiunta di dati esterni con la ricerca semantica: l'integrazione di fonti di dati esterne e interne utilizzando la ricerca semantica migliora le risposte dell'intelligenza artificiale fornendo informazioni più rilevanti dal punto di vista contestuale.

- Memoria e consapevolezza del contesto: sistemi conversazionali efficaci devono mantenere la consapevolezza del contesto, incluso il monitoraggio della storia della conversazione attuale e delle interazioni passate, per fornire risposte significative e coerenti.

- Impostazione dei guardrail: per garantire un comportamento responsabile, i sistemi di intelligenza artificiale conversazionale dovrebbero utilizzare guardrail per prevenire imprecisioni, allucinazioni e violazioni della privacy.

- Progettazione della persona: progettare una persona coerente per il tuo assistente conversazionale è essenziale per creare un'esperienza utente coesa e brandizzata. Le caratteristiche della persona dovrebbero essere in linea con gli attributi del tuo prodotto e del tuo marchio.

- Voce o chat: la scelta tra le interfacce voce e chat dipende da fattori come l'ambiente fisico, il contesto emotivo, la funzionalità e le sfide di progettazione. Considera questi fattori quando decidi l'interfaccia per la tua IA conversazionale.

- Integrazione in vari contesti: l'intelligenza artificiale conversazionale può essere integrata in diversi contesti, inclusi copiloti, esseri umani sintetici, gemelli digitali e database, ciascuno con casi d'uso e requisiti specifici.

- Rispetto del principio di cooperazione: seguire i principi di quantità, qualità, pertinenza e modalità nelle conversazioni può rendere le interazioni con l'intelligenza artificiale conversazionale più utili e facili da usare.

Riferimenti

[1] Heng-Tze Chen et al. 2022. LaMDA: verso modelli di dialogo sicuri, radicati e di alta qualità per tutto.

[2] ApriAI. 2022. ChatGPT: Ottimizzazione dei modelli linguistici per il dialogo. Estratto il 13 gennaio 2022.

[3] Patrick Lewis et al. 2020. Generazione aumentata di recupero per attività di PNL ad alta intensità di conoscenza.

[4] Paolo Grice. 1989. Studi sulla via delle parole.

[5] Cathy Perla. 2016. Progettazione di interfacce utente vocali.

[6] Michael Cohen et al. 2004. Progettazione dell'interfaccia utente vocale.

Nota: tutte le immagini sono dell'autore, salvo diversa indicazione.

Questo articolo è stato pubblicato in origine Verso la scienza dei dati e ripubblicato su TOPBOTS con il permesso dell'autore.

Ti piace questo articolo? Iscriviti per ulteriori aggiornamenti sulla ricerca AI.

Ti faremo sapere quando pubblicheremo altri articoli di riepilogo come questo.

Leggi Anche

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://www.topbots.com/redefining-conversational-ai-with-large-language-models/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 11

- 12

- 125

- 13

- 14

- 17

- 200

- 2016

- 2020

- 2022

- 30

- 32

- 35%

- 41

- 7

- 70

- 8

- 9

- a

- abilità

- capacità

- Chi siamo

- Assoluta

- Accetta

- accettazione

- accesso

- accessibile

- accessibile

- ospitare

- realizzare

- Secondo

- Il mio account

- Accumulare

- precisione

- preciso

- operanti in

- Legge

- attivamente

- attività

- attività

- atti

- effettivamente

- aggiungere

- l'aggiunta di

- aggiuntivo

- Informazioni aggiuntive

- Inoltre

- indirizzo

- Adozione

- avanzamenti

- Vantaggio

- vantaggi

- aiutarti

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- contro

- Agente

- agenti

- fa

- AI

- ricerca ai

- Sistemi di intelligenza artificiale

- compagnia aerea

- AL

- allineare

- Allineati

- Tutti

- consentire

- consente

- quasi

- lungo

- già

- anche

- alternativa

- alternative

- am

- Ambiguità

- tra

- an

- analizzare

- ed

- Anonimo

- Un altro

- anticipare

- in qualsiasi

- App

- apparire

- Applicazioni

- applicazioni

- si applica

- approccio

- opportuno

- applicazioni

- SONO

- aree

- in giro

- Arriva

- Arte

- articolo

- news

- artificiale

- AS

- chiedere

- chiedendo

- valutare

- valutato

- valutazione

- attività

- assistere

- Assistant

- assistenti

- associato

- At

- Tentativi

- attenzione

- gli attributi

- aumentare

- aumentata

- autore

- automaticamente

- disponibile

- evitare

- evitando

- consapevolezza

- lontano

- precedente

- di nuovo in pista

- Equilibrio

- palla

- base

- basato

- basic

- BE

- perché

- diventare

- diventa

- stato

- prima

- comportamento

- comportamenti

- dietro

- essendo

- fede

- CREDIAMO

- diletto

- beneficio

- Berlin

- MIGLIORE

- best practice

- Meglio

- fra

- Al di là di

- pregiudizio

- Po

- blocco

- libro

- entrambi

- bots

- Scatola

- marca

- marcato

- marchio

- violazioni

- Rottura

- portare

- più ampia

- portato

- costruire

- Costruzione

- costruito

- affari

- occupato

- ma

- pulsante

- Acquistare

- Acquisto

- by

- detto

- Bandi

- è venuto

- Materiale

- non può

- funzionalità

- Career

- auto

- Custodie

- casi

- Cathy

- centro

- Challenge

- sfide

- impegnativo

- possibilità

- cambiato

- canale

- carattere

- caratteristiche

- caratterizza

- chatbot

- chatbots

- ChatGPT

- chen

- bambino

- scegliere

- scelte

- la scelta

- pulire campo

- chiaramente

- Chiudi

- strettamente

- Abbigliamento

- Cloud

- codice

- cohen

- COERENTE

- coesivo

- collaborazione

- collezione

- combinare

- Venire

- viene

- confortevole

- merce

- comunicare

- Comunicazione

- Comunicazioni

- Aziende

- azienda

- rispetto

- competere

- complesso

- componente

- componenti

- concerto

- conciso

- Segui il codice di Condotta

- collegato

- Collegamento

- Connessioni

- Prendere in considerazione

- considerando

- coerente

- costante

- costantemente

- costruire

- costruzione

- contatti

- contenuto

- contesto

- contesti

- contestuale

- continuamente

- contratto

- contrasto

- contribuire

- contribuendo

- contributo

- controverso

- Conversazione

- discorsivo

- AI conversazionale

- Conversazioni

- Froids

- cooperazione

- cooperativa

- Nucleo

- Corrispondente

- potuto

- Coppia

- Portata

- coperto

- creare

- Creazione

- la creatività

- creature

- credibile

- criteri

- crowdsourcing

- Corrente

- Attualmente

- curva

- cliente

- Servizio clienti

- Assistenza clienti

- Clienti

- dati

- strategia di dati

- Banca Dati

- banche dati

- morto

- affare

- decenni

- decide

- Decidere

- decisioni

- più profondo

- definire

- decisamente

- Laurea

- ritardo

- dipende

- descrizione

- Design

- Designer

- designer e gli illustratori veneziani,

- progettazione

- desiderato

- dettagliati

- dettagli

- sviluppare

- sviluppato

- sviluppatori

- in via di sviluppo

- Mercato

- dispositivo

- dispositivi

- dialogo

- Dialogo

- diverso

- differenziatore

- difficile

- DIG

- digerire

- digitale

- Gemelli digitali

- mondo digitale

- direttamente

- scoperta

- Dsiplay

- distribuzione

- immersione

- do

- documentazione

- documenti

- effettua

- Cane

- fare

- dominio

- fatto

- Dont

- Doomed

- scaricare

- autista

- dovuto

- durante

- e

- e-commerce

- E&T

- ogni

- più facile

- educativo

- Efficace

- efficienza

- efficiente

- o

- elementi

- incorporamento

- emerse

- emersione

- emerge

- empatia

- dipendenti

- e potenza

- consentendo

- incoraggiare

- fine

- sforzi

- Senza fine

- impegnarsi

- Motori

- accrescere

- miglioramenti

- Migliora

- piacevole

- abbastanza

- arricchire

- arricchito

- arricchendo

- garantire

- Impresa

- particolarmente

- essential

- eccetera

- la valutazione

- Anche

- alla fine

- EVER

- prova

- di preciso

- esempio

- Esempi

- eccellente

- Tranne

- eccesso

- eccitato

- coinvolgenti

- eseguire

- esistente

- attenderti

- previsto

- costoso

- esperienza

- sperimentale

- Spiegare

- spiegazione

- espressione

- esterno

- Faccia

- fattore

- fabbriche

- Fattori

- FAIL

- fallisce

- Fallimento

- cadute

- falso

- familiare

- affascinante

- Moda

- più veloce

- feedback

- sentire

- figura

- filtro

- ultimare

- Trovare

- Nome

- in forma

- Fissare

- volo

- Voli

- flusso

- fluente

- flussi

- Focus

- seguire

- seguito

- i seguenti

- Nel

- modulo

- formale

- formulando

- per fortuna

- Avanti

- essere trovato

- quattro

- frequente

- frequentemente

- da

- anteriore

- frustrante

- Adempiere

- ti divertirai

- funzionalità

- fondamentale

- ulteriormente

- futuro

- gaming

- divario

- raccogliere

- Generale

- generalmente

- generare

- ELETTRICA

- ottenere

- GitHub

- dato

- Go

- va

- andando

- buono

- grande

- Green

- Terra

- guida

- guida

- linee guida

- ha avuto

- Mani

- accadere

- accade

- Hard

- dannoso

- Avere

- he

- Salute e benessere

- sentire

- Aiuto

- utile

- suo

- qui

- nascosto

- Alta

- alta qualità

- superiore

- vivamente

- il suo

- storia

- Colpire

- olistica

- speranza

- spera

- HOT

- Come

- Tuttavia

- HTML

- http

- HTTPS

- Enorme

- umano

- Gli esseri umani

- umorismo

- Montatura

- i

- idealmente

- identificatori

- identifica

- if

- illustra

- Immagine

- immagini

- immaginazioni

- immagine

- immersiva

- implementato

- importante

- migliorata

- miglioramento

- in

- Uno sguardo approfondito sui miglioramenti dei pneumatici da corsa di Bridgestone.

- includere

- Compreso

- incorporare

- Aumento

- incredibilmente

- indipendentemente

- individuale

- industrie

- infliggere

- informazioni

- informativo

- inerente

- inizialmente

- avviare

- Ingressi

- invece

- integrare

- integrato

- Integrazione

- integrazione

- intento

- apposta

- interagire

- interazione

- interazioni

- interattivo

- Sistemi di risposta vocale interattivi

- interessato

- Interfaccia

- interfacce

- interno

- intrecciate

- ai miglioramenti

- introdurre

- introdotto

- Introduzione

- introduzioni

- intuitivo

- investimento

- raccomandazioni di investimento

- coinvolto

- coinvolgendo

- da solo

- problema

- sicurezza

- IT

- elementi

- iterazione

- iterazioni

- SUO

- stessa

- IVR

- Gennaio

- gergo

- Lavoro

- giunto

- jpg

- ad appena

- mantenere

- Le

- parole chiave

- Genere

- Sapere

- conoscenze

- Gestione della conoscenza

- conosciuto

- per il tuo brand

- Dipingere

- Lingua

- Le Lingue

- grandi

- larga scala

- superiore, se assunto singolarmente.

- Latenza

- dopo

- avvocato

- principale

- Leads

- IMPARARE

- imparato

- apprendimento

- Lasciare

- partenza

- Eredità

- Legale

- prestare

- meno

- lasciare

- Livello

- livelli

- Leva

- leveraged

- leveraging

- Lewis

- Biblioteca

- si trova

- piace

- LIMITE

- Limitato

- Ascolto

- vivere

- LLM

- logica

- Lunghi

- Guarda

- cerca

- SEMBRA

- perdite

- lotto

- lotti

- macchina

- fatto

- mailing

- Principale

- mantenere

- Mantenere

- maggiore

- make

- FA

- Fare

- gestito

- gestione

- I gestori

- modo

- molti

- Rappresentanza

- opportunità di mercato

- partita

- abbinato

- materiale

- Materiale

- max-width

- Massima

- me

- significare

- significativo

- si intende

- Media

- medie

- incontro

- Utenti

- Memorie

- mentale

- Salute mentale

- metodi

- Michael

- Microsoft

- forza

- millisecondi

- minato

- ingannevole

- equivoco

- modello

- modelli

- moderno

- momento

- mese

- morale

- Scopri di più

- più efficiente

- Mattina

- maggior parte

- soprattutto

- in movimento

- molti

- multiplo

- moltitudine

- devono obbligatoriamente:

- my

- me

- Nome

- cioè

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- necessità

- Bisogno

- di applicazione

- esigenze

- negativo.

- mai

- New

- nuova app

- GENERAZIONE

- nlp

- no

- non tecnico

- Nessuna

- normalmente

- noto

- Nozione

- adesso

- Ombra

- numero

- numerose

- guscio di noce

- oggetto

- obiettivo

- oggetti

- of

- MENO

- offrire

- offerto

- Offerte

- Office

- di frequente

- on

- una volta

- ONE

- esclusivamente

- su

- aprire

- OpenAI

- operativo

- Operazioni

- Opinione

- Opportunità

- Opportunità

- ottimizzazione

- OTTIMIZZA

- ottimizzati

- ottimizzazione

- Opzione

- Opzioni

- or

- Arancio

- minimo

- originariamente

- Altro

- Altri

- altrimenti

- nostro

- su

- uscite

- al di fuori

- ancora

- travolgente

- proprio

- pagina

- documenti

- paradigma

- partner

- partito

- Passato

- passato

- Brevetti

- sentiero

- pazientemente

- patrick

- modelli

- Paul

- Persone

- per

- percepito

- Eseguire

- autorizzazione

- persona

- cronologia

- Personalità

- Personalmente

- Peter

- Fisico

- scegliere

- Immagini

- pitching

- posto

- pianura

- pianificazione

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- punto

- punti

- povero

- pop

- Popolare

- posizione

- positivo

- possibilità

- possibile

- potenziale

- potenzialmente

- pratica

- pratiche

- predizione

- preferenze

- presentata

- prevenire

- principio

- principi

- Privacy

- un bagno

- procedere

- processi

- Elaborato

- i processi

- lavorazione

- Prodotto

- Prodotto

- Prodotti

- professionale

- Profili

- Programmazione

- proiettato

- prominente

- promuove

- protocollo

- fornire

- fornisce

- fornitura

- Psicologia

- la percezione

- pubblicato

- scopo

- Spingi

- spinge

- qualità

- quantità

- query

- Domande

- rapidamente

- classifica

- Posizione

- piuttosto

- reazione

- pronto

- di rose

- mondo reale

- Realtà

- riconoscimento

- riconoscere

- riconoscendo

- raccomandazioni

- ricorrenti

- Rosso

- Ridefinendo

- ridurre

- riferimento

- riferimento

- Riferimenti

- di cui

- si riferisce

- riflettere

- riflette

- relazionato

- rilasciare

- rilevanza

- pertinente

- basandosi

- rimanere

- ripetere

- sostituito

- rispondere

- richiesta

- richieste

- necessario

- Requisiti

- richiede

- riparazioni

- assomiglia

- Risoluzione

- Risorse

- Rispondere

- risponde

- risposta

- risposte

- responsabile

- al Deck ristorante

- risultante

- Risultati

- rivelare

- Ricco

- destra

- Rischio

- Regola

- norme

- Correre

- sicura

- Sicurezza

- Suddetto

- stesso

- soddisfazione

- salvato

- dire

- Scalabilità

- Scala

- scala

- scientifico

- portata

- allo

- Cerca

- Secondo

- secondo

- Sezione

- vedere

- visto

- delicata

- Serie

- servizio

- set

- regolazione

- impostazioni

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- lato

- segno

- significativamente

- simile

- Un'espansione

- semplicità

- da

- Seduta

- situazione

- situazioni

- abilità

- piccole

- più liscia

- frammento

- So

- Social

- socializzare

- Soft

- venduto

- soluzione

- Soluzioni

- alcuni

- Qualcuno

- qualcosa

- a volte

- presto

- fonti

- lo spazio

- campate

- parlare

- Speaker

- Altoparlanti

- parlando

- specializzata

- specifico

- in particolare

- specificità

- discorso

- Riconoscimento vocale

- velocità

- inizia a

- iniziato

- inizio

- dichiarazione

- dichiarazioni

- stati

- stazione

- statistiche

- soggiorno

- guidare

- sterzo

- step

- Passi

- Ancora

- sosta

- memorizzati

- Storia

- lineare

- strategie

- Strategia

- snellire

- stress

- La struttura

- strutturato

- studi

- style

- sostanziale

- il successo

- di successo

- Con successo

- tale

- suggerisce

- adatto

- suite

- riassumere

- SOMMARIO

- supporto

- sicuro

- swing

- Interruttore

- simbolico

- sintassi

- sintetico

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- Takeaways

- Parlare

- parlando

- rubinetti

- Target

- obiettivi

- Task

- task

- insegnato

- Insegnamento

- team

- Membri del team

- Consulenza

- per l'esame

- Tecnologia

- telemedicina

- condizioni

- territori

- Testing

- testo

- di

- Grazie

- che

- I

- Il futuro

- le informazioni

- il mondo

- loro

- Li

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- think

- Pensiero

- Terza

- questo

- quelli

- tre

- Attraverso

- così

- biglietto

- biglietti

- tempo

- volte

- a

- insieme

- token

- domani

- TONE

- pure

- strumenti

- TOPBOT

- argomento

- verso

- verso

- pista

- Tracking

- Trading

- tradizionale

- Treni

- allenato

- Training

- Trasformare

- trasformato

- transizione

- transizioni

- trasmettere

- innescato

- vero

- prova

- TURNO

- Svolta

- si

- Gemelli

- seconda

- tipico

- ui

- subisce

- capire

- comprensibile

- e una comprensione reciproca

- unico

- universale

- universalmente

- inutile

- up-to-date

- Aggiornamenti

- aggiornamento

- us

- usabilità

- uso

- utilizzato

- Utente

- Esperienza da Utente

- Interfaccia utente

- progettazione dell'interfaccia utente

- user-friendly

- utenti

- usa

- utilizzando

- ux

- Progettazione UX

- progettista utente

- ux designer

- un valido

- Prezioso

- APPREZZIAMO

- varietà

- vario

- versatile

- contro

- molto

- via

- Vittima

- virtuale

- assistente virtuale

- La realtà virtuale

- Voce

- vs

- Volgare

- W3

- Muro

- volere

- vuole

- Prima

- onde

- Modo..

- modi

- we

- Ricchezza

- Sito web

- siti web

- WELL

- sono stati

- Che

- Che cosa è l'

- Ruota

- quando

- ogni volta che

- se

- quale

- while

- OMS

- perché

- volere

- finestre

- con

- senza

- parole

- Lavora

- lavoratori

- mondo

- preoccupante

- sarebbe

- scrivere

- anno

- anni

- Tu

- giovane

- Trasferimento da aeroporto a Sharm

- zefiro

- Zurigo