Questo è un guest post scritto in collaborazione con il team PyTorch di Meta ed è la continuazione di Parte 1 di questa serie, in cui dimostriamo le prestazioni e la facilità di esecuzione di PyTorch 2.0 su AWS.

La ricerca sull'apprendimento automatico (ML) ha dimostrato che i modelli linguistici di grandi dimensioni (LLM) addestrati con set di dati significativamente grandi determinano una migliore qualità del modello. Negli ultimi anni, la dimensione dei modelli della generazione attuale è aumentata in modo significativo e richiedono strumenti e infrastrutture moderni per essere addestrati in modo efficiente e su larga scala. PyTorch Distributed Data Parallelism (DDP) aiuta a elaborare i dati su larga scala in modo semplice e robusto, ma richiede che il modello si adatti a una GPU. La libreria PyTorch Fully Sharded Data Parallel (FSDP) supera questa barriera consentendo lo sharding del modello per addestrare modelli di grandi dimensioni tra lavoratori paralleli dei dati.

L'addestramento del modello distribuito richiede un cluster di nodi di lavoro in grado di scalare. Servizio Amazon Elastic Kubernetes (Amazon EKS) è un popolare servizio conforme a Kubernetes che semplifica notevolmente il processo di esecuzione dei carichi di lavoro AI/ML, rendendolo più gestibile e richiede meno tempo.

In questo post del blog, AWS collabora con il team PyTorch di Meta per discutere come utilizzare la libreria PyTorch FSDP per ottenere il dimensionamento lineare dei modelli di deep learning su AWS senza problemi utilizzando Amazon EKS e Contenitori per l'apprendimento profondo AWS (DLC). Lo dimostriamo attraverso un'implementazione passo-passo dell'addestramento dei modelli Llama7 13B, 70B e 2B utilizzando Amazon EKS con 16 Cloud di calcolo elastico di Amazon (Amazon EC2) p4de.24xlarge istanze (ciascuna con 8 GPU NVIDIA A100 Tensor Core e ciascuna GPU con 80 GB di memoria HBM2e) o 16 EC2 p5.48xgrande istanze (ciascuna con 8 GPU NVIDIA H100 Tensor Core e ciascuna GPU con 80 GB di memoria HBM3), ottenendo una scalabilità quasi lineare nel throughput e, in definitiva, consentendo tempi di addestramento più rapidi.

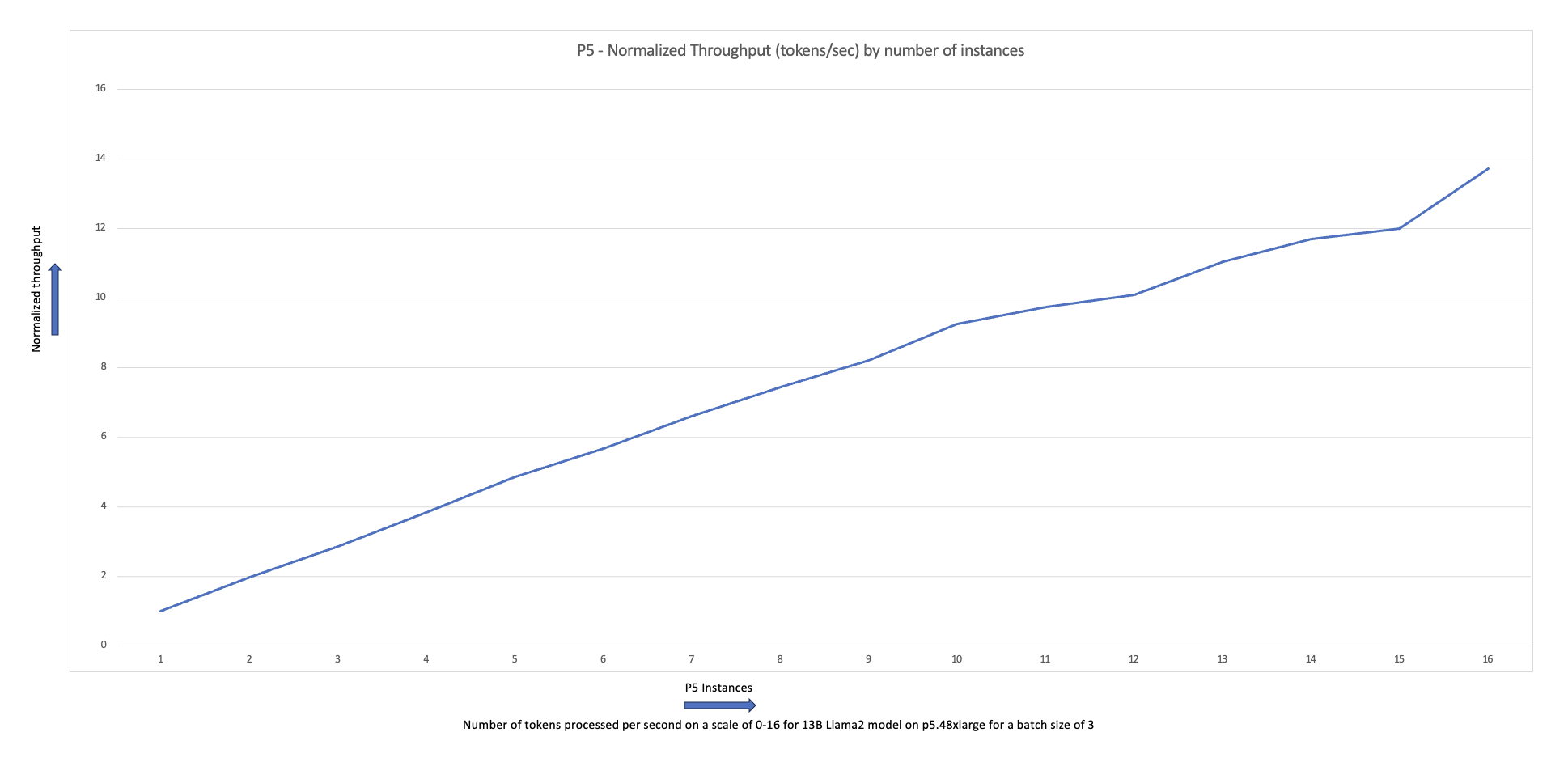

Il seguente grafico di dimensionamento mostra che le istanze p5.48xlarge offrono un'efficienza di dimensionamento dell'87% con la regolazione fine di FSDP Llama2 in una configurazione di cluster a 16 nodi.

Le sfide della formazione dei LLM

Le aziende stanno adottando sempre più LLM per una serie di attività, tra cui assistenti virtuali, traduzione, creazione di contenuti e visione artificiale, per migliorare l'efficienza e la precisione in una varietà di applicazioni.

Tuttavia, l'addestramento o la messa a punto di questi modelli di grandi dimensioni per un caso d'uso personalizzato richiede una grande quantità di dati e potenza di calcolo, il che si aggiunge alla complessità ingegneristica complessiva dello stack ML. Ciò è dovuto anche alla memoria limitata disponibile su una singola GPU, che limita la dimensione del modello che può essere addestrato e limita anche la dimensione del batch per GPU utilizzata durante l'addestramento.

Per affrontare questa sfida, varie tecniche di parallelismo dei modelli come DeepSpeed Zero ed PyTorch FSDP sono stati creati per consentirti di superare questa barriera di memoria GPU limitata. Ciò viene fatto adottando una tecnica parallela di dati frammentati, in cui ciascun acceleratore contiene solo una sezione (a coccio) di una replica del modello anziché dell'intera replica del modello, riducendo drasticamente l'impronta di memoria del processo di training.

Questo post dimostra come utilizzare PyTorch FSDP per ottimizzare il modello Llama2 utilizzando Amazon EKS. Raggiungiamo questo obiettivo aumentando la capacità di elaborazione e GPU per soddisfare i requisiti del modello.

Panoramica della PFSDP

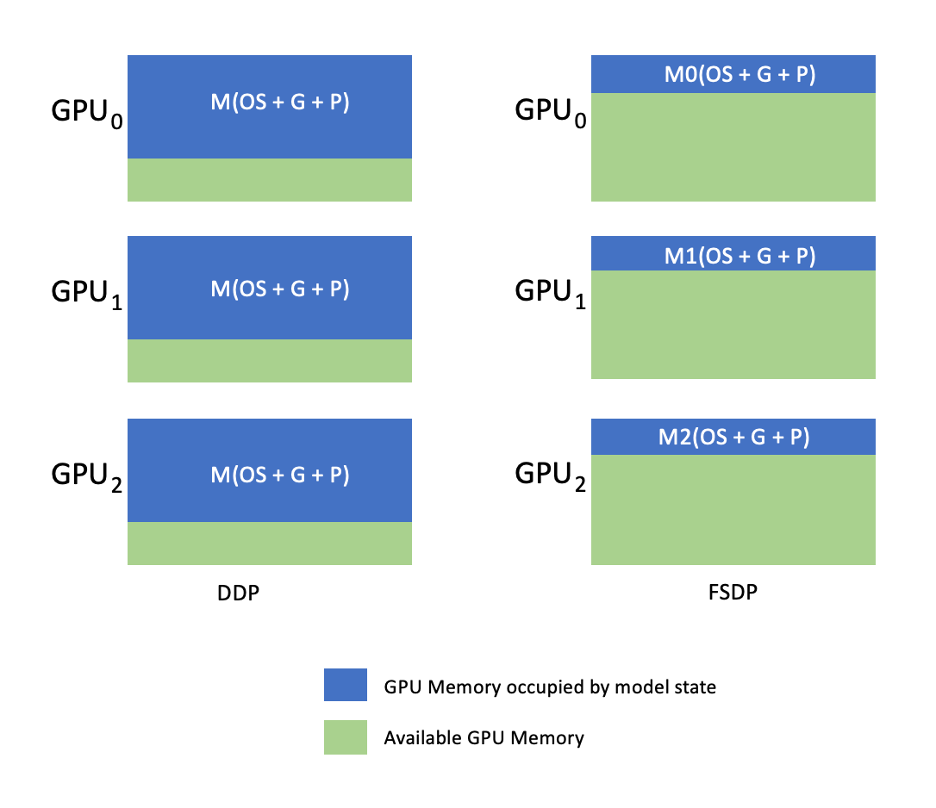

Nell'addestramento PyTorch DDP, ogni GPU (denominata a lavoratore nel contesto di PyTorch) contiene una copia completa del modello, inclusi i pesi, i gradienti e gli stati dell'ottimizzatore del modello. Ogni lavoratore elabora un batch di dati e, al termine del passaggio all'indietro, utilizza un file tutto-riduci operazione per sincronizzare i gradienti tra diversi lavoratori.

La presenza di una replica del modello su ciascuna GPU limita le dimensioni del modello che può essere ospitato in un flusso di lavoro DDP. FSDP aiuta a superare questa limitazione suddividendo in partizioni i parametri del modello, gli stati dell'ottimizzatore e i gradienti tra i lavoratori paralleli dei dati, pur preservando la semplicità del parallelismo dei dati.

Ciò è dimostrato nel diagramma seguente, dove nel caso di DDP, ciascuna GPU contiene una copia completa dello stato del modello, incluso lo stato dell'ottimizzatore (OS), i gradienti (G) e i parametri (P): M(OS + G +P). In FSDP, ogni GPU contiene solo una parte dello stato del modello, inclusi lo stato dell'ottimizzatore (OS), i gradienti (G) e i parametri (P): M (OS+G+P). L'utilizzo di FSDP comporta un ingombro di memoria della GPU significativamente inferiore rispetto a DDP su tutti i lavoratori, consentendo l'addestramento di modelli molto grandi o l'utilizzo di batch di dimensioni maggiori per i lavori di addestramento.

Ciò, tuttavia, ha il prezzo di un maggiore sovraccarico di comunicazione, che viene mitigato attraverso le ottimizzazioni FSDP come la sovrapposizione di processi di comunicazione e calcolo con funzionalità come prelettura. Per informazioni più dettagliate fare riferimento a Introduzione a Fully Sharded Data Parallel (FSDP).

FSDP offre vari parametri che ti consentono di ottimizzare le prestazioni e l'efficienza dei tuoi lavori di formazione. Alcune delle caratteristiche e capacità principali di FSDP includono:

- Politica di avvolgimento del trasformatore

- Precisione mista flessibile

- Checkpoint di attivazione

- Varie strategie di partizionamento orizzontale per adattarsi a diverse velocità di rete e topologie di cluster:

- FULL_SHARD – Parametri del modello shard, gradienti e stati dell'ottimizzatore

- IBRIDO_SHARD – Shard completo all'interno di un nodo DDP tra i nodi; supporta un gruppo di partizionamento flessibile flessibile per una replica completa del modello (HSDP)

- SHARD_GRAD_OP – Sharding solo gradienti e stati di ottimizzazione

- NO_SHARD – Simile al DDP

Per ulteriori informazioni su FSDP, fare riferimento a Formazione efficiente su larga scala con Pytorch FSDP e AWS.

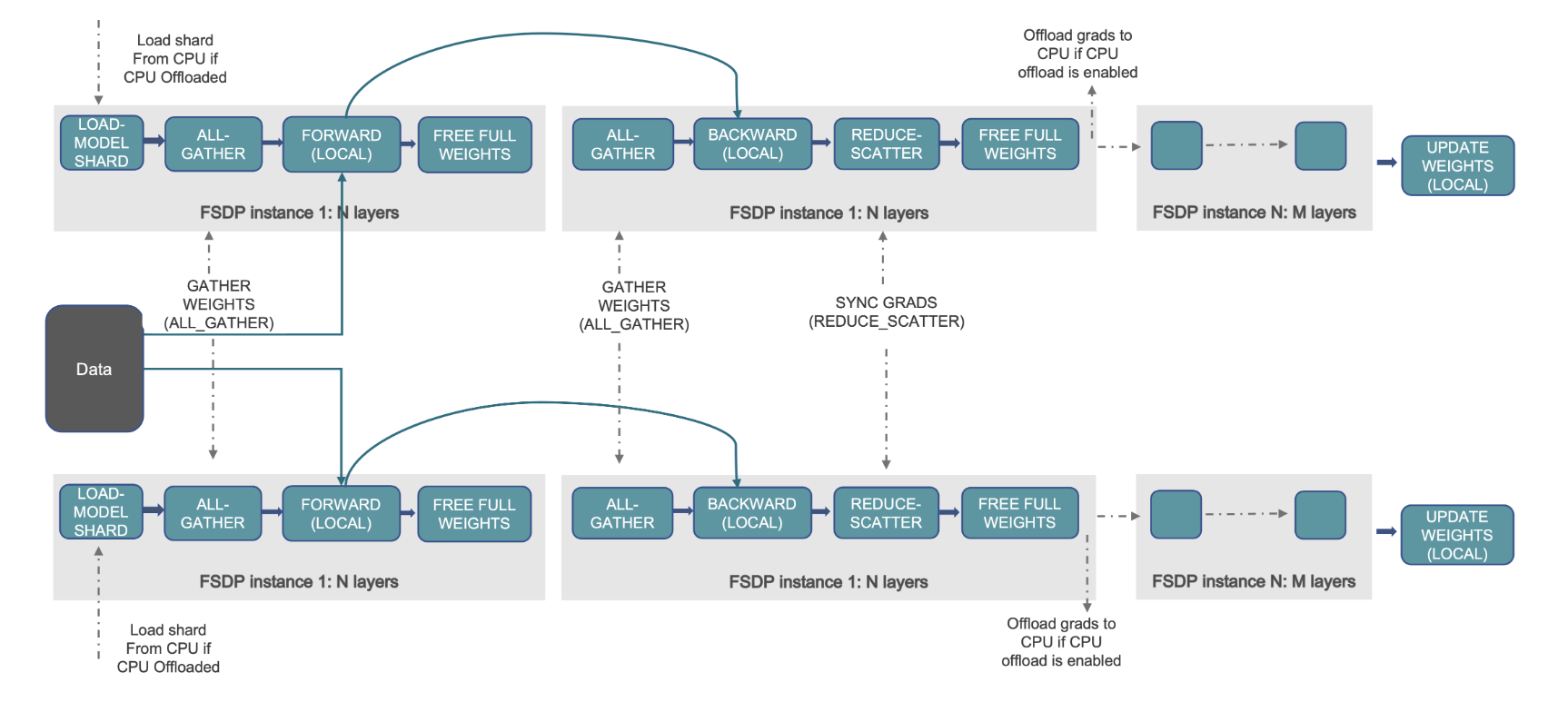

La figura seguente mostra come funziona FSDP per due processi paralleli di dati.

Panoramica della soluzione

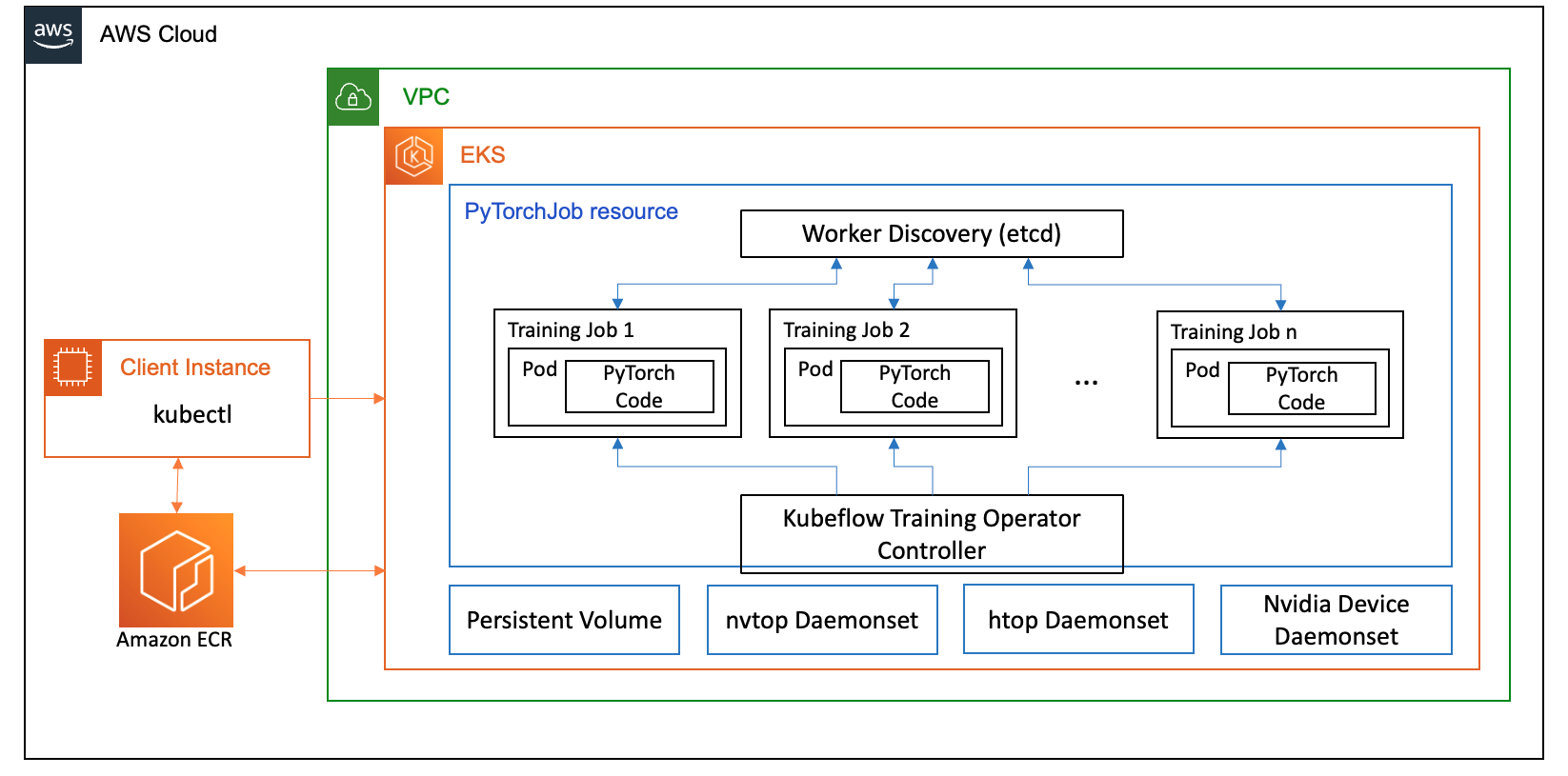

In questo post, configuriamo un cluster di calcolo utilizzando Amazon EKS, che è un servizio gestito per eseguire Kubernetes nel cloud AWS e nei data center locali. Molti clienti stanno adottando Amazon EKS per eseguire carichi di lavoro AI/ML basati su Kubernetes, sfruttando le sue prestazioni, scalabilità, affidabilità e disponibilità, nonché le sue integrazioni con reti, sicurezza e altri servizi AWS.

Per il nostro caso d'uso FSDP, utilizziamo il file Operatore di formazione Kubeflow su Amazon EKS, un progetto nativo di Kubernetes che facilita la messa a punto e la formazione distribuita scalabile per i modelli ML. Supporta vari framework ML, incluso PyTorch, che puoi utilizzare per distribuire e gestire processi di formazione PyTorch su larga scala.

Utilizzando la risorsa personalizzata PyTorchJob di Kubeflow Training Operator, eseguiamo lavori di formazione su Kubernetes con un numero configurabile di repliche di lavoro che ci consente di ottimizzare l'utilizzo delle risorse.

Di seguito sono riportati alcuni componenti dell'operatore di formazione che svolgono un ruolo nel nostro caso d'uso di messa a punto di Llama2:

- Un controller Kubernetes centralizzato che orchestra i processi di formazione distribuiti per PyTorch.

- PyTorchJob, una risorsa personalizzata Kubernetes per PyTorch, fornita da Kubeflow Training Operator, per definire e distribuire processi di formazione Llama2 su Kubernetes.

- etcd, che è legato all'implementazione del meccanismo di rendezvous per coordinare l'addestramento distribuito dei modelli PyTorch. Questo

etcdil server, come parte del processo di rendez-vous, facilita il coordinamento e la sincronizzazione dei lavoratori partecipanti durante la formazione distribuita.

Il diagramma seguente illustra l'architettura della soluzione.

La maggior parte dei dettagli verranno estratti dagli script di automazione che utilizziamo per eseguire l'esempio Llama2.

Utilizziamo i seguenti riferimenti al codice in questo caso d'uso:

Cos'è Llama2?

Llama2 è un LLM pre-addestrato su 2 trilioni di token di testo e codice. È uno dei LLM più grandi e potenti oggi disponibili. Puoi utilizzare Llama2 per una varietà di attività, tra cui l'elaborazione del linguaggio naturale (PNL), la generazione di testo e la traduzione. Per ulteriori informazioni, fare riferimento a Iniziare con Lama.

Llama2 è disponibile in tre diverse dimensioni del modello:

- Lama2-70b – Questo è il modello Llama2 più grande, con 70 miliardi di parametri. È il modello Llama2 più potente e può essere utilizzato per i compiti più impegnativi.

- Lama2-13b – Questo è un modello Llama2 di medie dimensioni, con 13 miliardi di parametri. È un buon equilibrio tra prestazioni ed efficienza e può essere utilizzato per una varietà di attività.

- Lama2-7b – Questo è il modello Llama2 più piccolo, con 7 miliardi di parametri. È il modello Llama2 più efficiente e può essere utilizzato per attività che non richiedono il massimo livello di prestazioni.

Questo post ti consente di ottimizzare tutti questi modelli su Amazon EKS. Per fornire un'esperienza semplice e riproducibile nella creazione di un cluster EKS e nell'esecuzione di processi FSDP al suo interno, utilizziamo il metodo aws-do-eks progetto. L'esempio funzionerà anche con un cluster EKS preesistente.

Una procedura dettagliata con script è disponibile su GitHub per un'esperienza fuori dagli schemi. Nelle sezioni seguenti spiegheremo il processo end-to-end in modo più dettagliato.

Fornire l'infrastruttura della soluzione

Per gli esperimenti descritti in questo post utilizziamo cluster con nodi p4de (GPU A100) e p5 (GPU H100).

Cluster con nodi p4de.24xlarge

Per il nostro cluster con nodi p4de, utilizziamo quanto segue eks-gpu-p4de-odcr.yaml sceneggiatura:

utilizzando escl e il manifest del cluster precedente, creiamo un cluster con nodi p4de:

Cluster con nodi p5.48xlarge

Di seguito è riportato un modello di terraform per un cluster EKS con nodi P5 Repository GitHub.

È possibile personalizzare il cluster tramite il file variabili.tf file e quindi crearlo tramite la CLI Terraform:

Puoi verificare la disponibilità del cluster eseguendo un semplice comando kubectl:

Il cluster è integro se l'output di questo comando mostra il numero previsto di nodi in stato Pronto.

Distribuire i prerequisiti

Per eseguire FSDP su Amazon EKS, utilizziamo il file PyTorchJob risorsa personalizzata. Richiede etcd ed Operatore di formazione Kubeflow come prerequisiti.

Distribuisci etcd con il seguente codice:

Distribuisci Kubeflow Training Operator con il seguente codice:

Crea ed esegui il push di un'immagine del contenitore FSDP su Amazon ECR

Utilizza il codice seguente per creare un'immagine del contenitore FSDP ed eseguirne il push Registro dei contenitori Amazon Elastic (Amazon ECR):

Crea il manifest PyTorchJob FSDP

Inserisci il tuo Gettone Volto che abbraccia nel seguente frammento prima di eseguirlo:

Configura il tuo PyTorchJob con .env file o direttamente nelle variabili di ambiente come di seguito:

Genera il manifest PyTorchJob utilizzando il file modello FSDP ed generare.sh script o crealo direttamente utilizzando lo script seguente:

Esegui PyTorchJob

Esegui PyTorchJob con il seguente codice:

Vedrai il numero specificato di pod di lavoro FDSP creati e, dopo aver estratto l'immagine, entreranno in uno stato In esecuzione.

Per visualizzare lo stato di PyTorchJob, utilizzare il seguente codice:

Per interrompere PyTorchJob, utilizzare il seguente codice:

Una volta completato un lavoro, è necessario eliminarlo prima di iniziare una nuova esecuzione. Abbiamo anche osservato che l'eliminazione del fileetcdpod e lasciarlo riavviare prima di avviare un nuovo lavoro aiuta a evitare a RendezvousClosedError.

Ridimensionare il cluster

Puoi ripetere i passaggi precedenti di creazione ed esecuzione dei lavori variando il numero e il tipo di istanza dei nodi di lavoro nel cluster. Ciò consente di produrre grafici in scala come quello mostrato in precedenza. In generale, dovresti notare una riduzione dell'ingombro della memoria della GPU, una riduzione del tempo di epoca e un aumento del throughput quando vengono aggiunti più nodi al cluster. Il grafico precedente è stato prodotto conducendo diversi esperimenti utilizzando un gruppo di nodi p5 di dimensioni variabili da 1 a 16 nodi.

Osservare il carico di lavoro della formazione FSDP

L'osservabilità dei carichi di lavoro di intelligenza artificiale generativa è importante per consentire la visibilità dei lavori in esecuzione e per aiutare a massimizzare l'utilizzo delle risorse di elaborazione. In questo post utilizziamo a questo scopo alcuni strumenti di osservabilità nativi di Kubernetes e open source. Questi strumenti consentono di tenere traccia di errori, statistiche e comportamento del modello, rendendo l'osservabilità dell'intelligenza artificiale una parte cruciale di qualsiasi caso d'uso aziendale. In questa sezione mostriamo diversi approcci per osservare le attività di formazione della PSDSP.

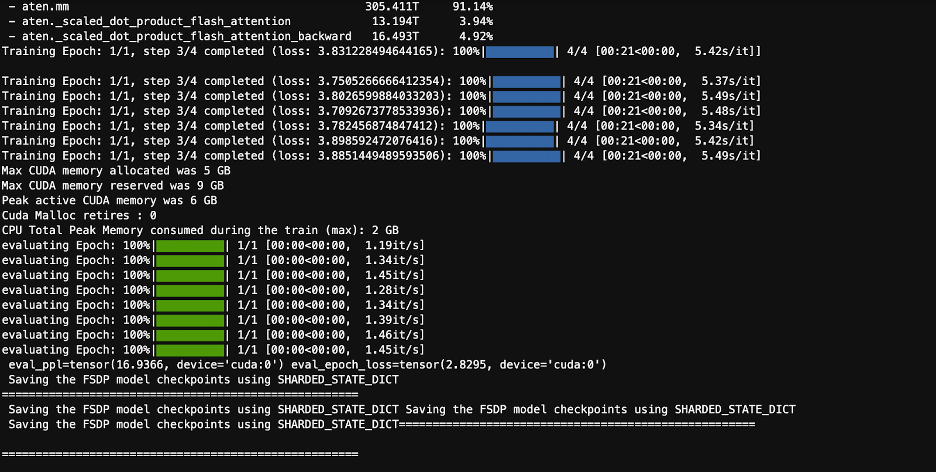

Registri dei pod di lavoro

Al livello più elementare, devi essere in grado di vedere i registri dei tuoi pod di allenamento. Questa operazione può essere eseguita facilmente utilizzando i comandi nativi di Kubernetes.

Per prima cosa, recupera un elenco di pod e individua il nome di quello di cui vuoi visualizzare i log:

Quindi visualizza i log per il pod selezionato:

Solo il registro del pod di un lavoratore (leader eletto) elencherà le statistiche generali del lavoro. Il nome del pod leader eletto è disponibile all'inizio di ogni log del pod lavoratore, identificato dalla chiave master_addr=.

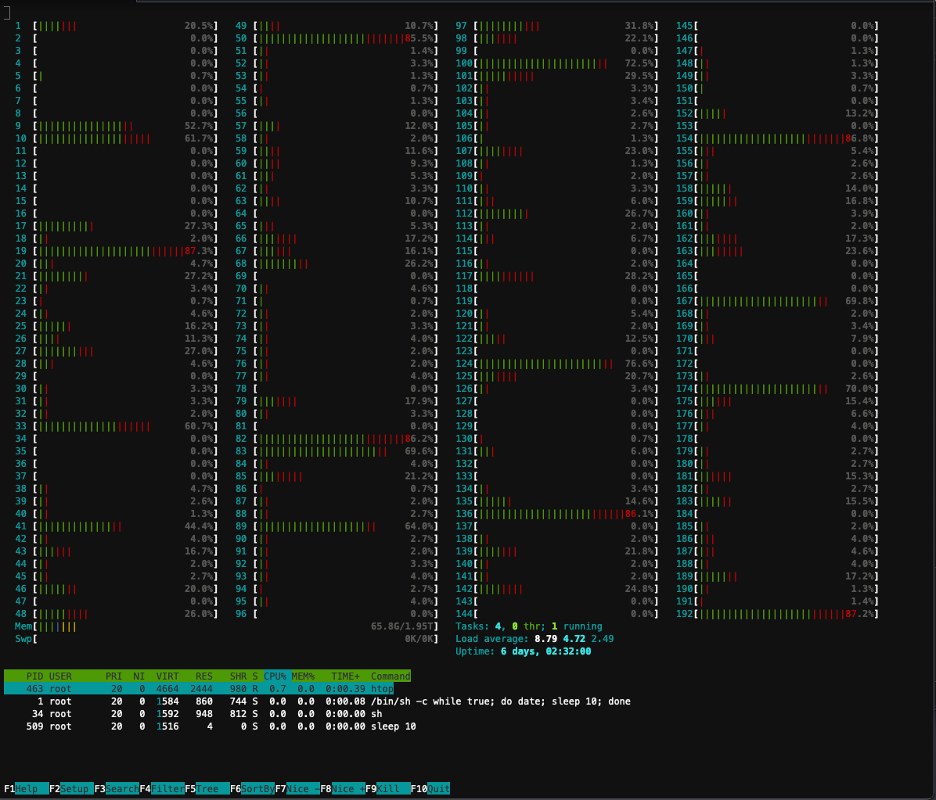

Utilizzo della CPU

I carichi di lavoro di formazione distribuiti richiedono risorse sia CPU che GPU. Per ottimizzare questi carichi di lavoro, è importante capire come vengono utilizzate queste risorse. Fortunatamente, sono disponibili alcune ottime utility open source che aiutano a visualizzare l'utilizzo di CPU e GPU. Per visualizzare l'utilizzo della CPU, è possibile utilizzarehtop. Se i tuoi pod di lavoro contengono questa utilità, puoi utilizzare il comando seguente per aprire una shell in un pod ed eseguirehtop.

In alternativa, puoi distribuire un htopdaemonsetcome quello riportato di seguito Repository GitHub.

Ildaemonseteseguirà un pod htop leggero su ciascun nodo. Puoi eseguire l'esecuzione in uno qualsiasi di questi pod ed eseguire il filehtopcomando:

La schermata seguente mostra l'utilizzo della CPU su uno dei nodi del cluster. In questo caso, stiamo esaminando un'istanza P5.48xlarge, che ha 192 vCPU. I core del processore sono inattivi mentre i pesi del modello vengono scaricati e vediamo un utilizzo crescente mentre i pesi del modello vengono caricati nella memoria della GPU.

Utilizzo della GPU

Se l'nvtopè disponibile nel tuo pod, puoi eseguirla utilizzando di seguito e quindi eseguirenvtop.

In alternativa, puoi distribuire un nvtopdaemonsetcome quello riportato di seguito Repository GitHub.

Questo eseguirà anvtoppod su ciascun nodo. Puoi eseguire l'esecuzione in uno qualsiasi di questi pod ed eseguirenvtop:

Lo screenshot seguente mostra l'utilizzo della GPU su uno dei nodi nel cluster di training. In questo caso, stiamo esaminando un'istanza P5.48xlarge, che ha 8 GPU NVIDIA H100. Le GPU sono inattive mentre i pesi del modello vengono scaricati, quindi l'utilizzo della memoria della GPU aumenta man mano che i pesi del modello vengono caricati sulla GPU e l'utilizzo della GPU raggiunge il 100% mentre sono in corso le iterazioni di training.

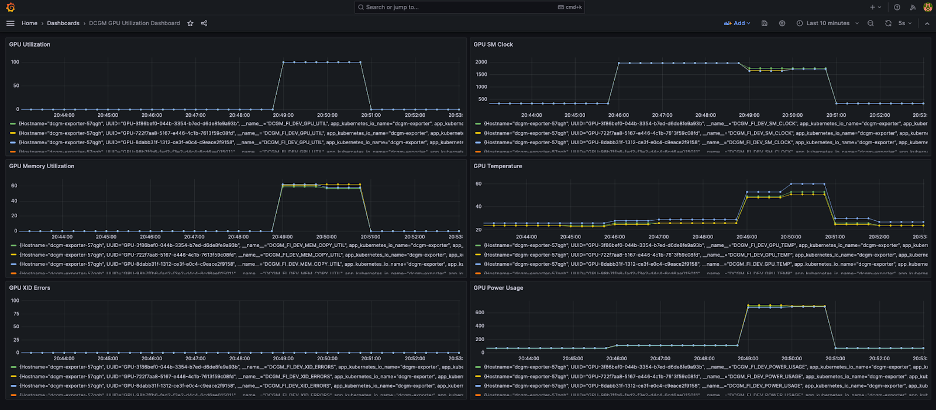

Cruscotto Grafana

Ora che hai compreso come funziona il tuo sistema a livello di pod e di nodo, è importante anche esaminare i parametri a livello di cluster. I parametri di utilizzo aggregati possono essere raccolti da NVIDIA DCGM Exporter e Prometheus e visualizzati in Grafana.

Di seguito è disponibile un esempio di distribuzione Prometheus-Grafana Repository GitHub.

Di seguito è disponibile un esempio di distribuzione dell'esportatore DCGM Repository GitHub.

Una semplice dashboard di Grafana è mostrata nello screenshot seguente. È stato costruito selezionando le seguenti metriche DCGM: DCGM_FI_DEV_GPU_UTIL, DCGM_FI_MEM_COPY_UTIL, DCGM_FI_DEV_XID_ERRORS, DCGM_FI_DEV_SM_CLOCK, DCGM_FI_DEV_GPU_TEMPe DCGM_FI_DEV_POWER_USAGE. La dashboard può essere importata in Prometheus da GitHub.

La seguente dashboard mostra un'esecuzione di un lavoro di formazione a epoca singola Llama2 7b. I grafici mostrano che all'aumentare del clock del multiprocessore di streaming (SM), aumentano anche l'assorbimento di potenza e la temperatura delle GPU, insieme all'utilizzo della GPU e della memoria. Puoi anche vedere che non si sono verificati errori XID e che le GPU erano integre durante questa esecuzione.

Da marzo 2024 l'osservabilità della GPU per EKS è supportata in modo nativo in CloudWatch Container Insights. Per abilitare questa funzionalità è sufficiente distribuire il componente aggiuntivo CloudWatch Observability nel tuo cluster EKS. Potrai quindi sfogliare le metriche a livello di pod, nodo e cluster tramite dashboard preconfigurate e personalizzabili in Container Insights.

ripulire

Se hai creato il tuo cluster utilizzando gli esempi forniti in questo blog, puoi eseguire il seguente codice per eliminare il cluster e tutte le risorse ad esso associate, incluso il VPC:

Per eksctl:

Per la terraformazione:

Caratteristiche imminenti

Si prevede che FSDP includa una funzionalità di sharding per parametro, con l'obiettivo di migliorare ulteriormente l'impronta di memoria per GPU. Inoltre, lo sviluppo continuo del supporto FP8 mira a migliorare le prestazioni FSDP sulle GPU H100. Infine, quando FSDP è integrato contorch.compile, speriamo di vedere ulteriori miglioramenti delle prestazioni e l'abilitazione di funzionalità come il checkpoint di attivazione selettiva.

Conclusione

In questo post abbiamo discusso di come FSDP riduca l'ingombro di memoria su ciascuna GPU, consentendo l'addestramento di modelli più grandi in modo più efficiente e ottenendo una scalabilità quasi lineare nel throughput. Lo abbiamo dimostrato attraverso un'implementazione passo-passo dell'addestramento di un modello Llama2 utilizzando Amazon EKS su istanze P4de e P5 e utilizzando strumenti di osservabilità come kubectl, htop, nvtop e dcgm per monitorare i log, nonché l'utilizzo di CPU e GPU.

Ti invitiamo a sfruttare PyTorch FSDP per i tuoi lavori di formazione LLM. Inizia da aws-do-fsdp.

Informazioni sugli autori

Kanwaljit Khurmi è Principal AI/ML Solutions Architect presso Amazon Web Services. Collabora con i clienti AWS per fornire indicazioni e assistenza tecnica, aiutandoli a migliorare il valore delle loro soluzioni di machine learning su AWS. Kanwaljit è specializzato nell'aiutare i clienti con applicazioni di elaborazione containerizzata e distribuita e di deep learning.

Kanwaljit Khurmi è Principal AI/ML Solutions Architect presso Amazon Web Services. Collabora con i clienti AWS per fornire indicazioni e assistenza tecnica, aiutandoli a migliorare il valore delle loro soluzioni di machine learning su AWS. Kanwaljit è specializzato nell'aiutare i clienti con applicazioni di elaborazione containerizzata e distribuita e di deep learning.

Alex Iankoulski è Principal Solutions Architect, Machine Learning autogestito presso AWS. È un ingegnere completo di software e infrastrutture a cui piace svolgere un lavoro approfondito e pratico. Nel suo ruolo, si concentra sull'aiutare i clienti con la containerizzazione e l'orchestrazione dei carichi di lavoro ML e AI su servizi AWS basati su container. È anche l'autore dell'open source fare quadro e un capitano Docker che ama applicare le tecnologie dei container per accelerare il ritmo dell'innovazione risolvendo al contempo le più grandi sfide del mondo.

Alex Iankoulski è Principal Solutions Architect, Machine Learning autogestito presso AWS. È un ingegnere completo di software e infrastrutture a cui piace svolgere un lavoro approfondito e pratico. Nel suo ruolo, si concentra sull'aiutare i clienti con la containerizzazione e l'orchestrazione dei carichi di lavoro ML e AI su servizi AWS basati su container. È anche l'autore dell'open source fare quadro e un capitano Docker che ama applicare le tecnologie dei container per accelerare il ritmo dell'innovazione risolvendo al contempo le più grandi sfide del mondo.

Ana Simoes è uno specialista principale di machine learning, ML Frameworks presso AWS. Supporta i clienti che implementano intelligenza artificiale, machine learning e intelligenza artificiale generativa su larga scala sull'infrastruttura HPC nel cloud. Ana si concentra sul supportare i clienti per ottenere un buon rapporto prezzo-prestazioni per nuovi carichi di lavoro e casi d'uso per l'intelligenza artificiale generativa e l'apprendimento automatico.

Ana Simoes è uno specialista principale di machine learning, ML Frameworks presso AWS. Supporta i clienti che implementano intelligenza artificiale, machine learning e intelligenza artificiale generativa su larga scala sull'infrastruttura HPC nel cloud. Ana si concentra sul supportare i clienti per ottenere un buon rapporto prezzo-prestazioni per nuovi carichi di lavoro e casi d'uso per l'intelligenza artificiale generativa e l'apprendimento automatico.

Hamid Shojanazeri è un ingegnere partner presso PyTorch che lavora su ottimizzazione di modelli open source e ad alte prestazioni, formazione distribuita (PFSDP) e inferenza. È il co-creatore di ricetta-lama e collaboratore di Torcia Servire. Il suo interesse principale è migliorare l’efficienza in termini di costi, rendendo l’intelligenza artificiale più accessibile a una comunità più ampia.

Hamid Shojanazeri è un ingegnere partner presso PyTorch che lavora su ottimizzazione di modelli open source e ad alte prestazioni, formazione distribuita (PFSDP) e inferenza. È il co-creatore di ricetta-lama e collaboratore di Torcia Servire. Il suo interesse principale è migliorare l’efficienza in termini di costi, rendendo l’intelligenza artificiale più accessibile a una comunità più ampia.

Meno Wright è un ingegnere AI/partner in PyTorch. Lavora su kernel Triton/CUDA (Accelerare Dequant con la scomposizione del lavoro SplitK); ottimizzatori paginati, streaming e quantizzati; e PyTorch distribuito (PyTorch FSDP).

Meno Wright è un ingegnere AI/partner in PyTorch. Lavora su kernel Triton/CUDA (Accelerare Dequant con la scomposizione del lavoro SplitK); ottimizzatori paginati, streaming e quantizzati; e PyTorch distribuito (PyTorch FSDP).

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/scale-llms-with-pytorch-2-0-fsdp-on-amazon-eks-part-2/

- :ha

- :È

- :Dove

- ][P

- $ SU

- 1

- 10

- 100

- 12

- 13

- 16

- 2024

- 28

- 500

- 7

- 70

- 8

- 80

- 800

- a

- capace

- WRI

- astratto

- accelerare

- acceleratore

- accessibile

- Il mio account

- precisione

- Raggiungere

- il raggiungimento

- operanti in

- Attivazione

- Aggiungi su

- aggiunto

- aggiuntivo

- Inoltre

- indirizzo

- Aggiunge

- Adottando

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- aggregato

- AI

- AI / ML

- aiuto

- Mirare

- mira

- Tutti

- consentire

- consente

- anche

- sempre

- Amazon

- Amazon EC2

- Amazon Web Services

- quantità

- an

- Ana

- ed

- e infrastruttura

- in qualsiasi

- App

- applicazioni

- APPLICA

- AMMISSIONE

- approcci

- architettura

- SONO

- artificiale

- intelligenza artificiale

- AS

- Assistenza

- assistenti

- associato

- At

- autore

- Automazione

- disponibilità

- disponibile

- evitare

- AWS

- Equilibrio

- barriera

- bash

- basic

- BE

- prima

- Inizio

- comportamento

- essendo

- sotto

- Meglio

- fra

- Maggiore

- Miliardo

- Blog

- entrambi

- pause

- più ampia

- costruire

- costruito

- affari

- ma

- by

- Materiale

- funzionalità

- Ultra-Grande

- Custodie

- casi

- CAT

- centri

- centralizzata

- Challenge

- sfide

- Grafico

- Grafici

- cli

- Orologio

- Cloud

- Cluster

- codice

- collabora

- viene

- Comunicazione

- comunità

- rispetto

- completamento di una

- complessità

- componenti

- calcolo

- Calcolare

- computer

- Visione computerizzata

- informatica

- conduzione

- Configurazione

- contenere

- Contenitore

- Tecnologie Container

- contenuto

- creazione di contenuti

- contesto

- continuazione

- collaboratore

- controllore

- coordinamento

- coordinazione

- copia

- Nucleo

- Costo

- creare

- creato

- Creazione

- creazione

- cruciale

- Corrente

- costume

- Clienti

- personalizzabile

- personalizzare

- cruscotto

- cruscotti

- dati

- data center

- dataset

- DDP

- deep

- apprendimento profondo

- definire

- esigente

- dimostrare

- dimostrato

- dimostra

- schierare

- distribuzione

- deployment

- descrivere

- descritta

- dettaglio

- dettagliati

- dettagli

- Mercato

- diagramma

- diverso

- direttamente

- discutere

- discusso

- distribuito

- calcolo distribuito

- formazione distribuita

- do

- docker

- fatto

- Dont

- scaricare

- scaricata

- drammaticamente

- disegnare

- dovuto

- durante

- ogni

- In precedenza

- alleviare

- facilmente

- efficienza

- efficiente

- in modo efficiente

- eletto

- abbracciando

- enable

- abilitazione

- Abilita

- consentendo

- incoraggiare

- fine

- da un capo all'altro

- ingegnere

- Ingegneria

- accrescere

- entrare

- Intero

- Ambiente

- epoca

- errori

- esempio

- Esempi

- eseguire

- previsto

- esperienza

- esperimenti

- Spiegare

- Faccia

- facilita

- più veloce

- caratteristica

- Caratteristiche

- pochi

- figura

- Compila il

- Infine

- in forma

- flessibile

- si concentra

- i seguenti

- Orma

- Nel

- per fortuna

- quadri

- da

- pieno

- completamente

- funzionalità

- ulteriormente

- Generale

- ELETTRICA

- generativo

- AI generativa

- ottenere

- GitHub

- buono

- GPU

- GPU

- gradienti

- grafici

- grande

- molto

- Gruppo

- GUEST

- Ospite Messaggio

- guida

- mani su

- he

- sano

- Aiuto

- aiutare

- aiuta

- Alte prestazioni

- massimo

- il suo

- detiene

- speranza

- Come

- Tutorial

- Tuttavia

- hpc

- HTML

- http

- HTTPS

- identificato

- Idle

- if

- illustra

- Immagine

- implementazione

- importante

- competenze

- miglioramenti

- in

- includere

- Compreso

- Aumento

- è aumentato

- Aumenta

- sempre più

- info

- informazioni

- Infrastruttura

- Innovazione

- intuizioni

- esempio

- invece

- integrato

- integrazioni

- Intelligence

- interesse

- ai miglioramenti

- IT

- iterazioni

- SUO

- Lavoro

- Offerte di lavoro

- jpeg

- jpg

- json

- ad appena

- Le

- Genere

- Kubeflow

- per il tuo brand

- Lingua

- grandi

- larga scala

- superiore, se assunto singolarmente.

- maggiore

- Cognome

- lancio

- leader

- apprendimento

- meno

- locazione

- Livello

- Biblioteca

- leggero

- piace

- piace

- limitazione

- Limitato

- limiti

- lineare

- Lista

- LLM

- collocato

- ceppo

- accesso

- Guarda

- cerca

- ama

- macchina

- machine learning

- Principale

- Fare

- gestire

- maneggevole

- gestito

- modo

- molti

- Marzo

- Marzo 2024

- massimizzando

- Maggio..

- meccanismo

- Memorie

- Meta

- Metadati

- Metrica

- misto

- ML

- modello

- modelli

- moderno

- Monitorare

- Scopri di più

- maggior parte

- Nome

- nativamente

- Naturale

- Elaborazione del linguaggio naturale

- Vicino

- Bisogno

- esigenze

- Rete

- internazionale

- New

- nlp

- no

- nodo

- nodi

- numero

- Nvidia

- of

- offrire

- Offerte

- on

- ONE

- in corso

- esclusivamente

- su

- aprire

- open source

- operazione

- operatore

- ottimizzazione

- ottimizzazioni

- OTTIMIZZA

- or

- orchestrazione

- OS

- Altro

- nostro

- su

- produzione

- complessivo

- Superare

- alto

- proprio

- Pace

- Parallel

- parametri

- parte

- partecipante

- partner

- passare

- sentiero

- per

- performance

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- Popolare

- Post

- energia

- potente

- precedente

- prerequisiti

- preservare

- precedente

- Direttore

- Precedente

- processi

- i processi

- lavorazione

- Processore

- produrre

- Prodotto

- progetto

- comprovata

- fornire

- purché

- traino

- scopo

- Spingi

- pytorch

- qualità

- gamma

- pronto

- riduce

- riduzione

- riferimento

- Riferimenti

- di cui

- regione

- registro

- relazionato

- problemi di

- ripetere

- replica

- richieste

- richiedere

- Requisiti

- richiede

- riparazioni

- risorsa

- Risorse

- colpevole

- Risultati

- crescita

- robusto

- Ruolo

- Correre

- running

- Scalabilità

- scalabile

- Scala

- scala

- copione

- script

- senza soluzione di continuità

- Sezione

- sezioni

- problemi di

- vedere

- selezionato

- Selezione

- selettivo

- Serie

- servizio

- Servizi

- set

- alcuni

- scheggiato

- sharding

- lei

- Conchiglia

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- significativamente

- simile

- Un'espansione

- semplicità

- semplifica

- singolo

- Taglia

- Dimensioni

- Taglia

- inferiore

- frammento

- Software

- soluzione

- Soluzioni

- Soluzione

- alcuni

- Fonte

- specialista

- specializzata

- specificato

- velocità

- picchi

- pila

- iniziato

- Regione / Stato

- stati

- statistica

- Stato dei servizi

- Passi

- Ancora

- Fermare

- strategie

- Streaming

- tale

- Completo

- supporto

- supportato

- Supporto

- supporti

- dati

- SYS

- sistema

- Fai

- presa

- Target

- task

- team

- Consulenza

- per l'esame

- tecniche

- Tecnologie

- modello

- Terraform

- testo

- che

- Il

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- Attraverso

- portata

- tempo

- richiede tempo

- a

- oggi

- insieme

- Tokens

- strumenti

- pista

- Treni

- allenato

- Training

- Traduzione

- Trilione

- vero

- sintonizzare

- seconda

- Digitare

- in definitiva

- capire

- In corso

- us

- uso

- caso d'uso

- utilizzato

- usa

- utilizzando

- utilità

- utilità

- utilizzati

- APPREZZIAMO

- varietà

- vario

- variando

- verificare

- versione

- molto

- via

- Visualizza

- visualizzazione

- virtuale

- visibilità

- visione

- visualizzare

- volumi

- walkthrough

- volere

- Prima

- we

- sito web

- servizi web

- WELL

- sono stati

- quando

- quale

- while

- OMS

- volere

- con

- entro

- Lavora

- lavoratore

- lavoratori

- flusso di lavoro

- lavoro

- lavori

- Il mondo di

- involucro

- YAML

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro