I ricercatori continuano a sviluppare nuove architetture modello per attività comuni di machine learning (ML). Una di queste attività è la classificazione delle immagini, in cui le immagini vengono accettate come input e il modello tenta di classificare l'immagine nel suo insieme con gli output dell'etichetta dell'oggetto. Con molti modelli oggi disponibili che eseguono questa attività di classificazione delle immagini, un professionista ML può porre domande come: "Quale modello dovrei mettere a punto e quindi distribuire per ottenere le migliori prestazioni sul mio set di dati?" E un ricercatore di ML può porre domande del tipo: "Come posso generare il mio confronto equo di più architetture di modelli rispetto a un set di dati specificato controllando gli iperparametri di addestramento e le specifiche del computer, come GPU, CPU e RAM?" La prima domanda riguarda la selezione del modello tra le architetture del modello, mentre la seconda domanda riguarda l'analisi comparativa dei modelli addestrati rispetto a un set di dati di test.

In questo post, vedrai come il Classificazione delle immagini TensorFlow algoritmo di JumpStart di Amazon SageMaker può semplificare le implementazioni necessarie per rispondere a queste domande. Insieme ai dettagli di implementazione in un file corrispondente esempio notebook Jupyter, avrai a disposizione strumenti per eseguire la selezione del modello esplorando le frontiere di Pareto, dove non è possibile migliorare una metrica delle prestazioni, come l'accuratezza, senza peggiorare un'altra metrica, come il throughput.

Panoramica della soluzione

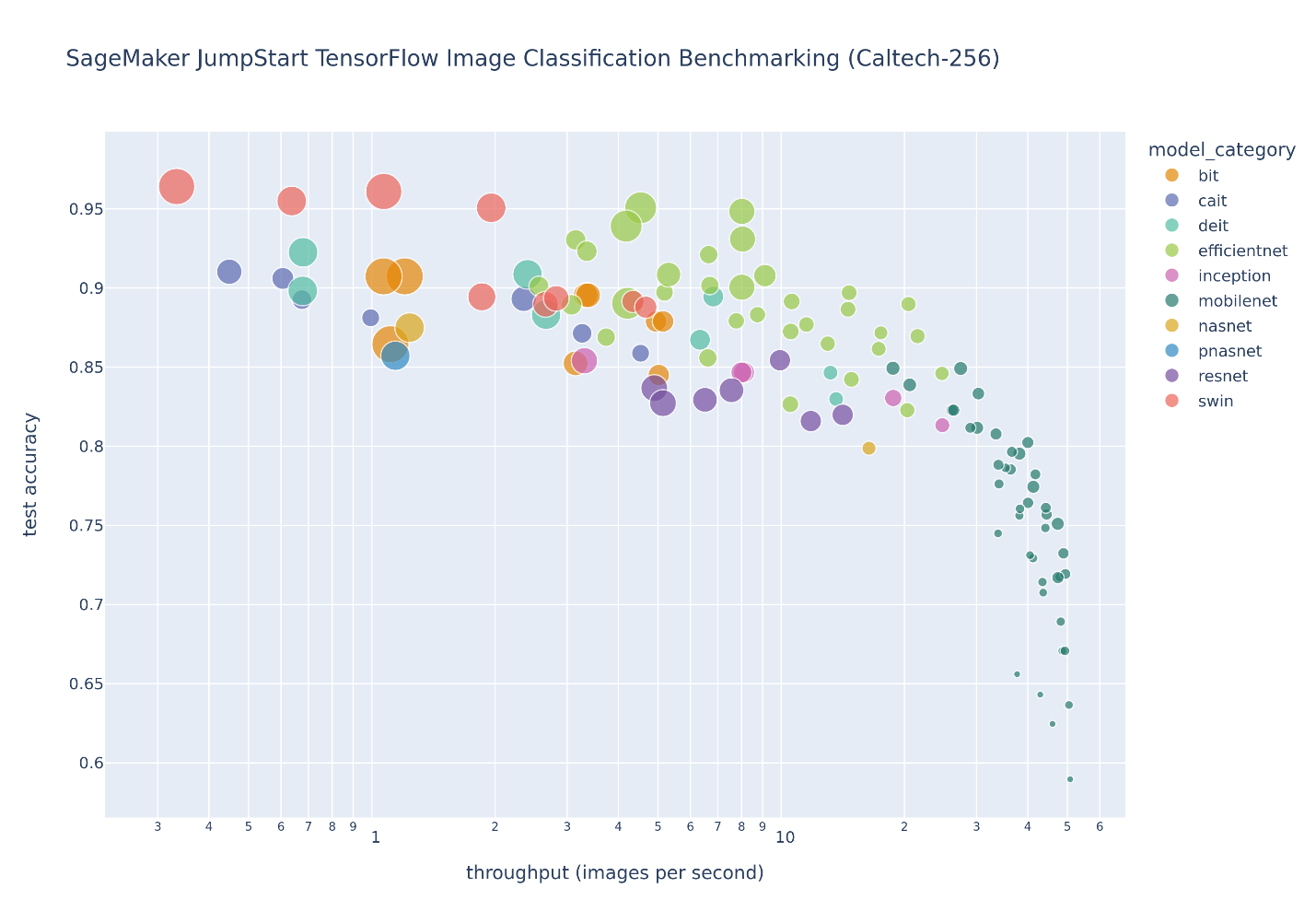

La figura seguente illustra il compromesso della selezione del modello per un gran numero di modelli di classificazione delle immagini ottimizzati su Caltech-256 set di dati, che è un set impegnativo di 30,607 immagini del mondo reale che coprono 256 categorie di oggetti. Ogni punto rappresenta un singolo modello, le dimensioni dei punti sono ridimensionate rispetto al numero di parametri che compongono il modello e i punti sono codificati a colori in base alla loro architettura del modello. Ad esempio, i punti verde chiaro rappresentano l'architettura EfficientNet; ogni punto verde chiaro è una configurazione diversa di questa architettura con misurazioni delle prestazioni del modello univoche e ottimizzate. La figura mostra l'esistenza di una frontiera di Pareto per la selezione del modello, in cui una maggiore precisione viene scambiata con un throughput inferiore. In definitiva, la selezione di un modello lungo la frontiera di Pareto, o l'insieme di soluzioni efficienti di Pareto, dipende dai requisiti di prestazioni della distribuzione del modello.

Se osservi l'accuratezza del test e le frontiere del throughput del test di interesse, l'insieme di soluzioni efficienti di Pareto nella figura precedente viene estratto nella tabella seguente. Le righe vengono ordinate in modo tale che la velocità effettiva del test aumenti e la precisione del test diminuisca.

| Nome del modello | Numero di parametri | Precisione del test | Prova la precisione dei primi 5 | Throughput (immagini/s) | Durata per epoca/e |

| swin-grande-patch4-finestra12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-grande-patch4-finestra7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| efficientenet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| efficientenet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| efficientenet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| efficientenet-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| efficientenet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| efficientenet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| efficientenet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-grande-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-grande-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Questo post fornisce dettagli su come implementare su larga scala Amazon Sage Maker attività di benchmarking e selezione del modello. In primo luogo, introduciamo JumpStart e gli algoritmi di classificazione delle immagini TensorFlow integrati. Discutiamo quindi considerazioni sull'implementazione di alto livello, come configurazioni di iperparametri JumpStart, estrazione di metriche da Log di Amazon CloudWatche l'avvio di processi di ottimizzazione degli iperparametri asincroni. Infine, copriamo l'ambiente di implementazione e la parametrizzazione che portano alle soluzioni efficienti di Pareto nella tabella e nella figura precedenti.

Introduzione alla classificazione delle immagini JumpStart TensorFlow

JumpStart offre la messa a punto e l'implementazione con un solo clic di un'ampia varietà di modelli pre-addestrati nelle attività ML più diffuse, oltre a una selezione di soluzioni end-to-end che risolvono problemi aziendali comuni. Queste funzionalità rimuovono il lavoro pesante da ogni fase del processo ML, facilitando lo sviluppo di modelli di alta qualità e riducendo i tempi di implementazione. IL API JumpStart consentono di distribuire e ottimizzare a livello di programmazione un'ampia selezione di modelli pre-addestrati sui propri set di dati.

L'hub del modello JumpStart fornisce l'accesso a un gran numero di Modelli di classificazione delle immagini TensorFlow che consentono di trasferire l'apprendimento e la messa a punto su set di dati personalizzati. Al momento della stesura di questo documento, l'hub del modello JumpStart contiene 135 modelli di classificazione delle immagini TensorFlow in una varietà di architetture di modelli popolari da Hub TensorFlow, per includere le reti residue (RESNET), Rete Mobile, Rete efficiente, Inizio, Reti di ricerca architettura neurale (NASNet), Grande trasferimento (BiT), finestra spostata (Suino) trasformatori, Class-Attention in Image Transformers (CaiT) e trasformatori di immagini efficienti per i dati (DeiT).

Strutture interne molto diverse comprendono ogni architettura del modello. Ad esempio, i modelli ResNet utilizzano connessioni skip per consentire reti sostanzialmente più profonde, mentre i modelli basati su trasformatore utilizzano meccanismi di auto-attenzione che eliminano la località intrinseca delle operazioni di convoluzione a favore di campi ricettivi più globali. Oltre ai diversi set di funzionalità forniti da queste diverse strutture, ogni architettura del modello ha diverse configurazioni che regolano le dimensioni, la forma e la complessità del modello all'interno di tale architettura. Ciò si traduce in centinaia di modelli di classificazione delle immagini univoci disponibili nell'hub del modello JumpStart. In combinazione con l'apprendimento di trasferimento integrato e gli script di inferenza che comprendono molte funzionalità di SageMaker, l'API JumpStart è un ottimo punto di partenza per i professionisti del machine learning per iniziare rapidamente la formazione e la distribuzione dei modelli.

Fare riferimento a Trasferisci l'apprendimento per i modelli di classificazione delle immagini TensorFlow in Amazon SageMaker e il seguente quaderno di esempio per conoscere in modo più approfondito la classificazione delle immagini di SageMaker TensorFlow, incluso come eseguire l'inferenza su un modello pre-addestrato e perfezionare il modello pre-addestrato su un set di dati personalizzato.

Considerazioni sulla selezione del modello su larga scala

La selezione del modello è il processo di selezione del modello migliore da un insieme di modelli candidati. Questo processo può essere applicato a modelli dello stesso tipo con pesi dei parametri diversi ea modelli di tipo diverso. Esempi di selezione del modello tra modelli dello stesso tipo includono l'adattamento dello stesso modello con diversi iperparametri (ad esempio, la velocità di apprendimento) e l'arresto anticipato per evitare l'overfitting dei pesi del modello nel set di dati del treno. La selezione del modello tra modelli di tipi diversi include la selezione della migliore architettura del modello (ad esempio, Swin vs. MobileNet) e la selezione delle migliori configurazioni del modello all'interno di un'unica architettura del modello (ad esempio, mobilenet-v1-025-128 vs. mobilenet-v3-large-100-224).

Le considerazioni delineate in questa sezione abilitano tutti questi processi di selezione del modello su un set di dati di convalida.

Selezionare le configurazioni degli iperparametri

La classificazione delle immagini TensorFlow in JumpStart ha un gran numero di disponibili iperparametri che può regolare i comportamenti dello script di apprendimento del trasferimento in modo uniforme per tutte le architetture del modello. Questi iperparametri si riferiscono all'aumento e alla preelaborazione dei dati, alle specifiche dell'ottimizzatore, ai controlli di overfitting e agli indicatori di livello addestrabili. Ti invitiamo a regolare i valori predefiniti di questi iperparametri secondo necessità per la tua applicazione:

Per questa analisi e per il notebook associato, tutti gli iperparametri sono impostati sui valori predefiniti, ad eccezione della frequenza di apprendimento, del numero di epoche e della specifica di arresto anticipato. Il tasso di apprendimento è regolato come a parametro categoriale dal Ottimizzazione automatica del modello di SageMaker lavoro. Poiché ogni modello ha valori iperparametrici predefiniti univoci, l'elenco discreto di possibili tassi di apprendimento include il tasso di apprendimento predefinito e un quinto del tasso di apprendimento predefinito. In questo modo vengono avviati due processi di addestramento per un singolo processo di ottimizzazione degli iperparametri e viene selezionato il processo di addestramento con le migliori prestazioni segnalate nel set di dati di convalida. Poiché il numero di epoche è impostato su 10, che è maggiore dell'impostazione predefinita dell'iperparametro, il miglior processo di addestramento selezionato non sempre corrisponde alla frequenza di apprendimento predefinita. Infine, viene utilizzato un criterio di arresto anticipato con una pazienza, o il numero di epoche per continuare l'allenamento senza miglioramenti, di tre epoche.

Un'impostazione iperparametrica predefinita di particolare importanza è train_only_on_top_layer, dove, se impostato su True, i livelli di estrazione delle caratteristiche del modello non vengono ottimizzati nel set di dati di addestramento fornito. L'ottimizzatore addestrerà solo i parametri nel livello di classificazione superiore completamente connesso con dimensionalità di output pari al numero di etichette di classe nel set di dati. Per impostazione predefinita, questo iperparametro è impostato su True, che è un'impostazione destinata al trasferimento dell'apprendimento su set di dati di piccole dimensioni. Potresti avere un set di dati personalizzato in cui l'estrazione delle funzionalità dal pre-training sul set di dati ImageNet non è sufficiente. In questi casi, dovresti impostare train_only_on_top_layer a False. Anche se questa impostazione aumenterà il tempo di addestramento, estrarrai caratteristiche più significative per il tuo problema di interesse, aumentando così la precisione.

Estrai parametri da CloudWatch Logs

L'algoritmo di classificazione delle immagini JumpStart TensorFlow registra in modo affidabile una varietà di metriche durante l'addestramento accessibili a SageMaker Estimator e oggetti HyperparameterTuner. Il costruttore di un SageMaker Estimator ha una metric_definitions argomento parola chiave, che può essere utilizzato per valutare il lavoro di addestramento fornendo un elenco di dizionari con due chiavi: Nome per il nome della metrica e Regex per l'espressione regolare utilizzata per estrarre la metrica dai log. L'accompagnamento taccuino mostra i dettagli di implementazione. La tabella seguente elenca le metriche disponibili e le espressioni regolari associate per tutti i modelli di classificazione delle immagini JumpStart TensorFlow.

| Nome metrica | Regular Expression |

| numero di parametri | “- Numero di parametri: ([0-9\.]+)” |

| numero di parametri addestrabili | "- Numero di parametri addestrabili: ([0-9\.]+)" |

| numero di parametri non addestrabili | "- Numero di parametri non addestrabili: ([0-9\.]+)" |

| metrica del set di dati del treno | f”- {metrica}: ([0-9\.]+)” |

| metrica del set di dati di convalida | f"- val_{metrica}: ([0-9\.]+)" |

| metrica del set di dati di prova | f”- Test {metrica}: ([0-9\.]+)” |

| durata del treno | "- Durata totale dell'allenamento: ([0-9\.]+)" |

| durata del treno per epoca | "- Durata media dell'addestramento per epoca: ([0-9\.]+)" |

| latenza di valutazione del test | "- Latenza della valutazione del test: ([0-9\.]+)" |

| latenza del test per campione | "- Latenza media del test per campione: ([0-9\.]+)" |

| rendimento di prova | "- Throughput medio del test: ([0-9\.]+)" |

Lo script di apprendimento del trasferimento incorporato fornisce una varietà di metriche del set di dati di addestramento, convalida e test all'interno di queste definizioni, come rappresentato dai valori di sostituzione della stringa f. Le metriche esatte disponibili variano in base al tipo di classificazione eseguita. Tutti i modelli compilati hanno a loss metrica, che è rappresentata da una perdita di entropia incrociata per un problema di classificazione binaria o categoriale. Il primo viene utilizzato quando è presente un'etichetta di classe; quest'ultimo viene utilizzato se sono presenti due o più etichette di classe. Se è presente una sola etichetta di classe, le seguenti metriche vengono calcolate, registrate ed estraibili tramite le espressioni regolari f-string nella tabella precedente: numero di veri positivi (true_pos), numero di falsi positivi (false_pos), numero di veri negativi (true_neg), numero di falsi negativi (false_neg), precision, recall, area sotto la curva delle caratteristiche operative del ricevitore (ROC) (auc) e l'area sotto la curva di richiamo di precisione (PR) (prc). Allo stesso modo, se ci sono sei o più etichette di classe, una metrica di accuratezza top-5 (top_5_accuracy) può anche essere calcolato, registrato ed estraibile tramite le espressioni regolari precedenti.

Durante l'addestramento, le metriche specificate a un SageMaker Estimator vengono inviati a CloudWatch Logs. Al termine dell'addestramento, è possibile richiamare il file API SageMaker DescribeTrainingJob e ispeziona il file FinalMetricDataList digitare la risposta JSON:

Questa API richiede solo il nome del lavoro da fornire alla query, quindi, una volta completata, le metriche possono essere ottenute in analisi future purché il nome del lavoro di addestramento sia registrato in modo appropriato e recuperabile. Per questa attività di selezione del modello, i nomi dei processi di ottimizzazione degli iperparametri vengono archiviati e le analisi successive ricollegano a HyperparameterTuner all'oggetto dato il nome del processo di ottimizzazione, estrarre il miglior nome del processo di addestramento dal sintonizzatore di iperparametri collegato e quindi richiamare il DescribeTrainingJob API come descritto in precedenza per ottenere le metriche associate al miglior lavoro di formazione.

Avvia processi di ottimizzazione degli iperparametri asincroni

Fare riferimento al corrispondente taccuino per i dettagli di implementazione sull'avvio asincrono dei processi di ottimizzazione degli iperparametri, che utilizza la libreria standard di Python futures simultanei module, un'interfaccia di alto livello per l'esecuzione asincrona di callable. In questa soluzione vengono implementate diverse considerazioni relative a SageMaker:

- Ogni account AWS è affiliato con Quote di servizio SageMaker. Dovresti visualizzare i tuoi limiti attuali per utilizzare appieno le tue risorse e potenzialmente richiedere aumenti del limite delle risorse secondo necessità.

- Le frequenti chiamate API per creare molti processi di ottimizzazione degli iperparametri simultanei possono superare la frequenza di Python SDK e generare eccezioni di limitazione. Una soluzione a questo è creare un client SageMaker Boto3 con una configurazione di tentativi personalizzata.

- Cosa succede se lo script incontra un errore o lo script viene interrotto prima del completamento? Per una selezione di modelli così ampia o uno studio di benchmarking, è possibile registrare i nomi dei lavori di ottimizzazione e fornire funzioni utili a ricollegare i processi di ottimizzazione degli iperparametri già esistenti:

Dettagli di analisi e discussione

L'analisi in questo post esegue l'apprendimento del trasferimento per ID modello nell'algoritmo di classificazione delle immagini JumpStart TensorFlow sul set di dati Caltech-256. Tutti i lavori di addestramento sono stati eseguiti sull'istanza di addestramento SageMaker ml.g4dn.xlarge, che contiene una singola GPU NVIDIA T4.

Il set di dati di test viene valutato nell'istanza di addestramento al termine dell'addestramento. La selezione del modello viene eseguita prima della valutazione del set di dati di test per impostare i pesi del modello sull'epoca con le migliori prestazioni del set di convalida. La velocità effettiva del test non è ottimizzata: la dimensione del batch del set di dati è impostata sulla dimensione del batch dell'iperparametro di addestramento predefinita, che non viene regolata per massimizzare l'utilizzo della memoria della GPU; la velocità effettiva di test segnalata include il tempo di caricamento dei dati perché il set di dati non è pre-memorizzato nella cache; e l'inferenza distribuita su più GPU non viene utilizzata. Per questi motivi, questa velocità effettiva è una buona misurazione relativa, ma la velocità effettiva effettiva dipenderebbe fortemente dalle configurazioni di distribuzione dell'endpoint di inferenza per il modello addestrato.

Sebbene l'hub del modello JumpStart contenga molti tipi di architettura di classificazione delle immagini, questa frontiera di Pareto è dominata da modelli Swin, EfficientNet e MobileNet selezionati. I modelli Swin sono più grandi e relativamente più accurati, mentre i modelli MobileNet sono più piccoli, relativamente meno accurati e adatti ai vincoli di risorse dei dispositivi mobili. È importante notare che questa frontiera è condizionata da una varietà di fattori, tra cui l'esatto set di dati utilizzato e gli iperparametri di fine tuning selezionati. Potresti scoprire che il tuo set di dati personalizzato produce un set diverso di soluzioni pareto efficienti e potresti desiderare tempi di addestramento più lunghi con diversi iperparametri, come più aumento dei dati o messa a punto più del semplice livello di classificazione superiore del modello.

Conclusione

In questo post, abbiamo mostrato come eseguire la selezione del modello su larga scala o le attività di benchmarking utilizzando l'hub del modello JumpStart. Questa soluzione può aiutarti a scegliere il modello migliore per le tue esigenze. Ti invitiamo a provare ed esplorare questo soluzione sul tuo set di dati.

Riferimenti

Maggiori informazioni sono disponibili alle seguenti risorse:

Circa gli autori

Dottor Kyle Ulrich è uno scienziato applicato con il Algoritmi integrati di Amazon SageMaker squadra. I suoi interessi di ricerca includono algoritmi di machine learning scalabili, visione artificiale, serie storiche, bayesiani non parametrici e processi gaussiani. Il suo dottorato di ricerca è presso la Duke University e ha pubblicato articoli su NeurIPS, Cell e Neuron.

Dottor Kyle Ulrich è uno scienziato applicato con il Algoritmi integrati di Amazon SageMaker squadra. I suoi interessi di ricerca includono algoritmi di machine learning scalabili, visione artificiale, serie storiche, bayesiani non parametrici e processi gaussiani. Il suo dottorato di ricerca è presso la Duke University e ha pubblicato articoli su NeurIPS, Cell e Neuron.

Dottor Ashish Khetan è un Senior Applied Scientist con Algoritmi integrati di Amazon SageMaker e aiuta a sviluppare algoritmi di apprendimento automatico. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois Urbana Champaign. È un ricercatore attivo nell'apprendimento automatico e nell'inferenza statistica e ha pubblicato molti articoli in conferenze NeurIPS, ICML, ICLR, JMLR, ACL ed EMNLP.

Dottor Ashish Khetan è un Senior Applied Scientist con Algoritmi integrati di Amazon SageMaker e aiuta a sviluppare algoritmi di apprendimento automatico. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois Urbana Champaign. È un ricercatore attivo nell'apprendimento automatico e nell'inferenza statistica e ha pubblicato molti articoli in conferenze NeurIPS, ICML, ICLR, JMLR, ACL ed EMNLP.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- WRI

- accesso

- accessibile

- Il mio account

- precisione

- preciso

- Raggiungere

- operanti in

- attivo

- aggiunta

- indirizzo

- indirizzi

- Rettificato

- affiliato

- contro

- algoritmo

- Algoritmi

- Tutti

- già

- Sebbene il

- sempre

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Analisi

- .

- ed

- Un altro

- api

- Applicazioni

- applicato

- appropriatamente

- architettura

- RISERVATA

- argomento

- associato

- allegare

- Tentativi

- Automatico

- disponibile

- media

- AWS

- basato

- bayesiano

- perché

- prima

- essendo

- analisi comparativa

- MIGLIORE

- Big

- incassato

- affari

- Bandi

- candidato

- casi

- categoria

- impegnativo

- caratteristica

- Scegli

- classe

- classificazione

- classificare

- cliente

- combinato

- Uncommon

- confronto

- completamento di una

- Completato

- completamento

- complessità

- computer

- Visione computerizzata

- preoccupazioni

- conferenze

- Configurazione

- collegato

- Connessioni

- Considerazioni

- vincoli

- contiene

- continua

- controllo

- controlli

- comodità

- Corrispondente

- coprire

- creare

- Corrente

- curva

- costume

- dati

- dataset

- più profondo

- Predefinito

- dipende

- schierare

- distribuzione

- deployment

- profondità

- descritta

- descrizione

- dettagli

- sviluppare

- dispositivi

- diverso

- discutere

- distribuito

- paesaggio differenziato

- non

- Duca

- Università del Duca

- durante

- ogni

- In precedenza

- Presto

- più facile

- efficiente

- o

- eliminato

- enable

- incoraggiare

- incoraggiato

- da un capo all'altro

- endpoint

- Ambiente

- epoca

- epoche

- errore

- valutare

- valutato

- valutazione

- esempio

- Esempi

- Tranne

- esplora

- Esplorare

- espressioni

- estratto

- Fattori

- fiera

- favorire

- caratteristica

- Caratteristiche

- campi

- figura

- Infine

- Trovate

- Nome

- adatto

- i seguenti

- Ex

- da

- Frontier

- Frontiers

- completamente

- funzioni

- futuro

- Futures

- generare

- ottenere

- dato

- globali

- buono

- GPU

- GPU

- grande

- maggiore

- Green

- accade

- pesantemente

- Aiuto

- aiuta

- alto livello

- alta qualità

- superiore

- Come

- Tutorial

- HTML

- HTTPS

- Hub

- centinaia

- Sintonia iperparametro

- Illinois

- Immagine

- Classificazione delle immagini

- immagini

- realizzare

- implementazione

- implementato

- importanza

- importante

- miglioramento

- miglioramento

- in

- includere

- inclusi

- Compreso

- Aumento

- Aumenta

- crescente

- informazioni

- ingresso

- esempio

- interesse

- interessi

- Interfaccia

- interno

- intrinseco

- introdurre

- IT

- Lavoro

- Offerte di lavoro

- json

- Le

- Tasti

- Discografica

- per il tuo brand

- grandi

- larga scala

- superiore, se assunto singolarmente.

- Latenza

- lancia

- lancio

- strato

- galline ovaiole

- principale

- IMPARARE

- apprendimento

- di sollevamento

- leggera

- LIMITE

- limiti

- Lista

- elenchi

- Caricamento in corso

- Lunghi

- più a lungo

- spento

- macchina

- machine learning

- Fare

- molti

- Massimizzare

- significativo

- misurazioni

- Memorie

- metrico

- Metrica

- ML

- Mobile

- dispositivi mobili

- modello

- modelli

- Moduli

- Scopri di più

- multiplo

- Nome

- nomi

- necessaria

- esigenze

- reti

- New

- taccuino

- numero

- Nvidia

- oggetto

- oggetti

- osservare

- ottenere

- ottenuto

- ONE

- operativo

- Operazioni

- ottimizzati

- delineato

- proprio

- documenti

- parametro

- parametri

- particolare

- Pazienza

- Eseguire

- performance

- esegue

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- punti

- Popolare

- possibile

- Post

- potenzialmente

- pr

- prevenire

- Precedente

- Problema

- problemi

- processi

- i processi

- fornire

- purché

- fornisce

- fornitura

- pubblicato

- Python

- domanda

- Domande

- rapidamente

- RAM

- tasso

- mondo reale

- motivi

- riducendo

- Basic

- relativamente

- rimuovere

- Segnalati

- rappresentare

- rappresentato

- rappresenta

- richiesta

- necessario

- Requisiti

- richiede

- riparazioni

- ricercatore

- Risoluzione

- risorsa

- Risorse

- risposta

- Risultati

- Correre

- running

- sagemaker

- stesso

- scalabile

- Scienziato

- script

- sdk

- Cerca

- Sezione

- selezionato

- Selezione

- prodotti

- anziano

- Serie

- servizio

- Sessione

- set

- Set

- regolazione

- alcuni

- Forma

- dovrebbero

- Spettacoli

- Allo stesso modo

- semplificare

- singolo

- SIX

- Taglia

- Dimensioni

- piccole

- inferiore

- So

- soluzione

- Soluzioni

- RISOLVERE

- specificazione

- Specifiche tecniche

- specificato

- Standard

- iniziato

- statistiche

- step

- fermato

- sosta

- memorizzati

- Studio

- successivo

- tale

- sufficiente

- adatto

- tavolo

- mirata

- Task

- task

- team

- tensorflow

- test

- Il

- loro

- in tal modo

- tre

- portata

- tempo

- Serie storiche

- volte

- a

- oggi

- insieme

- strumenti

- top

- top 5

- Totale

- Treni

- allenato

- Training

- trasferimento

- trasformatori

- vero

- Tipi di

- in definitiva

- per

- unico

- Università

- Impiego

- uso

- utilizzare

- utilizzati

- convalida

- Valori

- varietà

- Fisso

- via

- Visualizza

- visione

- quale

- while

- tutto

- largo

- volere

- entro

- senza

- sarebbe

- scrittura

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro