Le notizie false, definite come notizie che trasmettono o incorporano informazioni false, fabbricate o deliberatamente fuorvianti, circolano già dall’avvento della stampa. La rapida diffusione di notizie false e disinformazione online non solo inganna il pubblico, ma può anche avere un profondo impatto sulla società, sulla politica, sull’economia e sulla cultura. Esempi inclusi:

- Coltivare la sfiducia nei media

- Minando il processo democratico

- Diffondere scienza falsa o screditata (ad esempio, il movimento anti-vax)

I progressi nell’intelligenza artificiale (AI) e nell’apprendimento automatico (ML) hanno reso ancora più semplice lo sviluppo di strumenti per la creazione e la condivisione di notizie false. I primi esempi includono bot sociali avanzati e account automatizzati che potenziano la fase iniziale della diffusione di notizie false. In generale, per il pubblico non è banale determinare se tali account sono persone o bot. Inoltre, i social bot non sono strumenti illegali e molte aziende li acquistano legalmente come parte della loro strategia di marketing. Pertanto non è facile frenare sistematicamente l’uso dei social bot.

Le recenti scoperte nel campo dell’intelligenza artificiale generativa rendono possibile la produzione di contenuti testuali a un ritmo senza precedenti con l’aiuto di modelli linguistici di grandi dimensioni (LLM). Gli LLM sono modelli di testo AI generativi con oltre 1 miliardo di parametri e sono facilitati nella sintesi di testo di alta qualità.

In questo post, esploriamo come utilizzare gli LLM per affrontare il problema prevalente del rilevamento di notizie false. Suggeriamo che i LLM siano sufficientemente avanzati per questo compito, soprattutto se migliorate tecniche tempestive come Catena di pensiero ed Reagire vengono utilizzati insieme a strumenti per il recupero delle informazioni.

Lo illustriamo creando un file LangChain applicazione che, data una notizia, informa l'utente se l'articolo è vero o falso utilizzando il linguaggio naturale. La soluzione utilizza anche Roccia Amazzonica, un servizio completamente gestito che rende accessibili i modelli di fondazione (FM) di Amazon e di fornitori di modelli di terze parti tramite Console di gestione AWS e API.

LLM e fake news

Il fenomeno delle fake news ha iniziato ad evolversi rapidamente con l’avvento di Internet e più specificatamente dei social media (Nielsen et al., 2017). Sui social media, le notizie false possono essere condivise rapidamente nella rete di un utente, portando il pubblico a formarsi un'opinione collettiva sbagliata. Inoltre, le persone spesso diffondono notizie false in modo impulsivo, ignorando la realtà dei contenuti se le notizie sono in sintonia con le loro norme personali (Tsipursky et al. 2018). La ricerca nelle scienze sociali ha suggerito che il bias cognitivo (bias di conferma, effetto carrozzone e bias di supporto alla scelta) è uno dei fattori più cruciali nel prendere decisioni irrazionali in termini sia di creazione che di consumo di notizie false (Kim, et al., 2021). Ciò implica anche che i consumatori di notizie condividano e consumino informazioni solo nella direzione di rafforzare le proprie convinzioni.

Il potere dell’intelligenza artificiale generativa di produrre contenuti testuali e ricchi a un ritmo senza precedenti aggrava il problema delle fake news. Un esempio degno di nota è la tecnologia deepfake, che combina varie immagini su un video originale e genera un video diverso. Oltre all’intento di disinformazione che gli attori umani apportano al mix, gli LLM aggiungono una serie completamente nuova di sfide:

- Errori di fatto – I LLM hanno un rischio maggiore di contenere errori fattuali a causa della natura della loro formazione e della capacità di essere creativi durante la generazione delle parole successive in una frase. La formazione LLM si basa sulla presentazione ripetuta di un modello con input incompleti, quindi sull'utilizzo di tecniche di formazione ML fino a colmare correttamente le lacune, apprendendo così la struttura del linguaggio e un modello mondiale basato sul linguaggio. Di conseguenza, sebbene gli LLM siano ottimi abbinatori e ricombinatori di modelli (“pappagalli stocastici”), falliscono in una serie di compiti semplici che richiedono ragionamento logico o deduzione matematica e possono dare risposte allucinanti. Inoltre, la temperatura è uno dei parametri di input LLM che controlla il comportamento del modello durante la generazione della parola successiva in una frase. Selezionando una temperatura più alta, il modello utilizzerà una parola con probabilità più bassa, fornendo una risposta più casuale.

- Lungo – I testi generati tendono ad essere lunghi e mancano di una granularità chiaramente definita per i singoli fatti.

- Mancanza di controllo dei fatti – Non sono disponibili strumenti standardizzati per il controllo dei fatti durante il processo di generazione del testo.

Nel complesso, la combinazione della psicologia umana e dei limiti dei sistemi di intelligenza artificiale ha creato una tempesta perfetta per la proliferazione di notizie false e disinformazione online.

Panoramica della soluzione

Gli LLM stanno dimostrando capacità eccezionali nella generazione, comprensione e apprendimento del linguaggio. Vengono addestrati su un vasto corpus di testi provenienti da Internet, dove la qualità e l'accuratezza del linguaggio naturale estratto potrebbero non essere garantite.

In questo post, forniamo una soluzione per rilevare le notizie false basata sia sull'approccio immediato Chain-of-Thought che Re-Act (Reasoning and Acting). Innanzitutto, discutiamo queste due tecniche di ingegneria rapida, quindi mostriamo la loro implementazione utilizzando LangChain e Amazon Bedrock.

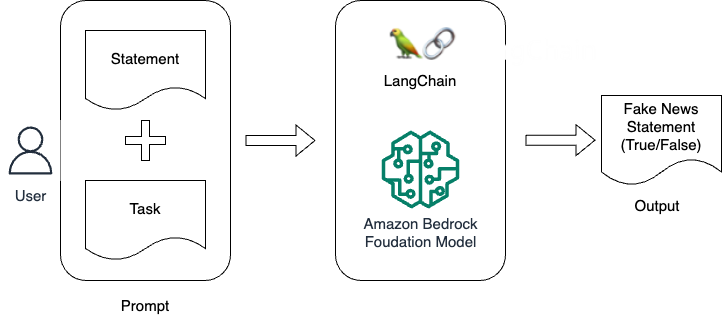

Il seguente diagramma dell'architettura delinea la soluzione per il nostro rilevatore di notizie false.

Diagramma dell'architettura per il rilevamento delle notizie false.

Usiamo un sottoinsieme di Set di dati FEBBRE contenente una dichiarazione e la verità fondamentale sulla dichiarazione che indica affermazioni false, vere o non verificabili (Thorne J. et al., 2018).

Il flusso di lavoro può essere suddiviso nei seguenti passaggi:

- L'utente seleziona una delle affermazioni per verificare se è falsa o vera.

- La dichiarazione e l'attività di rilevamento delle notizie false sono incorporate nel prompt.

- Il prompt viene passato a LangChain, che richiama FM in Amazon Bedrock.

- Amazon Bedrock restituisce una risposta alla richiesta dell'utente con l'affermazione True o False.

In questo post utilizziamo il modello Claude v2 di Anthrophic (anthropic.claude-v2). Claude è un LLM generativo basato sulla ricerca di Anthropic nella creazione di sistemi di intelligenza artificiale affidabili, interpretabili e gestibili. Creato utilizzando tecniche come l'intelligenza artificiale costituzionale e l'addestramento all'innocuità, Claude eccelle nel dialogo ponderato, nella creazione di contenuti, nel ragionamento complesso, nella creatività e nella codifica. Tuttavia, utilizzando Amazon Bedrock e la nostra architettura di soluzione, abbiamo anche la flessibilità di scegliere tra altri FM forniti da Amazon, AI21labs, avere coesionee Stabilità.ai.

È possibile trovare i dettagli di implementazione nelle sezioni seguenti. Il codice sorgente è disponibile in il repository GitHub.

Prerequisiti

Per questo tutorial è necessario un terminale bash con Python 3.9 o versione successiva installato su Linux, Mac o un sottosistema Windows per Linux e un account AWS.

Si consiglia inoltre di utilizzare an Amazon Sage Maker Studio taccuino, un AWS Cloud9 istanza, o un Cloud di calcolo elastico di Amazon (Amazon EC2).

Distribuisci il rilevamento di notizie false utilizzando l'API Amazon Bedrock

La soluzione utilizza l'API Amazon Bedrock, a cui è possibile accedere utilizzando il file Interfaccia della riga di comando di AWS (AWS CLI), il SDK AWS per Python (Boto3), o Amazon Sage Maker taccuino. Fare riferimento al Guida per l'utente di Amazon Bedrock per maggiori informazioni. Per questo post utilizziamo l'API Amazon Bedrock tramite l'SDK AWS per Python.

Configura l'ambiente API Amazon Bedrock

Per configurare il tuo ambiente API Amazon Bedrock, completa i seguenti passaggi:

- Scarica l'ultimo Boto3 o aggiornalo:

- Assicurati di configurare le credenziali AWS utilizzando il file

aws configurecomandarli o passarli al client Boto3. - Installa l'ultima versione di LangChain:

Ora puoi testare la tua configurazione utilizzando il seguente script della shell Python. Lo script crea un'istanza del client Amazon Bedrock utilizzando Boto3. Successivamente, chiamiamo il list_foundation_models API per ottenere l'elenco dei modelli di fondazione disponibili per l'uso.

Dopo aver eseguito correttamente il comando precedente, dovresti ottenere l'elenco dei FM da Amazon Bedrock.

LangChain come soluzione di concatenamento rapida

Per rilevare notizie false per una determinata frase, seguiamo il processo di ragionamento della catena di pensiero zero-shot (Wei J. et al., 2022), che si compone dei seguenti passaggi:

- Inizialmente, il modello tenta di creare una dichiarazione sulla notizia suggerita.

- Il modello crea un elenco puntato di asserzioni.

- Per ogni affermazione, il modello determina se l'affermazione è vera o falsa. Si noti che utilizzando questa metodologia, il modello si basa esclusivamente sulla sua conoscenza interna (pesi calcolati nella fase di pre-addestramento) per raggiungere un verdetto. Le informazioni non vengono verificate rispetto a dati esterni a questo punto.

- Dati i fatti, il modello risponde VERO o FALSO per l'affermazione data nel prompt.

Per raggiungere questi passaggi, utilizziamo LangChain, un framework per lo sviluppo di applicazioni basate su modelli linguistici. Questo framework ci consente di aumentare i FM concatenando insieme vari componenti per creare casi d'uso avanzati. In questa soluzione utilizziamo il built-in SimpleSequentialChain in LangChain per creare una semplice catena sequenziale. Questo è molto utile perché possiamo prendere l'output da una catena e usarlo come input per un'altra.

Amazon Bedrock è integrato con LangChain, quindi devi solo istanziarlo passando il file model_id quando si istanzia l'oggetto Amazon Bedrock. Se necessario, i parametri di inferenza del modello possono essere forniti tramite il file model_kwargs argomento, come ad esempio:

- maxTokenCount – Il numero massimo di token nella risposta generata

- stopSequences – La sequenza di arresto utilizzata dal modello

- temperatura – Un valore compreso tra 0 e 1, dove 0 indica il più deterministico e 1 il più creativo

- top – Un valore compreso tra 0 e 1 e viene utilizzato per controllare le scelte dei token in base alla probabilità delle scelte potenziali

Se è la prima volta che utilizzi un modello base Amazon Bedrock, assicurati di richiedere l'accesso al modello selezionandolo dall'elenco dei modelli nella pagina Accesso al modello pagina sulla console Amazon Bedrock, che nel nostro caso è claude-v2 di Anthropic.

La seguente funzione definisce la catena di prompt Chain-of-Thought menzionata in precedenza per il rilevamento di notizie false. La funzione accetta l'oggetto Amazon Bedrock (llm) e il prompt dell'utente (q) come argomenti. Quello di LangChain Modello Prompt la funzionalità viene utilizzata qui per predefinire una ricetta per la generazione di prompt.

Il codice seguente chiama la funzione definita in precedenza e fornisce la risposta. La dichiarazione è TRUE or FALSE. TRUE significa che la dichiarazione fornita contiene fatti corretti e FALSE significa che l'affermazione contiene almeno un fatto errato.

Un esempio di istruzione e risposta del modello è fornito nel seguente output:

ReAct e strumenti

Nell'esempio precedente, il modello ha identificato correttamente che l'affermazione è falsa. Tuttavia, sottoporre nuovamente la query dimostra l'incapacità del modello di distinguere la correttezza dei fatti. Il modello non dispone degli strumenti per verificare la veridicità delle affermazioni oltre la propria memoria di addestramento, quindi le esecuzioni successive dello stesso prompt possono portarlo a etichettare erroneamente affermazioni false come vere. Nel codice seguente, hai un'esecuzione diversa dello stesso esempio:

Una tecnica per garantire la veridicità è ReAct. Reagire (Yao S. et al., 2023) è una tecnica rapida che aumenta il modello di base con lo spazio di azione di un agente. In questo post, così come nel documento ReAct, lo spazio azione implementa il recupero delle informazioni utilizzando le azioni di ricerca, ricerca e completamento da una semplice API Web di Wikipedia.

Il motivo per cui si utilizza ReAct rispetto a Chain-of-Thought è utilizzare il recupero di conoscenza esterna per aumentare il modello di base per rilevare se una determinata notizia è falsa o vera.

In questo post, utilizziamo l'implementazione di ReAct di LangChain tramite l'agente ZERO_SHOT_REACT_DESCRIPTION. Modifichiamo la funzione precedente per implementare ReAct e utilizzare Wikipedia utilizzando la funzione load_tools dal file langchain.agents.

Dobbiamo anche installare il pacchetto Wikipedia:

!pip install Wikipedia

Di seguito il nuovo codice:

Quello che segue è l'output della funzione precedente data la stessa istruzione usata prima:

ripulire

Per risparmiare sui costi, elimina tutte le risorse distribuite come parte del tutorial. Se hai avviato AWS Cloud9 o un'istanza EC2, puoi eliminarla tramite la console o utilizzando AWS CLI. Allo stesso modo, puoi eliminare il notebook SageMaker che potresti aver creato tramite la console SageMaker.

Limitazioni e lavori correlati

Il campo del rilevamento delle notizie false è attivamente studiato nella comunità scientifica. In questo post abbiamo utilizzato le tecniche Chain-of-Thought e ReAct e nella valutazione delle tecniche ci siamo concentrati solo sull'accuratezza della classificazione della tecnica rapida (se una determinata affermazione è vera o falsa). Pertanto, non abbiamo considerato altri aspetti importanti come la velocità della risposta, né esteso la soluzione ad ulteriori fonti di conoscenza oltre a Wikipedia.

Sebbene questo post si concentri su due tecniche, Chain-of-Thought e ReAct, un ampio corpus di lavoro ha esplorato il modo in cui gli LLM possono rilevare, eliminare o mitigare le notizie false. Lee et al. ha proposto l'uso di un modello codificatore-decodificatore che utilizza il NER (riconoscimento delle entità denominate) per mascherare le entità denominate al fine di garantire che il token mascherato utilizzi effettivamente la conoscenza codificata nel modello linguistico. Chern et al. ha sviluppato FacTool, che utilizza i principi della catena di pensiero per estrarre affermazioni dal prompt e di conseguenza raccogliere prove rilevanti delle affermazioni. Il LLM giudica quindi la fattualità del reclamo in base all'elenco delle prove recuperate. Du E. et al. presenta un approccio complementare in cui più LLM propongono e discutono le loro risposte individuali e processi di ragionamento su più round al fine di arrivare a una risposta finale comune.

Sulla base della letteratura, vediamo che l’efficacia dei LLM nel rilevare notizie false aumenta quando i LLM sono arricchiti con conoscenza esterna e capacità di conversazione multi-agente. Tuttavia, questi approcci sono più complessi dal punto di vista computazionale perché richiedono più chiamate e interazioni del modello, prompt più lunghi e chiamate a livello di rete lunghe. In definitiva, questa complessità si traduce in un aumento dei costi complessivi. Consigliamo di valutare il rapporto costi/prestazioni prima di implementare soluzioni simili in produzione.

Conclusione

In questo post, abbiamo approfondito come utilizzare gli LLM per affrontare il problema prevalente delle fake news, che rappresenta una delle maggiori sfide della nostra società al giorno d'oggi. Abbiamo iniziato delineando le sfide presentate dalle fake news, ponendo l’accento sul loro potenziale di influenzare il sentimento pubblico e causare disagi sociali.

Abbiamo quindi introdotto il concetto di LLM come modelli di intelligenza artificiale avanzati addestrati su una notevole quantità di dati. Grazie a questa formazione approfondita, questi modelli vantano un’impressionante comprensione del linguaggio, consentendo loro di produrre testi simili a quelli umani. Con questa capacità, abbiamo dimostrato come gli LLM possono essere sfruttati nella battaglia contro le notizie false utilizzando due diverse tecniche di tempestività, Chain-of-Thought e ReAct.

Abbiamo sottolineato come i LLM possano facilitare i servizi di verifica dei fatti su una scala senza precedenti, data la loro capacità di elaborare e analizzare rapidamente grandi quantità di testo. Questo potenziale di analisi in tempo reale può portare al rilevamento precoce e al contenimento delle notizie false. Lo abbiamo illustrato creando uno script Python che, data un'affermazione, evidenzia all'utente se l'articolo è vero o falso utilizzando il linguaggio naturale.

Abbiamo concluso sottolineando i limiti dell’approccio attuale e con una nota di speranza, sottolineando che, con le adeguate tutele e continui miglioramenti, gli LLM potrebbero diventare strumenti indispensabili nella lotta alle fake news.

Ci piacerebbe sentire la tua opinione. Fateci sapere cosa ne pensate nella sezione commenti o utilizzate il forum dei problemi in il repository GitHub.

Dichiarazione di non responsabilità: il codice fornito in questo post è destinato esclusivamente a scopi didattici e di sperimentazione. Non si dovrebbe fare affidamento su di esso per individuare notizie false o disinformazione nei sistemi di produzione del mondo reale. Non viene fornita alcuna garanzia circa l'accuratezza o la completezza del rilevamento di notizie false utilizzando questo codice. Gli utenti devono prestare attenzione ed eseguire la dovuta diligenza prima di utilizzare queste tecniche in applicazioni sensibili.

Per iniziare con Amazon Bedrock, visita il Console Amazon Bedrock.

Circa gli autori

Anamaria Todor è un Principal Solutions Architect con sede a Copenhagen, Danimarca. Ha visto il suo primo computer quando aveva 4 anni e da allora non ha mai abbandonato l'informatica, i videogiochi e l'ingegneria. Ha lavorato in vari ruoli tecnici, da libero professionista, sviluppatore full-stack, ingegnere di dati, responsabile tecnico e CTO, presso varie aziende in Danimarca, concentrandosi sui settori dei giochi e della pubblicità. Lavora in AWS da oltre 3 anni, lavorando come Principal Solutions Architect, concentrandosi principalmente su scienze della vita e AI/ML. Anamaria ha una laurea in ingegneria applicata e informatica, un master in informatica e oltre 10 anni di esperienza in AWS. Quando non lavora o non gioca ai videogiochi, insegna a ragazze e professioniste a comprendere e trovare il loro percorso attraverso la tecnologia.

Anamaria Todor è un Principal Solutions Architect con sede a Copenhagen, Danimarca. Ha visto il suo primo computer quando aveva 4 anni e da allora non ha mai abbandonato l'informatica, i videogiochi e l'ingegneria. Ha lavorato in vari ruoli tecnici, da libero professionista, sviluppatore full-stack, ingegnere di dati, responsabile tecnico e CTO, presso varie aziende in Danimarca, concentrandosi sui settori dei giochi e della pubblicità. Lavora in AWS da oltre 3 anni, lavorando come Principal Solutions Architect, concentrandosi principalmente su scienze della vita e AI/ML. Anamaria ha una laurea in ingegneria applicata e informatica, un master in informatica e oltre 10 anni di esperienza in AWS. Quando non lavora o non gioca ai videogiochi, insegna a ragazze e professioniste a comprendere e trovare il loro percorso attraverso la tecnologia.

Marcel Castro è un Senior Solutions Architect con sede a Oslo, Norvegia. Nel suo ruolo, Marcel aiuta i clienti con l'architettura, la progettazione e lo sviluppo di infrastrutture ottimizzate per il cloud. È membro del team AWS Generative AI Ambassador con l'obiettivo di guidare e supportare i clienti EMEA nel loro percorso verso l'intelligenza artificiale generativa. Ha conseguito un dottorato in Informatica in Svezia e un master e una laurea in Ingegneria Elettrica e Telecomunicazioni in Brasile.

Marcel Castro è un Senior Solutions Architect con sede a Oslo, Norvegia. Nel suo ruolo, Marcel aiuta i clienti con l'architettura, la progettazione e lo sviluppo di infrastrutture ottimizzate per il cloud. È membro del team AWS Generative AI Ambassador con l'obiettivo di guidare e supportare i clienti EMEA nel loro percorso verso l'intelligenza artificiale generativa. Ha conseguito un dottorato in Informatica in Svezia e un master e una laurea in Ingegneria Elettrica e Telecomunicazioni in Brasile.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :ha

- :È

- :non

- :Dove

- $100 milioni

- $ SU

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21st

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- capacità

- WRI

- sopra

- AC

- accademico

- ricerca accademica

- Academy

- accesso

- accessibile

- accessibile

- Il mio account

- conti

- precisione

- Raggiungere

- realizzazioni

- operanti in

- recitazione

- Action

- azioni

- attivamente

- attori

- effettivamente

- aggiungere

- aggiunta

- aggiuntivo

- Avanzate

- Avvento

- Pubblicità

- ancora

- contro

- Agente

- agenti

- AI

- Modelli AI

- Sistemi di intelligenza artificiale

- AI / ML

- AL

- Tutti

- consente

- da solo

- anche

- Sebbene il

- Amazon

- Amazon EC2

- Amazon Web Services

- Ambassador

- americano

- tra

- importi

- an

- .

- analizzare

- Antico

- ed

- Annualmente

- Un altro

- rispondere

- risposte

- Antropico

- in qualsiasi

- api

- API

- appare

- Applicazioni

- applicazioni

- applicato

- designato

- approccio

- approcci

- circa

- architettura

- SONO

- argomento

- argomenti

- in giro

- articolo

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- Arte

- AS

- aspetti

- valutare

- valutazioni

- ipotesi

- assicurato

- astronomia

- At

- Tentativi

- aumentare

- aumentata

- aumenti

- Automatizzata

- disponibile

- assegnato

- AWS

- AWS Cloud9

- base

- basato

- bash

- Battaglia

- BE

- perché

- diventare

- diventando

- stato

- prima

- comportamento

- dietro

- essendo

- credenze

- oltre a

- fra

- Al di là di

- pregiudizio

- Miliardo

- biologia

- biomedico

- stile di vita

- entrambi

- bots

- Brasil

- portare

- Rotto

- incassato

- uomo d'affari

- ma

- by

- chiamata

- Bandi

- Materiale

- funzionalità

- capacità

- Ultra-Grande

- Custodie

- casi

- Causare

- cautela

- Secolo

- catena

- Catene

- sfide

- chang

- dai un'occhiata

- chimica

- Cinese

- scelte

- Scegli

- rivendicare

- classe

- classificazione

- chiaramente

- cliente

- Chiudi

- Cloud9

- istruire

- codice

- codifica

- conoscitivo

- raccogliere

- Collective

- College

- COLUMBIA

- combinazione

- Commenti

- Uncommon

- comunemente

- comunità

- Aziende

- confronto

- complementare

- completamento di una

- complesso

- complessità

- componenti

- composto

- Calcolare

- computer

- Informatica

- concetto

- concluso

- Confermare

- conferma

- congiunzione

- conseguentemente

- considerato

- coerente

- consiste

- consolle

- consumare

- Consumatori

- consumo

- Contenimento

- contiene

- contenuto

- creazione di contenuti

- continuo

- contributo

- di controllo

- controlli

- Conversazione

- correggere

- correttamente

- Costo

- Costi

- potuto

- paesi

- nazione

- creare

- creato

- crea

- Creazione

- creazione

- Creative

- la creatività

- Credenziali

- CTO

- Cultura

- frenare

- Corrente

- Clienti

- dati

- dibattito

- decisioni

- definito

- definisce

- Laurea

- democratico

- dimostrato

- dimostra

- dimostrando

- Danmark

- Shirts Department

- schierato

- distribuzione

- Design

- dettagli

- individuare

- rivelazione

- Determinare

- determina

- sviluppato

- Costruttori

- in via di sviluppo

- Mercato

- sviluppi

- Dialogo

- diverso

- diligenza

- direzione

- discutere

- Le disinformazioni sanitarie

- Dsiplay

- interruzioni

- distinguere

- diffidenza

- Medico

- effettua

- non

- giù

- dr

- guidare

- dovuto

- durante

- e

- E&T

- ogni

- In precedenza

- Presto

- guadagnare

- guadagnato

- terra

- più facile

- facile

- Economia

- economia

- educativo

- educatori

- effetto

- efficacia

- o

- eliminato

- altrove

- emersione

- enfasi

- consentendo

- finito

- ingegnere

- Ingegneria

- miglioramenti

- garantire

- entrare

- entità

- entità

- Ambiente

- uguaglianza

- errori

- particolarmente

- sviluppate

- la valutazione

- Anche

- eventi

- evoluzione

- esempio

- Esempi

- esclusivamente

- Esercitare

- esperienza

- Spiegare

- esplora

- Esplorazione

- estensivo

- esterno

- estratto

- facilitare

- facilitato

- fatto

- Fattori

- fatti

- FAIL

- falso

- notizie false

- falso

- famoso

- la donna

- campo

- combattere

- riempimenti

- finale

- finanziario

- Trovate

- ricerca

- finire

- Nome

- prima volta

- Flessibilità

- concentrato

- si concentra

- messa a fuoco

- seguire

- i seguenti

- Nel

- modulo

- formale

- Forum

- Fondazione

- fondamentale

- Fondato

- Contesto

- da

- fu

- completamente

- function

- funzionalità

- Giochi

- gaming

- lacune

- Sesso

- Uguaglianza di genere

- Generale

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- ragazze

- GitHub

- dato

- Go

- scopo

- grande

- Terra

- garanzie

- ha avuto

- cintura da arrampicata

- Avere

- he

- sentire

- Aiuto

- aiuta

- suo

- qui

- alta qualità

- superiore

- evidenzia

- vivamente

- il suo

- storia

- detiene

- onore

- speranzoso

- alloggiamento

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- umano

- i

- IBM

- identificato

- if

- Illegale

- illustrare

- immagini

- Impact

- realizzare

- implementazione

- attrezzi

- importare

- importante

- impressionante

- migliorata

- in

- incapacità

- includere

- inclusi

- Compreso

- Incorporated

- incorpora

- è aumentato

- Aumenta

- indica

- individuale

- industrie

- informazioni

- Informa

- Infrastruttura

- inizialmente

- ingresso

- interno

- install

- installato

- esempio

- Istituto

- istituzioni

- integrato

- Intelligence

- intento

- interazioni

- interno

- Internet

- ai miglioramenti

- introdotto

- invoca

- coinvolto

- problema

- sicurezza

- IT

- SUO

- viaggio

- jpg

- json

- giudici

- kenneth

- Sapere

- conoscenze

- conosciuto

- Dipingere

- Lingua

- grandi

- In ritardo

- con i più recenti

- latino

- lanciato

- strato

- portare

- principale

- apprendimento

- meno

- legalmente

- lasciare

- Vita

- Life Sciences

- piace

- limiti

- linea

- Collegamento

- linux

- Lista

- elencati

- letteratura

- LLM

- logico

- più a lungo

- ricerca

- amore

- Mac

- macchina

- machine learning

- fatto

- principalmente

- mantiene

- maggiore

- make

- FA

- Fare

- gestito

- gestione

- molti

- Marketing

- mask

- master

- matematico

- matematica

- massimo

- Maggio..

- si intende

- significava

- Media

- medicale

- medicina

- membro

- Utenti

- Memorie

- menzionato

- Metodologia

- Michigan

- milione

- miniere

- Disinformazione

- ingannevole

- CON

- Ridurre la perdita dienergia con una

- scelta

- ML

- modello

- modelli

- modificare

- Scopri di più

- maggior parte

- movimento

- multiplo

- my

- Detto

- Nasa

- il

- Naturale

- Natura

- Bisogno

- di applicazione

- Rete

- mai

- New

- notizie

- GENERAZIONE

- no

- Vincitore del premio Nobel

- norme

- Norvegia

- notevole

- taccuino

- adesso

- numero

- oggetto

- osservazione

- ottobre

- of

- offerto

- di frequente

- Vecchio

- on

- ONE

- online

- esclusivamente

- Operazioni

- Opinione

- or

- minimo

- i

- Altro

- altrimenti

- nostro

- lineamenti

- delineando

- produzione

- eccezionale

- ancora

- complessivo

- proprio

- Di proprietà

- Pace

- pacchetto

- pagina

- pagine

- Carta

- parametri

- parte

- passare

- Passato

- Di passaggio

- Brevetti

- sentiero

- Cartamodello

- Persone

- perfetta

- Eseguire

- cronologia

- fase

- phd

- fenomeno

- filosofia

- Fisica

- pezzo

- centrale

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- punto

- politica

- possibile

- Post

- potenziale

- energia

- alimentato

- presentata

- presents

- stampa

- atleta

- precedente

- in precedenza

- principalmente

- Direttore

- principi

- stampa

- stampatrice

- Precedente

- premi

- Problema

- processi

- i processi

- produrre

- Produzione

- Scelto dai professionisti

- profonda

- Programma

- offre

- proposto

- fornire

- purché

- fornitori

- fornisce

- fornitura

- Psicologia

- la percezione

- Acquista

- fini

- Python

- qualità

- quantità

- rapidamente

- radio

- casuale

- gamme

- classificato

- veloce

- rapidamente

- rapporto

- raggiungere

- Reagire

- mondo reale

- tempo reale

- ragione

- ricevere

- ricevuto

- ricetta

- riconoscimento

- raccomandare

- riferimento

- si riferisce

- relazionato

- relativamente

- pertinente

- affidabile

- RIPETUTAMENTE

- deposito

- richiesta

- richiedere

- necessario

- riparazioni

- risuona

- Risorse

- Rispondere

- risposta

- risposte

- responsabile

- ritorno

- problemi

- Ricco

- Rischio

- Ruolo

- ruoli

- round

- Correre

- running

- corre

- s

- garanzie

- sagemaker

- stesso

- Risparmi

- sega

- Scala

- di moto

- Facoltà di Ingegneria

- Scienze

- SCIENZE

- scientifico

- scienziati

- copione

- sdk

- Cerca

- Sezione

- sezioni

- vedere

- Selezione

- anziano

- delicata

- condanna

- sentimento

- Sequenza

- servizio

- Servizi

- set

- flessibile.

- Condividi

- condiviso

- azioni

- compartecipazione

- lei

- Conchiglia

- dovrebbero

- mostrare attraverso le sue creazioni

- simile

- Allo stesso modo

- Un'espansione

- da

- sorella

- So

- Social

- Social Media

- sociale

- Società

- soluzione

- Soluzioni

- alcuni

- Fonte

- codice sorgente

- fonti

- lo spazio

- tensione

- in particolare

- velocità

- diffondere

- Diffondere

- Stage

- Standard

- stanford

- Università di Stanford

- iniziato

- dichiarazione

- dichiarazioni

- stati

- Passi

- Fermare

- Tempesta

- Strategia

- potenziamento

- La struttura

- Gli studenti

- Studio

- successivo

- sostanziale

- Con successo

- tale

- suggerire

- SOMMARIO

- Sovralimentare

- supporto

- sicuro

- Ondeggiare

- Svezia

- rapidamente

- sintesi

- SISTEMI DI TRATTAMENTO

- attrezzatura

- Fai

- prende

- Task

- task

- team

- Consulenza

- per l'esame

- tecniche

- tecnologico

- Tecnologia

- telecomunicazioni

- modello

- terminal

- condizioni

- test

- testo

- testuale

- che

- Il

- le informazioni

- L’ORIGINE

- il mondo

- loro

- Li

- poi

- Là.

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- think

- di parti terze standard

- questo

- quelli

- pensiero

- Attraverso

- per tutto

- TIE

- tempo

- time line

- a

- insieme

- token

- Tokens

- strumenti

- allenato

- Training

- vero

- Verità

- lezione

- seconda

- in definitiva

- sottolineato

- e una comprensione reciproca

- Unito

- Stati Uniti

- Università

- Università

- ineguagliabile

- inaudito

- fino a quando

- upgrade

- su

- us

- uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- Utilizzando

- APPREZZIAMO

- vario

- Fisso

- Giudizio

- verificato

- verificare

- versione

- molto

- via

- Video

- video games

- Visita

- Prima

- we

- sito web

- servizi web

- WELL

- Che

- quando

- se

- quale

- while

- OMS

- tutto

- perché

- wikipedia

- volere

- finestre

- con

- entro

- donna

- Donna

- Ha vinto

- Word

- parole

- Lavora

- lavorato

- flusso di lavoro

- lavoro

- mondo

- valore

- Wrong

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro