Questo post è stato scritto in collaborazione con Marc Neumann, Amor Steinberg e Marinus Krommenhoek del BMW Group.

I BMW Group – con sede a Monaco di Baviera, in Germania – conta 149,000 dipendenti in tutto il mondo e produce in oltre 30 stabilimenti di produzione e assemblaggio in 15 paesi. Oggi il BMW Group è il produttore leader a livello mondiale di automobili e motociclette premium e fornitore di servizi finanziari e di mobilità premium. Il BMW Group definisce le tendenze nella tecnologia di produzione e nella sostenibilità come leader dell’innovazione con un mix di materiali intelligente, un passaggio tecnologico verso la digitalizzazione e una produzione efficiente in termini di risorse.

In un mondo sempre più digitale e in rapido cambiamento, le strategie aziendali e di sviluppo dei prodotti del BMW Group fanno molto affidamento sul processo decisionale basato sui dati. Pertanto, la necessità di data scientist e ingegneri di machine learning (ML) è cresciuta in modo significativo. Questi professionisti qualificati hanno il compito di costruire e implementare modelli che migliorino la qualità e l'efficienza dei processi aziendali di BMW e consentano decisioni di leadership informate.

I data scientist e gli ingegneri ML necessitano di strumenti capaci e di risorse di calcolo sufficienti per il loro lavoro. Pertanto, diversi anni fa BMW ha creato un’infrastruttura centralizzata di ML/deep learning in sede e l’ha costantemente aggiornata. Per aprire la strada alla crescita dell’intelligenza artificiale, il BMW Group doveva fare un salto in termini di scalabilità ed elasticità, riducendo al contempo i costi operativi, le licenze software e la gestione dell’hardware.

In questo post parleremo di come BMW Group, in collaborazione con AWS Professional Services, ha creato il suo servizio Jupyter Managed (JuMa) per affrontare queste sfide. JuMa è un servizio della piattaforma AI del BMW Group per analisti di dati, ingegneri ML e scienziati di dati che fornisce uno spazio di lavoro intuitivo con un ambiente di sviluppo integrato (IDE). È alimentato da Amazon Sage Maker Studio e fornisce JupyterLab per Python e Posit Workbench per R. Questa offerta consente agli ingegneri di BMW ML di eseguire analisi dei dati e ML incentrati sul codice, aumenta la produttività degli sviluppatori fornendo funzionalità self-service e automazione dell'infrastruttura e si integra strettamente con il panorama degli strumenti IT centralizzati di BMW.

JuMa è ora disponibile per tutti i data scientist, gli ingegneri ML e gli analisti di dati del BMW Group. Il servizio semplifica i flussi di lavoro di sviluppo e produzione ML (MLOps) in tutta BMW fornendo un ambiente di sviluppo economicamente vantaggioso e scalabile che facilita la collaborazione senza soluzione di continuità tra i team di data science e di ingegneria in tutto il mondo. Ciò si traduce in una sperimentazione più rapida e cicli di convalida delle idee più brevi. Inoltre, l'infrastruttura JuMa, su cui si basa AWS senza server e servizi gestiti, aiuta a ridurre i costi operativi per i team DevOps e consente loro di concentrarsi sull'attivazione di casi d'uso e sull'accelerazione dell'innovazione dell'intelligenza artificiale nel BMW Group.

Sfide legate alla crescita di una piattaforma AI locale

Prima di introdurre il servizio JuMa, i team BMW in tutto il mondo utilizzavano due piattaforme locali che fornivano ai team gli ambienti JupyterHub e RStudio. Queste piattaforme erano troppo limitate in termini di CPU, GPU e memoria per consentire la scalabilità dell’intelligenza artificiale nel BMW Group. Scalare queste piattaforme con la gestione di più hardware locale, più licenze software e tariffe di supporto richiederebbe investimenti iniziali significativi e sforzi elevati per la loro manutenzione. In aggiunta a ciò, erano disponibili funzionalità self-service limitate, che richiedevano un elevato impegno operativo per i team DevOps. Ancora più importante, l’uso di queste piattaforme non era allineato con la strategia IT cloud-first del BMW Group. Ad esempio, i team che utilizzano queste piattaforme non hanno potuto migrare facilmente i loro prototipi AI/ML verso l'industrializzazione della soluzione in esecuzione su AWS. Al contrario, i team di data science e analisi che già utilizzavano AWS direttamente per la sperimentazione dovevano anche occuparsi della costruzione e del funzionamento della propria infrastruttura AWS garantendo al contempo la conformità con le politiche interne, le leggi locali e i regolamenti del BMW Group. Ciò includeva una serie di attività di configurazione e governance, dall'ordinazione di account AWS, alla limitazione dell'accesso a Internet, all'utilizzo dei pacchetti elencati consentiti per mantenere aggiornate le immagini Docker.

Panoramica della soluzione

JuMa è un servizio di piattaforma AI multi-tenant completamente gestito e con sicurezza rafforzata, costruito su AWS con Sage Maker Studio al centro. Facendo affidamento sui servizi serverless e gestiti di AWS come elementi costitutivi principali dell'infrastruttura, il team JuMa DevOps non deve preoccuparsi di applicare patch ai server, aggiornare lo storage o gestire altri componenti dell'infrastruttura. Il servizio gestisce tutti questi processi in modo automatico, fornendo una potente piattaforma tecnica generalmente aggiornata e pronta all'uso.

Gli utenti JuMa possono ordinare facilmente uno spazio di lavoro tramite un portale self-service per creare un ambiente di sviluppo e sperimentazione sicuro e isolato per i propri team. Dopo aver effettuato il provisioning di uno spazio di lavoro JuMa, gli utenti possono avviare gli ambienti workbench JupyterLab o Posit in SageMaker Studio con pochi clic e avviare immediatamente lo sviluppo, utilizzando gli strumenti e i framework con cui hanno più familiarità. JuMa è strettamente integrato con una gamma di servizi IT centrali di BMW, tra cui la gestione dell'identità e degli accessi, la gestione dei ruoli e dei diritti, BMW Cloud Data Hub (Data Lake BMW su AWS) e database locali. Quest'ultimo aiuta i team AI/ML ad accedere senza problemi ai dati richiesti, purché siano autorizzati a farlo, senza la necessità di creare pipeline di dati. Inoltre, i notebook possono essere integrati nei repository Git aziendali per collaborare utilizzando il controllo della versione.

La soluzione elimina tutte le complessità tecniche associate alla gestione, configurazione e personalizzazione degli account AWS per i team AI/ML, consentendo loro di concentrarsi completamente sull'innovazione AI. La piattaforma garantisce che la configurazione dello spazio di lavoro soddisfi immediatamente i requisiti di sicurezza e conformità di BMW.

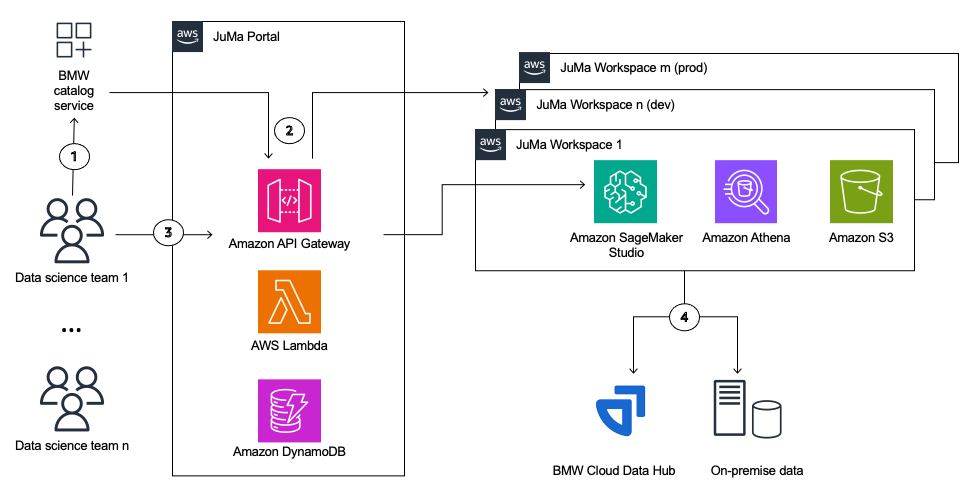

Il diagramma seguente descrive la visualizzazione del contesto di alto livello dell'architettura.

Viaggio dell'utente

I membri del team BMW AI/ML possono ordinare il proprio spazio di lavoro JuMa utilizzando il servizio catalogo standard di BMW. Dopo l'approvazione da parte del manager di linea, l'area di lavoro JuMa ordinata viene fornita dalla piattaforma in modo completamente automatizzato. Il flusso di lavoro di provisioning dell'area di lavoro include i seguenti passaggi (come numerati nel diagramma dell'architettura).

- Un team di data scientist ordina un nuovo spazio di lavoro JuMa nel catalogo BMW. JuMa effettua automaticamente il provisioning di un nuovo account AWS per lo spazio di lavoro. Ciò garantisce il completo isolamento tra le aree di lavoro seguendo la struttura degli account del modello federato menzionata in Best practice per l'amministrazione di SageMaker Studio.

- JuMa configura uno spazio di lavoro (che è un file Dominio Sagemaker) che consente solo quelli predefiniti Amazon Sage Maker funzionalità richieste per la sperimentazione e lo sviluppo, kernel personalizzati specifici e configurazioni del ciclo di vita. Configura inoltre le sottoreti e i gruppi di sicurezza richiesti che garantiscono l'esecuzione dei notebook in un ambiente sicuro.

- Dopo il provisioning degli spazi di lavoro, gli utenti autorizzati accedono al portale JuMa e accedono all'IDE SageMaker Studio all'interno del proprio spazio di lavoro utilizzando un URL prefirmato SageMaker. Gli utenti possono scegliere tra l'apertura di uno spazio privato di SageMaker Studio o un file spazio condiviso. Gli spazi condivisi incoraggiano la collaborazione tra diversi membri di un team che possono lavorare in parallelo sugli stessi notebook, mentre gli spazi privati consentono un ambiente di sviluppo per carichi di lavoro solitari.

- Utilizzando il portale dati BMW, gli utenti possono richiedere l'accesso ai database locali o ai dati archiviati nel Cloud Data Hub di BMW, rendendoli disponibili nel loro spazio di lavoro per lo sviluppo e la sperimentazione, dalla preparazione e analisi dei dati alla formazione e validazione dei modelli.

Dopo che un modello AI è stato sviluppato e convalidato in JuMa, i team AI possono utilizzare il servizio MLOPs della piattaforma AI BMW per implementarlo in produzione in modo rapido e semplice. Questo servizio fornisce agli utenti un'infrastruttura ML e pipeline di livello produttivo su AWS utilizzando SageMaker, che può essere configurato in pochi minuti con pochi clic. Gli utenti devono semplicemente ospitare il proprio modello sull'infrastruttura fornita e personalizzare la pipeline per soddisfare le esigenze specifiche del caso d'uso. In questo modo, la piattaforma AI copre l’intero ciclo di vita dell’IA nel BMW Group.

Caratteristiche di JuMa

Seguendo l'architettura delle migliori pratiche su AWS, il servizio JuMa è stato progettato e implementato secondo Framework ben progettato di AWS. Le decisioni architettoniche di ciascun pilastro Well-Architected sono descritte in dettaglio nelle sezioni seguenti.

Sicurezza e conformità

Per garantire il completo isolamento tra i tenant, ogni spazio di lavoro riceve il proprio account AWS, dove gli utenti autorizzati possono collaborare congiuntamente su attività di analisi nonché sullo sviluppo e la sperimentazione di modelli AI/ML. Il portale JuMa stesso impone l'isolamento in fase di esecuzione utilizzando l'isolamento basato su policy con Gestione dell'identità e dell'accesso di AWS (IAM) e il contesto dell'utente JuMa. Per ulteriori informazioni su questa strategia, fare riferimento a Isolamento runtime basato su policy con IAM.

I data scientist possono accedere al proprio dominio attraverso la rete BMW solo tramite URL prefirmati generati dal portale. L'accesso diretto a Internet è disabilitato all'interno del dominio. I loro privilegi di dominio Sagemaker vengono creati utilizzando Gestore ruoli di Amazon SageMaker personas per garantire l'accesso con privilegi minimi ai servizi AWS necessari per lo sviluppo come SageMaker, Amazzone Atena, Servizio di archiviazione semplice Amazon (Amazon S3) e Colla AWS. Questo ruolo implementa i guardrail ML (come quelli descritti in Governance e controllo), inclusa l'attuazione della formazione sul riciclaggio in entrambi i paesi Cloud privato virtuale di Amazon (Amazon VPC) o senza Internet e consentendo solo l'uso delle immagini SageMaker personalizzate, controllate e aggiornate di JuMa.

Poiché JuMa è progettato per lo sviluppo, la sperimentazione e l'analisi ad hoc, implementa politiche di conservazione per rimuovere i dati dopo 30 giorni. Per accedere ai dati quando necessario e archiviarli a lungo termine, JuMa si integra perfettamente con il BMW Cloud Data Hub e i database locali BMW.

Infine, JuMa supporta più regioni nel conformarsi a speciali situazioni legali locali che, ad esempio, richiedono di elaborare i dati localmente per consentire la sovranità dei dati di BMW.

Eccellenza operativa

Sia il backend della piattaforma JuMa che gli spazi di lavoro sono implementati con AWS senza server e servizi gestiti. L'utilizzo di questi servizi aiuta a ridurre al minimo lo sforzo del team della piattaforma BMW che mantiene e gestisce la soluzione end-to-end, cercando di essere un servizio no-ops. Sia lo spazio di lavoro che il portale vengono monitorati utilizzando Amazon Cloud Watch registri, parametri e allarmi per controllare gli indicatori chiave di prestazione (KPI) e notificare in modo proattivo al team della piattaforma eventuali problemi. Inoltre, il Raggi X AWS Il sistema di tracciamento distribuito viene utilizzato per tracciare le richieste in più componenti e annotare i log CloudWatch con il contesto pertinente allo spazio di lavoro.

Tutte le modifiche all'infrastruttura JuMa vengono gestite e implementate tramite l'automazione utilizzando l'infrastruttura come codice (IaC). Ciò aiuta a ridurre gli sforzi manuali e gli errori umani, aumentare la coerenza e garantire modifiche riproducibili e controllate dalla versione negli spazi di lavoro backend di entrambe le piattaforme JuMa. Nello specifico, tutti gli spazi di lavoro vengono forniti e aggiornati attraverso un processo di onboarding basato su Funzioni AWS Step, AWSCodeBuilde Terraform. Pertanto, non è necessaria alcuna configurazione manuale per integrare nuovi spazi di lavoro sulla piattaforma JuMa.

Ottimizzazione dei costi

Utilizzando i servizi serverless AWS, JuMa garantisce scalabilità su richiesta, dimensioni delle istanze pre-approvate e un modello con pagamento in base al consumo per le risorse utilizzate durante le attività di sviluppo e sperimentazione in base alle esigenze dei team AI/ML. Per ottimizzare ulteriormente i costi, la piattaforma JuMa monitora e identifica le risorse inattive all'interno di SageMaker Studio e le spegne automaticamente per evitare spese per risorse non utilizzate.

Sostenibilità

JuMa sostituisce le due piattaforme locali di BMW per i carichi di lavoro di analisi e deep learning che consumano una notevole quantità di elettricità e producono emissioni di CO2 anche quando non vengono utilizzate. Migrando i carichi di lavoro AI/ML da on-premise ad AWS, BMW ridurrà il proprio impatto ambientale disattivando le piattaforme on-premise.

Inoltre, il meccanismo per l'arresto automatico delle risorse inattive, le politiche di conservazione dei dati e i report sull'utilizzo dello spazio di lavoro ai proprietari implementati in JuMa aiutano a ridurre ulteriormente l'impatto ambientale dell'esecuzione di carichi di lavoro AI/ML su AWS.

Efficienza prestazionale

Utilizzando SageMaker Studio, i team BMW beneficiano di una facile adozione delle ultime funzionalità SageMaker che possono aiutare ad accelerare la loro sperimentazione. Ad esempio, possono utilizzare JumpStart di Amazon SageMaker funzionalità per utilizzare i più recenti modelli open source preaddestrati. Inoltre, aiuta a ridurre gli sforzi dei team AI/ML che passano dalla sperimentazione all'industrializzazione della soluzione, perché l'ambiente di sviluppo fornisce gli stessi servizi principali di AWS ma limitato alle capacità di sviluppo.

L’affidabilità

I domini SageMaker Studio vengono distribuiti in modalità solo VPC per gestire l'accesso a Internet e consentire solo l'accesso ai servizi AWS previsti. La rete è distribuita in due zone di disponibilità per proteggersi da un singolo punto di guasto, ottenendo maggiore resilienza e disponibilità della piattaforma per i suoi utenti.

Le modifiche agli spazi di lavoro JuMa vengono automaticamente distribuite e testate negli ambienti di sviluppo e integrazione, utilizzando pipeline IaC e CI/CD, prima di aggiornare gli ambienti del cliente.

Infine, i dati memorizzati in File system elastico Amazon (Amazon EFS) per i domini SageMaker Studio viene conservato dopo che i volumi vengono eliminati a scopo di backup.

Conclusione

In questo post, abbiamo descritto come BMW Group, in collaborazione con AWS ProServe, ha sviluppato un servizio di piattaforma AI completamente gestito su AWS utilizzando SageMaker Studio e altri servizi serverless e gestiti AWS.

Con JuMa, i team AI/ML di BMW hanno la possibilità di sbloccare nuovo valore aziendale accelerando la sperimentazione e il time-to-market per soluzioni AI dirompenti. Inoltre, migrando dalla sua piattaforma locale, BMW può ridurre gli sforzi e i costi operativi complessivi, aumentando al tempo stesso la sostenibilità e il livello di sicurezza generale.

Per ulteriori informazioni sull'esecuzione dei carichi di lavoro di sperimentazione e sviluppo AI/ML su AWS, visita Amazon Sage Maker Studio.

Informazioni sugli autori

Marc Neumann è il capo della piattaforma AI centrale del gruppo BMP. È responsabile dello sviluppo e dell'implementazione di strategie per l'utilizzo della tecnologia AI per la creazione di valore aziendale in tutto il BMW Group. Il suo obiettivo principale è garantire che l’uso dell’intelligenza artificiale sia sostenibile e scalabile, il che significa che possa essere applicato in modo coerente in tutta l’organizzazione per promuovere la crescita e l’innovazione a lungo termine. Attraverso la sua leadership, Neumann mira a posizionare il BMW Group come leader nell’innovazione guidata dall’intelligenza artificiale e nella creazione di valore nel settore automobilistico e non solo.

Marc Neumann è il capo della piattaforma AI centrale del gruppo BMP. È responsabile dello sviluppo e dell'implementazione di strategie per l'utilizzo della tecnologia AI per la creazione di valore aziendale in tutto il BMW Group. Il suo obiettivo principale è garantire che l’uso dell’intelligenza artificiale sia sostenibile e scalabile, il che significa che possa essere applicato in modo coerente in tutta l’organizzazione per promuovere la crescita e l’innovazione a lungo termine. Attraverso la sua leadership, Neumann mira a posizionare il BMW Group come leader nell’innovazione guidata dall’intelligenza artificiale e nella creazione di valore nel settore automobilistico e non solo.

Amore Steinberg è un ingegnere di machine learning presso il BMW Group e responsabile del servizio di Jupyter Managed, un nuovo servizio che mira a fornire un workbench di analisi e apprendimento automatico incentrato sul codice per ingegneri e data scientist del BMW Group. La sua passata esperienza come ingegnere DevOps presso istituti finanziari gli ha permesso di acquisire una comprensione unica delle sfide che devono affrontare le banche nell'Unione Europea e di mantenere l'equilibrio tra l'impegno per l'innovazione tecnologica, il rispetto di leggi e regolamenti e la massimizzazione della sicurezza per i clienti.

Amore Steinberg è un ingegnere di machine learning presso il BMW Group e responsabile del servizio di Jupyter Managed, un nuovo servizio che mira a fornire un workbench di analisi e apprendimento automatico incentrato sul codice per ingegneri e data scientist del BMW Group. La sua passata esperienza come ingegnere DevOps presso istituti finanziari gli ha permesso di acquisire una comprensione unica delle sfide che devono affrontare le banche nell'Unione Europea e di mantenere l'equilibrio tra l'impegno per l'innovazione tecnologica, il rispetto di leggi e regolamenti e la massimizzazione della sicurezza per i clienti.

Marinus Krommenhoek è un Senior Cloud Solution Architect e uno sviluppatore di software presso il BMW Group. È entusiasta di modernizzare il panorama IT con servizi all'avanguardia che aggiungono un valore elevato e sono facili da mantenere e utilizzare. Marinus è un grande sostenitore dei microservizi, delle architetture serverless e del lavoro agile. Ha una lunga esperienza di lavoro con team distribuiti in tutto il mondo all'interno di grandi aziende.

Marinus Krommenhoek è un Senior Cloud Solution Architect e uno sviluppatore di software presso il BMW Group. È entusiasta di modernizzare il panorama IT con servizi all'avanguardia che aggiungono un valore elevato e sono facili da mantenere e utilizzare. Marinus è un grande sostenitore dei microservizi, delle architetture serverless e del lavoro agile. Ha una lunga esperienza di lavoro con team distribuiti in tutto il mondo all'interno di grandi aziende.

Nicolas Jacob Baer è Principal Cloud Application Architect presso AWS ProServe con una forte attenzione all'ingegneria dei dati e all'apprendimento automatico, con sede in Svizzera. Lavora a stretto contatto con i clienti aziendali per progettare piattaforme dati e creare analisi avanzate e casi d'uso ML.

Nicolas Jacob Baer è Principal Cloud Application Architect presso AWS ProServe con una forte attenzione all'ingegneria dei dati e all'apprendimento automatico, con sede in Svizzera. Lavora a stretto contatto con i clienti aziendali per progettare piattaforme dati e creare analisi avanzate e casi d'uso ML.

Joaquin Rinaudo è Principal Security Architect presso AWS ProServe. La sua passione è creare soluzioni che aiutino gli sviluppatori a migliorare la qualità del loro software. Prima di AWS, ha lavorato in più ambiti nel settore della sicurezza, dalla sicurezza mobile al cloud e agli argomenti relativi alla conformità. Nel tempo libero, Joaquin ama trascorrere del tempo con la famiglia e leggere romanzi di fantascienza.

Joaquin Rinaudo è Principal Security Architect presso AWS ProServe. La sua passione è creare soluzioni che aiutino gli sviluppatori a migliorare la qualità del loro software. Prima di AWS, ha lavorato in più ambiti nel settore della sicurezza, dalla sicurezza mobile al cloud e agli argomenti relativi alla conformità. Nel tempo libero, Joaquin ama trascorrere del tempo con la famiglia e leggere romanzi di fantascienza.

Shukhrat Khodjaev è Senior Global Engagement Manager presso AWS ProServe. È specializzato nella fornitura di big data e soluzioni AI/ML di grande impatto che consentono ai clienti AWS di massimizzare il valore aziendale attraverso l'utilizzo dei dati.

Shukhrat Khodjaev è Senior Global Engagement Manager presso AWS ProServe. È specializzato nella fornitura di big data e soluzioni AI/ML di grande impatto che consentono ai clienti AWS di massimizzare il valore aziendale attraverso l'utilizzo dei dati.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerating-ai-ml-development-at-bmw-group-with-amazon-sagemaker-studio/

- :ha

- :È

- :non

- :Dove

- $ SU

- 000

- 100

- 120

- 15%

- 30

- 7

- 971

- a

- Chi siamo

- abstract

- accelerare

- accelerando

- accesso

- Secondo

- Il mio account

- gestione contabile

- conti

- il raggiungimento

- operanti in

- attività

- aggiungere

- Inoltre

- indirizzo

- amministrazione

- Adozione

- Avanzate

- avvocato

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- agile

- fa

- AI

- Piattaforma AI

- AI / ML

- mira

- Tutti

- consentire

- permesso

- Consentire

- consente

- già

- anche

- Amazon

- Amazon Sage Maker

- Amazon Sage Maker Studio

- Amazon Web Services

- quantità

- an

- .

- Gli analisti

- analitica

- ed

- e infrastruttura

- in qualsiasi

- Applicazioni

- applicato

- approvazione

- architettonico

- architettura

- SONO

- AS

- montaggio

- associato

- assicurare

- At

- autorizzato

- auto

- automaticamente

- Automazione

- settore automobilistico

- industria automobilistica

- disponibilità

- disponibile

- lontano

- AWS

- Servizi professionali AWS

- BACKEND

- di riserva

- Equilibrio

- Banche

- basato

- BE

- perché

- prima

- beneficio

- MIGLIORE

- fra

- Al di là di

- Big

- Big Data

- Blocchi

- BMW

- entrambi

- Scatola

- costruire

- Costruzione

- costruito

- affari

- ma

- by

- Materiale

- funzionalità

- capacità

- capace

- che

- Custodie

- casi

- catalogo

- centrale

- centralizzata

- sfide

- Modifiche

- cambiando

- dai un'occhiata

- Scegli

- strettamente

- Cloud

- codice

- collaboreranno

- collaborazione

- complessità

- conformità

- ottemperare

- componenti

- Calcolare

- Configurazione

- notevole

- costantemente

- consumare

- contesto

- continuamente

- contrasto

- di controllo

- Nucleo

- Aziende

- Costi

- paesi

- Copertine

- creare

- creazione

- costume

- cliente

- Clienti

- personalizzazione

- personalizzare

- cicli

- dati

- Dati Analytics

- Lago di dati

- Preparazione dei dati

- scienza dei dati

- scienziato di dati

- data-driven

- banche dati

- Data

- Giorni

- Decision Making

- decisioni

- deep

- apprendimento profondo

- consegna

- schierare

- schierato

- distribuzione

- descritta

- Design

- progettato

- dettaglio

- sviluppato

- Costruttori

- sviluppatori

- in via di sviluppo

- Mercato

- diverso

- digitale

- digitalizzazione

- dirette

- direttamente

- disabile

- dirompente

- distribuito

- do

- docker

- non

- dominio

- domini

- giù

- guidare

- spinto

- durante

- ogni

- facile

- efficienza

- sforzo

- senza sforzo

- sforzi

- o

- elettricità

- emissioni

- dipendenti

- il potere

- enable

- abilitato

- Abilita

- consentendo

- incoraggiare

- da un capo all'altro

- applicazione

- Fidanzamento

- ingegnere

- Ingegneria

- Ingegneri

- garantire

- assicura

- assicurando

- Impresa

- aziende

- entusiasta

- Intero

- Ambiente

- ambientale

- ambienti

- errori

- sviluppate

- europeo

- Unione europea

- Anche

- esempio

- spese

- esperienza

- facce

- facilita

- strutture

- Fallimento

- familiare

- famiglia

- più veloce

- Caratteristiche

- Costi

- pochi

- Compila il

- finanziario

- Istituzioni finanziarie

- Focus

- i seguenti

- Orma

- Nel

- quadri

- Gratis

- da

- pieno

- completamente

- ulteriormente

- Inoltre

- raccogliere

- generalmente

- generato

- Germania

- Idiota

- dato

- globali

- globo

- scopo

- la governance

- GPU

- maggiore

- Gruppo

- Gruppo

- Crescita

- cresciuto

- Crescita

- Maniglie

- Hardware

- he

- capo

- con sede

- pesantemente

- Aiuto

- aiuta

- Alta

- alto valore

- alto livello

- lui

- il suo

- host

- Come

- HTML

- http

- HTTPS

- Hub

- umano

- idea

- identifica

- Identità

- Idle

- immagini

- subito

- Impact

- di forte impatto

- implementato

- Implementazione

- attrezzi

- importante

- competenze

- in

- incluso

- inclusi

- Compreso

- Aumento

- Aumenta

- crescente

- sempre più

- industria

- informazioni

- informati

- Infrastruttura

- Innovazione

- esempio

- istituzioni

- integrato

- Integra

- integrazione

- Intelligente

- destinato

- interno

- Internet

- accesso ad Internet

- ai miglioramenti

- l'introduzione di

- Investimenti

- isolato

- da solo

- sicurezza

- IT

- SUO

- stessa

- Giacobbe

- jpg

- ad appena

- mantenere

- conservazione

- tenere

- Le

- lago

- paesaggio

- grandi

- Grandi imprese

- con i più recenti

- lanciare

- Legislazione

- Leggi e regolamenti

- portare

- leader

- Leadership

- principale

- Salto

- IMPARARE

- apprendimento

- meno

- Legale

- licenze

- Licenze

- ciclo di vita

- Limitato

- limitativo

- linea

- elencati

- locale

- a livello locale

- ceppo

- Lunghi

- a lungo termine

- macchina

- machine learning

- Principale

- mantenere

- Mantenere

- manutenzione

- make

- Fare

- gestire

- gestito

- gestione

- direttore

- gestione

- Manuale

- Costruttore

- materiale

- Massimizzare

- massimizzando

- significato

- meccanismo

- Soddisfare

- Soddisfa

- Utenti

- Memorie

- menzionato

- Metrica

- microservices

- la migrazione

- migrazione

- Minuti

- perse

- scelta

- ML

- MLOp

- Mobile

- sicurezza mobile

- mobilità

- Moda

- modello

- modelli

- modernizzazione

- monitorati

- monitor

- Scopri di più

- Inoltre

- maggior parte

- Moto

- in movimento

- multiplo

- Bisogno

- di applicazione

- che necessitano di

- esigenze

- Rete

- New

- no

- adesso

- numerato

- of

- offerta

- on

- On-Demand

- Onboard

- Procedura di Onboarding

- esclusivamente

- aprire

- open source

- apertura

- operare

- operativo

- operativa

- OTTIMIZZA

- or

- minimo

- ordini

- organizzazione

- Altro

- su

- ancora

- complessivo

- proprio

- proprietari

- Packages

- Parallel

- appassionato

- passato

- patching

- pavimentare

- per

- Eseguire

- performance

- Pilastro

- conduttura

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- Termini e Condizioni

- Portale

- posizione

- Post

- alimentato

- potente

- pratica

- Premium

- preparazione

- prevenire

- primario

- Direttore

- Precedente

- un bagno

- privilegio

- privilegi

- processi

- i processi

- produrre

- Prodotto

- sviluppo del prodotto

- Produzione

- della produttività

- professionale

- Scelto dai professionisti

- protegge

- prototipi

- fornire

- purché

- fornitore

- fornisce

- fornitura

- fini

- Python

- qualità

- rapidamente

- R

- gamma

- rapidamente

- Lettura

- pronto

- riceve

- record

- ridurre

- riducendo

- riferimento

- per quanto riguarda

- regioni

- normativa

- fare affidamento

- basandosi

- rimuovere

- Report

- richiesta

- richieste

- richiedere

- necessario

- Requisiti

- Risorse

- responsabile

- limitato

- Risultati

- ritenzione

- diritti

- Ruolo

- ruoli

- Correre

- running

- runtime

- sagemaker

- stesso

- Scalabilità

- scalabile

- scala

- Scienze

- Scienziato

- scienziati

- senza soluzione di continuità

- senza soluzione di continuità

- sezioni

- sicuro

- problemi di

- Fai da te

- anziano

- serverless

- Server

- servizio

- Servizi

- set

- Set

- alcuni

- condiviso

- spostamento

- chiusura

- chiude

- significativa

- significativamente

- Un'espansione

- semplicemente

- singolo

- situazioni

- Dimensioni

- qualificato

- So

- Software

- soluzione

- Soluzioni

- Fonte

- sovranità

- lo spazio

- spazi

- la nostra speciale

- specializzata

- specifico

- in particolare

- Spendere

- Standard

- inizia a

- state-of-the-art

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- strategie

- Strategia

- linee di corrente

- sforzandosi

- forte

- La struttura

- studio

- sottoreti

- tale

- sufficiente

- supporto

- supporti

- Sostenibilità

- sostenibile

- Svizzera

- sistema

- Fai

- Parlare

- task

- team

- Membri del team

- le squadre

- Consulenza

- tecnologico

- Tecnologia

- termine

- Terraform

- testato

- che

- I

- La linea

- loro

- Li

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- Attraverso

- per tutto

- strettamente

- tempo

- a

- oggi

- pure

- strumenti

- top

- Argomenti

- verso

- Traccia

- Tracciato

- Training

- tendenze

- seconda

- e una comprensione reciproca

- unione

- unico

- sbloccare

- up-to-date

- aggiornato

- aggiornato

- URL

- Impiego

- uso

- caso d'uso

- utilizzato

- user-friendly

- utenti

- utilizzando

- convalidato

- convalida

- APPREZZIAMO

- Creazione di valore

- versione

- controllati

- via

- Visualizza

- virtuale

- Visita

- volumi

- Prima

- Modo..

- we

- sito web

- servizi web

- WELL

- sono stati

- quando

- ogni volta che

- mentre

- quale

- while

- volere

- con

- entro

- senza

- Lavora

- lavorato

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- mondo

- Il mondo di

- In tutto il mondo

- preoccuparsi

- sarebbe

- anni

- Trasferimento da aeroporto a Sharm

- zefiro

- zone