In un precedente settimana, abbiamo parlato dell'analisi e dell'etichettatura delle risorse archiviate in Veeva Vault PromoMats utilizzando i servizi Amazon AI e le API della piattaforma Veeva Vault. In questo post, esploriamo come utilizzare Flusso di app Amazon, un servizio di integrazione completamente gestito che ti consente di trasferire in modo sicuro i dati dalle applicazioni SaaS (Software as a Service) come Veeva Vault ad AWS. Il Connettore Veeva di Amazon AppFlow ti consente di connettere il tuo ambiente AWS all'ecosistema Veeva in modo rapido, affidabile e conveniente per analizzare il contenuto ricco archiviato in Veeva Vault su larga scala.

Il connettore Amazon AppFlow Veeva è il primo connettore Amazon AppFlow a supportare il trasferimento automatico di documenti Veeva. Consente di scegliere tra l'ultima versione (il Stato stazionario versione in termini Veeva) e tutte le versioni dei documenti. Inoltre, puoi importare i metadati del documento.

Con pochi clic puoi configurare facilmente una connessione gestita e scegliere i documenti e i metadati di Veeva Vault da importare. È possibile modificare ulteriormente il comportamento di importazione mappando i campi di origine ai campi di destinazione. Puoi anche aggiungere filtri in base a tipo e sottotipo di documento, classificazione, prodotti, paese, sito e altro. Infine, puoi aggiungere la convalida e gestire i trigger di flusso su richiesta e pianificati.

Puoi utilizzare il connettore Veeva di Amazon AppFlow per vari casi d'uso, che vanno da Veeva Vault PromoMats ad altre soluzioni Veeva Vault come QualityDocs, eTMF o Regulatory Information Management (RIM). Di seguito sono riportati alcuni casi d'uso in cui è possibile utilizzare il connettore:

- Sincronizzazione dei dati – È possibile utilizzare il connettore nel processo di determinazione della coerenza e dell'armonizzazione tra i dati provenienti da un Veeva Vault di origine e qualsiasi sistema a valle nel tempo. Ad esempio, puoi condividere le risorse di marketing Veeva PromoMats con Salesforce. Puoi anche utilizzare il connettore per condividere Veeva QualityDocs come le procedure operative standard (SOP) o le specifiche su siti Web memorizzati nella cache che possono essere ricercati dai tablet presenti nell'area di produzione.

- Rilevazione di anomalie – Puoi condividere i documenti Veeva PromoMats con Amazon Lookout per le metriche per il rilevamento delle anomalie. È inoltre possibile utilizzare il connettore con Vault RIM in grafica, etichette commerciali, modelli o volantini per i pazienti prima di importarli per la stampa in soluzioni di etichettatura aziendali come Loftware.

- Idratazione del lago di dati – Il connettore può essere uno strumento efficace per replicare dati strutturati o non strutturati in data lake, al fine di supportare la creazione e l'idratazione di data lake. Ad esempio, puoi utilizzare il connettore per estrarre informazioni standardizzate sullo studio dai protocolli archiviati in Vault RIM ed esporle a valle ai team di analisi delle analisi mediche.

- Traduzioni – Il connettore può essere utile per inviare materiale illustrativo, documenti clinici, materiale di marketing o protocolli di studio per la traduzione nelle lingue native a reparti come imballaggi, studi clinici o invii normativi.

Questo post si concentra su come puoi usarlo Servizi di Amazon AI in combinazione con Amazon AppFlow per analizzare i contenuti archiviati in Veeva Vault PromoMats, estrarre automaticamente le informazioni sui tag e, infine, reinserire queste informazioni nel sistema Veeva Vault. Il post discute l'architettura generale, i passaggi per distribuire una soluzione e un dashboard e un caso d'uso del tagging dei metadati delle risorse. Per ulteriori informazioni sulla base di codice proof of concept per questo caso d'uso, vedere il Repository GitHub.

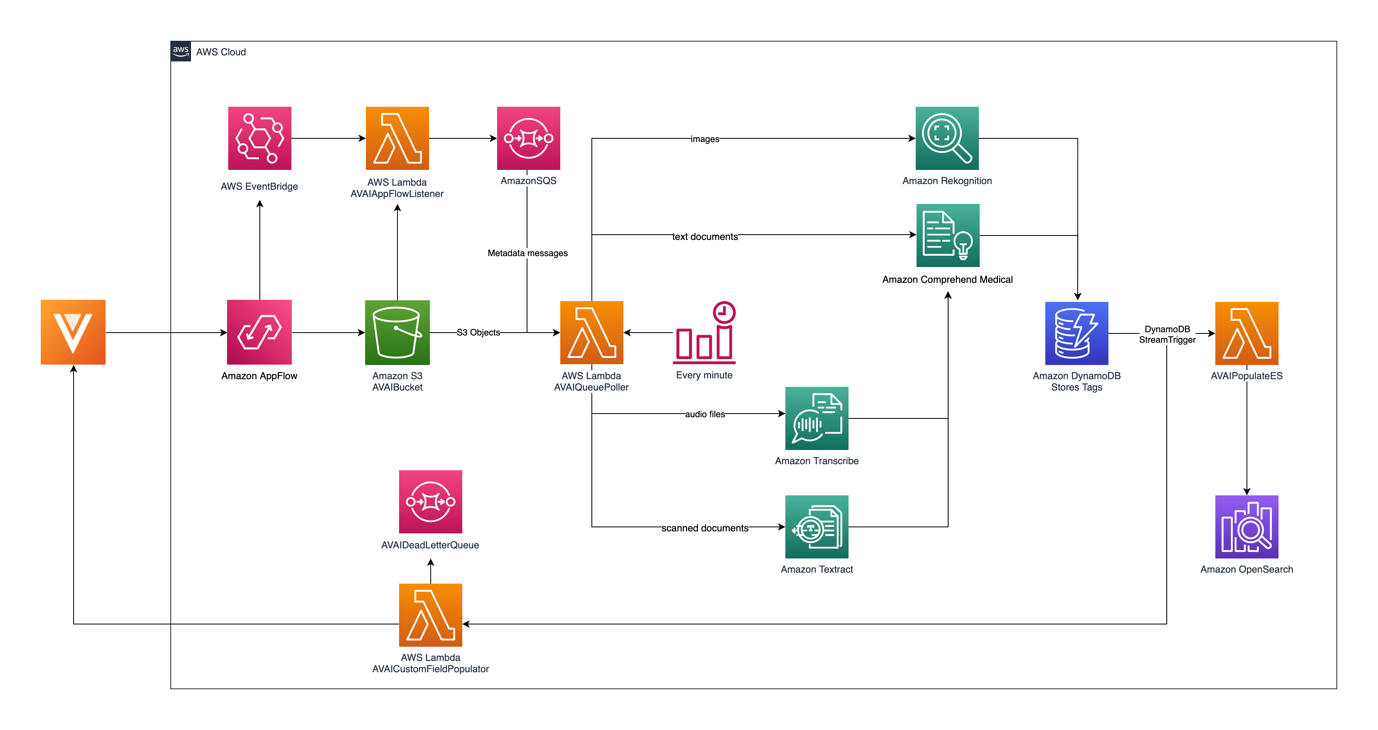

Panoramica della soluzione

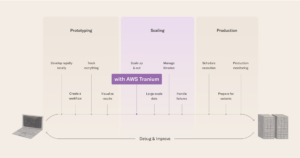

Il diagramma seguente illustra l'architettura della soluzione aggiornata.

In precedenza, per importare risorse da Veeva Vault, dovevi scrivere la tua logica di codice personalizzata utilizzando il file API di Veeva Vault per eseguire il polling delle modifiche e importare i dati in Servizio di archiviazione semplice Amazon (Amazon S3). Potrebbe trattarsi di un processo manuale che richiede molto tempo, in cui è necessario tenere conto delle limitazioni, degli errori e dei tentativi dell'API, nonché della scalabilità per ospitare una quantità illimitata di risorse. La soluzione aggiornata utilizza Amazon AppFlow per astrarre la complessità del mantenimento di una pipeline di importazione dati Veeva su Amazon S3 personalizzata.

Come accennato nell'introduzione, Amazon AppFlow è uno strumento self-service senza codice facile da usare che utilizza configurazioni point-and-click per spostare i dati in modo semplice e sicuro tra varie applicazioni SaaS e servizi AWS. AppFlow consente di estrarre dati (oggetti e documenti) da origini supportate e scrivere tali dati su varie destinazioni supportate. L'origine o la destinazione potrebbe essere un'applicazione SaaS o un servizio AWS come Amazon S3, Amazon RedShifto Cerca metriche. Oltre all'interfaccia senza codice, Amazon AppFlow supporta la configurazione tramite API, AWS CLI e AWS CloudFormazione interfacce.

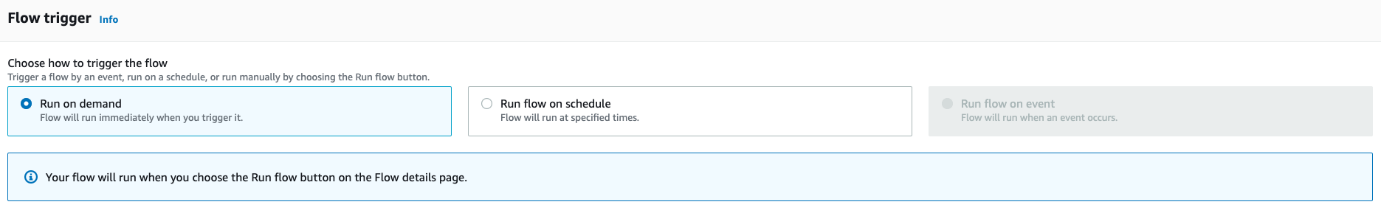

Un flusso in Amazon AppFlow descrive come spostare i dati, inclusi i dettagli dell'origine, i dettagli della destinazione, le condizioni di attivazione del flusso (su richiesta, su evento o pianificate) e le attività di elaborazione dei dati come checkpoint, convalida sul campo o mascheratura. Quando attivato, Amazon AppFlow esegue un flusso che recupera i dati di origine (in genere tramite le API pubbliche dell'applicazione di origine), esegue attività di elaborazione dei dati e trasferisce i dati elaborati alla destinazione.

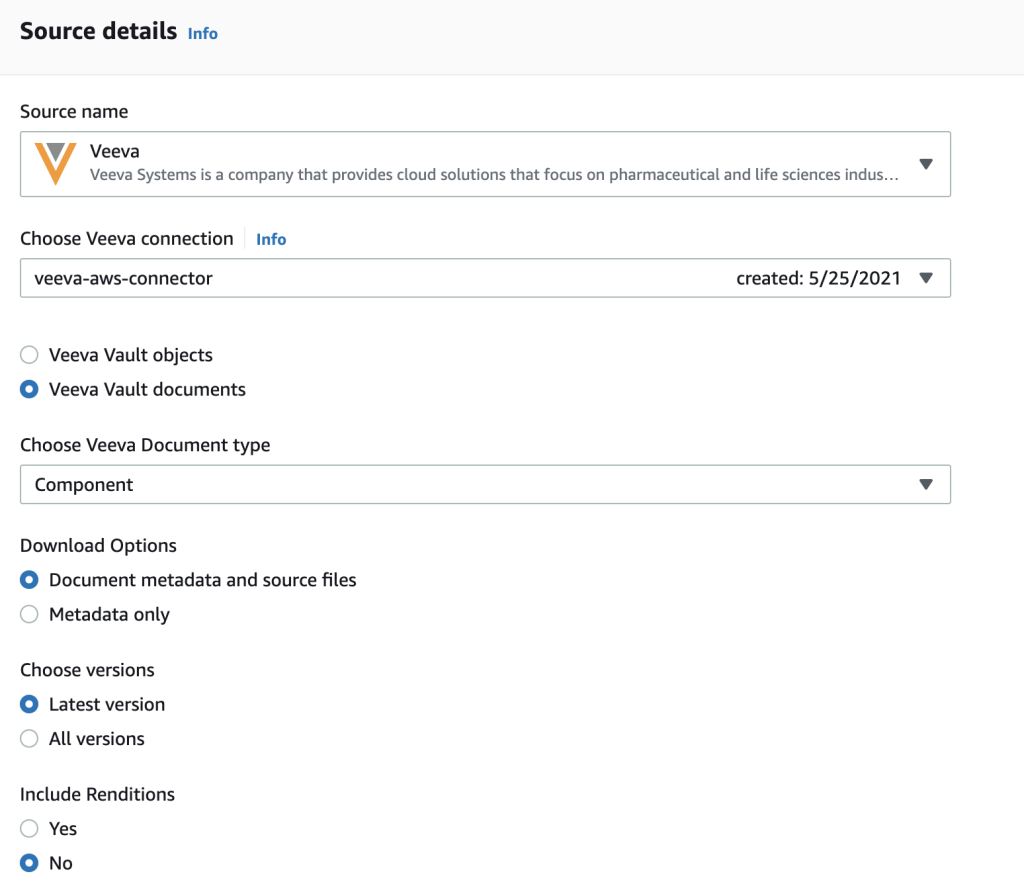

In questo esempio, distribuisci un flusso preconfigurato utilizzando un modello CloudFormation. Lo screenshot seguente mostra il preconfigurato veeva-aws-connector flusso creato automaticamente dal modello di soluzione sulla console Amazon AppFlow.

Il flusso utilizza Veeva come origine ed è configurato per importare gli oggetti dei componenti Veeva Vault. Sia i metadati che i file di origine sono necessari per tenere traccia delle risorse che sono state elaborate e reinserire i tag sulla risorsa corrispondente corretta nel sistema di origine. In questa situazione, viene importata solo l'ultima versione e le rappresentazioni non sono incluse.

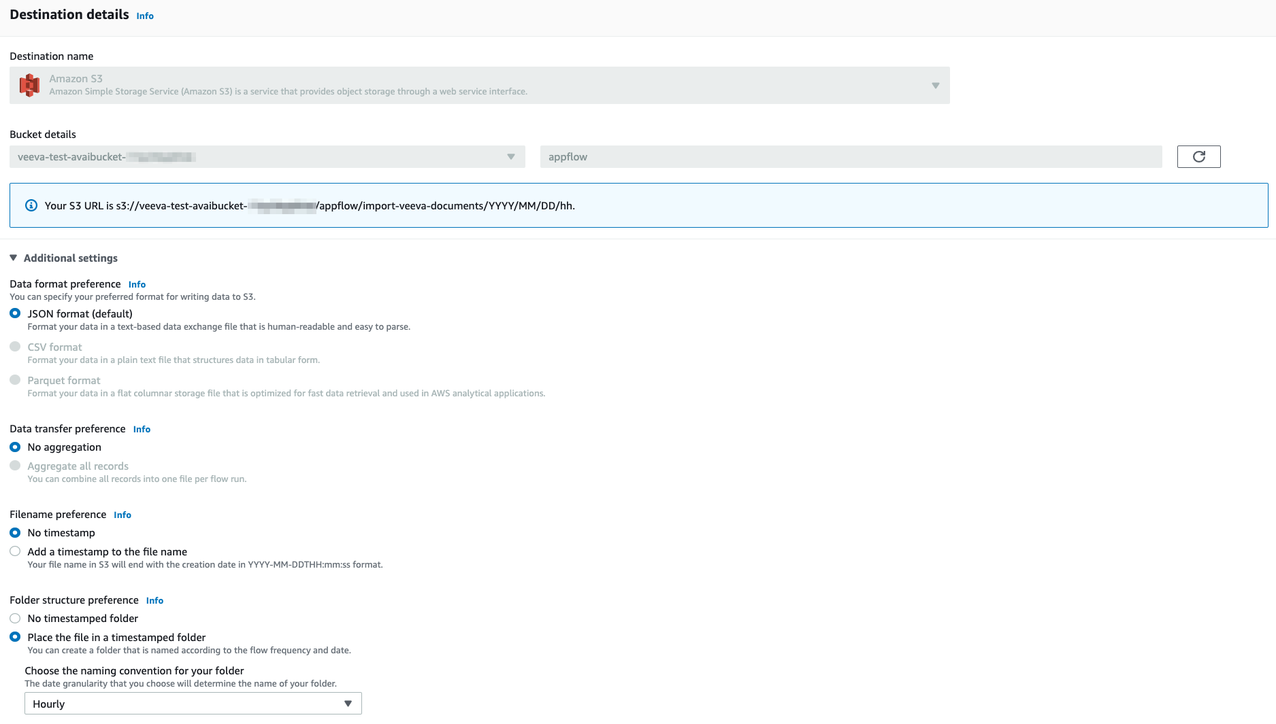

Anche la destinazione del flusso deve essere configurata. Nella schermata seguente, definiamo un formato di file e una struttura di cartelle per il bucket S3 che è stato creato come parte del modello CloudFormation.

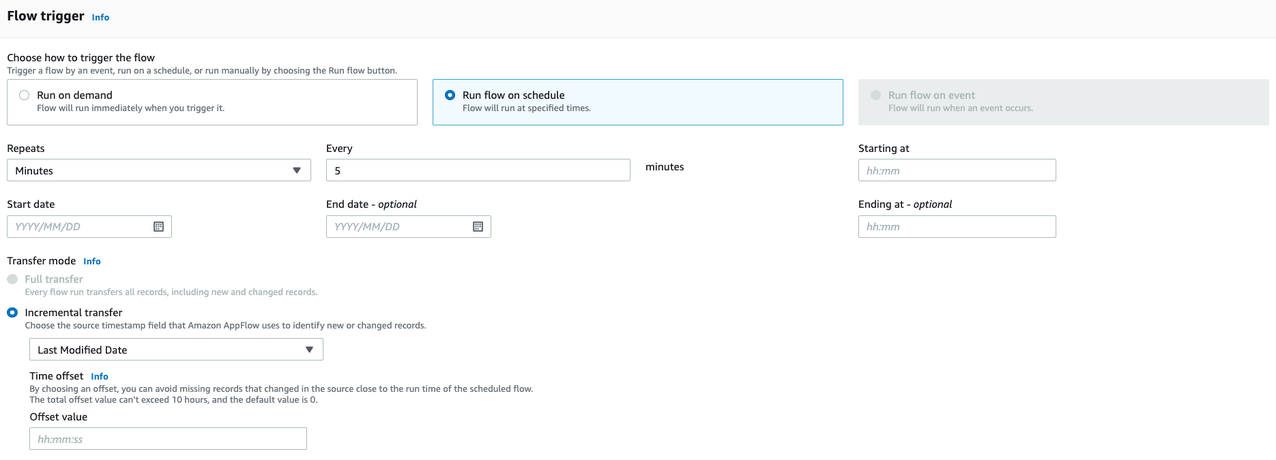

Infine, il flusso viene attivato su richiesta a scopo dimostrativo. Questo può essere modificato in modo che il flusso segua un programma, con una granularità massima di 1 minuto. Quando viene attivato in base a una pianificazione, la modalità di trasferimento cambia automaticamente da un trasferimento completo a una modalità di trasferimento incrementale. Specificare un campo timestamp di origine per tenere traccia delle modifiche. Per il caso d'uso di tagging, abbiamo riscontrato che il Data ultima modifica l'impostazione è la più adatta.

Amazon AppFlow viene quindi integrato con Amazon EventBridge per pubblicare eventi ogni volta che un'esecuzione del flusso è completa.

Per una migliore resilienza, il AVAIAppFlowListener AWS Lambda la funzione è cablata in EventBridge. Quando un evento Amazon AppFlow viene attivato, verifica che l'esecuzione del flusso specifico sia stata completata correttamente, legge le informazioni sui metadati di tutte le risorse importate da quella specifica esecuzione del flusso e inserisce i metadati dei singoli documenti in un Servizio Amazon Simple Queue (Amazon SQS) coda. L'utilizzo di Amazon SQS fornisce un accoppiamento libero tra le sezioni del produttore e del processore dell'architettura e consente inoltre di distribuire le modifiche alla sezione del processore senza interrompere gli aggiornamenti in arrivo.

Una seconda funzione poller (AVAIQueuePoller) legge la coda SQS a intervalli frequenti (ogni minuto) ed elabora gli asset in entrata. Per un tempo di reazione ancora migliore dalla funzione Lambda, puoi sostituire la regola CloudWatch configurando Amazon SQS come trigger per la funzione.

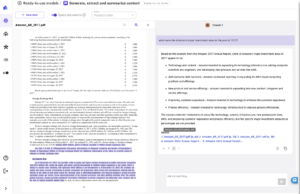

A seconda del tipo di messaggio in arrivo, la soluzione utilizza vari servizi di intelligenza artificiale di AWS per ricavare informazioni dettagliate dai tuoi dati. Alcuni esempi includono:

- File di testo - La funzione utilizza il Rileva entità Operazione di Amazon comprende medica, un servizio di elaborazione del linguaggio naturale (NLP) che semplifica l'utilizzo del ML per estrarre informazioni mediche rilevanti da testo non strutturato. Questa operazione rileva entità in categorie come

Anatomy,Medical_Condition,Medication,Protected_Health_InformationeTest_Treatment_Procedure. L'output risultante viene filtrato perProtected_Health_Informatione le informazioni rimanenti, insieme ai punteggi di confidenza, vengono appiattiti e inseriti in un file Amazon DynamoDB tavolo. Queste informazioni sono tracciate sul cluster OpenSearch Kibana. Nelle applicazioni del mondo reale, puoi anche utilizzare Amazon Comprehend Medical ICD-10-CM o RxNorm funzione per collegare le informazioni rilevate alle ontologie mediche in modo che le applicazioni sanitarie a valle possano utilizzarle per ulteriori analisi. - Immagini - La funzione utilizza il RilevaEtichette metodo di Rekognition di Amazon per rilevare le etichette nell'immagine in arrivo. Queste etichette possono fungere da tag per identificare le informazioni ricche sepolte nelle tue immagini, come informazioni su grafica commerciale ed etichette cliniche. Se le etichette piacciono

HumanorPersonvengono rilevati con un punteggio di affidabilità superiore all'80%, il codice utilizza il Rileva Facce metodo per cercare le caratteristiche facciali chiave come occhi, naso e bocca per rilevare i volti nell'immagine di input. Amazon Rekognition fornisce tutte queste informazioni con un punteggio di confidenza associato, che viene appiattito e memorizzato nella tabella DynamoDB. - Registrazioni vocali - Per le risorse audio, il codice utilizza il InizioTrascrizioneLavoro metodo asincrono di Amazon Transcribe per trascrivere l'audio in arrivo in testo, passando un identificatore univoco come

TranscriptionJobName. Il codice presuppone che la lingua dell'audio sia l'inglese (USA), ma è possibile modificarla per legare alle informazioni provenienti da Veeva Vault. Il codice chiama il OttieniTrascrizioneLavoro , passando lo stesso identificativo univoco del metodoTranscriptionJobNamein un ciclo, fino al completamento del lavoro. Amazon Transcribe consegna il file di output su un bucket S3, che viene letto dal codice ed eliminato. Il codice chiama il flusso di lavoro di elaborazione del testo (come discusso in precedenza) per estrarre entità dall'audio trascritto. - Documenti scansionati (PDF) - Una grande percentuale delle risorse delle scienze della vita sono rappresentate in PDF: potrebbero trattarsi di qualsiasi cosa, da riviste scientifiche e documenti di ricerca a etichette di farmaci. Testo Amazon è un servizio che estrae automaticamente testo e dati dai documenti scansionati. Il codice utilizza il Avvia DocumentTextDetection metodo per avviare un lavoro asincrono per rilevare il testo nel documento. Il codice utilizza il

JobIdrestituito nella risposta alla chiamata OttieniDocumentTextDetection in un ciclo, fino al completamento del lavoro. La struttura JSON di output contiene righe e parole del testo rilevato, insieme a punteggi di confidenza per ciascun elemento identificato, in modo da poter prendere decisioni informate su come utilizzare i risultati. Il codice elabora la struttura JSON per ricreare il blurb del testo e chiama il flusso di lavoro di elaborazione del testo per estrarre entità dal testo.

Una tabella DynamoDB memorizza tutti i dati elaborati. La soluzione utilizza Flussi DynamoDB e trigger Lambda (AVAIPopulateES) per popolare i dati in un cluster Kibana OpenSearch. La funzione AVAIPopulateES viene eseguita per ogni operazione di aggiornamento, inserimento ed eliminazione che si verifica nella tabella DynamoDB e inserisce un record corrispondente nell'indice OpenSearch. Puoi visualizzare questi record usando Kibana.

Per chiudere il ciclo di feedback, il AVAICustomFieldPopulator La funzione Lambda è stata creata. Viene attivato da eventi nel flusso DynamoDB della tabella di metadati DynamoDB. Per ogni DocumentID nei record DynamoDB, la funzione tenta di inserire le informazioni sui tag in una proprietà di campo personalizzata predefinita dell'asset con l'ID corrispondente in Veeva, utilizzando l'API Veeva. Per evitare di inserire rumore nel campo personalizzato, la funzione Lambda filtra tutti i tag che sono stati identificati con un punteggio di affidabilità inferiore a 0.9. Le richieste non riuscite vengono inoltrate a una coda di messaggi non recapitabili (DLQ) per l'ispezione manuale o un nuovo tentativo automatico.

Questa soluzione offre un approccio senza server e pay-as-you-go per elaborare, taggare e abilitare ricerche complete sulle risorse digitali. Inoltre, ogni componente gestito ha un'alta disponibilità integrata dalla distribuzione automatica su più zone di disponibilità. Per Servizio Amazon OpenSearch (successore di Amazon Elasticsearch Service), puoi scegliere il opzione tre-AZ per fornire una migliore disponibilità per i tuoi domini.

Prerequisiti

Per questa procedura dettagliata, è necessario disporre dei seguenti prerequisiti:

- An Account AWS con appropriato Gestione dell'identità e dell'accesso di AWS (IAM) per avviare il modello CloudFormation

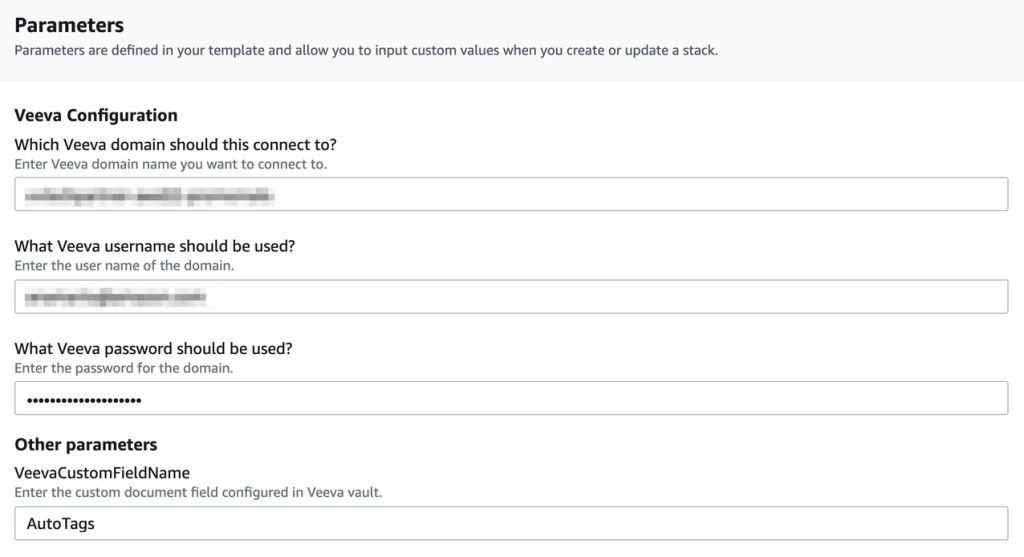

- Credenziali di accesso appropriate per un dominio Veeva Vault PromoMats (URL dominio, nome utente e password)

- Un tag di contenuto personalizzato definito in Veeva per le risorse digitali che desideri vengano contrassegnate (ad esempio, abbiamo creato il file

AutoTagstag contenuto personalizzato) - Risorse digitali in PromoMats Vault accessibili con le credenziali precedenti

Distribuisci la tua soluzione

Si utilizza uno stack CloudFormation per distribuire la soluzione. Lo stack crea tutte le risorse necessarie, tra cui:

- Un bucket S3 per archiviare le risorse in entrata.

- Un flusso Amazon AppFlow per importare automaticamente gli asset nel bucket S3.

- Una regola EventBridge e una funzione Lambda per reagire agli eventi generati da Amazon AppFlow (

AVAIAppFlowListener). - Una coda SQS FIFO che funge da accoppiamento libero tra la funzione listener (

AVAIAppFlowListener) e la funzione poller (AVAIQueuePoller). - Una tabella DynamoDB per archiviare l'output dei servizi Amazon AI.

- Un cluster Amazon OpenSearch Kibana (ELK) per visualizzare i tag analizzati.

- Una funzione Lambda per respingere i tag identificati in Veeva (

AVAICustomFieldPopulator), con un DLQ corrispondente. - Funzioni Lambda richieste:

- AVAAppFlow Listener – Attivato da eventi inviati da Amazon AppFlow a EventBridge. Utilizzato per la convalida dell'esecuzione del flusso e il push di un messaggio nella coda SQS.

- AVAQueuePoller - Attivato ogni 1 minuto. Utilizzato per eseguire il polling della coda SQS, elaborare le risorse utilizzando i servizi Amazon AI e popolare la tabella DynamoDB.

- AVAIPopolaES - Attivato in caso di aggiornamento, inserimento o eliminazione nella tabella DynamoDB. Utilizzato per acquisire modifiche da DynamoDB e popolare il cluster ELK.

- AVAICustomFieldPopolatore – Attivato quando è presente un aggiornamento, inserimento o eliminazione nella tabella DynamoDB. Utilizzato per inviare informazioni sui tag a Veeva.

- I Eventi Amazon CloudWatch regole che attivano il

AVAIQueuePollerfunzione. Questi trigger sono nelDISABLEDstato per impostazione predefinita. - Ruoli e criteri IAM richiesti per interagire con EventBridge e i servizi di intelligenza artificiale in modo ridotto.

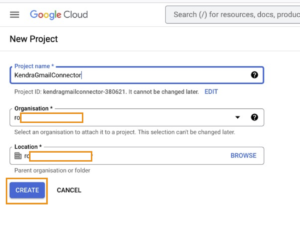

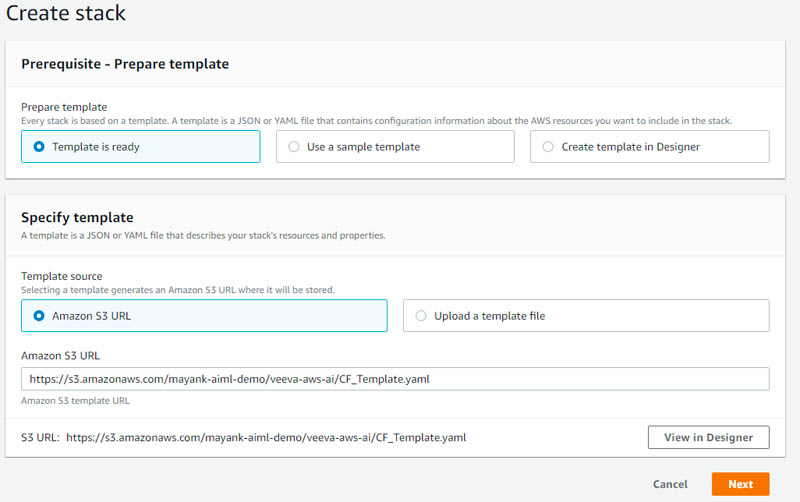

Per iniziare, completare i seguenti passi:

- Accedi al Console di gestione AWS con un account che dispone delle autorizzazioni IAM prerequisite.

- Scegli Avvia Stack e aprilo in una nuova scheda:

- Sulla Crea stack pagina, scegli Avanti.

- Sulla Specifica i dettagli dello stack pagina, immettere un nome per lo stack.

- Immettere i valori per i parametri.

- Scegli Avanti.

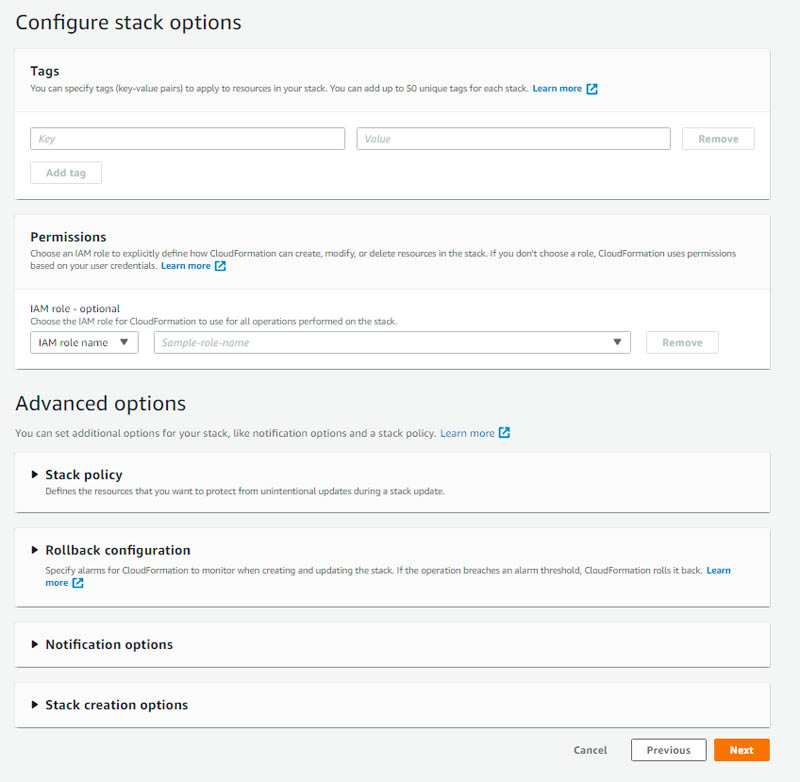

- Sulla Configura le opzioni di stack pagina, lascia tutto come predefinito e scegli Avanti.

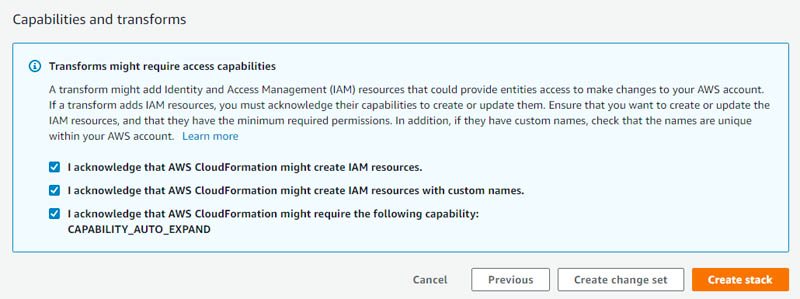

- Sulla Review pagina, nella Funzionalità e trasformazioni sezione, selezionare le tre caselle di controllo.

- Scegli Crea stack.

- Attendi il completamento dello stack. È possibile esaminare vari eventi dal processo di creazione dello stack su Eventi scheda.

- Al termine della creazione dello stack, è possibile cercare Risorse scheda per vedere tutte le risorse create dal modello CloudFormation.

- Sulla Uscite scheda, copia il valore di

ESDomainAccessPrincipal.

Questo è l'ARN del ruolo IAM che il AVAIPopulateES presuppone la funzione. Lo utilizzi in seguito per configurare l'accesso al dominio Amazon OpenSearch Service.

Configura Amazon OpenSearch Service e Kibana

Questa sezione ti guida attraverso la protezione del tuo cluster Amazon OpenSearch Service e l'installazione di un proxy locale per accedere a Kibana in modo sicuro.

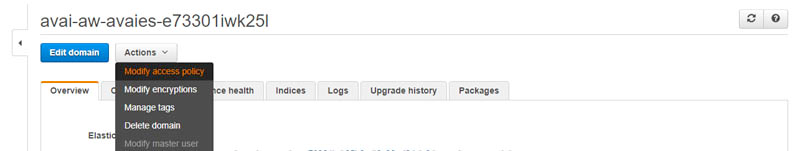

- Nella console Amazon OpenSearch Service, seleziona il dominio che è stato creato dal modello.

- Sulla Azioni menù, scegliere Modifica la politica di accesso.

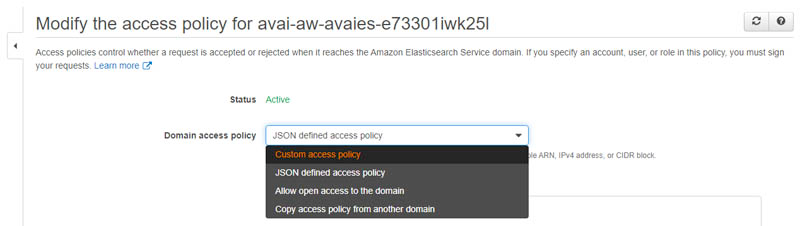

- Nel Politica di accesso al dominioscegli Politica di accesso personalizzata.

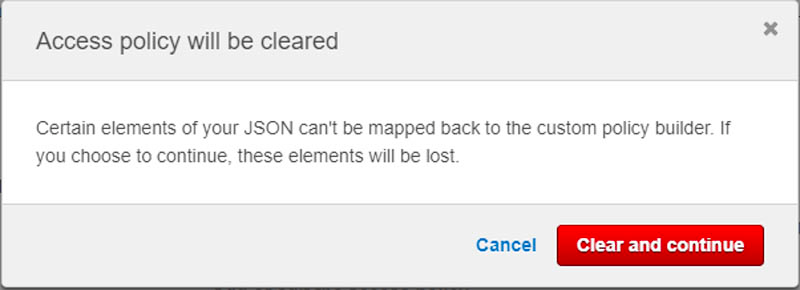

- Nel La politica di accesso verrà cancellata finestra pop-up, scegli Cancella e continua.

- Nella pagina successiva, configura le seguenti istruzioni per bloccare l'accesso al dominio Amazon OpenSearch Service:

- Consenti indirizzo IPv4 - Il tuo indirizzo IP.

- Consenti IAM ARN - Il valore di

ESDomainAccessPrincipalhai copiato prima.

- Scegli Invio.

Questo crea una politica di accesso che garantisce l'accesso alla funzione AVAIPopulateES e l'accesso a Kibana dal tuo indirizzo IP. Per ulteriori informazioni sulla definizione dell'ambito della policy di accesso, vedere Configurazione delle politiche di accesso.

- Attendere che lo stato del dominio sia visualizzato come

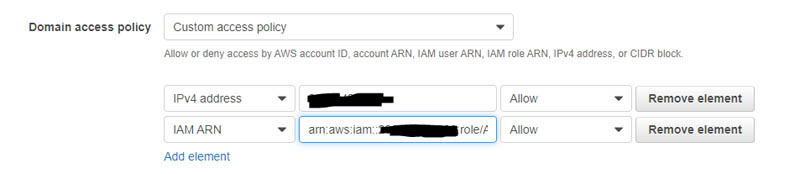

Active. - Sulla console Amazon EventBridge, sotto Eventiscegli Regole. Puoi vedere due regole create dal modello CloudFormation.

- Seleziona il

AVAIQueuePollerScheduleregola e abilitala facendo clic permettere.

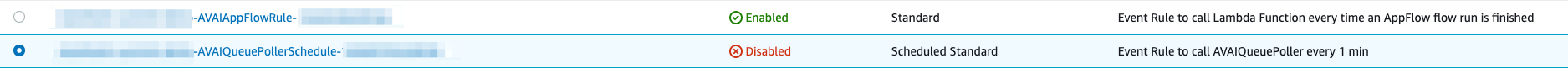

In 5-8 minuti, i dati dovrebbero iniziare a fluire e le entità vengono create nel cluster Amazon OpenSearch Service. Ora puoi visualizzare queste entità in Kibana. Per fare ciò, usi un proxy open source chiamato AWS-es-Kibana. Per installare il proxy sul tuo computer, inserisci il seguente codice:

aws-es-kibana your_OpenSearch_domain_endpointÈ possibile trovare l'endpoint del dominio su Uscite scheda dello stack CloudFormation in ESDomainEndPoint. Dovresti vedere il seguente output:

Crea visualizzazioni e analizza i contenuti con tag

Si prega di fare riferimento all'originale post sul blog.

ripulire

Per evitare di incorrere in addebiti futuri, elimina le risorse quando non sono in uso. Puoi eliminare facilmente tutte le risorse eliminando lo stack CloudFormation associato. Tieni presente che è necessario svuotare i bucket di contenuto S3 creati affinché l'eliminazione dello stack abbia esito positivo.

Conclusione

In questo post, abbiamo dimostrato come utilizzare i servizi Amazon AI in combinazione con Amazon AppFlow per estendere la funzionalità di Veeva Vault PromoMats ed estrarre informazioni preziose in modo rapido e semplice. Il meccanismo di loopback integrato ti consente di aggiornare nuovamente i tag in Veeva Vault e abilitare la codifica automatica delle tue risorse. Ciò rende più facile per il tuo team trovare e individuare rapidamente le risorse.

Sebbene nessun output di ML sia perfetto, può avvicinarsi molto alle prestazioni umane e aiutare a compensare una parte sostanziale degli sforzi del tuo team. Puoi utilizzare questa capacità aggiuntiva per attività a valore aggiunto, dedicando una piccola capacità per controllare l'output della soluzione ML. Questa soluzione può anche aiutare a ottimizzare i costi, ottenere la coerenza dei tag e consentire una rapida scoperta delle risorse esistenti.

Infine, puoi mantenere la proprietà dei tuoi dati e scegliere quali servizi AWS possono elaborare, archiviare e ospitare il contenuto. AWS non accede o utilizza i tuoi contenuti per qualsiasi scopo senza il tuo consenso e non utilizza mai i dati dei clienti per ricavare informazioni per marketing o pubblicità. Per ulteriori informazioni, vedere Domande frequenti sulla privacy dei dati.

È inoltre possibile estendere ulteriormente la funzionalità di questa soluzione con ulteriori miglioramenti. Ad esempio, oltre ai servizi AI e ML in questo post, puoi facilmente aggiungere qualsiasi tuo modello ML personalizzato creato utilizzando Amazon Sage Maker all'architettura.

Se sei interessato ad esplorare ulteriori casi d'uso per Veeva e AWS, contatta il team del tuo account AWS.

Veeva Systems ha esaminato e approvato questo contenuto. Per ulteriori domande relative a Veeva Vault, contattare Supporto Veeva.

Circa gli autori

Mayank Thakkar è Head of AI/ML Business Development, Global Healthcare and Life Sciences presso AWS. Ha più di 18 anni di esperienza in vari settori come sanità, scienze biologiche, assicurazioni e vendita al dettaglio, specializzato nella creazione di soluzioni serverless, basate sull'intelligenza artificiale e sull'apprendimento automatico per risolvere i problemi del settore del mondo reale. In AWS, lavora a stretto contatto con le grandi aziende farmaceutiche di tutto il mondo per creare soluzioni all'avanguardia e aiutarle nel loro viaggio verso il cloud. Oltre al lavoro, Mayank, insieme a sua moglie, è impegnato a crescere due ragazzi energici e dispettosi, Aaryan (6) e Kiaan (4), mentre cerca di evitare che la casa bruci o venga allagata!

Mayank Thakkar è Head of AI/ML Business Development, Global Healthcare and Life Sciences presso AWS. Ha più di 18 anni di esperienza in vari settori come sanità, scienze biologiche, assicurazioni e vendita al dettaglio, specializzato nella creazione di soluzioni serverless, basate sull'intelligenza artificiale e sull'apprendimento automatico per risolvere i problemi del settore del mondo reale. In AWS, lavora a stretto contatto con le grandi aziende farmaceutiche di tutto il mondo per creare soluzioni all'avanguardia e aiutarle nel loro viaggio verso il cloud. Oltre al lavoro, Mayank, insieme a sua moglie, è impegnato a crescere due ragazzi energici e dispettosi, Aaryan (6) e Kiaan (4), mentre cerca di evitare che la casa bruci o venga allagata!

Anamaria Todor è un Senior Solutions Architect con sede a Copenhagen, Danimarca. Ha visto il suo primo computer quando aveva 4 anni e da allora non ha mai abbandonato l'informatica e l'ingegneria. Ha lavorato in vari ruoli tecnici da sviluppatore full-stack, a data engineer, responsabile tecnico e CTO in varie aziende danesi. Anamaria ha una laurea in ingegneria applicata e informatica, un master in informatica e oltre 10 anni di esperienza pratica in AWS. In AWS, lavora a stretto contatto con aziende sanitarie e di scienze biologiche nel segmento enterprise. Quando non lavora o non gioca ai videogiochi, insegna a ragazze e professioniste a capire e trovare la propria strada attraverso la tecnologia.

Anamaria Todor è un Senior Solutions Architect con sede a Copenhagen, Danimarca. Ha visto il suo primo computer quando aveva 4 anni e da allora non ha mai abbandonato l'informatica e l'ingegneria. Ha lavorato in vari ruoli tecnici da sviluppatore full-stack, a data engineer, responsabile tecnico e CTO in varie aziende danesi. Anamaria ha una laurea in ingegneria applicata e informatica, un master in informatica e oltre 10 anni di esperienza pratica in AWS. In AWS, lavora a stretto contatto con aziende sanitarie e di scienze biologiche nel segmento enterprise. Quando non lavora o non gioca ai videogiochi, insegna a ragazze e professioniste a capire e trovare la propria strada attraverso la tecnologia.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/analyze-and-tag-assets-stored-in-veeva-vault-promomats-using-amazon-appflow-and-amazon-ai-services/

- "

- 10

- 100

- 7

- 9

- a

- Chi siamo

- ABSTRACT

- accesso

- accessibile

- ospitare

- Il mio account

- Raggiungere

- operanti in

- Legge

- aggiunta

- aggiuntivo

- indirizzo

- Pubblicità

- AI

- Servizi di intelligenza artificiale

- Tutti

- consente

- Amazon

- quantità

- .

- analitica

- analizzare

- a parte

- api

- API

- Applicazioni

- applicazioni

- applicato

- approccio

- opportuno

- architettura

- in giro

- artificiale

- intelligenza artificiale

- opere d'arte

- attività

- Attività

- associato

- Audio

- Automatico

- automaticamente

- disponibilità

- AWS

- prima

- essendo

- Meglio

- fra

- sistema

- costruire

- Costruzione

- incassato

- affari

- chiamata

- funzionalità

- Ultra-Grande

- Custodie

- casi

- oneri

- Scegli

- classificazione

- test clinici

- Cloud

- istruire

- codice

- combinazione

- Venire

- arrivo

- Aziende

- completamento di una

- componente

- globale

- computer

- Informatica

- concetto

- condizioni

- fiducia

- Configurazione

- Connettiti

- veloce

- consenso

- consolle

- contatti

- contiene

- contenuto

- Corrispondente

- Costi

- potuto

- nazione

- creare

- creato

- crea

- creazione

- Credenziali

- CTO

- costume

- cliente

- bordo tagliente

- cruscotto

- dati

- elaborazione dati

- decisioni

- fornisce un monitoraggio

- Richiesta

- dimostrato

- Danmark

- schierare

- deployment

- destinazione

- Destinazioni

- dettagli

- rilevato

- rivelazione

- Costruttori

- Mercato

- digitale

- Risorse digitali

- scoperta

- documenti

- non

- dominio

- domini

- giù

- droga

- ogni

- facilmente

- facile da usare

- ecosistema

- Efficace

- sforzi

- enable

- Abilita

- endpoint

- ingegnere

- Ingegneria

- Inglese

- entrare

- Impresa

- entità

- Ambiente

- Evento

- eventi

- qualunque cosa

- esempio

- Esempi

- esistente

- esperienza

- esplora

- estendere

- estratti

- facce

- caratteristica

- Caratteristiche

- feedback

- la donna

- campi

- filtri

- ricerca

- Nome

- flusso

- si concentra

- i seguenti

- formato

- essere trovato

- da

- pieno

- function

- funzionalità

- funzioni

- ulteriormente

- futuro

- Giochi

- generalmente

- generato

- ottenere

- ragazze

- globali

- borse di studio

- mani su

- capo

- assistenza sanitaria

- Aiuto

- Alta

- Casa

- Come

- Tutorial

- HTTPS

- umano

- identificatore

- identificare

- Identità

- Immagine

- immagini

- importazione

- includere

- incluso

- Compreso

- Index

- individuale

- industrie

- industria

- informazioni

- informati

- ingresso

- Inserti

- intuizione

- intuizioni

- install

- assicurazione

- integrato

- integrazione

- Intelligence

- si interagisce

- interessato

- Interfaccia

- IP

- Indirizzo IP

- IT

- Lavoro

- viaggio

- mantenere

- Le

- etichettatura

- per il tuo brand

- Lingua

- Le Lingue

- grandi

- con i più recenti

- lanciare

- portare

- Lasciare

- Life Sciences

- Linee

- LINK

- locale

- Guarda

- macchina

- mantenere

- make

- FA

- gestire

- gestito

- gestione

- modo

- Manuale

- consigliato per la

- mappatura

- Marketing

- master

- Materiale

- meccanismo

- medicale

- menzionato

- Metrica

- ML

- modelli

- Scopri di più

- maggior parte

- cambiano

- multiplo

- Naturale

- necessaria

- esigenze

- GENERAZIONE

- Rumore

- Offerte

- offset

- aprire

- operativo

- operazione

- OTTIMIZZA

- Opzioni

- minimo

- i

- Altro

- complessivo

- proprio

- proprietà

- parte

- Di passaggio

- Password

- paziente

- percentuale

- perfetta

- performance

- Pharma

- gioco

- per favore

- Termini e Condizioni

- politica

- sondaggio

- pop-up

- presenti

- precedente

- Privacy

- problemi

- processi

- i processi

- lavorazione

- Processore

- produttore

- Prodotti

- Scelto dai professionisti

- prova

- prova del concetto

- proprietà

- protocolli

- fornire

- fornisce

- delega

- la percezione

- pubblicare

- scopo

- fini

- spinto

- Presto

- rapidamente

- raccolta

- che vanno

- raggiungere

- Reagire

- reazione

- record

- record

- normativo

- pertinente

- rimanente

- rappresentato

- richieste

- riparazioni

- Risorse

- risposta

- risultante

- Risultati

- nello specifico retail

- Ruolo

- norme

- Correre

- stesso

- Scalabilità

- Scala

- in programma

- Scienze

- SCIENZE

- in modo sicuro

- segmento

- serverless

- servizio

- Servizi

- set

- regolazione

- Condividi

- mostrare attraverso le sue creazioni

- Un'espansione

- da

- site

- situazione

- piccole

- So

- Software

- software come un servizio

- solido

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- specializzata

- specifico

- Specifiche tecniche

- pila

- Standard

- inizia a

- iniziato

- Regione / Stato

- dichiarazioni

- Stato dei servizi

- conservazione

- Tornare al suo account

- negozi

- ruscello

- strutturato

- Studio

- sostanziale

- di successo

- Con successo

- supporto

- supportato

- Supporto

- supporti

- sistema

- SISTEMI DI TRATTAMENTO

- task

- team

- le squadre

- Consulenza

- Tecnologia

- modelli

- condizioni

- I

- L’ORIGINE

- il mondo

- tre

- Attraverso

- TIE

- tempo

- richiede tempo

- verso

- pista

- Tracking

- trasferimento

- trasferimenti

- Traduzione

- innescato

- per

- e una comprensione reciproca

- unico

- illimitato

- Aggiornanento

- Aggiornamenti

- us

- uso

- convalida

- APPREZZIAMO

- vario

- Volta

- versione

- Video

- video games

- siti web

- while

- senza

- parole

- Lavora

- lavorato

- lavoro

- lavori

- mondo

- anni

- Trasferimento da aeroporto a Sharm