La creazione di pipeline di machine learning (ML) scalabili ed efficienti è fondamentale per semplificare lo sviluppo, la distribuzione e la gestione dei modelli ML. In questo post presentiamo un framework per automatizzare la creazione di un grafico aciclico diretto (DAG) per Pipeline di Amazon SageMaker basato su semplici file di configurazione. IL codice quadro ed esempi qui presentati riguardano solo le pipeline di addestramento del modello, ma possono essere facilmente estesi anche alle pipeline di inferenza batch.

Questo framework dinamico utilizza file di configurazione per orchestrare le fasi di preelaborazione, formazione, valutazione e registrazione per casi d'uso sia a modello singolo che multimodello basati su script Python definiti dall'utente, esigenze infrastrutturali (inclusi Cloud privato virtuale di Amazon (Amazon VPC) sottoreti e gruppi di sicurezza, Gestione dell'identità e dell'accesso di AWS (IAM) ruoli, Servizio di gestione delle chiavi AWS (chiavi AWS KMS), registro dei contenitori e tipi di istanze), input e output Servizio di archiviazione semplice Amazon (Amazon S3) percorsi e tag delle risorse. I file di configurazione (YAML e JSON) consentono ai professionisti del machine learning di specificare codice indifferenziato per orchestrare le pipeline di formazione utilizzando la sintassi dichiarativa. Ciò consente ai data scientist di creare ed eseguire rapidamente iterazioni su modelli ML e consente agli ingegneri ML di eseguire pipeline ML di integrazione continua e distribuzione continua (CI/CD) più velocemente, riducendo i tempi di produzione dei modelli.

Panoramica della soluzione

Il codice framework proposto inizia leggendo i file di configurazione. Quindi crea dinamicamente un DAG SageMaker Pipelines in base ai passaggi dichiarati nei file di configurazione e alle interazioni e dipendenze tra i passaggi. Questo framework di orchestrazione si rivolge a casi d'uso sia a modello singolo che a modello multiplo e fornisce un flusso regolare di dati e processi. Di seguito sono riportati i principali vantaggi di questa soluzione:

- Automazione – L'intero flusso di lavoro ML, dalla preelaborazione dei dati al registro dei modelli, è orchestrato senza alcun intervento manuale. Ciò riduce il tempo e lo sforzo necessari per la sperimentazione e l'operatività del modello.

- Riproducibilità – Con un file di configurazione predefinito, data scientist e ingegneri ML possono riprodurre l'intero flusso di lavoro, ottenendo risultati coerenti su più esecuzioni e ambienti.

- Scalabilità - Amazon Sage Maker viene utilizzato in tutta la pipeline, consentendo ai professionisti del machine learning di elaborare set di dati di grandi dimensioni e addestrare modelli complessi senza problemi di infrastruttura.

- Flessibilità – Il framework è flessibile e può ospitare un'ampia gamma di casi d'uso ML, framework ML (come XGBoost e TensorFlow), formazione multi-modello e formazione in più fasi. Ogni fase del DAG di formazione può essere personalizzata tramite il file di configurazione.

- Modello di governance - L' Registro dei modelli di Amazon SageMaker l'integrazione consente di tenere traccia delle versioni dei modelli e quindi di promuoverli in produzione in tutta sicurezza.

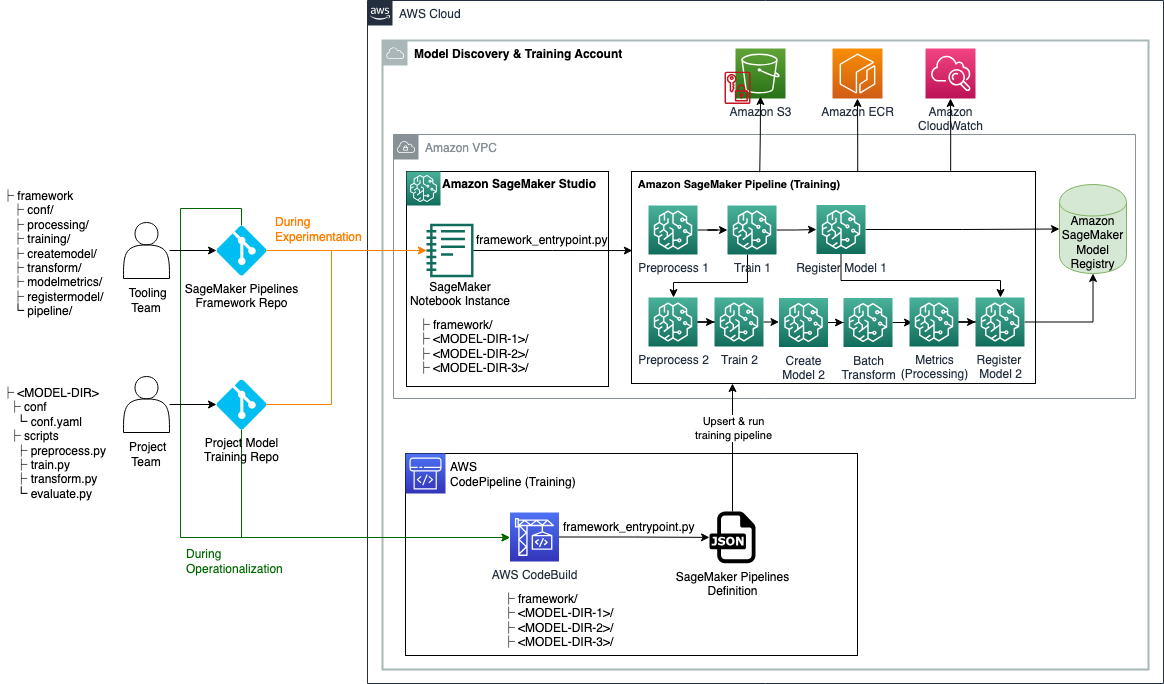

Il diagramma dell'architettura seguente illustra come utilizzare il framework proposto sia durante la sperimentazione che durante l'operazionalizzazione dei modelli ML. Durante la sperimentazione, puoi clonare il repository del codice framework fornito in questo post e i repository del codice sorgente specifici del progetto Amazon Sage Maker Studioe imposta il tuo ambiente virtuale (dettagliato più avanti in questo post). È quindi possibile eseguire l'iterazione degli script di preelaborazione, formazione e valutazione, nonché delle scelte di configurazione. Per creare ed eseguire un DAG di addestramento SageMaker Pipelines, è possibile chiamare il punto di ingresso del framework, che leggerà tutti i file di configurazione, creerà i passaggi necessari e li orchestra in base all'ordine dei passaggi e alle dipendenze specificati.

Durante l'operatività, la pipeline CI clona il repository del codice framework e i repository di formazione specifici del progetto in un file AWSCodeBuild job, in cui lo script del punto di ingresso del framework viene chiamato per creare o aggiornare il DAG di formazione di SageMaker Pipelines e quindi eseguirlo.

Struttura del repository

I Repository GitHub contiene le seguenti directory e file:

- /framework/conf/ – Questa directory contiene un file di configurazione utilizzato per impostare variabili comuni in tutte le unità di modellazione come sottoreti, gruppi di sicurezza e ruolo IAM in fase di runtime. Un'unità di modellazione è una sequenza composta da un massimo di sei passaggi per l'addestramento di un modello ML.

- /framework/creamodello/ – Questa directory contiene uno script Python che crea un file Modello SageMaker oggetto basato su artefatti modello da a Passaggio di formazione di SageMaker Pipelines. L'oggetto modello viene successivamente utilizzato in a Trasformazione batch SageMaker lavoro per valutare le prestazioni del modello su un set di test.

- /framework/modelmetrics/ – Questa directory contiene uno script Python che crea un file Elaborazione di Amazon SageMaker lavoro per generare un report JSON delle metriche del modello per un modello addestrato in base ai risultati di un lavoro di trasformazione batch SageMaker eseguito sui dati di test.

- /struttura/conduttura/ – Questa directory contiene script Python che utilizzano classi Python definite in altre directory del framework per creare o aggiornare un DAG SageMaker Pipelines in base alle configurazioni specificate. Lo script model_unit.py viene utilizzato da pipeline_service.py per creare una o più unità di modellazione. Ogni unità di modellazione è una sequenza composta da un massimo di sei passaggi per l'addestramento di un modello ML: elaborazione, addestramento, creazione del modello, trasformazione, metrica e registrazione del modello. Le configurazioni per ciascuna unità di modellazione devono essere specificate nel rispettivo repository del modello. pipeline_service.py imposta inoltre le dipendenze tra i passaggi di SageMaker Pipelines (come i passaggi all'interno e tra le unità di modellazione vengono sequenziati o concatenati) in base alla sezione sagemakerPipeline, che dovrebbe essere definita nel file di configurazione di uno dei repository di modelli (il modello di ancoraggio). Ciò consente di sovrascrivere le dipendenze predefinite dedotte da SageMaker Pipelines. Discuteremo la struttura del file di configurazione più avanti in questo post.

- /quadro/elaborazione/ – Questa directory contiene uno script Python che crea un processo di elaborazione SageMaker basato sull'immagine Docker specificata e sullo script del punto di ingresso.

- /framework/registermodel/ – Questa directory contiene uno script Python per la registrazione di un modello addestrato insieme ai relativi parametri calcolati in SageMaker Model Registry.

- /quadro/formazione/ – Questa directory contiene uno script Python che crea un lavoro di formazione SageMaker.

- /framework/trasforma/ – Questa directory contiene uno script Python che crea un processo di trasformazione batch SageMaker. Nel contesto dell'addestramento del modello, viene utilizzato per calcolare la metrica delle prestazioni di un modello addestrato sui dati di test.

- /framework/utilità/ – Questa directory contiene script di utilità per leggere e unire file di configurazione, nonché per la registrazione.

- /framework_entrypoint.py – Questo file è il punto di ingresso del codice quadro. Chiama una funzione definita nella directory /framework/pipeline/ per creare o aggiornare un DAG SageMaker Pipelines ed eseguirlo.

- /esempi/ – Questa directory contiene diversi esempi di come utilizzare questo framework di automazione per creare DAG di formazione semplici e complessi.

- /env.env – Questo file consente di impostare variabili comuni come sottoreti, gruppi di sicurezza e ruolo IAM come variabili di ambiente.

- /requisiti.txt – Questo file specifica le librerie Python richieste per il codice del framework.

Prerequisiti

Prima di distribuire questa soluzione è necessario disporre dei seguenti prerequisiti:

- Un account AWS

- Sage Maker Studio

- Un ruolo SageMaker con autorizzazioni di lettura/scrittura Amazon S3 e crittografia/decrittografia AWS KMS

- Un bucket S3 per l'archiviazione di dati, script e artefatti del modello

- Facoltativamente, il Interfaccia della riga di comando di AWS (interfaccia a riga di comando dell'AWS)

- Python3 (Python 3.7 o versione successiva) e i seguenti pacchetti Python:

- boto3

- sagemaker

- PyYAML

- Pacchetti Python aggiuntivi utilizzati nei tuoi script personalizzati

Distribuisci la soluzione

Completare i seguenti passaggi per distribuire la soluzione:

- Organizza il repository di addestramento del modello secondo la seguente struttura:

- Clona il codice del framework e il codice sorgente del tuo modello dai repository Git:

-

- clone

dynamic-sagemaker-pipelines-frameworkrepository in una directory di formazione. Nel codice seguente si presuppone che venga richiamata la directory di trainingaws-train: - Clona il codice sorgente del modello nella stessa directory. Per l'addestramento su più modelli, ripetere questo passaggio per tutti i modelli necessari per l'addestramento.

- clone

Per l'addestramento a modello singolo, la directory dovrebbe essere simile alla seguente:

Per l'addestramento su più modelli, la directory dovrebbe essere simile alla seguente:

- Configura le seguenti variabili di ambiente. Gli asterischi indicano le variabili di ambiente richieste; il resto è facoltativo.

| Variabile d'ambiente | Descrizione |

SMP_ACCOUNTID* |

Account AWS in cui viene eseguita la pipeline SageMaker |

SMP_REGION* |

Regione AWS in cui viene eseguita la pipeline SageMaker |

SMP_S3BUCKETNAME* |

Nome del bucket S3 |

SMP_ROLE* |

Ruolo SageMaker |

SMP_MODEL_CONFIGPATH* |

Percorso relativo dei file di configurazione a modello singolo o multimodello |

SMP_SUBNETS |

ID di sottorete per la configurazione di rete SageMaker |

SMP_SECURITYGROUPS |

ID dei gruppi di sicurezza per la configurazione di rete SageMaker |

Per i casi d'uso a modello singolo, SMP_MODEL_CONFIGPATH sarà <MODEL-DIR>/conf/conf.yaml. Per i casi d'uso multimodello, SMP_MODEL_CONFIGPATH sarà */conf/conf.yaml, che ti permette di trovare tutto conf.yaml file utilizzando il modulo glob di Python e combinarli per formare un file di configurazione globale. Durante la sperimentazione (test locale), puoi specificare le variabili di ambiente all'interno del file env.env e quindi esportarle eseguendo il seguente comando nel terminale:

Tieni presente che i valori delle variabili di ambiente in env.env devono essere racchiusi tra virgolette (ad esempio SMP_REGION="us-east-1"). Durante l'operatività, queste variabili di ambiente dovrebbero essere impostate dalla pipeline CI.

- Crea e attiva un ambiente virtuale eseguendo i seguenti comandi:

- Installa i pacchetti Python richiesti eseguendo il comando seguente:

- Modifica la formazione del tuo modello

conf.yamlFile. Discuteremo la struttura del file di configurazione nella sezione successiva. - Dal terminale, chiama il punto di ingresso del framework per creare o aggiornare ed eseguire il DAG di formazione SageMaker Pipeline:

- Visualizza ed esegui il debug delle pipeline SageMaker eseguite su Condotte scheda dell'interfaccia utente di SageMaker Studio.

Struttura del file di configurazione

Esistono due tipi di file di configurazione nella soluzione proposta: configurazione del framework e configurazione del modello. In questa sezione, descriviamo ciascuno di essi in dettaglio.

Configurazione del quadro

I /framework/conf/conf.yaml file imposta le variabili comuni a tutte le unità di modellazione. Ciò comprende SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSe SMP_MODELNAME. Fare riferimento al passaggio 3 delle istruzioni di distribuzione per le descrizioni di queste variabili e come impostarle tramite variabili di ambiente.

Configurazione del modello

Per ogni modello presente nel progetto è necessario specificare quanto segue nel file <MODEL-DIR>/conf/conf.yaml file (gli asterischi indicano le sezioni obbligatorie; il resto è facoltativo):

- /conf/modelli* – In questa sezione è possibile configurare una o più unità di modellazione. Quando il codice del framework viene eseguito, leggerà automaticamente tutti i file di configurazione durante il runtime e li aggiungerà all'albero di configurazione. In teoria, è possibile specificare tutte le unità di modellazione nello stesso modo

conf.yamlfile, ma è consigliabile specificare la configurazione di ciascuna unità di modellazione nella rispettiva directory o nel repository Git per ridurre al minimo gli errori. Le unità sono le seguenti:- {nome del modello}* – Il nome del modello.

- directory_origine* - Un comune

source_dirpercorso da utilizzare per tutti i passaggi all'interno dell'unità di modellazione. - preprocesso – Questa sezione specifica i parametri di preelaborazione.

- treno* – Questa sezione specifica i parametri del lavoro di formazione.

- trasformare* – Questa sezione specifica i parametri del processo SageMaker Transform per effettuare previsioni sui dati del test.

- valutare – Questa sezione specifica i parametri del processo di elaborazione SageMaker per generare un report JSON delle metriche del modello per il modello addestrato.

- registro* – Questa sezione specifica i parametri per la registrazione del modello addestrato in SageMaker Model Registry.

- /conf/sagemakerPipeline* – Questa sezione definisce il flusso di SageMaker Pipelines, comprese le dipendenze tra i passaggi. Per i casi d'uso con modello singolo, questa sezione è definita alla fine del file di configurazione. Per i casi d'uso multimodello, il

sagemakerPipelineLa sezione deve essere definita solo nel file di configurazione di uno dei modelli (uno qualsiasi dei modelli). Chiameremo questo modello il modello di ancoraggio. I parametri sono i seguenti:- Nome pipeline* – Nome della pipeline SageMaker.

- modelli* – Elenco nidificato di unità di modellazione:

- {nome del modello}* – Identificatore del modello, che dovrebbe corrispondere a un identificatore {model-name} nella sezione /conf/models.

- passaggi* -

- nome_passo* – Nome del passaggio da visualizzare nel DAG SageMaker Pipelines.

- passo_class* – (Unione[Elaborazione, Formazione, CreateModel, Trasforma, Metriche, RegisterModel])

- tipo_passo* – Questo parametro è richiesto solo per le fasi di preelaborazione, per le quali deve essere impostato su preelaborazione. Ciò è necessario per distinguere i passaggi di preelaborazione e valutazione, entrambi con a

step_classdi Elaborazione. - abilita_cache – ([Unione[Vero, Falso]]). Questo indica se abilitare Cache di SageMaker Pipelines per questo passaggio.

- chain_input_source_step – ([lista[nome_passo]]). È possibile utilizzarlo per impostare le uscite del canale di un altro passaggio come input per questo passaggio.

- chain_input_additional_prefix – Ciò è consentito solo per i passaggi della trasformazione

step_class, e può essere utilizzato in combinazione conchain_input_source_stepparametro per individuare il file da utilizzare come input per la fase di trasformazione.

- passaggi* -

- {nome del modello}* – Identificatore del modello, che dovrebbe corrispondere a un identificatore {model-name} nella sezione /conf/models.

- dipendenze – Questa sezione specifica la sequenza in cui devono essere eseguiti i passaggi di SageMaker Pipelines. Abbiamo adattato la notazione Apache Airflow per questa sezione (ad esempio,

{step_name} >> {step_name}). Se questa sezione viene lasciata vuota, le dipendenze esplicite specificate dachain_input_source_stepIl parametro o le dipendenze implicite definiscono il flusso DAG di SageMaker Pipelines.

Tieni presente che ti consigliamo di effettuare una fase di addestramento per unità di modellazione. Se vengono definiti più passaggi di training per un'unità di modellazione, i passaggi successivi seguono implicitamente l'ultimo passaggio di training per creare l'oggetto del modello, calcolare le metriche e registrare il modello. Se è necessario addestrare più modelli, è consigliabile creare più unità di modellazione.

Esempi

In questa sezione, mostriamo tre esempi di DAG di addestramento del modello ML creati utilizzando il framework presentato.

Formazione a modello singolo: LightGBM

Questo è un esempio di modello singolo per un caso d'uso di classificazione in cui utilizziamo LightGBM in modalità script su SageMaker. dataset è costituito da variabili categoriali e numeriche per prevedere l'etichetta binaria Entrate (per prevedere se il soggetto effettua un acquisto o meno). IL script di preelaborazione viene utilizzato per modellare i dati per l'addestramento e il test e quindi metterlo in scena in un bucket S3. I percorsi S3 vengono quindi forniti al file fase di formazione nel file di configurazione.

Quando viene eseguita la fase di training, SageMaker carica il file nel contenitore in /opt/ml/input/data/{channelName}/, accessibile tramite la variabile d'ambiente SM_CHANNEL_{channelName} sul contenitore (channelName= 'allena' o 'prova'). L' copione formativo fa quanto segue:

- Caricare i file localmente dai percorsi del contenitore locale utilizzando il file Carico NumPy modulo.

- Imposta gli iperparametri per l'algoritmo di training.

- Salvare il modello addestrato nel percorso del contenitore locale

/opt/ml/model/.

SageMaker prende il contenuto in /opt/ml/model/ per creare un tarball utilizzato per distribuire il modello su SageMaker per l'hosting.

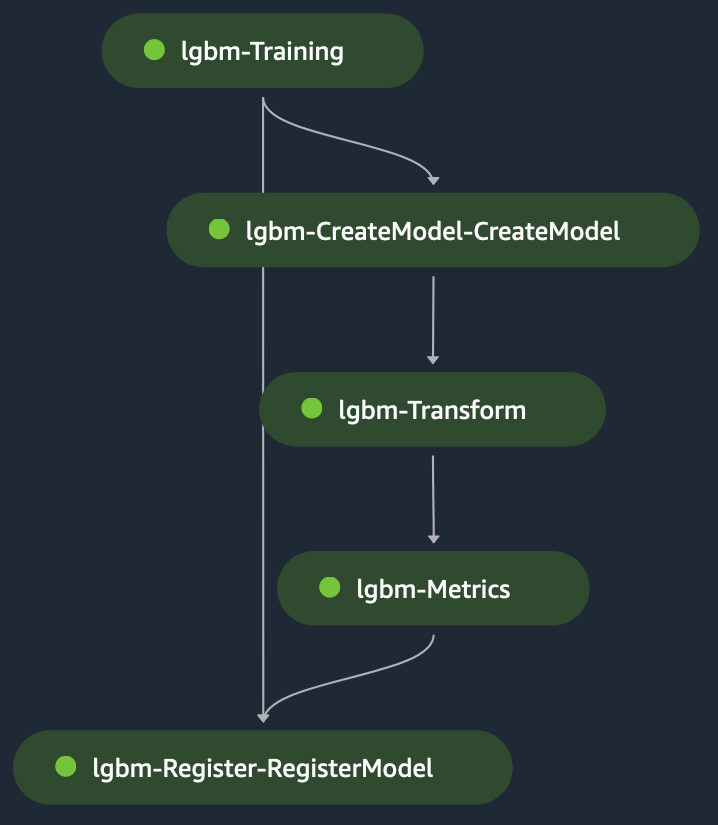

Il passaggio di trasformazione prende come input lo staged file di prova come input e il modello addestrato per fare previsioni sul modello addestrato. L'output della fase di trasformazione è incatenato al passaggio delle metriche per valutare il modello rispetto a realtà di base, che viene fornito esplicitamente al passaggio delle metriche. Infine, l'output della fase delle metriche è implicitamente concatenato alla fase di registrazione per registrare il modello nel registro dei modelli SageMaker con le informazioni sulle prestazioni del modello prodotte nella fase delle metriche. La figura seguente mostra una rappresentazione visiva del DAG di addestramento. È possibile fare riferimento agli script e al file di configurazione per questo esempio nel file Repository GitHub.

Formazione a modello unico: messa a punto del LLM

Questo è un altro esempio di formazione a modello singolo, in cui orchestramo la messa a punto di un modello linguistico di grandi dimensioni (LLM) Falcon-40B di Hugging Face Hub per un caso d'uso di riepilogo del testo. IL script di preelaborazione carica il file Samsum set di dati da Hugging Face, carica il tokenizzatore per il modello ed elabora le suddivisioni dei dati di training/test per ottimizzare il modello sui dati di questo dominio nella fase di preelaborazione di riepilogo del testo falco.

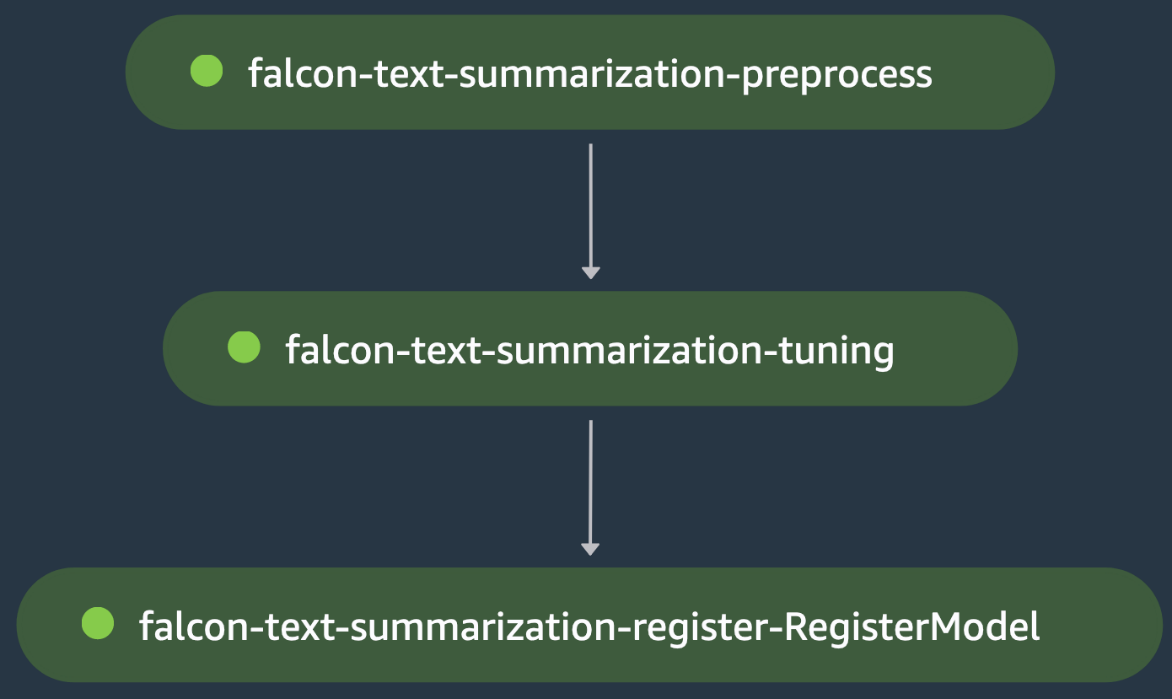

L'output è incatenato al passaggio di ottimizzazione del riepilogo del testo falco, dove il copione formativo carica il Falcon-40B LLM da Hugging Face Hub e avvia la messa a punto accelerata utilizzando LORA sulla divisione del treno. Il modello viene valutato nella stessa fase dopo la messa a punto, che portieri la perdita di valutazione dovuta al fallimento della fase di ottimizzazione del riepilogo del testo falco, che causa l'arresto della pipeline SageMaker prima che sia in grado di registrare il modello ottimizzato. In caso contrario, la fase di ottimizzazione del riepilogo del testo falco viene eseguita correttamente e il modello viene registrato nel registro dei modelli SageMaker. La figura seguente mostra una rappresentazione visiva del DAG di ottimizzazione LLM. Gli script e il file di configurazione per questo esempio sono disponibili nel file Repository GitHub.

Formazione multimodello

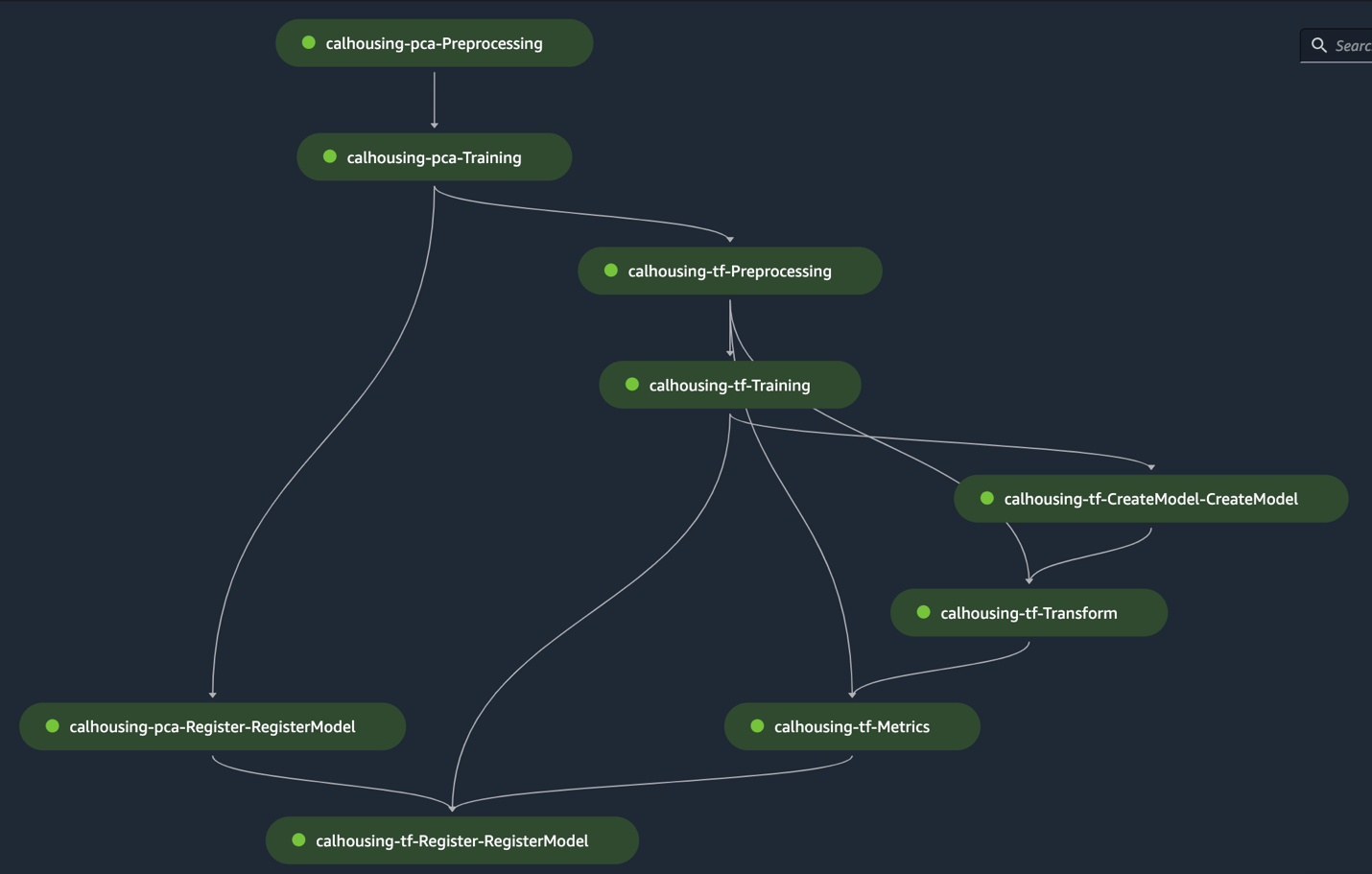

Questo è un esempio di addestramento multi-modello in cui un modello di analisi delle componenti principali (PCA) viene addestrato per la riduzione della dimensionalità e un modello TensorFlow Multilayer Perceptron viene addestrato per Previsione dei prezzi delle case in California. La fase di preelaborazione del modello TensorFlow utilizza un modello PCA addestrato per ridurre la dimensionalità dei dati di addestramento. Aggiungiamo una dipendenza nella configurazione per garantire che il modello TensorFlow venga registrato dopo la registrazione del modello PCA. La figura seguente mostra una rappresentazione visiva dell'esempio del DAG di training multimodello. Gli script e i file di configurazione per questo esempio sono disponibili nel file Repository GitHub.

ripulire

Completa i seguenti passaggi per ripulire le tue risorse:

- Utilizza l'AWS CLI per stratagemma ed rimuovere eventuali pipeline rimanenti create dagli script Python.

- Facoltativamente, elimina altre risorse AWS come il bucket S3 o il ruolo IAM creato all'esterno di SageMaker Pipelines.

Conclusione

In questo post, abbiamo presentato un framework per automatizzare la creazione di DAG SageMaker Pipelines in base ai file di configurazione. Il framework proposto offre una soluzione lungimirante alla sfida di orchestrare carichi di lavoro ML complessi. Utilizzando un file di configurazione, SageMaker Pipelines offre la flessibilità necessaria per creare orchestrazione con un codice minimo, in modo da poter semplificare il processo di creazione e gestione di pipeline sia a modello singolo che a modello multiplo. Questo approccio non solo fa risparmiare tempo e risorse, ma promuove anche le migliori pratiche MLOps, contribuendo al successo complessivo delle iniziative ML. Per ulteriori informazioni sui dettagli di implementazione, consultare il Repository GitHub.

Informazioni sugli autori

Luis Felipe Yepez Barrios, è un ingegnere di machine learning presso AWS Professional Services, specializzato in sistemi distribuiti scalabili e strumenti di automazione per accelerare l'innovazione scientifica nel campo del machine learning (ML). Inoltre, assiste i clienti aziendali nell'ottimizzazione delle loro soluzioni di machine learning tramite i servizi AWS.

Luis Felipe Yepez Barrios, è un ingegnere di machine learning presso AWS Professional Services, specializzato in sistemi distribuiti scalabili e strumenti di automazione per accelerare l'innovazione scientifica nel campo del machine learning (ML). Inoltre, assiste i clienti aziendali nell'ottimizzazione delle loro soluzioni di machine learning tramite i servizi AWS.

Jinzhao Feng, è un ingegnere di machine learning presso AWS Professional Services. Si concentra sull'architettura e sull'implementazione di soluzioni di pipeline di ML e intelligenza artificiale generativa su larga scala. È specializzato in FMOps, LLMOps e formazione distribuita.

Jinzhao Feng, è un ingegnere di machine learning presso AWS Professional Services. Si concentra sull'architettura e sull'implementazione di soluzioni di pipeline di ML e intelligenza artificiale generativa su larga scala. È specializzato in FMOps, LLMOps e formazione distribuita.

Duro Asnani, è un ingegnere di machine learning presso AWS. Il suo background è nella scienza dei dati applicata, con particolare attenzione all'operazionalizzazione dei carichi di lavoro di machine learning nel cloud su larga scala.

Duro Asnani, è un ingegnere di machine learning presso AWS. Il suo background è nella scienza dei dati applicata, con particolare attenzione all'operazionalizzazione dei carichi di lavoro di machine learning nel cloud su larga scala.

Hassan Shojaei, è un Senior Data Scientist presso AWS Professional Services, dove aiuta i clienti di diversi settori a risolvere le loro sfide aziendali attraverso l'uso di big data, machine learning e tecnologie cloud. Prima di ricoprire questo ruolo, Hasan ha guidato numerose iniziative per sviluppare nuove tecniche di modellazione basate sulla fisica e sui dati per le principali aziende energetiche. Al di fuori del lavoro, Hasan è appassionato di libri, escursionismo, fotografia e storia.

Hassan Shojaei, è un Senior Data Scientist presso AWS Professional Services, dove aiuta i clienti di diversi settori a risolvere le loro sfide aziendali attraverso l'uso di big data, machine learning e tecnologie cloud. Prima di ricoprire questo ruolo, Hasan ha guidato numerose iniziative per sviluppare nuove tecniche di modellazione basate sulla fisica e sui dati per le principali aziende energetiche. Al di fuori del lavoro, Hasan è appassionato di libri, escursionismo, fotografia e storia.

Alec Jenab, è un ingegnere di machine learning specializzato nello sviluppo e nell'operatività di soluzioni di machine learning su larga scala per i clienti aziendali. Alec ha la passione di portare soluzioni innovative sul mercato, soprattutto nelle aree in cui l'apprendimento automatico può migliorare significativamente l'esperienza dell'utente finale. Fuori dal lavoro, gli piace giocare a basket, fare snowboard e scoprire gemme nascoste a San Francisco.

Alec Jenab, è un ingegnere di machine learning specializzato nello sviluppo e nell'operatività di soluzioni di machine learning su larga scala per i clienti aziendali. Alec ha la passione di portare soluzioni innovative sul mercato, soprattutto nelle aree in cui l'apprendimento automatico può migliorare significativamente l'esperienza dell'utente finale. Fuori dal lavoro, gli piace giocare a basket, fare snowboard e scoprire gemme nascoste a San Francisco.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :È

- :non

- :Dove

- $ SU

- 120

- 160

- 7

- 8

- 9

- a

- capace

- Chi siamo

- accelerata

- accesso

- accessibile

- ospitare

- Secondo

- Il mio account

- il raggiungimento

- operanti in

- attivare

- aciclico

- aggiungere

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AI

- algoritmo

- Tutti

- consentire

- permesso

- consente

- lungo

- anche

- Amazon

- Amazon Sage Maker

- Pipeline di Amazon SageMaker

- Amazon Web Services

- tra

- an

- .

- Presentatrice

- ed

- Un altro

- in qualsiasi

- Apache

- applicato

- approccio

- architettura

- SONO

- aree

- AS

- assist

- assumere

- At

- automatizzare

- automaticamente

- Automatizzare

- Automazione

- disponibile

- AWS

- Servizi professionali AWS

- sfondo

- basato

- Pallacanestro

- BE

- prima

- vantaggi

- MIGLIORE

- best practice

- Big

- Big Data

- Libri

- entrambi

- Portare

- costruire

- affari

- ma

- by

- calcolare

- calcolato

- chiamata

- detto

- Bandi

- Materiale

- Custodie

- casi

- Dedicato

- cause

- incatenato

- Challenge

- sfide

- canale

- scelte

- classi

- classificazione

- cavedano

- cli

- clienti

- Cloud

- codice

- combinare

- Uncommon

- Aziende

- complesso

- componente

- preoccupazioni

- fiducia

- Configurazione

- congiunzione

- coerente

- consiste

- Contenitore

- Tecnologie Container

- contiene

- contenuto

- contesto

- continuo

- contribuendo

- coprire

- creare

- creato

- crea

- Creazione

- creazione

- cruciale

- costume

- Clienti

- personalizzate

- GIORNO

- dati

- scienza dei dati

- scienziato di dati

- data-driven

- dataset

- dichiarata

- Predefinito

- definire

- definito

- definisce

- consegna

- dimostrare

- dipendenze

- Dipendenza

- schierare

- distribuzione

- deployment

- descrivere

- dettaglio

- dettagliati

- dettagli

- sviluppare

- in via di sviluppo

- Mercato

- diagramma

- diverso

- indirizzato

- directory

- elenco

- scoprire

- discutere

- visualizzati

- distinguere

- distribuito

- sistemi distribuiti

- formazione distribuita

- docker

- effettua

- dominio

- durante

- dinamico

- dinamicamente

- ogni

- efficiente

- sforzo

- Potenzia

- enable

- Abilita

- consentendo

- fine

- energia

- ingegnere

- Ingegneri

- garantire

- Impresa

- Intero

- iscrizione

- Ambiente

- ambienti

- errori

- particolarmente

- valutare

- valutato

- la valutazione

- valutazione

- Ogni

- esempio

- Esempi

- affrettare

- esperienza

- espressamente

- export

- Faccia

- FAIL

- falso

- più veloce

- campo

- figura

- Compila il

- File

- Infine

- Trovare

- Flessibilità

- flessibile

- flusso

- Focus

- concentrato

- si concentra

- i seguenti

- segue

- Nel

- modulo

- lungimirante

- Contesto

- quadri

- Francisco

- da

- function

- Inoltre

- la generazione di

- generativo

- AI generativa

- Idiota

- globali

- la governance

- grafico

- maggiore

- Gruppo

- Gruppo

- Avere

- avendo

- he

- aiuta

- qui

- nascosto

- il suo

- storia

- di hosting

- alloggiamento

- Come

- Tutorial

- HTML

- http

- HTTPS

- Hub

- identificatore

- Identità

- ids

- if

- Immagine

- implementazione

- Implementazione

- competenze

- in

- In altre

- inclusi

- Compreso

- indicare

- indica

- industrie

- inferito

- informazioni

- Infrastruttura

- iniziative

- Innovazione

- creativi e originali

- ingresso

- interno

- install

- esempio

- istruzioni

- integrazione

- interazioni

- intervento

- ai miglioramenti

- IT

- SUO

- Lavoro

- accoppiamento

- jpg

- json

- Le

- Tasti

- Discografica

- Lingua

- grandi

- Cognome

- dopo

- apprendimento

- Guidato

- a sinistra

- biblioteche

- piace

- linea

- Lista

- LLM

- caricare

- carichi

- locale

- a livello locale

- registrazione

- Guarda

- una

- spento

- macchina

- machine learning

- make

- FA

- Fare

- gestione

- gestione

- Manuale

- molti

- Rappresentanza

- partita

- metrico

- Metrica

- minimo

- ridurre al minimo

- ML

- MLOp

- Moda

- modello

- modellismo

- modelli

- Moduli

- Scopri di più

- multiplo

- Nome

- necessaria

- Bisogno

- di applicazione

- esigenze

- internazionale

- GENERAZIONE

- no

- romanzo

- oggetto

- of

- Offerte

- on

- ONE

- esclusivamente

- ottimizzazione

- or

- orchestrato

- orchestrare

- orchestrazione

- Altro

- altrimenti

- produzione

- uscite

- al di fuori

- complessivo

- Override

- Packages

- parametro

- parametri

- appassionato

- sentiero

- percorsi

- per

- performance

- eseguita

- fotografia

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- punto

- Post

- pratiche

- predefinito

- predire

- Previsioni

- prerequisiti

- presenti

- presentata

- prezzo

- Direttore

- Precedente

- un bagno

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- professionale

- progetto

- promuove

- promuovere

- proposto

- purché

- fornisce

- Acquista

- Python

- rapidamente

- gamma

- Leggi

- prontamente

- Lettura

- raccomandare

- raccomandato

- ridurre

- riduce

- riduzione

- riferimento

- regione

- registro

- registrato

- registrazione

- Iscrizione

- registro

- rimanente

- ripetere

- rapporto

- deposito

- rappresentazione

- necessario

- Requisiti

- risorsa

- Risorse

- quelli

- REST

- Risultati

- Le vendite

- recensioni

- Ruolo

- ruoli

- Correre

- running

- corre

- runtime

- sagemaker

- Pipeline SageMaker

- stesso

- San

- San Francisco

- scalabile

- Scala

- Scienze

- scientifico

- Scienziato

- scienziati

- copione

- script

- Sezione

- sezioni

- problemi di

- Sequenza

- Servizi

- set

- Set

- alcuni

- dovrebbero

- Spettacoli

- Un'espansione

- SIX

- lisciare

- So

- soluzione

- Soluzioni

- RISOLVERE

- Fonte

- codice sorgente

- specializzata

- specializzata

- specificato

- dividere

- Si divide

- inizio

- step

- Passi

- Fermare

- conservazione

- memorizzare

- snellire

- razionalizzazione

- La struttura

- studio

- soggetto

- sottoreti

- successivo

- il successo

- Con successo

- tale

- in dotazione

- sintassi

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- tecniche

- Tecnologie

- tensorflow

- terminal

- test

- Testing

- testo

- che

- I

- Il registro

- loro

- Li

- poi

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- tre

- Attraverso

- per tutto

- tempo

- a

- top

- Tracking

- Treni

- allenato

- Training

- Trasformare

- albero

- vero

- seconda

- Tipi di

- ui

- per

- unità

- unità

- Aggiornanento

- uso

- caso d'uso

- utilizzato

- Utente

- Esperienza da Utente

- usa

- utilizzando

- utilità

- Valori

- variabile

- versioni

- via

- virtuale

- visivo

- we

- sito web

- servizi web

- WELL

- quando

- se

- quale

- OMS

- largo

- Vasta gamma

- volere

- con

- entro

- senza

- Lavora

- flusso di lavoro

- XGBoost

- YAML

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro