Il machine learning (ML) aiuta le organizzazioni a generare entrate, ridurre i costi, mitigare i rischi, promuovere l'efficienza e migliorare la qualità ottimizzando le funzioni aziendali principali in più unità aziendali come marketing, produzione, operazioni, vendite, finanza e assistenza clienti. Con AWS ML, le organizzazioni possono accelerare la creazione di valore da mesi a giorni. Tela di Amazon SageMaker è un servizio visivo point-and-click che consente agli analisti aziendali di generare previsioni ML accurate senza scrivere una sola riga di codice o richiedere competenze ML. È possibile utilizzare i modelli per effettuare previsioni in modo interattivo e per il punteggio batch su set di dati in blocco.

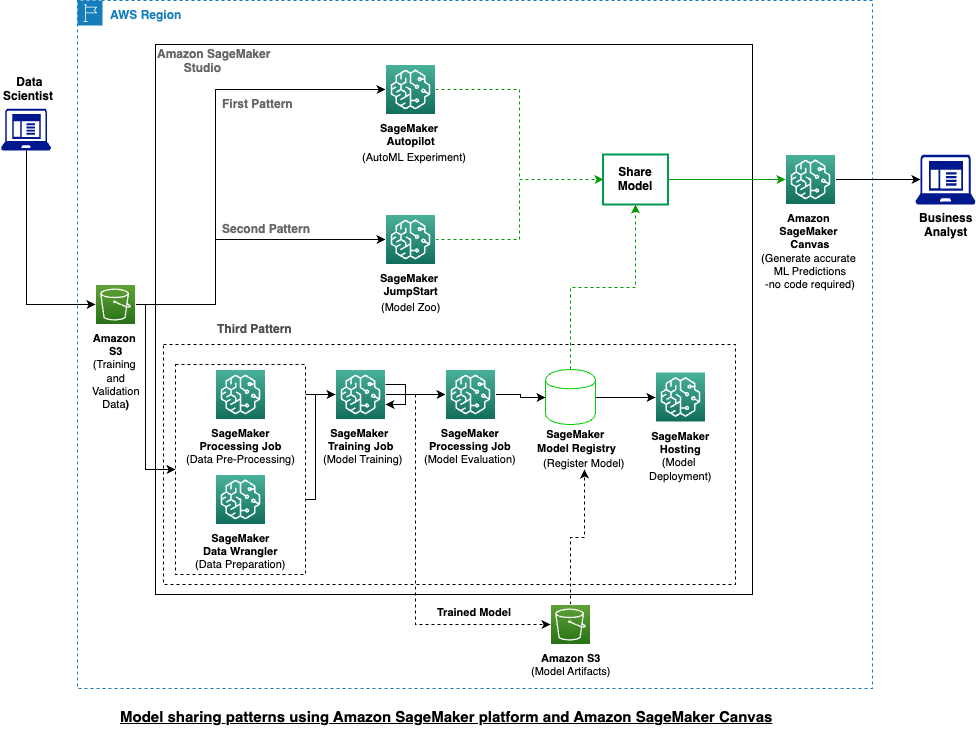

In questo post, mostriamo i modelli architetturali su come i team aziendali possono utilizzare i modelli ML creati ovunque generando previsioni in Canvas e ottenere risultati aziendali efficaci.

Questa integrazione dello sviluppo e della condivisione dei modelli crea una collaborazione più stretta tra i team aziendali e di data science e riduce il time-to-value. I team aziendali possono utilizzare modelli esistenti creati dai loro data scientist o altri reparti per risolvere un problema aziendale invece di ricostruire nuovi modelli in ambienti esterni.

Infine, gli analisti aziendali possono importare modelli condivisi in Canvas e generare previsioni prima della distribuzione in produzione con pochi clic.

Panoramica della soluzione

La figura seguente descrive tre diversi modelli di architettura per dimostrare come i data scientist possono condividere i modelli con gli analisti aziendali, che possono quindi generare direttamente previsioni da tali modelli nell'interfaccia visiva di Canvas:

Prerequisiti

Per addestrare e costruire il tuo modello utilizzando SageMaker e portare il tuo modello in Canvas, completa i seguenti prerequisiti:

- Se non disponi già di un dominio SageMaker e di un utente Studio, configurare e integrare un utente di Studio in un dominio SageMaker.

- Abilita e configura Canvas autorizzazioni di base per i tuoi utenti e concedere agli utenti le autorizzazioni per collaborare con Studio.

- È necessario disporre di un modello addestrato da Autopilot, JumpStart o dal registro dei modelli. Per qualsiasi modello che hai creato al di fuori di SageMaker, devi registrare il tuo modello nel registro dei modelli prima di importarlo in Canvas.

Ora assumiamo il ruolo di un data scientist che sta cercando di addestrare, creare, distribuire e condividere modelli ML con un analista aziendale per ciascuno di questi tre modelli architetturali.

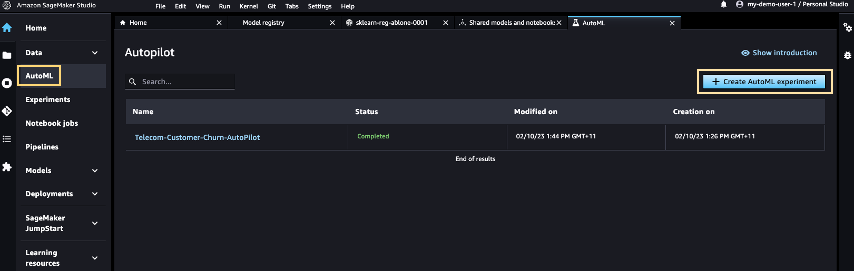

Usa il pilota automatico e Canvas

Autopilot automatizza le attività chiave di un processo ML automatico (AutoML) come l'esplorazione dei dati, la selezione dell'algoritmo pertinente per il tipo di problema e quindi l'addestramento e l'ottimizzazione. Tutto ciò può essere ottenuto consentendo di mantenere il pieno controllo e visibilità sul set di dati. Autopilot esplora automaticamente diverse soluzioni per trovare il modello migliore e gli utenti possono iterare sul modello ML o distribuire direttamente il modello in produzione con un clic.

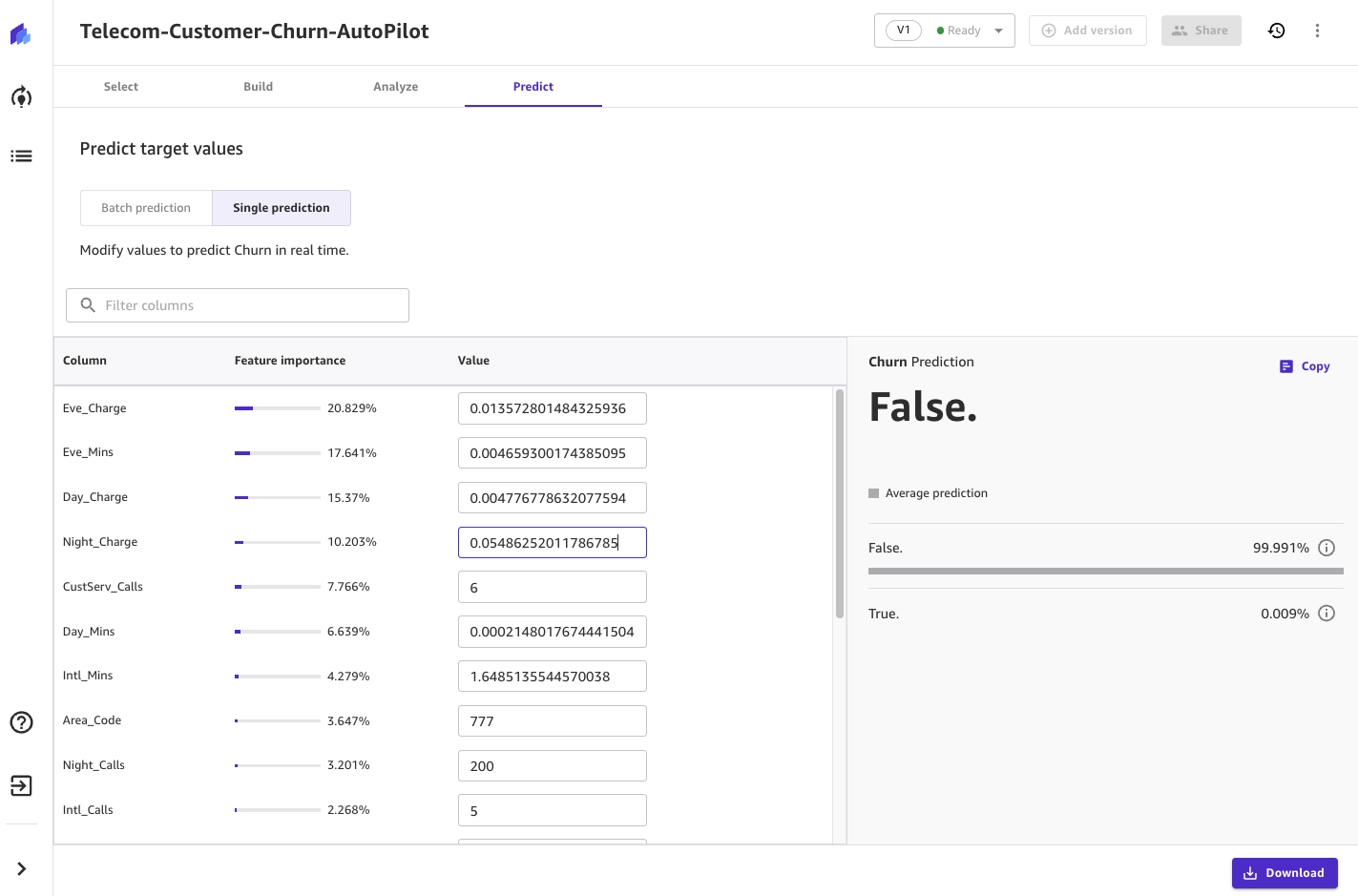

In questo esempio, utilizziamo un sintetico di abbandono dei clienti dataset dal dominio delle telecomunicazioni e hanno il compito di identificare i clienti potenzialmente a rischio di abbandono. Completa i passaggi seguenti per utilizzare Autopilot AutoML per creare, addestrare, distribuire e condividere un modello ML con un analista aziendale:

- Scarica la dataset, caricalo su Amazon S3 (Servizio di archiviazione semplice Amazon) bucket e prendere nota dell'URI S3.

- Nella console di Studio, scegli AutoML nel pannello di navigazione.

- Scegli Crea esperimento AutoML.

- Specifica il nome dell'esperimento (per questo post,

Telecom-Customer-Churn-AutoPilot), ingresso dati S3 e posizione di uscita. - Imposta la colonna di destinazione come tasso di abbandono.

- Nelle impostazioni di distribuzione, puoi abilitare l'opzione di distribuzione automatica per creare un endpoint che distribuisce il tuo modello migliore ed esegue l'inferenza sull'endpoint.

Per ulteriori informazioni, fare riferimento a Crea un esperimento Amazon SageMaker Autopilot.

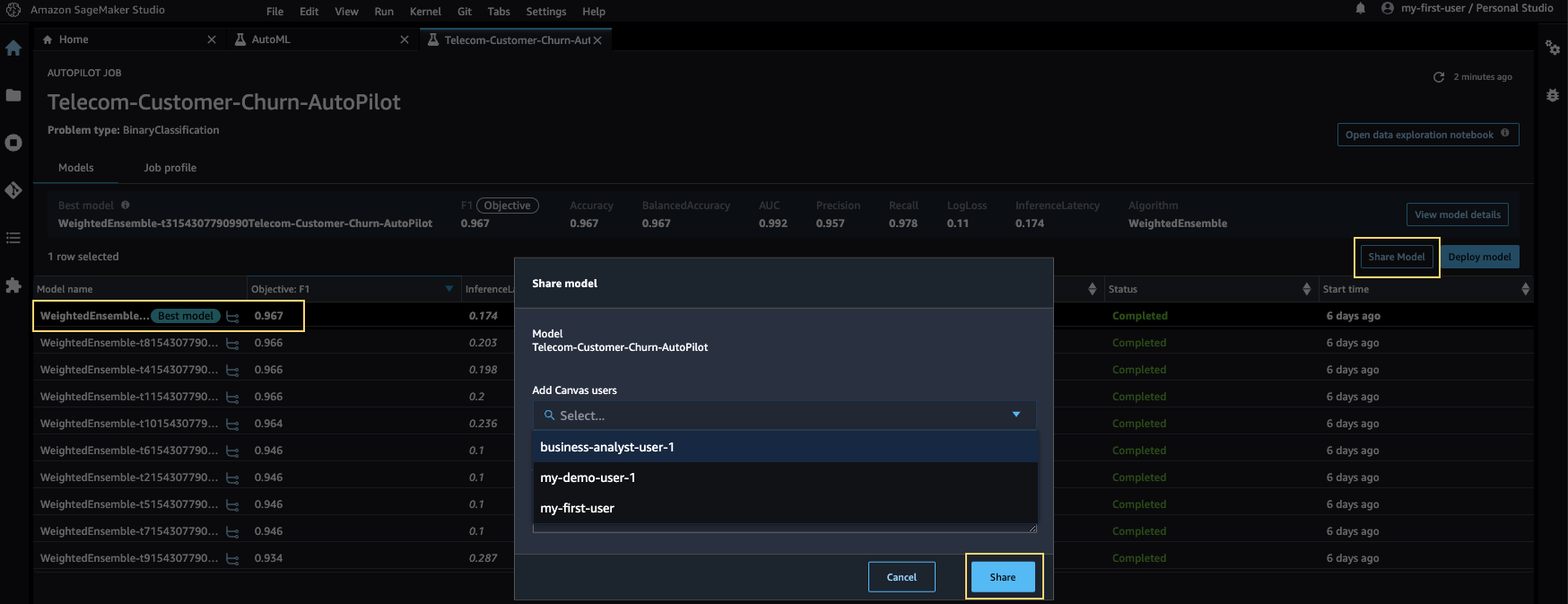

- Scegli il tuo esperimento, quindi seleziona il tuo modello migliore e scegli Condividi il modello.

- Aggiungi un utente Canvas e scegli Condividi condividere il modello

(Note:: non puoi condividere il modello con lo stesso utente Canvas utilizzato per l'accesso a Studio. Ad esempio, l'utente A di Studio non può condividere il modello con l'utente A di Canvas. Ma l'utente A può condividere il modello con l'utente B, quindi scegliere usi diversi per la condivisione del modello)

Per ulteriori informazioni, fare riferimento a Utenti di Studio: condividi un modello su SageMaker Canvas.

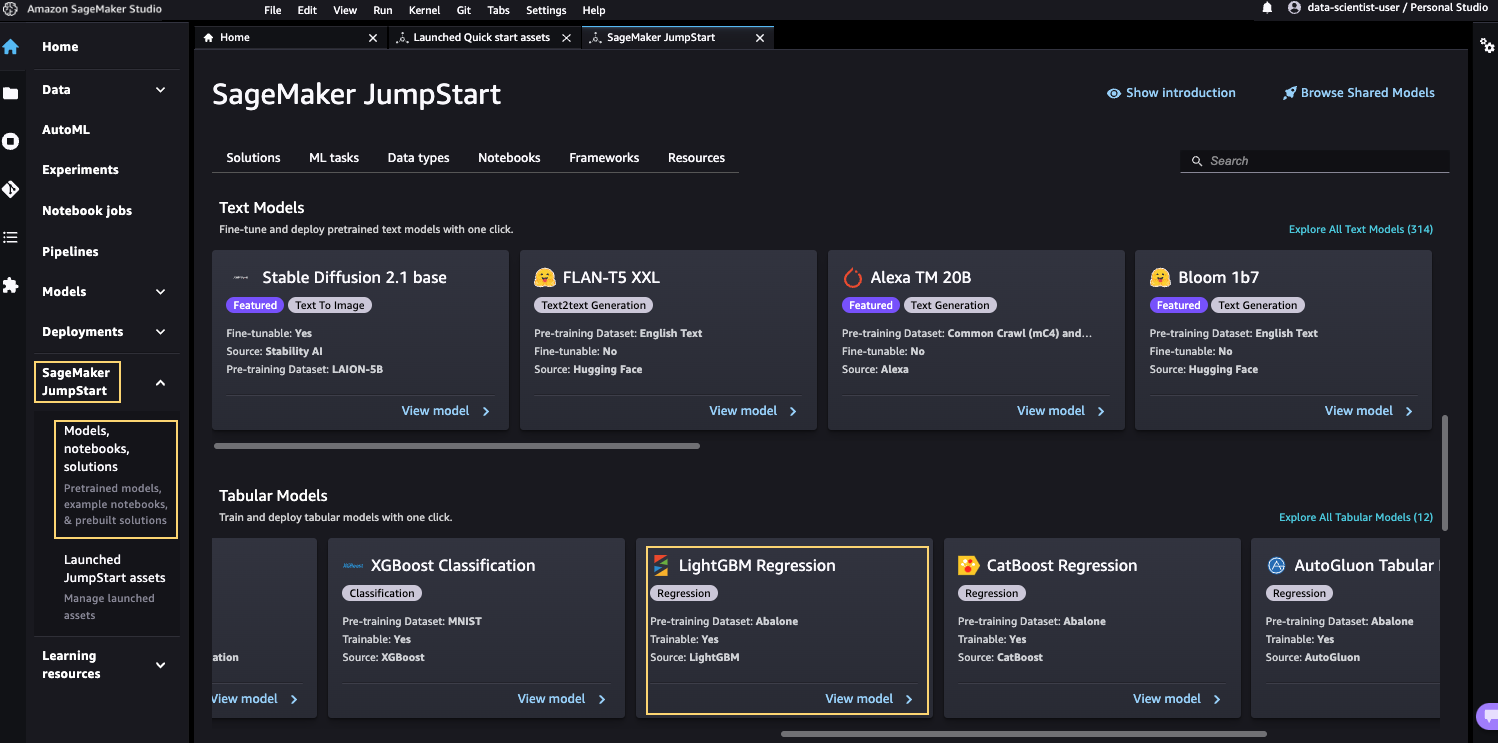

Usa JumpStart e Canvas

JumpStart è un hub ML che fornisce modelli open source preaddestrati per un'ampia gamma di casi d'uso ML come il rilevamento di frodi, la previsione del rischio di credito e il rilevamento di difetti del prodotto. Puoi distribuire più di 300 modelli pre-addestrati per dati tabulari, visivi, di testo e audio.

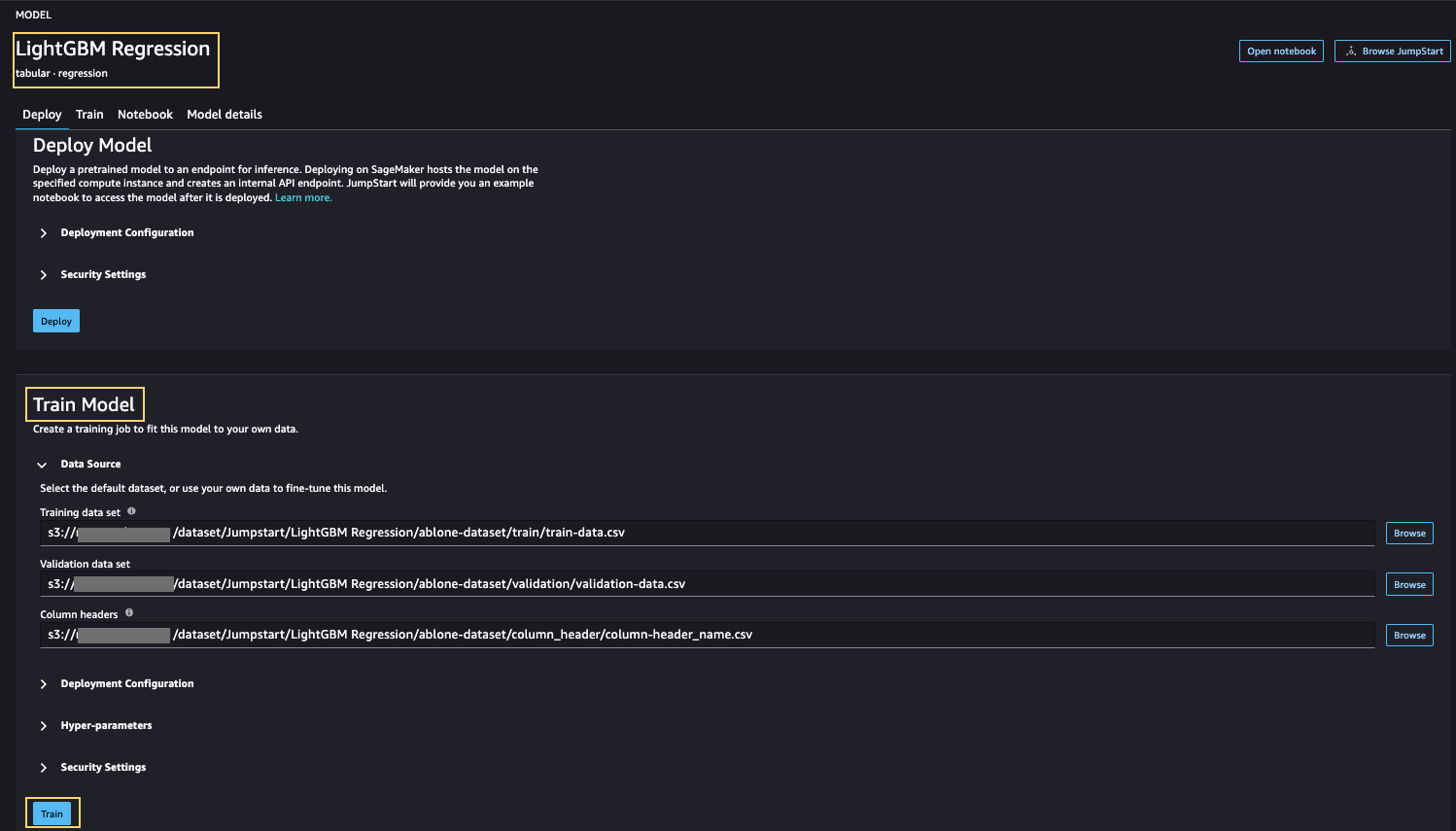

Per questo post, utilizziamo un modello pre-addestrato di regressione LightGBM da JumpStart. Formiamo il modello su un set di dati personalizzato e condividiamo il modello con un utente Canvas (analista aziendale). Il modello preaddestrato può essere distribuito a un endpoint per l'inferenza. JumpStart fornisce un notebook di esempio per accedere al modello dopo che è stato distribuito.

In questo esempio, usiamo il set di dati abalone. Il set di dati contiene esempi di otto misurazioni fisiche come lunghezza, diametro e altezza per prevedere l'età dell'abalone (un problema di regressione).

- Scarica la set di dati abalone da Kaggle.

- Crea un bucket S3 e carica i set di dati di addestramento, convalida e intestazione personalizzata.

- Sulla console di Studio, sotto SageMaker JumpStart nel pannello di navigazione, scegli Modelli, taccuini, soluzioni.

- Sotto Modelli tabulariscegli Regressione LightGBM.

- Sotto Modello di treno, specificare gli URI S3 per i set di dati di addestramento, convalida e intestazione di colonna.

- Scegli Treni.

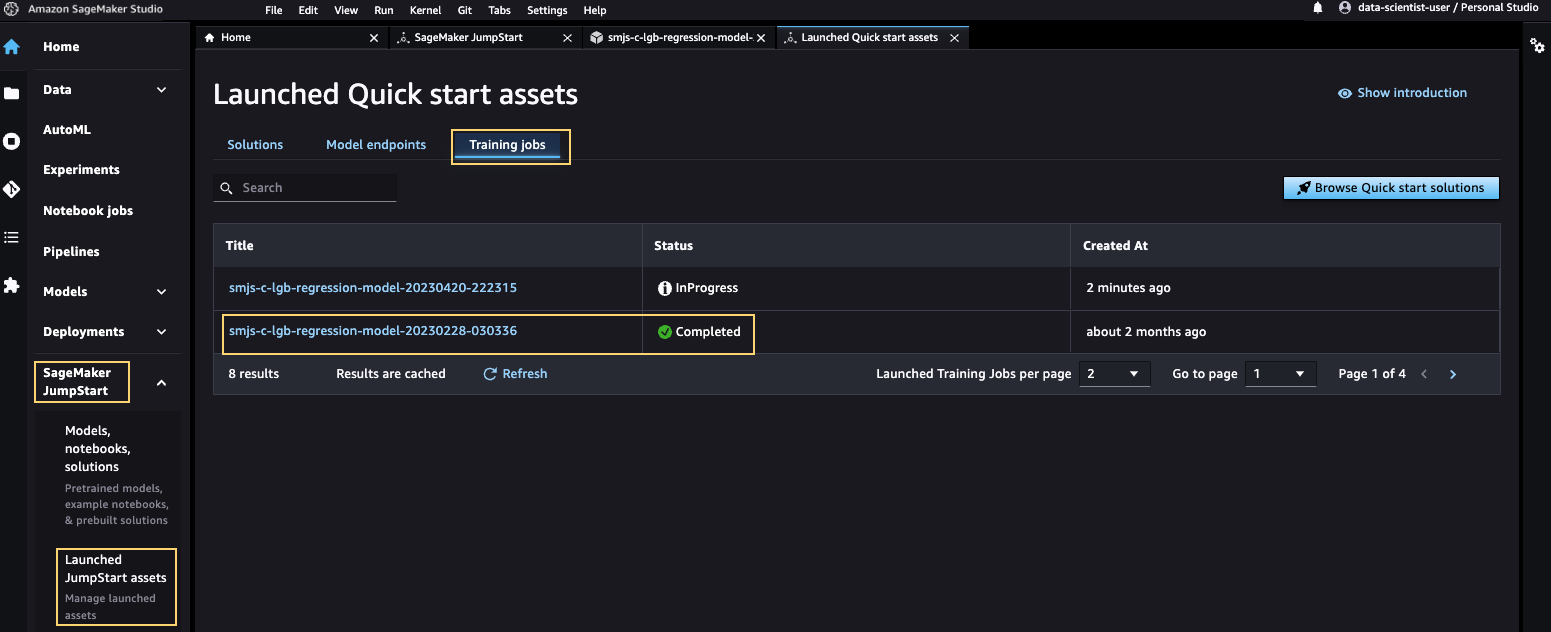

- Nel pannello di navigazione, scegli Asset JumpStart lanciati.

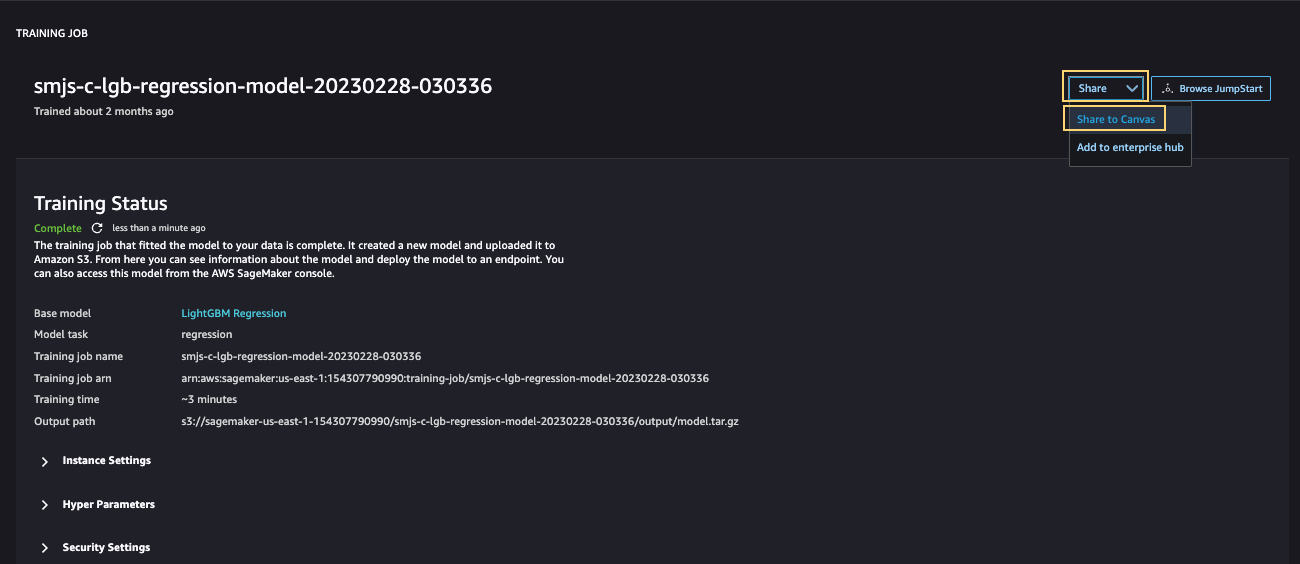

- Sulla Lavori di formazione scheda, scegli il tuo lavoro di formazione.

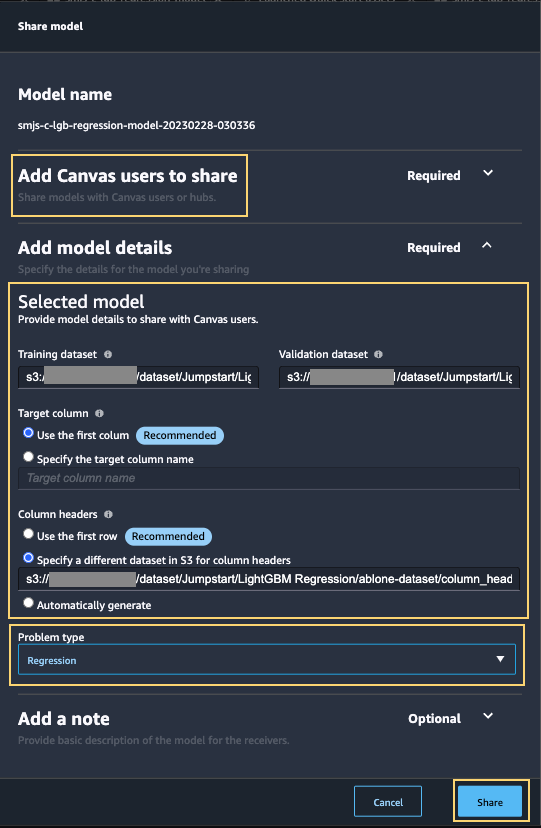

- Sulla Condividi menù, scegliere Condividi su tela.

- Scegli gli utenti Canvas con cui condividere, specifica i dettagli del modello e scegli Condividi.

Per ulteriori informazioni, fare riferimento a Utenti di Studio: condividi un modello su SageMaker Canvas.

Usa il registro dei modelli SageMaker e Canvas

Con il registro dei modelli di SageMaker, puoi catalogare i modelli per la produzione, gestire le versioni dei modelli, associare i metadati, gestire lo stato di approvazione di un modello, distribuire i modelli alla produzione e automatizzare la distribuzione dei modelli con CI/CD.

Assumiamo il ruolo di un data scientist. Per questo esempio, stai creando un progetto ML end-to-end che include la preparazione dei dati, l'addestramento del modello, l'hosting del modello, il registro del modello e la condivisione del modello con un analista aziendale. Facoltativamente, è possibile utilizzare per la preparazione dei dati e le fasi di pre- o post-elaborazione Gestore di dati di Amazon SageMaker e Amazon SageMaker Elaborazione del lavoro. In questo esempio, utilizziamo il set di dati abalone scaricato da LIBSVM. La variabile target è l'età dell'abalone.

- In Studio, clona il file Repository GitHub.

- Completare i passaggi elencati nel file README.

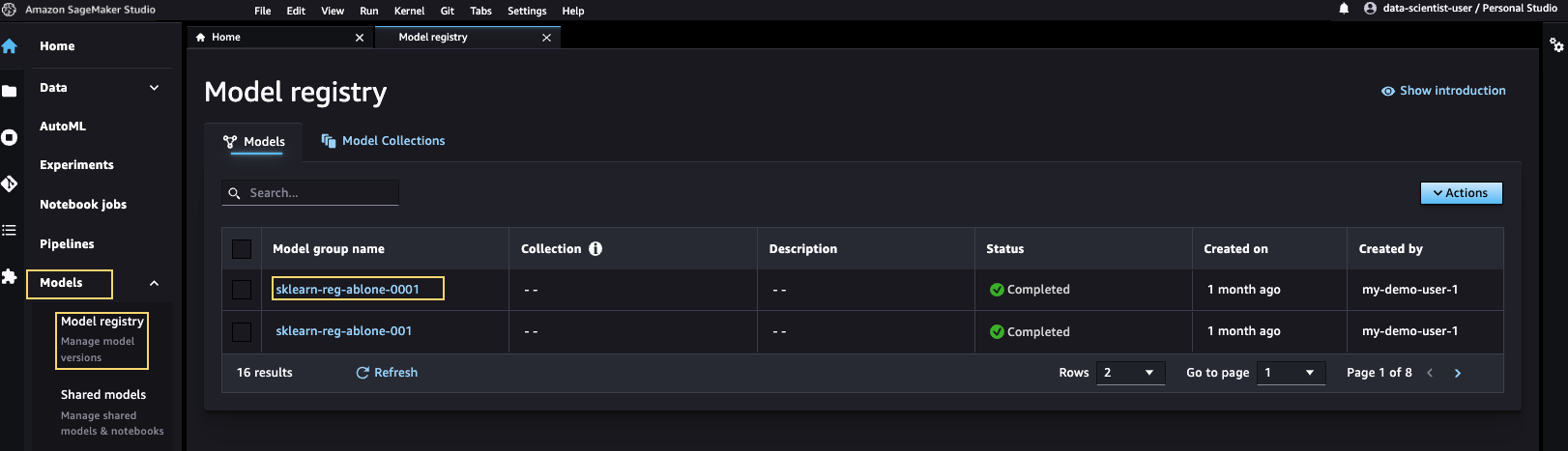

- Sulla console di Studio, sotto Modelli nel pannello di navigazione, scegli Registro dei modelli.

- Scegli il modello

sklearn-reg-ablone.

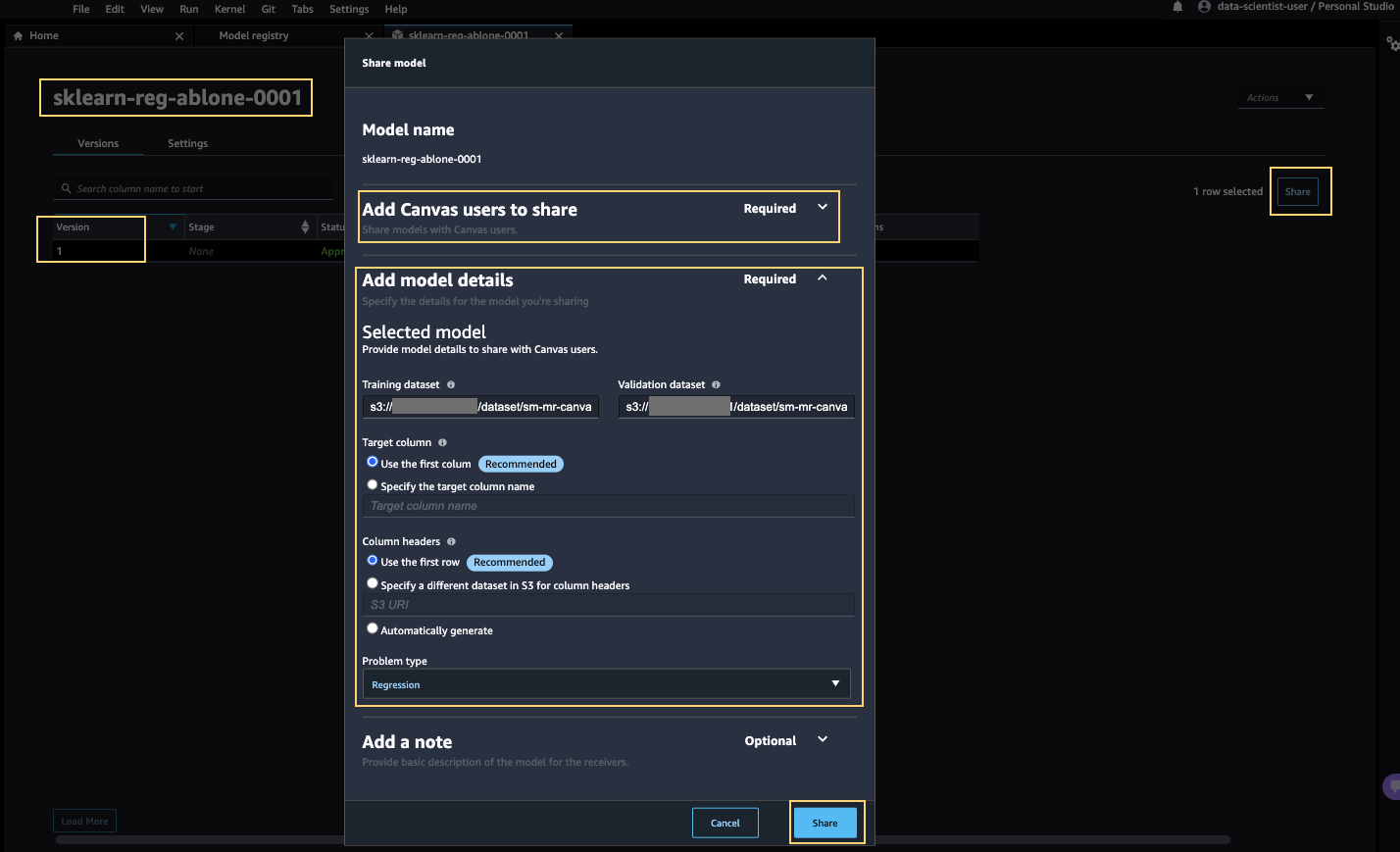

- Condividi la versione 1 del modello dal registro dei modelli a Canvas.

- Scegli gli utenti Canvas con cui condividere, specifica i dettagli del modello e scegli Condividi.

Per le istruzioni, fare riferimento al Registro dei modelli sezione in Utenti di Studio: condividi un modello su SageMaker Canvas.

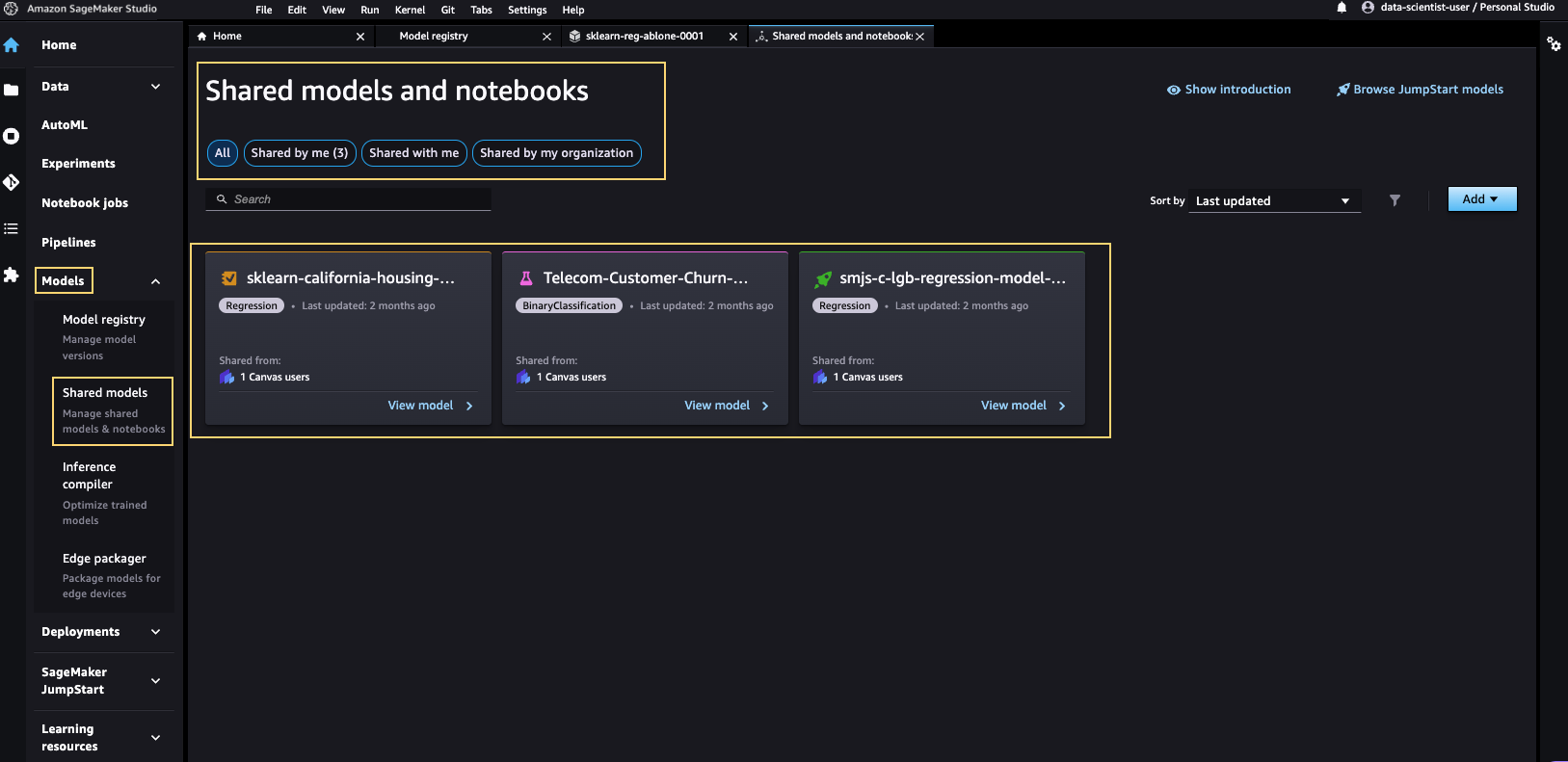

Gestisci i modelli condivisi

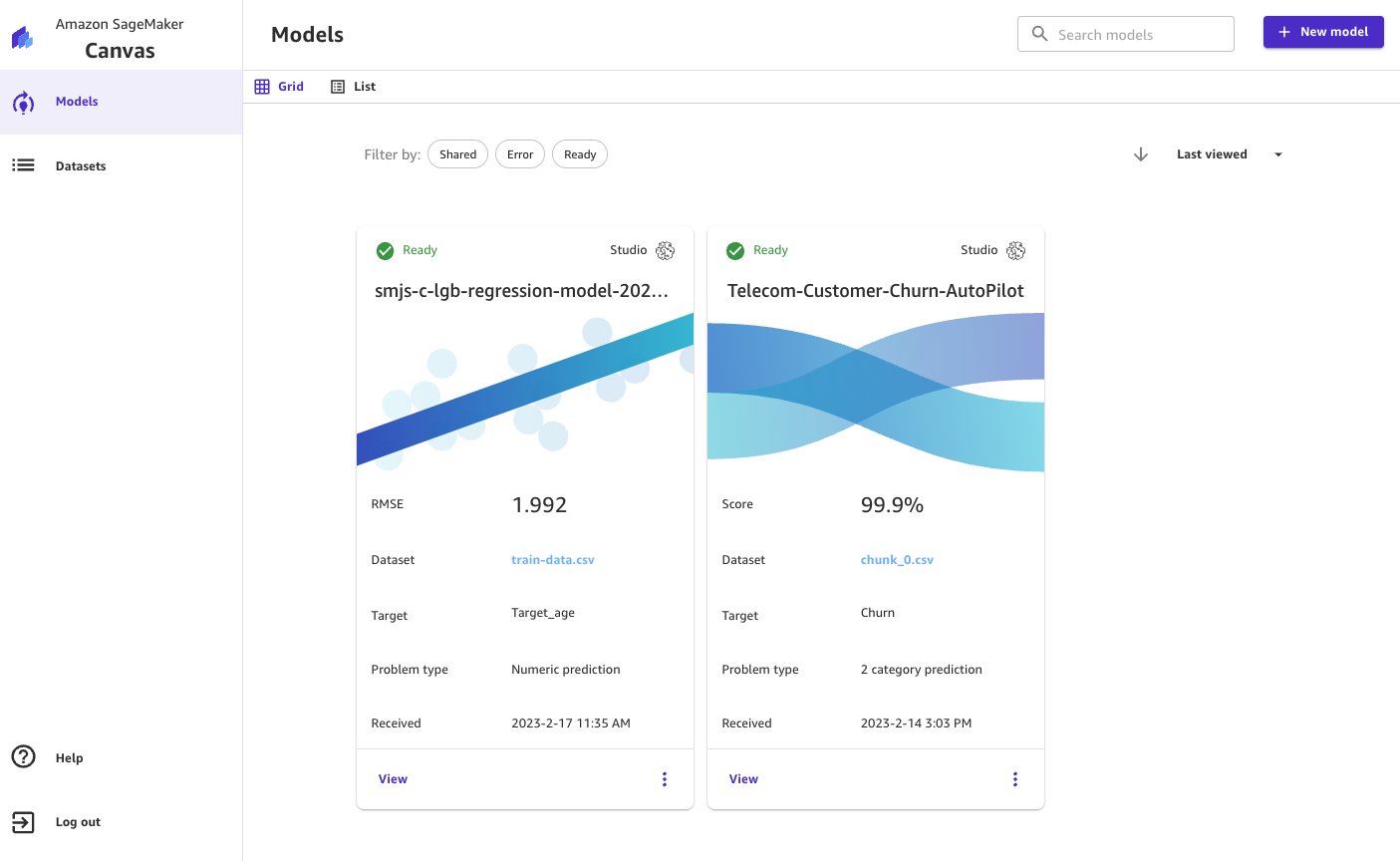

Dopo aver condiviso il modello utilizzando uno dei metodi precedenti, puoi andare al file Modelli sezione in Studio ed esamina tutti i modelli condivisi. Nello screenshot seguente, vediamo 3 diversi modelli condivisi da un utente Studio (data scientist) con diversi utenti Canvas (team aziendali).

Importa un modello condiviso e fai previsioni con Canvas

Assumiamo il ruolo di analista aziendale e accediamo a Canvas con il nostro utente Canvas.

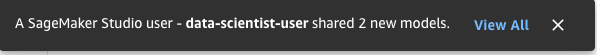

Quando un data scientist o un utente di Studio condivide un modello con un utente Canvas, ricevi una notifica all'interno dell'applicazione Canvas che un utente di Studio ha condiviso un modello con te. Nell'applicazione Canvas, la notifica è simile allo screenshot seguente.

È possibile scegliere Visualizza aggiornamento per vedere il modello condiviso, oppure puoi andare al Modelli pagina nell'applicazione Canvas per scoprire tutti i modelli che sono stati condivisi con te. L'importazione del modello da Studio può richiedere fino a 20 minuti.

Dopo aver importato il modello, puoi visualizzarne le metriche e generare previsioni in tempo reale con analisi what-if o previsioni batch.

Considerazioni

Tieni presente quanto segue quando condividi i modelli con Canvas:

- I set di dati di addestramento e convalida vengono archiviati in Amazon S3 e gli URI S3 vengono passati a Canvas con Gestione dell'identità e dell'accesso di AWS (IAM) autorizzazioni.

- Fornisci la colonna di destinazione a Canvas o utilizza la prima colonna come impostazione predefinita.

- Affinché un contenitore Canvas analizzi i dati di inferenza, l'endpoint Canvas accetta testo (CSV) o applicazione (JSON).

- Canvas non supporta più container o pipeline di inferenza.

- Uno schema di dati viene fornito a Canvas se non vengono fornite intestazioni nei set di dati di addestramento e convalida. Per impostazione predefinita, la piattaforma JumpStart non fornisce intestazioni nei set di dati di addestramento e convalida.

- Con Jumpstart, il lavoro di formazione deve essere completato prima di poterlo condividere con Canvas.

Fare riferimento a Limitazioni e risoluzione dei problemi per aiutarti a risolvere eventuali problemi riscontrati durante la condivisione dei modelli.

ripulire

Per evitare di incorrere in futuri addebiti, elimina o chiudi le risorse che hai creato seguendo questo post. Fare riferimento a Disconnessione da Amazon SageMaker Canvas per ulteriori dettagli. Spegni le singole risorse, inclusi notebook, terminale, kernel, app e istanze. Per ulteriori informazioni, fare riferimento a Arresta le risorse. Elimina il file versione del modello, Endpoint e risorse SageMaker, Risorse per l'esperimento del pilota automaticoe Benna S3.

Conclusione

Studio consente ai data scientist di condividere i modelli ML con gli analisti aziendali in pochi semplici passaggi. Gli analisti aziendali possono trarre vantaggio dai modelli ML già creati dai data scientist per risolvere i problemi aziendali invece di creare un nuovo modello in Canvas. Tuttavia, potrebbe essere difficile utilizzare questi modelli al di fuori degli ambienti in cui vengono creati a causa dei requisiti tecnici e dei processi manuali per importare i modelli. Ciò costringe spesso gli utenti a ricostruire i modelli ML, con conseguente duplicazione degli sforzi e tempo e risorse aggiuntivi. Canvas rimuove queste limitazioni in modo da poter generare previsioni in Canvas con modelli addestrati ovunque. Utilizzando i tre modelli illustrati in questo post, puoi registrare i modelli ML nel registro dei modelli SageMaker, che è un archivio di metadati per i modelli ML, e importarli in Canvas. Gli analisti aziendali possono quindi analizzare e generare previsioni da qualsiasi modello in Canvas.

Per ulteriori informazioni sull'utilizzo dei servizi SageMaker, consulta le seguenti risorse:

Se hai domande o suggerimenti, lascia un commento.

Circa gli autori

Aman Sharma è un Senior Solutions Architect presso AWS. Lavora con start-up, piccole e medie imprese e clienti aziendali in tutta la regione APJ, oltre 19 anni di esperienza nella consulenza, progettazione e soluzioni. È appassionato di democratizzazione dell'IA e del machine learning e aiuta i clienti a progettare i propri dati e le strategie di machine learning. Al di fuori del lavoro, gli piace esplorare la natura e la fauna selvatica.

Aman Sharma è un Senior Solutions Architect presso AWS. Lavora con start-up, piccole e medie imprese e clienti aziendali in tutta la regione APJ, oltre 19 anni di esperienza nella consulenza, progettazione e soluzioni. È appassionato di democratizzazione dell'IA e del machine learning e aiuta i clienti a progettare i propri dati e le strategie di machine learning. Al di fuori del lavoro, gli piace esplorare la natura e la fauna selvatica.

Zichen Nie è il Senior Software Engineer presso AWS SageMaker che ha guidato il progetto Bring Your Own Model to SageMaker Canvas l'anno scorso. Lavora in Amazon da più di 7 anni e ha esperienza sia nell'ottimizzazione della supply chain di Amazon che nei servizi di intelligenza artificiale di AWS. Le piacciono gli allenamenti di Barre e la musica dopo il lavoro.

Zichen Nie è il Senior Software Engineer presso AWS SageMaker che ha guidato il progetto Bring Your Own Model to SageMaker Canvas l'anno scorso. Lavora in Amazon da più di 7 anni e ha esperienza sia nell'ottimizzazione della supply chain di Amazon che nei servizi di intelligenza artificiale di AWS. Le piacciono gli allenamenti di Barre e la musica dopo il lavoro.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/bring-your-own-ml-model-into-amazon-sagemaker-canvas-and-generate-accurate-predictions/

- :ha

- :È

- $ SU

- 1

- 100

- 20

- 7

- a

- WRI

- accelerare

- accetta

- accesso

- preciso

- Raggiungere

- raggiunto

- operanti in

- aggiuntivo

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Servizi di intelligenza artificiale

- algoritmo

- Tutti

- Consentire

- consente

- già

- Amazon

- Amazon Sage Maker

- Pilota automatico Amazon SageMaker

- Tela di Amazon SageMaker

- an

- .

- analista

- Gli analisti

- analizzare

- ed

- in qualsiasi

- ovunque

- Applicazioni

- approvazione

- applicazioni

- architettonico

- architettura

- SONO

- AS

- Associate

- At

- Audio

- auto

- automatizzare

- automatizza

- Automatico

- automaticamente

- AutoML

- evitare

- AWS

- base

- BE

- stato

- prima

- beneficio

- MIGLIORE

- fra

- entrambi

- portare

- costruire

- Costruzione

- costruito

- affari

- funzioni aziendali

- aziende

- ma

- by

- Materiale

- tela

- casi

- catalogo

- catena

- oneri

- dai un'occhiata

- Scegli

- clicca

- codice

- collaboreranno

- collaborazione

- Colonna

- commento

- completamento di una

- consolle

- consulting

- Contenitore

- contiene

- di controllo

- Nucleo

- Costi

- creare

- creato

- crea

- Creazione

- creazione

- credito

- costume

- cliente

- Servizio clienti

- Clienti

- dati

- Preparazione dei dati

- scienza dei dati

- scienziato di dati

- dataset

- Giorni

- Predefinito

- democratizzare

- dimostrare

- dipartimenti

- schierare

- schierato

- distribuzione

- deployment

- Distribuisce

- progettazione

- dettagli

- rivelazione

- Mercato

- diverso

- difficile

- direttamente

- scopri

- non

- dominio

- Dont

- giù

- guidare

- dovuto

- ogni

- Efficace

- efficienze

- sforzo

- o

- enable

- da un capo all'altro

- endpoint

- ingegnere

- Impresa

- ambienti

- esempio

- Esempi

- esistente

- esperienza

- esperimento

- competenza

- esplora

- esplora

- Esplorare

- pochi

- figura

- Compila il

- finanziare

- Trovate

- Nome

- i seguenti

- Nel

- Forze

- frode

- rilevazione di frodi

- da

- pieno

- funzioni

- futuro

- generare

- la generazione di

- Go

- Avere

- he

- intestazioni

- altezza

- Aiuto

- aiutare

- aiuta

- quindi

- di hosting

- Come

- Tuttavia

- HTML

- http

- HTTPS

- Hub

- identificazione

- Identità

- if

- importare

- importazione

- competenze

- in

- inclusi

- Compreso

- individuale

- informazioni

- ingresso

- invece

- istruzioni

- integrazione

- Interfaccia

- ai miglioramenti

- sicurezza

- IT

- SUO

- Lavoro

- jpg

- json

- ad appena

- Le

- Cognome

- L'anno scorso

- principale

- IMPARARE

- apprendimento

- Lasciare

- Lunghezza

- piace

- piace

- limiti

- linea

- elencati

- località

- ceppo

- accesso

- cerca

- mantenere

- make

- gestire

- Manuale

- consigliato per la

- Marketing

- misurazioni

- medie

- Metadati

- metodi

- Metrica

- forza

- mente

- Minuti

- Ridurre la perdita dienergia con una

- ML

- modello

- modelli

- mese

- Scopri di più

- multiplo

- Musica

- devono obbligatoriamente:

- Nome

- Natura

- Navigazione

- esigenze

- New

- no

- taccuino

- notifica

- of

- di frequente

- on

- Onboard

- ONE

- open source

- Operazioni

- ottimizzazione

- ottimizzazione

- Opzione

- or

- organizzazioni

- Altro

- su

- risultati

- produzione

- al di fuori

- proprio

- pagina

- vetro

- Passato

- appassionato

- modelli

- permessi

- Fisico

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- Post

- potenzialmente

- predire

- predizione

- Previsioni

- prerequisiti

- Problema

- problemi

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- progetto

- fornire

- purché

- fornisce

- qualità

- Domande

- gamma

- ricevere

- ridurre

- regione

- registro

- registro

- pertinente

- Requisiti

- Risorse

- risultante

- Le vendite

- recensioni

- Rischio

- Ruolo

- sagemaker

- vendite

- stesso

- Scienze

- Scienziato

- scienziati

- punteggio

- Sezione

- vedere

- Selezione

- anziano

- servizio

- Servizi

- set

- impostazioni

- Condividi

- condiviso

- azioni

- compartecipazione

- lei

- vetrina

- fermare

- simile

- Un'espansione

- singolo

- piccole

- So

- Software

- Software Engineer

- Soluzioni

- RISOLVERE

- start-up

- Stato dei servizi

- Passi

- conservazione

- Tornare al suo account

- strategie

- studio

- tale

- fornire

- supply chain

- Ottimizzazione della catena di fornitura

- supporto

- sintetico

- Fai

- Target

- task

- le squadre

- Consulenza

- telecom

- terminal

- di

- che

- Il

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- stretto

- tempo

- a

- Treni

- allenato

- Training

- Digitare

- per

- unità

- uso

- utilizzato

- Utente

- utenti

- utilizzando

- convalida

- APPREZZIAMO

- Creazione di valore

- versione

- Visualizza

- visibilità

- visione

- we

- quando

- quale

- while

- OMS

- largo

- Vasta gamma

- con

- entro

- senza

- Lavora

- lavoro

- lavori

- scrittura

- anno

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro