I modelli di machine learning (ML) non funzionano in modo isolato. Per offrire valore, devono integrarsi nei sistemi di produzione e nelle infrastrutture esistenti, il che richiede di considerare l'intero ciclo di vita del machine learning durante la progettazione e lo sviluppo. Le operazioni di machine learning, note come MLOps, si concentrano sulla razionalizzazione, sull'automazione e sul monitoraggio dei modelli di machine learning durante tutto il loro ciclo di vita. La costruzione di una solida pipeline MLOps richiede una collaborazione interfunzionale. Data scientist, ingegneri ML, personale IT e team DevOps devono lavorare insieme per rendere operativi i modelli dalla ricerca all'implementazione e alla manutenzione. Con i processi e gli strumenti giusti, MLOps consente alle organizzazioni di adottare il ML in modo affidabile ed efficiente nei propri team.

Sebbene i requisiti delle pipeline di integrazione continua e distribuzione continua (CI/CD) possano essere unici e riflettere le esigenze di ciascuna organizzazione, la scalabilità delle pratiche MLOps tra i team può essere semplificata utilizzando orchestrazioni e strumenti gestiti in grado di accelerare il processo di sviluppo ed eliminare il lavoro pesante indifferenziato .

Amazon SageMakerMLOps è una suite di funzionalità che include Progetti Amazon SageMaker (CI/CD), Pipeline di Amazon SageMaker ed Registro dei modelli di Amazon SageMaker.

Pipeline SageMaker consente la creazione e la gestione semplici di flussi di lavoro ML, offrendo allo stesso tempo funzionalità di archiviazione e riutilizzo per le fasi del flusso di lavoro. IL Registro dei modelli SageMaker centralizza il monitoraggio del modello, semplificando la distribuzione del modello. Progetti SageMaker introduce pratiche CI/CD al ML, tra cui parità di ambiente, controllo della versione, test e automazione. Ciò consente una rapida creazione di CI/CD nel tuo ambiente ML, facilitando una scalabilità efficace in tutta l'azienda.

Il incorporato modelli di progetto fornito da Amazon Sage Maker includono l'integrazione con alcuni strumenti di terze parti, come Jenkins per l'orchestrazione e GitHub per il controllo del codice sorgente, e molti utilizzano strumenti CI/CD nativi di AWS come AWS CodeCommit, AWS Code Pipelinee AWSCodeBuild. In molti scenari, tuttavia, i clienti vorrebbero integrare SageMaker Pipelines con altri strumenti CI/CD esistenti e quindi creare i propri modelli di progetto personalizzati.

In questo post, ti mostriamo un'implementazione passo passo per ottenere quanto segue:

- Crea un modello di progetto SageMaker MLOps personalizzato che si integri con GitHub e GitHub Actions

- Rendi disponibili i tuoi modelli di progetto personalizzati in Amazon Sage Maker Studio per il tuo team di data science con il provisioning con un clic

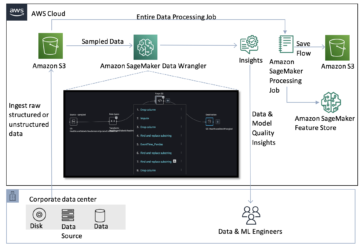

Panoramica della soluzione

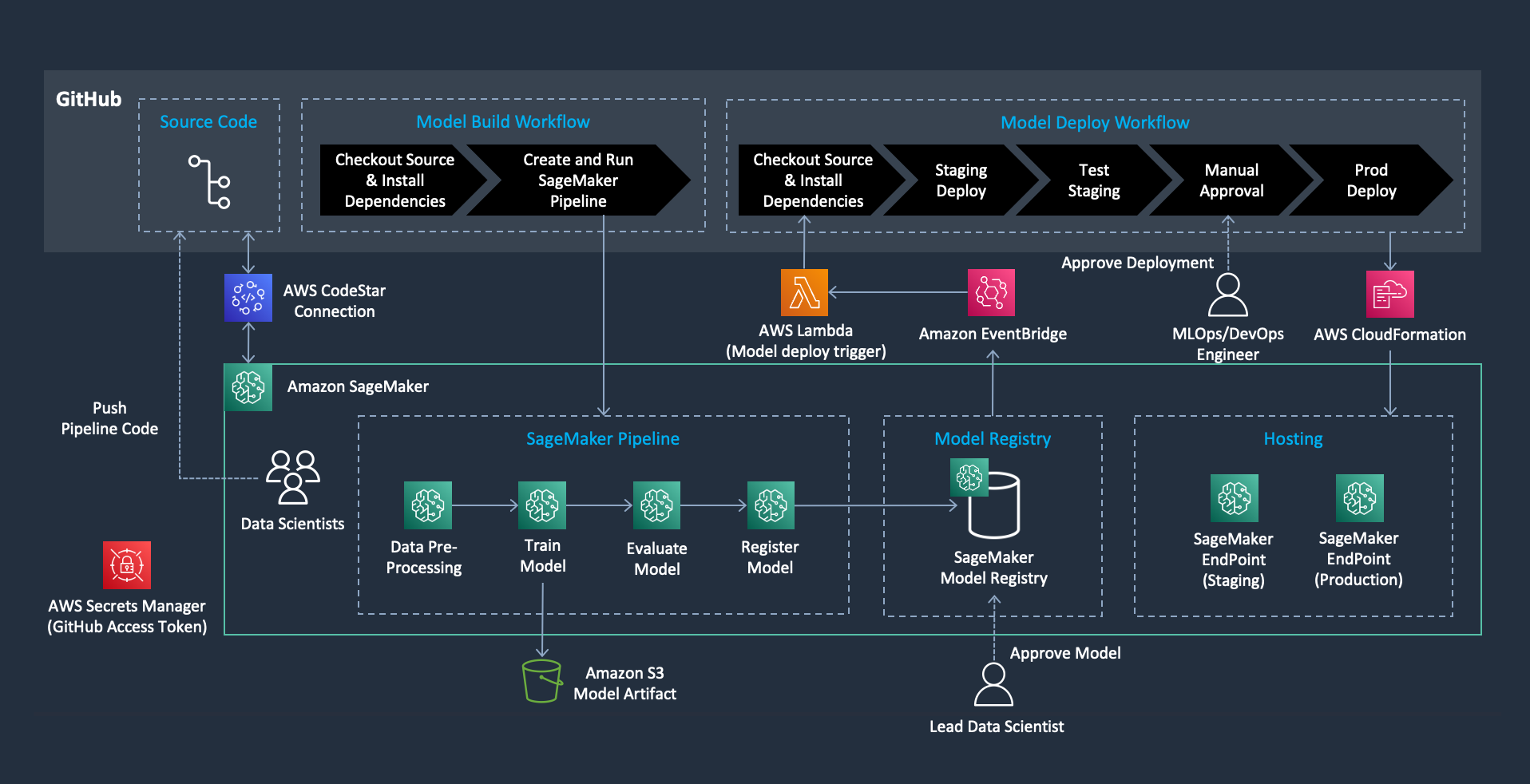

In questo post, costruiamo la seguente architettura. Creiamo una pipeline di creazione automatizzata del modello che include passaggi per la preparazione dei dati, l'addestramento del modello, la valutazione del modello e la registrazione del modello addestrato nel registro dei modelli SageMaker. Il modello ML addestrato risultante viene quindi distribuito dal registro dei modelli SageMaker agli ambienti di staging e di produzione previa approvazione manuale.

Approfondiamo gli elementi di questa architettura per comprendere la configurazione completa.

GitHub e azioni GitHub

GitHub è una piattaforma basata sul Web che fornisce il controllo della versione e la gestione del codice sorgente tramite Git. Consente ai team di collaborare su progetti di sviluppo software, tenere traccia delle modifiche e gestire repository di codici. GitHub funge da posizione centralizzata per archiviare, creare versioni e gestire la tua codebase ML. Ciò garantisce che la codebase e le pipeline ML siano dotate di versione, documentate e accessibili ai membri del team.

Azioni GitHub è un potente strumento di automazione all'interno dell'ecosistema GitHub. Ti consente di creare flussi di lavoro personalizzati che automatizzano i processi del ciclo di vita dello sviluppo software, come la creazione, il test e la distribuzione del codice. Puoi creare flussi di lavoro basati su eventi attivati da eventi specifici, come quando il codice viene inviato a un repository o viene creata una richiesta pull. Quando implementi MLOps, puoi utilizzare GitHub Actions per automatizzare varie fasi della pipeline ML, come:

- Convalida e preelaborazione dei dati

- Formazione e valutazione del modello

- Distribuzione e monitoraggio del modello

- CI/CD per i modelli ML

Con GitHub Actions puoi semplificare i flussi di lavoro ML e garantire che i tuoi modelli siano creati, testati e distribuiti in modo coerente, portando a distribuzioni ML più efficienti e affidabili.

Nelle sezioni seguenti inizieremo impostando i prerequisiti relativi ad alcuni dei componenti che utilizziamo come parte di questa architettura:

- AWS CloudFormazione - AWS CloudFormazione avvia la distribuzione del modello e stabilisce gli endpoint SageMaker dopo l'attivazione della pipeline di distribuzione del modello mediante l'approvazione del modello addestrato.

- Connessione AWS CodeStar - Noi usiamo AWS Code Star per stabilire un collegamento con il repository GitHub e utilizzarlo come integrazione del repository di codice con le risorse AWS, come SageMaker Studio.

- Amazon EventBridge - Amazon EventBridge tiene traccia di tutte le modifiche al registro del modello. Mantiene inoltre una regola che richiede alla funzione Lambda di distribuire la pipeline del modello quando lo stato della versione del pacchetto del modello cambia da

PendingManualApprovalaApprovedall'interno del registro dei modelli. - AWS Lambda – Usiamo un AWS Lambda funzione per avviare il flusso di lavoro di distribuzione del modello in GitHub Actions dopo che un nuovo modello è stato registrato nel registro del modello.

- Amazon Sage Maker – Configuriamo i seguenti componenti SageMaker:

- Tubatura - Questo componente è costituito da un grafico aciclico diretto (DAG) che ci aiuta a creare il flusso di lavoro ML automatizzato per le fasi di preparazione dei dati, addestramento del modello e valutazione del modello. Il registro del modello conserva i record delle versioni del modello, degli artefatti, della derivazione e dei metadati associati. Viene stabilito un gruppo di pacchetti modello che ospita tutte le versioni del modello correlate. Il registro del modello è inoltre responsabile della gestione dello stato di approvazione della versione del modello per la successiva distribuzione.

- endpoint – Questo componente configura due endpoint in tempo reale HTTPS per l'inferenza. La configurazione dell'hosting può essere modificata, ad esempio, per la trasformazione batch o l'inferenza asincrona. L'endpoint di gestione temporanea viene generato quando la pipeline di distribuzione del modello viene attivata mediante l'approvazione del modello addestrato dal registro dei modelli SageMaker. Questo endpoint viene utilizzato per convalidare il modello distribuito garantendo che fornisca previsioni che soddisfino i nostri standard di accuratezza. Quando il modello viene preparato per la distribuzione in produzione, un endpoint di produzione viene distribuito tramite una fase di approvazione manuale nel flusso di lavoro GitHub Actions.

- Codice del repository – Questo crea un repository Git come risorsa nel tuo account SageMaker. Utilizzando i dati esistenti dal repository del codice GitHub immessi durante la creazione del tuo progetto SageMaker, viene stabilita un'associazione con lo stesso repository in SageMaker quando avvii il progetto. Ciò forma essenzialmente un collegamento con un repository GitHub in SageMaker, consentendo azioni interattive (pull/push) con il tuo repository.

- Registro dei modelli – Questo monitora le varie versioni del modello e gli artefatti corrispondenti, che includono derivazione e metadati. Una raccolta conosciuta come a gruppo pacchetto modello viene creato, ospitando le versioni correlate del modello. Inoltre, il registro del modello supervisiona lo stato di approvazione della versione del modello, garantendone la disponibilità per la successiva implementazione.

- AWS Secrets Manager – Per preservare in modo sicuro il token di accesso personale GitHub, è necessario stabilire un segreto in AWS Secrets Manager e ospita al suo interno il tuo token di accesso.

- Catalogo dei servizi AWS - Noi usiamo il Catalogo dei servizi AWS per l'implementazione di progetti SageMaker, che includono componenti come un repository di codice SageMaker, una funzione Lambda, una regola EventBridge, un bucket S3 degli artefatti, ecc., tutti implementati tramite CloudFormation. Ciò consente alla tua organizzazione di utilizzare ripetutamente i modelli di progetto, assegnare progetti a ciascun utente e semplificare le operazioni.

- Amazon S3 – Usiamo un Servizio di archiviazione semplice Amazon (Amazon S3) per conservare gli artefatti del modello prodotti dalla pipeline.

Prerequisiti

Dovresti avere i seguenti prerequisiti:

È inoltre necessario completare ulteriori passaggi di configurazione prima di implementare la soluzione.

Configura una connessione AWS CodeStar

Se non disponi già di una connessione AWS CodeStar al tuo account GitHub, fai riferimento a Crea una connessione a GitHub per istruzioni su come crearne uno. L'ARN della connessione AWS CodeStar sarà simile al seguente:

In questo esempio, aEXAMPLE-8aad-4d5d-8878-dfcab0bc441f è l'ID univoco per questa connessione. Utilizziamo questo ID quando creiamo il nostro progetto SageMaker più avanti in questo esempio.

Configura chiavi di accesso segrete per il tuo token GitHub

Per archiviare in modo sicuro il token di accesso personale GitHub, devi creare un segreto in Secrets Manager. Se non disponi di un token di accesso personale per GitHub, fai riferimento a Gestire i tuoi token di accesso personali per le istruzioni per crearne uno.

È possibile creare un token di accesso classico o a grana fine. Assicurati tuttavia che il token abbia accesso ai contenuti e alle azioni del repository (flussi di lavoro, esecuzioni e artefatti).

Completa i seguenti passaggi per archiviare il token in Secrets Manager:

- Nella console di Secrets Manager, selezionare Memorizza un nuovo segreto.

- Seleziona Altro tipo di segreto per Scegli il tipo di segreto.

- Fornisci un nome per il tuo segreto nel file Le e aggiungi il tuo token di accesso personale al campo corrispondente Valore campo.

- Scegli Avanti, inserisci un nome per il tuo segreto e scegli Avanti nuovamente.

- Scegli Negozio per salvare il tuo segreto.

Memorizzando il tuo token di accesso personale GitHub in Secrets Manager, puoi accedervi in modo sicuro all'interno della tua pipeline MLOps garantendone la riservatezza.

Crea un utente IAM per le azioni GitHub

Per consentire a GitHub Actions di distribuire endpoint SageMaker nel tuo ambiente AWS, devi creare un file Gestione dell'identità e dell'accesso di AWS (IAM) e concedergli le autorizzazioni necessarie. Per istruzioni, fare riferimento a Creazione di un utente IAM nel tuo account AWS. Usa il iam/GithubActionsMLOpsExecutionPolicy.json file (fornito nel file esempio di codice) per fornire autorizzazioni sufficienti affinché questo utente possa distribuire i tuoi endpoint.

Dopo aver creato l'utente IAM, generare una chiave di accesso. Utilizzerai questa chiave, che consiste sia di un ID chiave di accesso che di una chiave di accesso segreta, nel passaggio successivo durante la configurazione dei segreti GitHub.

Configura il tuo account GitHub

Di seguito sono riportati i passaggi per preparare il tuo account GitHub per eseguire questo esempio.

Clona il repository GitHub

Puoi riutilizzare un repository GitHub esistente per questo esempio. Tuttavia, è più semplice se crei un nuovo repository. Questo repository conterrà tutto il codice sorgente sia per le build che per le distribuzioni della pipeline SageMaker.

Copia il contenuto della directory del codice seed nella radice del tuo repository GitHub. Ad esempio, il .github la directory dovrebbe trovarsi nella radice del repository GitHub.

Crea un segreto GitHub contenente la chiave di accesso utente IAM

In questo passaggio memorizziamo i dettagli della chiave di accesso dell'utente appena creato nel ns Segreto di GitHub.

- Sul sito Web GitHub, vai al tuo repository e scegli Impostazioni profilo.

- Nella sezione sicurezza, seleziona Segreti e variabili e scegli Azioni.

- Scegli Nuovo segreto del repository.

- Nel Nome, accedere

AWS_ACCESS_KEY_ID - Nel Segreto, inserisci l'ID della chiave di accesso associato all'utente IAM creato in precedenza.

- Scegli Aggiungi segreto.

- Ripetere la stessa procedura per

AWS_SECRET_ACCESS_KEY

Configura i tuoi ambienti GitHub

Per creare una fase di approvazione manuale nelle nostre pipeline di distribuzione, utilizziamo a Ambiente GitHub. Completa i seguenti passaggi:

- Passare alla Impostazioni profilo, Ambienti menu del tuo repository GitHub e crea un nuovo ambiente chiamato production.

- Nel Norme per la tutela dell'ambiente, selezionare Revisori obbligatori.

- Aggiungi i nomi utente GitHub desiderati come revisori. Per questo esempio, puoi scegliere il tuo nome utente.

Tieni presente che la funzionalità dell'ambiente non è disponibile in alcuni tipi di piani GitHub. Per ulteriori informazioni, fare riferimento a Utilizzo degli ambienti per la distribuzione.

Distribuisci la funzione Lambda

Nei passaggi successivi, comprimiamo lambda_function.py in un file .zip, che viene poi caricato in un bucket S3.

L'esempio di codice rilevante per questo può essere trovato di seguito Repository GitHub. In particolare, il lambda_function.py si trova nel lambda_functions/lambda_github_workflow_trigger directory.

Si consiglia di creare un fork del codice di esempio e clonarlo. Ciò ti darà la libertà di modificare il codice e sperimentare diversi aspetti dell'esempio.

- Dopo aver ottenuto una copia del codice, accedere alla directory appropriata e utilizzare il file

zipcomando per comprimerelambda_function.py. Sia gli utenti Windows che quelli MacOS possono utilizzare il proprio sistema di gestione file nativo, rispettivamente Esplora file o Finder, per generare un file .zip.

- Carica il

lambda-github-workflow-trigger.zipa un secchio S3.

Questo bucket sarà successivamente accessibile dal Catalogo dei servizi. Puoi scegliere qualsiasi bucket a cui hai accesso, purché Service Catalog sia in grado di recuperare i dati da esso nei passaggi successivi.

Da questo passaggio in poi, è necessario che AWS CLI v2 sia installato e configurato. Un'alternativa potrebbe essere quella di utilizzare AWS CloudShell, che viene fornito con tutti gli strumenti necessari preinstallati, eliminando la necessità di configurazioni aggiuntive.

- Per caricare il file nel bucket S3, utilizza il seguente comando:

Ora costruiamo un layer Lambda per le dipendenze relative a lambda_function abbiamo appena caricato.

- Configura un ambiente virtuale Python e installa le dipendenze:

- Genera il file .zip con i seguenti comandi:

- Pubblica il livello su AWS:

Con questo livello pubblicato, tutte le funzioni Lambda possono ora farvi riferimento per soddisfare le proprie dipendenze. Per una comprensione più dettagliata dei livelli Lambda, fare riferimento a Lavorare con i livelli Lambda.

Crea un modello di progetto personalizzato in SageMaker

Dopo aver completato tutti i passaggi precedenti, disponiamo di tutte le risorse e i componenti della pipeline CI/CD. Successivamente dimostreremo come possiamo rendere queste risorse disponibili come progetto personalizzato all'interno di SageMaker Studio accessibile tramite la distribuzione con un clic.

Come discusso in precedenza, quando i modelli forniti da SageMaker non soddisfano le tue esigenze (ad esempio, desideri avere un'orchestrazione più complessa in CodePipeline con più fasi, passaggi di approvazione personalizzati o integrare con uno strumento di terze parti come GitHub e le azioni GitHub dimostrato in questo post), puoi creare i tuoi modelli. Ti consigliamo di iniziare con i modelli forniti da SageMaker per capire come organizzare il codice e le risorse e costruire su di essi. Per ulteriori dettagli, fare riferimento a Crea modelli di progetto personalizzati.

Tieni presente che puoi anche automatizzare questo passaggio e utilizzare invece CloudFormation per distribuire il portafoglio e il prodotto del catalogo dei servizi tramite codice. In questo post, tuttavia, per una maggiore esperienza di apprendimento, ti mostriamo la distribuzione della console.

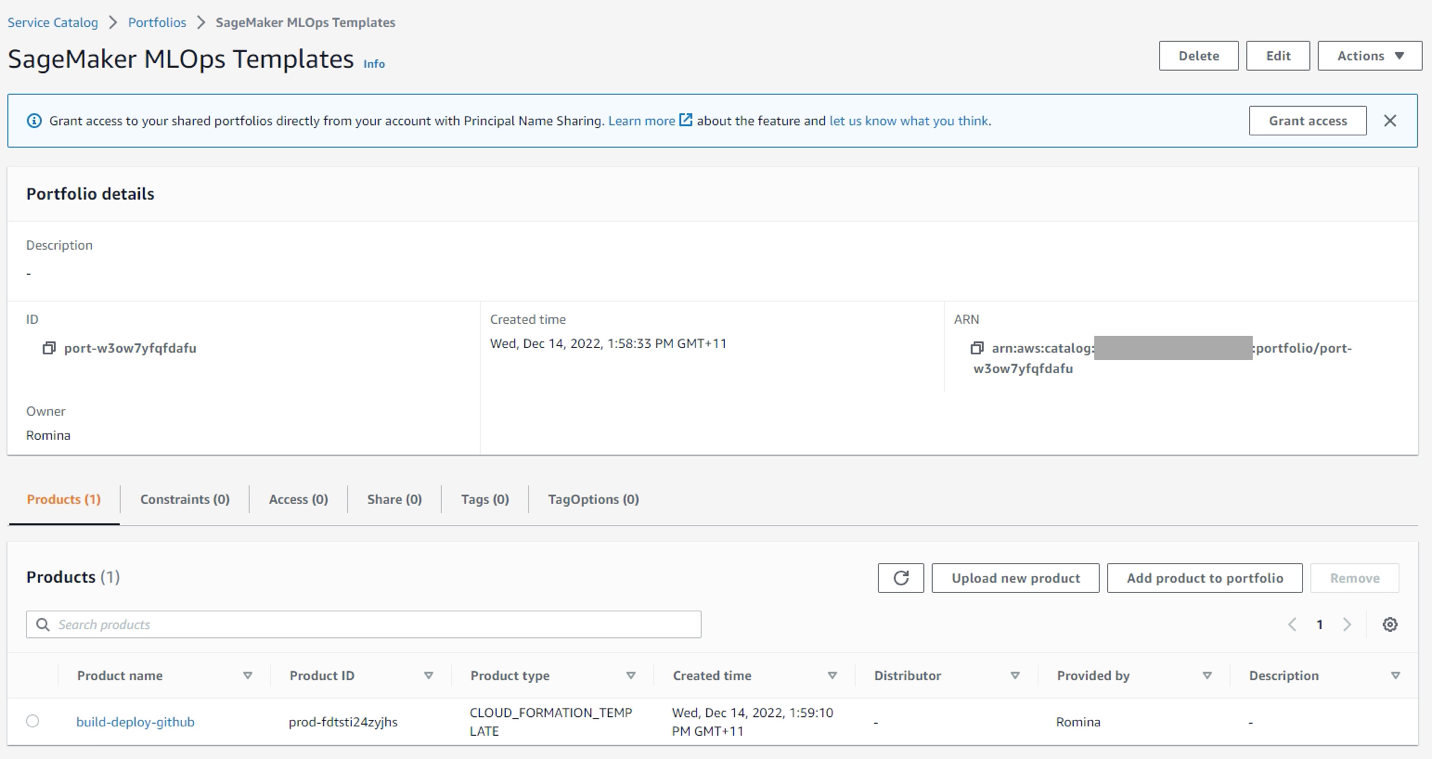

In questa fase, utilizziamo il modello CloudFormation fornito per creare un portfolio del catalogo dei servizi che ci aiuta a creare progetti personalizzati in SageMaker.

Puoi creare un nuovo dominio o riutilizzare il tuo dominio SageMaker per i seguenti passaggi. Se non hai un dominio, fai riferimento a Onboarding nel dominio Amazon SageMaker utilizzando la configurazione rapida per le istruzioni di configurazione.

Dopo aver abilitato l'accesso come amministratore ai modelli SageMaker, completa i seguenti passaggi:

- Nella console del Catalogo dei servizi, sotto Amministrazione nel pannello di navigazione, scegli portafogli.

- Scegli Crea un nuovo portafoglio.

- Assegna un nome al portfolio "Modelli di organizzazione SageMaker".

- Scarica la modello.yml file sul tuo computer.

Questo modello Cloud Formation fornisce tutte le risorse CI/CD di cui abbiamo bisogno come configurazione e infrastruttura come codice. Puoi studiare il modello in modo più dettagliato per vedere quali risorse vengono distribuite come parte di esso. Questo modello è stato personalizzato per l'integrazione con GitHub e GitHub Actions.

- Nel

template.ymlfile, cambia ilS3Bucketvalore nel tuo bucket in cui hai caricato il file Lambda .zip:

- Scegli il nuovo portafoglio.

- Scegli Carica un nuovo prodotto.

- Nel Nome prodotto¸ inserisci un nome per il tuo modello. Usiamo il nome

build-deploy-github. - Nel Descrizione, inserisci una descrizione.

- Nel Proprietario, Inserisci il tuo nome.

- Sotto Dettagli della versione, Per metodoscegli Usa un file modello.

- Scegli Carica un modello.

- Carica il modello che hai scaricato.

- Nel Titolo della versionescegli 1.0.

- Scegli Review.

- Rivedi le tue impostazioni e scegli Crea prodotto.

- Scegli ricaricare per elencare il nuovo prodotto.

- Scegli il prodotto che hai appena creato.

- Sulla tag scheda, aggiungi il seguente tag al prodotto:

- Le =

sagemaker:studio-visibility - Valore =

true

- Le =

Tornando ai dettagli del portafoglio, dovresti vedere qualcosa di simile allo screenshot seguente (con ID diversi).

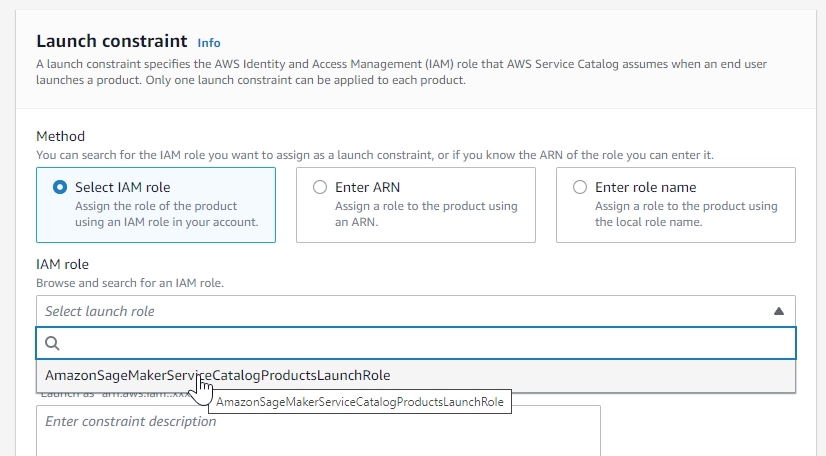

- Sulla vincoli scheda, scegliere Crea vincolo.

- Nel Prodottoscegli

build-deploy-github(il prodotto che hai appena creato). - Nel costrizione digita, scegli Lancio.

- Sotto Vincolo di lancio, Per metodoscegli Seleziona il ruolo IAM.

- Scegli

AmazonSageMakerServiceCatalogProductsLaunchRole. - Scegli Creare.

- Sulla Gruppi, ruoli e utenti scheda, scegliere Aggiungi gruppi, ruoli, utenti.

- Sulla Ruoli scheda, seleziona il ruolo che hai utilizzato durante la configurazione del tuo dominio SageMaker Studio. Qui è dove puoi trovare il ruolo del dominio SageMaker.

- Scegli Aggiungi accesso.

Distribuisci il progetto da SageMaker Studio

Nelle sezioni precedenti hai preparato l'ambiente di progetto MLOps personalizzato. Ora creiamo un progetto utilizzando questo modello:

- Nella console SageMaker, vai al dominio in cui desideri creare questo progetto.

- Sulla Lancio menù, scegliere Studio.

Verrai reindirizzato all'ambiente SageMaker Studio.

- In SageMaker Studio, nel riquadro di navigazione sotto Distribuzioniscegli Progetti.

- Scegli Crea progetto.

- Nella parte superiore dell'elenco dei modelli, scegli Modelli di organizzazione.

Se hai eseguito correttamente tutti i passaggi precedenti, dovresti essere in grado di vedere un nuovo modello di progetto personalizzato denominato Build-Deploy-GitHub.

- Seleziona quel modello e scegli Seleziona modello di progetto.

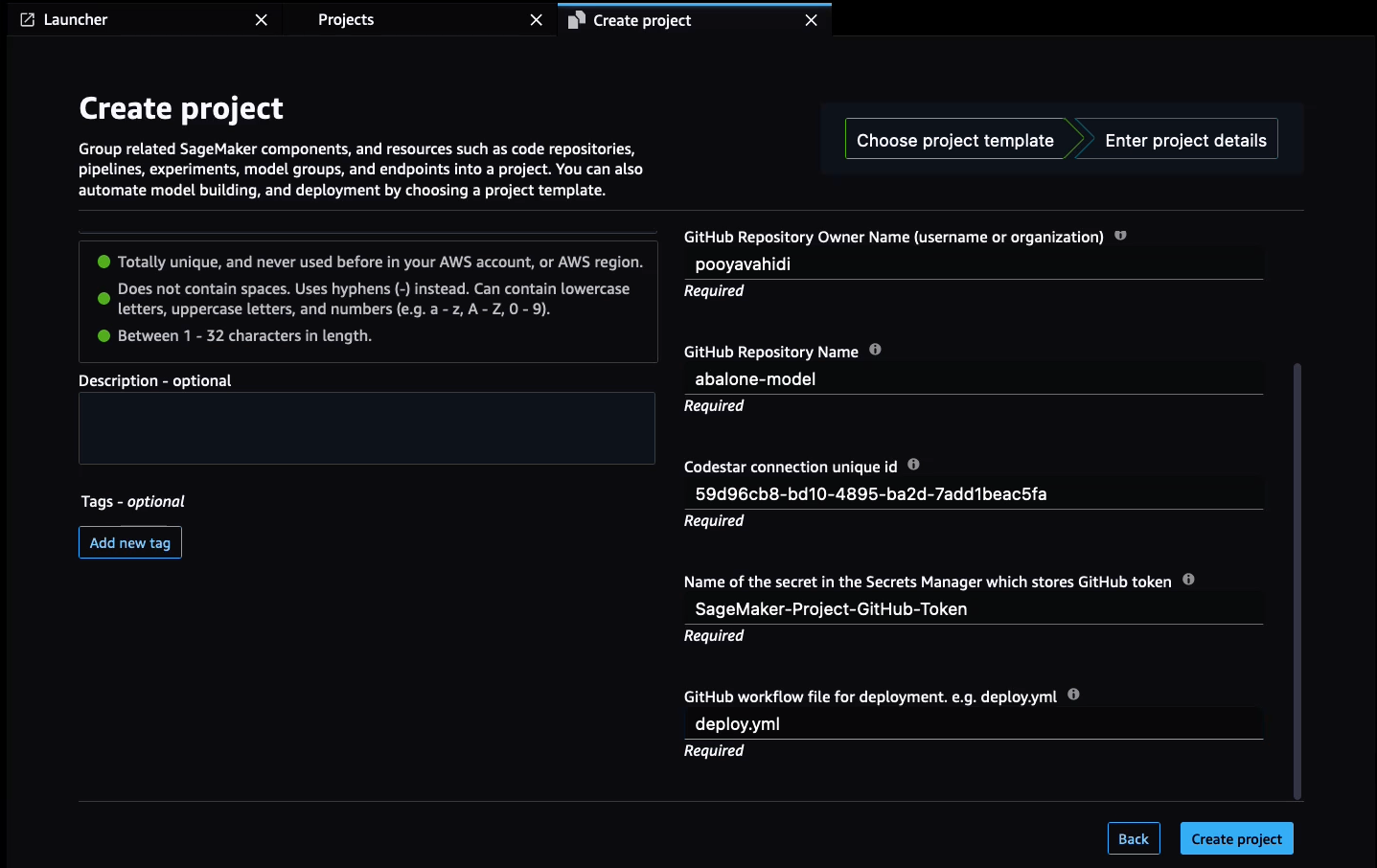

- Inserisci una descrizione facoltativa.

- Nel Nome del proprietario del repository GitHub, inserisci il proprietario del tuo repository GitHub. Ad esempio, se il tuo repository è su

https://github.com/pooyavahidi/my-repo, il proprietario sarebbepooyavahidi. - Nel Nome del repository GitHub, inserisci il nome del repository in cui hai copiato il codice seed. Sarebbe solo il nome del repository. Ad esempio, nel

https://github.com/pooyavahidi/my-repo, il pronti contro termine èmy-repo. - Nel ID univoco della connessione Codestar, inserisci l'ID univoco della connessione AWS CodeStar che hai creato.

- Nel Nome del segreto nel Secrets Manager che memorizza il token GitHub, inserisci il nome del segreto in Secrets Manager in cui hai creato e archiviato il token GitHub.

- Nel File del flusso di lavoro GitHub per la distribuzione, inserisci il nome del file del flusso di lavoro GitHub (at

.github/workflows/deploy.yml) dove sono disponibili le istruzioni per la distribuzione. Per questo esempio, puoi mantenerlo come predefinito, ovverodeploy.yml. - Scegli Crea progetto.

- Dopo aver creato il tuo progetto, assicurati di aggiornare il file

AWS_REGIONedSAGEMAKER_PROJECT_NAMEdi conseguenza le variabili di ambiente nei file del flusso di lavoro GitHub. I file del flusso di lavoro si trovano nel repository GitHub (copiati dal codice seed), all'interno del file.github/workflowsdirectory. Assicurati di aggiornare entrambibuild.ymleddeploy.ymlFile.

Ora il tuo ambiente è pronto! Puoi eseguire direttamente le pipeline, apportare modifiche e inviarle al repository GitHub per attivare la pipeline di creazione automatizzata e vedere come tutte le fasi di creazione e distribuzione sono automatizzate.

ripulire

Per pulire le risorse, completare i seguenti passaggi:

- Elimina gli stack CloudFormation utilizzati per il progetto SageMaker e gli endpoint SageMaker.

- Elimina il dominio SageMaker.

- Elimina le risorse del catalogo dei servizi.

- Elimina il collegamento di connessione AWS CodeStar con il repository GitHub.

- Elimina l'utente IAM che hai creato per GitHub Actions.

- Elimina il segreto in Secrets Manager che memorizza i dettagli di accesso personale di GitHub.

Sommario

In questo post, abbiamo esaminato il processo di utilizzo di un modello di progetto SageMaker MLOps personalizzato per costruire e organizzare automaticamente una pipeline CI/CD. Questa pipeline integra in modo efficace i meccanismi CI/CD esistenti con le funzionalità SageMaker per la manipolazione dei dati, l'addestramento dei modelli, l'approvazione e l'implementazione dei modelli. Nel nostro scenario, ci siamo concentrati sull'integrazione di GitHub Actions con progetti e pipeline SageMaker. Per una comprensione completa dei dettagli di implementazione, visitare il Repository GitHub. Sentiti libero di sperimentare questo e non esitare a lasciare qualsiasi domanda tu possa avere nella sezione commenti.

Informazioni sugli autori

Dott.ssa Romina Sharifpour è un architetto senior di soluzioni di machine learning e intelligenza artificiale presso Amazon Web Services (AWS). Ha trascorso oltre 10 anni alla guida della progettazione e dell'implementazione di soluzioni end-to-end innovative rese possibili dai progressi nel machine learning e nell'intelligenza artificiale. Le aree di interesse di Romina sono l'elaborazione del linguaggio naturale, i modelli linguistici di grandi dimensioni e MLOps.

Dott.ssa Romina Sharifpour è un architetto senior di soluzioni di machine learning e intelligenza artificiale presso Amazon Web Services (AWS). Ha trascorso oltre 10 anni alla guida della progettazione e dell'implementazione di soluzioni end-to-end innovative rese possibili dai progressi nel machine learning e nell'intelligenza artificiale. Le aree di interesse di Romina sono l'elaborazione del linguaggio naturale, i modelli linguistici di grandi dimensioni e MLOps.

Pooya Vahidi è un Senior Solutions Architect presso AWS, appassionato di informatica, intelligenza artificiale e cloud computing. In qualità di professionista dell'intelligenza artificiale, è un membro attivo del team AWS AI/ML Area-of-Depth. Con un background di oltre vent'anni di esperienza nella guida dell'architettura e dell'ingegneria di soluzioni su larga scala, aiuta i clienti nei loro percorsi di trasformazione attraverso le tecnologie cloud e AI/ML.

Pooya Vahidi è un Senior Solutions Architect presso AWS, appassionato di informatica, intelligenza artificiale e cloud computing. In qualità di professionista dell'intelligenza artificiale, è un membro attivo del team AWS AI/ML Area-of-Depth. Con un background di oltre vent'anni di esperienza nella guida dell'architettura e dell'ingegneria di soluzioni su larga scala, aiuta i clienti nei loro percorsi di trasformazione attraverso le tecnologie cloud e AI/ML.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-an-end-to-end-mlops-pipeline-using-amazon-sagemaker-pipelines-github-and-github-actions/

- :ha

- :È

- :non

- :Dove

- $ SU

- 10

- 100

- 114

- 14

- 20

- 28

- 7

- 8

- 9

- a

- capace

- WRI

- sopra

- accelerare

- accesso

- accessibile

- accessibile

- di conseguenza

- Il mio account

- precisione

- Raggiungere

- operanti in

- azioni

- attivo

- aciclico

- aggiungere

- aggiuntivo

- Rettificato

- adottare

- avanzamenti

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- AI

- AI / ML

- Tutti

- assegnare

- consentire

- consente

- già

- anche

- alternativa

- Amazon

- Amazon Sage Maker

- Pipeline di Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- ed

- e infrastruttura

- in qualsiasi

- opportuno

- approvazione

- architettura

- SONO

- aree

- artificiale

- intelligenza artificiale

- AS

- aspetti

- associato

- Associazione

- At

- automatizzare

- Automatizzata

- automaticamente

- Automatizzare

- Automazione

- disponibile

- AWS

- sfondo

- base

- BE

- stato

- prima

- entrambi

- costruire

- Costruzione

- costruisce

- costruito

- incassato

- by

- detto

- Materiale

- funzionalità

- catalogo

- CD

- centralizzata

- il cambiamento

- Modifiche

- Scegli

- classico

- cavedano

- clicca

- Cloud

- il cloud computing

- codice

- base del codice

- collaboreranno

- collaborazione

- collezione

- viene

- Commenti

- completamento di una

- completamento

- complesso

- componente

- componenti

- globale

- computer

- Informatica

- informatica

- riservatezza

- Configurazione

- configurato

- configurazione

- veloce

- considerando

- costantemente

- consiste

- consolle

- costruire

- contenere

- testuali

- continuo

- di controllo

- Corrispondente

- creare

- creato

- crea

- Creazione

- creazione

- costume

- Clienti

- personalizzate

- GIORNO

- dati

- Preparazione dei dati

- scienza dei dati

- decenni

- Predefinito

- consegnare

- consegna

- scavare

- richieste

- dimostrare

- dimostrato

- dipendenze

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- descrizione

- Design

- desiderato

- dettaglio

- dettagliati

- dettagli

- Mercato

- diverso

- indirizzato

- direttamente

- discusso

- do

- dominio

- Dont

- durante

- ogni

- In precedenza

- più facile

- ecosistema

- Efficace

- in maniera efficace

- efficiente

- in modo efficiente

- o

- elementi

- eliminando

- enable

- abilitato

- Abilita

- consentendo

- da un capo all'altro

- endpoint

- Ingegneria

- Ingegneri

- garantire

- assicura

- assicurando

- entrare

- Impresa

- Intero

- Ambiente

- ambienti

- essenzialmente

- stabilire

- sviluppate

- stabilisce

- stabilimento

- eccetera

- valutazione

- eventi

- esempio

- esistente

- esperienza

- esperimento

- competenza

- esploratore

- facilitando

- caratteristica

- Caratteristiche

- sentire

- campo

- Compila il

- File

- Finder

- Focus

- concentrato

- i seguenti

- Nel

- forcella

- formazione

- forme

- essere trovato

- Gratis

- La libertà

- da

- function

- funzioni

- generare

- generato

- ottenere

- Idiota

- GitHub

- Dare

- andando

- andato

- concedere

- grafico

- maggiore

- Gruppo

- Gruppo

- Avere

- he

- pesante

- sollevamento pesante

- aiuta

- di hosting

- Casa

- case

- alloggiamento

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- ID

- Identità

- ids

- if

- implementazione

- implementato

- Implementazione

- in

- includere

- inclusi

- Compreso

- informazioni

- Infrastruttura

- avviare

- iniziati

- creativi e originali

- ingresso

- interno

- install

- installato

- esempio

- invece

- istruzioni

- integrare

- Integra

- Integrazione

- integrazione

- Intelligence

- interattivo

- interesse

- ai miglioramenti

- Introduce

- da solo

- IT

- SUO

- Journeys

- jpg

- json

- ad appena

- mantenere

- continua

- Le

- Tasti

- conosciuto

- Lingua

- grandi

- larga scala

- dopo

- lanciare

- strato

- galline ovaiole

- principale

- apprendimento

- Lasciare

- ciclo di vita

- di sollevamento

- piace

- lignaggio

- LINK

- Lista

- collocato

- località

- Lunghi

- Guarda

- una

- macchina

- machine learning

- macos

- mantiene

- manutenzione

- make

- gestire

- gestito

- gestione

- direttore

- gestione

- Manipolazione

- Manuale

- molti

- meccanismi di

- Soddisfare

- membro

- Utenti

- Menu

- Metadati

- forza

- CON

- ML

- MLOp

- modello

- modelli

- modifiche

- modificare

- monitoraggio

- monitor

- Scopri di più

- più efficiente

- Inoltre

- multiplo

- devono obbligatoriamente:

- Nome

- Detto

- nomi

- nativo

- Naturale

- Elaborazione del linguaggio naturale

- Navigare

- Navigazione

- necessaria

- risulta necessario per

- Bisogno

- esigenze

- New

- nuovo prodotto

- recentemente

- GENERAZIONE

- adesso

- ottenere

- of

- offerta

- on

- ONE

- avanti

- operare

- Operazioni

- or

- orchestrazione

- organizzazione

- organizzazioni

- Altro

- nostro

- ancora

- panoramica

- proprio

- proprietario

- pacchetto

- vetro

- parità

- parte

- partito

- appassionato

- permessi

- cronologia

- conduttura

- piani

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- lavori

- Post

- potente

- pratiche

- Previsioni

- preparazione

- Preparare

- preparato

- prerequisiti

- precedente

- procedura

- processi

- i processi

- lavorazione

- Prodotto

- Prodotto

- Produzione

- professionale

- progetto

- progetti

- istruzioni

- protezione

- fornire

- purché

- fornisce

- pubblicato

- Spingi

- spinto

- Python

- query

- Presto

- prontezza

- pronto

- tempo reale

- raccomandare

- raccomandato

- record

- riferimento

- riferimento

- riflettere

- registrato

- Iscrizione

- registro

- relazionato

- pertinente

- affidabile

- rimuovere

- RIPETUTAMENTE

- deposito

- richiesta

- richiedere

- Requisiti

- riparazioni

- risorsa

- Risorse

- rispettivamente

- responsabile

- risultante

- riutilizzare

- destra

- robusto

- Ruolo

- ruoli

- radice

- Regola

- Correre

- corre

- sagemaker

- Pipeline SageMaker

- stesso

- Risparmi

- Scalabilità

- scala

- scenario

- Scenari

- Scienze

- scienziati

- Segreto

- segreti

- Sezione

- sezioni

- in modo sicuro

- problemi di

- vedere

- seme

- select

- anziano

- serve

- servizio

- Servizi

- Set

- regolazione

- impostazioni

- flessibile.

- alcuni

- lei

- dovrebbero

- mostrare attraverso le sue creazioni

- simile

- Un'espansione

- semplificata

- semplificando

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- alcuni

- qualcosa

- Fonte

- codice sorgente

- tensione

- specifico

- in particolare

- esaurito

- Stacks

- STAFF

- Stage

- tappe

- messa in scena

- standard

- inizia a

- Di partenza

- Stato dei servizi

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- negozi

- memorizzare

- lineare

- snellire

- razionalizzazione

- studio

- Studio

- successivo

- Con successo

- tale

- sufficiente

- suite

- sicuro

- sistema

- SISTEMI DI TRATTAMENTO

- TAG

- team

- Membri del team

- le squadre

- Tecnologie

- modello

- modelli

- testato

- Testing

- che

- Il

- L’ORIGINE

- loro

- poi

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Terza

- di parti terze standard

- questo

- quelli

- Attraverso

- per tutto

- a

- insieme

- token

- strumenti

- top

- pista

- Tracking

- allenato

- Training

- Trasformare

- trasformativa

- innescare

- innescato

- seconda

- Digitare

- Tipi di

- per

- capire

- e una comprensione reciproca

- unico

- Aggiornanento

- caricato

- su

- us

- uso

- utilizzato

- Utente

- utenti

- utilizzando

- utilizzare

- utilizzati

- CONVALIDARE

- convalida

- APPREZZIAMO

- vario

- versione

- versioni

- via

- virtuale

- Visita

- camminava

- volere

- we

- sito web

- servizi web

- Web-basata

- Sito web

- Che

- quando

- quale

- while

- volere

- finestre

- con

- entro

- Lavora

- lavorare insieme

- flusso di lavoro

- flussi di lavoro

- sarebbe

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- Codice postale