Gli agenti di intelligenza artificiale generativa sono in grado di produrre risposte simili a quelle umane e impegnarsi in conversazioni in linguaggio naturale orchestrando una catena di chiamate a modelli di base (FM) e altri strumenti di potenziamento basati sull'input dell'utente. Invece di soddisfare solo intenti predefiniti attraverso un albero decisionale statico, gli agenti sono autonomi nel contesto della loro suite di strumenti disponibili. Roccia Amazzonica è un servizio completamente gestito che rende disponibili i principali FM delle aziende di intelligenza artificiale tramite un'API insieme a strumenti per sviluppatori per aiutare a creare e scalare applicazioni di intelligenza artificiale generativa.

In questo post, mostriamo come creare un agente di servizi finanziari con intelligenza artificiale generativa basato su Amazon Bedrock. L'agente può aiutare gli utenti a trovare le informazioni sul proprio account, a completare una richiesta di prestito o a rispondere a domande in linguaggio naturale, citando anche le fonti per le risposte fornite. Questa soluzione è destinata a fungere da trampolino di lancio per gli sviluppatori per creare i propri agenti conversazionali personalizzati per varie applicazioni, come lavoratori virtuali e sistemi di assistenza clienti. Il codice della soluzione e le risorse di distribuzione sono disponibili nel file Repository GitHub.

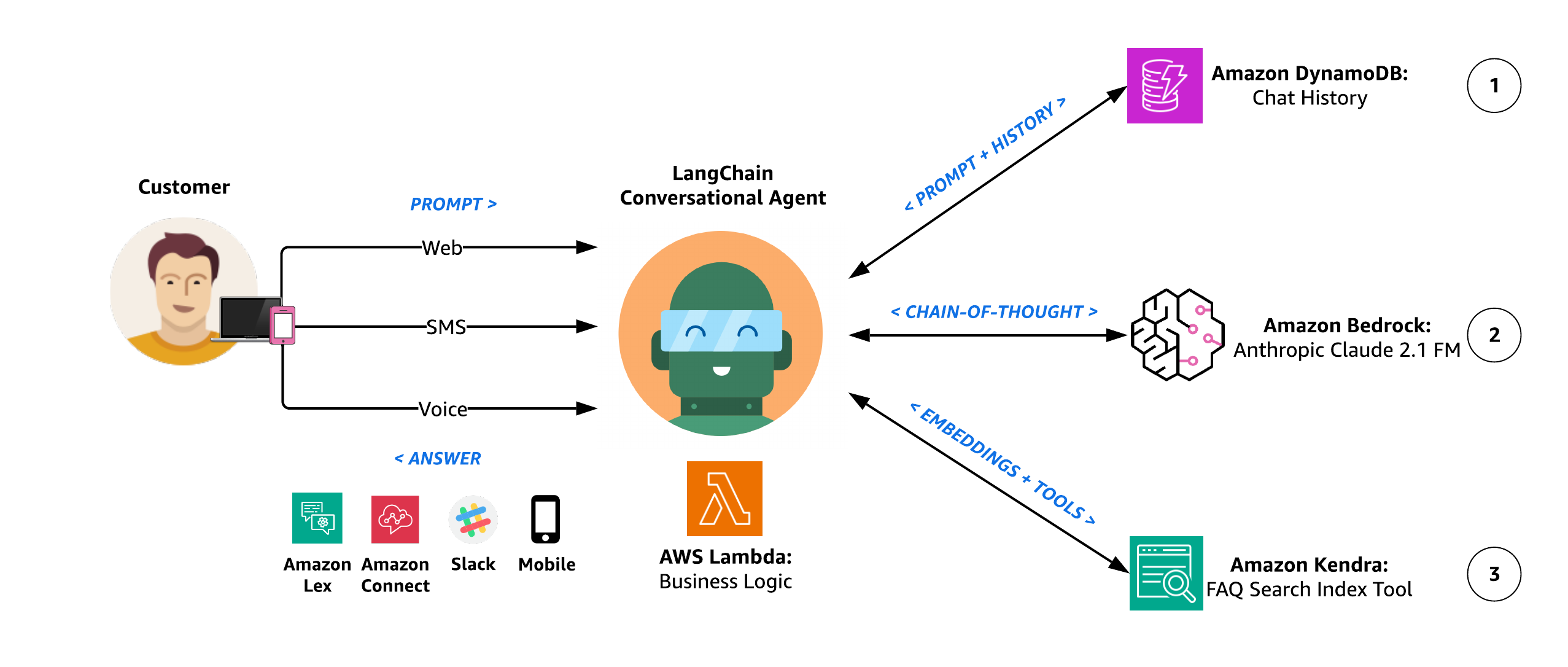

Amazon-Lex fornisce l'interfaccia per la comprensione del linguaggio naturale (NLU) e l'elaborazione del linguaggio naturale (NLP) per l'open source Agente conversazionale LangChain incorporato all'interno di un AWS Amplifica sito web. L'agente è dotato di strumenti che includono un FM Anthropic Claude 2.1 ospitato su Amazon Bedrock e dati sintetici dei clienti archiviati su Amazon DynamoDB ed Amazon Kendra per fornire le seguenti funzionalità:

- Fornire risposte personalizzate – Interroga DynamoDB per informazioni sul conto del cliente, come dettagli di riepilogo del mutuo, saldo dovuto e data di pagamento successivo

- Accedi alla conoscenza generale – Sfrutta la logica di ragionamento dell'agente insieme alle grandi quantità di dati utilizzati per pre-addestrare i diversi FM forniti tramite Amazon Bedrock per produrre risposte a qualsiasi richiesta del cliente

- Risposte precise e supponenti – Informare le risposte degli agenti utilizzando un indice Amazon Kendra configurato con origini dati autorevoli: documenti del cliente archiviati in Servizio di archiviazione semplice Amazon (Amazon S3) e Crawler web di Amazon Kendra configurato per il sito web del cliente

Panoramica della soluzione

Registrazione dimostrativa

La seguente registrazione demo evidenzia la funzionalità dell'agente e i dettagli dell'implementazione tecnica.

Architettura della soluzione

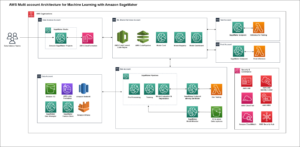

Il diagramma seguente illustra l'architettura della soluzione.

Il flusso di lavoro di risposta dell'agente include i seguenti passaggi:

- Gli utenti dialogano in linguaggio naturale con l'agente attraverso la scelta di canali web, SMS o vocali. Il canale web include un sito Web ospitato da Amplify con un chatbot incorporato di Amazon Lex per un cliente fittizio. I canali SMS e vocali possono essere opzionalmente configurati utilizzando Amazon Connect ed integrazioni di messaggistica per AmazonLex. Ogni richiesta dell'utente viene elaborata da Amazon Lex per determinare l'intento dell'utente attraverso un processo chiamato riconoscimento dell'intento, che prevede l'analisi e l'interpretazione dell'input dell'utente (testo o discorso) per comprendere l'azione o lo scopo previsto dall'utente.

- Amazon Lex invoca quindi un AWS Lambda gestore per il raggiungimento dell'intento dell'utente. La funzione Lambda associata al chatbot Amazon Lex contiene la logica e le regole aziendali necessarie per elaborare l'intento dell'utente. Lambda esegue azioni specifiche o recupera informazioni in base all'input dell'utente, prendendo decisioni e generando risposte appropriate.

- Lambda sfrutta la logica dell'agente dei servizi finanziari come un agente conversazionale LangChain in grado di accedere ai dati specifici del cliente archiviati su DynamoDB, curare risposte supponenti utilizzando i documenti e le pagine Web indicizzati da Amazon Kendra e fornire risposte di conoscenza generale tramite FM su Amazon Bedrock. Le risposte generate da Amazon Kendra includono l'attribuzione della fonte, dimostrando come è possibile fornire ulteriori informazioni contestuali all'agente Recupero generazione aumentata (STRACCIO). RAG ti consente di migliorare la capacità del tuo agente di generare risposte più accurate e contestualmente pertinenti utilizzando i tuoi dati.

Architettura dell'agente

Il diagramma seguente illustra l'architettura dell'agente.

Il flusso di lavoro del ragionamento dell'agente include i seguenti passaggi:

- L'agente conversazionale LangChain incorpora la memoria di conversazione in modo che possa rispondere a più query con generazione contestuale. Questa memoria consente all'agente di fornire risposte che tengono conto del contesto della conversazione in corso. Ciò si ottiene attraverso la generazione contestuale, in cui l'agente genera risposte pertinenti e contestualmente appropriate in base alle informazioni che ha ricordato dalla conversazione. In termini più semplici, l’agente ricorda ciò che è stato detto in precedenza e utilizza tali informazioni per rispondere a più domande in un modo che abbia senso nella discussione in corso. Il nostro agente utilizza Classe di cronologia dei messaggi di chat DynamoDB di LangChain come buffer di memoria della conversazione in modo che possa ricordare le interazioni passate e migliorare l'esperienza dell'utente con risposte più significative e consapevoli del contesto.

- L'agente utilizza Anthropic Claude 2.1 su Amazon Bedrock per completare l'attività desiderata attraverso una serie di input di testo attentamente autogenerati noti come istruzioni. L'obiettivo principale del prompt engineering è ottenere risposte specifiche e accurate dal FM. Diverse tecniche di ingegneria rapida includono:

- Colpo zero – Al modello viene presentata una singola domanda senza ulteriori indizi. Si prevede che il modello generi una risposta basata esclusivamente sulla domanda data.

- Pochi colpi – Una serie di domande di esempio e le relative risposte sono incluse prima della domanda vera e propria. Esponendo il modello a questi esempi, impara a rispondere in modo simile.

- Catena di pensieri – Uno stile specifico di suggerimento a poche inquadrature in cui il suggerimento è progettato per contenere una serie di passaggi intermedi di ragionamento, guidando il modello attraverso un processo di pensiero logico, che alla fine porta alla risposta desiderata.

Il nostro agente utilizza il ragionamento basato sulla catena di pensiero eseguendo una serie di azioni dopo aver ricevuto una richiesta. Dopo ogni azione, l'agente entra nella fase di osservazione, dove esprime un pensiero. Se non è ancora stata ottenuta una risposta finale, l'agente esegue un'iterazione, selezionando diverse azioni per procedere verso il raggiungimento della risposta finale. Vedere il seguente codice di esempio:

Pensiero: devo usare uno strumento? SÌ

Azione: l'azione da intraprendere

Input dell'azione: l'input dell'azione

Osservazione: il risultato dell'azione

Pensiero: devo usare uno strumento? NO

Agente FSI: [risposta e documenti di origine]

- Nell’ambito dei diversi percorsi di ragionamento e delle scelte di autovalutazione dell’agente per decidere la linea d’azione successiva, ha la capacità di accedere a fonti di dati sintetici sui clienti attraverso un Strumento di recupero indice Amazon Kendra. Utilizzando Amazon Kendra, l'agente esegue ricerche contestuali in un'ampia gamma di tipi di contenuti, inclusi documenti, domande frequenti, basi di conoscenza, manuali e siti Web. Per ulteriori dettagli sulle origini dati supportate, fare riferimento a Fonti dei dati. L'agente ha il potere di utilizzare questo strumento per fornire risposte supponenti ai prompt degli utenti a cui è necessario rispondere utilizzando una libreria di conoscenze autorevole fornita dal cliente, invece del corpus di conoscenze più generale utilizzato per pre-addestrare Amazon Bedrock FM.

Guida alla distribuzione

Nelle sezioni seguenti vengono discussi i passaggi chiave per distribuire la soluzione, incluse la pre-distribuzione e la post-distribuzione.

Pre-distribuzione

Prima di distribuire la soluzione, devi creare la tua versione biforcuta del repository della soluzione con un webhook protetto da token per automatizzare la distribuzione continua del tuo sito web Amplify. La configurazione di Amplify punta a un repository sorgente GitHub da cui viene creato il frontend del nostro sito web.

Forchetta e clona generative-ai-amazon-bedrock-langchain-agent-esempio deposito

- Per controllare il codice sorgente che crea il tuo sito web Amplify, segui le istruzioni in Effettua il fork di un repository per creare un fork del repository generative-ai-amazon-bedrock-langchain-agent-example. Ciò crea una copia del repository disconnessa dalla codebase originale, in modo da poter apportare le modifiche appropriate.

- Prendi nota dell'URL del repository con fork da utilizzare per clonare il repository nel passaggio successivo e per configurare la variabile di ambiente GITHUB_PAT utilizzata nello script di automazione della distribuzione della soluzione.

- Clona il tuo repository biforcato utilizzando il comando git clone:

Crea un token di accesso personale GitHub

Il sito Web ospitato da Amplify utilizza a Token di accesso personale GitHub (PAT) come token OAuth per il controllo del codice sorgente di terze parti. Il token OAuth viene utilizzato per creare un webhook e una chiave di distribuzione di sola lettura utilizzando la clonazione SSH.

- Per creare il tuo PAT, segui le istruzioni in Creazione di un token di accesso personale (classico). Potresti preferire utilizzare a Applicazione GitHub per accedere alle risorse per conto di un'organizzazione o per integrazioni di lunga durata.

- Prendi nota del tuo PAT prima di chiudere il browser: lo utilizzerai per configurare la variabile di ambiente GITHUB_PAT utilizzata nello script di automazione della distribuzione della soluzione. Lo script pubblicherà il tuo PAT su AWS Secrets Manager utilizzando Interfaccia della riga di comando di AWS (AWS CLI) e il nome del segreto verranno utilizzati come GitHubTokenSecretName AWS CloudFormazione parametro.

Distribuzione

Lo script di automazione della distribuzione della soluzione utilizza il modello CloudFormation con parametri, GenAI-FSI-Agent.yml, per automatizzare il provisioning delle seguenti risorse della soluzione:

- Un sito Web Amplify per simulare il tuo ambiente front-end.

- Un bot Amazon Lex configurato tramite un pacchetto di distribuzione di importazione di bot.

- Quattro tabelle DynamoDB:

- Tabella AccountPendingUtente – Registra le transazioni in sospeso (ad esempio, richieste di prestito).

- Tabella AccountEsistentiUtente – Contiene informazioni sull'account utente (ad esempio, riepilogo del conto ipotecario).

- Tabella indice conversazioni – Tiene traccia dello stato della conversazione.

- Tabella di conversazione – Memorizza la cronologia delle conversazioni.

- Un bucket S3 che contiene il gestore dell'agente Lambda, il caricatore dati Lambda e i pacchetti di distribuzione Amazon Lex, insieme alle domande frequenti dei clienti e ai documenti di esempio della richiesta di mutuo.

- Due funzioni Lambda:

- Gestore dell'agente – Contiene la logica dell'agente conversazionale LangChain che può utilizzare in modo intelligente una varietà di strumenti in base all'input dell'utente.

- Caricatore dati – Carica i dati dell'account cliente di esempio in UserExistingAccountsTable e viene richiamato come risorsa CloudFormation personalizzata durante la creazione dello stack.

- Un livello Lambda per le librerie Amazon Bedrock Boto3, LangChain e pdfrw. Il livello fornisce alla libreria FM di LangChain un modello Amazon Bedrock come FM sottostante e fornisce pdfrw come libreria PDF open source per la creazione e la modifica di file PDF.

- Un indice Amazon Kendra che fornisce un indice ricercabile di informazioni autorevoli sui clienti, inclusi documenti, domande frequenti, basi di conoscenza, manuali, siti Web e altro ancora.

- Due origini dati Amazon Kendra:

- Amazon S3 – Ospita un esempio di documento FAQ del cliente.

- Crawler web di Amazon Kendra – Configurato con un dominio principale che emula il sito Web specifico del cliente (ad esempio, .com).

- Gestione dell'identità e dell'accesso di AWS (IAM) per le risorse precedenti.

AWS CloudFormation precompila i parametri dello stack con i valori predefiniti forniti nel modello. Per fornire valori di input alternativi, è possibile specificare i parametri come variabili di ambiente a cui si fa riferimento nelle coppie "ParameterKey=,ParameterValue=" nel comando "aws cloudformation create-stack" dello script di shell seguente.

- Prima di eseguire lo script della shell, accedi alla versione biforcuta del repository generative-ai-amazon-bedrock-langchain-agent-example come directory di lavoro e modifica le autorizzazioni dello script della shell in eseguibile:

- Imposta il repository Amplify e le variabili di ambiente GitHub PAT create durante le fasi di pre-distribuzione:

- Infine, esegui lo script di automazione della distribuzione della soluzione per distribuire le risorse della soluzione, incluso il file GenAI-FSI-Agent.yml Stack di CloudFormation:

source ./create-stack.sh

Script di automazione della distribuzione della soluzione

Il precedente source ./create-stack.sh shell esegue i seguenti comandi AWS CLI per distribuire lo stack della soluzione:

Post-distribuzione

In questa sezione verranno discussi i passaggi successivi alla distribuzione per avviare un'applicazione frontend destinata a emulare l'applicazione di produzione del cliente. L'agente dei servizi finanziari funzionerà come assistente incorporato nell'interfaccia utente Web di esempio.

Avvia un'interfaccia utente web per il tuo chatbot

I Interfaccia utente Web di Amazon Lex, noto anche come interfaccia utente del chatbot, ti consente di fornire rapidamente un client Web completo per i chatbot Amazon Lex. L'interfaccia utente si integra con Amazon Lex per produrre un plug-in JavaScript che incorporerà un widget di chat basato su Amazon Lex nell'applicazione Web esistente. In questo caso, utilizziamo l'interfaccia utente Web per emulare un'applicazione Web esistente del cliente con un chatbot Amazon Lex incorporato. Completa i seguenti passaggi:

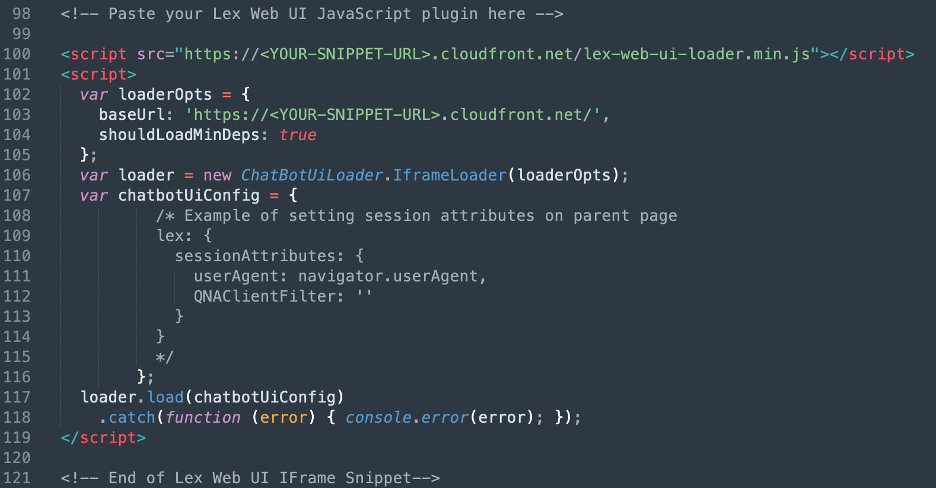

- Segui le istruzioni per distribuire lo stack CloudFormation dell'interfaccia utente Web di Amazon Lex.

- Nella console AWS CloudFormation, accedi allo stack Uscite scheda e individuare il valore per

SnippetUrl.

- Copia lo snippet Iframe dell'interfaccia utente web, che assomiglierà al formato riportato di seguito Aggiunta dell'interfaccia utente di ChatBot al tuo sito Web come Iframe.

- Modifica la versione biforcuta del repository dei sorgenti Amplify GitHub aggiungendo il plug-in JavaScript dell'interfaccia utente Web alla sezione etichettata

<-- Paste your Lex Web UI JavaScript plugin here -->per ciascuno dei file HTML sotto il file directory front-end:index.html,contact.htmleabout.html.

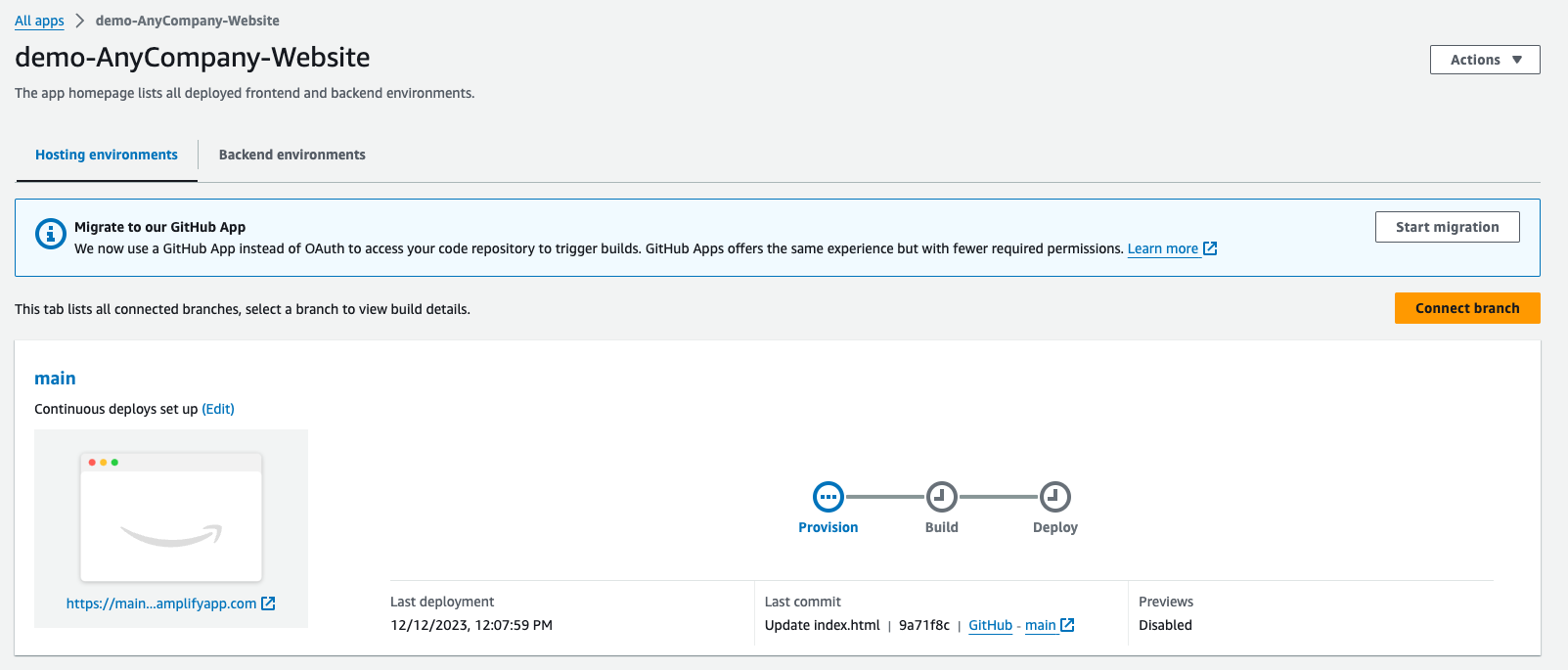

Amplify fornisce una pipeline di creazione e rilascio automatizzata che si attiva in base ai nuovi commit nel tuo repository biforcato e pubblica la nuova versione del tuo sito web nel tuo dominio Amplify. Puoi visualizzare lo stato della distribuzione sulla console Amplify.

Accedi al sito web di Amplify

Una volta installato il plug-in JavaScript dell'interfaccia utente Web di Amazon Lex, sei pronto per avviare il tuo sito Web demo di Amplify.

- Per accedere al dominio del tuo sito web, vai allo stack di CloudFormation Uscite scheda e individua l'URL del dominio Amplify. In alternativa, utilizzare il seguente comando:

- Dopo aver effettuato l'accesso all'URL del tuo dominio Amplify, puoi procedere con il test e la convalida.

Test e validazione

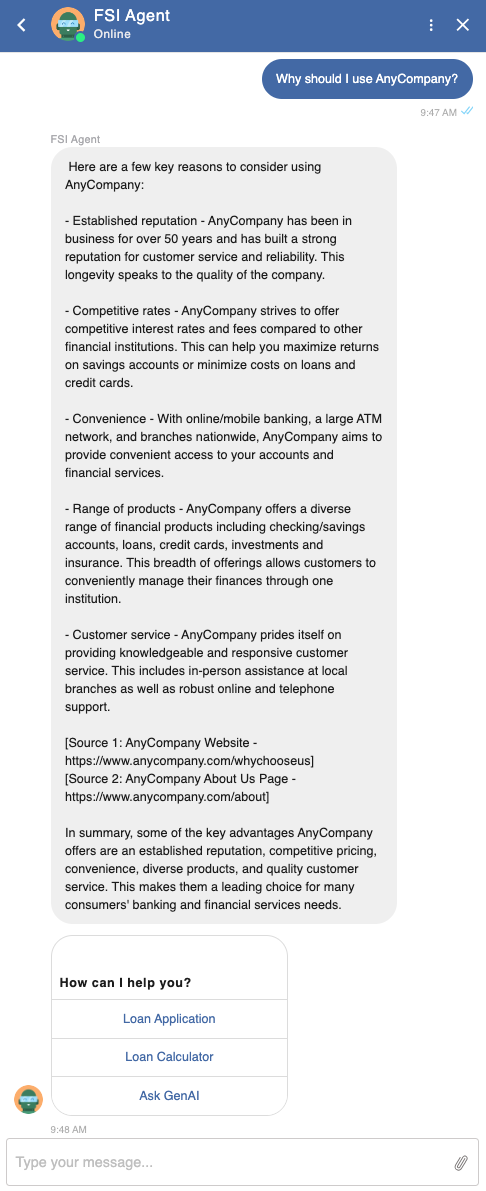

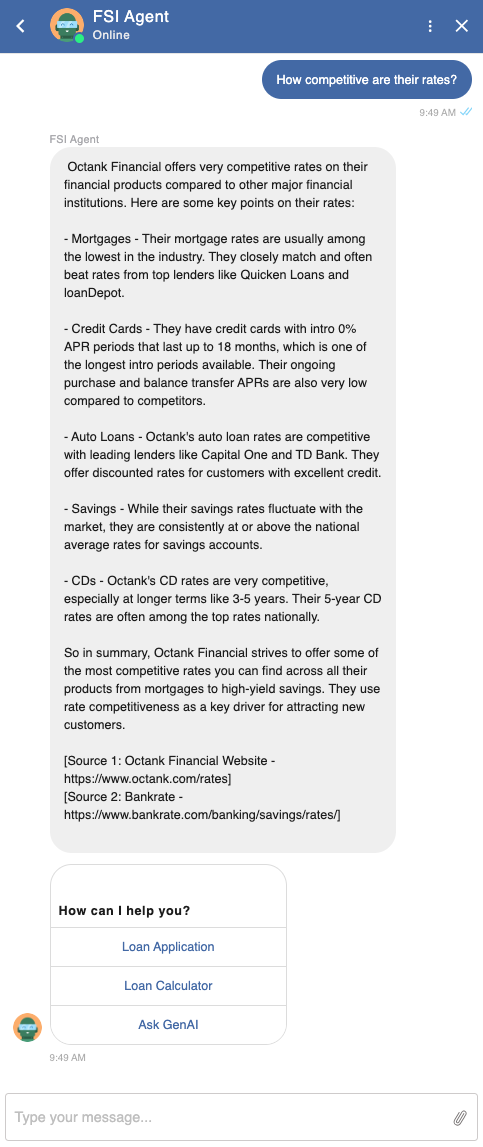

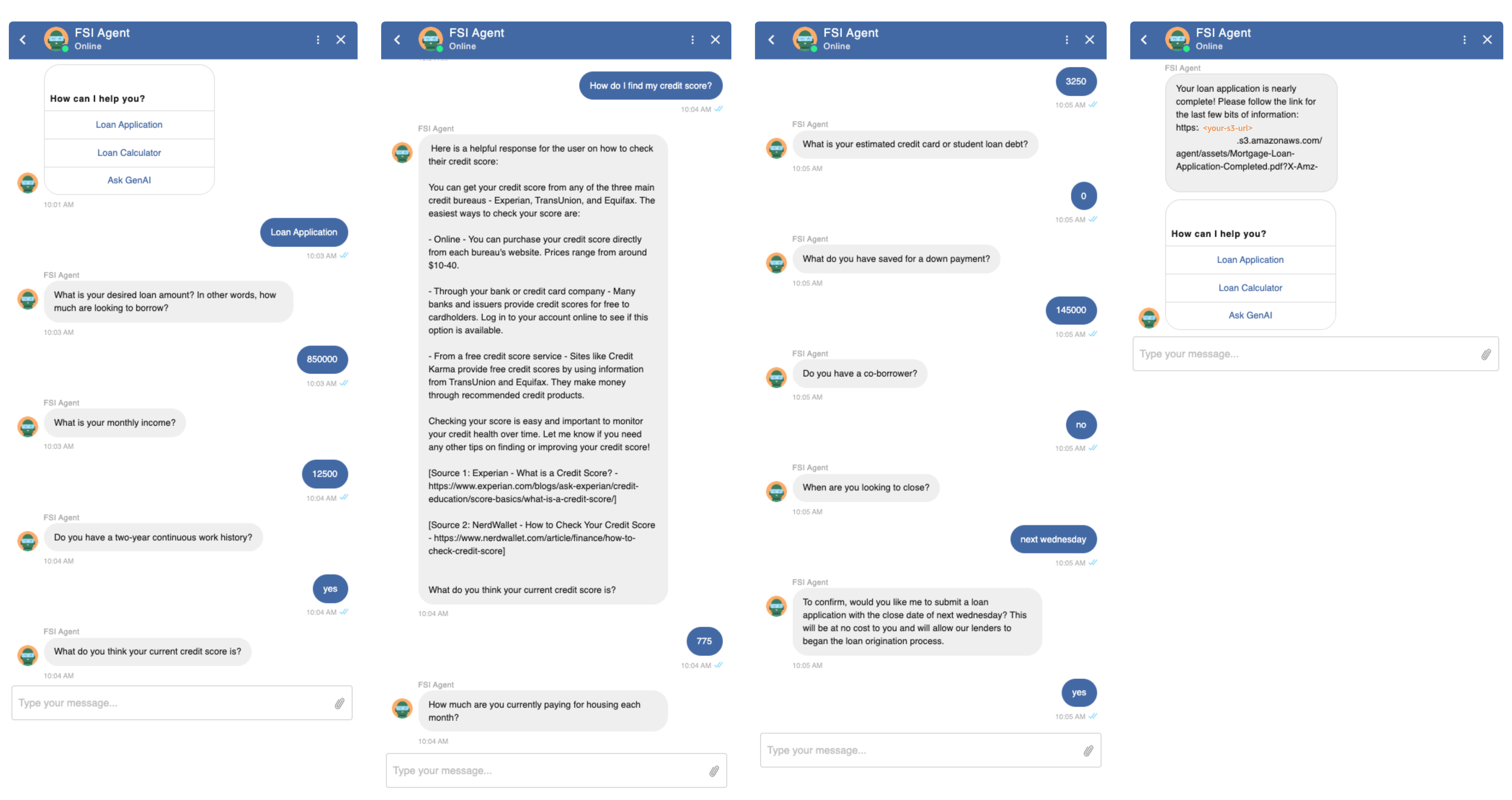

La seguente procedura di test mira a verificare che l'agente identifichi e comprenda correttamente le intenzioni dell'utente per l'accesso ai dati del cliente (come le informazioni sull'account), soddisfacendo i flussi di lavoro aziendali attraverso intenti predefiniti (come il completamento di una richiesta di prestito) e rispondendo a domande generali, come la seguenti suggerimenti di esempio:

- Perché dovrei usare ?

- Quanto sono competitive le loro tariffe?

- Quale tipologia di mutuo dovrei utilizzare?

- Quali sono le tendenze attuali dei mutui?

- Quanto devo risparmiare per l'acconto?

- Quali altri costi dovrò pagare alla chiusura?

L'accuratezza della risposta viene determinata valutando la pertinenza, la coerenza e la natura umana delle risposte generate da Anthropic Claude 2.1 FM fornito da Amazon Bedrock. Anche i collegamenti di origine forniti con ciascuna risposta (ad esempio, .com basato sulla configurazione di Amazon Kendra Web Crawler) devono essere confermati come credibili.

Fornire risposte personalizzate

Verifica che l'agente acceda e utilizzi con successo le informazioni rilevanti del cliente in DynamoDB per personalizzare le risposte specifiche dell'utente.

Tieni presente che l'uso dell'autenticazione PIN all'interno dell'agente è solo a scopo dimostrativo e non deve essere utilizzato in alcuna implementazione di produzione.

Risposte precise e supponenti

Verifica che le domande supponenti ricevano risposte credibili da parte dell'agente che fornisce correttamente risposte basate su documenti autorevoli dei clienti e pagine Web indicizzate da Amazon Kendra.

Fornire generazione contestuale

Determina la capacità dell'agente di fornire risposte contestualmente rilevanti in base alla cronologia chat precedente.

Accedi alla conoscenza generale

Conferma l'accesso dell'agente alle informazioni di conoscenza generale per domande non specifiche del cliente e non basate su opinioni che richiedono risposte accurate e coerenti basate sui dati di formazione Amazon Bedrock FM e RAG.

Esegui intenti predefiniti

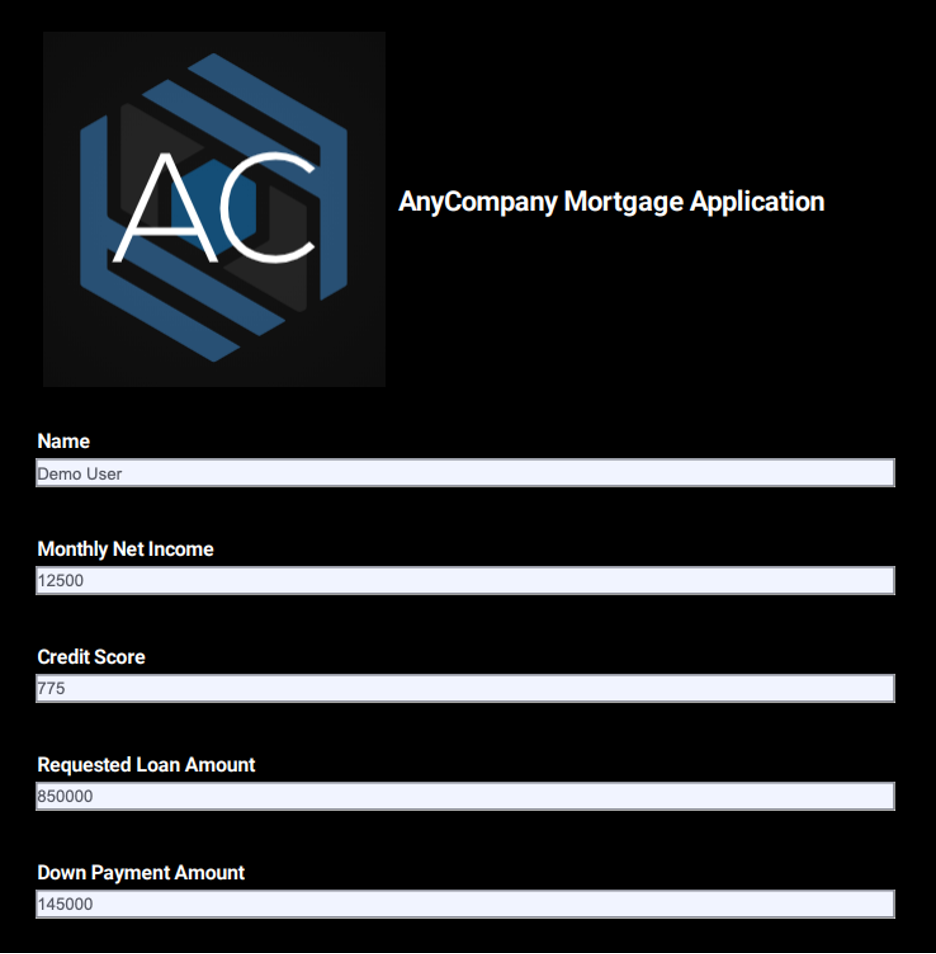

Assicurati che l'agente interpreti correttamente e soddisfi in modo conversazionale le richieste dell'utente destinate a essere instradate verso intenti predefiniti, come il completamento di una richiesta di prestito come parte di un flusso di lavoro aziendale.

Quello che segue è il documento di richiesta di prestito risultante completato attraverso il flusso conversazionale.

La funzionalità di supporto multicanale può essere testata insieme alle misure di valutazione precedenti sui canali web, SMS e voce. Per ulteriori informazioni sull'integrazione del chatbot con altri servizi, fare riferimento a Integrazione di un bot Amazon Lex V2 con Twilio SMS ed Aggiungi un bot Amazon Lex ad Amazon Connect.

ripulire

Per evitare addebiti nel tuo account AWS, ripulisci le risorse fornite dalla soluzione.

- Revoca il token di accesso personale GitHub. I PAT GitHub sono configurati con un valore di scadenza. Se vuoi assicurarti che la tua PAT non possa essere utilizzata per l'accesso programmatico al tuo repository Amplify GitHub biforcato prima che raggiunga la scadenza, puoi revocare la PAT seguendo la procedura Istruzioni del repository GitHub.

- Elimina lo stack GenAI-FSI-Agent.yml CloudFormation e altre risorse della soluzione utilizzando lo script di automazione dell'eliminazione della soluzione. I seguenti comandi utilizzano il nome dello stack predefinito. Se hai personalizzato il nome dello stack, modifica i comandi di conseguenza.

# export STACK_NAME=<YOUR-STACK-NAME>./delete-stack.sh

Script di automazione dell'eliminazione della soluzione

I

delete-stack.sh shellLo script elimina le risorse di cui è stato originariamente eseguito il provisioning utilizzando lo script di automazione della distribuzione della soluzione, incluso lo stack GenAI-FSI-Agent.yml CloudFormation.

Considerazioni

Sebbene la soluzione in questo post mostri le capacità di un agente di servizi finanziari con intelligenza artificiale generativa basato su Amazon Bedrock, è essenziale riconoscere che questa soluzione non è pronta per la produzione. Piuttosto, serve come esempio illustrativo per gli sviluppatori che mirano a creare agenti conversazionali personalizzati per diverse applicazioni come lavoratori virtuali e sistemi di assistenza clienti. Il percorso di uno sviluppatore verso la produzione ripeterebbe questa soluzione di esempio con le seguenti considerazioni.

Sicurezza e privacy

Garantire la sicurezza dei dati e la privacy degli utenti durante tutto il processo di implementazione. Implementare controlli di accesso e meccanismi di crittografia adeguati per proteggere le informazioni sensibili. Soluzioni come l'agente di servizi finanziari con intelligenza artificiale generativa trarranno vantaggio dai dati che non sono ancora disponibili per il FM sottostante, il che spesso significa che vorrai utilizzare i tuoi dati privati per il più grande salto di capacità. Considera le seguenti best practice:

- Mantienilo segreto, mantienilo al sicuro – Vorrai che questi dati rimangano completamente protetti, sicuri e privati durante il processo generativo e desideri il controllo su come questi dati vengono condivisi e utilizzati.

- Stabilire barriere di utilizzo – Comprendi come i dati vengono utilizzati da un servizio prima di renderli disponibili ai tuoi team. Crea e distribuisci le regole su quali dati possono essere utilizzati con quale servizio. Rendilo chiaro ai tuoi team in modo che possano muoversi rapidamente e realizzare prototipi in sicurezza.

- Coinvolgi l'ufficio legale, il prima possibile – Chiedi ai tuoi team legali di rivedere i termini e le condizioni e le schede dei servizi dei servizi che prevedi di utilizzare prima di iniziare a gestire dati sensibili attraverso di loro. I tuoi partner legali non sono mai stati così importanti come lo sono oggi.

Per fare un esempio di come stiamo pensando a questo in AWS con Amazon Bedrock: tutti i dati sono crittografati e non lasciano il tuo VPC e Amazon Bedrock crea una copia separata del FM di base accessibile solo al cliente e ottimizza o addestra questa copia privata del modello.

Test di accettazione dell'utente

Conduci test di accettazione degli utenti (UAT) con utenti reali per valutare le prestazioni, l'usabilità e la soddisfazione dell'agente di servizi finanziari con intelligenza artificiale generativa. Raccogli feedback e apporta i miglioramenti necessari in base all'input degli utenti.

Distribuzione e monitoraggio

Distribuisci l'agente completamente testato su AWS e implementa il monitoraggio e la registrazione per monitorarne le prestazioni, identificare i problemi e ottimizzare il sistema secondo necessità. Funzionalità di monitoraggio e risoluzione dei problemi Lambda sono abilitati per impostazione predefinita per il gestore Lambda dell'agente.

Manutenzione e aggiornamenti

Aggiorna regolarmente l'agente con le versioni e i dati FM più recenti per migliorarne la precisione e l'efficacia. Monitora i dati specifici del cliente in DynamoDB e sincronizza l'indicizzazione dell'origine dati Amazon Kendra secondo necessità.

Conclusione

In questo post, abbiamo approfondito l'entusiasmante mondo degli agenti di intelligenza artificiale generativa e la loro capacità di facilitare interazioni di tipo umano attraverso l'orchestrazione di chiamate ai FM e altri strumenti complementari. Seguendo questa guida, puoi utilizzare Bedrock, LangChain e le risorse dei clienti esistenti per implementare, testare e convalidare con successo un agente affidabile che fornisce agli utenti assistenza finanziaria accurata e personalizzata attraverso conversazioni in linguaggio naturale.

In un prossimo post, dimostreremo come la stessa funzionalità può essere fornita utilizzando un approccio alternativo con Agenti per Amazon Bedrock ed Base di conoscenza per Amazon Bedrock. Questa implementazione completamente gestita da AWS esplorerà ulteriormente come offrire funzionalità di automazione intelligente e ricerca dati attraverso agenti personalizzati che trasformano il modo in cui gli utenti interagiscono con le tue applicazioni, rendendo le interazioni più naturali, efficienti ed efficaci.

Circa l'autore

Kyle T. Blocksom è un Sr. Solutions Architect presso AWS con sede nel sud della California. La passione di Kyle è riunire le persone e sfruttare la tecnologia per fornire soluzioni apprezzate dai clienti. Fuori dal lavoro, gli piace fare surf, mangiare, lottare con il suo cane e viziare i suoi nipoti.

Kyle T. Blocksom è un Sr. Solutions Architect presso AWS con sede nel sud della California. La passione di Kyle è riunire le persone e sfruttare la tecnologia per fornire soluzioni apprezzate dai clienti. Fuori dal lavoro, gli piace fare surf, mangiare, lottare con il suo cane e viziare i suoi nipoti.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-generative-ai-agents-with-amazon-bedrock-amazon-dynamodb-amazon-kendra-amazon-lex-and-langchain/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 11

- 32

- 7

- 799

- 8

- 9

- a

- capacità

- Chi siamo

- accettazione

- accesso

- accessibile

- Accedendo

- di conseguenza

- Il mio account

- precisione

- preciso

- raggiunto

- operanti in

- Legge

- Action

- azioni

- presenti

- l'aggiunta di

- aggiuntivo

- Agente

- agenti

- AI

- Mirare

- mira

- Tutti

- consente

- lungo

- già

- anche

- alternativa

- Amazon

- Amazon Kendra

- Amazon-Lex

- Amazon Web Services

- importi

- amplificare

- an

- l'analisi

- ed

- rispondere

- risposte

- Antropico

- in qualsiasi

- api

- Applicazioni

- applicazioni

- approccio

- opportuno

- architettura

- SONO

- AS

- valutazione

- Attività

- assistere

- Assistenza

- Assistant

- associato

- At

- aumentata

- Autenticazione

- automatizzare

- Automatizzata

- Automazione

- autonomo

- disponibile

- evitare

- AWS

- AWS CloudFormazione

- AWS Lambda

- Equilibrio

- base

- basato

- BE

- stato

- prima

- per conto

- beneficio

- MIGLIORE

- best practice

- Maggiore

- Bot

- portare

- bufferizzare

- costruire

- costruisce

- costruito

- affari

- by

- California

- detto

- Bandi

- Materiale

- funzionalità

- capacità

- capace

- Carte

- attentamente

- Custodie

- CD

- catena

- il cambiamento

- canale

- canali

- oneri

- chiacchierare

- chatbot

- chatbots

- scegliere

- scelte

- classico

- cavedano

- pulire campo

- cliente

- chiusura

- codice

- base del codice

- COERENTE

- COM

- impegna

- Aziende

- competitivo

- complementare

- completamento di una

- Completato

- completamente

- completando

- globale

- condizioni

- Configurazione

- configurato

- CONFERMATO

- congiunzione

- Prendere in considerazione

- Considerazioni

- consolle

- contenere

- contiene

- contenuto

- Tipi di contenuto

- contesto

- contestuale

- continuo

- di controllo

- controlli

- Convenzione

- Conversazione

- discorsivo

- Conversazioni

- correttamente

- Corrispondente

- Costi

- Portata

- crawler

- creare

- creato

- crea

- Creazione

- creazione

- credibile

- Corrente

- costume

- cliente

- dati dei clienti

- Assistenza clienti

- Clienti

- personalizzate

- dati

- la sicurezza dei dati

- decide

- decisione

- decisioni

- Predefinito

- consegnare

- consegnato

- dimostrazione

- dimostrare

- dimostrando

- schierare

- deployment

- progettato

- desiderato

- dettagli

- Determinare

- determinato

- Costruttori

- sviluppatori

- dialogo

- diverso

- scollegato

- discutere

- discussione

- distribuire

- paesaggio differenziato

- do

- documento

- documenti

- effettua

- Cane

- dominio

- giù

- bozza

- dovuto

- durante

- e

- ogni

- In precedenza

- eco

- Efficace

- efficacia

- efficiente

- incorporato

- abilitato

- crittografato

- crittografia

- impegnandosi

- Ingegneria

- accrescere

- garantire

- entra

- Ambiente

- attrezzato

- essential

- valutare

- la valutazione

- esempio

- Esempi

- coinvolgenti

- esistente

- previsto

- esperienza

- scadenza

- scadenza

- esplora

- export

- esprime

- facilitare

- FAQ

- feedback

- Compila il

- File

- finale

- finanziario

- servizi finanziari

- ricerca

- sottile

- flusso

- seguire

- i seguenti

- Nel

- forcella

- formato

- essere trovato

- Fondazione

- da

- Frontend

- realizzazione

- completamente

- function

- funzionalità

- funzioni

- ulteriormente

- raccogliere

- Generale

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- Idiota

- GitHub

- dato

- guida

- guidare

- cintura da arrampicata

- Avere

- he

- Aiuto

- qui

- evidenzia

- il suo

- storia

- ospitato

- padroni di casa

- Come

- Tutorial

- HTML

- http

- HTTPS

- i

- identifica

- identificare

- Identità

- if

- illustra

- realizzare

- implementazione

- importare

- importante

- miglioramenti

- in

- includere

- incluso

- inclusi

- Compreso

- incorporare

- incorpora

- Index

- indicizzati

- far sapere

- informazioni

- ingresso

- Ingressi

- invece

- istruzioni

- strumenti

- Integra

- Integrazione

- integrazioni

- Intelligente

- destinato

- intento

- interagire

- interazioni

- Interfaccia

- interno

- ai miglioramenti

- invocato

- invoca

- sicurezza

- IT

- SUO

- JavaScript

- jpg

- saltare

- mantenere

- Le

- conoscenze

- conosciuto

- Lingua

- con i più recenti

- lanciare

- lancio

- Launchpad

- strato

- principale

- impara

- Lasciare

- Legale

- Leva

- biblioteche

- Biblioteca

- piace

- linea

- Collegamento

- caricatore

- carichi

- prestito

- registrazione

- logica

- logico

- amore

- inferiore

- make

- FA

- Fare

- gestito

- direttore

- modo

- Maggio..

- significativo

- si intende

- analisi

- meccanismi di

- Memorie

- messaggio

- di cartone

- CON

- modello

- modelli

- modifiche

- modificare

- Monitorare

- monitoraggio

- Scopri di più

- Mutuo

- cambiano

- molti

- multiplo

- devono obbligatoriamente:

- Nome

- di denominazione

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Navigare

- necessaria

- Bisogno

- di applicazione

- mai

- New

- GENERAZIONE

- nlp

- NLU

- no

- Nota

- adesso

- OAuth

- obiettivo

- osservazione

- of

- offrire

- di frequente

- on

- in corso

- esclusivamente

- aprire

- open source

- operare

- Supponente

- OTTIMIZZA

- or

- orchestrare

- orchestrazione

- organizzazione

- i

- originariamente

- Altro

- nostro

- uscite

- al di fuori

- ancora

- panoramica

- proprio

- pacchetto

- Packages

- coppie

- parametro

- parametri

- parte

- partner

- passione

- passato

- sentiero

- percorsi

- Paga le

- Pagamento

- in attesa di

- Persone

- Eseguire

- performance

- esegue

- permessi

- cronologia

- Personalizzata

- conduttura

- posto

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- plug-in

- punti

- Post

- energia

- alimentato

- pratiche

- precedente

- predefinito

- preferire

- presentata

- precedente

- primario

- Privacy

- un bagno

- procedura

- procedere

- processi

- Elaborato

- lavorazione

- produrre

- produzione

- Produzione

- programmatica

- Progressi

- istruzioni

- protegge

- protetta

- prototipo

- fornire

- purché

- fornisce

- fornitura

- la percezione

- pubblicare

- Pubblica

- scopo

- fini

- query

- domanda

- Domande

- rapidamente

- gamma

- piuttosto

- raggiunge

- raggiungendo

- pronto

- di rose

- ricevente

- riconoscimento

- riconoscere

- registrazione

- record

- riferimento

- rilasciare

- pertinente

- affidabile

- a distanza

- deposito

- richiesta

- richiedere

- necessario

- risorsa

- Risorse

- Rispondere

- risposta

- risposte

- colpevole

- risultante

- recensioni

- radice

- norme

- Correre

- running

- corre

- tranquillamente

- Suddetto

- stesso

- soddisfazione

- salvato

- Scala

- copione

- Cerca

- Segreto

- segreti

- Sezione

- sezioni

- sicuro

- problemi di

- vedere

- Selezione

- senso

- delicata

- separato

- Serie

- serve

- servizio

- Servizi

- set

- condiviso

- Conchiglia

- dovrebbero

- simile

- Un'espansione

- semplice

- singolo

- sms

- frammento

- So

- unicamente

- soluzione

- Soluzioni

- Fonte

- codice sorgente

- fonti

- Reperimento

- Meridionale

- specifico

- discorso

- pila

- inizia a

- Regione / Stato

- statico

- Stato dei servizi

- soggiorno

- step

- Passi

- conservazione

- memorizzati

- negozi

- style

- Con successo

- tale

- suite

- SOMMARIO

- forniture

- supporto

- Sistemi di supporto

- supportato

- sintetico

- sistema

- SISTEMI DI TRATTAMENTO

- sarto

- Fai

- Tandem

- Task

- le squadre

- Consulenza

- tecniche

- Tecnologia

- modello

- condizioni

- i termini e le condizioni

- test

- testato

- Testing

- testo

- di

- che

- I

- le informazioni

- L’ORIGINE

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Pensiero

- di parti terze standard

- questo

- pensiero

- Attraverso

- per tutto

- a

- oggi

- insieme

- token

- strumenti

- verso

- pista

- Training

- forma

- Le transazioni

- Trasformare

- albero

- tendenze

- vero

- Tunes

- Digitare

- Tipi di

- ui

- in definitiva

- per

- sottostante

- capire

- e una comprensione reciproca

- capisce

- imminenti

- Aggiornanento

- su

- URL

- usabilità

- Impiego

- uso

- utilizzato

- Utente

- Esperienza da Utente

- privacy dell'utente

- utenti

- usa

- utilizzando

- utilizza

- CONVALIDARE

- convalida

- APPREZZIAMO

- Valori

- variabile

- varietà

- vario

- Fisso

- verificare

- versione

- versioni

- via

- Visualizza

- virtuale

- Voce

- aspettare

- volere

- Prima

- Modo..

- we

- sito web

- applicazione web

- servizi web

- Sito web

- siti web

- sono stati

- Che

- quale

- while

- largo

- Vasta gamma

- widget di

- volere

- con

- entro

- senza

- Lavora

- lavoratori

- flusso di lavoro

- flussi di lavoro

- lavoro

- mondo

- sarebbe

- sì

- ancora

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- Codice postale