I clienti in settori come i beni di consumo confezionati, la produzione e la vendita al dettaglio sono sempre alla ricerca di modi per potenziare i propri processi operativi arricchendoli con approfondimenti e analisi generati dai dati. Attività come la previsione delle vendite influiscono direttamente su operazioni come la pianificazione delle materie prime, l'approvvigionamento, la produzione, la distribuzione e la logistica in entrata/uscita e possono avere molti livelli di impatto, da un unico magazzino fino a strutture di produzione su larga scala.

I rappresentanti di vendita e i manager utilizzano i dati storici sulle vendite per fare previsioni informate sulle tendenze future delle vendite. I clienti utilizzano SAP ERP Central Component (ECC) per gestire la pianificazione per la produzione, la vendita e la distribuzione delle merci. Il modulo vendite e distribuzione (SD) all'interno di SAP ECC aiuta a gestire gli ordini di vendita. I sistemi SAP sono la fonte principale di dati storici sulle vendite.

I rappresentanti di vendita e i manager hanno la conoscenza del dominio e una comprensione approfondita dei loro dati di vendita. Tuttavia, non hanno competenze di data science e programmazione per creare modelli di machine learning (ML) in grado di generare previsioni di vendita. Cercano strumenti intuitivi e semplici da usare per creare modelli ML senza scrivere una sola riga di codice.

Per aiutare le organizzazioni a raggiungere l'agilità e l'efficacia che gli analisti aziendali cercano, noi introdotto Tela di Amazon SageMaker, una soluzione ML senza codice che ti aiuta ad accelerare la consegna delle soluzioni ML fino a ore o giorni. Canvas consente agli analisti di utilizzare facilmente i dati disponibili in data lake, data warehouse e data store operativi; costruire modelli ML; e usali per fare previsioni in modo interattivo e per il punteggio batch su set di dati in blocco, il tutto senza scrivere una singola riga di codice.

In questo post, mostriamo come importare i dati degli ordini cliente da SAP ECC per generare previsioni di vendita utilizzando un modello ML creato utilizzando Canvas.

Panoramica della soluzione

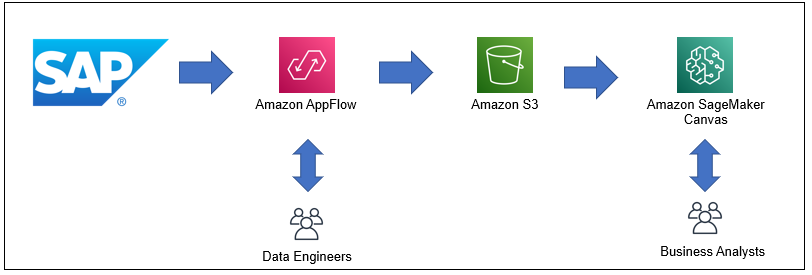

Per generare previsioni di vendita utilizzando i dati di vendita SAP, abbiamo bisogno della collaborazione di due persone: ingegneri dei dati e analisti aziendali (rappresentanti e manager di vendita). I data engineer sono responsabili della configurazione dell'esportazione dei dati dal sistema SAP a Servizio di archiviazione semplice Amazon (Amazon S3) utilizzando Flusso di app Amazon, che gli analisti aziendali possono quindi eseguire su richiesta o automaticamente (in base alla pianificazione) per aggiornare i dati SAP nel bucket S3. Gli analisti aziendali sono quindi responsabili della generazione di previsioni con i dati esportati utilizzando Canvas. Il diagramma seguente illustra questo flusso di lavoro.

Per questo post, utilizziamo SAP Modello di approvvigionamento aziendale di NetWeaver (EPM) per i dati di esempio. L'EPM viene generalmente utilizzato a scopo dimostrativo e di test in SAP. Utilizza un modello di processo aziendale comune e segue il paradigma dell'oggetto aziendale (BO) per supportare una logica aziendale ben definita. Abbiamo utilizzato la transazione SAP SEPM_DG (generatore di dati) per generare circa 80,000 ordini cliente storici e abbiamo creato una vista CDS HANA per aggregare i dati per ID prodotto, data di vendita e città, come mostrato nel codice seguente:

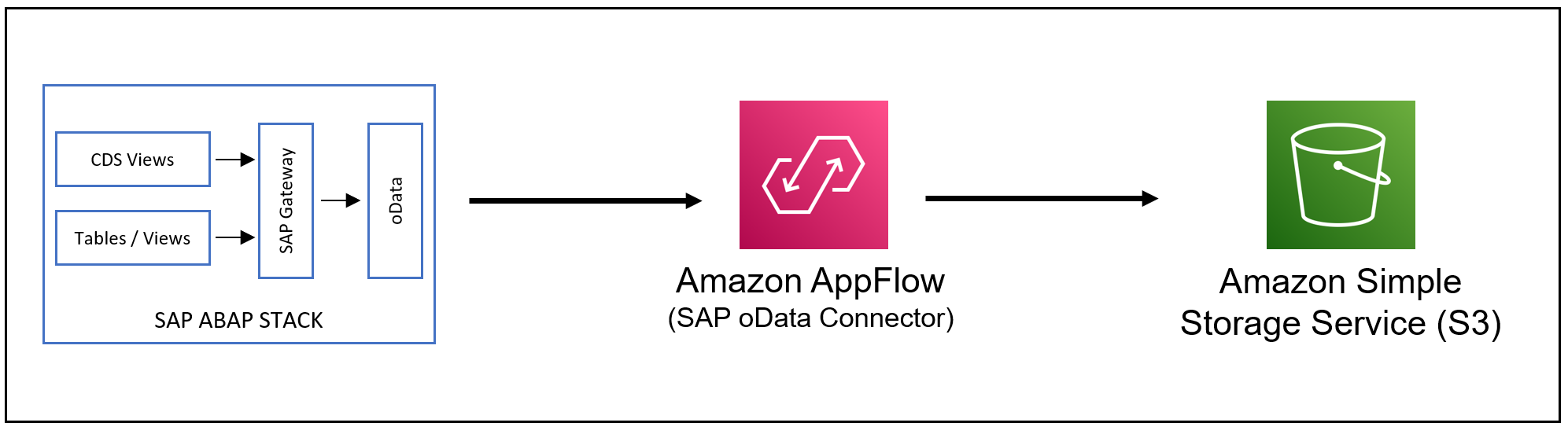

Nella sezione successiva, esponiamo questa vista utilizzando i servizi SAP OData come struttura ABAP, che ci consente di estrarre i dati con Amazon AppFlow.

La tabella seguente mostra i dati storici di vendita rappresentativi di SAP, che utilizziamo in questo post.

| numero identificativo del prodotto | data di vendita | città | vendite totali |

| P-4 | 2013-01-02 00:00:00 | Quito | 1922.00 |

| P-5 | 2013-01-02 00:00:00 | Santo Domingo | 1903.00 |

Il file di dati è dati storici di frequenza giornaliera. Ha quattro colonne (productid, saledate, citye totalsales). Usiamo Canvas per costruire un modello ML che viene utilizzato per prevedere totalsales per productid in una determinata città.

Questo post è stato organizzato per mostrare le attività e le responsabilità sia degli ingegneri dei dati che degli analisti aziendali per generare previsioni di vendita dei prodotti.

Data engineer: estrai, trasforma e carica il set di dati da SAP ad Amazon S3 con Amazon AppFlow

La prima attività che esegui come ingegnere dei dati consiste nell'eseguire un processo di estrazione, trasformazione e caricamento (ETL) sui dati storici di vendita da SAP ECC in un bucket S3, che l'analista aziendale utilizza come set di dati di origine per il proprio modello di previsione. Per questo, utilizziamo Amazon AppFlow, perché fornisce un out-of-the-box Connettore SAP OData per ETL (come mostrato nel diagramma seguente), con una semplice interfaccia utente per impostare tutto il necessario per configurare la connessione da SAP ECC al bucket S3.

Prerequisiti

Di seguito sono riportati i requisiti per integrare Amazon AppFlow con SAP:

- SAP NetWeaver Stack versione 7.40 SP02 o successiva

- Servizio catalogo (OData v2.0/v2.0) abilitato in SAP Gateway per l'individuazione del servizio

- Supporto per l'impaginazione lato client e le opzioni di query per SAP OData Service

- Connessione abilitata HTTPS a SAP

Autenticazione

Amazon AppFlow supporta due meccanismi di autenticazione per la connessione a SAP:

- Standard – Autentica utilizzando il nome utente e la password SAP OData.

- OAuth2.0 – Utilizza la configurazione OAuth 2.0 con un provider di identità. OAuth 2.0 deve essere abilitato per i servizi OData v2.0/v2.0.

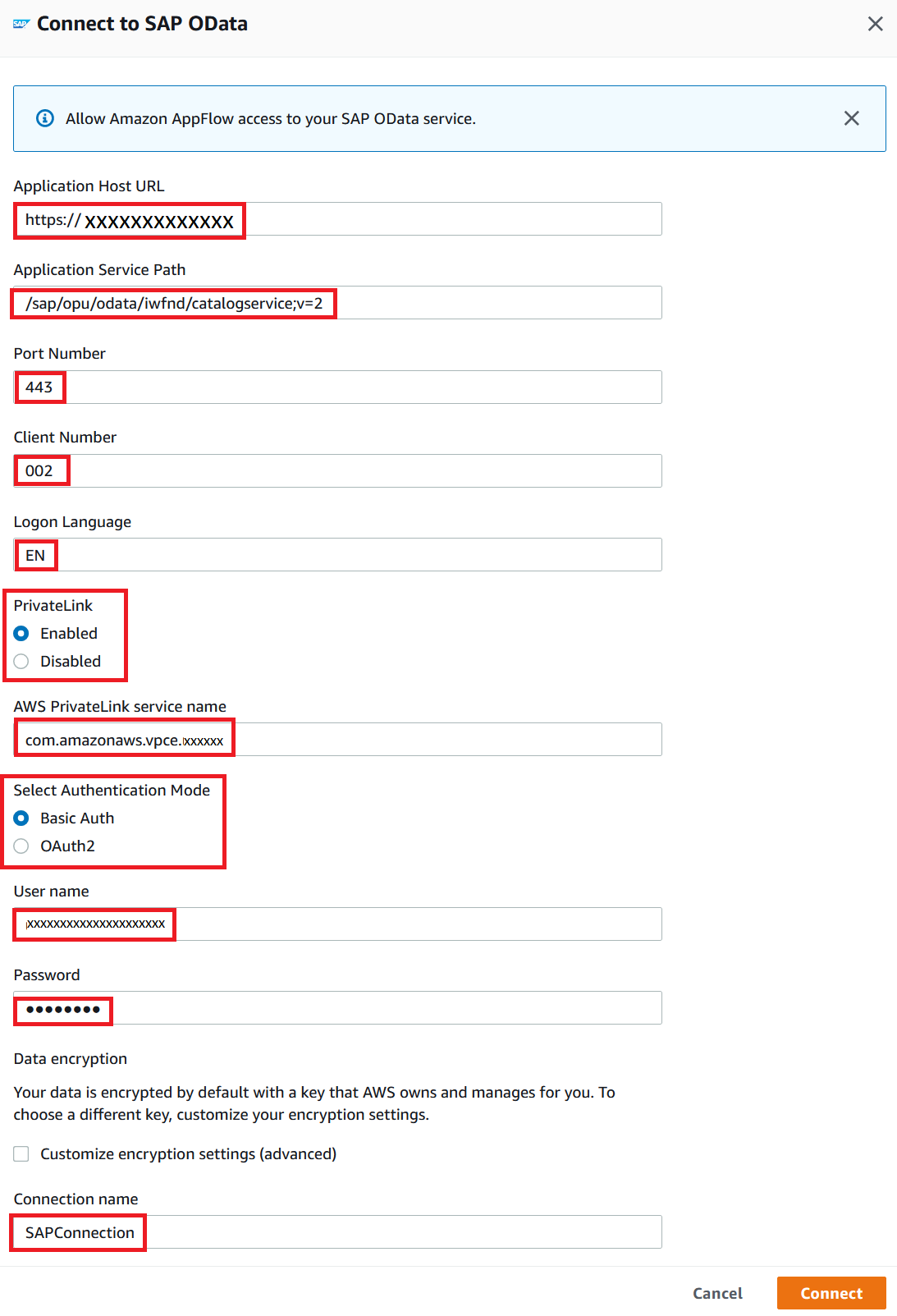

Connessione

Amazon AppFlow può connettersi a SAP ECC utilizzando un'interfaccia SAP OData pubblica o una connessione privata. Una connessione privata migliora la privacy e la sicurezza dei dati trasferendo i dati attraverso la rete AWS privata anziché la rete Internet pubblica. Una connessione privata utilizza il servizio endpoint VPC per l'istanza SAP OData in esecuzione in un VPC. Il servizio endpoint VPC deve avere l'entità servizio Amazon AppFlow appflow.amazonaws.com come principale consentito e deve essere disponibile in almeno più del 50% delle zone di disponibilità in una regione AWS.

Configura un flusso in Amazon AppFlow

Configuriamo un nuovo flusso in Amazon AppFlow per eseguire un lavoro ETL sui dati da SAP a un bucket S3. Questo flusso consente la configurazione di SAP OData Connector come origine, il bucket S3 come destinazione, la selezione di oggetti OData, la mappatura dei dati, la convalida dei dati e il filtraggio dei dati.

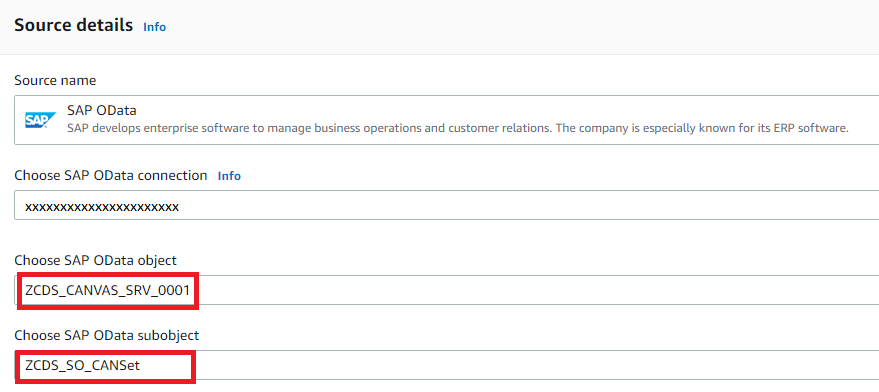

- Configurare SAP OData Connector come origine dati fornendo le seguenti informazioni:

- Dopo aver configurato l'origine, scegliere l'oggetto OData e l'oggetto secondario per gli ordini cliente.

In genere, i dati sulle vendite da SAP vengono esportati con una certa frequenza, ad esempio mensilmente o trimestralmente per l'intera dimensione. Per questo post, scegli l'opzione dell'oggetto secondario per l'esportazione a dimensione intera.

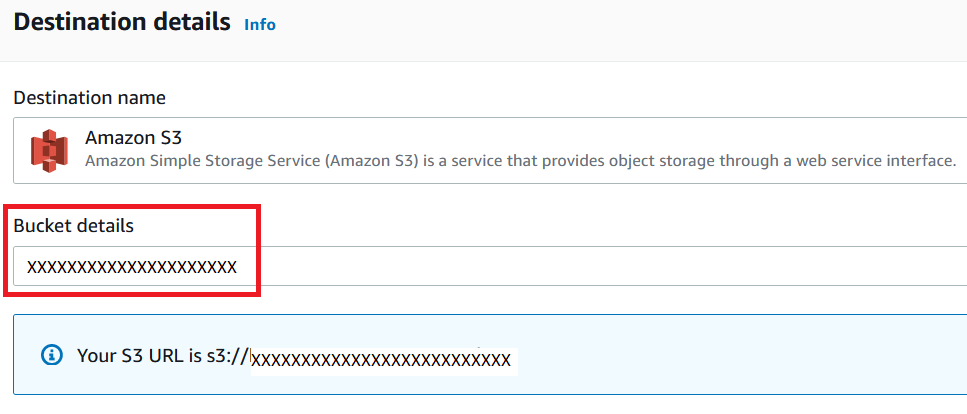

- Scegli il bucket S3 come destinazione.

Il flusso esporta i dati in questo bucket.

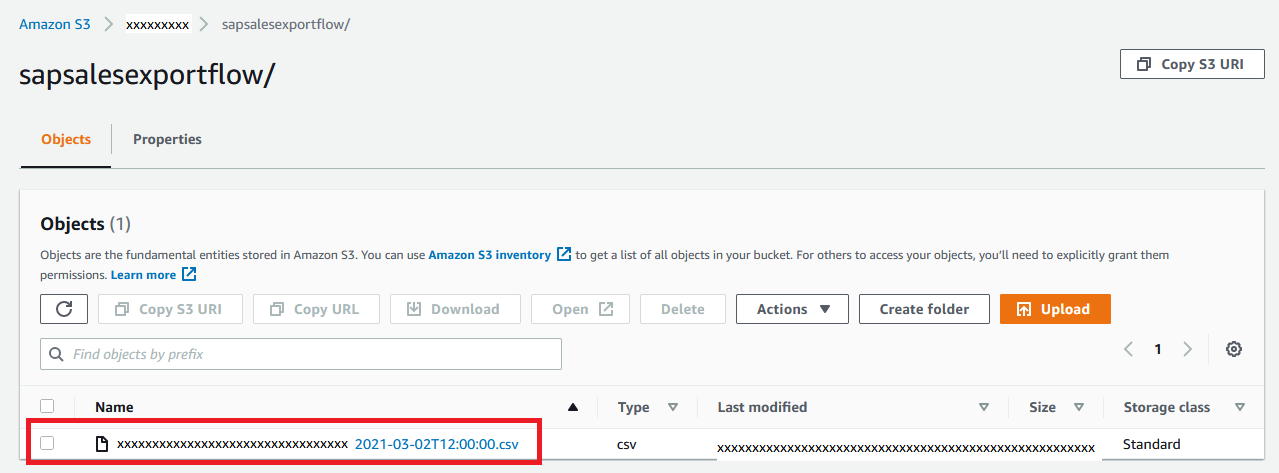

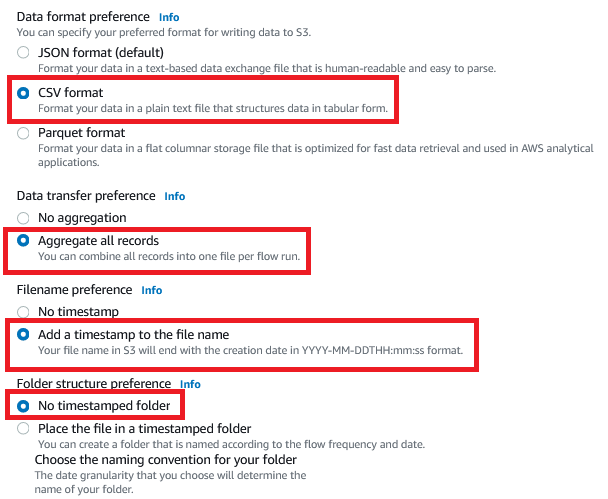

- Nel Preferenza formato dati, selezionare Formato CSV.

- Nel Preferenza per il trasferimento dei dati, selezionare Aggrega tutti i record.

- Nel Preferenza del nome del file, selezionare Aggiungi un timestamp al nome del file.

- Nel Preferenza per la struttura delle cartelle, selezionare Nessuna cartella con timestamp.

La configurazione dell'aggregazione dei record esporta i dati di vendita a grandezza naturale da SAP combinati in un unico file. Il nome del file termina con un timestamp nel formato AAAA-MM-GGTHH:mm:ss in una singola cartella (nome flusso) all'interno del bucket S3. Canvas importa i dati da questo singolo file per l'addestramento e la previsione del modello.

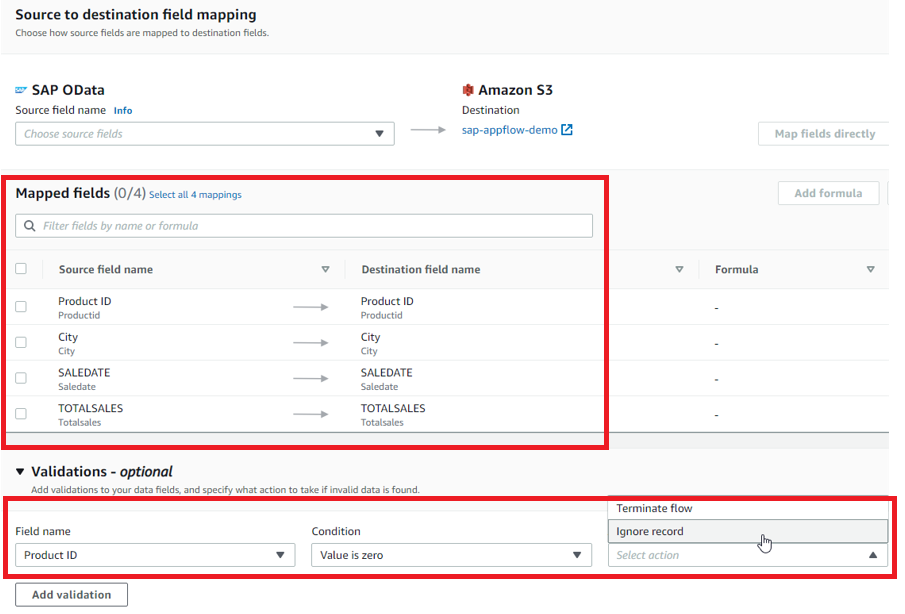

- Configurare la mappatura e le convalide dei dati per mappare i campi dei dati di origine ai campi dei dati di destinazione e abilitare le regole di convalida dei dati come richiesto.

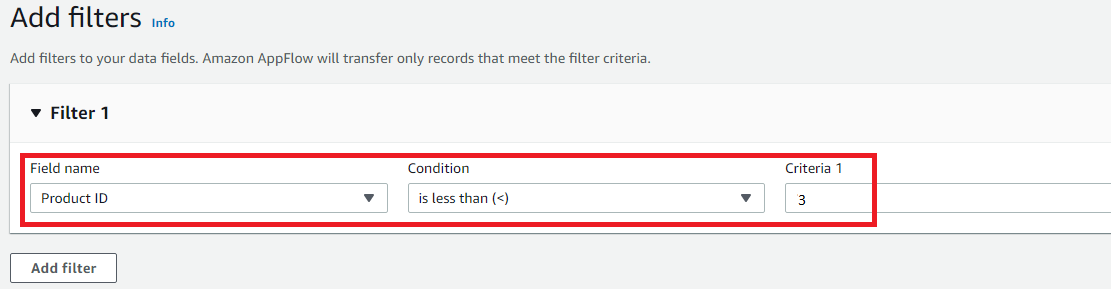

- Puoi anche configurare le condizioni di filtraggio dei dati per filtrare record specifici se il tuo requisito lo richiede.

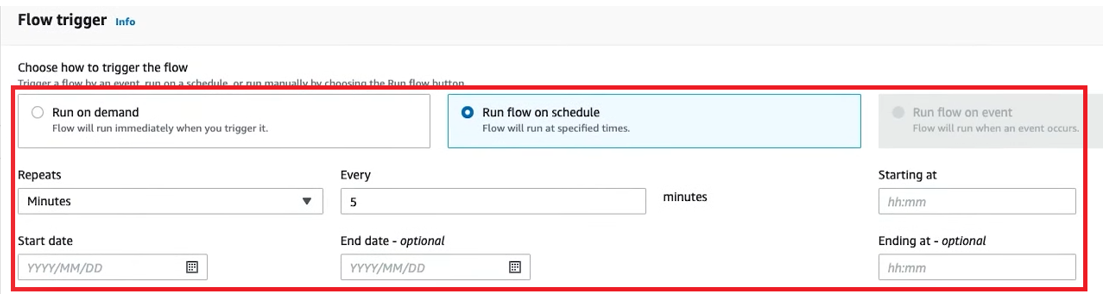

- Configura il trigger di flusso per decidere se il flusso viene eseguito manualmente su richiesta o automaticamente in base a una pianificazione.

Quando è configurata per una pianificazione, la frequenza si basa sulla frequenza con cui deve essere generata la previsione (generalmente mensile, trimestrale o semestrale).

Dopo aver configurato il flusso, gli analisti aziendali possono eseguirlo su richiesta o in base alla pianificazione per eseguire un lavoro ETL sui dati dell'ordine cliente da SAP a un bucket S3.

Dopo aver configurato il flusso, gli analisti aziendali possono eseguirlo su richiesta o in base alla pianificazione per eseguire un lavoro ETL sui dati dell'ordine cliente da SAP a un bucket S3. - Oltre alla configurazione di Amazon AppFlow, i tecnici dei dati devono anche configurare un Gestione dell'identità e dell'accesso di AWS (IAM) per Canvas in modo che possa accedere ad altri servizi AWS. Per istruzioni, fare riferimento a Concedi ai tuoi utenti le autorizzazioni per eseguire la previsione delle serie temporali.

Analista aziendale: utilizza i dati storici sulle vendite per addestrare un modello di previsione

Cambiamo marcia e passiamo al lato analista aziendale. In qualità di analista aziendale, stiamo cercando un servizio visivo, point-and-click che semplifichi la creazione di modelli ML e la generazione di previsioni accurate senza scrivere una singola riga di codice o avere competenze ML. Canvas soddisfa i requisiti come soluzione ML senza codice.

Innanzitutto, assicurati che il tuo ruolo IAM sia configurato in modo tale che Canvas possa accedere ad altri servizi AWS. Per ulteriori informazioni, fare riferimento a Concedi ai tuoi utenti le autorizzazioni per eseguire la previsione delle serie temporalioppure puoi chiedere aiuto al tuo team di Cloud Engineering.

Quando il tecnico dei dati ha finito di configurare la configurazione ETL basata su Amazon AppFlow, i dati storici sulle vendite sono disponibili per te in un bucket S3.

Ora sei pronto per addestrare un modello con Canvas! Ciò comporta in genere quattro passaggi: importazione dei dati nel servizio, configurazione dell'addestramento del modello selezionando il tipo di modello appropriato, addestramento del modello e infine generazione di previsioni utilizzando il modello.

Importa i dati in Canvas

Innanzitutto, avvia l'app Canvas da Amazon Sage Maker console o dal tuo accesso Single Sign-On. Se non sai come farlo, contatta il tuo amministratore in modo che possa guidarti attraverso il processo di configurazione di Canvas. Assicurati di accedere al servizio nella stessa regione del bucket S3 contenente il set di dati storico di SAP. Dovresti vedere una schermata come la seguente.

Quindi completare i seguenti passaggi:

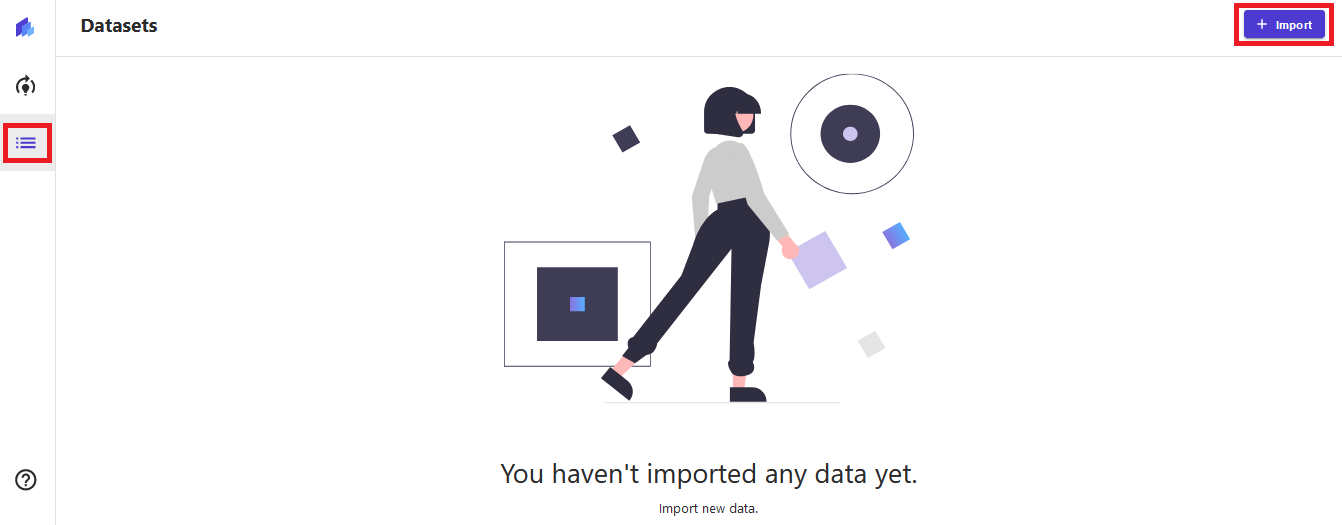

- In Tela, scegli Dataset nel pannello di navigazione.

- Scegli Importare per iniziare a importare i dati dal bucket S3.

- Nella schermata di importazione, scegli il file di dati o l'oggetto dal bucket S3 per importare i dati di addestramento.

Puoi importare più set di dati in Canvas. Supporta anche la creazione di join tra i set di dati scegliendo Unisci i dati, particolarmente utile quando i dati di addestramento sono distribuiti su più file.

Configura e addestra il modello

Dopo aver importato i dati, completare i seguenti passaggi:

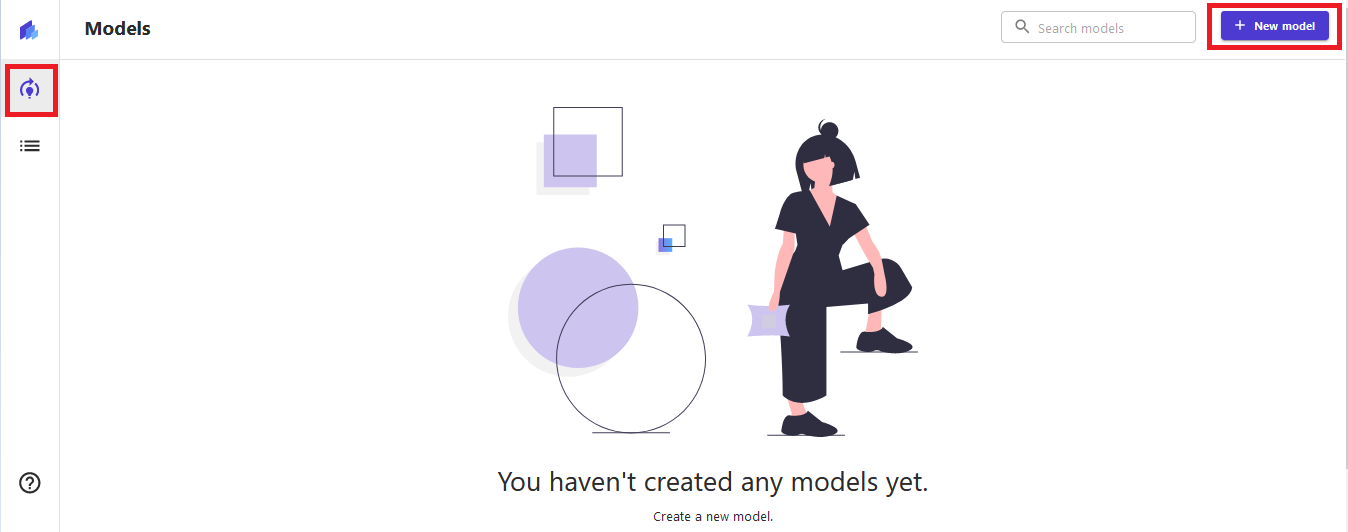

- Scegli Modelli nel pannello di navigazione.

- Scegli Nuovo modello per avviare la configurazione per l'addestramento del modello di previsione.

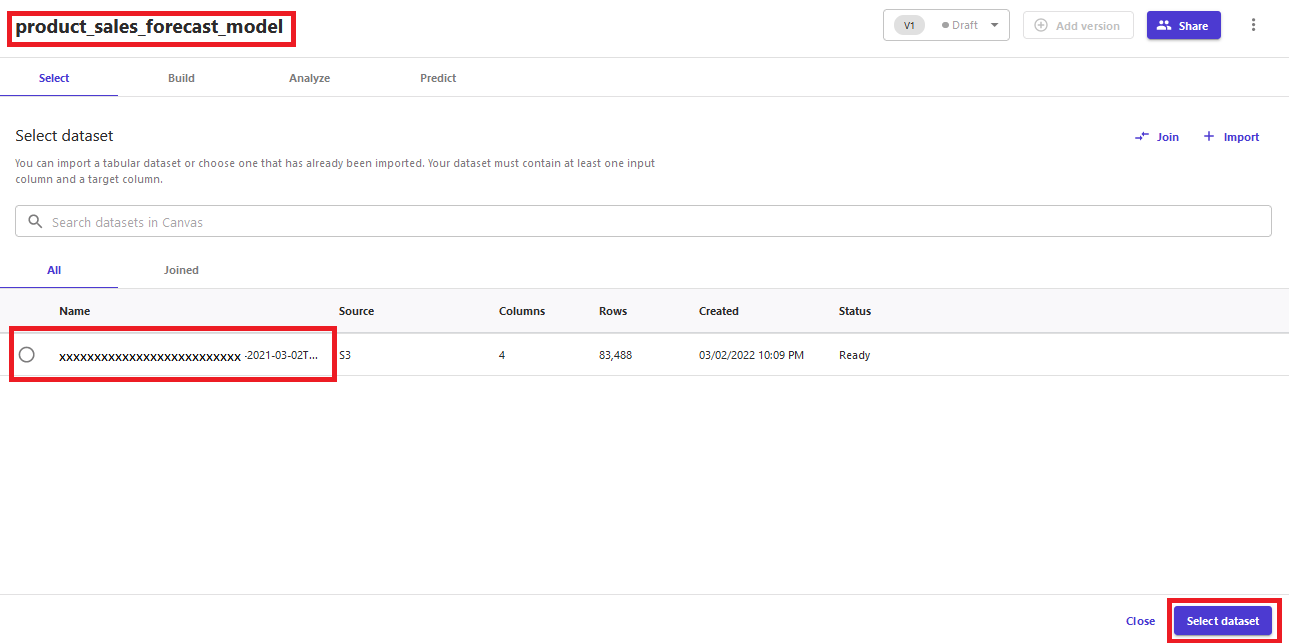

- Per il nuovo modello, assegnagli un nome adatto, ad esempio

product_sales_forecast_model. - Seleziona il set di dati di vendita e scegli Seleziona dataset.

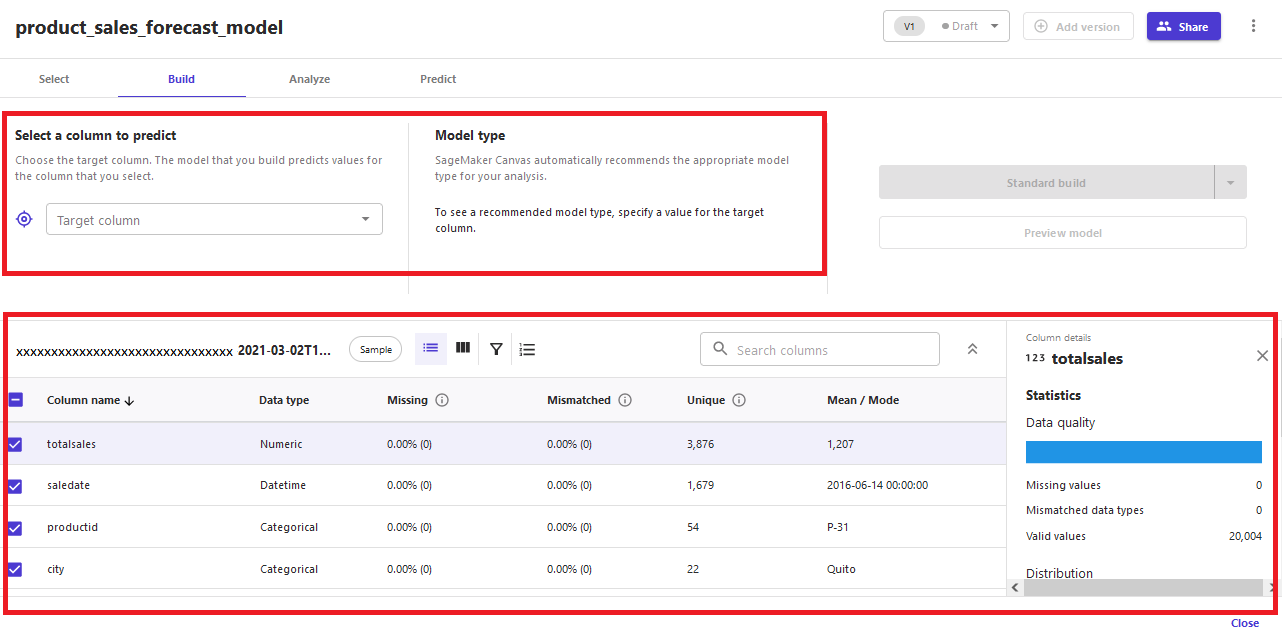

Dopo aver selezionato il set di dati, è possibile visualizzare le statistiche sui dati e configurare il training del modello nella scheda Crea.

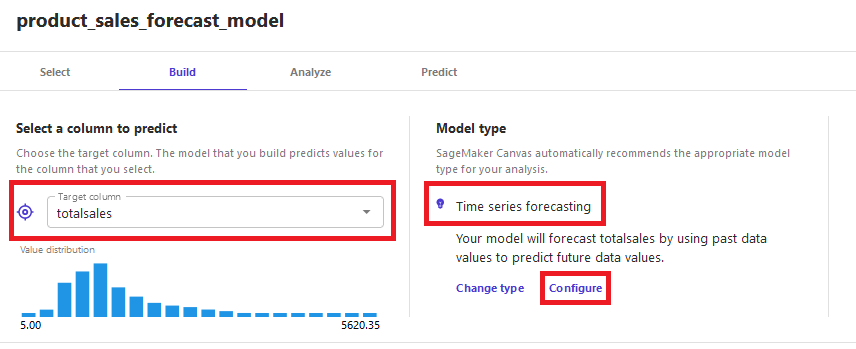

- Seleziona vendite totali come colonna di destinazione per la previsione.

Puoi vedere Previsione di serie temporali viene selezionato automaticamente come tipo di modello. - Scegli Configurazione.

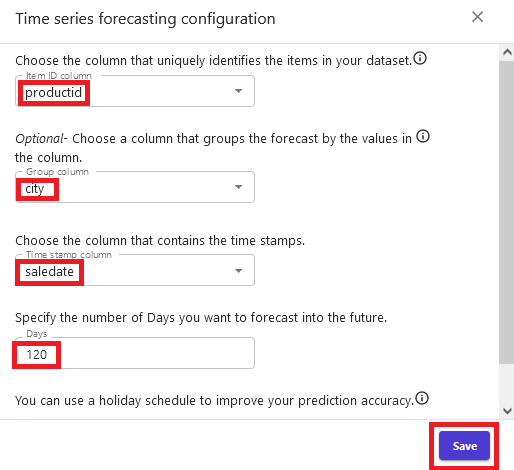

- Nel Configurazione della previsione di serie temporali sezione, scegliere numero identificativo del prodotto per Colonna ID articolo.

- Scegli città per Colonna di gruppo.

- Scegli data di vendita per Colonna timestamp.

- Nel Giorni, accedere

120. - Scegli Risparmi.

Questo configura il modello per cui fare previsionitotalsalesper 120 giorni di utilizzosaledatesulla base di dati storici, che possono essere interrogatiproductidedcity.

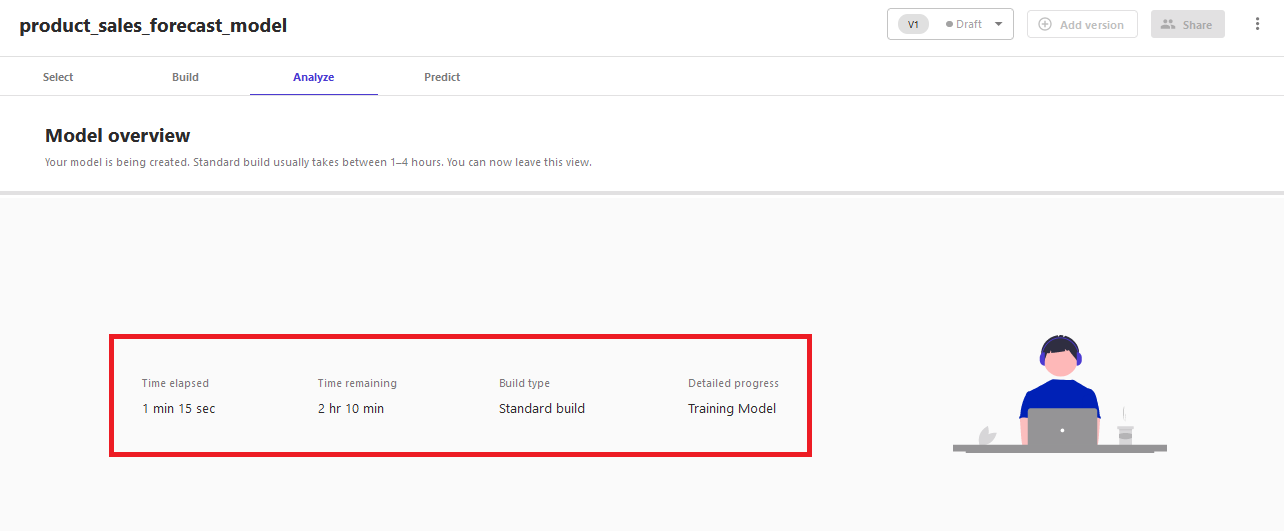

- Quando la configurazione dell'addestramento del modello è completa, scegliere Costruzione standard per iniziare la formazione del modello.

I Anteprima del modello l'opzione non è disponibile per il tipo di modello di previsione delle serie temporali. È possibile rivedere il tempo stimato per l'addestramento del modello su Analizzi i dati scheda.

Il completamento dell'addestramento del modello potrebbe richiedere da 1 a 4 ore, a seconda della dimensione dei dati. Quando il modello è pronto, puoi utilizzarlo per generare la previsione.

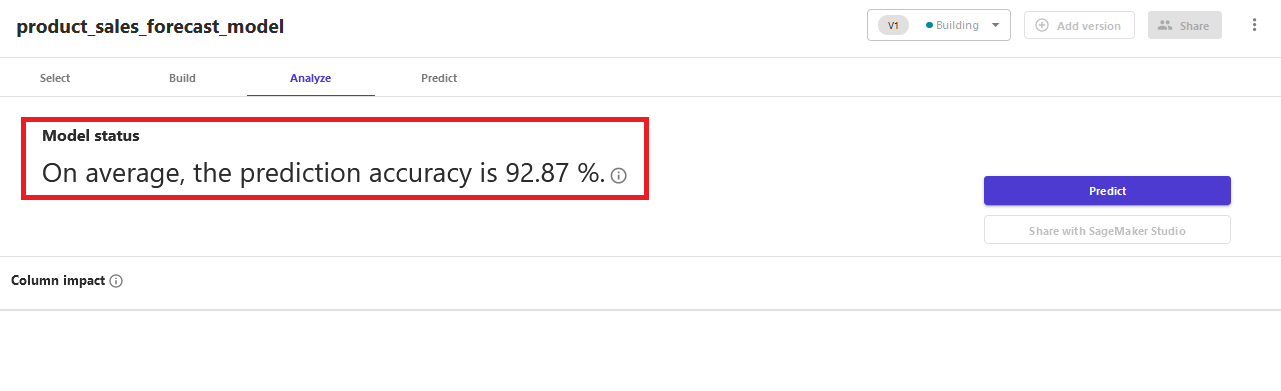

Genera una previsione

Quando l'addestramento del modello è completo, mostra l'accuratezza della previsione del modello sul Analizzi i dati scheda. Ad esempio, in questo esempio, mostra un'accuratezza di previsione del 92.87%.

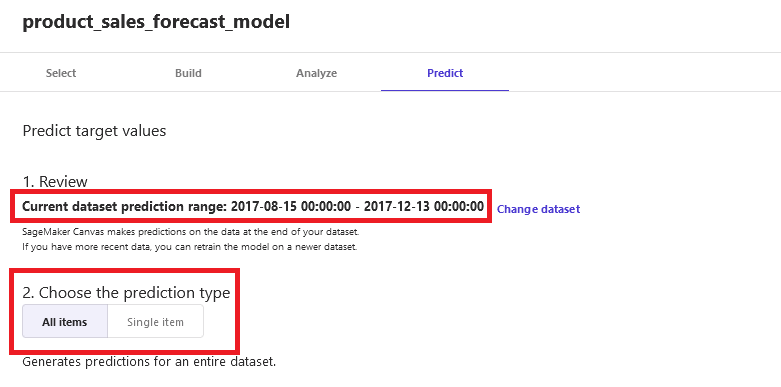

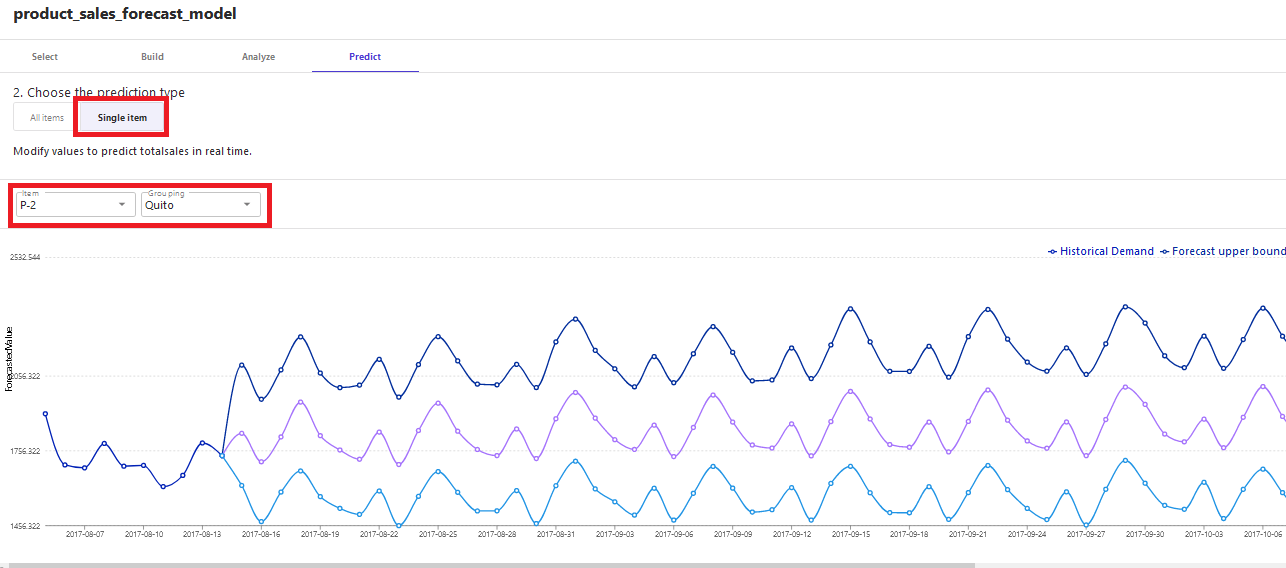

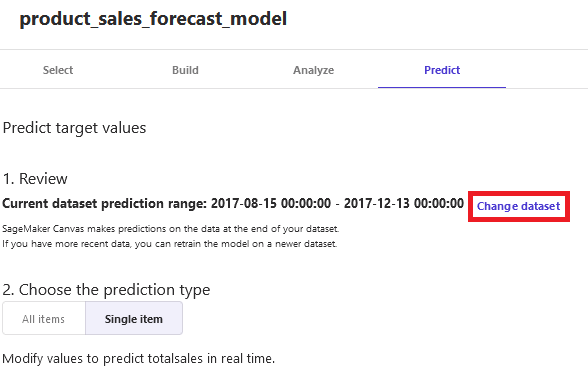

La previsione viene generata il Prevedere scheda. Puoi generare previsioni per tutti gli articoli o per un singolo articolo selezionato. Mostra anche l'intervallo di date per il quale è possibile generare la previsione.

Ad esempio, scegli il Singolo oggetto opzione. Selezionare P-2 per Articolo ed Quito per Gruppo per generare una previsione per il prodotto P-2 per la città di Quito per l'intervallo di date dal 2017-08-15 00:00:00 al 2017-12-13 00:00:00.

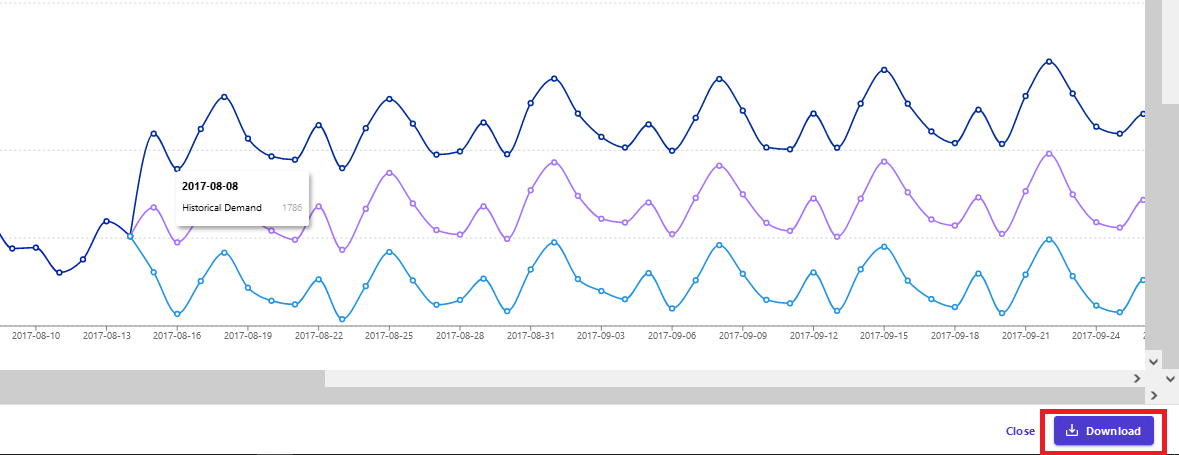

La previsione generata mostra la previsione media nonché il limite superiore e inferiore della previsione. I limiti di previsione aiutano a configurare un approccio aggressivo o equilibrato per la gestione delle previsioni.

Puoi anche scaricare la previsione generata come file CSV o immagine. Il file CSV di previsione generato viene generalmente utilizzato per lavorare offline con i dati di previsione.

La previsione è ora generata per i dati delle serie temporali. Quando una nuova linea di base di dati diventa disponibile per la previsione, è possibile modificare il set di dati in Canvas per riqualificare il modello di previsione utilizzando la nuova linea di base.

È possibile riqualificare il modello più volte man mano che i dati di addestramento cambiano.

Conclusione

In questo post, hai appreso come Amazon AppFlow SAP OData Connector esporta i dati degli ordini di vendita dal sistema SAP in un bucket S3 e quindi come utilizzare Canvas per creare un modello per la previsione.

Puoi utilizzare Canvas per qualsiasi scenario di dati di serie temporali SAP, come la previsione di spese o ricavi. L'intero processo di generazione delle previsioni è guidato dalla configurazione. I responsabili delle vendite e i rappresentanti possono generare previsioni di vendita ripetutamente al mese o per trimestre con un set di dati aggiornato in modo rapido, diretto e intuitivo senza scrivere una singola riga di codice. Ciò aiuta a migliorare la produttività e consente una pianificazione e decisioni rapide.

Per iniziare, scopri di più su Canvas e Amazon AppFlow utilizzando le seguenti risorse:

- Guida per sviluppatori di Amazon SageMaker Canvas

- Annuncio di Amazon SageMaker Canvas: una funzionalità visiva e senza codice di machine learning per analisti aziendali

- Estrai dati da SAP ERP e BW con Amazon AppFlow

- Configurazione del connettore SAP OData

Informazioni sugli autori

Brajendra Singh è architetto di soluzioni in Amazon Web Services che lavora con i clienti aziendali. Ha un forte background di sviluppatori ed è un appassionato di dati e soluzioni di machine learning.

Brajendra Singh è architetto di soluzioni in Amazon Web Services che lavora con i clienti aziendali. Ha un forte background di sviluppatori ed è un appassionato di dati e soluzioni di machine learning.

Davide Gallitelli è uno Specialist Solutions Architect per AI/ML nella regione EMEA. Ha sede a Bruxelles e lavora a stretto contatto con i clienti in tutto il Benelux. È uno sviluppatore sin da quando era molto giovane, iniziando a programmare all'età di 7 anni. Ha iniziato a studiare AI/ML all'università e da allora se ne è innamorato.

Davide Gallitelli è uno Specialist Solutions Architect per AI/ML nella regione EMEA. Ha sede a Bruxelles e lavora a stretto contatto con i clienti in tutto il Benelux. È uno sviluppatore sin da quando era molto giovane, iniziando a programmare all'età di 7 anni. Ha iniziato a studiare AI/ML all'università e da allora se ne è innamorato.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/extract-insights-from-sap-erp-with-no-code-ml-solutions-with-amazon-appflow-and-amazon-sagemaker- tela/

- '

- "

- 000

- 100

- 7

- a

- Chi siamo

- accelerare

- accesso

- preciso

- Raggiungere

- operanti in

- attività

- aggiunta

- influenzare

- Tutti

- consente

- sempre

- Amazon

- Amazon Web Services

- analista

- analitica

- App

- approccio

- opportuno

- in giro

- autentica

- Autenticazione

- automaticamente

- disponibilità

- disponibile

- media

- AWS

- sfondo

- Linea di base

- perché

- fra

- sistema

- portare

- Bruxelles

- costruire

- affari

- tela

- centrale

- certo

- il cambiamento

- Scegli

- Città

- Cloud

- codice

- collaborazione

- Colonna

- combinato

- Uncommon

- completamento di una

- componente

- condizioni

- Configurazione

- Connettiti

- veloce

- consolle

- Consumer

- contatti

- creare

- creato

- Creazione

- Clienti

- alle lezioni

- dati

- privacy dei dati

- Privacy e sicurezza dei dati

- scienza dei dati

- decisioni

- consegna

- Richiesta

- richieste

- Dipendente

- destinazione

- Costruttori

- direttamente

- distribuzione

- dominio

- giù

- scaricare

- spinto

- facilmente

- efficacia

- e potenza

- enable

- Abilita

- endpoint

- finisce

- ingegnere

- Ingegneria

- Ingegneri

- entrare

- Impresa

- stimato

- qualunque cosa

- esempio

- competenza

- FAST

- campi

- filtraggio

- Infine

- Nome

- flusso

- i seguenti

- segue

- formato

- da

- pieno

- futuro

- porta

- generalmente

- generare

- la generazione di

- ELETTRICA

- generatore

- merce

- Gruppo

- guida

- Manovrabilità

- avendo

- altezza

- Aiuto

- aiuta

- storico

- Come

- Tutorial

- Tuttavia

- HTTPS

- Identità

- Immagine

- Impact

- importazione

- competenze

- industrie

- informazioni

- informati

- intuizioni

- esempio

- integrare

- Interfaccia

- Internet

- intuitivo

- IT

- Lavoro

- join

- Entra a far parte

- Le

- Sapere

- conoscenze

- Discografica

- lanciare

- IMPARARE

- imparato

- apprendimento

- livelli

- linea

- LINK

- caricare

- logistica

- cerca

- amore

- macchina

- machine learning

- make

- FA

- gestire

- I gestori

- manualmente

- consigliato per la

- carta geografica

- mappatura

- materiale

- forza

- ML

- modello

- modelli

- Mese

- mensile

- Scopri di più

- cambiano

- multiplo

- Navigazione

- esigenze

- Rete

- offline

- Operazioni

- Opzione

- Opzioni

- minimo

- ordini

- organizzazioni

- Organizzato

- Altro

- paradigma

- particolare

- particolarmente

- Password

- pianificazione

- predizione

- Previsioni

- Anteprima

- primario

- Direttore

- Privacy

- Privacy e sicurezza

- un bagno

- processi

- i processi

- Prodotto

- Produzione

- della produttività

- Programmazione

- fornitore

- fornisce

- fornitura

- la percezione

- pubblicare

- fini

- Trimestre

- Presto

- gamma

- Crudo

- record

- record

- regione

- rappresentante

- necessario

- Requisiti

- Risorse

- responsabilità

- responsabile

- nello specifico retail

- Le vendite

- recensioni

- Ruolo

- norme

- Correre

- running

- vendita

- vendite

- stesso

- linfa

- Scienze

- punteggio

- allo

- problemi di

- selezionato

- prodotti

- Serie

- servizio

- Servizi

- set

- regolazione

- mostrato

- Un'espansione

- da

- singolo

- Taglia

- abilità

- So

- solido

- soluzione

- Soluzioni

- specialista

- specifico

- diffondere

- pila

- inizia a

- iniziato

- statistica

- conservazione

- negozi

- forte

- supporto

- supporti

- Interruttore

- sistema

- SISTEMI DI TRATTAMENTO

- Target

- task

- team

- Testing

- I

- L’ORIGINE

- Attraverso

- per tutto

- tempo

- volte

- strumenti

- Training

- delle transazioni

- trasferimento

- Trasferimento

- Trasformare

- tendenze

- tipicamente

- ui

- e una comprensione reciproca

- Università

- us

- uso

- utenti

- convalida

- versione

- Visualizza

- modi

- sito web

- servizi web

- ben definita

- se

- entro

- senza

- Lavora

- lavoro

- lavori

- scrittura

- giovane

- Trasferimento da aeroporto a Sharm