Amazon Sage Maker endpoint multi-modello (MME) sono una funzionalità completamente gestita dell'inferenza di SageMaker che consente di distribuire migliaia di modelli su un singolo endpoint. In precedenza, le MME assegnavano staticamente la potenza di calcolo della CPU ai modelli indipendentemente dal carico di traffico del modello, utilizzando Server multimodello (MMS) come server modello. In questo post, discutiamo una soluzione in cui una MME può regolare dinamicamente la potenza di calcolo assegnata a ciascun modello in base al modello di traffico del modello. Questa soluzione consente di utilizzare il calcolo sottostante delle MME in modo più efficiente e di risparmiare sui costi.

Gli MME caricano e scaricano dinamicamente i modelli in base al traffico in entrata verso l'endpoint. Quando si utilizza MMS come server modello, gli MME assegnano un numero fisso di lavoratori modello per ciascun modello. Per ulteriori informazioni, fare riferimento a Modelli di hosting dei modelli in Amazon SageMaker, parte 3: esegui e ottimizza l'inferenza multimodello con endpoint multimodello Amazon SageMaker.

Tuttavia, ciò può portare ad alcuni problemi quando il modello di traffico è variabile. Supponiamo che tu abbia uno o pochi modelli che ricevono una grande quantità di traffico. Puoi configurare MMS per allocare un numero elevato di lavoratori per questi modelli, ma questo viene assegnato a tutti i modelli dietro MME perché è una configurazione statica. Ciò porta un gran numero di lavoratori a utilizzare il calcolo hardware, anche i modelli inattivi. Può verificarsi il problema opposto se si imposta un valore basso per il numero di lavoratori. I modelli più diffusi non avranno abbastanza lavoratori a livello di server modello per allocare correttamente abbastanza hardware dietro l'endpoint per questi modelli. Il problema principale è che è difficile rimanere indipendenti dal modello di traffico se non è possibile ridimensionare dinamicamente i propri lavoratori a livello di server modello per allocare la quantità necessaria di calcolo.

La soluzione di cui discutiamo in questo post utilizza DJLServing come server modello, che può aiutare a mitigare alcuni dei problemi di cui abbiamo discusso e abilitare il ridimensionamento per modello e consentire agli MME di essere indipendenti dal modello di traffico.

Architettura MME

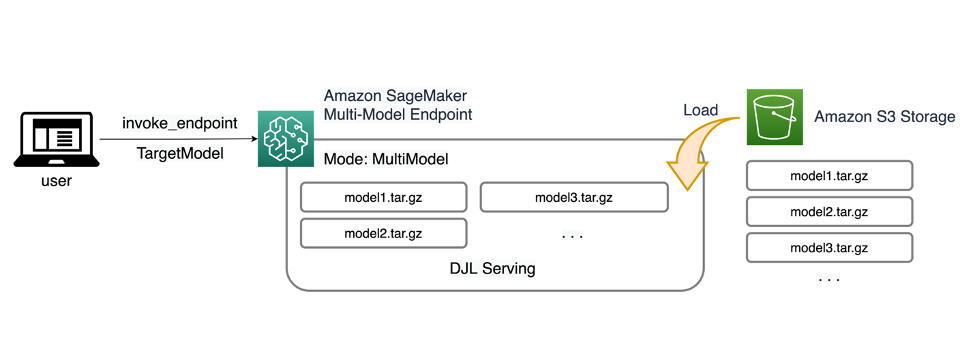

Gli MME SageMaker ti consentono di distribuire più modelli dietro un singolo endpoint di inferenza che può contenere una o più istanze. Ogni istanza è progettata per caricare e servire più modelli fino alla sua capacità di memoria e CPU/GPU. Con questa architettura, un'azienda SaaS (Software as a Service) può abbattere il costo in aumento lineare dell'hosting di più modelli e ottenere un riutilizzo dell'infrastruttura coerente con il modello multi-tenancy applicato altrove nello stack di applicazioni. Il diagramma seguente illustra questa architettura.

Un MME SageMaker carica dinamicamente i modelli da Servizio di archiviazione semplice Amazon (Amazon S3) quando richiamato, invece di scaricare tutti i modelli quando viene creato per la prima volta l'endpoint. Di conseguenza, un'invocazione iniziale a un modello potrebbe registrare una latenza di inferenza più elevata rispetto alle inferenze successive, che vengono completate con una bassa latenza. Se il modello è già caricato nel contenitore quando richiamato, il passaggio di download viene saltato e il modello restituisce le inferenze con bassa latenza. Ad esempio, supponiamo di avere un modello che viene utilizzato solo poche volte al giorno. Viene caricato automaticamente su richiesta, mentre i modelli ad accesso frequente vengono conservati in memoria e richiamati con una latenza costantemente bassa.

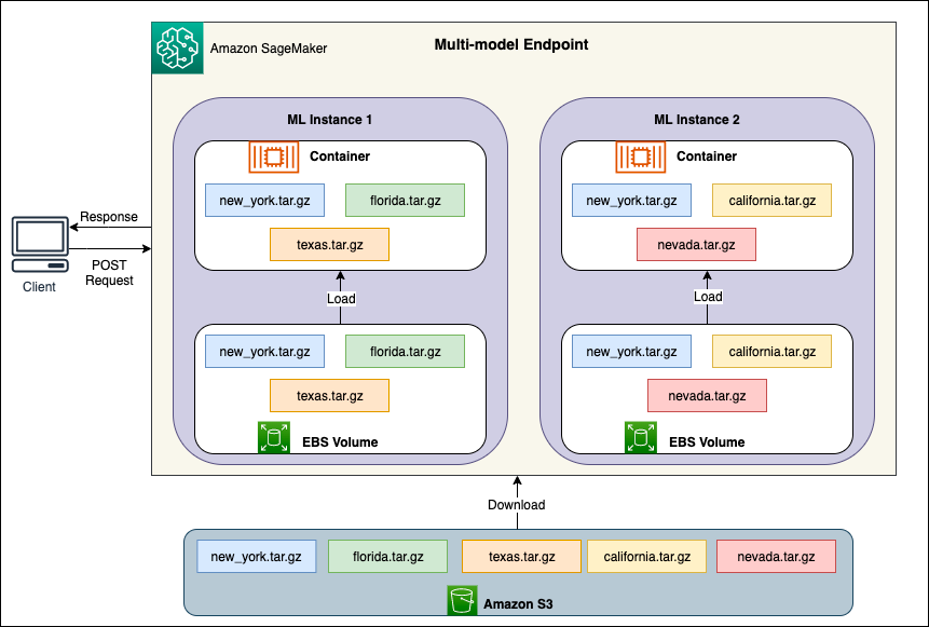

Dietro ogni MME ci sono istanze di hosting del modello, come illustrato nel diagramma seguente. Queste istanze caricano ed rimuovono più modelli da e verso la memoria in base ai modelli di traffico verso i modelli.

SageMaker continua a instradare le richieste di inferenza per un modello all'istanza in cui il modello è già caricato in modo tale che le richieste vengano servite da una copia del modello memorizzata nella cache (vedere il diagramma seguente, che mostra il percorso della richiesta per la prima richiesta di previsione rispetto alla previsione memorizzata nella cache percorso della richiesta). Tuttavia, se il modello riceve molte richieste di chiamata e sono presenti istanze aggiuntive per MME, SageMaker instrada alcune richieste a un'altra istanza per soddisfare l'aumento. Per sfruttare il ridimensionamento automatizzato del modello in SageMaker, assicurati di averlo impostazione del ridimensionamento automatico dell'istanza per fornire capacità di istanza aggiuntiva. Configura la tua policy di dimensionamento a livello di endpoint con parametri personalizzati o chiamate al minuto (consigliato) per aggiungere più istanze al parco di endpoint.

Panoramica del server modello

Un server modello è un componente software che fornisce un ambiente runtime per la distribuzione e la gestione di modelli di machine learning (ML). Funziona come un'interfaccia tra i modelli addestrati e le applicazioni client che desiderano effettuare previsioni utilizzando tali modelli.

Lo scopo principale di un server modello è consentire un'integrazione semplice e un'implementazione efficiente dei modelli ML nei sistemi di produzione. Invece di incorporare il modello direttamente in un'applicazione o in un framework specifico, il server modello fornisce una piattaforma centralizzata in cui è possibile distribuire, gestire e servire più modelli.

I server modello offrono in genere le seguenti funzionalità:

- Caricamento del modello – Il server carica in memoria i modelli ML addestrati, rendendoli pronti per fornire previsioni.

- API di inferenza – Il server espone un'API che consente alle applicazioni client di inviare dati di input e ricevere previsioni dai modelli distribuiti.

- scalata – I server modello sono progettati per gestire richieste simultanee da più client. Forniscono meccanismi per l'elaborazione parallela e la gestione efficiente delle risorse per garantire un throughput elevato e una bassa latenza.

- Integrazione con motori backend – I server modello dispongono di integrazioni con framework backend come DeepSpeed e FasterTransformer per partizionare modelli di grandi dimensioni ed eseguire inferenze altamente ottimizzate.

Architettura DJL

Servizio DJL è un server modello universale open source, ad alte prestazioni. DJL Serving è costruito sopra Djl, una libreria di deep learning scritta nel linguaggio di programmazione Java. Può prendere un modello di deep learning, diversi modelli o flussi di lavoro e renderli disponibili tramite un endpoint HTTP. DJL Serving supporta la distribuzione di modelli da più framework come PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer e altro ancora.

DJL Serving offre molte funzionalità che ti consentono di distribuire i tuoi modelli con prestazioni elevate:

- Facilità d'uso – DJL Serving può servire la maggior parte dei modelli immediatamente disponibili. Basta portare gli artefatti del modello e DJL Serving potrà ospitarli.

- Supporto di più dispositivi e acceleratori – DJL Serving supporta la distribuzione di modelli su CPU, GPU e AWS Inferenza.

- Prestazione – DJL Serving esegue l'inferenza multithread in una singola JVM per aumentare il throughput.

- Dosaggio dinamico – DJL Serving supporta il batching dinamico per aumentare la produttività.

- Ridimensionamento automatico – DJL Serving aumenterà o diminuirà automaticamente i lavoratori in base al carico di traffico.

- Supporto multi-motore – DJL Serving può ospitare simultaneamente modelli utilizzando diversi framework (come PyTorch e TensorFlow).

- Modelli di ensemble e di flusso di lavoro – DJL Serving supporta l'implementazione di flussi di lavoro complessi composti da più modelli ed esegue parti del flusso di lavoro su CPU e parti su GPU. I modelli all'interno di un flusso di lavoro possono utilizzare framework diversi.

In particolare, la funzionalità di ridimensionamento automatico di DJL Serving semplifica la garanzia che i modelli vengano ridimensionati in modo appropriato per il traffico in entrata. Per impostazione predefinita, DJL Serving determina il numero massimo di lavoratori per un modello che può essere supportato in base all'hardware disponibile (core CPU, dispositivi GPU). Puoi impostare limiti inferiore e superiore per ciascun modello per garantire che possa sempre essere servito un livello di traffico minimo e che un singolo modello non consumi tutte le risorse disponibili.

DJL Serving utilizza a Netty frontend sopra i pool di thread di lavoro backend. Il frontend utilizza una singola configurazione Netty con più HttpRequestHandlers. Diversi gestori di richieste forniranno supporto per il file API di inferenza, API di gestioneo altre API disponibili da vari plugin.

Il backend è basato su Gestore carico di lavoro (WLM). Il WLM si occupa di più thread di lavoro per ciascun modello insieme al raggruppamento e all'instradamento delle richieste ad essi. Quando vengono serviti più modelli, WLM controlla prima la dimensione della coda delle richieste di inferenza di ciascun modello. Se la dimensione della coda è maggiore di due volte la dimensione del batch di un modello, WLM aumenta il numero di lavoratori assegnati a quel modello.

Panoramica della soluzione

L'implementazione di DJL con un MME differisce dalla configurazione MMS predefinita. Per DJL Serving con un MME, comprimiamo i seguenti file nel formato model.tar.gz previsto da SageMaker Inference:

- modello.joblib – Per questa implementazione, inseriamo direttamente i metadati del modello nel tarball. In questo caso, stiamo lavorando con a

.joblibfile, quindi forniamo quel file nel nostro tarball affinché il nostro script di inferenza possa leggerlo. Se l'artefatto è troppo grande, puoi anche inviarlo ad Amazon S3 e puntarlo nella configurazione di servizio definita per DJL. - servire.proprietà – Qui è possibile configurare qualsiasi modello relativo al server variabili ambientali. La potenza di DJL qui è che puoi configurare

minWorkersedmaxWorkersper ogni modello tarball. Ciò consente a ciascun modello di scalare verso l'alto e verso il basso a livello del server modello. Ad esempio, se un singolo modello riceve la maggior parte del traffico per una MME, il server del modello aumenterà dinamicamente i lavoratori. In questo esempio, non configuriamo queste variabili e lasciamo che DJL determini il numero necessario di lavoratori in base al nostro modello di traffico. - modello.py – Questo è lo script di inferenza per qualsiasi preelaborazione o postelaborazione personalizzata che desideri implementare. model.py prevede che la tua logica sia incapsulata in un metodo handle per impostazione predefinita.

- requisiti.txt (facoltativo) – Per impostazione predefinita, DJL viene installato con PyTorch, ma eventuali dipendenze aggiuntive necessarie possono essere inviate qui.

Per questo esempio, mostriamo la potenza di DJL con un MME prendendo un modello SKLearn di esempio. Eseguiamo un lavoro di formazione con questo modello e quindi creiamo 1,000 copie di questo artefatto modello per supportare il nostro MME. Mostreremo quindi come DJL può scalare dinamicamente per gestire qualsiasi tipo di modello di traffico che il tuo MME potrebbe ricevere. Ciò può includere una distribuzione uniforme del traffico su tutti i modelli o anche su alcuni modelli popolari che ricevono la maggior parte del traffico. Puoi trovare tutto il codice di seguito Repository GitHub.

Prerequisiti

Per questo esempio, utilizziamo un'istanza notebook SageMaker con un kernel conda_python3 e un'istanza ml.c5.xlarge. Per eseguire i test di carico, è possibile utilizzare un Cloud di calcolo elastico di Amazon (Amazon EC2) o un'istanza notebook SageMaker più grande. In questo esempio, arriviamo a oltre mille transazioni al secondo (TPS), quindi suggeriamo di eseguire il test su un'istanza EC2 più pesante come ml.c5.18xlarge in modo da avere più calcolo con cui lavorare.

Creare un artefatto modello

Dobbiamo prima creare il nostro artefatto modello e i dati che utilizziamo in questo esempio. In questo caso, generiamo alcuni dati artificiali con NumPy ed eseguiamo il training utilizzando un modello di regressione lineare SKLearn con il seguente snippet di codice:

Dopo aver eseguito il codice precedente, dovresti avere a model.joblib file creato nel tuo ambiente locale.

Estrai l'immagine DJL Docker

L'immagine Docker djl-inference:0.23.0-cpu-full-v1.0 è il nostro contenitore di servizio DJL utilizzato in questo esempio. Puoi modificare il seguente URL in base alla tua regione:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Facoltativamente, puoi anche utilizzare questa immagine come immagine di base ed estenderla per creare la tua immagine Docker Registro dei contenitori Amazon Elastic (Amazon ECR) con tutte le altre dipendenze di cui hai bisogno.

Creare il file del modello

Per prima cosa, creiamo un file chiamato serving.properties. Ciò indica a DJLServing di utilizzare il motore Python. Definiamo anche il max_idle_time di un lavoratore pari a 600 secondi. Ciò garantisce che occorrerà più tempo per ridurre il numero di lavoratori di cui disponiamo per modello. Non ci adeguiamo minWorkers ed maxWorkers che possiamo definire e lasciamo che DJL calcoli dinamicamente il numero di lavoratori necessari a seconda del traffico ricevuto da ciascun modello. Il servizio.properties è mostrato come segue. Per visualizzare l'elenco completo delle opzioni di configurazione, fare riferimento a Configurazione del motore.

Successivamente, creiamo il nostro file model.py, che definisce il caricamento del modello e la logica di inferenza. Per gli MME, ogni file model.py è specifico per un modello. I modelli vengono archiviati nei propri percorsi nell'archivio modelli (solitamente /opt/ml/model/). Quando si caricano i modelli, verranno caricati nel percorso dell'archivio modelli nella propria directory. L'esempio completo di model.py in questa demo può essere visto nel file Repository GitHub.

Creiamo un file model.tar.gz file che include il nostro modello (model.joblib), model.pye serving.properties:

A scopo dimostrativo, ne realizziamo 1,000 copie model.tar.gz file per rappresentare il gran numero di modelli da ospitare. In produzione è necessario creare un file model.tar.gz file per ciascuno dei tuoi modelli.

Infine, carichiamo questi modelli su Amazon S3.

Crea un modello SageMaker

Ora creiamo un Modello SageMaker. Utilizziamo l'immagine ECR definita in precedenza e l'artefatto del modello del passaggio precedente per creare il modello SageMaker. Nell'impostazione del modello, configuriamo la modalità come MultiModel. Questo dice a DJLServing che stiamo creando un MME.

Crea un endpoint SageMaker

In questa demo utilizziamo 20 istanze ml.c5d.18xlarge per scalare fino a un TPS nell'ordine delle migliaia. Assicurati di ottenere un aumento del limite sul tipo di istanza, se necessario, per raggiungere il TPS prescelto.

Test di carico

Al momento in cui scrivo, lo strumento di test di carico interno di SageMaker Raccomandatore di inferenza Amazon SageMaker non supporta nativamente i test per gli MME. Pertanto, utilizziamo lo strumento Python open source Locusta. Locust è semplice da configurare e può tenere traccia di parametri come TPS e latenza end-to-end. Per una comprensione completa di come configurarlo con SageMaker, vedere Best practice per il test di carico degli endpoint di inferenza in tempo reale di Amazon SageMaker.

In questo caso d'uso, abbiamo tre diversi modelli di traffico che vogliamo simulare con gli MME, quindi abbiamo i seguenti tre script Python che si allineano con ciascun modello. Il nostro obiettivo qui è dimostrare che, indipendentemente dal nostro modello di traffico, possiamo raggiungere lo stesso TPS target e scalare in modo appropriato.

Possiamo specificare un peso nel nostro script Locust per assegnare il traffico tra diverse parti dei nostri modelli. Ad esempio, con il nostro modello a caldo singolo, implementiamo due metodi come segue:

Possiamo quindi assegnare un certo peso a ciascun metodo, ovvero quando un determinato metodo riceve una percentuale specifica del traffico:

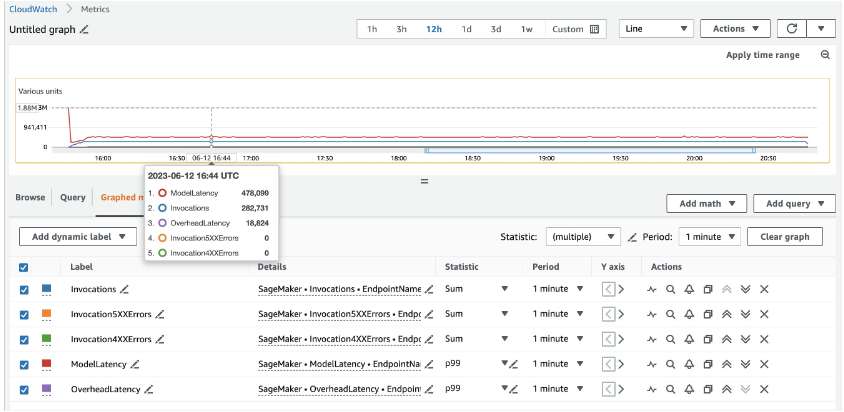

Per 20 istanze ml.c5d.18xlarge, vediamo i seguenti parametri di invocazione sul Amazon Cloud Watch consolle. Questi valori rimangono abbastanza coerenti in tutti e tre i modelli di traffico. Per comprendere meglio i parametri CloudWatch per l'inferenza in tempo reale di SageMaker e gli MME, fare riferimento a Metriche di chiamata dell'endpoint SageMaker.

Puoi trovare il resto degli script Locust nel file directory delle locust-utils nel repository GitHub.

Sommario

In questo post abbiamo discusso di come una MME può regolare dinamicamente la potenza di calcolo assegnata a ciascun modello in base al modello di traffico del modello. Questa funzionalità appena lanciata è disponibile in tutte le regioni AWS in cui è disponibile SageMaker. Tieni presente che al momento dell'annuncio sono supportate solo le istanze CPU. Per saperne di più, fare riferimento a Algoritmi, framework e istanze supportati.

Informazioni sugli autori

Ram Vegiraju è un ML Architect con il team SageMaker Service. Si concentra sull'aiutare i clienti a creare e ottimizzare le loro soluzioni AI/ML su Amazon SageMaker. Nel tempo libero ama viaggiare e scrivere.

Ram Vegiraju è un ML Architect con il team SageMaker Service. Si concentra sull'aiutare i clienti a creare e ottimizzare le loro soluzioni AI/ML su Amazon SageMaker. Nel tempo libero ama viaggiare e scrivere.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato di ricerca. in Ricerca Operativa dopo che ha rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

QingweiLi è uno specialista in machine learning presso Amazon Web Services. Ha conseguito il dottorato di ricerca. in Ricerca Operativa dopo che ha rotto il conto dell'assegno di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che aveva promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a creare soluzioni di machine learning su AWS. Nel tempo libero gli piace leggere e insegnare.

Giacomo Wu è un Senior AI/ML Specialist Solution Architect presso AWS. aiutare i clienti a progettare e realizzare soluzioni AI/ML. Il lavoro di James copre un'ampia gamma di casi d'uso di ML, con un interesse primario per la visione artificiale, il deep learning e la scalabilità del ML in tutta l'azienda. Prima di entrare in AWS, James è stato architetto, sviluppatore e leader tecnologico per oltre 10 anni, di cui 6 in ingegneria e 4 anni nei settori del marketing e della pubblicità.

Giacomo Wu è un Senior AI/ML Specialist Solution Architect presso AWS. aiutare i clienti a progettare e realizzare soluzioni AI/ML. Il lavoro di James copre un'ampia gamma di casi d'uso di ML, con un interesse primario per la visione artificiale, il deep learning e la scalabilità del ML in tutta l'azienda. Prima di entrare in AWS, James è stato architetto, sviluppatore e leader tecnologico per oltre 10 anni, di cui 6 in ingegneria e 4 anni nei settori del marketing e della pubblicità.

Saurabh Trikande è un Senior Product Manager per Amazon SageMaker Inference. È appassionato di lavorare con i clienti ed è motivato dall'obiettivo di democratizzare l'apprendimento automatico. Si concentra sulle sfide principali relative all'implementazione di applicazioni ML complesse, modelli ML multi-tenant, ottimizzazioni dei costi e rendere più accessibile l'implementazione di modelli di deep learning. Nel tempo libero, Saurabh ama fare escursioni, conoscere tecnologie innovative, seguire TechCrunch e trascorrere del tempo con la sua famiglia.

Saurabh Trikande è un Senior Product Manager per Amazon SageMaker Inference. È appassionato di lavorare con i clienti ed è motivato dall'obiettivo di democratizzare l'apprendimento automatico. Si concentra sulle sfide principali relative all'implementazione di applicazioni ML complesse, modelli ML multi-tenant, ottimizzazioni dei costi e rendere più accessibile l'implementazione di modelli di deep learning. Nel tempo libero, Saurabh ama fare escursioni, conoscere tecnologie innovative, seguire TechCrunch e trascorrere del tempo con la sua famiglia.

Xu Deng è un Software Engineer Manager del team SageMaker. Il suo obiettivo è aiutare i clienti a creare e ottimizzare la loro esperienza di inferenza AI/ML su Amazon SageMaker. Nel tempo libero ama viaggiare e fare snowboard.

Xu Deng è un Software Engineer Manager del team SageMaker. Il suo obiettivo è aiutare i clienti a creare e ottimizzare la loro esperienza di inferenza AI/ML su Amazon SageMaker. Nel tempo libero ama viaggiare e fare snowboard.

Siddharth Venkatesan è un ingegnere software in AWS Deep Learning. Attualmente si concentra sulla creazione di soluzioni per l'inferenza di modelli di grandi dimensioni. Prima di AWS ha lavorato nell'organizzazione Amazon Grocery sviluppando nuove funzionalità di pagamento per clienti in tutto il mondo. Al di fuori del lavoro, gli piace sciare, stare all'aria aperta e guardare gli sport.

Siddharth Venkatesan è un ingegnere software in AWS Deep Learning. Attualmente si concentra sulla creazione di soluzioni per l'inferenza di modelli di grandi dimensioni. Prima di AWS ha lavorato nell'organizzazione Amazon Grocery sviluppando nuove funzionalità di pagamento per clienti in tutto il mondo. Al di fuori del lavoro, gli piace sciare, stare all'aria aperta e guardare gli sport.

Rohith Nallamaddi è un ingegnere di sviluppo software presso AWS. Lavora sull'ottimizzazione dei carichi di lavoro di deep learning su GPU, creando inferenza ML ad alte prestazioni e servendo soluzioni. In precedenza, ha lavorato alla creazione di microservizi basati su AWS per il business Amazon F3. Al di fuori del lavoro gli piace giocare e guardare lo sport.

Rohith Nallamaddi è un ingegnere di sviluppo software presso AWS. Lavora sull'ottimizzazione dei carichi di lavoro di deep learning su GPU, creando inferenza ML ad alte prestazioni e servendo soluzioni. In precedenza, ha lavorato alla creazione di microservizi basati su AWS per il business Amazon F3. Al di fuori del lavoro gli piace giocare e guardare lo sport.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :È

- :Dove

- $ SU

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- WRI

- acceleratore

- accessibile

- accessibile

- ospitare

- Il mio account

- Raggiungere

- operanti in

- atti

- aggiungere

- aggiuntivo

- Vantaggio

- Pubblicità

- Dopo shavasana, sedersi in silenzio; saluti;

- AI / ML

- Algoritmi

- allineare

- Tutti

- assegnare

- allocato

- consentire

- consente

- lungo

- già

- anche

- sempre

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- quantità

- an

- ed

- Annuncio

- Un altro

- in qualsiasi

- Apache

- api

- API

- Applicazioni

- applicazioni

- applicato

- appropriatamente

- architettura

- SONO

- in giro

- artificiale

- AS

- addetto

- assumere

- At

- auto

- Automatizzata

- automaticamente

- disponibile

- AWS

- precedente

- BACKEND

- base

- basato

- dosaggio

- BE

- perché

- dietro

- Meglio

- fra

- stile di vita

- Incremento

- limiti

- Scatola

- Rompere

- portare

- Rotto

- costruire

- Costruzione

- costruito

- affari

- ma

- by

- detto

- Materiale

- capacità

- Ultra-Grande

- che

- Custodie

- casi

- cella

- centralizzata

- certo

- sfide

- Controlli

- classe

- cliente

- clienti

- codice

- viene

- completamento di una

- Completato

- complesso

- componente

- Compreso

- Calcolare

- computer

- Visione computerizzata

- informatica

- potenza di calcolo

- concorrente

- Configurazione

- coerente

- costantemente

- consolle

- consumare

- contenere

- Contenitore

- contesto

- continua

- Nucleo

- Costo

- Costi

- Copertine

- creare

- creato

- Creazione

- Attualmente

- costume

- Clienti

- dati

- giorno

- deep

- apprendimento profondo

- Predefinito

- definire

- definito

- definisce

- consegnare

- Richiesta

- dimostrazione

- democratizzare

- dipendenze

- Dipendente

- raffigurato

- schierare

- schierato

- distribuzione

- deployment

- Design

- progettato

- Determinare

- determina

- Costruttori

- Mercato

- dispositivo

- dispositivi

- diagramma

- diverso

- difficile

- direttamente

- elenco

- discutere

- discusso

- distribuzione

- docker

- non

- Dont

- giù

- scaricare

- il download

- dinamico

- dinamicamente

- ogni

- In precedenza

- efficiente

- in modo efficiente

- senza sforzo

- o

- altrove

- incorporamento

- enable

- Abilita

- incapsulato

- da un capo all'altro

- endpoint

- motore

- ingegnere

- Ingegneria

- abbastanza

- garantire

- Impresa

- Ambiente

- errore

- Anche

- esempio

- eccezione

- aspetta

- aspetta

- esperienza

- estendere

- Faccia

- fallito

- abbastanza

- famiglia

- caratteristica

- Caratteristiche

- pochi

- Compila il

- File

- finanziario

- servizio finanziario

- Trovate

- Nome

- fisso

- FLOTTA

- si concentra

- i seguenti

- segue

- Nel

- formato

- Contesto

- quadri

- frequentemente

- da

- Frontend

- pieno

- completamente

- funzionalità

- generare

- ottenere

- si

- GitHub

- scopo

- GPU

- GPU

- concedere

- maggiore

- maniglia

- accadere

- Hardware

- Avere

- he

- Aiuto

- aiutare

- aiuta

- qui

- Alta

- superiore

- vivamente

- il suo

- host

- ospitato

- di hosting

- HOT

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Idle

- if

- illustra

- Immagine

- realizzare

- implementazione

- importare

- in

- includere

- inclusi

- Compreso

- In arrivo

- Aumento

- crescente

- industrie

- industria

- informazioni

- Infrastruttura

- inizialmente

- creativi e originali

- tecnologie innovative

- ingresso

- installato

- esempio

- invece

- assicurazione

- integrazione

- integrazioni

- interesse

- Interfaccia

- ai miglioramenti

- invocato

- problema

- sicurezza

- IT

- SUO

- Giacomo

- Java

- Lavoro

- accoppiamento

- jpg

- ad appena

- Lingua

- grandi

- superiore, se assunto singolarmente.

- Latenza

- con i più recenti

- lanciato

- portare

- leader

- Leads

- IMPARARE

- apprendimento

- lasciare

- Livello

- Biblioteca

- piace

- piace

- LIMITE

- lineare

- Lista

- caricare

- Caricamento in corso

- carichi

- locale

- logica

- più a lungo

- ama

- Basso

- inferiore

- macchina

- machine learning

- Principale

- Maggioranza

- make

- FA

- Fare

- gestito

- direttore

- gestione

- molti

- Marketing

- Marketing e pubblicità

- massimo

- Maggio..

- meccanismi di

- Memorie

- Metadati

- metodo

- metodi

- Metrica

- microservices

- forza

- ordine

- minuto

- Ridurre la perdita dienergia con una

- ML

- Moda

- modello

- modelli

- Moduli

- Scopri di più

- maggior parte

- motivato

- multiplo

- Nome

- nativamente

- necessaria

- Bisogno

- di applicazione

- New

- recentemente

- premio Nobel

- Nessuna

- Nota

- taccuino

- adesso

- numero

- numpy

- of

- offrire

- Offerte

- on

- ONE

- esclusivamente

- aprire

- open source

- Operazioni

- di fronte

- ottimizzazioni

- OTTIMIZZA

- ottimizzati

- ottimizzazione

- Opzioni

- or

- Altro

- nostro

- su

- all'aperto

- produzione

- al di fuori

- ancora

- proprio

- Parallel

- parametri

- parte

- particolare

- Ricambi

- appassionato

- sentiero

- percorsi

- Cartamodello

- modelli

- Pagamento

- per

- percentuale

- Eseguire

- performance

- tubo

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- i plugin

- punto

- politica

- Piscine

- Popolare

- Post

- energia

- pratiche

- precedente

- predizione

- Previsioni

- precedente

- in precedenza

- primario

- Precedente

- premio

- Problema

- processi

- lavorazione

- Prodotto

- product manager

- Produzione

- Programmazione

- promesso

- propriamente

- proprietà

- Dimostra

- fornire

- fornisce

- fornitura

- scopo

- fini

- Spingi

- spinto

- Python

- pytorch

- casuale

- gamma

- Leggi

- Lettura

- pronto

- tempo reale

- ricevere

- ricevuto

- riceve

- ricevente

- raccomandato

- riferimento

- Indipendentemente

- regione

- regioni

- relazionato

- rimanere

- sostituire

- deposito

- rappresentare

- richiesta

- richieste

- Requisiti

- riparazioni

- Risorse

- risposta

- REST

- colpevole

- problemi

- riutilizzare

- strada

- percorsi

- instradamento

- Correre

- corre

- runtime

- SaaS

- sagemaker

- Inferenza di SageMaker

- stesso

- campione

- Risparmi

- dire

- Scala

- scalato

- bilancia

- scala

- copione

- script

- Secondo

- secondo

- vedere

- visto

- AUTO

- inviare

- anziano

- servire

- servito

- server

- Server

- servizio

- Servizi

- servizio

- set

- Set

- flessibile.

- alcuni

- dovrebbero

- vetrina

- mostrato

- Spettacoli

- Un'espansione

- simulare

- contemporaneamente

- singolo

- singolare

- Taglia

- piccole

- frammento

- So

- Software

- software come un servizio

- lo sviluppo del software

- Software Engineer

- soluzione

- Soluzioni

- alcuni

- Fonte

- specialista

- specifico

- Spendere

- dividere

- Sports

- pila

- statico

- step

- conservazione

- Tornare al suo account

- memorizzati

- lineare

- successivo

- tale

- suggerire

- supporto

- supportato

- supporti

- sicuro

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- presa

- Target

- mira

- Insegnamento

- team

- TechCrunch

- Tecnologie

- Tecnologia

- dice

- tensorflow

- Testing

- test

- di

- che

- Il

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- mille

- migliaia

- tre

- Attraverso

- portata

- tempo

- volte

- a

- pure

- top

- verso

- tps

- pista

- traffico

- Treni

- allenato

- Training

- Le transazioni

- trasformatori

- Di viaggio

- prova

- seconda

- Digitare

- tipicamente

- per

- sottostante

- capire

- e una comprensione reciproca

- universale

- URL

- uso

- caso d'uso

- utilizzato

- usa

- utilizzando

- generalmente

- Utilizzando

- APPREZZIAMO

- Valori

- variabile

- vario

- visione

- vs

- volere

- Prima

- guardare

- we

- sito web

- servizi web

- peso

- Che

- quando

- mentre

- quale

- largo

- Vasta gamma

- volere

- con

- entro

- Lavora

- lavorato

- lavoratore

- lavoratori

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- sarebbe

- scrittura

- scritto

- X

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro