Molte aziende sono sopraffatte dall'abbondante volume di documenti che devono elaborare, organizzare e classificare per servire meglio i propri clienti. Esempi di tali possono essere richieste di prestito, dichiarazione dei redditi e fatturazione. Tali documenti sono più comunemente ricevuti in formati immagine e sono per lo più a più pagine e in formato di bassa qualità. Per essere più competitive ed efficienti in termini di costi e per rimanere sicure e conformi allo stesso tempo, queste aziende devono evolvere le proprie capacità di elaborazione dei documenti per ridurre i tempi di elaborazione e migliorare l'accuratezza della classificazione in modo automatizzato e scalabile. Queste aziende devono affrontare le seguenti sfide nell'elaborazione dei documenti:

- Esecuzione della moderazione sui documenti per rilevare contenuti inappropriati, indesiderati o offensivi

- La classificazione manuale dei documenti, adottata dalle aziende più piccole, è dispendiosa in termini di tempo, soggetta a errori e costosa

- Le tecniche OCR con sistemi basati su regole non sono abbastanza intelligenti e non possono adattarsi ai cambiamenti nel formato del documento

- Le aziende che adottano approcci di machine learning (ML) spesso non hanno risorse per ridimensionare il proprio modello per gestire i picchi nel volume dei documenti in entrata

Questo post affronta queste sfide e fornisce un'architettura che risolve efficacemente questi problemi. Mostriamo come puoi usare Rekognition di Amazon ed Testo Amazon per ottimizzare e ridurre gli sforzi umani nell'elaborazione dei documenti. Amazon Rekognition identifica le etichette di moderazione nel documento e le classifica utilizzando Etichette personalizzate Amazon Rekognition. Amazon Texttract estrae il testo dai tuoi documenti.

In questo post, trattiamo la creazione di due pipeline ML (formazione e inferenza) per elaborare i documenti senza la necessità di alcuno sforzo manuale o codice personalizzato. I passaggi di alto livello nella pipeline di inferenza includono:

- Esegui la moderazione sui documenti caricati utilizzando Amazon Rekognition.

- Classifica i documenti in diverse categorie come W-2, fatture, estratti conto bancari e buste paga utilizzando Rekognition Custom Labels.

- Estrai testo da documenti come testo stampato, scrittura a mano, moduli e tabelle utilizzando Amazon Texttract.

Panoramica della soluzione

Questa soluzione utilizza i seguenti servizi di intelligenza artificiale, tecnologie senza server e servizi gestiti per implementare un'architettura scalabile ed economica:

- Amazon DynamoDB - Un database di documenti e valori-chiave che offre prestazioni in millisecondi a una cifra su qualsiasi scala.

- Amazon EventBridge – Un bus di eventi serverless per creare applicazioni basate su eventi su larga scala utilizzando eventi generati dalle tue applicazioni, applicazioni SaaS (Software as a Service) integrate e servizi AWS.

- AWS Lambda – Un servizio di elaborazione serverless che consente di eseguire codice in risposta a trigger quali modifiche ai dati, cambiamenti nello stato del sistema o azioni dell'utente.

- Rekognition di Amazon – Utilizza il ML per identificare oggetti, persone, testo, scene e attività in immagini e video, nonché per rilevare qualsiasi contenuto inappropriato.

- Etichette personalizzate Amazon Rekognition – Utilizza AutoML per la visione artificiale e il trasferimento dell'apprendimento per aiutarti ad addestrare modelli personalizzati per identificare gli oggetti e le scene nelle immagini che sono specifiche per le tue esigenze aziendali.

- Servizio di archiviazione semplice Amazon (Amazon S3) – Funge da archivio oggetti per i tuoi documenti e consente la gestione centralizzata con controlli di accesso ottimizzati.

- Funzioni Amazon Step – Un orchestratore di funzioni serverless che semplifica la sequenza di funzioni Lambda e più servizi in applicazioni business-critical.

- Testo Amazon - Utilizza ML per estrarre testo e dati dai documenti scansionati nei formati PDF, JPEG o PNG.

Il diagramma seguente illustra l'architettura della pipeline di inferenza.

Il nostro flusso di lavoro include i seguenti passaggi:

Il nostro flusso di lavoro include i seguenti passaggi:

- L'utente carica i documenti nel bucket S3 di input.

- Il caricamento attiva un file Notifica di eventi Amazon S3 per fornire eventi in tempo reale direttamente a EventBridge. Gli eventi Amazon S3 che corrispondono a "

object created” filtro definito per un Regola EventBridge avvia il flusso di lavoro di Step Functions. - Il flusso di lavoro Step Functions attiva una serie di funzioni Lambda, che eseguono le seguenti attività:

- La prima funzione esegue attività di preelaborazione ed effettua chiamate API ad Amazon Rekognition:

- Se i documenti in arrivo sono in formato immagine (come JPG o PNG), la funzione richiama l'API Amazon Rekognition e fornisce i documenti come oggetti S3. Tuttavia, se il documento è in formato PDF, la funzione trasmette i byte dell'immagine quando chiama l'API Amazon Rekognition.

- Se un documento contiene più pagine, la funzione divide il documento in singole pagine e le salva in una cartella intermedia nel bucket S3 di output prima di elaborarle singolarmente.

- Al termine delle attività di preelaborazione, la funzione effettua una chiamata API ad Amazon Rekognition per rilevare contenuti inappropriati, indesiderati o offensivi ed effettua un'altra chiamata API al modello Rekognition Custom Labels addestrato per classificare i documenti.

- La seconda funzione effettua una chiamata API ad Amazon Textract per avviare un processo per estrarre il testo dal documento di input e archiviarlo nel bucket S3 di output.

- La terza funzione archivia i metadati del documento come etichetta di moderazione, classificazione del documento, affidabilità della classificazione, ID processo Amazon Textract e percorso del file in una tabella DynamoDB.

- La prima funzione esegue attività di preelaborazione ed effettua chiamate API ad Amazon Rekognition:

È possibile regolare il flusso di lavoro in base alle proprie esigenze, ad esempio è possibile aggiungere una funzionalità di elaborazione del linguaggio naturale (NLP) in questo flusso di lavoro utilizzando Amazon Comprehend per ottenere informazioni dettagliate sul testo estratto.

Condotto di formazione

Prima di distribuire questa architettura, formiamo un modello personalizzato per classificare i documenti in diverse categorie utilizzando Rekognition Custom Labels. Nella pipeline di formazione, etichettiamo i documenti utilizzando Amazon SageMaker verità fondamentale. Quindi utilizziamo i documenti etichettati per addestrare un modello con Rekognition Custom Labels. In questo esempio, utilizziamo un Amazon Sage Maker notebook per eseguire questi passaggi, ma puoi anche annotare le immagini utilizzando la console Rekognition Custom Labels. Per istruzioni, fare riferimento a Etichettare le immagini.

dataset

Per addestrare il modello, utilizziamo i seguenti set di dati pubblici contenenti W2 e fatture:

Puoi utilizzare un altro set di dati rilevante per il tuo settore.

La tabella seguente riassume le suddivisioni del set di dati tra training e testing.

| Classe | Set di allenamento | Set di prova |

| Fatture | 352 | 75 |

| W-2 | 86 | 16 |

| Totale | 438 | 91 |

Distribuisci la pipeline di formazione con AWS CloudFormation

Distribuisci un file AWS CloudFormazione modello per fornire il necessario Gestione dell'identità e dell'accesso di AWS (IAM) ruoli e componenti della pipeline di formazione, inclusa un'istanza notebook SageMaker.

- Avvia il seguente modello CloudFormation nella regione Stati Uniti orientali (Virginia settentrionale):

- Nel Nome dello stack, inserisci un nome, ad esempio

document-processing-training-pipeline. - Scegli Avanti.

- Nel Funzionalità e trasformazioni sezione, seleziona la casella di controllo per confermare che AWS CloudFormation potrebbe creare Risorse IAM.

- Scegli Crea stack.

La pagina dei dettagli dello stack dovrebbe mostrare lo stato dello stack come CREATE_IN_PROGRESS. Potrebbero essere necessari fino a 5 minuti affinché lo stato cambi in CREATE_COMPLETE. Al termine, puoi visualizzare gli output sul file Uscite scheda.

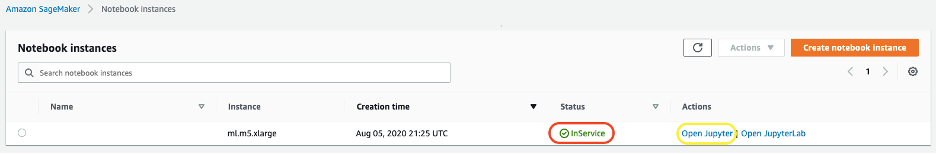

- Dopo che lo stack è stato avviato correttamente, apri la console SageMaker e scegli Istanze di notebook nel nome di navigazione.

- Cerca un'istanza con il

DocProcessingNotebookInstance-prefisso e attendere che il suo stato sia InService. - Sotto Azioniscegli Apri Jupyter.

Esegui il taccuino di esempio

Per eseguire il notebook, completare i seguenti passi:

- Scegliere il

Rekognition_Custom_Labelsesempio taccuino.

- Scegli Correre per eseguire le celle nel notebook di esempio in ordine.

Il notebook illustra l'intero ciclo di vita della preparazione delle immagini di training e di test, etichettatura, creazione di file manifest, training di un modello ed esecuzione del modello addestrato con Rekognition Custom Labels. In alternativa, puoi addestrare ed eseguire il modello utilizzando la console Rekognition Custom Labels. Per istruzioni, fare riferimento a Addestrare un modello (Console).

Il taccuino è autoesplicativo; puoi seguire i passaggi per completare l'addestramento del modello.

- Prendi nota del

ProjectVersionArnper fornire la pipeline di inferenza in un passaggio successivo.

Per le istanze notebook SageMaker, ti viene addebitato il tipo di istanza scelto, in base alla durata dell'utilizzo. Al termine dell'addestramento del modello, è possibile arrestare l'istanza notebook per evitare il costo delle risorse inattive.

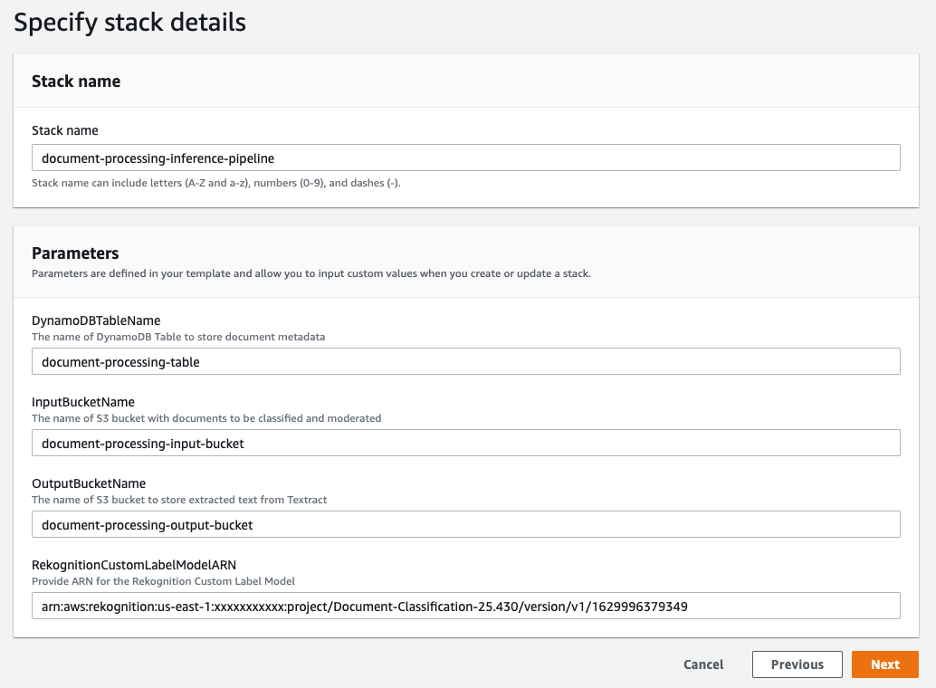

Distribuisci la pipeline di inferenza con AWS CloudFormation

Per distribuire la pipeline di inferenza, completare i seguenti passaggi:

- Avvia il seguente modello CloudFormation nella regione Stati Uniti orientali (Virginia settentrionale):

- Nel Nome dello stack, inserisci un nome, ad esempio

document-processing-inference-pipeline. - Nel DynamoDBTableName, inserisci un nome di tabella DynamoDB univoco; Per esempio,

document-processing-table. - Nel NomeBucketInput, inserisci un nome univoco per il bucket S3 creato dallo stack; Per esempio,

document-processing-input-bucket.

I documenti di input vengono caricati in questo bucket prima di essere elaborati. Utilizza solo caratteri minuscoli e senza spazi quando crei il nome del bucket di input. Inoltre, questa operazione crea un nuovo bucket S3, quindi non utilizzare il nome di un bucket esistente. Per ulteriori informazioni, vedere Regole per la denominazione della benna.

- Nel NomeBucket di output, inserisci un nome univoco per il tuo bucket di output; per esempio, d

ocument-processing-output-bucket.

Questo bucket archivia i documenti di output dopo che sono stati elaborati. Memorizza anche pagine di documenti di input PDF multipagina dopo che sono state divise dalla funzione Lambda. Segui le stesse regole di denominazione del tuo bucket di input.

- Nel RecognitionCustomLabelModelARN, Inserisci il

ProjectVersionArnvalore che hai notato dal taccuino di Jupyter. - Scegli Avanti.

- Sulla Configura le opzioni di stack pagina, imposta eventuali parametri aggiuntivi per lo stack, inclusi i tag.

- Scegli Avanti.

- Nel Funzionalità e trasformazioni sezione, seleziona la casella di controllo per riconoscere che AWS CloudFormation potrebbe creare risorse IAM.

- Scegli Crea stack.

La pagina dei dettagli dello stack dovrebbe mostrare lo stato dello stack come CREATE_IN_PROGRESS. Potrebbero essere necessari fino a 5 minuti affinché lo stato cambi in CREATE_COMPLETE. Al termine, puoi visualizzare gli output sul file Uscite scheda.

Elabora un documento attraverso la pipeline

Abbiamo distribuito sia pipeline di formazione che di inferenza e ora siamo pronti per utilizzare la soluzione ed elaborare un documento.

- Sulla console Amazon S3, apri il bucket di input.

- Carica un documento di esempio nella cartella S3.

Questo avvia il flusso di lavoro. Il processo popola la tabella DynamoDB con la classificazione del documento e le etichette di moderazione. L'output di Amazon Texttract viene consegnato al bucket S3 di output in TextractOutput cartella.

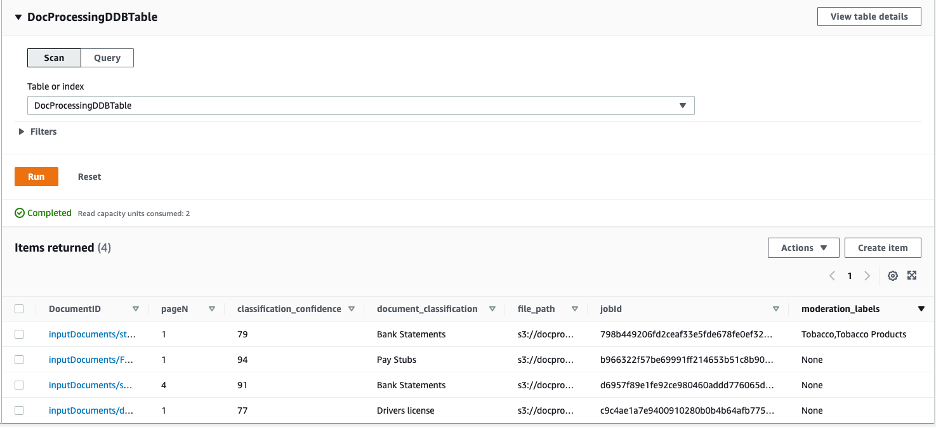

Abbiamo inviato alcuni documenti di esempio diversi al flusso di lavoro e abbiamo ricevuto le seguenti informazioni compilate nella tabella DynamoDB.

Se non vedi elementi nella tabella DynamoDB o documenti caricati nel bucket S3 di output, controlla il Log di Amazon CloudWatch per la funzione Lambda corrispondente e cercare potenziali errori che hanno causato l'errore.

ripulire

Completare i seguenti passaggi per ripulire le risorse distribuite per questa soluzione:

- Nella console CloudFormation, scegli Stacks.

- Seleziona gli stack distribuiti per questa soluzione.

- Scegli Elimina.

Questi passaggi non eliminano i bucket S3, la tabella DynamoDB e il modello Rekognition Custom Labels addestrato. Continui a incorrere in costi di archiviazione se non vengono eliminati. Dovresti eliminare queste risorse direttamente tramite le rispettive console di servizio se non ne hai più bisogno.

Conclusione

In questo post, abbiamo presentato un approccio scalabile, sicuro e automatizzato per moderare, classificare ed elaborare i documenti. Le aziende di più settori possono utilizzare questa soluzione per migliorare la propria attività e servire meglio i propri clienti. Consente un'elaborazione dei documenti più rapida e una maggiore precisione e riduce la complessità dell'estrazione dei dati. Fornisce inoltre una migliore sicurezza e conformità con la legislazione sui dati personali riducendo la forza lavoro umana coinvolta nell'elaborazione dei documenti in arrivo.

Per ulteriori informazioni, vedere la Guida alle etichette personalizzate di Amazon Rekognition, Guida per gli sviluppatori di Amazon Rekognition ed Guida per gli sviluppatori di Amazon Texttract. Se non conosci Amazon Rekognition Custom Labels, provalo utilizzando il nostro piano gratuito, che dura 3 mesi e include 10 ore di formazione gratuite al mese e 4 ore di inferenza gratuite al mese. Il piano gratuito di Amazon Rekognition include l'elaborazione di 5,000 immagini al mese per 12 mesi. Anche il piano gratuito di Amazon Textract dura tre mesi e include 1,000 pagine al mese per l'API di rilevamento del testo del documento.

Informazioni sugli autori

Jay Rao è Principal Solutions Architect presso AWS. Gli piace fornire una guida tecnica e strategica ai clienti e aiutarli a progettare e implementare soluzioni su AWS.

Jay Rao è Principal Solutions Architect presso AWS. Gli piace fornire una guida tecnica e strategica ai clienti e aiutarli a progettare e implementare soluzioni su AWS.

Uchenna Egbe è Associate Solutions Architect presso AWS. Trascorre il suo tempo libero ricercando erbe, tè, supercibi e come incorporarli nella sua dieta quotidiana.

Uchenna Egbe è Associate Solutions Architect presso AWS. Trascorre il suo tempo libero ricercando erbe, tè, supercibi e come incorporarli nella sua dieta quotidiana.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/moderate-classify-and-process-documents-using-amazon-rekognition-and-amazon-textract/

- "

- 000

- 10

- 100

- 116

- 12 mesi

- WRI

- accesso

- operanti in

- azioni

- attività

- aggiuntivo

- AI

- Servizi di intelligenza artificiale

- Amazon

- Un altro

- api

- applicazioni

- approccio

- architettura

- Associate

- Automatizzata

- AWS

- Banca

- prima

- fatturazione

- sistema

- Scatola

- costruire

- Costruzione

- autobus

- affari

- chiamata

- funzionalità

- ha causato

- centrale

- sfide

- il cambiamento

- carico

- oneri

- Scegli

- classificazione

- codice

- Aziende

- competitivo

- conformità

- compiacente

- Calcolare

- computer

- fiducia

- consolle

- contiene

- contenuto

- continua

- Corrispondente

- costo effettivo

- coprire

- creare

- crea

- Creazione

- costume

- Clienti

- dati

- Banca Dati

- consegnato

- fornisce un monitoraggio

- schierare

- schierato

- Design

- dettagli

- Costruttori

- Dieta

- diverso

- direttamente

- documenti

- in modo efficiente

- sforzo

- sforzi

- entrare

- Evento

- eventi

- evolvere

- esempio

- Esempi

- esistente

- estratti

- Faccia

- Fallimento

- più veloce

- Nome

- seguire

- i seguenti

- modulo

- formato

- forme

- Gratis

- function

- funzioni

- Inoltre

- maniglia

- Aiuto

- aiutare

- superiore

- Come

- Tuttavia

- HTTPS

- umano

- identificare

- Identità

- Immagine

- realizzare

- competenze

- includere

- inclusi

- Compreso

- individuale

- industrie

- industria

- informazioni

- ingresso

- intuizioni

- integrato

- Intelligente

- coinvolto

- IT

- Lavoro

- etichettatura

- per il tuo brand

- Lingua

- lanciato

- apprendimento

- Legislazione

- macchina

- machine learning

- FA

- gestito

- gestione

- Manuale

- partita

- forza

- ML

- modello

- modelli

- Mese

- mese

- Scopri di più

- multiplo

- Naturale

- Navigazione

- necessaria

- esigenze

- taccuino

- aprire

- operazione

- OTTIMIZZA

- minimo

- Paga le

- Persone

- performance

- cronologia

- dati personali

- potenziale

- Direttore

- problemi

- processi

- lavorazione

- fornire

- fornisce

- fornitura

- la percezione

- tempo reale

- ricevuto

- ridurre

- riducendo

- pertinente

- Risorse

- risposta

- norme

- Correre

- running

- scalabile

- Scala

- Scene

- sicuro

- problemi di

- Serie

- serverless

- servizio

- Servizi

- set

- Un'espansione

- So

- Software

- software come un servizio

- solido

- soluzione

- Soluzioni

- risolve

- spazi

- dividere

- Si divide

- pila

- inizio

- Regione / Stato

- dichiarazioni

- Stato dei servizi

- soggiorno

- conservazione

- Tornare al suo account

- negozi

- Strategico

- presentata

- Con successo

- sistema

- SISTEMI DI TRATTAMENTO

- task

- imposta

- Consulenza

- tecniche

- Tecnologie

- test

- Testing

- Attraverso

- tempo

- richiede tempo

- volte

- Training

- trasferimento

- unico

- us

- uso

- APPREZZIAMO

- Convalida

- Video

- Visualizza

- Virginia

- visione

- volume

- aspettare

- senza

- Forza lavoro