Intelligenza artificiale generativa (IA generativa) hanno dimostrato capacità impressionanti nel generare testo, immagini e altri contenuti di alta qualità. Tuttavia, questi modelli richiedono enormi quantità di dati di addestramento puliti e strutturati per raggiungere il loro pieno potenziale. La maggior parte dei dati del mondo reale esiste in formati non strutturati come i PDF, che richiedono una preelaborazione prima di poter essere utilizzati in modo efficace.

Secondo IDC, oggi i dati non strutturati rappresentano oltre l'80% di tutti i dati aziendali. Ciò include formati come e-mail, PDF, documenti scansionati, immagini, audio, video e altro ancora. Sebbene questi dati contengano informazioni preziose, la loro natura non strutturata rende difficile per gli algoritmi di intelligenza artificiale interpretarli e imparare da essi. Secondo a Sondaggio 2019 di Deloitte, solo il 18% delle aziende ha dichiarato di essere in grado di trarre vantaggio dai dati non strutturati.

Poiché l’adozione dell’intelligenza artificiale continua ad accelerare, lo sviluppo di meccanismi efficienti per digerire e apprendere da dati non strutturati diventerà ancora più critico in futuro. Ciò potrebbe comportare migliori strumenti di preelaborazione, tecniche di apprendimento semi-supervisionato e progressi nell’elaborazione del linguaggio naturale. Le aziende che utilizzano i propri dati non strutturati nel modo più efficace otterranno vantaggi competitivi significativi dall’intelligenza artificiale. La pulizia dei dati è importante per una buona prestazione del modello. I testi estratti contengono ancora grandi quantità di testo incomprensibile e standard (ad esempio, leggi HTML). I dati raschiati da Internet contengono spesso molte duplicazioni. Anche i dati provenienti dai social media, dalle recensioni o da qualsiasi contenuto generato dagli utenti possono contenere contenuti tossici e distorti e potrebbe essere necessario filtrarli utilizzando alcuni passaggi di pre-elaborazione. Potrebbero anche esserci molti contenuti di bassa qualità o testi generati da bot, che possono essere filtrati utilizzando i metadati di accompagnamento (ad esempio, filtrare le risposte del servizio clienti che hanno ricevuto valutazioni basse da parte dei clienti).

La preparazione dei dati è importante in più fasi del recupero della generazione aumentata (RAG) Modelli. I documenti di origine della conoscenza necessitano di preelaborazione, come la pulizia del testo e la generazione di incorporamenti semantici, in modo che possano essere indicizzati e recuperati in modo efficiente. Anche la query in linguaggio naturale dell’utente richiede una preelaborazione, in modo che possa essere codificata in un vettore e confrontata con gli incorporamenti del documento. Dopo aver recuperato i contesti rilevanti, potrebbero aver bisogno di un'ulteriore preelaborazione, come il troncamento, prima di essere concatenati alla query dell'utente per creare il prompt finale per il modello di base. Tela di Amazon SageMaker ora supporta funzionalità complete di preparazione dei dati fornite da Gestore di dati di Amazon SageMaker. Con questa integrazione, SageMaker Canvas offre ai clienti uno spazio di lavoro end-to-end senza codice per preparare i dati, creare e utilizzare modelli ML e di base per accelerare il tempo che passa dai dati agli insight aziendali. Ora puoi scoprire e aggregare facilmente dati da oltre 50 origini dati ed esplorare e preparare i dati utilizzando oltre 300 analisi e trasformazioni integrate nell'interfaccia visiva di SageMaker Canvas.

Panoramica della soluzione

In questo post lavoriamo con un set di dati di documentazione PDF:Roccia Amazzonica guida utente. Inoltre, mostriamo come preelaborare un set di dati per RAG. Nello specifico, puliamo i dati e creiamo artefatti RAG per rispondere alle domande sul contenuto del set di dati. Considera il seguente problema di machine learning (ML): l'utente pone una domanda sul modello di linguaggio di grandi dimensioni (LLM): "Come filtrare e cercare modelli in Amazon Bedrock?". LLM non ha visto la documentazione durante la fase di formazione o messa a punto, quindi non sarebbe in grado di rispondere alla domanda e molto probabilmente avrà allucinazioni. Il nostro obiettivo con questo post è trovare una parte di testo pertinente dal PDF (ad esempio RAG) e allegarla al prompt, consentendo così a LLM di rispondere a domande specifiche su questo documento.

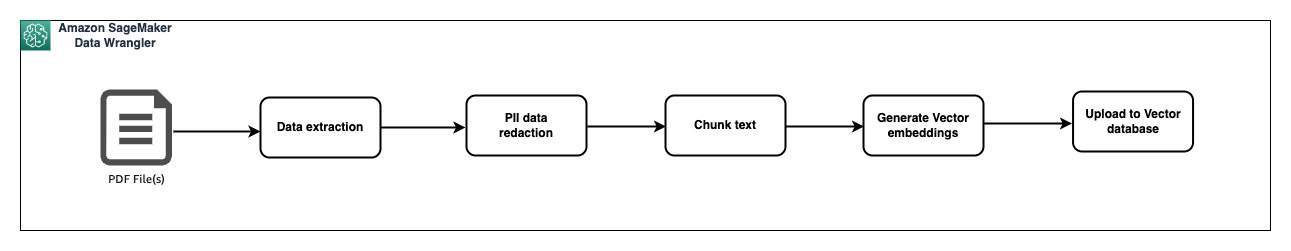

Di seguito, mostriamo come eseguire tutti questi principali passaggi di preelaborazione da Tela di Amazon SageMaker (offerto da Gestore di dati di Amazon SageMaker):

- Estrazione di testo da un documento PDF (con tecnologia Textract)

- Rimuovere le informazioni sensibili (fornito da Comprehend)

- Suddividi il testo in pezzi.

- Crea incorporamenti per ogni pezzo (fornito da Bedrock).

- Carica l'incorporamento in un database vettoriale (fornito da OpenSearch)

Prerequisiti

Per questa procedura dettagliata, dovresti avere quanto segue:

Note:: Crea i domini del servizio OpenSearch seguendo le istruzioni qui. Per semplicità, scegliamo l'opzione con un nome utente e una password principali per un controllo degli accessi capillare. Una volta creato il dominio, crea un indice vettoriale con le seguenti mappature e la dimensione vettoriale 1536 si allinea con gli incorporamenti di Amazon Titan:

Soluzione

Costruisci un flusso di dati

In questa sezione, spieghiamo come creare un flusso di dati per estrarre testo e metadati da PDF, pulire ed elaborare i dati, generare incorporamenti utilizzando Amazon Bedrock e indicizzare i dati in Amazon OpenSearch.

Avvia SageMaker Canvas

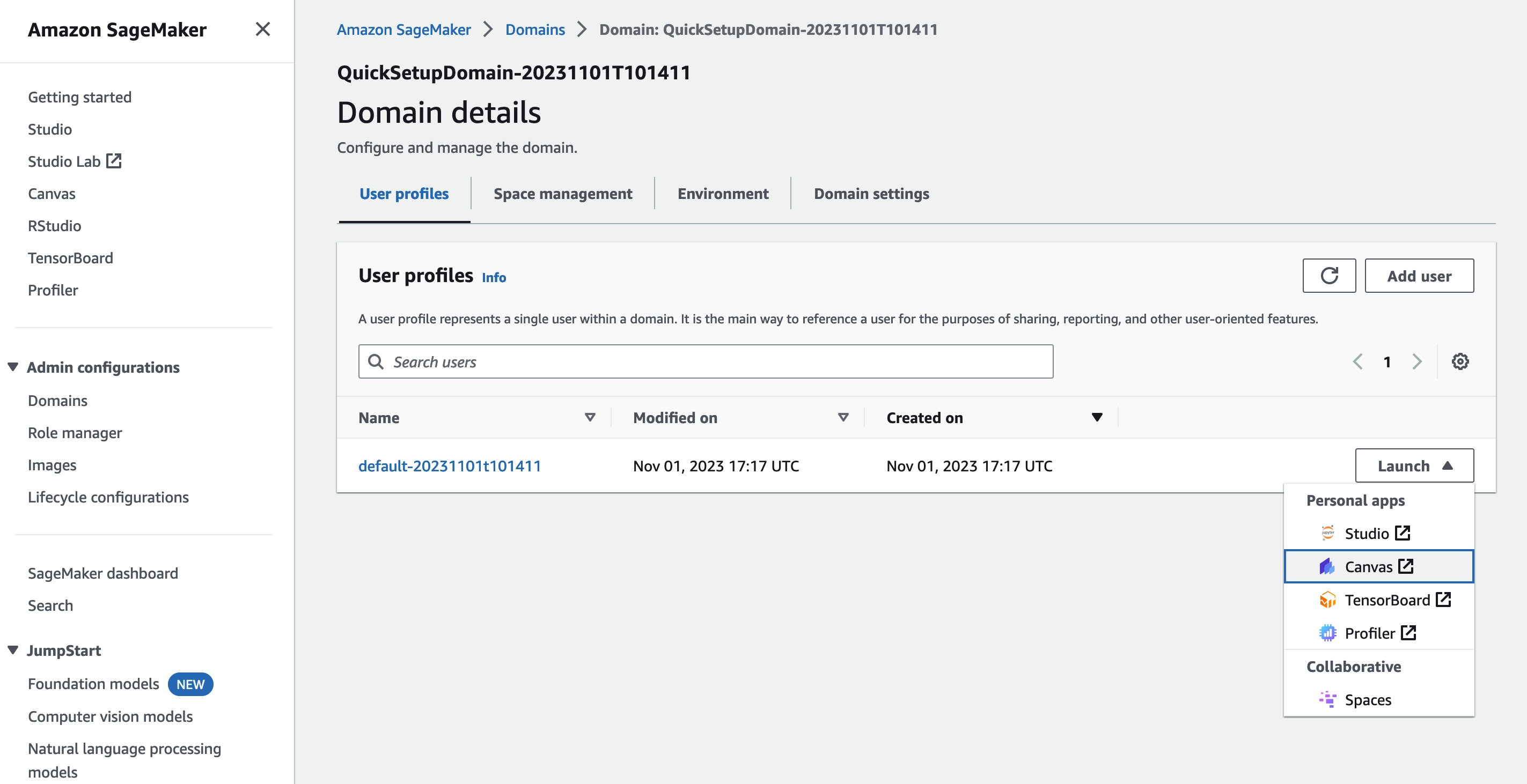

Per avviare SageMaker Canvas, completare i seguenti passaggi:

- In Amazzonia Console SageMakerscegli Domini nel pannello di navigazione.

- Scegli il tuo dominio.

- Nel menu di avvio, scegli Canvas.

Creare un flusso di dati

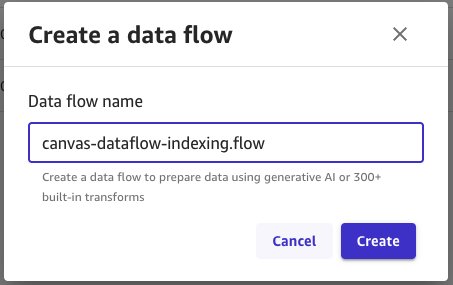

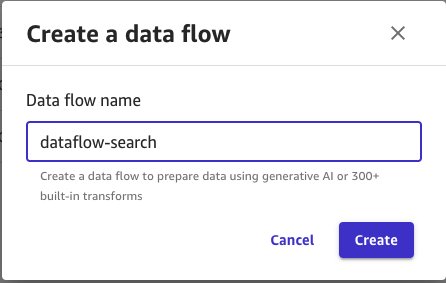

Completa i seguenti passaggi per creare un flusso di dati in SageMaker Canvas:

- Nella home page di SageMaker Canvas, scegli Wrangler di dati.

- Scegli Creare sul lato destro della pagina, quindi assegnare un nome al flusso di dati e selezionare Creare.

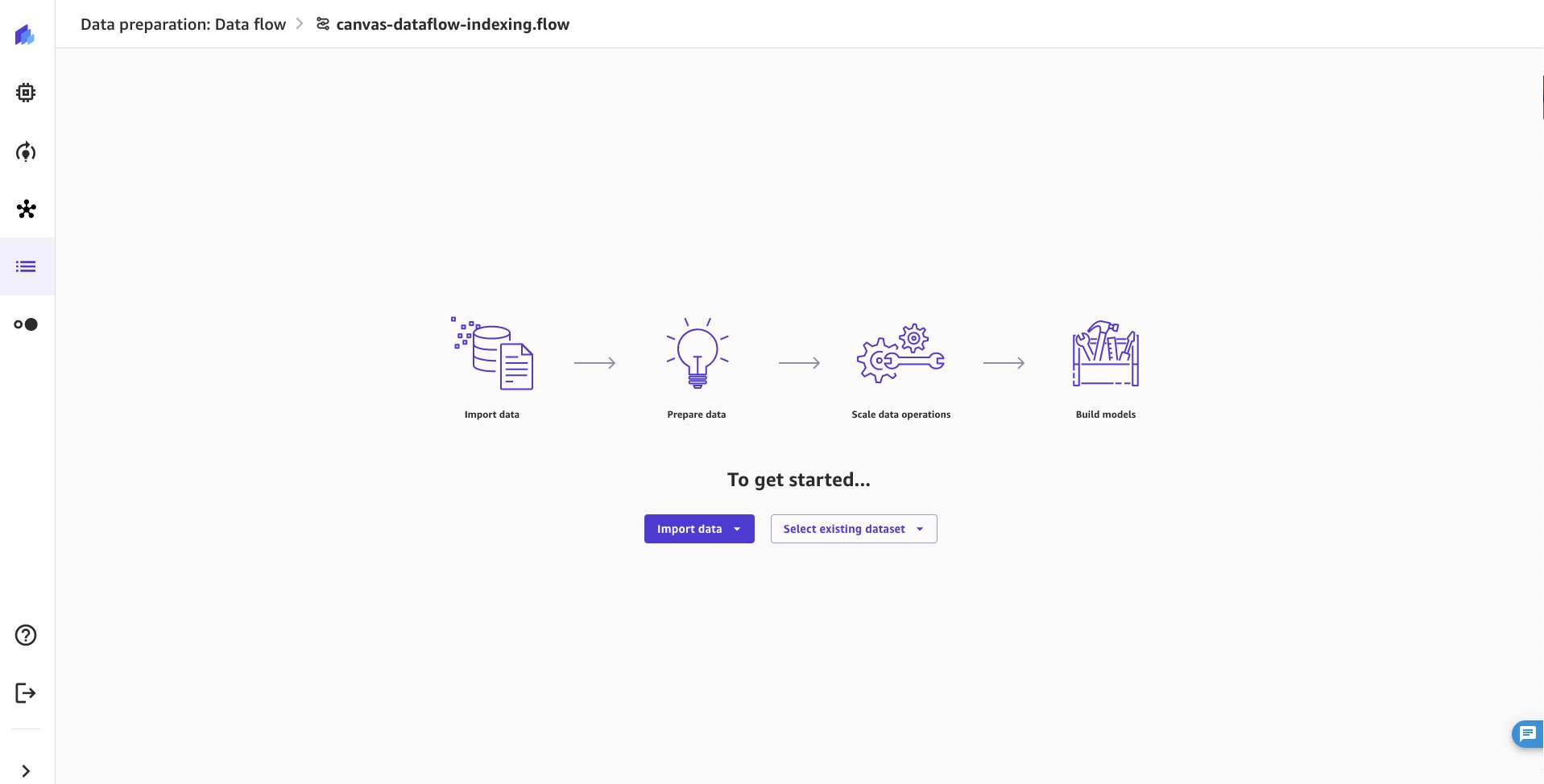

- Verrà visualizzata una pagina del flusso di dati.

- Scegli Importa le date, selezionare i dati tabellari.

Ora importiamo i dati dal bucket Amazon S3:

- Scegli Importa le date e seleziona di tabella dall'elenco a discesa.

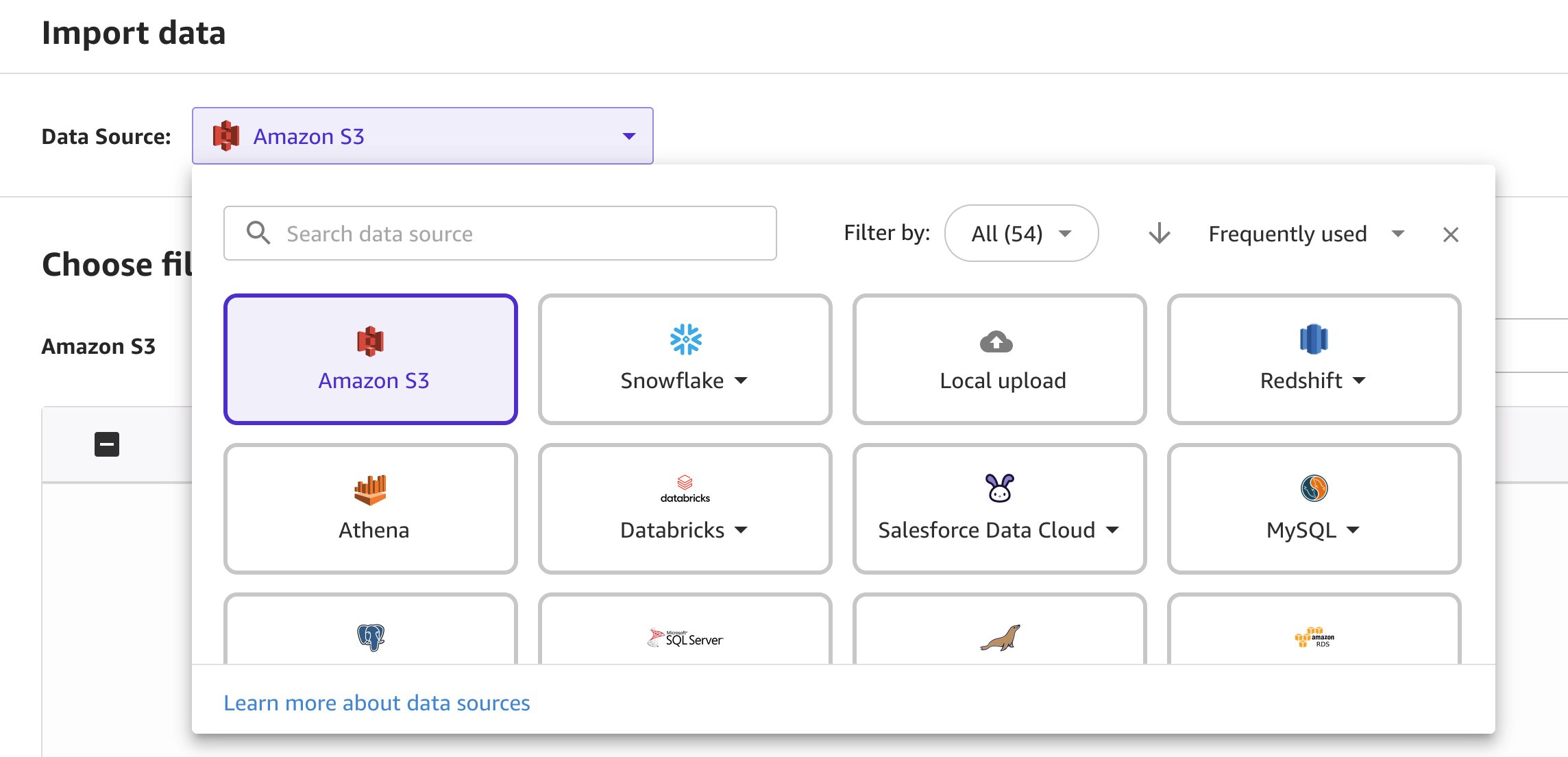

- Fonte di dati e seleziona Amazon S3 dall'elenco a discesa.

- Passare al file di metadati con i percorsi dei file PDF e scegliere il file.

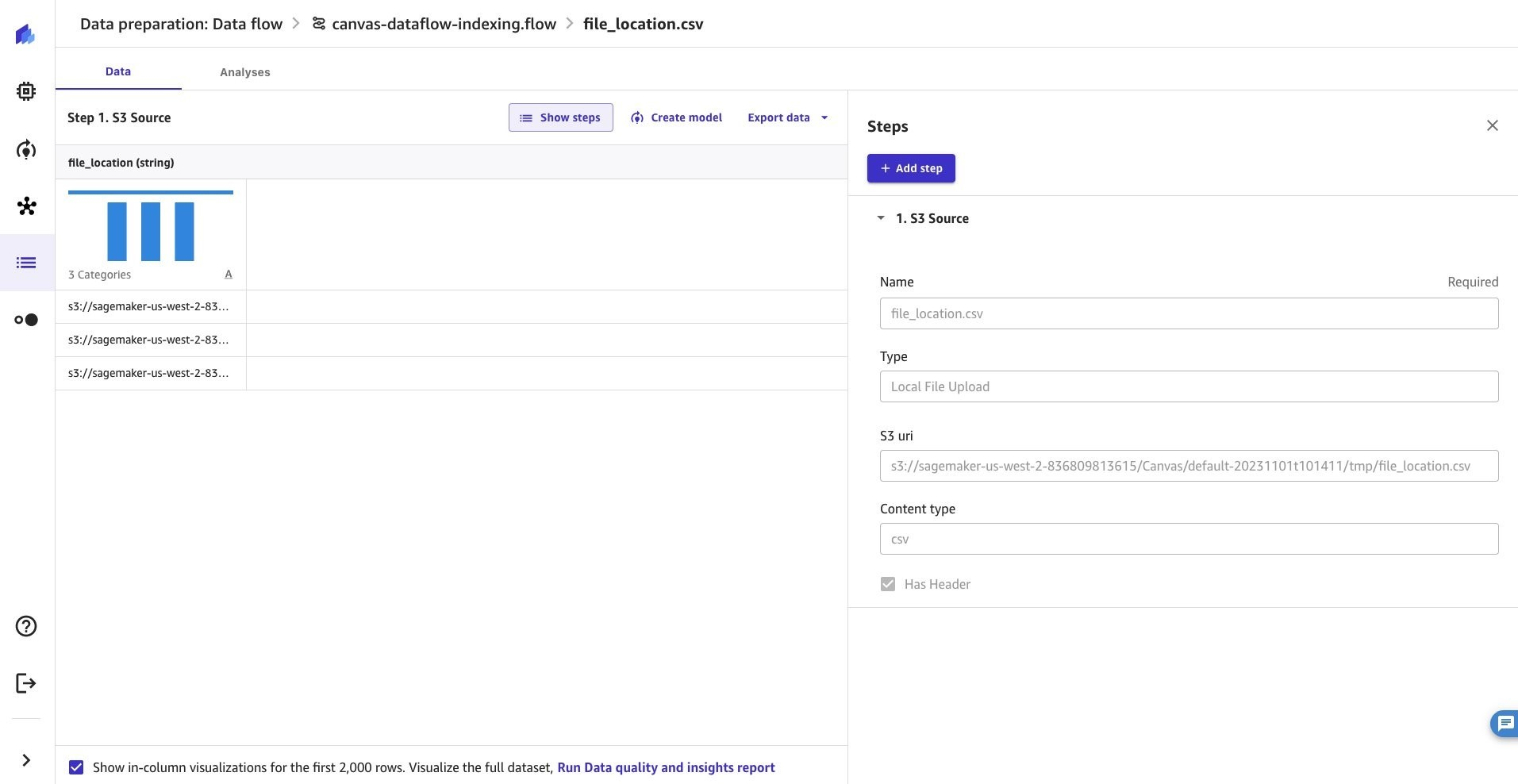

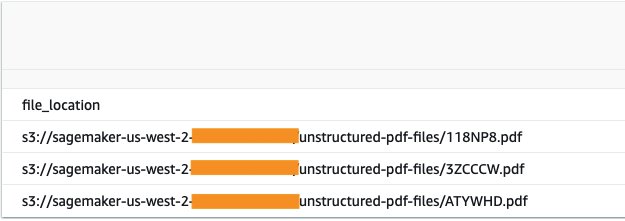

- Ora il file di metadati viene caricato nel flusso di dati di preparazione dei dati e possiamo procedere con l'aggiunta dei passaggi successivi per trasformare i dati e l'indice in Amazon OpenSearch. In questo caso il file ha i seguenti metadati, con la posizione di ciascun file nella directory Amazon S3.

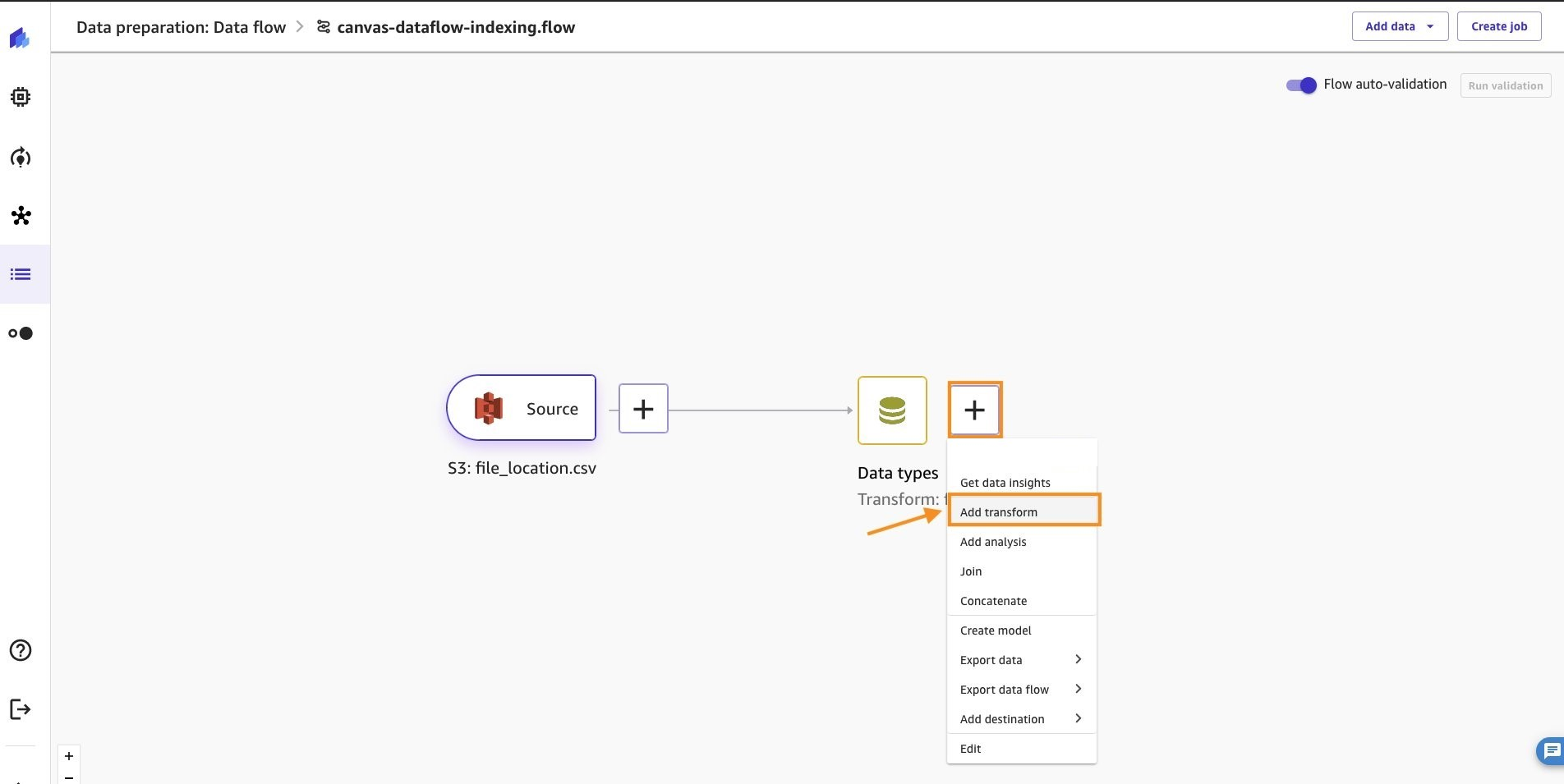

Per aggiungere una nuova trasformazione, completare i seguenti passaggi:

- Scegli il segno più e scegli Aggiungi trasformazione.

- Scegli Aggiungi passaggio e scegli Trasformazione personalizzata.

- È possibile creare una trasformazione personalizzata utilizzando Panda, PySpark, funzioni definite dall'utente Python e SQL PySpark. Scegliere Pitone (PySpark) per questo caso d'uso.

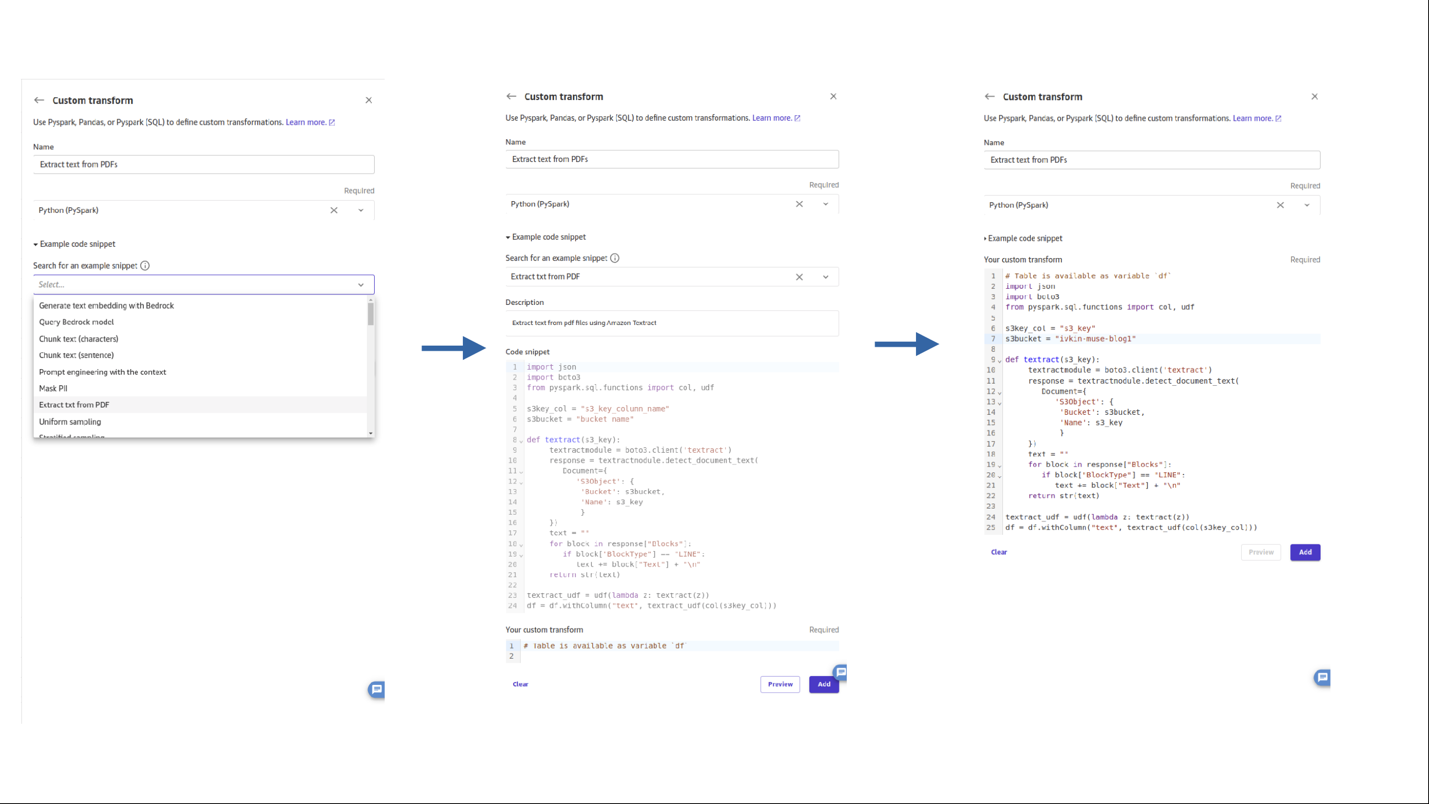

- Immettere un nome per il passaggio. Dai frammenti di codice di esempio, sfoglia e seleziona estrarre testo da pdf. Apporta le modifiche necessarie allo snippet di codice e seleziona Aggiungi.

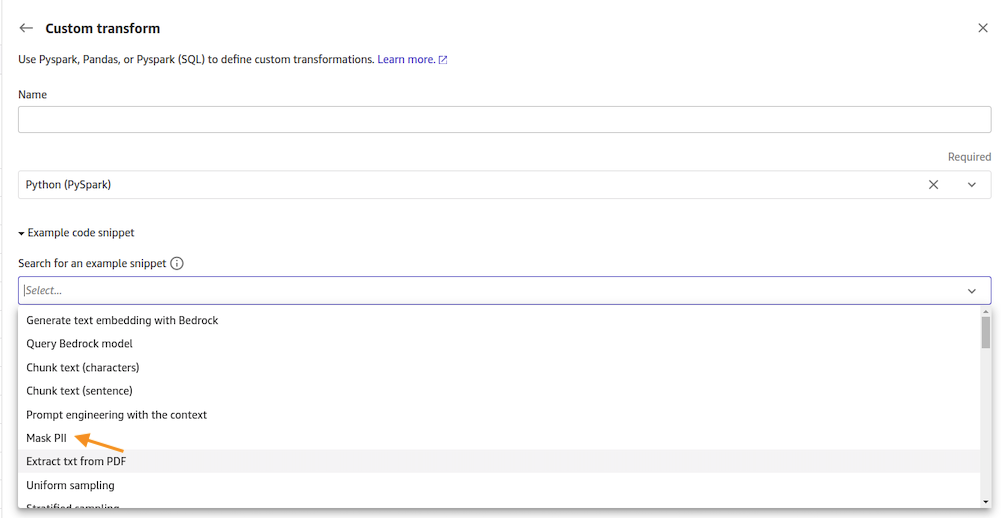

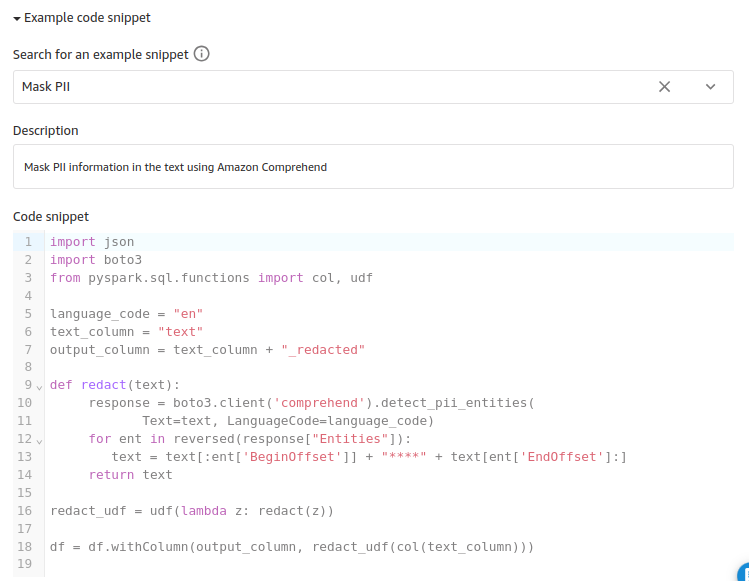

- Aggiungiamo un passaggio per redigere i dati delle informazioni di identificazione personale (PII) dai dati estratti sfruttando Amazon Comprehend. Scegliere Aggiungi passaggio e scegli Trasformazione personalizzata. E selezionare Pitone (PySpark).

Dai frammenti di codice di esempio, sfoglia e seleziona maschera PII. Apporta le modifiche necessarie allo snippet di codice e seleziona Aggiungi.

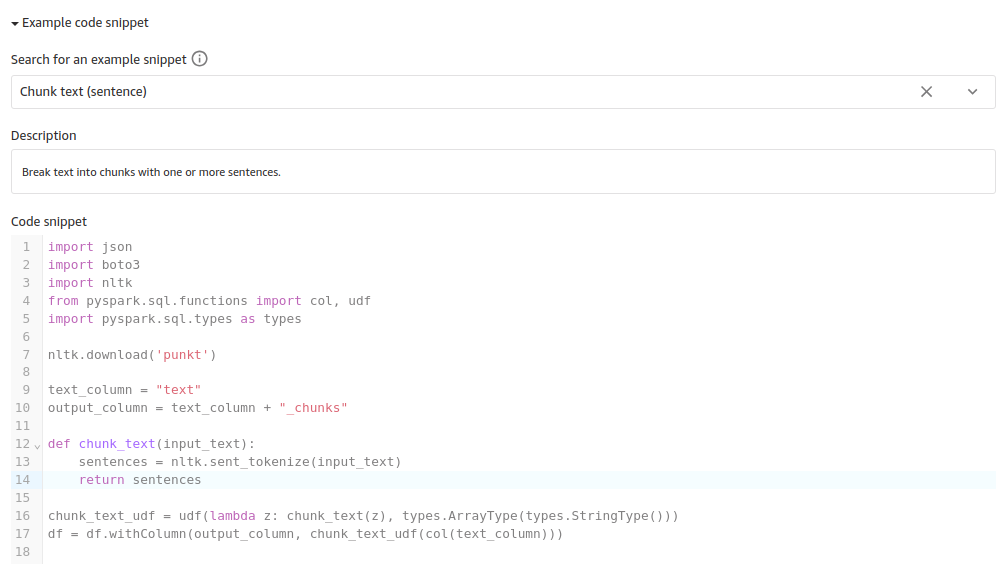

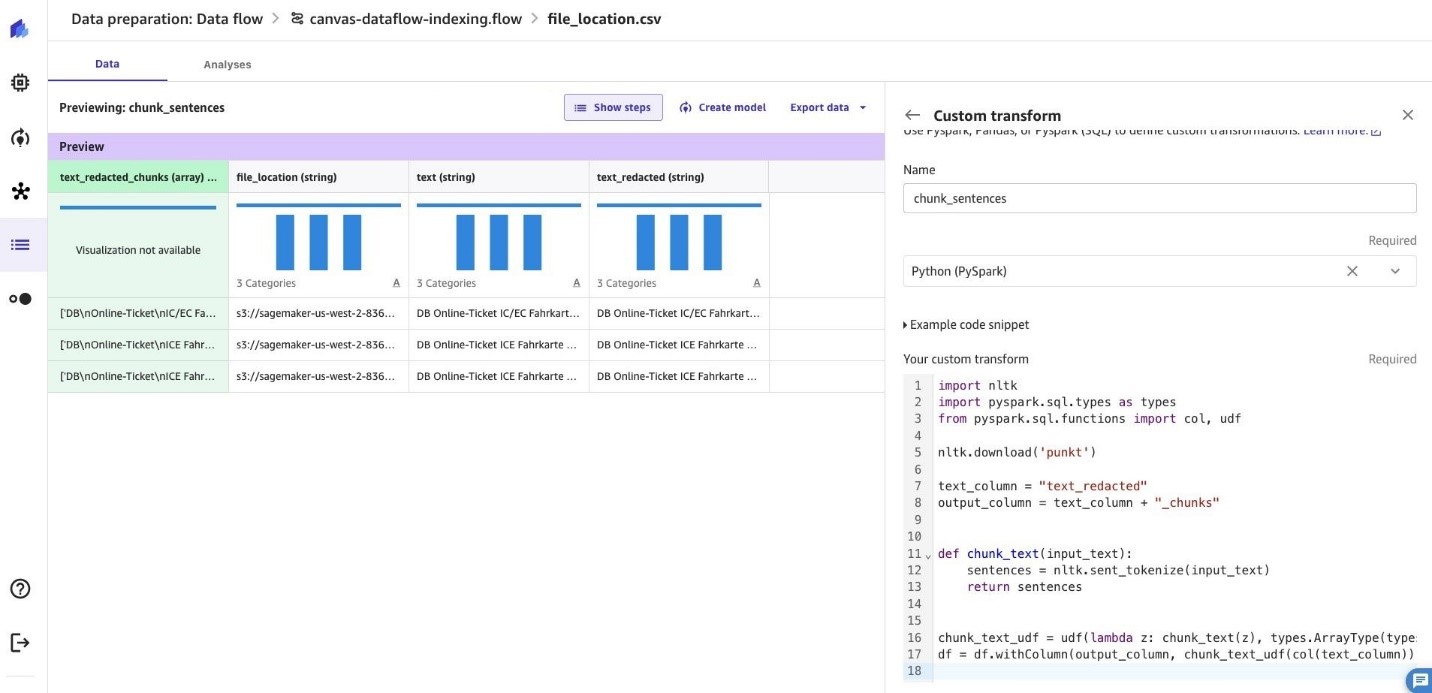

- Il passaggio successivo è suddividere in blocchi il contenuto del testo. Scegliere Aggiungi passaggio e scegli Trasformazione personalizzata. E selezionare Pitone (PySpark).

Dai frammenti di codice di esempio, sfoglia e seleziona Testo in blocchi. Apporta le modifiche necessarie allo snippet di codice e seleziona Aggiungi.

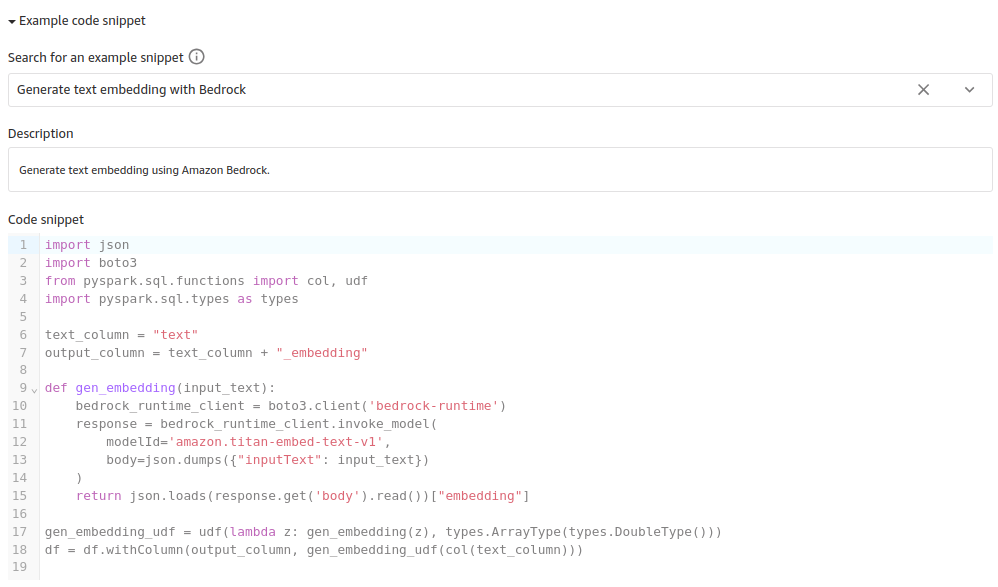

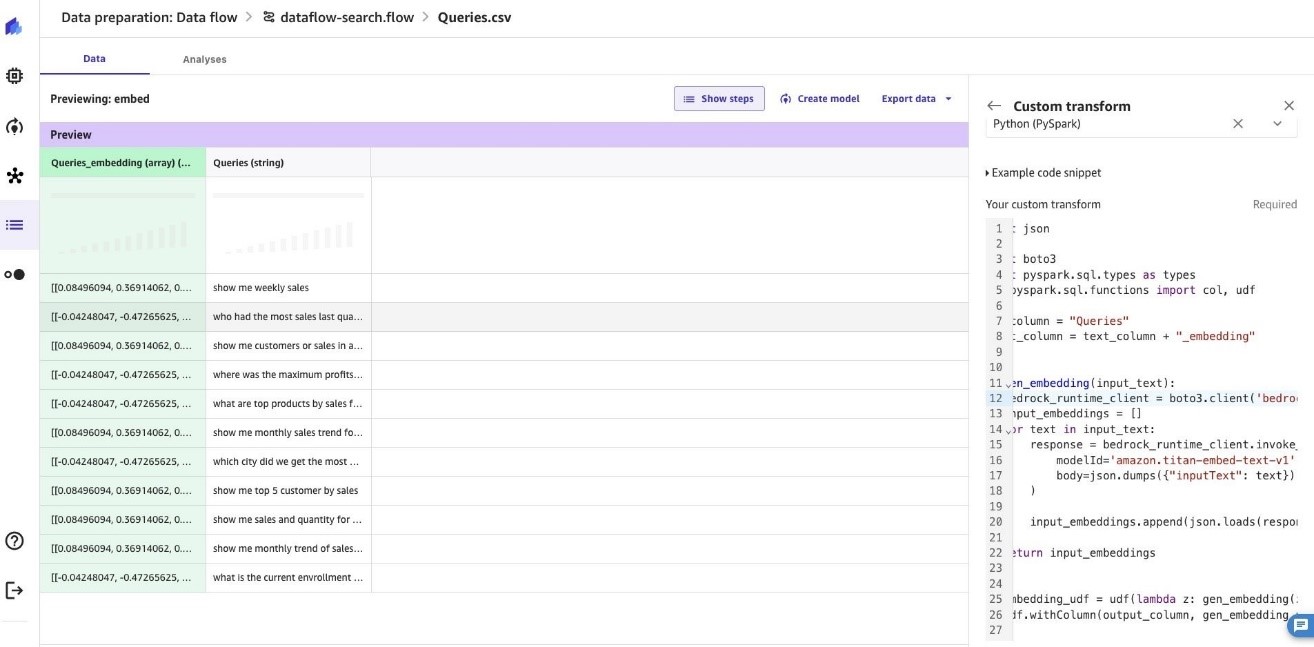

- Convertiamo il contenuto del testo in incorporamenti vettoriali utilizzando il file Roccia Amazzonica Modello Titan Embeddings. Scegliere Aggiungi passaggio e scegli Trasformazione personalizzata. E selezionare Pitone (PySpark).

Dai frammenti di codice di esempio, sfoglia e seleziona Genera l'incorporamento del testo con Bedrock. Apporta le modifiche necessarie allo snippet di codice e seleziona Aggiungi.

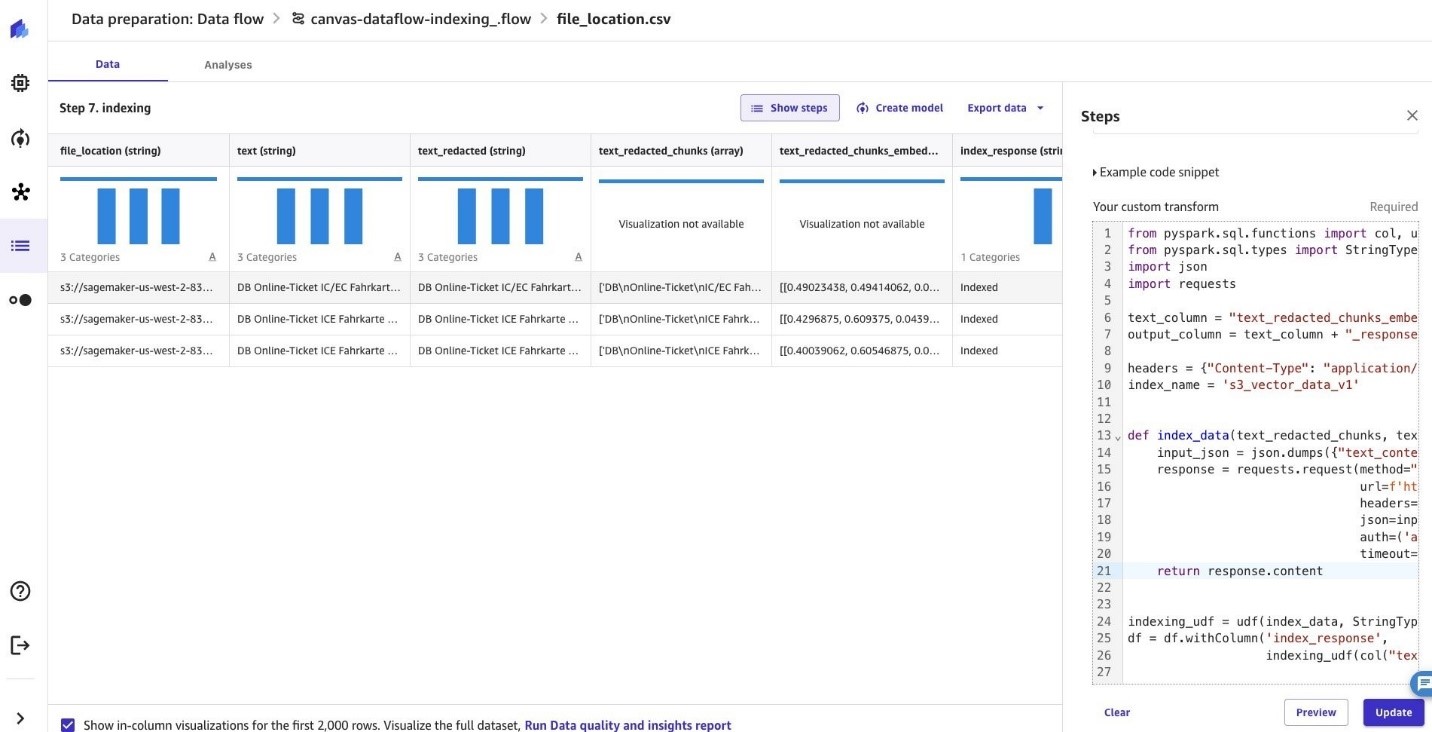

- Ora sono disponibili incorporamenti vettoriali per il contenuto del file PDF. Andiamo avanti e indicizziamo i dati in Amazon OpenSearch. Scegliere Aggiungi passaggio e scegli Trasformazione personalizzata. E selezionare Pitone (PySpark). Sei libero di riscrivere il seguente codice per utilizzare il tuo database vettoriale preferito. Per semplicità, utilizziamo nome utente e password principali per accedere alle API OpenSearch, per i carichi di lavoro di produzione seleziona l'opzione in base alle policy della tua organizzazione.

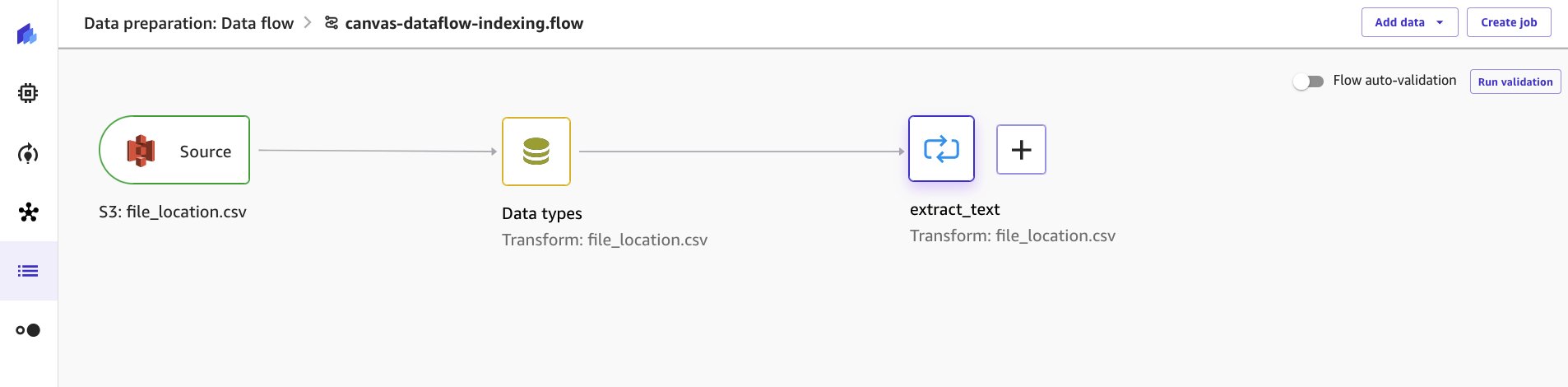

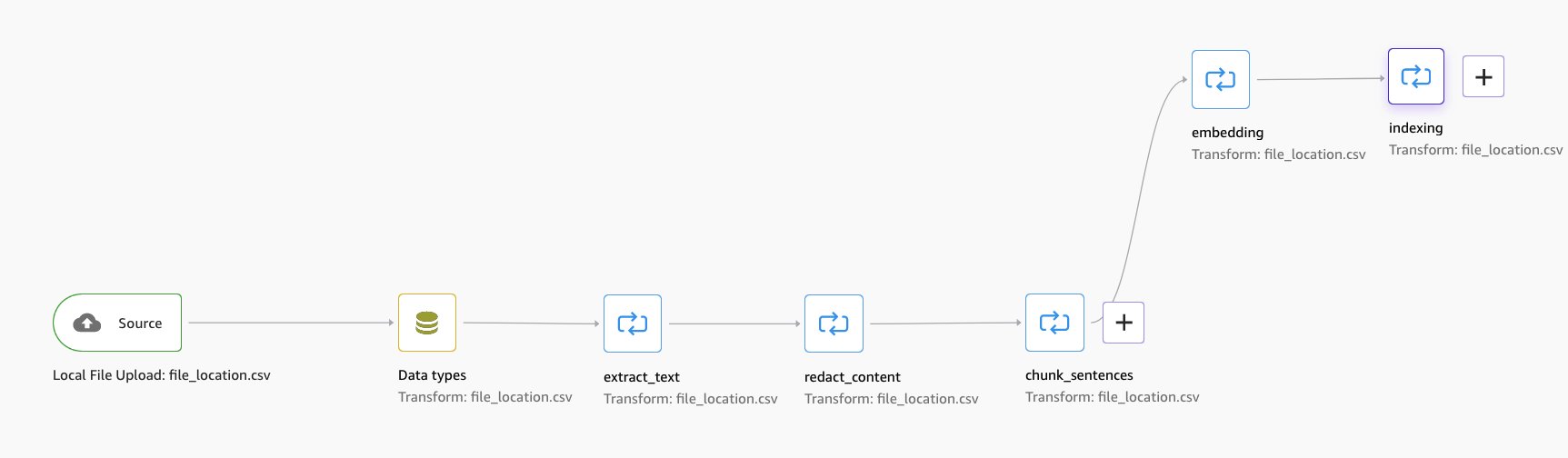

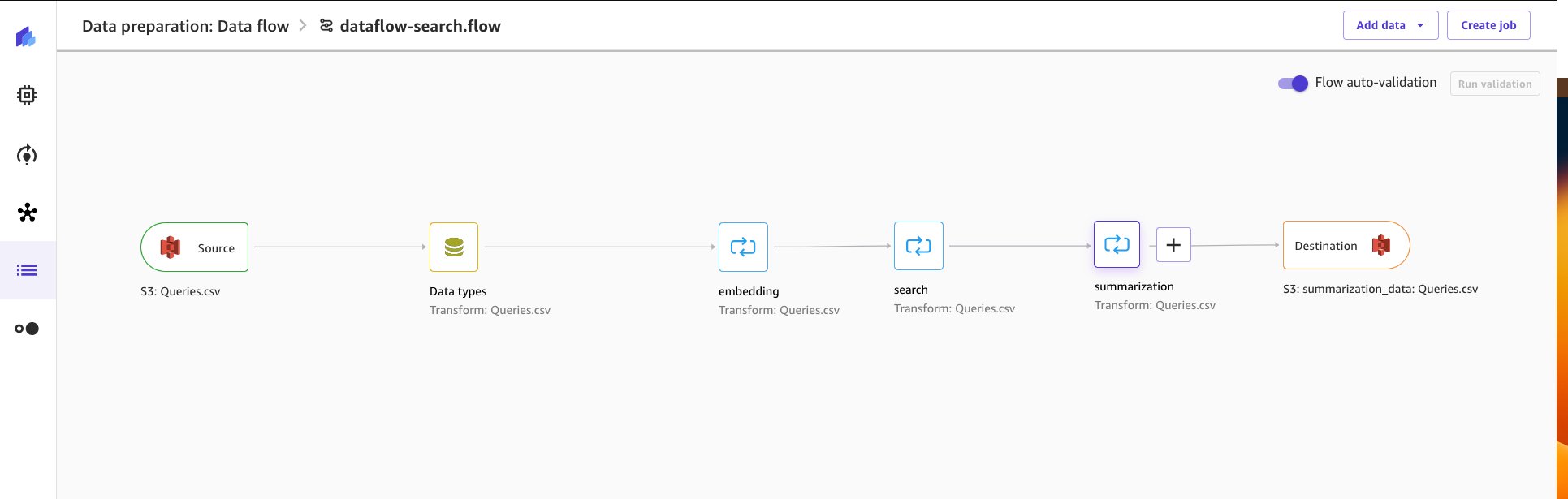

Infine, il flusso di dati creato sarebbe il seguente:

Con questo flusso di dati, i dati del file PDF sono stati letti e indicizzati con incorporamenti vettoriali in Amazon OpenSearch. Ora è il momento di creare un file con le query per interrogare i dati indicizzati e salvarlo nella posizione Amazon S3. Indirizzeremo il flusso di dati di ricerca al file e genereremo un file con i risultati corrispondenti in un nuovo file in una posizione Amazon S3.

Preparazione di un suggerimento

Dopo aver creato una knowledge base dal nostro PDF, possiamo testarla cercando nella knowledge base alcune query di esempio. Elaboreremo ogni query come segue:

- Genera l'incorporamento per la query (con tecnologia Amazon Bedrock)

- Interroga il database vettoriale per il contesto del vicino più vicino (fornito da Amazon OpenSearch)

- Combina la query e il contesto nel prompt.

- Interroga LLM con un prompt (fornito da Amazon Bedrock)

- Nella home page di SageMaker Canvas, scegli Preparazione dei dati.

- Scegli Creare sul lato destro della pagina, quindi assegnare un nome al flusso di dati e selezionare Creare.

Ora carichiamo le domande dell'utente e quindi creiamo un prompt combinando la domanda e i documenti simili. Questo prompt viene fornito a LLM per generare una risposta alla domanda dell'utente.

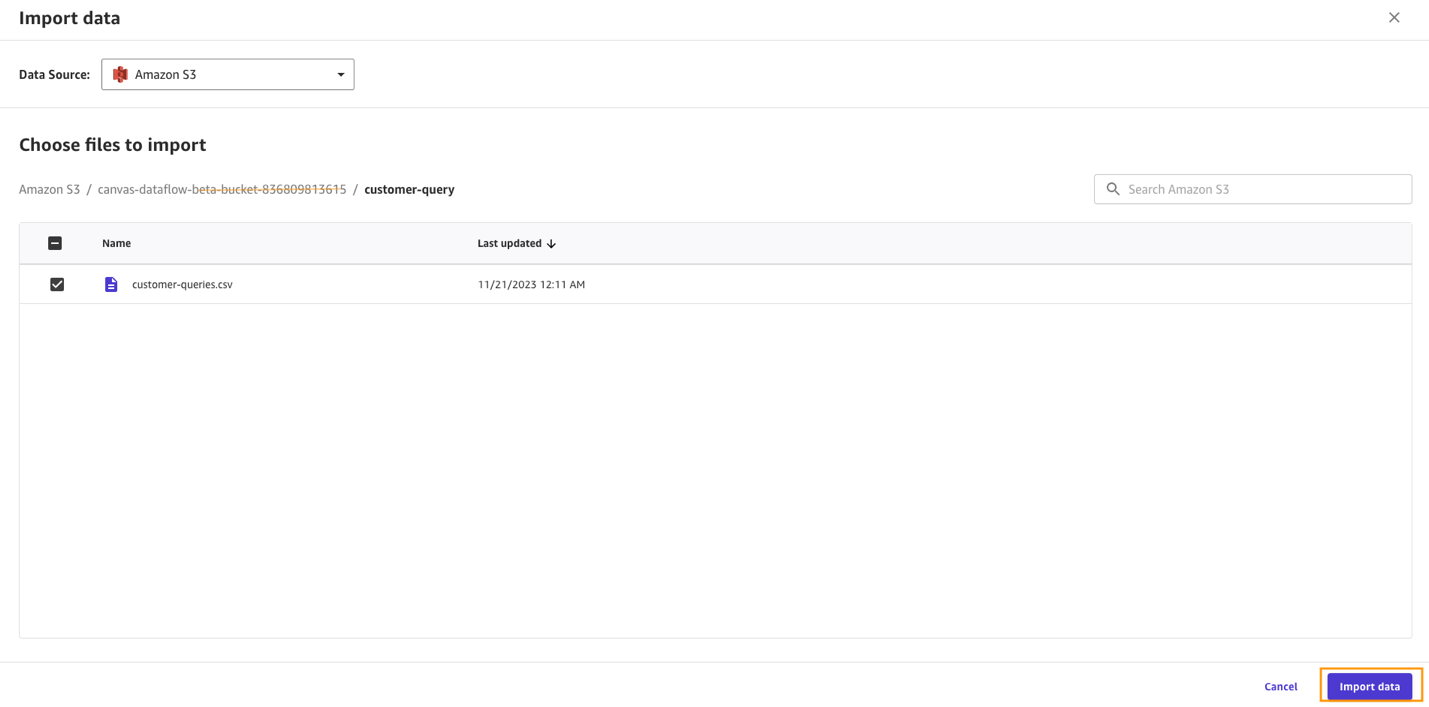

- Carichiamo un file CSV con le domande degli utenti. Scegliere Importa dati e seleziona di tabella dall'elenco a discesa.

- Fonte di dati, e seleziona Amazon S3 dall'elenco a discesa. In alternativa, puoi scegliere di caricare un file con le query degli utenti.

- Aggiungiamo una trasformazione personalizzata per convertire i dati in incorporamenti vettoriali, seguita dalla ricerca degli incorporamenti correlati da Amazon OpenSearch, prima di inviare un prompt ad Amazon Bedrock con la query e il contesto dalla knowledge base. Per generare incorporamenti per la query, puoi utilizzare lo stesso snippet di codice di esempio Genera l'incorporamento del testo con Bedrock menzionato al punto 7 sopra.

Invochiamo l'API Amazon OpenSearch per cercare documenti rilevanti per gli incorporamenti vettoriali generati. Aggiungi una trasformazione personalizzata con Python (PySpark).

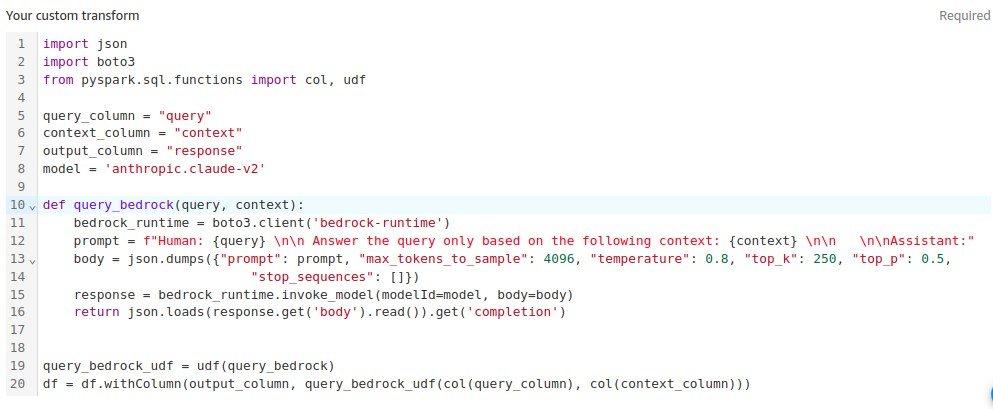

Aggiungiamo una trasformazione personalizzata per chiamare l'API Amazon Bedrock per la risposta alle query, passando i documenti dalla knowledge base Amazon OpenSearch. Dai frammenti di codice di esempio, sfoglia e seleziona Interroga Bedrock con il contesto. Apporta le modifiche necessarie allo snippet di codice e seleziona Aggiungi.

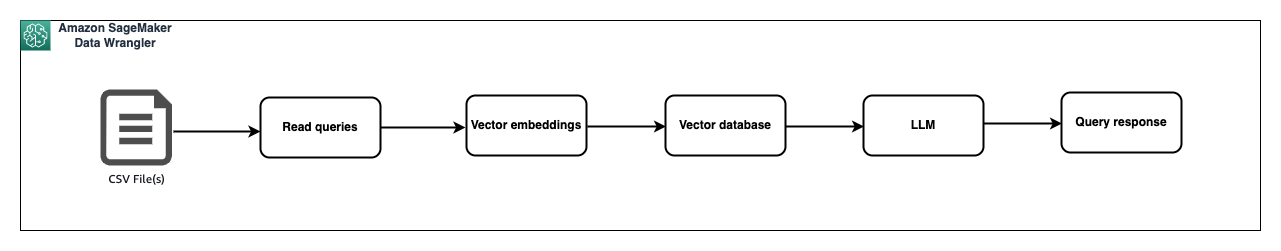

In sintesi, il flusso di dati delle risposte alle domande basato su RAG è il seguente:

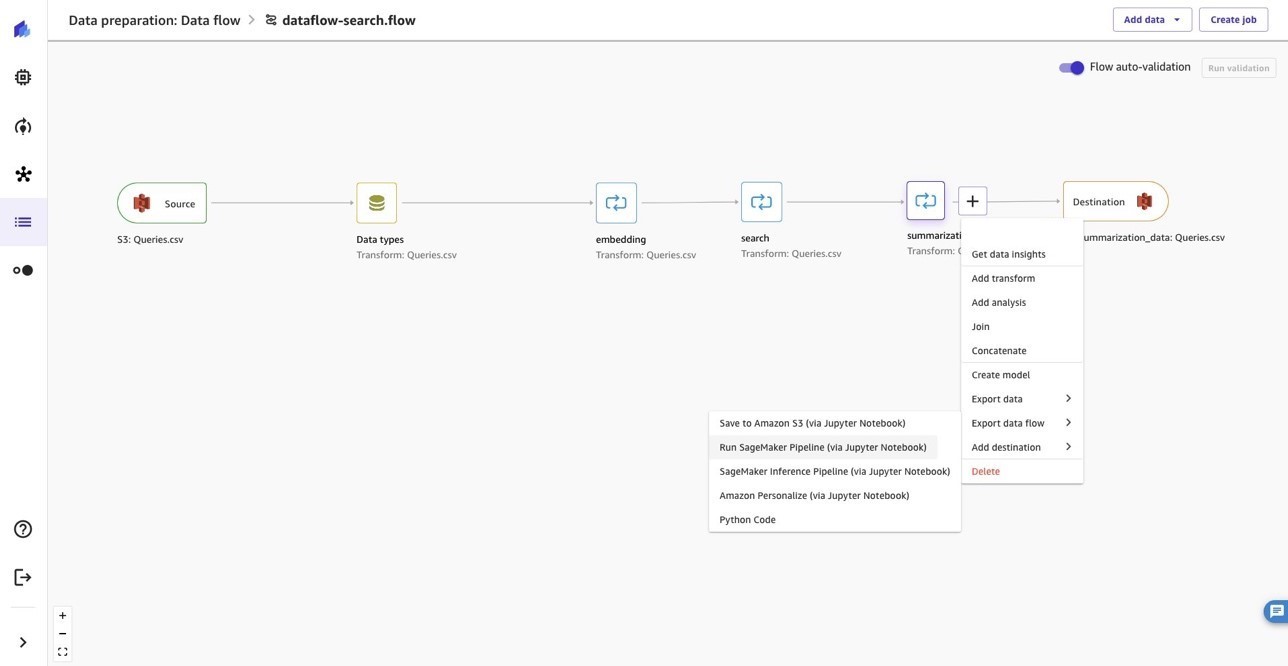

I professionisti del machine learning dedicano molto tempo alla creazione del codice di ingegneria delle funzionalità, applicandolo ai set di dati iniziali, addestrando i modelli sui set di dati ingegnerizzati e valutando l'accuratezza del modello. Data la natura sperimentale di questo lavoro, anche il progetto più piccolo porta a molteplici iterazioni. Lo stesso codice di progettazione delle funzionalità viene spesso eseguito più e più volte, sprecando tempo e risorse di calcolo nel ripetere le stesse operazioni. Nelle grandi organizzazioni, ciò può causare una perdita di produttività ancora maggiore perché team diversi spesso eseguono lavori identici o addirittura scrivono codici di progettazione delle funzionalità duplicati perché non sono a conoscenza del lavoro precedente. Per evitare la rielaborazione delle funzionalità, esporteremo il nostro flusso di dati su un Amazon Gasdotto SageMaker. Selezioniamo il + pulsante a destra della query. Seleziona il flusso di dati di esportazione e scegli Esegui la pipeline SageMaker (tramite il taccuino Jupyter).

Pulire

Per evitare di incorrere in futuri addebiti, elimina o chiudi le risorse che hai creato seguendo questo post. Fare riferimento a Disconnessione da Amazon SageMaker Canvas per ulteriori dettagli.

Conclusione

In questo post, ti abbiamo mostrato come sfruttare le funzionalità end-to-end di Amazon SageMaker Canvas assumendo il ruolo di un professionista dei dati che prepara i dati per un LLM. La preparazione interattiva dei dati ha consentito di pulire, trasformare e analizzare rapidamente i dati per progettare funzionalità informative. Eliminando le complessità della codifica, SageMaker Canvas ha consentito una rapida iterazione per creare un set di dati di addestramento di alta qualità. Questo flusso di lavoro accelerato ha portato direttamente alla creazione, alla formazione e all'implementazione di un modello di machine learning performante per l'impatto aziendale. Grazie alla preparazione completa dei dati e all'esperienza unificata dai dati agli approfondimenti, SageMaker Canvas consente agli utenti di migliorare i risultati del machine learning.

Ti invitiamo a saperne di più esplorando Gestore di dati di Amazon SageMaker, Tela di Amazon SageMaker, Titano Amazzonico modelli, Roccia Amazzonicae Amazon Servizio OpenSearch per creare una soluzione utilizzando l'implementazione di esempio fornita in questo post e un set di dati pertinente alla tua attività. Se hai domande o suggerimenti, lascia un commento.

Informazioni sugli autori

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

Nikita Ivkin è Senior Applied Scientist presso Amazon SageMaker Data Wrangler con interessi nell'apprendimento automatico e negli algoritmi di pulizia dei dati.

Nikita Ivkin è Senior Applied Scientist presso Amazon SageMaker Data Wrangler con interessi nell'apprendimento automatico e negli algoritmi di pulizia dei dati.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :ha

- :È

- :non

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- capace

- WRI

- sopra

- accelerare

- accelerata

- accesso

- Secondo

- conti

- precisione

- aggiungere

- aggiuntivo

- Adozione

- avanzamenti

- Vantaggio

- vantaggi

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- aggregato

- avanti

- AI

- AI / ML

- Algoritmi

- Allinea

- Tutti

- permesso

- anche

- Amazon

- Amazon Sage Maker

- Gestore di dati di Amazon SageMaker

- Amazon Web Services

- importi

- an

- Analisi

- analitica

- l'analisi

- ed

- rispondere

- in qualsiasi

- api

- Applicazioni

- applicato

- AMMISSIONE

- architettura

- SONO

- artificiale

- intelligenza artificiale

- AS

- Assistenza

- At

- allegare

- Audio

- aumentata

- disponibile

- evitare

- AWS

- base

- basato

- BE

- perché

- diventa

- stato

- prima

- essendo

- Meglio

- parziale

- Big

- Big Data

- costruire

- Costruzione

- incassato

- affari

- aziende

- pulsante

- by

- chiamata

- Materiale

- tela

- funzionalità

- Custodie

- Causare

- Modifiche

- oneri

- Scegli

- cavedano

- Pulizia

- codice

- codifica

- combinando

- commento

- Aziende

- rispetto

- competitivo

- completamento di una

- complesso

- complessità

- comprendere

- globale

- Calcolare

- Prendere in considerazione

- consolle

- contenere

- contiene

- contenuto

- testuali

- contesto

- contesti

- continua

- di controllo

- convertire

- Corrispondente

- potuto

- coprire

- creare

- creato

- critico

- costume

- cliente

- Servizio clienti

- Clienti

- dati

- Preparazione dei dati

- Banca Dati

- dataset

- Deloitte

- dimostrato

- distribuzione

- implementazioni

- Design

- dettagli

- in via di sviluppo

- diverso

- difficile

- Dimensioni

- direzione

- direttamente

- scopri

- do

- documento

- documentazione

- documenti

- dominio

- domini

- giù

- durante

- e

- ogni

- facilmente

- in maniera efficace

- efficiente

- in modo efficiente

- incorporamento

- Potenzia

- abilitato

- consentendo

- incoraggiare

- da un capo all'altro

- ingegnere

- progettato

- Ingegneria

- la valutazione

- Anche

- esempio

- esiste

- esperienza

- sperimentare

- sperimentale

- esplora

- Esplorare

- export

- estratto

- caratteristica

- Caratteristiche

- pochi

- campi

- Compila il

- filtro

- finale

- Trovate

- flusso

- seguito

- i seguenti

- segue

- Nel

- Forbes

- Fondazione

- Fondazioni

- Gratis

- da

- pieno

- funzioni

- ulteriormente

- futuro

- Guadagno

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- Dare

- dato

- globali

- Go

- scopo

- buono

- maggiore

- Avere

- he

- intestazioni

- alta qualità

- il suo

- detiene

- Casa

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- i

- identico

- if

- immagini

- Impact

- implementazione

- importare

- importante

- impressionante

- competenze

- in

- inclusi

- Index

- indicizzati

- informazioni

- informativo

- inizialmente

- intuizioni

- istruzioni

- integrazione

- Intelligence

- interattivo

- interessi

- Interfaccia

- Internet

- ai miglioramenti

- coinvolgere

- IT

- iterazione

- iterazioni

- SUO

- Offerte di lavoro

- jpg

- json

- conoscenze

- Paese

- Lingua

- grandi

- larga scala

- lanciare

- Leads

- IMPARARE

- apprendimento

- Lasciare

- Guidato

- leveraging

- si trova

- piace

- Lista

- Ascolto

- LLM

- caricare

- località

- posizioni

- spento

- lotto

- amato

- Basso

- macchina

- machine learning

- Principale

- make

- FA

- mask

- massiccio

- Mastercard

- Maggio..

- meccanismi di

- Media

- Menu

- Meta

- Metadati

- ML

- modello

- modelli

- modesto

- Scopri di più

- maggior parte

- multiplo

- Musica

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Navigazione

- necessaria

- Bisogno

- New

- GENERAZIONE

- no

- taccuino

- adesso

- of

- di frequente

- on

- una volta

- quelli

- esclusivamente

- Operazioni

- Opzione

- or

- organizzazione

- organizzazioni

- Altro

- nostro

- su

- risultati

- all'aperto

- produzione

- ancora

- pagina

- panda

- vetro

- Di passaggio

- Password

- performance

- cronologia

- scegliere

- pezzo

- pezzi

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- più

- punto

- Termini e Condizioni

- Post

- potenziale

- alimentato

- preferito

- preparazione

- Preparare

- preparazione

- Precedente

- probabilmente

- Problema

- problemi

- procedere

- processi

- lavorazione

- Produzione

- della produttività

- professionale

- progetto

- proprietà

- purché

- fornisce

- fornitura

- Python

- query

- domanda

- Domande

- rapidamente

- gamme

- veloce

- valutazioni

- raggiungere

- Leggi

- mondo reale

- ricevuto

- riferimento

- relazionato

- pertinente

- rimozione

- Segnalati

- richieste

- richiedere

- richiede

- Risorse

- risposta

- risposte

- riposo

- Risultati

- ritorno

- Recensioni

- destra

- Ruolo

- Correre

- sagemaker

- stesso

- Risparmi

- Scienziato

- Cerca

- ricerca

- Sezione

- visto

- select

- invio

- anziano

- delicata

- servizio

- Servizi

- impostazioni

- dovrebbero

- mostrare attraverso le sue creazioni

- ha mostrato

- chiuso

- fermare

- lato

- segno

- significativa

- simile

- semplicità

- semplificare

- Taglia

- frammento

- So

- Social

- Social Media

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- fonti

- specifico

- in particolare

- spendere

- Spendere

- Stage

- tappe

- step

- Passi

- Ancora

- Strategico

- strutturato

- SOMMARIO

- supporti

- Indagine

- Fai

- le squadre

- Consulenza

- tecniche

- test

- testo

- che

- Il

- Il futuro

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- così

- tempo

- titano

- a

- oggi

- strumenti

- Training

- Trasformare

- Trasformazione

- trasformazioni

- trasformazione

- vero

- troncamento

- Digitare

- Tipi di

- unificato

- us

- uso

- utilizzato

- Utente

- utenti

- utilizzando

- Prezioso

- via

- Video

- visivo

- walkthrough

- we

- sito web

- servizi web

- WELL

- quale

- while

- OMS

- volere

- con

- Lavora

- flusso di lavoro

- lavori

- sarebbe

- scrivere

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro