Il tuo contact center funge da collegamento vitale tra la tua azienda e i tuoi clienti. Ogni chiamata al tuo contact center è un'opportunità per conoscere meglio le esigenze dei tuoi clienti e quanto bene riesci a soddisfarle.

La maggior parte dei contact center richiede ai propri agenti di riassumere la conversazione dopo ogni chiamata. Il riepilogo delle chiamate è uno strumento prezioso che aiuta i contact center a comprendere e ottenere informazioni approfondite dalle chiamate dei clienti. Inoltre, riepiloghi accurati delle chiamate migliorano il percorso del cliente eliminando la necessità che i clienti ripetano le informazioni quando vengono trasferite a un altro agente.

In questo post spieghiamo come utilizzare la potenza dell'intelligenza artificiale generativa per ridurre lo sforzo e migliorare la precisione nella creazione di riepiloghi e disposizioni delle chiamate. Mostriamo anche come iniziare rapidamente utilizzando l'ultima versione della nostra soluzione open source, Analisi delle chiamate in tempo reale con Agent Assist.

Sfide con i riepiloghi delle chiamate

Poiché i contact center raccolgono sempre più dati vocali, la necessità di un riepilogo efficiente delle chiamate è cresciuta in modo significativo. Tuttavia, la maggior parte dei riepiloghi sono vuoti o imprecisi perché crearli manualmente richiede molto tempo e influisce sui parametri chiave degli agenti come il tempo di gestione medio (AHT). Gli agenti riferiscono che il riepilogo può richiedere fino a un terzo della chiamata totale, quindi lo saltano o inseriscono informazioni incomplete. Ciò danneggia l'esperienza del cliente: le lunghe trattenute frustrano i clienti mentre gli agenti digitano e i riepiloghi incompleti implicano chiedere ai clienti di ripetere le informazioni quando vengono trasferite tra agenti.

La buona notizia è che automatizzare e risolvere la sfida del riepilogo è ora possibile attraverso l’intelligenza artificiale generativa.

L’intelligenza artificiale generativa aiuta a riassumere le chiamate dei clienti in modo accurato ed efficiente

AI generativa è alimentato da modelli di machine learning (ML) di grandi dimensioni, denominati modelli di base (FM), preaddestrati su grandi quantità di dati su larga scala. Un sottoinsieme di questi FM focalizzati sulla comprensione del linguaggio naturale sono chiamati modelli linguistici di grandi dimensioni (LLM) e sono in grado di generare riassunti simili a quelli umani e contestualmente rilevanti. I migliori LLM possono elaborare con facilità anche strutture di frasi complesse e non lineari e determinare vari aspetti, tra cui argomento, intento, passaggi successivi, risultati e altro ancora. L'utilizzo degli LLM per automatizzare il riepilogo delle chiamate consente di riepilogare accuratamente le conversazioni dei clienti e in una frazione del tempo necessario per il riepilogo manuale. Ciò a sua volta consente ai contact center di offrire un'esperienza cliente superiore riducendo al tempo stesso il carico di documentazione sui propri agenti.

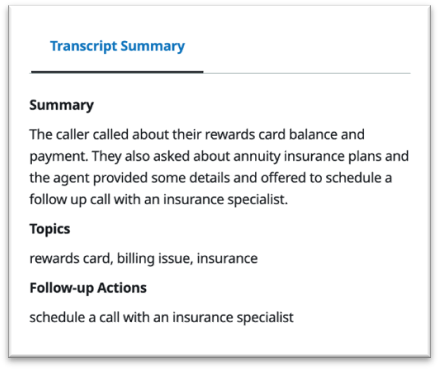

Lo screenshot seguente mostra un esempio della pagina dei dettagli della chiamata Analisi chiamate in tempo reale con Agent Assist, che contiene informazioni su ciascuna chiamata.

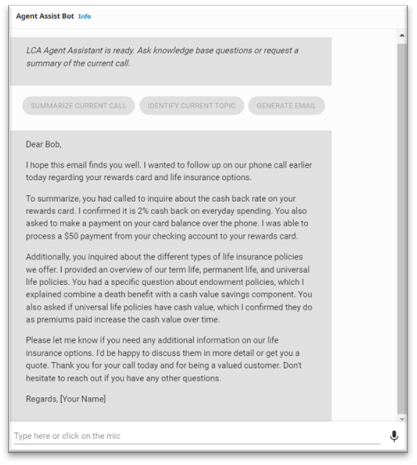

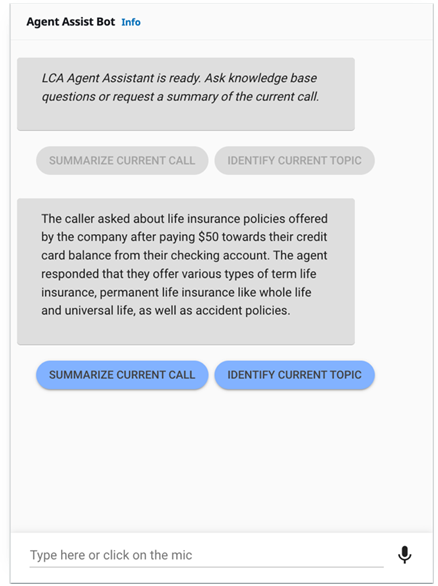

Il video seguente mostra un esempio di Analisi delle chiamate in tempo reale con Agent Assist che riassume una chiamata in corso, un riepilogo al termine della chiamata e la generazione di un'e-mail di follow-up.

Panoramica della soluzione

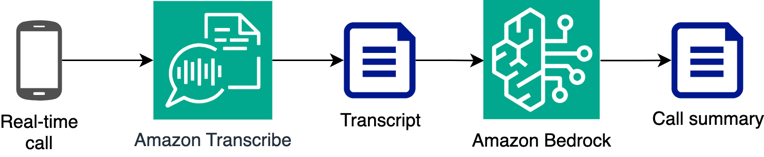

Il diagramma seguente illustra il flusso di lavoro della soluzione.

Il primo passo per generare riepiloghi astratti delle chiamate è trascrivere la chiamata del cliente. Disporre di trascrizioni accurate e pronte all'uso è fondamentale per generare riepiloghi delle chiamate accurati ed efficaci. Amazon Transcribe può aiutarti a creare trascrizioni con elevata precisione per le chiamate del tuo contact center. Amazon Transcribe è un'API di sintesi vocale ricca di funzionalità con modelli di riconoscimento vocale all'avanguardia, completamente gestiti e continuamente addestrati. Clienti come New York Times, Slack, Zillow, Wixe migliaia di altri utilizzare Amazon Transcribe per generare trascrizioni altamente accurate per migliorare i risultati aziendali. Un elemento chiave di differenziazione di Amazon Transcribe è la sua capacità di proteggere i dati dei clienti oscurando le informazioni sensibili dall'audio e dal testo. Sebbene proteggere la privacy e la sicurezza dei clienti sia importante in generale per i contact center, è ancora più importante mascherare informazioni sensibili come informazioni sul conto bancario e numeri di previdenza sociale prima di generare riepiloghi automatizzati delle chiamate, in modo che non vengano inserite nei riepiloghi.

Per i clienti che già utilizzano Amazon Connect, il nostro contact center cloud omnicanale, Lenti a contatto per Amazon Connect fornisce funzionalità di trascrizione e analisi in tempo reale in modo nativo. Tuttavia, se desideri utilizzare l'intelligenza artificiale generativa con il tuo contact center esistente, abbiamo sviluppato Solutions che svolgono la maggior parte del lavoro pesante associato alla trascrizione delle conversazioni in tempo reale o post-chiamata dal contact center esistente e alla generazione di riepiloghi automatizzati delle chiamate utilizzando l'intelligenza artificiale generativa. Inoltre, la soluzione dettagliata in questa sezione ti consente di farlo integrarsi con il sistema CRM (Customer Relationship Management). per aggiornare automaticamente il tuo CRM preferito con i riepiloghi delle chiamate generati. In questo esempio usiamo our Analisi delle chiamate in tempo reale con la soluzione Agent Assist (LCA) per generare trascrizioni delle chiamate in tempo reale e riepiloghi delle chiamate con LLM ospitati su Roccia Amazzonica. Puoi anche scrivere un AWS Lambda funzione e fornire a LCA l'Amazon Resource Name (ARN) della funzione nel file AWS CloudFormazione parametri e utilizzare il LLM di tua scelta.

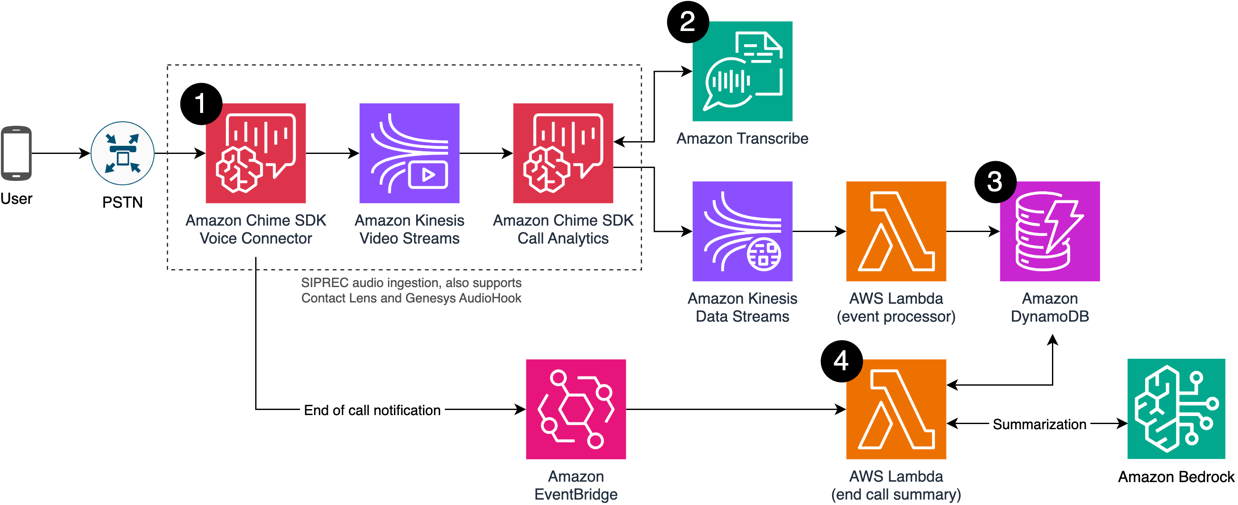

La seguente architettura LCA semplificata illustra il riepilogo delle chiamate con Amazon Bedrock.

LCA viene fornito come modello CloudFormation che distribuisce l'architettura precedente e consente di trascrivere le chiamate in tempo reale. I passaggi del flusso di lavoro sono i seguenti:

- L'audio della chiamata può essere trasmesso in streaming tramite SIPREC dal tuo sistema di telefonia al connettore vocale SDK Amazon Chime, che memorizza l'audio nel buffer Streaming video Amazon Kinesis. LCA supporta anche altri meccanismi di acquisizione audio, come ad esempio Genesys Cloud Audiohook.

- Amazon Chime SDK Call Analytics trasmette quindi l'audio da Kinesis Video Streams ad Amazon Transcribe e scrive l'output JSON su Flussi di dati di Amazon Kinesis.

- Una funzione Lambda elabora i segmenti di trascrizione e li rende persistenti in un file Amazon DynamoDB tabella.

- Al termine della chiamata, Amazon Chime SDK Voice Connector pubblica un file Amazon EventBridge notifica che attiva una funzione Lambda che legge la trascrizione persistente da DynamoDB, genera un prompt LLM (maggiori informazioni su questo argomento nella sezione seguente) ed esegue un'inferenza LLM con Amazon Bedrock. Il riepilogo generato viene reso persistente su DynamoDB e può essere utilizzato dall'agente nell'interfaccia utente LCA. Facoltativamente, puoi fornire un ARN della funzione Lambda che verrà eseguito dopo la generazione del riepilogo per l'integrazione con sistemi CRM di terze parti.

LCA consente inoltre di chiamare la funzione Lambda di riepilogo durante la chiamata, poiché in qualsiasi momento è possibile recuperare la trascrizione e creare un prompt, anche se la chiamata è in corso. Ciò può essere utile nei casi in cui una chiamata viene trasferita a un altro agente o inoltrata a un supervisore. Invece di mettere in attesa il cliente e spiegare la chiamata, il nuovo agente può leggere rapidamente un riepilogo generato automaticamente che può includere qual è il problema attuale e cosa ha tentato di fare l'agente precedente per risolverlo.

Esempio di richiesta di riepilogo delle chiamate

Puoi eseguire inferenze LLM con ingegneria tempestiva per generare e migliorare i riepiloghi delle chiamate. Puoi modificare i modelli di prompt per vedere cosa funziona meglio per il LLM selezionato. Di seguito è riportato un esempio della richiesta predefinita per il riepilogo di una trascrizione con LCA. Sostituiamo il {transcript} segnaposto con la trascrizione effettiva della chiamata.

LCA esegue il prompt e memorizza il riepilogo generato. Oltre al riepilogo, puoi indirizzare LLM a generare quasi tutti i testi importanti per la produttività degli agenti. Ad esempio, puoi scegliere da una serie di argomenti trattati durante la chiamata (disposizioni dell'agente), generare un elenco di attività di follow-up richieste o persino scrivere un'e-mail al chiamante ringraziandolo per la chiamata.

La schermata seguente è un esempio di generazione di email di follow-up dell'agente nell'interfaccia utente LCA.

Con un prompt ben progettato, alcuni LLM hanno la capacità di generare tutte queste informazioni anche in un'unica inferenza, riducendo i costi di inferenza e i tempi di elaborazione. L'agente può quindi utilizzare la risposta generata entro pochi secondi dalla fine della chiamata per il proprio lavoro successivo al contatto. Puoi anche integrare la risposta generata automaticamente nel tuo sistema CRM.

La schermata seguente mostra un riepilogo di esempio nell'interfaccia utente LCA.

È anche possibile generare un riepilogo mentre la chiamata è ancora in corso (vedere lo screenshot seguente), il che può essere particolarmente utile per le chiamate lunghe ai clienti.

Prima dell’intelligenza artificiale generativa, gli agenti sarebbero tenuti a prestare attenzione mentre prendono appunti e svolgono altre attività secondo necessità. Trascrivendo automaticamente la chiamata e utilizzando gli LLM per creare automaticamente i riepiloghi, possiamo ridurre il carico mentale dell'agente, in modo che possa concentrarsi sulla fornitura di un'esperienza cliente superiore. Ciò porta anche a un lavoro post-chiamata più accurato, perché la trascrizione è una rappresentazione accurata di ciò che è accaduto durante la chiamata, non solo di ciò di cui l'agente ha preso appunti o ha ricordato.

Sommario

L'applicazione LCA di esempio viene fornita come open source: utilizzala come punto di partenza per la tua soluzione e aiutaci a migliorarla contribuendo con correzioni e funzionalità tramite richieste pull GitHub. Per informazioni sulla distribuzione della LCA, fare riferimento a Analisi delle chiamate in tempo reale e assistenza degli agenti per il tuo contact center con i servizi di intelligenza artificiale in lingua Amazon. Sfoglia il Repository LCA GitHub per esplorare il codice, iscriviti per ricevere notifiche sulle nuove versioni e controlla il README per gli ultimi aggiornamenti della documentazione. Per i clienti che utilizzano già Amazon Connect, puoi ottenere ulteriori informazioni sull'intelligenza artificiale generativa con Amazon Connect facendo riferimento a Come i leader dei contact center possono prepararsi per l'intelligenza artificiale generativa.

Circa gli autori

Cristoforo Lot è Senior Solutions Architect nel team AWS AI Language Services. Ha 20 anni di esperienza nello sviluppo di software aziendali. Chris vive a Sacramento, in California, e ama il giardinaggio, l'aerospaziale e viaggiare per il mondo.

Cristoforo Lot è Senior Solutions Architect nel team AWS AI Language Services. Ha 20 anni di esperienza nello sviluppo di software aziendali. Chris vive a Sacramento, in California, e ama il giardinaggio, l'aerospaziale e viaggiare per il mondo.

Smriti Ranjan è un Principal Product Manager nel team AI/ML di AWS che si concentra sui servizi linguistici e di ricerca. Prima di unirsi ad AWS, ha lavorato presso Amazon Devices e altre startup tecnologiche alla guida di funzioni di prodotto e di crescita. Smriti vive a Boston, MA e ama fare escursioni, partecipare a concerti e viaggiare per il mondo.

Smriti Ranjan è un Principal Product Manager nel team AI/ML di AWS che si concentra sui servizi linguistici e di ricerca. Prima di unirsi ad AWS, ha lavorato presso Amazon Devices e altre startup tecnologiche alla guida di funzioni di prodotto e di crescita. Smriti vive a Boston, MA e ama fare escursioni, partecipare a concerti e viaggiare per il mondo.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/use-generative-ai-to-increase-agent-productivity-through-automated-call-summarization/

- :ha

- :È

- $ SU

- 100

- 13

- 20

- 20 anni

- 438

- 7

- a

- capacità

- capace

- Chi siamo

- Il mio account

- precisione

- preciso

- con precisione

- presenti

- Inoltre

- Aeronautico

- Dopo shavasana, sedersi in silenzio; saluti;

- Agente

- agenti

- AI

- AI / ML

- Tutti

- consente

- quasi

- già

- anche

- Sebbene il

- Amazon

- Carillon di Amazon

- Amazon Transcribe

- Amazon Web Services

- importi

- an

- analitica

- ed

- Un altro

- rispondere

- in qualsiasi

- api

- Applicazioni

- architettura

- SONO

- AS

- chiedendo

- aspetti

- assistere

- Assistant

- associato

- At

- frequentando

- attenzione

- Audio

- automatizzare

- Automatizzata

- automaticamente

- Automatizzare

- media

- AWS

- precedente

- Banca

- conto bancario

- basato

- BE

- perché

- prima

- sotto

- oltre a

- MIGLIORE

- Meglio

- fra

- Boston

- onere

- affari

- by

- California

- chiamata

- detto

- visitatore

- Bandi

- Materiale

- non può

- centro

- centri

- Challenge

- dai un'occhiata

- Chime

- scegliere

- Scegli

- chris

- Christopher

- Cloud

- codice

- raccogliere

- complesso

- concerti

- Connettiti

- contatti

- centralino

- contiene

- continuamente

- contribuendo

- Conversazione

- Conversazioni

- Costo

- coperto

- creare

- creato

- Creazione

- CRM

- cruciale

- Corrente

- cliente

- dati dei clienti

- esperienza del cliente

- VoC

- Clienti

- dati

- Predefinito

- definito

- consegnare

- consegna

- distribuzione

- Distribuisce

- dettagliati

- dettagli

- Determinare

- sviluppato

- Mercato

- dispositivi

- differenziatore

- dirette

- do

- documentazione

- Dont

- durante

- ogni

- alleviare

- Efficace

- efficiente

- sforzo

- eliminando

- Abilita

- finale

- finisce

- Ingegneria

- accrescere

- Impresa

- software aziendale

- particolarmente

- Anche

- Ogni

- esempio

- esistente

- esperienza

- Spiegare

- spiegando

- esplora

- Caratteristiche

- Recuperato

- pochi

- riempire

- Nome

- Focus

- concentrato

- messa a fuoco

- i seguenti

- segue

- Nel

- Fondazione

- frazione

- da

- completamente

- function

- funzioni

- Guadagno

- Sesso

- Generale

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- GitHub

- buono

- cresciuto

- Crescita

- maniglia

- Avere

- avendo

- he

- pesante

- sollevamento pesante

- Aiuto

- utile

- aiutare

- aiuta

- Alta

- vivamente

- tenere

- detiene

- ospitato

- Come

- Tutorial

- Tuttavia

- http

- HTTPS

- fa male

- if

- illustra

- impatto

- importante

- competenze

- in

- impreciso

- includere

- Compreso

- Aumento

- informazioni

- intuizioni

- integrare

- intento

- Interfaccia

- ai miglioramenti

- problema

- IT

- SUO

- accoppiamento

- viaggio

- json

- ad appena

- Le

- Lingua

- grandi

- con i più recenti

- capi

- principale

- Leads

- IMPARARE

- apprendimento

- di sollevamento

- piace

- LINK

- Lista

- vivere

- Lives

- LLM

- Lunghi

- inferiore

- macchina

- machine learning

- make

- gestito

- gestione

- direttore

- Manuale

- manualmente

- mask

- significare

- meccanismi di

- incontro

- mentale

- Metrica

- ML

- modelli

- modificare

- Scopri di più

- maggior parte

- Nome

- Naturale

- Bisogno

- di applicazione

- esigenze

- Neutres

- New

- notizie

- GENERAZIONE

- Note

- notifica

- adesso

- numeri

- si è verificato

- of

- omnichannel

- on

- in corso

- esclusivamente

- aprire

- open source

- Opportunità

- Opzione

- or

- Altro

- nostro

- su

- risultati

- produzione

- proprio

- pagina

- parametri

- Paga le

- esecuzione

- persiste

- segnaposto

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- possibile

- Post

- energia

- alimentato

- Preparare

- precedente

- Direttore

- Precedente

- Privacy

- processi

- i processi

- lavorazione

- Prodotto

- product manager

- della produttività

- Progressi

- protegge

- proteggere

- fornire

- purché

- fornisce

- Pubblica

- Mettendo

- domanda

- Domande

- rapidamente

- piuttosto

- Leggi

- di rose

- tempo reale

- riconoscimento

- ridurre

- riducendo

- riferimento

- di cui

- rapporto

- Uscite

- pertinente

- ripetere

- sostituire

- rispondere

- rapporto

- rappresentazione

- richieste

- richiedere

- necessario

- risolvere

- risorsa

- Rispondere

- risposta

- Correre

- corre

- Sacramento

- Sicurezza

- Scala

- sdk

- Cerca

- secondo

- Sezione

- problemi di

- vedere

- segmenti

- anziano

- delicata

- condanna

- serve

- Servizi

- set

- lei

- mostrare attraverso le sue creazioni

- Spettacoli

- segno

- significativamente

- semplificata

- singolo

- So

- Social

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- Soluzione

- alcuni

- Fonte

- discorso

- Riconoscimento vocale

- sintesi vocale

- iniziato

- Di partenza

- Startup

- state-of-the-art

- step

- Passi

- Ancora

- negozi

- streaming

- flussi

- strutture

- tale

- riassumere

- SOMMARIO

- superiore

- supporti

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- presa

- task

- team

- Tecnologia

- modello

- modelli

- testo

- di

- che

- I

- il mondo

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Terza

- di parti terze standard

- questo

- quelli

- migliaia

- Attraverso

- tempo

- richiede tempo

- volte

- a

- ha preso

- argomento

- Argomenti

- Totale

- allenato

- Trascrizione

- trasferito

- Di viaggio

- provato

- TURNO

- Tipi di

- capire

- e una comprensione reciproca

- Aggiornanento

- Aggiornamenti

- us

- uso

- utilizzato

- Utente

- Interfaccia utente

- utilizzando

- Prezioso

- vario

- Fisso

- versione

- molto

- via

- Video

- importantissima

- Voce

- volere

- we

- sito web

- servizi web

- WELL

- sono stati

- Che

- Che cosa è l'

- quando

- quale

- while

- OMS

- volere

- con

- entro

- Lavora

- lavorato

- flusso di lavoro

- lavori

- mondo

- sarebbe

- scrivere

- anni

- York

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro