In questa serie in due parti, dimostriamo come etichettare e addestrare i modelli per le attività di rilevamento di oggetti 3D. Nella parte 1, discutiamo del set di dati che stiamo usando, nonché di eventuali passaggi di pre-elaborazione, per comprendere ed etichettare i dati. Nella parte 2, esaminiamo come addestrare un modello sul set di dati e distribuirlo alla produzione.

LiDAR (rilevamento e distanza della luce) è un metodo per determinare le distanze prendendo di mira un oggetto o una superficie con un laser e misurando il tempo necessario alla luce riflessa per tornare al ricevitore. Le aziende di veicoli autonomi utilizzano in genere sensori LiDAR per generare una comprensione 3D dell'ambiente intorno ai loro veicoli.

Man mano che i sensori LiDAR diventano più accessibili e convenienti, i clienti utilizzano sempre più i dati delle nuvole di punti in nuovi spazi come la robotica, la mappatura dei segnali e la realtà aumentata. Alcuni nuovi dispositivi mobili includono persino sensori LiDAR. La crescente disponibilità di sensori LiDAR ha aumentato l'interesse per i dati delle nuvole di punti per le attività di machine learning (ML), come il rilevamento e il tracciamento di oggetti 3D, la segmentazione 3D, la sintesi e la ricostruzione di oggetti 3D e l'utilizzo di dati 3D per convalidare la stima della profondità 2D.

In questa serie, ti mostriamo come addestrare un modello di rilevamento di oggetti che viene eseguito su dati di nuvole di punti per prevedere la posizione dei veicoli in una scena 3D. In questo post, ci concentriamo in particolare sull'etichettatura dei dati LiDAR. L'output del sensore LiDAR standard è una sequenza di fotogrammi nuvola di punti 3D, con una velocità di acquisizione tipica di 10 fotogrammi al secondo. Per etichettare questo output del sensore è necessario uno strumento di etichettatura in grado di gestire i dati 3D. Amazon SageMaker verità fondamentale semplifica l'etichettatura degli oggetti in un singolo fotogramma 3D o in una sequenza di fotogrammi nuvola di punti 3D per la creazione di set di dati di addestramento ML. Ground Truth supporta anche la fusione di sensori di dati di telecamere e LiDAR con un massimo di otto ingressi per videocamere.

I dati sono essenziali per qualsiasi progetto ML. I dati 3D in particolare possono essere difficili da reperire, visualizzare ed etichettare. Noi usiamo il Serie di dati A2D2 in questo post e guidarti attraverso i passaggi per visualizzarlo ed etichettarlo.

A2D2 contiene 40,000 frame con segmentazione semantica ed etichette di nuvole di punti, inclusi 12,499 frame con etichette di bounding box 3D. Poiché ci stiamo concentrando sul rilevamento degli oggetti, siamo interessati ai 12,499 fotogrammi con etichette del riquadro di delimitazione 3D. Queste annotazioni includono 14 classi relative alla guida come auto, pedoni, camion, autobus, ecc.

La tabella seguente mostra l'elenco completo delle classi:

| Indice | Elenco delle classi |

| 1 | animali |

| 2 | bicicletta |

| 3 | autobus |

| 4 | auto |

| 5 | trasportatore di roulotte |

| 6 | ciclista |

| 7 | veicolo di emergenza |

| 8 | motociclista |

| 9 | MOTO |

| 10 | pedone |

| 11 | trailer |

| 12 | camion |

| 13 | veicolo d'utilità |

| 14 | furgone/SUV |

Addestreremo il nostro rilevatore per rilevare in modo specifico le auto poiché questa è la classe più comune nel nostro set di dati (32616 dei 42816 oggetti totali nel set di dati sono etichettati come auto).

Panoramica della soluzione

In questa serie, spieghiamo come visualizzare ed etichettare i tuoi dati con Amazon SageMaker Ground Truth e dimostriamo come utilizzare questi dati in un processo di formazione di Amazon SageMaker per creare un modello di rilevamento degli oggetti, distribuito a un Amazon SageMaker Endpoint. In particolare, utilizzeremo un notebook Amazon SageMaker per far funzionare la soluzione e lanciare eventuali attività di etichettatura o formazione.

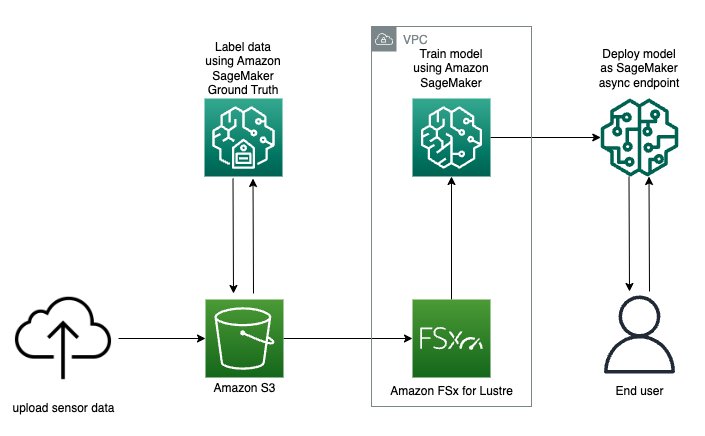

Il diagramma seguente illustra il flusso complessivo dei dati dei sensori dall'etichettatura alla formazione fino all'implementazione:

Imparerai come addestrare e distribuire un modello di rilevamento di oggetti 3D in tempo reale con Amazon Sage Maker Ground Truth con i seguenti passaggi:

- Scarica e visualizza un set di dati della nuvola di punti

- Preparare i dati da etichettare con il Strumento nuvola di punti Amazon SageMaker Ground Truth

- Avvia un lavoro di formazione distribuito su Amazon SageMaker Ground Truth con MMDetection3D

- Valuta i risultati del tuo lavoro di formazione e profila l'utilizzo delle risorse con Debugger di Amazon SageMaker

- Distribuisci un file asincrono Endpoint di SageMaker

- Chiama l'endpoint e visualizza le previsioni degli oggetti 3D

Servizi AWS utilizzati per implementare questa soluzione

Prerequisiti

Il diagramma seguente mostra come creare una forza lavoro privata. Per le istruzioni scritte passo dopo passo, vedere Crea una forza lavoro Amazon Cognito utilizzando la pagina Etichettatura forza lavoro.

Avvio dello stack AWS CloudFormation

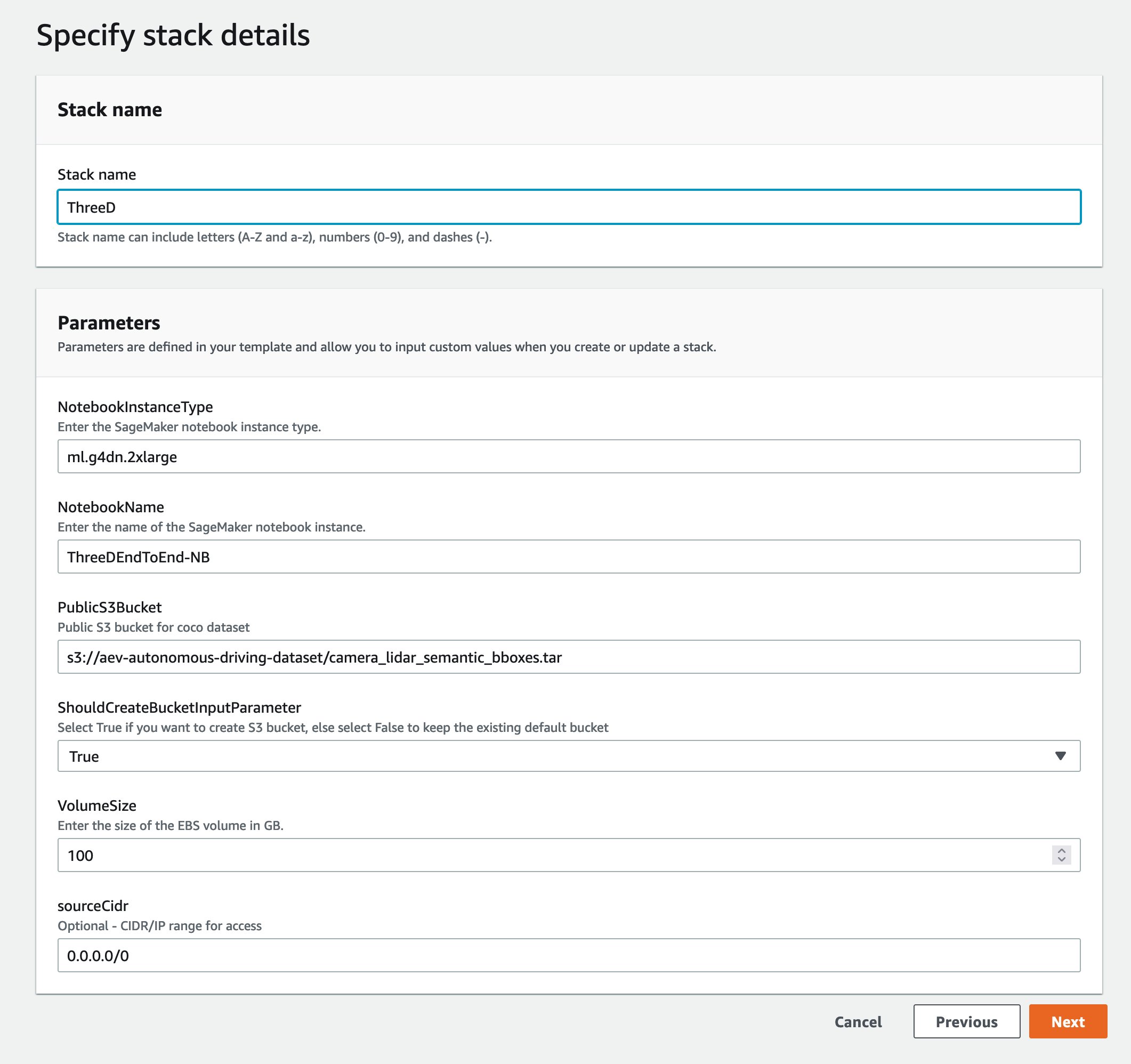

Ora che hai visto la struttura della soluzione, distribuiscila nel tuo account in modo da poter eseguire un flusso di lavoro di esempio. Tutte le fasi di distribuzione relative alla pipeline di etichettatura sono gestite da AWS CloudFormation. Ciò significa che AWS Cloudformation crea la tua istanza notebook nonché eventuali ruoli o bucket Amazon S3 per supportare l'esecuzione della soluzione.

Puoi avviare lo stack nella regione AWS us-east-1 sulla console AWS CloudFormation utilizzando il file Avvia Stack

pulsante. Per avviare lo stack in una regione diversa, utilizzare le istruzioni che si trovano nel README del file Repository GitHub.

Questo richiede circa 20 minuti per creare tutte le risorse. Puoi monitorare lo stato di avanzamento dall'interfaccia utente (UI) di AWS CloudFormation.

Al termine dell'esecuzione del modello CloudFormation, torna alla console AWS.

Apertura del taccuino

Le istanze notebook di Amazon SageMaker sono istanze di calcolo ML che vengono eseguite sull'app Jupyter Notebook. Amazon SageMaker gestisce la creazione di istanze e risorse correlate. Utilizza i notebook Jupyter nella tua istanza notebook per preparare ed elaborare dati, scrivere codice per addestrare modelli, distribuire modelli nell'hosting Amazon SageMaker e testare o convalidare i tuoi modelli.

Segui i passaggi successivi per accedere all'ambiente Amazon SageMaker Notebook:

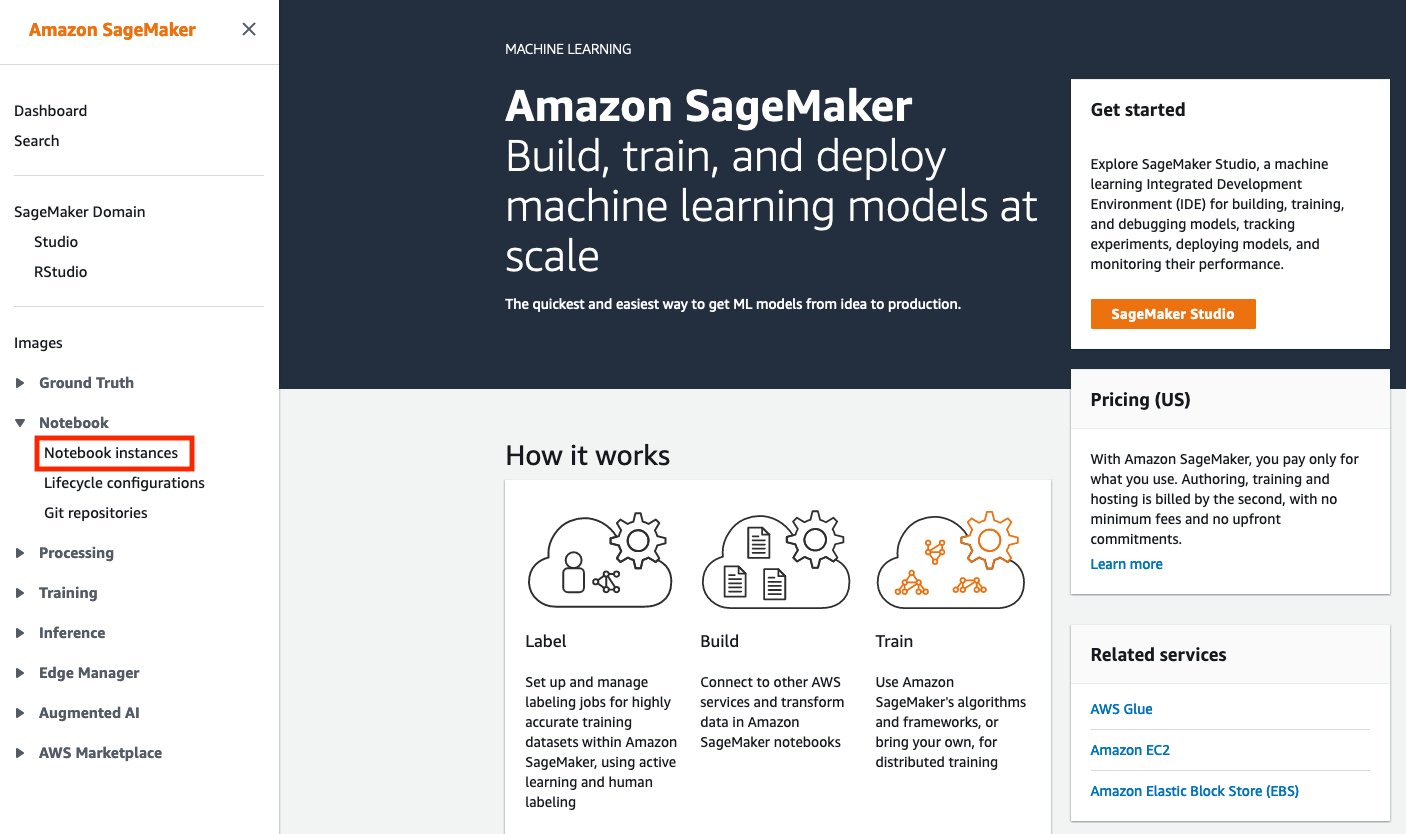

- Sotto servizi cerca Amazon Sage Maker.

- Sotto Taccuino, selezionare Istanze di notebook.

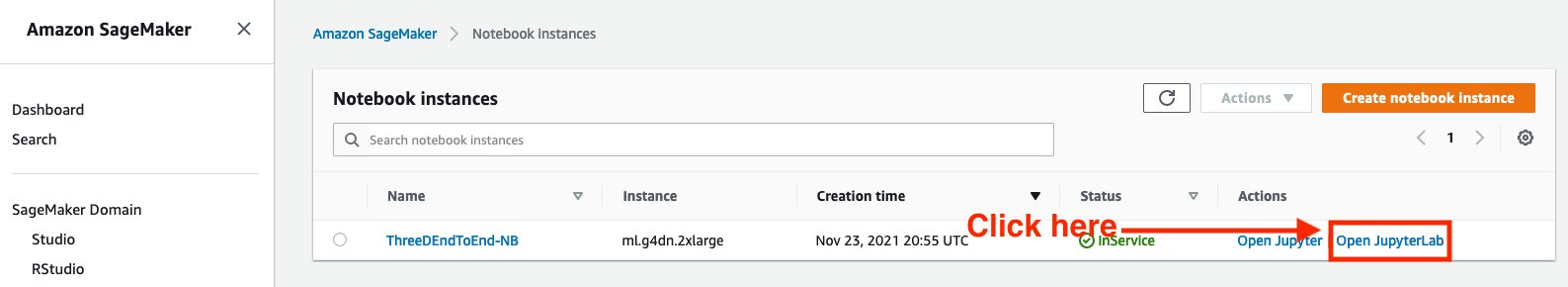

- È necessario eseguire il provisioning di un'istanza Notebook. Seleziona Apri laboratorio giove, che si trova sul lato destro dell'istanza Notebook di cui è stato eseguito il provisioning preliminare sotto Azioni.

- Vedrai un'icona come questa mentre la pagina viene caricata:

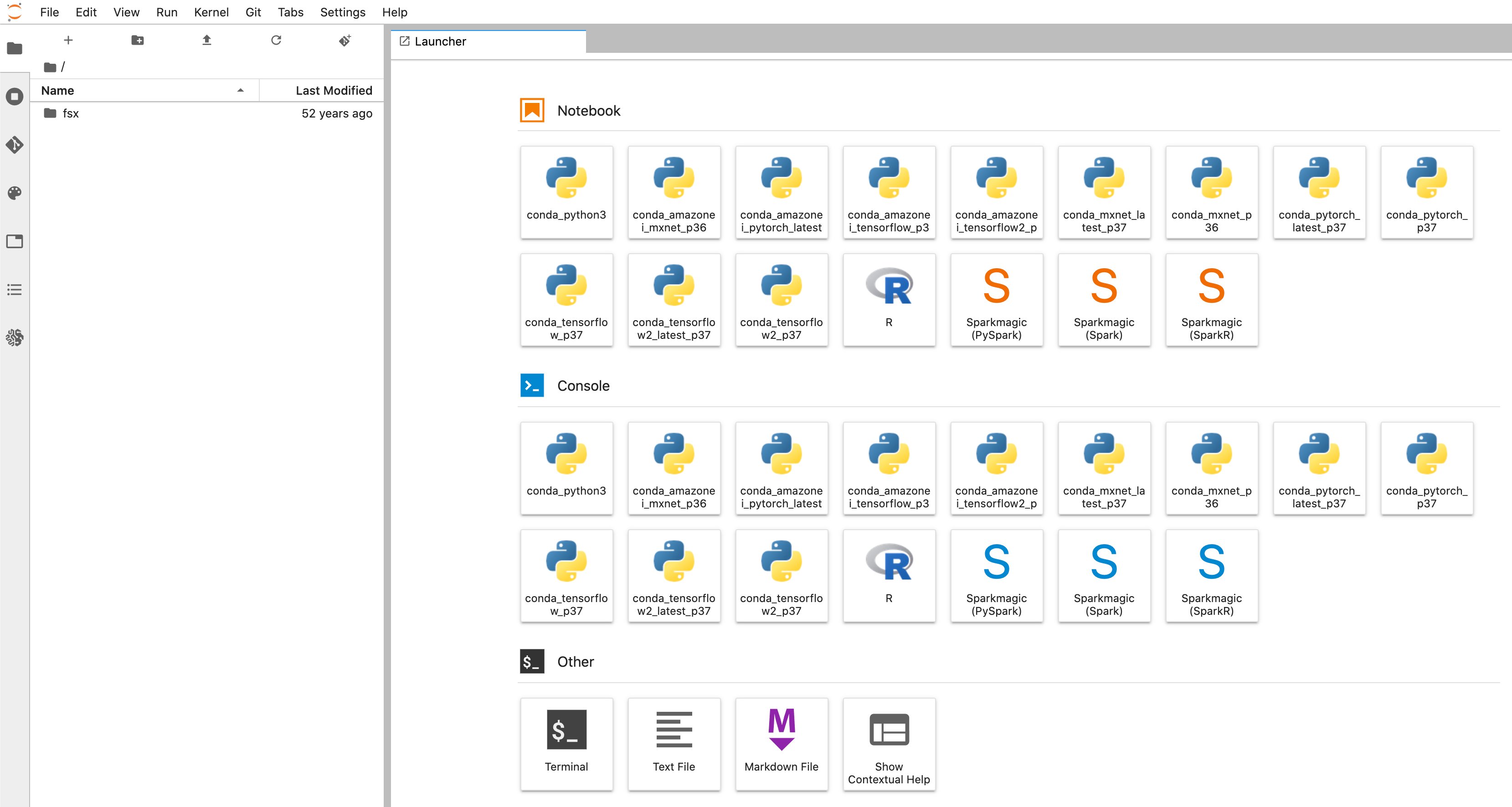

- Verrai reindirizzato a una nuova scheda del browser simile al seguente diagramma:

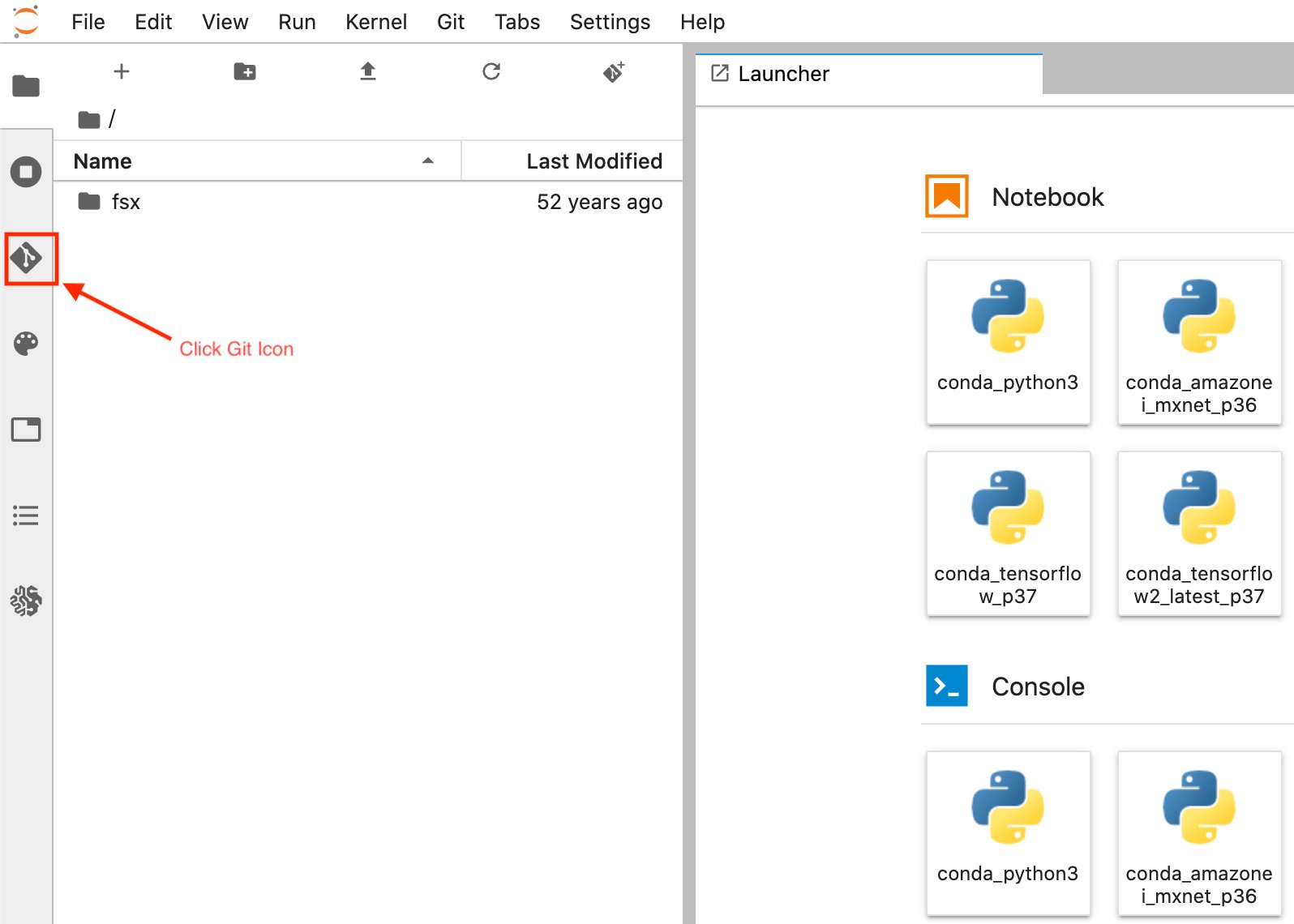

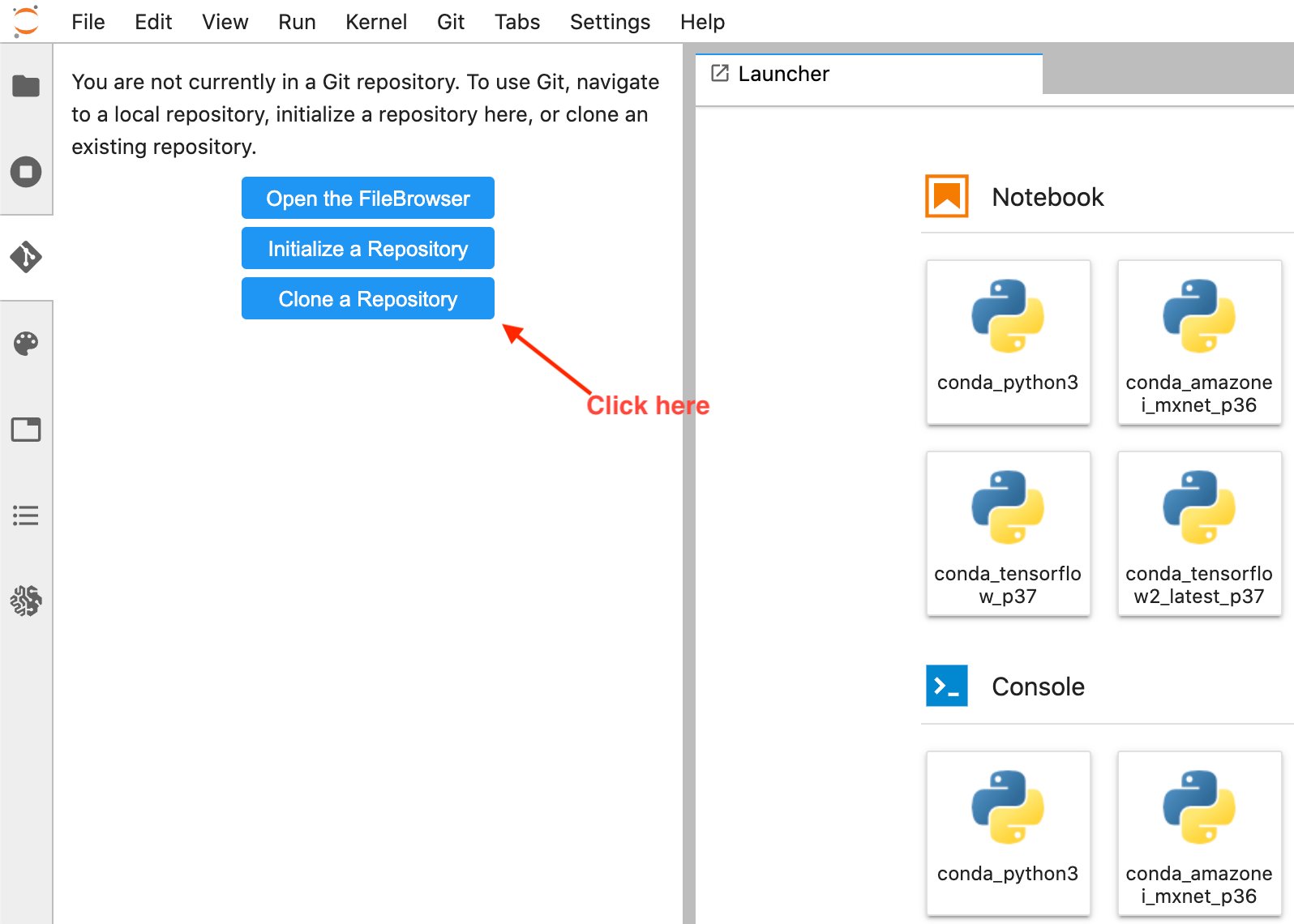

- Una volta che ti trovi nell'interfaccia utente di Amazon SageMaker Notebook Instance Launcher. Dalla barra laterale di sinistra, seleziona il Idiota icona come mostrato nel diagramma seguente.

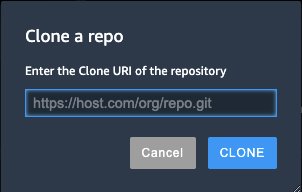

- Seleziona Clona un repository opzione.

- Inserisci l'URL di GitHub(https://github.com/aws-samples/end-2-end-3d-ml) nella finestra a comparsa e scegliere clonare.

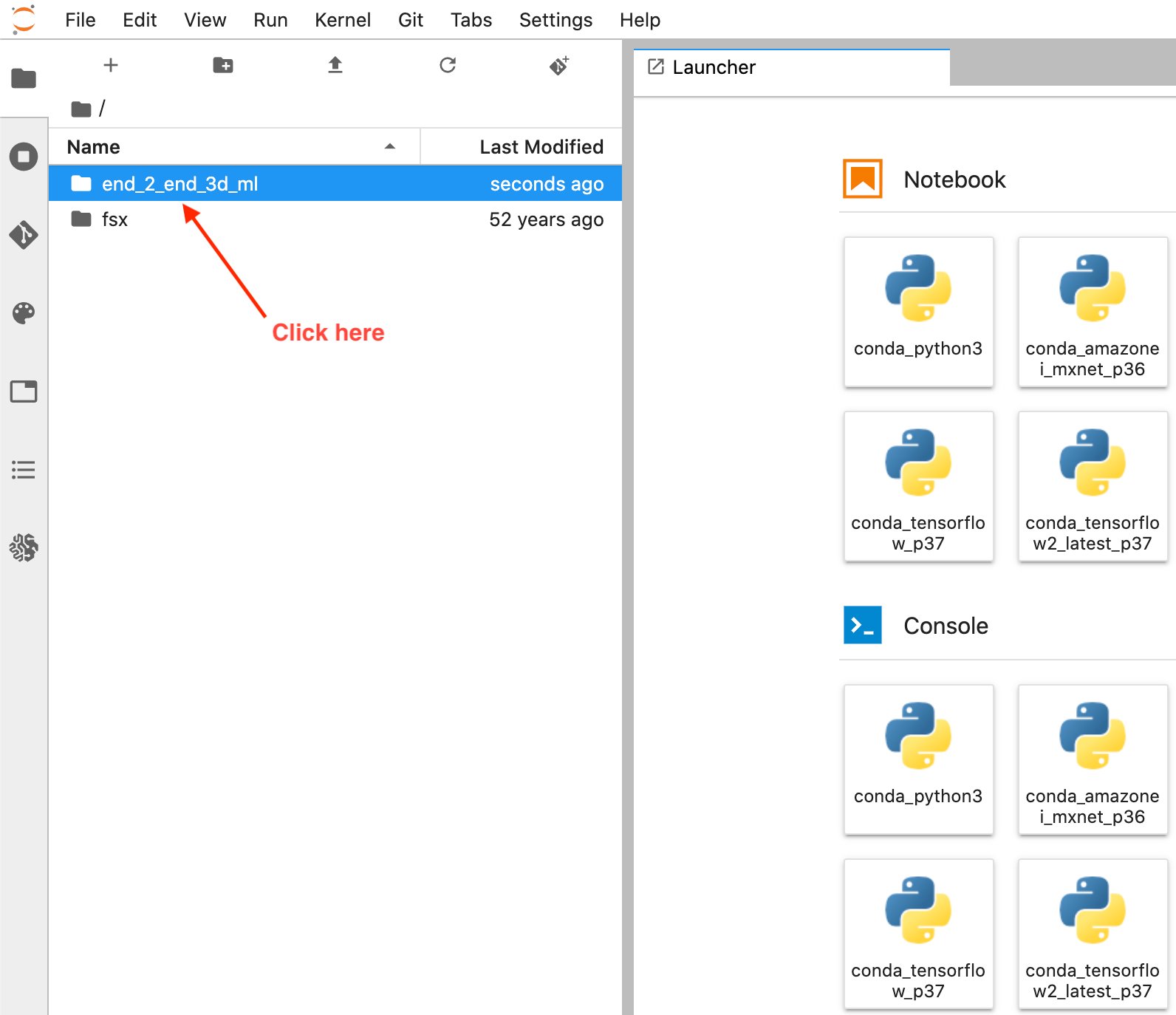

- Seleziona File Browser per vedere la cartella GitHub.

- Apri il taccuino intitolato

1_visualization.ipynb.

Utilizzo del notebook

Panoramica

Le prime celle del taccuino nella sezione intitolata File scaricati spiega come scaricare il set di dati e ispezionare i file al suo interno. Dopo che le celle sono state eseguite, sono necessari alcuni minuti per completare il download dei dati.

Una volta scaricato, puoi rivedere la struttura del file di A2D2, che è un elenco di scene o unità. Una scena è una breve registrazione dei dati dei sensori del nostro veicolo. A2D2 ci fornisce 18 di queste scene su cui allenarci, tutte identificate da date univoche. Ogni scena contiene dati della telecamera 2D, etichette 2D, annotazioni parallelepipede 3D e nuvole di punti 3D.

È possibile visualizzare la struttura del file per il set di dati A2D2 con quanto segue:

Configurazione del sensore A2D2

La sezione successiva illustra la lettura di alcuni di questi dati della nuvola di punti per assicurarci di interpretarli correttamente e di poterli visualizzare nel notebook prima di provare a convertirli in un formato pronto per l'etichettatura dei dati.

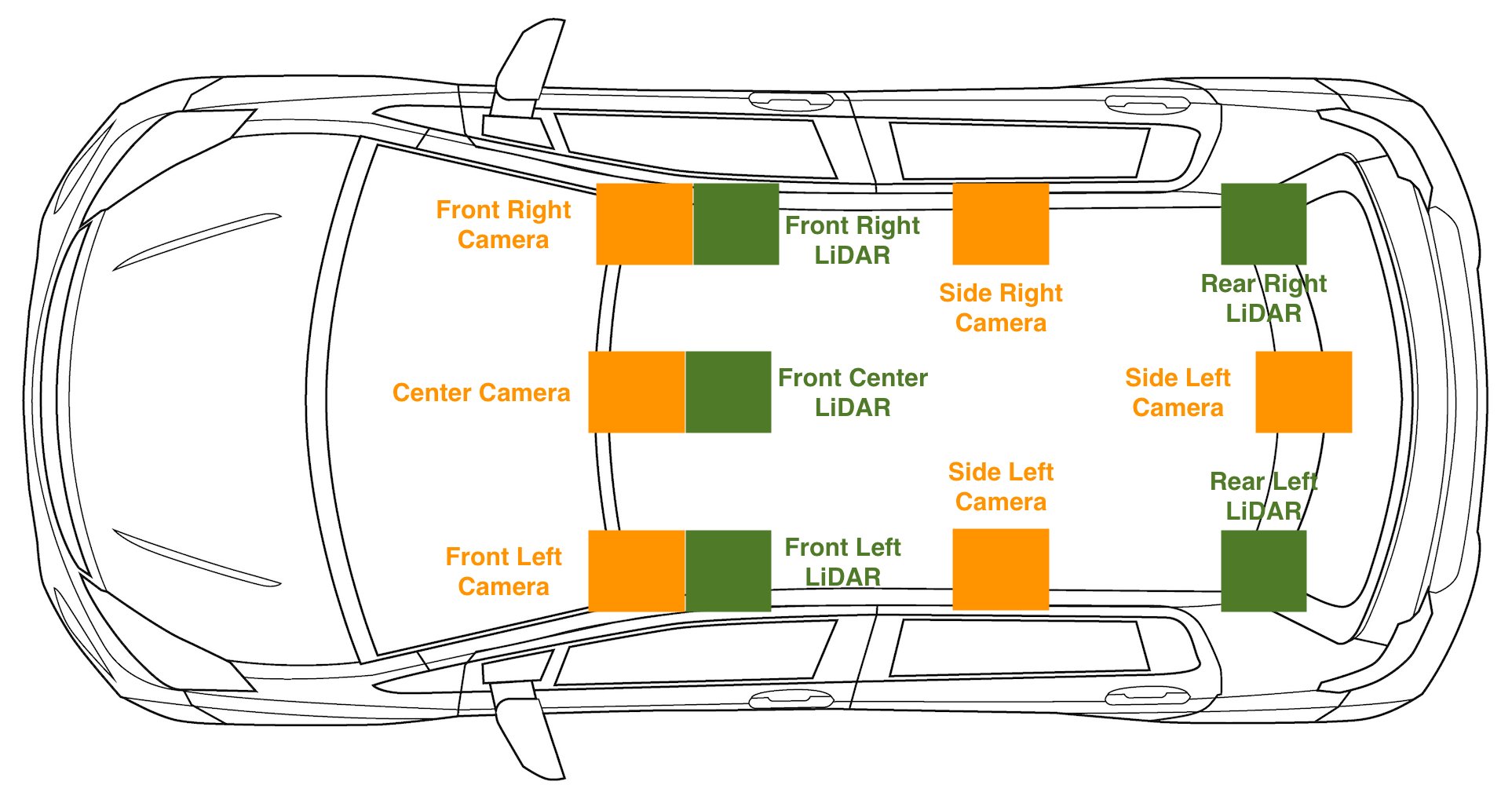

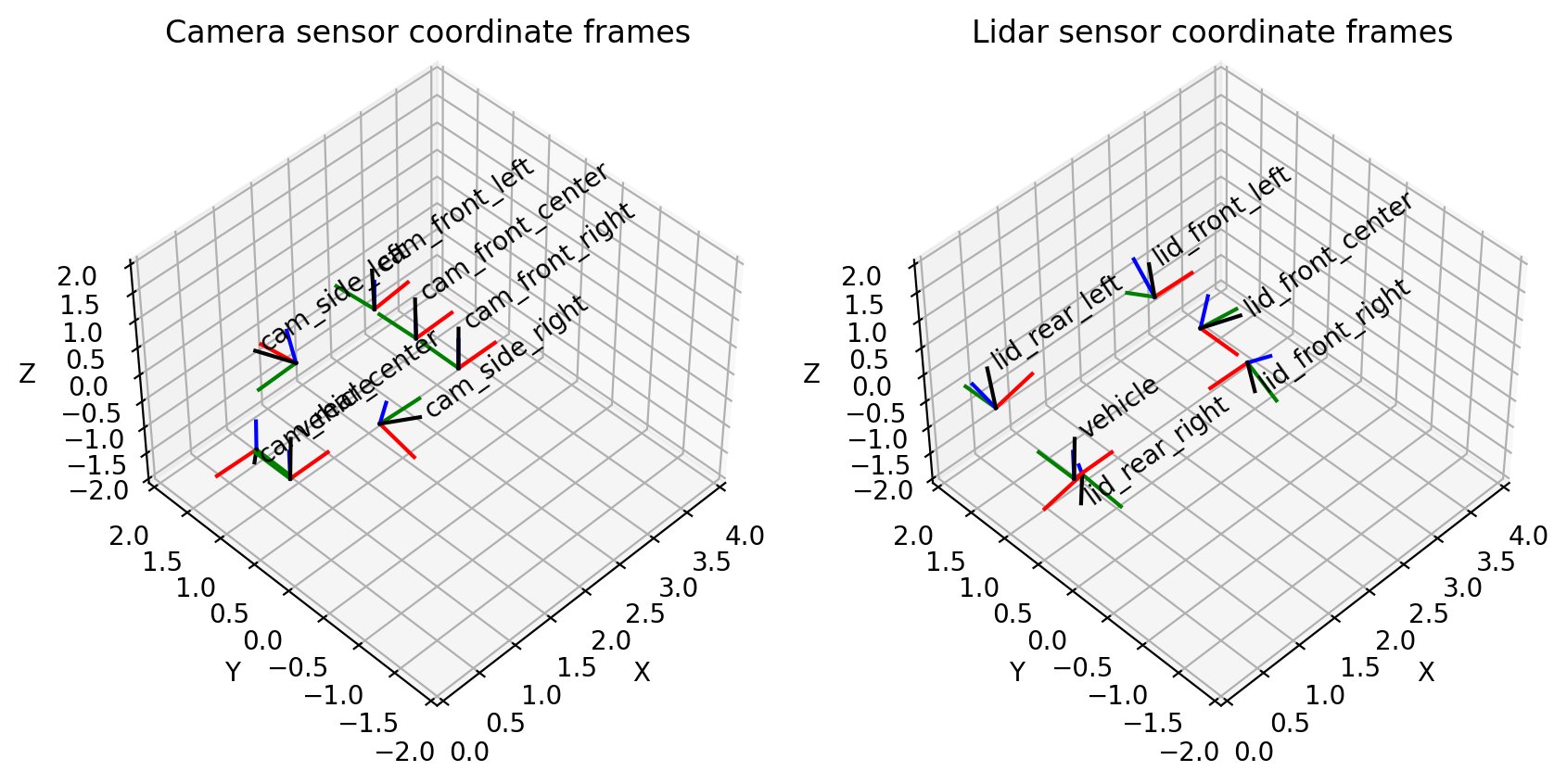

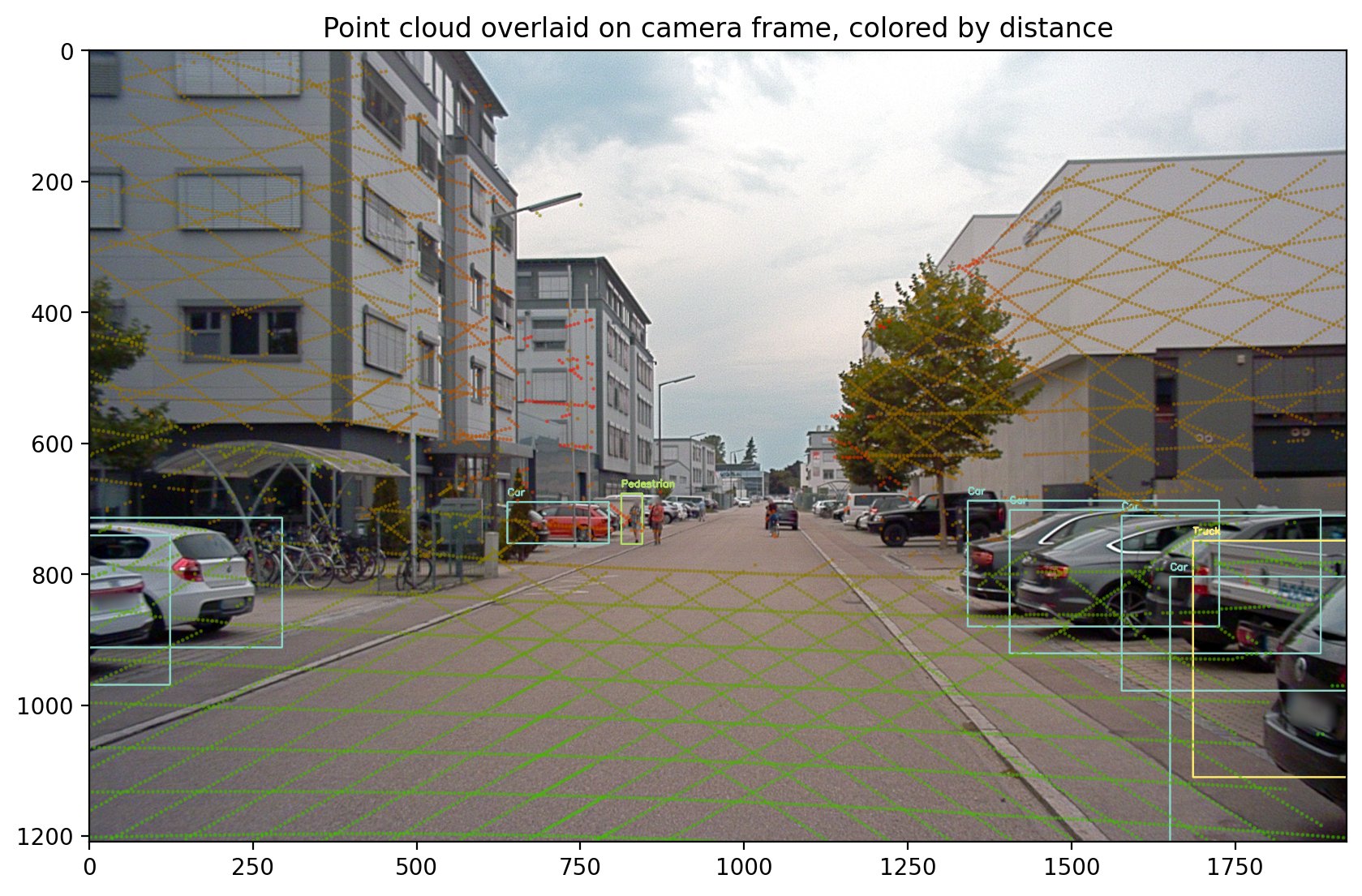

Per qualsiasi tipo di configurazione di guida autonoma in cui disponiamo di dati del sensore 2D e 3D, l'acquisizione dei dati di calibrazione del sensore è essenziale. Oltre ai dati grezzi, abbiamo anche scaricato cams_lidar.json. Questo file contiene la traslazione e l'orientamento di ciascun sensore rispetto al quadro di coordinate del veicolo, che può essere indicato anche come posizione del sensore o posizione nello spazio. Questo è importante per convertire i punti dal quadro di coordinate di un sensore al quadro di coordinate del veicolo. In altre parole, è importante per visualizzare i sensori 2D e 3D durante la guida del veicolo. Il quadro delle coordinate del veicolo è definito come un punto statico al centro del veicolo, con l'asse x nella direzione del movimento in avanti del veicolo, l'asse y che indica sinistra e destra con sinistra positiva e z- asse che punta attraverso il tetto del veicolo. Un punto (X, Y, Z) di (5,2,1) significa che questo punto è 5 metri davanti al nostro veicolo, 2 metri a sinistra e 1 metro sopra il nostro veicolo. Avere queste calibrazioni ci consente anche di proiettare punti 3D sulla nostra immagine 2D, il che è particolarmente utile per le attività di etichettatura delle nuvole di punti.

Per vedere la configurazione del sensore sul veicolo, controllare il diagramma seguente.

I dati della nuvola di punti su cui ci stiamo allenando sono specificamente allineati con la fotocamera frontale o la camma frontale:

Ciò corrisponde alla nostra visualizzazione dei sensori della fotocamera in 3D:

Questa parte del notebook passa attraverso la convalida che il set di dati A2D2 corrisponde alle nostre aspettative sulle posizioni dei sensori e che siamo in grado di allineare i dati dai sensori della nuvola di punti nel frame della fotocamera. Sentiti libero di eseguire tutte le celle attraverso quella intitolata Proiezione dal 3D al 2D per visualizzare la sovrapposizione dei dati della nuvola di punti sulla seguente immagine della telecamera.

Conversione ad Amazon SageMaker Ground Truth

Dopo aver visualizzato i nostri dati nel nostro taccuino, possiamo convertire con sicurezza le nostre nuvole di punti in Amazon Formato 3D di SageMaker Ground Truth per verificare e regolare le nostre etichette. Questa sezione illustra la conversione dal formato dati di A2D2 in un Amazon File di sequenza SageMaker Ground Truth, con il formato di input utilizzato dalla modalità di tracciamento dell'oggetto.

Il formato del file di sequenza include i formati delle nuvole di punti, le immagini associate a ciascuna nuvola di punti e tutti i dati di posizione e orientamento del sensore necessari per allineare le immagini con le nuvole di punti. Queste conversioni vengono eseguite utilizzando le informazioni del sensore lette dalla sezione precedente. L'esempio seguente è un formato di file di sequenza da Amazon SageMaker Ground Truth, che descrive una sequenza con un solo passo temporale.

La nuvola di punti per questa fase temporale si trova in s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/20180807145028_lidar_frontcenter_000000091.txt e ha un formato di <x coordinate> <y coordinate> <z coordinate>.

Associata alla nuvola di punti, è l'immagine di una singola telecamera situata a s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/undistort_20180807145028_camera_frontcenter_000000091.png. Si noti che prendiamo il file di sequenza che definisce tutti i parametri della fotocamera per consentire la proiezione dalla nuvola di punti alla fotocamera e viceversa.

La conversione in questo formato di input ci richiede di scrivere una conversione dal formato dati di A2D2 ai formati dati supportati da Amazon SageMaker Ground Truth. Questo è lo stesso processo a cui deve sottoporsi chiunque porti i propri dati per l'etichettatura. Esamineremo come funziona questa conversione, passo dopo passo. Se segui il taccuino, guarda la funzione nominata a2d2_scene_to_smgt_sequence_and_seq_label.

Conversione nuvola di punti

Il primo passaggio consiste nel convertire i dati da un file compresso in formato Numpy (NPZ), che è stato generato con numpy.sapere metodo, ad un formato 3D grezzo accettato per Amazon SageMaker Ground Truth. Nello specifico, generiamo un file con una riga per punto. Ogni punto 3D è definito da tre coordinate X, Y e Z in virgola mobile. Quando specifichiamo il nostro formato nel file di sequenza, usiamo la stringa text/xyz per rappresentare questo formato. Amazon SageMaker Ground Truth supporta anche l'aggiunta di valori di intensità o punti Red Green Blue (RGB).

I file NPZ di A2D2 contengono più array Numpy, ciascuno con il proprio nome. Per eseguire una conversione, carichiamo il file NPZ utilizzando Numpy's caricare metodo, accedere all'array chiamato punti (ovvero, un array Nx3, dove N è il numero di punti nella nuvola di punti) e salvare come testo in un nuovo file utilizzando Numpy's salvatxt metodo.

Pre-elaborazione delle immagini

Successivamente, prepariamo i nostri file immagine. A2D2 fornisce immagini PNG e Amazon SageMaker Ground Truth supporta immagini PNG; tuttavia, queste immagini sono distorte. La distorsione si verifica spesso perché l'obiettivo di ripresa dell'immagine non è allineato parallelamente al piano dell'immagine, il che rende alcune aree dell'immagine più vicine del previsto. Questa distorsione descrive la differenza tra una fotocamera fisica e una modello di fotocamera pinhole idealizzato. Se la distorsione non viene presa in considerazione, Amazon SageMaker Ground Truth non sarà in grado di eseguire il rendering dei nostri punti 3D sopra le viste della telecamera, il che rende più difficile eseguire l'etichettatura. Per un tutorial sulla calibrazione della fotocamera, guarda questa documentazione da OpenCV.

Sebbene Amazon SageMaker Ground Truth supporti i coefficienti di distorsione nel suo file di input, puoi anche eseguire la pre-elaborazione prima del lavoro di etichettatura. Poiché A2D2 fornisce il codice di supporto per eseguire la non distorsione, lo applichiamo all'immagine e lasciamo i campi relativi alla distorsione fuori dal nostro file di sequenza. Si noti che i campi relativi alla distorsione includono k1, k2, k3, k4, p1, p2 e inclinazione.

Posizione della telecamera, orientamento e conversione della proiezione

Oltre ai file di dati grezzi richiesti per l'etichettatura, il file di sequenza richiede anche la posizione della telecamera e le informazioni sull'orientamento per eseguire la proiezione di punti 3D nelle viste della telecamera 2D. Abbiamo bisogno di sapere dove sta guardando la telecamera nello spazio 3D per capire come dovrebbero essere renderizzate le etichette cuboidi 3D e i punti 3D sopra le nostre immagini.

Poiché abbiamo caricato le posizioni dei nostri sensori in un gestore di trasformazione comune nella sezione di configurazione del sensore A2D2, possiamo facilmente interrogare il gestore di trasformazione per le informazioni che vogliamo. Nel nostro caso, trattiamo la posizione del veicolo come (0, 0, 0) in ogni frame perché non disponiamo delle informazioni sulla posizione del sensore fornite dal set di dati di rilevamento degli oggetti di A2D2. Quindi rispetto al nostro veicolo, l'orientamento e la posizione della telecamera sono descritti dal seguente codice:

Ora che la posizione e l'orientamento sono stati convertiti, dobbiamo anche fornire i valori per fx, fy, cx e cy, tutti parametri per ciascuna telecamera nel formato del file di sequenza.

Questi parametri si riferiscono a valori nella matrice della telecamera. Mentre la posizione e l'orientamento descrivono in che direzione è rivolta una telecamera, la matrice della telecamera descrive il campo visivo della telecamera ed esattamente come un punto 3D relativo alla telecamera viene convertito in una posizione di pixel 2D in un'immagine.

A2D2 fornisce una matrice di telecamere. Nel codice seguente viene mostrata una matrice della fotocamera di riferimento, insieme al modo in cui il nostro notebook indicizza questa matrice per ottenere i campi appropriati.

Con tutti i campi analizzati dal formato di A2D2, possiamo salvare il file di sequenza e usarlo in un Amazon File manifest di input di SageMaker Ground Truth per iniziare un lavoro di etichettatura. Questo lavoro di etichettatura ci consente di creare etichette del riquadro di delimitazione 3D da utilizzare a valle per l'addestramento del modello 3D.

Esegui tutte le celle fino alla fine del notebook e assicurati di sostituire il workteam ARN con Amazon SageMaker Ground Truth workteam ARN hai creato un prerequisito. Dopo circa 10 minuti dall'etichettatura del tempo di creazione del lavoro, dovresti essere in grado di accedere al portale dei lavoratori e utilizzare il file etichettatura dell'interfaccia utente per visualizzare la tua scena.

ripulire

Elimina lo stack AWS CloudFormation che hai distribuito utilizzando il file Avvia Stack pulsante denominato ThreeD nella console AWS CloudFormation per rimuovere tutte le risorse utilizzate in questo post, comprese eventuali istanze in esecuzione.

Costi stimati

Il costo approssimativo è di $ 5 per 2 ore.

Conclusione

In questo post, abbiamo dimostrato come prendere i dati 3D e convertirli in un modulo pronto per l'etichettatura in Amazon SageMaker Ground Truth. Con questi passaggi, puoi etichettare i tuoi dati 3D per l'addestramento dei modelli di rilevamento degli oggetti. Nel prossimo post di questa serie, ti mostreremo come prendere A2D2 e addestrare un modello di rilevatore di oggetti sulle etichette già presenti nel set di dati.

Buona costruzione!

Informazioni sugli autori

Isacco Privitera è Senior Data Scientist presso il Lab di Amazon Machine Learning Solutions, dove sviluppa soluzioni di machine learning e deep learning su misura per affrontare i problemi aziendali dei clienti. Lavora principalmente nello spazio della visione artificiale, concentrandosi sull'abilitare i clienti AWS con formazione distribuita e apprendimento attivo.

Isacco Privitera è Senior Data Scientist presso il Lab di Amazon Machine Learning Solutions, dove sviluppa soluzioni di machine learning e deep learning su misura per affrontare i problemi aziendali dei clienti. Lavora principalmente nello spazio della visione artificiale, concentrandosi sull'abilitare i clienti AWS con formazione distribuita e apprendimento attivo.

Vidya Sagar Ravipati è Manager presso il Lab di Amazon Machine Learning Solutions, dove sfrutta la sua vasta esperienza nei sistemi distribuiti su larga scala e la sua passione per il machine learning per aiutare i clienti AWS in diversi settori verticali ad accelerare la loro adozione di intelligenza artificiale e cloud. In precedenza, era un ingegnere di machine learning nei servizi di connettività presso Amazon che ha contribuito a creare piattaforme di personalizzazione e manutenzione predittiva.

Vidya Sagar Ravipati è Manager presso il Lab di Amazon Machine Learning Solutions, dove sfrutta la sua vasta esperienza nei sistemi distribuiti su larga scala e la sua passione per il machine learning per aiutare i clienti AWS in diversi settori verticali ad accelerare la loro adozione di intelligenza artificiale e cloud. In precedenza, era un ingegnere di machine learning nei servizi di connettività presso Amazon che ha contribuito a creare piattaforme di personalizzazione e manutenzione predittiva.

Jeremy Feltracco è un ingegnere di sviluppo software con th Lab di Amazon Machine Learning Solutions presso Amazon Web Services. Usa il suo background in visione artificiale, robotica e apprendimento automatico per aiutare i clienti AWS ad accelerare l'adozione dell'IA.

Jeremy Feltracco è un ingegnere di sviluppo software con th Lab di Amazon Machine Learning Solutions presso Amazon Web Services. Usa il suo background in visione artificiale, robotica e apprendimento automatico per aiutare i clienti AWS ad accelerare l'adozione dell'IA.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/using-amazon-sagemaker-with-point-clouds-part-1-ground-truth-for-3d-labeling/

- :È

- $ SU

- 000

- 1

- 10

- 100

- 1996

- 2D

- 3d

- 7

- 9

- a

- capace

- WRI

- sopra

- accelerare

- accesso

- accessibile

- Il mio account

- operanti in

- attivo

- aggiunta

- indirizzo

- Adozione

- Dopo shavasana, sedersi in silenzio; saluti;

- avanti

- AI

- Allineati

- Tutti

- consente

- già

- Amazon

- Amazzonia Cognito

- Amazon Sage Maker

- Amazon SageMaker verità fondamentale

- Amazon Web Services

- ed

- chiunque

- App

- APPLICA

- opportuno

- circa

- architettura

- SONO

- aree

- in giro

- Italia

- AS

- associato

- At

- aumentata

- Realtà aumentata (RA)

- autonomo

- disponibilità

- AWS

- AWS CloudFormazione

- precedente

- sfondo

- BE

- perché

- diventare

- prima

- essendo

- sotto

- fra

- Blu

- Scatola

- Portare

- del browser

- costruire

- Costruzione

- autobus

- affari

- pulsante

- by

- detto

- stanza

- Materiale

- catturare

- Catturare

- auto

- auto

- Custodie

- Celle

- centro

- impegnativo

- dai un'occhiata

- Scegli

- classe

- classi

- più vicino

- Cloud

- adozione del cloud

- codice

- Uncommon

- Aziende

- completamento di una

- Calcolare

- computer

- Visione computerizzata

- con fiducia

- Connettività

- consolle

- contenere

- contiene

- Conversione

- conversioni

- convertire

- convertito

- coordinare

- Costo

- costo effettivo

- coprire

- creare

- creato

- crea

- creazione

- Clienti

- CX

- dati

- scienziato di dati

- dataset

- Date

- deep

- apprendimento profondo

- definito

- definisce

- dimostrare

- dimostrato

- dimostra

- schierare

- schierato

- deployment

- profondità

- descrivere

- descritta

- rivelazione

- determinazione

- Mercato

- sviluppa

- dispositivi

- differenza

- diverso

- difficile

- direzione

- discutere

- distribuito

- sistemi distribuiti

- formazione distribuita

- documentazione

- Dont

- scaricare

- guida

- e

- ogni

- facilmente

- consentendo

- endpoint

- ingegnere

- garantire

- Ambiente

- particolarmente

- essential

- eccetera

- Anche

- di preciso

- esempio

- le aspettative

- previsto

- esperienza

- di fronte

- pochi

- campo

- campi

- figura

- Compila il

- File

- finire

- Nome

- galleggiante

- flusso

- Focus

- messa a fuoco

- i seguenti

- Nel

- modulo

- formato

- Avanti

- essere trovato

- TELAIO

- Gratis

- da

- anteriore

- function

- fusione

- FX

- generare

- generato

- ottenere

- gif

- Idiota

- GitHub

- Go

- va

- Green

- Terra

- Crescita

- maniglia

- Avere

- avendo

- Titolo

- Aiuto

- aiutato

- utile

- di hosting

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- i

- ICON

- identificato

- Immagine

- immagini

- Imaging

- realizzare

- importante

- in

- In altre

- includere

- inclusi

- Compreso

- è aumentato

- sempre più

- indici

- industria

- informazioni

- ingresso

- esempio

- istruzioni

- interesse

- interessato

- Interfaccia

- IT

- SUO

- Lavoro

- Offerte di lavoro

- jpg

- json

- Genere

- Sapere

- Discografica

- etichettatura

- per il tuo brand

- larga scala

- laser

- lanciare

- IMPARARE

- apprendimento

- Lasciare

- leveraggi

- leggera

- piace

- Lista

- caricare

- carichi

- collocato

- località

- Guarda

- cerca

- SEMBRA

- macchina

- machine learning

- manutenzione

- make

- FA

- gestito

- direttore

- gestisce

- mappatura

- Matrice

- si intende

- di misura

- metodo

- Minuti

- ML

- Mobile

- dispositivi mobili

- modello

- modelli

- Monitorare

- Scopri di più

- maggior parte

- movimento

- multiplo

- Nome

- Detto

- Bisogno

- New

- GENERAZIONE

- taccuino

- numero

- numpy

- oggetto

- Rilevazione dell'oggetto

- oggetti

- of

- on

- ONE

- aprire

- OpenCV

- operare

- Opzione

- Altro

- produzione

- complessivo

- proprio

- pagina

- Parallel

- parametri

- parte

- particolare

- passione

- sentiero

- Eseguire

- personalizzazione

- Fisico

- conduttura

- pixel

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- punti

- Portale

- posizione

- posizioni

- positivo

- Post

- predire

- Preparare

- precedente

- in precedenza

- principalmente

- un bagno

- problemi

- processi

- Produzione

- profiling

- Progressi

- progetto

- Proiezione

- purché

- fornisce

- che vanno

- tasso

- Crudo

- Leggi

- Lettura

- pronto

- tempo reale

- Realtà

- registrazione

- Rosso

- di cui

- riflette

- regione

- relazionato

- pertinente

- rimanente

- rimuovere

- sostituire

- rappresentare

- necessario

- richiede

- risorsa

- Risorse

- Risultati

- ritorno

- recensioni

- RGB

- robotica

- ruoli

- tetto

- RIGA

- Correre

- running

- s

- sagemaker

- stesso

- Risparmi

- scena

- Scene

- Scienziato

- Cerca

- Secondo

- Sezione

- segmentazione

- anziano

- sensore

- Sequenza

- Serie

- Servizi

- flessibile.

- Corti

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Spettacoli

- lato

- Signal

- da

- singolo

- So

- Software

- lo sviluppo del software

- soluzione

- Soluzioni

- alcuni

- Fonte

- lo spazio

- spazi

- in particolare

- pila

- Standard

- inizia a

- step

- Passi

- La struttura

- fornire

- supporto

- supportato

- supporti

- superficie

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- prende

- mira

- task

- modello

- test

- che

- Il

- le informazioni

- loro

- Strumenti Bowman per analizzare le seguenti finiture:

- tre

- Attraverso

- tempo

- titolato

- a

- top

- Totale

- Tracking

- Treni

- Training

- Trasformare

- Traduzione

- trattare

- camion

- lezione

- tipico

- tipicamente

- ui

- per

- capire

- e una comprensione reciproca

- unico

- us

- uso

- Utente

- Interfaccia utente

- CONVALIDARE

- Valori

- Fisso

- veicolo

- Veicoli

- verificare

- verticali

- Video

- Visualizza

- visualizzazioni

- visione

- visualizzazione

- Modo..

- sito web

- servizi web

- WELL

- quale

- while

- OMS

- wikipedia

- volere

- con

- entro

- parole

- lavoratore

- Forza lavoro

- lavori

- scrivere

- scrivere codice

- scritto

- X

- YAML

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro