I clienti si trovano ad affrontare crescenti minacce alla sicurezza e vulnerabilità nelle infrastrutture e nelle risorse applicative man mano che la loro impronta digitale si è ampliata e l’impatto aziendale di tali risorse digitali è cresciuto. Una sfida comune alla sicurezza informatica è stata duplice:

- Consumare registri da risorse digitali disponibili in diversi formati e schemi e automatizzare l'analisi dei risultati delle minacce in base a tali registri.

- Sia che i log provengano da Amazon Web Services (AWS), da altri provider cloud, da dispositivi locali o periferici, i clienti devono centralizzare e standardizzare i dati di sicurezza.

Inoltre, l’analisi per l’identificazione delle minacce alla sicurezza deve essere in grado di scalare ed evolversi per soddisfare un panorama in evoluzione di attori delle minacce, vettori di sicurezza e risorse digitali.

Un nuovo approccio per risolvere questo complesso scenario di analisi della sicurezza combina l'acquisizione e l'archiviazione dei dati di sicurezza utilizzando Lago di sicurezza Amazon e analizzare i dati di sicurezza con l'utilizzo dell'apprendimento automatico (ML). Amazon Sage Maker. Amazon Security Lake è un servizio appositamente creato che centralizza automaticamente i dati di sicurezza di un'organizzazione da fonti cloud e locali in un data Lake appositamente creato archiviato nel tuo account AWS. Amazon Security Lake automatizza la gestione centralizzata dei dati di sicurezza, normalizza i log dei servizi AWS integrati e di servizi di terze parti e gestisce il ciclo di vita dei dati con conservazione personalizzabile e automatizza inoltre il tiering dello storage. Amazon Security Lake acquisisce i file di log nel file Apri il framework dello schema di sicurezza informatica (OCSF), con supporto per partner come Cisco Security, CrowdStrike, Palo Alto Networks e log OCSF da risorse esterne all'ambiente AWS. Questo schema unificato semplifica il consumo e l'analisi a valle perché i dati seguono uno schema standardizzato e nuove origini possono essere aggiunte con modifiche minime alla pipeline di dati. Dopo che i dati del registro di sicurezza sono stati archiviati in Amazon Security Lake, la questione diventa come analizzarli. Un approccio efficace per analizzare i dati del registro di sicurezza utilizza il machine learning; in particolare, il rilevamento delle anomalie, che esamina i dati sull'attività e sul traffico e li confronta con un riferimento. La linea di base definisce quale attività è statisticamente normale per quell'ambiente. Il rilevamento delle anomalie va oltre la firma di un singolo evento e può evolversi con una riqualificazione periodica; è quindi possibile intervenire sul traffico classificato come anomalo o anomalo con priorità e urgenza prioritarie. Amazon SageMaker è un servizio completamente gestito che consente ai clienti di preparare dati e creare, addestrare e distribuire modelli ML per qualsiasi caso d'uso con infrastrutture, strumenti e flussi di lavoro completamente gestiti, comprese offerte senza codice per gli analisti aziendali. SageMaker supporta due algoritmi di rilevamento delle anomalie integrati: Approfondimenti IP ed Foresta tagliata a caso. Puoi anche utilizzare SageMaker per creare il tuo modello di rilevamento dei valori anomali personalizzato utilizzando Algoritmi provenienti da più framework ML.

In questo post imparerai come preparare i dati provenienti da Amazon Security Lake e quindi addestrare e distribuire un modello ML utilizzando un algoritmo IP Insights in SageMaker. Questo modello identifica traffico o comportamento di rete anomalo che può quindi essere composto come parte di una soluzione di sicurezza end-to-end più ampia. Una soluzione di questo tipo potrebbe invocare un controllo di autenticazione a più fattori (MFA) se un utente accede da un server insolito o in un orario insolito, avvisare il personale se c'è una scansione di rete sospetta proveniente da nuovi indirizzi IP, avvisare gli amministratori se una rete insolita vengono utilizzati protocolli o porte o arricchire il risultato della classificazione degli approfondimenti IP con altre origini dati come Amazon Guard Duty e punteggi di reputazione IP per classificare i risultati delle minacce.

Panoramica della soluzione

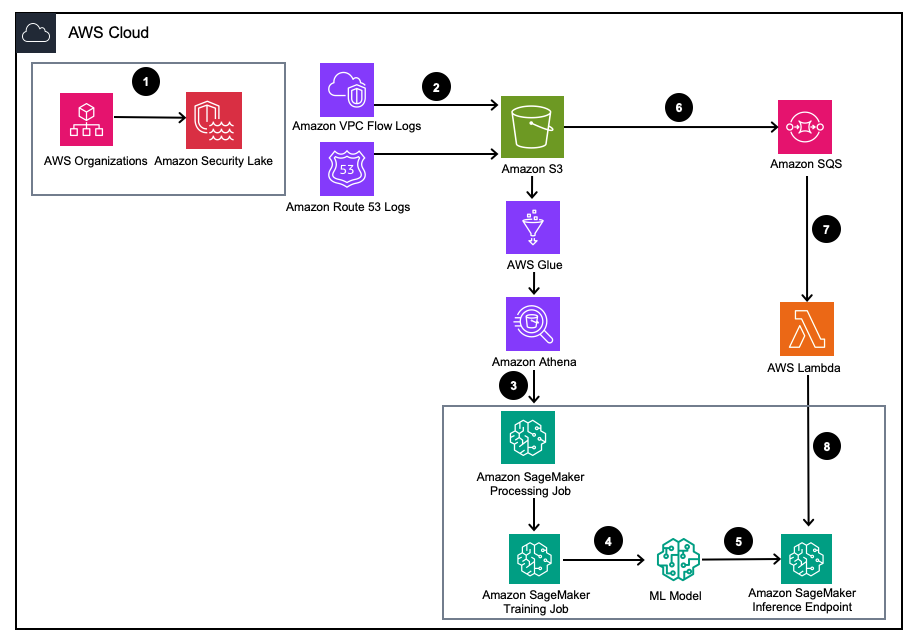

Figura 1 – Architettura della soluzione

- Abilita Amazon Security Lake con Organizzazioni AWS per account AWS, regioni AWS e ambienti IT esterni.

- Configura le origini Security Lake da Amazon Virtual Private Cloud (Amazon VPC) Registri di flusso e Itinerario dell'Amazzonia53 Log DNS nel bucket Amazon Security Lake S3.

- Elabora i dati di log di Amazon Security Lake utilizzando un processo di elaborazione SageMaker per progettare le funzionalità. Utilizzo Amazzone Atena da cui interrogare i dati di registro OCSF strutturati Servizio di archiviazione semplice Amazon (Amazon S3) attraverso Colla AWS tabelle gestite da AWS LakeFormation.

- Addestra un modello SageMaker ML utilizzando un processo di formazione SageMaker che utilizza i log elaborati di Amazon Security Lake.

- Distribuisci il modello ML addestrato a un endpoint di inferenza SageMaker.

- Archivia i nuovi log di sicurezza in un bucket S3 e accoda gli eventi Servizio Amazon Simple Queue (Amazon SQS).

- Iscriviti a AWS Lambda funzione alla coda SQS.

- Richiama l'endpoint di inferenza SageMaker utilizzando una funzione Lambda per classificare i log di sicurezza come anomalie in tempo reale.

Prerequisiti

Per distribuire la soluzione, è necessario prima completare i seguenti prerequisiti:

- Abilita Amazon Security Lake all'interno della tua organizzazione o in un singolo account con i log di flusso VPC e i log del risolutore Route 53 abilitati.

- Assicurarsi che il AWS Identity and Access Management (IAM) Al ruolo utilizzato dai processi di elaborazione e dai notebook di SageMaker è stata concessa una policy IAM che include il file Autorizzazione di accesso alle query dell'abbonato Amazon Security Lake per il database Lake gestito di Amazon Security e le tabelle gestite da AWS Lake Formation. Questo processo di elaborazione deve essere eseguito dall'interno di un account di strumenti di analisi o sicurezza per rimanere conforme Architettura di riferimento per la sicurezza AWS (AWS SRA).

- Assicurati che al ruolo IAM utilizzato dalla funzione Lambda sia stata concessa una policy IAM che includa il file Autorizzazione di accesso ai dati dell'abbonato Amazon Security Lake.

Distribuisci la soluzione

Per configurare l'ambiente, completare i seguenti passaggi:

- Avvia un Sage Maker Studio o il taccuino SageMaker Jupyter con a

ml.m5.largeesempio. Nota: La dimensione dell'istanza dipende dai set di dati utilizzati. - Clona GitHub deposito.

- Apri il taccuino

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implementare il policy IAM fornita ed policy di attendibilità IAM corrispondente affinché la tua istanza SageMaker Studio Notebook possa accedere a tutti i dati necessari in S3, Lake Formation e Athena.

Questo blog illustra la parte di codice pertinente all'interno del notebook dopo che è stato distribuito nel tuo ambiente.

Installa le dipendenze e importa la libreria richiesta

Utilizza il codice seguente per installare le dipendenze, importare le librerie richieste e creare il bucket SageMaker S3 necessario per l'elaborazione dei dati e l'addestramento dei modelli. Una delle librerie richieste, awswrangler, è un SDK AWS per dataframe Panda utilizzato per eseguire query sulle tabelle pertinenti all'interno del catalogo dati di AWS Glue e archiviare i risultati localmente in un dataframe.

Esegui una query sulla tabella di log del flusso VPC di Amazon Security Lake

Questa porzione di codice utilizza l'SDK AWS per panda per eseguire query sulla tabella AWS Glue relativa ai log di flusso VPC. Come menzionato nei prerequisiti, le tabelle Amazon Security Lake sono gestite da Formazione AWS Lake, quindi tutte le autorizzazioni appropriate devono essere concesse al ruolo utilizzato dal notebook SageMaker. Questa query estrarrà più giorni di traffico del log di flusso VPC. Il set di dati utilizzato durante lo sviluppo di questo blog era piccolo. A seconda della portata del tuo caso d'uso, dovresti essere consapevole dei limiti dell'SDK AWS per Panda. Quando consideri la scalabilità di terabyte, dovresti considerare il supporto dell'SDK AWS per Pandas Modin.

Quando visualizzi il data frame, vedrai l'output di una singola colonna con campi comuni che possono essere trovati nel file Attività di rete (4001) classe dell'OCSF.

Normalizza i dati del log del flusso VPC di Amazon Security Lake nel formato di training richiesto per IP Insights.

L'algoritmo IP Insights richiede che i dati di addestramento siano in formato CSV e contengano due colonne. La prima colonna deve essere una stringa opaca che corrisponde all'identificatore univoco di un'entità. La seconda colonna deve essere l'indirizzo IPv4 dell'evento di accesso dell'entità in notazione con punti decimali. Nel set di dati di esempio per questo blog, l'identificatore univoco sono gli ID istanza delle istanze EC2 associate a instance_id valore all'interno del dataframe. L'indirizzo IPv4 sarà derivato da src_endpoint. In base al modo in cui è stata creata la query Amazon Athena, i dati importati sono già nel formato corretto per l'addestramento di un modello IP Insights, quindi non è necessaria alcuna progettazione di funzionalità aggiuntive. Se modifichi la query in un altro modo, potrebbe essere necessario incorporare funzionalità aggiuntive.

Interroga e normalizza la tabella di log del risolutore Amazon Security Lake Route 53

Proprio come hai fatto in precedenza, il passaggio successivo del notebook esegue una query simile sulla tabella del risolutore Amazon Security Lake Route 53. Poiché utilizzerai tutti i dati conformi a OCSF all'interno di questo notebook, tutte le attività di progettazione delle funzionalità rimarranno le stesse per i log del risolutore Route 53 come lo erano per i log di flusso VPC. Quindi combini i due frame di dati in un unico frame di dati utilizzato per l'addestramento. Poiché la query di Amazon Athena carica i dati localmente nel formato corretto, non è necessaria alcuna ulteriore progettazione delle funzionalità.

Ottieni l'immagine di training di IP Insights e addestra il modello con i dati OCSF

Nella parte successiva del notebook, addestrerai un modello ML basato sull'algoritmo IP Insights e utilizzerai quello consolidato dataframe di OCSF da diversi tipi di log. È possibile trovare un elenco degli iperparmetri IP Insights qui. Nell'esempio seguente abbiamo selezionato gli iperparametri che hanno prodotto il modello con le migliori prestazioni, ad esempio 5 per epoch e 128 per vector_dim. Poiché il set di dati di addestramento per il nostro campione era relativamente piccolo, abbiamo utilizzato a ml.m5.large esempio. Gli iperparametri e le configurazioni di addestramento come il conteggio delle istanze e il tipo di istanza devono essere scelti in base alle metriche oggettive e alle dimensioni dei dati di addestramento. Una funzionalità che puoi utilizzare in Amazon SageMaker per trovare la versione migliore del tuo modello è Amazon SageMaker messa a punto automatica del modello che cerca il modello migliore in un intervallo di valori di iperparametri.

Distribuisci il modello addestrato ed esegui il test con traffico valido e anomalo

Dopo che il modello è stato addestrato, distribuisci il modello su un endpoint SageMaker e invii una serie di identificatori univoci e combinazioni di indirizzi IPv4 per testare il tuo modello. Questa porzione di codice presuppone che tu abbia dati di test salvati nel tuo bucket S3. I dati del test sono un file .csv, in cui la prima colonna contiene gli ID delle istanze e la seconda colonna gli IP. Si consiglia di testare dati validi e non validi per vedere i risultati del modello. Il codice seguente distribuisce il tuo endpoint.

Ora che il tuo endpoint è stato distribuito, puoi inviare richieste di inferenza per identificare se il traffico è potenzialmente anomalo. Di seguito è riportato un esempio di come dovrebbero apparire i dati formattati. In questo caso, l'identificatore della prima colonna è un ID di istanza e la seconda colonna è un indirizzo IP associato, come mostrato di seguito:

Dopo aver ricevuto i dati in formato CSV, puoi inviare i dati per l'inferenza utilizzando il codice leggendo il file .csv da un bucket S3.:

L'output di un modello IP Insights fornisce una misura di quanto siano statisticamente attesi un indirizzo IP e una risorsa online. L'intervallo per questo indirizzo e risorsa è tuttavia illimitato, quindi è necessario considerare come determinare se una combinazione di ID istanza e indirizzo IP deve essere considerata anomala.

Nell'esempio precedente, al modello sono state inviate quattro diverse combinazioni di identificatore e IP. Le prime due combinazioni erano combinazioni di ID istanza e indirizzo IP valide previste in base al set di training. La terza combinazione ha l'identificatore univoco corretto ma un indirizzo IP diverso all'interno della stessa sottorete. Il modello dovrebbe determinare che esiste una modesta anomalia poiché l'incorporamento è leggermente diverso dai dati di addestramento. La quarta combinazione ha un identificatore univoco valido ma un indirizzo IP di una sottorete inesistente all'interno di qualsiasi VPC nell'ambiente.

Nota: I dati sul traffico normale e anomalo cambieranno in base al tuo caso d'uso specifico, ad esempio: se desideri monitorare il traffico esterno e interno avrai bisogno di un identificatore univoco allineato a ciascun indirizzo IP e di uno schema per generare gli identificatori esterni.

Per determinare quale dovrebbe essere la soglia per determinare se il traffico è anomalo, è possibile utilizzare il traffico normale e anomalo noto. I passaggi delineati in questo taccuino campione sono come segue:

- Costruisci un set di test per rappresentare il traffico normale.

- Aggiungi traffico anomalo al set di dati.

- Traccia la distribuzione di

dot_productpunteggi per il modello sul traffico normale e sul traffico anomalo. - Selezionare un valore di soglia che distingua il sottoinsieme normale da quello anormale. Questo valore si basa sulla tolleranza ai falsi positivi

Configura il monitoraggio continuo del nuovo traffico del log del flusso VPC.

Per dimostrare come questo nuovo modello ML possa essere utilizzato con Amazon Security Lake in modo proattivo, configureremo una funzione Lambda da invocare su ciascun PutObject evento all'interno del bucket gestito di Amazon Security Lake, in particolare i dati del log del flusso VPC. All'interno di Amazon Security Lake esiste il concetto di abbonato, che consuma log ed eventi da Amazon Security Lake. Alla funzione Lambda che risponde ai nuovi eventi deve essere concesso un abbonamento di accesso ai dati. Gli abbonati con accesso ai dati ricevono una notifica dei nuovi oggetti Amazon S3 per un'origine mentre gli oggetti vengono scritti nel bucket Security Lake. Gli abbonati possono accedere direttamente agli oggetti S3 e ricevere notifiche di nuovi oggetti tramite un endpoint di sottoscrizione o eseguendo il polling di una coda Amazon SQS.

- Aprire il Console Security Lake.

- Nel riquadro di navigazione, seleziona Iscritti.

- Nella pagina Iscritti, scegli Crea abbonato.

- Per i dettagli dell'abbonato, inserisci

inferencelambdaper Nome dell'abbonato e un optional Descrizione. - I Regione viene impostato automaticamente come regione AWS attualmente selezionata e non può essere modificato.

- Nel Origini di log ed eventiscegli Origini specifiche di log ed eventi e scegli Log di flusso VPC e log Route 53

- Nel Metodo di accesso ai datiscegli S3.

- Nel Credenziali dell'abbonato, fornisci l'ID dell'account AWS dell'account in cui risiederà la funzione Lambda e un file specificato dall'utente identificativo esterno.

Nota: Se lo fai localmente all'interno di un account, non è necessario disporre di un ID esterno. - Scegli Creare.

Crea la funzione Lambda

Per creare e distribuire la funzione Lambda puoi completare i passaggi seguenti o distribuire il modello SAM predefinito 01_ipinsights/01.02-ipcheck.yaml nel repository GitHub. Il modello SAM richiede che tu fornisca l'ARN SQS e il nome dell'endpoint SageMaker.

- Sulla console Lambda, selezionare Crea funzione.

- Scegli Autore da zero.

- Nel Nome della funzione, accedere

ipcheck. - Nel Runtimescegli Python 3.10.

- Nel Architettura, selezionare x86_64.

- Nel Ruolo di esecuzione, selezionare Crea un nuovo ruolo con autorizzazioni Lambda.

- Dopo aver creato la funzione, inserisci il contenuto del file ipcheck.py file dal repository GitHub.

- Nel pannello di navigazione, scegli variabili ambientali.

- Scegli Modifica.

- Scegli Aggiungi variabile d'ambiente.

- Per la nuova variabile di ambiente, immettere

ENDPOINT_NAMEe come valore inserisci l'ARN dell'endpoint generato durante la distribuzione dell'endpoint SageMaker. - Seleziona Risparmi.

- Scegli Schierare.

- Nel pannello di navigazione, scegli Configurazione.

- Seleziona Trigger.

- Seleziona Aggiungi trigger.

- Sotto Seleziona una fontescegli SQS.

- Sotto Coda SQS, inserisci l'ARN della coda SQS principale creata da Security Lake.

- Seleziona la casella di controllo per Attiva il grilletto.

- Seleziona Aggiungi.

Convalida i risultati Lambda

- Aprire il Console Amazon CloudWatch.

- Nel riquadro laterale sinistro, seleziona Gruppi di log.

- Nella barra di ricerca, inserisci ipcheck, quindi seleziona il gruppo di log con il nome

/aws/lambda/ipcheck. - Seleziona il flusso di log più recente sotto Registra flussi.

- All'interno dei log, dovresti vedere risultati simili ai seguenti per ogni nuovo log di Amazon Security Lake:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Questa funzione Lambda analizza continuamente il traffico di rete acquisito da Amazon Security Lake. Ciò ti consente di creare meccanismi per avvisare i tuoi team di sicurezza quando viene violata una soglia specificata, il che indicherebbe un traffico anomalo nel tuo ambiente.

Pulire

Una volta terminata la sperimentazione di questa soluzione e per evitare addebiti sul tuo account, ripulisci le tue risorse eliminando il bucket S3, l'endpoint SageMaker, arrestando il computer collegato al notebook SageMaker Jupyter, eliminando la funzione Lambda e disabilitando Amazon Security Lago nel tuo account.

Conclusione

In questo post hai imparato come preparare i dati del traffico di rete provenienti da Amazon Security Lake per il machine learning e poi hai addestrato e distribuito un modello ML utilizzando l'algoritmo IP Insights in Amazon SageMaker. Tutti i passaggi descritti nel notebook Jupyter possono essere replicati in una pipeline ML end-to-end. Hai inoltre implementato una funzione AWS Lambda che utilizzava nuovi log di Amazon Security Lake e inviava inferenze in base al modello di rilevamento delle anomalie addestrato. Le risposte del modello ML ricevute da AWS Lambda potrebbero avvisare in modo proattivo i team di sicurezza del traffico anomalo quando vengono raggiunte determinate soglie. Il miglioramento continuo del modello può essere consentito includendo il team di sicurezza nelle revisioni del ciclo per etichettare se il traffico identificato come anomalo era un falso positivo o meno. Questo potrebbe quindi essere aggiunto al tuo set di allenamento e anche aggiunto al tuo normale set di dati sul traffico quando si determina una soglia empirica. Questo modello è in grado di identificare traffico di rete o comportamento potenzialmente anomalo per cui può essere incluso come parte di una soluzione di sicurezza più ampia per avviare un controllo MFA se un utente accede da un server insolito o in un orario insolito, avvisare il personale se c'è un problema sospetto scansione della rete proveniente da nuovi indirizzi IP oppure combina il punteggio delle informazioni IP con altre fonti come Amazon Guard Duty per classificare i risultati delle minacce. Questo modello può includere origini di log personalizzate come i log di flusso di Azure o i log locali aggiungendo origini personalizzate alla distribuzione Amazon Security Lake.

Nella parte 2 di questa serie di post del blog, imparerai come creare un modello di rilevamento delle anomalie utilizzando Foresta tagliata a caso algoritmo addestrato con ulteriori fonti Amazon Security Lake che integrano i dati di registro di sicurezza della rete e dell'host e applicano la classificazione delle anomalie di sicurezza come parte di una soluzione di monitoraggio della sicurezza automatizzata e completa.

Circa gli autori

Joe Morotti è un Solutions Architect presso Amazon Web Services (AWS), che aiuta i clienti Enterprise nel Midwest degli Stati Uniti. Ha ricoperto una vasta gamma di ruoli tecnici e si diverte a mostrare l'arte del possibile da parte dei clienti. Nel tempo libero, gli piace passare del tempo di qualità con la sua famiglia, esplorando nuovi posti e analizzando eccessivamente le prestazioni della sua squadra sportiva

Joe Morotti è un Solutions Architect presso Amazon Web Services (AWS), che aiuta i clienti Enterprise nel Midwest degli Stati Uniti. Ha ricoperto una vasta gamma di ruoli tecnici e si diverte a mostrare l'arte del possibile da parte dei clienti. Nel tempo libero, gli piace passare del tempo di qualità con la sua famiglia, esplorando nuovi posti e analizzando eccessivamente le prestazioni della sua squadra sportiva

Bishr Tabbaa è un architetto di soluzioni presso Amazon Web Services. Bishr è specializzata nell'aiutare i clienti con applicazioni di machine learning, sicurezza e osservabilità. Al di fuori del lavoro, gli piace giocare a tennis, cucinare e passare il tempo con la famiglia.

Bishr Tabbaa è un architetto di soluzioni presso Amazon Web Services. Bishr è specializzata nell'aiutare i clienti con applicazioni di machine learning, sicurezza e osservabilità. Al di fuori del lavoro, gli piace giocare a tennis, cucinare e passare il tempo con la famiglia.

Sriharsh Adari è Senior Solutions Architect presso Amazon Web Services (AWS), dove aiuta i clienti a lavorare a ritroso dai risultati aziendali per sviluppare soluzioni innovative su AWS. Nel corso degli anni, ha aiutato più clienti nelle trasformazioni della piattaforma dati in tutti i settori verticali. Le sue principali aree di competenza includono la strategia tecnologica, l'analisi dei dati e la scienza dei dati. Nel tempo libero, gli piace giocare a tennis, guardare programmi TV e giocare a Tabla.

Sriharsh Adari è Senior Solutions Architect presso Amazon Web Services (AWS), dove aiuta i clienti a lavorare a ritroso dai risultati aziendali per sviluppare soluzioni innovative su AWS. Nel corso degli anni, ha aiutato più clienti nelle trasformazioni della piattaforma dati in tutti i settori verticali. Le sue principali aree di competenza includono la strategia tecnologica, l'analisi dei dati e la scienza dei dati. Nel tempo libero, gli piace giocare a tennis, guardare programmi TV e giocare a Tabla.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :ha

- :È

- :non

- :Dove

- $ SU

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- sopra

- accesso

- Il mio account

- conti

- operanti in

- attività

- attori

- aggiunto

- l'aggiunta di

- aggiuntivo

- indirizzo

- indirizzi

- amministratori

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- Mettere in guardia

- algoritmo

- Algoritmi

- Allineati

- Tutti

- consente

- già

- anche

- Amazon

- Amazzone Atena

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- .

- Gli analisti

- analitica

- analizzare

- analisi

- l'analisi

- ed

- anomalie

- rilevamento anomalie

- Un altro

- in qualsiasi

- Applicazioni

- applicazioni

- APPLICA

- approccio

- architettura

- SONO

- RISERVATA

- Arte

- AS

- Attività

- associato

- assume

- At

- Autenticazione

- Automatizzata

- automatizza

- automaticamente

- Automatizzare

- evitare

- consapevole

- AWS

- Colla AWS

- Formazione AWS Lake

- AWS Lambda

- azzurro

- bar

- basato

- Linea di base

- BE

- perché

- diventa

- stato

- comportamento

- essendo

- sotto

- MIGLIORE

- Al di là di

- Blog

- entrambi

- costruire

- incassato

- affari

- ma

- by

- Materiale

- capacità

- capace

- Custodie

- catalogo

- centrale

- centralizzare

- certo

- Challenge

- il cambiamento

- Modifiche

- cambiando

- oneri

- dai un'occhiata

- Scegli

- scelto

- Cisco

- classe

- classificazione

- classificato

- classificare

- cavedano

- Cloud

- codice

- Colonna

- colonne

- combinazione

- combinazioni

- combinare

- combina

- Venire

- arrivo

- Uncommon

- completamento di una

- complesso

- compiacente

- composto

- globale

- Calcolare

- concetto

- Prendere in considerazione

- Considerazioni

- considerato

- considerando

- consolle

- consumato

- consumo

- contenere

- testuali

- continuamente

- continuo

- Nucleo

- correggere

- corrisponde

- potuto

- creare

- creato

- Attualmente

- costume

- Clienti

- personalizzabile

- taglio

- Cybersecurity

- dati

- l'accesso ai dati

- Dati Analytics

- Lago di dati

- Piattaforma dati

- elaborazione dati

- scienza dei dati

- Banca Dati

- dataset

- Giorni

- definisce

- dimostrare

- dipendenze

- dipendente

- Dipendente

- schierare

- schierato

- deployment

- Distribuisce

- derivato

- dettagli

- rivelazione

- Determinare

- determinazione

- sviluppare

- Mercato

- dispositivi

- DID

- diverso

- digitale

- Risorse digitali

- direttamente

- distribuzione

- dns

- doesn

- fare

- don

- fatto

- Dont

- giù

- durante

- e

- ogni

- bordo

- Efficace

- o

- altro

- incorporamento

- abilitato

- Abilita

- da un capo all'altro

- endpoint

- ingegnere

- Ingegneria

- godere

- arricchire

- entrare

- Impresa

- Ambiente

- ambienti

- epoca

- errore

- Evento

- eventi

- evolvere

- evoluzione

- esamina

- esempio

- Tranne

- esiste

- ampliato

- previsto

- competenza

- Esplorare

- esterno

- di fronte

- falso

- famiglia

- caratteristica

- Caratteristiche

- campi

- Compila il

- File

- Trovare

- I risultati

- Nome

- flusso

- Focus

- i seguenti

- segue

- Orma

- Nel

- formato

- formazione

- essere trovato

- quattro

- Quarto

- TELAIO

- quadri

- Gratis

- da

- completamente

- function

- ulteriormente

- generare

- GitHub

- concesso

- Gruppo

- cresciuto

- Guardia

- Avere

- he

- Eroe

- aiutato

- aiutare

- aiuta

- il suo

- host

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- ID

- identificato

- identificatore

- identificatori

- identifica

- identificare

- identificazione

- Identità

- ids

- if

- Immagine

- Impact

- implementato

- importare

- miglioramento

- in

- includere

- incluso

- Compreso

- incorporare

- crescente

- indicare

- individuale

- industria

- Infrastruttura

- avviare

- creativi e originali

- intuizioni

- install

- esempio

- integrare

- integrato

- interno

- ai miglioramenti

- invocato

- IP

- Indirizzo IP

- Gli indirizzi IP

- IT

- Lavoro

- Offerte di lavoro

- jpg

- json

- conosciuto

- Discografica

- lago

- paesaggio

- grandi

- superiore, se assunto singolarmente.

- IMPARARE

- imparato

- apprendimento

- a sinistra

- biblioteche

- ciclo di vita

- piace

- limiti

- Lista

- carichi

- a livello locale

- ceppo

- Guarda

- una

- macchina

- machine learning

- Principale

- gestito

- gestione

- gestisce

- modo

- Maggio..

- misurare

- meccanismi di

- Soddisfare

- menzionato

- di cartone

- Metrica

- AMF

- midwest

- minimo

- mancante

- ML

- modello

- modelli

- modesto

- modificato

- modificare

- Monitorare

- monitoraggio

- maggior parte

- multiplo

- devono obbligatoriamente:

- Nome

- Navigazione

- necessaria

- Bisogno

- di applicazione

- Rete

- traffico di rete

- reti

- New

- GENERAZIONE

- no

- inesistente

- normale

- taccuino

- notifiche

- romanzo

- adesso

- obiettivo

- oggetti

- of

- offerte

- on

- ONE

- online

- opaco

- or

- organizzazione

- OS

- Altro

- nostro

- risultati

- valore anomalo

- delineato

- produzione

- al di fuori

- ancora

- proprio

- pagina

- palo Alto

- panda

- vetro

- parte

- partner

- esecuzione

- periodico

- autorizzazione

- permessi

- conduttura

- Partner

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- politica

- porzione

- porte

- positivo

- possibile

- Post

- potenzialmente

- precedente

- Previsioni

- Predictor

- Preparare

- prerequisiti

- priorità

- un bagno

- Proactive

- Elaborato

- lavorazione

- corretto

- protocolli

- fornire

- fornitori

- fornisce

- qualità

- domanda

- aumentare

- gamma

- classifica

- Lettura

- di rose

- tempo reale

- ricevere

- ricevuto

- recente

- raccomandato

- riferimento

- regione

- regioni

- relazionato

- relativamente

- pertinente

- rimanere

- replicato

- rappresentare

- reputazione

- richieste

- necessario

- richiede

- risorsa

- Risorse

- risposta

- risposte

- colpevole

- Risultati

- ritenzione

- Recensioni

- Ruolo

- ruoli

- strada

- Correre

- corre

- sagemaker

- Inferenza di SageMaker

- Sam

- stesso

- Set di dati di esempio

- salvato

- Scala

- bilancia

- scala

- scansione

- scenario

- schema

- Scienze

- Punto

- sdk

- Cerca

- Ricerche

- Secondo

- problemi di

- Minacce alla sicurezza

- vedere

- select

- selezionato

- inviare

- anziano

- Serie

- server

- servizio

- Servizi

- Sessione

- set

- dovrebbero

- mostrato

- Spettacoli

- chiudendo

- lato

- firma

- firma

- simile

- Un'espansione

- da

- singolo

- Taglia

- leggermente diversa

- piccole

- So

- soluzione

- Soluzioni

- RISOLVERE

- Fonte

- source

- fonti

- specializzata

- specifico

- in particolare

- specificato

- Spendere

- Sports

- STAFF

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- Strategia

- ruscello

- linee di corrente

- Corda

- strutturato

- studio

- inviare

- presentata

- sottorete

- abbonato

- iscritti

- sottoscrizione

- tale

- supporto

- supporti

- sospettoso

- tavolo

- task

- team

- le squadre

- Consulenza

- Tecnologia

- Strategia tecnologica

- modello

- tennis

- test

- che

- I

- loro

- poi

- Là.

- di

- Terza

- di parti terze standard

- questo

- quelli

- minaccia

- attori della minaccia

- minacce

- soglia

- Attraverso

- tempo

- a

- strumenti

- traffico

- Treni

- allenato

- Training

- trasformazioni

- Affidati ad

- prova

- tv

- seconda

- duplice

- Digitare

- Tipi di

- per

- unificato

- unico

- su

- urgenza

- us

- uso

- caso d'uso

- utilizzato

- Utente

- usa

- utilizzando

- utilizzare

- utilizzati

- un valido

- APPREZZIAMO

- Valori

- variabile

- versione

- verticali

- Visualizza

- violato

- virtuale

- vulnerabilità

- passeggiate

- volere

- Prima

- Modo..

- we

- sito web

- servizi web

- sono stati

- Che

- quando

- se

- quale

- largo

- Vasta gamma

- volere

- con

- entro

- Lavora

- flussi di lavoro

- sarebbe

- scritto

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro