זהו הפוסט השני בסדרה בת שני חלקים בה אני מציע מדריך מעשי לארגונים כדי שתוכל להעריך את האיכות של מודלים לסיכום טקסטים עבור התחום שלך.

למבוא לסיכום טקסט, סקירה כללית של הדרכה זו, והשלבים ליצירת קו בסיס לפרויקט שלנו (המכונה גם סעיף 1), עיין בחזרה פוסט ראשון.

הפוסט הזה מחולק לשלושה חלקים:

- סעיף 2: צור סיכומים עם מודל של זריקת אפס

- סעיף 3: אימון מודל סיכום

- סעיף 4: הערך את המודל המאומן

סעיף 2: צור סיכומים עם מודל של זריקת אפס

בפוסט זה, אנו משתמשים במושג של אקדח למידה (ZSL), כלומר אנו משתמשים במודל שעבר הכשרה לסיכום טקסט, אך לא ראינו דוגמאות של מערך הנתונים של arXiv. זה קצת כמו לנסות לצייר דיוקן כאשר כל מה שעשית בחייך הוא ציור נוף. אתה יודע לצייר, אבל אולי אתה לא מכיר יותר מדי את המורכבויות של ציור דיוקן.

עבור סעיף זה, אנו משתמשים בסעיף הבא מחברה.

למה למידה בזריקת אפס?

ZSL הפך פופולרי בשנים האחרונות מכיוון שהוא מאפשר לך להשתמש בדגמי NLP חדישים ללא הכשרה. והביצועים שלהם לפעמים די מדהימים: ה קבוצת עבודה גדולה למחקר מדעי הוציאה לאחרונה את מודל ה-T0pp (מבוטא "T Zero Plus Plus"), אשר הוכשר במיוחד לחקר למידה מרובה משימות ב-Zero-shot. לעתים קרובות הוא יכול להתעלות על דגמים גדולים פי שישה על הדגמים ספסל BIG אמת מידה, ויכולה להתעלות על ה GPT-3 (פי 16 גדול יותר) במספר מדדי NLP אחרים.

יתרון נוסף של ZSL הוא שדרושות שתי שורות קוד בלבד כדי להשתמש בו. על ידי ניסיון זה, אנו יוצרים קו בסיס שני, שבו אנו משתמשים כדי לכמת את הרווח בביצועי המודל לאחר שאנו מכווננים את המודל במערך הנתונים שלנו.

הגדר צינור למידה עם זריקת אפס

כדי להשתמש בדגמי ZSL, אנחנו יכולים להשתמש ב-Huging Face's צינור API. API זה מאפשר לנו להשתמש במודל סיכום טקסט עם שתי שורות קוד בלבד. הוא דואג לשלבי העיבוד העיקריים במודל NLP:

- עבדו מראש את הטקסט לפורמט שהמודל יכול להבין.

- העבר את התשומות המעובדות מראש לדגם.

- עבדו לאחר מכן את התחזיות של המודל, כדי שתוכלו להבין אותן.

הוא משתמש במודלים של סיכום שכבר זמינים ב- רכזת דגם חיבוק.

כדי להשתמש בו, הפעל את הקוד הבא:

זהו זה! הקוד מוריד מודל סיכום ויוצר סיכומים באופן מקומי במחשב שלך. אם אתה תוהה באיזה דגם הוא משתמש, אתה יכול לחפש אותו ב- קוד מקור או השתמש בפקודה הבאה:

כאשר אנו מריצים פקודה זו, אנו רואים שמודל ברירת המחדל לסיכום טקסט נקרא sshleifer/distilbart-cnn-12-6:

אנחנו יכולים למצוא את כרטיס דגם עבור דגם זה באתר Hugging Face, שם אנו יכולים גם לראות שהמודל הוכשר על שני מערכי נתונים: מערך הנתונים של CNN Dailymail ו מערך נתונים של Extreme Summarization (XSum).. ראוי לציין כי מודל זה אינו מכיר את מערך הנתונים של arXiv והוא משמש רק לסיכום טקסטים הדומים לאלו שהוא הוכשר עליהם (בעיקר כתבות חדשותיות). המספרים 12 ו-6 בשם הדגם מתייחסים למספר שכבות המקודד ושכבות המפענח, בהתאמה. הסבר מה הם מחוץ לתחום המדריך הזה, אבל אתה יכול לקרוא עוד על זה בפוסט היכרות עם BART מאת סם שליפר, שיצר את הדגם.

אנו משתמשים במודל ברירת המחדל לעתיד, אבל אני ממליץ לך לנסות דגמים שונים שהוכשרו מראש. את כל הדגמים המתאימים לסיכום ניתן למצוא ב- אתר חיבוק פייס. כדי להשתמש במודל אחר, תוכל לציין את שם הדגם בעת קריאה ל-Pipeline API:

סיכום מופשט לעומת מופשט

עדיין לא דיברנו על שתי גישות אפשריות אך שונות לסיכום טקסט: מיצוי לעומת מופשט. סיכום מופשט הוא האסטרטגיה של שרשור תמציות שנלקחו מטקסט לסיכום, בעוד שסיכום מופשט כרוך בפרפרזה על הקורפוס באמצעות משפטים חדשים. רוב מודל הסיכום מבוססים על מודלים שמייצרים טקסט חדש (אלה מודלים ליצירת שפה טבעית, כמו, למשל, GPT-3). המשמעות היא שמודלי הסיכום מייצרים גם טקסט חדשני, מה שהופך אותם למודלים מופשטים של סיכום.

צור סיכומי אפס

עכשיו כשאנחנו יודעים איך להשתמש בו, אנחנו רוצים להשתמש בו במערך הנתונים של הבדיקה שלנו - אותו מערך נתונים בו השתמשנו סעיף 1 כדי ליצור את קו הבסיס. אנחנו יכולים לעשות את זה עם הלולאה הבאה:

אנו משתמשים min_length ו max_length פרמטרים לשליטה בסיכום שהמודל יוצר. בדוגמה זו, אנו קובעים min_length עד 5 כי אנחנו רוצים שהכותרת תהיה באורך חמש מילים לפחות. ועל ידי הערכת סיכומי ההתייחסות (הכותרות בפועל של עבודות המחקר), אנו קובעים ש-20 יכול להיות ערך סביר עבור max_length. אבל שוב, זה רק ניסיון ראשון. כאשר הפרויקט נמצא בשלב הניסוי, ניתן וצריך לשנות את שני הפרמטרים הללו כדי לראות אם ביצועי המודל משתנים.

פרמטרים נוספים

אם אתה כבר מכיר את יצירת הטקסט, אולי אתה יודע שיש עוד פרמטרים רבים להשפיע על הטקסט שמודל יוצר, כגון חיפוש קרן, דגימה וטמפרטורה. פרמטרים אלו נותנים לך יותר שליטה על הטקסט שנוצר, למשל הופכים את הטקסט ליותר שוטף ופחות חוזר על עצמו. טכניקות אלו אינן זמינות ב-Pipeline API - אתה יכול לראות ב- קוד מקור זֶה min_length ו max_length הם הפרמטרים היחידים שנחשבים. עם זאת, לאחר שנאמן ופריסה את המודל שלנו, יש לנו גישה לפרמטרים הללו. עוד על כך בסעיף 4 של פוסט זה.

הערכת מודל

לאחר שהפקנו את סיכומי האפס, נוכל להשתמש שוב בפונקציית ROUGE שלנו כדי להשוות את סיכומי המועמדים עם סיכומי ההפניה:

הפעלת חישוב זה על סיכומים שנוצרו עם מודל ZSL נותן לנו את התוצאות הבאות:

כאשר אנו משווים את אלה עם קו הבסיס שלנו, אנו רואים שמודל ה-ZSL הזה למעשה מתפקד גרוע יותר מההיוריסטיקה הפשוטה שלנו של רק לקחת את המשפט הראשון. שוב, זה לא בלתי צפוי: למרות שהמודל הזה יודע לסכם כתבות חדשותיות, הוא מעולם לא ראה דוגמה לסיכום תקציר של עבודת מחקר אקדמית.

השוואה בסיסית

יצרנו כעת שני קווי בסיס: אחד באמצעות היוריסטיקה פשוטה ואחד עם מודל ZSL. על ידי השוואת ציוני ROUGE, אנו רואים שהיוריסטיקה הפשוטה עולה כיום על מודל הלמידה העמוקה.

בסעיף הבא, אנו לוקחים את אותו מודל למידה עמוקה ומנסים לשפר את הביצועים שלו. אנו עושים זאת על ידי הכשרתו במערך הנתונים של arXiv (שלב זה נקרא גם כוונון עדין). אנחנו מנצלים את העובדה שהוא כבר יודע לסכם טקסט באופן כללי. לאחר מכן אנו מראים לו דוגמאות רבות של מערך הנתונים arXiv שלנו. מודלים של למידה עמוקה טובים בצורה יוצאת דופן בזיהוי דפוסים במערך נתונים לאחר שהם עברו הכשרה עליהם, ולכן אנו מצפים שהמודל ישתפר במשימה הספציפית הזו.

סעיף 3: אימון מודל סיכום

בחלק זה, אנו מאמנים את המודל בו השתמשנו עבור סיכומי אפס בסעיף 2 (sshleifer/distilbart-cnn-12-6) במערך הנתונים שלנו. הרעיון הוא ללמד את המודל איך נראים סיכומים לתקצירים של עבודות מחקר על ידי הצגת דוגמאות רבות. לאורך זמן המודל צריך לזהות את הדפוסים במערך הנתונים הזה, מה שיאפשר לו ליצור סיכומים טובים יותר.

ראוי לציין שוב שאם יש לך תיוג נתונים, כלומר טקסטים וסיכומים מתאימים, עליך להשתמש בהם כדי להכשיר מודל. רק על ידי כך המודל יכול ללמוד את הדפוסים של מערך הנתונים הספציפי שלך.

הקוד המלא להכשרת המודל נמצא בהמשך מחברה.

הגדר עבודת הדרכה

מכיוון שאימון מודל למידה עמוקה ייקח כמה שבועות על מחשב נייד, אנו משתמשים אמזון SageMaker במקום עבודות הכשרה. לפרטים נוספים, עיין ב אימון דגם עם Amazon SageMaker. בפוסט זה, אני מדגיש בקצרה את היתרון בשימוש בעבודות הדרכה אלו, מלבד העובדה שהן מאפשרות לנו להשתמש במופעי מחשוב של GPU.

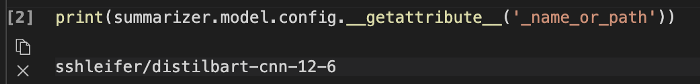

בוא נניח שיש לנו אשכול של מופעי GPU שאנחנו יכולים להשתמש בהם. במקרה כזה, סביר להניח שנרצה ליצור תמונת Docker כדי להפעיל את האימון כך שנוכל לשכפל בקלות את סביבת האימון במכונות אחרות. לאחר מכן אנו מתקינים את החבילות הנדרשות ומכיוון שאנו רוצים להשתמש במספר מופעים, עלינו להגדיר גם הדרכה מבוזרת. כאשר ההכשרה תושלם, אנו רוצים לכבות במהירות את המחשבים הללו מכיוון שהם יקרים.

כל השלבים הללו מופשטים מאיתנו בעת שימוש בעבודות הדרכה. למעשה, אנו יכולים לאמן מודל באותו אופן כפי שתואר על ידי ציון פרמטרי האימון ואז פשוט קריאה לשיטה אחת. SageMaker דואגת לשאר, כולל הפסקת מופעי ה-GPU כשההדרכה הושלמה כדי לא להיגרר בעלויות נוספות.

בנוסף, Hugging Face ו-AWS הכריזו על שותפות מוקדם יותר בשנת 2022 שמקלה עוד יותר על אימון דגמי Hugging Face ב- SageMaker. פונקציונליות זו זמינה באמצעות הפיתוח של Hugging Face מיכלי למידה עמוקה של AWS (DLCs). מיכלים אלו כוללים את Hugging Face Transformers, Tokenizers וספריית Datasets, המאפשרת לנו להשתמש במשאבים אלו לצורך הדרכה ועבודות מסקנות. לרשימה של תמונות DLC הזמינות, ראה זמינות מחבקת פנים תמונות מיכלי למידה עמוקה. הם מתוחזקים ומתעדכנים באופן קבוע עם תיקוני אבטחה. אנחנו יכולים למצוא דוגמאות רבות לאימון דגמי Hugging Face עם ה-DLCs האלה וה- חיבוק Face Python SDK בהמשך GitHub ריפו.

אנו משתמשים באחת מהדוגמאות הללו כתבנית מכיוון שהיא עושה כמעט כל מה שאנחנו צריכים למטרה שלנו: להכשיר מודל סיכום על מערך נתונים ספציפי בצורה מבוזרת (באמצעות יותר ממופע GPU אחד).

עם זאת, דבר אחד עלינו לתת את הדעת הוא שדוגמה זו משתמשת במערך נתונים ישירות ממרכז הנתונים של Hugging Face. מכיוון שאנו רוצים לספק נתונים מותאמים אישית משלנו, עלינו לתקן מעט את המחברת.

להעביר נתונים לעבודת ההדרכה

כדי להסביר את העובדה שאנו מביאים מערך נתונים משלנו, עלינו להשתמש ערוצים. למידע נוסף, עיין ב כיצד אמזון SageMaker מספקת מידע הדרכה.

אני אישית מוצא את המונח הזה קצת מבלבל, אז במוחי אני תמיד חושב מיפוי כשאני שומע ערוצים, כי זה עוזר לי לדמיין טוב יותר מה קורה. תן לי להסביר: כפי שכבר למדנו, עבודת ההדרכה מגבשת מקבץ של ענן מחשוב אלסטי של אמזון (Amazon EC2) מופעים ומעתיקים אליו תמונת Docker. עם זאת, מערכי הנתונים שלנו מאוחסנים ב שירות אחסון פשוט של אמזון (Amazon S3) ולא ניתן לגשת אליה על ידי תמונת Docker. במקום זאת, עבודת ההדרכה צריכה להעתיק את הנתונים מאמזון S3 לנתיב מוגדר מראש באופן מקומי בתמונת Docker זו. הדרך שבה הוא עושה זאת היא שאנו אומרים לעבודת ההדרכה היכן הנתונים נמצאים באמזון S3 ואיפה בתמונת ה-Docker יש להעתיק את הנתונים כדי שעבודת ההדרכה תוכל לגשת אליהם. אָנוּ מַפָּה המיקום של Amazon S3 עם השביל המקומי.

אנו מגדירים את הנתיב המקומי בקטע ההיפרפרמטרים של עבודת ההדרכה:

לאחר מכן אנו אומרים לעבודת ההדרכה היכן נמצאים הנתונים באמזון S3 כאשר אנו קוראים לשיטת fit() שמתחילה את האימון:

![]()

שים לב ששם התיקיה אחרי /opt/ml/input/data מתאים לשם הערוץ (datasets). זה מאפשר לעבודת ההדרכה להעתיק את הנתונים מאמזון S3 לנתיב המקומי.

התחל את האימון

כעת אנו מוכנים להתחיל את עבודת ההדרכה. כפי שצוין קודם, אנו עושים זאת על ידי התקשרות ל- fit() שיטה. עבודת ההדרכה נמשכת כ-40 דקות. אתה יכול לעקוב אחר ההתקדמות ולראות מידע נוסף על קונסולת SageMaker.

כאשר עבודת ההדרכה תושלם, הגיע הזמן להעריך את המודל החדש שלנו שהוכשר.

סעיף 4: הערך את המודל המאומן

הערכת המודל המאומן שלנו דומה מאוד למה שעשינו בסעיף 2, שבו הערכנו את מודל ה-ZSL. אנו קוראים למודל ומייצרים סיכומי מועמדים ומשווים אותם לסיכומי הייחוס על ידי חישוב ציוני ROUGE. אבל עכשיו, הדגם יושב באמזון S3 בקובץ שנקרא model.tar.gz (כדי למצוא את המיקום המדויק, ניתן לבדוק את עבודת ההדרכה בקונסולה). אז איך ניגשים למודל כדי ליצור סיכומים?

יש לנו שתי אפשרויות: לפרוס את המודל לנקודת קצה של SageMaker או להוריד אותו באופן מקומי, בדומה למה שעשינו בסעיף 2 עם מודל ה-ZSL. במדריך זה, I לפרוס את המודל לנקודת קצה של SageMaker כי זה יותר נוח ועל ידי בחירת מופע חזק יותר עבור נקודת הקצה, נוכל לקצר את זמן ההסקת באופן משמעותי. ריפו של GitHub מכיל א מחברה שמראה כיצד להעריך את המודל באופן מקומי.

פרוס מודל

בדרך כלל קל מאוד לפרוס דגם מאומן ב- SageMaker (ראה שוב את הדוגמה הבאה על GitHub מחבק פנים). לאחר הכשרת הדוגמנית, נוכל להתקשר estimator.deploy() ואת השאר עושה לנו SageMaker ברקע. מכיוון שבמדריך שלנו אנו עוברים ממחברת אחת לאחרת, עלינו לאתר תחילה את עבודת ההדרכה והמודל המשויך, לפני שנוכל לפרוס אותה:

לאחר שנשלוף את מיקום הדגם, נוכל לפרוס אותו לנקודת קצה של SageMaker:

הפריסה ב- SageMaker היא פשוטה מכיוון שהיא משתמשת ב- ערכת הכלים של SageMaker Hugging Face Inference, ספריית קוד פתוח להגשת דגמי רובוטריקים ב- SageMaker. בדרך כלל אנחנו אפילו לא צריכים לספק תסריט מסקנות; ערכת הכלים מטפלת בזה. אולם במקרה זה, ערכת הכלים משתמשת שוב ב-Pipeline API, וכפי שדיברנו בסעיף 2, ה-Pipeline API אינו מאפשר לנו להשתמש בטכניקות מתקדמות של יצירת טקסט כגון חיפוש קרן ודגימה. כדי להימנע ממגבלה זו, אנו מספקים את שלנו סקריפט מסקנות מותאם אישית.

הערכה ראשונה

להערכה הראשונה של המודל שהוכשר לאחרונה, אנו משתמשים באותם פרמטרים כמו בסעיף 2 עם מודל זריקת האפס כדי להפיק את סיכומי המועמדים. זה מאפשר לערוך השוואה בין תפוח לתפוח:

אנו משווים את הסיכומים שנוצרו על ידי המודל עם סיכומי ההתייחסות:

זה מעודד! הניסיון הראשון שלנו לאמן את הדגם, ללא כל כוונון היפרפרמטרים, שיפר משמעותית את ציוני ROUGE.

הערכה שניה

עכשיו הגיע הזמן להשתמש בטכניקות מתקדמות יותר כמו חיפוש קרן ודגימה כדי לשחק עם המודל. להסבר מפורט מה עושה כל אחד מהפרמטרים הללו, עיין כיצד ליצור טקסט: שימוש בשיטות פענוח שונות ליצירת שפה עם רובוטריקים. בואו ננסה את זה עם קבוצה אקראית למחצה של ערכים עבור כמה מהפרמטרים הבאים:

כשמריצים את המודל שלנו עם הפרמטרים האלה, אנחנו מקבלים את הציונים הבאים:

זה לא עבד בדיוק כפי שקיווינו - ציוני ROUGE ירדו מעט. עם זאת, אל תיתן לזה להרתיע אותך מלנסות ערכים שונים עבור פרמטרים אלה. למעשה, זו הנקודה שבה אנחנו מסיימים עם שלב ההתקנה והמעבר לשלב הניסויים של הפרויקט.

מסקנה והצעדים הבאים

סיימנו את ההגדרה לשלב הניסויים. בסדרה בת שני חלקים זו, הורדנו והכנו את הנתונים שלנו, יצרנו קו בסיס עם היוריסטיקה פשוטה, יצרנו קו בסיס נוסף באמצעות למידת זריקת אפס, ולאחר מכן אימנו את המודל שלנו וראינו עלייה משמעותית בביצועים. עכשיו הגיע הזמן לשחק עם כל חלק שיצרנו כדי ליצור סיכומים אפילו טובים יותר. שקול את הדברים הבאים:

- עבדו מראש את הנתונים כראוי – לדוגמה, הסר מילות עצור וסימני פיסוק. אל תזלזלו בחלק הזה - בפרויקטים רבים של מדעי הנתונים, עיבוד מוקדם של נתונים הוא אחד ההיבטים החשובים ביותר (אם לא החשוב ביותר), ומדעני נתונים בדרך כלל מבלים את רוב זמנם במשימה זו.

- נסה דגמים שונים – במדריך שלנו, השתמשנו במודל הסטנדרטי לסיכום (

sshleifer/distilbart-cnn-12-6), אבל עוד הרבה דגמים זמינים שתוכל להשתמש בהם למשימה זו. אחד מאלה עשוי להתאים יותר למקרה השימוש שלך. - בצע כוונון היפרפרמטרים – בעת אימון המודל, השתמשנו בקבוצה מסוימת של היפרפרמטרים (קצב למידה, מספר תקופות וכדומה). הפרמטרים האלה לא חקוקים באבן - להיפך. עליך לשנות את הפרמטרים האלה כדי להבין כיצד הם משפיעים על ביצועי הדגם שלך.

- השתמש בפרמטרים שונים ליצירת טקסט - כבר עשינו סבב אחד של יצירת סיכומים עם פרמטרים שונים כדי להשתמש בחיפוש ודגימה של אלומה. נסה ערכים ופרמטרים שונים. למידע נוסף, עיין ב כיצד ליצור טקסט: שימוש בשיטות פענוח שונות ליצירת שפה עם רובוטריקים.

אני מקווה שהגעת עד הסוף ומצאת את המדריך הזה שימושי.

על המחבר

הייקו הוץ הוא ארכיטקט פתרונות בכיר עבור AI ולמידת מכונה ומוביל את קהילת עיבוד השפה הטבעית (NLP) בתוך AWS. לפני תפקיד זה, הוא היה ראש מדעי הנתונים של שירות הלקוחות של אמזון באיחוד האירופי. Heiko עוזרת ללקוחותינו להצליח במסע AI/ML שלהם ב-AWS ועבדה עם ארגונים בתעשיות רבות, כולל ביטוח, שירותים פיננסיים, מדיה ובידור, שירותי בריאות, שירותים וייצור. בזמנו הפנוי הייקו נוסע כמה שיותר.

הייקו הוץ הוא ארכיטקט פתרונות בכיר עבור AI ולמידת מכונה ומוביל את קהילת עיבוד השפה הטבעית (NLP) בתוך AWS. לפני תפקיד זה, הוא היה ראש מדעי הנתונים של שירות הלקוחות של אמזון באיחוד האירופי. Heiko עוזרת ללקוחותינו להצליח במסע AI/ML שלהם ב-AWS ועבדה עם ארגונים בתעשיות רבות, כולל ביטוח, שירותים פיננסיים, מדיה ובידור, שירותי בריאות, שירותים וייצור. בזמנו הפנוי הייקו נוסע כמה שיותר.

- "

- &

- 100

- 2022

- 7

- 84

- 9

- אודות

- תקציר

- גישה

- חֶשְׁבּוֹן

- תוספת

- נוסף

- מתקדם

- יתרון

- AI

- תעשיות

- כְּבָר

- למרות

- אמזון בעברית

- הודיע

- אחר

- API

- סביב

- מאמרים

- זמין

- AWS

- רקע

- Baseline

- קרן

- להיות

- להיות

- בנצ 'מרק

- תועלת

- קצת

- שיחה

- אשר

- שינוי

- קוד

- קהילה

- לחשב

- מחשבים

- מושג

- קונסול

- מכולות

- מכיל

- לִשְׁלוֹט

- נוֹחַ

- עלויות

- יכול

- יוצר

- יוצרים

- מנהג

- שירות לקוחות

- לקוחות

- נתונים

- מדע נתונים

- לפרוס

- צעצועי התפתחות

- DID

- אחר

- מופץ

- סַוָר

- לא

- תחום

- מטה

- הורדות

- בקלות

- לעודד

- נקודת קצה

- בידור

- סביבה

- EU

- הכל

- דוגמה

- לצפות

- תמציות

- פָּנִים

- כספי

- שירותים פיננסיים

- ראשון

- מתאים

- לעקוב

- הבא

- פוּרמָט

- קדימה

- מצא

- פונקציה

- פונקציונלי

- נוסף

- כללי

- ליצור

- דור

- GitHub

- הולך

- טוב

- GPU

- מדריך

- ראש

- בריאות

- עוזר

- להבליט

- איך

- איך

- HTTPS

- רעיון

- זיהוי

- תמונה

- חשוב

- לשפר

- לכלול

- כולל

- להגדיל

- תעשיות

- להשפיע

- מידע

- להתקין

- ביטוח

- מורכבויות

- IT

- עבודה

- מקומות תעסוקה

- מפתח

- נוף

- שפה

- מחשב נייד

- גדול יותר

- מוביל

- לִלמוֹד

- למד

- למידה

- סִפְרִיָה

- רשימה

- מקומי

- באופן מקומי

- מיקום

- ארוך

- מכונה

- למידת מכונה

- מכונה

- עושה

- ייצור

- מדיה

- אכפת לי

- ML

- מודל

- מודלים

- יותר

- רוב

- כלומר

- טבעי

- חדשות

- מחברה

- מספר

- מספרים

- אפשרויות

- להזמין

- ארגונים

- אחר

- מאמר

- שותפות

- טלאים

- ביצועים

- שלב

- לְשַׂחֵק

- נקודה

- פופולרי

- אפשרי

- חזק

- התחזיות

- פּרוֹיֶקט

- פרויקטים

- להציע

- לספק

- מספק

- מטרה

- איכות

- מהירות

- סביר

- להכיר

- נדרש

- מחקר

- משאבים

- REST

- תוצאות

- עגול

- הפעלה

- ריצה

- מדע

- מדענים

- חיפוש

- אבטחה

- תחושה

- סדרה

- שרות

- שירותים

- הגשה

- סט

- משמעותי

- דומה

- פָּשׁוּט

- שישה

- So

- פתרונות

- במיוחד

- לבלות

- התחלה

- התחלות

- מדינה-of-the-art

- אחסון

- אִסטרָטֶגִיָה

- מוצלח

- מתג

- טכניקות

- מבחן

- דרך

- זמן

- כותרת

- הדרכה

- בדרך כלל

- להבין

- us

- להשתמש

- בְּדֶרֶך כְּלַל

- לנצל

- ערך

- אתר

- מה

- מי

- ויקיפדיה

- בתוך

- לְלֹא

- מילים

- תיק עבודות

- להתאמן

- עבד

- ראוי

- שנים

- אפס