כאשר ארגונים פורסים מודלים לייצור, הם מחפשים כל הזמן דרכים לייעל את הביצועים של דגמי היסוד שלהם (FMs) הפועלים על המאיצים העדכניים ביותר, כגון Afer Inferentia ו-GPUs, כך שהם יכולים להפחית את העלויות שלהם ולהפחית את זמן השהיית תגובה כדי לספק את החוויה הטובה ביותר למשתמשי הקצה. עם זאת, חלק ממכשירי ה-FM אינם מנצלים באופן מלא את המאיצים הזמינים עם המופעים שבהם הם נפרסים, מה שמוביל לשימוש לא יעיל במשאבי החומרה. ארגונים מסוימים פורסים מספר FMs לאותו מופע כדי לנצל טוב יותר את כל המאיצים הזמינים, אבל זה דורש תזמור תשתית מורכב שגוזל זמן וקשה לניהול. כאשר מספר FMs חולקים את אותו מופע, לכל FM יש צרכי קנה מידה ודפוסי שימוש משלו, מה שהופך את זה למאתגר לחזות מתי עליך להוסיף או להסיר מופעים. לדוגמה, מודל אחד עשוי לשמש להפעלת יישום משתמש שבו השימוש יכול לעלות במהלך שעות מסוימות, בעוד שדגם אחר עשוי להיות בעל דפוס שימוש עקבי יותר. בנוסף לאופטימיזציה של עלויות, לקוחות רוצים לספק את חוויית משתמש הקצה הטובה ביותר על ידי הפחתת זמן האחזור. לשם כך, לעתים קרובות הם פורסים מספר עותקים של FM לבקשות שדה ממשתמשים במקביל. מכיוון שתפוקות FM יכולות לנוע בין משפט בודד למספר פסקאות, הזמן שלוקח להשלים את בקשת ההסקה משתנה באופן משמעותי, מה שמוביל לעליות בלתי צפויות בהשהיה אם הבקשות מנותבות באופן אקראי בין מופעים. אמזון SageMaker תומך כעת ביכולות מסקנות חדשות שעוזרות לך להפחית את עלויות הפריסה והשהייה.

כעת תוכל ליצור נקודות קצה מבוססות רכיבי הסקה ולפרוס מודלים של למידת מכונה (ML) לנקודת קצה של SageMaker. רכיב היסק (IC) מפשט את מודל ה-ML שלך ומאפשר לך להקצות מעבדים, GPU או AWS נוירון מאיצים, ומדיניות קנה מידה לכל דגם. רכיבי הסקה מציעים את היתרונות הבאים:

- SageMaker תציב ותארוז בצורה אופטימלית דגמים על מופעי ML כדי למקסם את הניצול, מה שיוביל לחסכון בעלויות.

- SageMaker תשנה כל דגם למעלה ולמטה בהתבסס על התצורה שלך כדי לעמוד בדרישות יישום ה-ML שלך.

- SageMaker ישתלם כדי להוסיף ולהסיר מופעים באופן דינמי כדי להבטיח שהקיבולת זמינה תוך שמירה על מחשוב סרק למינימום.

- ניתן להקטין לאפס עותקים של מודל כדי לפנות משאבים לדגמים אחרים. אתה יכול גם לציין להשאיר דגמים חשובים תמיד טעונים ומוכנים לשרת תנועה.

עם היכולות האלה, אתה יכול להפחית את עלויות פריסת המודל ב-50% בממוצע. החיסכון בעלויות ישתנה בהתאם לעומס העבודה ולדפוסי התנועה שלך. בואו ניקח דוגמה פשוטה כדי להמחיש כיצד אריזה של מספר דגמים בנקודת קצה אחת יכולה למקסם את הניצול ולחסוך בעלויות. נניח שיש לך אפליקציית צ'אט שעוזרת לתיירים להבין מנהגים מקומיים ושיטות עבודה מומלצות שנבנו תוך שימוש בשתי גרסאות של לאמה 2: האחת מותאמת למבקרים אירופאים והשנייה מותאמת למבקרים אמריקאים. אנו מצפים לתנועה עבור הדגם האירופי בין השעות 00:01–11:59 UTC והדגם האמריקאי בין השעות 12:00–23:59 UTC. במקום לפרוס את הדגמים הללו במופעים ייעודיים משלהם, שבהם הם יישבו בחוסר פעילות חצי מהזמן, כעת תוכל לפרוס אותם בנקודת קצה אחת כדי לחסוך בעלויות. אתה יכול להקטין את הדגם האמריקאי לאפס כאשר אין בו צורך כדי לפנות קיבולת לדגם האירופי ולהיפך. זה מאפשר לך לנצל את החומרה שלך ביעילות ולהימנע מבזבוז. זוהי דוגמה פשוטה באמצעות שני מודלים, אבל אתה יכול בקלות להרחיב את הרעיון הזה לארוז מאות דגמים על נקודת קצה אחת שמתרחבת אוטומטית עם עומס העבודה שלך.

בפוסט זה, אנו מראים לכם את היכולות החדשות של נקודות קצה מבוססות IC SageMaker. אנו גם מלווים אותך בפריסת מודלים מרובים באמצעות רכיבי הסקה וממשקי API. לבסוף, אנו מפרטים כמה מיכולות הצפייה החדשות וכיצד להגדיר מדיניות קנה מידה אוטומטי עבור הדגמים שלך ולנהל קנה מידה של מופעים עבור נקודות הקצה שלך. אתה יכול גם לפרוס מודלים באמצעות חוויית המשתמש הפשוטה והאינטראקטיבית החדשה שלנו. אנו תומכים גם ביכולות ניתוב מתקדמות כדי לייעל את זמן ההשהיה והביצועים של עומסי העבודה שלך.

אבני בניין

בואו נסתכל לעומק ונבין כיצד היכולות החדשות הללו פועלות. להלן כמה טרמינולוגיה חדשה עבור אירוח SageMaker:

- מרכיב היסק – אובייקט אירוח של SageMaker שבו אתה יכול להשתמש כדי לפרוס מודל לנקודת קצה. אתה יכול ליצור רכיב הסקה על ידי אספקת הפרטים הבאים:

- דגם SageMaker או מפרט של תמונה וחפצי דגם תואמים SageMaker.

- דרישות משאבי מחשוב, המפרטות את הצרכים של כל עותק של הדגם שלך, כולל ליבות CPU, זיכרון מארח ומספר מאיצים.

- עותק דגם – עותק זמן ריצה של רכיב הסקה שמסוגל לשרת בקשות.

- שינוי קנה מידה אוטומטי של מופע מנוהל - יכולת אירוח של SageMaker להגדיל או להקטין את מספר מופעי המחשוב המשמשים עבור נקודת קצה. קנה מידה של מופע מגיב לקנה מידה של רכיבי הסקה.

כדי ליצור רכיב היסק חדש, אתה יכול לציין תמונת מיכל וחפץ מודל, או שאתה יכול להשתמש במודלים של SageMaker שאולי כבר יצרת. אתה גם צריך לציין את דרישות משאבי המחשוב כגון מספר ליבות המעבד המארח, זיכרון מארח או מספר המאיצים שהמודל שלך צריך להפעיל.

כאשר אתה פורס רכיב הסקה, אתה יכול לציין MinCopies כדי להבטיח שהדגם כבר נטען בכמות שאתה צריך, מוכן להגשת בקשות.

יש לך גם אפשרות להגדיר את המדיניות שלך כך שרכיב ההסקה יעתיק את קנה המידה לאפס. לדוגמה, אם אין לך עומס הפועל מול IC, עותק הדגם ייפרק. זה יכול לפנות משאבים שניתן להחליף בעומסי עבודה פעילים כדי לייעל את הניצול והיעילות של נקודת הקצה שלך.

ככל שבקשות להסקת מסקנות גדלות או יורדות, מספר העותקים של ה-ICs שלך יכול גם להגדיל או להקטין בהתבסס על מדיניות השינוי האוטומטי שלך. SageMaker תטפל במיקום כדי לייעל את האריזה של הדגמים שלך עבור זמינות ועלות.

בנוסף, אם תפעיל קנה מידה אוטומטי של מופע מנוהל, SageMaker תשנה קנה מידה של מופעי חישוב לפי מספר רכיבי ההסקה שיש לטעון בזמן נתון כדי לשרת תעבורה. SageMaker תגדיל את המופעים ותארוז את המופעים ורכיבי ההסקה שלך כדי לבצע אופטימיזציה לעלות תוך שמירה על ביצועי המודל. למרות שאנו ממליצים להשתמש בשינוי קנה מידה מנוהל, יש לך גם אפשרות לנהל את קנה המידה בעצמך, אם תבחר בכך, באמצעות קנה מידה אוטומטי של יישום.

SageMaker יאזן מחדש את רכיבי ההסקה ותקטין את המופעים אם הם אינם נחוצים יותר על ידי רכיבי הסקה ותחסוך בעלויות שלך.

הדרכה של ממשקי API

SageMaker הציגה ישות חדשה בשם InferenceComponent. זה מנתק את הפרטים של אירוח מודל ה-ML מנקודת הקצה עצמה. ה InferenceComponent מאפשר לך לציין מאפייני מפתח לאירוח המודל כמו דגם SageMaker שבו ברצונך להשתמש או פרטי המכולה וחפצי המודל. אתה גם מציין את מספר העותקים של הרכיבים עצמם לפריסה, ומספר המאיצים (GPUs, Inf או Trn מאיצי) או CPU (vCPUs) הנדרשים. זה מספק גמישות רבה יותר עבורך להשתמש בנקודת קצה אחת עבור כל מספר דגמים שאתה מתכנן לפרוס אליו בעתיד.

בואו נסתכל על קריאות ה-API של Boto3 ליצירת נקודת קצה עם רכיב היסק. שימו לב שיש כמה פרמטרים שנתייחס אליהם בהמשך הפוסט הזה.

להלן קוד לדוגמה עבור CreateEndpointConfig:

להלן קוד לדוגמה עבור CreateEndpoint:

להלן קוד לדוגמה עבור CreateInferenceComponent:

הניתוק הזה של InferenceComponent לנקודת קצה מספקת גמישות. אתה יכול לארח דגמים מרובים באותה תשתית, להוסיף או להסיר אותם ככל שהדרישות שלך משתנות. ניתן לעדכן כל דגם באופן עצמאי לפי הצורך. בנוסף, אתה יכול להתאים מודלים בהתאם לצרכי העסק שלך. InferenceComponent מאפשר גם לשלוט בקיבולת לכל דגם. במילים אחרות, אתה יכול לקבוע כמה עותקים של כל דגם לארח. קנה מידה צפוי זה עוזר לך לעמוד בדרישות האחזור הספציפיות עבור כל דגם. באופן כללי, InferenceComponent נותן לך הרבה יותר שליטה על הדגמים המתארחים שלך.

בטבלה הבאה, אנו מציגים השוואה זו לצד זו של הגישה ברמה הגבוהה ליצירה והפעלת נקודת קצה ללא InferenceComponent ועם InferenceComponent. שים לב ש-CreateModel() הוא כעת אופציונלי עבור נקודות קצה מבוססות IC.

| שלב | נקודות קצה מבוססות מודל | נקודות קצה מבוססות רכיבי הסקה |

| 1 | CreateModel(…) | CreateEndpointConfig(...) |

| 2 | CreateEndpointConfig(...) | CreateEndpoint(...) |

| 3 | CreateEndpoint(...) | CreateInferenceComponent(...) |

| 4 | InvokeEndpoint(...) | InvokeEndpoint(InferneceComponentName='value'...) |

הכנסת InferenceComponent מאפשר לך לבצע קנה מידה ברמת הדגם. לִרְאוֹת התעמקו בקנה מידה אוטומטי של מופע ו-IC לפרטים נוספים כיצד InferenceComponent עובד עם קנה מידה אוטומטי.

בעת הפעלת נקודת הקצה של SageMaker, כעת תוכל לציין את הפרמטר החדש InferenceComponentName כדי להכות את הרצוי InferenceComponentName. SageMaker יטפל בניתוב הבקשה למופע המארח את המבוקש InferenceComponentName. ראה את הקוד הבא:

כברירת מחדל, SageMaker משתמש בניתוב אקראי של הבקשות למופעים המגבים את נקודת הקצה שלך. אם ברצונך לאפשר ניתוב בקשות לפחות מצטיינים, תוכל להגדיר את אסטרטגיית הניתוב בתצורת נקודת הקצה RoutingConfig:

בקשות הכי פחות מתקיימות מנתבות מסלולים למופעים הספציפיים שיש להם יותר יכולת לעבד בקשות. זה יספק איזון עומסים וניצול משאבים אחידים יותר.

נוסף על CreateInferenceComponent, ממשקי ה-API הבאים זמינים כעת:

DescribeInferenceComponentDeleteInferenceComponentUpdateInferenceComponentListInferenceComponents

יומנים ומדדים של InferenceComponent

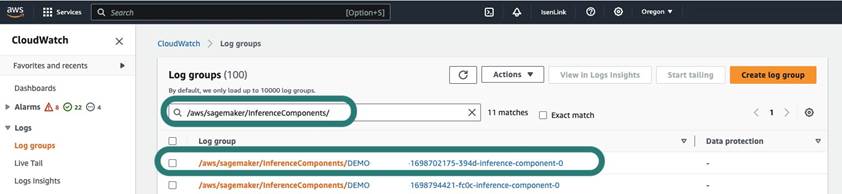

InferenceComponent יומנים ממוקמים ב /aws/sagemaker/InferenceComponents/<InferenceComponentName>. כל היומנים הנשלחים אל stderr ו-stdout במיכל נשלחים לכניסות אלו אמזון CloudWatch.

עם ההקדמה של נקודות קצה מבוססות IC, כעת יש לך את היכולת להציג מדדי מופע נוספים, מדדי רכיבי מסקנות ומדדי הפעלה.

עבור מקרים של SageMaker, כעת תוכל לעקוב אחר GPUReservation ו CPUReservation מדדים כדי לראות את המשאבים השמורים לנקודת קצה בהתבסס על רכיבי ההסקה שפרסת. מדדים אלה יכולים לעזור לך להתאים את גודל מדיניות נקודות הקצה וקנה המידה האוטומטי שלך. אתה יכול גם להציג את המדדים המצטברים המשויכים לכל המודלים שנפרסו לנקודת קצה.

SageMaker גם חושף מדדים ברמת רכיבי ההסקה, שיכולים להראות תצוגה מפורטת יותר של ניצול המשאבים עבור רכיבי ההסקה שפרסת. זה מאפשר לך לקבל תצוגה של כמה ניצול משאבים מצטבר כגון GPUUtilizationNormalized ו GPUMemoryUtilizationNormalized עבור כל רכיב הסקת מסקנות שפרסת שיכול להיות בעל אפס או עותקים רבים.

לבסוף, SageMaker מספקת מדדי קריאת טלפון, שעוקבת כעת אחר קריאות לרכיבי מסקנות במצטבר (Invocations) או לכל עותק המופק (InvocationsPerCopy)

לרשימה מקיפה של מדדים, עיין ב מדדי הזמנת נקודת קצה של SageMaker.

קנה מידה אוטומטי ברמת הדגם

כדי ליישם את התנהגות קנה המידה האוטומטי שתיארנו, בעת יצירת רכיב תצורת נקודת הקצה וההסקת SageMaker, אתה מגדיר את ספירת המופעים הראשוניים וספירת ההעתקות הראשונית של המודל, בהתאמה. לאחר יצירת נקודת הקצה וה-IC המתאימים, כדי להחיל קנה מידה אוטומטי ברמת ה-IC, עליך לרשום תחילה את יעד קנה המידה ולאחר מכן לשייך את מדיניות קנה המידה ל-IC.

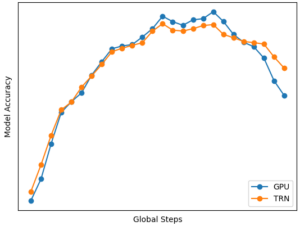

בעת יישום מדיניות קנה המידה, אנו משתמשים SageMakerInferenceComponentInvocationsPerCopy, שהוא מדד חדש שהוצג על ידי SageMaker. הוא לוכד את מספר הפניות הממוצע לכל עותק דגם לדקה.

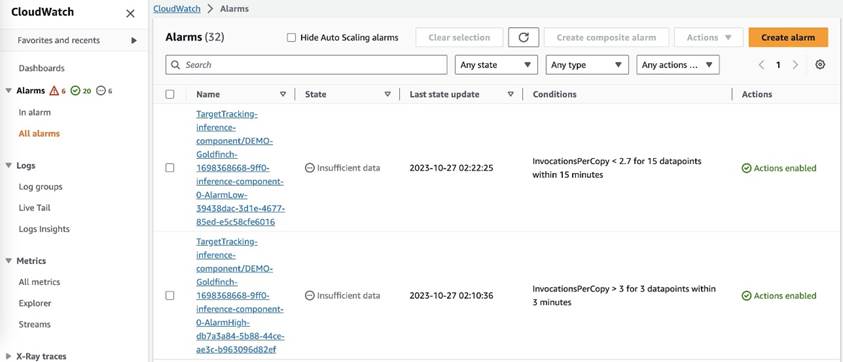

לאחר שתגדיר את מדיניות קנה המידה, SageMaker יוצר שתי אזעקות CloudWatch עבור כל יעד קנה מידה אוטומטי: אחת כדי להפעיל scale-out אם אזעקה למשך 3 דקות (שלוש נקודות נתונים של דקה אחת) ואחת כדי להפעיל scale-in אם אזעקה למשך 1 דקות (15 נקודות נתונים של דקה אחת), כפי שמוצג בצילום המסך הבא. הזמן להפעיל את פעולת קנה המידה הוא בדרך כלל 15-1 דקות יותר מהדקות הללו מכיוון שלוקח זמן לנקודת הקצה לפרסם מדדים ל-CloudWatch, וזה גם לוקח זמן עבור AutoScaling להגיב. תקופת הצינון היא משך הזמן, בשניות, לאחר סיום פעילות scale-in או scale-out לפני שניתן להתחיל פעילות scale-out אחרת. אם התקררות הרחבה קצרה מזמן עדכון נקודת הקצה, אז זה לא משפיע, מכיוון שלא ניתן לעדכן נקודת קצה של SageMaker כשהיא ב עדכון מעמד.

שים לב שכאשר מגדירים קנה מידה אוטומטי ברמת IC, עליך לוודא ש MaxInstanceCount פרמטר שווה למספר המרבי של ICs שנקודת קצה זו יכולה להתמודד עם או קטן ממנו. לדוגמה, אם נקודת הקצה שלך מוגדרת למופע אחד בלבד בתצורת נקודת הקצה ומופע זה יכול לארח רק ארבעה עותקים לכל היותר של המודל, אז MaxInstanceCount צריך להיות שווה ל-4 או קטן מ-XNUMX. עם זאת, אתה יכול גם להשתמש ביכולת קנה המידה האוטומטי המנוהל שסיפקה SageMaker כדי להתאים אוטומטית את ספירת המופעים בהתבסס על מספר העתקת הדגם הנדרש כדי למלא את הצורך במשאבי מחשוב נוספים. קטע הקוד הבא מדגים כיצד להגדיר שינוי גודל מופע מנוהל במהלך יצירת תצורת נקודת הקצה. בדרך זו, כאשר קנה המידה האוטומטי ברמת ה-IC דורש יותר ספירת מופעים כדי לארח את עותקי הדגם, SageMaker תרחיב את מספר המופע באופן אוטומטי כדי לאפשר קנה המידה ברמת ה-IC להצליח.

אתה יכול להחיל מדיניות קנה מידה אוטומטי מרובים כנגד אותה נקודת קצה, מה שאומר שתוכל להחיל את מדיניות קנה המידה האוטומטית המסורתית על נקודות הקצה שנוצרו עם ICs ולהגדיל ולמטה בהתבסס על מדדי נקודות הקצה האחרים. למידע נוסף, עיין ב בצע אופטימיזציה של פריסות למידת המכונה שלך עם קנה מידה אוטומטי ב- Amazon SageMaker. עם זאת, למרות שזה אפשרי, אנו עדיין ממליצים להשתמש בשינוי גודל מופע מנוהל על פני ניהול קנה המידה בעצמך.

סיכום

בפוסט זה, הצגנו תכונה חדשה בהסקת SageMaker שתעזור לכם למקסם את הניצול של מופעי מחשוב, להגדיל למאות דגמים ולבצע אופטימיזציה של עלויות, תוך מתן ביצועים צפויים. יתר על כן, סיפקנו הדרכה על ממשקי ה-API והראנו לך כיצד להגדיר ולפרוס רכיבי הסקה לעומסי העבודה שלך.

אנחנו גם תומכים יכולות ניתוב מתקדמות כדי לייעל את זמן ההשהיה והביצועים של עומסי העבודה שלך. SageMaker יכול לעזור לך לייעל את עומסי העבודה שלך להסקת עלות וביצועים ולתת לך פירוט ברמת המודל לניהול. יצרנו א סט של מחברות שיראה לך כיצד לפרוס שלושה דגמים שונים, באמצעות קונטיינרים שונים והחלת מדיניות קנה מידה אוטומטי ב- GitHub. אנו ממליצים לך להתחיל עם מחברת 1 ולהתחיל עם יכולות האירוח החדשות של SageMaker היום!

על המחברים

פארק ג'יימס הוא אדריכל פתרונות בשירותי האינטרנט של אמזון. הוא עובד עם Amazon.com כדי לתכנן, לבנות ולפרוס פתרונות טכנולוגיים ב-AWS, ויש לו עניין מיוחד בבינה מלאכותית ולמידת מכונה. בזמן הפנוי הוא נהנה לחפש תרבויות חדשות, חוויות חדשות, ולהישאר מעודכן בטרנדים הטכנולוגיים העדכניים ביותר. אתה יכול למצוא אותו על לינקדין.

פארק ג'יימס הוא אדריכל פתרונות בשירותי האינטרנט של אמזון. הוא עובד עם Amazon.com כדי לתכנן, לבנות ולפרוס פתרונות טכנולוגיים ב-AWS, ויש לו עניין מיוחד בבינה מלאכותית ולמידת מכונה. בזמן הפנוי הוא נהנה לחפש תרבויות חדשות, חוויות חדשות, ולהישאר מעודכן בטרנדים הטכנולוגיים העדכניים ביותר. אתה יכול למצוא אותו על לינקדין.

מלאני לי, PhD, הוא TAM מומחה בינה מלאכותית/ML בכיר ב-AWS שבסיסו בסידני, אוסטרליה. היא עוזרת ללקוחות ארגוניים לבנות פתרונות תוך שימוש בכלי AI/ML מתקדמים ב-AWS ומספקת הדרכה לגבי ארכיטקטורה והטמעה של פתרונות ML עם שיטות עבודה מומלצות. בזמנה הפנוי היא אוהבת לחקור את הטבע ולבלות עם משפחה וחברים.

מלאני לי, PhD, הוא TAM מומחה בינה מלאכותית/ML בכיר ב-AWS שבסיסו בסידני, אוסטרליה. היא עוזרת ללקוחות ארגוניים לבנות פתרונות תוך שימוש בכלי AI/ML מתקדמים ב-AWS ומספקת הדרכה לגבי ארכיטקטורה והטמעה של פתרונות ML עם שיטות עבודה מומלצות. בזמנה הפנוי היא אוהבת לחקור את הטבע ולבלות עם משפחה וחברים.

מארק קארפ הוא אדריכל ML בצוות שירות Amazon SageMaker. הוא מתמקד בסיוע ללקוחות לתכנן, לפרוס ולנהל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי הוא נהנה לטייל ולחקור מקומות חדשים.

מארק קארפ הוא אדריכל ML בצוות שירות Amazon SageMaker. הוא מתמקד בסיוע ללקוחות לתכנן, לפרוס ולנהל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי הוא נהנה לטייל ולחקור מקומות חדשים.

אלן טאן הוא מנהל מוצר בכיר ב- SageMaker, המוביל מאמצים בהסקת דגמים גדולים. הוא נלהב ליישם למידת מכונה לתחום האנליטיקה. מחוץ לעבודה, הוא נהנה בחוץ.

אלן טאן הוא מנהל מוצר בכיר ב- SageMaker, המוביל מאמצים בהסקת דגמים גדולים. הוא נלהב ליישם למידת מכונה לתחום האנליטיקה. מחוץ לעבודה, הוא נהנה בחוץ.

ראגו רמשה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, לפרוס ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בתחומי למידת מכונה, בינה מלאכותית וראייה ממוחשבת, ובעל תואר שני במדעי המחשב מאוניברסיטת דאלאס. בזמנו הפנוי הוא אוהב לטייל ולצלם.

ראגו רמשה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, לפרוס ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בתחומי למידת מכונה, בינה מלאכותית וראייה ממוחשבת, ובעל תואר שני במדעי המחשב מאוניברסיטת דאלאס. בזמנו הפנוי הוא אוהב לטייל ולצלם.

רופנדר גרוואל הוא אדריכל פתרונות מומחה Sr Ai/ML עם AWS. כיום הוא מתמקד בהגשת דגמים ו-MLOps ב- SageMaker. לפני תפקיד זה עבד כמהנדס למידת מכונה בבניית ואירוח מודלים. מחוץ לעבודה הוא נהנה לשחק טניס ולרכוב על אופניים בשבילי הרים.

רופנדר גרוואל הוא אדריכל פתרונות מומחה Sr Ai/ML עם AWS. כיום הוא מתמקד בהגשת דגמים ו-MLOps ב- SageMaker. לפני תפקיד זה עבד כמהנדס למידת מכונה בבניית ואירוח מודלים. מחוץ לעבודה הוא נהנה לשחק טניס ולרכוב על אופניים בשבילי הרים.

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

לקשמי רמקרישנן הוא מהנדס ראשי בצוות הפלטפורמה Amazon SageMaker Machine Learning (ML) ב- AWS, המספק מנהיגות טכנית למוצר. הוא עבד במספר תפקידים הנדסיים באמזון למעלה מ 9 שנים. יש לו תואר ראשון בהנדסה בטכנולוגיית מידע מהמכון הלאומי לטכנולוגיה, קרנטקה, הודו ותואר שני במדעי המחשב מאוניברסיטת ערים תאומות מאוניברסיטת מינסוטה.

לקשמי רמקרישנן הוא מהנדס ראשי בצוות הפלטפורמה Amazon SageMaker Machine Learning (ML) ב- AWS, המספק מנהיגות טכנית למוצר. הוא עבד במספר תפקידים הנדסיים באמזון למעלה מ 9 שנים. יש לו תואר ראשון בהנדסה בטכנולוגיית מידע מהמכון הלאומי לטכנולוגיה, קרנטקה, הודו ותואר שני במדעי המחשב מאוניברסיטת ערים תאומות מאוניברסיטת מינסוטה.

דייוויד ניג'נדה הוא מהנדס פיתוח תוכנה בכיר בצוות אמזון SageMaker, שעובד כעת על שיפור תהליכי עבודה של למידת מכונה בייצור, כמו גם על השקת תכונות מסקנות חדשות. בזמנו הפנוי, הוא מנסה לשמור על קשר עם ילדיו.

דייוויד ניג'נדה הוא מהנדס פיתוח תוכנה בכיר בצוות אמזון SageMaker, שעובד כעת על שיפור תהליכי עבודה של למידת מכונה בייצור, כמו גם על השקת תכונות מסקנות חדשות. בזמנו הפנוי, הוא מנסה לשמור על קשר עם ילדיו.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/reduce-model-deployment-costs-by-50-on-average-using-sagemakers-latest-features/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 114

- 12

- 13

- 15%

- 150

- 16

- 22

- 360

- 362

- 500

- 7

- 9

- a

- יכולת

- יכול

- אודות

- תקצירים

- מאיצים

- נגיש

- פי

- להשיג

- פעולה

- פעיל

- פעילות

- להוסיף

- מוסיף

- תוספת

- נוסף

- בנוסף

- כתובת

- מתקדם

- לאחר

- נגד

- לְקַבֵּץ

- AI

- AI / ML

- אלן

- אזעקה

- תעשיות

- להתיר

- מאפשר

- כְּבָר

- גם

- למרות

- תמיד

- אמזון בעברית

- אמזון SageMaker

- אמזון שירותי אינטרנט

- Amazon.com

- אֲמֶרִיקָאִי

- כמות

- an

- ניתוח

- ו

- אחר

- כל

- API

- ממשקי API

- בקשה

- יישומים

- החל

- מריחה

- גישה

- ARE

- AREA

- מלאכותי

- בינה מלאכותית

- AS

- עמית

- המשויך

- At

- אוסטרליה

- המכונית

- באופן אוטומטי

- זמינות

- זמין

- מְמוּצָע

- לְהִמָנַע

- AWS

- גיבוי

- מבוסס

- BE

- כי

- לפני

- התנהגות

- הטבות

- הטוב ביותר

- שיטות עבודה מומלצות

- מוטב

- בֵּין

- לִבנוֹת

- בִּניָן

- נבנה

- עסקים

- אבל

- by

- נקרא

- שיחות

- CAN

- יכולות

- יכולת

- מסוגל

- קיבולת

- לוכדת

- מסוים

- האתגרים

- אתגר

- שינוי

- בחרו

- ערים

- קוד

- COM

- השוואה

- להשלים

- הושלם

- מורכב

- רְכִיב

- רכיבים

- מַקִיף

- לחשב

- המחשב

- מדעי מחשב

- ראייה ממוחשבת

- מחשוב

- תְצוּרָה

- מוגדר

- עִקבִי

- תמיד

- רב

- מכולה

- מכולות

- לִשְׁלוֹט

- ליבה

- תוֹאֵם

- עלות

- חיסכון עלויות

- עלויות

- יכול

- לִיצוֹר

- נוצר

- יוצר

- יוצרים

- יצירה

- כיום

- לקוחות

- מכס

- דאלאס

- נתונים

- נקודות מידע

- תַאֲרִיך

- להקטין

- מוקדש

- עמוק

- למידה עמוקה

- עמוק יותר

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- תואר

- להתעמק

- דמוקרטיזציה

- מדגים

- תלוי

- לפרוס

- פרס

- פריסה

- פריסה

- פריסות

- מְתוּאָר

- עיצוב

- רצוי

- פרט

- פרטים

- לקבוע

- צעצועי התפתחות

- אחר

- קשה

- מופץ

- מחשוב מבוזר

- do

- תחומים

- לא

- מטה

- בְּמַהֲלָך

- באופן דינמי

- כל אחד

- בקלות

- השפעה

- יְעִילוּת

- יעילות

- מַאֲמָצִים

- לאפשר

- מופעל

- מאפשר

- לעודד

- נקודת קצה

- מהנדס

- הנדסה

- לְהַבטִיחַ

- מִפְעָל

- חברות

- ישות

- שווה

- אֵירוֹפִּי

- דוגמה

- לצפות

- ניסיון

- חוויות

- לחקור

- היכרות

- להאריך

- משפחה

- מאפיין

- תכונות

- שדה

- ראשון

- גמישות

- מתמקד

- הבא

- בעד

- קרן

- ארבע

- חופשי

- חברים

- החל מ-

- לגמרי

- יתר על כן

- עתיד

- לקבל

- gif

- GitHub

- לתת

- נתן

- נותן

- מטרה

- GPU

- GPUs

- פרטני

- הדרכה

- חצי

- לטפל

- ידיים

- חומרה

- יש

- he

- לעזור

- עזרה

- עוזר

- לה

- גָבוֹהַ

- ברמה גבוהה

- לו

- שֶׁלוֹ

- מכה

- מחזיק

- המארח

- אירח

- אירוח

- שעות

- איך

- איך

- אולם

- http

- HTTPS

- מאות

- רעיון

- להתבטל

- if

- להמחיש

- תמונה

- ליישם

- יישום

- חשוב

- שיפור

- in

- באחר

- כולל

- להגדיל

- באופן עצמאי

- הודו

- לֹא יָעִיל

- מידע

- טכנולוגיית מידע

- תשתית

- בתחילה

- חדשני

- טכנולוגיות חדשניות

- למשל

- במקום

- מכון

- מוֹדִיעִין

- אינטראקטיבי

- אינטרס

- אל תוך

- הציג

- מבוא

- IT

- שֶׁלָה

- עצמו

- jpg

- שמור

- שמירה

- מפתח

- הילדים

- גָדוֹל

- מפעלים גדולים

- לבסוף

- חֶבִיוֹן

- מאוחר יותר

- האחרון

- השקה

- מנהיגות

- מוביל

- למידה

- הכי פחות

- רמה

- כמו

- לינקדין

- רשימה

- לאמה

- לִטעוֹן

- מקומי

- ממוקם

- עוד

- נראה

- הסתכלות

- אוהב

- מכונה

- למידת מכונה

- לעשות

- עשייה

- לנהל

- הצליח

- ניהול

- מנהל

- ניהול

- רב

- אב

- מאסטר

- לְהַגדִיל

- מקסימום

- מאי..

- אומר

- לִפְגוֹשׁ

- זכרון

- מטרי

- מדדים

- נודד

- מינימום

- דקה

- דקות

- ML

- MLOps

- מודל

- מודלים

- יותר

- מוטיבציה

- הַר

- הרבה

- מספר

- לאומי

- טבע

- צורך

- נחוץ

- צרכי

- חדש

- NLP

- לא

- הערות

- מחברה

- עַכשָׁיו

- מספר

- אובייקט

- of

- הַצָעָה

- לעתים קרובות

- on

- ONE

- רק

- עַל גַבֵּי

- מטב

- מיטוב

- אפשרות

- or

- תזמור

- ארגונים

- אחר

- שלנו

- הַחוּצָה

- בחוץ

- פלטים

- בחוץ

- בולט

- יותר

- מקיף

- שֶׁלוֹ

- חבילה

- מקביל

- פרמטר

- פרמטרים

- מסוים

- לוהט

- תבנית

- דפוסי

- עבור

- ביצועים

- תקופה

- דוקטורט

- צילום

- מקום

- מיקום

- מקומות

- תכנית

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- משחק

- נקודות

- מדיניות

- מדיניות

- אפשרי

- הודעה

- כּוֹחַ

- פרקטיקות

- לחזות

- צפוי

- מִשׁמֶרֶת

- מנהל

- קודם

- בעיות

- תהליך

- המוצר

- מנהל מוצר

- הפקה

- נכסים

- לספק

- ובלבד

- מספק

- מתן

- לפרסם

- כמות

- אקראי

- רכס

- טִוּוּחַ

- להגיב

- מגיב

- מוכן

- לאזן

- להמליץ

- להפחית

- הפחתה

- להתייחס

- הירשם

- קָשׁוּר

- להסיר

- הסרת

- החליף

- לבקש

- בקשות

- לדרוש

- נדרש

- דרישות

- דורש

- שמור

- משאב

- משאבים

- בהתאמה

- תגובה

- תפקיד

- תפקידים

- נתיבים

- ניתוב

- הפעלה

- ריצה

- זמן ריצה

- בעל חכמים

- SageMaker Inference

- אותו

- שמור

- חיסכון

- לומר

- סולם

- מאזניים

- דרוג

- מדע

- שניות

- לִרְאוֹת

- מחפשים

- לחצני מצוקה לפנסיונרים

- נשלח

- משפט

- לשרת

- שרות

- שירותים

- הגשה

- סט

- הצבה

- כמה

- שיתוף

- היא

- צריך

- לְהַצִיג

- הראה

- הראה

- באופן משמעותי

- פָּשׁוּט

- פשוט

- יחיד

- לשבת

- מידה

- קטן יותר

- קטע

- So

- תוכנה

- פיתוח תוכנה

- פתרונות

- כמה

- מומחה

- מתמחה

- ספציפי

- מפרט

- לבלות

- הוצאה

- דָרְבָּן

- קוצים

- התחלה

- חברות סטארט

- מדינה-of-the-art

- מצב

- להישאר

- עוד

- אִסטרָטֶגִיָה

- מוצלח

- כזה

- אספקה

- תמיכה

- תומך

- בטוח

- סידני

- שולחן

- לקחת

- לוקח

- יעד

- נבחרת

- TechCrunch

- טכני

- טכנולוגיות

- טכנולוגיה

- טֶנִיס

- טרמינולוגיה

- מֵאֲשֶׁר

- זֶה

- השמיים

- האזור

- העתיד

- שֶׁלָהֶם

- אותם

- אז

- שם.

- אלה

- הֵם

- זֶה

- אלה

- שְׁלוֹשָׁה

- דרך

- זמן

- ל

- כלים

- לעקוב

- מסורתי

- תְנוּעָה

- נסיעה

- מגמות

- להפעיל

- תאום

- שתיים

- להבין

- אוניברסיטה

- בלתי צפוי

- עדכון

- מְעוּדכָּן

- נוֹהָג

- להשתמש

- מְשׁוּמָשׁ

- משתמש

- חוויית משתמש

- משתמשים

- שימושים

- באמצעות

- בְּדֶרֶך כְּלַל

- UTC

- לנצל

- סְגָן

- לצפיה

- חזון

- מבקרים

- ללכת

- בהדרכה

- רוצה

- לבזבז

- דֶרֶך..

- דרכים

- we

- אינטרנט

- שירותי אינטרנט

- טוֹב

- מתי

- ואילו

- אשר

- בזמן

- יצטרך

- עם

- לְלֹא

- מילים

- תיק עבודות

- עבד

- זרימות עבודה

- עובד

- עובד

- שנים

- אתה

- עצמך

- זפירנט

- אפס