עולם הבינה המלאכותית (AI) ולמידת מכונה (ML) היה עד לשינוי פרדיגמה עם עלייתם של מודלים AI גנרטיביים שיכולים ליצור טקסט, תמונות, קוד ואודיו דמויי אדם. בהשוואה לדגמי ML קלאסיים, דגמי AI גנרטיביים גדולים ומורכבים משמעותית. עם זאת, המורכבות הגוברת שלהם מגיעה גם עם עלויות גבוהות להסקת מסקנות וצורך הולך וגובר במשאבי מחשוב רבי עוצמה. העלות הגבוהה של מסקנות עבור מודלים של AI גנרטיביים יכולה להוות חסם כניסה עבור עסקים וחוקרים בעלי משאבים מוגבלים, מה שמחייב את הצורך בפתרונות יעילים וחסכוניים יותר. יתר על כן, רוב מקרי השימוש ב-AI גנרטיביים כוללים אינטראקציה אנושית או תרחישים בעולם האמיתי, המצריכים חומרה שיכולה לספק ביצועים עם אחזור נמוך. AWS חידשה עם שבבים ייעודיים כדי לענות על הצורך הגובר בחומרת מחשוב חזקה, יעילה וחסכונית.

היום, אנו נרגשים להכריז על כך אמזון SageMaker תומך AWS Inferentia2 (ml.inf2) ו AWS Trainium (ml.trn1) מופעים מבוססי SageMaker לארח מודלים של בינה מלאכותית להסקה בזמן אמת וא-סינכרונית. מופעי ml.inf2 זמינים לפריסת מודל ב- SageMaker במזרח ארה"ב (אוהיו) ומופעי ml.trn1 במזרח ארה"ב (מדינת וירג'יניה).

אתה יכול להשתמש במופעים אלה ב- SageMaker כדי להשיג ביצועים גבוהים בעלות נמוכה עבור דגמי AI גנרטיביים, כולל מודלים של שפה גדולה (LLMs), דיפוזיה יציבה ושנאי ראייה. בנוסף, אתה יכול להשתמש אמזון SageMaker Inference Recommend כדי לעזור לך להריץ בדיקות עומס ולהעריך את היתרונות של מחיר-ביצועים של פריסת המודל שלך במופעים אלה.

אתה יכול להשתמש במופעי ml.inf2 ו-ml.trn1 כדי להפעיל את יישומי ה-ML שלך ב- SageMaker עבור סיכום טקסט, הפקת קוד, יצירת וידאו ותמונה, זיהוי דיבור, התאמה אישית, זיהוי הונאה ועוד. אתה יכול להתחיל בקלות על ידי ציון מופעי ml.trn1 או ml.inf2 בעת הגדרת נקודת הקצה של SageMaker. אתה יכול להשתמש ב-ml.trn1 ו-ml.inf2 תואמי AWS Deep Learning Containers (DLCs) עבור PyTorch, TensorFlow, Hugging Face והסקת מודלים גדולים (LMI) כדי להתחיל בקלות. לרשימה המלאה עם גרסאות, ראה תמונות מכולות זמינות למידה עמוקה.

בפוסט זה, אנו מראים את התהליך של פריסת מודל שפה גדול ב-AWS Inferentia2 באמצעות SageMaker, ללא צורך בקידוד נוסף, על ידי ניצול מיכל ה-LMI. אנו משתמשים ב- GPT4ALL-J, דגם GPT-J 7B מכוון עדין המספק אינטראקציה בסגנון צ'טבוט.

סקירה כללית של מופעי ml.trn1 ו-ml.inf2

מופעי ml.trn1 מופעלים על ידי מאיץ Trainium, אשר נבנה בעיקר לאימון למידה עמוקה בעלת ביצועים גבוהים של דגמי AI גנרטיביים, כולל LLMs. עם זאת, מופעים אלה תומכים גם בעומסי עבודה של הסקת עבודה עבור מודלים שהם אפילו גדולים יותר ממה שמתאים ל-Inf2. גודל המופע הגדול ביותר, trn1.32xlarge מופעים, כולל 16 מאיצי טרייניום עם זיכרון מאיץ של 512 ג'יגה-בייט במופע יחיד המספק עד 3.4 petaflops של כוח מחשוב FP16/BF16. 16 מאיצי Trainium מחוברים ל-NeuronLinkv2 במהירות גבוהה במיוחד לתקשורת קולקטיבית יעילה.

מופעי ml.Inf2 מופעלים על ידי מאיץ AWS Inferentia2, מאיץ ייעודי להסקת מסקנות. הוא מספק ביצועי מחשוב גבוהים פי שלושה, תפוקה גבוהה פי ארבעה, ועד פי 10 זמן אחזור נמוך יותר בהשוואה ל-AWS Inferentia מהדור הראשון. גודל המופע הגדול ביותר, Inf2.48xlarge, כולל 12 מאיצי AWS Inferentia2 עם זיכרון מאיץ של 384 ג'יגה-בייט במופע בודד עבור כוח חישוב משולב של 2.3 petaflops עבור BF16/FP16. זה מאפשר לך לפרוס עד מודל של 175 מיליארד פרמטרים במופע בודד. Inf2 הוא המופע היחיד המותאם להסקת מסקנות שמציע את החיבור הזה, תכונה שזמינה רק במקרי אימון יקרים יותר. עבור דגמים גדולים במיוחד שאינם מתאימים למאיץ אחד, הנתונים זורמים ישירות בין מאיצים עם NeuronLink, ועוקפים לחלוטין את המעבד. עם NeuronLink, Inf2 תומך בהסקה מבוזרת מהירה יותר ומשפר את התפוקה והשהייה.

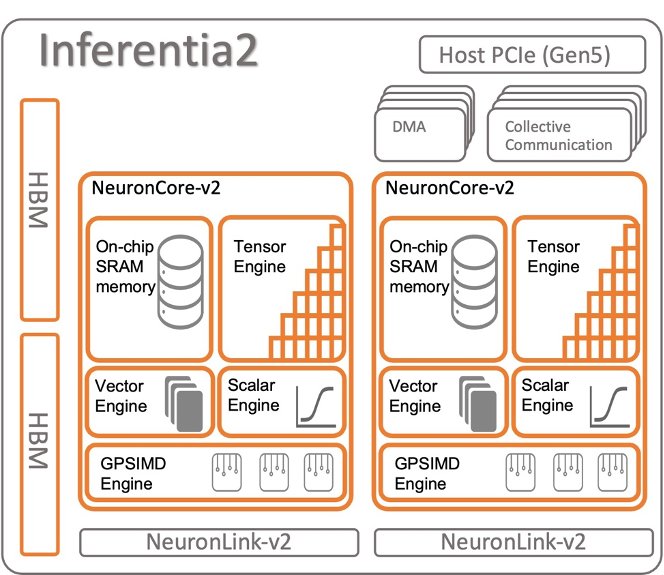

גם למאיצי AWS Inferentia2 וגם ל-Trainium יש שניים NeuronCores-v2, ערימות זיכרון HBM בנפח 32 גיגה-בייט ומנועי מחשוב קולקטיבי ייעודיים, אשר מייעלים אוטומטית את זמן הריצה על ידי חישוב ותקשורת חופפים בעת ביצוע הסקת מסקנות מרובה מאיצים. לפרטים נוספים על הארכיטקטורה, עיין ב מכשירי Trainium ו-Inferentia.

התרשים הבא מציג ארכיטקטורה לדוגמה באמצעות AWS Inferentia2.

AWS נוירון SDK

AWS נוירון הוא ה-SDK המשמש להפעלת עומסי עבודה של למידה עמוקה במופעים מבוססי AWS Inferentia ו-Trainium. AWS Neuron כולל מהדר למידה עמוקה, זמן ריצה וכלים המשולבים באופן טבעי ב- TensorFlow ו- PyTorch. עם Neuron, אתה יכול לפתח, ליצור פרופיל ולפרוס עומסי עבודה ML בעלי ביצועים גבוהים ב-ml.trn1 ו-ml.inf2.

השמיים מהדר נוירונים מקבל דגמי ML בפורמטים שונים (TensorFlow, PyTorch, XLA HLO) ומייעל אותם לרוץ על מכשירי Neuron. מהדר Neuron מופעל במסגרת ML, כאשר מודלים של ML נשלחים אל המהדר על ידי תוסף Neuron framework. חפץ המהדר שהתקבל נקרא קובץ NEFF (פורמט קובץ Neuron Executable) שבתורו נטען על ידי זמן הריצה של Neuron למכשיר ה-Neuron.

השמיים זמן ריצה של נוירונים מורכב מספריות מנהלי התקנים של ליבה ו-C/C++, המספקות ממשקי API לגישה למכשירי AWS Inferentia ו-Trainium Neuron. התוספים Neuron ML frameworks עבור TensorFlow ו- PyTorch משתמשים בזמן הריצה של Neuron כדי לטעון ולהפעיל מודלים על NeuronCores. זמן הריצה של Neuron טוען מודלים של למידה עמוקה (NEFF) למכשירי Neuron והוא מותאם לתפוקה גבוהה והשהייה נמוכה.

מארח דגמי NLP באמצעות מופעי SageMaker ml.inf2

לפני שאנחנו צוללים עמוק לתוך הגשת LLMs עם שנאים-נוירון, שהיא ספריית קוד פתוח לריסוק מטריצות המשקל הגדולות של המודל על מספר NeuronCores, הבה נעבור בקצרה על זרימת הפריסה האופיינית למודל שיכול להתאים ל- NeuronCore הבודדת.

בדקו רשימה של דגמים נתמכים כדי להבטיח שהמודל נתמך ב-AWS Inferentia2. לאחר מכן, המודל צריך להיות מורכב מראש על ידי מהדר Neuron. אתה יכול להשתמש במחברת SageMaker או ב- ענן מחשוב אלסטי של אמזון (Amazon EC2) מופע להידור המודל. אתה יכול להשתמש ב-SageMaker Python SDK כדי לפרוס מודלים באמצעות מסגרות למידה עמוקה פופולריות כגון PyTorch, כפי שמוצג בקוד הבא. אתה יכול לפרוס את המודל שלך לשירותי אירוח של SageMaker ולקבל נקודת קצה שניתן להשתמש בה להסקת מסקנות. נקודות קצה אלו מנוהלות באופן מלא ותומכות בקנה מידה אוטומטי.

עיין זרימת מפתחים לפרטים נוספים על זרימות פיתוח טיפוסיות של Inf2 ב- SageMaker עם סקריפטים לדוגמה.

ארח LLMs באמצעות SageMaker ml.inf2 מופעים

מודלים של שפה גדולים עם מיליארדי פרמטרים הם לרוב גדולים מכדי להתאים למאיץ יחיד. זה מחייב שימוש בטכניקות מקבילות מודל לאירוח LLMs על פני מספר מאיצים. דרישה חיונית נוספת לאירוח LLMs היא הטמעה של פתרון מתן מודלים בעל ביצועים גבוהים. פתרון זה אמור לטעון ביעילות את המודל, לנהל את המחיצות ולשרת בצורה חלקה בקשות דרך נקודות קצה HTTP.

SageMaker כולל מיכלים מיוחדים ללמידה עמוקה (DLCs), ספריות וכלים עבור מקביליות מודלים והסקת מודלים גדולים. למשאבים לתחילת העבודה עם LMI ב- SageMaker, עיין ב מקביליות מודל והסקת מודל גדולה. SageMaker מתחזקת DLCs עם ספריות קוד פתוח פופולריות לאירוח דגמים גדולים כגון GPT, T5, OPT, BLOOM ו-Stable Diffusion על תשתית AWS. DLCs מיוחדים אלה מכונים מכולות SageMaker LMI.

מכולות SageMaker LMI השתמש ב-DJLServing, שרת מודל המשולב עם ספריית ה-transformers-neuronx כדי לתמוך בהקבלה טנזורית על פני NeuronCores. למידע נוסף על אופן פעולת DJLServing, עיין ב פרוס דגמים גדולים ב-Amazon SageMaker באמצעות מסקנות מקבילות של מודל DJLServing ו-DeepSpeed. שרת מודל DJL וספריית Transformers-neuronx משמשים כרכיבי ליבה של המיכל, הכולל גם את Neuron SDK. הגדרה זו מקלה על טעינת מודלים על מאיצי AWS Inferentia2, מקבילה את המודל על פני NeuronCores מרובות ומאפשרת הגשה באמצעות נקודות קצה HTTP.

מיכל ה-LMI תומך בטעינת דגמים מ-an שירות אחסון פשוט של אמזון (Amazon S3) דלי או Hugging Face Hub. סקריפט המטפל המוגדר כברירת מחדל טוען את המודל, קומפילציה וממיר אותו לפורמט מותאם ל- Neuron, וטוען אותו. כדי להשתמש במאגר LMI לארח LLMs, יש לנו שתי אפשרויות:

- ללא קוד (מועדף) - זוהי הדרך הקלה ביותר לפרוס LLM באמצעות מיכל LMI. בשיטה זו, אתה יכול להשתמש בשיטה המסופקת מטפל ברירת מחדל ופשוט להעביר את שם הדגם ואת הפרמטרים הנדרשים ב

serving.propertiesקובץ כדי לטעון ולארח את הדגם. כדי להשתמש במטפל ברירת המחדל, אנו מספקים אתentryPointפרמטר כdjl_python.transformers-neuronx. - תביא תסריט משלך – בגישה זו, יש לך אפשרות ליצור קובץ model.py משלך, המכיל את הקוד הדרוש לטעינת המודל ולהגשתו. קובץ זה משמש כמתווך בין

DJLServingממשקי API וה-transformers-neuronxממשקי API. כדי להתאים אישית את תהליך טעינת הדגם, אתה יכול לספקserving.propertiesעם פרמטרים הניתנים להגדרה. לרשימה מקיפה של פרמטרים זמינים הניתנים להגדרה, עיין ב כל אפשרויות התצורה של DJL. הנה דוגמה של א model.py קובץ.

ארכיטקטורת זמן ריצה

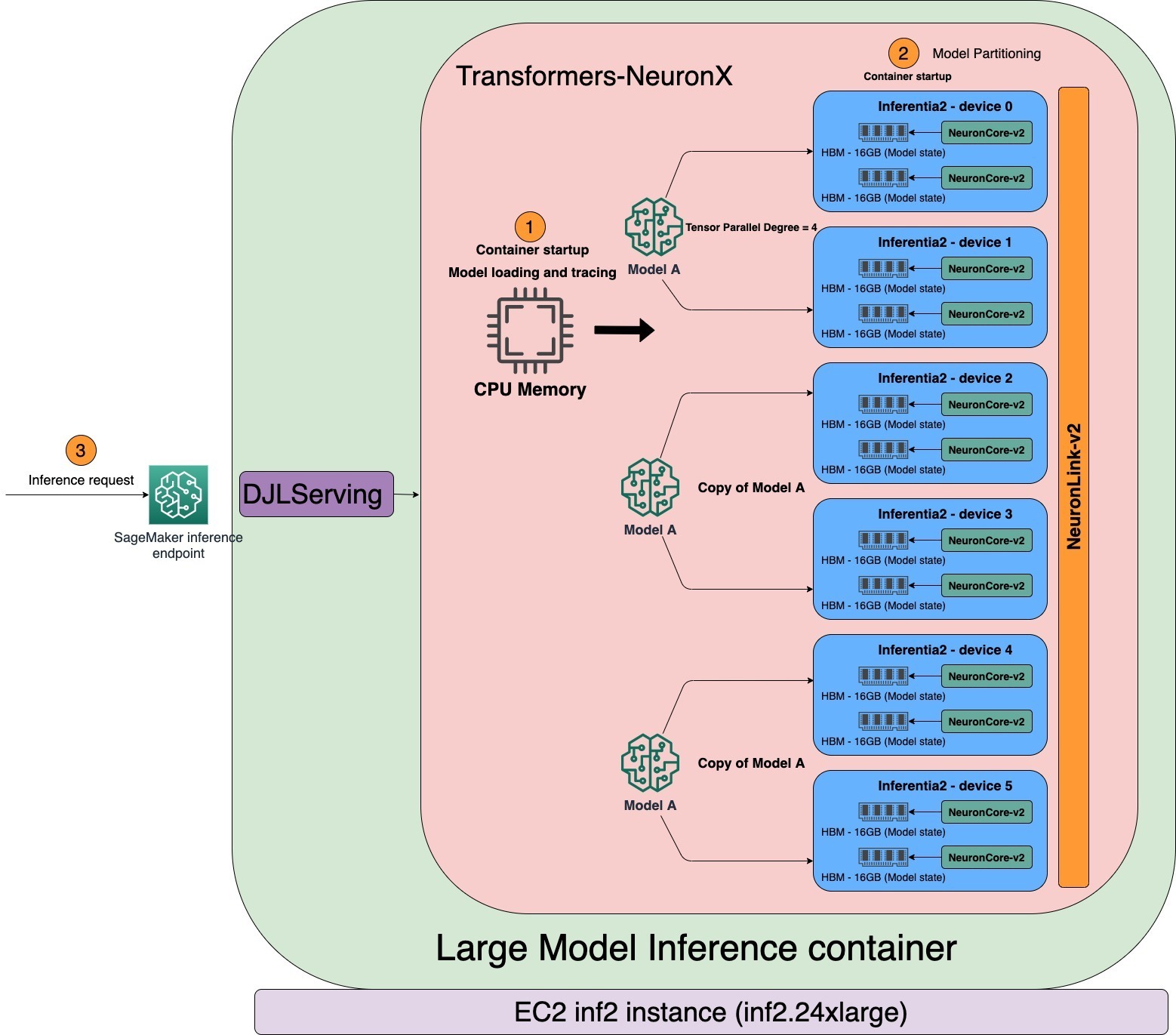

השמיים tensor_parallel_degree ערך המאפיין קובע את ההתפלגות של מודולים מקבילים טנזור על פני NeuronCores מרובות. לדוגמה, ל-inf2.24xlarge יש שישה מאיצי AWS Inferentia2. לכל מאיץ AWS Inferentia2 יש שתי NeuronCores. לכל NeuronCore זיכרון ייעודי ברוחב פס גבוה (HBM) של 16 ג'יגה-בייט המאחסן מודולים מקבילים טנזוריים. עם דרגת טנזור מקבילה של 4, ה-LMI יקצה שלושה עותקי דגם של אותו דגם, כל אחד ישתמש בארבעה NeuronCores. כפי שמוצג בתרשים הבא, כאשר מיכל ה-LMI יתחיל, הדגם ייטען ויעקוב ראשון בזיכרון הניתן להתייחסות של ה-CPU. כאשר המעקב הושלם, המודל מחולק על פני NeuronCores בהתבסס על דרגת מקבילית טנזור.

LMI משתמשת ב-DJLServing בתור ערימת הגשה לדגם שלה. לאחר שבדיקת התקינות של המכולה עוברת ב- SageMaker, המכולה מוכנה להגיש את בקשת ההסקה. DJLServing משיק מספר תהליכי Python השווים ל- TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. כל תהליך Python מכיל שרשורים ב-C++ המקבילים ל TENSOR_PARALLEL_DEGREE. כל פתיל C++ מחזיק רסיס אחד של הדגם על NeuronCore אחד.

מתרגלים רבים (תהליך Python) נוטים להפעיל מסקנות ברצף כאשר השרת מופעל עם מספר בקשות עצמאיות. למרות שקל יותר להגדיר, זה בדרך כלל לא השיטה הטובה ביותר לנצל את כוח המחשוב של המאיץ. כדי להתמודד עם זה, DJLServing מציע את האופטימיזציות המובנות של אצווה דינמית כדי לשלב בקשות הסקה עצמאיות אלו בצד השרת ליצירת אצווה גדולה יותר באופן דינמי כדי להגדיל את התפוקה. כל הבקשות מגיעות ל-batcher הדינמי תחילה לפני הכניסה לתורי העבודה בפועל כדי להמתין להסקת מסקנות. אתה יכול להגדיר את גדלי האצווה המועדפים עליך עבור אצווה דינמית באמצעות batch_size הגדרות ב - Windows serving.properties. אתה יכול גם להגדיר max_batch_delay כדי לציין את זמן ההשהיה המקסימלי ב-batcher להמתין לבקשות אחרות להצטרף לאצווה בהתבסס על דרישות האחזור שלך. התפוקה תלויה גם במספר עותקי הדגם ובקבוצות התהליך של Python שהושקו במיכל. כפי שמוצג בתרשים הבא, כשהדרגה המקבילה טנזור מוגדרת ל-4, מיכל ה-LMI משיק שלוש קבוצות תהליך של Python, כל אחת מחזיקה את העותק המלא של המודל. זה מאפשר לך להגדיל את גודל האצווה ולקבל תפוקה גבוהה יותר.

מחברת SageMaker לפריסת LLMs

בחלק זה, אנו מספקים הדרכה שלב אחר שלב לפריסת GPT4All-J, דגם של 6 מיליארד פרמטרים שהוא 24 GB ב-FP32. GPT4All-J הוא צ'אט בוט פופולרי שעבר הכשרה על מגוון עצום של תוכן אינטראקציה כמו בעיות מילים, דיאלוגים, קוד, שירים, שירים וסיפורים. GPT4all-J הוא מודל GPT-J מכוון עדין שיוצר תגובות הדומות לאינטראקציות אנושיות.

המחברת המלאה עבור דוגמה זו מסופקת ב- GitHub. אנחנו יכולים להשתמש ב- SageMaker Python SDK כדי לפרוס את המודל למופע Inf2. אנו משתמשים במסופקים מטפל ברירת מחדל כדי לטעון את הדגם. עם זה, אנחנו רק צריכים לספק א servings.properties קוֹבֶץ. לקובץ זה יש את התצורות הנדרשות עבור שרת דגם ה-DJL כדי להוריד ולארח את הדגם. אנו יכולים לציין את השם של דגם ה-Huging Face באמצעות model_id פרמטר להורדת הדגם ישירות מהריפו של Hugging Face. לחלופין, אתה יכול להוריד את הדגם מאמזון S3 על ידי אספקת s3url פָּרָמֶטֶר. ה entryPoint הפרמטר מוגדר להצביע על הספרייה כדי לטעון את המודל. לפרטים נוספים על djl_python.fastertransformer, ראה קוד GitHub.

השמיים tensor_parallel_degree ערך המאפיין קובע את ההתפלגות של מודולים מקבילים טנזור על פני התקנים מרובים. לדוגמה, עם 12 NeuronCores ודרגת טנזור מקבילה של 4, LMI תקצה שלושה עותקי מודל, שכל אחד מהם ישתמש בארבעה NeuronCores. אתה יכול גם להגדיר את סוג הדיוק באמצעות המאפיין dtype. n_position פרמטר מגדיר את הסכום של אורך רצף קלט ופלט מקסימלי עבור המודל. ראה את הקוד הבא:

בנה את tarball מכיל serving.properties ולהעלות אותו לדלי S3. למרות שמשתמש ברירת המחדל משמש בדוגמה זו, אתה יכול לפתח א model.py קובץ להתאמה אישית של תהליך הטעינה וההגשה. אם יש חבילות שצריכות התקנה, כלול אותן ב- requirements.txt קוֹבֶץ. ראה את הקוד הבא:

אחזר את תמונת מיכל DJL וצור את מודל SageMaker:

לאחר מכן, אנו יוצרים את נקודת הקצה של SageMaker עם תצורת המודל שהוגדרה קודם לכן. המיכל מוריד את הדגם לתוך /tmp שטח כי SageMaker ממפה את /tmp ל חנות בלוקים אלסטית של אמזון (אמזון EBS). אנחנו צריכים להוסיף א volume_size פרמטר כדי להבטיח את /tmp בספרייה יש מספיק מקום להורדה והידור של המודל. קבענו container_startup_health_check_timeout עד 3,600 שניות כדי להבטיח שבדיקת התקינות מתחילה לאחר שהדגם מוכן. אנו משתמשים במופע ml.inf2.8xlarge. ראה את הקוד הבא:

לאחר יצירת נקודת הקצה של SageMaker, נוכל לבצע תחזיות בזמן אמת כנגד נקודות הקצה של SageMaker באמצעות Predictor אובייקט:

לנקות את

מחק את נקודות הקצה כדי לחסוך בעלויות לאחר שתסיים את הבדיקות שלך:

סיכום

בפוסט זה, הצגנו את היכולת שהושקה לאחרונה של SageMaker, אשר תומכת כעת במופעי ml.inf2 ו-ml.trn1 לאירוח דגמי AI גנרטיביים. הדגמנו כיצד לפרוס את GPT4ALL-J, מודל AI מחולל, ב-AWS Inferentia2 באמצעות SageMaker והמיכל LMI, מבלי לכתוב שום קוד. הצגנו גם איך אתה יכול להשתמש ב- DJLServing ו transformers-neuronx לטעון דגם, לחלק אותו ולהגיש.

מופעי Inf2 מספקים את הדרך החסכונית ביותר להפעיל דגמי AI גנרטיביים ב-AWS. לפרטי ביצועים, עיין ב Inf2 ביצועים.

בדוק GitHub ריפו למחברת לדוגמה. נסה את זה ודווח לנו אם יש לך שאלות כלשהן!

על הכותבים

Vivek Gangasani הוא ארכיטקט בכיר של פתרונות למידת מכונה בשירותי האינטרנט של אמזון. הוא עובד עם סטארט-אפים של Machine Learning כדי לבנות ולפרוס יישומי AI/ML ב-AWS. כיום הוא מתמקד באספקת פתרונות עבור MLOps, ML Inference ו-ML בקוד נמוך. הוא עבד על פרויקטים בתחומים שונים, כולל עיבוד שפה טבעית וראייה ממוחשבת.

Vivek Gangasani הוא ארכיטקט בכיר של פתרונות למידת מכונה בשירותי האינטרנט של אמזון. הוא עובד עם סטארט-אפים של Machine Learning כדי לבנות ולפרוס יישומי AI/ML ב-AWS. כיום הוא מתמקד באספקת פתרונות עבור MLOps, ML Inference ו-ML בקוד נמוך. הוא עבד על פרויקטים בתחומים שונים, כולל עיבוד שפה טבעית וראייה ממוחשבת.

הירושי טוקויו הוא אדריכל פתרונות במעבדות AWS Annapurna. מבוסס ביפן, הוא הצטרף ל- Annapurna Labs עוד לפני הרכישה על-ידי AWS ועזר באופן עקבי ללקוחות עם הטכנולוגיה של Annapurna Labs. ההתמקדות האחרונה שלו היא בפתרונות Machine Learning המבוססים על סיליקון ייעודי, AWS Inferentia ו-Trainium.

הירושי טוקויו הוא אדריכל פתרונות במעבדות AWS Annapurna. מבוסס ביפן, הוא הצטרף ל- Annapurna Labs עוד לפני הרכישה על-ידי AWS ועזר באופן עקבי ללקוחות עם הטכנולוגיה של Annapurna Labs. ההתמקדות האחרונה שלו היא בפתרונות Machine Learning המבוססים על סיליקון ייעודי, AWS Inferentia ו-Trainium.

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

צ'ינג לאן הוא מהנדס פיתוח תוכנה ב-AWS. הוא עבד על כמה מוצרים מאתגרים באמזון, כולל פתרונות ML ביצועים גבוהים ומערכת רישום ביצועים גבוהים. הצוות של צ'ינג השיק בהצלחה את המודל הראשון של מיליארד פרמטרים בפרסום באמזון עם זמן אחזור נמוך מאוד. לצ'ינג יש ידע מעמיק באופטימיזציית התשתית והאצת הלמידה העמוקה.

צ'ינג לאן הוא מהנדס פיתוח תוכנה ב-AWS. הוא עבד על כמה מוצרים מאתגרים באמזון, כולל פתרונות ML ביצועים גבוהים ומערכת רישום ביצועים גבוהים. הצוות של צ'ינג השיק בהצלחה את המודל הראשון של מיליארד פרמטרים בפרסום באמזון עם זמן אחזור נמוך מאוד. לצ'ינג יש ידע מעמיק באופטימיזציית התשתית והאצת הלמידה העמוקה.

צ'ינגווי לי הוא מומחה למידת מכונה בשירותי האינטרנט של אמזון. הוא קיבל את הדוקטורט. במחקר מבצעים לאחר ששבר את חשבון מענקי המחקר של יועצו ולא הצליח להעניק את פרס נובל שהבטיח. נכון לעכשיו הוא מסייע ללקוחות בענף השירותים הפיננסיים וביטוח לבנות פתרונות למידת מכונה ב- AWS. בזמנו הפנוי הוא אוהב לקרוא ולהוריד.

צ'ינגווי לי הוא מומחה למידת מכונה בשירותי האינטרנט של אמזון. הוא קיבל את הדוקטורט. במחקר מבצעים לאחר ששבר את חשבון מענקי המחקר של יועצו ולא הצליח להעניק את פרס נובל שהבטיח. נכון לעכשיו הוא מסייע ללקוחות בענף השירותים הפיננסיים וביטוח לבנות פתרונות למידת מכונה ב- AWS. בזמנו הפנוי הוא אוהב לקרוא ולהוריד.

אלן טאן הוא מנהל מוצר בכיר עם SageMaker המוביל את המאמצים בהסקת דגמים גדולים. הוא נלהב מהיישום של למידת מכונה בתחום האנליטיקס. מחוץ לעבודה, הוא נהנה בחוץ.

אלן טאן הוא מנהל מוצר בכיר עם SageMaker המוביל את המאמצים בהסקת דגמים גדולים. הוא נלהב מהיישום של למידת מכונה בתחום האנליטיקס. מחוץ לעבודה, הוא נהנה בחוץ.

וארון סיאל הוא מהנדס פיתוח תוכנה עם AWS Sagemaker שעובד על תכונות קריטיות מול לקוחות עבור פלטפורמת ML Inference. הוא נלהב לעבוד במרחב המערכות המבוזרות ובינה מלאכותית. בזמנו הפנוי הוא אוהב קריאה וגינון.

וארון סיאל הוא מהנדס פיתוח תוכנה עם AWS Sagemaker שעובד על תכונות קריטיות מול לקוחות עבור פלטפורמת ML Inference. הוא נלהב לעבוד במרחב המערכות המבוזרות ובינה מלאכותית. בזמנו הפנוי הוא אוהב קריאה וגינון.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoAiStream. Web3 Data Intelligence. הידע מוגבר. גישה כאן.

- הטבעת העתיד עם אדריאן אשלי. גישה כאן.

- קנה ומכירה של מניות בחברות PRE-IPO עם PREIPO®. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- אודות

- מאיץ

- מאיצים

- מקבל

- גישה

- חֶשְׁבּוֹן

- להשיג

- רכישה

- לרוחב

- מעשים

- להוסיף

- תוספת

- כתובת

- ניתן להתייחס אליו

- יתרון

- פרסום

- לאחר

- נגד

- AI

- מקרי שימוש

- AI / ML

- תעשיות

- מאפשר

- גם

- למרות

- אמזון בעברית

- אמזון

- אמזון SageMaker

- אמזון שירותי אינטרנט

- an

- ניתוח

- ו

- להכריז

- אחר

- כל

- ממשקי API

- יישומים

- מריחה

- גישה

- ארכיטקטורה

- ARE

- AREA

- מלאכותי

- בינה מלאכותית

- בינה מלאכותית (AI)

- AS

- At

- אודיו

- המכונית

- באופן אוטומטי

- זמין

- AWS

- Afer Inferentia

- כדור

- רוחב פס

- מחסום

- מבוסס

- BE

- כי

- היה

- לפני

- הטבות

- הטוב ביותר

- בֵּין

- גָדוֹל

- גדול

- מיליארדים

- לחסום

- בלוג

- לִפְרוֹחַ

- בקצרה

- חסר פרוטה

- לִבנוֹת

- נבנה

- מובנה

- עסקים

- by

- C + +

- נקרא

- CAN

- מקרים

- אתגר

- chatbot

- לבדוק

- שבבי

- קוד

- סִמוּל

- קבוצתי

- לשלב

- משולב

- מגיע

- תקשורת

- תקשורת

- לעומת

- תואם

- להשלים

- לחלוטין

- מורכב

- מורכבות

- רכיבים

- מַקִיף

- חישוב

- לחשב

- המחשב

- ראייה ממוחשבת

- מחשוב

- תְצוּרָה

- מחובר

- מכולה

- מכולות

- מכיל

- תוכן

- ליבה

- עלות

- עלות תועלת

- עלויות

- לִיצוֹר

- נוצר

- קריטי

- מכריע

- כיום

- לקוח

- לקוחות

- אישית

- נתונים

- מוקדש

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- מוגדר

- מגדיר

- תואר

- עיכוב

- למסור

- אספקה

- מספק

- מופגן

- תלוי

- לפרוס

- פריסה

- פריסה

- פרטים

- איתור

- קובע

- לפתח

- צעצועי התפתחות

- מכשיר

- התקנים

- אחר

- שידור

- ישירות

- מופץ

- מחשוב מבוזר

- מערכות מבוזרות

- הפצה

- עושה

- תחומים

- לא

- להורדה

- הורדות

- נהג

- דינמי

- באופן דינמי

- כל אחד

- מוקדם יותר

- קל יותר

- הקל ביותר

- בקלות

- מזרח

- יעיל

- יעילות

- מַאֲמָצִים

- מאפשר

- סוף

- נקודת קצה

- מהנדס

- מנועים

- מספיק

- לְהַבטִיחַ

- הזנת

- חברות

- כניסה

- שווה

- להעריך

- אֲפִילוּ

- דוגמה

- נרגש

- יקר

- נוסף

- פָּנִים

- מקל

- מול

- נכשל

- מהר יותר

- מאפיין

- תכונות

- שלח

- כספי

- שירות כלכלי

- גימור

- ראשון

- מתאים

- תזרים

- זורם

- להתמקד

- מרוכז

- מתמקד

- הבא

- בעד

- טופס

- פוּרמָט

- ארבע

- מסגרת

- מסגרות

- הונאה

- גילוי הונאה

- החל מ-

- מלא

- לגמרי

- יתר על כן

- מייצר

- דור

- גנרטטיבית

- AI Generative

- לקבל

- Go

- להעניק

- קבוצה

- גדל

- חומרה

- יש

- he

- בְּרִיאוּת

- לעזור

- עזר

- עוזר

- כאן

- גָבוֹהַ

- ביצועים גבוהים

- גבוה יותר

- שֶׁלוֹ

- מחזיק

- מחזיק

- המארח

- אירוח

- שירותי אירוח

- בית

- איך

- איך

- אולם

- HTML

- http

- HTTPS

- טבור

- בן אנוש

- if

- תמונה

- תמונות

- הפעלה

- לייבא

- in

- מעמיק

- לכלול

- כולל

- כולל

- להגדיל

- גדל

- עצמאי

- תעשייה

- תשתית

- חדשנות

- קלט

- תשומות

- התקנה

- למשל

- ביטוח

- משולב

- מוֹדִיעִין

- אינטראקציה

- יחסי גומלין

- מתווך

- אל תוך

- הופעל

- לערב

- IT

- שֶׁלָה

- יפן

- עבודה

- להצטרף

- הצטרף

- jpg

- ג'סון

- רק

- לדעת

- ידע

- מעבדות

- שפה

- גָדוֹל

- מפעלים גדולים

- גדול יותר

- הגדול ביותר

- חֶבִיוֹן

- הושק

- השקות

- מוביל

- לִלמוֹד

- למידה

- אורך

- לתת

- ספריות

- סִפְרִיָה

- כמו

- אוהב

- מוגבל

- רשימה

- LLM

- לִטעוֹן

- טוען

- המון

- רישום

- נמוך

- להוריד

- הנמוך ביותר

- מכונה

- למידת מכונה

- בעיקר

- שומר

- הרוב

- לעשות

- לנהל

- הצליח

- מנהל

- מפות

- מקסימום

- מקסימום

- זכרון

- שיטה

- ML

- MLOps

- מודל

- מודלים

- מודולים

- יותר

- יותר יעיל

- רוב

- מספר

- שם

- טבעי

- עיבוד שפה טבעית

- הכרחי

- צורך

- צרכי

- חדש

- ניו יורק

- הבא

- NLP

- פרס נובל

- מחברה

- עַכשָׁיו

- מספר

- אובייקט

- of

- הַצָעָה

- המיוחדות שלנו

- לעתים קרובות

- אוהיו

- on

- ONE

- רק

- קוד פתוח

- תפעול

- אופטימיזציה

- מטב

- אופטימיזציה

- מייעל

- אפשרות

- אפשרויות

- or

- ארגונים

- אחר

- שלנו

- הַחוּצָה

- בחוץ

- תפוקה

- בחוץ

- שֶׁלוֹ

- חבילות

- פרדיגמה

- מקביל

- פרמטר

- פרמטרים

- לעבור

- מעברי

- לוהט

- ביצועים

- התאמה אישית

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- חיבור

- תוספים

- נקודה

- פופולרי

- הודעה

- כּוֹחַ

- מופעל

- חזק

- תרגול

- דיוק

- התחזיות

- חיזוי

- מועדף

- מנהל

- הפרס

- בעיות

- תהליך

- תהליכים

- תהליך

- המוצר

- מנהל מוצר

- מוצרים

- פּרוֹפִיל

- פרויקטים

- מוּבטָח

- נכסים

- רכוש

- לספק

- ובלבד

- מספק

- מתן

- מטרה

- פיתון

- פיטורך

- טִוּוּחַ

- לְהַגִיעַ

- קריאה

- מוכן

- עולם אמיתי

- זמן אמת

- קיבלו

- לאחרונה

- הכרה

- מכונה

- קָשׁוּר

- לבקש

- בקשות

- נדרש

- דרישה

- דרישות

- מחקר

- חוקרים

- משאבים

- תגובות

- וכתוצאה מכך

- לעלות

- הפעלה

- בעל חכמים

- SageMaker Inference

- אותו

- שמור

- דרוג

- תרחישים

- סקריפטים

- Sdk

- בצורה חלקה

- שניות

- סעיף

- לִרְאוֹת

- לחצני מצוקה לפנסיונרים

- רצף

- לשרת

- שרות

- שירותים

- הגשה

- סט

- הגדרות

- התקנה

- כמה

- משמרת

- צריך

- לְהַצִיג

- הוצג

- הראה

- הופעות

- צד

- באופן משמעותי

- סיליקון

- דומה

- פָּשׁוּט

- יחיד

- שישה

- מידה

- גדל

- So

- תוכנה

- פיתוח תוכנה

- פִּתָרוֹן

- פתרונות

- מֶרחָב

- מומחה

- מיוחד

- נאום

- זיהוי דיבור

- יציב

- לערום

- ערימות

- התחלה

- החל

- התחלות

- חברות סטארט

- אחסון

- סיפורים

- אחסון

- זִרמִי

- סגנון

- בהצלחה

- כזה

- תמיכה

- נתמך

- תומך

- מערכת

- מערכות

- נטילת

- הוראה

- נבחרת

- טכניקות

- טכנולוגיה

- tensorflow

- בדיקות

- מֵאֲשֶׁר

- זֶה

- השמיים

- האזור

- שֶׁלָהֶם

- אותם

- שם.

- אלה

- זֶה

- שְׁלוֹשָׁה

- דרך

- תפוקה

- זמן

- פִּי

- ל

- גַם

- כלים

- מעקב

- מְאוּמָן

- הדרכה

- רוֹבּוֹטרִיקִים

- תור

- שתיים

- סוג

- טיפוסי

- נטען

- us

- להשתמש

- מְשׁוּמָשׁ

- באמצעות

- בְּדֶרֶך כְּלַל

- לנצל

- ניצול

- ערך

- מגוון

- שונים

- Vast

- מאוד

- באמצעות

- וִידֵאוֹ

- וירג'יניה

- חזון

- לחכות

- בהדרכה

- דֶרֶך..

- we

- אינטרנט

- שירותי אינטרנט

- מִשׁקָל

- מה

- מתי

- אשר

- יצטרך

- עם

- בתוך

- לְלֹא

- עדים

- Word

- תיק עבודות

- עבד

- עובד

- עובד

- עוֹלָם

- לכתוב

- כתיבה

- york

- אתה

- זפירנט