ZOO דיגיטלי מספקת שירותי לוקליזציה ומדיה מקצה לקצה כדי להתאים תכני טלוויזיה וסרטים מקוריים לשפות, אזורים ותרבויות שונות. זה מקל על הגלובליזציה עבור יוצרי התוכן הטובים בעולם. מהימנים על ידי השמות הגדולים בבידור, ZOO Digital מספקת שירותי לוקליזציה ומדיה באיכות גבוהה בקנה מידה, כולל דיבוב, כתוביות, סקריפטים ותאימות.

זרימות עבודה טיפוסיות של לוקליזציה דורשות יומן ידני של רמקול, שבו זרם שמע מפולח על סמך זהות הדובר. יש להשלים תהליך שגוזל זמן זה לפני שניתן יהיה לדבב את התוכן לשפה אחרת. עם שיטות ידניות, פרק של 30 דקות יכול לקחת בין 1-3 שעות להתמקם. באמצעות אוטומציה, ZOO Digital שואפת להשיג לוקליזציה תוך פחות מ-30 דקות.

בפוסט זה, אנו דנים בפריסת מודלים של למידת מכונה מדרגית (ML) לתיאום תוכן מדיה באמצעות אמזון SageMaker, עם התמקדות ב WhisperX מודל.

רקע

החזון של ZOO Digital הוא לספק תפנית מהירה יותר של תוכן מקומי. מטרה זו היא צווארי בקבוק בשל האופי האינטנסיבי ידנית של התרגיל בשילוב כוח העבודה הקטן של אנשים מיומנים שיכולים לבצע לוקליזציה של תוכן באופן ידני. ZOO Digital עובדת עם למעלה מ-11,000 פרילנסרים ומיקומם למעלה מ-600 מיליון מילים בשנת 2022 בלבד. עם זאת, ההיצע של אנשים מיומנים עולה על ידי הביקוש הגובר לתוכן, המחייב אוטומציה כדי לסייע בתהליכי עבודה של לוקליזציה.

במטרה להאיץ את הלוקליזציה של זרימות עבודה של תוכן באמצעות למידת מכונה, ZOO Digital פעיל את AWS Prototyping, תוכנית השקעה של AWS לבנייה משותפת של עומסי עבודה עם לקוחות. ההתקשרות התמקדה במתן פתרון פונקציונלי לתהליך הלוקליזציה, תוך מתן הדרכה מעשית למפתחי ZOO Digital ב- SageMaker, אמזון תעתיק, ו אמזון תרגם.

אתגר לקוח

לאחר שכותרת (סרט או פרק מסדרת טלוויזיה) תומלל, יש להקצות רמקולים לכל קטע של דיבור כך שניתן יהיה להקצותם בצורה נכונה לאמני הקול שלוהקים לגלם את הדמויות. תהליך זה נקרא יומן דובר. ZOO Digital עומדת בפני האתגר של יומן תוכן בקנה מידה גדול תוך כדאיות כלכלית.

סקירת פתרונות

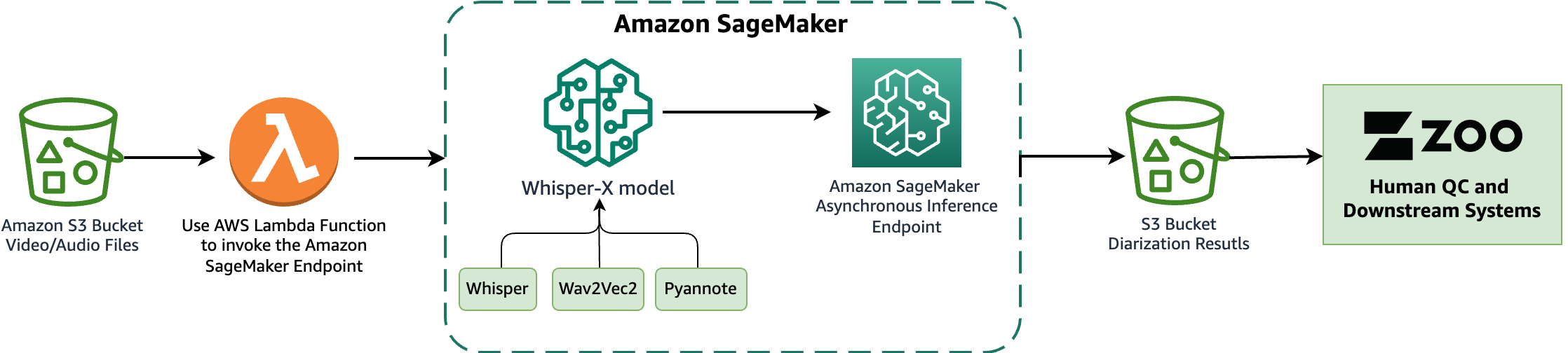

באב טיפוס זה, אחסנו את קבצי המדיה המקוריים בקובץ מוגדר שירות אחסון פשוט של אמזון דלי (Amazon S3). דלי S3 זה הוגדר לפלוט אירוע כאשר קבצים חדשים מזוהים בתוכו, מה שמפעיל AWS למבדה פוּנקצִיָה. להנחיות להגדרת טריגר זה, עיין במדריך שימוש בטריגר של Amazon S3 כדי להפעיל פונקציית Lambda. לאחר מכן, פונקציית Lambda הפעילה את נקודת הקצה של SageMaker להסקת מסקנות באמצעות לקוח Boto3 SageMaker Runtime.

השמיים WhisperX מודל, מבוסס על הלחישה של OpenAI, מבצעת תמלול ותיאום עבור נכסי מדיה. זה בנוי על לחישה מהירה יותר יישום מחדש, המציע עד פי ארבעה תעתיק מהיר יותר עם יישור חותמת זמן משופר ברמת המילה בהשוואה ל-Whisper. בנוסף, הוא מציג יומן רמקול, שאינו קיים בדגם Whisper המקורי. WhisperX משתמש במודל Whisper עבור תעתיקים, ה Wav2Vec2 מודל לשיפור יישור חותמת הזמן (הבטחת סנכרון של טקסט מתומלל עם חותמות זמן של שמע), וה הערה פירוט מודל ליומן. FFmpeg משמש לטעינת אודיו ממדיה מקור, התומך במגוון פורמטי מדיה. ארכיטקטורת המודל השקופה והמודולרית מאפשרת גמישות, מכיוון שניתן להחליף כל רכיב בדגם לפי הצורך בעתיד. עם זאת, חשוב לציין כי WhisperX חסר תכונות ניהול מלאות ואינו מוצר ברמת הארגון. ללא תחזוקה ותמיכה, ייתכן שהוא לא יתאים לפריסת ייצור.

בשיתוף פעולה זה, פרסנו והערכנו את WhisperX ב- SageMaker, באמצעות א נקודת קצה של הסקה אסינכרונית לארח את הדגם. נקודות קצה אסינכרוניות של SageMaker תומכות בגדלים של העלאה של עד 1 GB ומשלבות תכונות קנה מידה אוטומטי המפחיתות ביעילות את עליות התעבורה וחוסכות עלויות בזמני שיא. נקודות קצה אסינכרוניות מתאימות במיוחד לעיבוד קבצים גדולים, כגון סרטים וסדרות טלוויזיה במקרה השימוש שלנו.

התרשים הבא ממחיש את מרכיבי הליבה של הניסויים שערכנו בשיתוף פעולה זה.

בסעיפים הבאים, אנו מתעמקים בפרטים של פריסת מודל WhisperX ב- SageMaker, ומעריכים את ביצועי היומן.

הורד את הדגם ומרכיביו

WhisperX היא מערכת הכוללת מספר מודלים לתמלול, יישור מאולץ ותיאום. לתפעול חלק של SageMaker ללא צורך להביא חפצי מודל במהלך הסקת מסקנות, חיוני להוריד מראש את כל חפצי הדגם. החפצים הללו נטענים לאחר מכן לתוך מיכל ההגשה של SageMaker במהלך ההפעלה. מכיוון שדגמים אלה אינם נגישים ישירות, אנו מציעים תיאורים וקוד לדוגמה ממקור WhisperX, ומספקים הוראות להורדת הדגם ורכיביו.

WhisperX משתמש בשישה דגמים:

את רוב הדגמים הללו ניתן להשיג פנים מחבקות באמצעות ספריית huggingface_hub. אנו משתמשים בדברים הבאים download_hf_model() פונקציה לאחזר חפצי מודל אלה. נדרש אסימון גישה מ-Huging Face, שנוצר לאחר קבלת הסכמי המשתמש עבור דגמי הפיאנוט הבאים:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

דגם ה-VAD נלקח מאמזון S3, ודגם ה-Wav2Vec2 מאוחזר מהמודול torchaudio.pipelines. בהתבסס על הקוד הבא, נוכל לאחזר את כל החפצים של הדגמים, כולל אלה מ-Huging Face, ולשמור אותם בספריית הדגמים המקומית שצוינה:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

בחר את מיכל AWS Deep Learning המתאים להגשת המודל

לאחר שמירת חפצי הדגם באמצעות קוד הדוגמה הקודם, תוכל לבחור בנוי מראש מיכלי למידה עמוקה של AWS (DLCs) מהבאים GitHub ריפו. בעת בחירת תמונת Docker, שקול את ההגדרות הבאות: מסגרת (חיבוק פנים), משימה (מסק), גרסת Python וחומרה (לדוגמה, GPU). אנו ממליצים להשתמש בתמונה הבאה: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 בתמונה זו מותקנות מראש כל חבילות המערכת הדרושות, כגון ffmpeg. זכור להחליף את [REGION] באזור ה-AWS שבו אתה משתמש.

עבור חבילות Python נדרשות אחרות, צור א requirements.txt קובץ עם רשימה של חבילות וגרסאותיהן. חבילות אלו יותקנו כאשר ה-AWS DLC יבנה. להלן החבילות הנוספות הדרושות לאירוח דגם WhisperX ב- SageMaker:

צור סקריפט מסקנות כדי לטעון את המודלים ולהפעיל מסקנות

לאחר מכן, אנו יוצרים התאמה אישית inference.py סקריפט כדי לתאר כיצד מודל WhisperX ומרכיביו נטענים לתוך המיכל וכיצד יש להפעיל את תהליך ההסקה. הסקריפט מכיל שתי פונקציות: model_fn ו transform_fn. ה model_fn הפונקציה מופעלת כדי לטעון את הדגמים מהמיקומים המתאימים. לאחר מכן, מודלים אלה מועברים ל- transform_fn תפקוד במהלך היסק, שבו מתבצעים תהליכי שעתוק, יישור ותיאום. להלן דגימת קוד עבור inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

בתוך ספריית הדגם, לצד ה requirements.txt קובץ, להבטיח את נוכחותו של inference.py בספריית משנה של קוד. ה models הספרייה צריכה להיות דומה לדברים הבאים:

צור טרבול של הדגמים

לאחר שתיצור את המודלים וספריות הקוד, תוכל להשתמש בשורות הפקודה הבאות כדי לדחוס את המודל ל-tarball (קובץ.tar.gz) ולהעלות אותו לאמזון S3. בזמן כתיבת שורות אלה, באמצעות דגם Large V2 הלוחש המהיר יותר, ה-tarball המתקבל המייצג את דגם SageMaker הוא בגודל 3 GB. למידע נוסף, עיין ב דפוסי אירוח דגמים באמזון SageMaker, חלק 2: תחילת העבודה עם פריסת מודלים בזמן אמת ב- SageMaker.

צור מודל של SageMaker ופרוס נקודת קצה עם מנבא אסינכרוני

עכשיו אתה יכול ליצור את מודל SageMaker, תצורת נקודת קצה ונקודת קצה אסינכרונית עם AsyncPredictor באמצעות הדגם Tarball שנוצר בשלב הקודם. להנחיות, עיין ב צור נקודת קצה אסינכרונית של הסקה.

הערכת ביצועי יומן

כדי להעריך את ביצועי היומן של מודל WhisperX בתרחישים שונים, בחרנו שלושה פרקים כל אחד משני כותרים באנגלית: כותר דרמה אחד המורכב מפרקים של 30 דקות, וכותרת דוקומנטרית אחת המורכבת מפרקים של 45 דקות. השתמשנו בערכת הכלים של המדדים של פיאנוט, pyannote.metrics, כדי לחשב את שיעור שגיאות יומן (DER). בהערכה, תמלילים מתומללים ויומנים שסופקו על ידי ZOO שימשו כאמת היסוד.

הגדרנו את ה-DER באופן הבא:

סה"כ הוא אורך סרטון האמת הקרקע. FA (אזעקת שווא) הוא אורך הקטעים הנחשבים לדיבור בתחזיות, אך לא באמיתות הקרקע. עלמה הוא אורך הקטעים הנחשבים כדיבור באמיתות הקרקע, אך לא בחיזוי. שְׁגִיאָה, המכונה גם בִּלבּוּל, הוא אורך הקטעים המוקצים לדוברים שונים בחיזוי ובאמת הקרקע. כל היחידות נמדדות בשניות. הערכים האופייניים ל-DER יכולים להשתנות בהתאם ליישום הספציפי, מערך הנתונים והאיכות של מערכת היומן. שים לב ש-DER יכול להיות גדול מ-1.0. DER נמוך יותר עדיף.

כדי להיות מסוגל לחשב את ה-DER עבור פיסת מדיה, נדרש יומן אמת קרקע, כמו גם הפלטים המתומללים והמיומנים של WhisperX. יש לנתח את אלה ולהביא לרשימות של טאפלים המכילות תווית דובר, שעת התחלה של קטע דיבור ושעת סיום קטע דיבור עבור כל קטע של דיבור במדיה. תוויות הרמקולים אינן צריכות להתאים בין יומני ה-WhisperX לבין יומני האמת. התוצאות מבוססות בעיקר על זמן הקטעים. pyannote.metrics לוקח את הטפולים האלה של יומני אמת קרקע ויומי פלט (המכונה בתיעוד pyannote.metrics כ הפניה ו השערה) כדי לחשב את ה-DER. הטבלה הבאה מסכמת את התוצאות שלנו.

| סוג וידאו | DER | נכון | עלמה | שְׁגִיאָה | אזעקת שווא |

| דרמה | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| תעודה | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| מְמוּצָע | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

תוצאות אלו חושפות הבדל משמעותי בביצועים בין כותרות הדרמה לתיעוד, כאשר המודל משיג תוצאות טובות במיוחד (באמצעות DER כמדד מצטבר) עבור פרקי הדרמה בהשוואה לכותר התיעודי. ניתוח מדוקדק יותר של הכותרות מספק תובנות לגבי גורמים פוטנציאליים התורמים לפער ביצועים זה. גורם מפתח אחד יכול להיות הנוכחות התכופה של מוזיקת רקע החופפת לדיבור בכותרת התיעודי. למרות שעיבוד מוקדם של מדיה לשיפור דיוק היומן, כגון הסרת רעשי רקע כדי לבודד דיבור, היה מעבר לתחום של אב טיפוס זה, הוא פותח אפיקים לעבודה עתידית שיכולה לשפר את הביצועים של WhisperX.

סיכום

בפוסט זה, חקרנו את השותפות השיתופית בין AWS ו-ZOO Digital, תוך שימוש בטכניקות למידת מכונה עם SageMaker ומודל WhisperX כדי לשפר את זרימת העבודה ביומן. צוות AWS מילא תפקיד מרכזי בסיוע ל-ZOO ביצירת אב טיפוס, הערכה והבנת הפריסה האפקטיבית של מודלים מותאמים אישית של ML, שתוכננו במיוחד עבור יומן. זה כלל שילוב של קנה מידה אוטומטי לצורך מדרגיות באמצעות SageMaker.

רתימת AI ליומן תוביל לחסכון משמעותי הן בעלויות והן בזמן בעת יצירת תוכן מקומי עבור גן החיות. על ידי סיוע למתמללים ליצור ולזהות רמקולים במהירות ובדייקנות, טכנולוגיה זו נותנת מענה לאופי המסורתי שצורך זמן רב ונוטה לטעויות של המשימה. התהליך הקונבנציונלי כולל לרוב מעברים מרובים בסרטון ושלבי בקרת איכות נוספים כדי למזער שגיאות. האימוץ של AI ליומן מאפשר גישה ממוקדת ויעילה יותר, ובכך להגדיל את הפרודוקטיביות בתוך מסגרת זמן קצרה יותר.

תיארנו את השלבים העיקריים לפריסת מודל WhisperX בנקודת הקצה הא-סינכרונית של SageMaker, ומעודדים אותך לנסות זאת בעצמך באמצעות הקוד שסופק. לתובנות נוספות על השירותים והטכנולוגיה של ZOO Digital, בקר האתר הרשמי של ZOO Digital. לפרטים על פריסת מודל OpenAI Whisper ב- SageMaker ואפשרויות מסקנות שונות, עיין ארח את דגם Whisper ב- Amazon SageMaker: בחינת אפשרויות הסקת מסקנות. אל תהסס לשתף את המחשבות שלך בתגובות.

על הכותבים

יינג הו, דוקטורט, הוא אדריכל אבות טיפוס למידת מכונה ב-AWS. תחומי העניין העיקריים שלה כוללים למידה עמוקה, עם דגש על GenAI, Computer Vision, NLP וחיזוי נתונים של סדרות זמן. בזמנה הפנוי, היא נהנית לבלות רגעי איכות עם משפחתה, לשקוע ברומנים ולטייל בפארקים הלאומיים של בריטניה.

יינג הו, דוקטורט, הוא אדריכל אבות טיפוס למידת מכונה ב-AWS. תחומי העניין העיקריים שלה כוללים למידה עמוקה, עם דגש על GenAI, Computer Vision, NLP וחיזוי נתונים של סדרות זמן. בזמנה הפנוי, היא נהנית לבלות רגעי איכות עם משפחתה, לשקוע ברומנים ולטייל בפארקים הלאומיים של בריטניה.

איתן קמברלנד הוא מהנדס מחקר בינה מלאכותית ב-ZOO Digital, שם הוא עובד על שימוש בבינה מלאכותית ולמידת מכונה כטכנולוגיות מסייעות לשיפור זרימות עבודה בדיבור, שפה ולוקליזציה. יש לו רקע בהנדסת תוכנה ומחקר בתחום האבטחה והשיטור, תוך התמקדות בחילוץ מידע מובנה מהרשת ובמינוף מודלים של ML בקוד פתוח לניתוח והעשרת נתונים שנאספו.

איתן קמברלנד הוא מהנדס מחקר בינה מלאכותית ב-ZOO Digital, שם הוא עובד על שימוש בבינה מלאכותית ולמידת מכונה כטכנולוגיות מסייעות לשיפור זרימות עבודה בדיבור, שפה ולוקליזציה. יש לו רקע בהנדסת תוכנה ומחקר בתחום האבטחה והשיטור, תוך התמקדות בחילוץ מידע מובנה מהרשת ובמינוף מודלים של ML בקוד פתוח לניתוח והעשרת נתונים שנאספו.

גורב קאילה מוביל את צוות AWS Prototyping עבור בריטניה ואירלנד. הצוות שלו עובד עם לקוחות בתעשיות מגוונות כדי לגבש רעיונות ולפתח יחד עומסי עבודה קריטיים לעסקים עם מנדט להאיץ את האימוץ של שירותי AWS.

גורב קאילה מוביל את צוות AWS Prototyping עבור בריטניה ואירלנד. הצוות שלו עובד עם לקוחות בתעשיות מגוונות כדי לגבש רעיונות ולפתח יחד עומסי עבודה קריטיים לעסקים עם מנדט להאיץ את האימוץ של שירותי AWS.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- יכול

- להאיץ

- קבלה

- גישה

- נגיש

- דיוק

- להשיג

- השגתי

- לרוחב

- להסתגל

- נוסף

- בנוסף

- כתובות

- אימוץ

- לאחר

- לְקַבֵּץ

- הסכמים

- AI

- ai מחקר

- המטרה

- מטרות

- אזעקה

- ליישר

- יישור

- יישור

- תעשיות

- מאפשר

- לבד

- בַּצַד

- גם

- למרות

- אמזון בעברית

- אמזון SageMaker

- אמזון שירותי אינטרנט

- an

- מנתח

- אנליזה

- ו

- אחר

- בקשה

- גישה

- מתאים

- ארכיטקטורה

- ARE

- אזורים

- אמנים

- AS

- לְהַעֲרִיך

- נכסים

- שהוקצה

- לעזור

- סיוע

- At

- אודיו

- מורשה

- המכונית

- אוטומציה

- שדרות

- AWS

- רקע

- מבוסס

- BE

- כי

- היה

- לפני

- להיות

- הטוב ביותר

- מוטב

- בֵּין

- מעבר

- הגדול ביותר

- BIN

- שניהם

- נבנה

- עסקים

- אבל

- by

- לחשב

- נקרא

- CAN

- מקרה

- לאתגר

- תווים

- בחרו

- קרוב יותר

- קוד

- שיתוף פעולה

- שיתוף פעולה

- הערות

- לעומת

- השלמת

- הענות

- רְכִיב

- רכיבים

- מורכב

- המחשב

- ראייה ממוחשבת

- מנוהל

- מוגדר

- תצורה

- לשקול

- נחשב

- מורכב

- מכולה

- מכיל

- תוכן

- יוצרי תוכן

- תורם

- לִשְׁלוֹט

- מקובל

- ליבה

- צורה נכונה

- עלות

- עלויות

- יכול

- לִיצוֹר

- נוצר

- יוצרים

- יוצרים

- קריטי

- תרבויות

- מנהג

- לקוחות

- נתונים

- עמוק

- למידה עמוקה

- מוגדר

- אספקה

- מספק

- להתעמק

- דרישה

- תלוי

- לפרוס

- פרס

- פריסה

- פריסה

- מעוצב

- פרטים

- זוהה

- מפתחים

- מכשיר

- תרשים

- DICT

- הבדל

- אחר

- דיגיטלי

- ספרות

- ישירות

- ספריות

- בספרייה

- לדון

- שונה

- סַוָר

- תעודה

- תיעוד

- תחום

- לא

- להורדה

- הורדה

- דרמה

- דיבוב

- בְּמַהֲלָך

- כל אחד

- קל יותר

- אפקטיבי

- יעיל

- יעילות

- אלמנטים

- אחר

- הטבעה

- העסקת

- מאפשר

- להקיף

- לעודד

- סוף

- מקצה לקצה

- נקודת קצה

- מאורס

- התעסקות

- מהנדס

- הנדסה

- אנגלית

- להגביר את

- מעשיר

- לְהַבטִיחַ

- הבטחתי

- ברמה הארגונית

- בידור

- אפיזודה

- שגיאה

- שגיאות

- חיוני

- להעריך

- העריך

- הערכה

- הערכה

- אירוע

- כל

- דוגמה

- תרגיל

- ניסויים

- חקר

- היכרות

- פָּנִים

- פנים

- גורם

- גורמים

- שקר

- משפחה

- מהר יותר

- תכונות

- להרגיש

- הושג

- שלח

- קבצים

- גמישות

- להתמקד

- מרוכז

- התמקדות

- הבא

- כדלקמן

- בעד

- מאולץ

- ארבע

- מסגרת

- חופשי

- תכוף

- החל מ-

- מלא

- פונקציה

- פונקציונלי

- פונקציות

- נוסף

- עתיד

- פער

- גנאי

- נוצר

- יצירת

- מקבל

- GitHub

- הגלובליזציה

- מטרה

- GPU

- קרקע

- ידות על

- חומרה

- he

- לה

- באיכות גבוהה

- שֶׁלוֹ

- המארח

- אירוח

- שעות

- איך

- אולם

- HTML

- http

- HTTPS

- חיבוק פנים

- זיהוי

- זהות

- if

- מדגים

- תמונה

- לייבא

- לשפר

- משופר

- in

- כלול

- כולל

- כולל

- בע"מ

- שילוב

- גדל

- תעשיות

- מידע

- ייזום

- תובנות

- מותקן

- הוראות

- אינטרס

- אל תוך

- מציג

- השקעה

- הופעל

- כרוך

- אירלנד

- IT

- שֶׁלָה

- jpg

- ג'סון

- מפתח

- גורם מפתח

- תווית

- תוויות

- שפה

- שפות

- גָדוֹל

- גדול יותר

- עוֹפֶרֶת

- מוביל

- למידה

- אורך

- מינוף

- סִפְרִיָה

- קווים

- רשימה

- רשימות

- לִטעוֹן

- טוען

- מקומי

- לוקליזציה

- באופן מקומי

- מקומות

- היכנס

- רישום

- ארוך

- להוריד

- מכונה

- למידת מכונה

- תחזוקה

- עושה

- ניהול

- מנדט

- מדריך ל

- באופן ידני

- להתאים

- מאי..

- מדיה

- מידע נוסף

- שיטות

- מטרי

- מדדים

- מִילִיוֹן

- לצמצם

- דקות

- להקל

- ML

- מודל

- מודלים

- מודולרי

- מודול

- רגעים

- יותר

- בעיקר

- סרט

- סרטים

- מספר

- כלי נגינה

- צריך

- שם

- שמות

- לאומי

- טבע

- הכרחי

- צורך

- נחוץ

- חדש

- NLP

- רעש

- בייחוד

- הערות

- מושג

- of

- הַצָעָה

- הצעה

- רשמי

- לעתים קרובות

- on

- ONE

- קוד פתוח

- OpenAI

- נפתח

- מבצע

- אפשרויות

- or

- מְקוֹרִי

- OS

- אחר

- שלנו

- הַחוּצָה

- מתווה

- המתואר

- תפוקה

- פלטים

- יותר

- חבילות

- חלק

- במיוחד

- שותפות

- עבר

- מעברי

- נתיב

- שבילים

- דפוסי

- אֲנָשִׁים

- לְבַצֵעַ

- ביצועים

- ביצעתי

- מבצע

- לְחַבֵּר

- צינור

- מכריע

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- לְשַׂחֵק

- שיחק

- שיטור

- הודעה

- פוטנציאל

- פוטנציאל

- קודם

- בדיוק

- נבואה

- התחזיות

- נוכחות

- להציג

- קודם

- יְסוֹדִי

- תהליך

- תהליכים

- תהליך

- המוצר

- הפקה

- פִּריוֹן

- תָכְנִית

- אב טיפוס

- prototyping

- לספק

- ובלבד

- מספק

- מתן

- פיתון

- איכות

- R

- ציון

- חומר עיוני

- ממשי

- זמן אמת

- להמליץ

- להתייחס

- מכונה

- באזור

- אזורים

- לזכור

- הסרת

- להחליף

- המייצג

- לבקש

- לדרוש

- נדרש

- דרישות

- מחקר

- אלה

- תוצאה

- וכתוצאה מכך

- תוצאות

- לַחֲזוֹר

- החזרות

- לגלות

- תפקיד

- הפעלה

- ריצה

- זמן ריצה

- s

- בעל חכמים

- לִטעוֹם

- שמור

- הציל

- חיסכון

- בקרת מערכות ותקשורת

- להרחבה

- סולם

- דרוג

- תרחישים

- היקף

- תסריט

- שניות

- סעיפים

- אבטחה

- קטע

- פילוח

- מגזרים

- נבחר

- בחירה

- סדרה

- שירת

- שירותים

- הגשה

- הגדרות

- שיתוף

- היא

- צריך

- משמעותי

- פָּשׁוּט

- שישה

- מידה

- גדל

- מיומן

- קטן

- להחליק

- So

- תוכנה

- הנדסת תוכנה

- פִּתָרוֹן

- מָקוֹר

- רַמקוֹל

- רמקולים

- ספציפי

- במיוחד

- מפורט

- נאום

- הוצאה

- קוצים

- התחלה

- החל

- שלב

- צעדים

- אחסון

- מאוחסן

- סיפור

- זרם

- לייעל

- מובנה

- כתוצאה מכך

- ניכר

- כזה

- מַתְאִים

- לספק

- תמיכה

- מסייע

- החלף

- במהירות

- סִנכְּרוּן

- מערכת

- שולחן

- לקחת

- לוקח

- ממוקד

- המשימות

- נבחרת

- טכניקות

- טכנולוגיות

- טכנולוגיה

- זמני

- טֶקסט

- מֵאֲשֶׁר

- זֶה

- השמיים

- העתיד

- בריטניה

- שֶׁלָהֶם

- אותם

- אז

- בכך

- אלה

- הֵם

- זֶה

- אלה

- שְׁלוֹשָׁה

- דרך

- זמן

- סדרת זמן

- דורש זמן רב

- מסגרת זמן

- פִּי

- חותם

- תזמונים

- כותרת

- כותרות

- ל

- אסימון

- לקח

- ארגז כלים

- לפיד

- באופן מסורתי

- תְנוּעָה

- הדרכה

- שָׁקוּף

- להפעיל

- מפעילה

- מהימן

- אמת

- לנסות

- הדרכה

- tv

- שתיים

- טיפוסי

- Uk

- תחת

- במהלך 30

- הבנה

- יחידות

- עדכון

- על

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמש

- שימושים

- באמצעות

- מנוצל

- מנצל

- ערכים

- שונים

- לְהִשְׁתַנוֹת

- גרסה

- גירסאות

- בַּר חַיִים

- וִידֵאוֹ

- חזון

- לְבַקֵר

- קול

- W

- היה

- we

- אינטרנט

- שירותי אינטרנט

- טוֹב

- מתי

- בזמן

- Whisper

- יצטרך

- עם

- בתוך

- לְלֹא

- מילים

- תיק עבודות

- זרימת עבודה

- זרימות עבודה

- כוח עבודה

- עובד

- של העולם

- כתיבה

- יאמל

- אתה

- עצמך

- זפירנט

- גן חיות