כיום, עשרות אלפי לקוחות בונים, מאמנים ופרסים מודלים של למידת מכונה (ML) באמצעות אמזון SageMaker להפעיל יישומים שיש להם פוטנציאל להמציא מחדש את העסקים ואת חוויות הלקוחות שלהם. דגמי ML אלה גדלו בגודל ובמורכבות במהלך השנים האחרונות, מה שהוביל לדיוקים מתקדמים במגוון משימות וגם לדחוף את זמן האימון מימים לשבועות. כתוצאה מכך, הלקוחות חייבים להתאים את הדגמים שלהם על פני מאות עד אלפי מאיצים, מה שהופך אותם ליקרים יותר לאימון.

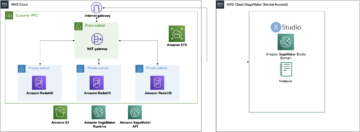

SageMaker הוא שירות ML מנוהל במלואו המסייע למפתחים ומדעני נתונים לבנות, לאמן ולפרוס בקלות מודלים של ML. SageMaker כבר מספקת את הבחירה הרחבה והעמוקה ביותר של היצע מחשוב הכולל מאיצי חומרה לאימון ML, כולל G5 (Nvidia A10G) מקרים ו P4d (Nvidia A100) מקרים.

דרישות המחשוב הגדלות דורשות כוח עיבוד מהיר וחסכוני יותר. כדי לצמצם עוד יותר את זמני ההכשרה של המודל ולאפשר למתרגלי ML לבצע פעולות חוזרות מהר יותר, AWS חידשה בין שבבים, שרתים וקישוריות למרכזי נתונים. המופעים החדשים של Trn1 מופעלים על ידי AWS Trainium שבבים מציעים את ביצועי המחיר הטובים ביותר ואת ההכשרה המהירה ביותר של מודל ML ב-AWS, ומספקים עד 50% עלות נמוכה יותר לאימון מודלים של למידה עמוקה על פני מופעים מבוססי GPU דומים ללא כל ירידה ברמת הדיוק.

בפוסט זה, אנו מראים כיצד תוכל למקסם את הביצועים שלך ולהפחית עלויות באמצעות מופעי Trn1 עם SageMaker.

סקירת פתרונות

משרות הדרכה של SageMaker תומכות במופעי ml.trn1, המופעלים על ידי שבבי Trainium, שנבנו ייעודיים עבור יישומי אימון ML בעלי ביצועים גבוהים בענן. אתה יכול להשתמש במופעי ml.trn1 ב- SageMaker כדי לאמן עיבוד שפה טבעית (NLP), ראייה ממוחשבת ומודלים ממליצים על פני מערך רחב של יישומים, כגון זיהוי דיבור, המלצה, זיהוי הונאה, סיווג תמונות ווידאו וחיזוי. מופעי ml.trn1 כוללים עד 16 שבבי Trainium, שהוא שבב ML דור שני שנבנה על ידי AWS לאחר Afer Inferentia. מופעי ml.trn1 הם הראשונים ענן מחשוב אלסטי של אמזון (Amazon EC2) מופעים עם רוחב פס של עד 800 Gbps של מתאם בד אלסטי (EFA). לצורך מקביליות יעילה לנתונים ולמודלים, לכל מופע ml.trn1.32xl יש 512 GB של זיכרון ברוחב פס גבוה, מספק עד 3.4 petaflops של כוח מחשוב FP16/BF16, וכולל NeuronLink, חיבור בין מופעי, ברוחב פס גבוה, לא חוסם .

Trainium זמין בשתי תצורות וניתן להשתמש בו באזורי ארה"ב מזרח (נ' וירג'יניה) ומערב ארה"ב (אורגון).

הטבלה הבאה מסכמת את התכונות של מופעי Trn1.

| גודל מופע | טרייניום מאיצים |

מאיץ זכרון (GB) |

מעבדי vCPU | מופע זכרון (GiB) |

רשת רוחב פס (Gbps) |

EFA ו RDMA תמיכה |

| trn1.2xlarge | 1 | 32 | 8 | 32 | עד 12.5 | לא |

| trn1.32xlarge | 16 | 512 | 128 | 512 | 800 | יש |

| trn1n.32xlarge (בקרוב) | 16 | 512 | 128 | 512 | 1600 | יש |

בואו נבין כיצד להשתמש ב-Trainium עם SageMaker עם דוגמה פשוטה. נאמן מודל סיווג טקסט עם אימון SageMaker ו-PyTorch באמצעות ספריית ה-Huging Face Transformers.

אנו משתמשים במערך הנתונים של Amazon Reviews, המורכב מסקירות מ-amazon.com. הנתונים משתרעים על פני תקופה של 18 שנים, וכוללים כ-35 מיליון ביקורות עד מרץ 2013. הביקורות כוללות מידע על מוצר ומשתמש, דירוגים וסקירת טקסט רגיל. הקוד הבא הוא דוגמה מתוך AmazonPolarity סט מבחן:

עבור פוסט זה, אנו משתמשים רק בשדות התוכן והתווית. שדה התוכן הוא סקירת טקסט חופשי, ושדה התווית הוא ערך בינארי המכיל 1 או 0 עבור ביקורות חיוביות או שליליות, בהתאמה.

עבור האלגוריתם שלנו, אנו משתמשים ב-BERT, מודל שנאי שהוכשר מראש על קורפוס גדול של נתונים באנגלית באופן בפיקוח עצמי. מודל זה נועד בעיקר להתכוונן במשימות המשתמשות בכל המשפט (עלול להסתובב) כדי לקבל החלטות, כגון סיווג רצף, סיווג אסימונים או מענה לשאלות.

פרטי היישום

נתחיל בהסתכלות מקרוב על המרכיבים השונים המעורבים באימון המודל:

- AWS Trainium – בבסיסו, כל אחד דוגמה של טריניום יש בו מכשירי Trainium מובנים. ל-Trn1.2xlarge יש מכשיר Trainium אחד, ול-Trn1xlarge יש 1.32 מכשירי Trainium. כל מכשיר Trainium מורכב ממחשוב (16 NeuronCore-v2), 2 GB של זיכרון מכשיר HBM ו- NeuronLink לתקשורת מהירה בין מכשירים. כל אחד NeuronCore-v2 מורכב מיחידת מחשוב הטרוגנית עצמאית לחלוטין עם מנועים נפרדים (טנזור/וקטור/סקלר/GPSIMD). GPSIMD הם מעבדים למטרות כלליות הניתנות לתכנות באופן מלא שבהם אתה יכול להשתמש כדי ליישם אופרטורים מותאמים אישית ולהפעיל אותם ישירות על מנועי NeuronCore.

- אימון אמזון SageMaker – SageMaker מספק חווית אימון מנוהלת במלואה כדי לאמן בקלות דגמים מבלי לדאוג לתשתית. כאשר אתה משתמש ב- SageMaker Training, הוא מריץ את כל הדרוש לעבודת הדרכה, כגון קוד, קונטיינר ונתונים, בתשתית מחשוב נפרדת מסביבת ה-invocation. זה מאפשר לנו להריץ ניסויים במקביל ולחזור מהר. SageMaker מספקת א פיתון SDK להשיק עבודות הדרכה. הדוגמה בפוסט זה משתמשת ב- SageMaker Python SDK כדי להפעיל את עבודת ההדרכה באמצעות Trainium.

- AWS נוירון - מכיוון של-Trainium NeuronCore יש מנוע מחשוב משלה, אנו זקוקים למנגנון כדי להרכיב את קוד האימון שלנו. ה AWS נוירון המהדר לוקח את הקוד שנכתב ב- Pytorch/XLA וממטב אותו להפעלה על מכשירי Neuron. מהדר Neuron משולב כחלק מ-Deep Learning Container בו נשתמש להכשרת המודל שלנו.

- PyTorch/XLA זה - חבילת פייתון משתמש במהדר הלמידה העמוקה XLA כדי לחבר את מסגרת הלמידה העמוקה של PyTorch ומאיצי ענן כמו Trainium. בניית רשת PyTorch חדשה או המרת רשת קיימת להפעלה במכשירי XLA דורשות רק כמה שורות של קוד ספציפי ל-XLA. אנו נראה למקרה השימוש שלנו אילו שינויים עלינו לבצע.

- אימונים מבוזרים - כדי להפעיל את האימון ביעילות על מספר NeuronCores, אנו זקוקים למנגנון להפצת האימון לתוך NeuronCores זמינים. SageMaker תומך ב-torchrun עם מופעי Trainium, שניתן להשתמש בהם להפעלת תהליכים מרובים השווים למספר NeuronCores באשכול. זה נעשה על ידי העברת פרמטר ההפצה לאומדן SageMaker באופן הבא, שמתחיל אימון מבוזר מקביל של נתונים שבו אותו מודל נטען לתוך NeuronCores שונים המעבדים קבוצות נתונים נפרדות:

נדרשים שינויים בסקריפט כדי לרוץ ב-Trainium

בואו נסתכל על שינויי הקוד הדרושים כדי לאמץ סקריפט PyTorch רגיל מבוסס GPU להפעלה ב-Trainium. ברמה גבוהה, עלינו לבצע את השינויים הבאים:

- החלף התקני GPU בהתקני Pytorch/XLA. מכיוון שאנו משתמשים בחלוקת לפיד, עלינו לאתחל את האימון עם XLA כמכשיר באופן הבא:

- אנו משתמשים בקצה האחורי המבוזר PyTorch/XLA כדי לגשר בין ה-APIs המבוזרים של PyTorch לסמנטיקה של תקשורת XLA.

- אנו משתמשים ב- PyTorch/XLA MpDeviceLoader עבור צינורות קליטת הנתונים. MpDeviceLoader עוזר לשפר את הביצועים על ידי חפיפה של שלושה שלבים: מעקב, קומפילציה וטעינת אצווה נתונים למכשיר. עלינו לעטוף את טוען הנתונים של PyTorch עם MpDeviceDataLoader באופן הבא:

- הפעל את שלב האופטימיזציה באמצעות ה-API שסופק על ידי XLA כפי שמוצג בקוד הבא. זה מגבש את ההדרגות בין הליבות ומנפיק את חישוב הצעדים של התקן XLA.

- מפה ממשקי API של CUDA (אם יש) לממשקי API גנריים של PyTorch.

- החלף את מיטובי האופטימיזציה של CUDA (אם יש) בחלופות PyTorch גנריות.

הדוגמה כולה, המאמנת מודל סיווג טקסט באמצעות SageMaker ו-Trainium, זמינה בהמשך GitHub ריפו. קובץ המחברת כוונון עדין של רובוטריקים לבניית דגמי סיווג באמצעות SageMaker ו-Trainium.ipynb הוא נקודת הכניסה ומכיל הוראות שלב אחר שלב להפעלת האימון.

בדיקות בנצ'מרק

במבחן, הרצנו שתי עבודות הדרכה: אחת ב-ml.trn1.32xlarge ואחת ב-ml.p4d.24xlarge עם אותו גודל אצווה, נתוני אימון ופרמטרים נוספים. במהלך עבודות ההדרכה, מדדנו את זמן החיוב של עבודות ההדרכה של SageMaker, וחישבנו את המחיר-ביצועים על ידי הכפלת הזמן הנדרש להפעלת עבודות הדרכה בשעות במחיר לשעה עבור סוג המופע. בחרנו את התוצאה הטובה ביותר עבור כל סוג מופע מתוך ריצות משימות מרובות.

הטבלה הבאה מסכמת את ממצאי המדד שלנו.

| מספר סימוכין | סוג מופע | מחיר (לצומת * שעה) | תפוקה (איטרציות/שנייה) | דיוק אימות | זמן לחיוב (שנייה) | עלות הדרכה ב$ |

| סיווג בסיס BERT | ml.trn1.32xlarge | 24.725 | 6.64 | 0.984 | 6033 | 41.47 |

| סיווג בסיס BERT | ml.p4d.24xlarge | 37.69 | 5.44 | 0.984 | 6553 | 68.6 |

התוצאות הראו שמופע ה-Trainium עולה פחות ממופע ה-P4d, ומספק תפוקה ודיוק דומים בעת אימון אותו מודל עם אותם נתוני קלט ופרמטרים של אימון. המשמעות היא שמופע ה-Trainium מספק ביצועי מחיר טובים יותר מאשר מופעי P4D מבוססי GPU. עם דוגמה פשוטה כמו זו, אנו יכולים לראות ש-Trainium מציע זמן אימון מהיר יותר ב-22% ובעלות נמוכה יותר של עד 50% בהשוואה למופעי P4d.

פרוס את המודל המאומן

לאחר שנאמן את המודל, נוכל לפרוס אותו לסוגי מופע שונים כגון CPU, GPU או AWS Inferentia. נקודת המפתח שיש לציין היא שהדגם המאומן אינו תלוי בחומרה מיוחדת כדי לפרוס ולהסיק מסקנות. SageMaker מספקת מנגנונים לפריסת מודל מאומן תוך שימוש במנגנוני זמן אמת או אצווה. דוגמה למחברת ב-Repo GitHub מכילה קוד לפריסת המודל המאומן כנקודת קצה בזמן אמת באמצעות מופע ml.c5.xlarge (מבוסס מעבד).

סיכום

בפוסט זה, בדקנו כיצד להשתמש ב-Trainium ו- SageMaker כדי להגדיר ולהכשיר במהירות מודל סיווג שנותן עד 50% חיסכון בעלויות מבלי להתפשר על הדיוק. אתה יכול להשתמש ב-Trainium עבור מגוון רחב של מקרי שימוש הכוללים אימון מקדים או כוונון עדין של דגמים מבוססי שנאי. למידע נוסף על תמיכה בארכיטקטורות מודלים שונות, עיין ב הנחיות התאמה לאדריכלות מודל.

על הכותבים

ארון קומאר לוקנת'ה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, להכשיר ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בלמידה עמוקה במיוחד בתחום ה-NLP ו-CV. מחוץ לעבודה, הוא נהנה לרוץ ולטייל.

ארון קומאר לוקנת'ה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, להכשיר ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בלמידה עמוקה במיוחד בתחום ה-NLP ו-CV. מחוץ לעבודה, הוא נהנה לרוץ ולטייל.

מארק יו הוא מהנדס תוכנה ב-AWS SageMaker. הוא מתמקד בבניית מערכות אימון מבוזרות בקנה מידה גדול, אופטימיזציה של ביצועי האימון ופיתוח חומרות אימון ml בעלות ביצועים גבוהים, כולל SageMaker trainium. למארק יש גם ידע מעמיק באופטימיזציה של תשתית למידת מכונה. בזמנו הפנוי הוא נהנה מטיולים וריצה.

מארק יו הוא מהנדס תוכנה ב-AWS SageMaker. הוא מתמקד בבניית מערכות אימון מבוזרות בקנה מידה גדול, אופטימיזציה של ביצועי האימון ופיתוח חומרות אימון ml בעלות ביצועים גבוהים, כולל SageMaker trainium. למארק יש גם ידע מעמיק באופטימיזציה של תשתית למידת מכונה. בזמנו הפנוי הוא נהנה מטיולים וריצה.

עומרי פוקס הוא מנהל פיתוח תוכנה ב-AWS SageMaker. הוא המנהיג הטכני האחראי על פלטפורמת העבודה לאימון SageMaker, תוך התמקדות באופטימיזציה של ביצועי האימון של SageMaker ושיפור חווית האימון. יש לו תשוקה לטכנולוגיית ML ו-AI מתקדמים. בזמנו הפנוי הוא אוהב רכיבה על אופניים וטיולים.

עומרי פוקס הוא מנהל פיתוח תוכנה ב-AWS SageMaker. הוא המנהיג הטכני האחראי על פלטפורמת העבודה לאימון SageMaker, תוך התמקדות באופטימיזציה של ביצועי האימון של SageMaker ושיפור חווית האימון. יש לו תשוקה לטכנולוגיית ML ו-AI מתקדמים. בזמנו הפנוי הוא אוהב רכיבה על אופניים וטיולים.

גל אושרי הוא מנהל מוצר בכיר בצוות אמזון SageMaker. יש לו ניסיון של 7 שנים בעבודה על כלים, מסגרות ושירותים של Machine Learning.

גל אושרי הוא מנהל מוצר בכיר בצוות אמזון SageMaker. יש לו ניסיון של 7 שנים בעבודה על כלים, מסגרות ושירותים של Machine Learning.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- Platoblockchain. Web3 Metaverse Intelligence. ידע מוגבר. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/maximize-performance-and-reduce-your-deep-learning-training-cost-with-aws-trainium-and-amazon-sagemaker/

- :הוא

- $ למעלה

- 1

- 100

- 7

- 8

- a

- אודות

- מאיצים

- דיוק

- לרוחב

- לְאַמֵץ

- לאחר

- AI

- אַלגוֹרִיתְם

- מאפשר

- כְּבָר

- חלופות

- אמזון בעברית

- אמזון

- אמזון SageMaker

- Amazon.com

- ו

- API

- ממשקי API

- יישומים

- בערך

- ארכיטקטורה

- ARE

- AREA

- AS

- At

- זמין

- AWS

- Afer Inferentia

- קצה אחורי

- רע

- רוחב פס

- בסיס

- BE

- כי

- להתחיל

- להיות

- בנצ 'מרק

- הטוב ביותר

- מוטב

- בֵּין

- מעבר

- גָדוֹל

- שחור

- ספר

- לְגַשֵׁר

- לִבנוֹת

- בִּניָן

- נבנה

- עסקים

- by

- מחושב

- שיחות

- CAN

- מקרה

- מקרים

- CD

- מרכז

- שינויים

- שבב

- שבבי

- בחירה

- מיון

- קרוב יותר

- ענן

- אשכול

- קוד

- COM

- מגיע

- בקרוב

- תקשורת

- השוואה

- מורכבות

- רכיבים

- מתפשר

- חישוב

- לחשב

- המחשב

- ראייה ממוחשבת

- לְחַבֵּר

- קישוריות

- מתאגד

- מכולה

- מכיל

- תוכן

- ליבה

- עלות

- חיסכון עלויות

- עלות תועלת

- עלויות

- מנהג

- לקוח

- לקוחות

- שיא הטכנולוגיה

- נתונים

- מרכז נתונים

- ימים

- החלטות

- עמוק

- למידה עמוקה

- העמוק ביותר

- מספק

- תלוי

- לפרוס

- פריסה

- מִדבָּר

- איתור

- מפתחים

- מתפתח

- צעצועי התפתחות

- מכשיר

- התקנים

- אחר

- ישירות

- לְהָפִיץ

- מופץ

- הכשרה מבוזרת

- הפצה

- ירידה

- בְּמַהֲלָך

- כל אחד

- בקלות

- מזרח

- יעיל

- יעילות

- לאפשר

- מופעל

- נקודת קצה

- מנוע

- מהנדס

- מנועים

- אנגלית

- שלם

- סביבה

- שווה

- במיוחד

- הכל

- דוגמה

- קיימים

- יקר

- ניסיון

- חוויות

- בד

- פָּנִים

- אופנה

- מהר

- מהר יותר

- המהיר ביותר

- מאפיין

- תכונות

- משתתפים

- נְקֵבָה

- מעטים

- שדה

- שדות

- שלח

- ראשון

- מתאים

- מתמקד

- התמקדות

- הבא

- כדלקמן

- בעד

- מסגרת

- מסגרות

- הונאה

- גילוי הונאה

- חופשי

- החל מ-

- לגמרי

- נוסף

- מטרה כללית

- דור

- GitHub

- נותן

- טוב

- GPU

- שיפועים

- גדול

- חומרה

- יש

- יש

- עזרה

- עוזר

- מוּסתָר

- גָבוֹהַ

- ביצועים גבוהים

- שעות

- איך

- איך

- HTML

- http

- HTTPS

- מאות

- i

- תמונה

- ליישם

- לשפר

- שיפור

- in

- מעמיק

- לכלול

- כולל

- גדל

- עצמאי

- מידע

- תשתית

- חדשנות

- קלט

- למשל

- הוראות

- משולב

- לערב

- מעורב

- בעיות

- IT

- שֶׁלָה

- עבודה

- מקומות תעסוקה

- jpg

- מפתח

- לַהֲרוֹג

- ידע

- תווית

- שפה

- גָדוֹל

- בקנה מידה גדול

- אחרון

- לשגר

- מנהיג

- למידה

- הוביל

- רמה

- סִפְרִיָה

- החיים

- כמו

- קווים

- טוען

- נראה

- נראה

- אהבה

- מכונה

- למידת מכונה

- עשוי

- לעשות

- עושה

- הצליח

- מנהל

- צעדה

- סימן

- דבר

- לְהַגדִיל

- אומר

- מנגנון

- זכרון

- נודד

- מִילִיוֹן

- ML

- מודל

- מודלים

- יותר

- מספר

- מכפילים

- טבעי

- עיבוד שפה טבעית

- צורך

- שלילי

- רשת

- חדש

- NLP

- צומת

- מחברה

- מספר

- Nvidia

- of

- הַצָעָה

- הצעות

- המיוחדות שלנו

- זקן

- on

- ONE

- מפעילי

- אופטימיזציה

- מייעל

- מיטוב

- אורגון

- אחר

- בחוץ

- שֶׁלוֹ

- מקביל

- פרמטר

- פרמטרים

- חלק

- חולף

- תשוקה

- ביצועים

- תקופה

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- לְשַׂחֵק

- נקודה

- חיובי

- הודעה

- פוטנציאל

- פוטנציאל

- כּוֹחַ

- מופעל

- מחיר

- בראש ובראשונה

- תהליך

- תהליכים

- תהליך

- כוח עיבוד

- מעבדים

- המוצר

- מנהל מוצר

- הפקה

- מספק

- מתן

- מטרה

- דוחף

- פיתון

- פיטורך

- שאלה

- מהירות

- RAIN

- רכס

- דירוגים

- זמן אמת

- הכרה

- המלצה

- להפחית

- אזורים

- רגיל

- נדרש

- דרישות

- דורש

- אחראי

- תוצאה

- תוצאות

- סקירה

- חוות דעת של לקוחותינו

- הפעלה

- ריצה

- s

- בעל חכמים

- אותו

- חיסכון

- אומר

- סולם

- מדענים

- Sdk

- ה-SEC

- נבחר

- סמנטיקה

- לחצני מצוקה לפנסיונרים

- משפט

- נפרד

- רצף

- שרתים

- שרות

- שירותים

- סט

- לְהַצִיג

- הראה

- דומה

- פָּשׁוּט

- מידה

- תוכנה

- פיתוח תוכנה

- מהנדס תוכנה

- פתרונות

- משתרע

- מיוחד

- מתמחה

- נאום

- זיהוי דיבור

- התחלות

- מדינה-of-the-art

- שלב

- צעדים

- עוד

- כזה

- תמיכה

- תומך

- מערכות

- שולחן

- לוקח

- נטילת

- משימות

- נבחרת

- טכני

- טכנולוגיה

- מבחן

- סיווג טקסט

- זֶה

- השמיים

- האזור

- שֶׁלָהֶם

- אותם

- אלה

- דבר

- אלפים

- שְׁלוֹשָׁה

- תפוקה

- זמן

- פִּי

- כותרת

- ל

- אסימון

- כלים

- לפיד

- מעקב

- רכבת

- מְאוּמָן

- הדרכה

- רכבות

- רוֹבּוֹטרִיקִים

- להפעיל

- סוגים

- להבין

- יחידה

- us

- להשתמש

- במקרה להשתמש

- משתמש

- ערך

- שונים

- וִידֵאוֹ

- וירג'יניה

- חזון

- VOICES

- שבועות

- מערב

- מה

- אשר

- לבן

- מי

- כל

- רָחָב

- טווח רחב

- יצטרך

- עם

- לְלֹא

- תיק עבודות

- עובד

- לעטוף

- כתוב

- שנים

- אתה

- צעיר

- זפירנט