אימוץ הבינה המלאכותית (AI) מואצת בתעשיות ובמקרי שימוש. פריצות דרך מדעיות אחרונות בתחום למידה עמוקה (DL), מודלים של שפות גדולות (LLMs) ובינה מלאכותית גנרטיבית מאפשרת ללקוחות להשתמש בפתרונות מתקדמים מתקדמים עם ביצועים כמעט כמו אנושיים. מודלים מורכבים אלה דורשים לעתים קרובות האצת חומרה מכיוון שהם מאפשרים לא רק אימון מהיר יותר אלא גם הסקה מהירה יותר בעת שימוש ברשתות עצביות עמוקות ביישומים בזמן אמת. המספר הרב של ליבות עיבוד מקביליות של מעבדי גרפי הופך אותם למתאימים היטב למשימות DL אלו.

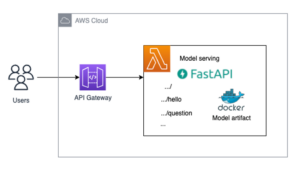

עם זאת, בנוסף להזמנת מודל, יישומי DL אלה כרוכים לעתים קרובות בעיבוד מקדים או לאחר עיבוד בצינור מסקנות. לדוגמה, ייתכן שיהיה צורך לשנות את הגודל או לחתוך תמונות קלט עבור מקרה שימוש בזיהוי אובייקט לפני הגשה למודל ראייה ממוחשבת, או אסימון של קלט טקסט לפני השימוש ב-LLM. NVIDIA טריטון הוא שרת הסקות קוד פתוח המאפשר למשתמשים להגדיר צינורות הסקה כאלה כמכלול של מודלים בצורה של גרף אציקלי מכוון (DAG). הוא נועד להריץ דגמים בקנה מידה ב-CPU וגם ב-GPU. אמזון SageMaker תומך בפריסה חלקה של Triton, מה שמאפשר לך להשתמש בתכונות של Triton ובמקביל ליהנות מהן יכולות SageMaker: סביבה מנוהלת ומאובטחת עם שילוב כלי MLOps, שינוי קנה מידה אוטומטי של מודלים מתארחים ועוד.

AWS, במסירותה לעזור ללקוחות להשיג את החיסכון הגבוה ביותר, חידשה ללא הרף לא רק בתחום אפשרויות תמחור ו אופטימיזציה של שירותים פרואקטיביים, אלא גם בהשקת תכונות חיסכון בעלויות כמו נקודות קצה מרובות-מודלים (MMEs). MMEs הם פתרון חסכוני לפריסת מספר רב של דגמים תוך שימוש באותו צי משאבים ומיכל הגשה משותף לארח את כל הדגמים שלך. במקום להשתמש במספר נקודות קצה של דגם יחיד, אתה יכול להפחית את עלויות האירוח שלך על ידי פריסת דגמים מרובים תוך תשלום רק עבור סביבת מסקנות אחת. בנוסף, MMEs מפחיתים את תקורה של הפריסה מכיוון ש- SageMaker מנהלת טעינת מודלים בזיכרון ומרחיבה אותם על סמך דפוסי התעבורה לנקודת הקצה שלך.

בפוסט זה, אנו מראים כיצד להפעיל מספר דגמי אנסמבל למידה עמוקה על מופע GPU עם SageMaker MME. כדי לעקוב אחר הדוגמה הזו, תוכל למצוא את הקוד בציבור מאגר דוגמאות של SageMaker.

כיצד עובדים MME של SageMaker עם GPU

עם MMEs, מיכל יחיד מארח מספר דגמים. SageMaker שולט במחזור החיים של דגמים המתארחים ב-MME על ידי טעינתם ופריקתם לזיכרון המכולה. במקום להוריד את כל הדגמים למופע של נקודת הקצה, SageMaker טוען באופן דינמי ומאחסן את הדגמים תוך כדי הפעלתם.

כאשר מוגשת בקשת הזמנה לדגם מסוים, SageMaker עושה את הפעולות הבאות:

- תחילה הוא מנתב את הבקשה למופע נקודת הקצה.

- אם הדגם לא נטען, הוא מוריד את חפץ הדגם מ שירות אחסון פשוט של אמזון (Amazon S3) לאותו מופע אמזון אחסון בלוק אלסטי נפח (Amazon EBS).

- הוא טוען את הדגם לזיכרון המיכל במופע המחשוב המואץ של GPU. אם המודל כבר נטען בזיכרון של המכולה, ההפעלה מהירה יותר מכיוון שאין צורך בצעדים נוספים.

כאשר צריך לטעון דגם נוסף, וניצול הזיכרון של המופע גבוה, SageMaker יפרוק דגמים שאינם בשימוש מהמיכל של אותו מופע כדי להבטיח שיש מספיק זיכרון. דגמים אלה שנפרקו יישארו על נפח ה-EBS של המופע, כך שניתן יהיה לטעון אותם לזיכרון המכולה מאוחר יותר, ובכך יסיר את הצורך להוריד אותם שוב מדלי S3. עם זאת, אם נפח האחסון של המופע יגיע לקיבולת שלו, SageMaker תמחק את הדגמים שאינם בשימוש מנפח האחסון. במקרים שבהם ה-MME מקבל בקשות רבות להתקשרות, ומופעים נוספים (או מדיניות קנה מידה אוטומטי) מופעלים, SageMaker מנתב כמה בקשות למופעים אחרים באשכול ההסקה כדי להתאים לתעבורה הגבוהה.

זה לא רק מספק מנגנון חיסכון בעלויות, אלא גם מאפשר לך לפרוס באופן דינמי דגמים חדשים ולהוציא משימוש ישנים. כדי להוסיף דגם חדש, אתה מעלה אותו לדלי S3 שה-MME מוגדר להשתמש בו ולהפעיל אותו. כדי למחוק דגם, הפסק לשלוח בקשות ומחק אותו מה-S3 bucket. הוספת מודלים או מחיקתם מ-MME אינם מצריכים עדכון של נקודת הקצה עצמה!

הרכבי טריטון

אנסמבל המודלים של Triton מייצג צינור המורכב ממודל אחד, לוגיקה קדם-עיבוד ופוסט-עיבוד, וחיבור של טנסורי קלט ופלט ביניהם. בקשת הסקה בודדת לאנסמבל מפעילה את הריצה של כל הצינור כסדרה של שלבים באמצעות מתזמן האנסמבל. המתזמן אוסף את טנסור הפלט בכל שלב ומספק אותם כטנסורי קלט עבור שלבים אחרים בהתאם למפרט. להבהיר: מודל האנסמבל עדיין נתפס כדגם יחיד מנקודת מבט חיצונית.

שרת טריטון ארכיטקטורה כולל מאגר דגמים: מאגר מבוסס מערכת קבצים של המודלים שטריטון יהפוך לזמינים להסקת מסקנות. Triton יכול לגשת לדגמים מנתיב קבצים נגיש מקומי אחד או יותר או ממקומות מרוחקים כמו Amazon S3.

כל דגם במאגר מודלים חייב לכלול תצורת מודל המספקת מידע נדרש ואופציונלי על המודל. בדרך כלל, תצורה זו מסופקת ב-a config.pbtxt הקובץ שצוין כ ModelConfig protobuf. תצורת דגם מינימלית חייבת לציין את הפלטפורמה או הקצה האחורי (כמו PyTorch או TensorFlow), את max_batch_size תכונה, וטנסורי הקלט והפלט של המודל.

טריטון על SageMaker

SageMaker מאפשר פריסת מודל באמצעות שרת Triton עם קוד מותאם אישית. פונקציונליות זו זמינה דרך SageMaker המנוהל Triton Inference Server Containers. מיכלים אלה תומכים במסגרות נפוצות של הישענות מכונה (ML) (כמו TensorFlow, ONNX ו-PyTorch, כמו גם פורמטים של מודלים מותאמים אישית) ומשתני סביבה שימושיים המאפשרים לך לייעל את הביצועים ב- SageMaker. מומלץ להשתמש בתמונות של SageMaker Deep Learning Container (DLC) מכיוון שהן מתוחזקות ומתעדכנות באופן קבוע עם תיקוני אבטחה.

דרך פיתרון

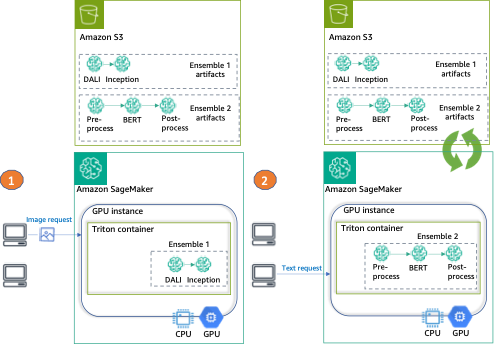

עבור פוסט זה, אנו פורסים שני סוגים שונים של הרכבים על מופע GPU, באמצעות Triton ונקודת קצה אחת של SageMaker.

האנסמבל הראשון מורכב משני דגמים: מודל DALI לעיבוד מקדים של תמונה ודגם TensorFlow Inception v3 להסקת מסקנות בפועל. אנסמבל הצינור לוקח תמונות מקודדות כקלט, אשר יהיה צורך לפענח, לשנות את הגודל לרזולוציה של 299×299 ולנרמל. עיבוד מקדים זה יטופל על ידי מודל DALI. DALI הוא קוד פתוח ספרייה למשימות נפוצות של עיבוד מקדים של תמונה ודיבור כגון פענוח והגדלת נתונים. Inception v3 הוא מודל זיהוי תמונה המורכב מפיתולים סימטריים ואסימטריים, ומאיגום ממוצע ומקסימום שכבות מחוברות במלואן (ולכן מושלם לשימוש ב-GPU).

האנסמבל השני הופך משפטי שפה טבעית גולמית להטבעות ומורכב משלושה דגמים. ראשית, מודל עיבוד מקדים מוחל על אסימון טקסט הקלט (מיושם ב-Python). לאחר מכן אנו משתמשים במכשיר מאומן מראש דגם BERT (לא מארז). מ רכזת דוגמניות פנים מחבקות כדי לחלץ הטבעות אסימונים. BERT הוא מודל בשפה האנגלית שהוכשר באמצעות מטרת מודלים של שפה מסכת (MLM). לבסוף, אנו מיישמים מודל שלאחר עיבוד שבו הטמעות האסימון הגולמי מהשלב הקודם משולבות להטבעות משפטים.

לאחר שאנו מגדירים את Triton להשתמש בהרכבים הללו, אנו מראים כיצד להגדיר ולהפעיל את SageMaker MME.

לבסוף, אנו מספקים דוגמה לכל קריאת אנסמבל, כפי שניתן לראות בתרשים הבא:

- סט 1 – הפעל את נקודת הקצה עם תמונה, תוך ציון DALI-Inception כמכלול היעד

- סט 2 - הפעל את אותה נקודת קצה, הפעם עם קלט טקסט ובקשת אנסמבל preprocess-BERT-postprocess

הגדר את הסביבה

ראשית, הגדרנו את הסביבה הדרושה. זה כולל עדכון ספריות AWS (כמו Boto3 ו SageMaker SDK) והתקנת התלות הנדרשות כדי לארוז את ההרכבים שלנו ולהפעיל מסקנות באמצעות Triton. אנו משתמשים גם בתפקיד ביצוע ברירת המחדל של SageMaker SDK. אנו משתמשים בתפקיד זה כדי לאפשר ל-SageMaker לגשת לאמזון S3 (שם מאוחסנים חפצי הדגם שלנו) ול- רישום מיכלים (מאיפה ישמש תמונת NVIDIA Triton). ראה את הקוד הבא:

הכן הרכבים

בשלב הבא זה, אנו מכינים את שני ההרכבים: TensorFlow (TF) Inception עם DALI preprocessing ו-BERT עם Python preprocessing ופוסט-עיבוד.

זה כרוך בהורדה של הדגמים שהוכשרו מראש, אספקת קובצי התצורה של Triton ואריזת החפצים שיישמרו באמזון S3 לפני הפריסה.

הכן את אנסמבל TF ו-DALI

ראשית, אנו מכינים את הספריות לאחסון הדגמים והתצורות שלנו: עבור TF Inception (inception_graphdef), עבור עיבוד מקדים DALI (dali), ועבור האנסמבל (ensemble_dali_inception). מכיוון ש-Triton תומך בגירסת מודל, אנו מוסיפים גם את גירסת הדגם לנתיב הספרייה (מסומן כ-1 כי יש לנו רק גרסה אחת). למידע נוסף על מדיניות גרסת Triton, עיין ב מדיניות גרסה. לאחר מכן, אנו מורידים את מודל Inception v3, מחלצים אותו ומעתיקים ל- inception_graphdef ספריית דגמים. ראה את הקוד הבא:

כעת, אנו מגדירים את טריטון להשתמש בצינור האנסמבל שלנו. ב config.pbtxt קובץ, אנו מציינים את צורות וסוגי הטנזור הקלט והפלט, ואת הצעדים שמתזמן Triton צריך לנקוט (עיבוד מקדים DALI ומודל Inception לסיווג תמונה):

לאחר מכן, אנו מגדירים כל אחד מהדגמים. ראשית, תצורת הדגם עבור הקצה האחורי של DALI:

לאחר מכן, תצורת הדגם עבור TensorFlow Inception v3 שהורדנו קודם לכן:

מכיוון שזהו מודל סיווג, עלינו גם להעתיק את תוויות מודל Inception ל- inception_graphdef ספרייה במאגר המודלים. תוויות אלה כוללות 1,000 תוויות כיתות מה- אימג'נט מערך נתונים.

לאחר מכן, אנו מגדירים ומסדרים את צינור ה-DALI שיטפל בעיבוד המקדים שלנו לקובץ. העיבוד המקדים כולל קריאת התמונה (באמצעות CPU), פענוח (מואץ באמצעות GPU), ושינוי גודל ונורמליזציה של התמונה.

לבסוף, אנו אורזים את החפצים יחד ומעלים אותם כאובייקט בודד לאמזון S3:

הכן את אנסמבל TensorRT ו- Python

עבור דוגמה זו, אנו משתמשים במודל מאומן מראש מה- ספריית שנאים.

אתה יכול למצוא את כל הדגמים (קדם עיבוד ופוסט תהליכים, יחד עם config.pbtxt קבצים) בתיקייה ensemble_hf. מבנה מערכת הקבצים שלנו יכלול ארבע ספריות (שלוש עבור שלבי הדגם הבודדים ואחת עבור האנסמבל) וכן את הגרסאות שלהן:

ב תיקיית סביבת העבודה, אנו מספקים שני סקריפטים: הראשון להמיר את המודל לפורמט ONNX (onnx_exporter.py) ותסריט הידור TensorRT (gener_model_trt.sh).

Triton תומך באופן טבעי בזמן הריצה של TensorRT, המאפשר לך לפרוס בקלות מנוע TensorRT, ובכך לבצע אופטימיזציה עבור ארכיטקטורת GPU נבחרת.

כדי לוודא שאנו משתמשים בגרסת TensorRT ובתלות התואמות לאלה שבמיכל ה-Triton שלנו, אנו מרכיבים את המודל באמצעות הגרסה המתאימה של תמונת מיכל PyTorch של NVIDIA:

לאחר מכן אנו מעתיקים את חפצי המודל לספרייה שיצרנו קודם לכן ונוסיף גרסה לנתיב:

אנו משתמשים בחבילת Conda כדי ליצור סביבת Conda שבה הקצה האחורי של Triton Python ישתמש בעיבוד מקדים ואחרי עיבוד:

לבסוף, אנו מעלים את חפצי הדגם לאמזון S3:

הפעל אנסמבלים על מופע SageMaker MME GPU

כעת, כאשר חפצי האנסמבל שלנו מאוחסנים באמזון S3, אנו יכולים להגדיר ולהפעיל את SageMaker MME.

אנו מתחילים באחזור ה-URI של תמונת המכולה עבור תמונת Triton DLC שתואם את אחד באזור שלנו רישום container (ומשמש עבור הידור מודל TensorRT):

לאחר מכן, אנו יוצרים את המודל ב- SageMaker. בתוך ה create_model בקשה, אנו מתארים את המיכל לשימוש ואת המיקום של חפצי מודל, ואנחנו מציינים באמצעות ה- Mode פרמטר שמדובר בריבוי מודל.

כדי לארח את ההרכבים שלנו, אנו יוצרים תצורת נקודת קצה עם create_endpoint_config קריאת API, ולאחר מכן צור נקודת קצה עם ה- create_endpoint ממשק API. לאחר מכן, SageMaker פורס את כל הקונטיינרים שהגדרת עבור המודל בסביבת האירוח.

למרות שבדוגמה זו אנו מגדירים מופע יחיד לארח את המודל שלנו, MMEs של SageMaker תומכים באופן מלא בהגדרת מדיניות קנה מידה אוטומטי. למידע נוסף על תכונה זו, ראה הפעל מספר מודלים של למידה עמוקה ב-GPU עם נקודות קצה מרובי דגמים של Amazon SageMaker.

צור עומסי בקשות והפעל את ה-MME עבור כל דגם

לאחר פריסת ה-MME בזמן אמת שלנו, הגיע הזמן להפעיל את נקודת הקצה שלנו עם כל אחד מהרכבי הדגמים שבהם השתמשנו.

ראשית, אנו יוצרים מטען עבור אנסמבל DALI-Inception. אנו משתמשים ב- shiba_inu_dog.jpg תמונה ממערך הנתונים הציבורי של SageMaker של תמונות חיות מחמד. אנו טוענים את התמונה כמערך מקודד של בתים לשימוש ב-DALI backend (למידע נוסף, ראה דוגמאות למפענח תמונה).

כשהתמונה המקודדת והמטען שלנו מוכנים, אנו מפעילים את נקודת הקצה.

שימו לב שאנו מציינים את אנסמבל היעד שלנו להיות model_tf_dali.tar.gz חפץ. הפרמטר TargetModel הוא מה שמבדיל MMEs מנקודות קצה של מודל יחיד ומאפשר לנו להפנות את הבקשה למודל הנכון.

התגובה כוללת מטא נתונים על הפנייה (כגון שם הדגם והגרסה) ותגובת ההסקה בפועל בחלק הנתונים של אובייקט הפלט. בדוגמה זו, נקבל מערך של 1,001 ערכים, כאשר כל ערך הוא ההסתברות של המחלקה אליה שייכת התמונה (1,000 מחלקות ו-1 נוסף עבור אחרים).

לאחר מכן, אנו מפעילים שוב את ה-MME שלנו, אך הפעם מכוונים לאנסמבל השני. כאן הנתונים הם רק שני משפטי טקסט פשוטים:

כדי לפשט את התקשורת עם טריטון, פרויקט טריטון מספק כמה ספריות לקוחות. אנו משתמשים בספרייה זו כדי להכין את המטען בבקשה שלנו:

כעת אנו מוכנים להפעיל את נקודת הקצה - הפעם, מודל היעד הוא ה- model_trt_python.tar.gz מִכלוֹל:

התגובה היא הטמעות המשפט שניתן להשתמש בהן במגוון יישומי עיבוד שפה טבעית (NLP).

לנקות את

לבסוף, אנו מנקים ומוחקים את נקודת הקצה, תצורת נקודת הקצה והמודל:

סיכום

בפוסט זה, הראינו כיצד להגדיר, לפרוס ולהפעיל MME של SageMaker עם הרכבי Triton במופע מואץ של GPU. אירחנו שני הרכבים בסביבת מסקנות אחת בזמן אמת, מה שהפחית את העלות שלנו ב-50% (עבור מופע g4dn.4xlarge, שמייצג יותר מ-13,000 דולר בחיסכון שנתי). למרות שדוגמה זו השתמשה רק בשני צינורות, MMEs של SageMaker יכולים לתמוך באלפי הרכבי דגמים, מה שהופך אותו למנגנון חיסכון בעלויות יוצא דופן. יתר על כן, אתה יכול להשתמש ביכולת הדינמית של SageMaker MMEs לטעון (ולפרוק) מודלים כדי למזער את התקורה התפעולית של ניהול פריסות מודלים בייצור.

על המחברים

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

ניקיל קולקרני היא מפתחת תוכנה עם AWS Machine Learning, המתמקדת בהפיכת עומסי עבודה של למידת מכונה לביצועים יותר בענן, והיא שותפה ליצירה של AWS Deep Learning Containers להדרכה והסקה. הוא נלהב ממערכות למידה עמוקות מבוזרות. מחוץ לעבודה הוא נהנה לקרוא ספרים, להתעסק בגיטרה ולהכין פיצה.

ניקיל קולקרני היא מפתחת תוכנה עם AWS Machine Learning, המתמקדת בהפיכת עומסי עבודה של למידת מכונה לביצועים יותר בענן, והיא שותפה ליצירה של AWS Deep Learning Containers להדרכה והסקה. הוא נלהב ממערכות למידה עמוקות מבוזרות. מחוץ לעבודה הוא נהנה לקרוא ספרים, להתעסק בגיטרה ולהכין פיצה.

אורי רוזנברג הוא המנהל הטכני מומחה AI ו-ML לאירופה, המזרח התיכון ואפריקה. בהתבסס מישראל, אורי פועל להעצמת לקוחות ארגוניים לתכנן, לבנות ולהפעיל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי, הוא נהנה לרכוב על אופניים, לרכוב על תרמילאים ולהתפשט.

אורי רוזנברג הוא המנהל הטכני מומחה AI ו-ML לאירופה, המזרח התיכון ואפריקה. בהתבסס מישראל, אורי פועל להעצמת לקוחות ארגוניים לתכנן, לבנות ולהפעיל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי, הוא נהנה לרכוב על אופניים, לרכוב על תרמילאים ולהתפשט.

אליוט טריאנה איזאזה הוא מנהל קשרי מפתחים בצוות NVIDIA-AWS. הוא מחבר בין מובילי מוצר, מפתחים ומדענים של אמזון ו-AWS עם טכנולוגים ומובילי מוצר של NVIDIA כדי להאיץ את עומסי העבודה של אמזון ML/DL, מוצרי EC2 ושירותי AI של AWS. בנוסף, אליוט הוא רוכב הרים נלהב, גולש סקי ושחקן פוקר.

אליוט טריאנה איזאזה הוא מנהל קשרי מפתחים בצוות NVIDIA-AWS. הוא מחבר בין מובילי מוצר, מפתחים ומדענים של אמזון ו-AWS עם טכנולוגים ומובילי מוצר של NVIDIA כדי להאיץ את עומסי העבודה של אמזון ML/DL, מוצרי EC2 ושירותי AI של AWS. בנוסף, אליוט הוא רוכב הרים נלהב, גולש סקי ושחקן פוקר.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. רכב / רכבים חשמליים, פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- BlockOffsets. מודרניזציה של בעלות על קיזוז סביבתי. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/deploy-thousands-of-model-ensembles-with-amazon-sagemaker-multi-model-endpoints-on-gpu-to-minimize-your-hosting-costs/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 000

- 1

- 10

- 100

- 11

- 12

- 14

- 16

- 22

- 224

- 23

- 7

- 8

- a

- יכולת

- אודות

- להאיץ

- מוּאָץ

- מאיצה

- גישה

- נגיש

- להתאים

- פי

- להשיג

- לרוחב

- ממשי

- מחזורי

- להוסיף

- מוסיף

- תוספת

- נוסף

- בנוסף

- אימוץ

- מתקדם

- אפריקה

- שוב

- AI

- שירותי AI

- תעשיות

- מאפשר

- לאורך

- כְּבָר

- גם

- למרות

- אמזון בעברית

- אמזון SageMaker

- אמזון שירותי אינטרנט

- an

- ו

- API

- בקשה

- יישומים

- יישומית

- החל

- גישה

- ארכיטקטורה

- ARE

- מערך

- AS

- At

- המכונית

- מכני עם סלילה אוטומטית

- זמין

- מְמוּצָע

- AWS

- למידת מכונות AWS

- קצה אחורי

- בסיס

- מבוסס

- BE

- כי

- היה

- לפני

- להיות

- שייך

- מרוויח

- בֵּין

- לחסום

- ספרים

- שניהם

- פריצות דרך

- לִבנוֹת

- אבל

- by

- שיחה

- CAN

- קיבולת

- מקרה

- מקרים

- מֶרכָּזִי

- האתגרים

- בכיתה

- כיתות

- מיון

- ענן

- אשכול

- קוד

- COM

- משולב

- Common

- תקשורת

- תואם

- מורכב

- לחשב

- המחשב

- ראייה ממוחשבת

- תְצוּרָה

- מוגדר

- מחובר

- הקשר

- מתחבר

- מורכב

- מכולה

- מכולות

- ברציפות

- בקרות

- להמיר

- ליבה

- תוֹאֵם

- עלות

- חיסכון עלויות

- עלות תועלת

- עלויות

- לִיצוֹר

- נוצר

- מנהג

- לקוחות

- DAG

- נתונים

- פענוח

- מסירות

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- מוגדר

- דמוקרטיזציה

- תלות

- לפרוס

- פרס

- פריסה

- פריסה

- פריסות

- פורס

- לתאר

- עיצוב

- מעוצב

- איתור

- מפתח

- מפתחים

- אחר

- ישיר

- ספריות

- מופץ

- סַוָר

- עושה

- לא

- להורדה

- הורדות

- דינמי

- באופן דינמי

- כל אחד

- מוקדם יותר

- בקלות

- מזרח

- אחר

- להסמיך

- לאפשר

- מאפשר

- נקודת קצה

- מנוע

- אנגלית

- מספיק

- לְהַבטִיחַ

- מִפְעָל

- שלם

- סביבה

- אירופה

- דוגמה

- דוגמאות

- הוצאת להורג

- מורחב

- חיצוני

- נוסף

- תמצית

- יוצא דופן

- פָּנִים

- משפחה

- מהר יותר

- מאפיין

- תכונות

- שלח

- קבצים

- בסופו של דבר

- ראשון

- צי

- לָצוּף

- מתמקד

- התמקדות

- לעקוב

- הבא

- בעד

- טופס

- פוּרמָט

- ארבע

- מסגרות

- החל מ-

- לגמרי

- פונקציונלי

- נוסף

- יתר על כן

- ליצור

- גנרטטיבית

- AI Generative

- לקבל

- מטרה

- GPU

- גרף

- לטפל

- חומרה

- יש

- he

- לעזור

- כאן

- גָבוֹהַ

- הגבוה ביותר

- שֶׁלוֹ

- המארח

- אירח

- אירוח

- עלויות אירוח

- מארחים

- איך

- איך

- אולם

- HTML

- http

- HTTPS

- i

- if

- תמונה

- סיווג תמונות

- זיהוי תמונה

- תמונות

- יושם

- לייבא

- in

- הַתחָלָה

- לכלול

- כולל

- בנפרד

- תעשיות

- מידע

- חדשני

- טכנולוגיות חדשניות

- קלט

- תשומות

- התקנה

- למשל

- במקום

- השתלבות

- מוֹדִיעִין

- אל תוך

- הופעל

- ישראל

- IT

- שֶׁלָה

- jpg

- ג'סון

- רק

- מפתח

- סוג

- תוויות

- שפה

- גָדוֹל

- מאוחר יותר

- לשגר

- השקה

- שכבות

- מנהיגים

- לִלמוֹד

- למידה

- לתת

- ספריות

- סִפְרִיָה

- מעגל החיים

- כמו

- LLM

- לִטעוֹן

- טוען

- המון

- באופן מקומי

- מיקום

- מקומות

- הגיון

- מכונה

- למידת מכונה

- עשוי

- לעשות

- עושה

- עשייה

- הצליח

- מנהל

- מצליח

- ניהול

- רב

- מבחר המסיכות

- מקסימום

- מנגנון

- זכרון

- מידע נוסף

- אמצע

- המזרח התיכון

- יכול

- מינימלי

- מעורב

- ML

- MLOps

- מצב

- מודל

- דוגמנות

- מודלים

- יותר

- מוטיבציה

- הַר

- מספר

- צריך

- שם

- טבעי

- עיבוד שפה טבעית

- צורך

- נחוץ

- צרכי

- רשתות

- רשתות עצביות

- חדש

- הבא

- NLP

- לא

- מספר

- קהות

- Nvidia

- אובייקט

- זיהוי אובייקט

- מטרה

- of

- לעתים קרובות

- זקן

- on

- ONE

- יחידות

- רק

- קוד פתוח

- להפעיל

- מבצעי

- מטב

- מיטוב

- or

- אחר

- שלנו

- הַחוּצָה

- תפוקה

- בחוץ

- יותר

- חבילה

- חבילה

- אריזה

- מקביל

- פרמטר

- פרמטרים

- חלק

- מסוים

- לוהט

- טלאים

- נתיב

- דפוסי

- משלם

- ביצועים

- PHP

- צינור

- פיצה

- מקום

- תכנית

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- שחקן

- פוקר

- מדיניות

- הודעה

- להכין

- קודם

- פרואקטיבי

- תהליך

- המוצר

- מנהל מוצר

- הפקה

- מוצרים

- פּרוֹיֶקט

- רכוש

- הפרוטו

- לספק

- ובלבד

- מספק

- מתן

- ציבורי

- פיתון

- פיטורך

- להעלות

- חי

- מגיע

- קריאה

- מוכן

- זמן אמת

- מקבל

- לאחרונה

- הכרה

- מוּמלָץ

- להפחית

- מופחת

- באזור

- רישום

- באופן קבוע

- קָשׁוּר

- יחסים

- להשאר

- מרחוק

- הסרת

- מאגר

- מייצג

- לבקש

- בקשות

- לדרוש

- נדרש

- החלטה

- משאבים

- אלה

- תגובה

- לַחֲזוֹר

- החזרות

- RGB

- תקין

- תפקיד

- נתיבים

- הפעלה

- בעל חכמים

- SageMaker Inference

- אותו

- חסכת

- חיסכון

- סולם

- דרוג

- מדעי

- מדענים

- סקריפטים

- Sdk

- בצורה חלקה

- שְׁנִיָה

- מְאוּבטָח

- אבטחה

- לִרְאוֹת

- לראות

- נבחר

- שליחה

- לחצני מצוקה לפנסיונרים

- משפט

- סדרה

- שירותים

- הגשה

- סט

- הצבה

- כמה

- צוּרָה

- צורות

- משותף

- לְהַצִיג

- הראה

- פָּשׁוּט

- לפשט

- יחיד

- מידה

- So

- תוכנה

- פִּתָרוֹן

- פתרונות

- כמה

- מומחה

- מפרט

- מפורט

- נאום

- הוצאה

- התחלה

- מדינה-of-the-art

- שלב

- צעדים

- עוד

- עצור

- אחסון

- מאוחסן

- אחסון

- מִבְנֶה

- כזה

- תמיכה

- תומך

- בטוח

- מערכת

- מערכות

- לקחת

- לוקח

- יעד

- משימות

- נבחרת

- TechCrunch

- טכני

- טכנולוגיות

- טכנולוגים

- tensorflow

- זֶה

- השמיים

- שֶׁלָהֶם

- אותם

- אז

- שם.

- בכך

- לכן

- אלה

- הֵם

- זֶה

- אלה

- אלפים

- שְׁלוֹשָׁה

- דרך

- זמן

- ל

- יַחַד

- אסימון

- טוקניזציה

- כלים

- תְנוּעָה

- מְאוּמָן

- הדרכה

- התמרות

- טריטון

- שתיים

- סוגים

- טיפוסי

- בדרך כלל

- לא בשימוש

- מְעוּדכָּן

- עדכון

- us

- נוֹהָג

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמשים

- באמצעות

- ערך

- ערכים

- מגוון

- גרסה

- גירסאות

- לצפיה

- חזון

- כֶּרֶך

- רוצה

- היה

- we

- אינטרנט

- שירותי אינטרנט

- טוֹב

- מה

- מתי

- אשר

- בזמן

- יצטרך

- עם

- תיק עבודות

- עובד

- עובד

- שְׁנָתִי

- אתה

- זפירנט