היום אנו נרגשים לבשר כי משמר הלאמה המודל זמין כעת עבור לקוחות המשתמשים אמזון SageMaker JumpStart. Llama Guard מספק אמצעי הגנה לקלט ופלט בפריסת מודל שפה גדול (LLM). זהו אחד המרכיבים תחת Purple Llama, היוזמה של Meta הכוללת כלי אמון ובטיחות פתוחים והערכות כדי לעזור למפתחים לבנות בצורה אחראית עם מודלים של AI. Purple Llama מפגיש כלים והערכות כדי לעזור לקהילה לבנות בצורה אחראית עם מודלים של בינה מלאכותית. המהדורה הראשונית כוללת התמקדות באבטחת סייבר והגנה על קלט ופלט של LLM. רכיבים בפרויקט Purple Llama, כולל מודל ה-Llama Guard, מקבלים רישיון מתירני, מה שמאפשר שימוש מחקר ומסחרי כאחד.

עכשיו אתה יכול להשתמש במודל ה-Llama Guard בתוך SageMaker JumpStart. SageMaker JumpStart הוא מרכז למידת המכונה (ML) של אמזון SageMaker המספק גישה למודלים בסיסיים בנוסף לאלגוריתםים מובנים ותבניות פתרונות מקצה לקצה כדי לעזור לך להתחיל במהירות עם ML.

בפוסט זה, אנו עוברים דרך כיצד לפרוס את מודל ה-Llama Guard ולבנות פתרונות AI מחוללים אחראיים.

דגם לאמה גארד

Llama Guard הוא דגם חדש מבית Meta המספק מעקות בטיחות קלט ופלט עבור פריסות LLM. Llama Guard הוא מודל זמין באופן גלוי שמתפקד באופן תחרותי על אמות מידה פתוחות נפוצות ומספק למפתחים מודל מאומן מראש כדי לסייע בהגנה מפני יצירת תפוקות שעלולות להיות מסוכנות. מודל זה עבר הכשרה על שילוב של מערכי נתונים זמינים לציבור כדי לאפשר זיהוי של סוגים נפוצים של תוכן שעלול להיות מסוכן או מפר, שעשוי להיות רלוונטי למספר מקרי שימוש של מפתחים. בסופו של דבר, החזון של המודל הוא לאפשר למפתחים להתאים את המודל הזה כדי לתמוך במקרים שימוש רלוונטיים ולהפוך אותו ללא מאמץ לאמץ שיטות עבודה מומלצות ולשפר את האקולוגית הפתוחה.

ניתן להשתמש ב-Llama Guard ככלי משלים למפתחים לשילוב באסטרטגיות הפחתה משלהם, כגון עבור צ'אטבוטים, ניהול תוכן, שירות לקוחות, ניטור מדיה חברתית וחינוך. על ידי העברת תוכן שנוצר על ידי משתמשים דרך Llama Guard לפני פרסום או תגובה אליו, מפתחים יכולים לסמן שפה לא בטוחה או לא הולמת ולנקוט פעולה כדי לשמור על סביבה בטוחה ומכבדת.

בואו נחקור כיצד אנו יכולים להשתמש במודל ה-Llama Guard ב- SageMaker JumpStart.

דגמי יסוד ב- SageMaker

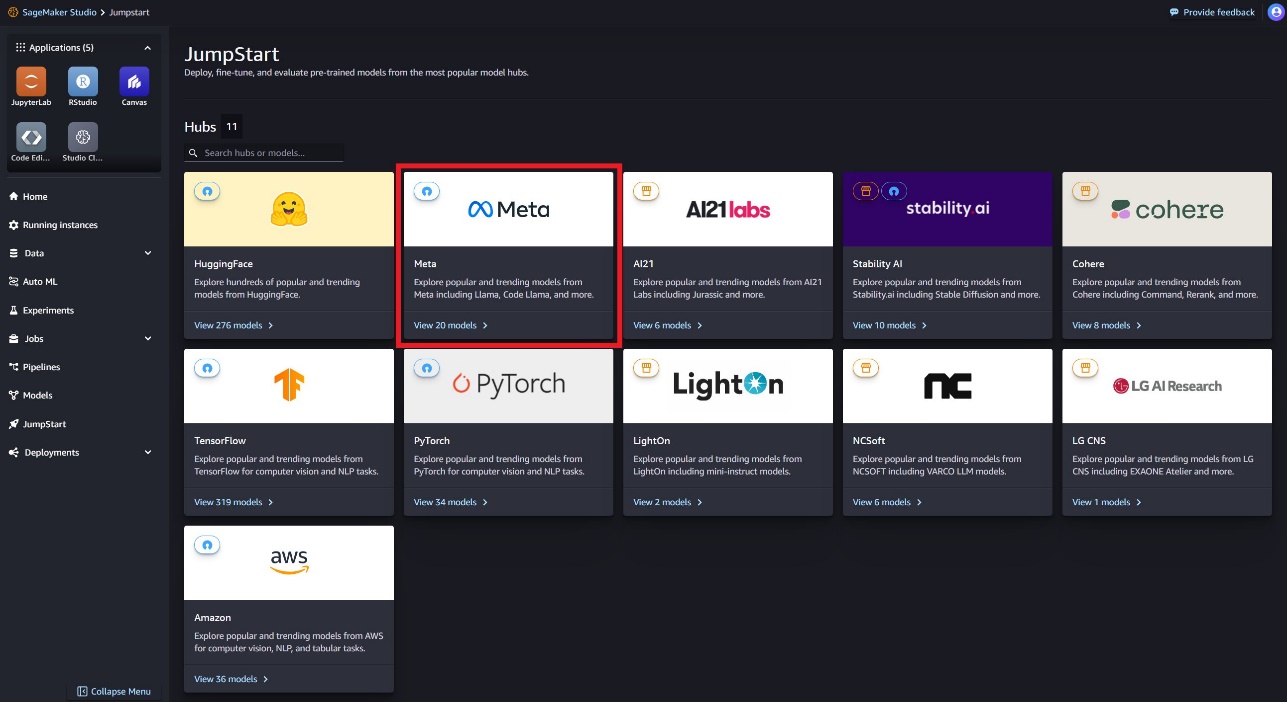

SageMaker JumpStart מספקת גישה למגוון דגמים ממרכזי דגמים פופולריים, כולל Hugging Face, PyTorch Hub ו- TensorFlow Hub, שבהם אתה יכול להשתמש במסגרת זרימת העבודה שלך לפיתוח ML ב- SageMaker. ההתקדמות האחרונה ב-ML הובילה לסוג חדש של דגמים המכונה דגמי יסוד, אשר בדרך כלל מאומנים על מיליארדי פרמטרים וניתנים להתאמה לקטגוריה רחבה של מקרי שימוש, כגון סיכום טקסט, יצירת אמנות דיגיטלית ותרגום שפה. מכיוון שדגמים אלו יקרים לאימון, לקוחות רוצים להשתמש במודלים קיימים של יסודות שהוכשרו מראש ולכוונן אותם לפי הצורך, במקום לאמן את הדגמים הללו בעצמם. SageMaker מספק רשימה אוצרת של דגמים שתוכלו לבחור מהם בקונסולת SageMaker.

כעת תוכל למצוא דגמי יסוד מספקי דגמים שונים בתוך SageMaker JumpStart, מה שמאפשר לך להתחיל עם דגמי יסוד במהירות. אתה יכול למצוא מודלים של בסיס המבוססים על משימות או ספקי מודל שונים, ולסקור בקלות את מאפייני המודל ומונחי השימוש. אתה יכול גם לנסות את הדגמים האלה באמצעות ווידג'ט למבחן ממשק משתמש. כאשר אתה רוצה להשתמש במודל יסוד בקנה מידה, אתה יכול לעשות זאת בקלות מבלי לעזוב את SageMaker על ידי שימוש במחברות מובנות מראש מספקי דגמים. מכיוון שהמודלים מתארחים ונפרסים ב-AWS, אתה יכול להיות סמוך ובטוח שהנתונים שלך, בין אם הם משמשים להערכת המודל או לשימוש בקנה מידה גדול, לעולם אינם משותפים עם צדדים שלישיים.

בואו נחקור כיצד אנו יכולים להשתמש במודל ה-Llama Guard ב- SageMaker JumpStart.

גלה את דגם ה-Llama Guard ב-SageMaker JumpStart

אתה יכול לגשת לדגמי בסיס Code Llama דרך SageMaker JumpStart בממשק המשתמש של SageMaker Studio ו- SageMaker Python SDK. בחלק זה נעבור על איך לגלות את הדגמים ב סטודיו SageMaker של אמזון.

SageMaker Studio הוא סביבת פיתוח משולבת (IDE) המספקת ממשק חזותי אחד מבוסס אינטרנט שבו אתה יכול לגשת לכלים ייעודיים לביצוע כל שלבי הפיתוח של ML, מהכנת נתונים ועד לבנייה, הדרכה ופריסה של מודלי ה-ML שלך. לפרטים נוספים כיצד להתחיל ולהגדיר את SageMaker Studio, עיין ב סטודיו SageMaker של אמזון.

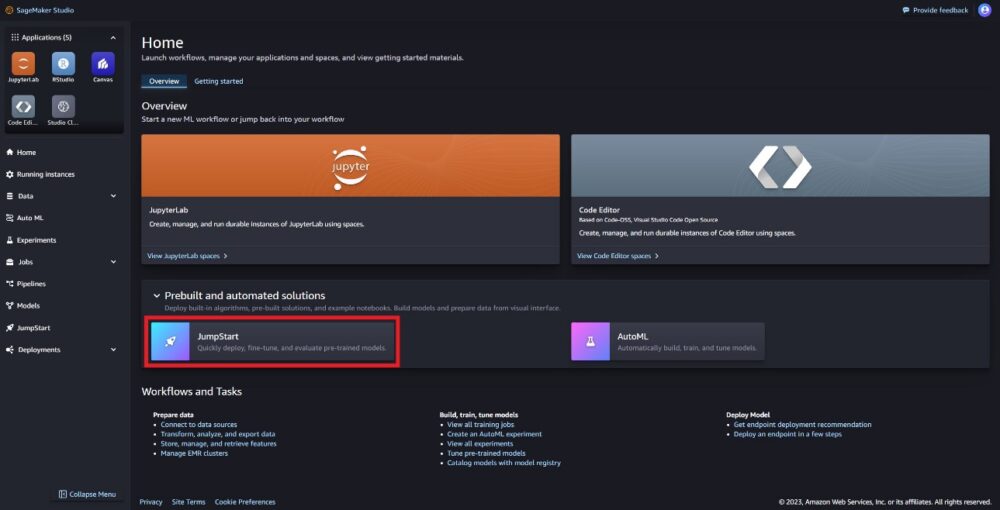

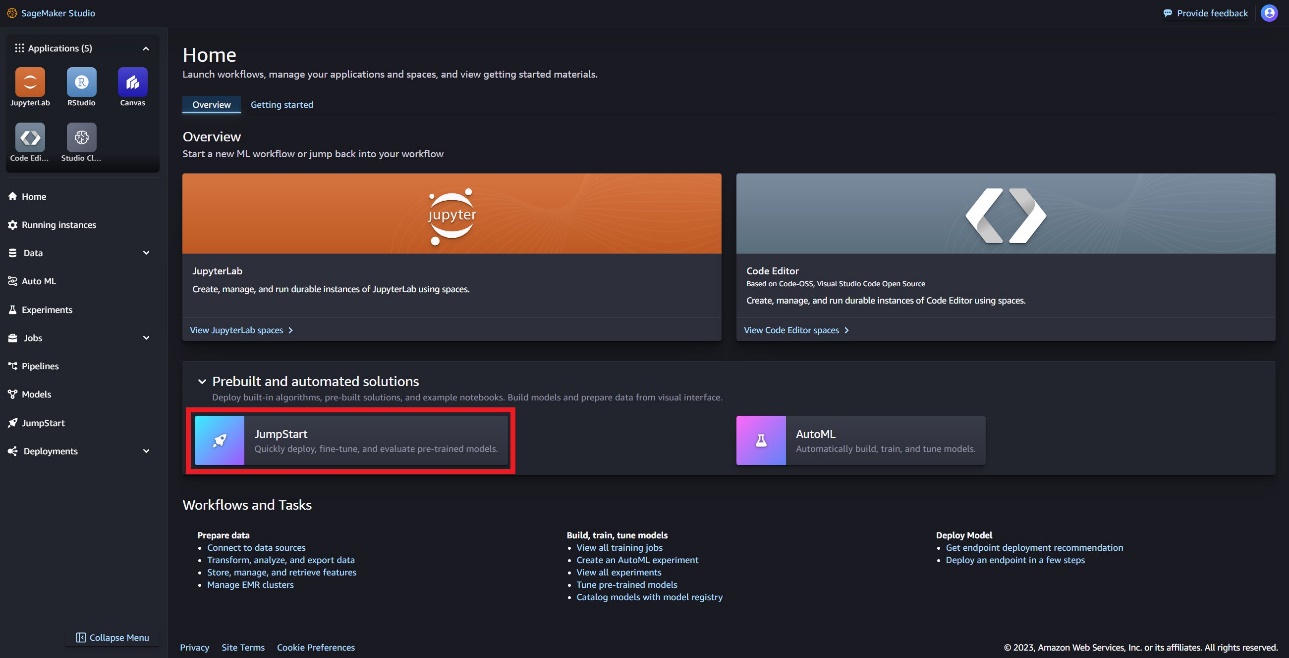

ב-SageMaker Studio, תוכל לגשת ל-SageMaker JumpStart, המכיל דגמים מאומנים מראש, מחברות ופתרונות מובנים מראש, תחת פתרונות מובנים ואוטומטיים מראש.

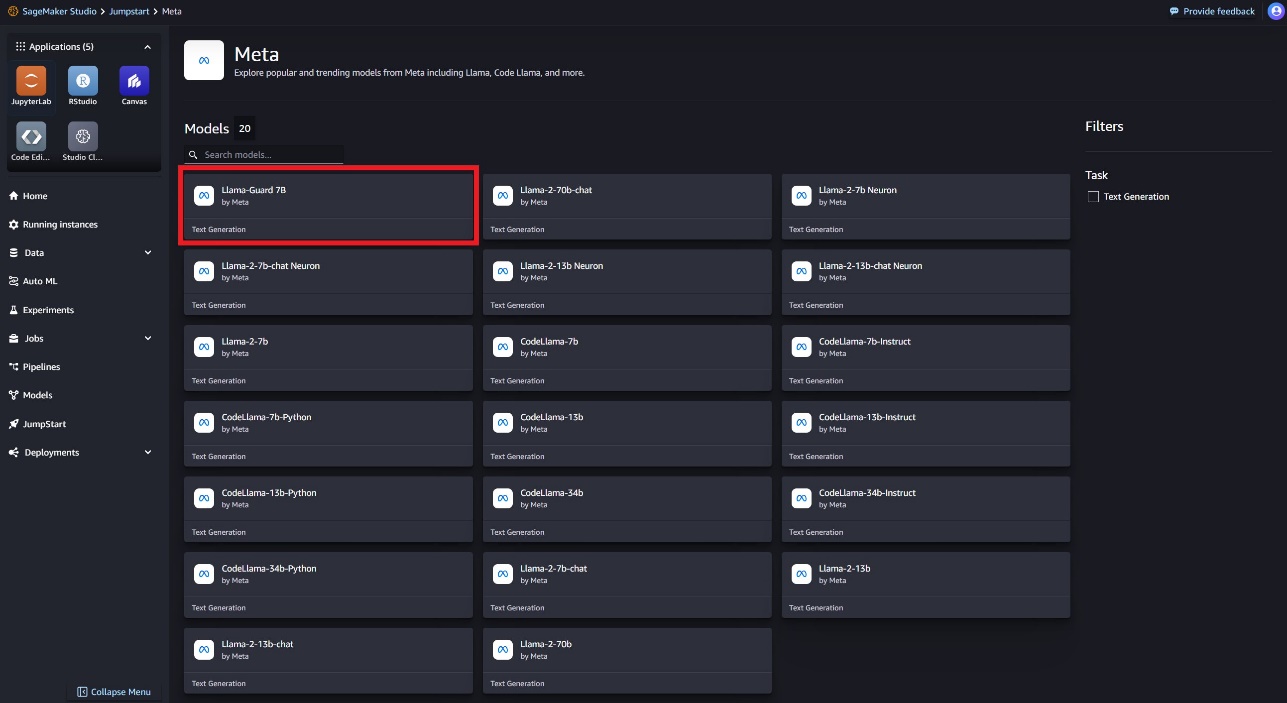

בדף הנחיתה של SageMaker JumpStart, תוכל למצוא את דגם ה-Llama Guard על ידי בחירה ב-Meta Hub או חיפוש אחר Llama Guard.

אתה יכול לבחור מתוך מגוון גרסאות של דגמי לאמה, כולל Lama Guard, Llama-2 וקוד לאמה.

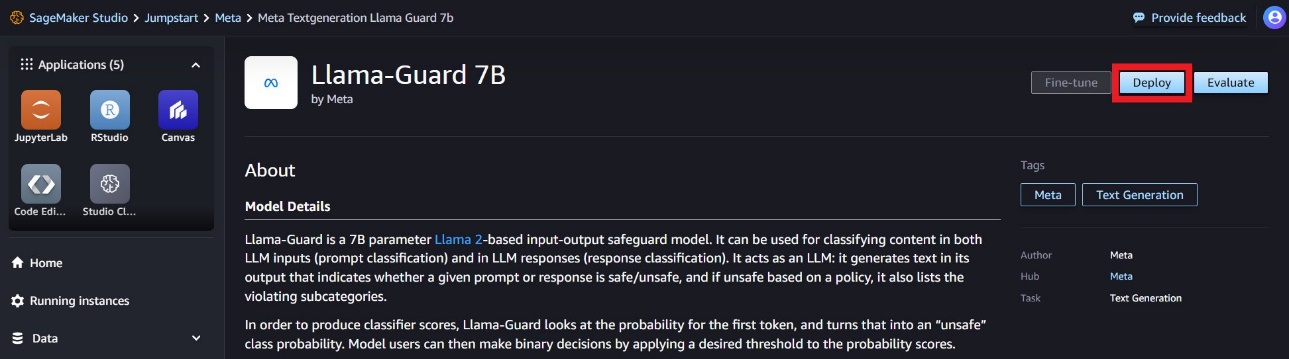

אתה יכול לבחור את כרטיס הדגם כדי להציג פרטים על הדגם כגון רישיון, נתונים המשמשים לאימון ואופן השימוש. תמצא גם א לפרוס אפשרות, שתעביר אותך לדף נחיתה שבו תוכל לבדוק מסקנות עם מטען דוגמה.

פרוס את הדגם עם SageMaker Python SDK

אתה יכול למצוא את הקוד המציג את פריסת ה-Llama Guard ב- Amazon JumpStart ודוגמה לשימוש במודל הפרוס ב- זֶה מחברת GitHub.

בקוד הבא, אנו מציינים את מזהה דגם הרכזת של דגם SageMaker וגרסת הדגם לשימוש בעת פריסת ה-Llama Guard:

כעת תוכל לפרוס את המודל באמצעות SageMaker JumpStart. הקוד הבא משתמש במופע ברירת המחדל ml.g5.2xlarge עבור נקודת הסיום. אתה יכול לפרוס את המודל על סוגי מופעים אחרים על ידי מעבר instance_type ב JumpStartModel מעמד. הפריסה עשויה להימשך מספר דקות. לפריסה מוצלחת, עליך לשנות ידנית את accept_eula ארגומנט בשיטת הפריסה של המודל ל True.

מודל זה נפרס באמצעות מיכל הלמידה העמוקה (TGI). בקשות להסיק תומכות בפרמטרים רבים, כולל הפרמטרים הבאים:

- אורך מקסימלי – המודל יוצר טקסט עד שאורך הפלט (הכולל את אורך ההקשר של הקלט) מגיע

max_length. אם צוין, זה חייב להיות מספר שלם חיובי. - max_new_tokens – המודל יוצר טקסט עד שאורך הפלט (לא כולל אורך ההקשר של הקלט) מגיע

max_new_tokens. אם צוין, זה חייב להיות מספר שלם חיובי. - num_beams - זה מציין את מספר הקורות המשמשות בחיפוש החמדני. אם צוין, הוא חייב להיות מספר שלם הגדול או שווה ל

num_return_sequences. - no_repeat_ngram_size – המודל מבטיח שרצף מילים של

no_repeat_ngram_sizeאינו חוזר על עצמו ברצף הפלט. אם צוין, זה חייב להיות מספר שלם חיובי הגדול מ-1. - טמפרטורה – פרמטר זה שולט באקראיות בפלט. גבוה יותר

temperatureהתוצאה היא רצף פלט עם מילים בסבירות נמוכה, ומילים נמוכות יותרtemperatureמביא לרצף פלט עם מילים בסבירות גבוהה. אםtemperatureהוא 0, זה גורם לפענוח חמדני. אם צוין, זה חייב להיות ציפה חיובית. - עצירה מוקדמת - אם

True, יצירת טקסט מסתיימת כאשר כל השערות האלומה מגיעות לסוף אסימון המשפט. אם צוין, זה חייב להיות בוליאני. - do_sample - אם

True, המודל דוגם את המילה הבאה לפי הסבירות. אם צוין, זה חייב להיות בוליאני. - top_k – בכל שלב של יצירת טקסט, המודל דוגם רק מה-

top_kסביר להניח מילים. אם צוין, זה חייב להיות מספר שלם חיובי. - top_p - בכל שלב של יצירת טקסט, המודל דוגם מקבוצת המילים הקטנה ביותר האפשרית עם הסתברות מצטברת

top_p. אם צוין, זה חייב להיות צף בין 0-1. - return_full_text - אם

True, טקסט הקלט יהיה חלק מהטקסט שנוצר בפלט. אם צוין, זה חייב להיות בוליאני. ערך ברירת המחדל הואFalse. - להפסיק – אם צוין, זה חייב להיות רשימה של מחרוזות. יצירת טקסט נעצרת אם אחת מהמחרוזות שצוינו נוצרת.

הפעל נקודת קצה של SageMaker

אתה יכול לאחזר באופן תוכניתי מטענים לדוגמה מה- JumpStartModel לְהִתְנַגֵד. זה יעזור לך להתחיל במהירות על ידי התבוננות בהנחיות הוראות מעוצבות מראש ש-Lama Guard יכול לקלוט. ראה את הקוד הבא:

לאחר שתפעיל את הדוגמה הקודמת, תוכל לראות כיצד הקלט והפלט שלך יפורמטו על ידי Llama Guard:

בדומה ל-Llama-2, Llama Guard משתמש באסימונים מיוחדים כדי לציין הוראות בטיחות לדגם. באופן כללי, המטען צריך להיות בפורמט הבא:

הודעת משתמש מוצגת כ {user_prompt} לעיל, יכול לכלול עוד קטעים עבור הגדרות ושיחות של קטגוריות תוכן, שנראה כך:

בסעיף הבא, נדון בערכי ברירת המחדל המומלצים עבור הגדרות המשימה, קטגוריית התוכן וההוראות. השיחה צריכה לעבור לסירוגין User ו Agent טקסט כדלקמן:

ניהול שיחה עם Llama-2 Chat

כעת תוכל לפרוס נקודת קצה של דגם Llama-2 7B Chat לצ'אט שיחה ולאחר מכן להשתמש ב-Llama Guard כדי למתן קלט ופלט של טקסט המגיע מ-Llama-2 7B Chat.

אנו מראים לך את הדוגמה של הקלט והפלט של מודל הצ'אט של Llama-2 7B המנוהל באמצעות Llama Guard, אך אתה יכול להשתמש ב-Llama Guard לניהול עם כל LLM לבחירתך.

פרוס את המודל עם הקוד הבא:

כעת תוכל להגדיר את תבנית המשימות של משמר הלאמה. קטגוריות התוכן הלא בטוח עשויות להיות מותאמות כרצונך למקרה השימוש הספציפי שלך. אתה יכול להגדיר בטקסט רגיל את המשמעות של כל קטגוריית תוכן, לרבות איזה תוכן צריך להיות מסומן כלא בטוח ואיזה תוכן צריך להיות בטוח. ראה את הקוד הבא:

לאחר מכן, אנו מגדירים פונקציות מסייעות format_chat_messages ו format_guard_messages כדי לעצב את ההנחיה עבור מודל הצ'אט ועבור דגם ה-Llama Guard שדרשו אסימונים מיוחדים:

לאחר מכן תוכל להשתמש בפונקציות המסייעות האלה בבקשת קלט הודעה לדוגמה כדי להפעיל את הקלט לדוגמה דרך Llama Guard כדי לקבוע אם תוכן ההודעה בטוח:

הפלט הבא מציין שההודעה בטוחה. ייתכן שתבחין שההנחיה כוללת מילים שעשויות להיות קשורות לאלימות, אבל במקרה זה, משמר הלאמה מסוגל להבין את ההקשר ביחס להוראות ולהגדרות הקטגוריות הלא בטוחות שסיפקנו קודם לכן ולקבוע שזו הנחיה בטוחה ולא הקשורים לאלימות.

כעת לאחר שאישרת שטקסט הקלט נקבע בטוח ביחס לקטגוריות התוכן של Llama Guard שלך, אתה יכול להעביר את המטען הזה למודל ה-Llama-2 7B שנפרס כדי ליצור טקסט:

להלן תגובת המודל:

לבסוף, ייתכן שתרצה לאשר שטקסט התגובה מהמודל נקבע כמכיל תוכן בטוח. כאן, אתה מרחיב את תגובת הפלט של LLM להודעות הקלט ומפעיל את כל השיחה הזו דרך Llama Guard כדי להבטיח שהשיחה בטוחה עבור היישום שלך:

ייתכן שתראה את הפלט הבא, המציין שהתגובה ממודל הצ'אט בטוחה:

לנקות את

לאחר שבדקת את נקודות הקצה, ודא שאתה מוחק את נקודות הקצה של SageMaker ואת המודל כדי להימנע מחיובים.

סיכום

בפוסט זה, הראינו לכם כיצד ניתן למתן כניסות ופלטים באמצעות Llama Guard ולהציב מעקות בטיחות לכניסות ויציאות מ-LLMs ב- SageMaker JumpStart.

ככל שה-AI ממשיך להתקדם, חיוני לתת עדיפות לפיתוח ופריסה אחראיים. כלים כמו CyberSecEval של Purple Llama ו-Llama Guard מסייעים בטיפוח חדשנות בטוחה, ומציעים זיהוי מוקדם של סיכונים והכוונה להפחתת מודלים של שפה. אלה צריכים להיות מושרשים בתהליך עיצוב הבינה המלאכותית כדי לרתום את מלוא הפוטנציאל שלו בלימודי LLM באופן אתי מהיום הראשון.

נסה את ה-Llama Guard ודגמי יסוד אחרים ב- SageMaker JumpStart עוד היום וספר לנו את המשוב שלך!

הדרכה זו מיועדת למטרות מידע בלבד. אתה עדיין צריך לבצע הערכה עצמאית משלך, ולנקוט באמצעים כדי להבטיח שאתה מציית לפרקטיקות ולסטנדרטים הספציפיים של בקרת איכות משלך, ולכללים המקומיים, החוקים, התקנות, הרישיונות ותנאי השימוש החלים עליך, התוכן שלך, ומודל הצד השלישי הנזכר בהנחיה זו. ל-AWS אין שליטה או סמכות על מודל הצד השלישי הנזכר בהנחיה זו, ואינה מציגה כל מצג או התחייבות לכך שדגם הצד השלישי מאובטח, נטול וירוסים, תפעולי או תואם לסביבת הייצור והסטנדרטים שלך. AWS אינה מציגה כל מצג, אחריות או ערבות לכך שמידע כלשהו בהנחיה זו יביא לתוצאה או תוצאה מסוימת.

על המחברים

ד"ר קייל אולריך הוא מדען יישומי עם אלגוריתמים מובנים של Amazon SageMaker קְבוּצָה. תחומי המחקר שלו כוללים אלגוריתמים של למידת מכונה ניתנים להרחבה, ראייה ממוחשבת, סדרות זמן, אי-פרמטריות בייסיאניות ותהליכי גאוס. הדוקטורט שלו הוא מאוניברסיטת דיוק והוא פרסם מאמרים ב-NeurIPS, Cell, and Neuron.

ד"ר קייל אולריך הוא מדען יישומי עם אלגוריתמים מובנים של Amazon SageMaker קְבוּצָה. תחומי המחקר שלו כוללים אלגוריתמים של למידת מכונה ניתנים להרחבה, ראייה ממוחשבת, סדרות זמן, אי-פרמטריות בייסיאניות ותהליכי גאוס. הדוקטורט שלו הוא מאוניברסיטת דיוק והוא פרסם מאמרים ב-NeurIPS, Cell, and Neuron.

אוון קרביץ הוא מהנדס תוכנה בחברת Amazon Web Services, עובד על SageMaker JumpStart. הוא מתעניין בשילוב של למידת מכונה עם מחשוב ענן. אוון קיבל את התואר הראשון שלו מאוניברסיטת קורנל ותואר שני מאוניברסיטת קליפורניה, ברקלי. בשנת 2021, הוא הציג מאמר על רשתות עצביות יריבות בוועידת ICLR. בזמנו הפנוי, אוון נהנה לבשל, לטייל ולצאת לריצות בעיר ניו יורק.

אוון קרביץ הוא מהנדס תוכנה בחברת Amazon Web Services, עובד על SageMaker JumpStart. הוא מתעניין בשילוב של למידת מכונה עם מחשוב ענן. אוון קיבל את התואר הראשון שלו מאוניברסיטת קורנל ותואר שני מאוניברסיטת קליפורניה, ברקלי. בשנת 2021, הוא הציג מאמר על רשתות עצביות יריבות בוועידת ICLR. בזמנו הפנוי, אוון נהנה לבשל, לטייל ולצאת לריצות בעיר ניו יורק.

רחנה צ'דהא הוא ארכיטקט פתרונות ראשי AI/ML בחשבונות אסטרטגיים ב-AWS. רחנה היא אופטימית המאמינה ששימוש אתי ואחראי בבינה מלאכותית יכול לשפר את החברה בעתיד ולהביא לשגשוג כלכלי וחברתי. בזמנה הפנוי, רחנה אוהבת לבלות עם משפחתה, לטייל ולהאזין למוזיקה.

רחנה צ'דהא הוא ארכיטקט פתרונות ראשי AI/ML בחשבונות אסטרטגיים ב-AWS. רחנה היא אופטימית המאמינה ששימוש אתי ואחראי בבינה מלאכותית יכול לשפר את החברה בעתיד ולהביא לשגשוג כלכלי וחברתי. בזמנה הפנוי, רחנה אוהבת לבלות עם משפחתה, לטייל ולהאזין למוזיקה.

ד"ר אשיש חתן הוא מדען יישומי בכיר עם אלגוריתמים מובנים של Amazon SageMaker ועוזר בפיתוח אלגוריתמים של למידת מכונה. הוא קיבל את הדוקטורט שלו מאוניברסיטת אילינוי אורבנה-שמפיין. הוא חוקר פעיל בלמידת מכונה והסקה סטטיסטית, ופרסם מאמרים רבים בכנסים NeurIPS, ICML, ICLR, JMLR, ACL ו-EMNLP.

ד"ר אשיש חתן הוא מדען יישומי בכיר עם אלגוריתמים מובנים של Amazon SageMaker ועוזר בפיתוח אלגוריתמים של למידת מכונה. הוא קיבל את הדוקטורט שלו מאוניברסיטת אילינוי אורבנה-שמפיין. הוא חוקר פעיל בלמידת מכונה והסקה סטטיסטית, ופרסם מאמרים רבים בכנסים NeurIPS, ICML, ICLR, JMLR, ACL ו-EMNLP.

קרל אלברטסן מוביל מוצר, הנדסה ומדע עבור אלגוריתמים של אמזון SageMaker ו-JumpStart, מרכז למידת המכונה של SageMaker. הוא נלהב ליישם למידת מכונה כדי לפתוח ערך עסקי.

קרל אלברטסן מוביל מוצר, הנדסה ומדע עבור אלגוריתמים של אמזון SageMaker ו-JumpStart, מרכז למידת המכונה של SageMaker. הוא נלהב ליישם למידת מכונה כדי לפתוח ערך עסקי.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/llama-guard-is-now-available-in-amazon-sagemaker-jumpstart/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 11

- 12

- 13

- 2021

- 39

- 7

- 8

- 9

- a

- יכול

- אודות

- מֵעַל

- לְקַבֵּל

- גישה

- פי

- חשבונות

- לפעול

- פעולה

- פעולות

- פעיל

- פעילויות

- ממשי

- תוספת

- מותאם

- לְאַמֵץ

- לקדם

- התקדמות

- -

- עצה

- נגד

- סוֹכֵן

- AI

- דגמי AI

- AI / ML

- כּוֹהֶל

- אלגוריתמים

- תעשיות

- גם

- אמזון בעברית

- אמזון SageMaker

- אמזון SageMaker JumpStart

- אמזון שירותי אינטרנט

- an

- ו

- להכריז

- לענות

- כל

- בקשה

- יישומית

- החל

- מריחה

- מתאים

- ARE

- טענה

- טיעונים

- אמנות

- AS

- הערכה

- לעזור

- עוזר

- המשויך

- בטוח

- At

- סמכות

- אוטומטי

- זמין

- לְהִמָנַע

- AWS

- מבוסס

- בסיסי

- בייסיאנית

- BE

- קרן

- כי

- היה

- לפני

- להתחיל

- התנהגות

- מאמין

- להלן

- מבחני ביצועים

- ברקלי

- הטוב ביותר

- שיטות עבודה מומלצות

- בֵּין

- מיליארדים

- גוּף

- שניהם

- להביא

- מביא

- לִבנוֹת

- בִּניָן

- מובנה

- עסקים

- אבל

- by

- קליפורניה

- CAN

- חשיש

- כרטיס

- מקרה

- מקרים

- קטגוריות

- קטגוריה

- האתגרים

- סיכוי

- שינוי

- מאפיינים

- חיובים

- צ'אט

- chatbots

- לבדוק

- כימי

- בחירה

- בחרו

- בחירה

- עִיר

- בכיתה

- לְנַקוֹת

- ענן

- ענן מחשוב

- קוד

- צֶבַע

- מגיע

- מסחרי

- מְחוּיָב

- Common

- קהילה

- תואם

- להיענות

- רכיבים

- הרכב

- המחשב

- ראייה ממוחשבת

- מחשוב

- כנס

- כנסים

- לאשר

- מְאוּשָׁר

- מפגש

- קונסול

- צְרִיכָה

- להכיל

- מכולה

- מכיל

- תוכן

- הקשר

- ממשיך

- לִשְׁלוֹט

- נשלט

- בקרות

- שיחה

- שיחה

- שיחות

- קורנל

- יכול

- לִיצוֹר

- יצירה

- פשעים

- פלילי

- קריטי

- אוצר

- לקוח

- שירות לקוחות

- לקוחות

- אישית

- סייבר

- אבטחת סייבר

- מחזור

- נתונים

- מערכי נתונים

- יְוֹם

- פענוח

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- הגדרות

- תואר

- לפרוס

- פרס

- פריסה

- פריסה

- פריסות

- עיצוב

- תהליך עיצוב

- רצון עז

- רצוי

- מְפוֹרָט

- פרטים

- איתור

- לקבוע

- נחוש

- לפתח

- מפתח

- מפתחים

- צעצועי התפתחות

- DICT

- אחר

- דיגיטלי

- אמנות דיגיטלית

- לגלות

- לדון

- do

- עושה

- סמים

- דוכס

- אוניברסיטת דוכס

- e

- כל אחד

- מוקדם יותר

- מוקדם

- בקלות

- כַּלְכָּלִי

- המערכת האקולוגית

- חינוך

- תופעות

- ללא מאמץ

- לאפשר

- מה שמאפשר

- לעודד

- סוף

- מקצה לקצה

- נקודת קצה

- לעסוק

- מהנדס

- הנדסה

- לְהַבטִיחַ

- מבטיח

- סביבה

- שווה

- במיוחד

- אֶתִי

- הערכה

- הערכות

- אוון

- אירועים

- דוגמה

- אלא

- יוצא מן הכלל

- נרגש

- לְמַעֵט

- הוצאת להורג

- קיימים

- יקר

- לחקור

- אקספרס

- להאריך

- פָּנִים

- מתמודד

- שקר

- משפחה

- משתתפים

- מעטים

- כספי

- פשעים כספיים

- נשק חם

- ראשון

- מסומן

- לָצוּף

- להתמקד

- לעקוב

- בעקבות

- הבא

- כדלקמן

- בעד

- פוּרמָט

- טיפוח

- קרן

- חופשי

- החל מ-

- מלא

- פונקציות

- נוסף

- עתיד

- מין

- כללי

- ליצור

- נוצר

- מייצר

- יצירת

- דור

- גנרטטיבית

- AI Generative

- לקבל

- GitHub

- נתן

- נתינה

- Go

- הולך

- קבל

- יותר

- חמדן

- ערבויות

- שומר

- הדרכה

- אקדחים

- לפגוע

- רתמת

- לשנוא

- יש

- he

- בְּרִיאוּת

- לעזור

- עוזר

- לה

- כאן

- גבוה יותר

- שֶׁלוֹ

- היסטורי

- אירח

- איך

- איך

- HTML

- HTTPS

- טבור

- רכזות

- i

- ID

- הזדהות

- זהות

- if

- לא חוקי

- אילינוי

- מיד

- לייבא

- לשפר

- in

- לכלול

- כולל

- כולל

- עצמאי

- להצביע

- מצביע על

- מידע

- מידע

- עָמוֹק

- בתחילה

- יוזמה

- חדשנות

- קלט

- תשומות

- למשל

- הוראות

- אינסטרומנטלי

- לשלב

- משולב

- מעוניין

- אינטרסים

- מִמְשָׁק

- אל תוך

- מעורב

- IT

- שֶׁלָה

- jpg

- לַהֲרוֹג

- לדעת

- ידוע

- קייל

- נחיתה

- שפה

- גָדוֹל

- אחרון

- חוקים

- מוביל

- למידה

- עזיבה

- אורך

- לתת

- רישיון

- מורשה

- רישיונות

- כמו

- סְבִירוּת

- סביר

- אוהב

- מוגבל

- קו

- לינוקס

- רשימה

- האזנה

- לאמה

- LLM

- מקומי

- נראה

- להוריד

- מכונה

- למידת מכונה

- לתחזק

- לעשות

- באופן ידני

- מְיוּצָר

- רב

- מאסטר

- מאי..

- משמעות

- אמצעים

- מדיה

- נפשי

- בריאות נפש

- הודעה

- הודעות

- meta

- שיטה

- שיטות

- יכול

- דקות

- הֲקָלָה

- לערבב

- ML

- מודל

- מודלים

- מתינות

- ניטור

- יותר

- רוב

- כלי נגינה

- צריך

- לאומי

- נחוץ

- רשתות

- עצבי

- רשתות עצביות

- לעולם לא

- חדש

- ניו יורק

- ניו יורק

- הבא

- לא

- מחברה

- הודעה..

- עַכשָׁיו

- מספר

- אובייקט

- of

- הצעה

- on

- ONE

- רק

- לפתוח

- בגלוי

- מבצעי

- אפשרות

- אפשרויות

- or

- מקור

- אחר

- שלנו

- הַחוּצָה

- תוֹצָאָה

- תפוקה

- פלטים

- יותר

- שֶׁלוֹ

- בעלות

- עמוד

- מאמר

- ניירות

- פרמטר

- פרמטרים

- חלק

- מסוים

- צדדים

- לעבור

- חולף

- לוהט

- אֲנָשִׁים

- עבור

- לְבַצֵעַ

- מבצע

- אדם

- אישי

- דוקטורט

- מישור

- תכנית

- תכנון

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- מדיניות

- פופולרי

- חיובי

- אפשרי

- הודעה

- פוטנציאל

- פוטנציאל

- פרקטיקות

- קודם

- חיזוי

- העריכה

- מוצג

- למנוע

- מנהל

- תיעדוף

- תהליך

- תהליכים

- המוצר

- הפקה

- פּרוֹיֶקט

- הנחיות

- שגשוג

- לספק

- ובלבד

- ספקים

- מספק

- בפומבי

- לאור

- הוצאה לאור

- למטרות

- גם

- פיתון

- פיטורך

- איכות

- מהירות

- גזע

- אקראי

- רכס

- במקום

- לְהַגִיעַ

- מגיע

- חומר עיוני

- קיבלו

- לאחרונה

- מוּמלָץ

- להתייחס

- בדבר

- מוסדר

- תקנון

- קָשׁוּר

- לשחרר

- רלוונטי

- דת

- חזר

- להחליף

- בקשות

- נדרש

- מחקר

- חוקר

- משאבים

- כבוד

- להגיב

- תגובה

- אחראי

- באחריות

- REST

- תוצאה

- תוצאות

- לַחֲזוֹר

- סקירה

- לעלות

- הסיכון

- מְסוּכָּן

- מפת דרכים

- תפקיד

- תפקידים

- כללי

- הפעלה

- פועל

- בטוח

- אמצעי הגנה

- בְּטִיחוּת

- בעל חכמים

- SageMaker Inference

- להרחבה

- סולם

- מדע

- מַדְעָן

- Sdk

- חיפוש

- חיפוש

- שְׁנִיָה

- סעיף

- סעיפים

- לבטח

- אבטחה

- לִרְאוֹת

- בחר

- לחצני מצוקה לפנסיונרים

- רגיש

- משפט

- רגשות

- רצף

- סדרה

- שרות

- שירותים

- סט

- מיני

- משותף

- צריך

- לְהַצִיג

- הראה

- הראה

- יחיד

- So

- חֶברָתִי

- מדיה חברתית

- חֶברָה

- תוכנה

- מהנדס תוכנה

- פִּתָרוֹן

- פתרונות

- מיוחד

- ספציפי

- מפורט

- הוצאה

- תקנים

- החל

- החל

- סטטיסטי

- סטטיסטיקה

- שלב

- צעדים

- עוד

- עוצר

- אסטרטגי

- אסטרטגיות

- סטודיו

- מוצלח

- כזה

- התאבדות

- תמיכה

- תומך

- בטוח

- תחביר

- מערכת

- מערכות

- לקחת

- המשימות

- משימות

- נבחרת

- תבנית

- תבניות

- tensorflow

- מונחים

- מבחן

- נבדק

- טֶקסט

- מֵאֲשֶׁר

- זֶה

- השמיים

- העתיד

- המידע

- גְנֵבָה

- שֶׁלָהֶם

- אותם

- עצמם

- אז

- שם.

- אלה

- הֵם

- שְׁלִישִׁי

- צד שלישי

- צד שלישי

- זֶה

- אלה

- דרך

- זמן

- סדרת זמן

- ל

- היום

- יַחַד

- אסימון

- מטבעות

- כלי

- כלים

- נושאים

- רכבת

- מְאוּמָן

- הדרכה

- תרגום

- נסיעה

- נָכוֹן

- סומך

- לנסות

- תור

- סוגים

- בדרך כלל

- ui

- בסופו של דבר

- תחת

- להבין

- אוניברסיטה

- אוניברסיטת קליפורניה

- לפתוח

- עד

- us

- נוֹהָג

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמש

- שימושים

- באמצעות

- ערך

- ערכים

- מגוון

- גרסה

- לצפיה

- הופר

- מפר

- אלימות

- חזון

- חזותי

- ללכת

- רוצה

- דֶרֶך..

- we

- נשק

- אינטרנט

- שירותי אינטרנט

- המבוסס על האינטרנט

- מה

- מתי

- אם

- אשר

- מי

- כל

- רָחָב

- יישומון

- יצטרך

- רצון

- עם

- בתוך

- לְלֹא

- Word

- מילים

- תיק עבודות

- זרימת עבודה

- עובד

- היה

- york

- אתה

- זפירנט