היום, אנו מכריזים על זמינות הציבור של הטכנולוגיה המתקדמת של אמזון Alexa Teacher Model עם 20 מיליארד פרמטרים (AlexaTM 20B) דרך אמזון SageMaker JumpStart, מרכז למידת המכונה של SageMaker. AlexaTM 20B הוא מודל שפה רב לשוני בקנה מידה גדול מרצף לרצף (seq2seq) שפותח על ידי אמזון. אתה יכול להשתמש ב- AlexaTM 20B עבור מגוון רחב של מקרי שימוש בתעשייה, מסיכום דוחות כספיים ועד למענה על שאלות עבור צ'אטבוטים של שירות לקוחות. ניתן ליישם אותו גם כאשר יש רק כמה דוגמאות הדרכה זמינות, או אפילו אף אחת. AlexaTM 20B ביצועים טובים יותר 175 מיליארד דגם GPT-3 על משימות למידה ב-Zero-shot כגון SuperGLUE ומראה ביצועים עדכניים למשימות אפס-shot רב לשוניות כגון XNLI.

בפוסט זה, אנו מספקים סקירה כללית כיצד לפרוס ולהפעיל הסקה עם מודל AlexaTM 20B באופן תכנותי באמצעות ממשקי API של JumpStart, הזמינים ב- SageMaker Python SDK. אנו מדגימים כיצד ניתן להשתמש במודל זה כדי לתרגם בין מספר שפות, לסכם טקסט ארוך, לענות על שאלות המבוססות על הקשר נתון וליצור טקסט שלא ניתן להבחין בו מטקסט שנכתב על ידי אדם.

AlexaTM 20B ולמידה בתוך הקשר

התוכנית Alexa Teacher Model (AlexaTM) של Amazon Alexa AI נועדה לבנות מודלים של למידה עמוקה בקנה מידה גדול ורב לשוני (בעיקר מבוססי רובוטריקים), במטרה לשפר הכללה וטיפול במחסור בנתונים עבור משימות במורד הזרם. עם הכשרה מוקדמת בקנה מידה גדול, מודלים של מורים יכולים להכליל היטב כדי ללמוד משימות חדשות מנתונים דלילים ולעזור למפתחים לשפר ביצועים במשימות במורד הזרם. AlexaTM 20B הראה ביצועים תחרותיים על מדדים ומשימות נפוצות של עיבוד שפה טבעית (NLP), כגון תרגום מכונה, הפקת נתונים וסיכום.

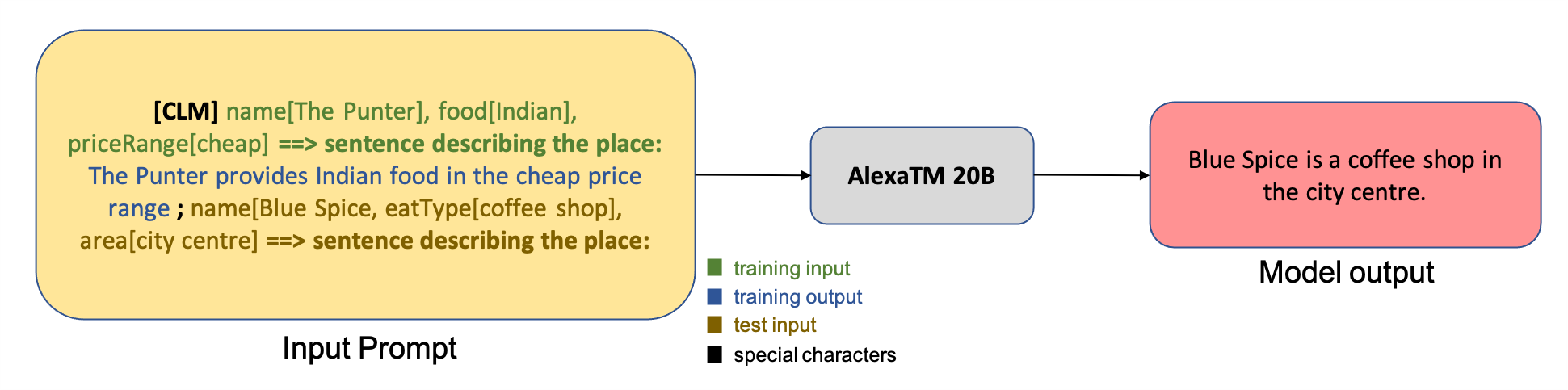

שימוש במודלים של בסיס כגון AlexaTM 20B מפחית את הצורך בהכשרה מוקדמת של מודלים יקרים ומספק נקודת התחלה עדכנית לפיתוח מודלים של משימות עם פחות מאמץ ופחות נתוני אימון ספציפיים למשימה. אחת היכולות המרכזיות של מודלים של בסיס היא שאנו יכולים ללמד מודל לבצע משימות חדשות כגון שאלות ותשובות בשפות שונות, עם כמויות קטנות מאוד של דוגמאות קלט וללא צורך בשינוי עדין או עדכוני שיפוע. זה ידוע בשם למידה בתוך הקשר. עם דוגמאות בודדות של משימה חדשה שסופקו כהקשר להסקת מסקנות, מודל AlexaTM 20B יכול להעביר ידע ממה שנלמד במהלך אימון מקדים בקנה מידה גדול, אפילו בין שפות. זה נקרא כמה יריות למידה. במקרים מסוימים, המודל יכול לתפקד היטב ללא נתוני אימון כלל, עם הסבר בלבד של מה יש לחזות. זה נקרא אקדח למידה. לדוגמה, נניח שאנו משתמשים ב-AlexaTM 20B ליצירת שפה טבעית חד-פעמית. הקלט המועבר למודל הוא דוגמה לאימון בצורה של צמדי תכונה-ערך, יחד עם נרטיב טקסט הפלט המתאים לו. לאחר מכן מצורפת דוגמה לבדיקה כדי ליצור את שורת הקלט המלאה, כפי שמוצג באיור הבא.

למידע נוסף על הדגם, בדוק מודל Alexa בעל פרמטר 20B מציב סימנים חדשים בלמידה של מספר יריות או המקור מאמר.

השימוש ב- AlexaTM 20B זמין לשימוש לא מסחרי ומכוסה תחת הסכם רישיון Alexa Teacher Model.

סקירת פתרונות

הסעיפים הבאים מספקים הדגמה שלב אחר שלב כיצד לפרוס את המודל, להפעיל מסקנות ולעשות למידה בהקשר כדי לפתור משימות למידה של מספר יריות.

שימו לב שהסעיף הבא מכיל קטעי קוד; הקוד המלא עם כל השלבים בהדגמה זו זמין במחברת המצורפת: למידה בהקשר עם AlexaTM 20B ב- SageMaker JumpStart.

פרוס את הדגם

כדי להשתמש במודל שפה גדול ב- SageMaker, אתה צריך סקריפט מסקנות ספציפי למודל, הכולל שלבים כמו טעינת מודל, הקבילה ועוד. אתה גם צריך ליצור בדיקות מקצה לקצה עבור סקריפטים, מודל וסוגי המופעים הרצויים כדי לאמת ששלושתם יכולים לעבוד יחד. JumpStart מסירה את המאמץ הזה על ידי אספקת סקריפטים מוכנים לשימוש שנבדקו היטב.

SageMaker נותן לך את היכולת להפעיל קונטיינרים של Docker באופן נרחב לצורך הדרכה והסקת מסקנות. JumpStart משתמש אלה, הספציפיים למסגרת הזמינים מכולות ללמידה עמוקה של SageMaker (DLCs). נתחיל באחזור ה-DLC המותאם (deploy_image_uri) משתמש ב model_id. ואז אנחנו מביאים את model_uri המכיל את פרמטרי המודל, יחד עם סקריפטים לטיפול בהסקת מסקנות וכל תלות קשורה. לאחר מכן, אנו יוצרים א דוגמה לדוגמא ב- SageMaker ופרסו אותו לנקודת קצה בזמן אמת. ראה את הקוד הבא:

פריסת AlexaTM 20B דורשת מופע מגובה GPU עם לפחות 50 GB של זיכרון CPU ולפחות 42 GB של זיכרון GPU. SageMaker מספקת מקרים רבים כאלה התומכים בהסקה בזמן אמת. בדקנו את הפתרון הזה בשלושה מקרים: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge. ראה את הקוד הבא:

לאחר מכן, אנו פורסים את המודל לנקודת קצה של SageMaker בזמן אמת:

AlexaTM 20B דורש 40 ג'יגה-בייט של שטח דיסק במיכל ההסקה. מופע ml.g4dn.12xlarge עונה על הדרישה הזו. לדוגמה, סוגים ml.p3.8xlarge ו-ml.p3.16xlarge, אנו מצרף חנות בלוקים אלסטית של אמזון (Amazon EBS) נפח לטיפול בגודל הדגם הגדול. לכן, קבענו volume_size = None בעת פריסה על ml.g4dn.12xlarge ו volume_size=256 בעת פריסה על ml.p3.8xlarge או ml.p3.16xlarge.

פריסת המודל עשויה להימשך עד 10 דקות. לאחר פריסת המודל, נוכל לקבל ממנו תחזיות בזמן אמת!

הפעל מסקנות

AlexaTM 20B הוא מודל ליצירת טקסט אשר בהינתן רצף חלקי (משפט או קטע טקסט), יוצר את קבוצת המילים הבאה. קטע הקוד הבא נותן לך הצצה כיצד לבצע שאילתות על נקודת הקצה שפרסנו ולנתח את הפלטים עבור משימת השלמה אוטומטית. כדי לשלוח בקשות למודל פרוס, אנו משתמשים במילון JSON מקודד בפורמט UTF-8. תגובת נקודת הקצה היא אובייקט JSON המכיל רשימה של טקסטים שנוצרו.

לאחר מכן, נשאל את נקודת הקצה וננתח את התגובה על טקסט קלט לדוגמה:

AlexaTM 20B תומך כיום ב-10 פרמטרים של יצירת טקסט במהלך הסקה: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_p, ו seed. למידע מפורט על ערכים חוקיים עבור כל פרמטר והשפעתם על הפלט, עיין במחברת המצורפת: למידה בהקשר עם AlexaTM 20B ב- SageMaker JumpStart.

למידה בתוך הקשר

למידה בתוך הקשר מתייחסת לדברים הבאים: אנו מספקים למודל השפה הנחיה, המורכבת מאימון צמדי קלט-פלט המדגימים את המשימה. אנו מוסיפים קלט מבחן להנחיה ומאפשרים למודל השפה לבצע חיזויים על ידי התניה על ההנחיה וחיזוי האסימונים או המילים הבאים. זוהי טכניקה יעילה ביותר לפתרון מעט בעיות של לימוד יריות, שבה אנו לומדים משימה מכמה דוגמאות אימון.

לאחר מכן, אנו מראים כיצד ניתן להשתמש ב- AlexaTM 20B עבור מספר משימות של צילום 1 ואפס באמצעות למידה בתוך הקשר. שלא כמו מודלים קודמים של רצף לרצף, AlexaTM 20B הוכשר על מודלים של שפה סיבתית בנוסף ל-denoising, מה שהופך אותו למודל טוב ללמידה בתוך הקשר.

סיכום טקסט של צילום אחד

סיכום טקסט הוא המשימה של קיצור הנתונים ויצירת סיכום המייצג את המידע החשוב ביותר הקיים בטקסט המקורי. סיכום טקסט 1-shot מתייחס להגדרה שבה אנו לומדים לסכם את הטקסט על סמך מדגם אימון בודד. הקוד הבא הוא דוגמה לסיכום טקסט מתוך מערך נתונים של XSUM:

אנו משתמשים בהנחיה הבאה לסיכום כאשר מסופקת רק מדגם הדרכה אחד. הטקסט שנוצר מהמודל מתפרש כסיכום החזוי של מאמר הבדיקה.

הפלט הוא כדלקמן:

יצירת שפה טבעית 1-shot

יצירת שפה טבעית היא המשימה של הפקת נרטיבים של טקסט בהינתן טקסט הקלט. המדגם הבא מציג מדגם הדרכה מה- מערך נתונים של E2E:

אנו משתמשים בהנחיה הבאה ליצירת שפה טבעית כאשר מסופקת רק דגימת אימון אחת (1-shot). הטקסט שנוצר מהמודל מתפרש כנרטיב הטקסט החזוי עבור קלט הבדיקה (test_inp).

הפלט הוא כדלקמן:

תרגום מכונה 1-shot

תרגום מכונה הוא המשימה של תרגום טקסט משפה אחת לאחרת. הדוגמה הבאה מציגה מדגם הדרכה מה- מערך נתונים של WMT19 שבו עלינו לתרגם מגרמנית לאנגלית:

אנו משתמשים בהנחיה הבאה לתרגום מכונה כאשר מסופקת רק דגימת אימון אחת (1-shot). טקסט שנוצר מהמודל מתפרש כתרגום של קלט הבדיקה (test_inp).

הפלט הוא כדלקמן:

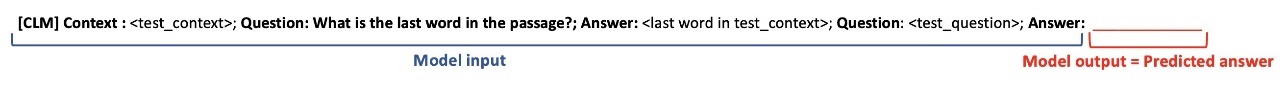

תשובה לשאלת חילוץ אפס-שוט

תשובה לשאלות חילוץ היא המשימה של מציאת התשובה לשאלה מפסקת ההקשר. להלן דוגמה להקשר ולשאלה מה- מערך נתונים של SQuAD v2:

שימו לב שאין לנו דוגמאות הדרכה למשימה שלנו. במקום זאת, אנו יוצרים שאלת דמה לגבי המילה האחרונה בהנחיה , על סמך ה test_context (דמה-shot). לכן, אנחנו למעשה מבצעים תשובות לשאלות מיצוי אפס.

אנו משתמשים בהנחיה הבאה לתשובה לשאלות מיצוי כאשר לא מסופקת מדגם הדרכה. טקסט שנוצר מהמודל מתפרש כתשובה לשאלת המבחן.

הפלט הוא כדלקמן:

הנדסה מהירה

הנדסה מהירה יכולה לפעמים להיות אומנות. אפילו שינויים קטנים בתבנית ההנחיה יכולים לגרום לשינויים משמעותיים בביצועי המודל במשימה ספציפית. להלן כמה עצות לכתיבת תבניות בקשות טובות. ראשית, חשוב לזכור שהמודל הוכשר ללמוד את המבנה של משפטים אמיתיים (מודל שפה סיבתית). ככזה, עדיף לוודא שתבנית ההנחיה שלך נכונה מבחינה דקדוקית ומבנית בשפה טבעית. שנית, הדגם המסוים הזה נהנה מצילומי דמה כדי לעזור ללמד אותו את המבנה הצפוי בתשובה, כפי שהודגם לעיל. שלישית, תמיד מומלץ לבחון את ביצועי המשימות על פני מגוון תבניות של מועמדות להנחיות. הנחה ו הוראות טבעיות הן שתי מסגרות קוד פתוח לסטנדרטיזציה של תבניות הנחיות, והן מספקות מגוון הנחיות לדוגמה המשמשות למשימות דוגמנות קיימות. בנוסף, נספח ב' של נייר AlexaTM 20B מספק את תבניות ההנחיות המשמשות ליצירת התוצאות המוצגות במאמר. ישנו תת-תחום הולך וגדל המוקדש ליצירה ולמידה אוטומטית של ההנחיות הטובות ביותר למשימה, כולל שפה טבעית והנחיות מתמשכות. זה מעבר להיקף של הדרכה זו.

סיכום

בפוסט זה, הראינו כיצד לפרוס את מודל AlexaTM 20B על נקודת קצה של SageMaker ולהפעיל מסקנות. אתה יכול להשתמש במודל AlexaTM 20B ללמידה בתוך הקשר עבור מגוון משימות למידה של מספר יריות. למידע נוסף על AlexaTM 20B, עיין ב מודל Alexa בעל פרמטר 20B מציב סימנים חדשים בלמידה של מספר יריות או המקור מאמר.

המחברים מבקשים להכיר בתרומותיהם הטכניות של Maciej Rudnicki, Jakub Debski, Ashish Khetan, Anastasiia Dubinina, Vitaliy Korolev, Karl Albertsen, Saleh Soltan, ו-Mariusz Momotko לקראת השקה זו.

על JumpStart

JumpStart הוא מרכז למידת המכונה (ML) של Amazon SageMaker שמציע למעלה מ-350 דגמים מאומנים מראש, אלגוריתמים מובנים ותבניות פתרונות מובנות מראש כדי לעזור לך להתחיל עם ML במהירות. JumpStart מארח דגמים חדישים ממרכזי דגמים פופולריים כגון TensorFlow, PyTorch, Hugging Face ו-MXNet, התומכים במשימות ML פופולריות כגון זיהוי אובייקטים, סיווג טקסט ויצירת טקסט. קהילת המחקר של ML השקיעה מאמץ רב כדי להפוך את רוב המודלים שפותחו לאחרונה לזמינים לשימוש הציבור. JumpStart שואפת לעזור לך למצוא נכון את המודלים והאלגוריתמים של ML, ולהתחיל מיד לבנות מודלים. באופן ספציפי, JumpStart מספק את היתרונות הבאים:

- גישה קלה עם ממשק המשתמש וה-SDK - אתה יכול לגשת לדגמים ואלגוריתמים ב-JumpStart באופן פרוגרמטי באמצעות SageMaker Python SDK או דרך JumpStart UI באמזון SageMaker Studio. נכון לעכשיו, AlexaTM 20B נגיש רק דרך SageMaker Python SDK.

- אלגוריתמים מובנים של SageMaker - JumpStart מספקת למעלה מ-350 אלגוריתמים מובנים ומודלים מאומנים מראש, יחד עם סקריפטים הדרכה מתאימים (אם נתמכים), סקריפטים להסקת מסקנות ומחברות לדוגמה. סקריפטים מותאמים לכל מסגרת ומשימה, ומספקים תכונות כגון תמיכה ב-GPU, כוונון דגמים אוטומטי והדרכה מצטברת. סקריפטים נבדקים גם מול מופעים ותכונות של SageMaker כדי שלא תתקלו בבעיות תאימות.

- פתרונות מובנים מראש – JumpStart מספקת קבוצה של 23 פתרונות למקרי שימוש נפוצים ב-ML, כגון חיזוי ביקוש ויישומים תעשייתיים ופיננסיים, אותם תוכל לפרוס בכמה קליקים בלבד. פתרונות הם יישומי ML מקצה לקצה המחברים שירותי AWS שונים כדי לפתור מקרה שימוש עסקי מסוים. הם משתמשים בתבניות AWS CloudFormation ובארכיטקטורות התייחסות לפריסה מהירה, מה שאומר שהן ניתנות להתאמה אישית מלאה.

- תמיכה – SageMaker מספקת מגוון תמיכה, כגון שמירה על גרסאות עדכניות כאשר תכונות חדשות של SageMaker או גרסאות Deep Learning Container יוצאות לאור, ויצירת תיעוד על אופן השימוש בתכני JumpStart בסביבת SageMaker.

למידע נוסף על JumpStart וכיצד ניתן להשתמש במודלים מאומנים מראש בקוד פתוח עבור מגוון משימות ML אחרות, בדוק את הדברים הבאים סרטון AWS re:Invent 2020.

על הכותבים

ד"ר Vivek Madan הוא מדען יישומי בצוות אמזון SageMaker JumpStart. הוא קיבל את הדוקטורט שלו מאוניברסיטת אילינוי באורבנה-שמפיין והיה חוקר פוסט דוקטורט בג'ורג'יה טק. הוא חוקר פעיל בלמידת מכונה ועיצוב אלגוריתמים ופרסם מאמרים בכנסים של EMNLP, ICLR, COLT, FOCS ו-SODA.

ד"ר Vivek Madan הוא מדען יישומי בצוות אמזון SageMaker JumpStart. הוא קיבל את הדוקטורט שלו מאוניברסיטת אילינוי באורבנה-שמפיין והיה חוקר פוסט דוקטורט בג'ורג'יה טק. הוא חוקר פעיל בלמידת מכונה ועיצוב אלגוריתמים ופרסם מאמרים בכנסים של EMNLP, ICLR, COLT, FOCS ו-SODA.

ג'ק פיצ'רלד הוא מדען יישומי בכיר עם Alexa AI, שם הוא מתמקד כיום במודלים של שפות גדולות, מודלים של טקסט רב לשוני ופעולות למידת מכונה.

ג'ק פיצ'רלד הוא מדען יישומי בכיר עם Alexa AI, שם הוא מתמקד כיום במודלים של שפות גדולות, מודלים של טקסט רב לשוני ופעולות למידת מכונה.

ז'ואאו מורה הוא אדריכל פתרונות AI/ML מומחה בשירותי האינטרנט של אמזון. הוא מתמקד בעיקר במקרים של שימוש ב-NLP ובעזרה ללקוחות לייעל אימון ופריסה של מודל למידה עמוקה. הוא גם חסיד פעיל של פתרונות ML בעלי קוד נמוך וחומרה מתמחה ב-ML.

ז'ואאו מורה הוא אדריכל פתרונות AI/ML מומחה בשירותי האינטרנט של אמזון. הוא מתמקד בעיקר במקרים של שימוש ב-NLP ובעזרה ללקוחות לייעל אימון ופריסה של מודל למידה עמוקה. הוא גם חסיד פעיל של פתרונות ML בעלי קוד נמוך וחומרה מתמחה ב-ML.

יוני זכה הוא מנהל מוצר עם SageMaker JumpStart ואלגוריתמים מובנים. הוא מתמקד בהפיכת תוכן ML לגילוי וניתן לשימוש בקלות עבור לקוחות SageMaker.

יוני זכה הוא מנהל מוצר עם SageMaker JumpStart ואלגוריתמים מובנים. הוא מתמקד בהפיכת תוכן ML לגילוי וניתן לשימוש בקלות עבור לקוחות SageMaker.

פולקיט קפור היא המובילה במוצר עבור תוכנית Alexa Teacher Model עם Alexa AI, תוך התמקדות באינטליגנציה כללית ויישומים של מודלי היסוד הרב-תכליתי של אלקסה.

פולקיט קפור היא המובילה במוצר עבור תוכנית Alexa Teacher Model עם Alexa AI, תוך התמקדות באינטליגנציה כללית ויישומים של מודלי היסוד הרב-תכליתי של אלקסה.

- AI

- איי אמנות

- מחולל אמנות ai

- איי רובוט

- אמזון SageMaker

- אמזון SageMaker JumpStart

- בינה מלאכותית

- הסמכת בינה מלאכותית

- בינה מלאכותית בבנקאות

- רובוט בינה מלאכותית

- רובוטים של בינה מלאכותית

- תוכנת בינה מלאכותית

- למידת מכונות AWS

- blockchain

- blockchain conference ai

- קוינגניוס

- בינה מלאכותית של שיחה

- קריפטו כנס ai

- של דאל

- למידה עמוקה

- יסודי (100)

- גוגל איי

- למידת מכונה

- אפלטון

- plato ai

- מודיעין אפלטון

- משחק אפלטון

- אפלטון נתונים

- פלטוגיימינג

- סולם ai

- תחביר

- זפירנט