הגודל ההולך וגדל של מודלים של שפה הייתה אחת המגמות הגדולות ביותר בעיבוד שפה טבעית (NLP) בשנים האחרונות. מאז 2018, ראינו פיתוח ופריסה חסרי תקדים של דגמי שפה גדולים מתמיד, כולל BERT והגרסאות שלו, GPT-2, T-NLG ו-GPT-3 (175 מיליארד פרמטרים).

מודלים אלה דחפו את הגבולות של חידושים אדריכליים אפשריים. אנו מתמודדים עם מספר אתגרים בעת אימון מודלים של למידה עמוקה בקנה מידה גדול, במיוחד הגל החדש של שנאים שהוכשרו מראש. האתגרים הללו כוללים מגבלות חומרה ופשרות עם חישוב ויעילות. כדי להתגבר על האתגרים הללו של מקביליות מודלים ונתונים, AWS מציעה מגוון רחב של יכולות.

בפוסט זה, אנו מציגים שתי גישות עיקריות: הקבילת נתונים ושימוש בהקבלת מודלים אמזון SageMaker, ולדון ביתרונות ובחסרונות שלהם.

המודל

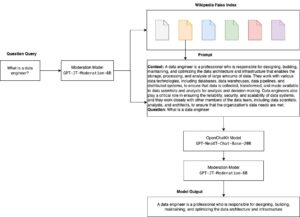

עבור מודל השפה, אנו משתמשים ברובוטריקים, שהוצגו בעיתון תשומת הלב היא כל מה שאתה צריך. רובוטריקים הם מודלים של למידה עמוקה שנועדו להימנע במכוון מהמלכודות של RNNs על ידי הסתמכות על מנגנון תשומת לב עצמית כדי למשוך תלות גלובלית בין קלט ופלט. ארכיטקטורת מודל ה-Transformer מאפשרת הקבלה טובה משמעותית ויכולה להגיע לביצועים גבוהים בזמן אימון קצר יחסית. נבנה על הצלחת רובוטריקים, BERT, שהוצגה בעיתון BERT: הכשרה מקדימה של רובוטריקים דו כיווניים עמוקים להבנת שפה, הוספה הדרכה דו-כיוונית לייצוג שפה. בהשראת משימת ה-Cloze, BERT עבר הכשרה מוקדמת עם מודלים של שפה מסיכה (MLM), שבה המודל לומד לשחזר את המילים המקוריות עבור אסימונים המסוכים באופן אקראי. מודל BERT מיומן מראש גם במשימת חיזוי המשפט הבא (NSP) כדי לחזות אם שני משפטים נמצאים בסדר הקריאה הנכון. מאז הופעתו ב-2018, נעשה שימוש נרחב ב-BERT והווריאציות שלו במודלים של שפה.

אנו מתחילים ביצירת שתי שכבות הטבעה להטמעה אסימון ומיקום. הטבעות הקלט הן הסכום של הטבעות האסימון והטבעות המיקום.

לאחר מכן אנו מגדירים בלוק מפענח שנאי עם שתי שכבות משנה: שכבת תשומת לב עצמית מרובת ראשים, ורשת הזנה קדימה פשוטה המחוברת במלואה ולאחריה נורמליזציה ונשירת שכבות:

לבסוף, אנו יוצרים את מודל השפה שלנו עם שכבת ההטמעה הקודמת ובלוקי שנאי:

בהתאם לפרמטרים ההיפר שלך, אתה יכול לשנות את המודל הזה מאלפי פרמטרים למיליארדי פרמטרים. האתגר העיקרי עם מודלים של מיליארד פרמטרים הוא שאתה לא יכול לארח את המודל במופע אחד וצריך להפיץ את המודל על מספר צמתים לצורך אימון והסקת מסקנות.

מערך הנתונים

בניסויים שלנו, השתמשנו ב- ערימה של מערך נתונים. The Pile הוא מערך נתונים באנגלית של 800 GiB המיועד לאימון מודלים של שפות בקנה מידה גדול. הוא נוצר מ-22 מערכי נתונים מגוונים ואיכותיים, כולל מערכי נתונים מבוססים של NLP וגם אלה שהוצגו לאחרונה.

מערך הנתונים נוצר ממגוון מקורות נתונים, כולל ספרים; מאגרי GitHub; דפי אינטרנט; יומני צ'אט; ומאמרי רפואה, פיזיקה, מתמטיקה, מדעי המחשב ופילוסופיה. באופן ספציפי, הוא משתמש במקורות הבאים: Pile-CC, PubMed Central, ArXiv, GitHub, the FreeLaw Project, Stack Exchange, משרד הפטנטים והסימנים המסחריים בארה"ב, PubMed, Ubuntu, IRC, HackerNews, YouTube, PhilPapers, Books3, Project Gutenberg ( PG-19), OpenSubtitles, ויקיפדיה באנגלית, DM Mathematics, EuroParl, קורפוס האימיילים של Enron ו-NIH Exporter. זה כולל גם את OpenWebText2 ו-BookCorpus2, שהם הרחבות של מערכי הנתונים המקוריים של OpenWebText ו-BookCorpus, בהתאמה. הגיוון במקורות הנתונים יכול לשפר את הידע הכללי בין התחומים ובעקבות כך לשפר את יכולות ההכללה במורד הזרם.

האתגר העיקרי עם מערך הנתונים הזה הוא הגודל העצום; למערך הנתונים יש 825 GiB של טקסט, שמתורגמים ל-4.2 TiB של נקודות נתונים מעובדות ודחוסות מראש. בדומה לאתגרים העומדים בפנינו בהדרכה ואירוח המודלים, אימון מודל עם מערך נתונים זה על מופע בודד ייקח הרבה זמן ואינו מעשי.

הפתרון שלנו הוא לפרק את מערך הנתונים לכ-1 GiB של נתונים, לטעון ולעבד מראש את התכונות ב ערכת נתונים של TensorFlow חפצים, ולאחסן אותם שירות קבצים אלסטי של אמזון (Amazon EFS). מערכי נתונים של TensorFlow מספקים צינור נתונים קל לשימוש ובעל ביצועים גבוהים המשתלב היטב עם המודלים שלנו. Amazon EFS הוא שירות קל לשימוש המאפשר לנו לבנות מערכת קבצים משותפת שמתרחבת באופן אוטומטי עם הוספה ונמחקת קבצים. בנוסף, אמזון EFS מסוגלת לפרוץ לרמות תפוקה גבוהות יותר בעת הצורך, וזה קריטי בצנרת ההדרכה של הנתונים והמודלים שלנו.

לאחר מכן, אנו בוחנים אסטרטגיות הכשרה מבוזרות להתמודדות עם אתגרים אלו.

אימונים מבוזרים

בפרויקט זה התמודדנו עם שני אתגרים: קנה מידה של גודל המודל ונפח הנתונים. הגדלת גודל הדגם ומספר הפרמטרים הניתנים לאימון עשויה להביא לדיוק טוב יותר, אך יש גבול לדגם שניתן להכניס לזיכרון GPU בודד או אפילו למספר GPUs במופע אחד. בנוסף, לגדלים גדולים יותר לוקח יותר זמן להתאמן.

אתה יכול להתמודד עם אתגרים אלה בשתי דרכים שונות: מקביליות נתונים ומקביליות מודל. עם מקביליות נתונים, אנו מבצעים ירידה בדרגה סטוקהסטית (SGD) על ידי הפצת הרשומות של מיני-אצט על גבי מכשירים שונים כדי להאיץ את האימון. עם זאת, אימון נתונים מקביל מגיע עם מורכבות נוספת של מחשוב ממוצע שיפוע מיני-אצווה עם שיפועים מכל המכשירים, שלב שנקרא AllReduce, מה שהופך קשה יותר ככל שאשכול האימונים גדל. תוך כדי שימוש מקביליות נתונים, עלינו להיות מסוגלים להתאים את הדגם ונקודת נתונים בודדת במכשיר (CPU או GPU), וזה גורם מגביל בניסויים שלנו מכיוון שגודלו של דגם גדול כל כך גדול בהרבה מהזיכרון של ה-GPU היחיד. גודל.

פתרון נוסף הוא שימוש מקביליות מודל, אשר מפצלת את הדגם על פני מספר מכשירים. מקביליות מודל היא תהליך של פיצול מודל בין התקנים או צמתים מרובים (כגון מופעים המצוידים ב-GPU) ויצירת צינור יעיל לאימון המודל על פני מכשירים אלה כדי למקסם את ניצול ה-GPU.

הקבילת נתונים

הקבילה של הנתונים היא הגישה הנפוצה ביותר למספר GPUs או אימון מבוזר. אתה יכול לקבץ את הנתונים שלך, לשלוח אותם למספר מכשירים (כל אחד מארח דגם משוכפל), ואז לצבור את התוצאות. התנסינו בשתי חבילות להקבילת נתונים: Horovod וה- SageMaker הפיצה ספריית נתונים מקבילה.

Horovod היא מסגרת אימון למידה עמוקה מבוזרת עבור TensorFlow, Keras, PyTorch ו- Apache MXNet. כדי להשתמש בהרובוד, עברנו את התהליך הבא:

- אתחול על ידי ריצה

hvd.init(). - שייך כל מכשיר לתהליך יחיד. התהליך או העובד הראשון משויכים למכשיר הראשון, התהליך השני משויך למכשיר השני וכן הלאה.

- התאם את קצב הלמידה בהתאם למספר המכשירים.

- עטפו את האופטימיזציה

hvd.DistributedOptimizer. - שדר את מצבי המשתנים ההתחלתיים מהעובד הראשון עם דרגה 0 לכל שאר התהליכים. זה הכרחי כדי להבטיח אתחול עקבי של כל העובדים כאשר האימון מתחיל עם משקלים אקראיים או משוחזר ממחסום.

- ודא שרק מכשיר 0 יכול לשמור נקודות ביקורת כדי למנוע מעובדים אחרים להשחית אותם.

להלן תסריט האימון:

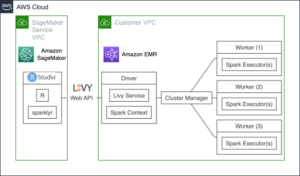

ספריית הנתונים המקבילים של SageMaker מאפשרת לנו להתאים את האימון שלנו ביעילות כמעט ליניארית, ולהאיץ את האימון שלנו עם שינויים מינימליים בקוד. הספרייה מבצעת מנהג AllReduce תפעול ומייעל את התקשורת בין מכשיר למכשיר על ידי ניצול מלא של תשתית הרשת של AWS ו ענן מחשוב אלסטי של אמזון (Amazon EC2) טופולוגיה של מופע. כדי להשתמש בספריית הנתונים המקבילית של SageMaker, עברנו את התהליך הבא:

- ייבוא ואתחול

sdp.init(). - שייך כל מכשיר ליחיד

smdistributed.dataparallelתהליך עםlocal_rank.sdp.tensorflow.local_rank()נותן לנו את הדירוג המקומי של מכשירים. המנהיג הוא דרגה 0, והעובדים הם דרגה 1, 2, 3 וכן הלאה. - התאם את קצב הלמידה בהתאם למספר המכשירים.

- עטוף

tf.GradientTapeעםDistributedGradientTapeלהופיעAllReduce. - שדר את משתני המודל הראשוניים מהצומת המוביל לכל צמתי העבודה.

- ודא שרק מכשיר 0 יכול לשמור נקודות ביקורת.

מקבילת מודל

אנחנו יכולים להתאים את הפרמטרים ההיפר כדי לשמור על המודל קטן מספיק כדי לאמן באמצעות GPU יחיד, או שנוכל להשתמש במקביל למודל כדי לפצל את המודל בין מספר GPUs על פני מספר מופעים. הגדלת מספר הפרמטרים הניתנים לאימון של דגם יכולה להביא לדיוק טוב יותר, אך יש גבול לגודל הדגם המקסימלי שניתן להכניס לזיכרון GPU יחיד. השתמשנו בספריית המודלים המקבילים המבוזרים של SageMaker כדי להכשיר את הדגמים הגדולים שלנו. השלבים הם כדלקמן:

- ייבא ואתחול הספרייה עם

smp.init(). - מודל Keras צריך לרשת מ-smp.DistributedModel במקום מחלקה Keras Model.

- לקבוע

drop_remainder=Trueבtf.Dataset.batch()שיטה להבטיח שגודל האצווה תמיד מתחלק במספר המיקרו-אצטות. - כל פעולות אקראיות בצנרת הנתונים צריכות להשתמש באותו סיד:

smp.dp_rank(), למשל,shuffle(ds, seed=smp.dp_rank()). זה מבטיח עקביות של דגימות נתונים על פני מכשירים המחזיקים מחיצות דגמים שונים. - היגיון קדימה ואחורה צריך להיות בפונקציה צעד עם

smp.stepקישוט. - בצע עיבוד אחר על הפלטים על פני מיקרו-אצטות באמצעות שיטות StepOutput כגון

reduce_mean. הsmp.stepלפונקציה חייב להיות ערך החזרה שתלוי בפלט שלsmp.DistributedModel.

תסריט האימון הוא כדלקמן:

למדריך מפורט להפעלת סקריפט ההדרכה של TensorFlow עבור ספריית המודל המקבילית המבוזר של SageMaker, עיין ב שנה סקריפט אימון של TensorFlow. עבור PyTorch, עיין ב שנה סקריפט אימון של PyTorch.

איתור באגים של SageMaker

בסעיפים הקודמים, דנו כיצד לייעל את האימון באמצעות טכניקות מקבילות מודלים ונתונים. עם באגים של SageMaker באמזון, כעת נוכל ללכוד מידע על פרופיל ביצועים מהריצות האימונים שלנו כדי לקבוע כמה השתפר האימון. כברירת מחדל, Debugger לוכד מדדי מערכת עבור כל עבודת אימון של SageMaker כגון GPU, ניצול מעבד, זיכרון, רשת ו-I/O במרווח דגימה של 500 אלפיות שניות. אנו יכולים לגשת לנתונים באופן הבא:

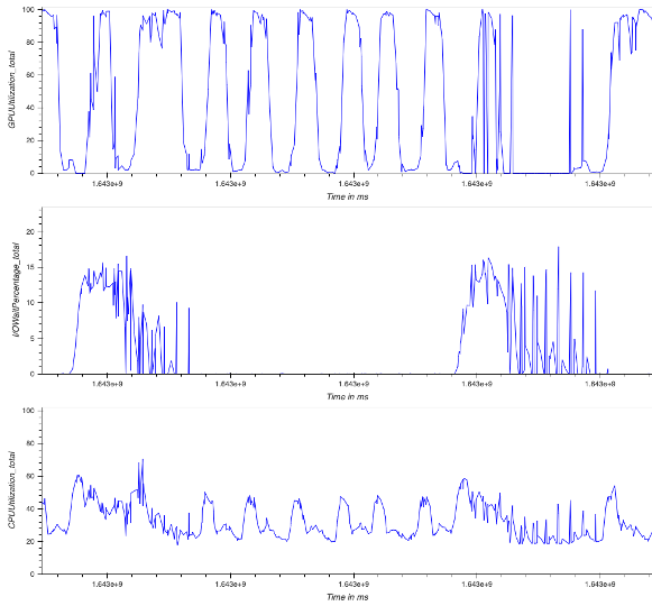

Debugger מספק כלי עזר ל לחזות נתוני הפרופיל בדרכים שונות. בדוגמה הבאה, אנו רואים את סך ניצול ה-GPU וה-CPU, כמו גם את זמן ההמתנה ל-I/O לעבודת האימון מרובת GPU באמצעות Horovod. כדי ליצור גרפים אלה, אנו מפעילים את הקוד הבא:

ניצול ה-GPU נע לעתים קרובות בין 0-100%, וזמני המתנה גבוהים ל-I/O עם ניצול GPU נמוך הם אינדיקטור של צוואר בקבוק I/O. יתר על כן, ניצול ה-CPU הכולל לעולם אינו עולה על 70%, מה שאומר שאנו יכולים לשפר את עיבוד הנתונים מראש על ידי הגדלת מספר תהליכי העבודה.

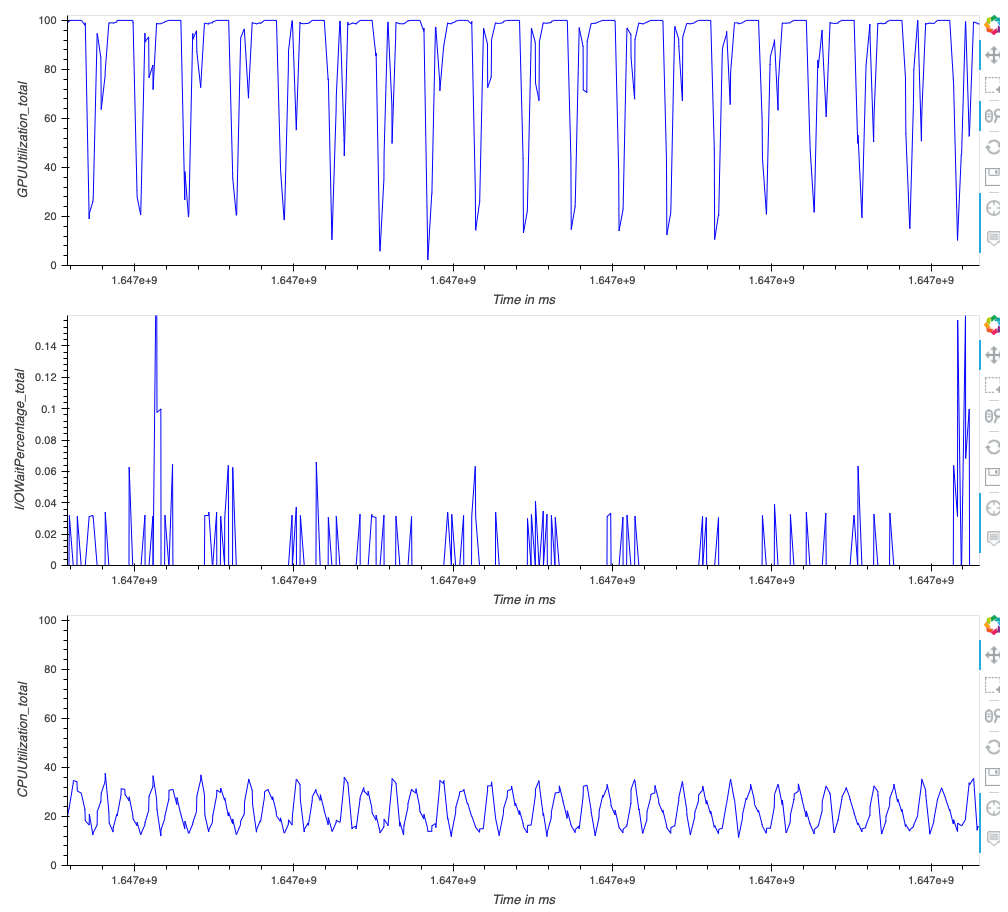

אנו יכולים לשפר את הביצועים על ידי מעבר מהורובוד לספריית הנתונים המקבילים המבוזרים של SageMaker. בגרפים הבאים, אנו יכולים לראות ש-GPUs מנוצלים בצורה יעילה יותר ורק יורדים לניצול נמוך לפרקי זמן קצרים.

תשתית הדרכה

להכשרת הדגמים, השתמשנו במופעים של 10 ml.p3.16xlarge באמצעות עבודת אימון של SageMaker. SageMaker מפחית את הזמן והעלות להכשיר ולכוונן מודלים של למידת מכונה (ML) ללא צורך בניהול תשתית. עם SageMaker, אתה יכול בקלות לאמן ולכוון מודלים של ML באמצעות כלים מובנים לניהול ומעקב אחר ניסויי אימון, לבחור אוטומטית בפרמטרים אופטימליים, לנפות באגים בעבודות אימון ולנטר את ניצול משאבי המערכת כגון GPUs, CPUs ורוחב פס רשת. הנתונים התארחו באמזון EFS, מה שאפשר לנו לגדול ולהצטמצם תוך כדי הוספה והסרה של קבצים ללא צורך בניהול או הקצאה. היעדים העיקריים שלנו היו לשפר את מהירות האימון ולהפחית עלויות.

מדרגיות מודל

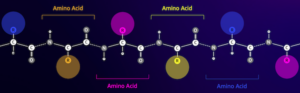

למרות שתשתית זו משמשת בעיקר ליצירת שפה, עם ארכיטקטורת GPT ומערך הנתונים של Pile, אתה יכול להשתמש בטכניקות אלו כדי להכשיר מודלים של שנאים בקנה מידה גדול, דבר שימושי בתחומים רבים מעבר ל-NLP. בלמידת מכונה עצמה, משימות ראייה ממוחשבת רבות נפתרות כעת עם ארכיטקטורות בעלות פרמטרים גדולים (שנאי), שבהן הוכח שהן עולות על רשתות CNN מסורתיות (רשת עצבית משולבת) במשימות כמו למידת ייצוג (ראה קידום המצב הטכנולוגי בראייה ממוחשבת עם רובוטריקים בפיקוח עצמי ואימונים יעילים פי 10) ומיפוי בקנה מידה גדול של תמונות לטקסט (כגון CLIP). מודלים בעלי פרמטרים גדולים פורצים דרך גם במדעי החיים בתחומים כמו ניתוח מבנה חלבון ו ניתוח נתוני תמונה רפואית.

הפתרונות שאנו מפרטים בפוסט זה להדרכה מבוזרת ולניהול מודלים גדולים צריכים לחול גם על מודלים בכל אחד מהתחומים הללו.

תמורות

בקהילת המחקר התקיים דיון מתמשך לגבי הסיכונים בהכשרת מודלים של שפה בקנה מידה גדול, והאם הושקעה מספיק מחשבה בסיכונים הפוטנציאליים הקשורים בפיתוחם ואסטרטגיות להפחתת סיכונים אלו, שחלקם כוללים את הפיננסי עלויות סביבתיות. לפי א מאמר שפורסם ב-ACM, אימון מודל בסיס BERT יחיד (ללא כוונון היפרפרמטר) על GPU הוערך כדרוש אנרגיה רבה כמו טיסה טרנס-אמריקאית. ההשפעות הסביבתיות מתארכות בהתאם לגודל הדגם, והיכולת לכוונן ביעילות מודלים כאלה עלולה לצמצם את הפליטות באופן משמעותי. AWS השיקה לאחרונה גרסה חדשה כלי טביעת רגל פחמן ללקוח, זמין לכל לקוחות AWS ללא עלות, כחלק מהמאמצים של אמזון להגביר את הקיימות ולהפחית את פליטת הפחמן. הפעלת אפליקציות על AWS Cloud עשויה להקטין את טביעת הרגל הפחמנית (בהשוואה למרכזי נתונים ארגוניים שנסקרו ב- דוח 2019).

סיכום

פוסט זה הדגים פתרון שמקל על כוונון עדין של מודלים של שפה עם מיליארד פרמטרים בענן AWS באמצעות SageMaker.

למידע נוסף על מקביליות מודל עם SageMaker, עיין אימון של 175+ מיליארד פרמטרים של דגמי NLP עם תוספות מקבילות לדגמים ו-Huging Face ב-Amazon SageMaker ו כיצד החלל הסמוי השתמש בספריית ההקבלה של אמזון SageMaker לדחיפת גבולות השנאים בקנה מידה גדול.

אם תרצה עזרה בהאצת השימוש שלך ב- ML במוצרים ובתהליכים שלך, אנא צור קשר עם מעבדת פתרונות אמזון ML.

על הכותבים

סיה גולמי הוא מדען נתונים בכיר במעבדת אמזון ML Solutions, שם הוא בונה פתרונות AI/ML עבור לקוחות בתעשיות שונות. הוא נלהב מעיבוד שפה טבעית (NLP) ולמידה עמוקה. מחוץ לעבודה, סיה נהנית לבלות בטבע ולשחק טניס.

סיה גולמי הוא מדען נתונים בכיר במעבדת אמזון ML Solutions, שם הוא בונה פתרונות AI/ML עבור לקוחות בתעשיות שונות. הוא נלהב מעיבוד שפה טבעית (NLP) ולמידה עמוקה. מחוץ לעבודה, סיה נהנית לבלות בטבע ולשחק טניס.

מהדי נוריהוא מנהל ומדען יישומי בכיר במעבדת אמזון ML Solutions, שם הוא עובד עם לקוחות בתעשיות שונות, ועוזר להם להאיץ את מסע ההגירה שלהם לענן ולפתור את בעיות ה-ML שלהם באמצעות פתרונות חדישים ו טכנולוגיות.

מהדי נוריהוא מנהל ומדען יישומי בכיר במעבדת אמזון ML Solutions, שם הוא עובד עם לקוחות בתעשיות שונות, ועוזר להם להאיץ את מסע ההגירה שלהם לענן ולפתור את בעיות ה-ML שלהם באמצעות פתרונות חדישים ו טכנולוגיות.

מוחיון קים הוא מדען נתונים במעבדת Amazon Machine Learning Solutions. הוא פותר את הבעיות העסקיות השונות של הלקוח על ידי יישום למידה מכונה ולמידה עמוקה, ועוזר להם גם להיות מיומנים.

מוחיון קים הוא מדען נתונים במעבדת Amazon Machine Learning Solutions. הוא פותר את הבעיות העסקיות השונות של הלקוח על ידי יישום למידה מכונה ולמידה עמוקה, ועוזר להם גם להיות מיומנים.

דני בירד הוא מדען יישומי במעבדת פתרונות ML של אמזון. במעבדה הוא עזר ללקוחות לפתח פתרונות ML מתקדמים, בהתמחויות ML מראייה ממוחשבת ועד למידת חיזוק. הוא נלהב לדחוף את הטכנולוגיה קדימה ולפתור פוטנציאל חדש ממוצרי AWS לאורך הדרך.

דני בירד הוא מדען יישומי במעבדת פתרונות ML של אמזון. במעבדה הוא עזר ללקוחות לפתח פתרונות ML מתקדמים, בהתמחויות ML מראייה ממוחשבת ועד למידת חיזוק. הוא נלהב לדחוף את הטכנולוגיה קדימה ולפתור פוטנציאל חדש ממוצרי AWS לאורך הדרך.

פרנסיסקו קלדרון רודריגז הוא מדען נתונים במעבדת פתרונות ML של אמזון. כחבר במעבדת פתרונות ML, הוא עוזר לפתור בעיות עסקיות קריטיות עבור לקוחות AWS באמצעות למידה עמוקה. בזמנו הפנוי, פרנסיסקו אוהב לנגן מוזיקה וגיטרה, לשחק כדורגל עם בנותיו וליהנות מזמן עם משפחתו.

פרנסיסקו קלדרון רודריגז הוא מדען נתונים במעבדת פתרונות ML של אמזון. כחבר במעבדת פתרונות ML, הוא עוזר לפתור בעיות עסקיות קריטיות עבור לקוחות AWS באמצעות למידה עמוקה. בזמנו הפנוי, פרנסיסקו אוהב לנגן מוזיקה וגיטרה, לשחק כדורגל עם בנותיו וליהנות מזמן עם משפחתו.

יוהי נקיאמה הוא אדריכל למידה עמוקה במעבדת פתרונות ML של אמזון. הוא עובד עם לקוחות בתחומים שונים כדי להאיץ את השימוש שלהם בבינה מלאכותית ובשירותי ענן AWS כדי לפתור את האתגרים העסקיים שלהם. הוא מעוניין ליישם טכנולוגיות ML/AI בתעשיית החלל.

יוהי נקיאמה הוא אדריכל למידה עמוקה במעבדת פתרונות ML של אמזון. הוא עובד עם לקוחות בתחומים שונים כדי להאיץ את השימוש שלהם בבינה מלאכותית ובשירותי ענן AWS כדי לפתור את האתגרים העסקיים שלהם. הוא מעוניין ליישם טכנולוגיות ML/AI בתעשיית החלל.

נטלי ראושמאייר היא מדענית שימושית בכירה ב-AWS, שם היא עוזרת ללקוחות לפתח יישומי למידה עמוקה.

נטלי ראושמאייר היא מדענית שימושית בכירה ב-AWS, שם היא עוזרת ללקוחות לפתח יישומי למידה עמוקה.

- Coinsmart. בורסת הביטקוין והקריפטו הטובה באירופה.

- Platoblockchain. Web3 Metaverse Intelligence. ידע מוגבר. גישה חופשית.

- CryptoHawk. רדאר אלטקוין. ניסיון חינם.

- מקור: https://aws.amazon.com/blogs/machine-learning/create-train-and-deploy-a-billion-parameter-language-model-on-terabytes-of-data-with-tensorflow-and- amazon-sagemaker/

- "

- 10

- 100

- 2019

- a

- אודות

- להאיץ

- מאיצה

- גישה

- פי

- להשיג

- לרוחב

- הוסיף

- תוספת

- מתקדם

- תעשיות

- מאפשר

- תמיד

- אמזון בעברית

- אנליזה

- API

- יישומים

- יישומית

- החל

- מריחה

- גישה

- גישות

- בערך

- אדריכלי

- ארכיטקטורה

- אמנות

- מלאכותי

- בינה מלאכותית

- המשויך

- תשומת לב

- באופן אוטומטי

- זמין

- מְמוּצָע

- AWS

- כי

- להיות

- בֵּין

- מעבר

- גדול

- הגדול ביותר

- B

- מיליארדים

- לחסום

- ספרים

- לִבנוֹת

- בונה

- מובנה

- עסקים

- יכולות

- מסוגל

- ללכוד

- לוכדת

- פַּחמָן

- פליטת הפחמן

- מֶרכָּזִי

- לאתגר

- האתגרים

- בחרו

- בכיתה

- ענן

- שירותי ענן

- קוד

- Common

- תקשורת

- קהילה

- לעומת

- חישוב

- לחשב

- המחשב

- מדעי מחשב

- מחשוב

- מחובר

- חסרונות

- עִקבִי

- צור קשר

- עלויות

- לִיצוֹר

- נוצר

- יוצר

- יוצרים

- קריטי

- מנהג

- לקוחות

- נתונים

- מרכז נתונים

- מדען נתונים

- עמוק

- מופגן

- תלוי

- לפרוס

- פריסה

- מעוצב

- פרט

- מְפוֹרָט

- לקבוע

- לפתח

- מתפתח

- צעצועי התפתחות

- מכשיר

- התקנים

- אחר

- לדון

- מופץ

- הפצה

- גיוון

- DM

- תחומים

- מטה

- בקלות

- קל לשימוש

- יְעִילוּת

- יעיל

- יעילות

- מַאֲמָצִים

- פליטות

- לאפשר

- מאפשר

- אנרגיה

- אנגלית

- מִפְעָל

- סביבתי

- במיוחד

- נוסד

- מוערך

- דוגמה

- עולה

- חליפין

- סיומות

- פָּנִים

- פייסבוק

- מתמודד

- משפחה

- תכונות

- שדות

- כספי

- ראשון

- מתאים

- טיסה

- הבא

- כדלקמן

- עָקֵב

- קדימה

- מסגרת

- פרנסיסקו

- החל מ-

- פונקציה

- יתר על כן

- כללי

- ליצור

- דור

- גנרטטיבית

- מקבל

- GitHub

- גלוֹבָּלִי

- GPU

- GPUs

- לגדול

- מדריך

- חומרה

- לעזור

- עוזר

- גָבוֹהַ

- באיכות גבוהה

- גבוה יותר

- להחזיק

- אירח

- אירוח

- איך

- איך

- אולם

- HTTPS

- תמונה

- תמונות

- לשפר

- משופר

- לכלול

- כולל

- כולל

- להגדיל

- גדל

- מדד

- תעשיות

- תעשייה

- מידע

- תשתית

- חידושים

- קלט

- השראה

- למשל

- מוֹדִיעִין

- מעוניין

- IT

- עצמו

- עבודה

- מקומות תעסוקה

- מסע

- שמור

- ידע

- מעבדה

- תווית

- תוויות

- שפה

- גָדוֹל

- גדול יותר

- הושק

- שכבה

- מנהיג

- למידה

- רמות

- סִפְרִיָה

- מדעי חיים

- לִטעוֹן

- מקומי

- נראה

- מכונה

- למידת מכונה

- לנהל

- ניהול

- מנהל

- ניהול

- מיפוי

- מסכה

- מתמטיקה

- מתימטיקה

- אומר

- רפואי

- חבר

- זכרון

- שיטות

- מדדים

- ML

- מודל

- מודלים

- צג

- יותר

- רוב

- מספר

- כלי נגינה

- טבעי

- טבע

- הכרחי

- צרכי

- רשת

- NIH

- צמתים

- מספר

- יעדים

- המיוחדות שלנו

- Office

- מתמשך

- מבצע

- תפעול

- מטב

- להזמין

- אחר

- מאמר

- חלק

- לוהט

- פטנט

- ביצועים

- תקופות

- פילוסופיה

- פיסיקה

- לְשַׂחֵק

- משחק

- עמדה

- אפשרי

- פוטנציאל

- לחזות

- נבואה

- התחזיות

- קודם

- יְסוֹדִי

- בעיות

- תהליך

- תהליכים

- תהליך

- מוצרים

- פרופיל

- פּרוֹיֶקט

- PROS

- לספק

- מספק

- דחף

- רכס

- קריאה

- לאחרונה

- לאחרונה

- רשום

- להחלים

- להפחית

- בדבר

- נציגות

- מיוצג

- לדרוש

- מחקר

- משאבים

- תוצאות

- לַחֲזוֹר

- סיכונים

- הפעלה

- ריצה

- אותו

- סולם

- דרוג

- מדע

- מדעים

- מַדְעָן

- זרע

- שרות

- שירותים

- כמה

- SGD

- צוּרָה

- משותף

- קצר

- הראה

- דומה

- פָּשׁוּט

- since

- יחיד

- מידה

- קטן

- So

- כדורגל

- פִּתָרוֹן

- פתרונות

- לפתור

- פותר

- כמה

- מֶרחָב

- במיוחד

- מְהִירוּת

- הוצאה

- לפצל

- פיצולים

- לערום

- החל

- מדינה

- מדינה-of-the-art

- הברית

- חנות

- אסטרטגיות

- הצלחה

- קיימות

- מערכת

- משימות

- טכניקות

- טכנולוגיות

- טכנולוגיה

- השמיים

- אלפים

- דרך

- תפוקה

- זמן

- פִּי

- אסימון

- מטבעות

- כלים

- לעקוב

- סימן מסחרי

- מסורתי

- הדרכה

- מגמות

- אובונטו

- חסר תקדים

- us

- להשתמש

- כלי עזר

- ניצול

- ערך

- מגוון

- שונים

- אנכיות

- חזון

- כֶּרֶך

- לחכות

- גל

- דרכים

- אם

- בזמן

- ויקיפדיה

- לְלֹא

- מילים

- תיק עבודות

- עובד

- עובדים

- עובד

- X

- שנים

- YouTube