עם האימוץ המהיר של יישומי AI גנרטיביים, יש צורך שיישומים אלה יגיבו בזמן כדי להפחית את ההשהיה הנתפסת עם תפוקה גבוהה יותר. מודלים של בסיס (FMs) מאומנים לעתים קרובות מראש על קורפוסים עצומים של נתונים עם פרמטרים הנעים בקנה מידה של מיליונים עד מיליארדים ומעלה. מודלים של שפה גדולה (LLM) הם סוג של FM שמייצרים טקסט כתגובה להסקת המשתמש. הסקת מודלים אלה עם תצורות משתנות של פרמטרי מסקנות עשויה להוביל להשהיות לא עקביות. חוסר העקביות יכול להיות בגלל המספר המשתנה של אסימוני תגובה שאתה מצפה מהדגם או סוג המאיץ שבו הדגם נפרס.

בכל מקרה, במקום לחכות לתגובה המלאה, אתה יכול לאמץ את הגישה של הזרמת תגובות עבור ההסקות שלך, אשר שולחת חזרה נתחי מידע ברגע שהם נוצרים. זה יוצר חוויה אינטראקטיבית בכך שהוא מאפשר לך לראות תגובות חלקיות המוזרמות בזמן אמת במקום תגובה מלאה מושהית.

עם ההודעה הרשמית ש מסקנות בזמן אמת של Amazon SageMaker תומך כעת בהזרמת תגובה, כעת תוכל להזרים באופן רציף תגובות מסקנות בחזרה ללקוח בעת השימוש אמזון SageMaker מסקנות בזמן אמת עם הזרמת תגובה. פתרון זה יעזור לך לבנות חוויות אינטראקטיביות עבור יישומי AI גנרטיביים שונים כגון צ'טבוטים, עוזרים וירטואליים ומחוללי מוזיקה. פוסט זה מראה לכם כיצד לממש זמני תגובה מהירים יותר בצורה של Time to First Byte (TTFB) ולהפחית את ההשהיה הכוללת הנתפסת תוך הסקת דגמי Llama 2.

כדי ליישם את הפתרון, אנו משתמשים ב-SageMaker, שירות מנוהל במלואו כדי להכין נתונים ולבנות, לאמן ולפרוס מודלים של למידת מכונה (ML) לכל מקרה שימוש עם תשתית, כלים וזרימות עבודה מנוהלות במלואן. למידע נוסף על אפשרויות הפריסה השונות שמספקת SageMaker, עיין ב שאלות נפוצות בנושא אירוח דגמי אמזון SageMaker. בואו נבין כיצד נוכל לטפל בבעיות השהיה באמצעות הסקת מסקנות בזמן אמת עם הזרמת תגובה.

סקירת פתרונות

מכיוון שאנו רוצים להתייחס לעיכובים שהוזכרו לעיל הקשורים להסקת מסקנות בזמן אמת עם LLMs, בואו נבין תחילה כיצד נוכל להשתמש בתמיכה בהזרמת תגובה להסקת מסקנות בזמן אמת עבור Llama 2. עם זאת, כל LLM יכול לנצל את התמיכה בהזרמת תגובה עם אמת -הסקת זמן.

Lama 2 הוא אוסף של מודלים של טקסט מחולל ומכוונן מראש, בקנה מידה של 7 מיליארד עד 70 מיליארד פרמטרים. דגמי Llama 2 הם דגמים אוטורגרסיביים עם ארכיטקטורת מפענח בלבד. כשהם מסופקים עם הנחיה ופרמטרים להסקת מסקנות, דגמי Llama 2 מסוגלים ליצור תגובות טקסט. מודלים אלה יכולים לשמש לתרגום, סיכום, מענה על שאלות וצ'אט.

עבור פוסט זה, אנו פורסים את מודל Llama 2 Chat meta-llama/Llama-2-13b-chat-hf ב- SageMaker להסקת מסקנות בזמן אמת עם הזרמת תגובה.

כשמדובר בפריסת מודלים על נקודות קצה של SageMaker, אתה יכול לאכלס את המודלים באמצעות מיוחדים מיכל AWS Deep Learning תמונות (DLC) זמינות עבור ספריות קוד פתוח פופולריות. דגמי Llama 2 הם מודלים ליצירת טקסט; אתה יכול להשתמש ב- מיכלי מסקנות של Face LLM מחבקים ב- SageMaker מופעל על ידי Hugging Face מסקנות מדור טקסט (TGI) או AWS DLCs עבור מסקנות מודל גדולות (LMI).

בפוסט זה, אנו פורסים את מודל ה-Llama 2 13B Chat באמצעות DLCs ב- SageMaker Hosting להסקת מסקנות בזמן אמת המופעלות על ידי מופעי G5. מופעי G5 הם מופעים מבוססי GPU בעלי ביצועים גבוהים עבור יישומים עתירי גרפיקה והסקת ML. אתה יכול גם להשתמש בסוגי המופעים הנתמכים p4d, p3, g5 ו-g4dn עם שינויים מתאימים לפי תצורת המופע.

תנאים מוקדמים

כדי ליישם פתרון זה, אתה צריך את הדברים הבאים:

- חשבון AWS עם an AWS זהות וניהול גישה תפקיד (IAM) עם הרשאות לניהול משאבים שנוצרו כחלק מהפתרון.

- אם זו הפעם הראשונה שאתה עובד עם סטודיו SageMaker של אמזון, תחילה עליך ליצור א תחום SageMaker.

- חשבון חיבוק. הרשם עם האימייל שלך אם עדיין אין לך חשבון.

- לגישה חלקה של הדגמים הזמינים ב-Hugging Face, במיוחד דגמים מגודרים כגון Llama, למטרות כוונון והסקת מסקנות, עליך להיות בעל חשבון Hugging Face כדי לקבל אסימון גישת קריאה. לאחר שנרשמת לחשבון Hugging Face שלך, התחבר לבקר https://huggingface.co/settings/tokens כדי ליצור אסימון גישת קריאה.

- גישה ל-Llama 2, באמצעות אותו זיהוי אימייל שבו השתמשת כדי להירשם ל-Huging Face.

- דגמי Llama 2 הזמינים דרך Hugging Face הם דגמים מגודרים. השימוש במודל Llama כפוף לרישיון Meta. כדי להוריד את המשקולות והאסימון של הדגם, לבקש גישה ללאמה ולקבל את הרישיון שלהם.

- לאחר מתן גישה (בדרך כלל תוך מספר ימים), תקבל אישור בדוא"ל. עבור דוגמה זו, אנו משתמשים במודל

Llama-2-13b-chat-hf, אבל אתה אמור להיות מסוגל לגשת גם לגרסאות אחרות.

גישה 1: חיבוק פנים TGI

בחלק זה, אנו מראים לך כיצד לפרוס את meta-llama/Llama-2-13b-chat-hf דגם לנקודת קצה של SageMaker בזמן אמת עם הזרמת תגובה באמצעות Hugging Face TGI. הטבלה הבאה מתארת את המפרטים עבור פריסה זו.

| מִפרָט | ערך |

| מכולה | חיבוק פנים TGI |

| שם דגם | meta-llama/Llama-2-13b-chat-hf |

| מופע ML | ml.g5.12xlarge |

| הסקה | בזמן אמת עם הזרמת תגובה |

פרוס את הדגם

ראשית, אתה מאחזר את תמונת הבסיס עבור ה-LLM לפריסה. לאחר מכן אתה בונה את המודל על תמונת הבסיס. לבסוף, אתה פורס את המודל למופע ML עבור SageMaker Hosting להסקת מסקנות בזמן אמת.

בואו נראה כיצד להשיג את הפריסה באופן תוכניתי. למען הקיצור, רק הקוד שעוזר בשלבי הפריסה נדון בסעיף זה. קוד המקור המלא לפריסה זמין במחברת llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

אחזר את ה-DLC העדכני ביותר של Hugging Face LLM המופעל על ידי TGI באמצעות מובנה מראש DLC של SageMaker. אתה משתמש בתמונה זו כדי לפרוס את meta-llama/Llama-2-13b-chat-hf דגם ב- SageMaker. ראה את הקוד הבא:

הגדר את הסביבה עבור המודל עם פרמטרי התצורה המוגדרים כדלקמן:

חלף <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> עבור פרמטר התצורה HUGGING_FACE_HUB_TOKEN עם ערך האסימון שהושג מפרופיל החיבוק שלך כמפורט בסעיף התנאים המוקדמים של פוסט זה. בתצורה, אתה מגדיר את מספר ה-GPUs בשימוש לכל העתק של דגם כ-4 עבור SM_NUM_GPUS. אז אתה יכול לפרוס את meta-llama/Llama-2-13b-chat-hf דגם על מופע ml.g5.12xlarge שמגיע עם 4 GPUs.

עכשיו אתה יכול לבנות את המופע של HuggingFaceModel עם תצורת הסביבה שהוזכרה לעיל:

לבסוף, פרוס את המודל על ידי מתן ארגומנטים לשיטת הפריסה הזמינה במודל עם ערכי פרמטרים שונים כגון endpoint_name, initial_instance_count, ו instance_type:

בצע מסקנות

ה-Hugging Face TGI DLC מגיע עם היכולת להזרים תגובות ללא כל התאמות אישיות או שינויי קוד בדגם. אתה יכול להשתמש invoke_endpoint_with_response_stream אם אתה משתמש ב-Boto3 או InvokeEndpointWithResponseStream בעת תכנות עם SageMaker Python SDK.

השמיים InvokeEndpointWithResponseStream API של SageMaker מאפשר למפתחים להזרים תגובות בחזרה מדגמי SageMaker, מה שיכול לעזור לשפר את שביעות רצון הלקוחות על ידי הפחתת זמן ההשהיה הנתפס. זה חשוב במיוחד עבור יישומים שנבנו עם מודלים של AI גנרטיביים, שבהם עיבוד מיידי חשוב יותר מאשר לחכות לתגובה כולה.

עבור דוגמה זו, אנו משתמשים ב-Boto3 כדי להסיק מהמודל ולהשתמש בממשק ה-API של SageMaker invoke_endpoint_with_response_stream באופן הבא:

הוויכוח CustomAttributes מוגדר לערך accept_eula=false. השמיים accept_eula יש להגדיר את הפרמטר ל true כדי להשיג בהצלחה את התגובה מדגמי ה-Llama 2. לאחר הקריאה המוצלחת באמצעות invoke_endpoint_with_response_stream, השיטה תחזיר זרם תגובה של בתים.

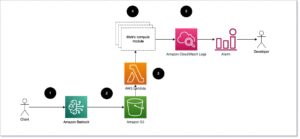

התרשים הבא ממחיש זרימת עבודה זו.

אתה צריך איטרטור שעובר בלולאה על זרם הבתים ומנתח אותם לטקסט קריא. ה LineIterator יישום ניתן למצוא ב llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. עכשיו אתה מוכן להכין את ההנחיה וההוראות להשתמש בהן כמטען תוך כדי הסקת המודל.

הכן הנחיה והנחיות

בשלב זה, אתה מכין את ההנחיה וההוראות עבור ה-LLM שלך. כדי להנחות את Llama 2, צריכה להיות לך תבנית ההנחיה הבאה:

אתה בונה את תבנית ההנחיה המוגדרת באופן תכנותי בשיטה build_llama2_prompt, שמתיישרת עם תבנית ההנחיה שהוזכרה לעיל. לאחר מכן אתה מגדיר את ההוראות לפי מקרה השימוש. במקרה זה, אנו מורים למודל ליצור דוא"ל עבור מסע פרסום שיווקי כפי שמכוסה ב- get_instructions שיטה. הקוד עבור שיטות אלה נמצא ב- llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb מחברת. בנו את ההוראה בשילוב המשימה שתתבצע כמפורט ב user_ask_1 באופן הבא:

אנו מעבירים את ההוראות לבניית ההנחיה לפי תבנית ההנחיה שנוצרה על ידי build_llama2_prompt.

אנו מועדון את פרמטרי ההסקה יחד עם הנחיה עם המפתח stream עם הערך True כדי ליצור מטען סופי. שלח את המטען אל get_realtime_response_stream, אשר ישמש להפעיל נקודת קצה עם הזרמת תגובה:

הטקסט שנוצר מה-LLM יוזרם לפלט כפי שמוצג בהנפשה הבאה.

גישה 2: LMI עם DJL Serving

בחלק זה, אנו מדגימים כיצד לפרוס את meta-llama/Llama-2-13b-chat-hf מודל לנקודת קצה של SageMaker בזמן אמת עם הזרמת תגובה באמצעות LMI עם DJL Serving. הטבלה הבאה מתארת את המפרטים עבור פריסה זו.

| מִפרָט | ערך |

| מכולה | תמונת מיכל LMI עם DJL Serving |

| שם דגם | meta-llama/Llama-2-13b-chat-hf |

| מופע ML | ml.g5.12xlarge |

| הסקה | בזמן אמת עם הזרמת תגובה |

תחילה אתה מוריד את הדגם ומאחסן אותו שירות אחסון פשוט של אמזון (אמזון S3). לאחר מכן אתה מציין את S3 URI המציין את קידומת S3 של הדגם ב- serving.properties קוֹבֶץ. לאחר מכן, אתה מאחזר את תמונת הבסיס עבור ה-LLM לפריסה. לאחר מכן אתה בונה את המודל על תמונת הבסיס. לבסוף, אתה פורס את המודל למופע ML עבור SageMaker Hosting להסקת מסקנות בזמן אמת.

הבה נבחן כיצד להשיג את שלבי הפריסה הנ"ל באופן תכנותי. למען הקיצור, רק הקוד שעוזר בשלבי הפריסה מפורט בסעיף זה. קוד המקור המלא עבור פריסה זו זמין במחברת llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

הורד את תמונת המצב של הדגם מ-Huging Face והעלה את חפצי הדגם ב-Amazon S3

עם התנאים המוקדמים שהוזכרו לעיל, הורד את הדגם במופע המחברת של SageMaker ולאחר מכן העלה אותו לדלי S3 לפריסה נוספת:

שימו לב שלמרות שאינכם מספקים אסימון גישה חוקי, הדגם יוריד. אבל כאשר אתה פורס מודל כזה, הגשת המודל לא תצליח. לכן, מומלץ להחליף <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> לטיעון token עם ערך האסימון שהושג מפרופיל החיבוק שלך כמפורט בדרישות המוקדמות. עבור פוסט זה, אנו מציינים את שם הדגם הרשמי עבור Llama 2 כפי שזוהה ב-Huging Face עם הערך meta-llama/Llama-2-13b-chat-hf. הדגם הלא דחוס יוורד אל local_model_path כתוצאה מהפעלת הקוד הנ"ל.

העלה את הקבצים לאמזון S3 והשיג את ה-URI, שישמש מאוחר יותר ב serving.properties.

אתה תארוז את meta-llama/Llama-2-13b-chat-hf דגם על תמונת מיכל LMI עם DJL Serving באמצעות התצורה שצוינה באמצעות serving.properties. לאחר מכן אתה פורס את המודל יחד עם חפצי מודל ארוזים על תמונת המכולה במופע SageMaker ML ml.g5.12xlarge. לאחר מכן אתה משתמש במופע ML זה עבור SageMaker Hosting להסקת מסקנות בזמן אמת.

הכן חפצי דגם להגשה של DJL

הכן את חפצי הדגם שלך על ידי יצירת א serving.properties קובץ תצורה:

אנו משתמשים בהגדרות הבאות בקובץ התצורה הזה:

- מנוע - זה מציין את מנוע זמן הריצה לשימוש DJL. הערכים האפשריים כוללים

Python,DeepSpeed,FasterTransformer, וMPI. במקרה זה, הגדרנו אותו לMPI. מקבילות והסקת מודלים (MPI) מקלה על חלוקת המודל על פני כל ה-GPUs הזמינים ולכן מאיץ את ההסקה. - option.entryPoint – אפשרות זו מציינת באיזה מטפל המוצע על ידי DJL Serving תרצה להשתמש. הערכים האפשריים הם

djl_python.huggingface,djl_python.deepspeed, וdjl_python.stable-diffusion. אנו משתמשיםdjl_python.huggingfaceעבור חיבוק פנים להאיץ. - option.tensor_parallel_degree – אפשרות זו מציינת את מספר המחיצות המקבילות טנזור המבוצעות בדגם. אתה יכול להגדיר את מספר מכשירי ה-GPU שעבורם Accelerate צריך לחלק את הדגם. פרמטר זה שולט גם במספר העובדים לכל דגם שיופעל כאשר הפעלת DJL שרת. לדוגמה, אם יש לנו מכונת 4 GPU ואנחנו יוצרים ארבע מחיצות, אז יהיה לנו עובד אחד לכל דגם שישרת את הבקשות.

- option.low_cpu_mem_usage - זה מפחית את השימוש בזיכרון המעבד בעת טעינת דגמים. אנו ממליצים להגדיר זאת ל

TRUE. - option.rolling_batch - זה מאפשר אצווה ברמת איטרציה באמצעות אחת מהאסטרטגיות הנתמכות. הערכים כוללים

auto,scheduler, וlmi-dist. אנו משתמשיםlmi-distלהפעלת אצווה רציפה עבור Llama 2. - option.max_rolling_batch_size - זה מגביל את מספר הבקשות במקביל באצווה הרציפה. ברירת המחדל של הערך הוא 32.

- option.model_id - כדאי להחליף

{{model_id}}עם מזהה הדגם של דגם מאומן מראש המתארח בתוך a מאגר דגמים ב-Huging Face או נתיב S3 לחפצי הדגם.

אפשרויות תצורה נוספות ניתן למצוא ב תצורות והגדרות.

מכיוון ש-DJL Serving מצפה שחפצי הדגם יהיו ארוזים ומעוצבים בקובץ .tar, הפעל את קטע הקוד הבא כדי לדחוס ולהעלות את קובץ ה-.tar לאמזון S3:

אחזר את תמונת מיכל ה-LMI העדכנית ביותר עם DJL Serving

לאחר מכן, אתה משתמש ב-DLCs הזמינים עם SageMaker עבור LMI כדי לפרוס את המודל. אחזר את URI התמונה של SageMaker עבור djl-deepspeed מיכל באופן תוכנתי באמצעות הקוד הבא:

אתה יכול להשתמש בתמונה שהוזכרה לעיל כדי לפרוס את meta-llama/Llama-2-13b-chat-hf דגם ב- SageMaker. כעת אתה יכול להמשיך ליצירת המודל.

צור את הדגם

אתה יכול ליצור את הדגם שהמיכל שלו נבנה באמצעות ה inference_image_uri וקוד ההגשה של הדגם שנמצא ב-S3 URI המצוין על ידי s3_code_artifact:

כעת תוכל ליצור את תצורת המודל עם כל הפרטים עבור תצורת נקודת הקצה.

צור את תצורת המודל

השתמש בקוד הבא כדי ליצור תצורת מודל עבור המודל המזוהה על ידי model_name:

תצורת המודל מוגדרת עבור ProductionVariants פרמטר InstanceType עבור מופע ML ml.g5.12xlarge. אתה גם מספק את ModelName באמצעות אותו שם שבו השתמשת כדי ליצור את המודל בשלב הקודם, ובכך ליצור קשר בין המודל לתצורת נקודת הקצה.

כעת לאחר שהגדרת את המודל ואת תצורת המודל, תוכל ליצור את נקודת הקצה של SageMaker.

צור את נקודת הקצה של SageMaker

צור את נקודת הקצה לפריסת המודל באמצעות קטע הקוד הבא:

אתה יכול לראות את התקדמות הפריסה באמצעות קטע הקוד הבא:

לאחר שהפריסה תצליח, סטטוס נקודת הקצה יהיה InService. כעת, כשנקודת הקצה מוכנה, בואו נבצע הסקה באמצעות הזרמת תגובה.

מסקנות בזמן אמת עם הזרמת תגובה

כפי שסיקרנו בגישה הקודמת של Hugging Face TGI, אתה יכול להשתמש באותה שיטה get_realtime_response_stream להפעיל הזרמת תגובה מנקודת הקצה של SageMaker. הקוד להסקת מסקנות באמצעות גישת LMI נמצא ב- llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb מחברת. ה LineIterator היישום נמצא ב llama-2-lmi/utils/LineIterator.py. שים לב כי LineIterator עבור מודל ה-Llama 2 Chat שנפרס על מיכל ה-LMI שונה מה- LineIterator מוזכר בסעיף Hugging Face TGI. ה LineIterator לולאות מעל זרם הבתים ממודלים של Llama 2 צ'אט המוסקים עם מיכל LMI עם djl-deepspeed גרסה 0.25.0. פונקציית העזר הבאה תנתח את זרם התגובה שהתקבל מבקשת ההסקה שנעשתה באמצעות invoke_endpoint_with_response_stream API:

השיטה הקודמת מדפיסה את זרם הנתונים הנקרא על ידי LineIterator בפורמט קריא אנושי.

הבה נחקור כיצד להכין את ההנחיה וההוראות להשתמש בהן כמטען תוך הסקת המודל.

מכיוון שאתה מסיק את אותו דגם גם ב-Hugging Face TGI וגם ב-LMI, תהליך הכנת ההנחיה וההוראות זהה. לכן, אתה יכול להשתמש בשיטות get_instructions ו build_llama2_prompt להסקת מסקנות.

השמיים get_instructions השיטה מחזירה את ההוראות. בנו את ההוראות בשילוב עם המשימה שתתבצע כמפורט ב user_ask_2 באופן הבא:

העבר את ההוראות לבניית ההנחיה לפי תבנית ההנחיה שנוצרה על ידי build_llama2_prompt:

אנו מועדון את פרמטרי ההסקה יחד עם ההנחיה ליצור מטען סופי. ואז אתה שולח את המטען אל get_realtime_response_stream, המשמש להפעלת נקודת קצה עם הזרמת תגובה:

הטקסט שנוצר מה-LLM יוזרם לפלט כפי שמוצג בהנפשה הבאה.

לנקות את

כדי למנוע חיובים מיותרים, השתמש ב- קונסולת הניהול של AWS למחוק את נקודות הקצה והמשאבים המשויכים אליהן שנוצרו תוך כדי הפעלת הגישות המוזכרות בפוסט. עבור שתי גישות הפריסה, בצע את שגרת הניקוי הבאה:

חלף <SageMaker_Real-time_Endpoint_Name> עבור משתנה endpoint_name עם נקודת הסיום בפועל.

עבור הגישה השנייה, אחסנו את חפצי המודל והקוד ב-Amazon S3. אתה יכול לנקות את דלי S3 באמצעות הקוד הבא:

סיכום

בפוסט זה, דנו כיצד מספר משתנה של אסימוני תגובה או קבוצה שונה של פרמטרים להסקת מסקנות יכולים להשפיע על ההשהיות הקשורות ל-LLMs. הראינו כיצד לטפל בבעיה בעזרת הזרמת תגובה. לאחר מכן זיהינו שתי גישות לפריסה והסקת מודלים של Llama 2 Chat באמצעות AWS DLCs - LMI ו- Hugging Face TGI.

כעת עליך להבין את החשיבות של תגובת סטרימינג וכיצד היא יכולה להפחית את השהיה הנתפסת. תגובת סטרימינג יכולה לשפר את חווית המשתמש, שאחרת תגרום לך לחכות עד שה-LLM יבנה את כל התגובה. בנוסף, פריסת דגמי Llama 2 Chat עם הזרמת תגובה משפרת את חווית המשתמש ומשמחת את הלקוחות שלך.

אתה יכול לעיין ב-aws-דגימות הרשמיות amazon-sagemaker-llama2-response-streaming-recipes המכסה פריסה עבור גרסאות אחרות של דגם Llama 2.

הפניות

על הכותבים

Pavan Kumar Rao Navule הוא אדריכל פתרונות בשירותי האינטרנט של אמזון. הוא עובד עם ISVs בהודו כדי לעזור להם לחדש ב-AWS. הוא מחבר שפורסם עבור הספר "להתחיל עם תכנות V." הוא למד לתואר מנהלי M.Tech במדעי נתונים מהמכון ההודי לטכנולוגיה (IIT), היידראבאד. הוא גם למד לתואר שני במנהל עסקים בהתמחות ב-IT מבית הספר ההודי לניהול עסקים ומינהל, ובעל תואר B.Tech בהנדסת אלקטרוניקה ותקשורת ממכון Vaagdevi לטכנולוגיה ומדע. Pavan הוא אדריכל AWS Certified Solutions Architect ומחזיק בהסמכות נוספות כגון AWS Certified Machine Learning Specialty, Microsoft Certified Professional (MCP) ומומחה טכנולוגיה מוסמך של מיקרוסופט (MCTS). הוא גם חובב קוד פתוח. בזמנו הפנוי, הוא אוהב להקשיב לקולות הקסומים הגדולים של סיה וריהאנה.

Pavan Kumar Rao Navule הוא אדריכל פתרונות בשירותי האינטרנט של אמזון. הוא עובד עם ISVs בהודו כדי לעזור להם לחדש ב-AWS. הוא מחבר שפורסם עבור הספר "להתחיל עם תכנות V." הוא למד לתואר מנהלי M.Tech במדעי נתונים מהמכון ההודי לטכנולוגיה (IIT), היידראבאד. הוא גם למד לתואר שני במנהל עסקים בהתמחות ב-IT מבית הספר ההודי לניהול עסקים ומינהל, ובעל תואר B.Tech בהנדסת אלקטרוניקה ותקשורת ממכון Vaagdevi לטכנולוגיה ומדע. Pavan הוא אדריכל AWS Certified Solutions Architect ומחזיק בהסמכות נוספות כגון AWS Certified Machine Learning Specialty, Microsoft Certified Professional (MCP) ומומחה טכנולוגיה מוסמך של מיקרוסופט (MCTS). הוא גם חובב קוד פתוח. בזמנו הפנוי, הוא אוהב להקשיב לקולות הקסומים הגדולים של סיה וריהאנה.

שונאת סודהנשו הוא מומחה ראשי בבינה מלאכותית/ML עם AWS ועובד עם לקוחות כדי לייעץ להם לגבי ה-MLOps ומסע הבינה המלאכותית שלהם. בתפקידו הקודם לפני אמזון, הוא הגה, יצר והוביל צוותים לבניית פלטפורמות AI ו-gamification מבוססות קוד פתוח מבוססות קוד פתוח, ומסחר אותה בהצלחה עם למעלה מ-100 לקוחות. סודהאנשו ייאמר לזכותו כמה פטנטים, כתב שני ספרים וכמה מאמרים ובלוגים, והציג את נקודות המבט שלו בפורומים טכניים שונים. הוא היה מוביל מחשבה ונואם, והוא נמצא בתעשייה כמעט 25 שנה. הוא עבד עם לקוחות Fortune 1000 ברחבי העולם ולאחרונה עם לקוחות מקוריים דיגיטליים בהודו.

שונאת סודהנשו הוא מומחה ראשי בבינה מלאכותית/ML עם AWS ועובד עם לקוחות כדי לייעץ להם לגבי ה-MLOps ומסע הבינה המלאכותית שלהם. בתפקידו הקודם לפני אמזון, הוא הגה, יצר והוביל צוותים לבניית פלטפורמות AI ו-gamification מבוססות קוד פתוח מבוססות קוד פתוח, ומסחר אותה בהצלחה עם למעלה מ-100 לקוחות. סודהאנשו ייאמר לזכותו כמה פטנטים, כתב שני ספרים וכמה מאמרים ובלוגים, והציג את נקודות המבט שלו בפורומים טכניים שונים. הוא היה מוביל מחשבה ונואם, והוא נמצא בתעשייה כמעט 25 שנה. הוא עבד עם לקוחות Fortune 1000 ברחבי העולם ולאחרונה עם לקוחות מקוריים דיגיטליים בהודו.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- :יש ל

- :הוא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1st

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- יכולת

- יכול

- אודות

- להאיץ

- מאיץ

- מאיץ

- לְקַבֵּל

- גישה

- חֶשְׁבּוֹן

- להשיג

- לרוחב

- פעולה

- ממשי

- בנוסף

- כתובת

- מנהל

- לְאַמֵץ

- אימוץ

- יתרון

- לייעץ

- להשפיע על

- לאחר

- AI

- דגמי AI

- AI / ML

- ירייה

- מיישר

- תעשיות

- מאפשר

- מאפשר

- לאורך

- כְּבָר

- גם

- אמזון בעברית

- אמזון SageMaker

- אמזון שירותי אינטרנט

- an

- ו

- הנפשה

- הודיע

- הַכרָזָה

- כל

- API

- יישומים

- גישה

- גישות

- מתאים

- אדריכלי

- ארכיטקטורה

- ARE

- טענה

- טיעונים

- AS

- עוזרים

- המשויך

- At

- מחבר

- זמין

- לְהִמָנַע

- AWS

- בחזרה

- בסיס

- אצווה

- BE

- כי

- היה

- לפני

- בֵּין

- מעבר

- B

- מיליארדים

- BIN

- בלוגים

- גוּף

- ספר

- ספרים

- שניהם

- לִבנוֹת

- בונה

- נבנה

- עסקים

- אבל

- by

- שיחה

- מבצע

- CAN

- מסוגל

- מקרה

- אישורים

- מוסמך

- שינויים

- חיובים

- צ'אט

- chatbots

- לְנַקוֹת

- לקוחות

- לקוחות

- מועדון

- קוד

- אוסף

- COM

- משולב

- מגיע

- תקשורת

- במקביל

- תְצוּרָה

- אישור

- מכולה

- מכולות

- רציף

- ברציפות

- בקרות

- יכול

- זוג

- קופון

- מכוסה

- מכסה

- לִיצוֹר

- נוצר

- יוצר

- יוצרים

- אשראי

- לקוח

- שביעות רצון של לקוח

- לקוחות

- נתונים

- מדע נתונים

- ימים

- עמוק

- למידה עמוקה

- מחדל

- לְהַגדִיר

- מוגדר

- נדחה

- להפגין

- לפרוס

- פרס

- פריסה

- פריסה

- מְפוֹרָט

- פרטים

- מפתחים

- התקנים

- אחר

- דיגיטלי

- נָדוֹן

- לא

- להורדה

- בְּמַהֲלָך

- מוקדם יותר

- או

- מכשירי חשמל

- אמייל

- מאפשר

- נקודת קצה

- מנוע

- הנדסה

- נלהב

- שלם

- סביבה

- במיוחד

- מקימים

- אֲפִילוּ

- דוגמה

- מנהלים

- מצפה

- מצפה

- ניסיון

- חוויות

- לחקור

- פָּנִים

- מקל

- שקר

- מהר יותר

- שלח

- קבצים

- סופי

- בסופו של דבר

- ראשון

- firsttime

- הבא

- כדלקמן

- בעד

- טופס

- פוּרמָט

- הון עתק

- פורומים

- מצא

- קרן

- ארבע

- חופשי

- החל מ-

- מלא

- לגמרי

- פונקציה

- נוסף

- gamification

- מגודרת

- ליצור

- נוצר

- יצירת

- דור

- גנרטטיבית

- AI Generative

- גנרטורים

- לקבל

- gif

- כדור הארץ

- Go

- נשלט

- GPU

- GPUs

- כמובן מאליו

- גדול

- שמח

- לשנוא

- יש

- he

- לעזור

- עוזר

- ביצועים גבוהים

- גבוה יותר

- שֶׁלוֹ

- מחזיק

- אירח

- אירוח

- איך

- איך

- אולם

- HTML

- http

- HTTPS

- חיבוק פנים

- קריא אדם

- ID

- מזוהה

- זהות

- if

- מדגים

- תמונה

- תמונות

- מיידי

- ליישם

- הפעלה

- לייבא

- חשיבות

- חשוב

- לשפר

- משפר

- in

- לכלול

- כולל

- הודו

- הוֹדִי

- הצביע

- תעשייה

- מידע

- תשתית

- לחדש

- קלט

- תשומות

- בתוך

- למשל

- במקום

- מכון

- הוראות

- אינטראקטיבי

- אינטרנט

- בעיות

- IT

- שֶׁלָה

- מסע

- ג'סון

- מפתח

- קומאר

- שפה

- גָדוֹל

- חֶבִיוֹן

- בעיות חביון

- מאוחר יותר

- האחרון

- לשגר

- עוֹפֶרֶת

- מנהיג

- למידה

- הוביל

- אורך

- ספריות

- רישיון

- כמו

- גבולות

- קו

- להקשיב

- לאמה

- LLM

- טוען

- ממוקם

- אוהב

- מכונה

- למידת מכונה

- עשוי

- לעשות

- עושה

- לנהל

- הצליח

- ניהול

- שיווק

- מקסימום

- מאי..

- MCP

- זכרון

- מוּזְכָּר

- meta

- שיטה

- שיטות

- מיקרוסופט

- מיליונים

- ML

- MLOps

- מודל

- מודלים

- חודשים

- יותר

- רוב

- כלי נגינה

- צריך

- שם

- שם

- יליד

- כמעט

- צורך

- צרכי

- חדש

- הבא

- הערות

- מחברה

- עַכשָׁיו

- מספר

- אובייקטים

- להתבונן

- להשיג

- מושג

- of

- מוצע

- רשמי

- לעתים קרובות

- on

- ONE

- רק

- לפתוח

- קוד פתוח

- אפשרות

- אפשרויות

- or

- אחר

- אַחֶרֶת

- קווי מתאר

- תפוקה

- יותר

- מקיף

- ארוז

- אריזה

- ניירות

- מקביל

- פרמטר

- פרמטרים

- חלק

- לעבור

- פטנטים

- נתיב

- עבור

- נתפס

- לְבַצֵעַ

- ביצעתי

- הרשאות

- פלטפורמות

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- נקודות

- פופולרי

- אפשרי

- הודעה

- מופעל

- קודם

- להכין

- העריכה

- תנאים מוקדמים

- מוצג

- קודם

- מנהל

- הדפסים

- בעיה

- להמשיך

- תהליך

- מעובד

- תהליך

- המוצר

- השקת מוצר

- מקצועי

- פּרוֹפִיל

- תכנות

- התקדמות

- נכסים

- לספק

- ובלבד

- מספק

- מתן

- לאור

- למטרות

- פיתון

- פיטורך

- שאלה

- טִוּוּחַ

- מהיר

- במקום

- חומר עיוני

- מוכן

- ממשי

- זמן אמת

- להבין

- לקבל

- קיבלו

- לאחרונה

- להמליץ

- מוּמלָץ

- להפחית

- מפחית

- הפחתה

- להתייחס

- יחס

- להחליף

- תגובה

- מאגר

- לבקש

- בקשות

- משאבים

- להגיב

- תגובה

- תגובות

- תוצאה

- לַחֲזוֹר

- החזרות

- תפקיד

- שגרה

- הפעלה

- ריצה

- פועל

- זמן ריצה

- בעל חכמים

- אותו

- שביעות רצון

- סולם

- בית ספר

- מדע

- Sdk

- בצורה חלקה

- שְׁנִיָה

- סעיף

- לִרְאוֹת

- לשלוח

- שולח

- לשרת

- שרות

- שירותים

- הגשה

- סט

- הגדרות

- כמה

- קצר

- צריך

- לְהַצִיג

- הראה

- הראה

- הופעות

- סִימָן

- פָּשׁוּט

- תמונת בזק

- קטע

- פִּתָרוֹן

- פתרונות

- בקרוב

- מָקוֹר

- קוד מקור

- רַמקוֹל

- מומחה

- מיוחד

- התמחות

- מפרטים

- מפורט

- החל

- מצב

- שלב

- צעדים

- עצור

- אחסון

- חנות

- מאוחסן

- אסטרטגיות

- זרם

- מוזרם

- נהירה

- שירות זרימה

- להצליח

- מוצלח

- בהצלחה

- כזה

- תמיכה

- נתמך

- תומך

- שולחן

- לקחת

- המשימות

- צוותי

- טק

- טכני

- טכנולוגיה

- תבנית

- טֶקסט

- מֵאֲשֶׁר

- זֶה

- השמיים

- שֶׁלָהֶם

- אותם

- אז

- שם.

- בכך

- לכן

- אלה

- הֵם

- זֶה

- אם כי?

- מחשבה

- תפוקה

- זמן

- פִּי

- ל

- אסימון

- מטבעות

- כלים

- רכבת

- תרגום

- נָכוֹן

- פנייה

- שתיים

- סוג

- סוגים

- בדרך כלל

- להבין

- מְיוּתָר

- עד

- נוֹהָג

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמש

- חוויית משתמש

- באמצעות

- תקף

- ערך

- ערכים

- משתנה

- שונים

- משתנה

- Vast

- גרסה

- באמצעות

- לצפיה

- וירטואלי

- לְבַקֵר

- VOICES

- לחכות

- הַמתָנָה

- רוצה

- we

- אינטרנט

- שירותי אינטרנט

- טוֹב

- היו

- מתי

- אשר

- בזמן

- כל

- של מי

- יצטרך

- עם

- בתוך

- לְלֹא

- עבד

- עובד

- עובדים

- זרימת עבודה

- זרימות עבודה

- עובד

- עובד

- היה

- לכתוב

- כתוב

- שנים

- אתה

- זפירנט