- 2014 年 6 月 30 日

- ヴァシリス・ヴリニオティス

- 。 コメントはありません

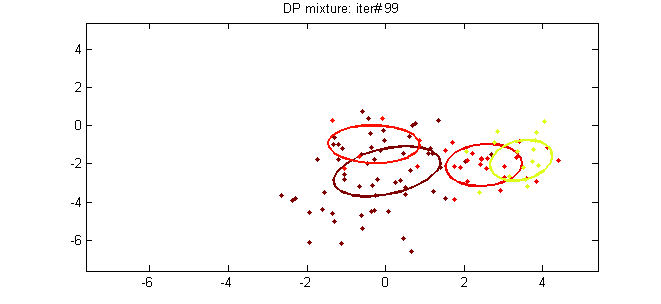

この記事は、チュートリアルのXNUMX番目の部分です。 DPMMによるクラスタリング。 以前の投稿では、メソッドの理論的背景を詳細に取り上げ、その数学的表現とその構築方法について説明しました。 この投稿では、ガウスデータのクラスター化に使用できるディリクレ多変量正規混合モデルとドキュメントのクラスター化に使用されるディリクレ多項混合モデルのXNUMXつのモデルDPMMを導入することで、理論と実践をリンクします。

更新:Datumbox Machine Learning Frameworkがオープンソースになり、無料で ダウンロード。 パッケージcom.datumbox.framework.machinelearning.clusteringをチェックして、Javaでのディリクレプロセス混合モデルの実装を確認してください。

1.ディリクレ多変量正規混合モデル

ここで検討する最初のディリクレプロセス混合モデルは、連続データセットでクラスタリングを実行するために使用できるディリクレ多変量正規混合モデルです。 混合モデルは次のように定義されます。

![]()

![]()

![]()

方程式1:ディリクレ多変量正規混合モデル

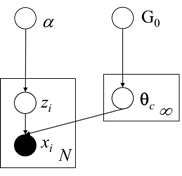

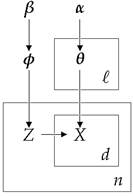

上記のように、特定のモデルは、生成分布が多項ガウス分布であると想定し、クラスター割り当ての前と同じように中華レストランプロセスを使用します。 さらに、基本分布G0 ノーマルインバースウィシャート事前分布を使用します。 前共役 平均と共分散行列が不明な多変量正規分布の分析。 以下に、混合モデルのグラフィカルモデルを示します。

図1:ディリクレ多変量正規混合モデルのグラフィカルモデル

前に説明したように、クラスター割り当てを推定できるようにするために、 折りたたまれたギブスサンプリング を選択する必要があります 適切な共役事前分布。 さらに、指定された事後パラメーターを更新する必要があります 事前および証拠。 以下を参照してください MAPの見積もり いずれかのクラスターのパラメーター:

![]()

![]()

![]()

![]()

![]()

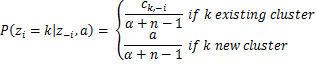

方程式2:クラスターパラメーターのMAP推定

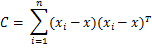

ここで、dはデータの次元数であり、 ![]() サンプル平均です。 さらに、μなどのNormal-Inverse-Wishartのいくつかのハイパーパラメーターがあります。0 これは最初の平均です、κ0 は平滑化パラメーターνとして機能する平均部分です。0 次元数に設定された自由度であり、Ψ0 定数で乗算されたdxd単位行列に設定されるペアワイズ偏差積です。 これからは、Gの以前のすべてのハイパーパラメーター0 表記を簡単にするために、λで表されます。 最後に、上記のすべてを用意することで、Collapsed Gibbs Samplerで必要とされる確率を推定できます。 クラスターの割り当て、データセット、およびDPとGのすべてのハイパーパラメーターαおよびλが与えられた場合、観測値iがクラスターkに属する確率0 以下に示します:

サンプル平均です。 さらに、μなどのNormal-Inverse-Wishartのいくつかのハイパーパラメーターがあります。0 これは最初の平均です、κ0 は平滑化パラメーターνとして機能する平均部分です。0 次元数に設定された自由度であり、Ψ0 定数で乗算されたdxd単位行列に設定されるペアワイズ偏差積です。 これからは、Gの以前のすべてのハイパーパラメーター0 表記を簡単にするために、λで表されます。 最後に、上記のすべてを用意することで、Collapsed Gibbs Samplerで必要とされる確率を推定できます。 クラスターの割り当て、データセット、およびDPとGのすべてのハイパーパラメーターαおよびλが与えられた場合、観測値iがクラスターkに属する確率0 以下に示します:

![]()

![]()

方程式3:Gibbs SamplerがMNMMに使用する確率

ここでzi 観測値xのクラスター割り当てi、X1:n 完全なデータセット、z-i iのXNUMXつを含まないクラスター割り当てのセットです。th 観察、x-i iを除く完全なデータセットですth 観察、ck、-私 iを除いたクラスターkに割り当てられた観測の総数th 観察中 ![]() および

および ![]() iを除外するクラスターkの平均および共分散行列th 観察。

iを除外するクラスターkの平均および共分散行列th 観察。

2.ディリクレ多項式混合モデル

Dirichlet-Multinomial Mixture Modelは、ドキュメントのクラスター分析を実行するために使用されます。 特定のモデルは、ドキュメントのトピック/カテゴリ、各トピック内の単語の確率、クラスターの割り当て、ドキュメントの生成分布をモデル化するため、少し複雑な階層になっています。 その目的は、教師なし学習を実行し、ドキュメントをグループに割り当てることによってドキュメントのリストをクラスター化することです。 混合モデルは次のように定義されます。

![]()

![]()

![]()

![]()

方程式4:ディリクレ多項式混合モデル

φがトピック確率zをモデル化する場合i トピックセレクター、θk 各クラスターの単語確率であり、x私、j ドキュメントの単語を表します。 この手法では、 Bag-of-Wordsフレームワーク これは、文法と単語の順序を無視して、ドキュメントを単語の順序のないコレクションとして表します。 この簡略化された表現は、自然言語処理と情報検索で一般的に使用されます。 以下に、混合モデルのグラフィカルモデルを示します。

図2:ディリクレ多項式混合モデルのグラフィカルモデル

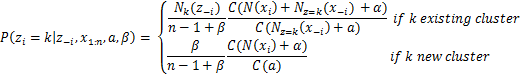

特定のモデルは 多項離散分布 事前分布の生成分布とディリクレ分布。 ℓはアクティブなクラスターのサイズ、nはドキュメントの総数、βはアプリオリに予想されるクラスターの数を制御し、αは各クラスターに割り当てられた単語の数を制御します。 によって必要とされる確率を推定するには 折りたたまれたギブスサンプラー 私たちは 次の方程式:

![]()

方程式5:Gibbs SamplerがDMMMに使用する確率

ここで、Γはガンマ関数、zi ドキュメントxのクラスター割り当てです。i、X1:n 完全なデータセット、z-i iのXNUMXつを含まないクラスター割り当てのセットです。th ドキュメント、x-i iを除く完全なデータセットですth ドキュメント、Nk(z-i)は、iを除くクラスターkに割り当てられた観測値の数ですth ドキュメント、Nz=k(x-i)は、iを除くクラスターkに割り当てられたすべてのドキュメントの各単語のカウントの合計を持つベクトルですth ドキュメントとN(xi)は、ドキュメントxの各単語のカウントを含むスパースベクトルです。i。 最後に、上記のように、折りたたまれたギブスサンプラーと中華レストランプロセスを使用して、θjk トピックkの単語jの確率を格納する変数を統合できます。